Je comprends. OpenClaw fait fureur et l'idée d'un assistant IA disponible 24h/24 et 7j/7, capable d'effectuer des tâches sur votre ordinateur, vous intrigue. Mais quand on voit des gens parler de centaines de dollars dépensés en crédits API, l'enthousiasme se transforme soudain en angoisse quant aux coûts.

Voici le point essentiel : OpenClaw est sous licence MIT et entièrement open source. D'après le dépôt GitHub officiel openclaw/openclaw, qui compte plus de 100 000 étoiles, cet assistant IA est compatible avec “ n'importe quel système d'exploitation, n'importe quelle plateforme ”. Et oui, son utilisation est entièrement gratuite.

La vraie question n'est pas de savoir si OpenClaw peut être utilisé gratuitement, mais plutôt comment le configurer pour éviter les factures d'API exorbitantes dont tout le monde se plaint dans les discussions de la communauté.

Comprendre le problème des coûts

Avant de nous pencher sur les solutions, voyons pourquoi les gens dépensent de l'argent. OpenClaw est un agent d'IA qui se connecte aux plateformes de messagerie comme Slack, WhatsApp ou Telegram et exécute des tâches pour vous. Mais voilà le hic : il lui faut un modèle de langage pour fonctionner.

La plupart des tutoriels vous orientent vers Claude, GPT-4 ou d'autres API commerciales. Et ces solutions ne sont pas bon marché. Un utilisateur, lors d'une discussion sur GitHub en février 2026, a demandé quel était le “ meilleur LLM abordable actuellement ”, soulignant ainsi l'importance de cette question pour la communauté OpenClaw.

Mais il existe trois voies légitimes pour parvenir à un fonctionnement sans frais :

- Exécuter des modèles entièrement locaux sur votre propre matériel

- Utilisation des ressources GPU gratuites du cloud

- Tirer parti stratégiquement des niveaux d'API gratuits

Analysons chaque approche.

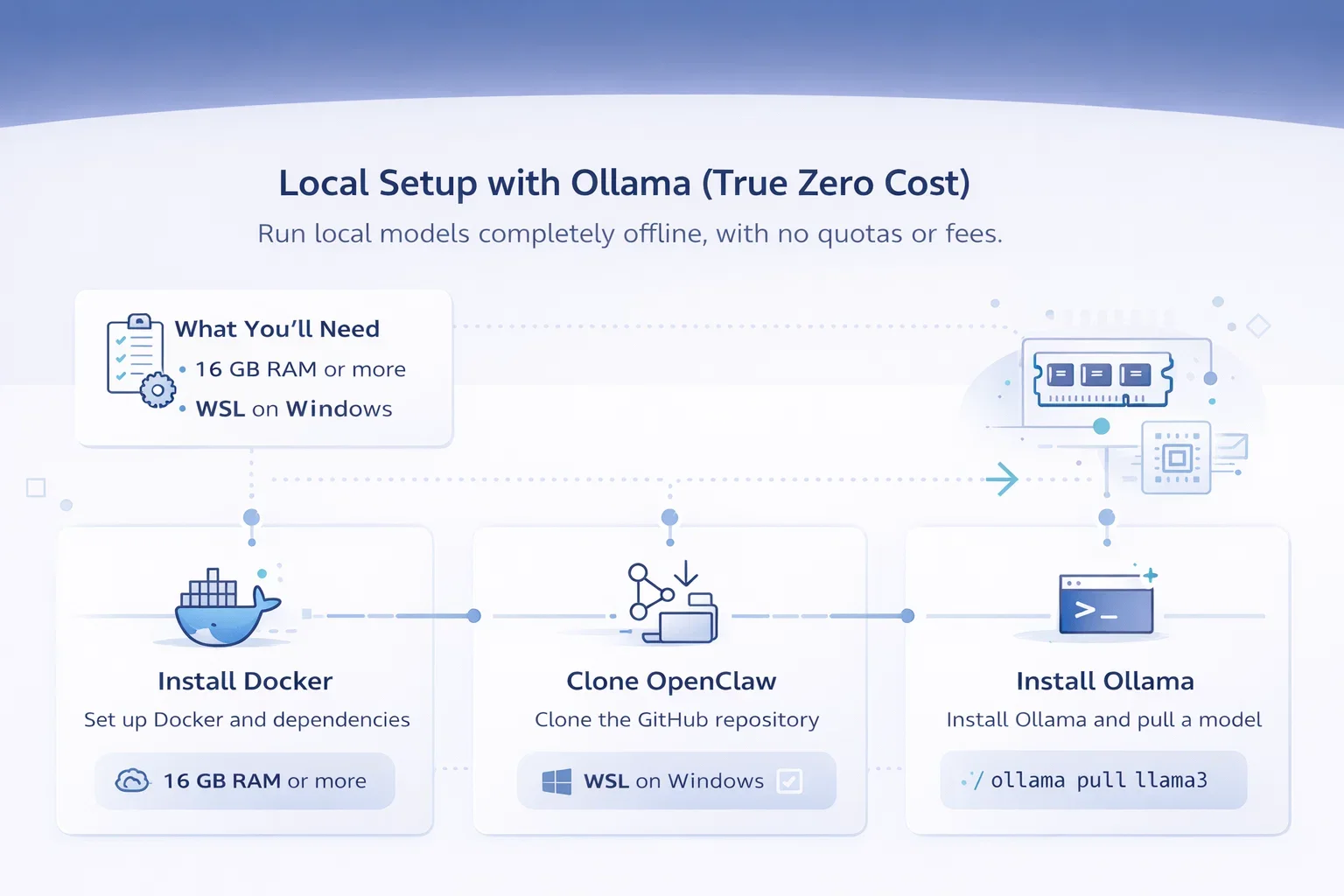

Méthode 1 : Installation locale avec Ollama (Coût zéro)

C'est mon choix préféré car, une fois configuré, il vous offre une totale indépendance. Pas de quotas, pas de limites de débit, pas de factures surprises. D'après le guide Digitalknk “ Gérer OpenClaw sans se ruiner, sans dépasser ses quotas ni perdre la tête ”, qui a reçu 92 étoiles sur GitHub, les modèles locaux constituent la solution la plus durable à long terme.

Ce dont vous aurez besoin

Soyons francs : pas besoin d’une machine de jeu avec plusieurs cartes graphiques. Un ordinateur correct avec 16 Go de RAM suffit amplement pour faire tourner les modèles plus modestes. Un utilisateur de Reddit a mentionné avoir réussi à faire fonctionner OpenClaw sur un Intel NUC équipé de 16 Go de RAM, malgré quelques problèmes de configuration initiaux.

Pour les utilisateurs Windows, vous aurez besoin de WSL (Windows Subsystem for Linux). Les utilisateurs Mac et Linux peuvent ignorer cette étape.

Installation étape par étape

Installer Docker et ses dépendances

OpenClaw s'exécute dans des conteneurs Docker pour une compatibilité multiplateforme optimale. Sous Windows, installez Docker Desktop et activez l'intégration WSL2. L'application Flutter de Mithun_Gowda_B vous permet d'exécuter la passerelle IA OpenClaw directement sur votre téléphone, sans accès root et avec une configuration en un clic.

Clone OpenClaw

Rendez-vous sur le dépôt GitHub officiel openclaw/openclaw et clonez-le sur votre machine locale. L'installation est simple, mais comme l'a souligné un utilisateur de Reddit : “ Ce n'est pas si facile ! Sur un VPS, le problème vient de localhost et il faut lier l'adresse IP. ”

Gardez cela à l'esprit si vous prévoyez un accès à distance.

Installer Ollama

Ollama est votre gestionnaire de modèles local. Téléchargez-le depuis ollama.ai et installez-le en fonction de votre système d'exploitation. Ensuite, téléchargez un modèle compatible avec votre matériel :

- Pour 8 Go de RAM : essayez llama3.2 ou mistral

- Pour 16 Go de RAM : la Llama3 8B fonctionne parfaitement.

- Pour 32 Go de RAM ou plus : vous pouvez exécuter llama3 70B ou mixtral

La commande ressemble à ceci : ollama tire lama3

Configurer la connexion OpenClaw

Vous devez maintenant configurer OpenClaw pour qu'il utilise votre instance Ollama locale au lieu d'une API cloud. Modifiez votre fichier de configuration OpenClaw pour utiliser le point de terminaison local (généralement http://localhost:11434 pour Ollama).

C'est là que la plupart des débutants trébuchent. Comme indiqué dans une discussion sur GitHub, la configuration correcte de la connexion à localhost est essentielle si vous exécutez le programme sur un VPS ou si vous souhaitez un accès distant.

attentes en matière de performance

Certes, les modèles locaux n'égalent pas la capacité de raisonnement de GPT-4 ni les compétences de programmation de Claude. Mais ils sont étonnamment performants pour les tâches quotidiennes. Et surtout, vous pouvez les exécuter 24 h/24 et 7 j/7 sans vous soucier du nombre de jetons ni des limites de débit.

Un membre de la communauté a partagé : “ J'utilise une configuration qui me coûte littéralement $0/mois, reste opérationnelle 24h/24 et 7j/7 et dispose de jetons pratiquement illimités. ”

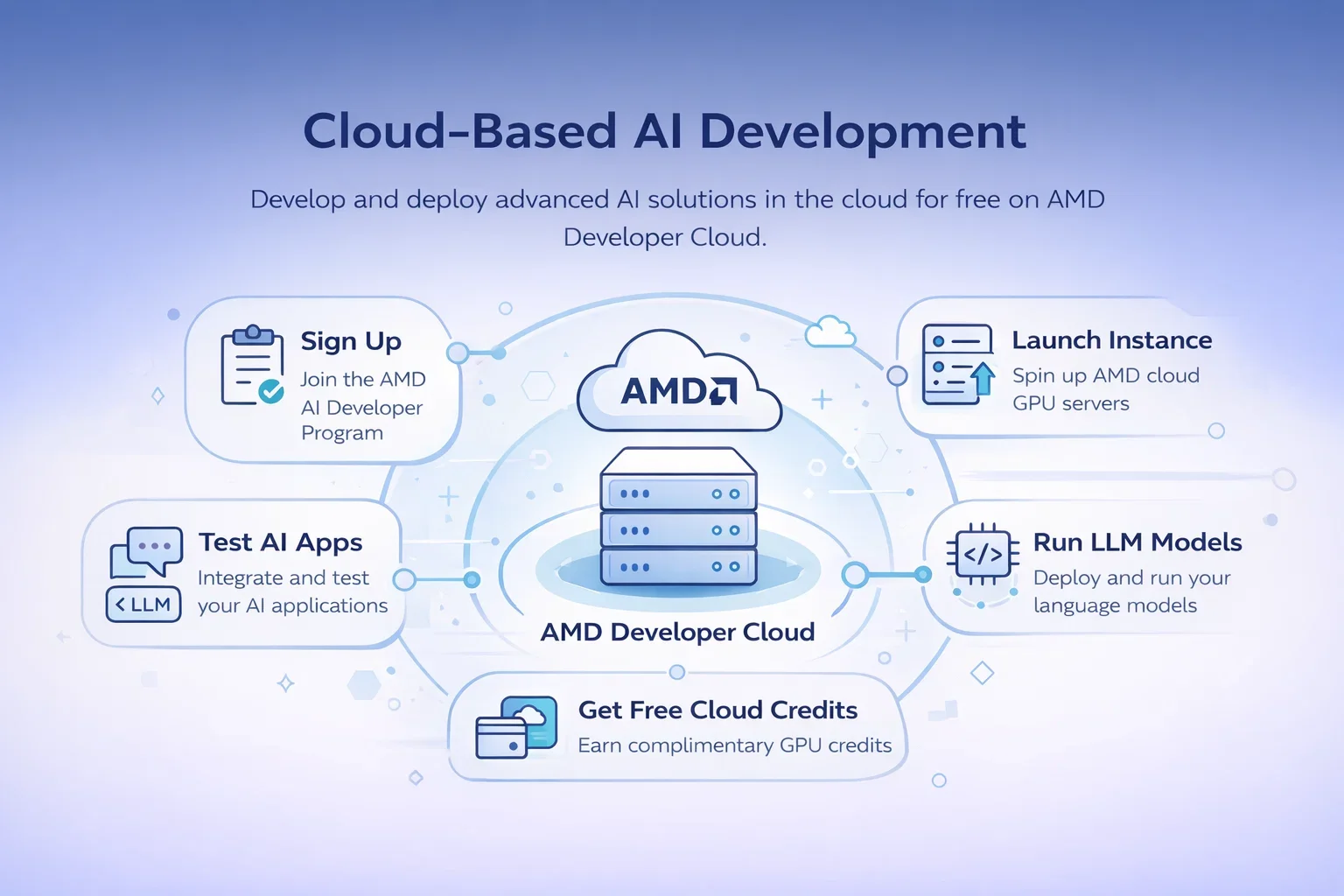

Méthode 2 : AMD Developer Cloud (Meilleure option cloud gratuite)

C'est là que ça devient intéressant. D'après plusieurs guides GitHub intitulés “ OpenClaw avec vLLM fonctionnant gratuitement sur le cloud pour développeurs AMD ”, vous pouvez accéder à du matériel de qualité professionnelle sans frais grâce au programme AMD AI Developer.

On parle ici de cartes graphiques AMD Instinct MI300X dotées de 192 Go de mémoire. C'est suffisant pour faire tourner des jeux qui nécessiteraient normalement des cartes graphiques grand public coûtant des milliers de dollars.

Accès au cloud pour développeurs AMD

Inscrivez-vous au programme AMD AI Developer. Ils offrent des crédits cloud gratuits spécialement conçus pour les développeurs testant des charges de travail d'IA. Un guide de février 2026 montre comment déployer OpenClaw sur cette infrastructure “ sans frais ”.”

Mais attention, il y a un hic. Ce sont des crédits promotionnels, et non un accès gratuit permanent. Cependant, si vous testez simplement OpenClaw ou si vous l'utilisez pour des projets personnels, ces crédits devraient vous suffire pendant un bon moment.

Exécution de vLLM sur AMD Cloud

vLLM est un serveur d'inférence optimisé qui permet d'exécuter efficacement des modèles de langage de grande taille. La procédure d'installation comprend les étapes suivantes :

- Déployez une instance cloud AMD

- Installez vLLM et le modèle que vous avez choisi.

- Configurez OpenClaw pour qu'il pointe vers votre point de terminaison vLLM

- Connectez vos plateformes de messagerie

Selon le dépôt secure-openclaw de ComposioHQ (1,5k étoiles), vous pouvez intégrer OpenClaw avec WhatsApp, Telegram, Signal ou iMessage pour une expérience d'assistant personnel complète.

Méthode 3 : Stratégie GitHub Codespaces

GitHub offre des heures de calcul gratuites via Codespaces : 60 heures par mois avec son offre gratuite. Un guide d’installation original mentionnait le “ déploiement d’OpenClaw en moins de 5 minutes avec l’offre gratuite d’AWS ”, mais GitHub Codespaces propose une alternative plus simple.

Certes, 60 heures ne correspondent pas à une disponibilité 24h/24 et 7j/7. Mais si vous utilisez principalement votre assistant IA pendant vos heures de travail, cette autonomie est étonnamment longue. Éteignez-le lorsque vous dormez ou le week-end, et vous obtenez une solution gratuite et performante.

L'approche hybride

Voici comment procèdent certains utilisateurs expérimentés : ils exécutent les tâches légères en local avec Ollama, mais pour les tâches complexes de codage ou de raisonnement, ils font appel à une API gratuite via OpenClaw.

OpenRouter, mentionné dans des discussions sur Reddit, offre des crédits gratuits qui se réinitialisent chaque mois. Un utilisateur a fait remarquer : “ OpenRouter coûte plus de 10 € pour 1 000 requêtes par jour avec les modèles gratuits. ” Ces 10 € sont des crédits, pas des frais : utilisez-les judicieusement et vous n’aurez rien à débourser.

Considérations de sécurité à ne pas négliger

Soyons clairs : OpenClaw a un accès complet à l’ordinateur. C’est puissant, mais potentiellement dangereux en cas de mauvaise configuration.

Un fil de discussion très actif sur Reddit était spécifiquement consacré au “ Guide de renforcement de la sécurité ”, et mettait en garde : “ Étant donné que je vois de nombreuses nouvelles personnes installer Clawdbot, je recommande fortement de le protéger contre les attaques par injection rapide. ”

Il existe des scripts de détection (comme knostic/openclaw-detect, noté 56 étoiles) spécifiquement conçus pour le “ déploiement MDM afin d'identifier les installations d'OpenClaw sur les appareils gérés ”. Cela montre que les organisations se soucient des implications en matière de sécurité.

Mesures de sécurité essentielles

| Mesures de sécurité | Pourquoi c'est important | Comment mettre en œuvre |

| Gestion des clés | OpenClaw a besoin de clés API et d'identifiants. | Utilisez 1Password ou un logiciel similaire avec un coffre-fort dédié. |

| Liaison réseau | Empêche l'accès externe à votre instance | Se connecter uniquement à localhost, sauf si le VPN est configuré. |

| Règles du pare-feu | Limite ce à quoi OpenClaw peut accéder | Utilisez ufw ou Tailscale pour un accès distant sécurisé |

| Protection contre l'injection rapide | Empêche les commandes malveillantes provenant de sources externes | Configurer la validation des entrées et les restrictions de commandes |

Comme l'a confié un utilisateur soucieux de sa sécurité : “ J'utilise 1Password pour la gestion de mes clés ; la seule clé dont dispose OpenClaw est celle qui permet d'accéder à 1Password via un coffre-fort dédié et un compte de service. ”

C'est une architecture intelligente.

Problèmes et solutions courants liés à la configuration

D’après les discussions de la communauté et la compilation de ressources awesome-openclaw (221 étoiles sur GitHub), voici les problèmes qui posent problème aux nouveaux venus :

“ Il s'est installé mais n'exécute rien ”

Un utilisateur de Reddit, visiblement frustré, a déclaré : “ J’ai essayé d’installer Clawdbot à cinq reprises sur mon Intel NUC de 16 Go sous Ubuntu, sans succès. Je peux interagir avec lui par la voix, mais il est incapable de compiler quoi que ce soit. ”

Cela indique généralement un problème d'autorisations ou une connexion incorrecte du modèle. Vérifiez votre fichier de configuration et assurez-vous qu'OpenClaw peut bien accéder à votre point de terminaison LLM.

Confusion autour de l'emplacement des fichiers WSL

Les utilisateurs Windows ont souvent du mal à trouver leurs fichiers OpenClaw. Comme l'a judicieusement fait remarquer un utilisateur : “ Les fichiers devices/pending.json se trouvent dans \\wsl$\Ubuntu\home\user\.openclaw\devices ; chez moi, ils sont dans le sous-système Linux. ”

La confusion “ gratuite ”

De nombreux guides “ gratuits ” exigent en réalité des services payants. Un utilisateur sceptique a fait remarquer : “ Alors… un bot qui coûte $0… à condition d’avoir un abonnement à Google AI Pro et à GitHub Copilot ? Comment est-ce possible ? ”

Argument valable. Un coût véritablement nul signifie aucun abonnement – seulement des modèles locaux ou des crédits cloud réellement gratuits.

Comparaison des plateformes : ce qui fonctionne réellement

| Plate-forme | Niveau véritablement gratuit | Temps de disponibilité mensuel | Performance | Idéal pour |

| Ollama local | Oui (coût du matériel uniquement) | 24/7 | Idéal pour les tâches quotidiennes | Utilisateurs soucieux de leur vie privée |

| AMD Developer Cloud | Crédits (durée limitée) | 24h/24 et 7j/7, dans la limite des crédits disponibles. | Idéal pour les grands modèles | Tests et développement |

| Espaces de code GitHub | 60 heures/mois | À temps partiel | Cela dépend du modèle choisi | Utilisation pendant les heures de travail |

| Niveau gratuit d'OpenRouter | Réinitialisation des crédits mensuels | Jusqu'à épuisement des crédits | Varie selon le modèle | Approches hybrides |

Des cas d'utilisation concrets qui ne vous ruineront pas.

D'après les discussions sur le dépôt openclaw-blog, les utilisateurs se servent des configurations OpenClaw gratuites pour :

- Automatisation de la revue de code : configurez-la pour qu’elle vérifie vos commits avant de les pousser.

- Résumé des messages : Synthèse des canaux Slack ou des fils de discussion par e-mail

- Rappels programmés : La branche secure-openclaw mentionne spécifiquement cette fonctionnalité

- Assistance à la recherche : Collecte d'informations et rédaction de synthèses

- Automatisation des tâches : organisation des fichiers, traitement des données, génération de rapports

L'essentiel est de choisir des tâches adaptées aux capacités de votre modèle. N'attendez pas d'un modèle 7B local qu'il produise du code de qualité professionnelle, mais il peut s'avérer très utile pour la génération de code standard ou la documentation.

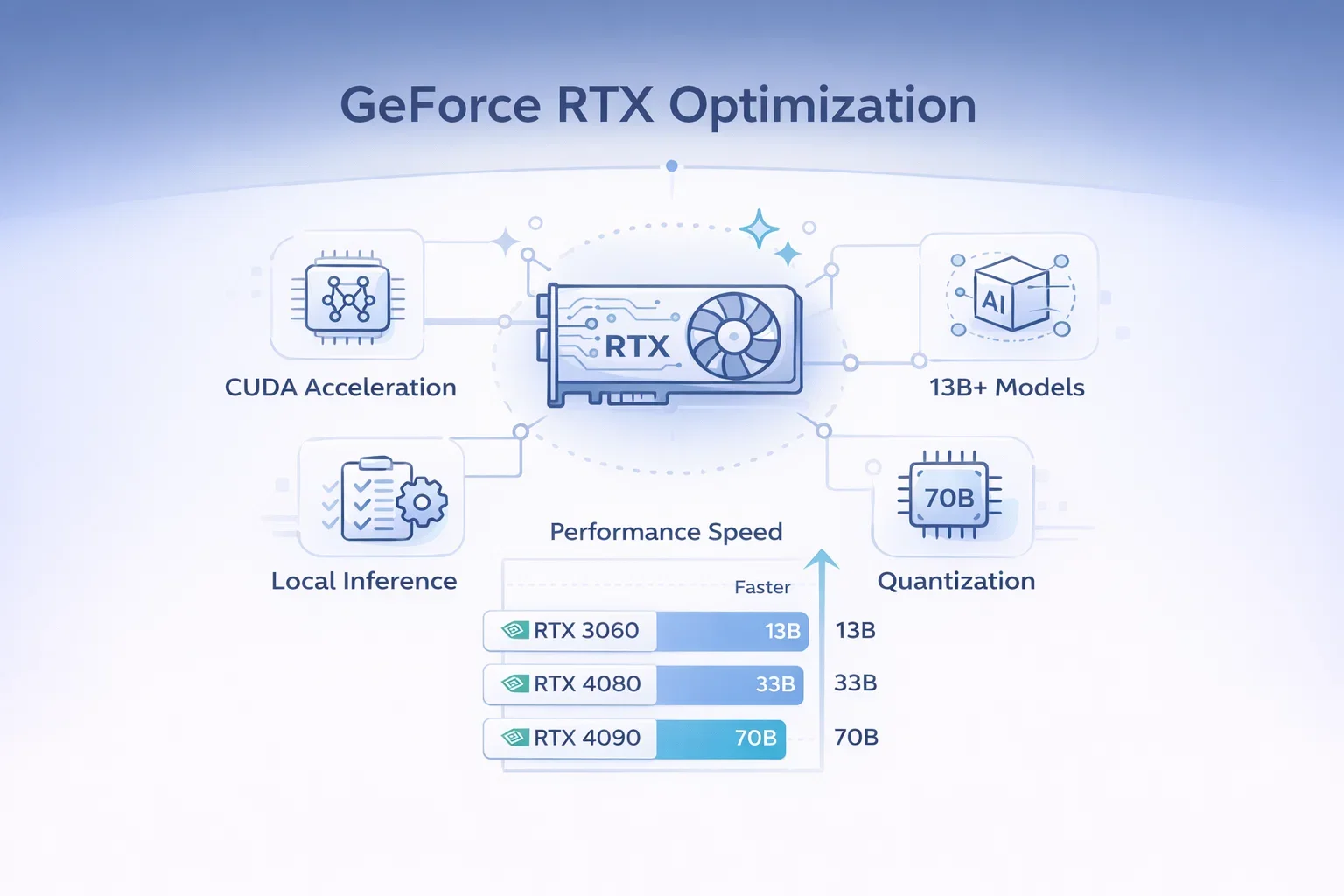

Optimisation GeForce RTX

Un guide populaire explique comment exécuter OpenClaw gratuitement sur GeForce RTX grâce à l'optimisation de l'inférence locale. Si vous possédez un GPU NVIDIA, vous pouvez tirer parti de l'accélération CUDA pour une inférence locale nettement plus rapide.

Pour des performances optimales avec les modèles 13B, une carte graphique RTX 3060 ou supérieure est recommandée. La RTX 4090 peut gérer les modèles 70B avec quantification.

[IMAGE : Tableau comparatif des performances montrant les vitesses d'inférence sur différents GPU]

Projets alternatifs à considérer

L'écosystème OpenClaw a donné naissance à plusieurs alternatives. D'après le document “ moltbot-vs-openclaw-complete-comparison ”, Moltbot est en réalité un fork renommé avec une nouvelle identité visuelle. ClawdBot était son nom d'origine avant d'être rebaptisé OpenClaw.

Secure-OpenClaw de ComposioHQ (258 forks, 1,5k étoiles) se concentre spécifiquement sur l'intégration de plateformes de messagerie avec “ mémoire persistante, rappels programmés et intégrations avec plus de 500 applications ”.”

Pour les configurations à très petit budget, un fil de discussion Reddit intitulé “ Faire fonctionner OpenClaw / ClawdBot / MoltBot à petit budget (ou gratuitement) ” compile diverses approches à faible coût qui ont fonctionné pour les membres de la communauté.

En conclusion : le zéro coût en vaut-il vraiment la peine ?

Voici mon avis sincère après avoir consulté des dizaines de guides d'installation et de discussions communautaires : oui, vous pouvez tout à fait utiliser OpenClaw gratuitement en 2026. Mais il y a un compromis à faire entre le coût et la facilité d'utilisation.

Les modèles locaux avec Ollama vous offrent une véritable indépendance et aucun frais mensuel, mais leurs performances sont légèrement inférieures à celles des modèles Frontier. Les crédits AMD Developer Cloud offrent d'excellentes performances pendant leur durée de validité, mais ne constituent pas une solution permanente. Les niveaux d'API gratuits fonctionnent jusqu'à épuisement des quotas.

La solution idéale ? Commencez par utiliser Ollama en local pour les tâches courantes, puis exploitez stratégiquement les ressources cloud gratuites pour les charges de travail exigeantes. Comme l’a souligné un utilisateur expérimenté dans un guide détaillé sur Reddit : “ L’essentiel est de tirer parti des offres gratuites et de les gérer efficacement. ”

Et surtout, même si vous décidez finalement de payer pour l'accès à l'API, comprendre ces méthodes gratuites vous permettra d'utiliser plus efficacement les ressources payantes. Vous saurez précisément quand privilégier la puissance du cloud et quand une solution locale suffit.

Le dépôt openclaw/openclaw poursuit son développement actif grâce à sa communauté de plus de 200 000 étoiles. De nouveaux guides d'optimisation, des améliorations de sécurité et des outils d'installation sont régulièrement ajoutés. Au moment où vous lirez ces lignes, l'installation sera peut-être encore plus simple.

Prêt à créer votre propre assistant IA disponible 24h/24 et 7j/7 sans frais mensuels ? Commencez par configurer Ollama localement, expérimentez différentes configurations pour trouver celle qui convient à votre matériel et rejoignez la communauté awesome-openclaw et ses ressources pour apprendre des autres utilisateurs.

Votre agent IA personnel vous attend — et cela ne vous coûtera pas un centime.

Questions fréquemment posées

OpenClaw est-il vraiment entièrement gratuit ?

Oui, le logiciel est sous licence MIT et gratuit. Cependant, son exécution nécessite soit votre propre matériel (installation locale), soit des ressources cloud. Vous pouvez utiliser des solutions entièrement gratuites comme Ollama en local, les crédits AMD Developer Cloud ou l'offre gratuite de GitHub Codespaces pour éviter tout abonnement mensuel.

Puis-je exécuter OpenClaw sur un Raspberry Pi ?

Techniquement, oui, comme expliqué dans les guides communautaires concernant “ OpenClaw sur Raspberry Pi : Créer un système d'automatisation IA local avec LM Studio ”. Cependant, les performances seront limitées. Un Raspberry Pi 4 avec 8 Go de RAM peut exécuter de très petits modèles, mais les temps de réponse seront lents. Il s'agit davantage d'un projet de loisir que d'une solution pratique.

Quelle est la configuration matérielle minimale requise pour une installation locale ?

Pour un fonctionnement de base, 8 Go de RAM et un processeur récent sont recommandés. Pour une utilisation optimale, 16 Go de RAM minimum sont conseillés. Si votre carte graphique dispose de 8 Go de VRAM ou plus, vous bénéficierez de performances nettement supérieures. De nombreux utilisateurs font tourner OpenClaw avec succès sur des Intel NUC ou des Mac Mini.

Comment éviter les risques de sécurité ?

D'après les discussions de sécurité au sein de la communauté OpenClaw, les mesures clés consistent à : utiliser des gestionnaires d'identifiants dédiés (comme 1Password), se connecter à localhost sauf en cas d'utilisation d'un VPN, mettre en place des règles de pare-feu et renforcer la sécurité contre les attaques par injection de requêtes. Ne donnez jamais à OpenClaw un accès direct à vos identifiants sensibles.

Pourquoi certains guides mentionnent-ils des services payants alors qu'OpenClaw est gratuit ?

OpenClaw est gratuit, mais nécessite un modèle de langage pour fonctionner. De nombreux tutoriels utilisent par défaut des API commerciales comme Claude ou GPT-4, car elles sont plus faciles à configurer. Cependant, vous pouvez tout à fait utiliser des modèles locaux gratuits ou des ressources cloud gratuites ; cela demande simplement un peu plus d'efforts de configuration.

Quelle est la différence entre ClawdBot, Moltbot et OpenClaw ?

Il s'agit essentiellement du même projet, rebaptisé simplement ClawdBot. Initialement appelé ClawdBot, il est ensuite devenu Moltbot, puis OpenClaw. Sa fonctionnalité principale reste inchangée : c'est un agent d'IA disposant d'un accès complet à votre système informatique et fonctionnant sur votre propre infrastructure.

Puis-je utiliser OpenClaw gratuitement à des fins commerciales ?

La licence MIT autorise l'utilisation commerciale du logiciel OpenClaw. Cependant, vérifiez la licence du modèle de langage que vous utilisez. La plupart des modèles open source autorisent une utilisation commerciale, mais certains (comme Llama) imposent des restrictions liées au nombre d'utilisateurs. Vérifiez toujours la licence spécifique du modèle.