Le paysage de l'IA a connu une transformation spectaculaire. Trois acteurs majeurs se disputent désormais l'attention des développeurs : Claude d'Anthropic, la série GPT d'OpenAI et le nouveau venu disruptif DeepSeek.

Mais quel modèle est réellement performant ? La réponse n’est pas simple. Chacun présente des atouts différents, et votre meilleur choix dépend entièrement de ce que vous développez.

Analysons maintenant comment ces modèles se comparent selon les indicateurs qui comptent vraiment.

Gammes de modèles : ce que vous choisissez réellement entre

La première étape consiste à comprendre les modèles actuellement proposés. Ces entreprises ne se contentent pas d'un seul modèle ; elles ont développé des gammes complètes avec différents niveaux de performance.

Liste actuelle de Claude

Anthropic propose trois modèles principaux début 2026. Claude Opus 4.6 est leur modèle le plus performant, conçu spécifiquement pour la création d'agents et les tâches de programmation complexes. Claude Sonnet 4.6 offre un bon compromis entre vitesse et intelligence, ce qui en fait leur solution recommandée au quotidien. Claude Haiku 4.5 est l'option la plus rapide, dotée d'une intelligence quasi-de pointe.

Claude Opus 4.6 et Claude Sonnet 4.6 (et certaines variantes de Sonnet 4.x) prennent en charge une fenêtre de contexte de jetons de 1M en version bêta sur l'API Claude, Amazon Bedrock, Google Cloud Vertex AI et Microsoft Foundry.

Gamme élargie d'OpenAI

Le portefeuille d'OpenAI s'est considérablement étoffé. Son modèle phare, GPT-5.2, cible les tâches de programmation et d'automatisation dans divers secteurs, avec une fenêtre de contexte de 400 000 jetons et une date limite d'acquisition des connaissances fixée au 31 août 2025. Le coût d'entrée est de $1,75 par million de jetons, et le coût de sortie de $14,00 par million de jetons. Le coût de l'entrée mise en cache chute à seulement $0,18 par million de jetons.

GPT-4.1 est leur modèle non raisonnant le plus intelligent, avec une fenêtre de contexte impressionnante de 1 047 576 jetons et une date limite de connaissance fixée au 1er juin 2024. La tarification standard est de $2,00 par million de jetons d'entrée et de $8,00 par million de jetons de sortie.

La gamme s'étend vers le bas avec GPT-5-mini ($0,25 entrée, $2,00 sortie par million de jetons) et GPT-5-nano ($0,05 entrée, $0,40 sortie par million de jetons) pour les applications soucieuses de leur budget.

L'approche Lean de DeepSeek

DeepSeek mise sur la simplicité. Sa version 3.2 propose deux modes : deepseek-chat (mode sans réflexion) et deepseek-reasoner (mode réflexion). Les deux fonctionnent sur le même modèle de base avec une fenêtre de contexte de 128 Ko.

D'après la documentation officielle de l'API DeepSeek, deepseek-chat limite par défaut la sortie à 4 000 jetons (8 000 maximum), tandis que deepseek-reasoner autorise une sortie par défaut de 32 000 jetons (64 000 maximum). La tarification est particulièrement avantageuse : 1 TP4T0,028 par million de jetons d'entrée avec accès au cache, 1 TP4T0,28 par million de jetons d'entrée standard et 1 TP4T0,42 par million de jetons de sortie.

DeepSeek-V3.2-Speciale repousse encore les limites des capacités de raisonnement, atteignant des performances de niveau or dans des compétitions telles que les OIM, les CMO, les finales mondiales ICPC et les IOI 2025. Actuellement, son utilisation se limite à l'API et ne prend pas en charge les outils.

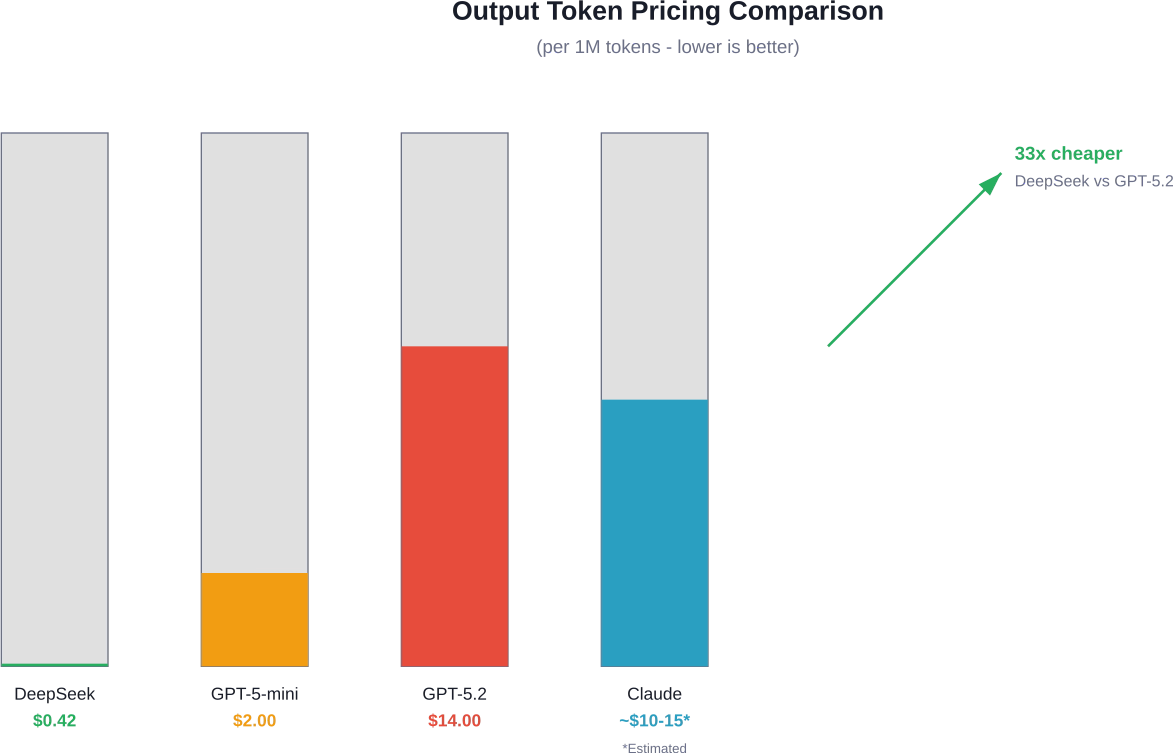

Positionnement coût-performance des principaux modèles d'IA début 2026, illustrant l'avantage concurrentiel de DeepSeek en matière de prix.

Performance du codage : là où tout se joue.

Les développeurs se soucient avant tout d'une chose : ce modèle est-il capable de produire du code de qualité ?

D'après une étude publiée sur arXiv comparant ces modèles sur des tâches de programmation, DeepSeek offre des performances compétitives à un coût nettement inférieur, tandis que Claude coûte généralement beaucoup plus cher par jeton. C'est un argument de poids pour les équipes soucieuses de leurs coûts.

Soyons francs : l’écart entre ces modèles pour les tâches de programmation s’est considérablement réduit. GPT-4.1 offre des capacités de programmation équilibrées et une intégration Azure performante si vous utilisez déjà l’écosystème Microsoft. Claude Opus excelle dans la compréhension des bases de code complexes et la formulation de suggestions de refactorisation pertinentes.

Mais c'est là que ça devient intéressant. D'après les données de référence, DeepSeek R1 a obtenu un score de 65,9 sur LiveCodeBench (Pass@1-COT), contre 63,4 pour OpenAI o1-1217 et 33,8 pour Claude-3.5-Sonnet, tandis que GPT-4o-0513 a atteint 34,2.

| Modèle | Score HumanEval | LiveCodeBench | Cas d'utilisation optimal

|

|---|---|---|---|

| DeepSeek R1 | 85%+ | 65.9 | Tâches de codage à budget limité |

| GPT-5.2 | Haut | ~63-65 | Flux de travail de codage agentiel |

| Claude Opus 4.6 | Compétitif | N / A | Refactorisation complexe |

| OpenAI o1-1217 | Haut | 63.4 | Tâches nécessitant beaucoup de raisonnement |

Qu'en est-il du codage dans le monde réel ?

Les indicateurs de performance racontent une histoire. Le travail de développement concret en raconte une autre.

Les discussions au sein de la communauté révèlent que Claude excelle généralement dans le maintien d'un style de code cohérent sur les grands projets. GPT-5 gère efficacement les décisions architecturales complexes, notamment lorsqu'il s'agit d'évaluer plusieurs approches d'implémentation. DeepSeek surprend les développeurs par sa capacité à comprendre le contexte malgré son prix abordable.

La vérité ? Pour les applications CRUD simples et les modèles de développement web standard, les trois solutions fonctionnent parfaitement. Les différences apparaissent lors du débogage de problèmes de concurrence subtils ou de la refonte de systèmes existants.

Capacités de raisonnement : jusqu’où vont leurs réflexions ?

Les modèles de la série O d'OpenAI ont été explicitement entraînés à “ réfléchir plus longtemps ” et à produire un raisonnement en chaîne avant de répondre. Cela permet un raisonnement logique robuste face à des problèmes complexes.

DeepSeek V3.2 en mode raisonnement (deepseek-reasoner) est un concurrent direct dans ce domaine. Ce modèle a obtenu des résultats de niveau or aux olympiades de mathématiques et aux compétitions de programmation. DeepSeek-V3.2-Speciale exploite au maximum les capacités de raisonnement pour rivaliser avec des modèles avancés comme Gemini-3.0-Pro, bien qu'il nécessite une utilisation plus importante de jetons.

L'approche de Claude diffère légèrement. Plutôt que de présenter un raisonnement détaillé visible par les utilisateurs, Claude utilise une pensée adaptative, décidant dynamiquement quand et comment réfléchir en fonction de la complexité de la tâche.

D'après une étude universitaire publiée sur arXiv, la comparaison de ces modèles sur des tâches de calcul scientifique a révélé que chacun présentait des schémas de raisonnement distincts. L'étude a évalué les performances dans de multiples domaines et a constaté que le choix du modèle avait un impact significatif sur les résultats, en fonction du type de raisonnement requis.

Vérification de la réalité des prix

Le coût est important. Surtout lorsqu'on traite des millions de jetons par mois.

Passons aux chiffres précis des pages de tarification officielles.

Structure tarifaire d'OpenAI

Le traitement standard de GPT-5.2 coûte $1,75 par million de jetons d'entrée et $14,00 par million de jetons de sortie. Avec la mise en cache, ce coût tombe à $0,175 par million de jetons. L'API par lots permet une économie de 50%, ramenant le coût à $0,875 par million de jetons d'entrée et $7,00 par million de jetons de sortie.

GPT-5-mini offre une option plus économique avec un coût d'entrée de $0,25 et un coût de sortie de $2,00 par million de jetons (tarifs standards). GPT-5-nano est encore plus compétitif avec un coût d'entrée de $0,025 et un coût de sortie de $0,20 par million de jetons.

Les modèles professionnels coûtent nettement plus cher. GPT-5.2-pro effectue $21,00 opérations d'entrée et $168,00 opérations de sortie par million de jetons.

Tarification de Claude (basée sur les tendances historiques)

Bien que le prix actuel officiel de Claude Opus 4.6 n'ait pas été précisé dans la documentation fournie, des recherches menées par arXiv ont montré que Claude coûte généralement plus cher que d'autres approches d'IA pour des tâches similaires.

Les informations tarifaires actuelles de l'API Claude sont disponibles dans la documentation officielle d'Anthropic.

Tarification agressive de DeepSeek

DeepSeek propose des tarifs nettement inférieurs à ceux de ses concurrents. D'après sa documentation API officielle, le prix standard est de $0,28 par million de jetons entrants et de $0,42 par million de jetons sortants. Grâce aux accès au cache, le prix d'entrée chute à seulement $0,028 par million de jetons.

C'est environ 5 à 50 fois moins cher que les modèles comparables, selon la configuration.

Comparaison des prix des jetons de sortie montrant l'avantage concurrentiel considérable de DeepSeek par rapport aux modèles concurrents

Fenêtres contextuelles et mémoire

Quelle quantité d'informations ces modèles peuvent-ils retenir dans leur “ mémoire de travail ” au cours d'une conversation ?

- Claude propose en version bêta une fenêtre de contexte d'un million de jetons. Cela suffit pour analyser plusieurs romans complets ou un vaste code source. Claude est donc particulièrement efficace pour les tâches nécessitant l'analyse de documents volumineux ou de conversations de longue durée.

- GPT-5.2 offre 400 000 jetons, tandis que GPT-4.1 offre une fenêtre de contexte de 1 047 576 jetons. Ces deux valeurs sont considérables, largement suffisantes pour la plupart des applications concrètes.

- DeepSeek V3.2 fournit 128 000 jetons, ce qui est moins, mais reste suffisant pour la plupart des tâches. La plupart des développeurs n'atteindront pas cette limite en utilisation courante.

En pratique, quel est l'impact ? Si vous développez des outils qui analysent des bases de données entières, traitent de longs documents juridiques ou gèrent des conversations très longues, Claude ou GPT-4.1 sont plus performants. Pour les applications de chatbot classiques ou les tâches de programmation ciblées, le modèle 128K de DeepSeek convient parfaitement.

Écosystème et intégration

Les modèles n'existent pas isolément. L'intégration est essentielle.

L'avantage de l'écosystème d'OpenAI

Les modèles d'OpenAI s'intègrent parfaitement à Microsoft Azure, GitHub Copilot et à de nombreux outils tiers. L'écosystème GPT est mature et bénéficie d'une documentation complète, de ressources communautaires et d'intégrations prêtes à l'emploi.

L'appel de fonctions, les sorties structurées, le réglage fin, la distillation et les sorties prédites sont tous pris en charge. Le point de terminaison v1/chat/completions est devenu un standard de facto pris en charge par de nombreux outils.

La présence grandissante de Claude

Claude est disponible via plusieurs canaux : l’API Claude directement depuis Anthropic, Amazon Bedrock, Google Cloud Vertex AI et Microsoft Foundry. Cette approche multicloud offre une grande flexibilité.

Anthropic a introduit les compétences d'agent, des capacités modulaires qui étendent les fonctionnalités de Claude. Chaque compétence comprend des instructions, des métadonnées et des ressources optionnelles que Claude utilise automatiquement le cas échéant.

Jeu de compatibilité de DeepSeek

L'API de DeepSeek imite volontairement le format d'OpenAI. D'après sa documentation officielle, il est possible d'utiliser le SDK OpenAI ou tout logiciel compatible OpenAI avec DeepSeek en remplaçant simplement l'URL de base par https://api.deepseek.com et en fournissant une clé API DeepSeek.

Cette compatibilité signifie que de nombreux outils existants fonctionnent immédiatement avec DeepSeek, réduisant ainsi les coûts de migration.

Sécurité, alignement et transparence

Tous les modèles n'abordent pas la sécurité de la même manière.

- Claude s'est forgé une réputation grâce à son approche rigoureuse en matière de sécurité. L'intelligence artificielle constitutionnelle d'Anthropic vise à créer des modèles utiles, inoffensifs et intègres. En pratique, cela signifie parfois que Claude refuse des requêtes que d'autres modèles tenteraient d'effectuer, ce que certains utilisateurs jugent excessif.

- OpenAI utilise un apprentissage par renforcement poussé à partir de retours humains (RLHF) et des tests de sécurité rigoureux. L'entreprise s'est montrée plus encline à repousser les limites tout en maintenant des garde-fous.

- DeepSeek a publié une documentation technique expliquant les mécanismes de ses modèles et ses méthodes d'entraînement, favorisant ainsi la transparence. Cependant, étant un nouvel acteur sur le marché, sa fiabilité à long terme en matière de sécurité reste à démontrer.

Pour les applications d'entreprise dans les secteurs réglementés, l'approche prudente de Claude peut s'avérer avantageuse. Pour la recherche et l'expérimentation, l'équilibre entre fonctionnalités et sécurité offert par GPT est optimal. L'approche ouverte de DeepSeek séduit les développeurs désireux de comprendre son fonctionnement interne.

Considérations relatives à l'entreprise : Quel modèle d'entreprise choisir ?

Le choix d'un modèle d'IA pour une utilisation en entreprise implique des critères différents de ceux utilisés pour les projets personnels.

Coût total de possession

Ne vous contentez pas d'examiner le prix par jeton. Tenez compte des remises sur volume, des avantages de la mise en cache et du coût du temps de développement. Un modèle trois fois plus cher, mais qui réduit le temps de débogage de 40%, pourrait s'avérer un meilleur investissement.

La tarification de DeepSeek est avantageuse pour les applications à fort volume où le coût par interaction est prépondérant. La précision de Claude peut justifier des coûts plus élevés pour les applications destinées aux clients, où les erreurs sont onéreuses. L'intégration à l'écosystème GPT peut réduire le temps de développement, compensant ainsi les coûts plus élevés de l'API.

Fiabilité et disponibilité

OpenAI a connu des interruptions ponctuelles lors des pics d'utilisation. La disponibilité multicloud de Claude via AWS, GCP et Azure offre des options de redondance. DeepSeek, service plus récent, dispose de données d'historique limitées.

Pour les applications critiques, les stratégies multi-modèles se généralisent. Utilisez Claude comme modèle principal et GPT comme solution de repli, ou bien dirigez les requêtes simples vers DeepSeek et les requêtes complexes vers des modèles plus performants.

Confidentialité et conformité des données

Examinez attentivement les politiques de gestion des données de chaque fournisseur. Claude, via Amazon Bedrock ou Google Vertex AI, peut proposer des certifications de conformité différentes de celles offertes par l'API directe. Le déploiement Azure d'OpenAI fournit des fonctionnalités de sécurité de niveau entreprise. Les politiques de données de DeepSeek doivent être analysées en fonction de vos exigences réglementaires spécifiques.

| Facteur | Idéal pour Claude | Idéal pour GPT | Idéal pour DeepSeek

|

|---|---|---|---|

| Priorité budgétaire | Faible | Moyen | Haut |

| Intégration à l'écosystème | Moyen | Haut | Moyen |

| Exigences de sécurité | Haut | Moyen | Moyen |

| Besoins de la fenêtre contextuelle | Très élevé (1M) | Élevé (400K-1M) | Moyen (128K) |

| Tâches de raisonnement | Haut | Très élevé | Haut |

| Qualité de la documentation | Haut | Très élevé | Bien |

Limites et faiblesses connues

Chaque modèle a ses angles morts. Les connaître permet de les contourner.

Les bizarreries de Claude

Claude peut se montrer excessivement prudent, refusant des requêtes anodines par mesure de sécurité. Il lui arrive de fournir des explications plus longues que nécessaire. Son prix élevé limite son utilisation aux cas où le coût par jeton est un facteur déterminant.

Les défis de GPT

Les modèles GPT produisent parfois des informations avec une assurance déconcertante. Leurs capacités de raisonnement peuvent être ralenties par un temps de réflexion plus long. Enfin, le prix élevé des versions professionnelles les rend inaccessibles à de nombreuses applications.

Les difficultés de croissance de DeepSeek

Plus récente, DeepSeek bénéficie d'une communauté moins active et d'un nombre réduit d'intégrations tierces. La fenêtre de contexte plus restreinte limite certaines applications. La fiabilité et le support à long terme restent des points d'interrogation, le service étant encore en développement.

Indicateurs de performance : les chiffres

Les benchmarks fournissent des points de comparaison standardisés, même si les performances réelles varient.

Les recherches du Centre pour la sécurité et les technologies émergentes de l'Université de Georgetown soulignent que les évaluations sont “ encore à un stade très préliminaire ” et doivent être interprétées avec prudence. Parmi les outils de référence couramment utilisés, on trouve le MMLU (Measuring Massive Multitask Language Understanding), qui utilise des questions à choix multiples issues d'examens professionnels, et le GPQA (Graduate-Level Google-Proof Q&A), qui repose sur des questions rédigées par des experts.

D'après diverses sources, DeepSeek V3 offre des performances compétitives sur les benchmarks de programmation tout en affichant des coûts nettement inférieurs. Les modèles de la série GPT-5 dominent les évaluations exigeant un raisonnement poussé. Claude excelle dans les tâches linguistiques nuancées et la compréhension de longs documents.

En résumé ? Les scores de référence sont importants, mais ils ne disent pas tout. Testez vos modèles sur vos cas d’utilisation spécifiques avant de vous engager.

Expérience utilisateur et interface

L'expérience du développeur compte autant que ses compétences brutes.

L'environnement de test et la documentation d'OpenAI sont soignés et complets. L'API est bien documentée et propose de nombreux exemples. Pour GPT-5.2, la version gratuite n'est pas prise en charge ; les différents niveaux d'utilisation ont des limites de TPM définies (par exemple, le niveau 5 autorise jusqu'à 40 000 000 de TPM).

La documentation de Claude est tout aussi complète, avec des tableaux comparatifs de modèles et des descriptions détaillées des fonctionnalités. Son approche multicloud implique que vous pourrez interagir avec Claude via différentes interfaces selon votre choix de déploiement.

La documentation de DeepSeek est fonctionnelle mais moins complète. La compatibilité avec OpenAI est un atout, car de nombreux tutoriels et exemples fonctionnent avec des modifications minimes.

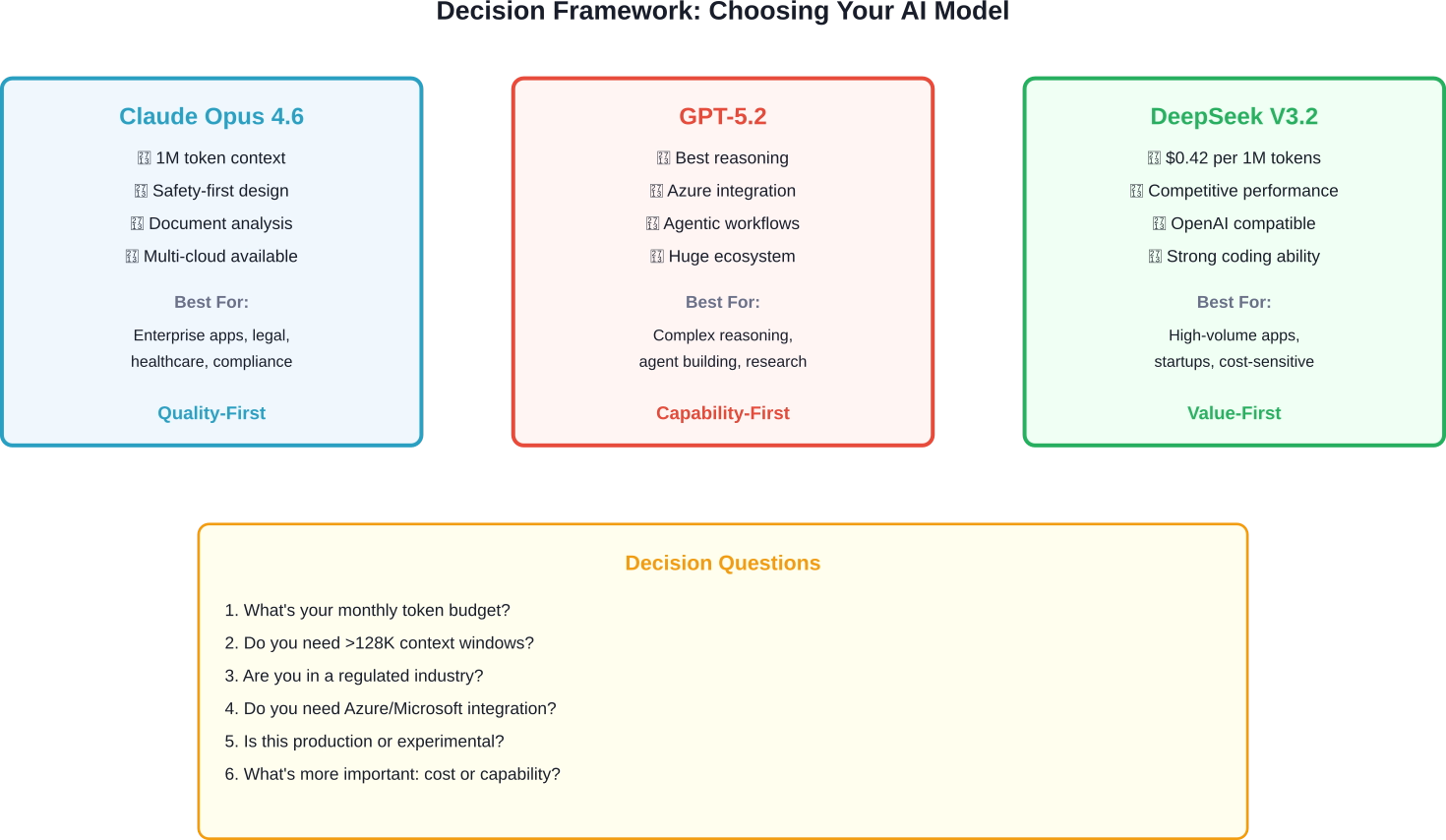

Quel modèle devriez-vous choisir ?

Voilà le point essentiel : il n’existe pas de modèle “ idéal ” universel. Votre choix dépend de vos besoins spécifiques.

Choisissez Claude si…

Vous avez besoin d'une fenêtre de contexte maximale pour le traitement des documents volumineux. La sécurité et la qualité des résultats sont primordiales. Vous développez des applications dans des domaines sensibles où la prudence est de mise. Le budget est moins contraignant que les exigences de qualité.

Choisissez GPT si…

Vous avez besoin d'une intégration poussée avec les outils Microsoft, Azure ou GitHub. Les capacités de raisonnement sont essentielles à votre cas d'usage. Vous souhaitez une documentation complète et un soutien communautaire optimal. Vous développez des systèmes multi-agents qui nécessitent une planification rigoureuse.

Choisissez DeepSeek si…

La maîtrise des coûts est primordiale. Vous traitez des volumes importants où le coût par jeton s'accumule rapidement. Vous avez besoin de performances compétitives sans prix exorbitant. Vous êtes à l'aise avec une plateforme récente et souhaitez la compatibilité avec OpenAI.

Cadre de sélection du modèle d'IA adapté à vos exigences et contraintes spécifiques

Stratégies multi-modèles

De nombreuses applications sophistiquées ne se contentent pas d'un seul modèle.

Une approche de routage permet d'optimiser à la fois les coûts et la qualité. Utilisez DeepSeek pour les requêtes simples, Claude pour les analyses complexes nécessitant un contexte étendu et GPT pour les tâches exigeant un raisonnement approfondi. Cela implique la mise en place d'une logique de routage, mais peut réduire les coûts de 601 TP3T ou plus tout en préservant la qualité.

Autre stratégie : utiliser des modèles moins coûteux pour générer les premières ébauches, puis des modèles plus performants pour l’affinage et le contrôle qualité. On peut aussi soumettre la même requête à plusieurs modèles et recourir à des méthodes de vote ou d’ensemble pour les décisions critiques.

La charge de travail liée à la gestion de plusieurs modèles diminue grâce à des outils comme Crazyrouter et des services similaires qui facilitent le test de différents modèles avec le même code.

Explorer les frontières de l'IA avec AI Superior

À mesure que l'écart entre les capacités de raisonnement et la rentabilité se réduit, le défi pour la plupart des entreprises passe du choix d'un modèle à sa mise en œuvre réussie. IA supérieure, Notre équipe de scientifiques des données et d'ingénieurs logiciels, tous titulaires d'un doctorat, se spécialise dans la réduction de cet écart grâce au développement d'applications d'IA complètes et au conseil stratégique. Nous aidons les organisations à dépasser les simples appels d'API en concevant des systèmes personnalisés et performants qui intègrent ces modèles de pointe aux flux de travail existants. Ainsi, votre choix d'architecture – qu'il s'agisse des vastes fenêtres de contexte de Claude ou du raisonnement économique de DeepSeek – se traduit concrètement en valeur ajoutée pour votre entreprise.

Notre approche systématique vise à identifier les domaines spécifiques où l'apprentissage automatique peut générer une efficacité durable, de la vision par ordinateur à l'analyse prédictive. Nous savons que dans un contexte aussi instable que celui de 2026, une stratégie de modèle unique est rarement efficace. C'est pourquoi notre équipe travaille en étroite collaboration avec vous, à travers un processus rigoureux de découverte et de développement d'un MVP, afin de concevoir des solutions robustes, fiables et adaptées aux exigences réglementaires et de données spécifiques à votre secteur.

Perspectives d'avenir : ce qui nous attend

Le paysage des modèles d'IA continue d'évoluer rapidement.

- OpenAI continue d'améliorer progressivement sa famille de modèles. L'écart entre les modèles de raisonnement et les modèles standards semble se réduire. La pression sur les prix exercée par des concurrents comme DeepSeek pourrait contraindre OpenAI à revoir sa stratégie.

- Anthropic étend la disponibilité de Claude aux fournisseurs de cloud et ajoute des fonctionnalités telles que les compétences d'agent. La fenêtre de contexte d'un million de jetons en version bêta laisse penser qu'ils repoussent les limites de la gestion des entrées.

- DeepSeek se positionne comme un acteur disruptif, prouvant que la performance n'est pas synonyme de prix exorbitant. Son modèle V3.2-Speciale, qui a obtenu des résultats exceptionnels lors de compétitions de programmation, démontre que son objectif ne se limite pas au coût : il repousse également les limites de la performance.

Il faut s'attendre à des améliorations continues des modèles, à une concurrence accrue sur les prix et à une consolidation des capacités entre les fournisseurs. Les différences entre ces modèles devraient s'atténuer en ce qui concerne les critères de référence, tandis qu'elles divergeront pour les cas d'utilisation spécifiques.

Conclusion : Faites votre choix

La concurrence entre Claude, GPT et DeepSeek profite à tous. Les prix baissent, les fonctionnalités augmentent et l'écart entre les solutions haut de gamme et les solutions économiques se réduit.

Votre décision dépendra en fin de compte de vos priorités. Si vous développez une application où l'intelligence prime sur le coût (applications de recherche, tâches de raisonnement complexes, agents sophistiqués), GPT-5.2 ou Claude Opus 4.6 justifient leur prix élevé.

Si vous traitez des volumes importants et recherchez une optimisation des coûts sans trop sacrifier les performances, DeepSeek offre un rapport qualité-prix exceptionnel. Son tarif de 0,42 TP4T par million de jetons de sortie révolutionne l'économie des applications d'IA.

Et de plus en plus, la stratégie intelligente ne consiste pas à choisir un seul modèle, mais à concevoir son application de manière à utiliser le modèle adapté à chaque tâche.

La meilleure solution ? Tester les trois solutions selon vos cas d’utilisation spécifiques. La plupart proposent des versions gratuites ou des crédits pour les tests initiaux. Exécutez vos requêtes réelles, mesurez les résultats, calculez les coûts et basez votre décision sur des données concrètes plutôt que sur des arguments marketing.

Prêt à commencer les tests ? Consultez la documentation officielle des API Claude, OpenAI Platform et DeepSeek pour obtenir vos clés et commencer vos expérimentations dès aujourd’hui.

Questions fréquemment posées

DeepSeek est-il aussi performant que GPT-4 ou Claude ?

Pour de nombreuses tâches, oui. DeepSeek V3.2 offre des performances compétitives sur des benchmarks de programmation comme HumanEval, tout en étant nettement moins coûteux. Les données de recherche montrent qu'il a atteint d'excellents niveaux de performance sur HumanEval à un coût considérablement inférieur à celui de Claude. Cependant, GPT et Claude peuvent conserver des avantages pour les tâches exigeant une capacité de raisonnement maximale ou des fenêtres de contexte très longues, supérieures à 128 000 jetons.

Quel modèle d'IA est le plus performant pour la programmation en 2026 ?

Cela dépend de vos besoins spécifiques. DeepSeek R1 a obtenu le meilleur score sur LiveCodeBench (65,9), ce qui en fait un excellent choix pour les tâches de codage à faible coût. GPT-5.2 excelle dans les flux de travail automatisés et les décisions architecturales complexes. Claude Opus 4.6 est performant pour la compréhension et la refactorisation de grands ensembles de code. Pour la plupart des développeurs, DeepSeek offre le meilleur rapport qualité-prix, tandis que GPT assure la meilleure intégration à l'écosystème.

Combien coûte l'utilisation de ces modèles d'IA ?

Les tarifs varient considérablement. D'après les pages de tarification officielles, DeepSeek coûte $0,28 en entrée et $0,42 en sortie par million de jetons (tarifs standard). GPT-5.2 coûte $1,75 en entrée et $14,00 en sortie par million de jetons. GPT-5-mini coûte $0,25 en entrée et $2,00 en sortie par million de jetons. Le prix de Claude varie selon la méthode de déploiement ; consultez la documentation officielle d'Anthropic pour connaître les tarifs actuels. DeepSeek est environ 5 à 50 fois moins cher que les modèles comparables.

Puis-je utiliser DeepSeek avec mon code OpenAI existant ?

Oui. D'après la documentation officielle de l'API DeepSeek, celle-ci utilise un format compatible avec OpenAI. Vous pouvez utiliser le SDK OpenAI ou tout autre logiciel compatible OpenAI avec DeepSeek en remplaçant l'URL de base par https://api.deepseek.com et en fournissant votre clé API DeepSeek. La plupart des codes existants devraient fonctionner avec des modifications mineures.

Quel modèle possède la fenêtre de contexte la plus longue ?

Claude propose actuellement une fenêtre de contexte d'un million de jetons en version bêta. GPT-4.1 offre 1 047 576 jetons, dépassant légèrement Claude. GPT-5.2 offre 400 000 jetons. DeepSeek V3.2 dispose de 128 000 jetons, ce qui est moins, mais suffisant pour la plupart des applications. Pour les tâches nécessitant l'analyse de documents extrêmement volumineux ou de conversations très longues, Claude ou GPT-4.1 sont plus performants.

Ces modèles sont-ils adaptés à un usage en entreprise ?

Ces trois solutions ont été déployées en entreprise, mais selon des critères différents. Claude privilégie la conformité aux normes de sécurité et est plébiscitée dans les secteurs réglementés. OpenAI propose des déploiements en entreprise via Azure avec des fonctionnalités de sécurité supplémentaires. DeepSeek est plus récent et son historique est moins établi. Pour une utilisation en entreprise, il est essentiel d'évaluer les politiques de gestion des données, les certifications de conformité et les accords de niveau de service (SLA) de chaque fournisseur en fonction de vos besoins spécifiques. Les déploiements multicloud de Claude via AWS, GCP ou Azure peuvent offrir des options de conformité supplémentaires.