Résumé rapide : En 2026, les tarifs des chatbots LLM s'échelonnent de formules gratuites à accès limité à des abonnements entreprise dépassant 3 000 TP4T par mois. Les coûts des API basées sur les jetons varient considérablement : OpenAI GPT-5.2 Pro facture 21 TP4T/168 TP4T par million de jetons, tandis que GPT-5.2 Standard facture 1,75 TP4T/14 TP4T. DeepSeek V3.2-Exp, quant à lui, coûte 0,28 TP4T par million de jetons d'entrée (en cas d'erreur de cache) et 0,42 TP4T par million de jetons de sortie. Le choix le plus adapté dépendra du volume d'utilisation, des fonctionnalités requises et de votre besoin : abonnement ou intégration directe de l'API.

Le marché des chatbots pour les développeurs de logiciels de gestion de l'apprentissage (LLM) a explosé, et avec lui une tarification qui peut dérouter même les développeurs expérimentés. Si l'on vous demandait combien coûte un chatbot IA en 2026, la réponse honnête serait : de zéro dollar à six chiffres par an.

Cette grande disparité s'explique par le fait que la tarification des chatbots LLM englobe deux approches fondamentalement différentes. D'une part, les plateformes de chatbots par abonnement proposent aux équipes de payer un forfait mensuel pour une IA conversationnelle prête à l'emploi. D'autre part, les services API basés sur un système de jetons permettent aux développeurs de créer des solutions personnalisées et de payer à l'usage.

Pour comprendre quel modèle correspond à des besoins spécifiques — et connaître les coûts réels —, il est indispensable de dépasser les arguments marketing et d'examiner les chiffres concrets. Les structures tarifaires ont considérablement évolué depuis 2025, avec l'arrivée de nouveaux modèles sur le marché et l'ajustement des tarifs par les fournisseurs établis.

Comment fonctionne réellement la tarification des chatbots LLM

Avant d'aborder les coûts spécifiques, il est utile de comprendre les deux principaux cadres de tarification qui structurent ce marché.

Plateformes de chatbots par abonnement

Ces services proposent des solutions de chatbot complètes avec interfaces, intégrations et assistance intégrées. Les équipes paient un abonnement (généralement mensuel) et accèdent à une plateforme qui gère la complexité technique.

D'après une analyse de marché récente, la tarification des chatbots par abonnement suit généralement la structure suivante :

| Modèle de tarification | Comment ça marche | Fourchette de coûts typique |

|---|---|---|

| Abonnement (SaaS) | Forfaits mensuels fixes avec limites de consommation | $30–$1 500/mois |

| Basé sur l'utilisation | Paiement à la conversation, à la résolution ou au jeton | $0,50–$5 par conversation |

| Entreprise personnalisée | Tarification négociée avec des ressources dédiées | $3 000–$50 000+/mois |

| Par utilisateur/poste | Coût par membre d'équipe accédant à la plateforme | $15–$200/utilisateur/mois |

L'abonnement est idéal pour les entreprises qui souhaitent des coûts prévisibles et des frais techniques minimaux. Mais attention : ces plateformes imposent souvent des limites strictes au nombre de conversations mensuelles, au nombre de chatbots actifs ou au volume de données d'entraînement.

Tarification des API basée sur les jetons

Pour les développeurs créant des solutions personnalisées, l'accès API offre une plus grande flexibilité, mais engendre des coûts variables. Chaque interaction avec un LLM est mesurée en jetons, soit l'équivalent approximatif de fragments de mots.

La tarification des jetons se divise en deux composantes : les jetons d’entrée (l’instruction envoyée au modèle) et les jetons de sortie (la réponse générée). Les jetons de sortie coûtent presque toujours plus cher, car la génération de texte exige davantage de ressources de calcul que son traitement.

Les calculs deviennent vite intéressants. Une conversation type avec le service client peut consommer 500 jetons d'entrée et générer 300 jetons de sortie. Selon les tarifs des différents fournisseurs, cette interaction peut coûter de quelques centimes à quelques centimes seulement.

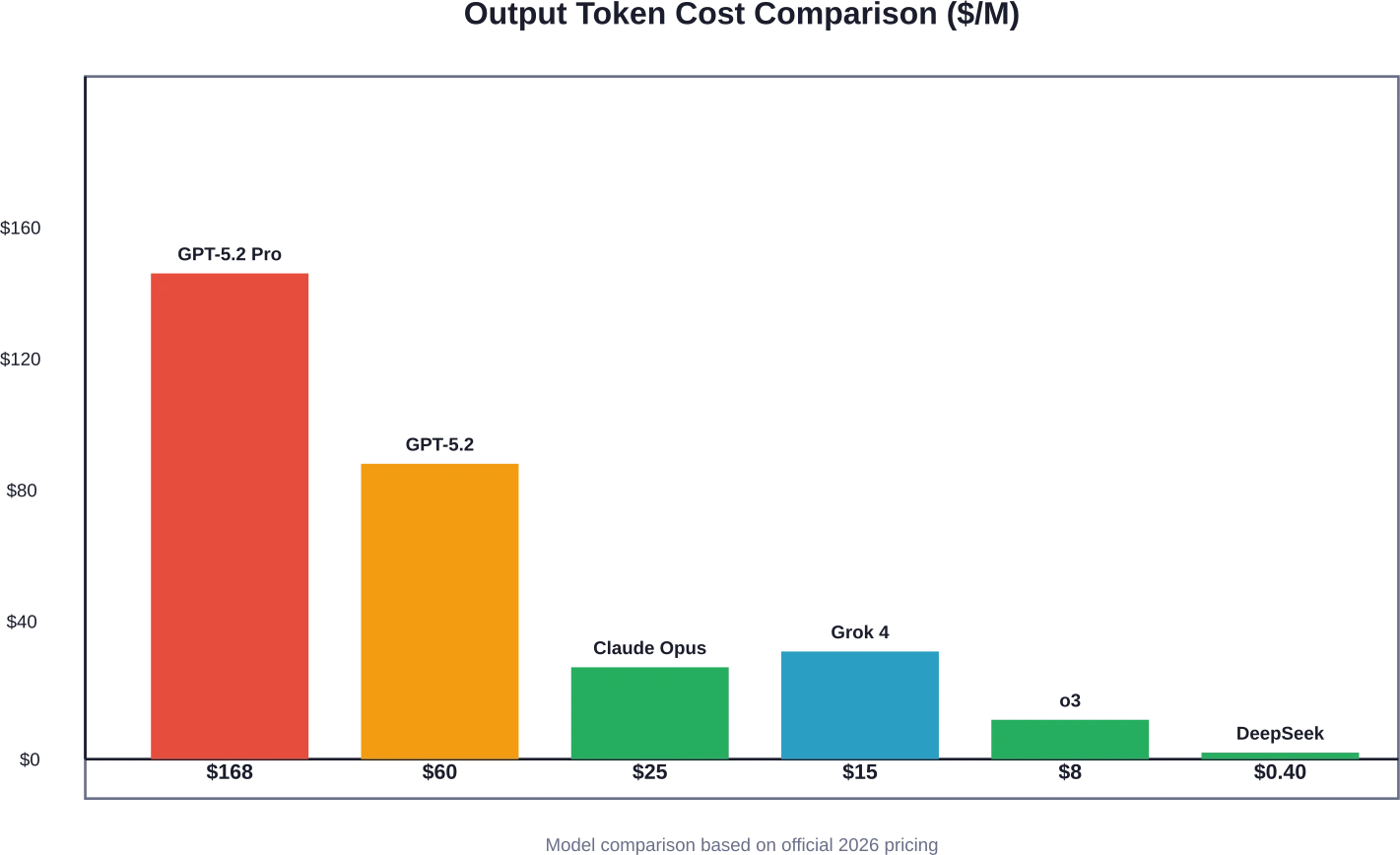

Comparatif des prix des principales API LLM

Le paysage tarifaire basé sur les jetons a connu une transformation radicale début 2026. De nouveaux modèles ont été lancés, les concurrents se sont livrés à une guerre des prix et les améliorations des capacités ont modifié les calculs du rapport coût/valeur.

Structure tarifaire d'OpenAI

OpenAI propose des abonnements pour accéder à ChatGPT ainsi qu'une tarification API par jeton pour les développeurs. D'après la page de tarification officielle d'OpenAI, les différents niveaux d'abonnement à ChatGPT sont les suivants :

- Gratuit: Accès limité à GPT-5.2 avec limitation du nombre de messages et réponses plus lentes.

- Aller: Accès étendu avec plus de messages et de téléchargements

- Plus, Pro, Team, Enterprise : Des niveaux progressifs avec des limites plus élevées et des fonctionnalités supplémentaires

Concernant l'accès à l'API, les tarifs d'OpenAI de février 2026 présentent des variations importantes selon les niveaux de modèles :

| Modèle | Entrée (1 jeton TP4T/M) | Sortie (1 jeton TP4T/M) | Cas d'utilisation |

|---|---|---|---|

| GPT-5.2 Pro | $21.00 | $168.00 | tâches à capacité maximale |

| GPT-5.2 | $1.75 | $14.00 | Dernier modèle phare |

| GPT-4.1 Mini | $0.40 | $1.60 | tâches rentables |

| o1 (raisonnement) | $15.00 | $60.00 | résolution de problèmes complexes |

| o3 (raisonnement) | $2.00 | $8.00 | Raisonnement de nouvelle génération |

Les discussions au sein de la communauté ont noté que o1 coûte beaucoup plus cher que o3, bien que la relation de prix reflète des architectures informatiques différentes plutôt qu'une hiérarchie de capacités.

OpenAI propose également des modèles spécialisés comme chatgpt-image-latest à $5 en entrée et $10 en sortie par million de jetons, conçus pour les interactions multimodales.

Prix de Claude l'anthropomorphe

Les modèles Claude d'Anthropic ont gagné en popularité grâce à leurs excellentes performances en matière de codage et d'analyse. Selon l'annonce d'Anthropic datée du 5 février 2026, le prix de Claude Opus 4.6 reste inchangé : $5 par million de jetons d'entrée et $25 par million de jetons de sortie.

Cela rend Claude Opus nettement moins cher que certains modèles d'OpenAI. Pour un développeur traitant 10 millions de jetons d'entrée et 5 millions de jetons de sortie par mois avec des modèles équivalents, la différence de coût est significative.

- GPT-5.2 Pro : (10 × $21) + (5 × $168) = $1 050

- Claude Opus 4.6 : (10 × $5) + (5 × $25) = $175

Claude a également introduit une fenêtre de contexte de 1 million de jetons en version bêta, permettant des conversations plus longues sans troncature du contexte – une fonctionnalité qui réduit le gaspillage de jetons dû à la répétition du contexte.

Anthropic propose des outils de suivi des coûts via la console Claude, permettant aux développeurs d'analyser les habitudes d'utilisation et de définir des limites de dépenses. Pour Anthropic Claude Code, la commande `/cost` permet de consulter des statistiques détaillées sur l'utilisation des jetons pour les sessions en cours, facilitant ainsi l'identification des pistes d'optimisation.

Tarification de Google Gemini

Les modèles Gemini de Google offrent des prix compétitifs, bien que les tarifs précis pour 2026 varient selon le niveau du modèle et la région. D'après une analyse concurrentielle, les modèles Gemini se positionnent généralement entre les offres premium d'OpenAI et les alternatives plus économiques.

L'avantage de Gemini réside dans son intégration avec l'infrastructure et les services de Google Cloud, ce qui le rend attractif pour les organisations ayant déjà investi dans cet écosystème.

Tarification xAI Grok

D'après une analyse concurrentielle, xAI a lancé les modèles Grok 4 au prix de $3 par million de jetons d'entrée et de $15 par million de jetons de sortie. Grok 4 se positionne ainsi comme plus cher que Claude Opus, mais moins cher que GPT-5.2.

xAI propose également Grok 4 Fast et Grok 4.1 Fast à des tarifs nettement inférieurs : $0,20 en entrée et $0,50 en sortie par million de jetons. Ces versions rapides privilégient la vitesse et la rentabilité au détriment de certaines fonctionnalités.

Perturbation des prix chez DeepSeek

La société chinoise DeepSeek propose des prix défiant toute concurrence avec sa variante V3.2-Exp. DeepSeek V3.2-Exp coûte $0,28 par million de jetons d'entrée (erreur de cache) et $0,42 par million de jetons de sortie.

Ce tarif représente une réduction considérable par rapport aux modèles occidentaux haut de gamme. Pour les applications à fort volume, les tarifs de DeepSeek pourraient se traduire par des économies mensuelles de plusieurs milliers de dollars.

Les compromis à faire incluent la latence potentielle des serveurs chinois, les problèmes de résidence des données pour les secteurs réglementés et les questions relatives à la viabilité des prix à long terme.

Coûts de la plateforme de chatbot par abonnement

Pour les entreprises qui privilégient les solutions clés en main au développement d'API, les plateformes d'abonnement regroupent l'accès LLM avec des interfaces, des outils d'analyse et des intégrations.

Tarifs pour petites entreprises

Les forfaits d'entrée de gamme s'adressent généralement aux entrepreneurs individuels ou aux petites équipes qui testent les fonctionnalités des chatbots. Ces forfaits de base coûtent souvent entre $30 et $150 par mois et comprennent :

- 1 à 3 chatbots actifs

- Nombre limité de conversations mensuelles (souvent 500 à 5 000)

- Intégrations de base (site web, Facebook Messenger)

- Modèles de réponses standard

- Assistance par e-mail

Les contraintes sont ici cruciales. Un petit site e-commerce traitant 100 demandes clients par jour atteindrait la limite mensuelle de 3 000 conversations dès la première semaine. Une fois cette limite dépassée, les plateformes facturent des frais supplémentaires ou suspendent le chatbot ; aucune de ces options n’est idéale pour l’expérience client.

Solutions pour le marché intermédiaire

Les entreprises en pleine croissance ont généralement besoin de forfaits mensuels compris entre $300 et $1000. À ce niveau, les fonctionnalités s'étendent considérablement :

- 5 à 10 chatbots dotés d'une logique plus sophistiquée

- 15 000 à 50 000 conversations mensuelles

- Intégrations CRM et assistance technique

- Formation personnalisée sur les données spécifiques à l'entreprise

- Analyses et informations sur les conversations

- Assistance prioritaire avec des temps de réponse plus rapides

Ce niveau convient aux entreprises disposant d'une clientèle établie, mais n'ayant pas encore atteint l'envergure d'une grande entreprise. La tarification commence à refléter la valeur de l'automatisation : un seul agent de support coûte entre $3 000 et $5 000 par mois en salaire et avantages sociaux ; ainsi, même un chatbot traitant 30% de demandes peut justifier l'investissement.

Tarification des chatbots d'entreprise

Les grandes organisations paient souvent entre $3 000 et plus de $50 000 par mois pour des plateformes de chatbots professionnelles. À ce niveau, la tarification fait généralement l'objet de devis personnalisés basés sur :

- Volumes de conversation illimités ou très élevés

- Options de marque blanche

- fonctionnalités avancées de sécurité et de conformité

- Gestion de compte dédiée

- Formation et mise au point de modèles personnalisés

- Les SLA garantissent la disponibilité et la rapidité de réponse

- Prise en charge multilingue

Les contrats d'entreprise incluent souvent des services professionnels : assistance à la mise en œuvre, développement d'intégrations sur mesure et conseils en optimisation continue. Ces services peuvent engendrer des coûts supplémentaires de plusieurs dizaines de milliers d'euros, ponctuels ou récurrents.

Coûts cachés qui font grimper le prix des chatbots LLM

Le prix annoncé reflète rarement la réalité dans son intégralité. Plusieurs coûts cachés ou semi-cachés peuvent doubler le coût réel de l'exploitation de chatbots LLM.

Fenêtre contextuelle et gaspillage de jetons

Chaque conversation avec un LLM inclut non seulement le dernier message de l'utilisateur, mais aussi l'historique des échanges pour le contexte. Une conversation de dix échanges peut ainsi transmettre des milliers d'éléments de contexte à chaque nouveau message.

Les modèles dotés de fenêtres de contexte plus larges réduisent ce gaspillage en conservant davantage d'informations sur la conversation sans avoir à les renvoyer. La fenêtre de contexte d'un million de jetons de Claude Opus 4.6 représente un avantage majeur à cet égard : les conversations plus longues ne nécessitent pas de retransmission coûteuse du contexte.

Coûts de mise en cache rapide

Certains fournisseurs proposent une mise en cache rapide afin de réduire les coûts liés à l'envoi répété du même contexte. OpenAI et Anthropic prennent tous deux en charge différentes formes de mise en cache, mais leurs modèles de tarification diffèrent.

Les jetons mis en cache coûtent moins cher que les jetons neufs, mais tout le contenu ne se prête pas à la mise en cache. Comprendre quand la mise en cache est pertinente — et optimiser les invites pour maximiser les accès au cache — exige des compétences techniques dont les petites équipes ne disposent pas toujours.

Temps d'intégration et de développement

Les approches basées sur les API permettent de réduire les frais d'abonnement, mais engendrent des coûts de développement. La création d'un chatbot prêt pour la production nécessite :

- Infrastructure backend pour les appels d'API

- développement d'interface utilisateur

- Logique du flux de conversation et gestion des erreurs

- Mise en œuvre de mesures de sécurité pour les données utilisateur

- Systèmes de surveillance et d'enregistrement

- Maintenance continue au fur et à mesure de l'évolution des API

Pour une équipe de développement de taille moyenne, cela pourrait représenter 200 à 500 heures de travail initiales, auxquelles s'ajoutent 10 à 20 heures par mois pour la maintenance. Aux tarifs habituels des développeurs, cela correspond à un coût initial de 20 000 à 50 000 £ et à un coût mensuel récurrent de 1 500 à 3 000 £.

Préparation et formation aux données

Les LLM à usage général fonctionnent bien dès leur sortie d'usine, mais les performances spécifiques à un domaine nécessitent souvent un réglage fin ou des systèmes de génération augmentée par récupération (RAG).

Construire un système RAG signifie :

- Collecte et nettoyage des documents de l'entreprise

- Découpage approprié du contenu

- Générer et stocker des plongements lexicaux

- Mise en œuvre de la logique de récupération

- Tester et améliorer la qualité de la récupération

Ce travail a un coût. Les organisations consacrent souvent des semaines, voire des mois, à rendre leurs bases de connaissances opérationnelles.

Surveillance et assurance qualité

Les LLM génèrent parfois des réponses incorrectes, inappropriées ou non conformes à la marque. Les déploiements en entreprise nécessitent :

- Systèmes de surveillance des conversations

- Processus d'examen humain pour les interactions signalées

- Tests A/B de différentes invites et modèles

- Des audits réguliers de qualité et de conformité

Ces coûts opérationnels s'accumulent. Une entreprise peut avoir besoin de 0,5 à 2 ETP dédiés à la gestion de la qualité des chatbots, selon le volume de conversations et sa tolérance au risque.

Choisir le bon modèle de tarification

Face à une telle variété d'options, comment les organisations doivent-elles choisir entre les plateformes d'abonnement et le développement d'API, ou entre les modèles premium et les alternatives économiques ?

Calculs du volume d'utilisation

Commencez par estimer le volume de conversations et la consommation de jetons. Pour un chatbot de service client :

- Estimer les conversations quotidiennes (le volume de tickets existant sert de base de référence)

- Calculer le nombre moyen de jetons par conversation (500 à 2 000 est typique selon la complexité).

- Ajouter du tampon 30–50% pour la croissance et les pics inattendus

Calculez ensuite les coûts auprès des différents fournisseurs. Une entreprise gérant 10 000 conversations par mois à raison de 1 000 jetons chacune (500 en entrée, 500 en sortie) consommerait :

- 5 millions de jetons d'entrée par mois

- 5 millions de jetons de production par mois

À des tarifs différents selon les fournisseurs :

| Fournisseur/Modèle | Coût mensuel | Coût annuel |

|---|---|---|

| GPT-5.2 Pro | $945 | $11,340 |

| Claude Opus 4.6 | $150 | $1,800 |

| Grok 4 | $90 | $1,080 |

| o3 | $50 | $600 |

| DeepSeek V3.2 | $3.50 | $42 |

Ce calcul révèle des différences considérables. Mais attention : le prix ne fait pas tout.

Compromis entre qualité et coût

Les modèles moins chers sont souvent synonymes de résultats de moindre qualité. Dans les cas où la précision est essentielle (conseils médicaux, informations juridiques, conseils financiers), investir dans des modèles plus performants permet de réduire les risques.

Certains développeurs ont signalé que les coûts de mémoire peuvent augmenter de manière inattendue lors de la création de chatbots avec de longs historiques de conversation, en particulier avec des modèles qui ne prennent pas en charge une gestion efficace du contexte.

Tester différents modèles sur des cas d'utilisation spécifiques apporte la réponse la plus claire. Menez des projets pilotes avec 100 à 500 conversations réelles sur plusieurs modèles, en mesurant :

- Exactitude et pertinence des réponses

- Scores de satisfaction des utilisateurs

- Taux de résolution des conversations

- Escalade vers des agents humains

Le modèle offrant une qualité acceptable au prix le plus bas l'emporte. Il peut s'agir parfois d'un modèle haut de gamme, parfois d'un modèle de milieu de gamme tout aussi performant.

Décision de construire ou d'acheter

Les entreprises doivent-elles développer des chatbots personnalisés à l'aide d'API ou acheter des plateformes par abonnement ?

Les plateformes d'abonnement sont pertinentes lorsque :

- Les ressources techniques sont limitées.

- La rapidité de mise sur le marché compte plus que la personnalisation.

- Le volume de la conversation respecte les limites de la plateforme.

- Les intégrations standard couvrent les cas d'utilisation nécessaires

Le développement d'API a du sens lorsque :

- Les flux de travail uniques nécessitent une logique personnalisée

- Un volume élevé rend les coûts d'abonnement prohibitifs

- Une intégration profonde avec les systèmes existants est essentielle

- L'équipe technique dispose des ressources nécessaires au développement.

Le point de bascule se situe généralement autour de 25 000 à 50 000 conversations mensuelles. En dessous de ce seuil, les plateformes par abonnement sont plus avantageuses économiquement. Au-dessus, les implémentations d'API personnalisées coûtent généralement moins cher malgré les coûts de développement.

Gestion et optimisation des coûts LLM

Une fois mises en œuvre, plusieurs stratégies permettent de maîtriser les dépenses courantes.

Ingénierie rapide pour une efficacité accrue

Des invites bien conçues réduisent le gaspillage de jetons et améliorent la qualité du travail. Les techniques utilisées incluent :

- Utiliser des messages système concis qui établissent le contexte sans mots superflus

- Mettre en œuvre l'apprentissage avec peu d'exemples (2 à 3 au lieu de plus de 10)

- Structurer les résultats au format JSON ou autres formats afin de minimiser les explications verbeuses.

- Décomposer les tâches complexes en étapes plus petites lorsque cela est possible

Une réduction de 20% du nombre moyen de jetons par conversation se traduit directement par des économies de coûts de 20%.

Sélection du modèle par tâche

Toutes les tâches ne nécessitent pas le modèle le plus performant. Un routage intelligent peut permettre de réaliser des économies substantielles :

- Utilisez des modèles moins coûteux pour les FAQ simples et les décisions de routage

- Réservez les modèles coûteux aux raisonnements ou à la génération complexes.

- Mettre en place un système de notation de confiance pour déterminer à quel moment passer aux modèles premium.

Une approche par paliers pourrait utiliser GPT-4.1 Mini pour 70% de conversations et GPT-5.2 pour les 30% restants qui nécessitent des capacités avancées, réduisant ainsi le coût moyen de 50 à 60%.

Mise en cache et optimisation du contexte

L'utilisation de la mise en cache rapide, lorsqu'elle est disponible, réduit les coûts liés à la consultation répétée du contexte. L'utilisation stratégique du contenu mis en cache peut réduire considérablement les dépenses liées aux jetons.

Pour Anthropic Claude Code, les développeurs peuvent utiliser la commande /cost pour consulter des statistiques détaillées sur l'utilisation des jetons pour les sessions en cours, ce qui permet d'identifier les opportunités d'optimisation.

Surveillance et alertes d'utilisation

OpenAI et Anthropic proposent tous deux des outils de suivi de la consommation. La mise en place d'alertes permet d'éviter les mauvaises surprises sur les factures en cas de pics de consommation inattendus.

Indicateurs clés à surveiller :

- tendances quotidiennes de consommation de jetons

- Coût par conversation au fil du temps

- Distribution de sélection du modèle

- Taux d'erreur qui déclenchent des nouvelles tentatives et gaspillent des jetons

La console Claude d'Anthropic fournit des rapports détaillés sur les coûts et l'utilisation, accessibles aux développeurs, aux responsables de la facturation et aux administrateurs, permettant ainsi une gestion proactive des coûts.

Considérations relatives aux entreprises et remises sur volume

Les grandes organisations négocient souvent des tarifs plus avantageux que ceux indiqués dans les prix publiés des API.

Contrats d'entreprise personnalisés

Les entreprises s'engageant sur un volume important (souvent plus de $50 000 par an) peuvent négocier :

- Remises sur volume de 10 à 30%

- Niveaux de tarification personnalisés en fonction des dépenses engagées

- Garanties SLA pour la disponibilité et la latence

- Assistance dédiée et gestion technique de compte

- Options de déploiement privé pour la sensibilité des données

OpenAI, Anthropic et d'autres grands fournisseurs proposent tous des forfaits pour entreprises, mais les détails des prix ne sont pas divulgués publiquement.

Résidence des données et conformité

Les secteurs réglementés sont confrontés à des contraintes supplémentaires. Les organismes de santé doivent se conformer à la loi HIPAA ; les services financiers doivent respecter la norme SOC 2 ; les entreprises européennes doivent tenir compte des règles de résidence des données du RGPD.

Les accords d'entreprise comprennent souvent :

- Accords de partenariat commercial (APC) pour le secteur de la santé

- accords de traitement des données spécifiant le traitement des données

- Options de déploiement régional pour conserver les données dans des juridictions spécifiques

- Politiques de conservation des données zéro

Claude Code propose des options de conservation des données zéro pour les équipes soucieuses de la confidentialité de leurs données.

Ces fonctionnalités de conformité s'accompagnent parfois de tarifs plus élevés ou d'engagements de dépenses minimales.

Modèles émergents et tendances futures en matière de prix

Le marché des LLM évolue rapidement. Plusieurs tendances influencent les prix pour 2026 et au-delà.

Concours Open Source

Des modèles comme GLM-5 et Qwen3.5 constituent des alternatives open source de plus en plus performantes. Les organisations disposant de ressources techniques peuvent héberger elles-mêmes ces modèles, éliminant ainsi tout coût par jeton.

Le compromis réside dans les dépenses d'infrastructure. L'exécution d'un modèle à 40 milliards de paramètres nécessite des ressources GPU importantes — souvent de $500 à $2000 par mois en coûts GPU cloud ou un investissement substantiel en matériel sur site.

Pour les déploiements à très haut volume (millions de conversations quotidiennes), l'auto-hébergement peut s'avérer plus économique que les services API malgré les frais d'infrastructure.

Modèles spécialisés

Les modèles dédiés à des tâches spécifiques et optimisés pour des cas d'utilisation précis offrent souvent un meilleur rapport qualité-prix que les modèles phares généralistes. Le modèle de raisonnement o3 d'OpenAI coûte moins cher que o1 tout en offrant des performances supérieures pour certaines tâches analytiques.

À mesure que les fournisseurs proposent des modèles plus spécialisés, les organisations peuvent optimiser leurs coûts en adaptant les modèles aux exigences spécifiques de chaque cas d'utilisation plutôt que d'utiliser systématiquement des modèles phares coûteux.

Évolution de la tarification multimodale

Les modèles gérant les images, l'audio et d'autres modalités introduisent une complexité supplémentaire en matière de tarification. L'API Realtime d'OpenAI facture différemment les jetons de texte, d'audio et d'image : les jetons audio dans les messages des utilisateurs coûtent 1 jeton toutes les 100 ms et les jetons audio des assistants, 1 jeton toutes les 50 ms.

Pour les chatbots vocaux, ces coûts s'accumulent rapidement. Une conversation de 5 minutes représente 300 000 ms d'audio. Avec les débits de l'API temps réel d'OpenAI (1 jeton toutes les 100 ms pour l'audio de l'utilisateur, 1 jeton toutes les 50 ms pour l'audio de l'assistant), cela pourrait se traduire par 3 000 à 6 000 jetons, selon le découpage de la conversation, avant même tout traitement du texte.

Calcul du retour sur investissement

Comprendre les coûts ne représente que la moitié du problème. L'autre moitié consiste à quantifier la valeur ajoutée des chatbots.

Réduction des coûts de soutien

Le calcul du retour sur investissement le plus simple repose sur le nombre de tickets d'assistance évités. Si un chatbot traite 401 030 000 demandes entrantes et que chaque ticket traité par un humain coûte entre 1 400 000 et 1 400 000 en main-d'œuvre, les économies sont rapidement réalisées.

Pour une entreprise traitant 5 000 tickets d’assistance par mois au coût moyen de $8 :

- Coût total mensuel du support : $40,000

- Chatbot gérant l'erreur 40% : 2 000 billets automatisés

- Économies : 2 000 × $8 = $16 000 par mois

Si le chatbot coûte $2 000 par mois (y compris les frais de développement et d'API), les économies nettes sont de $14 000 par mois ou $168 000 par an.

Impact sur les revenus

Pour les chatbots de vente et de génération de prospects, les calculs de retour sur investissement se concentrent désormais sur l'amélioration des conversions :

- Engagement accru grâce à une disponibilité 24h/24 et 7j/7

- Des temps de réponse plus rapides réduisent les abandons

- Meilleure qualification des prospects avant la prise en charge humaine

- Recommandations de vente incitative et de vente croisée

Même une légère amélioration des taux de conversion peut justifier un investissement dans un chatbot. Une augmentation de 21 000 ₹ du taux de conversion sur un chiffre d'affaires mensuel de 1 400 000 ₹ représente 20 400 000 ₹, soit bien plus que les coûts habituels d'un chatbot.

Avantages intangibles

La valeur de certains chatbots est plus difficile à quantifier :

- Amélioration de la satisfaction client grâce à des réponses instantanées

- Une voix de marque cohérente dans toutes les interactions

- Des agents humains libérés pour des cas complexes à forte valeur ajoutée

- Collecte de données et analyse des tendances conversationnelles

Ces facteurs sont importants pour la compétitivité à long terme, même s'ils n'apparaissent pas directement dans les calculs financiers.

Arrêtez de surpayer les chatbots LLM et créez-le correctement.

Le coût d'un chatbot LLM dépend fortement de la conception du système. Le choix du modèle, la stratégie d'entraînement, l'utilisation des jetons et l'infrastructure influent tous sur le prix final. De nombreuses entreprises constatent que l'utilisation de modèles génériques non optimisés fait rapidement grimper leurs coûts opérationnels.

IA supérieure Cette entreprise collabore avec des sociétés ayant besoin de systèmes LLM personnalisés, conçus pour une utilisation en production. Elle développe et affine des modèles de langage complexes, prépare les données d'entraînement et optimise le déploiement afin que les chatbots restent précis et rentables malgré l'augmentation de leur utilisation. Son équipe de data scientists et d'ingénieurs, tous titulaires d'un doctorat, se concentre sur la création de systèmes d'IA adaptés aux flux de travail spécifiques, plutôt que sur l'utilisation de modèles standardisés.

Vous prévoyez de créer un chatbot pour votre LLM ? Contactez-nous. IA supérieure Avant de vous engager dans une architecture coûteuse, renseignez-vous clairement sur le coût réel de construction et d'exploitation de votre chatbot.

Exemples de coûts concrets

Pour rendre la tarification concrète, prenons en compte quelques scénarios réalistes :

Scénario 1 : Bot de FAQ pour petits sites de commerce électronique

- Volume: 2 000 conversations par mois

- Approche: Plateforme d'abonnement

- Coût: Frais de plateforme de $79/mois

- Résultat: Ce traitement de 60% de questions sur les produits a permis de réduire de moitié le volume des e-mails d'assistance.

Scénario 2 : Assistance SaaS de taille moyenne

- Volume: 15 000 conversations par mois

- Approche: Intégration API personnalisée avec Claude Opus

- Utilisation des jetons : 12 millions d'entrées, 8 millions de sorties par mois

- Coût de l'API : (12 × $5) + (8 × $25) = $260/mois

- Développement: $30 000 unités produites initialement, $2 000 unités de maintenance mensuelle.

- Coût de la première année : $30 000 + ($260 + $2 000 × 12) = $57 120

- Coût annuel récurrent : $27,120

- Résultat: Gère 45% de support de niveau 1, économise 2 ETP

Scénario 3 : Assistant multicanal d’entreprise

- Volume: 200 000 conversations par mois sur le web, les appareils mobiles et la voix

- Approche: Modèle hybride utilisant DeepSeek pour les requêtes simples et GPT-5.2 pour les requêtes complexes.

- Utilisation des jetons : 120M en entrée (80M DeepSeek, 40M GPT), 80M en sortie (50M DeepSeek, 30M GPT)

- Coût de l'API : DeepSeek : (80 × $0,28) + (50 × $0,42) = $43,40 ; GPT : (40 × $21) + (30 × $168) = $5 880

- Coût total mensuel de l'API : $2,442

- Infrastructure: $5 000 par mois (équilibrage de charge, surveillance, bases de données)

- Équipe: 2 ETP pour la maintenance et l'optimisation = 1 TP4T20 000 par mois

- Coût mensuel total : $27,442

- Résultat: Gère 70% d'interactions clients, remplaçant 8 ETP de support

Ces exemples illustrent comment les coûts évoluent en fonction du volume et de la sophistication.

Questions fréquentes sur les prix

Existe-t-il des options de LLM gratuites ?

Oui, plusieurs fournisseurs proposent des versions gratuites. D'après la page de tarification d'OpenAI, leur offre gratuite donne un accès limité à GPT-5.2, avec des limitations de messages et des temps de réponse plus longs. Cela convient pour l'expérimentation, mais pas pour les déploiements en production.

Les modèles open source peuvent être auto-hébergés sans aucun coût de licence logicielle, mais les dépenses d'infrastructure demeurent.

Comment fonctionnent les remises pour entreprises ?

Les entreprises clientes s'engageant sur des volumes importants peuvent négocier des tarifs personnalisés, souvent de 10 à 30% inférieurs aux prix API publiés. Ces accords exigent généralement un engagement de dépenses annuel minimum de $50 000 à $100 000+.

Que se passe-t-il si l'utilisation dépasse les limites du forfait ?

Les plateformes d'abonnement facturent généralement des frais de dépassement (souvent plus élevés à l'unité) ou suspendent le service jusqu'au prochain cycle de facturation. Les services API, quant à eux, continuent de fonctionner, mais les frais s'accumulent au-delà des dépenses engagées.

Les coûts peuvent-ils être prévus avec précision ?

L'estimation de l'utilisation s'affine avec le temps, mais la variabilité persiste. Des contenus viraux inattendus, des pics saisonniers ou des changements de comportement des utilisateurs peuvent entraîner des fluctuations d'utilisation de 2 à 5 fois. Prévoir une marge de sécurité de 30 à 50% permet d'éviter les mauvaises surprises.

Existe-t-il des différences de prix selon les régions ?

Certains fournisseurs ajustent leurs tarifs selon la région, tandis que les principaux services d'API comme OpenAI et Anthropic appliquent des tarifs globaux uniformes. Les exigences de résidence des données imposent parfois le recours à des déploiements régionaux, qui entraînent des surcoûts.

Questions fréquemment posées

Quel est le coût moyen d'un chatbot IA en 2026 ?

Le coût moyen varie considérablement selon l'approche. Les plateformes d'abonnement pour les petites entreprises coûtent entre $30 et $300 par mois. Les solutions pour les entreprises de taille moyenne coûtent entre $300 et $1 000 par mois. Les déploiements en grande entreprise dépassent souvent $3 000 par mois. Pour les implémentations basées sur une API, les coûts dépendent du volume : comptez généralement entre $100 et $5 000 par mois pour la plupart des organisations, tandis que les déploiements en grande entreprise à fort volume peuvent parfois atteindre plus de $20 par mois rien que pour les jetons.

Quel est le coût de l'API ChatGPT par rapport à Claude ?

En février 2026, le modèle GPT-5.2 Pro d'OpenAI coûte $21 par million de jetons d'entrée et $168 par million de jetons de sortie, tandis que Claude Opus 4.6 d'Anthropic coûte $5 en entrée et $25 en sortie par million de jetons. Claude est nettement moins cher : environ 67% de moins que GPT-5.2 Pro. Pour 10 millions de jetons d'entrée et 5 millions de jetons de sortie par mois, GPT-5.2 coûte $1 050 contre $175 pour Claude.

Quels sont les facteurs qui influencent le plus le prix des chatbots LLM ?

Les principaux facteurs de coût sont le volume de conversations, le nombre de jetons par conversation, le choix du modèle et l'approche d'implémentation. Une entreprise utilisant des modèles haut de gamme comme GPT-5.2 Pro pour un volume élevé de conversations peut payer 100 à 400 fois plus cher qu'une entreprise utilisant des modèles économiques comme DeepSeek pour un nombre de conversations similaire. La taille de la fenêtre de contexte, l'efficacité de la mise en cache et la nécessité d'un développement personnalisé ont également un impact significatif sur le coût total de possession.

Est-il moins cher de créer un chatbot personnalisé ou d'utiliser une plateforme ?

Pour des volumes inférieurs à 25 000 conversations mensuelles, les plateformes d'abonnement sont généralement plus économiques, compte tenu du temps de développement. Au-delà de ce seuil, les implémentations d'API personnalisées deviennent plus rentables malgré des coûts de développement initiaux de 20 000 à 50 000 TP4T. Le point de basculement dépend de la disponibilité de l'équipe technique et des besoins spécifiques en fonctionnalités. Les solutions personnalisées offrent une plus grande flexibilité, mais nécessitent une maintenance continue.

Les fournisseurs de LLM proposent-ils des formules gratuites ?

Oui, la plupart des grands fournisseurs proposent un accès gratuit limité. OpenAI propose une formule gratuite avec un accès restreint à GPT-5.2, un nombre de messages limité et des temps de réponse plus longs. Ces formules gratuites conviennent aux tests et à l'expérimentation, mais leurs limitations les rendent inadaptées à une utilisation en production. Dès que le volume de conversations atteint des centaines ou des milliers par mois, un abonnement payant devient nécessaire.

Comment puis-je réduire les coûts de l'API LLM sans sacrifier la qualité ?

Plusieurs stratégies permettent de réduire les coûts tout en maintenant la qualité : utiliser un routage hiérarchisé des modèles (modèles moins coûteux pour les requêtes simples, modèles plus performants pour les requêtes complexes), optimiser les invites pour réduire le gaspillage de jetons, exploiter la mise en cache des invites lorsqu’elle est disponible, implémenter des fenêtres de contexte plus larges pour éviter les transmissions de contexte répétées et tester plusieurs modèles afin de trouver le meilleur rapport performance/prix pour des cas d’utilisation spécifiques. De nombreuses organisations réalisent des économies de 30 à 501 TP3T grâce à ces optimisations.

Quels coûts cachés dois-je prévoir au-delà du prix de l'API ?

Outre les coûts directs d'API ou d'abonnement, il faut prévoir un budget pour le temps de développement (entre 20 000 et 50 000 TP4T initialement pour les solutions personnalisées), la maintenance continue (entre 1 500 et 5 000 TP4T par mois), l'infrastructure d'hébergement et de surveillance (entre 500 et 5 000 TP4T par mois selon l'envergure du projet), la préparation des données et la création de la base de connaissances (plusieurs semaines, voire plusieurs mois), ainsi que l'assurance qualité, incluant les processus de vérification humaine. Ces coûts cachés doublent ou triplent souvent le prix apparent des services LLM.

Prendre votre décision concernant le prix de votre chatbot LLM

En 2026, le marché des chatbots LLM offre plus d'options que jamais, mais aussi une complexité accrue. L'écart entre les solutions économiques et haut de gamme s'est creusé, allant désormais de $0,28/$0,42 par million de jetons pour DeepSeek à $21/$168 pour GPT-5.2 Pro d'OpenAI.

Il n'existe pas de solution unique pour tous les cas de figure. Les petites entreprises qui testent l'IA conversationnelle tirent profit des plateformes d'abonnement qui regroupent technologie et assistance pour des frais mensuels fixes. Les entreprises en pleine croissance avec un volume d'activité modéré trouvent souvent que les plateformes de milieu de gamme ou les implémentations d'API aux modèles économiques, comme Claude Opus ou o3, offrent le meilleur rapport qualité-prix. Les grandes entreprises disposant de ressources techniques peuvent optimiser leurs coûts grâce au développement sur mesure, au routage des modèles et à la négociation des volumes.

L'essentiel est de commencer par des estimations d'utilisation claires, de tester plusieurs approches avec des charges de travail réelles et de mesurer non seulement les coûts, mais aussi les résultats : tickets d'assistance résolus, taux de conversion améliorés, satisfaction client accrue. Ce sont ces indicateurs qui déterminent le véritable retour sur investissement.

Une chose est sûre : les prix continueront d’évoluer. De nouveaux modèles sont lancés chaque mois, les fournisseurs existants ajustent leurs tarifs et les alternatives open source s’améliorent. Les organisations qui conçoivent des architectures flexibles permettant de changer facilement de modèle se positionnent de manière à optimiser leurs coûts face aux fluctuations du marché.

Prêt à explorer les options de chatbot LLM adaptées à vos besoins spécifiques ? Commencez par calculer votre volume de conversations mensuel et votre consommation de jetons prévus. Testez les offres gratuites de plusieurs fournisseurs avec des cas d’utilisation représentatifs. Choisissez ensuite la solution qui offre une qualité acceptable à un coût raisonnable ; pas forcément la moins chère ni la plus chère, mais celle qui présente le meilleur rapport qualité-prix pour vos exigences particulières.