Résumé rapide : Les tendances en matière d'analyse prédictive en 2026 s'articulent autour des prévisions en temps réel, de l'automatisation pilotée par l'IA, de l'apprentissage automatique causal pour les chaînes d'approvisionnement et de la personnalisation de l'expérience client. Le marché connaît une croissance annuelle de 22 à 281 milliards de dollars, les entreprises tirant parti des architectures événementielles et de l'apprentissage automatique avancé pour transformer les données historiques en informations exploitables pour l'avenir dans les secteurs de la santé, du commerce de détail, de la finance et de l'industrie manufacturière.

Le marché de l'analyse prédictive poursuit sa croissance fulgurante. Avec un chiffre d'affaires estimé entre 14 000 et 17 000 à 22 000 milliards de dollars en 2025, il maintient un taux de croissance annuel de 221 000 à 281 000 milliards de dollars sur les cinq prochaines années. Il ne s'agit pas d'une simple progression, mais d'une transformation profonde du processus décisionnel des entreprises.

Mais voilà : l’analyse prédictive a bien changé depuis deux ans. Les techniques, les outils et les applications ont considérablement évolué. Le traitement des données en temps réel, l’apprentissage automatique causal et l’automatisation par l’IA redéfinissent les pratiques.

Quelles sont donc les tendances qui façonnent réellement le secteur en 2026 ? Analysons les évolutions importantes.

Que sera réellement l'analyse prédictive en 2026 ?

L'analyse prédictive utilise des données historiques, des méthodes statistiques et des modèles d'apprentissage automatique pour prévoir les résultats ou les tendances futures. Selon Stanford HAI, ces techniques analysent les schémas des données historiques afin d'estimer la probabilité d'événements tels que le comportement des clients, les pannes d'équipement ou les fluctuations du marché.

Cette pratique se situe à la croisée des mathématiques, des statistiques et de l'informatique. Elle diffère fondamentalement de l'analyse descriptive (que s'est-il passé ?) ou de l'analyse diagnostique (pourquoi cela s'est-il produit ?). L'analyse prédictive, quant à elle, répond à la question : que va-t-il se passer ?

| Type d'analyse | Réponse à la question | Utilisation principale |

|---|---|---|

| Descriptif | Ce qui s'est passé? | Rapports historiques |

| Diagnostique | Pourquoi cela s'est-il produit ? | analyse des causes profondes |

| Prédictif | Que va-t-il se passer ? | Prévision et probabilité |

| Prescriptif | Que devons-nous faire ? | Optimisation des décisions |

La principale différence entre l'analyse prédictive et l'apprentissage automatique réside dans leur portée et leur application. L'analyse prédictive vise à prévoir les résultats de décisions commerciales spécifiques. L'apprentissage automatique, quant à lui, permet aux systèmes d'apprendre à partir des données et d'améliorer leurs performances sans programmation explicite.

Cela dit, la frontière s'estompe. Les implémentations modernes d'analyse prédictive exploitent largement les techniques d'apprentissage automatique, notamment l'apprentissage profond et les réseaux neuronaux.

L'apprentissage automatique causal transforme la gestion de la chaîne d'approvisionnement

L'une des tendances les plus marquantes est le passage des modèles basés sur la corrélation aux approches causales. Selon une étude du NIST publiée en janvier 2026, l'apprentissage automatique causal représente une avancée empirique majeure dans la gestion de la chaîne d'approvisionnement.

Les modèles prédictifs traditionnels identifient des schémas : “ Quand X se produit, Y a tendance à suivre. ” Les modèles causaux vont plus loin : “ X cause Y par le biais du mécanisme Z. ” Cette distinction est extrêmement importante pour prendre des décisions d’intervention.

Dans le domaine des chaînes d'approvisionnement en particulier, l'apprentissage automatique causal permet de répondre à des questions telles que :

- Le changement de fournisseur A permettra-t-il réellement de réduire les délais, ou cette corrélation est-elle fallacieuse ?

- Quel est le véritable impact des changements de politique de gestion des stocks sur la satisfaction client ?

- Quelles perturbations se propagent réellement à travers le réseau et lesquelles restent isolées ?

Le cadre NIST démontre comment les techniques d'inférence causale peuvent être appliquées aux données réelles des chaînes d'approvisionnement, passant de la simple prédiction à la compréhension des mécanismes sous-jacents qui déterminent les résultats.

Et il ne s'agit pas d'une simple théorie. Les fabricants mettent déjà en œuvre des modèles causaux pour optimiser leurs approvisionnements, réduire le gaspillage et renforcer leur résilience face aux perturbations.

Les architectures de données en temps réel permettent des prévisions immédiates

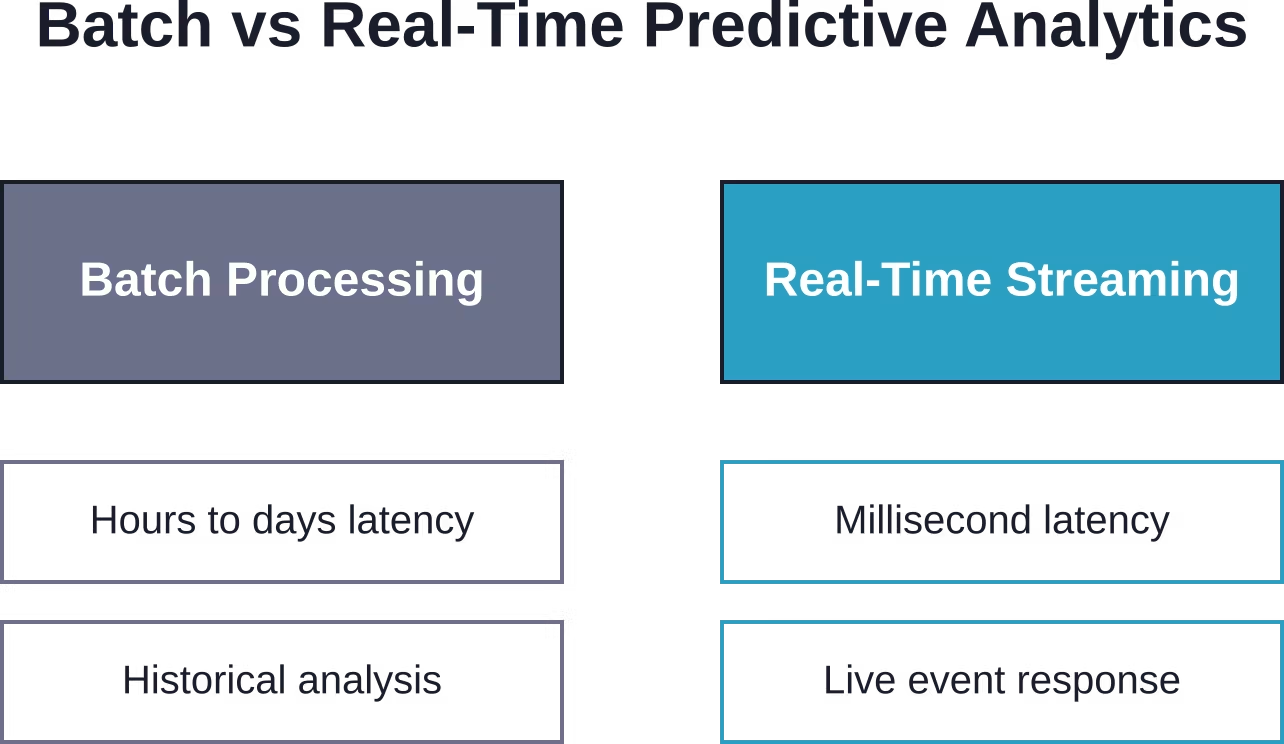

Le traitement par lots cède du terrain à l'analyse en temps réel. Les architectures événementielles (EDA) et les plateformes de données en mouvement deviennent le socle des systèmes prédictifs qui doivent réagir immédiatement.

Voici pourquoi c'est important : les modèles prédictifs traditionnels fonctionnent souvent avec des données datant de plusieurs heures, voire de plusieurs jours. Pour des cas d'utilisation comme la détection de fraudes, la surveillance d'équipements ou la tarification dynamique, ce délai est inacceptable.

Les technologies de données en temps réel permettent :

- Détection immédiate des anomalies dans les flux de transactions

- Prédiction des pannes d'équipements en fonctionnement basée sur les données des capteurs

- Personnalisation dynamique de l'expérience client pendant les sessions actives

- Alertes instantanées sur les risques liés à la chaîne d'approvisionnement au fur et à mesure que les événements se déroulent

Ce changement exige une infrastructure technique différente : des plateformes de traitement de flux, des courtiers d’événements et des modèles optimisés pour une faible latence. Mais le gain est considérable : des prédictions exploitables au moment précis où elles sont nécessaires.

La personnalisation basée sur l'IA atteint un nouveau niveau de sophistication

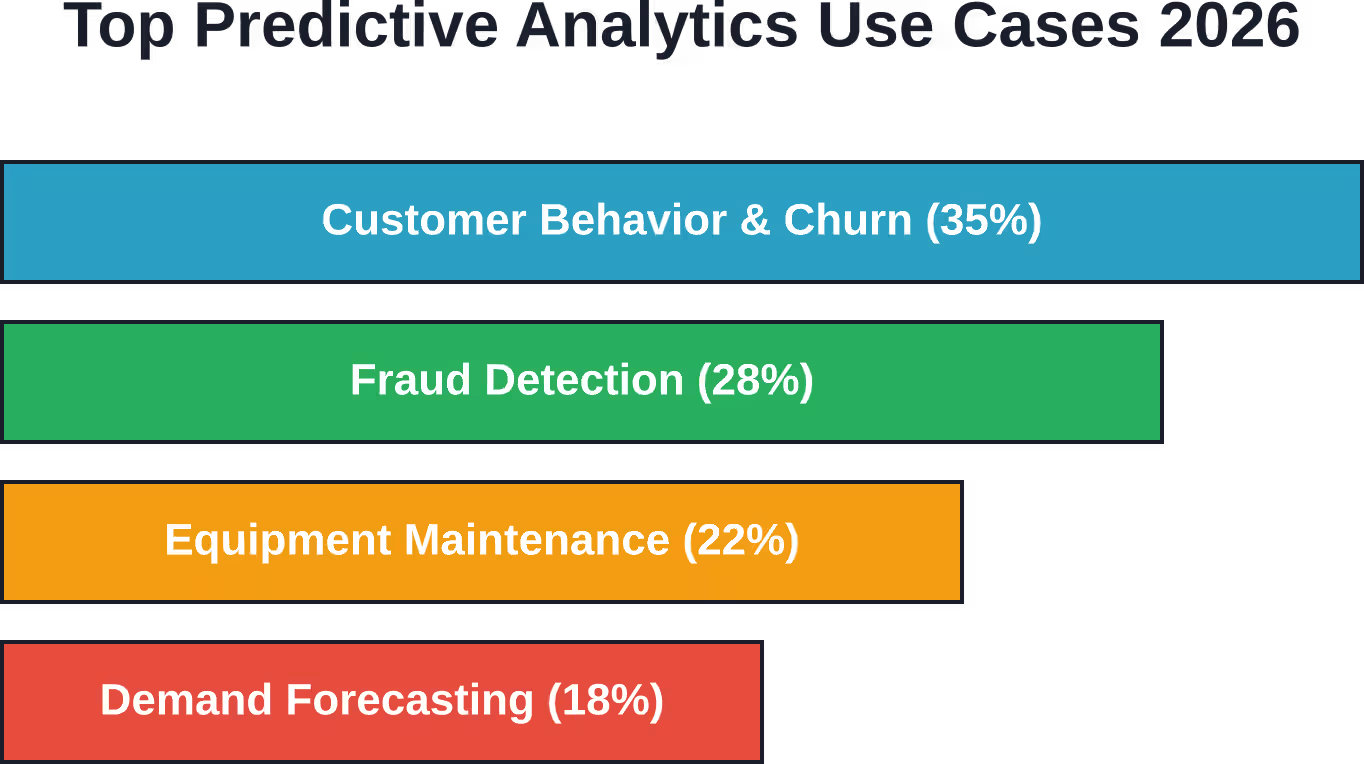

L'analyse des données clients a toujours été un cas d'usage fondamental de l'analyse prédictive. Mais le niveau de personnalisation possible en 2026 est remarquable.

Les entreprises qui utilisent des techniques avancées d'analyse prédictive des clients et de personnalisation constatent une augmentation de leurs revenus. Ce constat est corroboré par de nombreuses analyses sectorielles et témoigne de la maturité des moteurs de recommandation, des systèmes de contenu dynamique et des modèles de prédiction comportementale.

Les grandes entreprises de commerce électronique font état d'améliorations significatives de la fidélisation client grâce à l'analyse prédictive. Si l'envergure d'Amazon est unique, les techniques sous-jacentes — filtrage collaboratif, exploration de modèles séquentiels, modélisation de la propension — sont de plus en plus accessibles aux organisations de plus petite taille.

Les plateformes modernes d'analyse client combinent :

- Analyse des séquences comportementales pour prédire les actions suivantes

- Analyse des sentiments à partir des interactions textuelles et vocales

- Modélisation de la valeur vie client pour la priorisation de la fidélisation

- Prédiction du taux de désabonnement avec recommandations d'intervention

Le passage des prévisions segmentées aux prévisions individuelles est presque achevé. Les modèles d'apprentissage automatique peuvent désormais générer simultanément des prévisions personnalisées pour des millions de clients, une prouesse informatiquement impossible il y a encore cinq ans.

Les petits fabricants accèdent à l'IA grâce à des outils pratiques

L'analyse prédictive n'est plus l'apanage des grandes entreprises. Selon une étude du NIST menée auprès de petites entreprises manufacturières, l'intelligence artificielle est devenue un élément crucial de l'adoption de l'Industrie 4.0, même pour les PME et les petites structures de production.

Qu’est-ce qui a changé ? Principalement l’accessibilité et le coût des outils. Les plateformes d’analyse basées sur le cloud, les modèles pré-entraînés et les interfaces low-code/no-code ont considérablement abaissé les barrières à l’entrée.

Les petits fabricants tirent parti de l'analyse prédictive pour :

- Planification de la maintenance des équipements basée sur les données des capteurs

- Prédiction de la qualité pour réduire les défauts et les déchets

- Prévision de la demande pour l'optimisation des stocks

- Prévision de la consommation d'énergie pour la gestion des coûts

Les centres MEP (Manufacturing Extension Partnership) ont joué un rôle dans la diffusion de ces capacités, aidant les fabricants à identifier les cas d'utilisation et à mettre en œuvre des solutions sans investissement massif.

Soyons francs : l’analyse prédictive pour le secteur manufacturier ne nécessite plus une équipe de data scientists. De nombreuses plateformes proposent des modèles spécifiques à l’industrie et un apprentissage automatique des modèles que les responsables de production peuvent configurer eux-mêmes.

Développement du diagnostic et de la prévision des ressources en soins de santé

Le secteur de la santé demeure l'un des domaines où l'analyse prédictive a le plus fort impact. Ses applications vont de l'aide au diagnostic au niveau du patient à la planification des ressources à l'échelle du système.

Les principaux cas d'utilisation dans le secteur de la santé en 2026 comprennent :

- Prédiction des défaillances d'équipements pour les dispositifs médicaux critiques

- Modélisation du risque de réadmission des patients

- Prévision de l'évolution des maladies chroniques

- prévision de la capacité hospitalière et des besoins en personnel

- Probabilité de résultat du traitement pour les soins personnalisés

La précision de ces modèles continue de s'améliorer à mesure que les systèmes de dossiers médicaux électroniques (DME) gagnent en maturité et que la qualité des données s'accroît. Les techniques d'apprentissage automatique, comme les réseaux LSTM (Long Short-Term Memory), excellent dans le traitement des données de santé temporelles, permettant de suivre l'évolution de l'état de santé des patients au fil du temps.

Mais un défi se pose : les modèles prédictifs en santé doivent être explicables. Les réseaux neuronaux opaques, incapables de justifier leurs prédictions, se heurtent à des obstacles réglementaires et éthiques. Cela a engendré d’importantes innovations dans les techniques d’apprentissage automatique interprétables et d’inférence causale.

Les prévisions financières deviennent plus précises

Les services financiers utilisent l'analyse prédictive depuis des décennies ; le scoring de crédit est fondamentalement un modèle prédictif. La nouveauté réside dans la finesse et l'étendue des applications.

Les prévisions financières modernes exploitent l'analyse prédictive pour :

- Détection des fraudes en temps réel sur l'ensemble des flux de transactions

- Prédiction des mouvements de marché pour le trading algorithmique

- Évaluation du risque de crédit à l'aide de sources de données alternatives

- Prévisions de flux de trésorerie pour la gestion de trésorerie

- Modélisation de la valeur vie client pour l'optimisation de l'acquisition

Une tendance notable : l’intégration de données non structurées, telles que l’analyse du sentiment des médias, les signaux des réseaux sociaux et l’imagerie satellite, dans les modèles financiers. Ces sources de données alternatives fournissent des signaux prédictifs que les données structurées traditionnelles ne permettent pas de déceler.

WHOOP, par exemple, a amélioré ses prévisions financières grâce à l'IA et à l'apprentissage automatique, tout en optimisant l'expérience de ses membres en centralisant l'accès aux données sur des plateformes modernes. Cette combinaison – de meilleures prévisions et une expérience client améliorée – illustre l'intégration de l'analyse prédictive dans toutes les fonctions de l'entreprise, au lieu de son cloisonnement au sein de la finance.

Principaux modèles et techniques d'analyse prédictive

Les fondements techniques de l'analyse prédictive continuent d'évoluer. Si les méthodes statistiques classiques restent pertinentes, l'apprentissage automatique domine les implémentations modernes.

Modèles de régression

La régression linéaire, la régression logistique et la régression polynomiale permettent de réaliser des prédictions continues et catégorielles. Elles sont interprétables, rapides à entraîner et efficaces lorsque les relations sont relativement linéaires. Les prévisions financières et l'évaluation simple des risques reposent souvent sur la régression.

Arbres de décision et méthodes d'ensemble

Les forêts aléatoires, les algorithmes de gradient boosting (comme XGBoost et LightGBM) et les techniques d'ensemble combinent plusieurs modèles pour une précision accrue. Ils gèrent efficacement les relations non linéaires, les interactions entre les caractéristiques et les données manquantes. La prédiction du taux de désabonnement des clients et l'évaluation du crédit font fréquemment appel à ces méthodes d'ensemble.

Réseaux neuronaux et apprentissage profond

L'apprentissage profond excelle dans la reconnaissance de formes complexes, notamment dans les données non structurées telles que les images, les textes et les séries temporelles. Les réseaux LSTM, les réseaux de neurones convolutifs (CNN) et les architectures de type Transformer sont au cœur des applications de prévision avancées. Le diagnostic médical et le traitement automatique du langage naturel reposent largement sur l'apprentissage profond.

Prévisions de séries chronologiques

ARIMA, Prophet et des architectures neuronales spécialisées permettent de traiter les données temporelles présentant une saisonnalité et des tendances. La prévision de la demande, les prévisions de ventes et la planification des ressources reposent sur des techniques robustes d'analyse des séries temporelles.

Regroupement et classification

Les algorithmes K-means, de clustering hiérarchique, de machines à vecteurs de support et de classification bayésienne permettent de segmenter les données et d'attribuer des prédictions de catégorie. La segmentation client et la détection des fraudes tirent parti de ces approches.

Le choix de la technique dépend des caractéristiques des données, des exigences d'interprétabilité, des ressources de calcul et de la tâche de prédiction spécifique. De nombreux systèmes de production utilisent des approches d'ensemble, combinant plusieurs types de modèles pour tirer parti de leurs atouts complémentaires.

Optimisation de la production alimentaire grâce aux réseaux LSTM

Le gaspillage alimentaire demeure l'un des défis persistants auxquels est confrontée l'industrie. Des prévisions de la demande erronées entraînent une surproduction, des pertes et une mauvaise allocation des ressources.

Des recherches récentes sur l'analyse prédictive de la production alimentaire ont démontré l'efficacité d'une approche d'apprentissage automatique utilisant des réseaux de neurones à mémoire long-court terme (LSTM). Ce système prévoit les quantités et les transactions alimentaires à partir de données de ventes historiques combinées à des caractéristiques telles que le jour, le mois et les attributs spécifiques à chaque article.

Résultat ? Une précision de 89,68% dans la prévision de la demande. Ce niveau de précision permet une réduction significative du gaspillage, une gestion optimisée des stocks et une meilleure allocation des ressources, générant ainsi des avantages économiques et environnementaux pour une production alimentaire durable.

Les réseaux LSTM sont particulièrement adaptés à cette application car ils capturent les dépendances à long terme dans les données séquentielles. La demande alimentaire présente des schémas complexes (cycles hebdomadaires, tendances mensuelles, variations saisonnières, effets des jours fériés) que les modèles plus simples peinent à représenter.

Cette approche démontre comment des architectures neuronales spécialisées peuvent résoudre des problèmes de prévision spécifiques à un secteur d'activité qui étaient auparavant insolubles.

Outils et plateformes permettant l'analyse prédictive

L'écosystème de l'analyse prédictive comprend une gamme d'outils couvrant différents cas d'utilisation et niveaux de compétences techniques.

Les plateformes cloud comme Snowflake offrent des fonctionnalités intégrées d'entreposage et d'analyse de données. Elles centralisent l'accès aux données, réduisent la complexité de l'infrastructure et permettent aux équipes de créer des modèles prédictifs sans avoir à gérer de serveurs.

Les plateformes d'apprentissage automatique spécialisées proposent des pipelines automatisés pour l'entraînement des modèles, l'optimisation des hyperparamètres et le déploiement. Elles permettent de réduire le délai entre les données et la mise en production du modèle de plusieurs mois à quelques jours.

Les frameworks open source — scikit-learn, TensorFlow, PyTorch, XGBoost — offrent aux data scientists un contrôle et une personnalisation précis. Ils constituent la base du développement de modèles sur mesure lorsque les solutions prêtes à l'emploi ne conviennent pas.

Les outils de veille stratégique intègrent de plus en plus directement des fonctionnalités prédictives. Les utilisateurs non techniques peuvent ainsi générer des prévisions via des interfaces guidées, sans avoir à écrire de code.

La tendance est à la démocratisation : rendre l’analyse prédictive accessible à un plus grand nombre de profils, et non plus seulement aux data scientists. Mais cela ne signifie pas une simplification excessive ; il s’agit plutôt de proposer des abstractions et des interfaces plus performantes qui viennent s’ajouter à des techniques sophistiquées.

Défis et considérations

L'analyse prédictive n'est pas une solution miracle. Plusieurs défis persistent :

Qualité et disponibilité des données

La qualité d'un modèle dépend de la qualité de ses données d'entraînement. Des données incomplètes, biaisées ou obsolètes produisent des prédictions peu fiables. La gouvernance des données et la qualité du pipeline sont tout aussi importantes que le choix de l'algorithme.

Interprétabilité du modèle

Les modèles complexes, tels que les réseaux neuronaux profonds, fonctionnent souvent comme des boîtes noires. Or, pour les secteurs réglementés ou les décisions à forts enjeux, l'explicabilité est indispensable. C'est ce qui motive la recherche continue en matière d'apprentissage automatique interprétable.

Surapprentissage et généralisation

Les modèles peuvent mémoriser des données d'entraînement plutôt que d'apprendre des schémas généralisables. Une validation rigoureuse, une régularisation et des tests sur des données mises de côté sont essentiels pour garantir de bonnes performances des modèles sur de nouvelles entrées.

Problèmes éthiques et de partialité

Les modèles prédictifs peuvent perpétuer ou amplifier les biais présents dans les données historiques. Les applications visant à garantir l'équité en matière de prêts, d'embauche et de soins de santé nécessitent un audit rigoureux des biais et des stratégies d'atténuation appropriées.

Intégration et opérationnalisation

La création d'un modèle est une chose ; son déploiement dans des systèmes de production où il apporte une valeur ajoutée à l'entreprise en est une autre. Les pratiques MLOps (gestion des versions, surveillance, réentraînement) sont essentielles pour une analyse prédictive durable.

Les organisations qui réussissent en matière d'analyse prédictive prennent ces défis au sérieux plutôt que de les considérer comme des questions secondaires.

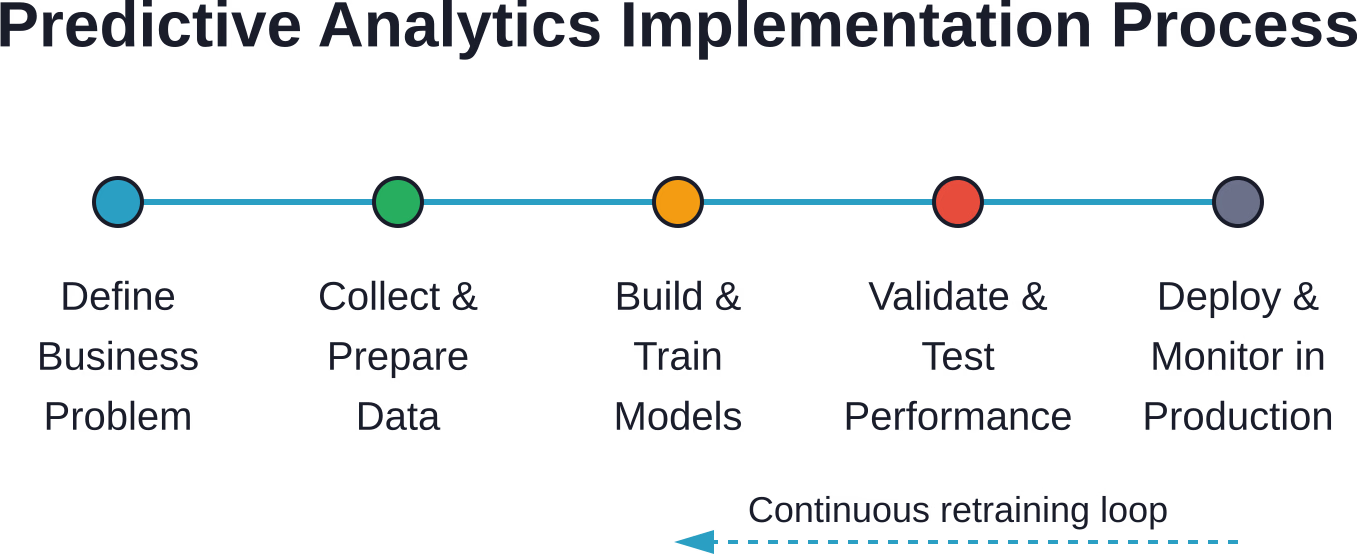

Premiers pas avec l'analyse prédictive

Les organisations qui découvrent l'analyse prédictive devraient adopter une approche pragmatique :

- Commencez par identifier clairement le problème commercial : Ne créez pas de modèles à la recherche d'applications. Identifiez une décision précise qu'une meilleure prévision permettrait d'améliorer : le taux d'attrition client, les niveaux de stock, les pannes d'équipement.

- Évaluer la disponibilité des données : Disposez-vous de données historiques suffisantes ? Sont-elles propres et accessibles ? La préparation des données représente généralement entre 60 et 80 % du temps de projet. La sous-estimer est une cause fréquente d’échec.

- Commencez par des bases simples : La régression linéaire ou les arbres de décision offrent souvent des résultats surprenants avant de passer à des modèles d'apprentissage profond complexes. Les modèles simples sont plus rapides à déployer, plus faciles à interpréter et servent de référence en matière de performance.

- Investir dans les infrastructures : L'analyse prédictive nécessite des pipelines de données, des environnements d'entraînement de modèles et des plateformes de déploiement. Les solutions basées sur le cloud permettent de réduire les coûts d'investissement initiaux.

- Constituez des équipes transversales : L'analyse prédictive efficace combine expertise du domaine, ingénierie des données et modélisation statistique. Personne ne possède à lui seul toutes ces compétences.

- Mesurez l'impact commercial, et pas seulement la précision du modèle : Un modèle avec une précision de 95% qui ne modifie pas les décisions est inutile. Suivez l'influence des prédictions sur les actions et les résultats.

Les barrières à l'entrée n'ont jamais été aussi basses. Mais le succès exige toujours une mise en œuvre rigoureuse et des attentes réalistes.

Créez des modèles prédictifs qui fonctionnent réellement avec vos données.

La plupart des projets d'analyse prédictive échouent car les modèles ne correspondent pas aux données réelles ni aux processus de décision. IA supérieure développe des modèles d'apprentissage automatique personnalisés qui utilisent des données historiques et actuelles pour faciliter les prévisions, la détection de tendances et des décisions plus précises.

Transformer les analyses prédictives en modèles opérationnels

AI Superior se concentre sur la mise en œuvre pratique, et non sur la théorie :

- Développement de modèles basés sur vos données

- Identification de modèles et de signaux dans de grands ensembles de données

- Soutien aux processus de décision fondés sur les données

- Intégration aux systèmes existants

- Validation par le biais de petites implémentations testables

Parlez à l'IA supérieure et découvrez comment vos données peuvent être transformées en modèles prédictifs fonctionnels.

Questions fréquemment posées

Qu’est-ce que l’analyse prédictive et comment fonctionne-t-elle ?

L'analyse prédictive utilise des données historiques, des algorithmes statistiques et l'apprentissage automatique pour prévoir les résultats futurs. Elle fonctionne en identifiant des tendances dans les données passées (achats clients, relevés de capteurs d'équipements, tendances du marché, etc.) et en appliquant ces tendances pour établir des prédictions probabilistes sur les événements à venir. Le processus comprend la collecte de données, l'entraînement du modèle sur des exemples historiques, sa validation pour garantir sa précision et son déploiement pour générer des prévisions à partir de nouvelles données.

Quels secteurs tirent le plus grand profit de l'analyse prédictive ?

Les secteurs de la santé, de la finance, du commerce de détail, de l'industrie et des télécommunications tirent un profit considérable de l'analyse prédictive. Le secteur de la santé l'utilise pour le diagnostic des patients et la planification des ressources. Les services financiers l'appliquent à la détection des fraudes et à l'évaluation du risque de crédit. Les détaillants exploitent la prédiction du comportement des clients et la prévision de la demande. Les fabricants anticipent les pannes d'équipement et optimisent leur production. Tout secteur disposant d'un important historique de données et dont les décisions sont influencées par l'incertitude future peut en bénéficier.

En quoi l'analyse prédictive diffère-t-elle de l'apprentissage automatique ?

L'analyse prédictive est une application qui vise à prévoir des résultats commerciaux spécifiques à partir de données. L'apprentissage automatique regroupe des techniques permettant aux systèmes d'apprendre des modèles à partir de données sans programmation explicite. L'analyse prédictive utilise souvent des méthodes d'apprentissage automatique, mais l'apprentissage automatique n'est pas toujours prédictif (certaines sont descriptives ou prescriptives). La principale distinction : l'analyse prédictive décrit l'objectif visé (prévoir l'avenir), tandis que l'apprentissage automatique décrit la méthode employée (apprentissage algorithmique de modèles).

Quelle est la taille des organisations qui ont besoin de capacités d'analyse prédictive ?

Les organisations de toutes tailles peuvent en tirer profit, même si les applications diffèrent. Les grandes entreprises utilisent l'analyse prédictive pour des prévisions complexes à variables multiples à l'échelle mondiale. Les PME l'appliquent à des cas d'usage ciblés, comme la fidélisation client ou l'optimisation des stocks. Même les petits fabricants ont désormais accès à la maintenance prédictive grâce à des plateformes cloud abordables et des outils spécifiques à leur secteur. La question n'est pas la taille de l'organisation, mais plutôt de savoir si de meilleures prévisions permettraient d'améliorer suffisamment certaines décisions pour justifier l'investissement.

Quels sont les principaux défis liés à la mise en œuvre de l'analyse prédictive ?

La qualité et la disponibilité des données sont primordiales : les modèles nécessitent un volume important de données historiques propres. L’intégration aux processus métier existants est complexe ; les prédictions doivent s’intégrer aux flux de décision pour apporter de la valeur. Des lacunes persistent en matière de compétences ; de nombreuses organisations manquent d’expertise en science des données. L’interprétabilité des modèles est cruciale pour les secteurs réglementés qui doivent justifier leurs prédictions. Enfin, il est essentiel de bien gérer les attentes : l’analyse prédictive améliore la prise de décision de manière probabiliste, mais n’élimine pas l’incertitude.

Dans quelle mesure les modèles d'analyse prédictive sont-ils précis ?

La précision varie considérablement selon le domaine, la qualité des données et l'horizon de prévision. Les prévisions à court terme présentant des tendances stables (comme la demande de produits établis pour la semaine suivante) peuvent atteindre une précision supérieure à 900 000 fois (TP3T). Les prévisions à long terme dans des domaines volatils (comme les fluctuations boursières) restent beaucoup moins fiables. La prévision de la production alimentaire a atteint une précision de près de 900 000 fois (TP3T) grâce aux réseaux LSTM. Les modèles de fidélisation client affichent généralement une précision comprise entre 70 et 850 000 fois (TP3T). L'essentiel est de comparer les performances du modèle à celles de méthodes de référence (comme les prévisions naïves ou le jugement humain) plutôt que de viser la perfection.

Quelle est la différence entre l'analyse prédictive et l'analyse prescriptive ?

L'analyse prédictive prévoit ce qui va se passer : elle estime les probabilités et les résultats probables. L'analyse prescriptive va plus loin en recommandant les actions à entreprendre en fonction de ces prévisions. Une analyse prédictive pourrait indiquer : “ Ce client a une probabilité de désabonnement de 75 %. ” Une analyse prescriptive ajouterait : “ Proposez une réduction de 15 % pour maximiser la fidélisation. ” L'analyse prescriptive combine généralement des modèles prédictifs avec des algorithmes d'optimisation et des règles métier afin de générer des recommandations concrètes, et non de simples prévisions.

L'avenir de l'analyse prédictive

À l'avenir, plusieurs tendances façonneront l'analyse prédictive au-delà de 2026.

L'apprentissage automatique automatisé (AutoML) continuera de réduire les obstacles techniques, permettant aux analystes d'affaires de créer des modèles sophistiqués sans programmation. Cependant, l'expertise humaine restera essentielle pour la définition des problèmes, l'interprétation des données et la détection des biais.

Les techniques d'inférence causale viendront de plus en plus compléter les prédictions basées sur la corrélation, aidant ainsi les organisations à comprendre non seulement ce qui va se passer, mais aussi pourquoi, et quelles interventions permettront réellement de modifier les résultats.

L'informatique de périphérie rapprochera les modèles prédictifs des sources de données. Les capteurs de production, les objets connectés et les applications mobiles exécuteront des modèles de prédiction locaux au lieu d'envoyer toutes les données vers des systèmes cloud centralisés.

L'intelligence artificielle éthique et les prévisions responsables gagneront en importance. À mesure que les modèles prédictifs influenceront davantage les décisions à forts enjeux, les cadres d'équité, de transparence et de responsabilité deviendront la norme et non plus une simple réflexion a posteriori.

L'intégration des données non structurées (texte, images, vidéo, audio) dans les modèles de prévision va s'intensifier. Les modèles multimodaux, qui combinent données structurées traditionnelles, langage naturel et entrées visuelles, ouvriront de nouvelles perspectives en matière de prédiction.

La prédiction en temps réel deviendra la norme. La prévision par lots ne disparaîtra pas, mais les applications exigeant des réponses immédiates stimuleront l'innovation architecturale dans l'analyse de flux et le déploiement de modèles à faible latence.

Les organisations qui réussiront grâce à l'analyse prédictive seront celles qui la considéreront non pas comme un projet technologique, mais comme une capacité de prise de décision — une capacité qui nécessite un investissement continu dans l'infrastructure de données, les talents et l'intégration des processus.

Prêt à mettre en œuvre l'analyse prédictive dans votre organisation ? Commencez par identifier une décision stratégique qu'une meilleure prévision permettrait d'améliorer. Évaluez la qualité de vos données. Constituez une équipe pluridisciplinaire. Et choisissez des outils adaptés à vos compétences techniques et à vos besoins métiers. La technologie n'a jamais été aussi accessible ; la clé du succès réside dans une mise en œuvre rigoureuse.