Résumé rapide : Le framework LangChain est gratuit et open source, mais le développement d'applications LLM engendre des coûts liés aux appels d'API LLM (généralement de $0,25 à $75 par million de jetons), à la plateforme d'observabilité LangSmith (de $0 à $39+ par utilisateur et par mois), à l'hébergement de l'infrastructure et au temps de développement. Le coût total de développement varie de quasi nul pour les prototypes à plus de $10 par mois pour les déploiements en production, selon l'échelle, le modèle choisi et la complexité des fonctionnalités.

En 2026, la création d'applications avec de grands modèles de langage s'est généralisée, et LangChain demeure l'un des frameworks les plus utilisés pour orchestrer les flux de travail LLM. Cependant, un point surprend souvent les équipes : bien que le framework soit gratuit, le coût total de développement et de déploiement implique de multiples couches qui ne sont pas toujours évidentes au premier abord.

La structure tarifaire n'est pas simple. LangChain étant un logiciel libre, il n'y a pas de frais de licence. Cependant, les équipes constatent rapidement des coûts liés aux appels d'API de modèles, aux outils d'observabilité, aux bases de données vectorielles, à l'infrastructure d'hébergement et aux heures de développement nécessaires à la création d'applications prêtes pour la production.

Ce guide détaille chaque composante de coût du développement d'applications LLM basées sur LangChain en 2026, du prototypage initial à la mise à l'échelle en production.

Tarification du framework LangChain : Les composants principaux

LangChain est entièrement gratuit. Ce framework open source est disponible sans frais de licence. Ceci s'applique aux implémentations Python et JavaScript, que les développeurs peuvent installer via pip ou npm et utiliser immédiatement.

Le framework propose des composants modulaires pour la création d'applications LLM : des chaînes pour le séquençage des opérations, des agents pour la prise de décision autonome, des moteurs de recherche documentaire et des systèmes de mémoire pour le contexte des conversations. L'utilisation de ces fonctionnalités essentielles est entièrement gratuite.

Cependant, l'écosystème LangChain ne se limite pas à son framework principal. LangGraph, une bibliothèque permettant de créer des workflows multi-agents avec état, est également open source et gratuite. LangServe, qui convertit les chaînes en API déployables, fonctionne sur le même modèle : son utilisation est gratuite, mais le déploiement de ces API nécessite une infrastructure cloud, engendrant des coûts d'hébergement.

Plateforme d'observabilité LangSmith : là où commencent les coûts d'abonnement

LangSmith est le point de départ des coûts directs liés à l'écosystème LangChain pour les équipes. Cette plateforme offre des fonctionnalités de traçage, de débogage, d'évaluation et de surveillance essentielles lors du passage du prototype à la production.

Selon la page officielle des tarifs de LangChain, LangSmith propose trois niveaux à partir de 2026 :

| Plan | Prix par siège | Traces de base incluses | Rétention de traces | Idéal pour |

|---|---|---|---|---|

| Promoteur | $0/mois | 5 000/mois | 14 jours (de base) | Développeurs indépendants, prototypage |

| Plus | $39/mois | 10 000/mois | 14 jours (de base), 400 jours (prolongé) | Petites équipes, applications de production |

| Entreprise | Tarification personnalisée | allocation personnalisée | rétention personnalisée | Grandes organisations, besoins de conformité |

L'abonnement Développeur offre une licence gratuite, ce qui le rend accessible aux développeurs débutants. Il inclut jusqu'à 5 000 traces de base par mois, avec une facturation à l'utilisation au-delà de ce seuil. Les traces de base coûtent $2,50 pour 1 000 traces et sont conservées pendant 14 jours.

L'enregistrement étendu, qui conserve les données pendant 400 jours, coûte $5,00 pour 1 000 enregistrements (soit le double du tarif de base). Pour les applications nécessitant une observabilité à long terme et des pistes d'audit de conformité, ce coût peut s'avérer considérable.

L'abonnement Plus, à $39 par utilisateur et par mois, est celui qui convient le mieux aux équipes de production. Il inclut 10 000 traces de base par mois, un nombre illimité d'agents Fleet pour les opérations autonomes et une assistance par e-mail. Les équipes peuvent ajouter un nombre illimité de postes au même tarif.

LangSmith propose également des fonctionnalités supplémentaires telles que des files d'attente d'annotations pour recueillir les commentaires humains, la gestion des invites via Prompt Hub et Playground, ainsi qu'une surveillance avec système d'alertes. Ces outils sont inclus dans les différents niveaux d'abonnement et ne font l'objet d'aucun coût supplémentaire.

Coûts des API LLM : le principal facteur de variation des budgets de production

Le coût récurrent le plus important pour les applications LangChain est celui des appels aux API LLM. Ce coût dépasse largement celui du framework et des outils pour toute application exécutée à grande échelle.

LangChain prend en charge l'intégration avec des dizaines de fournisseurs de modèles grâce à son interface standardisée. Chaque fournisseur propose des structures tarifaires différentes, basées sur la consommation de jetons, les capacités du modèle et des fonctionnalités supplémentaires telles que la mise en cache ou le traitement par lots.

Paysage tarifaire du modèle 2026

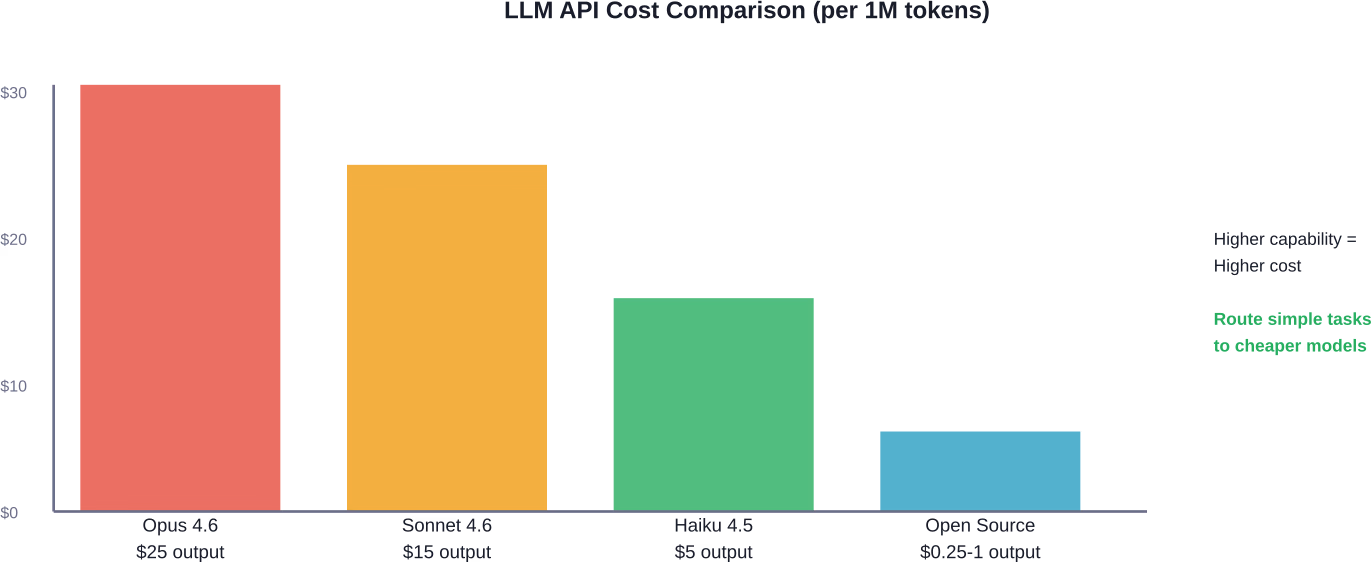

Les modèles Claude d'Anthropic sont souvent utilisés pour les applications LangChain. D'après la documentation tarifaire récente, les modèles Claude offrent les taux suivants par million de jetons (tarifs susceptibles d'évoluer) :

- Claude Opus 4.6 : Entrée $5 / Sortie $25

- Claude Sonnet 4.6 : Entrée $3 / Sortie $15

- Claude Haïku 4.5 : Entrée $0.25-$1 / Sortie $1.25-$5

Les modèles plus anciens de la série Claude 4.1 affichent des prix plus élevés, l'Opus 4.1 étant proposé à $15 en entrée et $75 en sortie par million de jetons. Cette évolution des prix illustre comment les nouvelles générations offrent souvent de meilleures performances à moindre coût.

Les modèles OpenAI appliquent une tarification similaire basée sur les jetons, bien que les tarifs spécifiques pour 2026 varient selon la génération du modèle. Les modèles de classe GPT-4 coûtent généralement entre $2,50 et $30 par million de jetons d'entrée, en fonction du niveau de capacité et de la taille de la fenêtre de contexte.

Les modèles open-source plus petits accessibles via des fournisseurs comme Groq ou hébergés sur une infrastructure comme AWS Bedrock peuvent réduire considérablement les coûts par jeton (parfois de 80 à 951 TP3T par rapport aux modèles de pointe), bien qu'avec des compromis de capacité correspondants.

Stratégies d'optimisation des coûts

La mise en cache des invites peut réduire les coûts jusqu'à 90% pour les contextes répétés. Lorsque des applications traitent des documents similaires ou conservent des invites système cohérentes d'une requête à l'autre, la mise en cache des représentations encodées élimine les coûts de traitement redondants.

Le traitement par lots via API, lorsqu'il est disponible, offre généralement des remises 50% par rapport à l'inférence en temps réel. Les applications tolérant des réponses différées, telles que les pipelines de traitement de documents ou les tâches d'analyse nocturnes, bénéficient grandement de la tarification par lots.

La combinaison de ces stratégies permet de réaliser des économies considérables. Selon une étude sur l'optimisation des coûts, les équipes utilisant conjointement la mise en cache rapide et les API par lots peuvent potentiellement réduire significativement les coûts totaux d'inférence par rapport au traitement en temps réel standard sans mise en cache.

Le routage de modèles représente une autre approche d'optimisation. Les architectures hiérarchiques utilisées dans le traitement des documents financiers ont atteint une précision de 97,71 TP3T pour une architecture réflexive, à un coût de 60,91 TP3T, d'après des données de référence pour des flux de travail spécialisés. Les applications LangChain peuvent implémenter une logique similaire afin d'acheminer les requêtes simples vers des modèles moins coûteux, tout en réservant les modèles de pointe, plus onéreux, aux tâches de raisonnement complexes.

Coûts d'infrastructure et de services de soutien

Au-delà des API LLM et de l'observabilité LangSmith, les applications LangChain nécessitent une infrastructure de support qui s'ajoute au budget total.

Coûts des bases de données vectorielles

Les applications utilisant la génération augmentée par la recherche nécessitent des bases de données vectorielles pour stocker et rechercher les représentations vectorielles des documents. Parmi les solutions populaires, on trouve Pinecone, Weaviate, Qdrant et Chroma, chacune avec son propre modèle de tarification.

Les services de bases de données vectorielles gérées sont généralement facturés en fonction du volume de données, du volume de requêtes et du niveau de performance. Les petites applications peuvent se contenter des offres gratuites proposant 1 Go de stockage et un nombre limité de requêtes. Les déploiements en production gérant des millions de vecteurs peuvent engendrer des coûts mensuels de $50 à plus de $500, selon l'échelle et les besoins de réplication.

Les bases de données vectorielles auto-hébergées éliminent les coûts d'abonnement, mais nécessitent la gestion de l'infrastructure. L'exécution de Qdrant ou Chroma sur des instances de calcul cloud transfère le coût vers la location de serveurs et les frais d'exploitation.

Coûts du modèle d'intégration

La génération d'embeddings pour le stockage vectoriel engendre des coûts d'API spécifiques, généralement bien inférieurs à ceux de l'inférence LLM. Le modèle text-embedding-3-large d'OpenAI coûte environ $0,13 par million de jetons, tandis que les modèles d'embeddings plus petits coûtent encore moins cher.

Pour les applications traitant de vastes collections de documents, les coûts d'intégration peuvent s'accumuler. Le traitement de 10 millions de jetons de documentation coûterait environ $1,30 avec les API d'intégration standard ; un coût négligeable comparé aux coûts LLM, mais qu'il est important de suivre pour une meilleure précision budgétaire.

Hébergement d'applications

Le déploiement d'applications LangChain nécessite des ressources de calcul. Les chatbots simples peuvent s'exécuter sur des plateformes sans serveur comme Vercel ou AWS Lambda à un coût minimal inférieur à 1 TP4T20 par mois. Les systèmes d'agents plus complexes, avec fonctionnement continu et gestion d'état, requièrent des serveurs persistants.

Les coûts du cloud computing varient considérablement selon les besoins. Un déploiement conteneurisé de base sur des services comme Render ou Railway coûte environ $7 à $25 par mois pour les petites instances. Les systèmes de production avec mise à l'échelle automatique, répartition de charge et haute disponibilité peuvent atteindre $200 à plus de $200 par mois, selon le trafic et la complexité.

Investissement de l'équipe de développement : la composante de coût caché

Le temps de développement représente une part importante du coût total d'un projet, bien qu'il soit souvent négligé lorsqu'on se concentre sur les dépenses liées à l'infrastructure et aux API.

La création d'une application LangChain basique (un simple chatbot RAG ou un système de questions-réponses sur des documents) nécessite généralement entre 40 et 80 heures de travail pour un développeur maîtrisant Python et les concepts LLM. Au tarif horaire standard de $75 à $150, cela représente un investissement de développement de $3 000 à $12 000.

Les systèmes multi-agents complexes, dotés d'outils personnalisés, d'une gestion sophistiquée de la mémoire et d'une gestion des erreurs de niveau production, peuvent nécessiter entre 200 et 500 heures de développement, voire plus. Pour les équipes développant des flux de travail multi-agents propriétaires, l'investissement peut facilement atteindre $20 000 à $75 000 avant même que l'application ne traite une seule requête en production.

La maintenance continue s'ajoute à ce total. Les API LLM évoluent rapidement : les modèles sont obsolètes et de nouvelles versions sont fréquemment publiées. Maintenir les applications à jour, surveiller la dégradation des performances et optimiser les invites en fonction des changements de comportement des modèles exige une attention constante de la part des développeurs.

Exemples concrets de budget : du prototype à la production

Comprendre les composantes abstraites des coûts est utile, mais des scénarios budgétaires réels fournissent des indications de planification plus claires.

Scénario 1 : Prototype de développeur solo

Un développeur indépendant créant un outil d'analyse de documents de type preuve de concept :

- Cadre LangChain : $0

- Plan développeur LangSmith : $0 (5 000 traces/mois)

- Utilisation de l'API Claude Haiku (50 000 requêtes, 2 000 jetons en moyenne en sortie) : ~$500/mois

- Base de données vectorielles (Chroma auto-hébergée) : $0

- Hébergement (niveau loisir ferroviaire) : $0-$5/mois

- Temps de développement (60 heures autofinancées) : Non facturé

Coût mensuel récurrent total : ~$505. Investissement initial de développement : 60 heures de travail de développeur.

Scénario 2 : Bot de support client pour petites équipes

Une startup qui développe un assistant de support client interne avec 3 membres d'équipe :

- Cadre LangChain : $0

- Forfait LangSmith Plus (3 sièges) : $117/mois

- Utilisation de l'API Claude Sonnet (200 000 requêtes, 1 500 jetons en moyenne renvoyés) : ~$4 500/mois

- Base de données vectorielle de pommes de pin (plan de démarrage) : $70/mois

- Hébergement AWS (déploiement conteneurisé) : $150/mois

- Temps de développement (200 heures initiales réparties entre les équipes à un tarif horaire de $75 à $150) : $15 000-$30 000 une seule fois

- Optimisation continue (10 heures/mois) : $750-$1 500/mois

Coût mensuel récurrent total : ~$5 587-$6 337. Investissement initial de développement : $15 000-$30 000.

Scénario 3 : Pipeline de traitement des documents d'entreprise

Une grande organisation qui traite quotidiennement des milliers de documents financiers :

- Cadre LangChain : $0

- Forfait LangSmith Enterprise (25 sièges) : ~$3 000+/mois (tarification personnalisée)

- Routage multi-modèles (Opus pour les traitements complexes, Haiku pour les traitements simples, traitement par lots) : ~$15 000/mois

- Base de données vectorielle (gérée, haute disponibilité) : $800/mois

- Infrastructure cloud (mise à l'échelle automatique, redondance) : $2 500/mois

- Équipe de développement (version initiale, 500 heures) : $50 000-$100 000 une seule fois

- Développement et optimisation continus (40 heures/mois) : $3 000-$6 000/mois

Coût mensuel récurrent total : ~$24 300-$27 300. Investissement initial de développement : $50 000-$100 000.

Suivi des coûts et gestion budgétaire

La gestion des coûts des applications LLM nécessite une visibilité sur les modèles de consommation de jetons. LangSmith offre des fonctionnalités intégrées de suivi des coûts qui s'intègrent aux applications LangChain.

D'après la documentation officielle de suivi des coûts, LangSmith calcule ces coûts en fonction des métadonnées d'utilisation des jetons et de modèles de tarification configurables. Les équipes peuvent définir les prix d'entrée et de sortie par million de jetons pour chaque modèle, avec une ventilation détaillée par type de jeton.

Pour les applications utilisant OpenAI, Anthropic ou des modèles compatibles avec OpenAI, le suivi des coûts est automatique grâce aux intégrations LangChain et aux wrappers LangSmith. La plateforme récupère le nombre de jetons dans les réponses de l'API et applique des règles de tarification pour calculer les coûts d'exécution.

Les structures de coûts personnalisées, telles que la tarification non linéaire ou les remises spécifiques aux fournisseurs, nécessitent une annotation manuelle des coûts. Les équipes peuvent ajouter des métadonnées de coûts aux traces par programmation lorsque le calcul automatique ne correspond pas à la facturation réelle.

Le calcul du coût s'effectue de manière gourmande, du type de jeton le plus spécifique au moins spécifique. Si la tarification définit $2 par million de jetons d'entrée, avec un tarif détaillé de $1 par million de jetons lus en cache, et qu'une exécution utilise 20 jetons d'entrée dont 5 provenant du cache, le système facture $1 par million pour les 5 jetons mis en cache et $2 par million pour les 15 jetons d'entrée standard restants.

Comparaison de LangChain avec d'autres frameworks

Les considérations de coût s'étendent au choix du framework. LangChain est en concurrence avec des alternatives comme le SDK d'IA Vercel et l'utilisation directe du SDK d'OpenAI, chacune ayant des implications financières différentes.

Le kit de développement logiciel (SDK) d'IA Vercel est axé sur le streaming et le déploiement en périphérie, et optimisé pour les applications Next.js. Le framework lui-même est gratuit, à l'instar de LangChain. Cependant, contrairement à LangSmith, il n'intègre pas de fonctionnalités d'observabilité, ce qui nécessite des solutions de surveillance externes pouvant engendrer des coûts supplémentaires.

Le SDK d'OpenAI offre un accès direct aux modèles OpenAI avec une abstraction minimale. Ceci élimine la surcharge liée au framework, mais nécessite une implémentation personnalisée des fonctionnalités fournies nativement par LangChain : composition de chaînes, gestion de la mémoire et intégration d'outils. Le gain de temps de développement obtenu grâce à LangChain compense souvent les gains de performance marginaux liés à l'utilisation directe du SDK.

Semantic Kernel de Microsoft offre des fonctionnalités d'orchestration similaires, avec une intégration étroite à Azure. Les équipes ayant déjà investi dans l'écosystème Azure peuvent envisager l'utilisation de services groupés via l'intégration Azure de Semantic Kernel, bien que le framework lui-même soit également open source et gratuit, à l'instar de LangChain.

| Cadre | Licence de base | Observabilité | Idéal pour | Profil de coûts |

|---|---|---|---|---|

| Chaîne de Lang | Libre/Ouvert | LangSmith ($0-$39+/siège) | Agents complexes, RAG | API LLM + outils optionnels |

| Kit de développement logiciel (SDK) Vercel AI | Libre/Ouvert | Un tiers est requis. | Streaming Edge, Next.js | API LLM + SaaS de surveillance |

| Kit de développement logiciel OpenAI | Libre/Ouvert | Implémentation personnalisée | Applications simples utilisant uniquement OpenAI | API LLM + temps de développement |

| Noyau sémantique | Libre/Ouvert | Azure Application Insights | Déploiements natifs Azure | API LLM + Services Azure |

Dette technique et considérations relatives aux coûts à long terme

Choisir un framework largement adopté comme LangChain peut réduire certains risques associés aux frameworks abandonnés.

Cependant, l'évolution rapide du framework pose des problèmes de gestion des versions. LangChain publie régulièrement des modifications importantes en fonction de l'évolution du paysage LLM. Les équipes doivent prévoir un budget pour les mises à niveau périodiques, car LangChain publie des modifications importantes et de nouvelles fonctionnalités.

Les recherches indiquent que la dette technique, reconnue par les développeurs eux-mêmes, se situe entre 2,41 et 311 TP3T dans les bases de code des projets open source, souvent introduite par des développeurs expérimentés. Dans le cas des applications LLM, cette dette s'accumule notamment autour de la gestion des demandes, des méthodologies d'évaluation et du verrouillage des versions des modèles — autant de domaines où des outils comme LangSmith apportent une réelle valeur ajoutée, moyennant un abonnement.

Calcul du retour sur investissement

La rentabilité du développement de LangChain dépend de la valeur ajoutée pour l'entreprise. Un chatbot de support client traitant 1 000 requêtes par jour et réduisant le volume de tickets d'assistance de 301 000 £ pourrait justifier des coûts opérationnels mensuels de 1 400 £ (5 000 £) s'il permet d'économiser 1 400 £ (20 000 £) en salaires d'agents de support.

Les processus de traitement documentaire nécessitent une analyse similaire. Si une entreprise traite 10 000 documents financiers par mois et que l'automatisation LLM réduit le temps de révision de 15 à 3 minutes par document, les économies de main-d'œuvre (2 000 heures par mois à un tarif horaire de $50) atteindraient 100 000 £. Même avec un modèle plus coûteux ($20), le retour sur investissement est clairement démontré.

Les prototypes et les MVP (Produits Minimum Viables) nécessitent des calculs différents. Investir 1 400 000 £ dans le développement pour valider l'adéquation produit-marché avant un déploiement à grande échelle est judicieux. En revanche, dépenser 1 400 000 £ dans un prototype sans validation utilisateur ne l'est pas.

L'idée clé : les coûts de LangChain et LangSmith relèvent de l'optimisation, et non de dépenses fixes. Les équipes maîtrisent le choix des modèles, les stratégies de mise en cache, le traitement par lots et l'infrastructure. Ce cadre offre la flexibilité nécessaire pour démarrer à moindre coût et évoluer stratégiquement en fonction de la valeur ajoutée pour l'entreprise.

Assurez l'efficacité des projets LangChain dès le premier jour

LangChain paraît souvent simple au départ, mais les coûts ont tendance à augmenter une fois que les chaînes, les invites et les appels de modèles sont mis à l'échelle dans une utilisation réelle. IA supérieure Ce système intervient sur l'ensemble de la couche applicative LLM sous-jacente à des frameworks comme LangChain : sélection du modèle, paramétrage fin, configuration de la récupération et déploiement. L'accent n'est pas mis sur le framework lui-même, mais sur la conception de systèmes où les appels de modèles, les flux de données et l'infrastructure sont alignés sur le cas d'utilisation réel. Cela permet de maîtriser la consommation de jetons et d'éviter les pipelines générant une charge inutile.

La plupart des problèmes de coûts liés aux configurations LangChain proviennent de la conception du système, et non de l'outil choisi. Pour éviter les chaînes surdimensionnées et l'augmentation des coûts d'inférence, contactez-nous. IA supérieure et vérifiez la configuration de votre application LLM avant de la mettre à l'échelle.

Questions fréquemment posées

LangChain est-il entièrement gratuit ?

Oui, le framework LangChain est open source et gratuit. Son utilisation (framework de base, LangGraph et LangServe) ne nécessite aucun frais de licence, d'utilisation ou d'abonnement. Cependant, le développement d'applications engendre des coûts liés aux appels à l'API LLM, à la plateforme d'observabilité optionnelle LangSmith et à l'hébergement de l'infrastructure.

Quel est le coût de LangSmith pour les applications de production ?

LangSmith propose un forfait Développeur gratuit avec 5 000 traces par mois, idéal pour les développeurs indépendants et les prototypes. Le forfait Plus coûte $39 par utilisateur et par mois et inclut 10 000 traces mensuelles, ce qui le rend adapté aux petites équipes et aux déploiements en production. La tarification pour les entreprises est personnalisée en fonction de la taille et des besoins. Les traces supplémentaires, au-delà des limites du forfait, coûtent entre $2,50 et $5,00 par tranche de 1 000 traces, selon la période de conservation.

Quels sont les coûts typiques de l'API LLM pour une application LangChain ?

Les coûts de l'API LLM varient considérablement selon le modèle choisi et le volume d'utilisation. Claude Haiku coûte entre $0,25 et $5 par million de jetons, Sonnet entre $3 et $15 par million, et Opus entre $5 et $25 par million. Un petit chatbot traitant 50 000 requêtes par mois avec une moyenne de 2 000 jetons de sortie pourrait coûter entre $500 et $2 500 par mois, selon le niveau du modèle. Les applications d'entreprise peuvent atteindre des coûts mensuels de plus de 10 000 à 50 000 $ à grande échelle.

Puis-je réduire les coûts du LLM sans sacrifier la qualité ?

Oui, grâce à plusieurs stratégies d'optimisation. La mise en cache des requêtes peut réduire les coûts jusqu'à 90% pour les contextes récurrents. Le traitement par lots des API offre des réductions de 50% pour les charges de travail non temps réel. Le routage des modèles (utilisation de modèles moins coûteux pour les tâches simples et de modèles plus onéreux uniquement pour les raisonnements complexes) peut réduire les coûts de 40 à 60% tout en maintenant une précision supérieure à 95%. La combinaison de ces techniques permet de réaliser des économies significatives par rapport aux implémentations non optimisées.

Ai-je besoin de LangSmith pour utiliser LangChain en production ?

Non, LangSmith est optionnel. Les applications LangChain fonctionnent parfaitement sans abonnement LangSmith. Cependant, LangSmith offre des fonctionnalités essentielles d'observabilité, de débogage et d'évaluation qui deviennent précieuses pour les déploiements en production. Les équipes peuvent commencer sans LangSmith et l'ajouter lorsque la complexité ou l'échelle de l'application rend le débogage et la surveillance difficiles. Le forfait Développeur gratuit offre un traçage limité pour tester ces fonctionnalités.

Quel budget dois-je prévoir pour le développement de LangChain ?

Les coûts de développement dépendent de la complexité de l'application. Les chatbots simples ou les systèmes de questions-réponses documentaires nécessitent généralement entre 40 et 80 heures de développement (de 3 000 à 12 000 £ aux tarifs standards). Les systèmes multi-agents complexes, dotés d'outils personnalisés et de flux de travail sophistiqués, peuvent nécessiter entre 200 et plus de 500 heures (de 15 000 à plus de 75 000 £). La maintenance continue représente un coût mensuel supplémentaire de 5 à 40 heures, selon l'échelle du système. Les coûts opérationnels mensuels varient de 500 £ pour les prototypes à plus de 25 000 £ pour les déploiements en entreprise, l'utilisation de l'API LLM représentant entre 55 000 et 991 000 £ de dépenses récurrentes.

Existe-t-il des coûts cachés auxquels je devrais faire attention ?

Les coûts les plus souvent négligés comprennent les abonnements aux bases de données vectorielles pour les applications RAG (de 1 400 à plus de 500 000 £ par mois), les coûts d'intégration d'API pour le traitement de documents (de 0,10 à 0,30 £ par million de jetons), l'hébergement de l'infrastructure au-delà des offres gratuites sans serveur (de 20 à plus de 2 000 £ par mois) et le temps de développement consacré par les développeurs à l'optimisation continue et aux mises à jour des modèles (10 à 40 heures par mois). Les équipes sous-estiment parfois également la consommation de jetons pendant le développement et les tests, ce qui peut ajouter de 20 à 500 000 £ aux estimations budgétaires initiales.

Planification de votre budget de développement LangChain

Développer des applications LLM avec LangChain en 2026 nécessite de comprendre plusieurs niveaux de coûts. Le framework lui-même élimine les frais de licence, mais le coût total de possession inclut la consommation de l'API LLM, les outils d'observabilité optionnels, l'infrastructure de support et l'investissement des développeurs.

Commencez par la version gratuite. Le framework open source de LangChain et le plan Développeur de LangSmith permettent aux équipes de prototyper et de valider leurs concepts sans investissement initial. Cette phase d'exploration sans risque permet de déterminer si l'application génère suffisamment de valeur pour justifier un investissement en production.

Prévoyez un budget progressif. Commencez par des modèles plus abordables comme Claude Haiku ou des alternatives plus compactes. Mettez en place dès le départ une mise en cache rapide et un traitement par lots. N'optez pour des modèles plus performants que pour des cas d'utilisation spécifiques où le gain de qualité justifie l'augmentation des coûts.

Suivez tout. Activez le suivi des coûts LangSmith dès le début pour anticiper les habitudes de consommation et éviter les mauvaises surprises. Examinez l'utilisation des jetons chaque semaine en phase de développement et quotidiennement en production. Configurez des alertes budgétaires avant que les coûts ne dépassent les seuils acceptables.

Surtout, il est essentiel de comparer la valeur ajoutée pour l'entreprise aux coûts techniques. Les applications LLM doivent résoudre des problèmes dont la valeur dépasse leurs dépenses opérationnelles. Si le calcul n'est pas concluant (si les coûts des API excèdent la valeur générée), aucune optimisation ne permettra de pérenniser le projet. En revanche, lorsque la valeur est supérieure au coût, LangChain fournit les outils nécessaires pour concevoir, déployer et faire évoluer efficacement le projet.

Prêt à vous lancer ? Le framework LangChain est disponible dès maintenant et entièrement gratuit. Testez-le en avant avec le plan Développeur LangSmith, choisissez un modèle économique pour vos premiers essais et augmentez votre investissement à mesure que votre application fait ses preuves. Ce framework vous permet de démarrer dès aujourd’hui à un coût quasi nul et de passer en production à votre rythme.