Résumé rapide : Au Royaume-Uni, les coûts des modèles logiques (LLM) varient considérablement selon le fournisseur et l'utilisation. En 2026, les entreprises devaient s'acquitter de frais allant de quelques centimes par jeton pour les modèles les plus simples à plusieurs livres sterling pour les requêtes complexes sur les systèmes d'entreprise. L'Université de Manchester a développé des cadres de travail permettant de réduire de plus de 90 millions de livres sterling les besoins en ressources des techniques de contrôle pour les LLM, ce qui pourrait considérablement diminuer les coûts opérationnels. L'adoption de l'IA au Royaume-Uni continue de progresser, le traitement automatique du langage naturel et la génération de texte étant les applications les plus courantes ; 85 millions d'entreprises ayant adopté l'IA l'utilisent actuellement à ces fins.

Les modèles de langage à grande échelle sont passés du statut de technologie expérimentale à celui d'outils indispensables pour les entreprises au Royaume-Uni. Mais attention : les coûts peuvent rapidement s'envoler si les organisations ne maîtrisent pas les structures tarifaires.

Le secteur de l'IA au Royaume-Uni a connu une croissance substantielle entre 2023 et 2024, selon les données gouvernementales. Cette expansion soulève une question cruciale : quel est le coût réel de fonctionnement de ces systèmes ?

Comprendre les dépenses liées à LLM ne se limite pas au coût par jeton. L'infrastructure, les tests, les mécanismes de contrôle et la consommation d'énergie contribuent tous au coût total de possession. Et ces chiffres sont importants, que l'on dirige une startup à Manchester ou que l'on gère des opérations d'entreprise à Londres.

Comprendre les modèles de tarification des LLM au Royaume-Uni

La plupart des fournisseurs de LLM facturent en fonction de la consommation de jetons. Un jeton équivaut approximativement à quatre caractères ou aux trois quarts d'un mot en anglais.

Les structures de tarification distinguent généralement les jetons d'entrée (l'instruction envoyée au modèle) des jetons de sortie (la réponse générée). Les jetons de sortie coûtent généralement plus cher car ils nécessitent davantage de ressources de calcul.

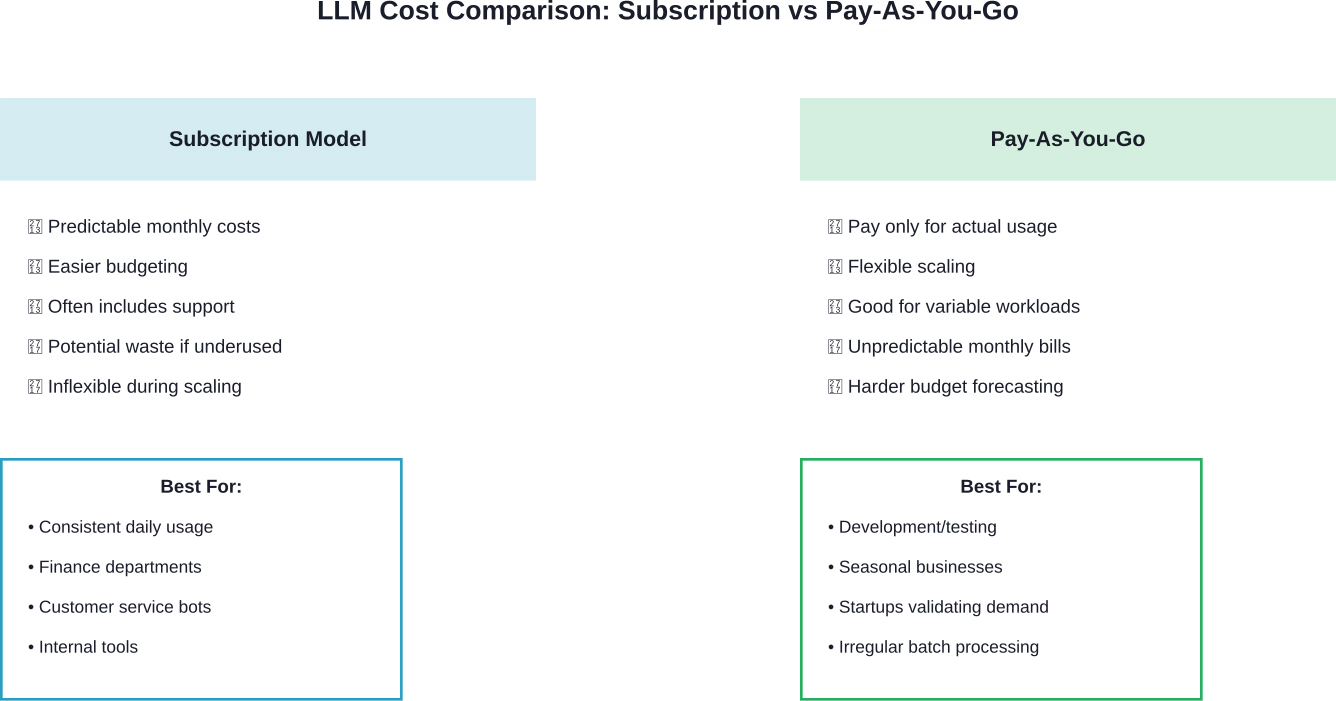

Le marché britannique propose plusieurs approches tarifaires. Certains fournisseurs offrent des abonnements à plusieurs niveaux avec des quotas de jetons inclus. D'autres utilisent un modèle de paiement à l'utilisation. Les contrats pour entreprises incluent souvent des remises sur volume et des garanties de capacité dédiée.

Explication de la tarification par jetons

La facturation par jetons signifie que les coûts sont proportionnels à l'utilisation. Une requête simple peut consommer entre 50 et 100 jetons. L'analyse de documents complexes peut en nécessiter plusieurs milliers.

Soyons francs : la plupart des entreprises sous-estiment leur consommation de jetons au premier trimestre du déploiement. Les environnements de test et de développement peuvent engloutir les budgets à une vitesse surprenante.

C'est là que ça devient intéressant. Des chercheurs de l'Université de Manchester ont développé de nouveaux frameworks logiciels, LangVAE et LangSpace, qui réduisent de plus de 901 TP3 T les besoins en matériel et en énergie pour le contrôle et le test des LLM. Il ne s'agit pas d'une simple amélioration, mais d'une véritable révolution pour les organisations préoccupées par l'explosion de leurs coûts opérationnels.

Abonnement ou paiement à l'utilisation

Les formules d'abonnement offrent une certaine prévisibilité. Les coûts mensuels fixes facilitent la gestion du budget. Cependant, elles peuvent s'avérer coûteuses si la consommation réelle ne correspond pas à la formule choisie.

Le paiement à l'usage offre une grande flexibilité : les entreprises ne paient que ce qu'elles consomment. L'inconvénient ? Les coûts deviennent plus difficiles à prévoir, notamment lors des phases de croissance.

De nombreuses entreprises britanniques adoptent des approches hybrides. Les abonnements de base couvrent les charges de travail prévisibles. L'utilisation excédentaire est facturée à la consommation.

Tendances d'adoption de l'IA au Royaume-Uni et implications en matière de coûts

Les données gouvernementales montrent que l'adoption de l'IA varie considérablement selon la taille de l'organisation et le secteur d'activité. Les grandes et moyennes entreprises affichent les taux d'adoption les plus élevés, notamment dans les secteurs de l'information et de la communication, de la finance, de l'immobilier et des services aux entreprises.

Le traitement automatique du langage naturel et la génération de texte sont les applications les plus courantes, avec 851 millions d'utilisateurs d'IA qui l'utilisent actuellement à ces fins. Cela se comprend aisément : ces cas d'usage offrent une valeur ajoutée immédiate sans nécessiter de personnalisation poussée.

Mais les tendances d'adoption révèlent un élément important concernant les coûts. Les secteurs affichant des taux d'adoption plus élevés ont appris à maîtriser leurs dépenses grâce à la spécialisation et à l'optimisation. Ils ne se contentent pas d'appliquer des modèles au hasard pour résoudre les problèmes.

Modèles d'utilisation spécifiques au secteur

Les entreprises de services financiers traitent généralement un volume important de requêtes relativement standardisées, comme la détection des fraudes, le contrôle de la conformité ou la classification des documents. Ces tâches nécessitent une capacité dédiée et des tarifs négociés.

Les secteurs de la santé et du droit sont confrontés à des dynamiques différentes. Leurs requêtes sont généralement plus longues et plus complexes. La précision prime sur la rapidité. Les modèles spécialisés sont souvent plus performants que les solutions généralistes.

Les recherches du Regulatory Genome Project de la Cambridge Judge Business School le démontrent précisément. Leur analyse indique que, pour que les systèmes à intervention humaine soient véritablement efficaces, l'évaluation doit prendre en compte l'efficacité globale de bout en bout. Les modèles spécialisés ne sont pas seulement plus précis ; ils sont aussi moins coûteux pris individuellement.

L'étude montre que le temps de traitement quasi instantané des modèles spécialisés accélère et améliore la réactivité de l'ensemble du flux de travail. Cette rapidité se traduit directement par des économies lors de la facturation au jeton.

Stratégies de réduction des coûts pour les organisations britanniques

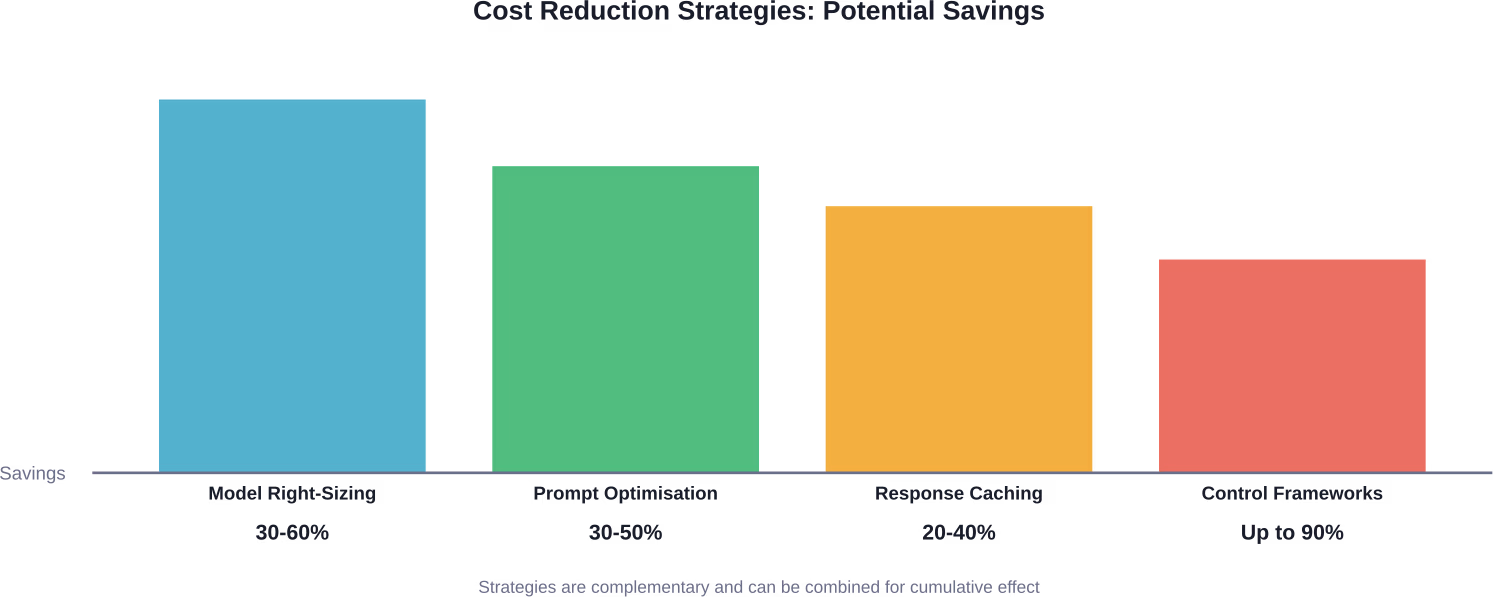

Les organisations avisées ne considèrent pas les prix des fournisseurs comme fixes. Plusieurs stratégies peuvent réduire considérablement les dépenses opérationnelles liées au marketing local.

Sélection du modèle et dimensionnement approprié

Toutes les tâches ne nécessitent pas le modèle le plus grand et le plus performant. Des modèles plus petits suffisent amplement pour de nombreuses tâches courantes, et ce, à un coût bien moindre.

Envisagez une approche par paliers. Acheminez les requêtes simples vers des modèles légers. Réservez les modèles haut de gamme aux tâches de raisonnement complexes qui nécessitent réellement des capacités avancées.

Une étude de la Cambridge Judge Business School confirme que les modèles d'IA spécialisés présentent des avantages considérables pour les tâches de précision. Si les modèles généralistes à grande échelle ont leur utilité, adapter les capacités du modèle aux exigences de la tâche permet d'optimiser à la fois les performances et les coûts.

Ingénierie et optimisation rapides

Des invites inefficaces entraînent un gaspillage de jetons. Des instructions verbeuses, des exemples inutiles et des requêtes mal structurées augmentent tous les coûts.

Une ingénierie efficace des invites permet de réduire la consommation de jetons sans compromettre la qualité de l'affichage. Cela se traduit par des invites plus courtes, des instructions plus claires et une utilisation stratégique des messages système.

Les tests montrent que des invites optimisées peuvent réduire la consommation de jetons de 30 à 50% par rapport aux approches classiques. Sur des milliers de requêtes quotidiennes, ces économies s'accumulent considérablement.

Mise en cache et réutilisation des réponses

De nombreuses organisations interrogent régulièrement les LLM avec des données d'entrée identiques ou quasi identiques. La mise en cache des réponses permet d'éliminer complètement les appels API redondants.

La mise en cache sémantique va plus loin. Lorsqu'une nouvelle requête correspond étroitement à une requête précédente, la réponse mise en cache peut suffire. Cette approche exige une mise en œuvre rigoureuse afin d'éviter de fournir des réponses obsolètes ou inappropriées, mais les économies réalisées peuvent être substantielles.

Cadres de contrôle avancés

L'avancée de l'Université de Manchester mérite une attention particulière. Leurs frameworks LangVAE et LangSpace réduisent les besoins en ressources pour le contrôle LLM de plus de 90%.

Ces cadres de travail génèrent des représentations linguistiques compressées à partir de modèles linguistiques logiques, ce qui rend les processus de contrôle et de test beaucoup plus efficaces. Pour les organisations qui privilégient l'explicabilité et la fiabilité, notamment dans les secteurs réglementés comme la santé et l'énergie, cette technologie pourrait bouleverser les coûts.

L'approche de l'équipe de recherche s'attaque à un obstacle majeur. L'examen et l'ajustement du comportement des LLM nécessitent traditionnellement des ressources de calcul considérables. En compressant les représentations du langage, ces cadres rendent ces processus accessibles aux organisations ne disposant pas d'infrastructures à très grande échelle.

Infrastructure et coûts cachés

Les frais d'identification ne représentent qu'une partie des dépenses totales de LLM. L'infrastructure, l'intégration, la surveillance et la maintenance constituent également des coûts supplémentaires.

Gestion et surveillance des API

Une gestion efficace des coûts nécessite une visibilité sur les tendances d'utilisation. Les plateformes de gestion des API suivent la consommation, identifient les anomalies et appliquent les limites de débit.

Sans un suivi adéquat, les organisations ne constatent souvent les dépassements budgétaires qu'à la réception des factures. Le suivi en temps réel permet une intervention proactive avant que les coûts ne s'envolent.

Coûts d'intégration et de développement

L'intégration de fonctionnalités LLM dans les systèmes existants nécessite du temps de développement. Selon la complexité, les projets d'intégration peuvent durer de quelques jours à plusieurs mois.

Les discussions au sein de la communauté mettent en lumière cette réalité. Les environnements de développement et de test consomment une part importante des ressources allouées. Les organisations doivent comptabiliser ces dépenses séparément de l'utilisation en production.

Considérations énergétiques et environnementales

Les modèles LLM consomment beaucoup d'énergie, tant pour l'entraînement que pour l'inférence. Bien que les fournisseurs de cloud gèrent l'infrastructure, ces coûts sont finalement répercutés sur les clients.

L'étude de Manchester répond directement à cette préoccupation. Réduire la demande en ressources grâce à la norme 90% entraîne une réduction correspondante de la consommation d'énergie. Pour les organisations engagées dans le développement durable, ces gains d'efficacité représentent bien plus que de simples économies financières.

Modèles spécialisés vs modèles généraux : analyse coûts-avantages

Le débat entre modèles spécialisés et modèles généraux a des implications concrètes en termes de coûts.

Les modèles généraux offrent une grande polyvalence : une API unique pour de multiples cas d’utilisation et une architecture simplifiée. Cependant, ils sont souvent surdimensionnés pour des tâches spécifiques et consomment plus de ressources que nécessaire.

Les modèles spécialisés excellent dans les tâches de précision. Une étude de la Cambridge Judge Business School démontre qu'ils sont non seulement plus précis, mais aussi moins coûteux pour les applications ciblées. Un traitement quasi instantané se traduit par des coûts par requête plus faibles et une meilleure utilisation des ressources.

La stratégie optimale combine généralement les deux. Les modèles généraux traitent des requêtes diverses et imprévisibles. Les modèles spécialisés prennent en charge les tâches volumineuses et spécifiques à un domaine.

| Facteur | Modèles généraux | Modèles spécialisés |

|---|---|---|

| Coût initial | Inférieur (aucune formation requise) | Niveau supérieur (nécessite une formation/un perfectionnement) |

| Coût par requête | Plus élevé (consommation de jetons plus importante) | Inférieur (optimisé pour des tâches spécifiques) |

| Précision | Bon dans diverses tâches | Excellent pour le domaine cible |

| Vitesse | Variable | Quasi instantané pour les tâches entraînées |

| La flexibilité | Élevé (traite des requêtes variées) | Faible (optimisé pour un domaine spécifique) |

| Seuil de rentabilité | N / A | En général, plus de 10 000 requêtes par mois. |

Adoption de l'IA dans le secteur public britannique et considérations relatives aux coûts

Le secteur public est confronté à des contraintes spécifiques en matière de déploiement de l'IA. Les limitations budgétaires, les procédures d'acquisition et la confiance du public sont autant de facteurs qui influencent les décisions d'adoption.

Une étude de Nesta révèle que moins de la moitié (40%) des Britanniques font confiance au secteur public pour utiliser l'IA de manière responsable. Ce manque de confiance complique le déploiement de l'IA et peut nécessiter des mécanismes de contrôle et de transparence supplémentaires, engendrant ainsi des coûts additionnels.

L'incubateur d'IA pour l'intelligence artificielle, en collaboration avec le Centre de conception de l'intelligence collective de Nesta, a expérimenté des approches visant à impliquer le public dans l'évaluation des outils d'IA destinés aux services publics. Ces méthodes participatives, bien qu'engendrant des contraintes supplémentaires, pourraient s'avérer essentielles pour instaurer la confiance nécessaire à un déploiement réussi.

Défis liés aux marchés publics

Les marchés publics privilégient la transparence et l'optimisation des ressources. Les modèles de tarification commerciaux classiques ne répondent pas toujours à ces exigences.

Les contrats à prix fixe garantissent la stabilité budgétaire, mais peuvent ne pas s'adapter à la variabilité des prix basés sur les jetons. Certains ministères négocient des accords hybrides prévoyant des plafonds d'utilisation et des clauses de dépassement.

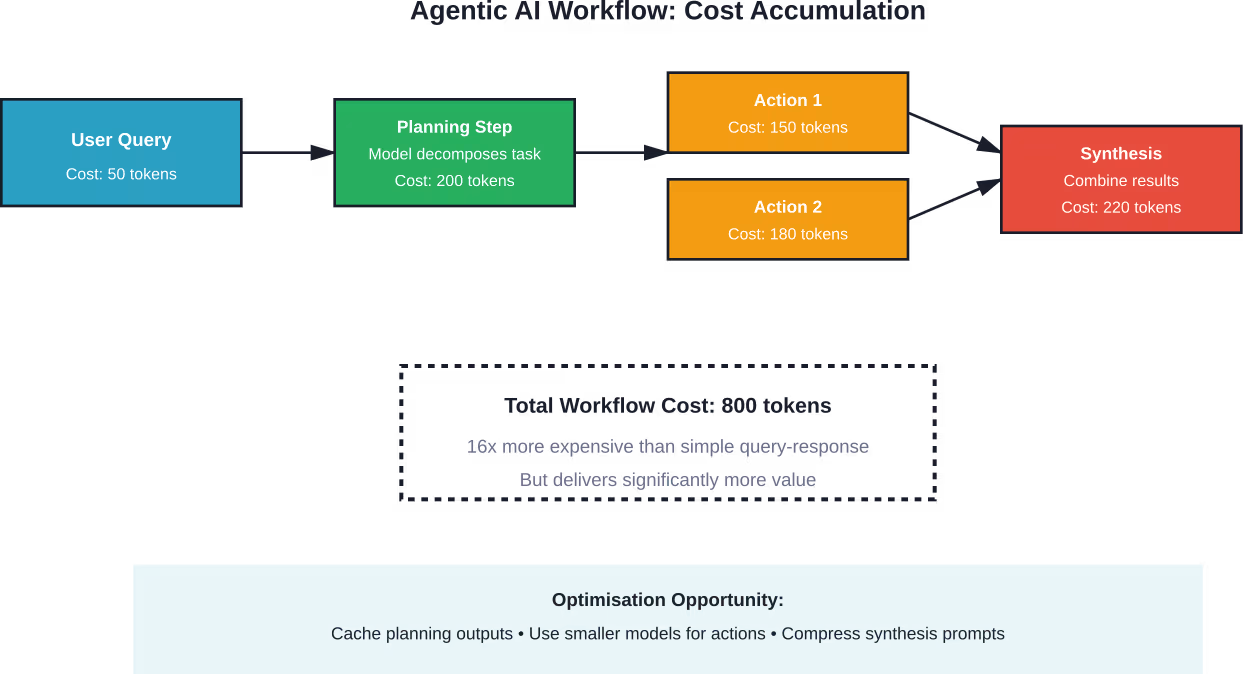

Systèmes d'IA agentiques et flux de travail multi-étapes

Les systèmes d'IA multi-agents qui gèrent des tâches en plusieurs étapes représentent la prochaine frontière de la complexité — et des défis en matière de gestion des coûts.

Ces systèmes effectuent plusieurs appels LLM pour traiter une seule requête utilisateur. Chaque étape consomme des jetons. Les flux de travail complexes peuvent rapidement multiplier les coûts par rapport aux modèles de requête-réponse simples.

L'intervention humaine dans les processus ajoute une dimension supplémentaire. Si elle améliore la précision et renforce la confiance, elle engendre également des coûts de main-d'œuvre humaine en plus des coûts de calcul.

Les recherches du Regulatory Genome Project sur les systèmes HITL soulignent que l'évaluation doit prendre en compte l'efficacité globale. Un modèle légèrement plus coûteux par requête pourrait réduire les coûts globaux en éliminant les étapes de vérification humaine.

Tendances et prévisions des coûts futurs

Les coûts de la LLM ont généralement eu tendance à diminuer à mesure que la concurrence s'intensifiait et que l'efficacité s'améliorait. Cependant, la prévision des prix futurs demeure difficile.

Plusieurs facteurs laissent présager une poursuite de la baisse des coûts. Les techniques de compression des modèles améliorent l'efficacité. Les progrès matériels réduisent les besoins en calcul. La concurrence accrue incite les fournisseurs à baisser leurs prix.

Toutefois, la demande croissante de fonctionnalités plus sophistiquées pourrait annuler ces économies. À mesure que les organisations déploient des LLM pour des tâches de plus en plus complexes, elles pourraient consommer davantage de jetons par interaction, même si le prix unitaire des jetons diminue.

Le facteur open source

Les logiciels libres et open source (LLM) exercent une pression concurrentielle sur les prix commerciaux. Les organisations qui acceptent de gérer leur propre infrastructure peuvent potentiellement réduire considérablement leurs coûts.

L'auto-hébergement n'est cependant pas gratuit. Le matériel, l'énergie, la maintenance et l'expertise ont tous un coût. Pour de nombreuses entreprises britanniques, les API commerciales restent plus économiques que les solutions auto-hébergées, notamment pour les faibles volumes d'utilisation.

Les recherches du Laboratoire d'IA générative de l'Université d'Édimbourg mettent en lumière la pression exercée par l'IA sur les ressources en libre accès. Le coût de la mise à disposition de ces ressources gratuites explose, créant une tension entre les idéaux d'ouverture et de viabilité économique.

Meilleures pratiques en matière de budgétisation et de prévision des coûts

Une gestion efficace des coûts liés aux programmes LLM commence par une budgétisation réaliste. Or, de nombreuses organisations peinent à prévoir leurs dépenses avec précision.

Établissement des lignes de base d'utilisation

Avant de procéder au déploiement en production, effectuez des tests pilotes approfondis. Suivez la consommation réelle de jetons sur des charges de travail représentatives. Les modèles d'utilisation diffèrent souvent considérablement des estimations initiales.

Tenez compte des variations saisonnières. De nombreuses applications professionnelles présentent des cycles d'utilisation. Prévoyez un budget pour les périodes de pointe, et non pas seulement pour les moyennes.

Intégration de marges de sécurité et de contingence

La consommation de jetons peut connaître des pics inattendus. Des bugs système, des changements de comportement des utilisateurs ou des cas d'utilisation élargis peuvent tous entraîner des coûts supérieurs aux prévisions.

De manière générale, l'ajout d'une marge de prévoyance de 20-30% aux budgets LLM offre une protection raisonnable contre les dépassements. Des marges de prévoyance plus réduites conviennent aux déploiements matures avec des modèles d'utilisation établis.

Cycles réguliers d'examen et d'optimisation

Les coûts liés aux LLM ne sont pas fixes. Des analyses régulières permettent d'identifier les possibilités d'optimisation. Les types de requêtes évoluent. De nouveaux modèles plus performants sont mis sur le marché. Les structures tarifaires évoluent également.

Les analyses de coûts trimestrielles conviennent à la plupart des organisations. Les utilisateurs à volume élevé de données peuvent tirer profit d'une analyse mensuelle.

Réduisez les coûts de votre LLM avant de vous engager

Au Royaume-Uni, les coûts des LLM augmentent souvent lors des phases de données et d'entraînement, en particulier lorsque les modèles sont construits sans structure claire. IA supérieure Cette approche se concentre sur la conception et le déploiement de systèmes LLM de bout en bout, depuis la collecte des données, le prétraitement et la conception du modèle jusqu'à l'entraînement et l'optimisation. Au lieu de traiter ces étapes séparément, le travail est aligné dès le départ, ce qui permet d'éviter les reprises et de mieux maîtriser les budgets.

L'équipe travaille généralement avec des entreprises qui ont besoin de systèmes opérationnels, et non d'expérimentations. Elle combine le conseil en IA et le développement complet pour adapter les modèles aux cas d'usage réels. Si vous prévoyez un projet de master en IA ou si vous cherchez à maîtriser les coûts liés aux données, à la formation et au déploiement, il est judicieux de solliciter un deuxième avis dès le début. Contactez-nous. IA supérieure revoir votre approche avant que les coûts ne soient définitivement fixés.

Questions fréquemment posées

Combien coûtent généralement les LLM aux entreprises britanniques par mois ?

Les coûts varient énormément en fonction du volume d'utilisation et du modèle choisi. Les petites entreprises utilisant des chatbots basiques peuvent dépenser entre 50 et 200 £ par mois. Les entreprises de taille moyenne disposant de plusieurs applications constatent généralement des coûts mensuels de 500 à 5 000 £. Les grandes entreprises avec des déploiements importants peuvent dépenser des dizaines de milliers de livres sterling par mois. La tarification au jeton signifie que les coûts sont directement proportionnels à l'utilisation, ce qui rend les généralisations difficiles sans connaître les caractéristiques spécifiques de la charge de travail.

Pour les entreprises britanniques, les abonnements ou la tarification à l'utilisation sont-ils plus avantageux ?

Tout dépend de la prévisibilité de l'utilisation. Les abonnements conviennent parfaitement aux charges de travail constantes et prévisibles et offrent une visibilité budgétaire. Le paiement à l'usage est plus adapté aux usages variables, aux environnements de test et aux organisations qui valident la demande. De nombreuses entreprises britanniques optent pour une approche hybride : un abonnement de base pour les tâches prévisibles et une facturation à l'usage pour les pics d'activité. Il est conseillé d'analyser l'historique d'utilisation afin de déterminer le modèle le plus adapté à la consommation actuelle.

Les modèles plus petits peuvent-ils réduire les coûts sans sacrifier la qualité ?

Absolument. Une étude de Cambridge confirme que les modèles spécialisés surpassent souvent les modèles généralistes pour des tâches spécifiques, tout en étant moins coûteux. Toutes les requêtes ne nécessitent pas le modèle le plus performant. Les modèles plus petits conviennent parfaitement aux tâches de classification simples, aux réponses courantes au service client et à l'extraction de données simples. Réservez les modèles haut de gamme aux tâches de raisonnement complexes qui requièrent réellement des capacités avancées. Tester différents modèles sur des charges de travail réelles permet d'identifier le meilleur compromis coût-performance.

Quels coûts cachés les organisations britanniques doivent-elles prévoir dans leur budget, au-delà des frais d'API ?

L'intégration et le développement représentent des coûts initiaux importants. Les outils de gestion et de surveillance des API engendrent des dépenses récurrentes. Les environnements de test et de développement consomment des jetons indépendamment de l'environnement de production. Les coûts de validation humaine pour les processus nécessitant une intervention humaine peuvent dépasser les coûts de calcul. Former le personnel à l'utilisation efficace des LLM exige un investissement en temps. Enfin, les organisations doivent prévoir un budget pour des optimisations périodiques afin de maîtriser les coûts à mesure que l'utilisation augmente.

Comment la réduction des coûts 90% de l'Université de Manchester peut-elle être appliquée ?

Les frameworks LangVAE et LangSpace répondent spécifiquement aux besoins en ressources de contrôle et de test. Les organisations qui privilégient l'explicabilité et la fiabilité, notamment dans les secteurs réglementés, peuvent adopter ces frameworks pour compresser les représentations du langage. L'examen et l'ajustement du comportement des modèles de langage (LLM) s'en trouvent considérablement simplifiés. Bien que ces frameworks ciblent des aspects spécifiques des opérations des LLM plutôt que les coûts d'inférence généraux, ils peuvent réduire sensiblement le coût total de possession pour les organisations exigeant des mécanismes de test et de contrôle rigoureux.

Quels indicateurs de coûts les entreprises britanniques devraient-elles utiliser pour les différents secteurs ?

Les services financiers enregistrent généralement des coûts LLM par employé plus élevés en raison des applications de conformité, de détection des fraudes et de traitement documentaire. Les organismes de santé sont confrontés à des requêtes complexes nécessitant des modèles sophistiqués, ce qui augmente les coûts par interaction malgré des volumes de travail plus faibles. Le commerce de détail et le e-commerce gèrent souvent des charges de travail importantes et peu complexes, avec des coûts par requête modérés. Les services professionnels, tels que les cabinets juridiques et de conseil, présentent des tendances variables : certaines entreprises utilisent intensivement les LLM pour la recherche et la rédaction, d’autres de façon minimale. Plutôt que de se baser sur des indicateurs sectoriels, il est préférable de privilégier des mesures spécifiques à chaque cas d’usage, alignées sur la valeur ajoutée pour l’entreprise.

Les organisations britanniques devraient-elles envisager l'auto-hébergement de modèles open source ?

L'auto-hébergement se justifie dans certains cas : volumes d'utilisation très élevés où le coût par jeton devient prohibitif, exigences strictes en matière de souveraineté des données ou besoin d'une personnalisation poussée du modèle. Toutefois, l'auto-hébergement implique des investissements matériels, des coûts énergétiques, une expertise en maintenance et des mises à jour régulières du modèle. Pour la plupart des entreprises britanniques dont le volume d'utilisation mensuel est inférieur à 10 millions de jetons, les API commerciales restent plus économiques. Les organisations doivent calculer le coût total de possession, incluant l'infrastructure, le personnel et le coût d'opportunité, avant de s'engager dans des déploiements auto-hébergés.

Conclusion

Au Royaume-Uni, le coût des formations LLM continue d'évoluer au gré de la maturation et de l'adoption croissante de la technologie. La compréhension des modèles de tarification, l'optimisation de leur utilisation et le choix des modèles appropriés contribuent à la maîtrise des coûts.

L'étude de Manchester, qui démontre une réduction de 90% des besoins en ressources de contrôle, prouve que des gains d'efficacité significatifs restent possibles. À mesure que les cadres et les techniques évoluent, les organisations prêtes à investir dans l'optimisation peuvent réaliser des économies substantielles.

Mais le coût ne doit pas être le seul critère. Les recherches du Regulatory Genome Project sur les systèmes HITL nous rappellent que l'efficacité globale de bout en bout importe plus que le prix unitaire. Un modèle légèrement plus coûteux, qui élimine les étapes de vérification humaine ou réduit les taux d'erreur, peut offrir un meilleur rapport qualité-prix.

Pour les entreprises britanniques qui envisagent d'adopter LLM, commencez par définir des cas d'usage clairs et des projections d'utilisation réalistes. Menez des projets pilotes pour établir des données de référence. Mettez en place un système de suivi dès le premier jour. Et n'oubliez pas : l'erreur la plus coûteuse n'est pas de dépenser trop en jetons, mais de déployer des systèmes qui n'apportent aucune valeur ajoutée à l'entreprise.

Prêt à optimiser vos coûts LLM ? Commencez par analyser vos habitudes d’utilisation actuelles, identifier les gains rapides grâce à une optimisation immédiate et évaluer si des modèles spécialisés pourraient mieux répondre aux besoins des utilisateurs à fort volume. La stratégie idéale allie rentabilité et valeur ajoutée de ces outils performants.