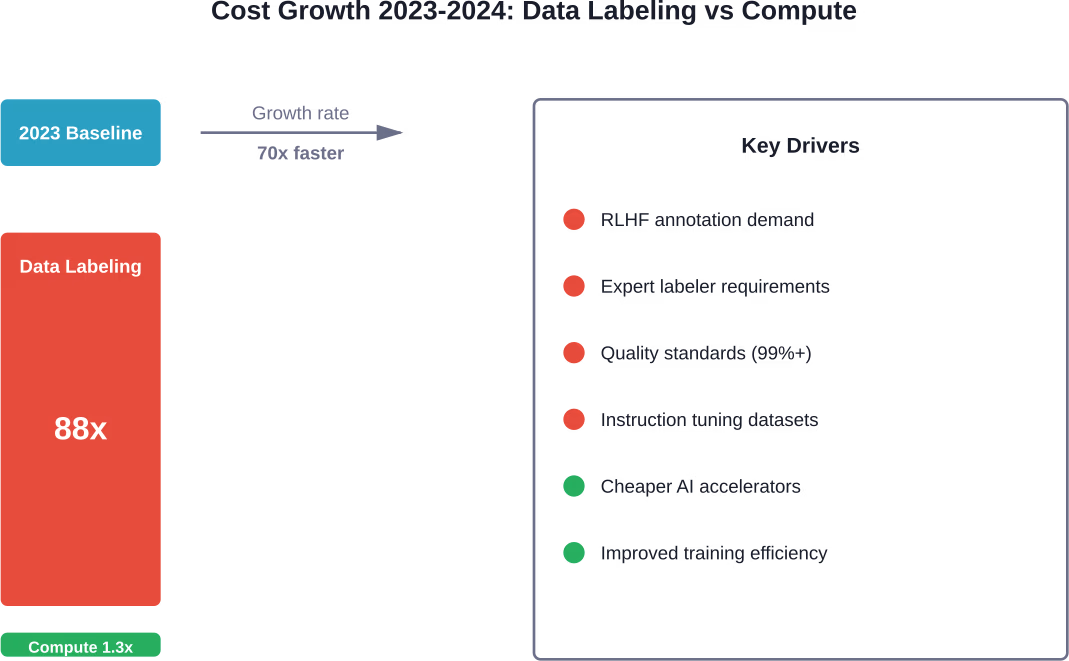

Résumé rapide : Les coûts d'annotation des données LLM ont explosé, le chiffre d'affaires du secteur ayant été multiplié par 88 entre 2023 et 2024, tandis que les coûts de calcul n'ont augmenté que de 1,3 fois. L'annotation humaine post-entraînement (RLHF, optimisation des instructions) coûte désormais environ trois fois plus cher que les dépenses de calcul marginales pour les modèles de pointe. Le coût d'une annotation par des experts pour un seul projet peut varier de 60 000 à 14 millions de TPE, faisant de l'annotation des données le principal goulot d'étranglement du développement de l'IA.

L'idée reçue concernant les coûts de l'IA est fausse.

Pendant des années, la puissance de calcul a dominé les discussions sur les budgets de formation des modèles de langage. GPU, infrastructure cloud, électricité : autant de facteurs généralement évoqués pour expliquer le coût élevé de l’IA. Selon des sources citées par la concurrence, la formation de GPT-4 aurait coûté entre $78 et plus de 100 millions de dollars, tandis que celle de Gemini Ultra 1.0 aurait atteint $192 millions de dollars.

Mais voici ce qui a changé : l’étiquetage des données a discrètement supplanté le calcul comme principal facteur de coût marginal pour les modèles de frontière.

Une analyse récente montre que le chiffre d'affaires des principales entreprises d'étiquetage de données a été multiplié par 88 entre 2023 et 2024, tandis que les coûts de calcul liés à l'entraînement n'ont augmenté que de 1,3 fois. Lorsque les chercheurs ont calculé le chiffre d'affaires annuel de Scale, Surge, Mercor, Labelbox et d'entreprises similaires, puis l'ont comparé aux dépenses de calcul marginales pour des modèles comme GPT-40, Claude Sonnet-3.5, Mistral-Large, Grok-2 et Llama-3-405B, les chiffres sont sans équivoque : les coûts d'étiquetage sont désormais environ trois fois supérieurs aux coûts de calcul marginales.

Cette évolution reflète la manière dont les modèles d'apprentissage automatique modernes acquièrent leurs capacités. Les techniques de post-entraînement, telles que l'ajustement fin supervisé (SFT) et l'apprentissage par renforcement à partir de retours humains (RLHF), sont devenues essentielles pour produire des modèles réellement opérationnels en production. Contrairement au pré-entraînement sur des données brutes issues d'Internet, ces méthodes nécessitent des ensembles de données soigneusement sélectionnés et créés par des humains, souvent des experts du domaine.

Et le temps des experts a un coût.

Les chiffres réels qui sous-tendent les coûts d'étiquetage des données LLM

Des études de cas révèlent à quel point l'annotation humaine est devenue coûteuse.

Prenons l'exemple de MiniMax-M1, qui a nécessité moins de 1 TP4T1 million de puissance de calcul pour atteindre la qualité de Claude-Opus-4. Ou encore SkyRL-SQL, qui a égalé les performances de GPT-4o sur des tâches de conversion de texte en SQL avec seulement 1 TP4T360 de puissance de calcul pour l'entraînement.

Il ne s'agit pas de cas isolés. Ils représentent la nouvelle économie du développement des LLM.

D'après le guide de référence de Scale AI sur l'étiquetage des données, obtenir une qualité extrêmement élevée (99%+) sur un grand ensemble de données exige une main-d'œuvre importante (plus de 1 000 étiqueteurs de données par projet). Grâce à des équipes hautement qualifiées et des flux de travail automatisés sophistiqués, les entreprises spécialisées fournissent des étiquetages de haute qualité, mais le coût minimal est relatif lorsque l'expertise humaine est au cœur du processus.

Quels sont les facteurs qui influencent les dépenses d'étiquetage des données LLM ?

Plusieurs facteurs contribuent à l'augmentation des coûts d'annotation.

Dépendance post-formation

Les modèles de langage modernes ne sont pas opérationnels immédiatement après la pré-formation. Ils nécessitent un perfectionnement par le biais d'un apprentissage supervisé et de techniques d'apprentissage par renforcement. Ces processus requièrent impérativement des données étiquetées par des humains, de préférence par des experts maîtrisant les critères d'évaluation nuancés.

Un article de recherche sur l'annotation en ligne de jeux de données basée sur les modèles de langage à grande échelle et prenant en compte les coûts (arXiv:2505.15101) souligne comment les progrès récents dans ce domaine ont permis l'étiquetage automatisé, mais que la supervision humaine demeure essentielle pour garantir la qualité. La tension entre le potentiel d'automatisation et les exigences de qualité maintient les coûts à un niveau élevé.

Exigences des étiqueteurs experts

L'étiquetage efficace des données d'entraînement LLM ne s'improvise pas. Différentes tâches requièrent différents niveaux d'expertise :

- Les tâches de classification de base pourraient être réalisées avec du travail participatif général.

- L'évaluation du code nécessite des développeurs de logiciels expérimentés.

- Les réponses aux questions médicales nécessitent des spécialistes du domaine possédant les qualifications requises.

- Les tâches de raisonnement juridique exigent de véritables professionnels du droit.

- La vérification des problèmes mathématiques nécessite des experts en la matière.

Les tarifs horaires des experts reflètent leur expertise. Les spécialistes de domaine, facturés entre $50 et plus de 200 £ de l'heure, modifient considérablement la rentabilité des projets par rapport à l'étiquetage de base à $10-15 £ de l'heure.

Normes de qualité et examen en plusieurs étapes

L'obtention d'une précision d'annotation de niveau 99%+ nécessite un contrôle qualité à plusieurs niveaux. Les flux de travail standard du secteur comprennent souvent :

- Étiquetage initial par des annotateurs formés

- Révision secondaire par des étiqueteurs seniors

- Contrôles ponctuels effectués par des experts du domaine

- Mécanismes de consensus pour les cas ambigus

- Suivi continu de la qualité et boucles de rétroaction

Chaque couche supplémentaire engendre des coûts, mais s'avère nécessaire pour les ensembles de données de qualité professionnelle.

Exigences relatives à l'échelle des ensembles de données

Un post-entraînement efficace exige des volumes de données considérables. Les implémentations RLHF peuvent nécessiter des dizaines de milliers de jugements de comparaison. Les jeux de données d'optimisation des instructions contiennent souvent des centaines de milliers d'exemples répartis dans diverses catégories de tâches.

L'échelle est importante pour la généralisation. Des ensembles de données plus vastes et plus diversifiés aident les modèles à gérer les cas limites et les schémas de requêtes inhabituels, mais ils multiplient proportionnellement les coûts d'annotation.

Comment les entreprises leaders fixent le prix des services d'étiquetage des données

Le secteur de l'étiquetage des données est devenu un secteur de plusieurs milliards de dollars avec des acteurs spécialisés.

D'après les analyses sectorielles, des entreprises majeures comme Scale, Surge, Mercor et Labelbox ont connu une croissance fulgurante de leur chiffre d'affaires. Les leaders de l'IA, tels qu'OpenAI, Google, Meta et Anthropic, investissent chacun environ 100 milliards de dollars par an dans des données d'entraînement et des retours d'information fournis par des humains afin d'obtenir des modèles performants.

Les modèles de tarification varient selon le fournisseur et la complexité du projet :

| Modèle de tarification | Idéal pour | Plage typique |

|---|---|---|

| Prix par article | tâches de classification simples | $0.01 – $2.00 par étiquette |

| Tarifs horaires | Annotation complexe nécessitant une expertise | $15 – $200+ par heure |

| Devis basés sur un projet | Initiatives à grande échelle avec un périmètre défini | $50 000 – $10M+ |

| Contrats de services gérés | Besoins d'étiquetage continus avec des SLA de qualité | Tarification personnalisée pour les entreprises |

Soyons francs : les tarifs publiés reflètent rarement la réalité dans son intégralité. Les contrats d’entreprise incluent des remises sur volume, des garanties de qualité, des engagements de délais de livraison et l’accès à des outils spécialisés — autant d’éléments qui influent sur le coût final.

Comparaison pratique des coûts d'étiquetage des données et de calcul

La structure des coûts du développement des LLM a fondamentalement changé.

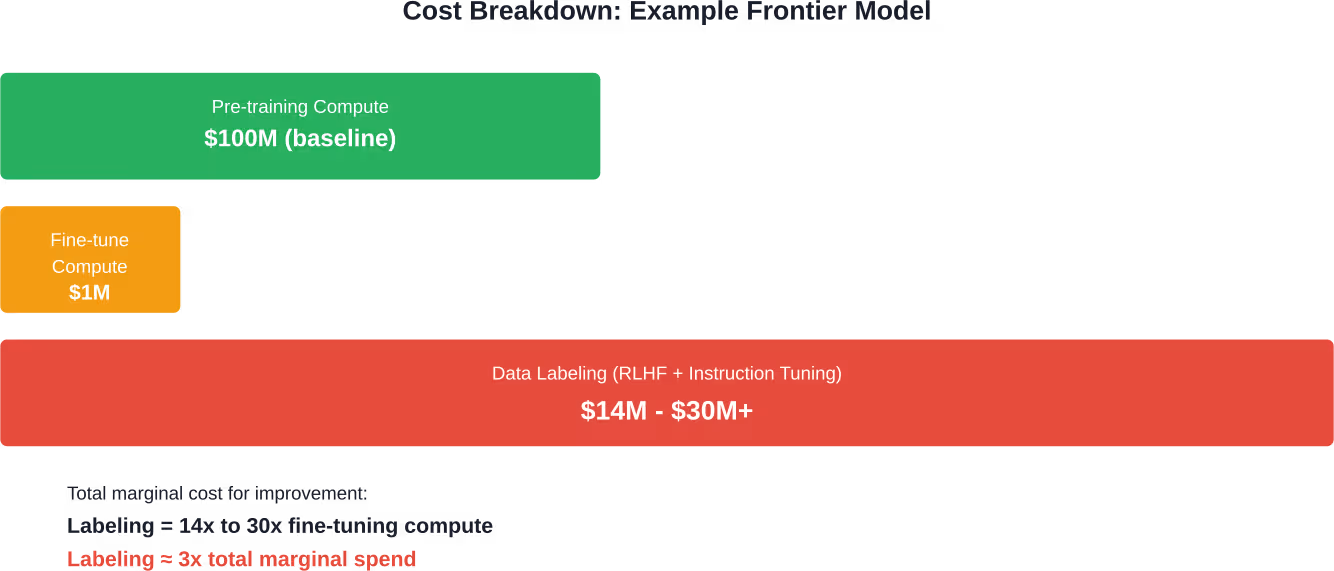

Le pré-entraînement consomme toujours d'importantes ressources de calcul. L'entraînement de modèles de pointe sur des milliards de jetons nécessite d'énormes clusters de GPU fonctionnant pendant des semaines, voire des mois. Mais voilà : les coûts de calcul sont devenus plus prévisibles et, comparativement, plus gérables.

Les fournisseurs de cloud proposent des capacités réservées et des contrats à long terme garantissant des tarifs fixes. L'efficacité des GPU continue de progresser. Des techniques d'entraînement comme l'arithmétique en précision mixte et le point de contrôle du gradient réduisent les besoins en ressources.

L'étiquetage des données, quant à lui, évolue différemment. Les ressources humaines ne doublent pas tous les 18 mois. La disponibilité des experts reste limitée. Le contrôle qualité ne peut être parallélisé à l'infini.

Les enjeux économiques deviennent criants lorsqu'on examine les cycles de développement de modèles spécifiques. Pour les modèles ciblant des domaines spécialisés (juridique, médical, scientifique), le coût élevé de l'expertise accentue le problème. Trouver des annotateurs qualifiés prend du temps. Les former aux directives d'annotation en prend encore plus. Garantir la cohérence au sein de grandes équipes exige une gestion rigoureuse.

Variations de coûts selon le type de tâche d'annotation

Toutes les tâches d'étiquetage n'ont pas le même coût.

Étiquetage de préférence RLHF

L’apprentissage par renforcement à partir de retours humains nécessite que des annotateurs comparent les résultats du modèle et indiquent leurs préférences. Les tâches consistent notamment à :

- Lire deux ou plusieurs réponses modèles à la même question

- Évaluation de la qualité selon de multiples dimensions (exactitude, utilité, sécurité, ton)

- Sélectionner la meilleure réponse ou classer plusieurs options

- Parfois, fournir une justification écrite des choix

La complexité varie énormément. Des jugements de préférence simples sur des requêtes directes peuvent coûter entre $2 et 5 par comparaison. Des évaluations nuancées nécessitant une expertise du domaine peuvent coûter entre $20 et plus de 100 par ensemble de comparaison.

Pour les ensembles de données nécessitant entre 50 000 et 200 000 comparaisons, les coûts atteignent rapidement des sommes à six ou sept chiffres.

Création d'un ensemble de données pour le réglage des instructions

La création d'ensembles de données de suivi d'instructions exige un travail différent. Les annotateurs créent :

- Des invites variées couvrant plusieurs catégories de tâches

- Des réponses de référence de haute qualité démontrant le comportement souhaité

- Des variantes couvrant les cas limites et différentes formulations

- Conversations à plusieurs tours démontrant une compréhension contextuelle

La création de paires instruction-réponse originales et de haute qualité prend beaucoup plus de temps qu'un simple étiquetage des préférences. Pour les tâches générales, on utilise généralement un taux de $10 à 50 par paire instruction-réponse. Les domaines spécialisés (programmation, mathématiques, raisonnement scientifique) peuvent nécessiter jusqu'à 50, voire plus de 200 paires instruction-réponse par exemple.

Classification et reconnaissance d'entités

Les tâches d'étiquetage NLP traditionnelles restent pertinentes pour des applications spécialisées :

- Reconnaissance d'entités nommées dans des textes spécifiques à un domaine

- Classification des sentiments avec des catégories fines

- Classification des intentions pour les systèmes conversationnels

- Extraction de relations à partir de documents non structurés

Ces tâches coûtent généralement moins cher que le RLHF ou le réglage des instructions, souvent de $0,05 à $2,00 par élément en fonction de la complexité et de l'expertise requise.

Annotation multimodale

Les modèles vision-langage nécessitent des paires image-texte étiquetées, des annotations vidéo et des données d'alignement intermodal. La complexité augmente avec :

- Légende détaillée des images nécessitant des descriptions complètes

- Détection et segmentation d'objets dans des scènes complexes

- Tâches de compréhension vidéo impliquant un raisonnement temporel

- Annotation 3D pour la compréhension spatiale

L'étiquetage par vision par ordinateur possède sa propre structure de coûts, souvent plus élevée que la simple annotation de texte en raison des exigences en matière d'outillage spécialisé et de la charge cognitive.

Stratégies pour réduire les coûts d'étiquetage des données LLM

Les équipes intelligentes optimisent les budgets d'annotation sans sacrifier la qualité.

Apprentissage actif et annotation sélective

Pourquoi tout étiqueter alors que les modèles peuvent identifier leurs propres points faibles ?

Les cadres d'apprentissage actif interrogent le modèle pour identifier les exemples où l'incertitude est la plus grande ou ceux où des données supplémentaires seraient particulièrement utiles. Cette approche permet de concentrer les efforts d'annotation là où ils sont les plus pertinents, réduisant potentiellement le volume d'annotation de 50 à 801 000 000 tout en maintenant des performances de modèle comparables.

L'article d'arXiv sur l'annotation de jeux de données en ligne basée sur LLM et prenant en compte les coûts explore comment les systèmes automatisés peuvent sélectionner stratégiquement les exemples nécessitant un étiquetage humain, en équilibrant les contraintes de coût et les objectifs de qualité.

Annotation assistée par un LLM

Les grands modèles de langage peuvent amorcer le processus d'étiquetage. Les flux de travail comprennent :

- Utiliser GPT-4 ou Claude pour générer les étiquettes initiales

- Des examinateurs humains valident et corrigent les résultats du LLM.

- Consacrer le temps des experts aux cas difficiles ou à l'assurance qualité

- Élaboration de mécanismes de consensus entre les modèles de langage et les jugements humains

Cette approche peut réduire les coûts de 40 à 70% par rapport à une annotation humaine complète tout en maintenant les normes de qualité, bien qu'une validation attentive reste essentielle pour détecter les erreurs systématiques LLM.

Flux de travail d'étiquetage hiérarchisés

Adapter l'expertise des annotateurs à la complexité de la tâche :

- Les étiqueteurs juniors traitent les cas simples à des tarifs inférieurs.

- Les annotateurs seniors s'attaquent aux exemples ambigus ou difficiles.

- Les experts du domaine se concentrent exclusivement sur le contenu spécialisé

- Des contrôles qualité automatisés acheminent les articles vers les niveaux appropriés.

Une orchestration sophistiquée maximise la rentabilité tout en préservant la qualité des éléments qui nécessitent véritablement l'attention d'experts.

Réutilisation des jeux de données et augmentation synthétique

Chaque nouveau projet ne doit pas nécessairement repartir de zéro. Les organisations peuvent :

- Constituez les ensembles de données de base une seule fois et réutilisez-les pour plusieurs itérations du modèle.

- Accéder aux licences des ensembles de données de haute qualité existants lorsqu'ils sont disponibles.

- Générer des variations synthétiques d'exemples étiquetés

- Partager les ensembles de données entre les projets connexes au sein de l'organisation

Mais attention : l’acquisition de licences de jeux de données peut s’avérer onéreuse, les fournisseurs prenant conscience de la valeur stratégique des données. Des accords récents entre des laboratoires d’IA et des fournisseurs de contenu ont atteint des centaines de millions de dollars pour l’accès à des sources textuelles propriétaires.

Réduisez les dépenses inutiles en étiquetage avant de vous former.

La qualité des données est le principal facteur d'augmentation discrète des coûts des modèles de modélisation linéaire. Corriger les problèmes d'étiquetage après l'entraînement est coûteux, et des jeux de données mal préparés entraînent davantage d'itérations, et non de meilleurs modèles. C'est là que… IA supérieure Il s'intègre généralement dans ce rôle – non pas en tant que fournisseur d'étiquetage, mais en tant que couche qui veille à ce que l'étiquetage se traduise effectivement par des performances de modèle utilisables.

Ils gèrent la collecte, le nettoyage et le prétraitement des données dans le cadre du pipeline du modèle, afin que les jeux de données soient structurés pour l'entraînement dès le départ, et non modifiés a posteriori. Cela inclut l'alignement des données avec le cas d'utilisation, la réduction du bruit et leur préparation pour les flux de travail d'ajustement fin qui optimisent les ressources de calcul et le budget. Si vos coûts d'étiquetage augmentent sans que la qualité du modèle ne suive, le problème se situe généralement en amont. Corrigez le pipeline avant de le déployer à plus grande échelle – contactez-les. IA supérieure et comprendre clairement ce qui influence réellement vos coûts.

Les implications stratégiques pour le développement de l'IA

Les coûts d'étiquetage des données modifient la façon dont les organisations abordent le développement des LLM.

Les petites entreprises sont confrontées à une réalité difficile. Faute de ressources suffisantes pour financer des projets d'annotation de grande envergure, la concurrence avec les laboratoires bien financés devient ardue. Cela crée une pression potentielle à la consolidation dans le secteur de l'IA : les entreprises disposant de moyens financiers plus importants peuvent se permettre de meilleurs ensembles de données et, par conséquent, de meilleurs modèles.

L'aspect économique favorise également certains choix architecturaux. Les petits modèles de langage (SLM), avec 1 à 15 milliards de paramètres, nécessitent moins de données d'entraînement et peuvent atteindre d'excellentes performances sur des domaines ciblés. Alors que l'entraînement des modèles de langage de pointe coûte plus de 100 millions de dollars, les SLM réduisent le coût par million de requêtes d'un facteur supérieur à 100 et requièrent des budgets d'annotation proportionnellement plus faibles pour l'ajustement fin.

Les organisations évaluent de plus en plus leurs décisions de développement interne ou d'achat en se basant sur les données. L'optimisation des modèles existants est souvent plus rentable que la création d'un nouveau modèle : on ne paie que les coûts d'annotation, sans les frais de calcul considérables liés au pré-entraînement.

Cela a accéléré l'adoption du réglage fin. Selon l'analyse des schémas de déploiement des modèles, le réglage fin permet d'économiser de 60 à 901 Tp par rapport à un pré-entraînement complet, tout en obtenant des performances spécifiques à la tâche comparables.

| Approche | Calculer le coût | Coût de l'étiquetage des données | Idéal pour |

|---|---|---|---|

| Pré-formation à partir de zéro | $50M – $200M+ | Minimal (non supervisé) | Développement de modèles de frontière |

| Modèle de base de réglage fin | $10K – $1M | $50K – $15M | Spécialisation de domaine |

| Ingénierie rapide uniquement | Proche de zéro | $5K – $50K (quelques exemples) | Prototypage rapide, tâches simples |

| Formation sur petits modèles | $5K – $500K | $10K – $500K | Déploiement en périphérie, applications sensibles aux coûts |

Tendances du secteur et perspectives d'avenir

Que va-t-il se passer ensuite en matière d'économie de l'étiquetage des données ?

Les taux de croissance devraient se modérer après le bond extraordinaire de 88 fois observé entre 2023 et 2024. Cette hausse s'explique en grande partie par l'expansion rapide d'entreprises spécifiques comme Mercor. Cependant, les montants en valeur absolue continuent d'augmenter à mesure que davantage d'organisations investissent dans le développement de LLM et que les laboratoires existants améliorent leurs modèles.

Les pistes de recherche susceptibles de modifier le paysage économique comprennent :

- Mécanismes de vérification automatisés : Si les modèles peuvent s'auto-vérifier de manière fiable ou si des méthodes de vérification peu coûteuses voient le jour, le coût de génération de grands ensembles de données étiquetées pourrait diminuer considérablement. Ce domaine de recherche demeure très actif.

- Modèles de récompense tolérant les données bruitées : Les implémentations actuelles de RLHF nécessitent des étiquettes de préférence de haute qualité. Les techniques fonctionnant avec des étiquettes de moindre qualité ou partiellement automatisées permettraient de réduire les coûts.

- Intelligence artificielle constitutionnelle et techniques d'auto-amélioration : Les méthodes permettant d'améliorer les modèles par l'autocritique et la révision pourraient réduire la dépendance à l'égard des annotations humaines.

- Meilleure efficacité des données : Les recherches se poursuivent afin d'extraire davantage de valeur à partir de données moins étiquetées grâce à des algorithmes et des techniques d'entraînement améliorés.

La question qui se pose à l'industrie : l'automatisation peut-elle compenser les exigences croissantes en matière de qualité et l'expansion des cas d'utilisation ?

Les discussions sur les forums professionnels mettent en lumière le fait que l'étiquetage des données est devenu un véritable goulot d'étranglement dans le développement de l'IA. Les organisations indiquent passer des mois à recruter et à former des équipes d'annotateurs. Les incohérences en matière de qualité entraînent des retards dans les projets. La disponibilité des experts limite davantage les délais que la planification des ressources de calcul.

Planification pratique des coûts pour les projets de maîtrise en droit

Les équipes qui planifient des initiatives LLM devraient prévoir un budget réaliste pour l'étiquetage des données.

Pour un projet de moyenne envergure visant une amélioration spécifique à un domaine :

- Ensemble de données RLHF (20 000 comparaisons, complexité modérée) : $100K – $400K

- Ensemble de données pour le réglage des instructions (10 000 exemples, domaine général) : $80K – $300K

- Assurance qualité et validation (données 20%) : $36K – $140K

- Gestion de projet et outillage : $25K – $100K

Budget total d'annotation : $241K – $940K

L'optimisation des ressources de calcul pour un même projet pourrait nécessiter entre $50K et $200K. Les coûts d'annotation sont prépondérants, conformément aux prévisions des données du secteur.

Pour les initiatives de grande envergure visant à développer des capacités de pointe, les budgets sont adaptés en conséquence. Les projets comportant plus de 100 000 exemples étiquetés et nécessitant l’intervention d’annotateurs experts peuvent facilement atteindre 1 400 000 à 15 millions de livres sterling rien que pour les coûts d’étiquetage.

Choisir un fournisseur d'étiquetage de données

Choisir le bon partenaire d'annotation a un impact significatif sur le coût et la qualité.

Les critères d'évaluation devraient inclure :

- Antécédents de qualité : Demandez des études de cas et des références de clients ayant réalisé des tâches similaires. Renseignez-vous sur les taux de précision atteints et les mécanismes de contrôle qualité mis en place.

- Expertise en annotation : Vérifiez que le prestataire a accès à des experts du domaine pertinents pour le projet. Les plateformes de crowdsourcing généralistes ont des difficultés avec les contenus spécialisés.

- Capacités d'outillage : Les plateformes d'annotation modernes offrent des fonctionnalités d'efficacité qui réduisent les coûts par élément : routage intelligent des tâches, contrôles de qualité automatisés, fonctionnalités de collaboration et intégration avec les pipelines d'apprentissage automatique.

- Évolutivité : Le prestataire est-il en mesure d'augmenter sa capacité pour faire face à une hausse soudaine des besoins ? Dispose-t-il d'effectifs suffisants pour les projets de grande envergure ou urgents ?

- Sécurité et conformité : Pour les données sensibles, vérifiez les certifications appropriées, les protocoles de traitement des données et les protections contractuelles.

- Transparence des prix : Méfiez-vous des fournisseurs qui refusent d'aborder la question des prix avant un stade avancé du processus de vente. La prévisibilité des coûts est essentielle à la planification d'un projet.

Les principaux fournisseurs du secteur ont mis en place des flux de travail spécialisés et optimisés pour les données d'entraînement LLM. Selon les ressources de Scale AI, ils disposent d'importantes équipes d'annotation qualifiées et d'outils propriétaires conçus spécifiquement pour les cas d'utilisation du ML.

Programme de recherche en économie des données

Les chercheurs universitaires et industriels commencent à considérer les données comme un domaine économique à part entière.

Un programme de recherche publié sur arXiv (L'économie des données d'entraînement en IA) souligne que, malgré le rôle central des données dans la production d'IA, elles demeurent l'intrant le moins bien compris. Face à l'épuisement des données publiques par les laboratoires d'IA et à leur recours à des sources propriétaires via des contrats atteignant des centaines de millions de dollars, la recherche s'est fragmentée entre l'informatique, l'économie, le droit et les politiques publiques.

Parmi les principales questions en suspens, on peut citer :

- Comment les données doivent-elles être valorisées en tant que facteur de production distinct ?

- Quelles structures de marché émergeront pour l'échange de données de formation ?

- Comment les régimes de propriété intellectuelle affectent-ils la disponibilité et le coût des données ?

- Quelles sont les conséquences de la concentration des données sur le bien-être ?

- Des mécanismes peuvent-ils garantir une juste rémunération aux créateurs de données ?

Il ne s'agit pas de simples préoccupations théoriques. Elles ont une incidence directe sur qui a les moyens de développer des systèmes d'IA compétitifs et sur les capacités de ces systèmes.

Le passage d'un goulot d'étranglement lié à la puissance de calcul à un goulot d'étranglement lié aux données représente un changement fondamental dans l'économie de l'IA. Il est plus difficile d'accroître l'expertise humaine que d'ajouter des GPU. Il est plus difficile d'automatiser un jugement nuancé que de paralléliser des multiplications matricielles.

Cette réalité façonnera l'industrie de l'IA pour les années à venir.

Questions fréquemment posées

Quel est le coût de l'étiquetage des données pour un projet de mise au point LLM typique ?

Les coûts d'étiquetage des données pour l'ajustement fin des modèles LLM varient considérablement en fonction de la complexité de la tâche et de la taille de l'ensemble de données. Un projet de taille moyenne, comprenant 20 000 à 30 000 exemples étiquetés, coûte généralement entre $200 000 et $900 000. Les tâches de classification simples, les moins coûteuses, peuvent coûter entre $0,05 et $2 par élément, tandis que les comparaisons RLHF complexes, nécessitant une expertise du domaine, peuvent coûter entre $20 et plus de $100 par comparaison. L'annotation par des experts pour des domaines spécialisés (médical, juridique, scientifique) est facturée à un tarif horaire plus élevé, de $50 à plus de $200.

Pourquoi les coûts d'étiquetage des données ont-ils augmenté plus rapidement que les coûts de calcul ?

Entre 2023 et 2024, les coûts d'étiquetage des données ont été multipliés par 88, tandis que les coûts de calcul n'ont augmenté que de 1,3 fois. Cet écart considérable s'explique par le fait que les techniques de post-entraînement (apprentissage par renforcement, ajustement fin supervisé) sont devenues essentielles pour les modèles compétitifs. Ces méthodes nécessitent une annotation humaine approfondie, souvent réalisée par des experts du domaine. Parallèlement, l'efficacité des GPU continue de progresser et les fournisseurs de cloud proposent des tarifs plus compétitifs, ce qui permet de maintenir les coûts de calcul relativement stables malgré la forte hausse des dépenses d'étiquetage.

Les LLM peuvent-ils automatiser l'étiquetage de leurs données pour réduire les coûts ?

Les modèles linguistiques logiques (LLM) peuvent faciliter l'étiquetage, mais ne permettent pas une automatisation complète sans problèmes de qualité. Les approches courantes consistent à utiliser GPT-4 ou Claude pour générer des étiquettes initiales, puis à faire valider les résultats par des relecteurs humains. Cette approche hybride peut réduire les coûts de 40 à 70 000 fois par rapport à une annotation entièrement humaine. Cependant, un contrôle qualité rigoureux demeure essentiel, car les LLM peuvent introduire des erreurs systématiques ou des biais. L'article d'arXiv sur l'annotation prenant en compte les coûts explore des cadres permettant d'équilibrer de manière optimale l'étiquetage automatisé par LLM et les coûts de vérification humaine.

Qu'est-ce qui coûte le plus cher : entraîner un LLM à partir de zéro ou peaufiner un modèle existant ?

Le pré-entraînement de modèles de pointe à partir de zéro coûte entre 100 000 et 200 millions de dollars, principalement en ressources de calcul, tandis que l'ajustement fin de modèles existants coûte généralement entre 10 000 et 1 million de dollars en ressources de calcul. Cependant, l'ajustement fin nécessite des budgets d'annotation de données considérables, souvent de 100 000 à 15 millions de dollars, selon la taille de l'ensemble de données et la complexité de la tâche. Malgré des coûts d'annotation plus élevés, l'ajustement fin permet tout de même de réaliser des économies globales de 60 à 900 milliards de dollars par rapport au pré-entraînement, tout en offrant d'excellentes performances spécifiques à la tâche. Pour la plupart des organisations, l'ajustement fin est plus avantageux économiquement.

Comment les Small Language Models (SLM) se comparent-ils aux LLM en termes de coût ?

Les modèles linéaires simples (SLM) comportant de 1 à 15 milliards de paramètres réduisent considérablement les coûts d'entraînement et d'inférence. L'entraînement d'un SLM coûte entre 10⁴ Tb/s et 500 000 Tb/s en puissance de calcul, contre plus de 10⁴ Tb/s pour les modèles linéaires de pointe (LLM). Les besoins en étiquetage des données sont proportionnellement plus faibles, généralement de 10⁴ Tb/s à 500 000 Tb/s pour des domaines ciblés. Les SLM réduisent le coût par million de requêtes d'un facteur supérieur à 100 par rapport aux grands modèles. Pour les applications à portée spécifique et les déploiements en périphérie de réseau, les SLM offrent des avantages économiques considérables tout en maintenant une précision acceptable pour les tâches ciblées.

Quelles stratégies permettent de réduire efficacement les coûts d'étiquetage des données sans sacrifier la qualité ?

Plusieurs stratégies éprouvées permettent de réduire les coûts tout en maintenant la qualité : l’apprentissage actif diminue le volume d’annotations de 50 à 80 t (TP3 T) en identifiant les exemples où l’annotation est la plus pertinente. Les flux de travail assistés par LLM utilisent des modèles pour générer les étiquettes initiales, les résultats étant validés par des humains, ce qui réduit les coûts de 40 à 70 t (TP3 T). Les flux de travail hiérarchisés adaptent l’expertise des annotateurs à la difficulté de la tâche, réservant les experts les plus coûteux aux cas véritablement complexes. La réutilisation des jeux de données amortit l’investissement dans l’annotation sur plusieurs projets. Un échantillonnage sélectif de haute qualité est souvent plus performant que des jeux de données plus volumineux mais de moindre qualité pour l’ajustement fin.

Les coûts d'étiquetage des données continueront-ils d'augmenter au rythme actuel ?

La croissance exceptionnelle de 88 fois enregistrée entre 2023 et 2024 devrait se modérer, car cette forte augmentation était principalement due à la croissance rapide de certaines entreprises. Cependant, les coûts d'étiquetage continuent d'augmenter, car de plus en plus d'organisations investissent dans le développement de modèles de modélisation de l'apprentissage (LLM) et les normes de qualité se renforcent. Les experts du secteur prévoient que l'étiquetage des données restera le principal poste de dépenses pour les modèles émergents jusqu'en 2026 et au-delà. Les recherches sur la vérification automatisée, l'apprentissage tolérant au bruit et les techniques d'auto-amélioration pourraient à terme réduire la dépendance à l'égard de l'annotation humaine coûteuse, mais aucune solution novatrice n'a encore émergé à grande échelle.

Conclusion

L'économie du développement des LLM a fondamentalement changé.

Ce qui était autrefois un domaine dominé par le calcul se retrouve aujourd'hui avec l'annotation humaine qui absorbe la majeure partie des budgets marginaux. Les coûts d'étiquetage des données ont été multipliés par 88 en une seule année, tandis que les dépenses de calcul n'ont augmenté que de 1,3 fois. Pour les organisations qui développent ou affinent des modèles, l'annotation représente désormais environ trois fois les dépenses de calcul marginales.

Il ne s'agit pas d'une anomalie passagère. Les techniques de post-entraînement nécessitant un retour humain se sont révélées essentielles pour créer des modèles fiables en production. L'apprentissage par renforcement à haute résolution (RLHF), l'optimisation des instructions et le réglage fin spécialisé reposent tous sur des jeux de données soigneusement sélectionnés et étiquetés par des experts. Le temps des experts a un coût, et même un coût important.

Les études de cas sont éloquentes. MiniMax-M1 a dépensé 28 fois plus en annotations qu'en calculs d'entraînement. Le budget d'annotation de SkyRL-SQL était 167 fois supérieur à ses coûts de calcul. Ces ratios reflètent la nouvelle norme du développement de l'IA.

Les équipes performantes optimisent leurs budgets d'annotation grâce à l'apprentissage actif, aux flux de travail assistés par les modèles d'apprentissage automatique et aux stratégies d'étiquetage hiérarchisées. Cependant, une réalité fondamentale demeure : la création de modèles d'apprentissage automatique compétitifs exige un investissement massif dans des données de haute qualité étiquetées par des humains.

Pour les organisations qui prévoient des projets de master en 2026, prévoyez un budget en conséquence. L'étiquetage des données représentera probablement entre 45 et 60 000 milliards de dollars du coût total des projets d'envergure. Collaborez avec des prestataires d'annotation expérimentés, investissez dans le contrôle qualité et prévoyez des délais plus longs que ne le laissent supposer les estimations basées uniquement sur les calculs.

Le principal obstacle n'est plus le silicium, mais l'expertise humaine. Comprendre ce changement – et anticiper ses conséquences financières – permet de distinguer les programmes de maîtrise en droit (LLM) réussis de ceux qui échouent faute de financement.

Besoin d'aide pour planifier votre budget d'annotation de données LLM ? Comprendre les coûts réels de l'annotation nécessite d'analyser votre cas d'utilisation spécifique, vos exigences de qualité et l'échelle du projet. Contactez des prestataires expérimentés pour obtenir des estimations précises avant d'engager des ressources.