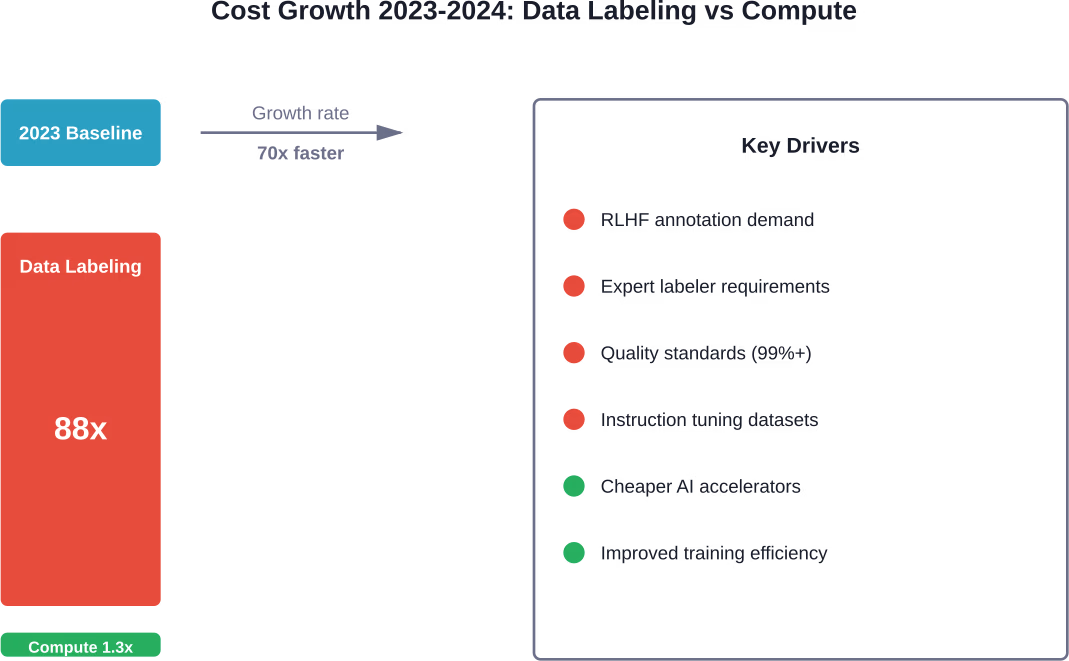

Resumen rápido: Los costos de etiquetado de datos para modelos de aprendizaje automático (LLM) se han disparado, con un crecimiento de los ingresos de la industria de 88 veces entre 2023 y 2024, mientras que los costos de computación aumentaron solo 1,3 veces. La anotación humana para el post-entrenamiento (RLHF, ajuste de instrucciones) ahora cuesta aproximadamente tres veces más que los gastos marginales de computación para los modelos de vanguardia. El etiquetado experto para un solo proyecto puede oscilar entre $60 000 y $14 millones, lo que convierte al etiquetado de datos en el cuello de botella emergente en el desarrollo de la IA.

La opinión generalizada sobre los costes de la IA es errónea.

Durante años, la computación dominó las conversaciones sobre los presupuestos de capacitación en LLM. GPU, infraestructura en la nube, electricidad: estos eran los factores habituales al hablar de lo que encarece la IA. Según fuentes citadas en contenido de la competencia, el entrenamiento de GPT-4 costó entre $78 y más de 100 millones, mientras que Gemini Ultra 1.0 alcanzó los $192 millones.

Pero esto es lo que ha cambiado: el etiquetado de datos ha superado discretamente a la capacidad de procesamiento como principal factor determinante del coste marginal para los modelos de vanguardia.

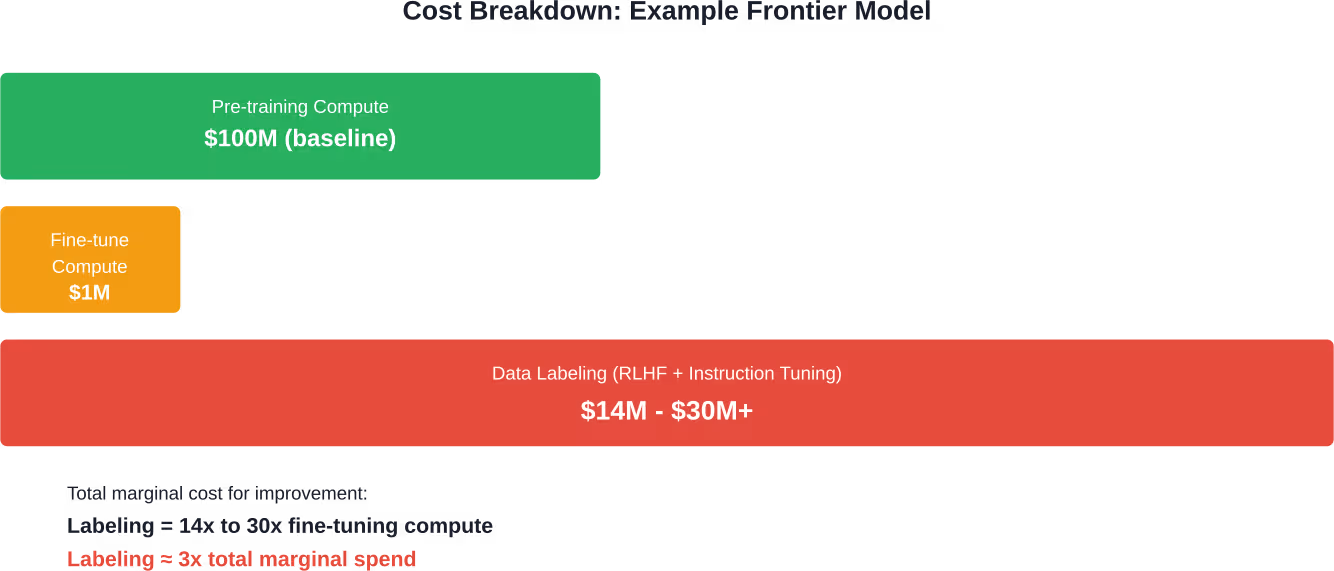

Análisis recientes muestran que los ingresos de las principales empresas de etiquetado de datos se multiplicaron por 88 entre 2023 y 2024, mientras que los costos de computación para el entrenamiento aumentaron solo 1,3 veces. Cuando los investigadores calcularon los ingresos anuales de Scale, Surge, Mercor, Labelbox y empresas similares, y los compararon con el gasto marginal en computación para modelos como GPT-4o, Claude Sonnet-3.5, Mistral-Large, Grok-2 y Llama-3-405B, las cifras revelaron una realidad clara: los costos de etiquetado ahora son aproximadamente 3 veces mayores que los costos marginales de computación.

Este cambio refleja cómo los modelos de aprendizaje automático modernos logran sus capacidades. Las técnicas posteriores al entrenamiento, como el ajuste fino supervisado (SFT) y el aprendizaje por refuerzo a partir de la retroalimentación humana (RLHF), se han vuelto esenciales para producir modelos que realmente funcionen en producción. A diferencia del preentrenamiento con datos brutos de internet, estos métodos requieren conjuntos de datos cuidadosamente seleccionados y creados por humanos, a menudo expertos en el dominio.

Y el tiempo de los expertos no es barato.

Las cifras reales detrás de los costos del etiquetado de datos LLM

Los estudios de caso revelan lo costosa que se ha vuelto la anotación humana.

Tomemos como ejemplo MiniMax-M1, que necesitó menos de 1 TP4T1 millones de recursos computacionales para alcanzar la calidad de Claude-Opus-4. O consideremos SkyRL-SQL, que igualó el rendimiento de GPT-4o en tareas de conversión de texto a SQL utilizando tan solo 1 TP4T360 de recursos computacionales para el entrenamiento.

No se trata de casos aislados. Representan la nueva economía del desarrollo de los másteres en derecho (LLM).

Según la guía de referencia de Scale AI sobre etiquetado de datos, lograr una calidad extremadamente alta (99%+) en un conjunto de datos extenso requiere una gran cantidad de personal (más de 1000 etiquetadores de datos por proyecto). Con equipos altamente capacitados y flujos de trabajo automatizados sofisticados, las empresas especializadas ofrecen etiquetas de alta calidad, pero el costo mínimo es relativo cuando la experiencia humana impulsa el proceso.

¿Qué factores impulsan los gastos en el etiquetado de datos de LLM?

Diversos factores se combinan para elevar los costes de anotación.

Dependencia posterior al entrenamiento

Los modelos de aprendizaje automático modernos no funcionan directamente tras el preentrenamiento. Requieren perfeccionamiento mediante técnicas de ajuste fino supervisado y aprendizaje por refuerzo. Estos procesos exigen datos etiquetados por humanos, preferiblemente por expertos que comprendan criterios de evaluación complejos.

Un artículo de investigación sobre la anotación en línea de conjuntos de datos basada en modelos de lenguaje a gran escala (arXiv:2505.15101) destaca cómo los recientes avances en modelos de lenguaje a gran escala han permitido el etiquetado automatizado, pero la supervisión humana sigue siendo fundamental para garantizar la calidad. La tensión entre el potencial de automatización y los requisitos de calidad mantiene los costos elevados.

Requisitos para etiquetadores expertos

No cualquiera puede etiquetar eficazmente los datos de formación de LLM. Las distintas tareas requieren distintos niveles de experiencia:

- Las tareas de clasificación básicas podrían funcionar con mano de obra colectiva general.

- La evaluación del código requiere desarrolladores de software experimentados.

- Las respuestas a consultas médicas requieren especialistas en el dominio con las credenciales pertinentes.

- Las tareas de razonamiento jurídico requieren profesionales del derecho reales.

- La verificación de problemas matemáticos requiere expertos en la materia.

Las tarifas por hora de los expertos reflejan su conocimiento especializado. Los especialistas en un dominio que cobran entre 50 y 200 dólares o más por hora cambian drásticamente la economía del proyecto en comparación con las tarifas básicas de entre 10 y 15 dólares por hora.

Estándares de calidad y revisión en múltiples etapas

Para lograr una precisión de anotación de 99%+ se requiere un control de calidad por capas. Los flujos de trabajo estándar de la industria suelen incluir:

- Etiquetado inicial por anotadores capacitados

- Revisión secundaria por etiquetadores sénior

- Verificación aleatoria por expertos en la materia

- Mecanismos de consenso para casos ambiguos

- Seguimiento continuo de la calidad y mecanismos de retroalimentación.

Cada capa adicional supone un coste extra, pero resulta necesaria para obtener conjuntos de datos aptos para la producción.

Requisitos de escala del conjunto de datos

El entrenamiento posterior eficaz requiere grandes volúmenes de datos. Las implementaciones de RLHF pueden necesitar decenas de miles de comparaciones. Los conjuntos de datos para el ajuste de instrucciones suelen contener cientos de miles de ejemplos en diversas categorías de tareas.

La escala es importante para la generalización. Los conjuntos de datos más grandes y diversos ayudan a los modelos a manejar casos extremos y patrones de consulta inusuales, pero multiplican los costos de anotación proporcionalmente.

Cómo fijan los precios las empresas líderes en los servicios de etiquetado de datos

La industria del etiquetado de datos ha madurado hasta convertirse en un sector multimillonario con actores especializados.

Según análisis del sector, empresas importantes como Scale, Surge, Mercor y Labelbox han experimentado un crecimiento explosivo en sus ingresos. Empresas líderes en IA como OpenAI, Google, Meta y Anthropic invierten cada una alrededor de 1.000 millones de dólares anuales en datos de entrenamiento y retroalimentación proporcionados por humanos para lograr modelos con capacidades competitivas.

Los modelos de precios varían según el proveedor y la complejidad del proyecto:

| Modelo de precios | Mejor para | Rango típico |

|---|---|---|

| Precios por artículo | Tareas de clasificación sencillas | $0.01 – $2.00 por etiqueta |

| Tarifas por hora | Anotación compleja que requiere experiencia. | $15 – $200+ por hora |

| Presupuestos basados en proyectos | Iniciativas a gran escala con alcance definido | $50.000 – $10M+ |

| Contratos de servicios gestionados | Necesidades de etiquetado continuas con acuerdos de nivel de servicio (SLA) de calidad. | Precios personalizados para empresas |

Seamos realistas: las tarifas publicadas rara vez reflejan la realidad completa. Los contratos empresariales incluyen descuentos por volumen, garantías de calidad, plazos de entrega fijos y acceso a herramientas especializadas, factores que influyen en los costes finales.

Comparación práctica de los costes de etiquetado de datos y de cálculo.

La estructura de costes del desarrollo de los másteres en Derecho (LLM) ha cambiado radicalmente.

El preentrenamiento aún consume importantes recursos computacionales. Entrenar modelos de vanguardia con billones de tokens requiere enormes clústeres de GPU que funcionan durante semanas o meses. Pero lo cierto es que los costos computacionales se han vuelto más predecibles y, en términos relativos, más manejables.

Los proveedores de servicios en la nube ofrecen capacidad reservada y contratos a largo plazo que garantizan tarifas fijas. La eficiencia de las GPU sigue mejorando. Técnicas de entrenamiento como la aritmética de precisión mixta y el punto de control de gradiente reducen los requisitos de recursos.

Mientras tanto, el etiquetado de datos se escala de manera diferente. La capacidad humana no se duplica cada 18 meses. La disponibilidad de expertos sigue siendo limitada. El control de calidad no se puede paralelizar infinitamente.

La situación económica se vuelve evidente al analizar los ciclos de desarrollo de modelos específicos. Para los modelos dirigidos a dominios especializados (legal, médico, científico), el alto costo de la experiencia agrava el problema. Encontrar anotadores calificados lleva tiempo. Capacitarlos en las pautas de anotación lleva aún más tiempo. Mantener la coherencia en equipos grandes requiere una gestión sofisticada.

Variaciones de costos según el tipo de tarea de anotación

No todas las tareas de etiquetado tienen el mismo precio.

Etiquetado de preferencias RLHF

El aprendizaje por refuerzo a partir de la retroalimentación humana requiere que los anotadores comparen los resultados del modelo e indiquen sus preferencias. Las tareas incluyen:

- Leer dos o más respuestas modelo a la misma pregunta.

- Evaluación de la calidad en múltiples dimensiones (precisión, utilidad, seguridad, tono)

- Seleccionar la respuesta superior o clasificar varias opciones

- A veces, proporcionar una justificación por escrito de las decisiones.

La complejidad varía enormemente. Los juicios de preferencia simples sobre consultas directas pueden costar entre $2 y 5 por comparación. Las evaluaciones matizadas que requieren conocimientos especializados pueden costar entre $20 y más de 100 por conjunto de comparaciones.

Con conjuntos de datos que requieren entre 50.000 y 200.000 comparaciones, los costes alcanzan rápidamente las seis o siete cifras.

Creación de conjuntos de datos para la optimización de instrucciones

La creación de conjuntos de datos que siguen instrucciones requiere un trabajo diferente. Los anotadores crean:

- Indicaciones diversas que abarcan múltiples categorías de tareas.

- Respuestas de referencia de alta calidad que demuestren el comportamiento deseado.

- Variaciones que abarcan casos excepcionales y diferentes formulaciones.

- Conversaciones de varios turnos que demuestran comprensión del contexto

La creación de pares de instrucciones y respuestas originales y de alta calidad requiere mucho más tiempo que el simple etiquetado de preferencias. En tareas generales, es común encontrar entre $10 y 50 pares de instrucciones. En ámbitos especializados (programación, matemáticas, razonamiento científico), se pueden alcanzar entre $50 y más de 200 ejemplos.

Clasificación y reconocimiento de entidades

Las tareas tradicionales de etiquetado de PLN siguen siendo relevantes para aplicaciones especializadas:

- Reconocimiento de entidades nombradas en textos específicos de un dominio.

- Clasificación de sentimientos con categorías detalladas

- Clasificación de intenciones para sistemas conversacionales

- Extracción de relaciones a partir de documentos no estructurados

Estas tareas generalmente cuestan menos que el ajuste de instrucciones o el RLHF; a menudo entre $0,05 y $2,00 por elemento, dependiendo de la complejidad y la experiencia requerida.

Anotación multimodal

Los modelos de visión-lenguaje necesitan pares de imágenes y texto etiquetados, anotaciones de vídeo y datos de alineación multimodal. La complejidad aumenta con:

- Leyendas de imágenes detalladas que requieren descripciones exhaustivas

- Detección y segmentación de objetos en escenas complejas

- Tareas de comprensión de vídeo que abarcan el razonamiento temporal.

- Anotación 3D para la comprensión espacial

El etiquetado mediante visión artificial tiene su propia estructura de costes, a menudo más elevada que la anotación de texto puro debido a los requisitos de herramientas especializadas y a la carga cognitiva que supone.

Estrategias para reducir los costos del etiquetado de datos LLM

Los equipos inteligentes optimizan los presupuestos de anotación sin sacrificar la calidad.

Aprendizaje activo y anotación selectiva

¿Para qué etiquetarlo todo si los modelos pueden identificar sus propios puntos débiles?

Los marcos de aprendizaje activo consultan el modelo para encontrar ejemplos donde existe mayor incertidumbre o donde la información adicional aportaría el máximo valor. Esto permite concentrar el esfuerzo de anotación donde más importa, reduciendo potencialmente el volumen de etiquetado entre 50 y 801 TP3T, manteniendo un rendimiento comparable del modelo.

El artículo de arXiv sobre la anotación en línea de conjuntos de datos basada en LLM con conciencia de costes explora cómo los sistemas automatizados pueden seleccionar estratégicamente qué ejemplos requieren etiquetado humano, equilibrando las restricciones de costes con los objetivos de calidad.

Anotación asistida por LLM

Los modelos de lenguaje grandes pueden impulsar el proceso de etiquetado. Los flujos de trabajo incluyen:

- Utilizar GPT-4 o Claude para generar etiquetas iniciales

- Los revisores humanos validan y corrigen los resultados de LLM.

- Concentrar el tiempo de los expertos en casos difíciles o en el control de calidad.

- Creación de mecanismos de consenso entre el LLM y los juicios humanos.

Este enfoque puede reducir los costos entre 40 y 701 TP3T en comparación con la anotación humana completa, manteniendo los estándares de calidad, aunque una validación cuidadosa sigue siendo esencial para detectar errores sistemáticos de LLM.

Flujos de trabajo de etiquetado por niveles

Adaptar la experiencia del anotador a la complejidad de la tarea:

- Los etiquetadores junior manejan casos sencillos a tarifas más bajas.

- Los anotadores sénior abordan ejemplos ambiguos o complejos.

- Los expertos en la materia se centran exclusivamente en contenido especializado.

- Los controles de calidad automatizados dirigen los artículos a los niveles apropiados.

Una orquestación sofisticada maximiza la rentabilidad al tiempo que preserva la calidad en los elementos que realmente requieren atención experta.

Reutilización de conjuntos de datos y aumento sintético

No es necesario que todos los proyectos nuevos comiencen desde cero. Las organizaciones pueden:

- Cree conjuntos de datos básicos una sola vez y reutilícelos en múltiples iteraciones del modelo.

- Adquiera licencias para conjuntos de datos de alta calidad existentes cuando estén disponibles.

- Generar variaciones sintéticas de ejemplos etiquetados

- Compartir conjuntos de datos entre proyectos relacionados dentro de la organización.

Pero cuidado: la concesión de licencias de conjuntos de datos puede resultar costosa a medida que los proveedores reconocen el valor estratégico de los datos. Acuerdos recientes entre laboratorios de IA y proveedores de contenido han alcanzado cientos de millones de dólares por el acceso a fuentes de texto propietarias.

Reduzca el gasto innecesario en etiquetas antes de entrenar.

La calidad de los datos es donde la mayoría de los costos de LLM aumentan silenciosamente. Corregir problemas de etiquetado después del entrenamiento es costoso, y los conjuntos de datos mal preparados conducen a más iteraciones, no a mejores modelos. Aquí es donde IA superior Por lo general, encaja perfectamente, no como proveedor de etiquetado, sino como la capa que garantiza que el etiquetado se traduzca realmente en un rendimiento útil del modelo.

Gestionan la recopilación, limpieza y preprocesamiento de datos como parte del proceso del modelo, de modo que los conjuntos de datos se estructuran para el entrenamiento desde el principio, sin necesidad de parches posteriores. Esto incluye alinear los datos con el caso de uso, reducir el ruido y prepararlos para flujos de trabajo de ajuste fino que no desperdicien recursos computacionales ni presupuesto. Si sus costos de etiquetado siguen aumentando, pero la calidad del modelo no, el problema suele estar en la fase anterior. Solucione el problema del proceso antes de escalarlo: póngase en contacto con IA superior y obtener claridad sobre qué es lo que realmente está impulsando sus costos.

Implicaciones estratégicas para el desarrollo de la IA

Los costes del etiquetado de datos transforman la forma en que las organizaciones abordan el desarrollo de modelos de aprendizaje permanente (LLM).

Las empresas más pequeñas se enfrentan a una realidad compleja. Sin recursos para financiar proyectos de anotación a gran escala, competir con laboratorios bien financiados se vuelve difícil. Esto genera una posible presión de consolidación en la industria de la IA: quienes cuentan con mayores recursos económicos pueden permitirse mejores conjuntos de datos y, por consiguiente, mejores modelos.

La economía también favorece ciertas decisiones arquitectónicas. Los modelos de lenguaje pequeños (SLM, por sus siglas en inglés), con entre 1 y 15 mil millones de parámetros, requieren menos datos de entrenamiento y pueden lograr un rendimiento sólido en dominios específicos. Mientras que los LLM de vanguardia cuestan más de 100 millones de dólares para entrenar, los SLM reducen el costo por millón de consultas en más de 100 veces y requieren presupuestos de anotación proporcionalmente menores para el ajuste fino.

Cada vez más, las organizaciones evalúan las decisiones de desarrollar internamente o adquirir soluciones desde una perspectiva basada en datos. Optimizar los modelos base existentes suele ser más rentable que entrenarlos desde cero: básicamente, se pagan los costos de anotación sin el elevado costo computacional del preentrenamiento.

Esto ha acelerado la adopción del ajuste fino. Según el análisis de los patrones de implementación de modelos, el ajuste fino puede ahorrar entre 60 y 90 TP3T en comparación con el preentrenamiento completo, al tiempo que se logra un rendimiento comparable en tareas específicas.

| Acercarse | Calcular costo | Costo del etiquetado de datos | Mejor para |

|---|---|---|---|

| Preentrenamiento desde cero | $50M – $200M+ | Mínimo (sin supervisión) | Desarrollo de modelos de frontera |

| Ajuste fino del modelo fundamental | $10K – $1M | $50K – $15M | especialización de dominio |

| Ingeniería inmediata únicamente | Casi cero | $5K – $50K (ejemplos de pocas tomas) | Prototipado rápido, tareas sencillas |

| Entrenamiento con modelos pequeños | $5K – $500K | $10K – $500K | Implementación en el borde, aplicaciones sensibles al costo |

Tendencias del sector y perspectivas de futuro

¿Qué sucederá a continuación con la economía del etiquetado de datos?

Es probable que las tasas de crecimiento se moderen tras el extraordinario aumento de 88 veces observado entre 2023 y 2024. Gran parte de ese repunte se debió a la rápida expansión de empresas específicas como Mercor. Sin embargo, las cifras absolutas en dólares siguen aumentando a medida que más organizaciones impulsan el desarrollo de programas de Maestría en Derecho (LLM) y los laboratorios existentes perfeccionan sus modelos.

Las líneas de investigación que podrían cambiar la economía incluyen:

- Mecanismos de verificación automatizados: Si los modelos pueden autoevaluarse de forma fiable o si surgen métodos de verificación económicos, el coste de generar grandes conjuntos de datos etiquetados podría reducirse sustancialmente. Esta sigue siendo un área de investigación activa.

- Modelos de recompensa que toleran datos ruidosos: Las implementaciones actuales de RLHF requieren etiquetas de preferencia de alta calidad. Las técnicas que funcionan con etiquetas de menor calidad o parcialmente automatizadas reducirían los costos.

- Inteligencia artificial constitucional y técnicas de automejora: Los métodos en los que los modelos mejoran mediante la autocrítica y la revisión podrían reducir la dependencia de la anotación humana.

- Mayor eficiencia de los datos: Se siguen realizando investigaciones para extraer más valor de los datos menos etiquetados mediante la mejora de los algoritmos y las técnicas de entrenamiento.

La pregunta que se plantea el sector es: ¿puede la automatización compensar las crecientes exigencias de calidad y la expansión de los casos de uso?

Los debates en foros profesionales ponen de manifiesto cómo el etiquetado de datos se ha convertido en un verdadero cuello de botella en el desarrollo de la IA. Las organizaciones informan de que dedican meses a reclutar y capacitar equipos de anotadores. Las inconsistencias en la calidad provocan retrasos en los proyectos. La disponibilidad de expertos limita los plazos de los proyectos más que la planificación de la computación.

Planificación práctica de costes para proyectos de máster en Derecho (LLM)

Los equipos que planifican iniciativas de gestión del aprendizaje automático deben presupuestar de forma realista el etiquetado de datos.

Para un proyecto de escala media que apunte a la mejora de un dominio específico:

- Conjunto de datos RLHF (20.000 comparaciones, complejidad moderada): $100K – $400K

- Conjunto de datos de ajuste de instrucciones (10.000 ejemplos, dominio general): $80K – $300K

- Garantía de calidad y validación (20% de datos): $36K – $140K

- Gestión de proyectos y herramientas: $25K – $100K

Presupuesto total de anotaciones: $241K – $940K

El ajuste fino del cálculo para el mismo proyecto podría costar entre $50K y $200K. Los costos de anotación son los predominantes, tal como predicen los datos de la industria.

Para iniciativas de mayor envergadura que buscan capacidades de vanguardia, los presupuestos se ajustan en consecuencia. Los proyectos con más de 100 000 ejemplos etiquetados y requisitos de anotadores expertos alcanzan fácilmente entre 1 y 15 millones de dólares solo en costos de etiquetado.

Cómo elegir proveedores de etiquetado de datos

Seleccionar el socio de anotación adecuado influye significativamente tanto en el coste como en la calidad.

Los criterios de evaluación deben incluir:

- Historial de calidad: Solicita estudios de caso y referencias de clientes que trabajen en tareas similares. Pregunta sobre los índices de precisión alcanzados y los mecanismos de control de calidad.

- Experiencia del anotador: Verifique que el proveedor tenga acceso a expertos en el área temática relevante para el proyecto. Las plataformas genéricas de crowdsourcing tienen dificultades con el contenido especializado.

- Capacidades de las herramientas: Las plataformas de anotación modernas ofrecen funciones de eficiencia que reducen los costes por elemento: enrutamiento inteligente de tareas, controles de calidad automatizados, funciones de colaboración e integración con sistemas de aprendizaje automático.

- Escalabilidad: ¿Puede el proveedor aumentar su capacidad para gestionar picos de demanda? ¿Cuentan con la plantilla suficiente para proyectos grandes o urgentes?

- Seguridad y cumplimiento: Para datos confidenciales, verifique las certificaciones adecuadas, los protocolos de manejo de datos y las protecciones contractuales.

- Transparencia en los precios: Desconfía de los proveedores que no hablan de precios hasta que el proceso de venta está muy avanzado. La previsibilidad de los costes es fundamental para la planificación del proyecto.

Los principales proveedores del sector han desarrollado flujos de trabajo especializados optimizados para datos de entrenamiento de LLM. Según los recursos de Scale AI, cuentan con grandes equipos de etiquetado altamente capacitados y herramientas propias diseñadas específicamente para casos de uso de aprendizaje automático.

Agenda de investigación en economía de datos

Los investigadores académicos y de la industria están empezando a tratar los datos como un campo económico propio.

Un artículo de investigación publicado en arXiv (The Economics of AI Training Data) señala que, a pesar del papel fundamental de los datos en la producción de IA, siguen siendo el insumo menos comprendido. A medida que los laboratorios de IA agotan los datos públicos y recurren a fuentes propietarias mediante acuerdos que alcanzan cientos de millones de dólares, la investigación se ha fragmentado entre la informática, la economía, el derecho y las políticas públicas.

Entre las principales cuestiones abiertas se incluyen:

- ¿Cómo deberían valorarse los datos como un factor de producción diferenciado?

- ¿Qué estructuras de mercado surgirán para el intercambio de datos de formación?

- ¿Cómo afectan los regímenes de propiedad intelectual a la disponibilidad y el coste de los datos?

- ¿Cuáles son las implicaciones para el bienestar de la concentración de datos?

- ¿Existen mecanismos que garanticen una compensación justa para los creadores de datos?

Estas no son meras preocupaciones teóricas. Afectan directamente a quién puede permitirse construir sistemas de IA competitivos y a las capacidades de dichos sistemas.

El cambio de los cuellos de botella computacionales a los cuellos de botella de datos representa una transformación fundamental en la economía de la IA. Es más difícil aumentar la experiencia humana que añadir más GPU. Es más difícil automatizar juicios complejos que paralelizar multiplicaciones de matrices.

Esta realidad marcará el rumbo de la industria de la IA durante los próximos años.

Preguntas frecuentes

¿Cuánto cuesta el etiquetado de datos para un proyecto típico de ajuste fino de LLM?

Los costos de etiquetado de datos para el ajuste fino de LLM varían ampliamente según la complejidad de la tarea y el tamaño del conjunto de datos. Un proyecto de escala moderada con 20 000 a 30 000 ejemplos etiquetados suele costar entre $200 000 y $900 000. Las tareas de clasificación simples en el extremo inferior pueden costar entre $0,05 y $2 por elemento, mientras que las comparaciones RLHF complejas que requieren experiencia en el dominio pueden costar entre $20 y $100+ por comparación. La anotación experta para dominios especializados (médico, legal, científico) tiene tarifas premium de entre $50 y $200+ por hora.

¿Por qué los costes de etiquetado de datos han crecido más rápido que los costes de computación?

Los costos de etiquetado de datos se multiplicaron por 88 entre 2023 y 2024, mientras que los costos de computación aumentaron solo un 1,3%. Esta drástica diferencia se debe a que las técnicas posteriores al entrenamiento (RLHF, ajuste fino supervisado) se han vuelto esenciales para los modelos competitivos. Estos métodos requieren una extensa anotación humana, a menudo por parte de expertos en la materia. Mientras tanto, la eficiencia de las GPU continúa mejorando y los proveedores de servicios en la nube ofrecen tarifas más competitivas, lo que mantiene los costos de computación relativamente estables incluso cuando los gastos de etiquetado se disparan.

¿Pueden los sistemas de gestión del aprendizaje automático automatizar el etiquetado de sus datos para reducir costes?

Los modelos de lenguaje natural (LLM) pueden ayudar con el etiquetado, pero no lo automatizan por completo sin comprometer la calidad. Los enfoques comunes incluyen el uso de GPT-4 o Claude para generar etiquetas iniciales, y la posterior validación de los resultados por revisores humanos. Este enfoque híbrido puede reducir los costos entre 40 y 701 TP3T en comparación con la anotación humana completa. Sin embargo, un control de calidad riguroso sigue siendo esencial, ya que los LLM pueden introducir errores o sesgos sistemáticos. El artículo de arXiv sobre anotación con conciencia de costos explora marcos para equilibrar de manera óptima el etiquetado automatizado con LLM frente a los costos de verificación humana.

¿Qué es más caro: entrenar un modelo LLM desde cero o perfeccionar un modelo existente?

El preentrenamiento de modelos de vanguardia desde cero cuesta entre 50 y 200 millones de TP, principalmente en computación, mientras que el ajuste fino de modelos existentes suele costar entre 10 000 y 1 millón de TP en computación. Sin embargo, el ajuste fino requiere presupuestos sustanciales para el etiquetado de datos, a menudo entre 50 000 y 15 millones de TP, dependiendo del tamaño del conjunto de datos y la complejidad de la tarea. A pesar de los mayores costos de anotación, el ajuste fino aún ofrece un ahorro de costos general de entre 60 y 90 TP en comparación con el preentrenamiento, al tiempo que logra un sólido rendimiento específico para la tarea. Para la mayoría de las organizaciones, el ajuste fino tiene más sentido económico.

¿Cómo se comparan los modelos de lenguaje pequeños (SLM, por sus siglas en inglés) con los modelos de lenguaje largos (LLM, por sus siglas en inglés) en cuanto a coste?

Los SLM con entre 1 y 15 mil millones de parámetros reducen drásticamente los costos de entrenamiento e inferencia. El entrenamiento de los SLM cuesta entre 5.000 y 500.000 TP4T en computación, frente a entre 50 y más de 200 millones de TP4T para los LLM de vanguardia. Los requisitos de etiquetado de datos se reducen proporcionalmente, generalmente entre 10.000 y 500.000 TP4T para dominios específicos. Los SLM reducen el costo por millón de consultas en más de 100 veces en comparación con los modelos grandes. Para aplicaciones con un alcance específico y escenarios de implementación en el borde, los SLM ofrecen ventajas de costos significativas, manteniendo una precisión aceptable en las tareas objetivo.

¿Qué estrategias permiten reducir eficazmente los costes de etiquetado de datos sin sacrificar la calidad?

Varias estrategias probadas reducen los costos manteniendo la calidad: el aprendizaje activo reduce el volumen de etiquetado entre 50 y 80% al identificar ejemplos donde la anotación proporciona el máximo valor. Los flujos de trabajo asistidos por LLM utilizan modelos para generar etiquetas iniciales, con validaciones humanas de los resultados, lo que reduce los costos entre 40 y 70%. Los flujos de trabajo por niveles hacen coincidir la experiencia del anotador con la dificultad de la tarea, reservando a los expertos más costosos para los casos realmente complejos. La reutilización de conjuntos de datos amortiza la inversión en anotación en múltiples proyectos. El muestreo selectivo de alta calidad a menudo supera a los conjuntos de datos más grandes y de menor calidad para el ajuste fino.

¿Seguirán aumentando los costes del etiquetado de datos al ritmo actual?

Es probable que el extraordinario crecimiento de 88 veces entre 2023 y 2024 se modere, ya que gran parte de ese repunte reflejó una rápida expansión en empresas específicas. Sin embargo, los costos absolutos de etiquetado continúan aumentando a medida que más organizaciones buscan desarrollar modelos de aprendizaje automático y se elevan los estándares de calidad. Los expertos de la industria prevén que el etiquetado de datos seguirá siendo el principal costo marginal para los modelos de vanguardia hasta 2026 y más allá. La investigación en verificación automatizada, entrenamiento tolerante al ruido y técnicas de autoaprendizaje podría reducir eventualmente la dependencia de la costosa anotación humana, pero aún no han surgido soluciones revolucionarias a gran escala.

Conclusión

La economía del desarrollo de los másteres en Derecho ha cambiado radicalmente.

Lo que antes era un campo dominado por la computación, ahora ve cómo la anotación humana consume la mayor parte de los presupuestos marginales. Los costos de etiquetado de datos se han multiplicado por 88 en un solo año, mientras que los gastos de computación aumentaron solo 1,3 veces. Para las organizaciones que desarrollan o ajustan modelos, la anotación ahora representa aproximadamente el triple del gasto marginal en computación.

Esto no es una anomalía temporal. Las técnicas posteriores al entrenamiento que requieren retroalimentación humana han demostrado ser esenciales para crear modelos que funcionen de manera confiable en producción. El aprendizaje por refuerzo de largo alcance (RLHF), el ajuste de instrucciones y el ajuste fino especializado dependen de conjuntos de datos cuidadosamente seleccionados y etiquetados por expertos. El tiempo de los expertos cuesta dinero, mucho dinero.

Los estudios de caso lo demuestran claramente. MiniMax-M1 gastó 28 veces más en anotaciones que en computación para el entrenamiento. El presupuesto de etiquetado de SkyRL-SQL fue 167 veces mayor que sus costos de computación. Estas proporciones reflejan la nueva normalidad en el desarrollo de la IA.

Los equipos inteligentes optimizan los presupuestos de anotación mediante el aprendizaje activo, los flujos de trabajo asistidos por LLM y las estrategias de etiquetado por niveles. Pero es innegable la realidad fundamental: para crear LLM competitivos se requiere una gran inversión en datos etiquetados manualmente de alta calidad.

Para las organizaciones que planean proyectos de maestría en derecho (LLM) en 2026, presupuesten en consecuencia. El etiquetado de datos probablemente representará entre 45 y 601 TP3T del costo total del proyecto para iniciativas importantes. Colaboren con proveedores de anotación experimentados, inviertan en control de calidad y planifiquen plazos más largos de lo que sugieren las estimaciones basadas únicamente en cálculos.

El cuello de botella se ha desplazado del silicio a la experiencia humana. Comprender este cambio —y planificar sus implicaciones financieras— es lo que distingue a las iniciativas de máster en derecho (LLM) exitosas de los fracasos por falta de financiación.

¿Necesitas ayuda para planificar tu presupuesto de etiquetado de datos para LLM? Para comprender los costos reales de la anotación, es necesario analizar tu caso de uso específico, los requisitos de calidad y la escala del proyecto. Contacta con proveedores experimentados para obtener estimaciones precisas antes de comprometer recursos.