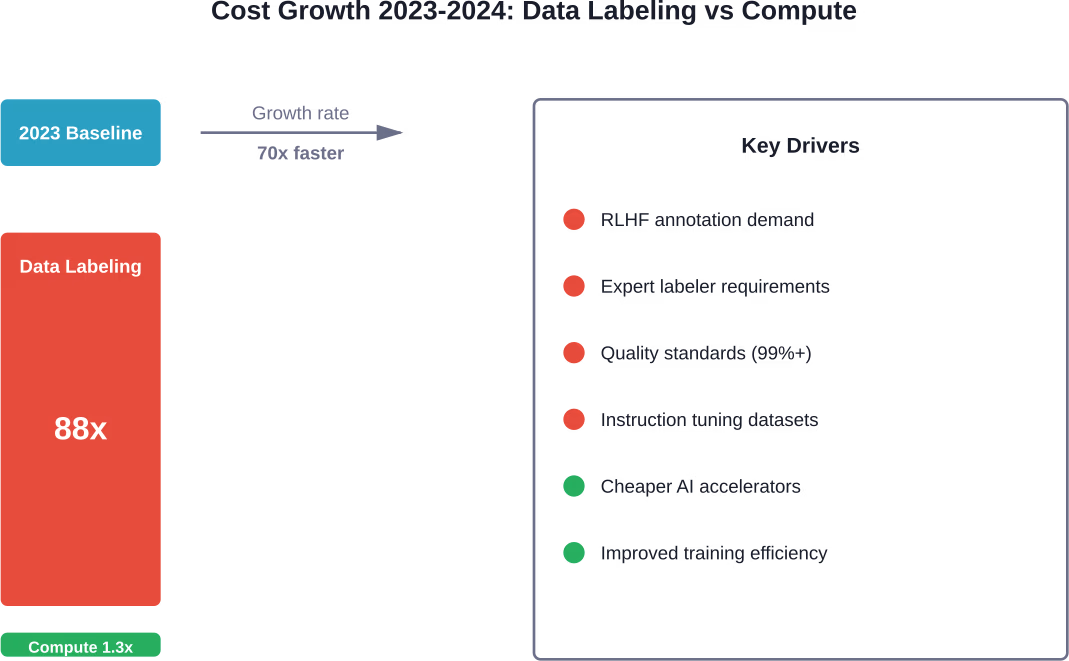

Kurzzusammenfassung: Die Kosten für die Datenkennzeichnung im Bereich LLM sind dramatisch gestiegen: Während die Brancheneinnahmen von 2023 bis 2024 um das 88-Fache zunahmen, stiegen die Rechenkosten lediglich um das 1,3-Fache. Die manuelle Annotation nach dem Training (RLHF, Optimierung der Instruktionen) kostet mittlerweile etwa dreimal so viel wie die zusätzlichen Rechenkosten für Spitzenmodelle. Die Kosten für die Expertenkennzeichnung eines einzelnen Projekts können zwischen 60.000 und 14 Millionen PKR liegen, wodurch die Datenkennzeichnung zum zunehmenden Engpass in der KI-Entwicklung wird.

Die gängige Meinung über die Kosten von KI ist falsch.

Jahrelang dominierte die Rechenleistung die Diskussionen um die Trainingskosten von LLM-Systemen. GPUs, Cloud-Infrastruktur, Strom – das waren die üblichen Verdächtigen, wenn es um die hohen Kosten von KI ging. Laut Quellen aus der Konkurrenz kostete das Training von GPT-4 schätzungsweise 1,4 Milliarden US-Dollar, während Gemini Ultra 1.0 sogar 1,4 Milliarden US-Dollar kostete.

Aber Folgendes hat sich geändert: Die Datenkennzeichnung hat die Rechenleistung stillschweigend als primären Grenzkostentreiber für Frontier-Modelle abgelöst.

Aktuelle Analysen zeigen, dass die Umsätze führender Datenkennzeichnungsunternehmen zwischen 2023 und 2024 um das 88-Fache gestiegen sind, während die Kosten für das Training nur um das 1,3-Fache zunahmen. Als Forscher die jährlichen Umsätze von Scale, Surge, Mercor, Labelbox und ähnlichen Firmen berechneten und diese mit den zusätzlichen Rechenkosten für Modelle wie GPT-4o, Claude Sonnet-3.5, Mistral-Large, Grok-2 und Llama-3-405B verglichen, ergab sich ein eindeutiges Bild: Die Kosten für die Kennzeichnung sind mittlerweile etwa dreimal so hoch wie die zusätzlichen Rechenkosten.

Diese Entwicklung verdeutlicht, wie moderne LLMs ihre Leistungsfähigkeit erreichen. Nachbearbeitungstechniken wie überwachtes Feinabstimmen (SFT) und bestärkendes Lernen durch menschliches Feedback (RLHF) sind unerlässlich geworden, um Modelle zu erstellen, die tatsächlich im Produktiveinsatz funktionieren. Im Gegensatz zum Vortraining mit unstrukturierten Internetdaten benötigen diese Methoden sorgfältig kuratierte Datensätze, die von Menschen – oft Fachexperten – erstellt wurden.

Und die Zeit von Experten ist nicht billig.

Die wahren Zahlen hinter den Kosten für die Datenkennzeichnung im LLM-Bereich

Fallstudien verdeutlichen, wie teuer die manuelle Annotation geworden ist.

Nehmen wir MiniMax-M1, das weniger als $1 Million Rechenleistung benötigte, um die Qualität von Claude-Opus-4 zu erreichen. Oder betrachten wir SkyRL-SQL, das die Leistung von GPT-4o bei Text-zu-SQL-Aufgaben mit nur $360 Trainingsrechenleistung erreichte.

Das sind keine Ausreißer. Sie repräsentieren die neue Ökonomie der LLM-Entwicklung.

Laut dem maßgeblichen Leitfaden von Scale AI zur Datenkennzeichnung erfordert die Erzielung einer extrem hohen Qualität (99%+) bei großen Datensätzen einen großen Personalaufwand (über 1.000 Datenkennzeichner pro Projekt). Spezialisierte Unternehmen liefern mit hochqualifizierten Mitarbeitern und ausgefeilten automatisierten Arbeitsabläufen zwar qualitativ hochwertige Kennzeichnungen, doch die Kosten sind relativ, wenn menschliches Fachwissen den Prozess bestimmt.

Was treibt die Kosten für die Datenkennzeichnung im LLM-Bereich an?

Mehrere Faktoren tragen gemeinsam zu den höheren Annotationskosten bei.

Abhängigkeit nach dem Training

Moderne LLMs funktionieren nicht direkt nach dem Vortraining. Sie müssen durch überwachtes Feintuning und Reinforcement-Learning-Verfahren optimiert werden. Diese Prozesse benötigen unbedingt von Menschen annotierte Daten – vorzugsweise von Experten, die differenzierte Bewertungskriterien verstehen.

Eine Forschungsarbeit zur kostenbewussten Annotation von Datensätzen mithilfe von LLM (arXiv:2505.15101) zeigt auf, wie jüngste Fortschritte bei großen Sprachmodellen die automatisierte Kennzeichnung ermöglicht haben, die menschliche Überprüfung jedoch weiterhin für die Qualitätssicherung unerlässlich ist. Das Spannungsverhältnis zwischen Automatisierungspotenzial und Qualitätsanforderungen führt zu hohen Kosten.

Anforderungen an erfahrene Etikettierer

Nicht jeder kann LLM-Schulungsdaten effektiv kennzeichnen. Unterschiedliche Aufgaben erfordern unterschiedliche Fachkenntnisse:

- Einfache Klassifizierungsaufgaben könnten mit allgemeiner Crowdsourcing-Arbeit durchgeführt werden.

- Die Codeauswertung erfordert erfahrene Softwareentwickler.

- Für die Beantwortung medizinischer Anfragen sind Fachspezialisten mit entsprechenden Qualifikationen erforderlich.

- Aufgaben im Bereich des juristischen Denkens erfordern echte Juristen.

- Zur Überprüfung mathematischer Probleme werden Fachexperten benötigt.

Die Stundensätze von Experten spiegeln ihr Fachwissen wider. Domänenspezialisten, die 50–200+ £ pro Stunde verlangen, verändern die Wirtschaftlichkeit eines Projekts im Vergleich zu einfachen Beschriftungsfachkräften mit 10–15 £ pro Stunde erheblich.

Qualitätsstandards und mehrstufige Überprüfung

Um eine Annotationsgenauigkeit von 99%+ zu erreichen, ist eine mehrstufige Qualitätskontrolle erforderlich. Branchenübliche Arbeitsabläufe umfassen häufig Folgendes:

- Erste Kennzeichnung durch geschulte Annotatoren

- Zweite Prüfung durch erfahrene Etikettierer

- Stichproben durch Fachexperten

- Konsensmechanismen für mehrdeutige Fälle

- Kontinuierliche Qualitätsüberwachung und Feedbackschleifen

Jede zusätzliche Ebene verursacht zwar Kosten, erweist sich aber für produktionsreife Datensätze als notwendig.

Anforderungen an die Skalierung des Datensatzes

Effektives Post-Training erfordert erhebliche Datenmengen. RLHF-Implementierungen benötigen möglicherweise Zehntausende von Vergleichsurteilen. Datensätze zur Optimierung von Instruktionen enthalten oft Hunderttausende von Beispielen aus verschiedenen Aufgabenkategorien.

Für die Generalisierbarkeit ist der Umfang entscheidend. Größere und vielfältigere Datensätze helfen Modellen, Grenzfälle und ungewöhnliche Abfragemuster zu bewältigen – allerdings vervielfachen sie die Annotationskosten proportional.

Wie führende Unternehmen Datenkennzeichnungsdienste bepreisen

Die Datenkennzeichnungsbranche hat sich zu einem milliardenschweren Sektor mit spezialisierten Anbietern entwickelt.

Branchenanalysen zufolge haben große Unternehmen wie Scale, Surge, Mercor und Labelbox ein explosionsartiges Umsatzwachstum verzeichnet. Führende KI-Unternehmen wie OpenAI, Google, Meta und Anthropic investieren jährlich jeweils rund 1,4 Billionen US-Dollar in von Menschen bereitgestellte Trainingsdaten und Feedback, um wettbewerbsfähige Modelle zu entwickeln.

Die Preismodelle variieren je nach Anbieter und Projektkomplexität:

| Preismodell | Am besten geeignet für | Typischer Bereich |

|---|---|---|

| Preisgestaltung pro Artikel | Einfache Klassifizierungsaufgaben | $0.01 – $2.00 pro Etikett |

| Stundensätze | Komplexe Annotationen, die Fachkenntnisse erfordern | $15 – $200+ pro Stunde |

| Projektbezogene Angebote | Groß angelegte Initiativen mit definiertem Umfang | $50.000 – $10M+ |

| Managed-Service-Verträge | Laufender Etikettierungsbedarf mit Qualitäts-SLAs | Individuelle Unternehmenspreise |

Mal ehrlich: Veröffentlichte Preise sagen selten alles aus. Verträge mit Großunternehmen beinhalten Mengenrabatte, Qualitätsgarantien, Zusagen zu Lieferzeiten und den Zugang zu Spezialwerkzeugen – all das beeinflusst die Endkosten.

Vergleich der Kosten für Datenkennzeichnung und Rechenleistung in der Praxis

Die Kostenstruktur der LLM-Ausbildung hat sich grundlegend verändert.

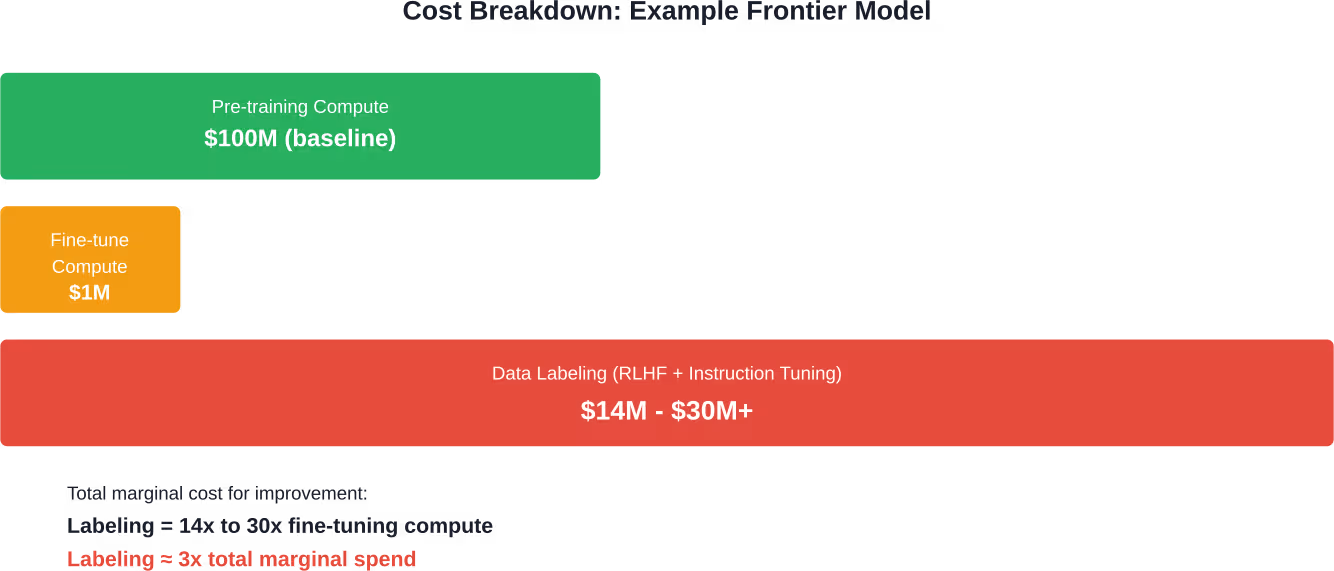

Das Vortraining beansprucht nach wie vor erhebliche Rechenressourcen. Das Training von Spitzenmodellen mit Billionen von Token erfordert massive GPU-Cluster, die wochen- oder monatelang laufen. Aber der entscheidende Punkt ist: Die Rechenkosten sind besser vorhersehbar und, relativ gesehen, besser zu handhaben geworden.

Cloud-Anbieter bieten reservierte Kapazitäten und langfristige Verträge mit festen Preisen. Die GPU-Effizienz verbessert sich stetig. Trainingsmethoden wie Mixed-Precision-Arithmetik und Gradienten-Checkpointing reduzieren den Ressourcenbedarf.

Die Datenkennzeichnung hingegen skaliert anders. Die menschliche Kapazität verdoppelt sich nicht alle 18 Monate. Die Verfügbarkeit von Experten bleibt begrenzt. Die Qualitätskontrolle lässt sich nicht unendlich parallelisieren.

Die wirtschaftlichen Auswirkungen werden deutlich, wenn man spezifische Modellentwicklungszyklen betrachtet. Bei Modellen für spezialisierte Bereiche (Recht, Medizin, Wissenschaft) verschärft der hohe Aufwand für Experten das Problem. Die Suche nach qualifizierten Annotatoren ist zeitaufwendig. Ihre Schulung in Annotationsrichtlinien benötigt noch mehr Zeit. Die Gewährleistung einheitlicher Standards in großen Teams erfordert ein ausgefeiltes Management.

Kostenunterschiede nach Art der Annotationsaufgabe

Nicht alle Etikettierungsaufgaben haben den gleichen Preis.

RLHF-Präferenzkennzeichnung

Beim bestärkenden Lernen durch menschliches Feedback müssen Annotatoren die Modellausgaben vergleichen und Präferenzen angeben. Zu den Aufgaben gehören:

- Lesen von zwei oder mehr Musterantworten auf dieselbe Aufforderung

- Qualitätsbewertung anhand mehrerer Dimensionen (Genauigkeit, Nützlichkeit, Sicherheit, Tonfall)

- Die beste Antwort auswählen oder mehrere Optionen bewerten

- Manchmal ist eine schriftliche Begründung für Entscheidungen erforderlich.

Die Komplexität variiert stark. Einfache Präferenzbewertungen bei unkomplizierten Anfragen können $2-5 pro Vergleich kosten. Differenzierte Bewertungen, die Domänenexpertise erfordern, können $20-100+ pro Vergleichsset erfordern.

Bei Datensätzen, die 50.000 bis 200.000 Vergleiche erfordern, erreichen die Kosten schnell sechs- oder siebenstellige Beträge.

Erstellung eines Datensatzes zur Befehlsoptimierung

Das Erstellen von Datensätzen zum Befolgen von Anweisungen erfordert andere Arbeitsschritte. Annotatoren erstellen:

- Diverse Aufgabenstellungen aus verschiedenen Aufgabenkategorien

- Hochwertige Referenzantworten, die das gewünschte Verhalten demonstrieren

- Varianten, die Sonderfälle und unterschiedliche Formulierungen abdecken

- Mehrrundengespräche, die kontextuelles Verständnis zeigen

Die Erstellung origineller, qualitativ hochwertiger Befehls-Antwort-Paare ist deutlich zeitaufwändiger als die einfache Präferenzkennzeichnung. Bei allgemeinen Aufgaben sind Raten von $10–50 pro Befehlspaar üblich. Spezialisierte Bereiche (Programmierung, Mathematik, wissenschaftliches Denken) können $50–200+ pro Beispiel erfordern.

Klassifizierung und Entitätserkennung

Traditionelle NLP-Kennzeichnungsaufgaben bleiben für spezielle Anwendungen relevant:

- Erkennung benannter Entitäten in domänenspezifischen Texten

- Stimmungsanalyse mit fein abgestuften Kategorien

- Absichtsklassifizierung für Konversationssysteme

- Beziehungsextraktion aus unstrukturierten Dokumenten

Diese Aufgaben sind in der Regel günstiger als RLHF- oder Instruktionsabstimmungen – oft $0.05-$2.00 pro Element, abhängig von Komplexität und erforderlichem Fachwissen.

Multimodale Annotation

Bild-Sprach-Modelle benötigen annotierte Bild-Text-Paare, Videoannotationen und Daten zur modalitätsübergreifenden Ausrichtung. Die Komplexität steigt mit:

- Detaillierte Bildunterschriften, die umfassende Beschreibungen erfordern

- Objekterkennung und -segmentierung in komplexen Szenen

- Aufgaben zum Videoverständnis, die zeitliches Denken umfassen

- 3D-Annotation zum räumlichen Verständnis

Die computergestützte Bildverarbeitung hat ihre eigene Kostenstruktur, die aufgrund des Bedarfs an speziellen Werkzeugen und der kognitiven Belastung oft höher ist als bei der reinen Textannotation.

Strategien zur Reduzierung der Kosten für die Datenkennzeichnung im LLM-Bereich

Intelligente Teams optimieren die Budgets für Annotationen, ohne dabei die Qualität zu beeinträchtigen.

Aktives Lernen und selektive Annotation

Warum alles etikettieren, wenn Modelle ihre eigenen Schwächen erkennen können?

Frameworks für aktives Lernen nutzen Abfragen im Modell, um Beispiele zu finden, in denen die Unsicherheit am größten ist oder zusätzliche Daten den größten Nutzen bringen würden. Dadurch wird der Annotationsaufwand gezielt dort konzentriert, wo er am wichtigsten ist, und das Annotationsvolumen potenziell um 50–801 Tsd. Billionen reduziert, während die Modellleistung vergleichbar bleibt.

Der arXiv-Artikel über kostenbewusste LLM-basierte Online-Datensatzannotation untersucht, wie automatisierte Systeme strategisch auswählen können, welche Beispiele eine menschliche Kennzeichnung erfordern, und dabei Kostenbeschränkungen mit Qualitätszielen in Einklang bringen.

LLM-gestützte Annotation

Große Sprachmodelle können den Labeling-Prozess beschleunigen. Arbeitsabläufe umfassen:

- Verwendung von GPT-4 oder Claude zur Generierung von Anfangsbezeichnungen

- Menschliche Gutachter überprüfen und korrigieren die Ergebnisse des LLM-Programms.

- Die Expertise auf schwierige Fälle oder die Qualitätssicherung konzentrieren

- Aufbau von Konsensmechanismen zwischen LLM und menschlichen Urteilen

Mit diesem Ansatz lassen sich die Kosten im Vergleich zur vollständigen manuellen Annotation um 40-70% senken, während gleichzeitig die Qualitätsstandards erhalten bleiben. Eine sorgfältige Validierung ist jedoch unerlässlich, um systematische LLM-Fehler aufzudecken.

Gestufte Etikettierungs-Workflows

Passen Sie die Expertise der Annotatoren der Aufgabenkomplexität an:

- Junior-Etikettierer bearbeiten unkomplizierte Fälle zu niedrigeren Tarifen.

- Erfahrene Kommentatoren bearbeiten mehrdeutige oder schwierige Beispiele.

- Domänenexperten konzentrieren sich ausschließlich auf spezialisierte Inhalte.

- Automatisierte Qualitätskontrollen leiten Artikel an die entsprechenden Stufen weiter.

Durch eine ausgeklügelte Orchestrierung wird die Kosteneffizienz maximiert, während gleichzeitig die Qualität bei Artikeln erhalten bleibt, die wirklich fachmännische Aufmerksamkeit erfordern.

Wiederverwendung von Datensätzen und synthetische Erweiterung

Nicht jedes neue Projekt muss bei Null anfangen. Organisationen können:

- Erstellen Sie die Kerndatensätze einmalig und verwenden Sie sie in mehreren Modelliterationen wieder.

- Lizenzieren Sie vorhandene, qualitativ hochwertige Datensätze, sofern verfügbar

- Synthetische Variationen von markierten Beispielen erzeugen

- Teilen Sie Datensätze organisationsübergreifend in verwandten Projekten.

Doch Vorsicht – die Lizenzierung von Datensätzen kann selbst teuer werden, sobald Anbieter den strategischen Wert der Daten erkennen. Jüngste Verträge zwischen KI-Laboren und Inhaltsanbietern beliefen sich auf Hunderte von Millionen Dollar für den Zugang zu proprietären Textquellen.

Reduzieren Sie unnötige Ausgaben für Etikettierung, bevor Sie mit dem Training beginnen

Die Datenqualität ist der Bereich, in dem die Kosten für LLM (Learning Learning Management) unbemerkt steigen. Die Behebung von Labeling-Problemen nach dem Training ist teuer, und schlecht aufbereitete Datensätze führen zu mehr Iterationen, nicht zu besseren Modellen. Genau hier liegt der Punkt, an dem… AI Superior typischerweise passt es – nicht als Anbieter von Etikettierungslösungen, sondern als die Schicht, die sicherstellt, dass die Etikettierung tatsächlich in eine nutzbare Modellleistung umgesetzt wird.

Sie übernehmen Datenerfassung, -bereinigung und -vorverarbeitung als Teil der Modellpipeline, sodass Datensätze von Anfang an für das Training strukturiert sind und nicht nachträglich angepasst werden müssen. Dazu gehört die Ausrichtung der Daten am Anwendungsfall, die Rauschunterdrückung und die Vorbereitung für Feinabstimmungs-Workflows, die weder Rechenleistung noch Budget verschwenden. Steigen Ihre Labeling-Kosten kontinuierlich, die Modellqualität jedoch nicht, liegt das Problem in der Regel in der vorgelagerten Pipeline. Optimieren Sie die Pipeline, bevor Sie sie skalieren – wenden Sie sich an [Name des Experten]. AI Superior und verschaffen Sie sich Klarheit darüber, was Ihre Kosten tatsächlich verursacht.

Die strategischen Implikationen für die KI-Entwicklung

Die Kosten für die Datenkennzeichnung verändern die Herangehensweise von Organisationen an die Entwicklung von LLM-Studiengängen.

Kleinere Unternehmen stehen vor großen Herausforderungen. Ohne die nötigen Ressourcen für umfangreiche Annotationsprojekte wird der Wettbewerb mit gut finanzierten Laboren schwierig. Dies birgt ein gewisses Konsolidierungspotenzial in der KI-Branche – Unternehmen mit größeren finanziellen Mitteln können sich bessere Datensätze und damit auch bessere Modelle leisten.

Auch die Wirtschaftlichkeit spricht für bestimmte Architekturvarianten. Kleine Sprachmodelle (SLMs) mit 1–15 Milliarden Parametern benötigen weniger Trainingsdaten und erzielen in fokussierten Domänen eine hohe Leistungsfähigkeit. Während das Training von fortgeschrittenen LLMs über 100 Millionen US-Dollar kostet, reduzieren SLMs die Kosten pro Million Anfragen um mehr als das Hundertfache und benötigen im Verhältnis geringere Annotationsbudgets für die Feinabstimmung.

Unternehmen bewerten Eigenentwicklungs- oder Kaufentscheidungen zunehmend datenbasiert. Die Feinabstimmung bestehender Basismodelle ist oft wirtschaftlicher als das Training von Grund auf – man zahlt im Wesentlichen nur die Annotationskosten, ohne die enormen Rechenkosten für das Vortraining.

Dies hat die Einführung des Feinabstimmens beschleunigt. Analysen der Modellbereitstellungsmuster zufolge kann Feinabstimmung im Vergleich zum vollständigen Vortraining 60–901 TP3T einsparen und gleichzeitig eine vergleichbare aufgabenspezifische Leistung erzielen.

| Ansatz | Kosten berechnen | Kosten für die Datenkennzeichnung | Am besten geeignet für |

|---|---|---|---|

| Vorbereitendes Training von Grund auf | $50M – $200M+ | Minimal (unüberwacht) | Entwicklung des Frontier-Modells |

| Feinabstimmung des Fundamentmodells | $10K – $1M | $50K – $15M | Domänenspezialisierung |

| Nur prompte technische Unterstützung | Nahezu Null | $5K – $50K (einige Beispiele) | Schnelles Prototyping, einfache Aufgaben |

| Kleinmodell-Schulung | $5K – $500K | $10K – $500K | Edge-Bereitstellung, kostensensible Apps |

Branchentrends und Zukunftsaussichten

Was geschieht als Nächstes in der Datenkennzeichnungsökonomie?

Die Wachstumsraten werden sich voraussichtlich nach dem außergewöhnlichen 88-fachen Anstieg zwischen 2023 und 2024 abschwächen. Dieser sprunghafte Anstieg ist größtenteils auf die rasante Expansion einzelner Unternehmen wie Mercor zurückzuführen. Die absoluten Beträge steigen jedoch weiter, da immer mehr Organisationen die Entwicklung von LLM-Programmen vorantreiben und bestehende Labore ihre Modelle kontinuierlich verbessern.

Zu den Forschungsrichtungen, die die Wirtschaftssysteme verändern könnten, gehören:

- Automatisierte Verifizierungsmechanismen: Wenn Modelle sich zuverlässig selbst überprüfen können oder kostengünstige Verifizierungsmethoden entwickelt werden, könnten die Kosten für die Erstellung großer, annotierter Datensätze erheblich sinken. Dies ist weiterhin ein aktives Forschungsgebiet.

- Belohnungsmodelle, die verrauschte Daten tolerieren: Aktuelle RLHF-Implementierungen erfordern hochwertige Präferenzlabels. Verfahren, die mit Labels geringerer Qualität oder teilautomatisierten Labels arbeiten, würden die Kosten senken.

- Verfassungsmäßige KI und Techniken zur Selbstverbesserung: Methoden, bei denen sich Modelle durch Selbstkritik und Überarbeitung verbessern, könnten die Abhängigkeit von menschlichen Annotationen verringern.

- Bessere Dateneffizienz: Die Forschung arbeitet weiterhin daran, durch verbesserte Algorithmen und Trainingsmethoden mehr Wert aus weniger gelabelten Daten zu gewinnen.

Die Frage, vor der die Branche steht: Kann die Automatisierung den steigenden Qualitätsanforderungen und den sich ausweitenden Anwendungsfällen gerecht werden?

Diskussionen in Fachforen verdeutlichen, dass die Datenkennzeichnung zu einem echten Engpass in der KI-Entwicklung geworden ist. Unternehmen berichten von monatelangen Bemühungen, Teams für die Datenkennzeichnung zu rekrutieren und zu schulen. Qualitätsschwankungen führen zu Projektverzögerungen. Die Verfügbarkeit von Experten ist dabei ein größerer limitierender Faktor als die Rechenkapazität.

Praktische Kostenplanung für LLM-Projekte

Teams, die LLM-Initiativen planen, sollten realistische Budgets für die Datenkennzeichnung einplanen.

Für ein mittelgroßes Projekt mit dem Ziel einer domänenspezifischen Verbesserung:

- RLHF-Datensatz (20.000 Vergleiche, mittlere Komplexität): $100K – $400K

- Datensatz zur Optimierung von Befehlen (10.000 Beispiele, allgemeiner Anwendungsbereich): $80K – $300K

- Qualitätssicherung und Validierung (20% der Daten): $36K – $140K

- Projektmanagement und Tools: $25K – $100K

Gesamtbudget für Annotationen: $241K – $940K

Die Feinabstimmung der Rechenleistung für dasselbe Projekt könnte $50K – $200K betragen. Die Annotationskosten sind der dominierende Faktor – genau wie es die Branchenzahlen vorhersagen.

Bei größeren Initiativen, die auf zukunftsweisende Technologien abzielen, steigen die Budgets entsprechend. Projekte mit über 100.000 annotierten Beispielen und dem Bedarf an erfahrenen Annotatoren erreichen allein bei den Annotationskosten leicht 1,4 bis 15 Millionen US-Dollar.

Auswahl von Anbietern für Datenkennzeichnung

Die Wahl des richtigen Annotationspartners hat einen erheblichen Einfluss auf Kosten und Qualität.

Die Bewertungskriterien sollten Folgendes umfassen:

- Erfolgsbilanz: Bitten Sie um Fallstudien und Referenzkunden, die an ähnlichen Aufgaben arbeiten. Erkundigen Sie sich nach den erreichten Genauigkeitsraten und den Qualitätskontrollmechanismen.

- Fachkenntnisse im Bereich Annotation: Prüfen Sie, ob der Anbieter Zugang zu relevanten Fachexperten für das Projekt hat. Generische Crowdsourcing-Plattformen haben oft Schwierigkeiten mit spezialisierten Inhalten.

- Werkzeugkapazitäten: Moderne Annotationsplattformen bieten Effizienzfunktionen, die die Kosten pro Element reduzieren – intelligentes Aufgabenrouting, automatisierte Qualitätsprüfungen, Kollaborationsfunktionen und Integration mit ML-Pipelines.

- Skalierbarkeit: Kann der Anbieter seine Kapazitäten bei Bedarf schnell ausbauen? Verfügt er über ausreichend Personal für große oder dringende Projekte?

- Sicherheit und Compliance: Bei sensiblen Daten sollten Sie die entsprechenden Zertifizierungen, Datenverarbeitungsprotokolle und vertraglichen Schutzmaßnahmen überprüfen.

- Preistransparenz: Vorsicht vor Anbietern, die erst im Laufe des Verkaufsprozesses über Preise sprechen. Kostenplanbarkeit ist für die Projektplanung unerlässlich.

Führende Anbieter in diesem Bereich haben spezialisierte Workflows entwickelt, die für LLM-Trainingsdaten optimiert sind. Laut Scale AI verfügen sie über große, geschulte Teams für die Datenkennzeichnung und eigene Tools, die speziell für ML-Anwendungsfälle entwickelt wurden.

Die Forschungsagenda zur Datenökonomie

Akademische und industrielle Forscher beginnen, Daten als ein eigenes ökonomisches Feld zu betrachten.

Eine auf arXiv veröffentlichte Forschungsagenda (The Economics of AI Training Data) stellt fest, dass Daten trotz ihrer zentralen Rolle in der KI-Entwicklung nach wie vor der am wenigsten verstandene Inputfaktor sind. Da KI-Labore öffentliche Datenquellen erschöpfen und sich durch Verträge in dreistelliger Millionenhöhe proprietären Quellen zuwenden, hat sich die Forschung auf Informatik, Wirtschaftswissenschaften, Recht und Politik zersplittert.

Zu den wichtigsten offenen Fragen gehören:

- Wie sollten Daten als eigenständiger Produktionsfaktor bewertet werden?

- Welche Marktstrukturen werden sich für den Austausch von Trainingsdaten herausbilden?

- Wie beeinflussen Regelungen zum geistigen Eigentum die Verfügbarkeit und die Kosten von Daten?

- Welche Auswirkungen hat die Datenkonzentration auf das Gemeinwohl?

- Können Mechanismen eine faire Vergütung für Datenersteller gewährleisten?

Dies sind nicht nur theoretische Bedenken. Sie wirken sich direkt darauf aus, wer es sich leisten kann, wettbewerbsfähige KI-Systeme zu entwickeln und was diese Systeme leisten können.

Der Wechsel von Rechen- zu Datenengpässen stellt einen grundlegenden Wandel in der KI-Ökonomie dar. Menschliches Fachwissen lässt sich schwieriger skalieren als die Anzahl der GPUs. Differenzierte Urteile lassen sich schwieriger automatisieren als Matrixmultiplikationen zu parallelisieren.

Diese Realität wird die KI-Branche auf Jahre hinaus prägen.

Häufig gestellte Fragen

Wie hoch sind die Kosten für die Datenkennzeichnung in einem typischen LLM-Feinabstimmungsprojekt?

Die Kosten für die Datenkennzeichnung zur Feinabstimmung von LLM variieren stark je nach Aufgabenkomplexität und Datensatzgröße. Ein Projekt mittleren Umfangs mit 20.000 bis 30.000 gekennzeichneten Beispielen kostet typischerweise zwischen 200.000 und 900.000 PKR. Einfache Klassifizierungsaufgaben im unteren Preissegment können 0,05 bis 2 PKR pro Element kosten, während komplexe RLHF-Vergleiche, die Fachwissen erfordern, 20 bis über 100 PKR pro Vergleich kosten können. Die Annotation durch Experten für spezialisierte Bereiche (Medizin, Recht, Wissenschaft) ist mit hohen Stundensätzen von 50 bis über 200 PKR pro Stunde verbunden.

Warum sind die Kosten für die Datenkennzeichnung schneller gestiegen als die Rechenkosten?

Die Kosten für die Datenkennzeichnung stiegen von 2023 bis 2024 um das 88-Fache, während die Rechenkosten nur um das 1,3-Fache zunahmen. Dieser drastische Unterschied ist darauf zurückzuführen, dass Nachbearbeitungstechniken (RLHF, überwachtes Feintuning) für wettbewerbsfähige Modelle unerlässlich geworden sind. Diese Methoden erfordern umfangreiche manuelle Annotationen, häufig durch Fachexperten. Gleichzeitig verbessert sich die GPU-Effizienz kontinuierlich, und Cloud-Anbieter bieten wettbewerbsfähigere Preise, wodurch die Rechenkosten trotz steigender Kennzeichnungskosten relativ stabil bleiben.

Können LLMs ihre eigene Datenkennzeichnung automatisieren, um Kosten zu senken?

LLMs können die Beschriftung unterstützen, sie aber nicht ohne Qualitätsbedenken vollständig automatisieren. Gängige Ansätze umfassen die Verwendung von GPT-4 oder Claude zur Generierung erster Beschriftungen und die anschließende Validierung der Ergebnisse durch menschliche Gutachter. Dieser hybride Ansatz kann die Kosten im Vergleich zur rein manuellen Annotation um 40–701 Tsd. Euro senken. Eine sorgfältige Qualitätskontrolle bleibt jedoch unerlässlich, da LLMs systematische Fehler oder Verzerrungen einführen können. Die arXiv-Veröffentlichung zur kostenbewussten Annotation untersucht Frameworks zur optimalen Balance zwischen automatisierter LLM-Beschriftung und den Kosten der manuellen Überprüfung.

Was ist teurer: ein LLM von Grund auf zu trainieren oder ein bestehendes Modell zu optimieren?

Das Vortraining von Spitzenmodellen von Grund auf kostet 1,4 Billionen Tsd. 50 bis über 200 Millionen Tsd., hauptsächlich für Rechenleistung, während das Feinabstimmen bestehender Modelle typischerweise 10.000 bis 1 Million Tsd. an Rechenleistung kostet. Allerdings erfordert das Feinabstimmen erhebliche Budgets für die Datenkennzeichnung – oft 1,4 Billionen Tsd. 50.000 bis 15 Millionen Tsd., abhängig von der Größe des Datensatzes und der Komplexität der Aufgabe. Trotz der höheren Annotationskosten bietet das Feinabstimmen im Vergleich zum Vortraining insgesamt Kosteneinsparungen von 60 bis 901 Billionen Tsd. und erzielt gleichzeitig eine hohe aufgabenspezifische Leistung. Für die meisten Organisationen ist das Feinabstimmen daher wirtschaftlich sinnvoller.

Wie schneiden kleine Sprachmodelle (SLMs) im Vergleich zu großen Sprachmodellen (LLMs) hinsichtlich der Kosten ab?

SLMs mit 1–15 Milliarden Parametern reduzieren die Trainings- und Inferenzkosten drastisch. Das Training von SLMs kostet 10⁴ Tsd. 5.000–10⁴ Tsd. 500.000 Recheneinheiten, verglichen mit 10⁴ Tsd. 50–200+ Millionen für große LLMs. Der Aufwand für die Datenkennzeichnung skaliert proportional geringer und liegt typischerweise bei 10⁴ Tsd. 10.000–10⁴ Tsd. 500.000 für fokussierte Domänen. SLMs senken die Kosten pro Million Abfragen um mehr als das Hundertfache im Vergleich zu großen Modellen. Für Anwendungen mit spezifischem Umfang und Edge-Bereitstellungsszenarien bieten SLMs überzeugende Kostenvorteile bei gleichzeitig akzeptabler Genauigkeit für die angestrebten Aufgaben.

Welche Strategien reduzieren die Kosten der Datenkennzeichnung effektiv, ohne die Qualität zu beeinträchtigen?

Mehrere bewährte Strategien senken die Kosten bei gleichbleibender Qualität: Aktives Lernen reduziert den Umfang der Annotationen um 50–80¹³T, indem es Beispiele identifiziert, bei denen die Annotation den größten Nutzen bringt. LLM-gestützte Workflows nutzen Modelle zur Generierung erster Labels, die anschließend von Experten validiert werden – dies senkt die Kosten um 40–70¹³T. Gestufte Workflows passen die Expertise der Annotatoren an den Schwierigkeitsgrad der Aufgabe an und reservieren teure Experten für besonders komplexe Fälle. Die Wiederverwendung von Datensätzen amortisiert die Annotationsinvestitionen über mehrere Projekte hinweg. Selektives Sampling hochwertiger Daten ist für das Feintuning oft effektiver als größere Datensätze geringerer Qualität.

Werden die Kosten für die Datenkennzeichnung weiterhin im derzeitigen Tempo steigen?

Das außergewöhnliche 88-fache Wachstum zwischen 2023 und 2024 dürfte sich abschwächen, da ein Großteil dieses Anstiegs auf die rasante Skalierung einzelner Unternehmen zurückzuführen ist. Die absoluten Kosten für die Datenkennzeichnung steigen jedoch weiter an, da immer mehr Organisationen die Entwicklung von LLM-Modellen vorantreiben und die Qualitätsstandards steigen. Branchenexperten gehen davon aus, dass die Datenkennzeichnung bis 2026 und darüber hinaus den größten Kostenfaktor für Spitzenmodelle darstellen wird. Forschung zu automatisierter Verifizierung, rauschtolerantem Training und Selbstverbesserungstechniken könnte die Abhängigkeit von teurer manueller Annotation langfristig verringern, doch bahnbrechende Lösungen in großem Umfang sind bisher noch nicht verfügbar.

Schlussfolgerung

Die ökonomischen Rahmenbedingungen der LLM-Entwicklung haben sich grundlegend verändert.

Was einst ein stark rechenintensives Feld war, sieht sich heute mit einem Großteil des Budgets konfrontiert, der für die manuelle Datenannotation aufgewendet wird. Die Kosten für die Datenkennzeichnung haben sich innerhalb eines Jahres um das 88-Fache erhöht, während die Rechenkosten nur um das 1,3-Fache gestiegen sind. Für Organisationen, die Modelle entwickeln oder optimieren, macht die Annotation mittlerweile etwa das Dreifache der zusätzlichen Rechenkosten aus.

Dies ist keine vorübergehende Ausnahme. Nachbereitende Trainingsverfahren, die menschliches Feedback erfordern, haben sich als unerlässlich für die Entwicklung von Modellen erwiesen, die im Produktiveinsatz zuverlässig funktionieren. RLHF, die Optimierung der Instruction und das spezialisierte Feintuning basieren allesamt auf sorgfältig kuratierten und fachmännisch annotierten Datensätzen. Die Zeit von Experten kostet Geld – und zwar viel.

Die Fallstudien sprechen für sich. MiniMax-M1 benötigte 28-mal mehr für die Annotation als für das Training. Bei SkyRL-SQL waren die Kosten für die Datenkennzeichnung sogar 167-mal höher als die Rechenkosten. Diese Verhältnisse spiegeln den neuen Standard in der KI-Entwicklung wider.

Intelligente Teams optimieren Annotationsbudgets durch aktives Lernen, LLM-gestützte Arbeitsabläufe und gestaffelte Labeling-Strategien. Doch die grundlegende Tatsache bleibt bestehen: Der Aufbau wettbewerbsfähiger LLMs erfordert erhebliche Investitionen in qualitativ hochwertige, manuell annotierte Daten.

Organisationen, die LLM-Projekte im Jahr 2026 planen, sollten dies in ihre Budgetplanung einbeziehen. Die Datenkennzeichnung wird bei größeren Vorhaben voraussichtlich 45.000 bis 601.000 Tonnen der Gesamtprojektkosten ausmachen. Es empfiehlt sich, mit erfahrenen Anbietern von Annotationsdiensten zusammenzuarbeiten, in die Qualitätssicherung zu investieren und längere Zeiträume einzuplanen, als reine Rechenkostenschätzungen vermuten lassen.

Der Engpass hat sich von Silizium hin zu menschlichem Fachwissen verlagert. Das Verständnis dieses Wandels – und die Planung seiner finanziellen Auswirkungen – unterscheidet erfolgreiche LLM-Initiativen von unterfinanzierten Fehlschlägen.

Benötigen Sie Unterstützung bei der Planung Ihres Budgets für die Datenkennzeichnung im Rahmen Ihres LLM-Studiums? Um die tatsächlichen Kosten der Annotation zu ermitteln, müssen Sie Ihren spezifischen Anwendungsfall, Ihre Qualitätsanforderungen und den Umfang analysieren. Wenden Sie sich an erfahrene Anbieter, um genaue Kostenvoranschläge für Ihr Projekt zu erhalten, bevor Sie Ressourcen einsetzen.