Résumé rapide : Les coûts des serveurs LLM varient considérablement : les API cloud comme OpenAI facturent de 1 TP4T0,03 à 1 TP4T6 par million de jetons selon le modèle, tandis que l’auto-hébergement nécessite de 1 TP4T50 000 à 1 TP4T287 000 par an pour une infrastructure performante. Le seuil de rentabilité est généralement atteint à partir de 500 millions de jetons par mois pour les déploiements en entreprise. L’optimisation des coûts dépend du volume d’utilisation, des exigences en matière de confidentialité des données et de la priorité accordée à un investissement initial minimal ou à des économies à long terme.

La rentabilité de l'exécution de grands modèles de langage est devenue une décision stratégique cruciale. Selon les concurrents, les dépenses des entreprises en API de grands modèles de langage ont doublé pour atteindre 14 000 milliards de dollars en 2025. Pourtant, de nombreuses organisations s'interrogent sur la pertinence financière du recours aux fournisseurs de cloud ou à une infrastructure auto-hébergée.

D'après un article de la concurrence citant le rapport 2025 de Kong sur l'IA d'entreprise, 441 030 organisations considèrent la confidentialité et la sécurité des données comme le principal frein à l'adoption des solutions LLM. Chaque requête envoyée à des API externes transite par des serveurs hors du contrôle de l'organisation. Cette préoccupation en matière de confidentialité incite de nombreuses équipes à opter pour l'auto-hébergement, mais les coûts d'infrastructure engendrent des difficultés financières supplémentaires.

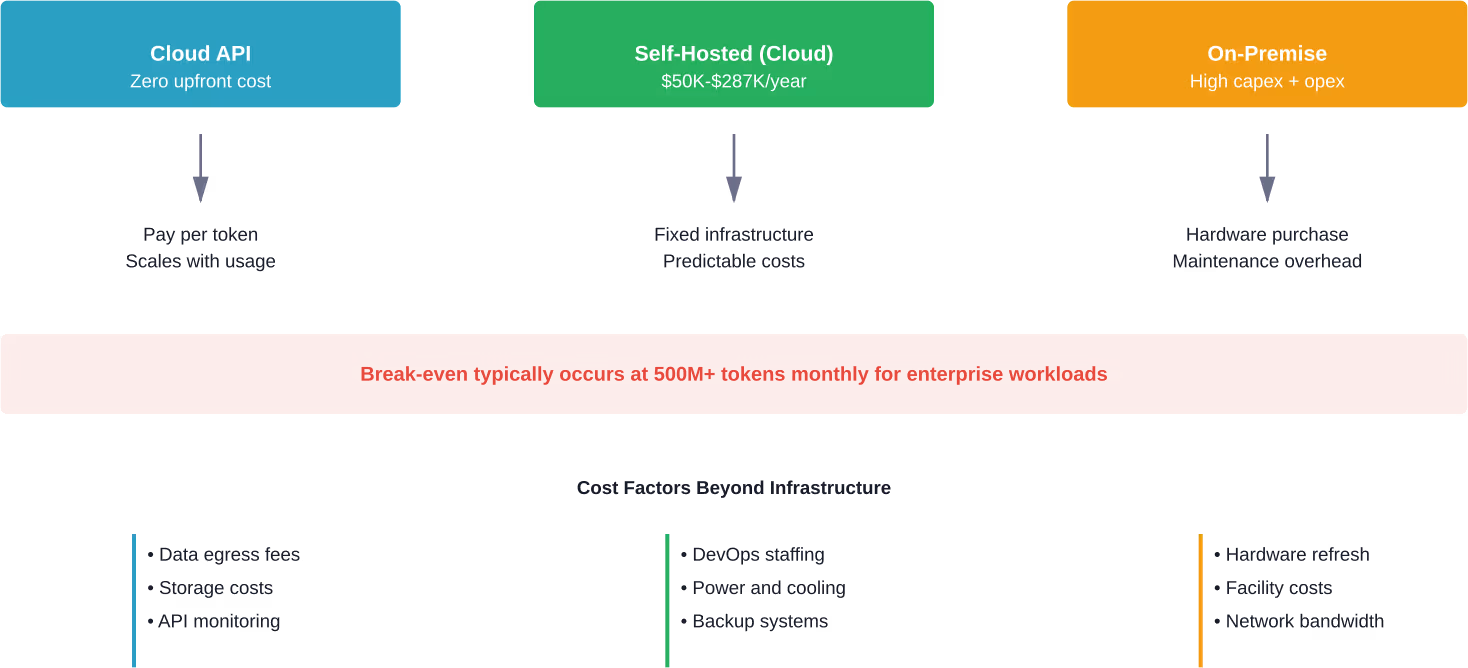

Le calcul n'est pas simple. Les API cloud ne nécessitent aucun investissement initial, mais les coûts s'accumulent avec l'augmentation de la charge. L'auto-hébergement exige un investissement initial important, mais promet des économies à long terme. Le seuil de rentabilité dépend du volume d'utilisation, de la taille du modèle et des exigences opérationnelles.

Comprendre les modèles de tarification des LLM

Les fournisseurs de services cloud ont standardisé leur tarification en fonction des jetons. OpenAI facture $0,03 pour 1 000 jetons d'entrée et $0,06 pour 1 000 jetons de sortie pour GPT-4. GPT-3.5 Turbo est nettement moins cher, à $0,0015 pour 1 000 jetons d'entrée.

Mais concrètement, qu'est-ce que cela signifie pour les charges de travail réelles ? Une seule conversation avec le service client peut consommer entre 2 000 et 5 000 jetons. Multipliez cela par des milliers de conversations quotidiennes, et les coûts s'accumulent rapidement.

Le coût des jetons varie considérablement selon les fournisseurs et les modèles. D'après la documentation d'OpenAI, les jetons audio de l'API Realtime sont facturés 1 jeton toutes les 100 millisecondes pour les messages utilisateur, tandis que les sorties audio de l'assistant sont facturées 1 jeton toutes les 50 millisecondes. Ces différences de modalité engendrent une complexité de tarification qu'il est facile de sous-estimer.

Structures tarifaires des principaux fournisseurs de cloud

Amazon Bedrock applique une tarification similaire basée sur des jetons, les tarifs dépendant toutefois du modèle de fondation choisi. Les prix varient selon la modalité, le fournisseur et le niveau du modèle. Vertex AI de Google Cloud propose des structures tarifaires comparables, avec des options de consommation Standard PayGo qui ajustent la capacité de débit en fonction des dépenses de l'organisation sur des périodes de 30 jours.

Le hic, c'est que la tarification du cloud ne se résume pas au prix par jeton. Les fournisseurs appliquent des paliers d'utilisation, des remises pour le traitement par lots et des variations régionales qui compliquent les comparaisons directes.

D'après la documentation d'OpenAI sur l'optimisation des coûts, l'API Batch et le traitement flexible offrent des mécanismes de réduction des coûts supplémentaires par rapport à la tarification standard. Le traitement par lots permet de réduire les dépenses liées aux charges de travail non critiques en termes de temps, pour lesquelles les exigences de latence sont flexibles.

| Fournisseur | Exemple de modèle | Coût d'entrée (par million de jetons) | Coût de production (par million de jetons) | Caractéristiques notables |

|---|---|---|---|---|

| OpenAI | GPT-4 | $30 | $60 | API en temps réel, traitement par lots |

| OpenAI | GPT-3.5 Turbo | $1.50 | $2.00 | Inférence à moindre coût et plus rapide |

| Roche de base amazonienne | Divers fournisseurs | Varie selon le modèle | Varie selon le modèle | Accès multi-fournisseurs |

| Google Vertex AI | Modèles Gémeaux | Varie selon le niveau | Varie selon le niveau | Mises à niveau de niveau basées sur l'utilisation |

Coûts cachés des services LLM en nuage

Le prix des jetons ne représente qu'une partie du tableau financier. Les déploiements dans le cloud engendrent des coûts qui n'apparaissent pas sur les pages de tarification initiales.

Les frais de sortie de données s'accumulent lors du transfert de volumes importants de réponses. Des coûts de stockage s'appliquent aux journaux de conversation et aux données d'entraînement. Les outils de surveillance et d'observabilité engendrent des frais supplémentaires. Pour les systèmes de production exigeant un débit garanti, les modèles de tarification à capacité réservée remplacent le paiement à l'utilisation par des engagements fixes.

Les discussions au sein de la communauté sur des plateformes comme LocalLLaMA révèlent une frustration face à l'imprévisibilité des coûts du cloud. Des modèles d'utilisation qui semblent raisonnables lors des tests peuvent exploser en production avec l'augmentation du nombre de connexions simultanées.

Coûts d'infrastructure d'auto-hébergement

Les programmes de maîtrise en droit (LLM) auto-hébergés promettent des économies à long terme et un meilleur contrôle des données. Cependant, l'investissement initial est conséquent et les frais d'exploitation persistent indéfiniment.

D'après les discussions de la communauté, l'exécution de Qwen-2.5 32B ou QwQ 32B sur des instances AWS g5.12xlarge (4 GPU A10G) coûte environ $50 000 par an en fonctionnement continu. Llama-3 70B sur des instances p4d.24xlarge (8 GPU A100) coûterait quant à lui environ $287 000 par an en fonctionnement continu.

Ces chiffres supposent une infrastructure cloud. Le matériel sur site modifie complètement la situation économique.

Exigences matérielles et coûts d'investissement

La bande passante des processeurs grand public modernes (environ 100 Go/s pour la DDR5-6400 double canal) est nettement inférieure au débit des GPU, qui dépasse 1,7 To/s. Apple Silicon fait exception grâce à son architecture de mémoire unifiée offrant une bande passante plus élevée, mais l'utilisation du matériel Apple à grande échelle pour les charges de travail de production se heurte à des limitations pratiques.

En règle générale, il faut compter environ 0,5 Go de VRAM par milliard de paramètres avec une quantification sur 4 bits. La précision maximale (FP16) double cette exigence. Un modèle de 70 milliards de paramètres en quantification sur 4 bits nécessite au minimum 35 Go de VRAM. Pour une vitesse d'inférence acceptable, le modèle doit tenir dans la VRAM ; sinon, le système bascule sur le traitement CPU, 10 à 100 fois plus lent.

D'après les discussions au sein de la communauté, les coûts de déploiement interne minimum se situent entre 125 000 et 190 000 TP4T par an, tandis que les fonctionnalités destinées aux clients, d'envergure moyenne, génèrent entre 500 000 et 820 000 TP4T par an. Les moteurs de produit principaux à l'échelle de l'entreprise dépassent largement ces chiffres.

Dépenses opérationnelles autres que le matériel

L'infrastructure ne représente que le point de départ. L'auto-hébergement nécessite du personnel DevOps qualifié, une maintenance continue, une alimentation électrique et un refroidissement adéquats, des systèmes de sauvegarde et une infrastructure réseau.

La consommation électrique des serveurs GPU est importante. Un système composé de 8 GPU A100 peut consommer de 3 à 5 kW en pleine charge, ce qui représente un coût annuel d'électricité de 1 040 000 à 1 040 000 £ selon les tarifs locaux. Le refroidissement ajoute 30 à 500 000 £ à cette consommation.

Mais attention ! Le matériel informatique vieillit. Les cartes graphiques perdent rapidement de la valeur à la revente avec l’apparition de nouvelles architectures. Un cycle d’amortissement de trois ans signifie que les coûts d’investissement sont amortis annuellement, auxquels s’ajoutent les frais de remplacement éventuels.

Analyse détaillée du coût total de possession

Comparer les coûts du cloud et de l'hébergement sur site nécessite de calculer le coût total de possession sur des horizons temporels réalistes. L'analyse varie considérablement en fonction du volume d'utilisation.

Pour les applications à faible volume traitant moins de 10 millions de jetons par mois, les API cloud restent économiquement imbattables. Avec un coût GPT-3.5 Turbo de $1,50 par million de jetons, les coûts mensuels demeurent inférieurs à $20. À cette échelle, aucun investissement en infrastructure n'est rentable.

Le calcul est différent pour une utilisation modérée. Le traitement de 100 millions de jetons par mois sur GPT-3.5 Turbo coûte environ $150-200. Sur trois ans, cela représente $5 400-7 200, ce qui reste bien inférieur au coût d'une infrastructure d'auto-hébergement minimale.

Le seuil de rentabilité

L'analyse suggère que le seuil de rentabilité se situe généralement entre 500 millions et 1 milliard de jetons par mois pour les déploiements en entreprise. À ce volume, les coûts du cloud atteignent 15 000 à 60 000 TP4T par mois selon le modèle utilisé. Sur une base annuelle, cela représente 180 000 à 720 000 TP4T.

Une infrastructure auto-hébergée, dont le coût annuel s'élève à 125 000 à 190 000 £ pour un déploiement minimal, commence à devenir économiquement viable. Sur trois ans, les solutions sur site peuvent générer des économies de 30 à 500 000 £ par rapport aux services cloud pour les charges de travail importantes.

Cela vous semble familier ? Cela correspond aux tendances observées dans les analyses communautaires comparant les déploiements dans le cloud et sur site à grande échelle.

| Volume mensuel de jetons | Coût de l'API Cloud (GPT-3.5) | Coût de l'API Cloud (GPT-4) | Estimation d'auto-hébergement | Approche recommandée |

|---|---|---|---|---|

| 10 millions de jetons | $15-20 | $300-600 | N / A | API Cloud |

| 100 millions de jetons | $150-200 | $3,000-6,000 | N / A | API Cloud |

| 500 millions de jetons | $750-1,000 | $15,000-30,000 | $10 400/mois | Envisagez l'auto-hébergement |

| Plus d'un milliard de jetons | $1,500-2,000 | $30,000-60,000 | $10 400-15 800/mois | L'auto-hébergement est probablement moins cher. |

Variables cachées dans les calculs du coût total de possession

L'analyse standard du seuil de rentabilité néglige des facteurs essentiels. Les exigences en matière de protection des données peuvent imposer l'auto-hébergement, indépendamment de la rentabilité. La conformité réglementaire dans les secteurs de la santé, de la finance ou du gouvernement exige souvent une infrastructure sur site.

Les exigences de latence changent la donne. Les appels d'API cloud introduisent un temps d'aller-retour réseau. Pour les applications temps réel nécessitant des temps de réponse inférieurs à 100 ms, l'inférence locale devient indispensable, indépendamment des considérations de coût.

La personnalisation des modèles introduit une nouvelle dimension. Les fournisseurs de services cloud offrent des options de réglage fin limitées. Les organisations nécessitant une adaptation poussée des modèles requièrent une infrastructure prenant en charge des pipelines d'entraînement personnalisés, ce qui accroît considérablement la complexité et les coûts.

Stratégies d'optimisation des coûts

Quel que soit le mode de déploiement choisi, les techniques d'optimisation des coûts peuvent réduire considérablement les dépenses liées au LLM. D'après la documentation d'OpenAI sur l'optimisation des coûts, plusieurs stratégies permettent de réaliser des économies de manière constante.

Réduction de la consommation de jetons

Chaque jeton a un coût. Minimiser leur utilisation permet de réduire directement les dépenses. Des invites plus courtes offrent les mêmes résultats à moindre coût. Supprimer le contexte, les exemples et les instructions superflus réduit le nombre de jetons sans compromettre la qualité du résultat.

L'optimisation des messages d'invite devient un exercice d'optimisation économique. Tester différentes formulations d'invites pour obtenir des résultats identiques avec moins de jetons génère un retour sur investissement immédiat. Une réduction de 20% de la longueur moyenne des invites se traduit directement par des économies de coûts de 20%.

La mise en cache du contexte fréquemment utilisé réduit le traitement redondant des jetons. De nombreux fournisseurs prennent désormais en charge la mise en cache immédiate, où les portions de contexte répétées ne sont pas comptabilisées dans les limites de jetons des requêtes suivantes.

Traitement par lots et charges de travail asynchrones

L'API Batch d'OpenAI propose des tarifs considérablement réduits pour les charges de travail non critiques en termes de temps. Le traitement asynchrone des requêtes, lorsque les exigences de latence sont flexibles, permet de bénéficier de remises substantielles.

L'API Batch accepte les requêtes groupées traitées par tranches de 24 heures. Pour des tâches telles que l'analyse de contenu, l'enrichissement de données ou la synthèse par lots, cette approche permet de réduire les coûts tout en maintenant le débit.

Des fonctionnalités de traitement par lots similaires existent chez différents fournisseurs. Amazon SageMaker prend en charge les tâches de transformation par lots. Google Vertex AI propose des points d'accès pour la prédiction par lots à un prix réduit par rapport à l'inférence en ligne.

Sélection et quantification du modèle

Les modèles plus petits coûtent moins cher par jeton et sont plus rapides. GPT-3.5 Turbo coûte environ 51 TP3T du prix de GPT-4. Pour les tâches relevant des capacités des modèles plus petits, les économies réalisées sont considérables à grande échelle.

Pour les déploiements auto-hébergés, la quantification réduit considérablement les besoins matériels. La quantification sur 4 bits divise par deux la mémoire nécessaire par rapport à la quantification sur 8 bits, permettant ainsi de gérer des modèles plus volumineux sur un matériel équivalent. D'après les analyses techniques, la dégradation de la précision due à la quantification reste minime pour la plupart des applications.

Une étude publiée sur arXiv explore les techniques de gestion des modèles de langage (LLM) où de petits modèles traitent la plupart des requêtes tandis que des modèles plus importants fournissent des indications uniquement lorsque cela est nécessaire. Même de faibles indications (10 à 30% de réponses complètes des LLM) permettent d'obtenir des gains de précision substantiels. Cette approche hybride peut engendrer des réductions de coûts importantes tout en préservant la qualité des résultats.

Optimisez votre hébergement (cloud ou auto-hébergement) avant que les coûts ne deviennent irréversibles.

Choisir entre une infrastructure LLM hébergée dans le cloud et une infrastructure auto-hébergée ne se résume pas à une simple question de prix. Les coûts dépendent de la manière dont les modèles sont entraînés, déployés et utilisés dans le temps, notamment des pipelines de données, de la stratégie de mise à l'échelle et de l'efficacité du système. IA supérieure Elle intervient sur l'ensemble du cycle de vie, de la préparation des données et de la sélection du modèle au déploiement et à l'optimisation, aidant ainsi les équipes à concevoir des configurations qui correspondent à l'utilisation réelle plutôt qu'à une capacité théorique.

En pratique, cela signifie souvent déterminer quand le cloud est pertinent, quand l'auto-hébergement est justifié et comment éviter les surcoûts dans un sens ou dans l'autre. L'objectif est de construire des systèmes fiables en production, et non de simplement comparer les coûts d'infrastructure. Si vous évaluez le cloud par rapport à l'auto-hébergement ou si vous constatez déjà une augmentation des coûts, il est judicieux de revoir votre architecture au plus tôt. Contactez-nous. IA supérieure pour évaluer votre configuration avant que les coûts n'augmentent davantage.

Optimisation des performances de l'infrastructure

Pour les déploiements auto-hébergés, l'utilisation du matériel influe directement sur la rentabilité. D'après les annonces d'AWS, le conteneur Amazon SageMaker Large Model Inference v15, basé sur vLLM 0.8.4 et prenant en charge le moteur vLLM V1, offre un débit supérieur à celui du moteur V0 précédent.

Le moteur V1 intègre un mode asynchrone directement compatible avec AsyncLLMEngine de vLLM, créant ainsi une boucle d'arrière-plan plus efficace qui traite en continu les requêtes entrantes pour un débit supérieur à celui de l'implémentation Rolling-Batch précédente. Ces améliorations d'infrastructure se traduisent directement par des économies de coûts grâce à une capacité d'inférence accrue sur un matériel équivalent.

Choix d'architecture matérielle

Les processeurs AWS Graviton offrent des alternatives économiques pour les petits modèles. Une analyse d'AWS démontre que l'exécution de petits modèles de langage sur des instances Graviton3 (série ml.c7g) avec llama.cpp pour l'inférence optimisée Graviton et des modèles au format GGUF pré-quantifiés permet de réaliser des économies substantielles pour les charges de travail appropriées.

Les machines virtuelles A4 de Google Cloud, basées sur l'architecture NVIDIA Blackwell, constituent la toute dernière option haute performance. D'après des études de cas, Baseten a réalisé des gains de performance et de coût supérieurs de plus de 2 251 TP3T en hébergeant des modèles populaires tels que DeepSeek V3, DeepSeek R1 et Llama 4 Maverick sur une infrastructure A4, par rapport aux générations précédentes.

Le choix du matériel dépend de la taille du modèle et des exigences en matière de débit. Les petits modèles (moins de 13 milliards de paramètres) fonctionnent efficacement sur des instances basées sur le processeur. Les modèles de taille moyenne (13 à 70 milliards de paramètres) tirent parti des configurations mono-GPU ou multi-GPU. Les grands modèles (plus de 70 milliards de paramètres) nécessitent des configurations multi-GPU ou des stratégies de parallélisme.

Planification dynamique de la charge de travail

Le planificateur de charge dynamique de Google Cloud optimise l'utilisation des ressources en fonction des variations de trafic. Au lieu de provisionner en permanence pour une capacité maximale, la planification dynamique ajuste les ressources en fonction de la demande réelle.

Cette fonctionnalité est particulièrement importante pour les charges de travail présentant d'importantes variations de trafic. Les applications dont l'utilisation varie quotidiennement ou hebdomadairement gaspillent des ressources pendant les périodes de faible trafic avec un provisionnement statique. La planification dynamique peut réduire les coûts d'infrastructure de 40 à 60 000 TPL pour les charges de travail à forte variabilité.

Exemples de coûts concrets

L'analyse théorique a ses limites. Seuls les coûts réels de déploiement fournissent des points de référence concrets.

Les discussions au sein de la communauté font état de déploiements de production minimaux dont le coût annuel est estimé entre $125 000 et 190 000. Ces déploiements prennent généralement en charge les outils internes et des volumes de requêtes modérés : quelques milliers de requêtes par jour plutôt que des millions.

D'après les mêmes analyses, les fonctionnalités destinées aux clients à échelle moyenne génèrent entre $500 000 et 820 000 requêtes par an. Cette échelle permet de gérer un trafic de production important avec des garanties de latence et de disponibilité acceptables.

Déploiements à l'échelle de l'entreprise

Les grandes organisations qui utilisent les LLM comme infrastructure produit principale font état de coûts bien supérieurs à ces fourchettes. Des investissements annuels de plusieurs millions de dollars deviennent la norme pour répondre aux exigences de volume élevé et de faible latence sur des régions géographiques distribuées.

Une étude publiée sur arXiv, analysant l'économie de l'inférence, fournit des calculs de base. Prenons l'exemple d'une carte A800 de 80 Go : sous des hypothèses courantes, le coût horaire de base par carte est d'environ $0,79 €/heure, généralement compris entre $0,51 et $0,99 €/heure. Les principales plateformes cloud facturent généralement plusieurs fois ce coût de base afin de couvrir leurs frais opérationnels et leur marge.

Ces coûts par carte se multiplient en fonction du nombre de GPU requis pour les modèles plus importants. Un déploiement à 8 GPU consomme environ $6,32 unités/heure en fonctionnement de base, soit $55 366 unités/an en fonctionnement continu, avant prise en compte des coûts d'alimentation, de refroidissement, de réseau et de personnel.

Comparaison des solutions cloud et sur site à grande échelle

Une analyse examinant les aspects économiques du cloud par rapport aux systèmes sur site révèle que les systèmes sur site offrant une capacité équivalente aux déploiements cloud à volume élevé nécessitent environ $833 806 en coûts d'investissement initiaux pour une infrastructure basée sur H100.

Sur trois ans, cet investissement initial s'amortit à hauteur d'environ 1 040 000 £ par an. En ajoutant les frais d'exploitation (électricité, refroidissement, maintenance, personnel), le coût annuel total atteint 1 040 000 £ à 450 000 £ pour un déploiement sur site en entreprise.

Comparons cela aux coûts des API cloud pour des volumes équivalents. Le traitement de 5 milliards de jetons par mois sur GPT-4 coûte environ $150 000 à 300 000 par mois, soit $1,8 à 3,6 millions par an. Le seuil de rentabilité d'une solution sur site devient alors évident.

| Scénario de déploiement | Coût annuel de l'API cloud | Coût annuel d'un cloud auto-hébergé | Coût annuel sur site |

|---|---|---|---|

| Petit (100 millions de jetons/mois) | $2,400 | Pas économique | Pas économique |

| Moyen (500 millions de jetons/mois) | $12,000-360,000 | $125,000-190,000 | $350,000-450,000 |

| Important (2 milliards de jetons/mois) | $48 000-1,4M | $287,000-400,000 | $350,000-450,000 |

| Entreprise (plus de 5 milliards de jetons par mois) | $1,8M-3,6M | $400,000-600,000 | $400,000-550,000 |

Coûts liés à la confidentialité et à la conformité des données

L'analyse financière à elle seule ne permet pas de saisir l'intégralité du processus décisionnel. La protection des données et la conformité réglementaire imposent des exigences qui priment sur la simple optimisation des coûts.

Les organismes de santé soumis à la réglementation HIPAA doivent respecter des exigences strictes en matière de traitement des données. L'envoi d'informations patient à des API externes soulève des problèmes de conformité dont la résolution peut s'avérer extrêmement complexe ou coûteuse. L'auto-hébergement devient alors indispensable, même si cela représente un coût non négligeable pour les faibles volumes de données.

Les services financiers sont soumis à des contraintes similaires en vertu de réglementations telles que le RGPD, la norme PCI-DSS et les exigences sectorielles. Le coût des infractions à la conformité – sanctions financières et atteinte à la réputation – dépasse largement les dépenses d'infrastructure.

Quantification de la valeur de la vie privée

Quelle est la valeur financière de la protection des données ? Ce calcul dépend du contexte commercial. Pour les applications grand public traitant des données non sensibles, le surcoût lié à la protection des données peut être minime. En revanche, pour les entreprises gérant des informations confidentielles, de la propriété intellectuelle ou des données réglementées, la valeur de la protection des données devient considérable.

Certaines organisations acceptent des coûts 2 à 3 fois supérieurs pour une infrastructure auto-hébergée, uniquement pour garantir la souveraineté des données. D'autres exigent des déploiements totalement isolés, sans aucune connectivité externe, indépendamment du surcoût engendré.

Le rapport 44% des organisations qui citent la protection des données comme un obstacle majeur à l'adoption du LLM illustre ce constat. La maîtrise des coûts est importante, mais pas au détriment des exigences fondamentales de sécurité et de conformité.

Tendances des coûts à long terme

L'économie des LLM continue d'évoluer rapidement. Les coûts d'inférence ont considérablement diminué grâce à l'amélioration de l'efficacité algorithmique et aux progrès matériels.

Une étude du MIT portant sur l'efficacité algorithmique et la baisse des coûts d'inférence de l'IA a révélé que les tendances des modèles à pondération fixe sont légèrement plus rapides que celles des modèles à pondération ouverte. Ce phénomène est particulièrement marqué pour les modèles à pondération fixe du groupe 40%-60%, où des chutes de prix soudaines se produisent, absentes des modèles à pondération ouverte, ce qui suggère l'existence d'effets concurrentiels non techniques.

Loi de Moore et accélération de l'IA

Les performances matérielles continuent de progresser. L'architecture Blackwell de NVIDIA offre des gains de performances significatifs par rapport aux générations précédentes. Les développements de la technologie TPU de Google et les accélérateurs d'IA spécialisés développés par des startups contribuent à l'amélioration continue des performances.

Ces avancées matérielles permettent de réduire les coûts de deux manières. Premièrement, le matériel plus récent offre un débit d'inférence supérieur pour chaque dollar investi. Deuxièmement, la concurrence entre les fournisseurs de services cloud exerce une pression sur les prix qui profite aux clients.

Mais attendez. Les améliorations matérielles permettent aussi de créer des modèles plus grands et plus performants. Le passage de GPT-3 à GPT-4 a considérablement accru les capacités, mais a également augmenté les coûts d'inférence. Cette tendance à l'utilisation de modèles plus grands peut compenser les gains d'efficacité de l'infrastructure.

Écosystème de modèles open source

Les modèles de pondération ouverts proposés par Meta, Mistral, Alibaba et d'autres acteurs exercent une pression concurrentielle sur les prix des modèles propriétaires. Les entreprises peuvent déployer des modèles ouverts comme Llama 4, DeepSeek ou Qwen sans frais d'API par jeton.

Cette dynamique accélère la réduction des coûts pour les organisations capables d'auto-héberger leurs solutions. L'écart entre les coûts des API propriétaires et ceux des modèles ouverts auto-hébergés se creuse à mesure que la qualité de ces modèles s'améliore.

L'analyse souligne que considérer les “ LLM open source ” comme gratuits est une idée fausse. Les modèles eux-mêmes ne comportent pas de frais de licence, mais les coûts opérationnels restent importants. Les véritables économies proviennent de la suppression des frais par jeton à une échelle suffisante, et non d'un fonctionnement sans frais.

Prendre la décision de construire ou d'acheter

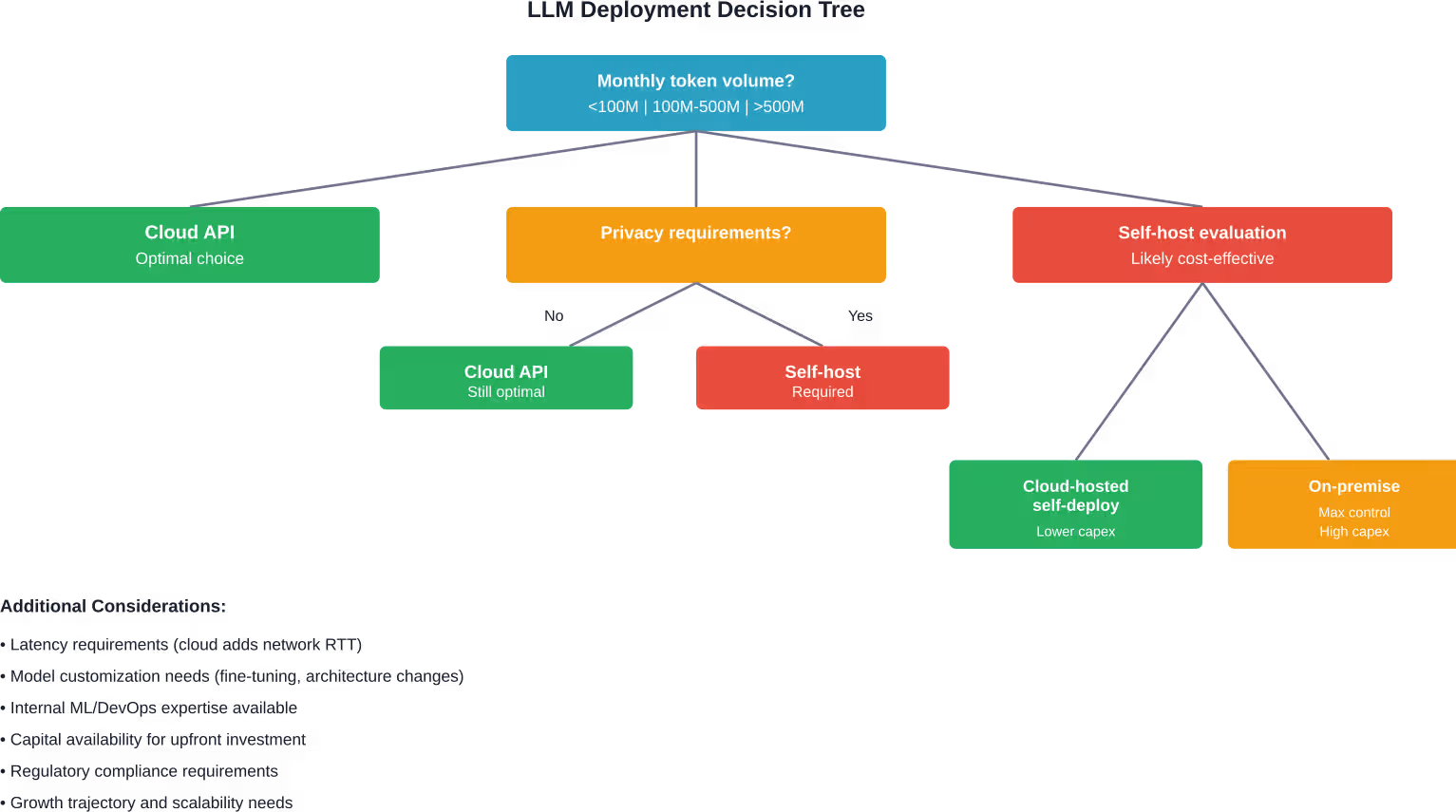

En résumé ? Cela dépend du volume, des capacités et des contraintes.

Les API cloud sont particulièrement pertinentes pour l'exploration, le prototypage et les volumes de production faibles à modérés. L'absence d'investissement initial, la simplicité d'utilisation et l'accès instantané à des modèles de pointe offrent une valeur ajoutée incomparable dans la plupart des cas d'usage.

L'auto-hébergement devient économiquement viable lorsque les volumes mensuels de jetons dépassent régulièrement entre 500 millions et 1 milliard de jetons. À cette échelle, les coûts d'infrastructure s'amortissent efficacement et le coût total de possession est plus avantageux pour une infrastructure détenue en propre que pour les frais d'API.

Cadre décisionnel

Considérez systématiquement ces facteurs :

- Volume et échelle : Calculez la consommation actuelle et prévisionnelle de jetons sur une période de 12 à 36 mois. L'analyse du seuil de rentabilité nécessite un horizon temporel pluriannuel pour amortir correctement les investissements.

- Sensibilité des données : Déterminez si les préoccupations liées à la confidentialité des données, à la conformité réglementaire ou à la propriété intellectuelle imposent l'auto-hébergement indépendamment des considérations de coût.

- Exigences de latence : Les applications nécessitant des temps de réponse inférieurs à 100 ms peuvent avoir besoin d'une inférence locale indépendamment de la rentabilité.

- Besoins de personnalisation du modèle : Un réglage fin poussé, une formation continue ou des modifications de l'architecture du modèle nécessitent une infrastructure auto-hébergée avec un accès complet au modèle.

- Capacités techniques : L'auto-hébergement exige une expertise en ingénierie du ML, en DevOps et en infrastructure. Les organisations qui ne possèdent pas ces compétences doivent faire face à des coûts importants de recrutement ou de conseil, ce qui a un impact sur le calcul du coût total de possession (TCO).

- Disponibilité des capitaux : L'infrastructure sur site exige un investissement initial important. Le déploiement autonome hébergé dans le cloud réduit les besoins en capitaux tout en conservant certains avantages de coûts par rapport aux API à grande échelle.

Questions fréquemment posées

Combien coûte l'exécution d'un serveur LLM ?

Les coûts des API cloud varient de $0,0015 à $6 par million de jetons, selon le modèle. L'auto-hébergement nécessite entre $50 000 et $287 000 par an pour une infrastructure cloud, et entre $350 000 et $550 000 pour un déploiement sur site, incluant le matériel, l'alimentation et les frais d'exploitation. Les coûts sont proportionnels à la taille du modèle, aux exigences de débit et au volume d'utilisation.

À quel moment les LLM auto-hébergés deviennent-ils moins chers que les API cloud ?

Le seuil de rentabilité se situe généralement entre 500 millions et 1 milliard de jetons par mois pour les déploiements en entreprise. En dessous de ce seuil, les API cloud restent plus rentables grâce à l'absence de frais initiaux et à leur simplicité d'utilisation. Au-delà de ce volume, une infrastructure auto-hébergée permet de réaliser des économies de 30 à 501 milliards de jetons sur trois ans.

Quels sont les coûts cachés d'un LLM auto-organisé ?

Au-delà des coûts liés au matériel et à l'infrastructure cloud, l'auto-hébergement engendre des dépenses de personnel DevOps, une consommation d'énergie (de $2 000 à $4 000 par an pour les grands systèmes GPU), des besoins en refroidissement ajoutant 30 à 50% aux coûts énergétiques, des systèmes de sauvegarde, de la bande passante réseau, des outils de surveillance et une dépréciation du matériel avec des cycles de remplacement tous les 3 à 5 ans.

Est-il possible de suivre un LLM à domicile à moindre coût ?

Les modèles plus petits, dont les paramètres sont inférieurs à 13 milliards, fonctionnent avec du matériel grand public à un coût modeste, principalement lié à l'électricité (entre 50 et 200 € par mois selon l'utilisation et les tarifs locaux). Les modèles plus grands nécessitent des configurations GPU professionnelles dont le coût (matériel entre 3 000 et 15 000 €) s'ajoute aux frais d'électricité. Pour un usage personnel et l'expérimentation, cette solution peut s'avérer économique, mais les déploiements en production requièrent une infrastructure d'entreprise.

Comment les différents fournisseurs de LLM se comparent-ils en termes de prix ?

OpenAI facture $30 à $60 par million de jetons pour GPT-4 et $1,50 à $2 pour GPT-3.5 Turbo. Amazon Bedrock et Google Vertex AI proposent des tarifs comparables, avec des variations selon les modèles et les niveaux de consommation. Les API de traitement par lots offrent des remises de 30 à 50 TP3T pour les charges de travail non critiques en termes de temps chez la plupart des fournisseurs.

Quels sont les facteurs qui ont le plus d'impact sur les coûts d'inférence des modèles linéaires à longue durée de vie (LLM) ?

Le volume de jetons représente le principal facteur de coût des API cloud. Pour les déploiements auto-hébergés, la taille du modèle détermine les besoins matériels, tandis que les besoins en débit dictent la taille de l'infrastructure. La quantification (4 bits, 8 bits ou pleine précision) influe sur les besoins en mémoire et les coûts matériels. Des stratégies d'ingénierie et de mise en cache rapides peuvent réduire la consommation de jetons (15 à 40%).

L'auto-hébergement de programmes LLM open source est-il judicieux ?

Les modèles open source éliminent les frais d'API par jeton, mais nécessitent toujours des investissements en infrastructure. Pour des volumes inférieurs à 100 millions de jetons par mois, les API cloud restent plus économiques. Au-delà de 500 millions de jetons par mois, les modèles ouverts auto-hébergés permettent de réaliser des économies substantielles malgré leur complexité opérationnelle. Les exigences en matière de confidentialité des données peuvent justifier l'auto-hébergement, indépendamment du seuil de rentabilité.

Conclusion

Les coûts des serveurs LLM nécessitent un cadre de décision complexe, aucune solution unique ne convenant à tous les cas de figure. Les API cloud offrent une commodité et une rentabilité inégalées pour les volumes faibles à moyens. L'auto-hébergement exige un investissement initial important, mais génère des économies à long terme à grande échelle.

Le seuil de rentabilité se situe généralement autour de 500 millions de jetons par mois, mais les exigences en matière de confidentialité, de latence et de personnalisation des modèles peuvent primer sur la simple optimisation financière. Les organisations doivent calculer le coût total de possession sur plusieurs années en tenant compte des dépenses opérationnelles cachées, au-delà des simples coûts d'infrastructure.

Les stratégies d’optimisation des coûts — ingénierie rapide, traitement par lots, sélection de modèles, quantification et mise en cache — s’appliquent quel que soit le choix de déploiement et peuvent réduire les dépenses 30-70% lorsqu’elles sont mises en œuvre de manière systématique.

À l'avenir, les coûts d'inférence continueront de diminuer grâce à l'amélioration du matériel et des algorithmes. Les modèles open source créent une concurrence qui profite aux organisations capables d'héberger elles-mêmes leurs services à grande échelle. Le cadre de décision reste inchangé : privilégier les API cloud, surveiller la croissance de la consommation de jetons et envisager l'auto-hébergement lorsque les volumes justifient un investissement dans l'infrastructure.

Prêt à optimiser les coûts LLM pour votre cas d'utilisation spécifique ? Calculez les volumes de jetons prévus, évaluez les exigences en matière de confidentialité des données et modélisez le coût total de possession selon les options de déploiement. Le choix le plus judicieux dépend de vos contraintes propres, mais grâce à des données de coûts réalistes, cette décision devient beaucoup plus claire.