Kurzzusammenfassung: Die Serverkosten für LLM variieren stark: Cloud-APIs wie OpenAI berechnen je nach Modell $0,03 bis $6 pro 1 Million Token, während für eine leistungsfähige Infrastruktur jährlich $50.000 bis $287.000 Token erforderlich sind. Der Break-Even-Punkt liegt bei Unternehmensimplementierungen typischerweise bei über 500 Millionen Token monatlich. Die Kostenoptimierung hängt vom Nutzungsvolumen, den Datenschutzanforderungen und der Priorität ab: minimale Anfangsinvestitionen oder langfristige Einsparungen.

Die Wirtschaftlichkeit des Betriebs großer Sprachmodelle ist zu einer entscheidenden Geschäftsfrage geworden. Laut Wettbewerbsberichten haben sich die Ausgaben von Unternehmen für LLM-APIs bis 2025 auf 1,4 Billionen US-Dollar verdoppelt. Dennoch fragen sich viele Organisationen, ob Cloud-Anbieter oder selbst gehostete Infrastruktur finanziell sinnvoller sind.

Laut Wettbewerbsanalysen, die sich auf den Enterprise AI Report 2025 von Kong beziehen, nennen 441.300 Unternehmen Datenschutz und Datensicherheit als größtes Hindernis für die Einführung von LLM (Learning Learning Management). Jede Anfrage an externe APIs berührt Server außerhalb der Kontrolle des Unternehmens. Diese Datenschutzbedenken veranlassen viele Teams zum Selbsthosting, doch die Infrastrukturkosten stellen eine zusätzliche finanzielle Herausforderung dar.

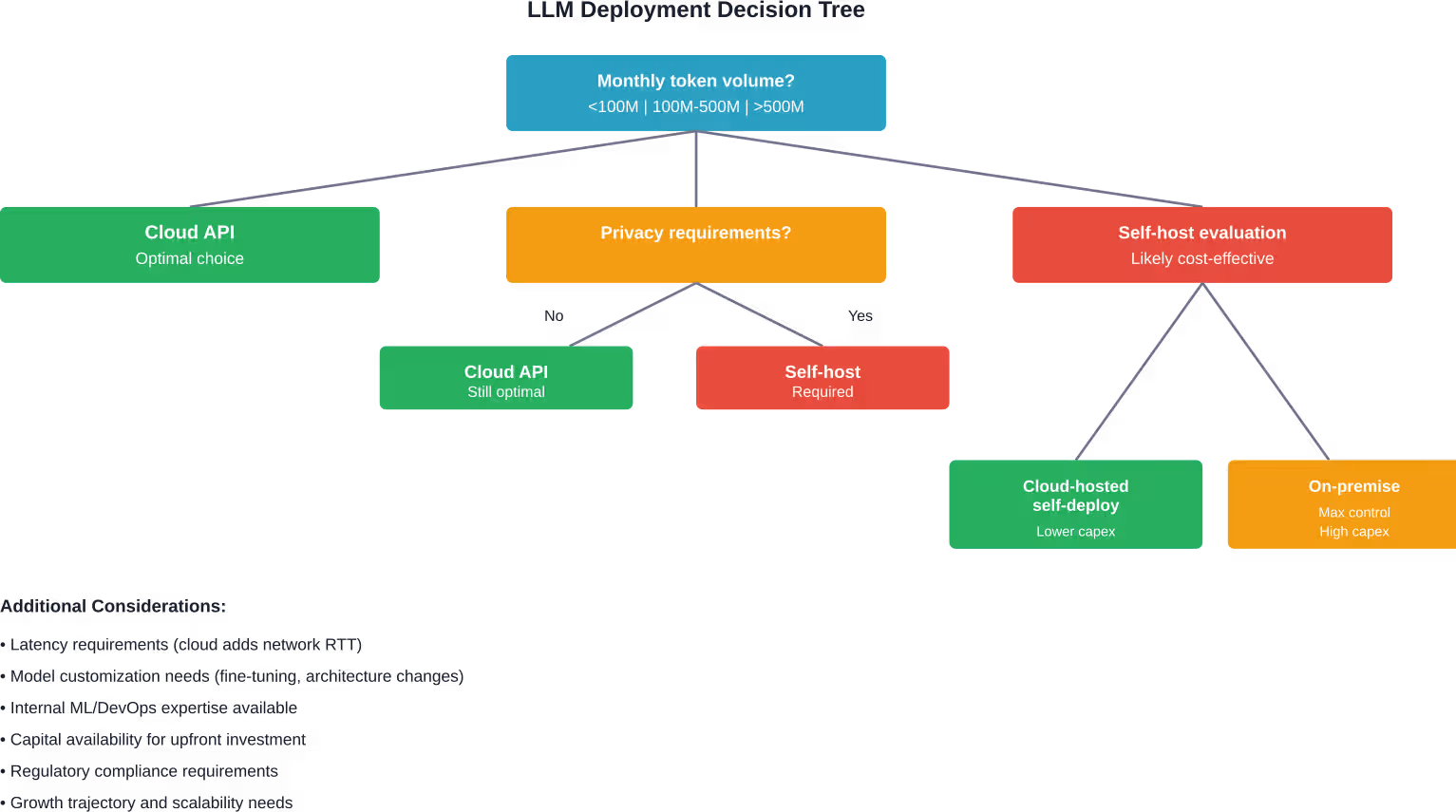

Die Rechnung ist nicht einfach. Cloud-APIs verursachen zwar keine Vorabkosten, aber die Ausgaben steigen mit zunehmender Größe. Selbsthosting erfordert erhebliche Investitionen, verspricht aber langfristige Einsparungen. Der Break-Even-Punkt hängt vom Nutzungsvolumen, der Modellgröße und den betrieblichen Anforderungen ab.

LLM-Preismodelle verstehen

Cloud-Anbieter haben sich auf tokenbasierte Preisgestaltung geeinigt. OpenAI berechnet für GPT-4 $0,03 pro 1.000 Eingabe-Token und $0,06 pro 1.000 Ausgabe-Token. GPT-3.5 Turbo ist mit $0,0015 pro 1.000 Eingabe-Token deutlich günstiger.

Doch was bedeutet das konkret für reale Arbeitslasten? Ein einzelnes Kundensupportgespräch kann 2.000 bis 5.000 Tokens verbrauchen. Bei Tausenden von Gesprächen täglich summieren sich die Kosten schnell.

Die Token-Kosten variieren je nach Anbieter und Modell erheblich. Laut OpenAI-Dokumentation kostet ein Audio-Token in der Realtime API 1 Token pro 100 Millisekunden für Nutzernachrichten, während die Audioausgabe von Assistenten mit 1 Token pro 50 Millisekunden berechnet wird. Diese Unterschiede zwischen den Modalitäten führen zu einer Preiskomplexität, die leicht unterschätzt wird.

Preisstrukturen der wichtigsten Cloud-Anbieter

Amazon Bedrock verwendet ein ähnliches tokenbasiertes Preismodell, wobei die Preise vom gewählten Basismodell abhängen. Die Preise variieren je nach Modalität, Anbieter und Modellstufe. Google Cloud Vertex AI bietet vergleichbare Preisstrukturen und Standard-PayGo-Verbrauchsoptionen, die die Durchsatzkapazität basierend auf den Ausgaben des Unternehmens über einen Zeitraum von 30 Tagen anpassen.

Aber das Problem ist: Bei der Preisgestaltung in der Cloud geht es nicht nur um die Kosten pro Token. Anbieter implementieren Nutzungsstufen, Rabatte für die Stapelverarbeitung und regionale Unterschiede, die einen direkten Vergleich erschweren.

Laut der Dokumentation zur Kostenoptimierung von OpenAI bieten die Batch-API und die flexible Verarbeitung zusätzliche Kostensenkungsmechanismen, die über die Standardpreise hinausgehen. Die Batch-Verarbeitung kann die Kosten für nicht zeitkritische Workloads mit flexiblen Latenzanforderungen reduzieren.

| Anbieter | Modellbeispiel | Inputkosten (pro 1 Million Token) | Ausgabekosten (pro 1 Million Token) | Besondere Merkmale |

|---|---|---|---|---|

| OpenAI | GPT-4 | $30 | $60 | Echtzeit-API, Stapelverarbeitung |

| OpenAI | GPT-3.5 Turbo | $1.50 | $2.00 | Geringere Kosten, schnellere Schlussfolgerungen |

| Amazonas-Felsgrund | Verschiedene Anbieter | Variiert je nach Modell | Variiert je nach Modell | Zugang über mehrere Anbieter |

| Google Vertex AI | Gemini-Modelle | Variiert je nach Stufe | Variiert je nach Stufe | Nutzungsbasierte Tarif-Upgrades |

Versteckte Kosten bei Cloud-LLM-Dienstleistungen

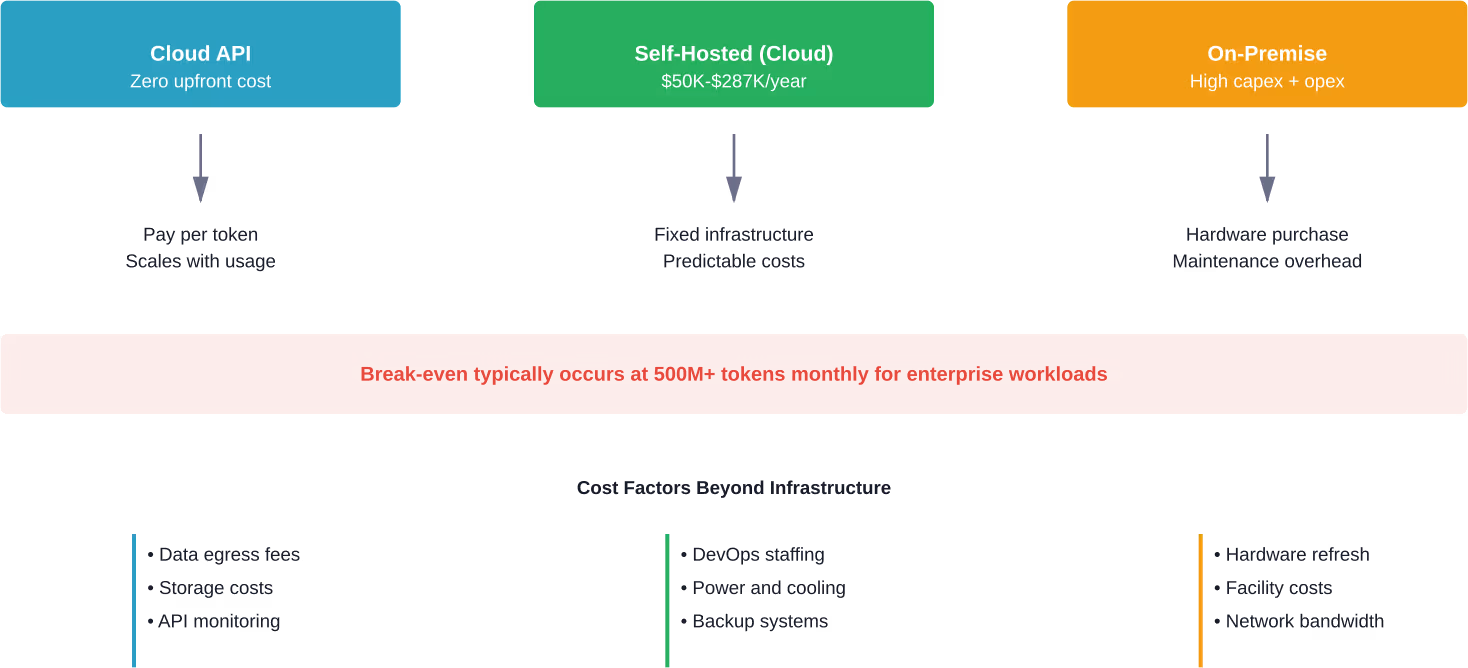

Die Token-Preisgestaltung stellt nur einen Teil der finanziellen Aspekte dar. Cloud-Implementierungen verursachen Kosten, die auf den ersten Preisseiten nicht erscheinen.

Bei der Übertragung großer Datenmengen fallen Gebühren für den Datenexport an. Speicherkosten entstehen für Gesprächsprotokolle und Trainingsdaten. Überwachungs- und Observability-Tools verursachen zusätzlichen Aufwand. Für Produktionssysteme, die einen garantierten Durchsatz erfordern, ersetzen Preismodelle mit reservierter Kapazität die bisherige Abrechnung pro Token durch feste Zusagen.

Diskussionen in Community-Plattformen wie LocalLLaMA zeigen die Frustration über unvorhersehbare Cloud-Kosten. Nutzungsmuster, die während der Testphase angemessen erscheinen, können im Produktivbetrieb mit zunehmender Parallelität explosionsartig ansteigen.

Kosten für die Selbsthosting-Infrastruktur

Das Versprechen von selbstgehosteten LLM-Studiengängen liegt in den langfristigen Kosteneinsparungen und der Datenkontrolle. Die anfängliche Investition ist jedoch beträchtlich, und die Betriebskosten fallen dauerhaft an.

Laut Community-Diskussionen kostet der Betrieb von Qwen-2.5 32B oder QwQ 32B auf AWS g5.12xlarge-Instanzen (4x A10G-GPUs) im Dauerbetrieb jährlich etwa 1,4 Tsd. 50.000 USD. Llama-3 70B auf p4d.24xlarge-Instanzen (8x A100-GPUs) soll im Dauerbetrieb jährlich etwa 1,4 Tsd. 287.000 USD kosten.

Diese Zahlen basieren auf der Annahme einer Cloud-Infrastruktur. Lokale Hardware verändert die Wirtschaftlichkeit grundlegend.

Hardwareanforderungen und Kapitalkosten

Die Bandbreite moderner Consumer-CPUs – Dual-Channel-DDR5-6400 mit rund 100 GB/s – ist im Vergleich zum GPU-Durchsatz von über 1,7 TB/s deutlich geringer. Apple Silicon bildet hier eine Ausnahme: Die Unified Memory Architecture bietet eine höhere Bandbreite, doch die Skalierung von Apple-Hardware für produktive Anwendungen stößt an praktische Grenzen.

Als Faustregel gilt: Bei 4-Bit-Quantisierung benötigt man etwa 0,5 GB VRAM pro Milliarde Parameter. Vollpräzision mit FP16 verdoppelt diesen Bedarf. Ein Modell mit 70 Milliarden Parametern benötigt in 4-Bit-Quantisierung mindestens 35 GB VRAM. Das Modell muss in den VRAM passen, um eine angemessene Inferenzgeschwindigkeit zu gewährleisten; andernfalls greift das System auf die CPU-Verarbeitung zurück, die 10- bis 100-mal langsamer abläuft.

Laut Community-Diskussionen liegen die minimalen internen Implementierungskosten zwischen 125.000 und 190.000 Tsd. pro Jahr, während kundenorientierte Funktionen mittleren Umfangs jährlich zwischen 500.000 und 820.000 Tsd. pro Jahr kosten. Die Kosten für die Kernprodukt-Engines im Enterprise-Bereich liegen deutlich über diesen Zahlen.

Betriebskosten jenseits der Hardware

Die Infrastruktur stellt nur den Anfang dar. Selbsthosting erfordert qualifiziertes DevOps-Personal, laufende Wartung, Stromversorgung und Kühlung, Backup-Systeme und eine Netzwerkinfrastruktur.

Der Stromverbrauch von GPU-Servern ist beträchtlich. Ein System mit 8 A100-Grafikkarten kann unter Last 3–5 kW verbrauchen, was je nach lokalem Tarif jährliche Stromkosten von 2.000–4.000 £ verursacht. Der Kühlbedarf erhöht den Stromverbrauch um weitere 30–50 £.

Aber Moment mal. Hardware altert. GPUs verlieren mit dem Aufkommen neuerer Architekturen schnell an Wiederverkaufswert. Ein dreijähriger Abschreibungszyklus bedeutet, dass sich die Investitionskosten jährlich amortisieren, zuzüglich der späteren Ersatzkosten.

Aufschlüsselung der Gesamtbetriebskosten

Um die Kosten von Cloud- und Eigenhosting-Lösungen zu vergleichen, müssen die Gesamtbetriebskosten über realistische Zeiträume berechnet werden. Die Analyse ändert sich je nach Nutzungsvolumen erheblich.

Für Anwendungen mit geringem Transaktionsvolumen (unter 10 Millionen Token pro Monat) sind Cloud-APIs wirtschaftlich unschlagbar. Bei GPT-3.5-Turbo-Raten von $1,50 pro Million eingegebener Token bleiben die monatlichen Kosten unter $20. Infrastrukturinvestitionen sind in diesem Umfang finanziell nicht sinnvoll.

Die Berechnung ändert sich bei moderater Nutzung. Die Verarbeitung von 100 Millionen Token monatlich auf GPT-3.5 Turbo kostet etwa $150-200. Über drei Jahre ergibt das $5.400-7.200 – immer noch deutlich unter den minimalen Kosten einer eigenen Infrastruktur.

Der Break-Even-Punkt

Analysen deuten darauf hin, dass der Break-even-Punkt bei Unternehmensimplementierungen typischerweise bei etwa 500 Millionen bis 1 Milliarde Token pro Monat erreicht wird. Bei diesem Volumen belaufen sich die Cloud-Kosten je nach verwendetem Modell auf 15.000 bis 60.000 Token pro Monat. Jährlich sind das 180.000 bis 720.000 Token pro Jahr.

Eine selbstgehostete Infrastruktur mit jährlichen Kosten von 125.000 bis 190.000 INR für einen minimalen Einsatz wird wirtschaftlich sinnvoll. Über einen Zeitraum von drei Jahren können On-Premise-Lösungen im Vergleich zu Cloud-Diensten bei hohem Datenaufkommen Einsparungen von 30 bis 50 INR ermöglichen.

Kommt Ihnen das bekannt vor? Dies entspricht Mustern, die in Community-Analysen zum Vergleich von Cloud- und On-Premise-Bereitstellungen im großen Maßstab festgestellt wurden.

| Monatliches Tokenvolumen | Cloud-API-Kosten (GPT-3.5) | Cloud-API-Kosten (GPT-4) | Selbsthosting-Schätzung | Empfohlene Vorgehensweise |

|---|---|---|---|---|

| 10 Millionen Token | $15-20 | $300-600 | N / A | Cloud-API |

| 100 Millionen Token | $150-200 | $3,000-6,000 | N / A | Cloud-API |

| 500 Millionen Token | $750-1,000 | $15,000-30,000 | $10.400/Monat | Erwägen Sie Selbsthosting. |

| Mehr als 1 Milliarde Token | $1,500-2,000 | $30,000-60,000 | $10.400-15.800/Monat | Selbsthosting ist wahrscheinlich günstiger |

Versteckte Variablen in TCO-Berechnungen

Die Standard-Break-Even-Analyse vernachlässigt entscheidende Faktoren. Datenschutzbestimmungen können unabhängig von der Kosteneffizienz eine Eigenhosting-Lösung erzwingen. Regulatorische Vorgaben im Gesundheitswesen, Finanzsektor oder im öffentlichen Dienst schreiben häufig eine On-Premise-Infrastruktur vor.

Latenzanforderungen verändern die Rahmenbedingungen. Cloud-API-Aufrufe führen zu Netzwerk-Roundtrip-Zeiten. Für Echtzeitanwendungen, die Antwortzeiten unter 100 ms erfordern, ist lokale Inferenz unabhängig von Kostenüberlegungen notwendig.

Die Modellanpassung eröffnet eine weitere Dimension. Cloud-Anbieter bieten nur begrenzte Feinabstimmungsmöglichkeiten. Organisationen, die eine umfassende Modellanpassung benötigen, benötigen eine Infrastruktur, die benutzerdefinierte Trainingspipelines unterstützt, was die Komplexität und die Kosten erheblich erhöht.

Strategien zur Kostenoptimierung

Unabhängig von der gewählten Bereitstellungsmethode können Kostenoptimierungstechniken die LLM-Kosten erheblich senken. Laut der Dokumentation von OpenAI zur Kostenoptimierung führen mehrere Strategien beständig zu Einsparungen.

Reduzierung des Tokenverbrauchs

Jeder Token kostet Geld. Durch die Minimierung des Tokenverbrauchs lassen sich die Kosten direkt senken. Kürzere Eingabeaufforderungen liefern die gleichen Ergebnisse zu geringeren Kosten. Das Entfernen unnötiger Kontextinformationen, Beispiele und ausführlicher Anweisungen reduziert die Anzahl der Token, ohne die Ausgabequalität zu beeinträchtigen.

Die Optimierung von Eingabeaufforderungen wird so zu einer wirtschaftlichen Maßnahme. Das Testen verschiedener Formulierungen, um mit weniger Token identische Ergebnisse zu erzielen, generiert einen sofortigen ROI. Eine Reduzierung der durchschnittlichen Eingabeaufforderungslänge um 20% führt direkt zu Kosteneinsparungen in Höhe von 20%.

Das Zwischenspeichern häufig verwendeter Kontextinformationen reduziert die redundante Tokenverarbeitung. Viele Anbieter unterstützen mittlerweile das Prompt-Caching, bei dem wiederholte Kontextabschnitte nicht auf das Tokenlimit nachfolgender Anfragen angerechnet werden.

Stapelverarbeitung und asynchrone Arbeitslasten

Die Batch-API von OpenAI bietet deutlich reduzierte Preise für nicht zeitkritische Workloads. Die asynchrone Verarbeitung von Anfragen bei flexiblen Latenzanforderungen ermöglicht erhebliche Preisnachlässe.

Die Batch-API verarbeitet Massenanfragen innerhalb eines 24-Stunden-Fensters. Für Aufgaben wie Inhaltsanalyse, Datenanreicherung oder Batch-Zusammenfassung senkt dieser Ansatz die Kosten bei gleichbleibendem Durchsatz.

Ähnliche Stapelverarbeitungsfunktionen sind bei verschiedenen Anbietern vorhanden. Amazon SageMaker unterstützt Stapelverarbeitungsaufträge. Google Vertex AI bietet Stapelvorhersage-Endpunkte zu günstigeren Preisen als Online-Inferenz.

Modellauswahl und Quantisierung

Kleinere Modelle sind pro Token günstiger und laufen schneller. GPT-3.5 Turbo kostet etwa 51 TP3T im Vergleich zu GPT-4. Bei Aufgaben, die von kleineren Modellen abgedeckt werden, summieren sich die Kosteneinsparungen bei der Skalierung enorm.

Bei selbstgehosteten Installationen reduziert die Quantisierung die Hardwareanforderungen drastisch. Die 4-Bit-Quantisierung halbiert den Speicherbedarf im Vergleich zur 8-Bit-Quantisierung und ermöglicht so größere Modelle auf gleicher Hardware. Laut technischen Diskussionen ist der Genauigkeitsverlust durch die Quantisierung für die meisten Anwendungen minimal.

Eine auf arXiv veröffentlichte Studie untersucht Techniken zur Steuerung von LLM-Modellen, bei denen kleine Sprachmodelle die meisten Anfragen bearbeiten, während größere Modelle nur bei Bedarf Hinweise liefern. Selbst kleine Hinweise (10–301 TpT vollständige LLM-Antworten) führen zu deutlichen Genauigkeitssteigerungen. Dieser hybride Ansatz ermöglicht drastische Kostensenkungen bei gleichbleibender Ausgabequalität.

Cloud-Hosting vs. Selbsthosting optimieren, bevor sich die Kosten festlegen

Die Wahl zwischen Cloud- und selbstgehosteter LLM-Infrastruktur ist selten nur eine Preisfrage. Die Kosten hängen davon ab, wie Modelle trainiert, bereitgestellt und im Laufe der Zeit genutzt werden, einschließlich Datenpipelines, Skalierungsstrategie und Systemeffizienz. AI Superior arbeitet über den gesamten Lebenszyklus hinweg, von der Datenaufbereitung und Modellauswahl bis hin zur Bereitstellung und Optimierung, und hilft Teams dabei, Setups zu entwerfen, die der tatsächlichen Nutzung und nicht der theoretischen Kapazität entsprechen.

In der Praxis bedeutet dies oft, zu entscheiden, wo Cloud-Lösungen sinnvoll sind, wo Selbsthosting gerechtfertigt ist und wie man in beiden Fällen unnötige Kosten vermeidet. Der Fokus liegt auf dem Aufbau von Systemen, die im Produktivbetrieb zuverlässig laufen, nicht nur auf dem Vergleich der Infrastrukturkosten. Wenn Sie Cloud-Lösungen mit Selbsthosting vergleichen oder bereits steigende Kosten feststellen, sollten Sie Ihre Architektur frühzeitig überprüfen. Wenden Sie sich an uns. AI Superior um Ihre aktuelle Situation zu bewerten, bevor die Kosten weiter steigen.

Optimierung der Infrastrukturleistung

Bei selbstgehosteten Bereitstellungen wirkt sich die Hardwareauslastung direkt auf die Kosteneffizienz aus. Laut AWS-Ankündigungen bietet der Amazon SageMaker Large Model Inference Container v15, basierend auf vLLM 0.8.4 mit Unterstützung für die vLLM V1-Engine, die V1-Engine, die einen höheren Durchsatz als die vorherige V0-Engine ermöglicht.

Die V1-Engine beinhaltet einen asynchronen Modus, der direkt mit der AsyncLLMEngine von vLLM integriert ist. Dadurch entsteht eine effizientere Hintergrundschleife, die eingehende Anfragen kontinuierlich verarbeitet und so einen höheren Durchsatz als die vorherige Rolling-Batch-Implementierung ermöglicht. Diese Infrastrukturverbesserungen führen direkt zu Kosteneinsparungen, da mit der gleichen Hardware mehr Inferenzkapazität erzielt wird.

Hardware-Architekturoptionen

AWS Graviton-Prozessoren bieten kosteneffiziente Alternativen für kleinere Modelle. Analysen von AWS zeigen, dass die Ausführung kleiner Sprachmodelle auf Graviton3-basierten Instanzen (ml.c7g-Serie) mit llama.cpp für Graviton-optimierte Inferenz und vorquantisierten GGUF-Formatmodellen erhebliche Kosteneinsparungen für geeignete Workloads ermöglicht.

Die auf der NVIDIA Blackwell-Architektur basierenden A4-VMs von Google Cloud stellen die neueste Hochleistungsoption dar. Laut Fallstudien erzielte Baseten auf der A4-Infrastruktur im Vergleich zur Vorgängergeneration ein um über 2251 TP3T besseres Preis-Leistungs-Verhältnis beim Betrieb beliebter Modelle wie DeepSeek V3, DeepSeek R1 und Llama 4 Maverick.

Die Hardwareauswahl hängt von der Modellgröße und den Durchsatzanforderungen ab. Kleinere Modelle mit weniger als 13 Byte Parametern laufen effizient auf CPU-basierten Instanzen. Mittelgroße Modelle (13–70 Byte Parameter) profitieren von Single- oder Multi-GPU-Systemen. Große Modelle mit mehr als 70 Byte Parametern erfordern Multi-GPU-Konfigurationen oder Strategien zur Modellparallelisierung.

Dynamische Arbeitslastplanung

Der dynamische Workload-Scheduler von Google Cloud optimiert die Ressourcennutzung bei unterschiedlichen Verkehrsmustern. Anstatt kontinuierlich Spitzenkapazität bereitzustellen, skaliert die dynamische Planung die Ressourcen bedarfsgerecht.

Diese Funktion ist besonders wichtig für Workloads mit stark schwankendem Datenverkehr. Anwendungen mit täglichen oder wöchentlichen Nutzungsmustern verschwenden bei statischer Bereitstellung Ressourcen in Zeiten geringen Datenverkehrs. Dynamische Planung kann die Infrastrukturkosten für Workloads mit ausgeprägter Variabilität um 40 bis 601 Tsd. 300 Tsd. senken.

Kostenbeispiele aus der Praxis

Theoretische Analysen haben ihre Grenzen. Reale Implementierungskosten liefern konkrete Anhaltspunkte.

In Community-Diskussionen wird von minimalen Produktionsimplementierungen mit jährlichen Kosten von 125.000 bis 190.000 £ berichtet. Dies deckt typischerweise interne Tools und ein moderates Anfragevolumen ab – Tausende von Anfragen täglich, nicht Millionen.

Kundenorientierte Funktionen mittleren Umfangs erreichen laut denselben Analysen jährlich $500.000 bis 820.000 Aufrufe. Dieser Umfang ermöglicht die Bewältigung eines signifikanten Produktionsdatenverkehrs mit akzeptablen Latenz- und Verfügbarkeitsgarantien.

Implementierungen im Unternehmensmaßstab

Große Organisationen, die LLMs als zentrale Produktinfrastruktur einsetzen, berichten von Kosten, die weit über diesen Spannen liegen. Jährliche Investitionen in Millionenhöhe sind typisch für Anforderungen mit hohem Datenvolumen und geringer Latenz in verteilten geografischen Regionen.

Eine Studie von arXiv zur Ökonomie von Inferenzdaten liefert Basisberechnungen. Am Beispiel der A800 80GB und unter gängigen Annahmen belaufen sich die stündlichen Basiskosten pro Karte auf etwa $0,79/Stunde, im Allgemeinen zwischen $0,51 und 0,99/Stunde. Große Cloud-Plattformen berechnen typischerweise ein Vielfaches dieses Basiswertes, um Betriebskosten und Margen zu decken.

Diese Kosten pro Grafikkarte multiplizieren sich mit der Anzahl der für größere Modelle benötigten GPUs. Ein System mit 8 GPUs verursacht bei Basistarifen Kosten von ca. $6,32/Stunde, was bei kontinuierlichem Betrieb jährlichen Kosten von $55.366 entspricht – ohne Berücksichtigung von Strom-, Kühlungs-, Netzwerk- und Personalkosten.

Vergleich von Cloud und On-Premise im großen Maßstab

Eine Analyse, die die Wirtschaftlichkeit von Cloud-Lösungen im Vergleich zu On-Premise-Lösungen untersucht, kommt zu dem Ergebnis, dass On-Premise-Systeme, die eine gleichwertige Kapazität wie Cloud-Implementierungen mit hohem Datenvolumen bieten, Vorab-Kapitalkosten von etwa $833,806 für eine H100-basierte Infrastruktur erfordern.

Über drei Jahre amortisiert sich diese Kapitalinvestition auf jährlich ca. 1.400.277.935. Hinzu kommen die Betriebskosten – Strom, Kühlung, Wartung, Personal – und die jährlichen Gesamtkosten belaufen sich für eine unternehmensgerechte On-Premise-Implementierung auf 350.000 bis 450.000.

Vergleichen Sie das mit den Kosten für Cloud-APIs bei vergleichbarem Volumen. Die Verarbeitung von 5 Milliarden Token monatlich auf GPT-4 kostet etwa 150.000–300.000 Token pro Monat bzw. 1,8–3,6 Millionen Token pro Jahr. Bei dieser Größenordnung wird der Break-even-Punkt für eine On-Premise-Lösung deutlich.

| Einsatzszenario | Jährliche Kosten der Cloud-API | Jährliche Kosten für selbstgehostete Cloud | Jährliche Kosten vor Ort |

|---|---|---|---|

| Klein (100 Mio. Token/Monat) | $2,400 | Nicht wirtschaftlich | Nicht wirtschaftlich |

| Mittel (500 Mio. Token/Monat) | $12,000-360,000 | $125,000-190,000 | $350,000-450,000 |

| Groß (2 Milliarden Token/Monat) | $48,000-1,4M | $287,000-400,000 | $350,000-450,000 |

| Enterprise (5 Milliarden+ Token/Monat) | $1.8M-3.6M | $400,000-600,000 | $400,000-550,000 |

Kosten für Datenschutz und Compliance

Die Finanzanalyse allein erfasst nicht den gesamten Entscheidungsprozess. Datenschutz und regulatorische Vorgaben stellen Anforderungen, die die reine Kostenoptimierung außer Kraft setzen.

Organisationen im Gesundheitswesen, die den HIPAA-Bestimmungen unterliegen, sehen sich mit strengen Anforderungen an den Umgang mit Daten konfrontiert. Die Übermittlung von Patientendaten an externe APIs birgt Compliance-Herausforderungen, deren Bewältigung mitunter extrem komplex oder kostspielig sein kann. Selbsthosting wird daher trotz möglicher Kostenineffizienz bei geringeren Datenmengen zwingend erforderlich.

Auch Finanzdienstleister sehen sich durch Regulierungen wie die DSGVO, PCI-DSS und branchenspezifische Anforderungen ähnlichen Beschränkungen gegenüber. Die Kosten von Compliance-Verstößen – sowohl finanzielle Strafen als auch Reputationsschäden – übersteigen die Infrastrukturkosten bei Weitem.

Quantifizierung des Datenschutzwertes

Welchen finanziellen Wert hat Datenschutz? Diese Berechnung hängt vom jeweiligen Geschäftskontext ab. Bei Verbraucheranwendungen, die unkritische Daten verarbeiten, sind die Vorteile des Datenschutzes möglicherweise gering. Für Unternehmen, die geschützte Informationen, geistiges Eigentum oder regulierte Daten verwalten, ist der Wert des Datenschutzes hingegen erheblich.

Manche Organisationen akzeptieren das Zwei- bis Dreifache der Kosten für selbstgehostete Infrastruktur allein aus Gründen der Datensouveränität. Andere fordern unabhängig von den damit verbundenen Kosten vollständig abgeschottete Systeme ohne externe Anbindung.

Die Liste 44% von Organisationen, die Datenschutz als größtes Hindernis für die Einführung von LLM-Programmen nennen, spiegelt diese Abwägung wider. Kosteneffizienz ist wichtig, aber nicht auf Kosten grundlegender Sicherheits- und Compliance-Anforderungen.

Langfristige Kostentrends

Die Ökonomie des LLM entwickelt sich weiterhin rasant. Die Inferenzkosten sind mit der Verbesserung der algorithmischen Effizienz und den Fortschritten in der Hardware erheblich gesunken.

Eine Studie des MIT zur algorithmischen Effizienz und sinkenden Kosten für KI-Inferenz ergab, dass sich die Trends bei Modellen mit geschlossener Gewichtung etwas schneller entwickeln als bei Modellen mit offener Gewichtung. Dies ist besonders ausgeprägt bei Modellen mit geschlossener Gewichtung der Gruppe 40%-60%, wo plötzliche Preisrückgänge auftreten, die sich bei Modellen mit offener Gewichtung nicht widerspiegeln. Dies deutet auf nicht-technische Wettbewerbseffekte hin.

Mooresches Gesetz und die Beschleunigung der KI

Die Hardwareleistung verbessert sich kontinuierlich. NVIDIAs Blackwell-Architektur bietet deutliche Leistungssteigerungen gegenüber früheren Generationen. Googles TPU-Entwicklungen und spezialisierte KI-Beschleuniger von Startups sorgen für stetige Leistungsverbesserungen.

Diese Hardware-Fortschritte senken die Kosten auf zweierlei Weise. Erstens bietet neuere Hardware einen höheren Durchsatz an Inferenzdaten pro investiertem Dollar. Zweitens erzeugt der Wettbewerb zwischen Cloud-Anbietern einen Preisdruck, der den Kunden zugutekommt.

Aber Moment mal. Hardwareverbesserungen ermöglichen auch größere und leistungsfähigere Modelle. Der Übergang von GPT-3 zu GPT-4 brachte zwar deutliche Leistungssteigerungen, aber auch höhere Inferenzkosten. Der Trend zu größeren Modellen kann die Effizienzgewinne der Infrastruktur zunichtemachen.

Open-Source-Modell-Ökosystem

Offene Modelle von Meta, Mistral, Alibaba und anderen erhöhen den Wettbewerbsdruck auf die Preisgestaltung proprietärer Modelle. Unternehmen können offene Modelle wie Llama 4, DeepSeek oder Qwen ohne API-Gebühren pro Token einsetzen.

Diese Dynamik beschleunigt die Kostensenkung für Organisationen, die in der Lage sind, ihre Lösungen selbst zu hosten. Die Kluft zwischen den Kosten proprietärer APIs und den Kosten selbstgehosteter offener Modelle vergrößert sich mit steigender Qualität offener Modelle.

Die Analyse verdeutlicht, dass die Annahme, “Open-Source-LLMs” seien kostenlos, ein Irrtum ist. Die Modelle selbst sind zwar lizenzgebührenfrei, die Betriebskosten bleiben jedoch beträchtlich. Die eigentlichen Einsparungen ergeben sich nicht aus einem kostenlosen Betrieb, sondern aus dem Wegfall der Token-Gebühren bei ausreichendem Umfang.

Die Entscheidung zwischen Eigenbau und Kauf treffen

Die kurze Antwort? Es hängt von Volumen, Kapazitäten und Einschränkungen ab.

Cloud-APIs sind für Erkundung, Prototyping und geringe bis mittlere Produktionsvolumina äußerst sinnvoll. Keine Vorabinvestitionen, keine operative Komplexität und sofortiger Zugriff auf modernste Modelle bieten in den meisten Anwendungsfällen einen unschlagbaren Mehrwert.

Selbsthosting wird wirtschaftlich rentabel, wenn das monatliche Token-Volumen konstant 500 Millionen bis 1 Milliarde Token übersteigt. In diesem Umfang amortisieren sich die Infrastrukturkosten effektiv, und die Gesamtbetriebskosten sprechen für eine eigene Infrastruktur anstelle von API-Gebühren.

Entscheidungsrahmen

Berücksichtigen Sie diese Faktoren systematisch:

- Volumen und Maßstab: Berechnen Sie den aktuellen und prognostizierten Tokenverbrauch über einen Zeitraum von 12 bis 36 Monaten. Für eine Break-Even-Analyse sind mehrjährige Zeiträume erforderlich, um die Kapitalinvestitionen korrekt zu amortisieren.

- Datensensibilität: Prüfen Sie, ob Bedenken hinsichtlich Datenschutz, Einhaltung gesetzlicher Bestimmungen oder geistigen Eigentums die Selbsthosting-Lösung unabhängig von den Kosten erfordern.

- Latenzanforderungen: Anwendungen, die Reaktionszeiten unter 100 ms erfordern, benötigen möglicherweise lokale Inferenz unabhängig von der Kosteneffizienz.

- Anforderungen an die Modellanpassung: Umfangreiche Feinabstimmungen, fortlaufendes Training oder Änderungen an der Modellarchitektur erfordern eine selbstgehostete Infrastruktur mit vollem Modellzugriff.

- Technische Fähigkeiten: Selbsthosting erfordert Expertise in den Bereichen ML-Engineering, DevOps und Infrastruktur. Organisationen, denen diese Kompetenzen fehlen, sehen sich mit erheblichen Einstellungs- oder Beratungskosten konfrontiert, die sich auf die Gesamtbetriebskosten auswirken.

- Kapitalverfügbarkeit: Lokale Infrastruktur erfordert erhebliche Vorabinvestitionen. Cloud-basierte Selbstbereitstellung reduziert den Kapitalbedarf und bietet gleichzeitig im großen Maßstab Kostenvorteile gegenüber APIs.

Häufig gestellte Fragen

Wie viel kostet der Betrieb eines LLM-Servers?

Die Kosten für Cloud-APIs liegen je nach Modell zwischen 0,0015 und 6 TTP pro Million Token. Für die Cloud-Infrastruktur fallen bei Selbsthosting jährliche Kosten zwischen 50.000 und 287.000 TTP für die Cloud-Infrastruktur bzw. zwischen 350.000 und 550.000 TTP für die On-Premise-Bereitstellung an (einschließlich Hardware, Strom und Betriebskosten). Die Kosten skalieren mit der Modellgröße, den Durchsatzanforderungen und dem Nutzungsvolumen.

Ab wann ist das Selbsthosting von LLMs günstiger als Cloud-APIs?

Der Break-even-Punkt liegt typischerweise bei monatlich 500 Millionen bis 1 Milliarde Token für Unternehmensimplementierungen. Unterhalb dieser Schwelle bleiben Cloud-APIs aufgrund fehlender Vorabkosten und einfacher Bedienung kostengünstiger. Oberhalb dieses Volumens ermöglicht selbstgehostete Infrastruktur Einsparungen von 30 bis 501 Tsd. Token über einen Zeitraum von drei Jahren.

Welche versteckten Kosten bergen selbstgehostete LLM-Studiengänge?

Neben den Kosten für Hardware und Cloud-Infrastruktur fallen beim Self-Hosting Kosten für DevOps-Personal, Stromverbrauch ($2.000-$4.000 jährlich für große GPU-Systeme), Kühlbedarf, der die Stromkosten um 30-50% erhöht, Backup-Systeme, Netzwerkbandbreite, Überwachungstools und Hardware-Abschreibung mit Austauschzyklen alle 3-5 Jahre an.

Kann ich LLMs kostengünstig von zu Hause aus durchführen?

Kleinere Modelle unterhalb der 13B-Parameter laufen auf handelsüblicher Hardware mit moderaten Kosten – hauptsächlich Stromkosten von 50–200 PKR pro Monat, abhängig von Nutzung und lokalen Tarifen. Größere Modelle benötigen professionelle GPU-Systeme mit Hardwarekosten von 3.000–15.000 PKR zuzüglich laufender Stromkosten. Für den privaten Gebrauch und Experimente kann dies kostengünstig sein, produktive Einsätze erfordern jedoch eine Unternehmensinfrastruktur.

Wie unterscheiden sich die verschiedenen LLM-Anbieter hinsichtlich ihrer Preise?

OpenAI berechnet $30–60 pro Million Token für GPT-4 und $1,50–2,00 für GPT-3.5 Turbo. Amazon Bedrock und Google Vertex AI bieten vergleichbare Preise, die je nach Modell und Nutzungsumfang variieren. Batch-Verarbeitungs-APIs gewähren bei den meisten Anbietern Rabatte von 30–50% für nicht zeitkritische Workloads.

Welche Faktoren beeinflussen die Kosten der LLM-Inferenz am stärksten?

Das Tokenvolumen ist der Hauptkostentreiber für Cloud-APIs. Bei selbstgehosteten Bereitstellungen bestimmt die Modellgröße die Hardwareanforderungen, während der Durchsatzbedarf die Infrastrukturgröße vorgibt. Die Quantisierung (4-Bit vs. 8-Bit vs. volle Genauigkeit) beeinflusst den Speicherbedarf und die Hardwarekosten. Schnelle Entwicklungs- und Caching-Strategien können den Tokenverbrauch reduzieren (15-40%).

Lohnt es sich, Open-Source-LLMs selbst zu hosten?

Open-Source-Modelle eliminieren API-Gebühren pro Token, erfordern aber weiterhin Infrastrukturinvestitionen. Bei einem monatlichen Volumen von unter 100 Millionen Token bleiben Cloud-APIs kostengünstiger. Ab 500 Millionen Token monatlich bieten selbstgehostete Open-Source-Modelle trotz höherer betrieblicher Komplexität erhebliche Einsparungen. Datenschutzbestimmungen können die Selbsthosting-Lösung unabhängig vom Kostendeckungspunkt rechtfertigen.

Schlussfolgerung

Die Kosten für LLM-Server erfordern eine differenzierte Entscheidungsfindung, da es keine allgemeingültige Lösung gibt. Cloud-APIs bieten unübertroffenen Komfort und Kosteneffizienz für geringe bis mittlere Datenmengen. Selbsthosting erfordert zwar erhebliche Vorabinvestitionen, ermöglicht aber langfristig Einsparungen bei großem Umfang.

Der Break-even-Punkt liegt typischerweise bei etwa 500 Millionen Token pro Monat, wobei Datenschutzanforderungen, Latenzbedürfnisse und Anforderungen an die Modellanpassung die rein finanzielle Optimierung in den Hintergrund drängen können. Unternehmen müssen die Gesamtbetriebskosten über mehrere Jahre hinweg berechnen und dabei neben den reinen Infrastrukturkosten auch versteckte Betriebskosten berücksichtigen.

Strategien zur Kostenoptimierung – wie etwa Prompt Engineering, Batch-Verarbeitung, Modellauswahl, Quantisierung und Caching – sind unabhängig von der Wahl des Bereitstellungssystems anwendbar und können die Kosten reduzieren (30-70%), wenn sie systematisch umgesetzt werden.

Mit Blick auf die Zukunft sinken die Inferenzkosten weiter, da sich die Hardware verbessert und die algorithmische Effizienz steigt. Open-Source-Modelle erzeugen Wettbewerbsdruck, von dem Organisationen profitieren, die in der Lage sind, ihre Lösungen in großem Umfang selbst zu hosten. Der Entscheidungsrahmen bleibt unverändert: Beginnen Sie mit Cloud-APIs, überwachen Sie das Wachstum des Tokenverbrauchs und evaluieren Sie das Selbsthosting, sobald die Volumina Investitionen in die Infrastruktur rechtfertigen.

Sie möchten die LLM-Kosten für Ihren spezifischen Anwendungsfall optimieren? Berechnen Sie das prognostizierte Tokenvolumen, bewerten Sie die Anforderungen an den Datenschutz und modellieren Sie die Gesamtbetriebskosten über verschiedene Bereitstellungsoptionen hinweg. Die richtige Wahl hängt von Ihren individuellen Rahmenbedingungen ab – doch mit realistischen Kostendaten wird die Entscheidung deutlich einfacher.