Résumé rapide : L'analyse prédictive en exploration de données combine algorithmes statistiques, apprentissage automatique et données historiques pour prévoir les résultats et les tendances futures. Ce processus extrait des modèles cachés dans de vastes ensembles de données grâce à des techniques d'exploration de données, puis applique des modèles prédictifs pour faciliter la prise de décisions éclairées, réduire les risques et optimiser les opérations dans des secteurs tels que la santé, la finance et le marketing.

Les organisations croulent sous les données, mais manquent cruellement d'informations exploitables. Tel est le paradoxe auquel les entreprises sont confrontées aujourd'hui.

L'analyse prédictive en exploration de données résout ce problème en transformant les données historiques brutes en prévisions exploitables. Cette approche utilise des algorithmes statistiques et des techniques d'apprentissage automatique pour identifier des tendances qui révèlent ce qui est susceptible de se produire à l'avenir.

Selon IBM, l'IA prédictive utilise l'analyse statistique et l'apprentissage automatique pour identifier des tendances, anticiper des comportements et prévoir des événements à venir. Les organisations y ont recours pour prédire les résultats futurs potentiels, les causes et l'exposition aux risques.

La différence entre conjecture et certitude forge un avantage concurrentiel. Voyons comment l'analyse prédictive tire profit de l'exploration des données.

Comprendre les fondements : exploration de données vs analyse prédictive

L'exploration de données et l'analyse prédictive ne sont pas la même chose, même si elles sont étroitement liées.

L'exploration de données vise à découvrir des tendances cachées dans les données historiques. Ce processus examine de vastes ensembles de données afin de révéler des relations, des anomalies et des tendances qui n'étaient pas évidentes auparavant. On peut la considérer comme la phase d'exploration.

L'analyse prédictive exploite ces tendances observées pour prévoir les résultats futurs. C'est la phase d'application qui transforme ces tendances en prédictions.

Le point essentiel est le suivant : impossible d’obtenir une analyse prédictive efficace sans une exploration de données rigoureuse. C’est ce processus d’exploration qui fournit la matière première nécessaire aux modèles prédictifs.

| Aspect | Exploration de données | Analyses prédictives |

|---|---|---|

| Objectif principal | Découvrir des tendances cachées dans les données historiques | Utiliser des modèles pour prédire les résultats futurs |

| Orientation temporelle | Orienté vers le passé | tourné vers l'avenir |

| Sortie principale | Modèles, corrélations, anomalies | Prévisions, probabilités, prédictions |

| Techniques courantes | Clustering, règles d'association, classification | Régression, arbres de décision, réseaux de neurones |

| Question d'entreprise | Que s'est-il passé et pourquoi ? | Que va-t-il se passer ensuite ? |

La recherche sur l'analyse prédictive en tant que composante essentielle de l'exploration de données a suscité un intérêt académique considérable de la part des chercheurs universitaires dans ce domaine.

Utilisez l'analyse prédictive dans l'exploration de données avec l'IA supérieure

IA supérieure Il travaille avec de grands ensembles de données pour construire des modèles prédictifs qui extraient des tendances et facilitent la prise de décision.

L'accent est mis sur le choix de la bonne approche de modélisation et l'intégration des résultats dans les flux de travail existants.

Vous souhaitez appliquer l'analyse prédictive à l'exploration de données ?

AI Superior peut vous aider avec :

- évaluation des sources de données

- construction de modèles prédictifs

- approches de test et d'amélioration

- intégrer les résultats dans les flux de travail

👉 Contactez l'IA supérieure pour discuter de votre projet, de vos données et de votre approche de mise en œuvre

Comment fonctionne réellement le processus

L'analyse prédictive en exploration de données suit un flux de travail systématique. Chaque étape s'appuie sur la précédente.

La première étape consiste à collecter les données. Les organisations recueillent des données historiques pertinentes provenant de sources multiples : bases de données transactionnelles, interactions clients, relevés de capteurs, réseaux sociaux, tout ce qui contient le signal nécessaire à la prédiction.

Vient ensuite la préparation des données. Les données brutes sont souvent désordonnées. Cette étape consiste à corriger les erreurs, à gérer les valeurs manquantes, à supprimer les doublons et à transformer les variables en formats exploitables. Les recherches utilisant des modèles prédictifs ont fait état d'un nettoyage et d'une préparation des données approfondis, ainsi que de l'application de ratios de validation croisée pour l'entraînement du modèle.

Ensuite, des techniques d'exploration de données permettent d'extraire des tendances. Des algorithmes analysent les données ainsi préparées afin d'identifier les relations entre les variables, de segmenter les populations ou de détecter les anomalies.

Ensuite, des modèles prédictifs sont élaborés. Des algorithmes statistiques et des techniques d'apprentissage automatique exploitent les tendances observées pour créer des modèles capables de prévoir les résultats. Parmi les approches courantes, on retrouve l'analyse de régression, les arbres de décision, les réseaux de neurones et les machines à vecteurs de support.

La validation du modèle suit. Le modèle prédictif est testé sur de nouvelles données afin d'évaluer sa précision. Des recherches ont démontré que les modèles Naïve Bayes atteignent des taux de précision élevés dans les tâches de classification.

Enfin, vient le déploiement. Une fois validé, le modèle prédictif est déployé en production où il effectue des prédictions en temps réel à partir des données entrantes.

Techniques et algorithmes fondamentaux

Plusieurs techniques statistiques et d'apprentissage automatique alimentent l'analyse prédictive dans l'exploration de données.

Analyse de régression

Les modèles de régression prédisent des résultats numériques continus. La régression linéaire prévoit des valeurs en fonction des relations entre les variables, tandis que la régression logistique prédit des probabilités pour des résultats binaires (oui/non, vrai/faux).

Arbres de décision

Ces modèles divisent les données en branches selon des règles de décision, créant ainsi une structure arborescente. Les forêts aléatoires combinent plusieurs arbres de décision pour améliorer la précision des prédictions et réduire le surapprentissage.

Réseaux neuronaux

Inspirés des neurones biologiques, ces algorithmes détectent des motifs non linéaires complexes. Les variantes d'apprentissage profond excellent dans la reconnaissance d'images, le traitement automatique du langage naturel et d'autres tâches de prédiction sophistiquées.

Classificateurs bayésiens naïfs

S’appuyant sur la théorie des probabilités, les algorithmes Naïve Bayes calculent la vraisemblance des résultats étant donné certaines conditions. Des recherches ont démontré que ces modèles atteignent des taux de précision élevés dans les tâches de classification.

Machines à vecteurs de support

Les SVM trouvent les frontières optimales entre les différentes classes de données, et fonctionnent bien aussi bien pour les problèmes de classification que de régression.

Analyse des séries chronologiques

Des techniques spécialisées comme les modèles ARIMA prévoient les valeurs futures en fonction des tendances temporelles des données séquentielles – essentielles pour les cours boursiers, les prévisions météorologiques et la planification de la demande.

| Technique | Idéal pour | Type de sortie | Complexité |

|---|---|---|---|

| Régression linéaire | prédictions numériques continues | Valeurs numériques | Faible |

| Arbres de décision | Classification et interprétabilité | Catégories ou valeurs | Moyen |

| Réseaux neuronaux | Motifs non linéaires complexes | Catégories ou valeurs | Haut |

| Bayes naïf | Classification de texte, détection de spam | Probabilités | Faible |

| Modèles de séries temporelles | Prévision temporelle séquentielle | Valeurs futures | Moyen |

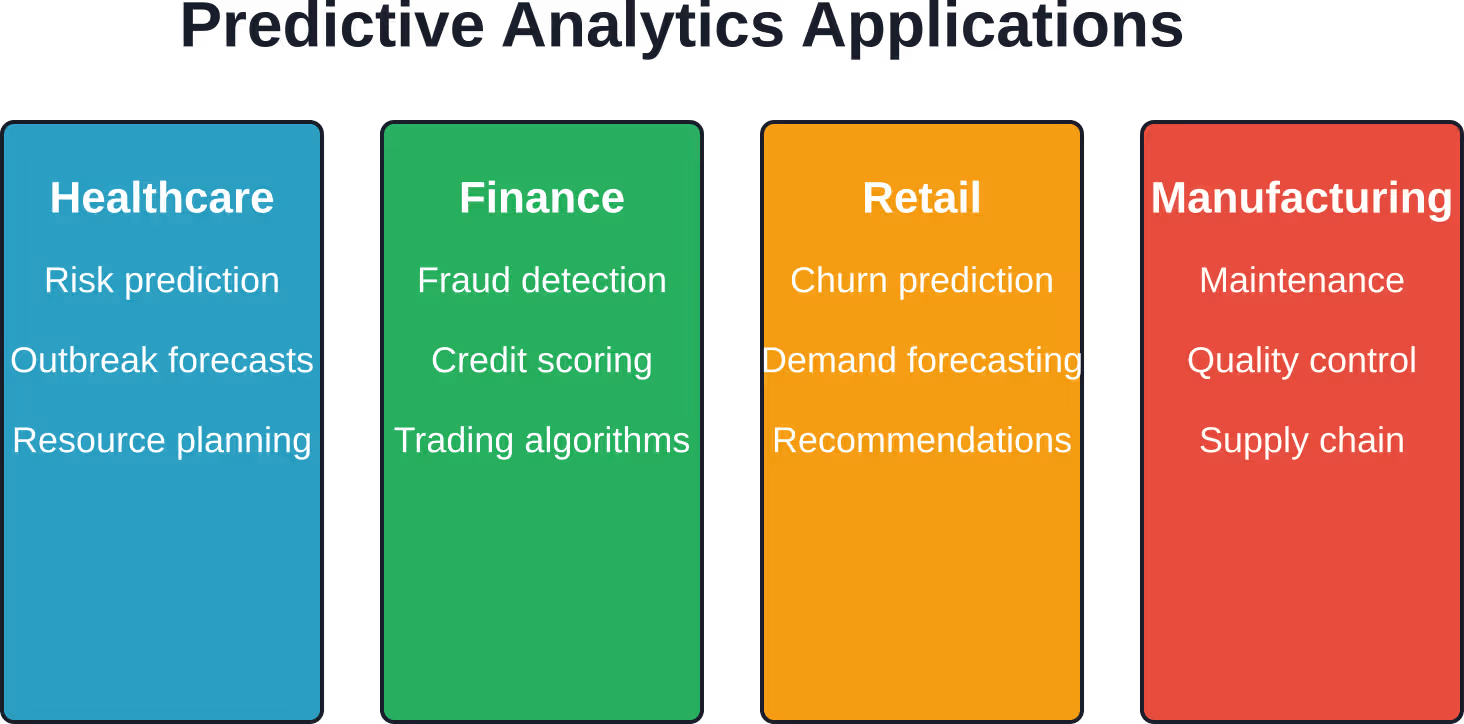

Applications concrètes dans différents secteurs d'activitéies

L'analyse prédictive dans l'exploration de données influence la prise de décision dans pratiquement tous les secteurs.

- Soins de santé : Les hôpitaux utilisent des modèles prédictifs pour identifier les patients à haut risque de réadmission, prévoir les épidémies et optimiser l'allocation des ressources. En matière de cybersécurité, l'exploration de données permet de détecter des anomalies dans les systèmes, pouvant indiquer des failles de sécurité ; les attaques de phishing ont ainsi révélé des schémas détectables grâce à l'analyse prédictive.

- Finance: Les banques utilisent l'analyse prédictive pour l'évaluation du crédit, la détection des fraudes et le trading algorithmique. Des recherches sur l'analyse boursière à l'aide de l'analyse prédictive ont été menées, notamment sur l'application de l'algorithme k-NN et l'analyse des chaînes de Markov pour la prédiction des tendances des indices boursiers.

- Vente au détail: Les plateformes de commerce électronique prédisent le taux de désabonnement des clients, recommandent des produits et anticipent la demande. Les équipes marketing utilisent des modèles prédictifs pour identifier les clients les plus susceptibles de réagir aux campagnes.

- Fabrication: Selon le NIST, l'analyse des données pour les systèmes de fabrication intelligents aide les PME à utiliser des services d'analyse de données pour améliorer leur prise de décision et leurs performances. La maintenance prédictive permet d'anticiper les pannes d'équipement avant qu'elles ne surviennent.

- Commercialisation: Les recherches universitaires sur la création de connaissances en marketing soulignent que l'analyse prédictive utilise des relations confirmées entre les variables pour prédire les résultats futurs, le plus souvent des valeurs suggérant la probabilité qu'un comportement ou un événement particulier se produise.

Les avantages qui favorisent l'adoption

Pourquoi les organisations investissent-elles dans l'analyse prédictive ? Les avantages sont indéniables.

- Réduction des risques : Anticiper les problèmes potentiels permet d'agir de manière proactive. Les institutions financières réduisent les défauts de paiement en prédisant plus précisément la solvabilité des emprunteurs.

- Efficacité opérationnelle : La maintenance prédictive permet d'éviter les pannes coûteuses des équipements. Les fabricants planifient les réparations pendant les périodes d'arrêt prévues plutôt que de devoir faire face à des pannes imprévues.

- Croissance des revenus : Les campagnes marketing ciblées, basées sur la notation prédictive des clients, génèrent des taux de conversion plus élevés. Les détaillants optimisent leurs stocks en fonction de la demande prévue, réduisant ainsi les ruptures de stock et les coûts liés aux surstocks.

- Une meilleure prise de décision : Les prévisions fondées sur les données remplacent l'intuition et les conjectures. Les dirigeants prennent des décisions stratégiques étayées par des preuves statistiques.

- Avantage concurrentiel : Les organisations qui anticipent les évolutions du marché réagissent plus rapidement que leurs concurrents qui analysent encore ce qui s'est déjà produit.

Défis et limites

L'analyse prédictive n'est pas magique. Il existe de véritables contraintes.

Les problèmes de qualité des données compromettent les prévisions. Le principe « données erronées en entrée, données erronées en sortie » reste d'actualité. Les modèles entraînés sur des données historiques biaisées ou incomplètes produisent des prévisions peu fiables.

Le domaine d'étude doit comprendre de nombreux cas individuels. L'analyse prédictive fonctionne lorsqu'il existe suffisamment d'exemples historiques pour établir des tendances. Prévoir des événements uniques et ponctuels s'avère difficile.

La complexité des modèles engendre des problèmes d'interprétabilité. Les réseaux neuronaux peuvent prédire avec précision, mais fournir peu d'explications quant à leur fonctionnement. Or, des secteurs réglementés comme la santé et la finance exigent souvent une transparence totale du raisonnement.

Le surapprentissage se produit lorsque les modèles mémorisent les données d'entraînement au lieu d'apprendre des schémas généralisables. Le modèle fonctionne alors parfaitement sur les données historiques, mais échoue face à de nouveaux cas.

Les prévisions sont probabilistes, et non certaines. Un taux de précision de 95 % (TP3T) implique toujours une marge d'erreur de 51 % (TP3T). Les entreprises doivent tenir compte de cette incertitude résiduelle dans leur planification.

Une maintenance continue est indispensable. Les tendances évoluent avec le temps : le comportement des clients change, les conditions du marché se transforment et de nouvelles variables apparaissent. Les modèles doivent être régulièrement réentraînés pour rester précis.

Le rôle croissant de l'apprentissage automatique

L'apprentissage automatique a transformé l'analyse prédictive dans le domaine de l'exploration de données. Les méthodes statistiques traditionnelles exigeaient des analystes qu'ils spécifient manuellement les relations entre les variables.

Les algorithmes d'apprentissage automatique découvrent automatiquement des modèles. Avec suffisamment de données, ces systèmes identifient des relations non linéaires complexes qui pourraient échapper à l'œil humain.

Cette distinction est importante. L'analyse de régression traditionnelle nécessite de formuler des hypothèses sur les variables prédictives du résultat. L'apprentissage automatique, quant à lui, explore simultanément des milliers de schémas potentiels.

Les réseaux de neurones profonds atteignent une précision remarquable dans des tâches telles que la classification d'images et le traitement automatique du langage naturel. Les recherches dans ce domaine ont démontré un impact académique considérable.

Mais voici le compromis : les modèles d’apprentissage automatique sacrifient souvent l’interprétabilité à la précision. Les forêts aléatoires, avec leurs centaines d’arbres, prédisent bien mais expliquent mal.

Premiers pas avec l'analyse prédictive

Les organisations qui découvrent l'analyse prédictive devraient adopter une approche pragmatique.

Commencez par un problème commercial précis. N'adoptez pas l'analyse prédictive simplement parce que c'est à la mode. Identifiez un défi concret – fidélisation client, optimisation des stocks, détection des fraudes – où la prévision apporterait une valeur ajoutée.

Évaluer la disponibilité des données. Existe-t-il suffisamment d'exemples historiques ? Les données sont-elles accessibles, fiables et pertinentes ?

Commencez par des modèles simples. La régression linéaire et les arbres de décision sont plus faciles à interpréter et à mettre en œuvre que les réseaux de neurones. Augmentez la complexité progressivement, en fonction des besoins.

Investissez dans l'infrastructure de données. L'analyse prédictive nécessite des systèmes qui collectent, stockent et traitent les données efficacement.

Développer les compétences analytiques. Les organisations ont besoin de personnes qui maîtrisent à la fois le domaine d'activité et les méthodes statistiques. Former le personnel en place est souvent plus efficace que de faire appel uniquement à des experts externes.

Validez rigoureusement avant le déploiement. Testez les modèles sur des données de test qu'ils n'ont jamais utilisées. Mesurez la précision dans des conditions de production réalistes, et non uniquement lors d'expériences contrôlées.

Questions fréquemment posées

Qu'est-ce que l'analyse prédictive dans le domaine de l'exploration de données ?

L'analyse prédictive en exploration de données consiste à utiliser des algorithmes statistiques et des techniques d'apprentissage automatique pour analyser les tendances historiques des données et prévoir les résultats futurs. L'exploration de données permet de découvrir des tendances cachées dans de vastes ensembles de données, tandis que l'analyse prédictive applique ces tendances pour prédire des comportements, des tendances et des événements futurs.

Dans quelle mesure les modèles d'analyse prédictive sont-ils précis ?

La précision varie selon l'application, la qualité des données et la technique utilisée. Des recherches ont démontré que certains modèles peuvent atteindre des taux de précision élevés dans les tâches de classification. Cependant, les problèmes simples avec des données propres donnent généralement de meilleurs résultats que les scénarios complexes avec des données bruitées. Un suivi et un réentraînement continus permettent de maintenir la précision dans le temps.

Quelle est la différence entre l'exploration de données et l'analyse prédictive ?

L'exploration de données vise à découvrir des tendances, des corrélations et des anomalies dans les données historiques, répondant ainsi à la question “ que s'est-il passé ? ”. L'analyse prédictive utilise ces tendances découvertes pour prévoir les événements futurs. L'exploration de données est une démarche d'exploration ; l'analyse prédictive est une application. Ces deux approches fonctionnent de concert au sein d'un flux de travail complémentaire.

Quels sont les secteurs qui tirent le plus profit de l'analyse prédictive ?

Les secteurs de la santé, de la finance, du commerce de détail, de l'industrie et du marketing en retirent des avantages considérables. Le secteur de la santé prédit les risques pour les patients et leurs besoins en ressources. Le secteur financier détecte les fraudes et évalue la solvabilité. Le commerce de détail prévoit la demande et le comportement des consommateurs. Le secteur manufacturier anticipe les pannes d'équipement. Tout secteur disposant de données historiques suffisantes peut appliquer efficacement l'analyse prédictive.

Quelles sont les compétences nécessaires en analyse prédictive ?

Une analyse prédictive réussie nécessite des connaissances en statistiques et en probabilités, des compétences en programmation dans des langages comme Python ou R, une compréhension des algorithmes d'apprentissage automatique, des capacités de préparation et de nettoyage des données, une expertise du domaine dans le problème commercial à résoudre et une pensée critique pour interpréter les résultats et valider les modèles.

De combien de données a-t-on besoin pour l'analyse prédictive ?

La quantité de données nécessaires dépend de la complexité et de la variabilité du problème. Des problèmes simples peuvent nécessiter des centaines d'exemples ; des scénarios complexes, des milliers, voire des millions. En général, plus les données sont nombreuses, plus la précision des prédictions est grande, mais la qualité prime sur la quantité.

Les petites entreprises peuvent-elles utiliser l'analyse prédictive ?

Absolument. Les outils cloud et les logiciels libres ont rendu l'analyse prédictive accessible aux organisations de toutes tailles. Les recherches du NIST visent à aider les PME à utiliser les services d'analyse de données pour améliorer leur prise de décision et leurs performances. Commencez par des problèmes ciblés où même des améliorations modestes apportent une réelle valeur ajoutée.

Avoir hâte de

L'analyse prédictive dans le domaine de l'exploration de données continue d'évoluer rapidement. Plusieurs tendances façonnent l'avenir.

Les prévisions en temps réel deviennent la norme. Les organisations souhaitent des prévisions mises à jour en continu dès l'arrivée de nouvelles données, et non des traitements par lots exécutés chaque nuit.

Les modèles de données mixtes, qui combinent des nombres structurés avec du texte non structuré et des images, améliorent les capacités de prédiction. Le traitement automatique du langage naturel extrait des informations des avis clients, des tickets d'assistance et des réseaux sociaux.

Les plateformes d'apprentissage automatique automatisées réduisent la barrière de l'expertise. Les outils AutoML gèrent la sélection des algorithmes, l'ingénierie des caractéristiques et le réglage des hyperparamètres, rendant ainsi l'analyse prédictive accessible aux non-spécialistes.

L'IA explicable relève le défi de l'interprétabilité. De nouvelles techniques aident les réseaux neuronaux et les modèles d'ensemble à expliquer leur raisonnement, un point crucial pour les secteurs réglementés.

L'informatique de périphérie permet d'effectuer des prédictions directement sur les appareils plutôt que sur des serveurs centralisés. Les systèmes de fabrication intelligents et les capteurs IoT prévoient des prévisions locales avec une latence minimale.

La demande d'analystes de données ne cesse de croître. Les programmes universitaires mettent de plus en plus l'accent sur les compétences quantitatives afin que de grandes quantités d'informations se transforment en connaissances plutôt qu'en surcharge informationnelle.

Les organisations qui maîtrisent l'analyse prédictive dans l'exploration de données ne se contentent pas de réagir au changement ; elles l'anticipent. Les tendances sont déjà présentes, tapies dans les données historiques. L'enjeu concurrentiel est de savoir qui les extraira en premier.