Résumé rapide : L'optimisation des coûts LLM dans le déploiement de l'IA exige une approche multicouche combinant une sélection intelligente des modèles, l'ajustement de l'infrastructure et la gestion des jetons. Les organisations peuvent réduire leurs coûts de 60 à 851 Tk grâce à des techniques telles que le routage des modèles, la mise en cache sémantique et l'optimisation du cache clé-valeur, sans compromettre la précision. L'essentiel est de considérer les coûts LLM comme des coûts unitaires de production plutôt que comme des dépenses logicielles classiques.

Un chatbot de support client traitant 500 000 requêtes mensuelles à raison de 1 500 jetons par requête engendre un coût d'environ 1 TP4T18 000 par mois, et ce, pour une seule fonctionnalité. Si l'on passe à 10 000 conversations quotidiennes, les coûts dépassent largement 1 TP4T1500 par jour, rien que pour les jetons d'entrée.

Il ne s'agit pas ici de la gestion traditionnelle des coûts du cloud. Les produits LLM natifs héritent des propriétés des biens physiques et des logiciels : ils s'adaptent instantanément comme du code, mais engendrent des coûts variables significatifs par utilisation. À mesure que les organisations déploient des modèles à grande échelle, la maîtrise des coûts devient un avantage concurrentiel, et non plus une simple préoccupation opérationnelle.

L'écart de prix entre les fournisseurs est considérable. GPT-5.4 facture $2,50 par million de jetons d'entrée, tandis que Claude 4.5 Sonnet facture $3 par million de jetons d'entrée. Mais le choix du fournisseur n'est que le point de départ : l'optimisation des coûts de production exige une réflexion globale sur l'infrastructure.

Pourquoi les coûts d'un LLM varient-ils différemment ?

Les logiciels traditionnels fonctionnent selon un modèle économique simple : des coûts de développement initiaux élevés, puis des coûts marginaux tendant vers zéro pour chaque utilisateur supplémentaire. Hébergez l’application une seule fois, servez-en des millions.

Les applications natives de l'IA bouleversent complètement ce modèle.

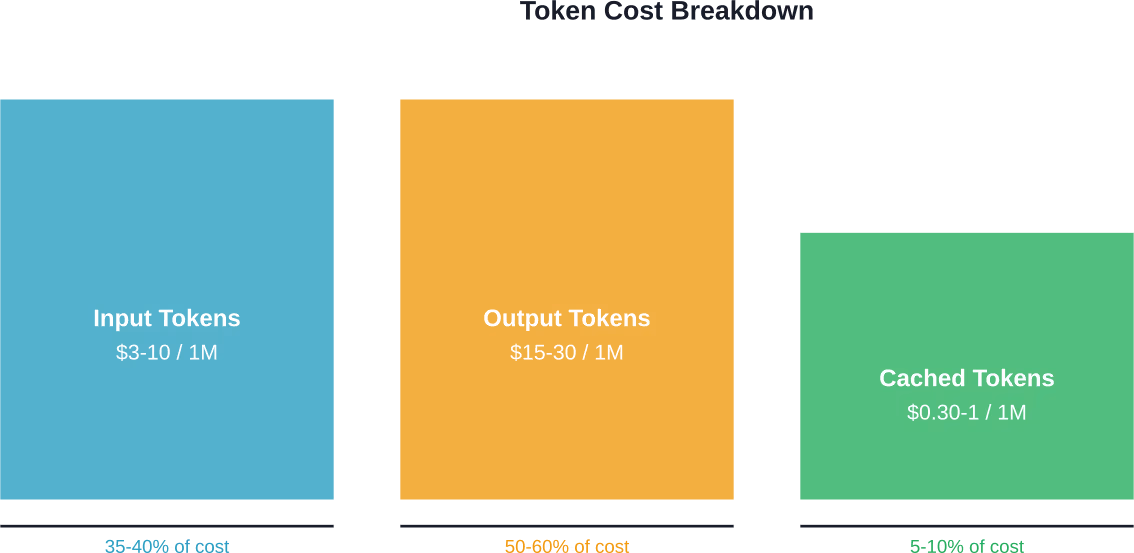

Chaque inférence engendre un coût de calcul réel. Les jetons d'entrée, de sortie et de mise en cache sont chacun soumis à une structure tarifaire différente. Cette tarification dépend de plusieurs variables interdépendantes qui évoluent dynamiquement en fonction des caractéristiques de la charge de travail.

La longueur du contexte a une importance souvent sous-estimée. Un modèle avec un contexte de 2 048 jetons peut traiter jusqu'à 2 048 jetons simultanément. Cependant, le traitement de contextes plus longs augmente les besoins en mémoire de façon exponentielle, et non linéaire. Le cache clé-valeur, qui évite les recalculs inutiles des représentations des jetons précédents lors de la génération autorégressive, croît proportionnellement à la longueur de la séquence.

Les systèmes de production rencontrent des goulots d'étranglement qui n'existent pas en développement. La bande passante mémoire devient la principale contrainte lors de la phase de décodage. Le mécanisme d'attention multi-têtes effectue plusieurs calculs d'attention en parallèle, mais les limitations matérielles déterminent le débit réel.

Le problème de l'économie unitaire

Les startups spécialisées dans l'IA sont confrontées à des défis uniques dans trois domaines : l'économie unitaire (coût par inférence), la planification des capacités (offre de GPU) et l'optimisation du rendement (qualité de la sortie du modèle par jeton).

Contrairement aux logiciels traditionnels où le coût marginal d'un nouvel utilisateur est pratiquement nul, les produits développés en LLM comportent d'importantes composantes de coûts variables. Cela oblige les équipes à adopter une approche industrielle : suivi de l'efficacité de la production, optimisation du débit et gestion des contraintes d'approvisionnement.

Soyons francs : la plupart des équipes sont incapables d’expliquer précisément leurs coûts LLM. La complexité des structures de coûts de l’IA, notamment le calcul, la bande passante mémoire, le stockage et le réseau, engendre des lacunes en matière de responsabilisation. Les équipes d’ingénierie manquent de visibilité sur les cas d’utilisation qui génèrent les dépenses ou sur les optimisations qui offriraient le meilleur retour sur investissement.

Stratégies de sélection et de routage des modèles

Les progrès récents en matière de modèles de langage ont donné naissance à un écosystème en pleine expansion. Les organisations ont désormais le choix entre des dizaines d'options open source et commerciales, chacune présentant des compromis différents entre performance et coût.

Mais considérer chaque requête comme ayant la même complexité est un gaspillage d'argent.

| Stratégie | Comment ça marche | Économies typiques |

|---|---|---|

| Routage statique | Acheminer les requêtes vers des modèles prédéterminés en fonction du cas d'utilisation | 30-40% |

| Routage dynamique | Analysez la complexité des requêtes en temps réel et sélectionnez le modèle optimal. | 45-60% |

| En cascade | Essayez d'abord les modèles les moins chers, et passez à un modèle supérieur uniquement en cas de besoin. | 50-70% |

| LLM Berger | Utilisez des modèles coûteux pour les indications, des modèles moins coûteux pour l'exécution. | 60-75% |

Des recherches publiées sur arXiv démontrent que les petits modèles de langage (SLM) bénéficiant d'indices ciblés provenant de grands modèles de langage (LLM) permettent d'améliorer la précision tout en minimisant l'utilisation des ressources des LLM. Les données montrent que la précision du SLM (Llama-3.2-3B-Instruct) en fonction de la taille des indices du LLM (Llama-3.3-70B-Versatile) s'améliore considérablement lorsque les petits indices représentent seulement 10 à 30% de la réponse complète du LLM, les gains étant ensuite décroissants au-delà de 60%.

Cela justifie une approche d'accompagnement : solliciter des pistes plutôt que des réponses complètes. Cette stratégie considère le modèle onéreux comme un consultant plutôt qu'un exécutant ; on paie pour des conseils, pas pour des réponses définitives.

Techniques d'optimisation au niveau de l'infrastructure

Le choix du modèle n'est qu'un levier parmi d'autres. L'optimisation de l'infrastructure permet de résoudre les problèmes liés au matériel qui limitent les performances et font grimper les coûts.

Gestion du cache KV

Le cache clé-valeur est une optimisation fondamentale des modèles basés sur Transformer. Mais il est aussi très gourmand en mémoire.

Lors de la génération autorégressive, le modèle calcule l'attention portée à tous les jetons précédents à chaque étape. Sans mise en cache, cela nécessite de recalculer les représentations de la séquence entière à chaque itération. Le cache KV stocke ces calculs, privilégiant la vitesse à la mémoire.

Voici le problème : la taille du cache augmente linéairement avec la longueur de la séquence et la taille du lot. Pour les applications à contexte long, la mémoire cache peut dépasser les poids du modèle eux-mêmes. Voici quelques stratégies pour gérer ce problème :

- Quantification des valeurs mises en cache à une précision inférieure (8 bits ou 4 bits)

- Mise en œuvre de politiques d'éviction qui éliminent les jetons les moins pertinents

- Utilisation de l'attention par fenêtre glissante pour la croissance de la mémoire limitée

- Compression des entrées du cache à l'aide de jetons de compression appris

Les recherches sur la compression de l'essence du sens ancrée dans la phrase démontrent que les modèles linéaires pré-entraînés peuvent être affinés pour compresser le contexte à l'aide de jetons appris, réduisant ainsi les besoins en mémoire et en calcul pour les longues séquences. Les méthodes d'affinage à faible consommation de paramètres permettent aux modèles compacts de gérer des tâches de raisonnement sans extension complète du cache clé-valeur.

Optimisation du traitement par lots et du débit

Les systèmes de traitement d'inférences doivent trouver un équilibre entre latence et débit. Des lots plus importants améliorent l'utilisation du matériel, mais augmentent les temps d'attente pour chaque requête.

La phase de calcul lors du préremplissage (traitement des jetons d'entrée) bénéficie grandement du traitement par lots : l'utilisation du GPU augmente linéairement avec la taille des lots jusqu'aux limites matérielles. En revanche, la phase de décodage est limitée par la bande passante. Ajouter des requêtes à un lot n'augmente pas proportionnellement le débit, car la bande passante mémoire devient le facteur limitant.

Les stratégies efficaces séparent le préremplissage et le décodage en lots distincts, permettant ainsi l'optimisation indépendante de chaque phase. Les techniques de traitement par lots continu ajoutent dynamiquement de nouvelles requêtes aux lots en cours, sans attendre la fin du traitement complet du lot.

Quantification du modèle

La quantification réduit la précision du modèle, passant de nombres à virgule flottante 32 ou 16 bits à des entiers 8 ou 4 bits. Cela diminue proportionnellement les besoins en mémoire et la consommation de bande passante.

D'après une étude de l'IST Austria, la quantification GPTQ est mathématiquement équivalente à l'algorithme du plan le plus proche de Babai. Cette interprétation géométrique fournit des bornes d'erreur pour la quantification de grands modèles de langage, permettant une précision de 4 bits avec des paramètres soigneusement calibrés afin de minimiser la dégradation de la précision.

DistilBERT démontre la puissance de la distillation de modèles combinée à la quantification. Créé par l'équipe Hugging Face, il est 40% plus petit et plus rapide que BERT de base (environ 66 millions de paramètres contre 110 millions), tout en conservant 97% de performances sur les tâches en aval.

| Technique | Réduction de la mémoire | Amélioration de la vitesse | Impact sur la précision |

|---|---|---|---|

| Quantification 8 bits | 50% | 1,5-2x | <1% perte |

| Quantification sur 4 bits | 75% | 2-3x | Perte 1-3% |

| Distillation modèle | 40-60% | 2-3x | Perte 2-5% |

| Quantification du cache KV | 30-50% (cache uniquement) | 1,3-1,8x | <1% perte |

Mise en cache sémantique pour la réduction des coûts

La mise en cache semble évidente : stocker les résultats et les réutiliser. Mais les applications LLM présentent des défis uniques.

La correspondance exacte de chaînes de caractères échoue car les utilisateurs formulent des questions identiques différemment. “ Quelle est la capitale de la France ? ” et “ Dites-moi la capitale de la France ” devraient renvoyer la même entrée dans le cache.

La mise en cache sémantique résout ce problème en intégrant les requêtes dans un espace vectoriel et en effectuant la correspondance en fonction de la similarité plutôt que de la correspondance exacte des chaînes de caractères. Lorsqu'une nouvelle requête arrive, le système calcule son vecteur et recherche les entrées mises en cache les plus proches. Si une correspondance est trouvée au-delà d'un certain seuil, la réponse mise en cache est renvoyée. Sinon, le modèle est appelé et le résultat est mis en cache.

Pour les applications à fort volume de requêtes, la mise en cache sémantique atteint généralement des taux d'accès de 40 à 601 T3T après la première semaine de fonctionnement. Au prix de GPT-5, cela représente des économies mensuelles substantielles pour une seule fonctionnalité.

La mise en œuvre exige un réglage précis du seuil de similarité. Un seuil trop élevé entraîne une chute brutale du nombre de requêtes mises en cache. À l'inverse, un seuil trop bas provoque des réponses obsolètes ou non pertinentes, dégradant ainsi l'expérience utilisateur.

Ingénierie rapide et gestion des jetons

Les jetons d'entrée coûtent de l'argent. Les jetons de sortie coûtent encore plus cher, souvent 3 à 5 fois plus que le coût d'entrée.

L'optimisation rapide vise à obtenir les mêmes résultats avec moins de jetons. Les techniques utilisées incluent :

- Supprimer le contexte ou les exemples inutiles

- Utiliser des instructions formulées de manière plus concise

- Exploiter efficacement les messages système

- Mise en œuvre de l'apprentissage avec peu d'exemples

- Limiter la longueur de la sortie par le biais d'instructions

Le défi consiste à trouver le juste équilibre entre concision et clarté. Des consignes trop brèves produisent souvent des résultats de moindre qualité, nécessitant des essais supplémentaires qui coûtent plus cher que les économies initiales.

Les tests montrent que la compression systématique des invites (suppression des jetons redondants tout en préservant le sens sémantique) peut réduire les coûts de saisie de 20 à 40% sans perte de précision. Cependant, cela nécessite une infrastructure d'évaluation pour vérifier que les invites compressées conservent la qualité de la sortie.

Mise en place d'un système de suivi des coûts

On ne peut optimiser ce qui n'est pas mesuré.

Les systèmes LLM de production nécessitent des outils de suivi des coûts à différents niveaux de granularité : par utilisateur, par fonctionnalité, par modèle et par type de requête. Cette visibilité permet de prendre des décisions d’optimisation basées sur les données.

La plupart des équipes commencent par compiler les factures mensuelles des fournisseurs. C'est insuffisant. L'instrumentation doit permettre de recueillir :

- Nombre de jetons (entrée, sortie, cache) par requête

- Modèle utilisé et décisions de routage

- Métriques de latence et de débit

- Taux de réussite et efficacité des caches

- Taux d'erreur et coûts de nouvelle tentative

- Attribution des coûts aux fonctionnalités ou aux utilisateurs

Les contrôles budgétaires hiérarchiques permettent aux équipes de définir des limites de dépenses à différents niveaux : à l’échelle de l’organisation, par équipe, par fonctionnalité ou par utilisateur. Lorsqu’un seuil budgétaire est atteint, le système peut automatiquement basculer vers des modèles moins coûteux ou mettre en place une limitation du débit.

D'après une étude du MIT sur les lois de mise à l'échelle de l'IA, il est crucial de définir en amont un budget de calcul et une précision cible pour le modèle. Cette étude a révélé qu'une erreur relative moyenne (ARE) de 4% correspond approximativement à la meilleure précision atteignable en raison du bruit aléatoire initial, mais qu'une ARE allant jusqu'à 20% reste utile pour la prise de décision.

Le problème de l'économie des fournisseurs

Les services LLM gérés, tels qu'Azure OpenAI, posent des défis de gestion des coûts fondamentalement différents des modèles cloud traditionnels. Leur structure tarifaire dépend des jetons d'entrée, des jetons de sortie, des jetons mis en cache, des unités de débit provisionnées (PTU) et des configurations de déploiement.

Azure OpenAI masque délibérément les véritables facteurs de coûts de par son architecture. Les organisations provisionnent de la capacité en PTU sans visibilité claire sur la consommation réelle de jetons ni sur l'utilisation des modèles. Cela engendre des lacunes en matière de responsabilité : les équipes d'ingénierie ne peuvent déterminer quelles fonctionnalités génèrent des coûts ni si les optimisations sont réellement efficaces.

Les plateformes de gestion des coûts du cloud conçues pour les infrastructures traditionnelles ne gèrent pas efficacement les charges de travail d'IA. Elles suivent les heures d'utilisation des machines virtuelles et l'espace de stockage, mais ne proposent pas la granularité au niveau des jetons nécessaire à l'optimisation LLM.

Les opérations financières pour l'IA nécessitent une analyse économique des cas d'usage. Les équipes doivent suivre les coûts unitaires (par conversation, par document résumé, par code exécuté) plutôt que les dépenses globales. Cela permet de passer d'une gestion axée sur les coûts d'infrastructure à une gestion axée sur l'efficacité opérationnelle.

Cadre de mise en œuvre dans le monde réel

L'optimisation n'est pas un projet ponctuel. C'est une pratique continue qui évolue en fonction des habitudes d'utilisation et de la disponibilité des modèles.

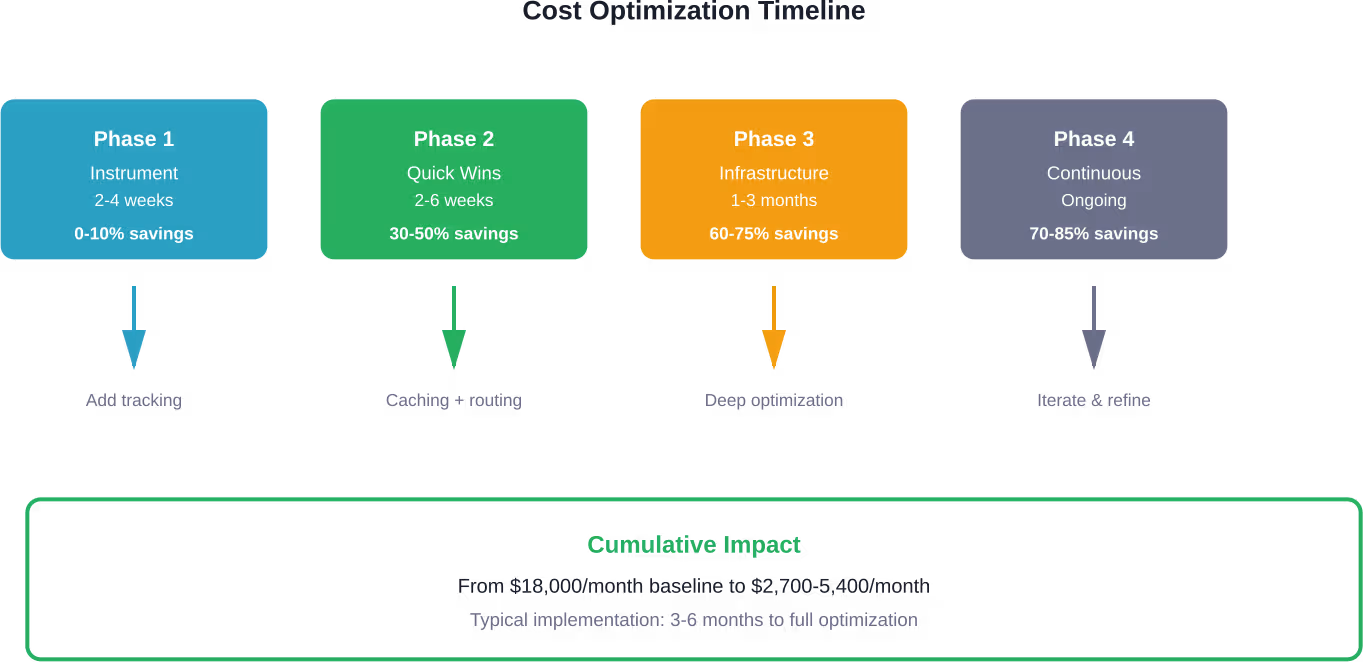

Phase 1 : Données de référence et instrumentation

Commencez par une instrumentation complète. Mettez en place un système de suivi qui enregistre l'utilisation des jetons, la sélection du modèle, la latence et les coûts au niveau de chaque requête. Établissez des indicateurs de référence : coûts actuels, répartition par cas d'utilisation et performances de pointe.

Cette phase dure généralement de 2 à 4 semaines et nécessite des modifications minimales du code, principalement l'ajout de la journalisation et de la collecte de métriques.

Phase 2 : Victoires rapides

Mettre en œuvre les optimisations les plus faciles à mettre en œuvre :

- Déployer la mise en cache sémantique pour les requêtes à haute fréquence

- Orienter les requêtes simples vers des modèles moins chers

- Compressez les invites en supprimant le contexte redondant

- Définir les limites maximales de jetons de sortie

Ces changements permettent souvent de réduire les coûts de 30 à 50% en quelques semaines sans perte de précision.

Phase 3 : Optimisation de l'infrastructure

Abordons maintenant des optimisations plus poussées :

- Mise en œuvre d'un routage dynamique avec analyse de complexité

- Déployer des modèles quantifiés pour les charges de travail tolérantes à la latence

- Optimisation de la gestion du cache KV

- Mettre en œuvre le traitement par lots continu pour améliorer le débit

Cette phase nécessite plus d'efforts d'ingénierie (généralement 1 à 3 mois), mais permet une réduction supplémentaire des coûts 20-40%.

Phase 4 : Amélioration continue

Mettez en place des boucles de rétroaction. Surveillez le routage des requêtes, les entrées de cache fréquemment consultées et l'apparition de problèmes de latence ou de qualité. Utilisez ces données pour affiner la logique de routage, mettre à jour les politiques de cache et réajuster les paramètres de quantification.

Tester de nouveaux modèles devient une pratique courante. Lorsque les fournisseurs proposent des options améliorées, les outils permettent de réaliser rapidement des tests A/B afin de valider le compromis coût-qualité avant le déploiement complet.

Pièges courants à éviter

L'optimisation des coûts peut se révéler contre-productive lorsque les équipes optimisent les mauvais indicateurs ou sacrifient des capacités essentielles :

- Dégradation de la latence : Un système de cache trop agressif ou un routage vers des modèles plus lents peuvent augmenter les temps de réponse au-delà du seuil de tolérance des utilisateurs. Pour les applications interactives, la latence est aussi importante que le coût. Les utilisateurs abandonnent une expérience dès qu'il y a un délai de 3 à 5 secondes, quelle que soit la précision.

- Érosion de qualité : Un routage trop agressif vers les petits modèles dégrade la qualité des résultats. Les tests peuvent indiquer une précision acceptable sur les benchmarks, mais les cas limites en production révèlent des faiblesses. Il est donc essentiel de mettre en place un suivi de la qualité parallèlement au suivi des coûts.

- Surdimensionnement de la mise en cache : La mise en cache sémantique complexifie l'infrastructure. Pour les fonctionnalités à faible trafic, les coûts d'ingénierie liés à la mise en œuvre et à la maintenance de la mise en cache dépassent les économies réalisées. Il est donc préférable de concentrer les efforts de mise en cache en priorité sur les points de terminaison à fort volume.

- En ignorant les coûts de démarrage à froid : Le chargement et l'initialisation des modèles peuvent impacter les performances et l'efficacité des coûts. Les politiques de mise à l'échelle à zéro nécessitent une analyse approfondie du rapport entre la latence de démarrage et les coûts d'inactivité. Il convient d'équilibrer ces coûts et la latence de démarrage.

- Dépendance au fournisseur : Une optimisation poussée pour les API ou la structure tarifaire spécifiques d'un fournisseur crée des obstacles à la migration. Dans la mesure du possible, il est préférable d'abstraire les détails propres à chaque fournisseur derrière des interfaces facilitant le changement.

Réduisez les coûts de déploiement des LLM à la source.

La plupart des coûts de déploiement des LLM ne sont pas uniquement liés au modèle lui-même, mais aussi à la manière dont le système est conçu, intégré et mis à l'échelle. IA supérieure Leur expertise couvre l'intégralité du cycle de vie du déploiement, de la sélection et du réglage fin des modèles à la mise en place et à l'optimisation de l'infrastructure. Leur approche consiste à concevoir des systèmes d'IA adaptés à la charge de travail réelle, que ce soit par l'utilisation de modèles personnalisés, l'optimisation de modèles existants ou l'équilibre entre l'utilisation d'API et un déploiement interne. Ceci permet de réduire les inférences inutiles, d'éviter le surdimensionnement de l'infrastructure et de garantir des performances prévisibles malgré l'augmentation de l'utilisation.

Les problèmes de coûts liés au déploiement proviennent généralement de décisions prises avant le lancement : taille du modèle, pipelines de données et fréquence d’appel des systèmes. Ajuster ces éléments a un impact plus important que de changer d’outils ultérieurement. Si vous souhaitez que votre déploiement LLM reste performant malgré sa mise à l’échelle, contactez-nous. IA supérieure et alignez votre configuration sur la manière dont elle sera réellement utilisée en production.

Perspectives d'avenir : Évolution des coûts

Certains pensent que les coûts de la maîtrise des langages de programmation (LLM) vont tendre vers zéro, rendant l'optimisation inutile. L'histoire prouve le contraire.

Les coûts de calcul ont diminué de façon constante pendant des décennies, mais la demande croît plus rapidement. Des modèles plus performants permettent de nouveaux cas d'utilisation qui consomment davantage de puissance de calcul. Le nombre de fenêtres de contexte passe de 2 048 à plus de 128 000 jetons, ce qui multiplie les besoins en mémoire. Les modèles multimodaux traitent simultanément les images et la vidéo, et le texte.

Les organisations qui intègrent les coûts LLM dans leur stratégie – en développant rapidement leurs capacités d'optimisation – acquièrent des avantages concurrentiels qui se renforcent avec le temps. Cette maîtrise des coûts permet une mise à l'échelle durable, autorisant un déploiement et une expérimentation plus larges sans que les contraintes budgétaires ne limitent le développement de produits.

L'optimisation de l'infrastructure, la sélection des modèles et la gestion des jetons ne sont pas des projets ponctuels. Ce sont des compétences fondamentales pour les entreprises spécialisées en IA. Les équipes qui développent ces capacités dès maintenant bénéficieront d'avantages structurels en matière de coûts que leurs concurrents auront du mal à égaler.

Questions fréquemment posées

Quel est le moyen le plus rapide de réduire les coûts d'un LLM de 30% ou plus ?

Mettez en œuvre la mise en cache sémantique pour les requêtes fréquentes et acheminez les requêtes simples vers des modèles moins coûteux. Ces deux modifications permettent généralement de réduire les coûts de 30 à 501 TPS/3 TPS en 4 à 6 semaines avec un minimum d'efforts d'ingénierie. Commencez par instrumenter le système pour identifier les points de terminaison présentant un volume de requêtes élevé et une faible diversité de requêtes : ce sont des candidats idéaux pour la mise en cache.

Dois-je utiliser GPT-4 ou Claude pour l'optimisation des coûts ?

Ni l'un ni l'autre. GPT-5.4 facture $2,50 par million de jetons d'entrée, tandis que Claude 4.5 Sonnet facture $3 par million de jetons d'entrée. Cependant, le coût par jeton n'est pas le seul facteur à prendre en compte : la qualité de la sortie, la latence et les exigences en matière de longueur du contexte sont également importantes. Il convient d'implémenter un routage qui utilise chaque modèle pour les charges de travail offrant le meilleur compromis coût-qualité-latence. Tester différents modèles sur des données de production est le seul moyen de déterminer l'allocation optimale.

La quantification nuit-elle significativement à la précision du modèle ?

Non, à condition d'être correctement mise en œuvre. Les recherches montrent que la quantification 8 bits entraîne généralement une perte de précision inférieure à 1% tout en réduisant les besoins en mémoire de 50%. Même une quantification 4 bits avec un étalonnage précis (comme GPTQ) ne perd que 1 à 3% en précision, tout en réduisant la mémoire de 75%. L'essentiel est de tester les modèles quantifiés sur des jeux de données d'évaluation représentatifs avant leur déploiement en production afin de valider des performances acceptables.

Combien la mise en cache permet-elle réellement d'économiser en production ?

Le taux d'accès au cache sémantique atteint généralement 40 à 60 Tk après la première semaine de fonctionnement pour la plupart des applications. Pour un chatbot d'assistance traitant 500 000 requêtes mensuelles avec une optimisation GPT-4, cela représente une économie mensuelle de 7 200 à 10 800 Tk. Cependant, l'efficacité varie selon le cas d'utilisation : les applications de type FAQ bénéficient de taux d'accès plus élevés, tandis que les applications créatives ou hautement personnalisées profitent moins du cache.

Quel est le retour sur investissement de la construction d'une infrastructure d'optimisation personnalisée ?

Pour les applications dont les coûts mensuels de gestion du cycle de vie des applications (LLM) dépassent 1 400 000 €, une infrastructure d'optimisation personnalisée est généralement rentabilisée en 3 à 6 mois. L'investissement en ingénierie varie de 2 à 4 mois de développement pour une implémentation complète incluant l'instrumentation, la mise en cache et le routage. Les organisations disposant de budgets plus modestes devraient privilégier des optimisations plus simples, telles que la compression rapide et la sélection du fournisseur, avant de mettre en place une infrastructure personnalisée.

Comment concilier optimisation des coûts et latence de réponse ?

Mesurez ces deux indicateurs simultanément et définissez des compromis acceptables. Certaines optimisations, comme la mise en cache, réduisent à la fois le coût et la latence. D'autres, comme le routage vers des modèles plus légers, peuvent légèrement augmenter la latence tout en réduisant les coûts. Définissez des SLA de latence pour chaque cas d'usage : une conversation interactive peut exiger des réponses inférieures à la seconde, tandis que le traitement par lots de documents tolère plusieurs minutes. Optimisez en tenant compte des contraintes plutôt que de traiter le coût ou la latence de manière isolée.

Puis-je exécuter des LLM sur site pour réduire les coûts ?

Peut-être. Le déploiement sur site élimine les coûts d'API, mais nécessite une infrastructure GPU, une expertise en ingénierie pour l'optimisation des serveurs et des coûts d'exploitation. Cette solution devient rentable à grande échelle (environ 500 000 requêtes par jour), car les coûts fixes d'infrastructure sont alors amortis sur le volume important de transactions. En dessous de ce seuil, les API gérées sont généralement plus économiques si l'on prend en compte le coût total de possession, y compris le temps d'ingénierie.

Conclusion

L'optimisation des coûts LLM est indispensable pour les produits basés sur l'IA. Leur modèle économique diffère fondamentalement de celui des logiciels traditionnels : les coûts variables évoluent avec l'utilisation, créant ainsi une économie unitaire comparable à celle de la production industrielle, qui exige une attention constante.

Mais l'opportunité est considérable. Les organisations qui mettent en œuvre une optimisation complète, combinant une sélection intelligente des modèles, un réglage de l'infrastructure, une mise en cache sémantique et une gestion des jetons, réalisent des réductions de coûts de 60 à 851 TP3T sans sacrifier la qualité ni l'expérience utilisateur.

Commencez par l'instrumentation. Les équipes ne peuvent optimiser ce qu'elles ne mesurent pas. Assurez une visibilité sur l'utilisation des jetons, la sélection des modèles et l'attribution des coûts avec une granularité adaptée à chaque requête.

Ensuite, mettez en œuvre des solutions rapides : la mise en cache des requêtes fréquentes et l’acheminement des requêtes simples vers des modèles performants. Ces mesures produisent un impact immédiat tout en renforçant les capacités de l’organisation pour une optimisation plus poussée.

L'avantage concurrentiel revient aux équipes qui considèrent l'optimisation des coûts comme une démarche continue plutôt que comme un projet ponctuel. Il est essentiel de mettre en place l'infrastructure nécessaire, d'établir les bonnes pratiques et d'itérer en permanence à mesure que les usages évoluent et que de nouveaux modèles émergent.

L'avenir du déploiement de l'IA appartient aux organisations qui relèvent les défis techniques et économiques. Optimisez dès aujourd'hui !.