Resumen rápido: La optimización de costos de LLM en la implementación de IA requiere un enfoque multicapa que combine la selección inteligente de modelos, el ajuste de la infraestructura y la gestión de tokens. Las organizaciones pueden reducir los costos entre 60 y 851 TP3T mediante técnicas como el enrutamiento de modelos, el almacenamiento en caché semántico y la optimización de la caché KV, sin sacrificar la precisión. La clave reside en tratar los costos de LLM como si fueran costos de unidades de fabricación, en lugar de los gastos de software tradicionales.

Un chatbot de atención al cliente que gestiona 500 000 solicitudes mensuales a 1500 tokens por solicitud genera aproximadamente 18 000 tokens al mes, solo por una única función. Si ampliamos esto a 10 000 conversaciones diarias, los costes superan los 1500 tokens diarios solo por los tokens de entrada.

Esto no es la gestión de costes tradicional en la nube. Los productos nativos de LLM heredan propiedades tanto de bienes físicos como de software: se escalan instantáneamente como el código, pero conllevan costes variables significativos por uso. A medida que las organizaciones implementan cada vez más modelos a gran escala, la gestión de costes se ha convertido en un factor diferenciador competitivo, más que en una simple cuestión operativa.

La diferencia de precios entre proveedores es considerable. GPT-5.4 cobra $2.50 por millón de tokens de entrada, mientras que Claude 4.5 Sonnet cobra $3 por millón de tokens de entrada. Pero la selección del proveedor es solo el comienzo: la optimización de los costos de producción exige una planificación a nivel de infraestructura.

¿Por qué los costes de los másteres en Derecho (LLM) se comportan de forma diferente?

El software tradicional funciona con un modelo económico simple: altos costos iniciales de desarrollo y luego costos marginales que se acercan a cero por cada usuario adicional. Aloje la aplicación una vez y dé servicio a millones.

Las aplicaciones nativas de IA rompen por completo este modelo.

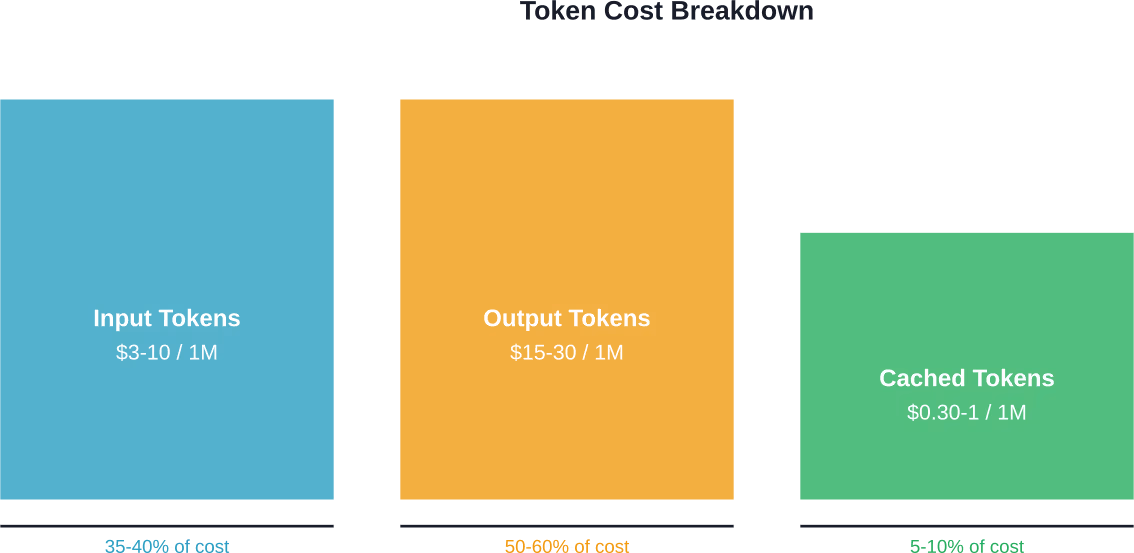

Cada inferencia conlleva un coste computacional real. Los tokens de entrada, los tokens de salida y los tokens en caché tienen estructuras de precios diferentes. El precio depende de varias variables interrelacionadas que cambian dinámicamente según las características de la carga de trabajo.

La longitud del contexto es más importante de lo que la mayoría de los equipos esperan. Un modelo con un contexto de 2048 tokens puede procesar hasta 2048 tokens a la vez. Sin embargo, procesar contextos más largos aumenta los requisitos de memoria de forma exponencial, no lineal. La caché de clave-valor, que elimina el recálculo redundante de representaciones de tokens anteriores durante la generación autorregresiva, crece proporcionalmente con la longitud de la secuencia.

Los sistemas de producción se enfrentan a cuellos de botella que no existen en la fase de desarrollo. El ancho de banda de la memoria se convierte en la principal limitación durante la fase de decodificación. El mecanismo de atención multi-cabeza realiza múltiples cálculos de atención en paralelo, pero las limitaciones del hardware determinan el rendimiento real.

El problema de la economía unitaria

Las empresas emergentes de IA se enfrentan a desafíos únicos en tres áreas: economía unitaria (coste por inferencia), planificación de la capacidad (suministro de GPU) y optimización del rendimiento (calidad de la salida del modelo por token).

A diferencia del software tradicional, donde el costo marginal de un nuevo usuario es prácticamente cero, los productos nativos de LLM tienen componentes de costo variable significativos. Esto obliga a los equipos a pensar como fabricantes: monitorear la eficiencia de la producción, optimizar el rendimiento y gestionar las restricciones de suministro.

En serio: la mayoría de los equipos no pueden explicar con precisión los costos de sus proyectos de IA. La complejidad de las estructuras de costos de la IA, que incluyen computación, ancho de banda de memoria, almacenamiento y redes, genera lagunas en la rendición de cuentas. Los equipos de ingeniería carecen de visibilidad sobre qué casos de uso generan gastos o qué optimizaciones ofrecerían el mayor retorno de la inversión.

Estrategias de selección de modelos y enrutamiento

Los recientes avances en los modelos de lenguaje han creado un ecosistema en expansión. Actualmente, las organizaciones pueden elegir entre docenas de opciones de código abierto y comerciales, cada una con diferentes ventajas y desventajas en cuanto a rendimiento y coste.

Pero tratar todas las consultas como igualmente complejas supone un derroche de dinero.

| Estrategia | Cómo funciona | Ahorros típicos |

|---|---|---|

| Enrutamiento estático | Dirigir las consultas a modelos predeterminados según el caso de uso. | 30-40% |

| Enrutamiento dinámico | Analizar la complejidad de las consultas en tiempo real y seleccionar el modelo óptimo. | 45-60% |

| Cascada | Pruebe primero con modelos más económicos y recurra a medidas más urgentes solo cuando sea necesario. | 50-70% |

| Máster en Derecho Pastoral | Utilice modelos costosos para obtener pistas y modelos más económicos para la ejecución. | 60-75% |

Una investigación de arXiv demuestra que los Modelos de Lenguaje Pequeños (SLM, por sus siglas en inglés) con sugerencias específicas de Modelos de Lenguaje Grandes (LLM, por sus siglas en inglés) logran mejoras en la precisión con un uso mínimo de recursos de LLM. Los datos muestran que la precisión del SLM (Llama-3.2-3B-Instruct) en función del tamaño de la sugerencia del LLM (Llama-3.3-70B-Versatile) mejora sustancialmente con sugerencias pequeñas que representan solo entre 10 y 30% de la respuesta completa del LLM, con rendimientos decrecientes más allá de 60%.

Esto justifica un enfoque de acompañamiento: solicitar sugerencias en lugar de respuestas completas. La estrategia trata al costoso modelo como un consultor en lugar de un ejecutor: se paga por orientación, no por respuestas completas.

Técnicas de optimización a nivel de infraestructura

La selección del modelo es solo una de las herramientas. La optimización de la infraestructura aborda los cuellos de botella impuestos por el hardware que limitan el rendimiento y aumentan los costos.

Gestión de caché KV

La caché clave-valor es una optimización fundamental en los modelos basados en Transformer. Pero también consume mucha memoria.

Durante la generación autorregresiva, el modelo calcula la atención sobre todos los tokens anteriores en cada paso. Sin almacenamiento en caché, esto requiere recalcular repetidamente las representaciones de toda la secuencia. La caché KV almacena estos cálculos, priorizando la velocidad sobre la memoria.

El problema radica en que el tamaño de la caché crece linealmente con la longitud de la secuencia y el tamaño del lote. Para aplicaciones de contexto largo, la memoria caché puede superar los pesos del modelo. Algunas estrategias para gestionar esto incluyen:

- Cuantificación de valores almacenados en caché a menor precisión (8 bits o 4 bits)

- Implementar políticas de desalojo que descarten los tokens menos relevantes.

- Uso de la atención de ventana deslizante para el crecimiento de memoria limitada

- Compresión de entradas de caché mediante tokens de compresión aprendidos

Las investigaciones sobre la compresión de la esencia de las oraciones demuestran que los modelos de lenguaje natural preentrenados pueden ajustarse para comprimir el contexto mediante tokens aprendidos, lo que reduce las exigencias de memoria y computación para secuencias largas. Los métodos de ajuste fino, que optimizan el uso de parámetros, permiten que los modelos compactos gestionen tareas de razonamiento sin necesidad de expandir completamente la caché de clave-valor.

Optimización del procesamiento por lotes y del rendimiento

Los sistemas de inferencia deben equilibrar la latencia con el rendimiento. Los lotes de mayor tamaño mejoran la utilización del hardware, pero aumentan los tiempos de espera para las solicitudes individuales.

La fase de cálculo durante el prellenado (procesamiento de tokens de entrada) se beneficia enormemente del procesamiento por lotes: la utilización de la GPU aumenta linealmente con el tamaño del lote hasta los límites del hardware. Sin embargo, la fase de decodificación está limitada por el ancho de banda. Añadir más solicitudes a un lote no aumenta proporcionalmente el rendimiento, ya que el ancho de banda de la memoria se convierte en el cuello de botella.

Las estrategias eficaces separan el prellenado y la decodificación en lotes distintos, lo que permite la optimización independiente de cada fase. Las técnicas de procesamiento continuo por lotes añaden nuevas solicitudes a los lotes en curso de forma dinámica, en lugar de esperar a que se complete el lote completo.

Cuantización de modelos

La cuantización reduce la precisión del modelo de punto flotante de 32 o 16 bits a enteros de 8 o 4 bits. Esto reduce proporcionalmente los requisitos de memoria y el consumo de ancho de banda.

Según una investigación del IST Austria, la cuantización GPTQ es matemáticamente equivalente al algoritmo del plano más cercano de Babai. Esta interpretación geométrica proporciona límites de error para la cuantización de modelos de lenguaje de gran tamaño, lo que permite una precisión de 4 bits con parámetros cuidadosamente calibrados para minimizar la degradación de la exactitud.

DistilBERT demuestra el poder de la destilación de modelos combinada con la cuantización. Creado por el equipo de Hugging Face, es 40% más pequeño y rápido que BERT base (aproximadamente 66 millones de parámetros frente a 110 millones), a la vez que conserva 97% del rendimiento en tareas posteriores.

| Técnica | Reducción de la memoria | Mejora de la velocidad | Impacto de la precisión |

|---|---|---|---|

| Cuantización de 8 bits | 50% | 1,5-2x | <1% pérdida |

| Cuantización de 4 bits | 75% | 2-3 veces | Pérdida de 1-3% |

| Destilación de modelos | 40-60% | 2-3 veces | Pérdida 2-5% |

| Cuantización de caché KV | 30-50% (solo caché) | 1,3-1,8x | <1% pérdida |

Almacenamiento en caché semántico para la reducción de costos

El almacenamiento en caché parece obvio: guardar los resultados y reutilizarlos. Pero las aplicaciones LLM presentan desafíos únicos.

La coincidencia exacta de cadenas falla porque los usuarios formulan preguntas idénticas de manera diferente. "What is the capital of France?" y "Tell me the capital city France" deberían coincidir con la misma entrada de caché.

El almacenamiento en caché semántico resuelve este problema al incrustar las consultas en un espacio vectorial y realizar coincidencias basadas en la similitud, en lugar de en cadenas exactas. Cuando llega una nueva consulta, el sistema calcula su incrustación y busca entradas cercanas almacenadas en caché. Si existe una coincidencia por encima de un umbral, se devuelve la respuesta almacenada. De lo contrario, se llama al modelo y se almacena el resultado en caché.

Para aplicaciones de alto volumen, el almacenamiento en caché semántico suele alcanzar tasas de aciertos de entre 40 y 601 TP3T tras la primera semana de funcionamiento. Con los precios de GPT-5, esto representa un ahorro mensual considerable para una sola función.

La implementación requiere un ajuste preciso del umbral de similitud. Si se establece demasiado alto, los aciertos de caché disminuyen drásticamente. Si se establece demasiado bajo, el sistema devuelve respuestas obsoletas o irrelevantes, lo que perjudica la experiencia del usuario.

Ingeniería rápida y gestión de tokens

Los tokens de entrada cuestan dinero. Los tokens de salida cuestan más, a menudo entre 3 y 5 veces más que la tarifa de entrada.

La optimización de prompts se centra en lograr los mismos resultados con menos tokens. Las técnicas incluyen:

- Eliminar contexto o ejemplos innecesarios

- Utilizar instrucciones con una redacción más concisa.

- Aprovechar los mensajes del sistema de manera eficiente

- Implementación del aprendizaje con pocos ejemplos

- Limitar la longitud de salida mediante instrucciones

El reto consiste en encontrar el equilibrio entre brevedad y claridad. Las indicaciones demasiado concisas suelen generar resultados de menor calidad, lo que obliga a repetir los intentos, cuyo coste supera el ahorro inicial.

Las pruebas demuestran que la compresión sistemática de las indicaciones —que elimina los tokens redundantes conservando el significado semántico— puede reducir los costos de entrada entre 20 y 401 TP3T sin pérdida de precisión. Sin embargo, esto requiere una infraestructura de evaluación que valide que las indicaciones comprimidas mantengan la calidad de la salida.

Creación de un sistema de control de costes

No se puede optimizar lo que no se mide.

Los sistemas LLM de producción requieren instrumentación que permita realizar un seguimiento de los costes con distintos niveles de detalle: por usuario, por función, por modelo y por tipo de solicitud. Esta visibilidad posibilita la toma de decisiones de optimización basadas en datos.

La mayoría de los equipos comienzan con las facturas mensuales agregadas de los proveedores. Eso es insuficiente. La instrumentación debería capturar:

- Recuento de tokens (entrada, salida, en caché) por solicitud

- Modelo utilizado y decisiones de enrutamiento

- Métricas de latencia y rendimiento

- Tasas de aciertos y efectividad de la caché

- Tasas de error y costes de reintento

- Atribución de costos a características o usuarios

Los controles presupuestarios jerárquicos permiten a los equipos establecer límites de gasto en distintos niveles: a nivel de toda la organización, por equipo, por función o por usuario. Cuando se alcanza un umbral presupuestario, el sistema puede redirigir automáticamente a modelos más económicos o implementar limitaciones de uso.

Según una investigación del MIT sobre las leyes de escalado de la IA, es fundamental definir de antemano el presupuesto de computación y la precisión objetivo del modelo. La investigación reveló que un error relativo promedio (ARE) de 4% representa aproximadamente la mejor precisión alcanzable debido al ruido aleatorio de la semilla, pero un ARE de hasta 20% sigue siendo útil para la toma de decisiones.

El problema económico del proveedor

Los servicios LLM gestionados, como Azure OpenAI, plantean desafíos de gestión de costes que difieren fundamentalmente de los modelos de nube tradicionales. La estructura de precios depende de los tokens de entrada, los tokens de salida, los tokens en caché, las unidades de rendimiento aprovisionadas (PTU) y las configuraciones de implementación.

Azure OpenAI oculta específicamente los verdaderos factores que influyen en los costos debido a su arquitectura. Las organizaciones aprovisionan capacidad en PTU sin una visibilidad clara del consumo real de tokens ni de la utilización del modelo. Esto genera lagunas en la rendición de cuentas: los equipos de ingeniería no pueden determinar qué funciones generan costos ni si las optimizaciones realmente funcionan.

Las plataformas de gestión de costes en la nube diseñadas para infraestructuras tradicionales no gestionan eficazmente las cargas de trabajo de IA. Registran las horas de las máquinas virtuales y los bytes de almacenamiento, pero carecen de la granularidad a nivel de token necesaria para la optimización de LLM.

La gestión financiera para la IA requiere un análisis económico de los casos de uso. Los equipos deben realizar un seguimiento de los costos unitarios (costo por conversación, por documento resumido, por finalización de código) en lugar de simplemente registrar el gasto total. Esto implica un cambio de enfoque, pasando de la gestión de costos de infraestructura a la eficiencia de la producción.

Marco de implementación en el mundo real

La optimización no es un proyecto puntual. Es una práctica continua que evoluciona con los patrones de uso y la disponibilidad de los modelos.

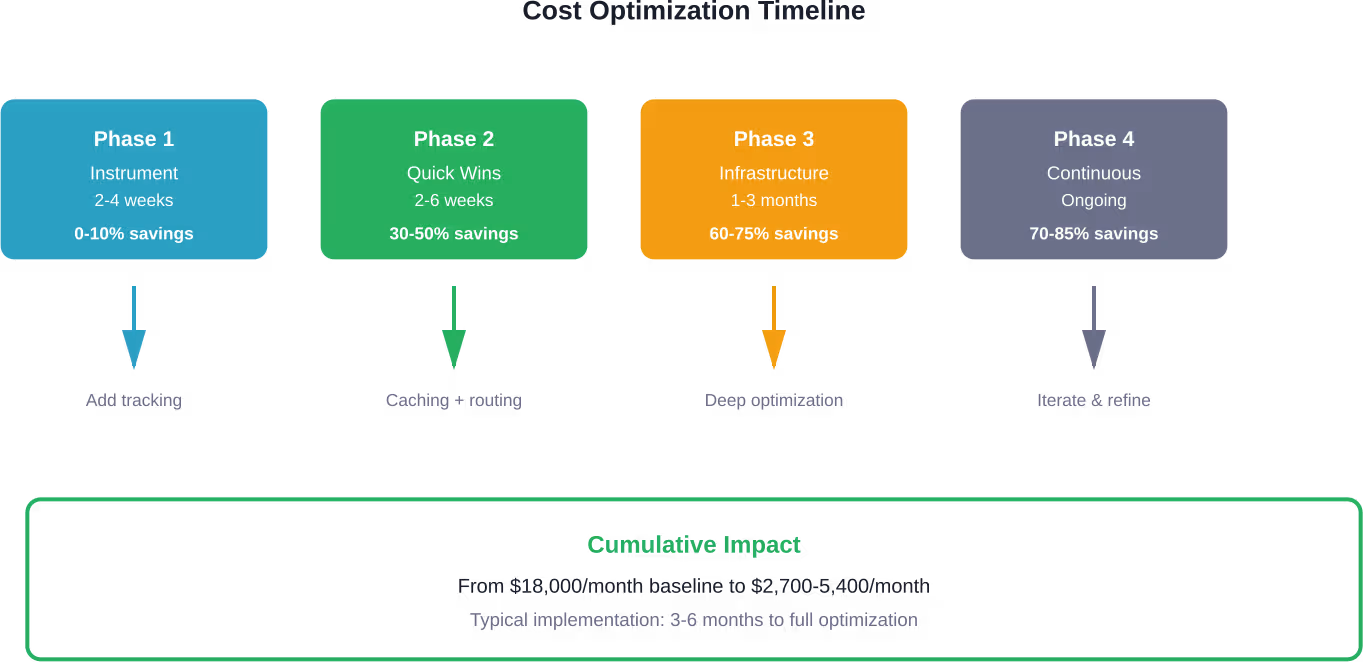

Fase 1: Línea de base e instrumentación

Comience con una instrumentación integral. Implemente un sistema de seguimiento que registre el uso de tokens, la selección de modelos, la latencia y los costos con granularidad por solicitud. Establezca métricas de referencia: costos actuales, distribución entre casos de uso y puntos de referencia de rendimiento.

Esta fase suele durar entre 2 y 4 semanas y requiere cambios mínimos en el código, principalmente la adición de registros y la recopilación de métricas.

Fase 2: Victorias rápidas

Implementar optimizaciones sencillas:

- Implementar el almacenamiento en caché semántico para consultas de alta frecuencia.

- Dirija las consultas simples a modelos más económicos.

- Comprime las indicaciones eliminando el contexto redundante.

- Establecer límites máximos de tokens de salida

Estos cambios suelen generar reducciones de costes de entre 30 y 501 TP3T en cuestión de semanas, sin pérdida de precisión.

Fase 3: Optimización de la infraestructura

Ahora abordemos optimizaciones más profundas:

- Implementar enrutamiento dinámico con análisis de complejidad

- Implementar modelos cuantizados para cargas de trabajo tolerantes a la latencia.

- Optimizar la gestión de la caché KV

- Implementar el procesamiento por lotes continuo para mejorar el rendimiento.

Esta fase requiere un mayor esfuerzo de ingeniería (normalmente de 1 a 3 meses), pero permite una reducción de costes adicional de 20-40%.

Fase 4: Mejora continua

Establezca mecanismos de retroalimentación. Supervise qué consultas se enrutan a dónde, qué entradas de caché se acceden con frecuencia y dónde surgen problemas de latencia o calidad. Utilice estos datos para refinar la lógica de enrutamiento, actualizar las políticas de caché y reajustar los parámetros de cuantificación.

Probar nuevos modelos se convierte en algo rutinario. Cuando los proveedores lanzan opciones mejoradas, la instrumentación permite realizar pruebas A/B rápidas para validar la relación costo-calidad antes de su implementación completa.

Errores comunes que se deben evitar

La optimización de costes puede resultar contraproducente cuando los equipos optimizan las métricas equivocadas o sacrifican capacidades críticas:

- Degradación de la latencia: El almacenamiento en caché agresivo o el enrutamiento a modelos más lentos pueden aumentar los tiempos de respuesta más allá de la tolerancia del usuario. En las aplicaciones interactivas, la latencia es tan importante como el coste. Los usuarios abandonan las experiencias con retrasos de 3 a 5 segundos, independientemente de la precisión.

- erosión de la calidad: El enrutamiento excesivo a modelos pequeños degrada la calidad de la salida. Las pruebas pueden mostrar una precisión aceptable en los conjuntos de datos de referencia, pero los casos extremos en producción revelan debilidades. Implemente un sistema de monitoreo de calidad junto con el seguimiento de costos.

- Sobrediseño del almacenamiento en caché: El almacenamiento en caché semántico aumenta la complejidad de la infraestructura. Para las funciones con poco tráfico, el costo de ingeniería para implementar y mantener el almacenamiento en caché supera el ahorro. Concéntrese primero en los puntos finales con alto volumen de tráfico.

- Ignorando los costos de arranque en frío: La carga e inicialización de modelos pueden afectar el rendimiento y la eficiencia de costos. Las políticas de escalado a cero requieren una cuidadosa consideración de la latencia de inicio frente a los costos de inactividad. Equilibre los costos de inactividad con la latencia de inicio.

- Dependencia del proveedor: La optimización exhaustiva para las API o la estructura de precios específicas de un proveedor crea barreras para la migración. Siempre que sea posible, abstraiga los detalles específicos del proveedor mediante interfaces que permitan el cambio.

Reduzca los costos de implementación de LLM donde realmente comienzan.

La mayoría de los costes de implementación de LLM no se deben únicamente al modelo, sino también a cómo se diseña, integra y escala el sistema. IA superior Trabajan en todo el ciclo de vida de la implementación, desde la selección y el ajuste de modelos hasta la configuración y optimización de la infraestructura. Su enfoque se centra en la creación de sistemas de IA que se ajusten a la carga de trabajo real, ya sea mediante el uso de modelos personalizados, la optimización de los existentes o el equilibrio entre el uso de API y la implementación interna. Esto reduce la inferencia innecesaria, evita la sobredimensionación de la infraestructura y mantiene un rendimiento predecible a medida que aumenta el uso.

Los problemas de costos en la implementación generalmente provienen de decisiones tomadas antes del lanzamiento: tamaño del modelo, flujos de datos y frecuencia de las llamadas a los sistemas. Ajustar estos aspectos tiene un mayor impacto que cambiar de herramientas posteriormente. Si desea que su implementación de LLM siga siendo eficiente a medida que crece, contáctenos. IA superior y adapta tu configuración a cómo se utilizará realmente en producción.

Mirando hacia el futuro: Trayectorias de costos

Algunos creen que los costes de los másteres en Derecho tenderán a cero, haciendo innecesaria la optimización. La historia sugiere lo contrario.

Los costos de computación han disminuido constantemente durante décadas, pero la demanda crece a un ritmo mayor. Los modelos más potentes permiten nuevos casos de uso que consumen más recursos computacionales. Las ventanas de contexto se expanden de 2048 a más de 128 000 tokens, lo que multiplica los requisitos de memoria. Los modelos multimodales procesan imágenes y video junto con texto.

Las organizaciones que consideran los costos de LLM como estratégicos —desarrollando capacidades de optimización desde el principio— crean ventajas competitivas que se multiplican con el tiempo. La eficiencia en costos permite una escalabilidad sostenible, facilitando una implementación y experimentación más amplias sin que las restricciones presupuestarias limiten el desarrollo del producto.

La optimización de la infraestructura, la selección de modelos y la gestión de tokens no son proyectos puntuales. Son competencias fundamentales para las empresas nativas de IA. Los equipos que desarrollen estas capacidades ahora operarán con ventajas estructurales en cuanto a costes que sus competidores difícilmente podrán igualar.

Preguntas frecuentes

¿Cuál es la forma más rápida de reducir los costos de LLM en 30% o más?

Implemente el almacenamiento en caché semántico para consultas de alta frecuencia y dirija las solicitudes simples a modelos más económicos. Estos dos cambios suelen generar una reducción de costos de 30 a 50 TP3T en 4 a 6 semanas con un mínimo esfuerzo de ingeniería. Comience por instrumentar para identificar qué puntos finales tienen un alto volumen de solicitudes y poca diversidad de consultas; estos son candidatos ideales para el almacenamiento en caché.

¿Debería usar GPT-4 o Claude para la optimización de costes?

Ninguno de los dos es exclusivo. GPT-5.4 cobra $2.50 por millón de tokens de entrada, mientras que Claude 4.5 Sonnet cobra $3 por millón de tokens de entrada. Pero el costo por token no es el único factor: la calidad de la salida, la latencia y los requisitos de longitud del contexto también son importantes. Implemente un enrutamiento que utilice cada modelo para las cargas de trabajo donde ofrezca el mejor equilibrio entre costo, calidad y latencia. Probar diferentes modelos con datos de producción es la única manera de determinar la asignación óptima.

¿La cuantización perjudica significativamente la precisión del modelo?

No, si se realiza correctamente. Las investigaciones demuestran que la cuantización de 8 bits suele provocar una pérdida de precisión inferior a 11 TP3T, a la vez que reduce los requisitos de memoria en 501 TP3T. Incluso la cuantización de 4 bits con una calibración cuidadosa (como GPTQ) solo pierde entre 1 y 31 TP3T de precisión, a la vez que reduce la memoria en 751 TP3T. La clave reside en probar los modelos cuantizados con conjuntos de datos de evaluación representativos antes de su implementación en producción para validar un rendimiento aceptable.

¿Cuánto ahorro real puede suponer el almacenamiento en caché en un entorno de producción?

Las tasas de aciertos del almacenamiento en caché semántico suelen alcanzar entre 40 y 60 TP3T tras la primera semana de funcionamiento para la mayoría de las aplicaciones. Para un chatbot de soporte que procesa 500 000 solicitudes mensuales con precios de GPT-4, esto se traduce en un ahorro mensual de entre 7200 y 10 800 TP4T. Sin embargo, la efectividad varía según el caso de uso: las aplicaciones de preguntas frecuentes (FAQ) obtienen tasas de aciertos más altas, mientras que las aplicaciones creativas o altamente personalizadas se benefician menos del almacenamiento en caché.

¿Cuál es el retorno de la inversión al construir una infraestructura de optimización personalizada?

Para aplicaciones con un gasto mensual superior a $5000 en costos de LLM, la infraestructura de optimización personalizada suele amortizarse en 3 a 6 meses. La inversión en ingeniería oscila entre 2 y 4 meses de trabajo de un desarrollador para una implementación integral que incluya instrumentación, almacenamiento en caché y enrutamiento. Las organizaciones con un presupuesto menor deberían centrarse en optimizaciones más sencillas, como la compresión de solicitudes y la selección de proveedores, antes de desarrollar una infraestructura personalizada.

¿Cómo puedo equilibrar la optimización de costes con la latencia de respuesta?

Mida ambas métricas en conjunto y defina los compromisos aceptables. Algunas optimizaciones, como el almacenamiento en caché, reducen tanto el costo como la latencia. Otras, como el enrutamiento a modelos más pequeños, pueden aumentar ligeramente la latencia a la vez que reducen los costos. Defina acuerdos de nivel de servicio (SLA) de latencia para cada caso de uso: el chat interactivo podría requerir respuestas en fracciones de segundo, mientras que el procesamiento de documentos por lotes tolera minutos. Optimice dentro de las restricciones en lugar de tratar el costo o la latencia de forma aislada.

¿Puedo ejecutar los programas de máster en derecho (LLM) en mis propias instalaciones para reducir costes?

Quizás. La implementación local elimina los costos de la API, pero requiere infraestructura de GPU, experiencia en ingeniería para la optimización del servicio y gastos operativos. Esto resulta rentable a gran escala (aproximadamente 500 000 solicitudes diarias o más), donde los costos fijos de infraestructura se amortizan entre un alto volumen de solicitudes. Por debajo de ese umbral, las API gestionadas suelen ser más económicas si se considera el costo total de propiedad, incluido el tiempo de ingeniería.

Conclusión

La optimización de costes de LLM no es opcional para los productos nativos de IA. La economía es fundamentalmente diferente a la del software tradicional: los costes variables aumentan con el uso, lo que genera una economía unitaria similar a la de la fabricación que exige atención constante.

Pero la oportunidad es considerable. Las organizaciones que implementan una optimización integral, que combina la selección inteligente de modelos, el ajuste de la infraestructura, el almacenamiento en caché semántico y la gestión de tokens, logran reducciones de costos de entre 60 y 851 TP3T sin sacrificar la calidad ni la experiencia del usuario.

Empiece por la instrumentación. Los equipos no pueden optimizar lo que no miden. Genere visibilidad sobre el uso de tokens, la selección de modelos y la atribución de costos con un nivel de detalle que permita evaluar las solicitudes.

Luego, implemente mejoras rápidas: almacenar en caché las consultas de alta frecuencia y redirigir las solicitudes simples a modelos eficientes. Estas medidas generan un impacto inmediato a la vez que fortalecen la capacidad organizacional para una optimización más profunda.

La ventaja competitiva la obtienen los equipos que consideran la optimización de costos como una disciplina continua, en lugar de un proyecto puntual. Es fundamental construir la infraestructura, establecer las prácticas y realizar iteraciones constantes a medida que evolucionan los patrones de uso y surgen nuevos modelos.

El futuro de la implementación de la IA pertenece a las organizaciones que resuelvan tanto los desafíos técnicos como los económicos. Empiece a optimizar hoy mismo.