Resumen rápido: Crear un modelo LLM personalizado cuesta entre 125.000 y 12 millones de TP4T anualmente, dependiendo del tamaño del modelo, las opciones de infraestructura y la escala de implementación. Los modelos más pequeños (32 mil millones de parámetros) en instancias en la nube cuestan alrededor de 50.000 TP4T al año, mientras que las implementaciones empresariales de modelos de más de 70 mil millones pueden superar los 287.000 TP4T anuales solo en alojamiento. El entrenamiento desde cero añade millones en costos de GPU, preparación de datos y recursos de ingeniería, lo que hace que los servicios API sean a menudo más económicos para la mayoría de los casos de uso.

La frase “los másteres jurídicos de código abierto son gratuitos” se encuentra entre las ideas erróneas más peligrosas del sector tecnológico actual. ¿Descargables gratis? Claro. ¿Ejecutables gratis? Ni de cerca.

Las organizaciones que evalúan modelos de lenguaje personalizados se enfrentan a una estructura de costos compleja que va mucho más allá de las tarifas de licencia. Los gastos se reflejan en la infraestructura, el tiempo de ingeniería, los costos generales de mantenimiento y los costos de oportunidad estratégicos que no son evidentes de inmediato.

Este análisis examina los costos reales de implementación basándose en los requisitos de infraestructura reales, los datos de precios de la nube y las implementaciones empresariales. Las cifras provienen de implementaciones en producción, no de cálculos teóricos.

La realidad de la infraestructura: ¿Cuánto cuesta realmente el alojamiento web?

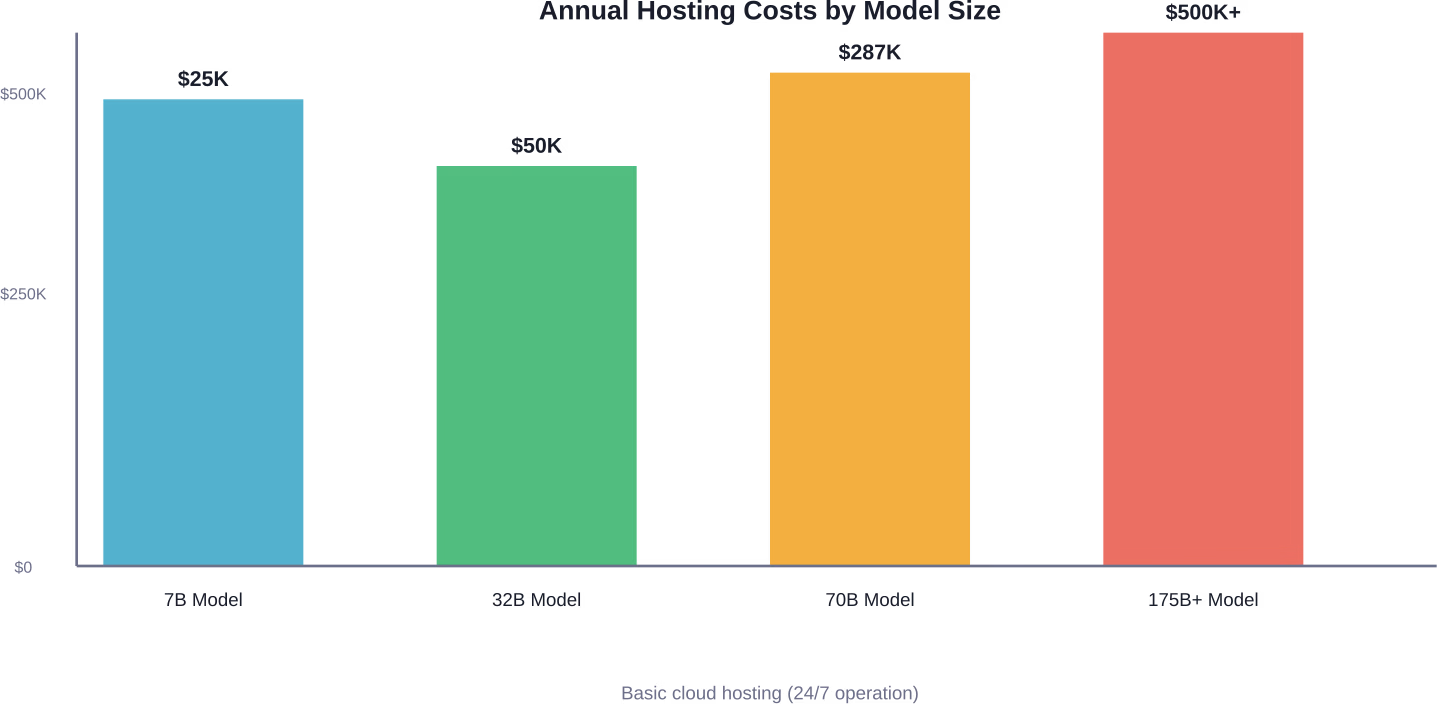

El hardware representa el gasto más visible al implementar modelos LLM personalizados. Los costos aumentan drásticamente con el tamaño del modelo, y los cálculos se vuelven complicados rápidamente.

Según debates de la comunidad que analizan escenarios de implementación reales, un modelo Qwen-2.5 32B o QwQ 32B requiere una instancia AWS g5.12xlarge equipada con 4 GPU A10G. Mantener esta configuración en funcionamiento las 24 horas del día, los 7 días de la semana, cuesta aproximadamente $50 000 al año. Esto corresponde a un modelo de tamaño moderado que gestiona cargas de trabajo de producción básicas.

Si opta por Llama-3 70B, los requisitos de infraestructura aumentan a una instancia p4d.24xlarge con 8 GPU A100. ¿El costo anual? Alrededor de $287,000 para operación continua.

Pero aquí está el detalle: estas cifras presuponen una utilización perfecta. Las implementaciones reales requieren redundancia, equilibrio de carga y capacidad de conmutación por error. Una implementación de nivel de producción con la redundancia y la monitorización adecuadas suele consumir entre cuatro y cinco veces el coste de la instancia base. Esa estimación mensual de $15 000 se dispara incluso antes de realizar cualquier ajuste o escalado.

Análisis económico de las GPU

Un estudio de arXiv que analiza la economía de la implementación local de LLM revela los costos base de las GPU que sustentan estos cálculos. Una tarjeta A800 de 80 GB, bajo supuestos comunes, tiene un costo horario base de aproximadamente $0,79 por hora. Este valor generalmente se encuentra dentro de un rango de $0,51 a $0,99 por hora, dependiendo de las especificaciones de adquisición e infraestructura.

Las plataformas en la nube añaden un margen de beneficio a los costes brutos de procesamiento. La comodidad de no tener que gestionar hardware físico conlleva un coste adicional que se acumula con el tiempo.

Requisitos de memoria y almacenamiento

Los modelos LLM requieren una cantidad considerable de memoria, más allá de la VRAM de la GPU. Un modelo con 70 mil millones de parámetros suele requerir aproximadamente 140 GB solo para cargar los pesos con precisión FP16. Si a esto le sumamos la caché KV para las ventanas de contexto, la memoria de activación durante la inferencia y la sobrecarga del marco de servicio, ese requisito teórico se dispara repentinamente a más de 200 GB de memoria del sistema.

Los costos de almacenamiento se acumulan de forma más silenciosa. Los puntos de control del modelo, los datos de entrenamiento, los registros y los artefactos de versionado se suman. Una ejecución de entrenamiento exhaustiva puede generar terabytes de artefactos que deben conservarse para garantizar la reproducibilidad y el cumplimiento normativo.

Costos de capacitación: La pregunta del millón

Alojar un modelo preentrenado es caro. ¿Entrenar uno desde cero? Ahí los costos entran en un terreno completamente diferente.

Una investigación publicada en arXiv que examinaba el preentrenamiento de modelos LLM con presupuesto limitado utilizó dos nodos de clúster, cada uno equipado con importantes recursos de GPU, para sus experimentos de entrenamiento. Incluso estos enfoques de bajo presupuesto requirieron configuraciones multi-GPU coordinadas que la mayoría de las organizaciones no pueden implementar fácilmente.

La intensidad computacional del preentrenamiento genera una estructura de costos dominada por las horas de GPU. Un entrenamiento completo para un modelo competitivo puede consumir miles de horas de GPU en aceleradores de alta gama.

¿En qué consiste realmente la preparación previa al entrenamiento?

El preentrenamiento de un modelo de lenguaje natural desde cero implica procesar enormes corpus de texto, a menudo de cientos de miles de millones a billones de tokens. El modelo aprende patrones lingüísticos, asociaciones fácticas y capacidades de razonamiento mediante la exposición repetida a estos datos.

Este proceso requiere:

- Adquisición y limpieza de datos (a menudo subestimada en su complejidad)

- Infraestructura de formación distribuida con interconexiones de alta velocidad.

- Ajuste de hiperparámetros en múltiples ejecuciones de prueba

- Seguimiento continuo e intervención cuando el entrenamiento se desestabiliza.

- Canales de gestión y evaluación de puntos de control

Cada uno de estos componentes conlleva costes directos y requiere tiempo de ingeniería.

La economía de la informática

Según una investigación de arXiv sobre economía de la inferencia, la estructura de costos marginales de las operaciones de LLM sigue un modelo de producción basado en la computación. La inferencia funciona como una "actividad de producción inteligente" donde los recursos computacionales se traducen directamente en capacidad de producción.

El entrenamiento acentúa esta relación. Mientras que los costos de inferencia aumentan con el uso, los costos de entrenamiento se concentran al inicio y son en gran medida fijos. Independientemente de si el modelo tiene éxito o fracasa, las horas de GPU se invierten.

Los proveedores de servicios en la nube ofrecen diversas opciones de GPU con diferentes características de relación precio-rendimiento. En general, los aceleradores de última generación ofrecen un mejor rendimiento por dólar, pero las limitaciones de disponibilidad y los precios elevados pueden anular las ventajas teóricas.

Los costos ocultos de los que nadie te advierte

La infraestructura y la capacitación representan partidas presupuestarias obvias. Los costos que sorprenden a las organizaciones suelen ser menos evidentes, pero igualmente impactantes.

Gastos de ingeniería y talento

El despliegue y mantenimiento de modelos de aprendizaje automático personalizados requiere conocimientos especializados. Los ingenieros de aprendizaje automático con experiencia en modelos de aprendizaje automático perciben salarios elevados, que suelen oscilar entre 150.000 y más de 300.000 dólares anuales para los profesionales sénior.

Un despliegue interno mínimo normalmente requiere:

- Al menos un ingeniero de aprendizaje automático para operaciones y ajuste fino de modelos.

- Soporte DevOps para infraestructura y monitorización

- Ingenieros de backend para trabajos de integración

- Expertos en productos/dominios para evaluación y orientación.

Según un análisis publicado en LinkedIn que examina los costos de las soluciones LLM de código abierto, incluso las implementaciones internas mínimas cuestan entre 125.000 y 190.000 dólares anuales, teniendo en cuenta los recursos de ingeniería. Las funcionalidades de cara al cliente de escala moderada ascienden a entre 500.000 y 820.000 dólares anuales. Los motores de productos principales a escala empresarial pueden superar varios millones de dólares.

Estas cifras parten de la base de que el equipo ya cuenta con la experiencia pertinente. Desarrollar esa capacidad desde cero implica costes adicionales de reclutamiento, incorporación y curva de aprendizaje.

Mantenimiento y Operaciones

Los modelos no se mantienen solos. Las implementaciones en producción requieren:

- Monitoreo de la degradación del rendimiento y la deriva

- Actualizaciones de seguridad y dependencias

- Respuesta ante incidentes cuando las cosas se rompen a las 3 de la mañana.

- Planificación de capacidad y ajustes de escala

- Optimización de costes a medida que evolucionan los patrones de uso.

Estas exigencias operativas persisten indefinidamente. La factura mensual de la nube puede estabilizarse, pero la atención humana requerida no.

Preparación y calidad de los datos

Los datos de capacitación de calidad no surgen espontáneamente. Las organizaciones generalmente necesitan:

- Licenciar o adquirir conjuntos de datos apropiados

- Limpiar y filtrar el contenido para garantizar su calidad y adecuación.

- Gestionar la privacidad de los datos y los requisitos de cumplimiento.

- Crear conjuntos de datos de evaluación para medir el rendimiento.

- Actualizar continuamente los datos a medida que evolucionan los dominios.

El trabajo con datos requiere mucha mano de obra y, a menudo, conocimientos especializados en el área. Los costos aumentan en función del volumen de datos y los requisitos de calidad.

La escala de despliegue determina los costos totales.

La diferencia entre ejecutar un modelo para herramientas internas y alimentar funciones orientadas al cliente genera variaciones de costos de un orden de magnitud.

Casos de uso internos

Implementar un LLM para la productividad interna (análisis de documentos, asistencia con el código, búsqueda interna) representa el extremo inferior del espectro de costos. Estas cargas de trabajo suelen:

- Atender a un número limitado de usuarios simultáneos (10-100)

- Tolerar una latencia más alta

- Acepte tiempos de inactividad o degradación ocasionales.

- Necesitan una supervisión y un apoyo menos rigurosos.

Incluso aquí, los costos ascienden a entre 1.040.000 y 1.040.000 dólares anuales si se tienen en cuenta los gastos generales de infraestructura, ingeniería y mantenimiento.

Características orientadas al cliente

Una vez que una solución LLM potencia las funcionalidades con las que los clientes interactúan directamente, los requisitos se vuelven considerablemente más estrictos:

- Las expectativas de latencia se reducen a tiempos de respuesta inferiores a un segundo.

- La disponibilidad debe aproximarse al 99,91 TP3T o superior.

- La carga varía de forma impredecible, lo que requiere margen de seguridad y escalabilidad.

- Los fracasos impactan directamente en los ingresos y la reputación.

Estas limitaciones hacen que los costos se sitúen entre $500K y $820K para implementaciones moderadas. Las aplicaciones de alto tráfico superan fácilmente los siete dígitos.

Motores de producto principales

Cuando un modelo LLM personalizado se convierte en el principal elemento diferenciador de un producto, las organizaciones se comprometen esencialmente a mantener la infraestructura de IA como una competencia central. Esto significa:

- Equipos especializados en aprendizaje automático e inteligencia artificial

- Mejora continua y reentrenamiento del modelo.

- Marcos sofisticados de monitoreo y experimentación

- Implementaciones multirregionales para un mejor rendimiento y fiabilidad.

- Importante atención por parte de la dirección ejecutiva e inversión estratégica.

Según un análisis de LinkedIn, estas implementaciones generan entre $6M y $12M anuales a escala empresarial. Y esto sin tener en cuenta el costo de oportunidad de los recursos de ingeniería que no se dedican a otras prioridades.

| Nivel de despliegue | Caso de uso típico | Rango de costos anuales | Restricciones clave |

|---|---|---|---|

| Herramientas internas | Búsqueda de documentos, asistencia de código, análisis | $125K–$190K | Usuarios limitados, latencia flexible. |

| Orientada al cliente | Chatbots, recomendaciones, generación de contenido | $500K–$820K | Alta disponibilidad, baja latencia |

| Producto principal | Diferenciación primaria del producto | $6M–$12M | Mejora continua, multirregional |

Ajuste fino: Un punto intermedio más accesible

La mayoría de las organizaciones no necesitan preentrenar modelos desde cero. El ajuste fino de los modelos de código abierto existentes ofrece una alternativa práctica que reduce drásticamente los costos a la vez que permite la personalización.

¿Cuánto cuesta el ajuste fino?

En arXiv se publicaron investigaciones sobre estrategias eficientes para la mejora de modelos lineales de bajo nivel (LLM), las cuales documentaron experimentos de ajuste fino utilizando técnicas como LoRA (Adaptación de Rango Bajo) en hardware modesto. El modelo base, cuantificado a 8 bits con entrenamiento LoRA, tardó aproximadamente 7 horas en una GPU NVIDIA T4 con 16 GB de VRAM. Esta prueba se realizó en Google Colab con 12 GB de RAM.

Una GPU T4 en proveedores de nube suele costar entre $0,35 y $0,50 por hora. Por lo tanto, una sesión de ajuste fino de 7 horas cuesta aproximadamente entre $2,50 y $3,50 en computación. Incluso teniendo en cuenta múltiples sesiones de entrenamiento, búsqueda de hiperparámetros y evaluación, los costos de ajuste fino generalmente se mantienen por debajo de $500–$1000 para modelos pequeños.

El tiempo de ingeniería representa la mayor inversión. Configurar los flujos de entrenamiento, preparar los conjuntos de datos y evaluar los resultados requiere experiencia, pero con un esfuerzo mucho menor que el necesario para el preentrenamiento.

Cuándo tiene sentido realizar ajustes finos

El ajuste fino funciona bien cuando:

- La terminología o el estilo específicos del dominio importan más que la capacidad general.

- Los datos propios pueden mejorar el rendimiento en tareas específicas.

- La personalización proporciona una ventaja competitiva.

- Los modelos más pequeños con ajustes precisos pueden igualar a los modelos generales más grandes.

Según una publicación del blog Hugging Face (del 20 de marzo de 2026) sobre la creación de modelos de incrustación específicos para cada dominio, las organizaciones que utilizan conjuntos de datos de entrenamiento sintéticos y métodos establecidos observaron una mejora de más de 10% en las métricas de recuperación y clasificación. Estas mejoras se lograron mediante un ajuste fino específico, no mediante grandes inversiones previas al entrenamiento.

Técnicas eficientes en parámetros

Los enfoques modernos de ajuste fino, como LoRA, QLoRA y los métodos adaptadores, reducen los requisitos de recursos al actualizar solo una pequeña fracción de los parámetros del modelo. Esto significa:

- Se necesita menos memoria durante el entrenamiento.

- Ciclos de iteración más rápidos

- Capacidad para mantener múltiples adaptaciones específicas para cada tarea.

- Menores costes de almacenamiento para variantes de modelos.

Estas técnicas hacen que la personalización sea accesible a organizaciones que no cuentan con presupuestos masivos para aprendizaje automático.

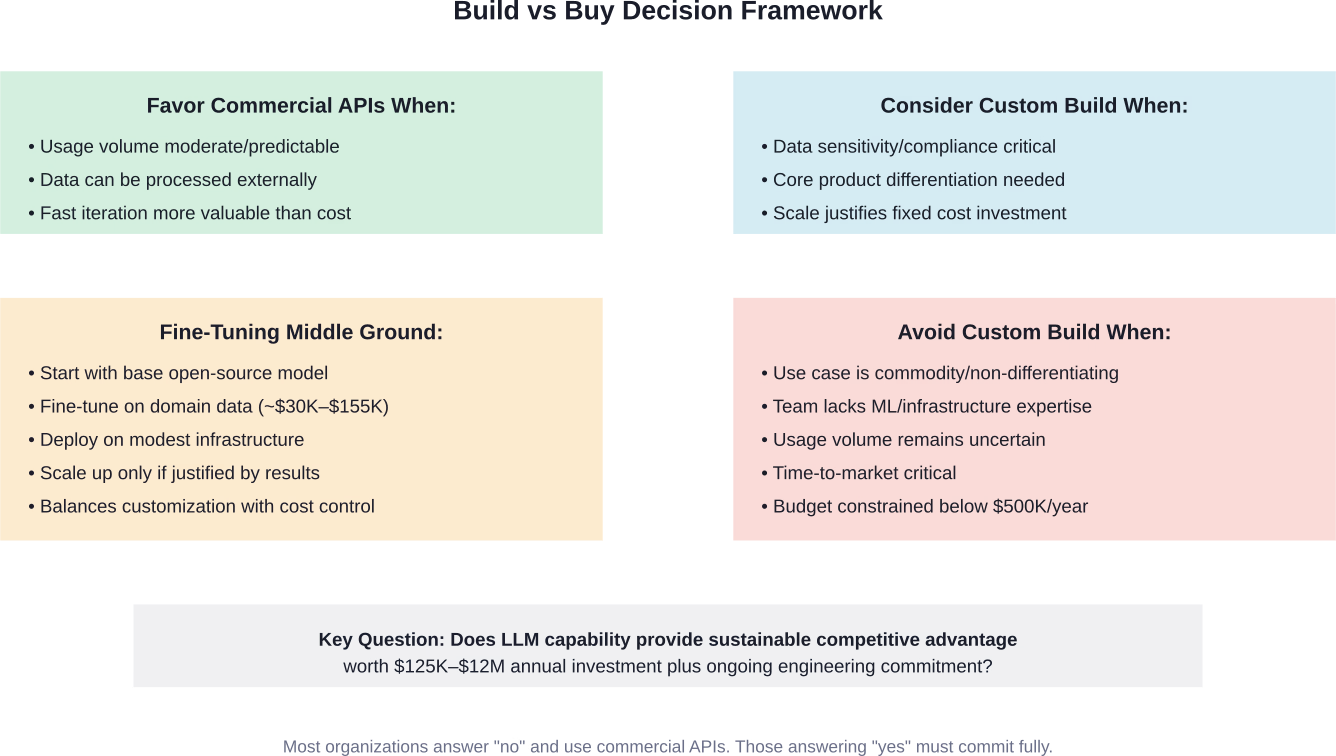

Servicios API comerciales: La alternativa

Antes de comprometerse con una infraestructura personalizada, las organizaciones deberían evaluar seriamente los servicios de API comerciales. Desde el punto de vista económico, las API suelen ser más ventajosas que los casos de uso más específicos.

Cómo funciona la fijación de precios de las API

Los proveedores comerciales de LLM suelen cobrar por token procesado. Las tarifas varían según la capacidad del modelo:

- Modelos más pequeños y rápidos: $0,10–$0,50 por millón de tokens

- Modelos de gama media: $1–$5 por millón de tokens

- Modelos de razonamiento avanzados: $10–$60 por millón de tokens

Los tokens de contexto y de salida pueden tener precios diferentes, siendo la generación de salida generalmente más costosa que el procesamiento de entrada.

Cuando las API tienen más sentido

Los API comerciales suelen ser más económicos cuando:

- El uso es moderado y predecible.

- Los requisitos de latencia permiten realizar llamadas de red.

- La sensibilidad de los datos permite el procesamiento externo.

- La iteración rápida y la experimentación son importantes.

- Los recursos de ingeniería son limitados.

Un estudio de arXiv sobre el análisis de costo-beneficio de la implementación local de programas de Maestría en Derecho (LLM) examina la decisión entre desarrollar internamente o adquirir una solución. Los servicios en la nube ofrecen comodidad y evitan la inversión inicial, pero los costos de suscripción continuos se acumulan con el tiempo.

El punto de equilibrio depende del volumen de uso y de las prioridades organizativas. Para muchas empresas, las API siguen siendo más económicas incluso a gran escala.

Enfoques híbridos

Algunas organizaciones implementan arquitecturas híbridas:

- Utilice las API para gestionar el tráfico máximo y la capacidad de desbordamiento.

- Ejecutar modelos personalizados para operaciones de alto volumen y sensibles a la latencia.

- Mantenga los datos confidenciales en sus propias instalaciones mientras utiliza las API para tareas generales.

- Prototipe con API antes de comprometerse con una infraestructura personalizada.

Este enfoque equilibra el coste, la flexibilidad y la capacidad, al tiempo que proporciona opciones de respaldo.

Estudios de casos reales y costos reportados

Comprender los costes teóricos ayuda, pero las experiencias de implementación reales revelan dónde se encuentran las estimaciones con la realidad.

Despliegue a escala moderada

Según los debates en la comunidad, la experiencia de un equipo al implementar sistemas LLM privados demostró que los costos iniciales parecían manejables, pero aumentaron rápidamente una vez que entraron en juego los requisitos de producción.

El equipo descubrió que su implementación de nivel de producción requería redundancia, almacenamiento en caché, equilibrio de carga y monitoreo integral. Lo que comenzó como unos pocos miles de dólares mensuales rápidamente se acercó a $15,000, y eso fue antes de cualquier ajuste fino o escalado significativo.

Implementación empresarial

Según el informe de OpenAI del 17 de diciembre de 2025 sobre la adopción de IA en las empresas, las organizaciones que implementaron IA a gran escala experimentaron aumentos drásticos en su uso. De acuerdo con dicho informe, el volumen de mensajes de ChatGPT se multiplicó por ocho con respecto al año anterior, mientras que el consumo de tokens de razonamiento de API por organización aumentó 320 veces.

Estos patrones de uso indican costos continuos sustanciales, tanto si se utiliza infraestructura personalizada como servicios comerciales. Las organizaciones que experimentaron un impacto tangible en la productividad y el negocio consideraron que la inversión valió la pena, pero el gasto sigue siendo significativo.

Contexto académico y de investigación

Las instituciones de investigación se enfrentan a presiones de costos similares, con limitaciones adicionales. Un equipo de Carnegie Mellon publicó en 2026 un análisis de costo-beneficio que examinaba la economía de la implementación local. Sus hallazgos destacaron que para lograr la paridad de rendimiento con los modelos comerciales se requiere una cuidadosa selección del modelo, generalmente apuntando a puntuaciones de referencia dentro de un rango de 20% con respecto a las principales ofertas comerciales.

Este umbral de rendimiento refleja la práctica empresarial, donde se aceptan pequeñas diferencias de rendimiento si otros factores —como la privacidad de los datos, la previsibilidad de los costes y la personalización— proporcionan beneficios compensatorios.

Estrategias de optimización para el control de costes

Las organizaciones comprometidas con la implementación personalizada de LLM pueden emplear diversas estrategias para gestionar los gastos.

Selección del modelo adecuado

El modelo más grande no siempre es necesario. Un análisis cuidadoso de los requisitos de la tarea a menudo revela que los modelos más pequeños, con ajustes precisos, igualan o superan a los modelos generales más grandes en cargas de trabajo específicas.

Probar diferentes tamaños de modelos con casos de uso reales ayuda a identificar el modelo más pequeño y eficaz. Esto repercute directamente en los requisitos de infraestructura y en los costes operativos.

Cuantización y compresión

La cuantización del modelo reduce la precisión de números de coma flotante de 16 o 32 bits a enteros de 8 o incluso 4 bits. Esto reduce drásticamente los requisitos de memoria y aumenta el rendimiento de la inferencia con una pérdida mínima de precisión para muchas tareas.

Las investigaciones documentadas en arXiv demostraron que el entrenamiento LoRA aplicado a modelos pre-cuantificados a 4 bits logró resultados comparables a una mayor precisión con requisitos de recursos sustancialmente menores.

Gestión eficiente de infraestructuras

Según una investigación de arXiv sobre la eficiencia del entrenamiento de modelos lineales de aprendizaje (LLM), la elección del optimizador y el ajuste de hiperparámetros influyen significativamente en los tiempos de preentrenamiento y el rendimiento final del modelo. Estudios que comparan AdamW, Lion y otros optimizadores han encontrado diferencias importantes en la velocidad de convergencia y la eficiencia computacional.

De igual modo, garantizar que las GPU se utilicen activamente en lugar de permanecer inactivas evita pagar por capacidad no utilizada. El procesamiento por lotes de las solicitudes, la implementación de colas de solicitudes y la infraestructura de autoescalado en función de la demanda mejoran la eficiencia de costes.

Almacenamiento en caché y optimización de solicitudes

Muchas consultas LLM se repiten o se superponen sustancialmente. La implementación del almacenamiento en caché semántico permite atender solicitudes idénticas o similares desde la caché en lugar de recalcular las respuestas. Esto reduce los costos de inferencia proporcionalmente a la tasa de aciertos de la caché.

El procesamiento por lotes de solicitudes también mejora la utilización de la GPU al procesar varias solicitudes simultáneamente, lo que permite amortizar la sobrecarga entre los miembros del lote.

Crea un programa LLM personalizado sin que los costos se disparen.

Los proyectos LLM personalizados rara vez se vuelven costosos de la noche a la mañana; los costos se acumulan a través de decisiones relacionadas con el alcance de los datos, el enfoque de entrenamiento y cómo se espera que funcione el modelo en el uso real. IA superior Admite el desarrollo de modelos LLM personalizados desde cero, incluyendo la preparación de conjuntos de datos, el entrenamiento del modelo, el ajuste fino y la implementación. En lugar de optar por modelos más grandes o ciclos de entrenamiento más largos, se centra en definir una configuración que se ajuste a la tarea y que pueda mantenerse a lo largo del tiempo. Esto suele implicar delimitar el alcance, estructurar los datos con mayor precisión y elegir métodos de entrenamiento que no sobrecarguen la capacidad de procesamiento.

Los proyectos tienden a exceder el presupuesto cuando el modelo se construye sin límites claros o cuando los requisitos se expanden continuamente durante el desarrollo. Mantener el sistema alineado con los casos de uso reales hace que tanto la construcción como el funcionamiento futuro sean más predecibles. Si desea un LLM personalizado que sea práctico de construir y operar, contáctenos. IA superior y alinear el proyecto antes de que aumenten los costos.

El cálculo estratégico: cuando lo personalizado tiene sentido.

Dados estos costes, ¿cuándo tiene sentido estratégico realmente construir una infraestructura LLM personalizada?

Sensibilidad y cumplimiento de los datos

Las organizaciones que manejan datos confidenciales —de los sectores sanitario, financiero y gubernamental— pueden enfrentarse a requisitos normativos o niveles de tolerancia al riesgo que impiden el uso de API externas. En estos casos, la implementación local se vuelve obligatoria en lugar de opcional.

Una investigación publicada en arXiv proporcionó un marco de decisión específico para la adopción de la Maestría en Derecho (LLM) en el sector público. El marco enfatizó que el valor estratégico y económico requiere un volumen de uso suficiente. Según el informe "Estado de la IA generativa 2025" de Menlo Ventures, citado en la investigación, los líderes del mercado, Anthropic, OpenAI y Google, experimentaron una adopción masiva; sin embargo, esto no significa que todas las organizaciones necesiten una infraestructura personalizada.

Diferenciación y ventaja competitiva

Si las capacidades de LLM proporcionan una diferenciación clave del producto, los modelos personalizados podrían justificar la inversión. Esto se aplica cuando:

- Los datos propios crean un corpus de entrenamiento sin igual.

- El conocimiento especializado del dominio no está disponible en los modelos generales.

- El comportamiento del modelo y el estilo de salida definen la identidad de la marca.

- La presión competitiva exige capacidades que otros no puedan replicar fácilmente.

Los casos de uso de productos básicos rara vez justifican una implementación personalizada. La diferenciación es importante.

Escala y patrones de uso

Los volúmenes de uso extremadamente altos pueden inclinar la economía hacia la infraestructura personalizada a pesar de los elevados costos fijos. El cálculo depende de la comparación de los costos acumulados de la API con el costo total de propiedad.

Pero hay que ser realistas con las proyecciones de uso. Sobreestimar la adopción y subestimar la eficiencia de las API conlleva a una infraestructura costosa que permanece infrautilizada.

Inversión estratégica a largo plazo

Desarrollar capacidades de gestión del aprendizaje en derecho (LLM) representa una inversión estratégica a largo plazo en la inteligencia artificial como competencia fundamental. Esto va más allá de los cálculos de costos inmediatos y abarca cuestiones de capacidades organizativas y posicionamiento estratégico.

Las organizaciones que eligen este camino se comprometen a invertir continuamente en talento, infraestructura y mejora. Los costos se extienden indefinidamente, pero también lo hace la flexibilidad estratégica.

Tendencias emergentes en los costos y perspectivas futuras

La economía de los sistemas de gestión de materiales legales personalizados sigue evolucionando rápidamente. Varias tendencias afectan a los cálculos de costes futuros.

Mejoras en la eficiencia del hardware

Las nuevas arquitecturas de GPU mejoran constantemente el rendimiento por dólar. Según un análisis de mercado de RISC-V publicado en 2025, el mercado global de procesadores de IA estaba valorado en $261,4 mil millones en 2025 y se espera que crezca a una CAGR de 8,1% hasta alcanzar los $385,4 mil millones en 2030.

Este crecimiento trae consigo competencia e innovación arquitectónica. El surgimiento de RISC-V como arquitectura nativa de IA podría alterar el dominio actual de las GPU, reduciendo potencialmente los costos mediante una mayor competencia y especialización.

Avances en algoritmos y arquitectura

La investigación continúa desarrollando arquitecturas de modelos y técnicas de entrenamiento más eficientes. Las mejoras en los mecanismos de atención, los enfoques de mezcla de expertos y los modelos dispersos reducen los requisitos computacionales para un rendimiento equivalente.

Estos avances benefician tanto a los costes de formación como a los de inferencia, aunque requieren conocimientos especializados para su implementación eficaz.

Presiones regulatorias y de cumplimiento

La creciente atención regulatoria sobre la IA —en particular en lo que respecta a la privacidad de los datos, los sesgos y la transparencia— podría inclinar la economía hacia las implementaciones locales en las industrias reguladas. Los costos de cumplimiento podrían hacer que la infraestructura personalizada resulte relativamente más atractiva, a pesar de sus mayores costos absolutos.

Consolidación del mercado

Según el informe de OpenAI sobre IA empresarial de diciembre de 2025, el volumen de mensajes de ChatGPT se multiplicó por ocho con respecto al año anterior, y el uso de la API aumentó 320 veces por organización. Esta concentración sugiere una posible consolidación del mercado en torno a unos pocos proveedores.

La dependencia de proveedores consolidados crea un riesgo estratégico que podría justificar la creación de infraestructuras a medida como medida de protección contra la dependencia de un único proveedor o la presión sobre los precios.

Preguntas frecuentes

¿Cuánto cuesta formar a un máster en Derecho (LLM) desde cero?

Entrenar un modelo LLM desde cero suele costar entre 1.500.000 y varios millones de dólares, dependiendo del tamaño del modelo y el rendimiento deseado. Esto incluye la computación con GPU (1.500.000–1.500.000+), los recursos de ingeniería (1.300.000–1.000.000+) y la preparación de datos (1.100.000–1.500.000). Los modelos de investigación más pequeños podrían entrenarse por menos utilizando técnicas de bajo presupuesto, pero un rendimiento competitivo a gran escala requiere una inversión sustancial. El ajuste fino de los modelos existentes reduce este coste a entre 1.300.000 y 1.155.000 dólares para la mayoría de los casos.

¿Qué es más económico: alojar un LLM personalizado o utilizar servicios API?

Los servicios API suelen ser más económicos para la mayoría de las organizaciones, a menos que el volumen de uso sea extremadamente alto y sostenido. Un modelo de 32 mil millones de parámetros alojado las 24 horas del día, los 7 días de la semana, cuesta alrededor de 1.000 millones de tokens anuales solo en infraestructura, mientras que un modelo de 70 mil millones de tokens cuesta aproximadamente 1.000 millones de tokens al año. El precio de las API, de entre 1.000 y 1.000 millones de tokens por millón, implica que para alcanzar el punto de equilibrio se requiere procesar miles de millones de tokens mensualmente. Además, el despliegue personalizado requiere recursos de ingeniería (entre 1.000 y 1.000 millones de tokens como mínimo), recursos que los servicios API eliminan.

¿Pueden las pequeñas empresas permitirse el lujo de crear másteres jurídicos personalizados?

Las pequeñas empresas pueden optimizar los modelos de código abierto existentes para obtener entre $30K y $155K, lo cual es factible para startups con buena financiación. Sin embargo, el preentrenamiento desde cero o la operación de implementaciones de producción a gran escala (entre $500K y $12M anuales) generalmente superan los presupuestos de las pequeñas empresas. La mayoría de las pequeñas organizaciones logran un mejor retorno de la inversión utilizando API comerciales o modelos más pequeños optimizados e implementados en infraestructura modesta. La experiencia en ingeniería requerida también representa un desafío para los equipos pequeños.

¿Cuáles son los costes ocultos de gestionar programas de máster en derecho (LLM) privados?

Los costos ocultos incluyen salarios de ingeniería (entre 150.000 y más de 300.000 dólares por puesto especializado), gastos generales de mantenimiento y operaciones, infraestructura de monitoreo, preparación y limpieza de datos, seguridad y cumplimiento normativo, y el costo de oportunidad de los recursos que no se dedican a resolver problemas empresariales clave. Las implementaciones en producción también requieren redundancia y equilibrio de carga, lo que multiplica los costos de infraestructura base por 4 o 5. Estos costos indirectos suelen superar las facturas visibles de la nube.

¿Cuánto cuesta perfeccionar un modelo existente?

El ajuste fino cuesta entre $500 y $5000 en computación para la mayoría de los proyectos, y el tiempo de ingeniería añade entre $20K y $100K dependiendo de la complejidad. La investigación muestra que una ejecución de ajuste fino de 7 horas en una sola GPU T4 cuesta aproximadamente entre $2,50 y $3,50 en computación en la nube. Las técnicas eficientes en parámetros como LoRA reducen aún más los requisitos. Los costos totales del proyecto, incluida la preparación de datos, suelen oscilar entre $30K y $155K, lo que representa una reducción de costos de aproximadamente 95% en comparación con el preentrenamiento desde cero.

¿Cuándo tiene sentido desde el punto de vista empresarial diseñar un máster en derecho (LLM) a medida?

Desarrollar modelos de lógica de negocio (LLM) personalizados tiene sentido cuando la confidencialidad de los datos exige una implementación local, cuando las capacidades del LLM proporcionan una diferenciación clave del producto que merece protección, cuando la escala de uso supera el punto de equilibrio del coste de la API o cuando se desarrolla la IA como una competencia estratégica a largo plazo. Las organizaciones que manejan datos regulados confidenciales, procesan miles de millones de tokens al mes o desarrollan productos centrados en LLM son las candidatas más probables. Los casos de uso genéricos rara vez justifican la inversión.

¿Qué tamaño de modelo deberían elegir las organizaciones para una implementación personalizada?

Las organizaciones deben elegir el modelo más pequeño que cumpla con los requisitos de rendimiento tras su optimización. En general, los modelos de 7 a 13 mil millones de parámetros gestionan eficazmente muchas cargas de trabajo de producción con una infraestructura modesta. Los modelos de 32 mil millones ofrecen mayor capacidad, pero requieren importantes recursos de GPU. Los modelos de 70 mil millones o más necesitan una infraestructura de nivel empresarial y solo deben implementarse cuando los modelos más pequeños demuestren claramente que no cumplen con los requisitos. Probar diferentes tamaños con casos de uso reales permite identificar el equilibrio adecuado entre capacidad y coste.

Tomar la decisión: un marco práctico

La decisión entre desarrollar una infraestructura de LLM a medida o utilizar servicios comerciales depende, en última instancia, de las circunstancias específicas de cada organización. A continuación, se explica cómo abordar esta decisión de forma sistemática.

Empiece por evaluar con honestidad el volumen de uso. Calcule el rendimiento esperado de tokens en todos los casos de uso. Compare los costos acumulados de la API con el costo total de la infraestructura personalizada, incluyendo ingeniería, mantenimiento y costos de oportunidad. Sea prudente con las proyecciones de uso: una sobreestimación conlleva una infraestructura costosa y subutilizada.

Evalúe los requisitos de confidencialidad de los datos. Si el cumplimiento normativo o el riesgo empresarial impiden realmente el procesamiento externo, se requiere una infraestructura personalizada, independientemente de la comparación de costos. Sin embargo, verifique que esta limitación sea real y no una mera suposición.

Consideremos la diferenciación estratégica. ¿La capacidad de LLM proporciona una ventaja competitiva sostenible o se trata de una funcionalidad básica? Los casos de uso básicos favorecen las API. Una verdadera diferenciación podría justificar la inversión en soluciones personalizadas.

Evalúe la capacidad organizacional de forma realista. La creación y operación de infraestructura LLM requiere experiencia especializada. Las organizaciones que carecen de talento en ML/IA se enfrentan a curvas de aprendizaje pronunciadas y mayores costos.

Empiece poco a poco, independientemente de la dirección que tome. Utilice API comerciales o modelos optimizados en una infraestructura modesta antes de comprometerse con una implementación personalizada a gran escala. Demuestre el valor y los patrones de uso con una inversión mínima y, cuando esté justificado, amplíe la infraestructura.

La mayoría de las organizaciones descubren que las API comerciales o los modelos más pequeños y optimizados satisfacen sus necesidades con menor coste y riesgo que las implementaciones personalizadas a gran escala. Los casos excepcionales —industrias altamente reguladas, escala masiva, diferenciación clave— justifican la infraestructura personalizada, pero son la minoría.

Los costos son reales y sustanciales. Las organizaciones que se comprometen con una infraestructura de LLM personalizada deben abordarla como una inversión estratégica a largo plazo, con atención y recursos constantes. Las soluciones a medias conducen a costosos fracasos.

¿Listo para explorar la implementación de LLM en casos de uso específicos? Evalúe las opciones sistemáticamente, valide las suposiciones con pruebas a pequeña escala y ajuste las inversiones a medida que el uso y el valor se hagan evidentes. La tecnología es potente, pero el éxito requiere adaptar los enfoques de implementación a las necesidades y capacidades reales de la organización.