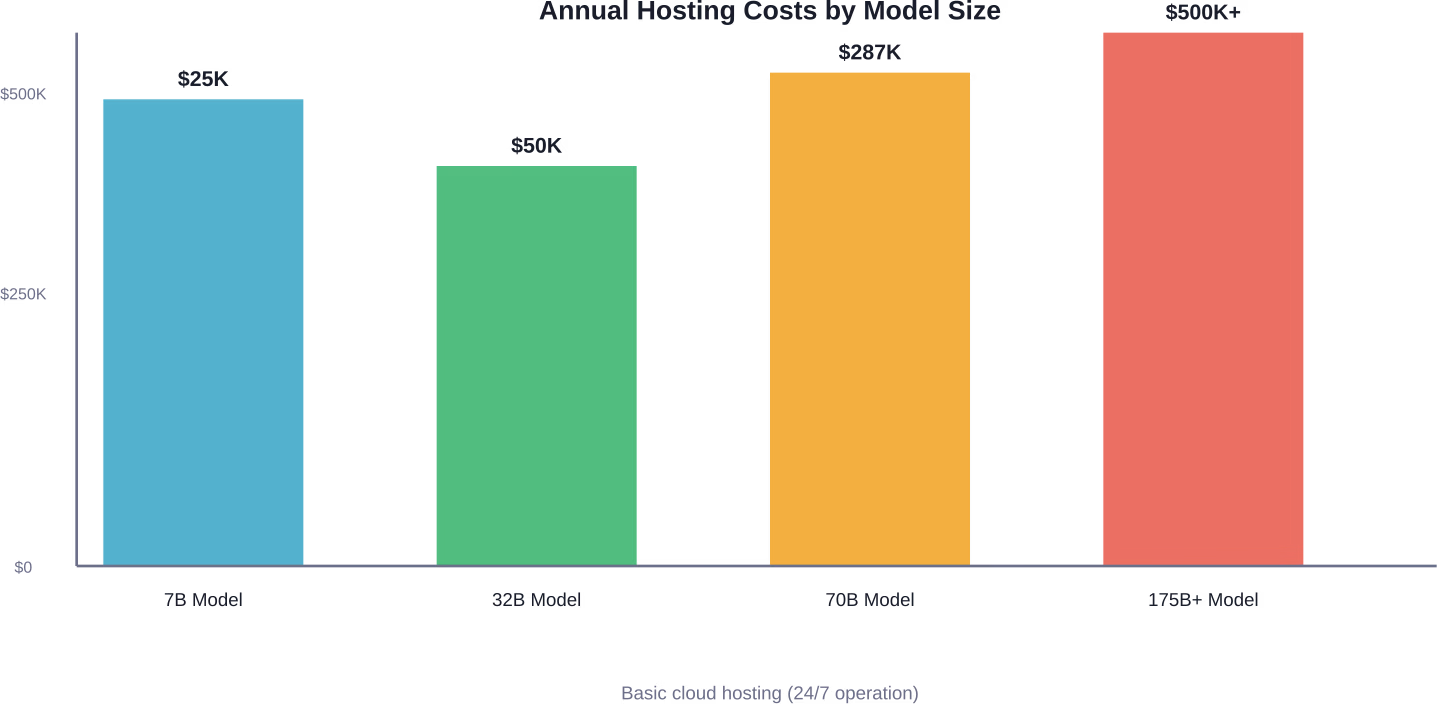

Kurzzusammenfassung: Die Entwicklung eines kundenspezifischen LLM kostet je nach Modellgröße, Infrastruktur und Bereitstellungsumfang jährlich zwischen 125.000 und 12.000 US-Dollar. Kleinere Modelle (32 Milliarden Parameter) auf Cloud-Instanzen kosten etwa 50.000 US-Dollar pro Jahr, während die Hostingkosten für Unternehmensimplementierungen mit über 70 Milliarden Modellen jährlich über 287.000 US-Dollar liegen können. Das Training von Grund auf verursacht zusätzliche Kosten in Millionenhöhe für GPUs, Datenaufbereitung und Entwicklungsressourcen – API-Dienste sind daher in den meisten Anwendungsfällen oft wirtschaftlicher.

Die Aussage “Open-Source-LLMs sind kostenlos” zählt aktuell zu den gefährlichsten Irrtümern im Technologiebereich. Kostenlos herunterzuladen? Sicher. Kostenlos zu nutzen? Weit gefehlt.

Organisationen, die benutzerdefinierte Sprachmodelle evaluieren, sehen sich mit einer komplexen Kostenstruktur konfrontiert, die weit über Lizenzgebühren hinausgeht. Die Ausgaben äußern sich in Infrastruktur, Entwicklungszeit, Wartungsaufwand und strategischen Opportunitätskosten, die nicht sofort ersichtlich sind.

Diese Aufschlüsselung untersucht die tatsächlichen Bereitstellungskosten auf Basis realer Infrastrukturanforderungen, Cloud-Preisdaten und Implementierungen in Unternehmen. Die Zahlen stammen aus produktiven Implementierungen und nicht aus theoretischen Berechnungen.

Die Realität der Infrastruktur: Was Hosting tatsächlich kostet

Die Hardware stellt den sichtbarsten Kostenfaktor beim Einsatz kundenspezifischer LLMs dar. Die Kosten steigen mit der Modellgröße dramatisch an, und die Berechnungen werden schnell unübersichtlich.

Laut Diskussionen in der Community, in denen reale Einsatzszenarien analysiert wurden, benötigt ein Qwen-2.5 32B- oder QwQ 32B-Modell eine AWS g5.12xlarge-Instanz mit vier A10G-GPUs. Der 24/7-Betrieb dieser Konfiguration kostet jährlich etwa 1.400.000 USD. Dies gilt für ein mittelgroßes Modell, das grundlegende Produktionslasten bewältigt.

Beim Upgrade auf Llama-3 70B steigen die Infrastrukturanforderungen auf eine p4d.24xlarge-Instanz mit 8 A100-GPUs. Die jährlichen Kosten? Rund 1.400.287.000 PKR für den Dauerbetrieb.

Aber hier liegt der Haken: Diese Zahlen setzen eine optimale Auslastung voraus. In der Praxis benötigen Implementierungen Redundanz, Lastverteilung und Ausfallsicherheit. Eine produktionsreife Implementierung mit angemessener Redundanz und Überwachung kostet typischerweise das Vier- bis Fünffache der Basisinstanz. Die geschätzten monatlichen Kosten von $15.000 steigen also bereits vor jeglicher Optimierung oder Skalierung enorm an.

GPU-Ökonomie im Detail

Eine Studie von arXiv zur Wirtschaftlichkeit von LLM-Implementierungen vor Ort liefert Basiskosten für GPUs, die in diese Berechnungen einfließen. Eine A800 80G-Karte verursacht unter gängigen Annahmen Basiskosten von etwa $0,79 pro Stunde. Diese Kosten liegen in der Regel zwischen $0,51 und $0,99 pro Stunde, abhängig von Beschaffung und Infrastruktur.

Cloud-Plattformen schlagen zusätzlich zu den reinen Rechenkosten einen Aufschlag auf. Der Komfort, keine physische Hardware verwalten zu müssen, hat seinen Preis, der sich im Laufe der Zeit immer weiter erhöht.

Speicher- und Speicheranforderungen

LLMs benötigen deutlich mehr Speicher als der GPU-VRAM. Ein Modell mit 70 Milliarden Parametern benötigt typischerweise etwa 140 GB allein zum Laden der Gewichte in FP16-Genauigkeit. Hinzu kommen der KV-Cache für Kontextfenster, der Aktivierungsspeicher während der Inferenz und der Overhead für das Serving-Framework – so schnellt der theoretische Bedarf auf über 200 GB Systemspeicher hoch.

Speicherkosten fallen oft unbemerkt an. Modell-Checkpoints, Trainingsdaten, Protokolle und Versionsartefakte summieren sich. Ein umfassender Trainingslauf kann Terabytes an Artefakten erzeugen, die aus Gründen der Reproduzierbarkeit und Compliance aufbewahrt werden müssen.

Trainingskosten: Die Millionen-Dollar-Frage

Das Hosting eines vortrainierten Modells ist teuer. Ein Modell von Grund auf zu trainieren? Da bewegen sich die Kosten in einer ganz anderen Liga.

Eine auf arXiv veröffentlichte Studie, die das Vortraining von LLMs mit begrenztem Budget untersuchte, nutzte für ihre Trainingsexperimente zwei Clusterknoten, die jeweils mit erheblichen GPU-Ressourcen ausgestattet waren. Selbst diese kostengünstigen Ansätze erforderten koordinierte Multi-GPU-Setups, die die meisten Organisationen nicht ohne Weiteres realisieren können.

Der hohe Rechenaufwand des Vortrainings führt zu einer Kostenstruktur, die von GPU-Stunden dominiert wird. Ein vollständiger Trainingslauf für ein wettbewerbsfähiges Modell kann Tausende von GPU-Stunden auf High-End-Beschleunigern in Anspruch nehmen.

Was die Vorbereitung tatsächlich beinhaltet

Das Vortraining eines LLM von Grund auf bedeutet die Verarbeitung riesiger Textkorpora – oft Hunderte von Milliarden bis Billionen von Token. Das Modell lernt Sprachmuster, faktische Zusammenhänge und logisches Denken durch wiederholte Auseinandersetzung mit diesen Daten.

Dieser Prozess erfordert:

- Datenerfassung und -bereinigung (oftmals unterschätzt in ihrer Komplexität)

- Verteilte Trainingsinfrastruktur mit Hochgeschwindigkeitsverbindungen

- Hyperparameter-Optimierung über mehrere Testläufe

- Kontinuierliche Überwachung und Intervention bei Trainingsinstabilität

- Checkpoint-Management- und Evaluierungspipelines

Jede dieser Komponenten verursacht sowohl direkte Kosten als auch einen hohen Entwicklungsaufwand.

Die Ökonomie des Rechnens

Laut einer Studie von arXiv zur Inferenzökonomie folgt die Grenzkostenstruktur von LLM-Operationen einem rechengetriebenen Produktionsmodell. Inferenz fungiert als “intelligente Produktionsaktivität”, bei der Rechenressourcen direkt in Produktionskapazität umgesetzt werden.

Das Training verstärkt diesen Zusammenhang. Während die Kosten für die Inferenz mit der Nutzung skalieren, fallen die Trainingskosten im Voraus an und sind weitgehend fix. Unabhängig vom Erfolg oder Misserfolg des Modells werden die GPU-Stunden verbraucht.

Cloud-Anbieter bieten verschiedene GPU-Optionen mit unterschiedlichen Preis-Leistungs-Verhältnissen an. Generell bieten die Beschleuniger der neuesten Generation ein besseres Preis-Leistungs-Verhältnis, jedoch können Verfügbarkeitsbeschränkungen und höhere Preise die theoretischen Vorteile zunichtemachen.

Die versteckten Kosten, vor denen Sie niemand warnt

Infrastruktur und Schulungen sind offensichtliche Kostenfaktoren. Die Kosten, die Organisationen durch unvorbereitete Aktionen entstehen, sind tendenziell weniger offensichtlich, aber nicht weniger wirkungsvoll.

Ingenieur- und Personalkosten

Die Implementierung und Wartung kundenspezifischer LLMs erfordert spezialisiertes Fachwissen. Machine-Learning-Ingenieure mit LLM-Erfahrung erzielen überdurchschnittliche Gehälter – oft 150.000 bis über 300.000 US-Dollar jährlich für erfahrene Fachkräfte.

Für eine minimale interne Bereitstellung sind typischerweise folgende Anforderungen erforderlich:

- Mindestens ein ML-Ingenieur für Modellbetrieb und Feinabstimmung

- DevOps-Unterstützung für Infrastruktur und Überwachung

- Backend-Entwickler für Integrationsarbeiten

- Produkt-/Domänenexperten für Bewertung und Beratung

Einer auf LinkedIn veröffentlichten Analyse der Kosten von Open-Source-LLM zufolge belaufen sich die Kosten selbst minimaler interner Implementierungen unter Berücksichtigung der Entwicklungsressourcen auf 125.000 bis 190.000 US-Dollar pro Jahr. Kundenorientierte Funktionen mittleren Umfangs verursachen jährliche Kosten von 500.000 bis 820.000 US-Dollar. Kernprodukt-Engines im Unternehmensmaßstab können mehrere Millionen US-Dollar übersteigen.

Diese Zahlen setzen voraus, dass das Team bereits über die entsprechende Expertise verfügt. Der Aufbau dieser Kompetenz von Grund auf verursacht zusätzliche Kosten für Rekrutierung, Einarbeitung und Lernprozesse.

Wartung und Betrieb

Modelle warten sich nicht von selbst. Für den Produktiveinsatz ist Folgendes erforderlich:

- Überwachung der Leistungsverschlechterung und -drift

- Sicherheitspatches und Abhängigkeitsaktualisierungen

- Reaktion auf Zwischenfälle, wenn um 3 Uhr morgens etwas kaputt geht

- Kapazitätsplanung und Skalierungsanpassungen

- Kostenoptimierung im Zuge der Weiterentwicklung von Nutzungsmustern

Diese betrieblichen Anforderungen bleiben auf unbestimmte Zeit bestehen. Die monatlichen Cloud-Kosten mögen sich stabilisieren, der dafür benötigte Personalaufwand jedoch nicht.

Datenaufbereitung und -qualität

Qualitativ hochwertige Trainingsdaten entstehen nicht von selbst. Organisationen müssen in der Regel Folgendes tun:

- Lizenzen oder geeignete Datensätze erwerben

- Inhalte auf Qualität und Angemessenheit prüfen und filtern

- Umgang mit Datenschutz- und Compliance-Anforderungen

- Erstellung von Auswertungsdatensätzen zur Leistungsmessung

- Daten kontinuierlich aktualisieren, wenn sich Domänen weiterentwickeln

Die Datenverarbeitung ist arbeitsintensiv und erfordert häufig Fachwissen. Die Kosten steigen mit dem Datenvolumen und den Qualitätsanforderungen.

Der Umfang des Einsatzes bestimmt die Gesamtkosten.

Der Unterschied zwischen dem Betrieb eines Modells für interne Tools und dem Betrieb eines Modells für kundenorientierte Funktionen führt zu Kostenunterschieden in Größenordnungen.

Interne Anwendungsfälle

Der Einsatz eines LLM zur Steigerung der internen Produktivität – Dokumentenanalyse, Codeunterstützung, interne Suche – stellt das untere Ende des Kostenspektrums dar. Diese Arbeitslasten umfassen typischerweise:

- Bedienung einer begrenzten Anzahl gleichzeitiger Nutzer (10-100)

- Höhere Latenz tolerieren

- Akzeptieren Sie gelegentliche Ausfallzeiten oder Leistungseinbußen.

- Weniger strenge Überwachung und Unterstützung erforderlich

Auch hier belaufen sich die Kosten jährlich auf $125K–$190K, wenn man die Gemeinkosten für Infrastruktur, Engineering und Instandhaltung berücksichtigt.

Kundenorientierte Merkmale

Sobald ein LLM Funktionen bereitstellt, mit denen Kunden direkt interagieren, steigen die Anforderungen erheblich:

- Die Latenzerwartungen sinken auf Reaktionszeiten im Subsekundenbereich.

- Die Verfügbarkeit muss mindestens 99,91 TP3T betragen.

- Die Last schwankt unvorhersehbar und erfordert daher Spielraum und Skalierbarkeit.

- Fehler haben direkte Auswirkungen auf Umsatz und Reputation.

Diese Einschränkungen treiben die Kosten für moderate Implementierungen in den Bereich von $500K bis $820K. Anwendungen mit hohem Datenverkehr überschreiten leicht siebenstellige Beträge.

Kernprodukt-Engines

Wenn ein maßgeschneidertes LLM zum zentralen Unterscheidungsmerkmal eines Produkts wird, verpflichten sich Unternehmen im Wesentlichen dazu, die KI-Infrastruktur als Kernkompetenz zu pflegen. Das bedeutet:

- Dedizierte ML/KI-Teams

- Kontinuierliche Modellverbesserung und Umschulung

- Ausgefeilte Überwachungs- und Experimentierrahmen

- Multiregionale Bereitstellungen für Leistung und Zuverlässigkeit

- Erhebliche Aufmerksamkeit der Führungsebene und strategische Investitionen

Laut einer Analyse von LinkedIn belaufen sich die Kosten für diese Implementierungen im Unternehmensmaßstab auf 1,4 Billionen bis 1,4 Billionen US-Dollar jährlich. Dabei sind die Opportunitätskosten, die durch die dadurch entstehenden, für andere Prioritäten nicht verfügbaren Entwicklungsressourcen entstehen, noch nicht berücksichtigt.

| Bereitstellungsebene | Typischer Anwendungsfall | Jährliche Kostenspanne | Wichtigste Einschränkungen |

|---|---|---|---|

| Interne Tools | Dokumentensuche, Codeunterstützung, Analyse | $125K–$190K | Begrenzte Benutzerzahl, flexible Latenz |

| Kundenkontakt | Chatbots, Empfehlungen, Content-Generierung | $500K–$820K | Hohe Verfügbarkeit, geringe Latenz |

| Kernprodukt | Primäre Produktdifferenzierung | $6M–$12M | Kontinuierliche Verbesserung, mehrere Regionen |

Feinabstimmung: Ein zugänglicherer Mittelweg

Die meisten Organisationen müssen Modelle nicht von Grund auf vortrainieren. Die Feinabstimmung bestehender Open-Source-Modelle bietet eine pragmatische Alternative, die die Kosten drastisch senkt und gleichzeitig die Anpassung ermöglicht.

Was die Feinabstimmung kostet

Eine auf arXiv veröffentlichte Studie zu effizienten Strategien zur Verbesserung von LLMs dokumentierte Feinabstimmungsexperimente mit Techniken wie LoRA (Low-Rank Adaptation) auf einfacher Hardware. Das Basismodell, quantisiert mit 8 Bit und trainiert mit LoRA, benötigte auf einer einzelnen NVIDIA T4 GPU mit 16 GB VRAM etwa 7 Stunden. Die Ausführung erfolgte auf Google Colab mit 12 GB RAM.

Eine T4-GPU bei Cloud-Anbietern kostet typischerweise $0,35–$0,50 pro Stunde. Ein 7-stündiger Feinabstimmungslauf verursacht daher Rechenkosten von etwa $2,50–$3,50. Selbst unter Berücksichtigung mehrerer Trainingsläufe, der Hyperparameter-Suche und der Evaluierung bleiben die Kosten für die Feinabstimmung bei kleineren Modellen in der Regel unter $500–$1000.

Der Entwicklungsaufwand stellt die größere Investition dar. Das Einrichten von Trainingspipelines, das Aufbereiten von Datensätzen und das Auswerten der Ergebnisse erfordern zwar Fachwissen, jedoch nur einen Bruchteil des Aufwands, der für das Vortraining notwendig ist.

Wann Feinabstimmung sinnvoll ist

Feinabstimmung funktioniert gut, wenn:

- Domänenspezifische Terminologie oder Stilistik sind wichtiger als allgemeine Fähigkeiten.

- Proprietäre Daten können die Leistung bei bestimmten Aufgaben verbessern

- Individualisierung bietet Wettbewerbsvorteile

- Kleinere Modelle mit Feinabstimmung können mit größeren allgemeinen Modellen mithalten.

Laut einem Blogbeitrag von Hugging Face (veröffentlicht am 20. März 2026) zum Erstellen domänenspezifischer Einbettungsmodelle erzielten Organisationen, die synthetische Trainingsdatensätze und etablierte Verfahren nutzten, eine Verbesserung von über 10¹³T bei den Recall- und Ranking-Metriken. Diese Verbesserungen resultierten aus gezieltem Feintuning und nicht aus massiven Investitionen in das Vortraining.

Parametereffiziente Verfahren

Moderne Feinabstimmungsverfahren wie LoRA, QLoRA und Adaptermethoden reduzieren den Ressourcenbedarf, indem sie nur einen kleinen Teil der Modellparameter aktualisieren. Das bedeutet:

- Weniger Speicherplatz wird während des Trainings benötigt

- Schnellere Iterationszyklen

- Fähigkeit, mehrere aufgabenspezifische Anpassungen aufrechtzuerhalten

- Geringere Lagerkosten für Modellvarianten

Diese Techniken ermöglichen es auch Organisationen ohne massive Budgets für maschinelles Lernen, individuelle Anpassungen vorzunehmen.

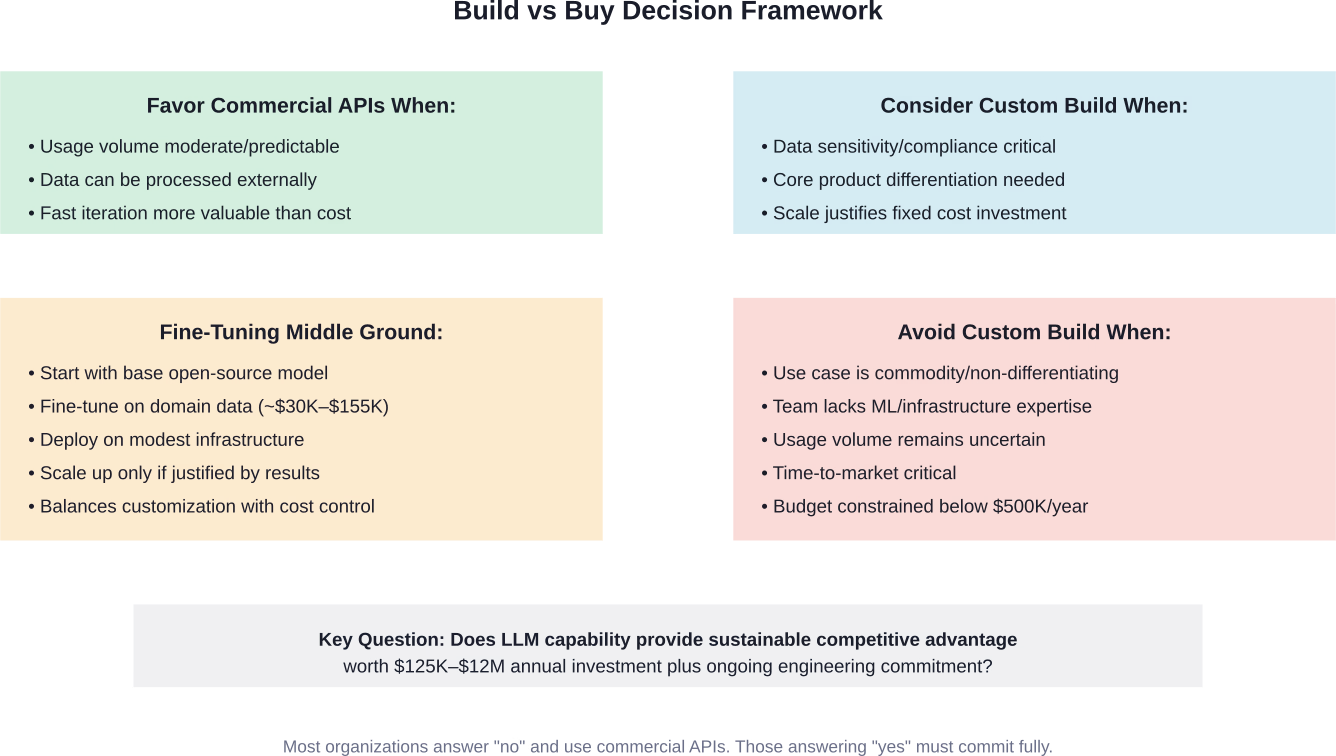

Kommerzielle API-Dienste: Die Alternative

Bevor Unternehmen sich für eine eigene Infrastruktur entscheiden, sollten sie kommerzielle API-Dienste sorgfältig prüfen. Wirtschaftlich gesehen sind APIs in fast allen Anwendungsfällen die bessere Wahl.

So funktioniert die API-Preisgestaltung

Kommerzielle LLM-Anbieter berechnen in der Regel pro verarbeitetem Token. Die Preise variieren je nach Modellfunktionalität:

- Kleinere, schnellere Modelle: $0,10–$0,50 pro Million Token

- Modelle der mittleren Preisklasse: $1–$5 pro Million Token

- Fortgeschrittene Schlussfolgerungsmodelle: $10–$60 pro Million Token

Kontext- und Output-Token können unterschiedlich bepreist sein, wobei die Output-Generierung in der Regel mehr kostet als die Input-Verarbeitung.

Wann APIs sinnvoller sind

Kommerzielle APIs sind in der Regel kostengünstiger, wenn:

- Die Nutzung ist mäßig und vorhersehbar.

- Latenzanforderungen ermöglichen Netzwerkanrufe

- Die Sensibilität der Daten erlaubt eine externe Verarbeitung

- Schnelle Iteration und Experimente sind wichtig.

- Die technischen Ressourcen sind begrenzt.

Eine Studie von arXiv zur Kosten-Nutzen-Analyse der On-Premise-Implementierung von LLM untersucht die Entscheidung zwischen Eigenentwicklung und Kauf, vor der Unternehmen stehen. Cloud-Dienste bieten Komfort und vermeiden anfängliche Investitionskosten, die laufenden Abonnementkosten summieren sich jedoch im Laufe der Zeit.

Der Break-Even-Punkt hängt vom Nutzungsvolumen und den Prioritäten des Unternehmens ab. Für viele Unternehmen bleiben APIs auch bei großem Umfang wirtschaftlicher.

Hybride Ansätze

Manche Organisationen setzen Hybridarchitekturen ein:

- Nutzen Sie APIs für Spitzenlasten und Überlaufkapazitäten

- Führen Sie benutzerdefinierte Modelle für umfangreiche, latenzkritische Operationen aus.

- Sensible Daten sollten lokal gespeichert werden, während APIs für allgemeine Aufgaben verwendet werden.

- Erstellen Sie einen Prototyp mit APIs, bevor Sie sich für eine kundenspezifische Infrastruktur entscheiden.

Dieser Ansatz schafft ein Gleichgewicht zwischen Kosten, Flexibilität und Leistungsfähigkeit und bietet gleichzeitig Ausweichmöglichkeiten.

Fallstudien aus der Praxis und berichtete Kosten

Das Verständnis der theoretischen Kosten ist hilfreich, aber erst die tatsächlichen Einsatzerfahrungen zeigen, wo Schätzungen der Realität entsprechen.

Einsatz in mittlerem Umfang

Laut Diskussionen in der Community zeigte die Erfahrung eines Teams mit dem Einsatz privater LLMs, dass die anfänglichen Kosten zwar überschaubar schienen, aber schnell anstiegen, sobald Produktionsanforderungen hinzukamen.

Das Team stellte fest, dass ihre Produktionsumgebung Redundanz, Caching, Lastverteilung und umfassendes Monitoring erforderte. Was mit einigen Tausend Dollar monatlich begann, näherte sich rasch 15.000 US-Dollar – und das noch vor jeglicher Feinabstimmung oder signifikanter Skalierung.

Unternehmensimplementierung

Laut dem OpenAI-Bericht vom 17. Dezember 2025 zur KI-Einführung in Unternehmen verzeichneten Organisationen, die KI in großem Umfang einsetzten, einen drastischen Nutzungsanstieg. Dem OpenAI-Bericht zufolge stieg das Nachrichtenvolumen von ChatGPT im Vergleich zum Vorjahr um das Achtfache, während der Verbrauch von API-Reasoning-Token pro Organisation um das 320-Fache zunahm.

Diese Nutzungsmuster deuten auf erhebliche laufende Kosten hin, unabhängig davon, ob kundenspezifische Infrastruktur oder kommerzielle Dienste genutzt werden. Die Unternehmen, die eine “messbare Produktivitätssteigerung und positive Geschäftsentwicklung” verzeichnen konnten, empfanden die Investition eindeutig als lohnenswert – die Kosten bleiben jedoch beträchtlich.

Akademischer und Forschungskontext

Forschungseinrichtungen stehen vor ähnlichen Kostendrucken, unterliegen jedoch zusätzlichen Einschränkungen. Ein Team der Carnegie Mellon University veröffentlichte 2026 eine Kosten-Nutzen-Analyse zur Wirtschaftlichkeit von On-Premise-Implementierungen. Die Ergebnisse unterstrichen, dass für eine vergleichbare Leistung wie bei kommerziellen Modellen eine sorgfältige Modellauswahl erforderlich ist, wobei typischerweise Benchmark-Werte innerhalb des 20%-Bereichs führender kommerzieller Angebote angestrebt werden.

Dieser Leistungsschwellenwert spiegelt die Unternehmenspraxis wider, bei der geringfügige Leistungsunterschiede akzeptabel sind, wenn andere Faktoren – Datenschutz, Kostenvorhersagbarkeit, Anpassungsmöglichkeiten – ausgleichende Vorteile bieten.

Optimierungsstrategien zur Kostenkontrolle

Organisationen, die sich für die kundenspezifische Implementierung von LLM entschieden haben, können verschiedene Strategien zur Kostenkontrolle einsetzen.

Auswahl des passenden Modells

Das größte Modell ist nicht immer notwendig. Eine sorgfältige Analyse der Aufgabenanforderungen zeigt oft, dass kleinere Modelle mit Feinabstimmung bei spezifischen Arbeitslasten mit größeren allgemeinen Modellen mithalten oder diese sogar übertreffen.

Das Testen verschiedener Modellgrößen anhand realer Anwendungsfälle hilft, das kleinste effektive Modell zu ermitteln. Dies wirkt sich direkt auf die Infrastrukturanforderungen und die laufenden Kosten aus.

Quantisierung und Kompression

Die Modellquantisierung reduziert die Genauigkeit von 16-Bit- oder 32-Bit-Gleitkommazahlen auf 8-Bit- oder sogar 4-Bit-Ganzzahlen. Dies verringert den Speicherbedarf drastisch und erhöht den Inferenzdurchsatz bei minimalem Genauigkeitsverlust für viele Aufgaben.

Auf arXiv dokumentierte Forschungsergebnisse zeigten, dass das Training von LoRA bei Modellen, die mit 4 Bit vorquantisiert wurden, Ergebnisse erzielte, die mit höherer Präzision vergleichbar waren, jedoch mit einem wesentlich geringeren Ressourcenbedarf.

Effizientes Infrastrukturmanagement

Laut arXiv-Recherchen zur Trainingseffizienz von LLM beeinflussen die Wahl des Optimierers und die Hyperparameter-Optimierung die Vortrainingszeiten und die endgültige Modellleistung maßgeblich. Studien, die AdamW, Lion und andere Optimierer verglichen, zeigten signifikante Unterschiede in der Konvergenzgeschwindigkeit und der Recheneffizienz.

Ebenso verhindert die Sicherstellung einer aktiven GPU-Auslastung anstelle von Leerlaufzeiten die Kosten für ungenutzte Kapazität. Stapelverarbeitung von Anfragen, Implementierung von Anfragewarteschlangen und bedarfsgerechte automatische Skalierung der Infrastruktur verbessern die Kosteneffizienz.

Caching und Anfrageoptimierung

Viele LLM-Anfragen wiederholen sich oder überschneiden sich erheblich. Durch die Implementierung von semantischem Caching können identische oder ähnliche Anfragen aus dem Cache bedient werden, anstatt die Antworten neu zu berechnen. Dies reduziert die Inferenzkosten proportional zur Cache-Trefferrate.

Durch die Stapelverarbeitung von Anfragen wird auch die GPU-Auslastung verbessert, indem mehrere Anfragen gleichzeitig verarbeitet und der Overhead auf die einzelnen Stapelmitglieder verteilt wird.

Erstellen Sie ein individuelles LLM-Projekt, ohne die Kosten außer Kontrolle geraten zu lassen.

Individuelle LLM-Projekte werden selten über Nacht teuer – die Kosten steigen durch Entscheidungen über den Datenumfang, den Trainingsansatz und die erwartete Leistung des Modells im realen Einsatz. AI Superior Wir unterstützen die Entwicklung kundenspezifischer LLM-Modelle von Grund auf, einschließlich Datensatzaufbereitung, Modelltraining, Feinabstimmung und Bereitstellung. Anstatt standardmäßig größere Modelle oder längere Trainingszyklen zu verwenden, liegt der Fokus auf der Definition eines Setups, das zur jeweiligen Aufgabe passt und langfristig gewartet werden kann. Dies bedeutet häufig, den Umfang einzugrenzen, die Daten sorgfältiger zu strukturieren und Trainingsmethoden zu wählen, die nicht zu viel Rechenleistung benötigen.

Projekte überschreiten häufig das Budget, wenn das Modell ohne klare Grenzen erstellt wird oder die Anforderungen während der Entwicklung ständig erweitert werden. Die Ausrichtung des Systems an den tatsächlichen Anwendungsfällen macht sowohl die Entwicklung als auch den zukünftigen Betrieb besser planbar. Wenn Sie ein maßgeschneidertes LLM benötigen, das sich praktisch entwickeln und betreiben lässt, kontaktieren Sie uns. AI Superior und das Projekt vor dem Kostenanstieg ausrichten.

Die strategische Kalkulation: Wann sich Maßanfertigung lohnt

Angesichts dieser Kosten: Wann ist der Aufbau einer maßgeschneiderten LLM-Infrastruktur strategisch sinnvoll?

Datensensibilität und Compliance

Organisationen, die sensible Daten verarbeiten – etwa im Gesundheitswesen, Finanzsektor oder in der öffentlichen Verwaltung – können regulatorischen Anforderungen oder Risikotoleranzen unterliegen, die die Nutzung externer APIs ausschließen. Die Bereitstellung vor Ort wird somit zur Pflicht und nicht mehr zur Option.

Eine auf arXiv veröffentlichte Studie lieferte einen Entscheidungsrahmen speziell für die Einführung von LLM im öffentlichen Sektor. Dieser Rahmen betonte, dass strategischer und wirtschaftlicher Nutzen ein ausreichendes Nutzungsvolumen voraussetzt. Laut dem in der Studie zitierten Bericht „Menlo Ventures 2025 State of Generative AI“ verzeichneten die Marktführer Anthropic, OpenAI und Google gemeinsam eine massive Nutzung – das bedeutet jedoch nicht, dass jede Organisation eine individuelle Infrastruktur benötigt.

Differenzierung und Wettbewerbsvorteil

Wenn die LLM-Fähigkeiten ein wesentliches Produktdifferenzierungsmerkmal darstellen, können kundenspezifische Modelle die Investition rechtfertigen. Dies gilt, wenn:

- Proprietäre Daten schaffen einen unübertroffenen Trainingskorpus

- Fachspezifisches Domänenwissen ist in allgemeinen Modellen nicht verfügbar.

- Modellverhalten und Ausgabestil definieren die Markenidentität

- Wettbewerbsdruck erfordert Fähigkeiten, die andere nicht so leicht kopieren können.

Standardisierte Anwendungsfälle rechtfertigen selten eine kundenspezifische Bereitstellung. Differenzierung ist wichtig.

Umfang und Nutzungsmuster

Extrem hohe Nutzungsvolumina können trotz hoher Fixkosten die Wirtschaftlichkeit einer kundenspezifischen Infrastruktur verbessern. Die Berechnung basiert auf dem Vergleich der kumulierten API-Kosten mit den Gesamtbetriebskosten.

Seien Sie jedoch bei den Nutzungsprognosen realistisch. Eine Überschätzung der Akzeptanz und eine Unterschätzung der API-Effizienz führen zu einer kostspieligen, ungenutzten Infrastruktur.

Langfristige strategische Investition

Der Aufbau von LLM-Kapazitäten stellt eine langfristige strategische Investition in KI als Kernkompetenz dar. Dies geht über unmittelbare Kostenkalkulationen hinaus und berührt Fragen der organisatorischen Fähigkeiten und der strategischen Positionierung.

Organisationen, die diesen Weg wählen, verpflichten sich zu kontinuierlichen Investitionen in Talente, Infrastruktur und Verbesserung. Die Kosten laufen zwar unbegrenzt weiter, aber auch die strategischen Handlungsoptionen.

Neue Kostentrends und Zukunftsaussichten

Die Wirtschaftlichkeit maßgeschneiderter LLM-Programme entwickelt sich weiterhin rasant. Mehrere Trends beeinflussen zukünftige Kostenberechnungen.

Verbesserungen der Hardwareeffizienz

Neue GPU-Architekturen verbessern kontinuierlich das Preis-Leistungs-Verhältnis. Laut einer 2025 veröffentlichten Marktanalyse zu RISC-V wurde der globale Markt für KI-Prozessoren im Jahr 2025 auf 1,2614 Milliarden US-Dollar geschätzt und soll bis 2030 mit einer durchschnittlichen jährlichen Wachstumsrate (CAGR) von 8,11 % auf 385,4 Milliarden US-Dollar anwachsen.

Dieses Wachstum führt zu Wettbewerb und architektonischer Innovation. Die Etablierung von RISC-V als KI-native Architektur könnte die derzeitige GPU-Dominanz in Frage stellen und durch verstärkten Wettbewerb und Spezialisierung potenziell die Kosten senken.

Fortschritte bei Algorithmen und Architekturen

Die Forschung entwickelt kontinuierlich effizientere Modellarchitekturen und Trainingsmethoden. Verbesserungen bei Aufmerksamkeitsmechanismen, Mixture-of-Experts-Ansätzen und Sparse-Modellen reduzieren den Rechenaufwand bei gleicher Leistung.

Diese Fortschritte wirken sich positiv auf die Ausbildungs- und Inferenzkosten aus, erfordern jedoch Fachkenntnisse für eine effektive Umsetzung.

Regulierungs- und Compliance-Druck

Die zunehmende regulatorische Aufmerksamkeit für KI – insbesondere im Hinblick auf Datenschutz, Verzerrungen und Transparenz – könnte die Wirtschaftlichkeit regulierter Branchen hin zu On-Premise-Lösungen verschieben. Die damit verbundenen Compliance-Kosten könnten kundenspezifische Infrastrukturen trotz höherer absoluter Kosten relativ attraktiver machen.

Marktkonsolidierung

Laut dem OpenAI-Bericht „Enterprise AI Report 2025“ vom Dezember 2025 hat sich das Nachrichtenvolumen von ChatGPT im Vergleich zum Vorjahr verachtfacht, während die API-Nutzung pro Unternehmen um das 320-Fache gestiegen ist. Diese Konzentration deutet auf eine mögliche Marktkonsolidierung um wenige Anbieter hin.

Die Abhängigkeit von konsolidierten Anbietern birgt ein strategisches Risiko, das eine maßgeschneiderte Infrastruktur als Absicherung gegen Anbieterbindung oder Preisdruck rechtfertigen könnte.

Häufig gestellte Fragen

Wie viel kostet die Ausbildung eines LLM-Absolventen von Grund auf?

Das Training eines LLM von Grund auf kostet typischerweise zwischen 1.500.000 und mehreren Millionen US-Dollar, abhängig von der Modellgröße und der gewünschten Leistung. Dies umfasst GPU-Rechenkosten (1.500.000–1.500.000+ US-Dollar), Entwicklungsressourcen (1.300.000–1.000.000+ US-Dollar) und Datenaufbereitung (100.000–500.000 US-Dollar). Kleinere Forschungsmodelle lassen sich mit kostengünstigeren Methoden günstiger trainieren, jedoch erfordert eine wettbewerbsfähige Leistung in großem Umfang erhebliche Investitionen. Durch Feinabstimmung bestehender Modelle reduzieren sich die Kosten in den meisten Anwendungsfällen auf 30.000–155.000 US-Dollar.

Was ist günstiger: die Entwicklung eines individuellen LLM-Systems oder die Nutzung von API-Diensten?

API-Dienste sind für die meisten Unternehmen in der Regel günstiger, es sei denn, das Nutzungsvolumen ist extrem hoch und anhaltend. Ein 24/7-gehostetes Modell mit 32 Milliarden Parametern kostet jährlich etwa 1,4 Billionen US-Dollar allein für die Infrastruktur, während ein Modell mit 70 Milliarden Parametern jährlich etwa 1,4 Billionen US-Dollar kostet. Bei API-Preisen von 1,4 Billionen bis 1,4 Billionen US-Dollar pro Million Tokens müssen monatlich Milliarden von Tokens verarbeitet werden, um die Gewinnschwelle zu erreichen. Darüber hinaus erfordert die individuelle Implementierung Entwicklungsressourcen (mindestens 1,25 Billionen bis 1,9 Billionen US-Dollar), die durch API-Dienste entfallen.

Können sich kleine Unternehmen die Entwicklung maßgeschneiderter LLMs leisten?

Kleine Unternehmen können bestehende Open-Source-Modelle für $30K–$155K optimieren, was für gut finanzierte Startups machbar ist. Die Vorentwicklung von Grund auf oder der Betrieb groß angelegter Produktionsumgebungen ($500K–$12M jährlich) übersteigen jedoch in der Regel die Budgets kleiner Unternehmen. Die meisten kleinen Organisationen erzielen einen besseren ROI durch den Einsatz kommerzieller APIs oder optimierter, kleinerer Modelle auf einer bescheidenen Infrastruktur. Auch die erforderliche technische Expertise stellt kleinere Teams vor Herausforderungen.

Welche versteckten Kosten entstehen bei der Durchführung privater LLM-Studiengänge?

Versteckte Kosten umfassen Ingenieurgehälter (150.000 bis über 300.000 INR pro Fachposition), Wartungs- und Betriebskosten, Infrastrukturüberwachung, Datenaufbereitung und -bereinigung, Sicherheits- und Compliance-Maßnahmen sowie die Opportunitätskosten von Ressourcen, die nicht für Kernaufgaben des Unternehmens eingesetzt werden können. Produktionsbereitstellungen erfordern zudem Redundanz und Lastverteilung, wodurch sich die Infrastrukturkosten um das Vier- bis Fünffache erhöhen. Diese indirekten Kosten übersteigen oft die sichtbaren Cloud-Rechnungen.

Was kostet die Feinabstimmung eines bestehenden Modells?

Die Feinabstimmung kostet für die meisten Projekte $500–$5.000 Rechenleistung, hinzu kommen je nach Komplexität weitere $20K–$100K Entwicklungszeit. Untersuchungen zeigen, dass ein 7-stündiger Feinabstimmungslauf auf einer einzelnen T4-GPU in der Cloud etwa $2,50–$3,50 Rechenleistung kostet. Parametereffiziente Verfahren wie LoRa reduzieren den Bedarf weiter. Die Gesamtprojektkosten inklusive Datenaufbereitung liegen typischerweise zwischen $30K und $155K, was einer Kostenreduktion von etwa 95% im Vergleich zum Vortraining von Grund auf entspricht.

Wann ist die Entwicklung eines maßgeschneiderten LLM-Programms aus geschäftlicher Sicht sinnvoll?

Die Entwicklung kundenspezifischer LLMs ist sinnvoll, wenn die Sensibilität der Daten eine lokale Bereitstellung erfordert, wenn die LLM-Funktionen ein schützenswertes Alleinstellungsmerkmal des Produkts darstellen, wenn der Nutzungsumfang die Kostendeckungsgrenze der API übersteigt oder wenn KI als langfristige strategische Kompetenz entwickelt wird. Organisationen, die sensible, regulierte Daten verarbeiten, monatlich Milliarden von Token abwickeln oder LLM-zentrierte Produkte entwickeln, sind die wahrscheinlichsten Kandidaten. Standard-Anwendungsfälle rechtfertigen die Investition selten.

Welche Modellgröße sollten Organisationen für die kundenspezifische Bereitstellung wählen?

Unternehmen sollten nach der Feinabstimmung das kleinste Modell wählen, das die Leistungsanforderungen erfüllt. Im Allgemeinen bewältigen Modelle mit 7 bis 13 Milliarden Parametern viele Produktions-Workloads effektiv mit einer moderaten Infrastruktur. Modelle mit 32 Milliarden Parametern bieten eine höhere Leistungsfähigkeit, benötigen aber erhebliche GPU-Ressourcen. Modelle mit 70 Milliarden und mehr Parametern erfordern eine Infrastruktur der Enterprise-Klasse und sollten nur dann eingesetzt werden, wenn kleinere Modelle die Anforderungen nachweislich nicht erfüllen. Durch das Testen verschiedener Größen anhand realer Anwendungsfälle lässt sich das optimale Verhältnis von Leistungsfähigkeit und Kosten ermitteln.

Die Entscheidungsfindung: Ein praktischer Rahmen

Die Entscheidung zwischen dem Aufbau einer individuellen LLM-Infrastruktur und der Nutzung kommerzieller Dienste hängt letztlich von den jeweiligen organisatorischen Gegebenheiten ab. Im Folgenden erfahren Sie, wie Sie diese Entscheidung systematisch angehen können.

Beginnen Sie mit einer realistischen Einschätzung des Nutzungsvolumens. Berechnen Sie den erwarteten Token-Durchsatz über alle Anwendungsfälle hinweg. Vergleichen Sie die kumulierten API-Kosten mit den Gesamtkosten der kundenspezifischen Infrastruktur, einschließlich Entwicklung, Wartung und Opportunitätskosten. Gehen Sie bei Nutzungsprognosen konservativ vor – Überschätzung führt zu teurer, ungenutzter Infrastruktur.

Prüfen Sie die Anforderungen an die Datensensibilität. Wenn regulatorische Vorgaben oder Geschäftsrisiken eine externe Verarbeitung tatsächlich verhindern, ist eine kundenspezifische Infrastruktur unabhängig von den Kosten erforderlich. Stellen Sie jedoch sicher, dass diese Einschränkung real und nicht nur angenommen ist.

Strategische Differenzierung ist entscheidend. Bietet die LLM-Funktionalität einen nachhaltigen Wettbewerbsvorteil oder handelt es sich lediglich um Standardfunktionen? Standardanwendungen sprechen für APIs. Echte Differenzierung kann hingegen Investitionen in kundenspezifische Lösungen rechtfertigen.

Die organisatorischen Fähigkeiten sollten realistisch eingeschätzt werden. Der Aufbau und Betrieb einer LLM-Infrastruktur erfordert spezialisiertes Fachwissen. Organisationen ohne ML/KI-Fachkräfte stehen vor steilen Lernkurven und höheren Kosten.

Beginnen Sie klein, unabhängig von der Richtung. Nutzen Sie kommerzielle APIs oder optimierte Modelle auf einer bescheidenen Infrastruktur, bevor Sie eine groß angelegte, individuelle Implementierung vornehmen. Weisen Sie den Nutzen und die Nutzungsmuster mit minimalem Aufwand nach und skalieren Sie erst, wenn es gerechtfertigt ist.

Die meisten Unternehmen stellen fest, dass kommerzielle APIs oder optimierte kleinere Modelle ihre Anforderungen kostengünstiger und mit geringerem Risiko erfüllen als kundenspezifische Großprojekte. Ausnahmefälle – stark regulierte Branchen, extrem große Skalierung, Kerndifferenzierung – rechtfertigen zwar eine individuelle Infrastruktur, sind aber in der Minderheit.

Die Kosten sind real und beträchtlich. Organisationen, die sich für eine maßgeschneiderte LLM-Infrastruktur entscheiden, müssen dies als langfristige strategische Investition mit kontinuierlicher Aufmerksamkeit und entsprechenden Ressourcen betrachten. Halbherzige Maßnahmen führen zu teuren Fehlschlägen.

Sind Sie bereit, den Einsatz von LLM für konkrete Anwendungsfälle zu erkunden? Bewerten Sie Optionen systematisch, validieren Sie Annahmen mit kleinen Tests und skalieren Sie die Investitionen, sobald sich Nutzung und Nutzen herauskristallisieren. Die Technologie ist leistungsstark, doch der Erfolg hängt davon ab, dass die Einsatzstrategien den tatsächlichen Bedürfnissen und Fähigkeiten Ihrer Organisation entsprechen.