Résumé rapide : Les outils d'analyse prédictive combinent modélisation statistique, apprentissage automatique et exploration de données pour prévoir les résultats futurs à partir de données historiques. Leur architecture technologique comprend des environnements de programmation (Python, R), des plateformes statistiques (IBM SPSS, SAS), des outils de veille stratégique (Tableau, Power BI), des plateformes d'apprentissage automatique (DataRobot, H2O.ai) et des solutions cloud (AWS SageMaker, Azure ML), adaptés à différents niveaux de compétences techniques et cas d'usage.

L'analyse prédictive détermine la probabilité d'événements futurs grâce à des techniques telles que l'exploration de données, les statistiques, la modélisation des données, l'intelligence artificielle et l'apprentissage automatique. Les organisations de tous les secteurs utilisent ces outils pour interpréter les tendances historiques des données et prendre des décisions éclairées concernant les risques, les opportunités et les comportements des clients.

Le marché de l'analyse prédictive en 2026 propose un large éventail de solutions, allant des outils sans code pour les analystes métier aux écosystèmes d'apprentissage automatique d'entreprise conçus pour les équipes de science des données. Le choix de l'outil le plus adapté dépend du niveau de maturité de votre organisation, de vos cas d'usage et de votre infrastructure technologique existante.

Mais voilà le hic : tous les outils d’analyse prédictive ne donnent pas les mêmes résultats. La bonne plateforme modifie la façon dont les équipes répartissent leur temps, en recentrant l’attention de la préparation des données vers les prévisions concrètes qui génèrent du chiffre d’affaires. Les analystes marketing, par exemple, consacrent généralement plus de 40 000 $ de leur temps à la préparation des données, ce qui leur laisse peu de temps pour les prévisions qui comptent vraiment.

Qu'est-ce qui constitue un outil d'analyse prédictive ?

Les outils d'analyse prédictive utilisent la modélisation statistique, les techniques d'exploration de données et l'apprentissage automatique pour analyser les données commerciales actuelles et historiques et établir des prévisions précises. Ces plateformes aident les entreprises à déterminer la probabilité d'événements futurs ou inconnus.

Cette distinction est importante car toutes les plateformes d'analyse ne sont pas prédictives. L'analyse descriptive vous indique ce qui s'est passé. L'analyse diagnostique explique pourquoi cela s'est produit. L'analyse prédictive, quant à elle, prévoit ce qui se passera ensuite en se basant sur les tendances observées dans vos données.

Les véritables plateformes d'analyse prédictive combinent plusieurs fonctionnalités essentielles :

- Intégration de données provenant de sources multiples (bases de données, feuilles de calcul, services cloud)

- Bibliothèques de modélisation statistique et d'algorithmes (régression, classification, séries temporelles)

- Entraînement et validation du modèle d'apprentissage automatique

- Ingénierie automatisée des caractéristiques et sélection des variables

- Infrastructure de déploiement et de surveillance des modèles

- Outils de visualisation pour l'interprétation des prédictions

Les outils de veille stratégique génériques proposent souvent des fonctionnalités de prévision de base. Cependant, ils ne permettent pas d'effectuer des modélisations prédictives sophistiquées. Les véritables plateformes prédictives offrent des techniques avancées telles que les méthodes d'ensemble, les réseaux de neurones et le gradient boosting, qui permettent d'obtenir une précision nettement supérieure.

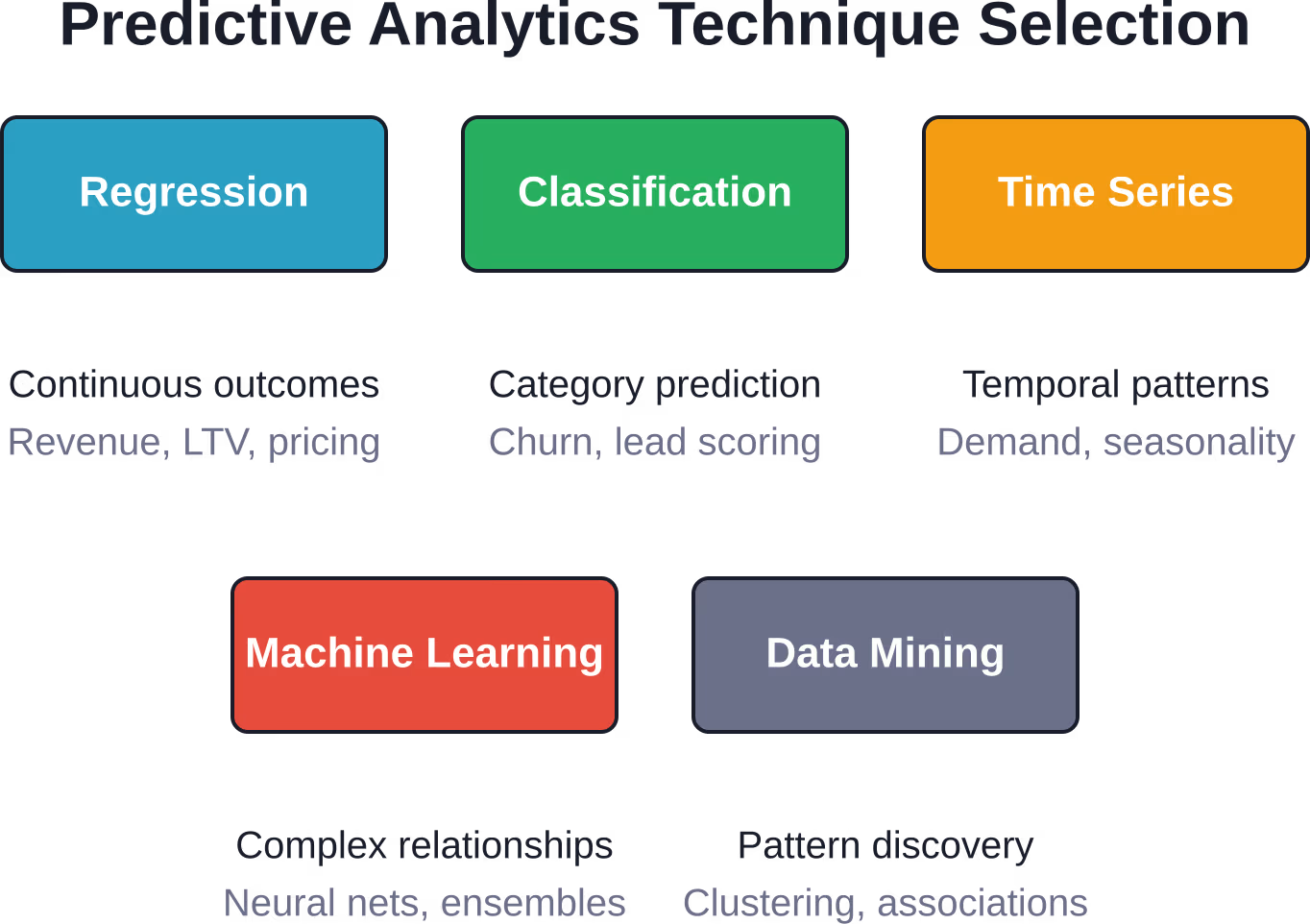

Techniques fondamentales d'analyse prédictive

Comprendre les techniques sous-jacentes à l'analyse prédictive permet de déterminer les outils dont vous avez réellement besoin. Différentes méthodes conviennent à différents types de prédiction, et toutes les plateformes ne prennent pas en charge toutes les techniques.

Analyse de régression

Les modèles de régression permettent de prédire des variables numériques continues. La régression linéaire convient aux relations simples, comme la prédiction du chiffre d'affaires à partir des dépenses publicitaires. Des variantes plus complexes, telles que la régression polynomiale et la régression ridge, traitent les relations non linéaires et préviennent le surapprentissage.

Cette technique nécessite des données historiques fiables, avec des relations identifiées entre les variables. Les équipes marketing utilisent la régression pour prévoir la valeur vie client, tandis que les services financiers prévoient le chiffre d'affaires trimestriel en fonction des tendances saisonnières et des signaux du marché.

Modèles de classification

La classification prédit des résultats catégoriels : décisions par oui/non, catégories de risque, segments de clientèle. La régression logistique, les arbres de décision et les machines à vecteurs de support appartiennent à cette catégorie.

Les systèmes de qualification des prospects reposent largement sur la classification. Le modèle analyse des centaines d'attributs (intitulé du poste, taille de l'entreprise, comportement sur le site web) afin de classer les prospects selon leur probabilité de conversion (élevée ou faible). Les organismes de santé utilisent la classification pour prédire le risque de réadmission des patients ou la probabilité d'un diagnostic.

Prévisions de séries chronologiques

Les techniques d'analyse de séries temporelles exploitent des points de données collectés à intervalles réguliers pour prédire les valeurs futures. Les modèles ARIMA, le lissage exponentiel et Prophet (l'outil de prévision open source de Meta) excellent dans la détection des variations saisonnières, des tendances et des comportements cycliques.

Les entreprises de vente au détail utilisent les prévisions de séries temporelles pour la planification de leurs stocks. Les plateformes de commerce électronique anticipent les pics de demande pendant les périodes de fêtes. Les institutions financières prévoient les cours boursiers et les fluctuations monétaires à l'aide de modèles de séries temporelles sophistiqués intégrant de multiples variables.

Algorithmes d'apprentissage automatique

L'apprentissage automatique améliore l'analyse prédictive en affinant automatiquement les prédictions à mesure que de nouvelles données sont disponibles. Les forêts aléatoires, les machines à gradient boosté (GBM), les réseaux de neurones et les architectures d'apprentissage profond permettent de traiter des relations complexes et non linéaires que les méthodes statistiques traditionnelles ne parviennent pas à identifier.

D'après une étude du programme d'analyse de données en ligne de l'université William & Mary, les techniques d'apprentissage automatique ont permis d'améliorer l'analyse prédictive pour les entreprises de nombreux secteurs. L'utilisation de l'apprentissage automatique permet aux systèmes de traiter simultanément des millions de points de données, ce qui serait impossible avec une modélisation statistique manuelle.

Par exemple, un algorithme d'apprentissage automatique gérant une campagne publicitaire au paiement par clic pourrait fixer une limite supérieure de $0,25 pour les enchères sur les mots clés. En intégrant des milliers de points de données, l'algorithme pourrait déterminer que $0,14 représente l'enchère optimale pour un retour sur investissement maximal — un niveau de précision difficilement atteignable par une analyse manuelle.

Exploration de données et reconnaissance de formes

L'exploration de données extrait des modèles jusque-là inconnus à partir de vastes ensembles de données. Les algorithmes de clustering regroupent les clients similaires sans catégories prédéfinies. L'apprentissage des règles d'association permet de découvrir quels produits les clients achètent fréquemment ensemble. La détection d'anomalies identifie les schémas inhabituels pouvant indiquer une fraude ou une défaillance du système.

L'apprentissage automatique et l'analyse prédictive sont des outils essentiels pour explorer et comprendre d'immenses ensembles de données. Ces techniques sont complémentaires : l'exploration de données permet de découvrir des tendances, tandis que la modélisation prédictive utilise ces tendances pour prévoir les résultats futurs.

Catégories d'outils d'analyse prédictive

Les plateformes d'analyse prédictive vont des solutions sans code destinées aux analystes métier aux écosystèmes d'apprentissage automatique d'entreprise conçus pour les équipes de science des données. Le marché se segmente en différentes catégories selon les exigences techniques, la spécificité des cas d'utilisation et la complexité du déploiement.

Plateformes logicielles statistiques

Les outils statistiques traditionnels tels qu'IBM SPSS, SAS et Stata ont dominé l'analyse prédictive pendant des décennies. Ces plateformes offrent des fonctionnalités complètes de modélisation statistique, une documentation exhaustive et une fiabilité éprouvée pour la recherche académique et en entreprise.

IBM SPSS propose des interfaces intuitives pour l'analyse de régression, l'analyse factorielle et d'autres techniques classiques. SAS, quant à lui, offre des solutions d'analyse robustes, particulièrement performantes dans les secteurs réglementés comme l'industrie pharmaceutique et la finance. Ces outils nécessitent des connaissances en statistiques, mais ne requièrent pas de compétences en programmation pour les analyses de base.

Leur principal inconvénient ? Elles n’ont pas été conçues pour les flux de travail modernes d’apprentissage automatique ni pour les infrastructures de mégadonnées. Les data scientists privilégient de plus en plus des alternatives plus flexibles.

Langages de programmation et bibliothèques

Python et R sont les environnements les plus utilisés par les équipes de science des données pour l'analyse prédictive. Ces deux langages offrent de vastes bibliothèques d'apprentissage automatique, des communautés actives et une grande flexibilité pour le développement de modèles personnalisés.

La bibliothèque scikit-learn de Python fournit des implémentations de dizaines d'algorithmes. TensorFlow et PyTorch alimentent les modèles d'apprentissage profond. Pandas assure la manipulation des données. Cet écosystème prend en charge l'ensemble du flux de travail d'analyse prédictive, du nettoyage des données au déploiement du modèle.

R est spécialisé dans le calcul statistique grâce à des packages tels que caret, randomForest et glmnet. Ce langage excelle dans l'analyse exploratoire des données et la visualisation statistique via ggplot2. Les statisticiens chercheurs privilégient R pour sa couverture exhaustive des techniques statistiques avancées.

Ces outils nécessitent des compétences en programmation. Mais ils offrent une flexibilité et une personnalisation maximales aux équipes possédant une expertise technique.

Outils de veille stratégique avec fonctionnalités prédictives

Des plateformes comme Tableau, Microsoft Power BI et Qlik ont intégré des fonctionnalités prédictives à leurs offres de BI. Ces outils privilégient l'accessibilité : les utilisateurs métiers peuvent générer des prévisions sans écrire de code ni comprendre les algorithmes.

Tableau s'intègre à R et Python pour la création de modèles personnalisés et propose des fonctionnalités de prévision intégrées pour les données de séries temporelles. Power BI inclut des fonctionnalités d'apprentissage automatique grâce à son intégration avec Azure. Ces plateformes se connectent à plus de 100 sources de données, notamment des bases de données, des feuilles de calcul et des services cloud.

Le compromis réside dans la sophistication. Les prévisions intégrées fonctionnent bien pour les scénarios standards, mais manquent de la profondeur nécessaire à la modélisation complexe. Les équipes financières qui utilisent ces outils pour prévoir les revenus en tenant compte des signaux de marché et des tendances saisonnières obtiennent des résultats fiables. Cependant, les cas d'utilisation spécifiques nécessitent toujours des plateformes prédictives dédiées.

Plateformes AutoML et No-Code

Les plateformes d'apprentissage automatique automatisées démocratisent l'analyse prédictive en prenant en charge automatiquement la sélection des algorithmes, l'optimisation des hyperparamètres et l'ingénierie des caractéristiques. DataRobot, H2O.ai et Google AutoML appartiennent à cette catégorie.

Ces outils intègrent des données d'entraînement et testent automatiquement des centaines de configurations de modèles afin d'identifier l'approche la plus performante. Les analystes métier, même sans formation en science des données, peuvent ainsi créer des modèles prêts pour la production. Les plateformes gèrent le déploiement, la surveillance et le réentraînement des modèles.

DataRobot excelle particulièrement dans les déploiements en entreprise avec des exigences de gouvernance. H2O.ai propose des versions open source et commerciales. Driverless AI automatise l'intégralité du processus d'apprentissage automatique tout en préservant l'explicabilité du modèle, un point crucial pour les secteurs réglementés.

Services d'apprentissage automatique basés sur le cloud

Amazon Web Services, Google Cloud Platform et Microsoft Azure proposent des environnements d'apprentissage automatique gérés. AWS SageMaker, Google Vertex AI et Azure Machine Learning combinent infrastructure, bibliothèques d'algorithmes et outils de déploiement sur des plateformes cloud natives.

Ces services s'intègrent naturellement aux autres ressources cloud. Les données stockées dans S3 ou BigQuery sont directement utilisées pour l'entraînement des modèles. Les modèles déployés s'adaptent automatiquement en fonction du volume de prédictions. Un système de surveillance intégré permet de suivre les performances des modèles et la dérive des données.

Les plateformes cloud conviennent aux organisations ayant déjà investi dans une infrastructure cloud. Elles éliminent les coûts liés à la gestion de l'infrastructure tout en offrant des fonctionnalités de sécurité et de conformité de niveau entreprise. Les organisations utilisant des services d'apprentissage automatique dans le cloud ont constaté une augmentation de la valeur vie client grâce à la segmentation prédictive.

Solutions spécifiques à l'industrie

Les outils d'analyse prédictive spécialisés ciblent des secteurs ou des cas d'usage spécifiques. Les solutions marketing (Salesforce Einstein, Adobe Sensei) se concentrent sur la prédiction et la personnalisation du parcours client. Les plateformes de santé s'attaquent à la stratification des risques des patients et à la prédiction des réadmissions. Les outils des services financiers sont spécialisés dans la détection des fraudes et l'évaluation du crédit.

Ces solutions sont préconfigurées avec des modèles et des schémas de données adaptés au secteur. Le temps de mise en œuvre est considérablement réduit par rapport à la création de modèles personnalisés. Les établissements de santé qui utilisent l'analyse prédictive ont constaté une diminution significative des hospitalisations et des passages aux urgences grâce à des approches de stratification des risques.

Cette spécificité a ses avantages et ses inconvénients. Les outils industriels excellent dans leur domaine de prédilection, mais manquent de flexibilité pour les nouveaux cas d'utilisation qui sortent de leur champ d'application.

Caractéristiques essentielles des plateformes d'analyse prédictive

Toutes les plateformes ne possèdent pas toutes les fonctionnalités. Comprendre quelles fonctionnalités sont essentielles pour des cas d'utilisation spécifiques permet d'éviter des inadéquations coûteuses entre les capacités des outils et les besoins de l'organisation.

Connectivité et intégration des données

Les modèles prédictifs ne fonctionnent que s'ils ont accès aux données pertinentes. Les meilleures plateformes proposent des bibliothèques de connecteurs complètes pour les bases de données (PostgreSQL, MySQL, Oracle), les entrepôts de données cloud (Snowflake, Redshift, BigQuery), les systèmes CRM (Salesforce, HubSpot) et les plateformes marketing.

L'intégration des données ne se limite pas aux simples importations. Les systèmes prédictifs de production nécessitent des pipelines de données automatisés qui mettent à jour les données d'entraînement, réentraînent les modèles selon une planification définie et renvoient les prédictions aux systèmes opérationnels. Les API de prédiction en temps réel requièrent des connexions à faible latence aux bases de données transactionnelles.

L'outil peut-il être déployé dans le cloud et sur site ? Prend-il en charge les exigences de résidence des données pour les opérations internationales ? Ces questions d'intégration déterminent si une plateforme est compatible avec les contraintes d'architecture d'entreprise.

Bibliothèques d'algorithmes et types de modèles

Les plateformes complètes prennent en charge de multiples approches de modélisation : modèles de régression pour les variables continues, algorithmes de classification pour les prédictions catégorielles, méthodes de séries temporelles pour les prévisions temporelles, clustering pour la segmentation et méthodes d’ensemble combinant plusieurs modèles pour une précision accrue.

La profondeur d'analyse est également importante. La plateforme propose-t-elle uniquement la régression linéaire, ou inclut-elle des techniques de régularisation comme LASSO et la régression Ridge ? Est-elle compatible avec le gradient boosting, les forêts aléatoires et les réseaux de neurones ? Prend-elle en charge l'apprentissage profond pour les données non structurées telles que les images et le texte ?

Les principales plateformes proposent de 10 à 50 implémentations d'algorithmes différentes. Elles expliquent également quand utiliser chaque approche, guidant ainsi les utilisateurs vers les techniques les plus adaptées aux caractéristiques de leurs données.

AutoML et ingénierie automatisée des caractéristiques

L'ingénierie des caractéristiques — la création de variables prédictives à partir de données brutes — était traditionnellement très chronophage pour les data scientists. Les plateformes modernes automatisent ce processus en testant des milliers de combinaisons de caractéristiques afin d'identifier les variables les plus prédictives.

AutoML étend l'automatisation à la sélection des algorithmes et à l'optimisation des hyperparamètres. Le système entraîne des dizaines de modèles candidats, compare leurs performances par validation croisée et recommande la meilleure configuration. Cette fonctionnalité permet de réduire le développement des modèles de plusieurs semaines à quelques heures.

L'automatisation a cependant ses limites. Les systèmes entièrement automatisés peuvent parfois passer à côté d'informations spécifiques à un domaine que des analystes experts intégreraient. Les meilleures plateformes proposent un équilibre entre automatisation et possibilité d'intervention d'experts.

Explicabilité et interprétabilité du modèle

Les modèles d'apprentissage automatique complexes fonctionnent souvent comme des boîtes noires : ils génèrent des prédictions précises, mais n'en expliquent pas le raisonnement. Les secteurs réglementés exigent l'interprétabilité des modèles pour se conformer aux normes. Les parties prenantes ont besoin d'explications pour faire confiance aux recommandations.

Les plateformes modernes intègrent des outils d'explicabilité. Les valeurs SHAP (SHapley Additive exPlanations) quantifient la contribution de chaque variable aux prédictions individuelles. Les graphiques de dépendance partielle illustrent l'impact de la modification d'une variable sur les résultats. Le classement de l'importance des variables permet d'identifier les points de données les plus pertinents.

Ces fonctionnalités d'interprétabilité permettent de concilier précision statistique et adoption par les équipes marketing. Lorsque ces dernières comprennent pourquoi un modèle identifie certains prospects comme prioritaires, elles font suffisamment confiance au système pour donner suite aux recommandations.

Infrastructure de déploiement et de surveillance

L'élaboration de modèles précis représente la moitié du défi. Leur déploiement dans les systèmes de production, où ils génèrent de la valeur ajoutée pour l'entreprise, complète le tableau. Les plateformes d'entreprise comprennent une infrastructure de déploiement : API REST, moteurs de scoring par lots et service de modèles intégré.

Le suivi post-déploiement permet d'évaluer les performances du modèle au fil du temps. La précision des prédictions se dégrade souvent lorsque les conditions réelles changent. Les tableaux de bord de suivi alertent les équipes lorsque les performances du modèle passent sous certains seuils, déclenchant ainsi des processus de réentraînement.

Le contrôle de version des modèles est également essentiel. Les systèmes de production doivent pouvoir revenir à une version antérieure lorsque les nouvelles versions d'un modèle présentent des performances insuffisantes. Les meilleures plateformes traitent les modèles comme des artefacts versionnés avec un suivi complet de leur traçabilité.

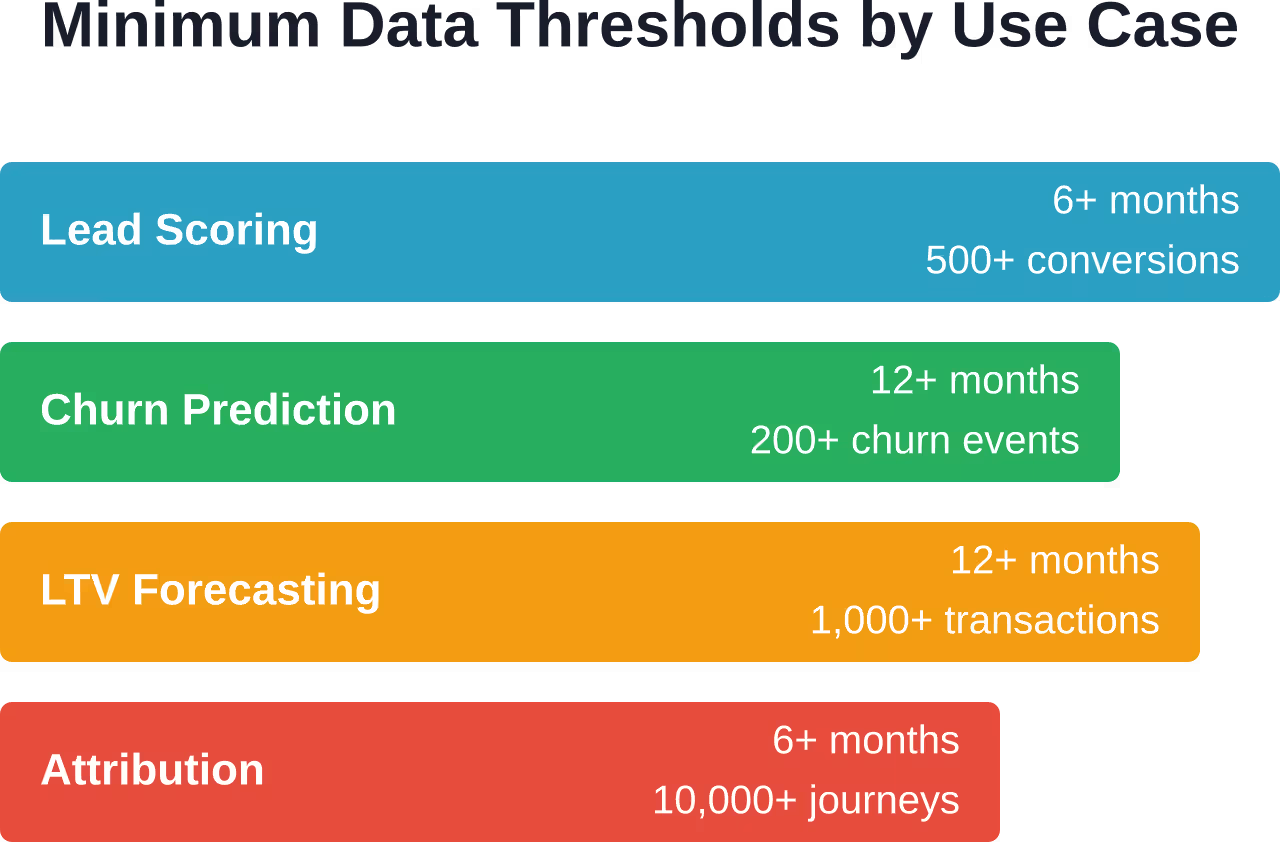

Exigences minimales en matière de données pour l'analyse prédictive

Voici où les implémentations échouent souvent : un volume ou une qualité de données insuffisants empêche les modèles d’apprendre des schémas significatifs. Différents types de prédiction requièrent différents seuils de données.

Si les prédictions reposent sur la probabilité de conversion, le modèle doit disposer de centaines, voire de milliers, de conversions passées dans différents contextes. Seuil minimal par type de prédiction :

- Score principal : Plus de 6 mois d'historique de prospects, plus de 500 conversions

- Prédiction du taux de désabonnement : Plus de 12 mois de données sur le cycle de vie client, plus de 200 événements de désabonnement

- Prévision du LTV : Données de revenus sur plus de 12 mois, plus de 1 000 transactions

- Modélisation de l'attribution : Plus de 6 mois de données multicanaux, plus de 10 000 parcours utilisateurs

Ces valeurs représentent les seuils minimaux de référence. En général, davantage de données améliorent la précision du modèle, mais les gains diminuent au-delà d'un certain volume. La qualité des données est aussi importante que leur quantité : les valeurs manquantes, les formats incohérents et les étiquettes incorrectes nuisent aux performances du modèle, quel que soit le volume.

Les organisations dont les résultats sont inférieurs à ces seuils devraient commencer par des approches analytiques plus simples (analyse descriptive, segmentation de base) tout en mettant en place une infrastructure de données pour de futures capacités prédictives.

Principales plateformes d'analyse prédictive pour différents cas d'utilisation

Le choix de l'outil adéquat dépend des capacités techniques, des exigences liées au cas d'utilisation et du niveau de maturité de l'organisation. Ces plateformes représentent actuellement le leader dans différentes catégories.

Pour les équipes marketing : Improvado

Improvado associe l'intégration unifiée des données marketing à l'analyse prédictive basée sur l'IA. La plateforme se connecte aux principales plateformes publicitaires, aux systèmes CRM et aux outils d'analyse, centralisant ainsi des données généralement dispersées dans des dizaines de sources.

L'agent IA permet des prédictions en langage naturel : les analystes marketing peuvent ainsi interroger les campagnes sur leurs chances de conversion au prochain trimestre, sans avoir à écrire de code SQL ni Python. La mise en place prend généralement deux semaines, ce qui en fait une solution clé en main idéale pour les services marketing ne disposant pas d'équipes dédiées à la science des données.

Improvado convient aux organisations qui privilégient les prédictions marketing : prévision des performances des campagnes, modélisation de la valeur vie client et optimisation de l’attribution. Il ne remplace pas les plateformes d’analyse de données généralistes, mais excelle dans son domaine d’analyse marketing.

Pour l'analyse visuelle : Tableau

La force de Tableau réside dans l'alliance de capacités prédictives et d'une visualisation des données de pointe. Les utilisateurs métiers peuvent générer des prévisions via des interfaces intuitives de type « glisser-déposer », tandis que les data scientists intègrent des modèles R et Python personnalisés.

La plateforme prend en charge des calculs complexes et une analyse poussée des séries temporelles pour explorer la saisonnalité et les tendances. Les données, les visualisations et les tableaux de bord peuvent être intégrés à des outils tiers, étendant ainsi les analyses prédictives à l'ensemble de l'organisation.

Tableau convient aux équipes qui doivent communiquer des prévisions à des parties prenantes non techniques. Sa couche de visualisation rend les prévisions accessibles et exploitables pour les dirigeants qui ne souhaitent pas interpréter les résultats bruts des modèles.

Pour Enterprise AutoML : DataRobot

DataRobot automatise l'intégralité du processus d'apprentissage automatique, de l'ingénierie des caractéristiques au déploiement et à la surveillance des modèles. La plateforme teste des centaines de configurations d'algorithmes, les classe selon leurs performances et explique le comportement des modèles grâce à des outils d'interprétabilité intégrés.

Les fonctionnalités de gouvernance d'entreprise incluent des pistes d'audit, des contrôles d'accès basés sur les rôles et la détection des biais. Les modèles sont déployés via des API REST ou des moteurs de scoring par lots. Une surveillance automatisée détecte la dégradation des performances et déclenche des processus de réentraînement.

DataRobot convient aux grandes entreprises ayant des cas d'utilisation prédictifs variés mais des effectifs limités en science des données. Les secteurs des services financiers, de la santé et de la production l'utilisent pour la modélisation des risques, la détection des fraudes et la maintenance prédictive.

Pour les flux de travail natifs du cloud : AWS SageMaker

Amazon SageMaker fournit une infrastructure gérée pour la création, l'entraînement et le déploiement à grande échelle de modèles de machine learning. Ce service s'intègre aux lacs de données AWS, gère l'entraînement distribué sur des clusters GPU et déploie les modèles avec une mise à l'échelle automatique.

Les algorithmes intégrés couvrent les cas d'utilisation courants, tandis que la prise en charge des modèles personnalisés répond aux exigences spécifiques. Les notebooks SageMaker Studio facilitent le développement collaboratif. Model Monitor assure le suivi des dérives des données et de la qualité des prédictions en production.

Les organisations ayant déjà investi dans l'infrastructure AWS bénéficient d'une intégration transparente. Les données stockées dans S3 sont directement intégrées aux pipelines d'entraînement. Les modèles déployés peuvent appeler d'autres services AWS sans configuration réseau complexe.

Pour une flexibilité open source : H2O.ai

H2O.ai propose des plateformes d'analyse prédictive open source et commerciales. Le framework open source H2O fonctionne sur des ordinateurs portables ou des clusters distribués et prend en charge les algorithmes les plus courants via des interfaces R et Python.

Driverless AI, la solution commerciale, automatise l'ingénierie des caractéristiques, la sélection des modèles et l'optimisation des hyperparamètres, tout en garantissant l'interprétabilité grâce à une documentation automatique. La plateforme génère des explications conformes aux exigences réglementaires dans les secteurs bancaire et de la santé.

H2O.ai convient aux organisations qui privilégient la flexibilité de l'open source tout en ayant besoin d'un support professionnel pour leurs déploiements en production. Cette approche hybride permet d'expérimenter des outils gratuits avant de s'engager sur des licences commerciales.

Pour l'analyse statistique : IBM SPSS

IBM SPSS demeure le logiciel de référence dans la recherche universitaire, le secteur de la santé et l'administration publique, où les techniques statistiques classiques et la conformité réglementaire sont primordiales. Son interface intuitive permet aux chercheurs, même sans connaissances en programmation, de réaliser des analyses poussées.

La plateforme couvre la modélisation de régression, l'analyse de survie, l'analyse factorielle et la conception expérimentale. La documentation et la validation répondent aux exigences de la FDA pour les essais cliniques pharmaceutiques. L'intégration avec la suite analytique IBM permet un déploiement en entreprise.

SPSS convient aux organisations où la rigueur statistique et la documentation priment sur les capacités d'apprentissage automatique de pointe. Il est moins flexible que Python ou R, mais plus accessible aux non-programmeurs.

| Plate-forme | Idéal pour | Atout majeur | Utilisateurs types |

|---|---|---|---|

| Improvisé | Analyse marketing | Données unifiées + Agent IA | analystes marketing |

| Tableau | Communication visuelle | Prédictif + visualisation | Analystes d'affaires |

| DataRobot | AutoML d'entreprise | Automatisation complète + gouvernance | analystes et scientifiques des données |

| AWS SageMaker | Machine learning native du cloud | Intégration et mise à l'échelle AWS | Ingénieurs et scientifiques des données |

| H2O.ai | Logiciel libre et commercial | Flexibilité et explicabilité | équipes de science des données |

| IBM SPSS | Rigueur statistique | Conformité réglementaire | Chercheurs et analystes |

Applications d'analyse prédictive dans le monde réel

Comprendre comment les organisations utilisent ces outils permet de clarifier leur valeur pratique au-delà des capacités théoriques.

Soins de santé : Stratification des risques des patients

Les organismes de santé utilisent l'analyse prédictive pour identifier les patients présentant un risque élevé de réhospitalisation ou de passage aux urgences. Ces organismes ont constaté une réduction significative des hospitalisations et des passages aux urgences grâce à des méthodes de stratification des risques.

Ces modèles intègrent les dossiers médicaux électroniques, les données d'observance thérapeutique, les déterminants sociaux de la santé et l'historique d'utilisation des services. Les cliniciens reçoivent des scores de risque qui éclairent leurs décisions en matière de planification des soins : planification des visites à domicile, coordination des suivis par des spécialistes ou ajustement des traitements médicamenteux avant la survenue d'épisodes aigus.

Commerce électronique : prédiction de la valeur vie client

Les plateformes logistiques e-commerce utilisant les outils d'analyse AWS ont constaté une augmentation de la valeur vie client grâce à la segmentation prédictive. Les équipes marketing exploitent ces prédictions pour optimiser leurs dépenses d'acquisition. Les clients à forte valeur vie client bénéficient d'offres de fidélisation plus attractives et d'expériences personnalisées. Cette approche permet de réorienter les budgets des campagnes généralistes vers des interventions ciblées, là où le retour sur investissement est le plus élevé.

Médias : Recommandation de contenu et croissance de l'audience

Les entreprises de médias ont constaté des améliorations significatives en matière d'acquisition de clients grâce à la modélisation prédictive d'audience. Les moteurs de recommandation de contenu utilisent des techniques similaires : Netflix et Spotify prédisent les films ou les chansons que chaque utilisateur appréciera en se basant sur le filtrage collaboratif et les attributs du contenu. Ces prédictions ont un impact direct sur la fidélisation et l'engagement des utilisateurs.

Services financiers : Détection des fraudes

Les sociétés de cartes de crédit utilisent des modèles prédictifs en temps réel qui évaluent la probabilité de fraude pour chaque transaction. Ces systèmes analysent le montant de la transaction, la catégorie du commerçant, la situation géographique, l'heure et l'historique des transactions afin de signaler toute activité suspecte en quelques millisecondes.

Ces modèles offrent un équilibre entre précision et taux de faux positifs. Bloquer des transactions légitimes est source de frustration pour les clients, tandis que manquer des tentatives de fraude engendre des coûts. Les méthodes d'ensemble, combinant plusieurs algorithmes, permettent d'atteindre la précision requise pour un déploiement en production.

Les violations de données engendrent des coûts considérables pour les organisations, ce qui fait des systèmes de détection prédictive des fraudes des investissements précieux.

Production : Maintenance prédictive

Les opérations industrielles utilisent les données de capteurs et l'apprentissage automatique pour prédire les pannes d'équipement avant qu'elles ne surviennent. Les recherches de l'IEEE démontrent l'existence de cadres d'IA explicables pour la surveillance prédictive de l'état des outils dans l'usinage à grande vitesse, alliant précision des prédictions et interprétabilité pour les techniciens de maintenance.

Ces systèmes analysent les vibrations, les températures, les signatures acoustiques et les journaux d'utilisation pour prévoir les défaillances des composants. La maintenance passe d'intervalles fixes à une maintenance conditionnelle, réduisant ainsi les temps d'arrêt et prolongeant la durée de vie des équipements.

Choisir le bon outil d'analyse prédictive

Le marché de l'analyse prédictive propose à la fois des solutions génériques applicables à tous les secteurs et des outils sectoriels adaptés à des cas d'usage spécifiques. Un mauvais choix entraîne une perte de temps et de budget, et retarde la création de valeur.

Évaluez la maturité de vos données

Les organisations se répartissent en différents stades de maturité des données. Les entreprises en phase de démarrage ne disposent pas de données historiques suffisantes pour une modélisation sophistiquée. Celles en phase de maturité intermédiaire possèdent des données mais doivent améliorer leur accessibilité. Les organisations avancées optimisent la performance de leurs modèles et leur infrastructure de déploiement.

Adaptez la sophistication des outils au niveau de maturité actuel. Les équipes sans expertise en science des données ne devraient pas commencer par AWS SageMaker : la courbe d'apprentissage retarde les résultats. Les analystes métier travaillant avec des ensembles de données existants obtiennent des résultats plus rapides en utilisant des plateformes d'apprentissage automatique ou des outils de BI dotés de fonctionnalités prédictives.

Définir des cas d'utilisation spécifiques

Les initiatives génériques du type “ nous avons besoin d'analyses prédictives ” échouent plus souvent que les projets ciblés. Définissez des cas d'utilisation concrets : réduire le taux d'attrition client de 151 000 £, améliorer la précision de la qualification des prospects de 201 000 £ ou optimiser les niveaux de stock pour réduire les coûts de stockage de 1 040 000 £ par an.

Des objectifs précis définissent les exigences en matière d'outils. La prédiction du taux de désabonnement nécessite des algorithmes de classification et l'intégration des données du cycle de vie client. L'optimisation des stocks requiert des prévisions de séries temporelles et la connectivité du système de la chaîne d'approvisionnement. Différents cas d'utilisation privilégient différentes plateformes.

Évaluer les exigences techniques

La plateforme est-elle compatible avec vos sources de données ? Peut-elle être déployée dans votre environnement préféré (cloud, sur site, hybride) ? S’intègre-t-elle à vos tableaux de bord décisionnels et systèmes opérationnels existants ?

La compatibilité technique détermine la complexité de la mise en œuvre. Une plateforme puissante nécessitant un travail d'intégration personnalisé important peut s'avérer moins avantageuse qu'un outil légèrement moins sophistiqué doté de connecteurs prêts à l'emploi pour votre environnement technique spécifique.

Tenir compte des capacités de l'équipe

Les plateformes AutoML permettent aux analystes d'affaires de créer des modèles sans programmation. Les outils statistiques comme SPSS conviennent aux chercheurs à l'aise avec les techniques traditionnelles. Python et R requièrent une expertise en science des données, mais offrent une flexibilité maximale.

Une évaluation objective des compétences de l'équipe permet d'éviter les inadéquations entre les outils et leurs capacités. Par ailleurs, le choix des outils peut guider les décisions de recrutement : si la stratégie d'entreprise exige une modélisation avancée, il convient d'investir dans des talents en science des données, en plus de l'infrastructure.

Tenir compte du coût total de possession

Le prix de l'abonnement ne représente qu'une partie du coût total. Les services de mise en œuvre, la formation, l'ingénierie des données et la maintenance continue ajoutent des dépenses substantielles aux frais logiciels indiqués.

Des coûts cachés apparaissent lors du passage à l'échelle. Certaines plateformes facturent à la prédiction, engendrant des dépenses à l'usage qui explosent avec l'adoption. D'autres nécessitent une infrastructure coûteuse pour un déploiement sur site. Les services cloud accumulent des frais de calcul et de stockage. Calculez un coût total de possession réaliste sur trois ans avant de vous engager.

Meilleures pratiques de mise en œuvre

L’acquisition d’une plateforme d’analyse prédictive marque le début, et non la fin, du processus. Les implémentations réussies suivent des schémas récurrents.

Commencez par un projet pilote

Les déploiements à l'échelle de l'entreprise sont souvent bloqués lorsque la complexité dépasse les capacités des équipes. Il est donc préférable d'identifier un cas d'utilisation unique à forte valeur ajoutée, assorti d'indicateurs de réussite clairs et d'une portée maîtrisable.

Un projet pilote de trois mois permet de valider la technologie, de renforcer la confiance au sein de l'organisation et de déceler les difficultés d'intégration avant le déploiement complet. Privilégiez les cas d'usage où la précision des prédictions a un impact direct sur des indicateurs commerciaux mesurables : taux d'attrition client, taux de conversion des prospects ou rotation des stocks.

Mettre en place une gouvernance des données

Les modèles prédictifs héritent des problèmes de qualité de leurs données d'entraînement. Il est donc essentiel d'établir des politiques de gouvernance des données avant de commencer le développement des modèles. Définissez la propriété des données, les normes de qualité, les politiques de conservation et les contrôles d'accès.

Les catalogues de données recensent les jeux de données disponibles, leurs schémas, leurs fréquences de mise à jour et les problèmes de qualité connus. Cette documentation accélère le développement des modèles en aidant les data scientists à localiser rapidement les données d'entraînement pertinentes.

Constituer des équipes transversales

L'efficacité des analyses prédictives repose sur la collaboration entre les experts métiers, les data scientists et les équipes d'exploitation informatique. Les experts métiers comprennent le contexte commercial et interprètent les résultats des modèles. Les data scientists conçoivent et valident les modèles. Les équipes informatiques gèrent le déploiement et la surveillance de l'infrastructure.

Les implémentations cloisonnées échouent car les modèles ne reflètent pas la réalité métier ou ne peuvent pas s'intégrer aux systèmes opérationnels. Les équipes pluridisciplinaires permettent d'éviter ces déconnexions.

Plan de gestion du cycle de vie du modèle

Les modèles se dégradent avec le temps, car les conditions réelles évoluent. Les comportements des clients changent. Les gammes de produits se transforment. Les concurrents ajustent leurs stratégies. Un modèle de taux de désabonnement performant l'an dernier peut être moins performant aujourd'hui.

Mettez en place des processus de suivi des performances du modèle, de réentraînement sur des données récentes et de déploiement des versions mises à jour. Les outils d'automatisation gèrent le réentraînement de routine, mais une intervention humaine empêche les systèmes automatisés d'apprendre et d'amplifier des comportements anormaux.

Prioriser l'explicabilité du modèle

Les parties prenantes ne se baseront pas sur des prédictions qu'elles ne comprennent pas. Même si un modèle opaque atteint une précision de 95 % (95 % de réussite sur 30 % de chances de succès), les équipes commerciales ignorent les scores des prospects sans explications. Les dirigeants rejettent les recommandations dépourvues de justification claire.

Investissez dans des outils d'explicabilité qui traduisent le fonctionnement interne des modèles en langage métier. “ Ce prospect a obtenu un score élevé car il a consulté les pages de tarification à trois reprises, travaille dans une entreprise de la taille cible et correspond à notre segment de clients idéal ” incite davantage à l'action que “ le modèle prédit une probabilité de conversion de 0,87 ”.”

Obtenez des modèles prédictifs construits autour de vos données et de vos cas d'utilisation

Les outils d'analyse prédictive exigent souvent d'adapter les données à leur structure. Lorsque les données proviennent de sources multiples ou ne suivent pas un format standard, les modèles intégrés deviennent inutiles. IA supérieure Nous développons des logiciels d'IA personnalisés avec analyse prédictive, en créant des modèles qui reflètent la manière dont vos données sont réellement collectées et utilisées. Vous pouvez ainsi travailler sur la prévision, la détection des fraudes et la prédiction des défaillances sans être limité par une logique d'outil prédéfinie.

Transformez vos données en modèles prédictifs opérationnels

AI Superior fournit :

- Des modèles prédictifs construits à partir de vos propres données, et non de modèles génériques.

- Logiciel d'IA conçu pour vos tâches de prédiction spécifiques

- Un système qui combine des données provenant de sources multiples

Contactez l'IA supérieure pour discuter de la manière dont l'analyse prédictive peut être mise en œuvre dans votre environnement.

Pièges courants et comment les éviter

Les organisations gaspillent des ressources dans des initiatives d'analyse prédictive qui n'apportent qu'une valeur minime. Ces schémas se répètent lors des implémentations qui échouent.

Données d'entraînement insuffisantes

Les algorithmes les plus sophistiqués ne peuvent pas extraire de tendances à partir de données insuffisantes. Il arrive que des équipes se lancent dans des projets prédictifs avant même d'avoir accumulé suffisamment de données historiques.

Soyez honnête quant à la disponibilité des données. Si la prédiction du taux de désabonnement nécessite plus de 200 événements historiques, mais qu'il n'en existe que 50, reportez le projet le temps de mettre en place l'infrastructure de données. Profitez de cette période intermédiaire pour réaliser des analyses descriptives documentant les tendances actuelles.

Importance excessive accordée à la précision

La recherche d'une précision légèrement supérieure du modèle apporte souvent moins de valeur ajoutée que le déploiement rapide d'un modèle suffisamment performant. La différence de précision entre les modèles 82% et 85% justifie rarement six mois de développement supplémentaires.

Définissez des seuils de précision acceptables en fonction de l'impact sur l'activité. Déployez des modèles qui respectent ces seuils, puis itérez en fonction des performances en production. L'utilisation réelle révèle souvent des améliorations invisibles lors des tests hors ligne.

Négliger le dernier kilomètre

L'élaboration de modèles précis représente la moitié du défi. L'intégration des prédictions dans les flux de travail opérationnels, là où elles influencent les décisions, complète la chaîne de valeur.

Si les scores des prospects ne sont pas intégrés au CRM utilisé par les commerciaux, ils n'auront aucun impact sur leur comportement. De même, si les prévisions de désabonnement ne déclenchent pas de campagnes de fidélisation, le taux de désabonnement ne diminuera pas. Planifiez le déploiement et l'intégration dès le début du projet, et non après coup.

Ignorer la gestion du changement

La mise en œuvre technique est plus souvent couronnée de succès que l'adoption organisationnelle. Les équipes commerciales, habituées à prendre des décisions intuitives, résistent à la notation algorithmique des prospects. Les responsables marketing remettent en question les modèles d'attribution qui contredisent leur intuition.

Impliquez les parties prenantes dès le début. Mettez en avant des résultats rapides pour renforcer la confiance. Fournissez des explications claires qui aident les utilisateurs à comprendre et à faire confiance aux prédictions. La gestion du changement déterminera si l'analyse prédictive a un impact concret sur l'activité ou seulement sur le papier.

L'avenir des outils d'analyse prédictive

Le paysage de l'analyse prédictive continue d'évoluer. Plusieurs tendances déterminent l'orientation future des outils.

Automatisation et accessibilité accrues

Les capacités d'AutoML se développent chaque année, réduisant ainsi les obstacles techniques à la modélisation prédictive. Les interfaces en langage naturel permettent aux analystes métier de poser des questions en langage clair plutôt que d'écrire du code ou du SQL.

Cette démocratisation étend les capacités prédictives au-delà des équipes spécialisées en science des données. Les experts du domaine élaborent leurs propres modèles, accélérant ainsi la production d'informations et libérant les data scientists pour des défis complexes nécessitant des approches personnalisées.

Prédictions en temps réel et en continu

Avec l'amélioration des infrastructures, les prédictions par lots cèdent la place à l'évaluation en temps réel. Les systèmes de détection de fraude évaluent déjà les transactions en quelques millisecondes. Les moteurs de personnalisation proposent des recommandations de contenu individualisées en temps réel pendant que les utilisateurs naviguent sur les sites web.

Les plateformes de données en flux continu et l'infrastructure de diffusion de modèles à faible latence permettent une mise à jour continue des prédictions. Les scores de risque client sont actualisés dès l'arrivée de nouveaux signaux comportementaux, sans avoir besoin d'être recalculés chaque nuit.

Accent mis sur l'IA explicable

La pression réglementaire et les exigences commerciales alimentent la demande de modèles interprétables. Le RGPD européen établit un droit à l'explication des décisions automatisées. La gestion des risques liés aux modèles dans le secteur bancaire requiert une documentation de la logique de ces modèles.

Les techniques d'explicabilité progressent de pair avec la sophistication des modèles. Les chercheurs développent des méthodes qui préservent la précision des prédictions tout en assurant la transparence de la logique de décision. Cet équilibre devient un avantage concurrentiel, les organisations étant soumises à un examen minutieux de leurs décisions algorithmiques.

Intégration de plusieurs types de données

Les premiers modèles prédictifs utilisaient des données structurées : données démographiques des clients, historiques de transactions, journaux comportementaux. Les plateformes modernes intègrent de plus en plus de données non structurées comme du texte, des images et des vidéos.

Le traitement automatique du langage naturel extrait des informations des transcriptions du service client et des publications sur les réseaux sociaux. La vision par ordinateur analyse les images de produits et les défauts de fabrication. Les modèles multimodaux combinent des données structurées et non structurées pour des prédictions plus précises.

Questions fréquemment posées

Quelle est la différence entre les outils d'analyse prédictive et les plateformes de veille stratégique ?

Les plateformes de veille stratégique se concentrent sur l'analyse descriptive : elles rendent compte des événements et de leurs causes grâce à des tableaux de bord, des visualisations et des analyses historiques. Les outils d'analyse prédictive, quant à eux, prévoient les événements futurs à l'aide de modèles statistiques et d'algorithmes d'apprentissage automatique. De nombreuses plateformes de veille stratégique modernes intègrent désormais des fonctionnalités prédictives de base, mais les plateformes prédictives dédiées offrent des techniques de modélisation plus sophistiquées et des flux de travail automatisés.

Ai-je besoin de data scientists pour utiliser les outils d'analyse prédictive ?

Cela dépend de la plateforme et du cas d'usage. Les outils d'apprentissage automatique comme DataRobot et les plateformes sectorielles permettent aux analystes métier de créer des modèles sans compétences en programmation. Ces plateformes automatisent la sélection des algorithmes et l'ingénierie des caractéristiques. Pour les modèles personnalisés, les techniques avancées ou les cas d'usage novateurs, les compétences en science des données restent précieuses. Les organisations commencent souvent par des outils accessibles et ajoutent des compétences techniques à mesure que leurs besoins se complexifient.

De combien de données ai-je besoin avant de commencer l'analyse prédictive ?

Les exigences minimales varient selon le cas d'utilisation. Le scoring des leads nécessite généralement au moins six mois d'historique et plus de 500 conversions. La prédiction du taux de désabonnement requiert au moins douze mois de données sur le cycle de vie client et plus de 200 événements de désabonnement. Des prévisions plus simples peuvent fonctionner avec moins de données, tandis que les modèles complexes en nécessitent davantage. La qualité compte autant que la quantité : des données propres et cohérentes, comportant des variables pertinentes, donnent de meilleurs résultats que de grands volumes d'enregistrements de mauvaise qualité.

Quels secteurs tirent le plus grand profit de l'analyse prédictive ?

Presque tous les secteurs d'activité utilisent l'analyse prédictive, même si les cas d'usage varient. Les services financiers s'en servent pour la détection des fraudes, l'évaluation du crédit et la gestion des risques. Les établissements de santé prévoient l'évolution des patients et le risque de réadmission. Les détaillants anticipent la demande et optimisent leurs prix. Le secteur manufacturier l'applique à la maintenance prédictive. Les équipes marketing, tous secteurs confondus, l'utilisent pour prédire la valeur vie client et optimiser leurs campagnes. Le point commun ? La capacité à anticiper les résultats futurs et à créer un avantage concurrentiel.

Dans quelle mesure les modèles d'analyse prédictive sont-ils précis ?

La précision varie considérablement selon la qualité des données, la complexité du problème et l'approche de modélisation. Une prévision simple peut atteindre une précision de 70 à 800 000 TPE, tandis que des méthodes d'ensemble sophistiquées, appliquées à des données propres, atteignent plus de 900 000 TPE. Cependant, une précision parfaite n'est ni atteignable ni nécessaire ; ce sont les modèles qui améliorent la prise de décision par rapport à la seule intuition qui apportent une réelle valeur ajoutée. Les performances réelles diffèrent souvent de la précision mesurée lors des tests ; une surveillance continue permet donc de garantir l'efficacité des modèles face à l'évolution des conditions.

L'analyse prédictive peut-elle fonctionner avec de petits ensembles de données ?

Les petits ensembles de données limitent les options de modélisation et la précision. Des techniques comme la régularisation préviennent le surapprentissage lorsque les données d'entraînement sont rares. L'apprentissage par transfert applique les modèles appris à partir de grands ensembles de données à des problèmes plus restreints et spécifiques à un domaine. Cela dit, la significativité statistique exige des tailles d'échantillon minimales : prédire des événements rares à partir de 20 exemples historiques ne produira pas de prévisions fiables. Les organisations disposant de données limitées devraient commencer par des approches analytiques plus simples tout en développant une infrastructure de données pour de futures capacités de prédiction.

Quel est le délai typique de retour sur investissement pour les implémentations d'analyse prédictive ?

Les projets pilotes démontrent souvent leur valeur en 3 à 6 mois lorsque les cas d'usage disposent d'indicateurs clairs et de données suffisantes. Les déploiements à l'échelle de l'entreprise prennent 12 à 18 mois, le temps que les organisations mettent en place l'infrastructure, établissent la gouvernance et intègrent les prévisions aux processus opérationnels. Le retour sur investissement dépend du cas d'usage : la réduction du taux de désabonnement et la prévention de la fraude génèrent rapidement un impact financier mesurable, tandis que les prévisions stratégiques offrent des avantages à plus long terme. Les organisations qui débutent par des projets pilotes ciblés et progressent par étapes obtiennent des retours sur investissement plus rapides que celles qui tentent des transformations globales immédiates.

Conclusion

Les outils d'analyse prédictive transforment la prise de décision au sein des organisations en remplaçant l'intuition par des prévisions basées sur les données. Leur écosystème technologique s'étend des plateformes AutoML accessibles qui démocratisent la modélisation aux environnements de programmation sophistiqués qui offrent aux data scientists une flexibilité maximale.

Les implémentations réussies adaptent les capacités des outils à la maturité de l'organisation, aux compétences des équipes et aux cas d'usage spécifiques. Les jeunes entreprises bénéficient de solutions clés en main avec des exigences techniques minimales. Les équipes de données avancées exploitent des environnements de modélisation personnalisés pour des applications spécialisées.

La clé du succès réside dans une approche ciblée : identifier un cas d’usage unique à forte valeur ajoutée, garantir la disponibilité des données, sélectionner les outils appropriés et démontrer la valeur ajoutée avant d’étendre la stratégie. Les entreprises qui adoptent cette approche obtiennent des résultats concrets : réduction du taux de désabonnement, amélioration des taux de conversion, optimisation des niveaux de stock et prévention des pertes liées à la fraude.

Les résultats concrets valident l'investissement. Les établissements de santé ont considérablement réduit les hospitalisations grâce à l'analyse prédictive. Les plateformes de commerce électronique ont augmenté la valeur vie client grâce à des approches prédictives. Les entreprises de médias ont considérablement accru leur acquisition grâce à la modélisation prédictive d'audience. Ces résultats sont possibles lorsque les outils adéquats sont associés à des données suffisantes et à des objectifs commerciaux clairs.

Le paysage de l'analyse prédictive continuera d'évoluer. L'automatisation élargit l'accès aux données. Les capacités en temps réel permettent des décisions instantanées. Les techniques d'explicabilité renforcent la confiance dans les recommandations algorithmiques. Les organisations qui investissent dès maintenant dans les capacités prédictives acquièrent des avantages concurrentiels qui se multiplient à mesure que les données s'accumulent et que les modèles s'améliorent.

Prêt à mettre en œuvre l'analyse prédictive ? Commencez par auditer vos données existantes, définir des objectifs mesurables et sélectionner un cas d'usage pilote où la prévision apporte une réelle valeur ajoutée à l'entreprise. Les outils existent ; la réussite repose sur une mise en œuvre réfléchie et adaptée à la réalité de l'organisation.