Kurzzusammenfassung: Predictive-Analytics-Tools kombinieren statistische Modellierung, maschinelles Lernen und Data Mining, um zukünftige Ergebnisse auf Basis historischer Daten vorherzusagen. Der Technologie-Stack umfasst Programmierumgebungen (Python, R), statistische Plattformen (IBM SPSS, SAS), Business-Intelligence-Tools (Tableau, Power BI), AutoML-Plattformen (DataRobot, H2O.ai) und Cloud-basierte Lösungen (AWS SageMaker, Azure ML), die auf unterschiedliche technische Kenntnisse und Anwendungsfälle zugeschnitten sind.

Prädiktive Analysen ermitteln die Wahrscheinlichkeit zukünftiger Ereignisse mithilfe von Techniken wie Data Mining, Statistik, Datenmodellierung, künstlicher Intelligenz und maschinellem Lernen. Unternehmen verschiedenster Branchen nutzen diese Werkzeuge, um historische Datenmuster zu interpretieren und fundierte Entscheidungen hinsichtlich Risiken, Chancen und Kundenverhalten zu treffen.

Der Markt für prädiktive Analysen bietet im Jahr 2026 ein breites Spektrum an Lösungen – von codefreien Lösungen für Business-Analysten bis hin zu unternehmensweiten Machine-Learning-Ökosystemen für Data-Science-Teams. Die Wahl des richtigen Tools hängt vom Reifegrad Ihres Unternehmens, Ihren Anwendungsfällen und Ihrer bestehenden Technologieinfrastruktur ab.

Aber der springende Punkt ist: Nicht jedes Tool für prädiktive Analysen liefert gleichwertige Ergebnisse. Die richtige Plattform verändert die Zeiteinteilung von Teams und verlagert den Fokus von der Datenaufbereitung hin zu konkreten Prognosen, die den Umsatz steigern. Marketinganalysten beispielsweise verbringen typischerweise 401 bis 300 Millionen ihrer Zeit mit der Datenaufbereitung für die Analyse, wodurch kaum Zeit für die wirklich wichtigen Prognosen bleibt.

Was qualifiziert sich als prädiktives Analysetool?

Predictive-Analytics-Tools nutzen statistische Modellierung, Data-Mining-Verfahren und maschinelles Lernen, um aktuelle und historische Geschäftsdaten zu analysieren und präzise Prognosen zu erstellen. Diese Plattformen helfen Unternehmen, die Wahrscheinlichkeit zukünftiger oder bisher unbekannter Ereignisse zu bestimmen.

Diese Unterscheidung ist wichtig, da nicht jede Analyseplattform als prädiktiv gilt. Deskriptive Analysen beschreiben, was passiert ist. Diagnostische Analysen erklären, warum es passiert ist. Prädiktive Analysen hingegen prognostizieren, was als Nächstes geschehen wird, basierend auf Mustern in Ihren Daten.

Echte Predictive-Analytics-Plattformen vereinen mehrere Kernfunktionen:

- Datenintegration aus verschiedenen Quellen (Datenbanken, Tabellenkalkulationen, Cloud-Dienste)

- Bibliotheken für statistische Modellierung und Algorithmen (Regression, Klassifizierung, Zeitreihen)

- Training und Validierung von Modellen des maschinellen Lernens

- Automatisierte Merkmalsentwicklung und Variablenauswahl

- Infrastruktur für Modellbereitstellung und -überwachung

- Visualisierungswerkzeuge zur Interpretation von Vorhersagen

Generische Business-Intelligence-Tools bieten oft grundlegende Prognosefunktionen. Ihnen fehlt jedoch die nötige Tiefe für anspruchsvolle prädiktive Modellierung. Echte prädiktive Plattformen bieten fortschrittliche Techniken wie Ensemble-Methoden, neuronale Netze und Gradient Boosting, die eine messbar höhere Genauigkeit erzielen.

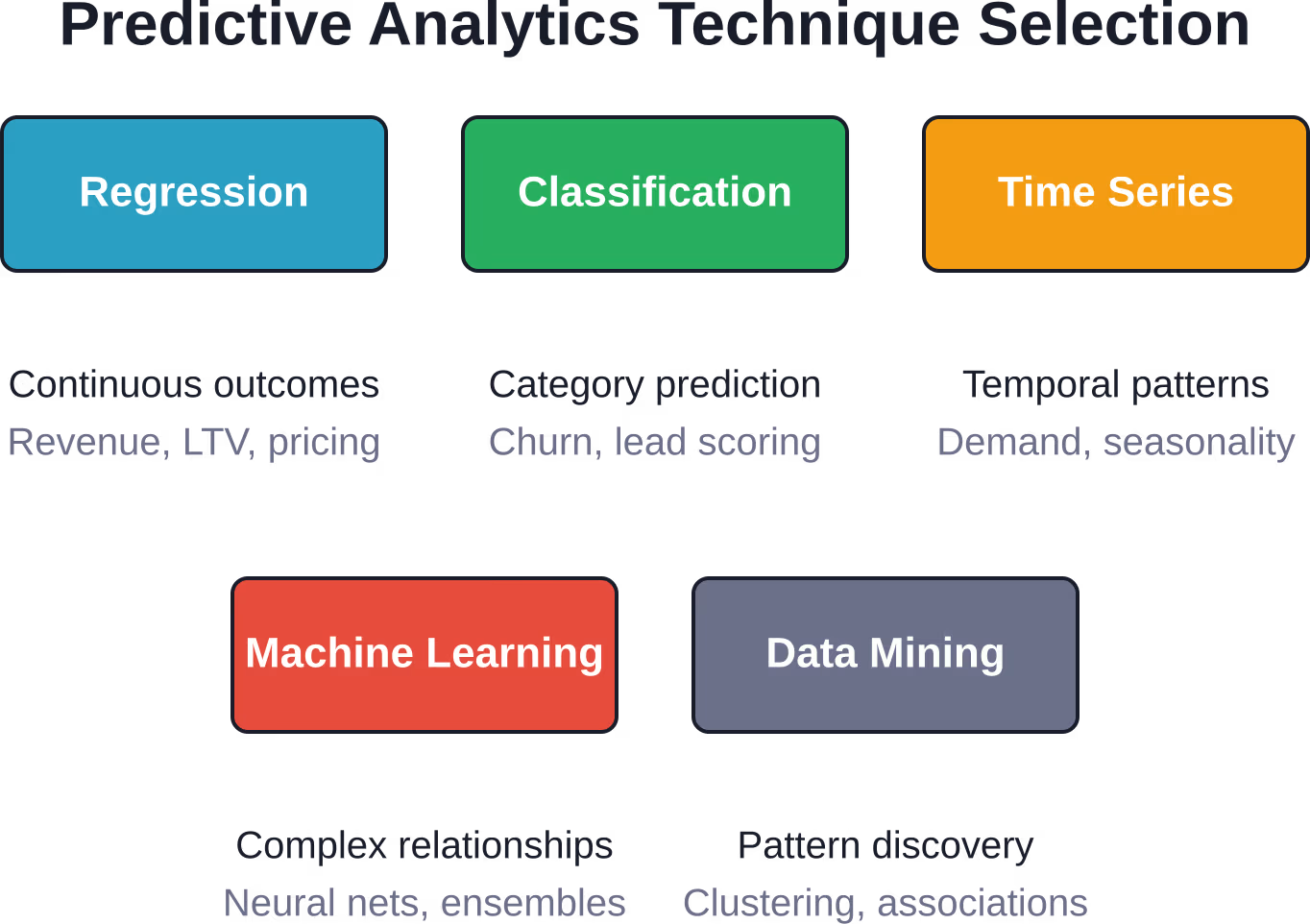

Kerntechniken der prädiktiven Analytik

Das Verständnis der Techniken hinter prädiktiver Analytik hilft dabei, die tatsächlich benötigten Tools auszuwählen. Verschiedene Methoden eignen sich für unterschiedliche Vorhersagetypen, und nicht jede Plattform unterstützt jede Technik.

Regressionsanalyse

Regressionsmodelle prognostizieren kontinuierliche numerische Ergebnisse. Die lineare Regression eignet sich für einfache Zusammenhänge – beispielsweise zur Prognose des Umsatzes anhand der Werbeausgaben. Komplexere Varianten wie die Polynomregression und die Ridge-Regression berücksichtigen nichtlineare Muster und verhindern eine Überanpassung.

Die Methode erfordert saubere historische Daten mit identifizierten Zusammenhängen zwischen den Variablen. Marketingteams nutzen Regressionsanalysen, um den Kundenwert zu prognostizieren, während Finanzabteilungen Quartalsumsätze auf Basis saisonaler Trends und Marktsignale vorhersagen.

Klassifikationsmodelle

Klassifizierungsverfahren sagen kategoriale Ergebnisse voraus – Ja/Nein-Entscheidungen, Risikokategorien, Kundensegmente. Logistische Regression, Entscheidungsbäume und Support-Vektor-Maschinen gehören in diese Kategorie.

Lead-Scoring-Systeme basieren maßgeblich auf Klassifizierung. Das Modell analysiert Hunderte von Attributen (Berufsbezeichnung, Unternehmensgröße, Website-Verhalten), um potenzielle Kunden als solche mit hoher oder niedriger Konversionswahrscheinlichkeit einzustufen. Organisationen im Gesundheitswesen nutzen diese Klassifizierung, um das Risiko einer Wiedereinweisung oder die Wahrscheinlichkeit einer Krankheitsdiagnose vorherzusagen.

Zeitreihenprognose

Zeitreihenanalysen untersuchen in regelmäßigen Abständen erfasste Datenpunkte, um zukünftige Werte vorherzusagen. ARIMA-Modelle, exponentielle Glättung und Prophet (Metas Open-Source-Prognosetool) eignen sich hervorragend zur Erfassung saisonaler Muster, Trends und zyklischer Verhaltensweisen.

Der Einzelhandel nutzt Zeitreihenprognosen für die Bestandsplanung. E-Commerce-Plattformen prognostizieren Nachfragespitzen rund um Feiertage. Finanzinstitute prognostizieren Aktienkurse und Währungsschwankungen mithilfe komplexer Zeitreihenmodelle, die zahlreiche Variablen berücksichtigen.

Algorithmen für maschinelles Lernen

Maschinelles Lernen verbessert prädiktive Analysen, indem es Vorhersagen automatisch optimiert, sobald mehr Daten verfügbar sind. Random Forests, Gradient Boosting Machines (GBM), neuronale Netze und Deep-Learning-Architekturen können komplexe, nichtlineare Zusammenhänge erfassen, die traditionellen statistischen Methoden verborgen bleiben.

Laut einer Studie des Online-Programms für Business Analytics von William & Mary haben Techniken des maschinellen Lernens zu Verbesserungen in der prädiktiven Analytik für Unternehmen verschiedenster Branchen geführt. Der Einsatz von maschinellem Lernen ermöglicht es Systemen, Millionen von Datenpunkten gleichzeitig zu verarbeiten – etwas, das mit manueller statistischer Modellierung praktisch unmöglich wäre.

Ein Machine-Learning-Algorithmus, der beispielsweise eine Pay-per-Click-Kampagne steuert, könnte eine Obergrenze von $0,25 für das Keyword-Gebot festlegen. Durch die Einbeziehung Tausender Datenpunkte könnte der Algorithmus ermitteln, dass $0,14 das optimale Gebot für maximalen ROI darstellt – eine Präzision, die durch manuelle Analyse nur schwer zu erreichen ist.

Data Mining und Mustererkennung

Data-Mining extrahiert bisher unbekannte Muster aus großen Datensätzen. Clustering-Algorithmen gruppieren ähnliche Kunden ohne vordefinierte Kategorien. Assoziationsregeln ermitteln, welche Produkte Kunden häufig gemeinsam kaufen. Anomalieerkennung identifiziert ungewöhnliche Muster, die auf Betrug oder Systemausfälle hindeuten könnten.

Maschinelles Lernen und prädiktive Analysen sind unverzichtbare Werkzeuge, um riesige Datenmengen zu erschließen und zu verstehen. Diese Techniken ergänzen sich: Data Mining deckt Muster auf, während prädiktive Modellierung diese Muster nutzt, um zukünftige Ergebnisse vorherzusagen.

Kategorien von Tools für prädiktive Analysen

Predictive-Analytics-Plattformen reichen von codefreien Lösungen für Business-Analysten bis hin zu unternehmensweiten Machine-Learning-Ökosystemen für Data-Science-Teams. Der Markt lässt sich anhand technischer Anforderungen, Anwendungsfallspezifik und Implementierungskomplexität in verschiedene Kategorien unterteilen.

Statistische Softwareplattformen

Traditionelle Statistikprogramme wie IBM SPSS, SAS und Stata dominierten die prädiktive Analytik jahrzehntelang. Diese Plattformen bieten umfassende statistische Modellierungsfunktionen, umfangreiche Dokumentation und bewährte Zuverlässigkeit für die Forschung in Wissenschaft und Wirtschaft.

IBM SPSS bietet intuitive Benutzeroberflächen für Regressionsanalysen, Faktorenanalysen und andere klassische Verfahren. SAS liefert leistungsstarke Analyselösungen, die insbesondere in regulierten Branchen wie der Pharma- und Finanzbranche führend sind. Diese Tools setzen statistische Kenntnisse voraus, erfordern aber für grundlegende Analysen keine Programmierkenntnisse.

Die Einschränkung? Sie wurden nicht für moderne Machine-Learning-Workflows oder Big-Data-Infrastrukturen entwickelt. Data Scientists bevorzugen zunehmend flexiblere Alternativen.

Programmiersprachen und Bibliotheken

Python und R zählen zu den beliebtesten Umgebungen für prädiktive Analysen in Data-Science-Teams. Beide Sprachen bieten umfangreiche Bibliotheken für maschinelles Lernen, aktive Communitys und Flexibilität für die Entwicklung kundenspezifischer Modelle.

Die Python-Bibliothek scikit-learn stellt Implementierungen zahlreicher Algorithmen bereit. TensorFlow und PyTorch ermöglichen Deep-Learning-Modelle. Pandas übernimmt die Datenmanipulation. Das Ökosystem unterstützt den gesamten Workflow der prädiktiven Analytik – von der Datenbereinigung bis zur Modellbereitstellung.

R ist auf statistische Berechnungen spezialisiert und bietet Pakete wie caret, randomForest und glmnet. Die Sprache eignet sich hervorragend für explorative Datenanalyse und statistische Visualisierung mittels ggplot2. Forschungsstatistiker schätzen R aufgrund seiner umfassenden Abdeckung fortgeschrittener statistischer Verfahren.

Diese Tools erfordern Programmierkenntnisse. Für Teams mit technischer Expertise bieten sie jedoch maximale Flexibilität und Anpassungsmöglichkeiten.

Business-Intelligence-Tools mit prädiktiven Funktionen

Plattformen wie Tableau, Microsoft Power BI und Qlik haben prädiktive Funktionen in ihre BI-Angebote integriert. Diese Tools legen Wert auf Benutzerfreundlichkeit – Anwender können Prognosen erstellen, ohne Code schreiben oder Algorithmen verstehen zu müssen.

Tableau integriert sich mit R und Python für benutzerdefinierte Modelle und bietet integrierte Prognosefunktionen für Zeitreihendaten. Power BI beinhaltet AutoML-Funktionen durch die Azure-Integration. Diese Plattformen verbinden sich mit über 100 Datenquellen, darunter Datenbanken, Tabellenkalkulationen und Cloud-Dienste.

Der Kompromiss liegt in der Komplexität. Integrierte Prognosefunktionen eignen sich gut für Standard-Szenarien, bieten aber nicht die nötige Tiefe für komplexe Modellierungen. Finanzteams, die diese Tools zur Umsatzprognose in Verbindung mit Marktsignalen und saisonalen Trends nutzen, erzielen zuverlässige Ergebnisse. Für spezielle Anwendungsfälle sind jedoch weiterhin dedizierte Prognoseplattformen erforderlich.

AutoML- und No-Code-Plattformen

Automatisierte Machine-Learning-Plattformen demokratisieren die prädiktive Analytik, indem sie die Algorithmenauswahl, die Hyperparameteroptimierung und das Feature Engineering automatisch übernehmen. DataRobot, H2O.ai und Google AutoML gehören zu dieser Kategorie.

Diese Tools verarbeiten Trainingsdaten und testen automatisch Hunderte von Modellkonfigurationen, um den leistungsstärksten Ansatz zu ermitteln. Auch Business-Analysten ohne Data-Science-Kenntnisse können so produktionsreife Modelle erstellen. Die Plattformen übernehmen die Bereitstellung, Überwachung und das erneute Training der Modelle.

DataRobot eignet sich besonders für Unternehmenseinsätze mit Governance-Anforderungen. H2O.ai bietet sowohl Open-Source- als auch kommerzielle Versionen an. Driverless AI automatisiert die gesamte Machine-Learning-Pipeline und gewährleistet gleichzeitig die Erklärbarkeit der Modelle – ein entscheidender Faktor für regulierte Branchen.

Cloudbasierte Dienste für maschinelles Lernen

Amazon Web Services, Google Cloud Platform und Microsoft Azure bieten verwaltete Umgebungen für maschinelles Lernen. AWS SageMaker, Google Vertex AI und Azure Machine Learning kombinieren Infrastruktur, Algorithmenbibliotheken und Bereitstellungstools in Cloud-nativen Plattformen.

Diese Dienste integrieren sich nahtlos in andere Cloud-Ressourcen. Daten, die in S3 oder BigQuery gespeichert sind, fließen direkt in das Modelltraining ein. Bereitgestellte Modelle skalieren automatisch basierend auf dem Vorhersagevolumen. Die integrierte Überwachung erfasst die Modellleistung und Datenabweichungen.

Cloud-Plattformen eignen sich für Unternehmen, die bereits in Cloud-Infrastruktur investiert haben. Sie reduzieren den Verwaltungsaufwand für die Infrastruktur und bieten gleichzeitig Sicherheits- und Compliance-Funktionen auf Unternehmensebene. Unternehmen, die Cloud-basierte Machine-Learning-Dienste nutzen, konnten durch prädiktive Kundensegmentierung den Kundenwert steigern.

Branchenspezifische Lösungen

Spezialisierte Tools für prädiktive Analysen zielen auf bestimmte Branchen oder Anwendungsfälle ab. Marketing-Clouds (Salesforce Einstein, Adobe Sensei) konzentrieren sich auf die Vorhersage der Customer Journey und die Personalisierung. Plattformen im Gesundheitswesen dienen der Risikostratifizierung von Patienten und der Vorhersage von Wiedereinweisungen. Tools für Finanzdienstleister sind auf Betrugserkennung und Kreditwürdigkeitsprüfung spezialisiert.

Diese Lösungen enthalten vorkonfigurierte, branchenrelevante Modelle und Datenschemata. Die Implementierungszeit verkürzt sich im Vergleich zur Entwicklung individueller Modelle erheblich. Gesundheitsorganisationen, die prädiktive Analysen einsetzen, berichten von einer signifikanten Reduzierung von Krankenhauseinweisungen und Notfallaufnahmen durch Risikostratifizierungsansätze.

Die Spezifität hat zwei Seiten. Branchenspezifische Werkzeuge sind zwar für ihren vorgesehenen Zweck hervorragend geeignet, mangelt es ihnen aber an Flexibilität für neuartige Anwendungsfälle außerhalb ihres Anwendungsbereichs.

Wesentliche Merkmale von Plattformen für prädiktive Analysen

Nicht jede Plattform bietet alle Funktionen. Zu verstehen, welche Funktionen für bestimmte Anwendungsfälle wichtig sind, verhindert kostspielige Diskrepanzen zwischen den Funktionen des Tools und den Bedürfnissen der Organisation.

Datenkonnektivität und -integration

Vorhersagemodelle funktionieren nur, wenn sie auf relevante Daten zugreifen können. Die besten Plattformen bieten umfangreiche Konnektorenbibliotheken für Datenbanken (PostgreSQL, MySQL, Oracle), Cloud-Data-Warehouses (Snowflake, Redshift, BigQuery), CRM-Systeme (Salesforce, HubSpot) und Marketingplattformen.

Datenintegration geht über einfache Importe hinaus. Produktionsbasierte Prognosesysteme benötigen automatisierte Datenpipelines, die Trainingsdaten aktualisieren, Modelle regelmäßig neu trainieren und Prognosen an operative Systeme zurückmelden. Echtzeit-Prognose-APIs erfordern latenzarme Verbindungen zu Transaktionsdatenbanken.

Lässt sich das Tool sowohl in der Cloud als auch lokal einsetzen? Unterstützt es die Anforderungen an den Datenstandort für internationale Geschäftstätigkeiten? Diese Integrationsfragen entscheiden darüber, ob eine Plattform den Anforderungen der Unternehmensarchitektur entspricht.

Algorithmenbibliotheken und Modelltypen

Umfassende Plattformen unterstützen verschiedene Modellierungsansätze. Regressionsmodelle für kontinuierliche Zielgrößen. Klassifikationsalgorithmen für kategoriale Vorhersagen. Zeitreihenmethoden für zeitliche Prognosen. Clustering zur Segmentierung. Ensemble-Methoden, die mehrere Modelle kombinieren, um die Genauigkeit zu verbessern.

Auch die Tiefe ist wichtig. Bietet die Plattform nur lineare Regression oder auch Regularisierungsverfahren wie LASSO und Ridge-Regression? Kann sie Gradient Boosting Machines, Random Forests und neuronale Netze verarbeiten? Unterstützt sie Deep Learning für unstrukturierte Daten wie Bilder und Texte?

Führende Plattformen bieten 10 bis 50 verschiedene Algorithmusimplementierungen. Sie erläutern zudem, wann welcher Ansatz anzuwenden ist, und leiten die Nutzer zu den für ihre Datenmerkmale geeigneten Techniken.

AutoML und automatisierte Merkmalsentwicklung

Feature Engineering – die Erstellung von Vorhersagevariablen aus Rohdaten – beanspruchte traditionell enorme Mengen an Data-Science-Zeit. Moderne Plattformen automatisieren diesen Prozess und testen Tausende von Feature-Kombinationen, um die aussagekräftigsten Variablen zu identifizieren.

AutoML erweitert die Automatisierung auf die Algorithmenauswahl und die Hyperparameteroptimierung. Das System trainiert Dutzende von Kandidatenmodellen, vergleicht deren Leistung mittels Kreuzvalidierung und empfiehlt die optimale Konfiguration. Dadurch verkürzt sich die Modellentwicklung von Wochen auf Stunden.

Doch die Automatisierung hat ihre Grenzen. Vollautomatisierte Systeme übersehen mitunter domänenspezifische Erkenntnisse, die erfahrene Analysten einbeziehen würden. Die besten Plattformen bieten ein ausgewogenes Verhältnis zwischen Automatisierung und der Möglichkeit zur manuellen Eingriffssteuerung durch Experten.

Erklärbarkeit und Interpretierbarkeit des Modells

Komplexe Modelle des maschinellen Lernens funktionieren oft wie Blackboxes – sie liefern zwar präzise Vorhersagen, erklären aber nicht, wie diese zustande kommen. Regulierte Branchen benötigen jedoch die Interpretierbarkeit der Modelle, um die Compliance-Anforderungen zu erfüllen. Geschäftsverantwortliche brauchen Erklärungen, um den Empfehlungen vertrauen zu können.

Moderne Plattformen beinhalten Werkzeuge zur Erklärbarkeit. SHAP-Werte (SHapley Additive exPlanations) quantifizieren den Beitrag jeder Variablen zu den einzelnen Vorhersagen. Partielle Abhängigkeitsdiagramme zeigen, wie sich die Änderung einer Variablen auf die Ergebnisse auswirkt. Rangfolgen der Merkmalswichtigkeit identifizieren die wichtigsten Datenpunkte.

Diese Interpretierbarkeitsfunktionen schließen die Lücke zwischen statistischer Genauigkeit und praktischer Anwendung im Unternehmen. Wenn Marketingteams verstehen, warum ein Modell bestimmte Leads als prioritär einstuft, vertrauen sie dem System genug, um den Empfehlungen zu folgen.

Bereitstellungs- und Überwachungsinfrastruktur

Die Erstellung präziser Modelle ist die halbe Miete. Erst die Implementierung in Produktionssystemen, wo sie einen geschäftlichen Mehrwert generieren, vervollständigt das Bild. Unternehmensplattformen umfassen die entsprechende Infrastruktur – REST-APIs, Batch-Scoring-Engines und eingebettete Modellbereitstellung.

Die Überwachung nach der Bereitstellung verfolgt die Modellleistung im Zeitverlauf. Die Vorhersagegenauigkeit verschlechtert sich häufig mit veränderten realen Bedingungen. Überwachungs-Dashboards alarmieren die Teams, wenn die Modellleistung unter bestimmte Schwellenwerte fällt, und lösen so erneute Trainingsprozesse aus.

Auch die Versionskontrolle von Modellen ist wichtig. Produktionssysteme benötigen Rollback-Funktionen, falls neue Modellversionen nicht die erwartete Leistung erbringen. Die besten Plattformen behandeln Modelle als versionierte Artefakte mit vollständiger Herkunftsnachverfolgung.

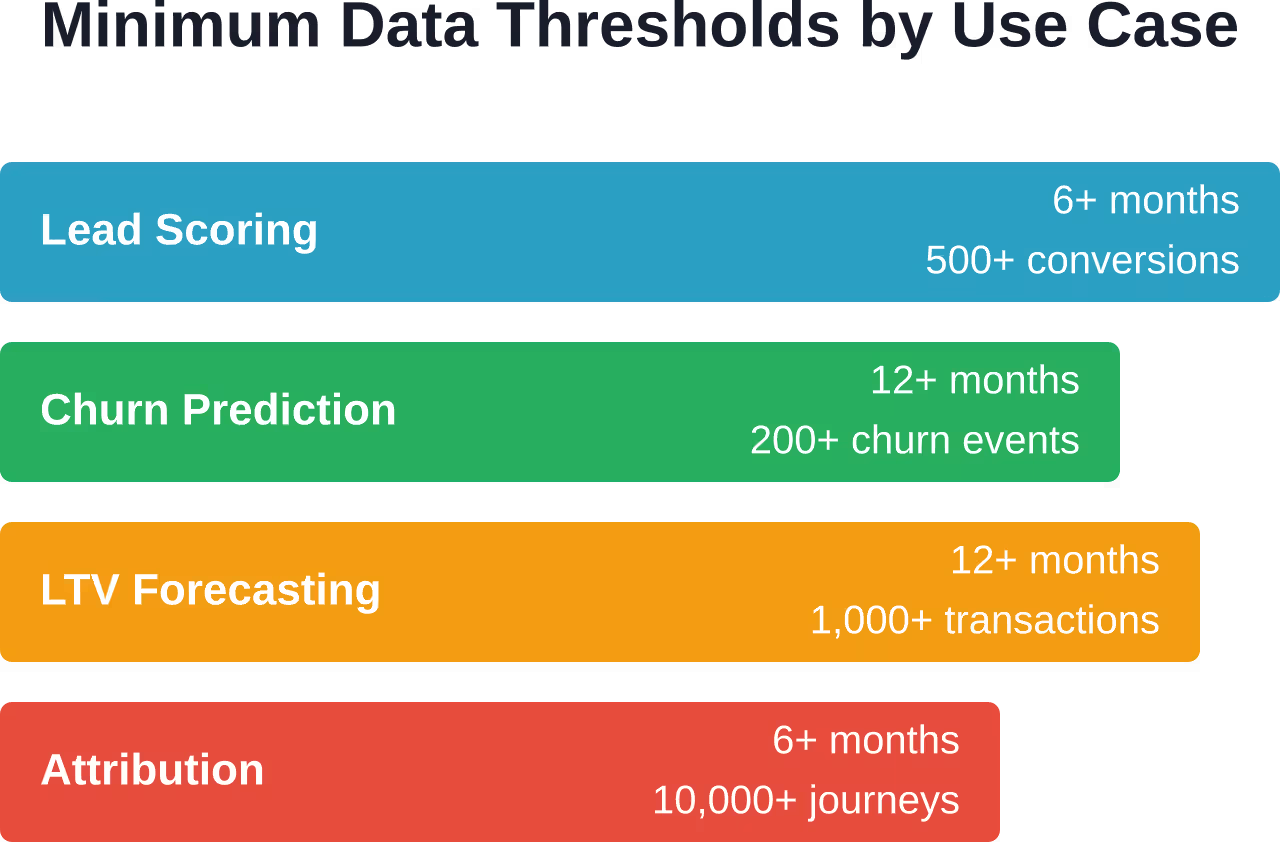

Minimale Datenanforderungen für prädiktive Analysen

Hier scheitern Implementierungen häufig: Unzureichendes Datenvolumen oder mangelhafte Datenqualität verhindern, dass Modelle aussagekräftige Muster lernen. Unterschiedliche Vorhersagetypen erfordern unterschiedliche Datenschwellenwerte.

Wenn Vorhersagen Konversionswahrscheinlichkeiten beinhalten, benötigt das Modell Hunderte – idealerweise Tausende – vergangener Konversionen aus verschiedenen Kontexten. Mindestschwellenwerte je nach Vorhersagetyp:

- Führung: Mehr als 6 Monate Lead-Historie, über 500 Konversionen

- Abwanderungsprognose: Mehr als 12 Monate Kundenlebenszyklusdaten, mehr als 200 Abwanderungsereignisse

- LTV-Prognose: Umsatzdaten der letzten 12 Monate, mehr als 1.000 Transaktionen

- Attributionsmodellierung: Mehr als 6 Monate Daten aus verschiedenen Kanälen, über 10.000 Nutzerreisen

Dies sind Mindestwerte. Mehr Daten verbessern im Allgemeinen die Modellgenauigkeit, jedoch nimmt der Nutzen ab einem bestimmten Datenvolumen ab. Die Datenqualität ist ebenso wichtig wie die Datenmenge – fehlende Werte, inkonsistente Formate und falsche Bezeichnungen beeinträchtigen die Modellleistung unabhängig vom Datenvolumen.

Organisationen unterhalb dieser Schwellenwerte sollten mit einfacheren analytischen Ansätzen (deskriptive Analytik, grundlegende Segmentierung) beginnen und gleichzeitig eine Dateninfrastruktur für zukünftige Vorhersagefähigkeiten aufbauen.

Die besten Predictive-Analytics-Plattformen für verschiedene Anwendungsfälle

Die Auswahl des richtigen Tools hängt von den technischen Möglichkeiten, den Anforderungen des Anwendungsfalls und dem Reifegrad der Organisation ab. Diese Plattformen zählen zu den führenden Anbietern in verschiedenen Kategorien.

Für Marketingteams: Improvado

Improvado kombiniert die Integration einheitlicher Marketingdaten mit KI-gestützter prädiktiver Analytik. Die Plattform verbindet sich mit führenden Werbeplattformen, CRM-Systemen und Analysetools und zentralisiert Daten, die üblicherweise über Dutzende von Quellen verstreut sind.

Der KI-Agent ermöglicht Vorhersagen in natürlicher Sprache – Marketinganalysten können abfragen, welche Kampagnen im nächsten Quartal die meisten Conversions generieren werden, ohne SQL oder Python schreiben zu müssen. Die Einrichtung dauert in der Regel zwei Wochen und positioniert ihn damit als sofort einsatzbereite Lösung für Marketingabteilungen ohne eigene Data-Science-Teams.

Improvado eignet sich für Unternehmen, die Wert auf marketingspezifische Prognosen legen: Kampagnen-Performance-Prognosen, Customer-Lifetime-Value-Modellierung und Attributionsoptimierung. Es ersetzt keine allgemeinen Data-Science-Plattformen, zeichnet sich aber im Bereich Marketinganalysen durch seine Stärken aus.

Für visuelle Analysen: Tableau

Tableaus Stärke liegt in der Kombination von Prognosefunktionen mit erstklassiger Datenvisualisierung. Geschäftsanwender können Prognosen über Drag-and-Drop-Oberflächen erstellen, während Data Scientists benutzerdefinierte R- und Python-Modelle integrieren.

Die Plattform unterstützt komplexe Berechnungen und umfassende Zeitreihenanalysen zur Untersuchung von Saisonalität und Trends. Daten, Visualisierungen und Dashboards lassen sich in Drittanbieter-Tools integrieren und erweitern so die prädiktiven Erkenntnisse im gesamten Unternehmen.

Tableau eignet sich für Teams, die Prognosen auch Nicht-Technikern verständlich machen müssen. Die Visualisierungsebene macht Prognosen für Führungskräfte zugänglich und umsetzbar, die keine Rohdaten des Modells interpretieren möchten.

Für Enterprise AutoML: DataRobot

DataRobot automatisiert den gesamten Machine-Learning-Prozess – von der Merkmalsentwicklung über die Modellbereitstellung bis hin zum Monitoring. Die Plattform testet Hunderte von Algorithmuskonfigurationen, ordnet sie nach ihrer Leistung und erklärt das Modellverhalten mithilfe integrierter Interpretationswerkzeuge.

Funktionen für die Unternehmensführung umfassen Prüfprotokolle, rollenbasierte Zugriffskontrollen und die Erkennung von Verzerrungen. Modelle werden über REST-APIs oder Batch-Scoring-Engines bereitgestellt. Die automatisierte Überwachung erkennt Leistungseinbußen und löst Nachschulungsprozesse aus.

DataRobot eignet sich für große Unternehmen mit vielfältigen Anwendungsfällen im Bereich der prädiktiven Datenanalyse, aber begrenztem Personal im Bereich Data Science. Finanzdienstleister, Gesundheitsunternehmen und Fertigungsbetriebe nutzen es für Risikomodellierung, Betrugserkennung und vorausschauende Wartung.

Für Cloud-native Workflows: AWS SageMaker

Amazon SageMaker bietet eine verwaltete Infrastruktur zum Erstellen, Trainieren und Bereitstellen von Machine-Learning-Modellen in großem Umfang. Der Dienst integriert sich in AWS Data Lakes, ermöglicht verteiltes Training auf GPU-Clustern und stellt Modelle mit automatischer Skalierung bereit.

Integrierte Algorithmen decken gängige Anwendungsfälle ab, während die Unterstützung benutzerdefinierter Modelle spezielle Anforderungen erfüllt. SageMaker Studio-Notebooks ermöglichen die kollaborative Entwicklung. Der Modellmonitor überwacht Datenabweichungen und die Vorhersagequalität im Produktivbetrieb.

Organisationen, die bereits in AWS-Infrastruktur investiert haben, profitieren von einer nahtlosen Integration. In S3 gespeicherte Daten fließen direkt in die Trainingspipelines. Bereitgestellte Modelle rufen andere AWS-Dienste ohne komplexe Netzwerkkonfiguration auf.

Für Open-Source-Flexibilität: H2O.ai

H2O.ai bietet sowohl Open-Source- als auch kommerzielle Plattformen für prädiktive Analysen an. Das Open-Source-Framework H2O läuft auf Laptops oder verteilten Clustern und unterstützt gängige Algorithmen über Schnittstellen zu R und Python.

Driverless AI, das kommerzielle Produkt, automatisiert Feature Engineering, Modellauswahl und Hyperparameter-Optimierung und gewährleistet gleichzeitig die Interpretierbarkeit durch automatische Dokumentation. Die Plattform generiert Erklärungen, die für regulatorische Prüfungen im Bank- und Gesundheitswesen geeignet sind.

H2O.ai eignet sich für Organisationen, die Wert auf die Flexibilität von Open-Source-Software legen und gleichzeitig Enterprise-Support für den Produktiveinsatz benötigen. Der hybride Ansatz ermöglicht es, mit kostenlosen Tools zu experimentieren, bevor man sich für kommerzielle Lizenzen entscheidet.

Für statistische Analysen: IBM SPSS

IBM SPSS ist weiterhin führend in der akademischen Forschung, im Gesundheitswesen und im öffentlichen Sektor, wo klassische statistische Verfahren und die Einhaltung gesetzlicher Vorschriften von größter Bedeutung sind. Die intuitive Benutzeroberfläche ermöglicht es auch Forschern ohne Programmierkenntnisse, anspruchsvolle Analysen durchzuführen.

Die Plattform umfasst Regressionsmodellierung, Überlebenszeitanalyse, Faktorenanalyse und Versuchsplanung. Dokumentation und Validierung erfüllen die FDA-Anforderungen für klinische Studien. Die Integration mit der umfassenderen Analysesuite von IBM unterstützt unternehmensweite Implementierungen.

SPSS eignet sich für Organisationen, in denen statistische Genauigkeit und Dokumentation wichtiger sind als modernste Machine-Learning-Funktionen. Es ist weniger flexibel als Python oder R, aber für Nicht-Programmierer leichter zugänglich.

| Plattform | Am besten geeignet für | Hauptstärke | Typische Benutzer |

|---|---|---|---|

| Improvisiert | Marketinganalysen | Vereinheitlichte Daten + KI-Agent | Marketinganalysten |

| Tableau | Visuelle Kommunikation | Vorhersage + Visualisierung | Wirtschaftsanalysten |

| DataRobot | Enterprise AutoML | Vollständige Automatisierung + Governance | Analysten und Datenwissenschaftler |

| AWS SageMaker | Cloud-natives ML | AWS-Integration + Skalierung | Dateningenieure und Wissenschaftler |

| H2O.ai | Open-Source + kommerziell | Flexibilität + Erklärbarkeit | Data-Science-Teams |

| IBM SPSS | Statistische Strenge | Einhaltung gesetzlicher Vorschriften | Forscher und Analysten |

Anwendungen für prädiktive Analysen in der Praxis

Das Verständnis dafür, wie Organisationen diese Instrumente einsetzen, verdeutlicht ihren praktischen Wert, der über die theoretischen Möglichkeiten hinausgeht.

Gesundheitswesen: Risikostratifizierung von Patienten

Gesundheitsorganisationen nutzen prädiktive Analysen, um Patienten mit hohem Risiko für eine erneute Krankenhauseinweisung oder einen Besuch in der Notaufnahme zu identifizieren. Durch den Einsatz prädiktiver Analysen konnten Gesundheitsorganisationen die Anzahl der Krankenhauseinweisungen und Notaufnahmen mithilfe von Risikostratifizierungsansätzen deutlich reduzieren.

Die Modelle integrieren elektronische Patientenakten, Daten zur Medikamenteneinnahme, soziale Determinanten der Gesundheit und historische Nutzungsmuster. Ärzte erhalten Risikobewertungen, die als Grundlage für Behandlungsplanungsentscheidungen dienen – beispielsweise für die Zuteilung von Hausbesuchen, die Koordination von Facharztterminen oder die Anpassung von Medikamentenplänen vor dem Auftreten akuter Krankheitsphasen.

E-Commerce: Prognose des Kundenlebenszeitwerts

E-Commerce-Logistikplattformen, die AWS-Analysetools nutzen, konnten durch prädiktive Kundensegmentierung den Kundenwert steigern. Marketingteams nutzen diese Prognosen, um die Ausgaben für die Kundengewinnung zu optimieren. Kunden mit hohem prognostiziertem Kundenwert erhalten attraktivere Angebote zur Kundenbindung und personalisierte Erlebnisse. Dieser Ansatz verlagert das Budget von breit angelegten Kampagnen hin zu gezielten Maßnahmen mit dem höchsten ROI.

Medien: Inhaltsempfehlung und Zielgruppenwachstum

Medienunternehmen berichten von deutlichen Verbesserungen bei der Kundengewinnung durch prädiktive Zielgruppenmodellierung. Empfehlungssysteme für Inhalte nutzen ähnliche Techniken – Netflix und Spotify prognostizieren anhand von kollaborativem Filtern und Inhaltsattributen, welche Filme oder Songs einzelnen Nutzern gefallen könnten. Diese Prognosen wirken sich direkt auf die Nutzerbindung und das Nutzerengagement aus.

Finanzdienstleistungen: Betrugserkennung

Kreditkartenunternehmen setzen Echtzeit-Vorhersagemodelle ein, die jede Transaktion hinsichtlich ihres Betrugsrisikos bewerten. Die Systeme analysieren Transaktionsbetrag, Händlerkategorie, geografischen Standort, Tageszeit und historische Muster, um verdächtige Aktivitäten innerhalb von Millisekunden zu erkennen.

Diese Modelle wägen Genauigkeit und Fehlalarmrate ab. Das Blockieren legitimer Transaktionen verärgert Kunden, während übersehene Betrugsversuche Kosten verursachen. Ensemble-Methoden, die mehrere Algorithmen kombinieren, erreichen die für den Produktiveinsatz erforderliche Präzision.

Datenpannen verursachen erhebliche Kosten für Unternehmen, weshalb Systeme zur vorausschauenden Betrugserkennung wertvolle Investitionen darstellen.

Fertigung: Vorausschauende Instandhaltung

Industrielle Betriebe nutzen Sensordaten und maschinelles Lernen, um Geräteausfälle vorherzusagen, bevor sie auftreten. IEEE-Forschungsergebnisse demonstrieren erklärbare KI-Frameworks für die vorausschauende Zustandsüberwachung von Werkzeugen in der Hochgeschwindigkeitsbearbeitung, die Vorhersagegenauigkeit mit Verständlichkeit für Wartungstechniker kombinieren.

Diese Systeme analysieren Schwingungsmuster, Temperaturmesswerte, akustische Signale und Nutzungsprotokolle, um den Ausfall von Komponenten vorherzusagen. Wartungspläne werden von festen Intervallen auf zustandsorientierte Wartung umgestellt, wodurch Ausfallzeiten reduziert und die Lebensdauer der Anlagen verlängert wird.

Auswahl des richtigen Tools für prädiktive Analysen

Der Markt für prädiktive Analysen bietet sowohl branchenübergreifende Standardlösungen als auch branchenspezifische Tools für spezielle Anwendungsfälle. Eine falsche Wahl verschwendet Zeit und Budget und verzögert die Wertschöpfung.

Beurteilen Sie die Reife Ihrer Daten

Organisationen lassen sich in verschiedene Reifegrade ihrer Datendaten einteilen. Unternehmen in der Frühphase verfügen nicht über ausreichend historische Daten für anspruchsvolle Modellierungen. Unternehmen in der mittleren Phase besitzen zwar Daten, benötigen aber Verbesserungen beim Datenzugriff. Fortgeschrittene Organisationen optimieren die Modellleistung und die Bereitstellungsinfrastruktur.

Die Komplexität der Tools sollte dem aktuellen Reifegrad entsprechen. Teams ohne Data-Science-Expertise sollten nicht mit AWS SageMaker beginnen – die Lernkurve verzögert die Ergebnisse. Business-Analysten, die mit etablierten Datensätzen arbeiten, erzielen mit AutoML-Plattformen oder BI-Tools mit prädiktiven Funktionen schnellere Erfolge.

Spezifische Anwendungsfälle definieren

Allgemeine Initiativen wie “Wir brauchen prädiktive Analysen” scheitern häufiger als zielgerichtete Projekte. Definieren Sie konkrete Anwendungsfälle: Reduzieren Sie die Kundenabwanderung um 151.300, verbessern Sie die Genauigkeit des Lead-Scorings um 201.300 oder optimieren Sie die Lagerbestände, um die Lagerkosten jährlich um 1.450.000 zu senken.

Spezifische Ziele verdeutlichen die Anforderungen an das Tool. Die Abwanderungsprognose erfordert Klassifizierungsalgorithmen und die Integration von Kundenlebenszyklusdaten. Die Bestandsoptimierung erfordert Zeitreihenprognosen und die Anbindung an das Lieferkettensystem. Unterschiedliche Anwendungsfälle begünstigen unterschiedliche Plattformen.

Technische Anforderungen bewerten

Unterstützt die Plattform Ihre Datenquellen? Lässt sie sich in Ihrer bevorzugten Umgebung (Cloud, On-Premises, Hybrid) bereitstellen? Lässt sie sich in bestehende BI-Dashboards und operative Systeme integrieren?

Die technische Kompatibilität bestimmt die Implementierungskomplexität. Eine leistungsstarke Plattform, die umfangreiche individuelle Integrationsarbeiten erfordert, bietet möglicherweise weniger Nutzen als ein etwas weniger ausgefeiltes Tool mit sofort einsatzbereiten Konnektoren für Ihren spezifischen Technologie-Stack.

Teamfähigkeiten berücksichtigen

AutoML-Plattformen ermöglichen es Business-Analysten, Modelle ohne Programmierung zu erstellen. Statistische Tools wie SPSS eignen sich für Forscher, die mit traditionellen Methoden vertraut sind. Python und R erfordern zwar Data-Science-Kenntnisse, bieten aber maximale Flexibilität.

Eine ehrliche Einschätzung der Teamkompetenzen beugt Fehlbesetzungen bei den Tools vor. Alternativ kann die Toolauswahl als Grundlage für Einstellungsentscheidungen dienen: Erfordert die Geschäftsstrategie fortgeschrittene Modellierung, sollte man neben der Infrastruktur auch in Data-Science-Fachkräfte investieren.

Berücksichtigung der Gesamtbetriebskosten

Die Abonnementpreise decken nur einen Teil der Gesamtkosten ab. Implementierungsleistungen, Schulungen, Datenaufbereitung und laufende Wartung verursachen erhebliche Mehrkosten zusätzlich zu den angegebenen Softwaregebühren.

Beim Skalieren können versteckte Kosten entstehen. Manche Plattformen berechnen die Kosten pro Vorhersage, wodurch nutzungsabhängige Ausgaben entstehen, die mit zunehmender Verbreitung stark ansteigen. Andere erfordern eine teure Infrastruktur für die lokale Bereitstellung. Bei Cloud-Diensten fallen zudem Gebühren für Rechenleistung und Speicherplatz an. Berechnen Sie daher realistische Gesamtbetriebskosten für drei Jahre, bevor Sie sich festlegen.

Bewährte Implementierungsmethoden

Die Anschaffung einer Plattform für prädiktive Analysen ist erst der Anfang, nicht das Ende des Prozesses. Erfolgreiche Implementierungen folgen einheitlichen Mustern.

Beginnen Sie mit einem Pilotprojekt

Unternehmensweite Implementierungen scheitern oft, wenn die Komplexität die Teams überfordert. Identifizieren Sie stattdessen einen einzelnen, wertvollen Anwendungsfall mit klaren Erfolgskennzahlen und überschaubarem Umfang.

Ein dreimonatiges Pilotprojekt erprobt die Technologie, stärkt das Vertrauen im Unternehmen und deckt Integrationsherausforderungen vor der vollständigen Implementierung auf. Wählen Sie Anwendungsfälle, in denen die Vorhersagegenauigkeit messbare Geschäftsergebnisse direkt beeinflusst – beispielsweise Kundenabwanderung, Lead-Konversionsraten oder Lagerumschlag.

Etablierung einer Daten-Governance

Prädiktive Modelle übernehmen die Qualitätsprobleme ihrer Trainingsdaten. Legen Sie daher Richtlinien für die Datenverwaltung fest, bevor die Modellentwicklung beginnt. Definieren Sie Dateneigentum, Qualitätsstandards, Aufbewahrungsrichtlinien und Zugriffskontrollen.

Datenkataloge dokumentieren verfügbare Datensätze, deren Schemata, Aktualisierungsfrequenzen und bekannte Qualitätsprobleme. Diese Dokumentation beschleunigt die Modellentwicklung, indem sie Datenwissenschaftlern hilft, relevante Trainingsdaten schnell zu finden.

Funktionsübergreifende Teams bilden

Effektive prädiktive Analysen erfordern die Zusammenarbeit von Fachexperten, Data Scientists und IT-Betriebsteams. Fachexperten verstehen den Geschäftskontext und interpretieren die Modellergebnisse. Data Scientists entwickeln und validieren Modelle. IT-Teams kümmern sich um die Bereitstellung und Überwachung der Infrastruktur.

Isolierte Implementierungen scheitern, weil die Modelle die Geschäftsrealität nicht widerspiegeln oder sich nicht in operative Systeme integrieren lassen. Bereichsübergreifende Teams verhindern diese Diskrepanzen.

Plan für das Modelllebenszyklusmanagement

Modelle verlieren mit der Zeit an Aussagekraft, da sich die realen Bedingungen ändern. Das Kundenverhalten ändert sich. Das Produktangebot entwickelt sich weiter. Wettbewerber passen ihre Strategien an. Ein im letzten Jahr noch erfolgreiches Abwanderungsmodell kann heute unterdurchschnittlich abschneiden.

Es sollten Prozesse etabliert werden, um die Modellleistung zu überwachen, mit neuen Daten nachzutrainieren und aktualisierte Versionen bereitzustellen. Automatisierungstools übernehmen das routinemäßige Nachtrainieren, aber die menschliche Überprüfung verhindert, dass automatisierte Systeme anomale Muster lernen und verstärken.

Priorisieren Sie die Erklärbarkeit des Modells.

Stakeholder reagieren nicht auf Prognosen, die sie nicht verstehen. Selbst wenn ein Black-Box-Modell eine Genauigkeit von 95% erreicht, ignorieren Vertriebsteams Lead-Scores ohne Erklärungen. Führungskräfte lehnen Empfehlungen ohne klare Begründung ab.

Investieren Sie in Tools zur Erklärbarkeit, die Modellinterna in eine verständliche Geschäftssprache übersetzen. Aussagen wie “Dieser Lead hat eine hohe Punktzahl erreicht, weil er dreimal die Preisseiten besucht hat, in einem Unternehmen der Zielgröße arbeitet und unserem besten Kundensegment entspricht” motivieren besser zum Handeln als “Das Modell prognostiziert eine Konversionswahrscheinlichkeit von 0,87”.”

Erhalten Sie auf Ihre Daten und Anwendungsfälle zugeschnittene Vorhersagemodelle.

Predictive-Analytics-Tools erfordern oft, dass Sie Ihre Daten an deren Struktur anpassen. Wenn Daten aus mehreren Quellen stammen oder keinem Standardformat folgen, sind die integrierten Modelle nicht mehr brauchbar. AI Superior Wir entwickeln maßgeschneiderte KI-Software mit prädiktiver Analytik und erstellen Modelle, die die tatsächliche Datenerfassung und -nutzung abbilden. So können Sie Prognosen, Betrugserkennung und Ausfallvorhersagen durchführen, ohne durch vordefinierte Tool-Logik eingeschränkt zu sein.

Verwandeln Sie Ihre Daten in funktionierende Vorhersagemodelle

AI Superior bietet:

- Vorhersagemodelle, die auf Ihren eigenen Daten basieren, nicht auf generischen Vorlagen.

- KI-Software, die für Ihre spezifischen Vorhersageaufgaben entwickelt wurde

- Ein System, das Daten aus mehreren Quellen kombiniert

Kontaktieren Sie AI Superior um zu besprechen, wie prädiktive Analysen in Ihrer Umgebung implementiert werden können.

Häufige Fehler und wie man sie vermeidet

Organisationen verschwenden Ressourcen für Initiativen zur prädiktiven Analytik, die nur minimalen Nutzen bringen. Diese Muster wiederholen sich bei gescheiterten Implementierungen.

Unzureichende Trainingsdaten

Selbst die ausgefeiltesten Algorithmen können aus unzureichenden Daten keine Muster erkennen. Teams erzwingen mitunter Prognoseprojekte, bevor genügend historische Daten vorliegen.

Seien Sie ehrlich hinsichtlich der Datenverfügbarkeit. Benötigt die Abwanderungsprognose mehr als 200 historische Abwanderungsereignisse, liegen aber nur 50 vor, verschieben Sie das Projekt, um die Dateninfrastruktur aufzubauen. Nutzen Sie die Zwischenzeit für deskriptive Analysen, die aktuelle Muster dokumentieren.

Überbetonung der Genauigkeit

Das Streben nach einer nur geringfügig höheren Modellgenauigkeit bietet oft weniger Nutzen für das Unternehmen als die schnelle Implementierung eines ausreichend guten Modells. Der Genauigkeitsunterschied zwischen 82% und 85% rechtfertigt selten sechs zusätzliche Entwicklungsmonate.

Definieren Sie akzeptable Genauigkeitsschwellenwerte basierend auf den Geschäftsauswirkungen. Implementieren Sie Modelle, die diese Schwellenwerte erfüllen, und optimieren Sie diese anschließend anhand der Produktionsleistung. Die praktische Anwendung deckt häufig Verbesserungen auf, die bei Offline-Tests nicht sichtbar sind.

Vernachlässigung der letzten Meile

Die Erstellung präziser Modelle stellt die halbe Miete dar. Die Integration von Prognosen in operative Arbeitsabläufe, wo sie Entscheidungen beeinflussen, vervollständigt die Wertschöpfungskette.

Wenn Lead-Scores nicht in das CRM-System der Vertriebsmitarbeiter einfließen, ändern sie kein Verhalten. Wenn Abwanderungsprognosen keine Kundenbindungsmaßnahmen auslösen, wird die Abwanderung nicht reduziert. Planen Sie Implementierung und Integration von Projektbeginn an, nicht erst im Nachhinein.

Änderungsmanagement ignorieren

Die technische Umsetzung gelingt häufiger als die organisatorische Akzeptanz. Vertriebsteams, die an intuitive Entscheidungen gewöhnt sind, sträuben sich gegen algorithmisches Lead-Scoring. Marketingmanager hinterfragen Attributionsmodelle, die ihrer Intuition widersprechen.

Binden Sie Stakeholder frühzeitig ein. Zeigen Sie schnelle Erfolge auf, die Vertrauen schaffen. Erklären Sie die Ergebnisse so, dass die Nutzer die Prognosen verstehen und ihnen vertrauen können. Das Change-Management entscheidet darüber, ob prädiktive Analysen nur theoretischen Nutzen bringen oder tatsächlich einen geschäftlichen Einfluss haben.

Die Zukunft von Predictive-Analytics-Tools

Die Landschaft der prädiktiven Analytik entwickelt sich ständig weiter. Mehrere Trends prägen die Richtung, in die sich die Tools entwickeln.

Erhöhte Automatisierung und Zugänglichkeit

Die AutoML-Funktionen erweitern sich jährlich und senken so die technischen Hürden für prädiktive Modellierung. Schnittstellen in natürlicher Sprache ermöglichen es Business-Analysten, Fragen in einfachem Englisch zu stellen, anstatt Code oder SQL zu schreiben.

Diese Demokratisierung erweitert die Vorhersagefähigkeiten über spezialisierte Data-Science-Teams hinaus. Fachexperten entwickeln ihre eigenen Modelle, wodurch die Erkenntnisgewinnung beschleunigt und Data Scientists für komplexe Herausforderungen freigestellt werden, die individuelle Lösungsansätze erfordern.

Echtzeit- und Streaming-Vorhersagen

Mit verbesserter Infrastruktur weichen Batch-Vorhersagen der Echtzeitbewertung. Betrugserkennungssysteme bewerten Transaktionen bereits in Millisekunden. Personalisierungs-Engines liefern individuelle Inhaltsempfehlungen in Echtzeit, während Nutzer Webseiten besuchen.

Streaming-Datenplattformen und eine latenzarme Infrastruktur zur Bereitstellung von Modellen ermöglichen die kontinuierliche Aktualisierung von Vorhersagen. Die Risikobewertungen der Kunden werden aktualisiert, sobald neue Verhaltenssignale eintreffen, anstatt jede Nacht neu berechnet zu werden.

Erklärbare KI-Schwerpunkt

Regulatorischer Druck und Geschäftsanforderungen treiben die Nachfrage nach interpretierbaren Modellen an. Die europäische Datenschutz-Grundverordnung (DSGVO) begründet das Recht auf Erläuterung automatisierter Entscheidungen. Das Modellrisikomanagement im Bankwesen erfordert eine dokumentierte Modelllogik.

Parallel zur Komplexität der Modelle entwickeln sich auch die Techniken zur Erklärbarkeit weiter. Forscher entwickeln Methoden, die die Vorhersagegenauigkeit erhalten und gleichzeitig Transparenz hinsichtlich der Entscheidungslogik ermöglichen. Dieses Gleichgewicht wird zu einem entscheidenden Wettbewerbsvorteil, da Unternehmen zunehmend wegen ihrer algorithmischen Entscheidungen unter die Lupe genommen werden.

Integration mehrerer Datentypen

Frühe Vorhersagemodelle nutzten strukturierte Daten – Kundendemografie, Transaktionsdaten, Verhaltensprotokolle. Moderne Plattformen integrieren zunehmend unstrukturierte Daten wie Text, Bilder und Videos.

Die Verarbeitung natürlicher Sprache extrahiert Signale aus Kundendienstprotokollen und Social-Media-Beiträgen. Computer Vision analysiert Produktbilder und Herstellungsfehler. Multimodale Modelle kombinieren strukturierte und unstrukturierte Eingaben für präzisere Vorhersagen.

Häufig gestellte Fragen

Worin besteht der Unterschied zwischen prädiktiven Analysetools und Business-Intelligence-Plattformen?

Business-Intelligence-Plattformen konzentrieren sich auf deskriptive Analysen – sie berichten über Ereignisse und deren Ursachen mithilfe von Dashboards, Visualisierungen und historischen Analysen. Predictive-Analytics-Tools prognostizieren zukünftige Entwicklungen mithilfe statistischer Modelle und Algorithmen des maschinellen Lernens. Viele moderne BI-Plattformen bieten mittlerweile grundlegende Prognosefunktionen, spezialisierte Predictive-Analytics-Plattformen hingegen bieten komplexere Modellierungstechniken und automatisierte Arbeitsabläufe.

Benötige ich Datenwissenschaftler, um prädiktive Analysetools einzusetzen?

Es kommt auf die Plattform und den Anwendungsfall an. AutoML-Tools wie DataRobot und branchenspezifische Plattformen ermöglichen es Business-Analysten, Modelle ohne Programmierkenntnisse zu erstellen. Diese Plattformen automatisieren die Algorithmenauswahl und das Feature Engineering. Für kundenspezifische Modelle, fortgeschrittene Techniken oder neuartige Anwendungsfälle bleiben Data-Science-Kenntnisse jedoch unerlässlich. Unternehmen beginnen oft mit leicht zugänglichen Tools und ergänzen ihr technisches Know-how, sobald die Anforderungen komplexer werden.

Wie viele Daten benötige ich, bevor ich mit prädiktiver Analytik beginne?

Die Mindestanforderungen variieren je nach Anwendungsfall. Lead-Scoring benötigt typischerweise mindestens sechs Monate Datenhistorie und über 500 Conversions. Die Abwanderungsprognose erfordert mindestens zwölf Monate Kundenlebenszyklusdaten und über 200 Abwanderungsereignisse. Einfachere Prognosen kommen mit weniger Daten aus, während komplexe Modelle mehr Daten benötigen. Qualität ist ebenso wichtig wie Quantität – saubere, konsistente Daten mit relevanten Variablen liefern bessere Ergebnisse als große Mengen minderwertiger Datensätze.

Welche Branchen profitieren am meisten von prädiktiver Analytik?

Nahezu jede Branche nutzt prädiktive Analysen, wenngleich die Anwendungsfälle variieren. Finanzdienstleister setzen sie zur Betrugserkennung, Bonitätsbewertung und zum Risikomanagement ein. Organisationen im Gesundheitswesen prognostizieren Behandlungsergebnisse und das Risiko von Wiedereinweisungen. Einzelhändler prognostizieren die Nachfrage und optimieren die Preisgestaltung. Die Fertigungsindustrie nutzt sie für die vorausschauende Wartung. Marketingteams branchenübergreifend verwenden sie zur Prognose des Kundenwerts und zur Kampagnenoptimierung. Der gemeinsame Nenner sind Entscheidungen, bei denen die Prognose zukünftiger Ergebnisse Wettbewerbsvorteile schafft.

Wie genau sind prädiktive Analysemodelle?

Die Genauigkeit variiert stark in Abhängigkeit von Datenqualität, Problemkomplexität und Modellierungsansatz. Einfache Prognosen erreichen eine Genauigkeit von 70–801 TP³T, während ausgefeilte Ensemble-Methoden auf Basis sauberer Daten über 901 TP³T erreichen. Perfekte Genauigkeit ist jedoch weder erreichbar noch notwendig – Modelle, die die Entscheidungsfindung im Vergleich zur Intuition verbessern, sind wertvoll. Die Leistung in der Praxis weicht oft von der Genauigkeit in Tests ab; daher stellt die kontinuierliche Überwachung sicher, dass die Modelle auch unter veränderten Bedingungen effektiv bleiben.

Kann prädiktive Analytik auch mit kleinen Datensätzen funktionieren?

Kleine Datensätze schränken die Modellierungsoptionen und die Genauigkeit ein. Techniken wie Regularisierung verhindern Überanpassung bei wenigen Trainingsdaten. Transferlernen wendet Muster, die aus großen Datensätzen gelernt wurden, auf kleinere, domänenspezifische Probleme an. Allerdings erfordert statistische Signifikanz Mindeststichprobengrößen – die Vorhersage seltener Ereignisse anhand von 20 historischen Beispielen liefert keine zuverlässigen Prognosen. Organisationen mit begrenzten Daten sollten mit einfacheren Analysemethoden beginnen und gleichzeitig die Dateninfrastruktur für zukünftige Vorhersagefähigkeiten aufbauen.

Wie sieht der typische ROI-Zeitrahmen für die Implementierung von Predictive Analytics aus?

Pilotprojekte zeigen oft innerhalb von 3–6 Monaten ihren Wert, wenn die Anwendungsfälle klare Kennzahlen und ausreichende Daten aufweisen. Unternehmensweite Implementierungen dauern 12–18 Monate, da Organisationen die Infrastruktur aufbauen, Governance-Strukturen etablieren und Prognosen in die operativen Arbeitsabläufe integrieren. Der ROI hängt vom jeweiligen Anwendungsfall ab: Kundenabwanderungsreduzierung und Betrugsprävention führen schnell zu messbaren finanziellen Ergebnissen, während strategische Prognosen langfristige Vorteile bieten. Organisationen, die mit fokussierten Pilotprojekten beginnen und schrittweise expandieren, erzielen schnellere Renditen als diejenigen, die sofort umfassende Transformationen anstreben.

Schlussfolgerung

Predictive-Analytics-Tools verändern die Entscheidungsfindung in Unternehmen grundlegend, indem sie Intuition durch datengestützte Prognosen ersetzen. Die Technologiepalette reicht von zugänglichen AutoML-Plattformen, die die Modellierung für alle zugänglich machen, bis hin zu hochentwickelten Programmierumgebungen, die Data Scientists maximale Flexibilität bieten.

Erfolgreiche Implementierungen gleichen die Leistungsfähigkeit der Tools mit der Reife des Unternehmens, den Kompetenzen des Teams und den spezifischen Anwendungsfällen ab. Junge Unternehmen profitieren von schlüsselfertigen Lösungen mit minimalen technischen Anforderungen. Fortgeschrittene Datenteams nutzen maßgeschneiderte Modellierungsumgebungen für spezialisierte Anwendungen.

Der Schlüssel zum Erfolg liegt in einem fokussierten Start: Identifizieren Sie einen einzelnen, wertvollen Anwendungsfall, stellen Sie die Datenverfügbarkeit sicher, wählen Sie die passenden Tools aus und demonstrieren Sie den Nutzen, bevor Sie expandieren. Unternehmen, die diesen Ansatz verfolgen, erzielen messbare Geschäftsergebnisse: geringere Kundenabwanderung, höhere Konversionsraten, optimierte Lagerbestände und weniger Betrugsverluste.

Die Ergebnisse aus der Praxis bestätigen die Investition. Gesundheitsdienstleister konnten Krankenhausaufenthalte durch prädiktive Analysen deutlich reduzieren. E-Commerce-Plattformen steigerten den Kundenwert mithilfe prädiktiver Ansätze. Medienunternehmen konnten ihre Kundengewinnung durch prädiktive Zielgruppenmodellierung erheblich steigern. Diese Ergebnisse sind erreichbar, wenn die richtigen Tools auf ausreichend Daten und klare Geschäftsziele treffen.

Die Landschaft der prädiktiven Analytik wird sich stetig weiterentwickeln. Automatisierung erweitert den Zugang. Echtzeitfunktionen ermöglichen sofortige Entscheidungen. Erklärbarkeitstechniken schaffen Vertrauen in algorithmische Empfehlungen. Unternehmen, die jetzt in prädiktive Fähigkeiten investieren, sichern sich Wettbewerbsvorteile, die sich mit zunehmender Datenmenge und verbesserten Modellen verstärken.

Bereit für die Implementierung von Predictive Analytics? Beginnen Sie mit der Prüfung vorhandener Daten, der Definition messbarer Ziele und der Auswahl eines Pilotprojekts, bei dem Prognosen einen klaren Mehrwert für Ihr Unternehmen bieten. Die Tools sind vorhanden – erfolgreiche Ergebnisse hängen von einer durchdachten, an die Gegebenheiten Ihres Unternehmens angepassten Implementierung ab.