Kijk, ik snap het. Je hebt OpenClaw overal voorbij zien komen en je bent geïntrigeerd door het idee van een 24/7 AI-assistent die daadwerkelijk dingen op je computer kan doen. Maar dan zie je mensen praten over het uitgeven van honderden dollars aan API-tegoeden, en plotseling slaat die opwinding om in angst voor de kosten.

Maar er is iets belangrijks om te weten: OpenClaw is gelicentieerd onder de MIT-licentie en volledig open source. Volgens de officiële openclaw/openclaw GitHub-repository met meer dan 100.000 sterren kan deze AI-assistent op "elk besturingssysteem en elk platform" draaien. En ja, dat betekent ook dat je hem gratis kunt gebruiken.

De echte vraag is niet of je OpenClaw gratis kunt gebruiken. Het gaat erom hoe je het configureert om die torenhoge API-kosten te vermijden waar iedereen in communitydiscussies over klaagt.

Het kostenprobleem begrijpen

Voordat we naar de oplossingen kijken, laten we het eerst hebben over waarom mensen überhaupt geld uitgeven. OpenClaw is in feite een AI-agent die verbinding maakt met berichtenplatforms zoals Slack, WhatsApp of Telegram en taken namens jou uitvoert. Maar er is een addertje onder het gras: het heeft een taalmodel nodig om te functioneren.

De meeste tutorials verwijzen je naar Claude, GPT-4 of andere commerciële API's. En die zijn niet goedkoop. Een gebruiker vroeg in een GitHub-discussie uit februari 2026 naar de "beste betaalbare LLM van dit moment", waarmee hij benadrukte dat dit een groot probleem is voor de OpenClaw-community.

Maar je hebt drie legitieme manieren om kosteloos te werken:

- Volledig lokale modellen uitvoeren op uw eigen hardware.

- Gebruikmaken van gratis GPU-bronnen in de cloud

- Strategisch gebruikmaken van gratis API-niveaus

Laten we elke aanpak eens nader bekijken.

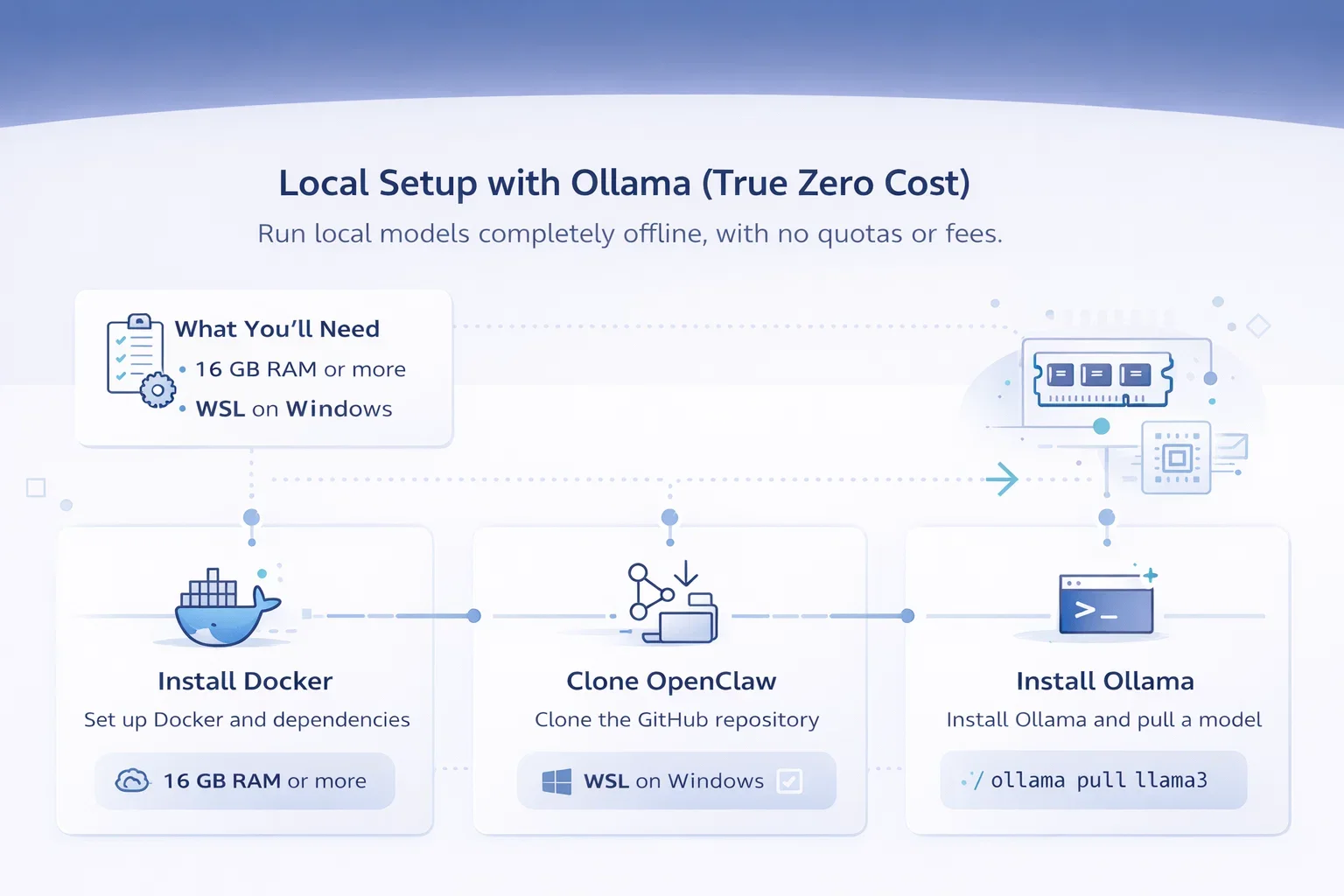

Methode 1: Lokale installatie met Ollama (volledig kosteloos)

Dit is mijn persoonlijke favoriet, omdat je na configuratie volledig onafhankelijk bent. Geen quota's, geen snelheidslimieten, geen onverwachte rekeningen. Volgens de handleiding "Running OpenClaw Without Burning Money, Quotas, or Your Sanity" van digitalknk, die 92 sterren kreeg op GitHub, zijn lokale modellen de meest duurzame oplossing op de lange termijn.

Wat je nodig hebt

Eerlijk gezegd: je hebt geen gaming-pc met meerdere GPU's nodig. Een degelijke computer met 16 GB RAM kan kleinere modellen prima aan. Een gebruiker op Reddit meldde dat hij OpenClaw succesvol draaide op een Intel NUC met 16 GB, hoewel hij wel wat initiële configuratieproblemen ondervond.

Windows-gebruikers hebben WSL (Windows Subsystem for Linux) nodig. Mac- en Linux-gebruikers kunnen deze stap overslaan.

Stapsgewijze installatie

Docker en de bijbehorende afhankelijkheden installeren

OpenClaw draait in Docker-containers voor consistentie op verschillende platformen. Als je Windows gebruikt, installeer dan Docker Desktop en schakel WSL2-integratie in. De op Flutter gebaseerde app van Mithun_Gowda_B laat je de OpenClaw AI Gateway rechtstreeks op je telefoon gebruiken zonder root-toegang en met een installatie die met één tik te voltooien is.

Kloon OpenClaw

Ga naar de officiële openclaw/openclaw GitHub-repository en kloon deze naar je lokale machine. Het installatieproces is eenvoudig, maar zoals een Reddit-gebruiker opmerkte: "Zo makkelijk is het niet, haha. Bij installatie op een VPS is het probleem localhost en moet je het IP-adres koppelen."“

Houd hier rekening mee als u toegang op afstand plant.

Installeer Ollama

Ollama is jouw lokale modelrunner. Download het van ollama.ai en installeer het volgens de instructies van je besturingssysteem. Kies vervolgens een model dat bij je hardware past:

- Voor 8 GB RAM: probeer llama3.2 of mistral.

- Voor 16 GB RAM: Llama3 8B werkt uitstekend.

- Voor 32 GB RAM of meer: je kunt llama3 70B of mixtral gebruiken.

Het commando ziet er als volgt uit: ollama pull llama3

OpenClaw-verbinding configureren

Nu moet je OpenClaw laten verwijzen naar je lokale Ollama-instantie in plaats van naar een cloud-API. Bewerk je OpenClaw-configuratiebestand om het lokale eindpunt te gebruiken (meestal http://localhost:11434 voor Ollama).

Dit is waar de meeste beginners de mist in gaan. Zoals vermeld in een GitHub-discussie, is het correct binden aan localhost belangrijk als je dit op een VPS uitvoert of toegang op afstand wilt.

Prestatieverwachtingen

Kijk, lokale modellen kunnen niet tippen aan de redeneerkracht van GPT-4 of de programmeervaardigheden van Claude. Maar ze zijn verrassend capabel voor alledaagse taken. En dit is wat telt: je kunt ze 24/7 laten draaien zonder je zorgen te maken over tokenaantallen of snelheidslimieten.

Een communitylid vertelde: "Ik heb een systeem dat me letterlijk 1 TP4T0 per maand kost, 24/7 online is en praktisch onbeperkte tokens heeft."“

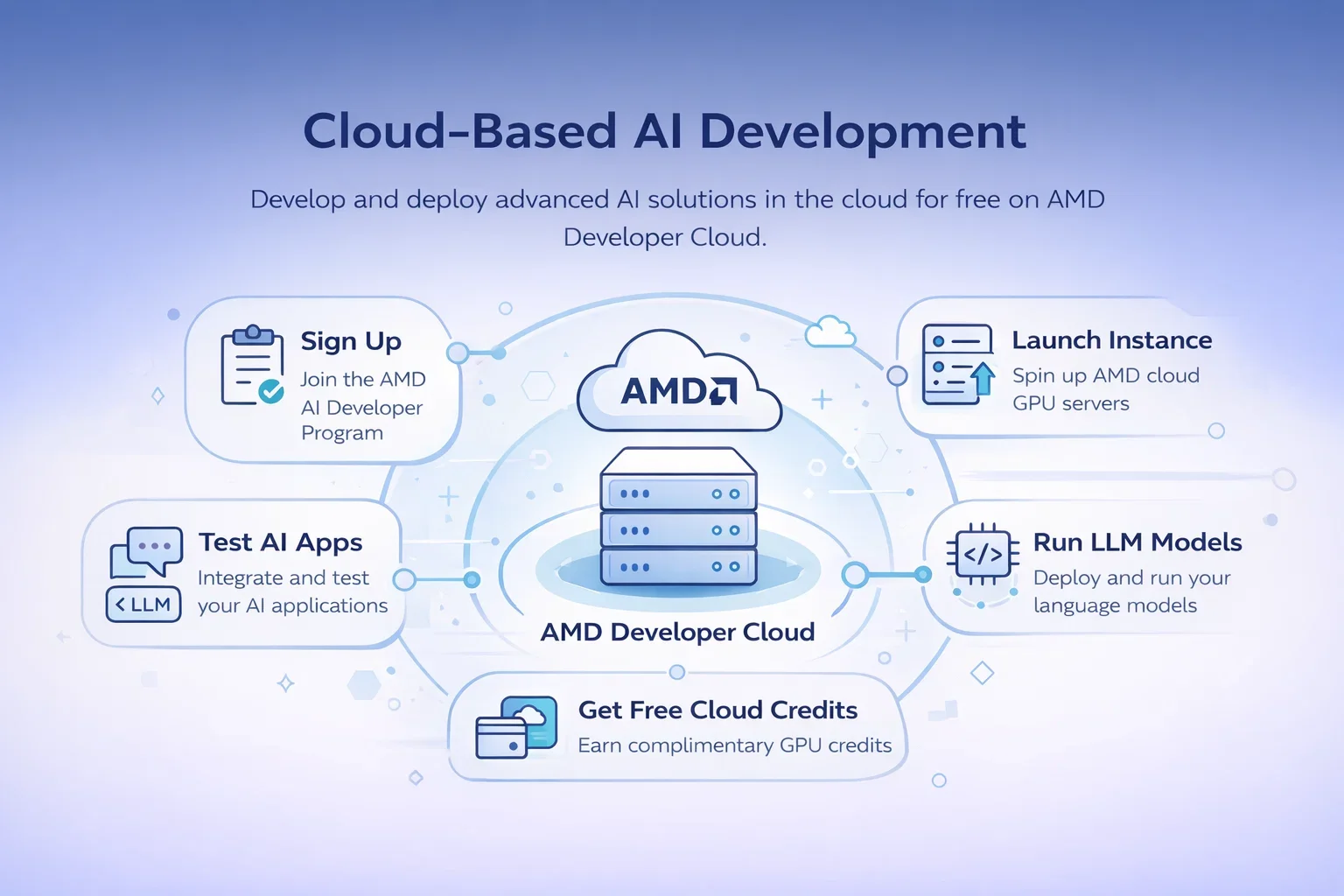

Methode 2: AMD Developer Cloud (beste gratis cloudoptie)

En nu wordt het interessant. Volgens diverse GitHub-handleidingen over "OpenClaw met vLLM gratis beschikbaar op AMD Developer Cloud" kun je via het AMD AI Developer Program kosteloos toegang krijgen tot hardware van enterprise-kwaliteit.

We hebben het hier over AMD Instinct MI300X GPU's met 192 GB geheugen. Dat is genoeg om games te draaien die normaal gesproken duizenden dollars aan consumenten-GPU's zouden kosten.

Toegang krijgen tot AMD Developer Cloud

Meld je aan voor het AMD AI Developer Program. Ze bieden gratis cloudtegoed aan, speciaal voor ontwikkelaars die AI-workloads testen. Een handleiding uit februari 2026 laat zien hoe je OpenClaw kosteloos op deze infrastructuur kunt implementeren.“

Maar wacht even, er is een addertje onder het gras. Dit zijn promotiecredits, geen permanente gratis versie. Als je OpenClaw echter alleen maar test of gebruikt voor persoonlijke projecten, zouden de credits een tijdje mee moeten gaan.

vLLM uitvoeren op AMD Cloud

vLLM is een geoptimaliseerde inferentieserver waarmee u grote taalmodellen efficiënt kunt uitvoeren. Het installatieproces omvat:

- Start een AMD-cloudinstantie op.

- Installeer vLLM en het model van uw keuze.

- Configureer OpenClaw zodat deze naar uw vLLM-eindpunt verwijst.

- Verbind uw berichtenplatformen.

Volgens de secure-openclaw repository van ComposioHQ (1,5k sterren) kun je OpenClaw integreren met WhatsApp, Telegram, Signal of iMessage voor een complete persoonlijke assistent-ervaring.

Methode 3: GitHub Codespaces-strategie

GitHub biedt gratis rekenuren aan via Codespaces: 60 uur per maand op hun gratis tier. In een creatieve installatiehandleiding werd gesproken over "OpenClaw implementeren in minder dan 5 minuten op de gratis AWS-tier", maar GitHub Codespaces biedt een eenvoudiger alternatief.

60 uur is natuurlijk geen 24/7-gebruik. Maar als je je AI-assistent voornamelijk tijdens werktijd gebruikt, is dit verrassend lang genoeg. Zet hem uit als je slaapt of in het weekend, en je hebt een prima gratis oplossing.

De hybride aanpak

Dit is wat ervaren gebruikers doen: ze voeren lichte taken lokaal uit met Ollama, maar voor complexere codeer- of redeneertaken laten ze OpenClaw een gratis API aanroepen.

OpenRouter, dat in Reddit-discussies ter sprake komt, biedt gratis credits die maandelijks worden gereset. Een gebruiker merkte op: "OpenRouter kost meer dan €10 voor 1000 verzoeken per dag met de gratis templates." Die €10 is credit, geen kosten – gebruik het verstandig en je blijft gratis.

Beveiligingsaspecten die u niet kunt negeren

Eerlijk gezegd: OpenClaw heeft volledige toegang tot de computer. Dat is krachtig, maar ook potentieel gevaarlijk als het verkeerd geconfigureerd wordt.

Een veelbeluisterde Reddit-thread, specifiek gericht op "Handleiding voor beveiligingsversterking", waarschuwde: "Aangezien ik zie dat zoveel nieuwe mensen Clawdbot installeren, raad ik ten zeerste aan om het te beschermen tegen prompt-injectieaanvallen."“

Er bestaan detectiescripts (zoals knostic/openclaw-detect met 56 sterren) specifiek voor "MDM-implementatie om OpenClaw-installaties op beheerde apparaten te identificeren". Dat geeft aan dat organisaties zich zorgen maken over de beveiligingsrisico's.

Essentiële beveiligingsmaatregelen

| Beveiligingsmaatregel | Waarom het belangrijk is | Hoe implementeer je dit? |

| Sleutelmanagement | OpenClaw heeft API-sleutels en inloggegevens nodig. | Gebruik 1Password of een vergelijkbare dienst met een aparte kluis. |

| Netwerkbinding | Voorkomt externe toegang tot uw instantie. | Maak alleen verbinding met localhost, tenzij VPN is geconfigureerd. |

| Firewallregels | Beperkt waartoe OpenClaw toegang heeft. | Gebruik ufw of Tailscale voor veilige toegang op afstand. |

| Snelle injectiebescherming | Voorkomt dat kwaadwillige commando's van externe bronnen worden verzonden. | Configureer invoervalidatie en opdrachtbeperkingen. |

Zoals een gebruiker die waarde hecht aan beveiliging het volgende vertelde: "Ik gebruik 1Password voor mijn sleutelbeheer. De enige sleutel die OpenClaw heeft, is de sleutel waarmee ik toegang krijg tot 1Password via een speciale kluis en een serviceaccount."“

Dat is slimme architectuur.

Veelvoorkomende installatieproblemen en oplossingen

Op basis van discussies binnen de community en de geweldige OpenClaw-resourcecompilatie (221 sterren op GitHub) zijn dit de problemen waar nieuwkomers tegenaan lopen:

“"Het is geïnstalleerd, maar voert niets uit."”

Een gefrustreerde Reddit-gebruiker zei: "Ik heb Clawdbot 5 keer geprobeerd te installeren op mijn Intel NUC met 16 GB RAM en Ubuntu, maar het is geen enkele keer gelukt. Ik kan er wel mee communiceren, maar het kan NIETS bouwen."“

Meestal duidt dit op problemen met de machtigingen of een onjuiste verbinding met het model. Controleer uw configuratiebestand en zorg ervoor dat OpenClaw uw LLM-eindpunt daadwerkelijk kan bereiken.

Verwarring over de locatie van WSL-bestanden

Windows-gebruikers kunnen hun OpenClaw-bestanden vaak niet vinden. Zoals een behulpzame reageerder opmerkte: "De bestanden voor devices/pending.json werden gevonden in \\wsl$\Ubuntu\home\user\.openclaw\devices — bij mij bevinden ze zich in het Linux-subsysteem."“

De verwarring rond "gratis"

Veel zogenaamde "gratis" handleidingen vereisen nog steeds betaalde diensten. Een sceptische gebruiker merkte dit op: "Dus... een bot die $0 kost... zolang je maar een abonnement hebt op Google AI Pro en GitHub Copilot? Hoe kan dat dan $0 zijn?"“

Goed punt. Echt gratis betekent helemaal geen abonnementen, alleen lokale modellen of echt gratis cloudcredits.

Platformvergelijking: wat werkt er nu echt?

| Platform | Echte gratis laag | Maandelijkse uptime | Prestatie | Het beste voor |

| Lokale Ollama | Ja (alleen de hardwarekosten) | 24/7 | Geschikt voor alledaagse taken | Gebruikers die waarde hechten aan privacy |

| AMD Developer Cloud | Credits (beperkte tijd) | 24/7 zolang het tegoed strekt | Uitstekend geschikt voor grote modellen. | Testen en ontwikkeling |

| GitHub Codespaces | 60 uur per maand | Deeltijd | Dat hangt af van de gekozen modelkeuze. | Gebruik van werkuren |

| OpenRouter gratis tier | Maandelijkse credits worden gereset | Totdat het tegoed op is | Verschilt per model. | Hybride benaderingen |

Praktische toepassingen die niet veel geld kosten

Volgens discussies in de openclaw-blog repository gebruiken mensen gratis OpenClaw-installaties voor:

- Automatisering van codebeoordeling: laat je commits controleren voordat je ze pusht.

- Berichtsamenvatting: Samenvatting van Slack-kanalen of e-mailconversaties

- Geplande herinneringen: De secure-openclaw fork vermeldt deze functie specifiek.

- Onderzoeksondersteuning: informatie verzamelen en samenvattingen maken.

- Taakautomatisering: Bestandsorganisatie, gegevensverwerking, rapportgeneratie

De sleutel is het kiezen van taken die aansluiten bij de mogelijkheden van je model. Verwacht niet dat een lokaal 7B-model code van productiekwaliteit kan schrijven, maar het kan absoluut helpen bij het genereren van standaardteksten of documentatie.

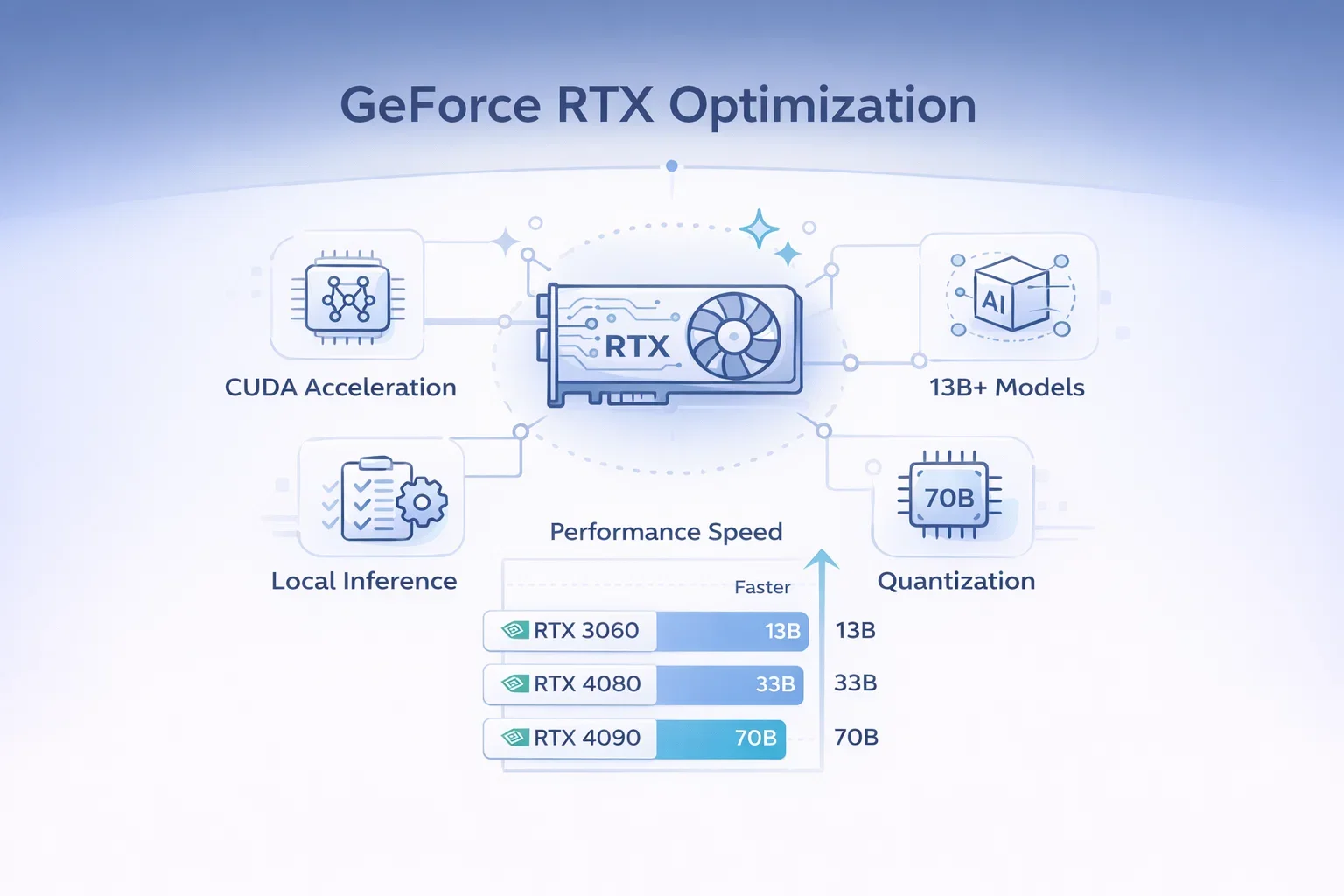

GeForce RTX-optimalisatie

Een populaire handleiding beschrijft hoe je "OpenClaw gratis kunt uitvoeren op een GeForce RTX" met optimalisatie voor lokale inferentie. Als je een NVIDIA GPU hebt, kun je CUDA-acceleratie gebruiken voor aanzienlijk snellere lokale inferentie.

Een RTX 3060 of hoger wordt aanbevolen voor comfortabele prestaties met 13B-modellen. Een RTX 4090 kan 70B-modellen met quantisatie aan.

[AFBEELDING: Grafiek met prestatievergelijking die de inferentiesnelheden van verschillende GPU's weergeeft]

Alternatieve projecten die het overwegen waard zijn

Het OpenClaw-ecosysteem heeft verschillende alternatieven voortgebracht. Volgens het document "moltbot-vs-openclaw-complete-comparison" is Moltbot in wezen een hernoemde fork met een andere merknaam. ClawdBot was de oorspronkelijke naam voordat het werd omgedoopt tot OpenClaw.

Secure-OpenClaw van ComposioHQ (258 forks, 1500 sterren) richt zich specifiek op de integratie van berichtenplatformen met "permanente opslag, geplande herinneringen en integraties met meer dan 500 apps".“

Voor ultrabudgetvriendelijke setups is er een Reddit-thread met de titel "Running OpenClaw / ClawdBot / MoltBot on a Budget (or for Free)" die verschillende goedkope methoden verzamelt die voor leden van de community hebben gewerkt.

Conclusie: Is gratis echt de moeite waard?

Na het bestuderen van tientallen installatiehandleidingen en discussies in de community, is dit mijn eerlijke mening: Ja, je kunt OpenClaw absoluut gratis gebruiken in 2026. Maar er is een afweging tussen kosten en gebruiksgemak.

Lokale modellen met Ollama bieden je echte onafhankelijkheid en geen maandelijkse kosten, maar je levert wel wat prestaties in ten opzichte van front-end modellen. AMD Developer Cloud-credits bieden uitstekende prestaties zolang ze beschikbaar zijn, maar zijn geen permanente oplossing. Gratis API-niveaus werken totdat je je quota overschrijdt.

De ideale aanpak? Begin met een lokale Ollama-server voor routinetaken en zet vervolgens strategisch gratis cloudresources in voor veeleisende workloads. Zoals een ervaren gebruiker in een gedetailleerde Reddit-handleiding opmerkte: "De sleutel is het benutten van gratis tiers en deze vervolgens goed beheren."“

En kijk eens: zelfs als je uiteindelijk besluit te betalen voor API-toegang, zorgt het begrijpen van deze gratis methoden ervoor dat je die betaalde resources efficiënter gebruikt. Je weet dan precies wanneer je cloudcapaciteit nodig hebt en wanneer een lokale verbinding volstaat.

De openclaw/openclaw-repository wordt actief verder ontwikkeld door de community met meer dan 200.000 sterren. Er verschijnen regelmatig nieuwe optimalisatiehandleidingen, beveiligingsverbeteringen en installatietools. Tegen de tijd dat u dit leest, is de installatie wellicht nog eenvoudiger.

Klaar om je eigen 24/7 AI-assistent te bouwen zonder maandelijkse kosten? Begin met de lokale Ollama-installatie, experimenteer met wat werkt voor jouw hardware en sluit je aan bij de geweldige OpenClaw-community om te leren van anderen die hetzelfde doen.

Je persoonlijke AI-assistent staat voor je klaar – en het kost je geen cent.

Veelgestelde vragen

Is OpenClaw echt helemaal gratis?

Ja, de software zelf is gelicentieerd onder de MIT-licentie en is gratis. Om deze te gebruiken, heb je echter eigen hardware (lokale installatie) of cloudresources nodig. Je kunt volledig gratis opties gebruiken, zoals Ollama lokaal, AMD Developer Cloud-tegoeden of de gratis tier van GitHub Codespaces, om maandelijkse kosten te vermijden.

Kan ik OpenClaw op een Raspberry Pi draaien?

Technisch gezien wel, zoals besproken in communitygidsen over "OpenClaw op Raspberry Pi: een lokaal AI-automatiseringssysteem bouwen met LM Studio". De prestaties zullen echter beperkt zijn. Een Raspberry Pi 4 met 8 GB RAM kan zeer kleine modellen uitvoeren, maar verwacht trage reactietijden. Het is meer een hobbyproject dan een praktische oplossing.

Wat zijn de minimale hardwarevereisten voor een lokale installatie?

Voor basisfunctionaliteit volstaat 8 GB RAM en een moderne CPU. Voor comfortabel gebruik is minimaal 16 GB RAM nodig. Met een GPU met 8 GB of meer VRAM behaal je aanzienlijk betere prestaties. Veel gebruikers draaien OpenClaw met succes op Intel NUC's of Mac Mini's.

Hoe kan ik veiligheidsrisico's vermijden?

Volgens discussies over beveiliging binnen de OpenClaw-community zijn de belangrijkste stappen: het gebruik van speciale inloggegevenskluizen (zoals 1Password), verbinding maken met localhost tenzij een VPN wordt gebruikt, firewallregels implementeren en beveiliging bieden tegen promptinjectieaanvallen. Geef OpenClaw nooit rechtstreeks toegang tot gevoelige inloggegevens.

Waarom vermelden sommige handleidingen betaalde diensten als OpenClaw gratis is?

OpenClaw zelf is gratis, maar heeft een taalmodel nodig om te functioneren. Veel tutorials gebruiken standaard commerciële API's zoals Claude of GPT-4 omdat die gemakkelijker te configureren zijn. Je kunt echter ook gewoon gratis lokale modellen of gratis cloudbronnen gebruiken – dat vereist alleen wat meer configuratiewerk.

Wat is het verschil tussen ClawdBot, Moltbot en OpenClaw?

Het zijn in wezen dezelfde projecten met verschillende namen. ClawdBot was de oorspronkelijke naam, die vervolgens Moltbot werd en nu OpenClaw heet. De kernfunctionaliteit blijft hetzelfde: het is een AI-agent met volledige computertoegang die op je eigen infrastructuur draait.

Kan ik OpenClaw gratis gebruiken voor commerciële doeleinden?

De MIT-licentie staat commercieel gebruik van de OpenClaw-software zelf toe. Controleer echter altijd de licentie van het taalmodel dat u gebruikt. De meeste open-source modellen staan commercieel gebruik toe, maar sommige (zoals Llama) hebben beperkingen op basis van het aantal gebruikers. Controleer daarom altijd de specifieke licentie van het model.