Korte samenvatting: Platformen voor kostenanalyse van kunstmatige intelligentie bieden organisaties realtime inzicht in hun AI-uitgaven. Ze volgen alles, van tokengebruik en kosten voor modeltraining tot GPU-verbruik bij verschillende cloudproviders. Deze gespecialiseerde tools combineren gedetailleerde kostenanalyse, geautomatiseerde detectie van afwijkingen en voorspellende prognoses om bedrijven te helpen hun AI-budgetten te optimaliseren en kostenoverschrijdingen te voorkomen.

AI-toepassingen kunnen budgetten sneller uitputten dan de meeste financiële teams beseffen. Zonder goed toezicht lopen de kosten uit de hand: GPU-uren stapelen zich op, API-aanroepen vermenigvuldigen zich en modeltraining duurt langer dan verwacht.

Traditionele methoden voor kostenbeheer in de cloud schieten tekort bij AI-workloads. Ze kunnen het tokengebruik niet bijhouden, de uitgaven niet toewijzen aan teams en bieden niet de gedetailleerde inzichten die nodig zijn om de kosten voor modeltraining te optimaliseren.

Dat is waar kostenanalyseplatforms voor kunstmatige intelligentie (AI) van pas komen. Deze gespecialiseerde tools veranderen de manier waarop organisaties hun AI-uitgaven begrijpen en beheren, en bieden inzicht dat een paar jaar geleden nog niet mogelijk was.

Wat is een AI-kostenanalyseplatform?

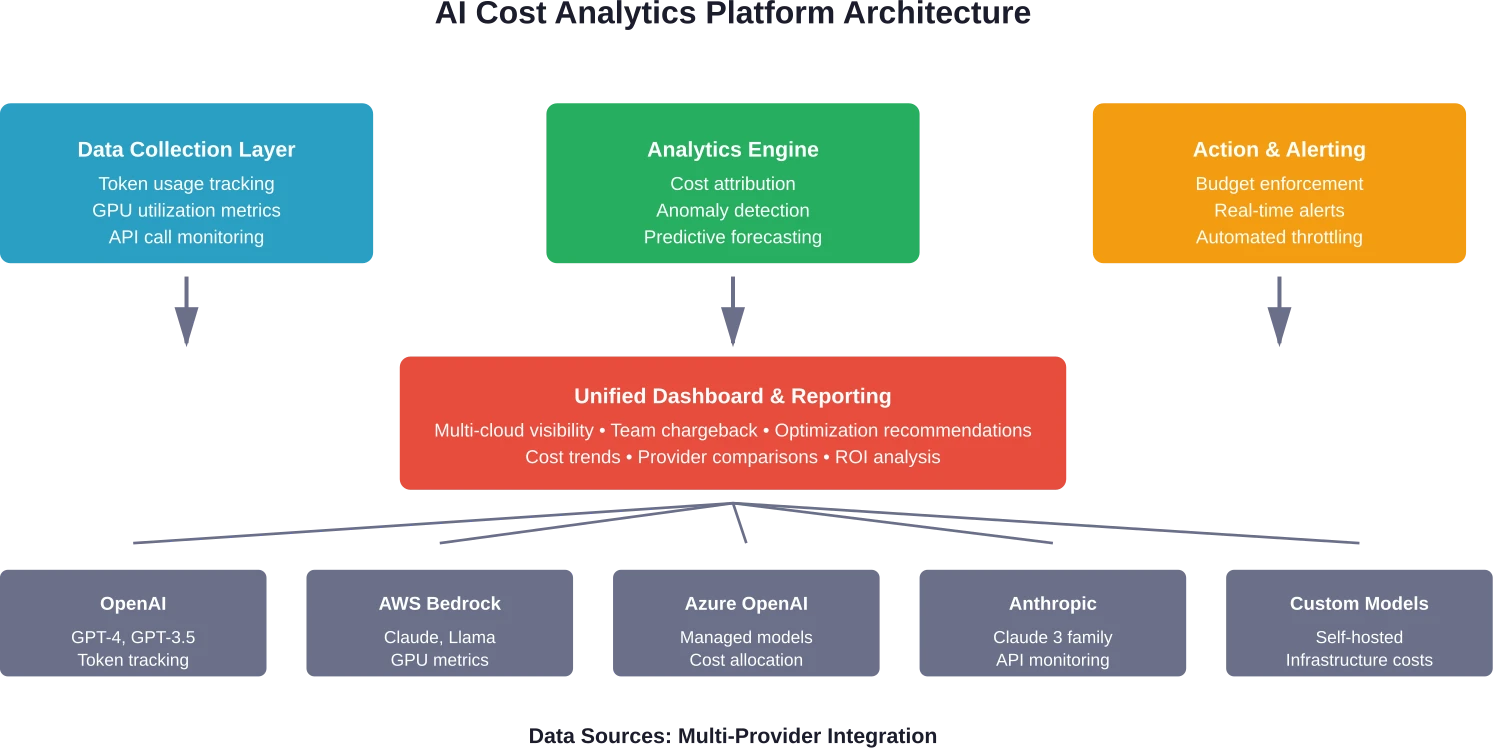

Een AI-kostenanalyseplatform is speciaal ontwikkelde software die de uitgaven voor AI-workloads bijhoudt, analyseert en optimaliseert. In tegenstelling tot generieke cloudkostentools begrijpen deze platforms de unieke economische aspecten van AI-operaties.

Ze monitoren specifieke kostenfactoren voor AI: tokenverbruik in taalmodellen, GPU-gebruik tijdens training, inferentieverzoeken van verschillende providers en de rekenkracht die aan diverse modellen wordt toegewezen. Het platform verzamelt deze gegevens en vertaalt ze naar bruikbare inzichten.

Zie het als financiële transparantie voor AI-infrastructuur. Elke uitgegeven dollar wordt toegewezen aan een specifiek team, project, model of agent. Kostenafwijkingen worden direct gesignaleerd. Budgetdrempels activeren waarschuwingen voordat er overschrijdingen optreden.

De waardepropositie is eenvoudig. AI-toepassingen vergen veel resources en zonder goede monitoring verspillen organisaties aanzienlijk geld aan inefficiënte configuraties, overgedimensioneerde resources en slecht geoptimaliseerde modellen.

Waarom traditioneel kostenbeheer tekortschiet ten opzichte van AI

Tools voor cloudkostenbeheer zijn niet ontworpen voor AI-workloads. Ze houden virtuele machines en opslagbuckets prima bij, maar AI-bewerkingen brengen complexiteiten met zich mee die deze systemen niet aankunnen.

Tokengebaseerde prijsstelling van aanbieders zoals OpenAI of Anthropic Claude past niet netjes in traditionele factureringscategorieën. Hoe verdelen organisaties kosten wanneer een enkele API-aanroep verschillende modellen met uiteenlopende prijspunten kan gebruiken?

Het GPU-gebruik vormt een andere uitdaging. Traditionele tools laten zien dat GPU's actief zijn, maar ze onthullen niet of die resources efficiënt worden gebruikt. Een model kan kostbare GPU-uren verbruiken terwijl het minimale resultaten oplevert – en standaard monitoring detecteert die discrepantie niet.

De kosten voor het trainen van modellen fluctueren enorm op basis van parameters die generieke tools niet bijhouden. Batchgrootte, aanpassingen van de leerfrequentie en hyperparameteroptimalisatie hebben allemaal invloed op de kosten, maar deze variabelen blijven onzichtbaar zonder AI-specifieke analyses.

AI-implementaties in meerdere clouds verergeren deze problemen. Organisaties gebruiken mogelijk AWS Bedrock voor sommige modellen, Azure OpenAI voor andere en hebben directe API-toegang tot meerdere providers. Uniforme zichtbaarheid over al deze platforms vereist gespecialiseerde infrastructuur.

Kernfunctionaliteiten van moderne AI-platformen voor kostenanalyse

De beste platforms beschikken over een aantal essentiële mogelijkheden die hen onderscheiden van eenvoudige monitoringtools. Deze functies spelen in op de specifieke uitdagingen van het beheren van AI-uitgaven.

Gedetailleerde kostenallocatie op elk niveau

Gedetailleerde kostentoewijzing houdt bij waar elke dollar naartoe gaat. Platforms splitsen de kosten uit per team, project, model, individuele medewerker of zelfs specifieke API-eindpunten.

Deze transparantie maakt chargeback-modellen mogelijk waarbij businessunits betalen voor hun daadwerkelijke AI-gebruik. Financiële teams kunnen eindelijk vragen beantwoorden zoals: "Hoeveel kostte de chatbot voor klantenservice het afgelopen kwartaal?" of "Welk onderzoeksteam is verantwoordelijk voor onze GPU-uitgaven?"“

Attributie kan worden uitgebreid naar individuele sessies of gesprekken. Organisaties kunnen de exacte kosten van een enkele klantinteractie berekenen, waardoor het mogelijk wordt om de winstgevendheid op een gedetailleerd niveau te optimaliseren.

Realtime tracking en anomaliedetectie

Realtime monitoring detecteert kostenstijgingen zodra ze zich voordoen, en niet pas dagen later wanneer de rekening binnenkomt. Platforms volgen continu het tokengebruik, modelaanroepen en het rekenverbruik.

Geautomatiseerde anomaliedetectie gebruikt basispatronen om ongebruikelijke uitgaven te identificeren. Als een bepaald model plotseling tien keer zoveel tokens verbruikt als normaal, worden er direct waarschuwingen geactiveerd. Teams kunnen onderzoek doen voordat kleine problemen grote kostenposten worden.

Deze mogelijkheid is met name waardevol voor organisaties die meerdere AI-agenten gebruiken of experimenteren met verschillende modellen. Ontwikkelteams laten soms onbedoeld kostbare processen draaien; realtime monitoring spoort deze fouten snel op.

Geautomatiseerde budgetcontrole en -handhaving

Budgetdrempels voorkomen kostenoverschrijdingen voordat ze zich voordoen. Teams stellen bestedingslimieten in op verschillende niveaus: per project, per team, per model of per tijdsperiode.

Wanneer de uitgaven deze limieten naderen, kan het platform geautomatiseerde acties ondernemen. Het kan bijvoorbeeld steeds strengere waarschuwingen versturen, de frequentie van aanvragen beperken of zelfs specifieke taken pauzeren totdat het budget is gereset.

Deze beheersmaatregelen zorgen voor een evenwicht tussen kostenbeheer en operationele behoeften. Teams willen voorkomen dat AI-toepassingen onverwacht uitvallen, maar ze kunnen zich ook geen onbeperkte uitgaven veroorloven. Configureerbare beleidsregels bieden de juiste balans voor elk gebruiksscenario.

Ondersteuning voor meerdere clouds en meerdere providers

Organisaties maken zelden gebruik van één enkele AI-aanbieder. Moderne platforms bundelen de kosten van OpenAI, Anthropic Claude, AWS Bedrock, Azure OpenAI, Google Cloud AI en andere diensten.

Uniforme dashboards bieden één betrouwbare bron voor AI-uitgaven, ongeacht waar de workloads worden uitgevoerd. Teams kunnen kosten van verschillende aanbieders vergelijken en mogelijkheden voor optimalisatie identificeren door workloads naar kosteneffectievere opties te verplaatsen.

Deze mogelijkheid wordt steeds belangrijker naarmate organisaties multi-cloudstrategieën implementeren om vendor lock-in te voorkomen en de sterke punten van verschillende providers te benutten voor specifieke toepassingen.

Voorspellende prognoses en trendanalyse

Historische gegevens vormen de basis voor voorspellende modellen die toekomstige uitgaven voorspellen. Platforms analyseren gebruikspatronen om kosten weken of maanden vooruit te projecteren.

Deze prognoses helpen financiële teams bij het budgetteren en plannen van middelen. Ze kunnen inschatten hoe de schaalvergroting van AI-toepassingen de kosten zal beïnvloeden en weloverwogen beslissingen nemen over capaciteitsuitbreiding.

Trendanalyse laat zien hoe bestedingspatronen in de loop van de tijd veranderen. Organisaties kunnen volgen of optimalisatie-inspanningen werken of dat bepaalde projecten een steeds groter deel van de middelen opslokken.

Economische kaders voor het evalueren van AI-kosten

Om de economische aspecten van AI te begrijpen, is meer nodig dan alleen het bijhouden van uitgaven. Organisaties hebben raamwerken nodig die kosten in een bredere bedrijfscontext plaatsen.

Onderzoek van arXiv introduceerde het concept van de genivelleerde kosten van AI (Levelized Cost of AI, LCOAI), een gestandaardiseerde maatstaf voor het evalueren van de implementatiekosten van AI. Deze aanpak is vergelijkbaar met de manier waarop energiebedrijven de economische aspecten van energieopwekking beoordelen: het berekenen van de totale levenscycluskosten per eenheid nuttige output.

Voor AI-toepassingen kan nuttige output bijvoorbeeld succesvolle klantinteracties, accurate voorspellingen of voltooide taken betekenen. Het raamwerk houdt rekening met infrastructuur, modeltraining, inferentiekosten en operationele overhead, en deelt dit vervolgens door de daadwerkelijke zakelijke waarde die wordt geleverd.

Een ander economisch raamwerk richt zich op de kosten per uitvoeringsstap voor taalmodellen. Deze aanpak evalueert modellen op basis van de kosten die nodig zijn om een succesvol resultaat te behalen, in plaats van alleen de kosten per token of API-aanroep.

Verschillende modellen hebben verschillende nauwkeurigheidspercentages. Een goedkoper model dat meerdere pogingen nodig heeft om acceptabele resultaten te leveren, kan duurder zijn dan een premium model dat in één keer slaagt. Cost-of-Pass-berekeningen houden rekening met deze nuance.

Deze frameworks helpen organisaties betere beslissingen te nemen over modelselectie, leverancierskeuze en optimalisatieprioriteiten. Ze verschuiven de discussie van "Hoeveel geven we uit aan AI?" naar "Wat is ons rendement op investering in AI?".“

Ontwikkel tools voor AI-monitoring en -analyse.

Naarmate AI-systemen op grotere schaal worden ingezet, hebben organisaties inzicht nodig in prestaties, infrastructuurgebruik en operationele kosten.

AI Superieur Ontwikkelt AI-platformen en analysetools die bedrijven helpen bij het monitoren en beheren van AI-workloads.

Typische platformcomponenten zijn onder andere:

- monitoring van modelprestaties

- tracking van infrastructuurgebruik

- operationele analyse-dashboards

- AI-systeembeheertools

Deze systemen helpen organisaties om AI-oplossingen betrouwbaar en op grote schaal te gebruiken.

Belangrijke meetwaarden die worden bijgehouden door AI-kostenanalyseplatforms

Effectieve platforms monitoren tientallen meetwaarden, maar een aantal daarvan springen eruit als essentieel voor het begrijpen van de economische aspecten van AI. Deze metingen vormen de basis voor optimalisatiebeslissingen.

Tokenverbruik en prijsefficiëntie

Bij taalmodellen zijn de kosten grotendeels afhankelijk van het tokengebruik. Platforms registreren het aantal verbruikte tokens per verzoek, per sessie, per gebruiker en per applicatie.

Ze berekenen ook de effectieve tokenprijzen voor verschillende aanbieders en modellen. Dit maakt een eerlijke vergelijking mogelijk, zelfs wanneer aanbieders verschillende prijsstructuren hanteren.

Metingen van de tokenefficiëntie onthullen mogelijkheden voor optimalisatie. Applicaties die gebruikmaken van omslachtige prompts of onnodig lange antwoorden genereren, verspillen geld bij elke interactie.

GPU-gebruik en rekenefficiëntie

Het trainen van aangepaste modellen vereist aanzienlijke GPU-bronnen. Platformen monitoren het GPU-gebruik, de inactieve tijd en de kosten per trainingsuur.

Een lage benutting duidt op een inefficiënte toewijzing van middelen. Organisaties kunnen dure GPU's aanschaffen die lange tijd ongebruikt blijven, of slecht geoptimaliseerde trainingstaken slagen er mogelijk niet in om de beschikbare rekenkracht volledig te benutten.

De kosten per trainingssessie helpen teams te begrijpen of modelverbeteringen hun uitgaven rechtvaardigen. Een nauwkeurigheidswinst van 2% rechtvaardigt mogelijk geen verhoging van de trainingskosten met 50%.

Afweging tussen inferentiekosten en latentie

Inferentie – het uitvoeren van getrainde modellen om voorspellingen te genereren – brengt doorlopende operationele kosten met zich mee. Platformen houden het inferentievolume, de kosten per voorspelling en de relatie tussen latentievereisten en kosten bij.

Snellere inferentie kost doorgaans meer. Organisaties moeten inzicht hebben in de vraag of hun latency-eisen een hogere prijs rechtvaardigen, of dat iets tragere (maar goedkopere) alternatieven aan de behoeften van de gebruiker voldoen.

Batchverwerking is voor veel toepassingen aanzienlijk goedkoper dan realtime voorspellingen. Platformen helpen bij het identificeren van mogelijkheden om workloads te verschuiven van dure realtime API's naar de meer economische batchverwerking.

Vergelijkingscriteria voor zorgaanbieders

Met meerdere AI-aanbieders op de markt hebben organisaties behoefte aan duidelijke vergelijkingen. Platformen vergelijken vergelijkbare workloads van OpenAI, Anthropic, AWS, Azure en andere aanbieders.

Bij deze vergelijkingen wordt rekening gehouden met kwaliteitsverschillen. De goedkoopste optie is niet altijd de beste keuze als deze inferieure resultaten oplevert. Platforms meten de kosten per kwaliteitseenheid in plaats van alleen de prijs.

Volgens een analyse van Artificial Analysis laten de verhoudingen tussen intelligentie en kosten aanzienlijke verschillen zien tussen aanbieders. Modellen met vergelijkbare mogelijkheden kunnen dramatisch verschillende prijzen hebben.

Impact in de praktijk: kostenoptimalisatie in de praktijk

De theorie is minder belangrijk dan de resultaten. Sommige organisaties die AI-platforms voor kostenanalyse implementeren, melden kostenbesparingen.

In discussies binnen de community komen voorbeelden naar voren van productiebedrijven die hun operationele kosten verlaagden door piekuren in het energieverbruik van hun AI-workloads te identificeren. Door trainingstaken in te plannen tijdens daluren, verlaagden ze de GPU-kosten aanzienlijk zonder de prestaties te beïnvloeden.

Ontwikkelteams ontdekken dat veel productieapplicaties te krachtige modellen gebruiken voor eenvoudige taken. Een chatbot voor klantenservice gebruikt bijvoorbeeld GPT-4 voor routinematige vragen die met GPT-3.5 voor een fractie van de kosten afgehandeld zouden kunnen worden. Platformen maken deze inefficiënties zichtbaar.

Anomaliedetectie spoort oplopende kosten op voordat ze ernstige problemen worden. Een verkeerd geconfigureerde API-integratie kan duizenden onnodige modelaanroepen veroorzaken – zonder realtime monitoring gaat deze verspilling door totdat de maandelijkse rekening binnenkomt.

Budgetbeheersing voorkomt dat experimenten uitmonden in financiële rampen. Onderzoeksteams kunnen nieuwe modellen en benaderingen verkennen binnen vastgestelde budgetlimieten, in de wetenschap dat het platform onbedoelde overschrijdingen zal voorkomen.

Het juiste AI-platform voor kostenanalyse kiezen

Niet alle platforms bieden dezelfde mogelijkheden of zijn geschikt voor dezelfde toepassingen. Organisaties moeten de opties evalueren op basis van hun specifieke behoeften en bestaande infrastructuur.

Integratie met bestaande infrastructuur

Het platform moet naadloos aansluiten op bestaande AI-workflows. Diepe integraties met grote cloudproviders, populaire modelhostingdiensten en gangbare ontwikkelomgevingen verminderen de implementatiebelemmeringen.

API-compatibiliteit is belangrijk voor maatwerkapplicaties. Teams die eigen AI-systemen ontwikkelen, hebben platforms nodig die data uit niet-standaard bronnen kunnen verwerken zonder uitgebreide maatwerkontwikkeling.

Authenticatie- en beveiligingsvereisten variëren per organisatie. Platformen van enterprise-niveau ondersteunen single sign-on, op rollen gebaseerde toegangscontrole en naleving van wettelijke kaders zoals SOC 2 of GDPR.

Granulariteit van kostentoewijzing

Hoe gedetailleerd moet de kostenregistratie zijn? Sommige organisaties vereisen toewijzing tot op het niveau van individuele API-aanroepen of specifieke gebruikerssessies. Andere organisaties hebben alleen inzicht op projectniveau nodig.

Gedetailleerdere toewijzing van oorzaken vereist doorgaans meer meetinstrumenten. Teams moeten afwegen of de extra implementatie-inspanning de extra inzichten rechtvaardigt.

Multitenant-applicaties brengen extra complexiteit met zich mee. Platformen moeten de kosten bijhouden voor verschillende klanten of bedrijfsonderdelen, terwijl tegelijkertijd de gegevensisolatie en privacy gewaarborgd blijven.

Schaalbaarheid en prestaties

AI-workloads schalen snel op. Platformen moeten steeds grotere datavolumes aankunnen zonder prestatieverlies of onevenredige kostenstijgingen.

De vereisten voor realtime verwerking nemen toe met de omvang van de werklast. Een platform dat duizenden API-aanroepen per dag verwerkt, kan problemen ondervinden met miljoenen. Organisaties moeten de schaalbaarheid controleren voordat ze een beslissing nemen.

Beleid voor gegevensbewaring heeft gevolgen voor de kosten op lange termijn. Platforms die gedetailleerde statistieken voor onbepaalde tijd opslaan, worden na verloop van tijd duur. Duidelijke bewaaropties helpen de opslagkosten te beheersen.

Waarschuwings- en automatiseringsmogelijkheden

De complexiteit van waarschuwingssystemen varieert sterk. Basisplatforms versturen e-mails wanneer de uitgaven een bepaalde drempel overschrijden. Geavanceerde systemen integreren met tools voor incidentbeheer, ondersteunen complexe waarschuwingen op basis van meerdere voorwaarden en maken geautomatiseerde herstelworkflows mogelijk.

Aanpasbare waarschuwingslogica voorkomt notificatiemoeheid. Teams moeten precies kunnen bepalen wanneer en hoe ze op de hoogte worden gebracht van kostenkwesties.

Geautomatiseerde reacties op kostenafwijkingen besparen geld en verminderen handmatig werk. Platforms die automatisch resources kunnen afschalen, aanvragen kunnen beperken of kunnen overschakelen naar goedkopere leveranciers, bieden aanzienlijke operationele voordelen.

| Vermogen | Basisplatformen | Geavanceerde platforms | Bedrijfsplatformen |

|---|---|---|---|

| Kostentoewijzing | Tracking op projectniveau | Team- en modelniveau | Detailniveau per sessie |

| Ondersteuning van de leverancier | 1-2 grote aanbieders | 5+ aanbieders | Onbeperkt via API |

| Realtime monitoring | Uurlijkse updates | Gegevens op minuutniveau | Streaming binnen een seconde |

| Onregelmatigheidsdetectie | Statische drempelwaarden | Op machine learning gebaseerd | Contextuele AI-modellen |

| Budgetbeheersing | Handmatige meldingen | Geautomatiseerde throttling | Beleidsgestuurde orkestratie |

| Voorspelling | Eenvoudige trendlijnen | Multifactoriële voorspellingen | Scenariomodellering |

| Integratieopties | Basis-API's | Webhooks en SDK's | Aangepaste connectoren |

| Prijzen | Gratis of goedkoop | Op gebruik gebaseerde tariefniveaus | Maatwerk bedrijfscontracten |

Implementatie-best practices

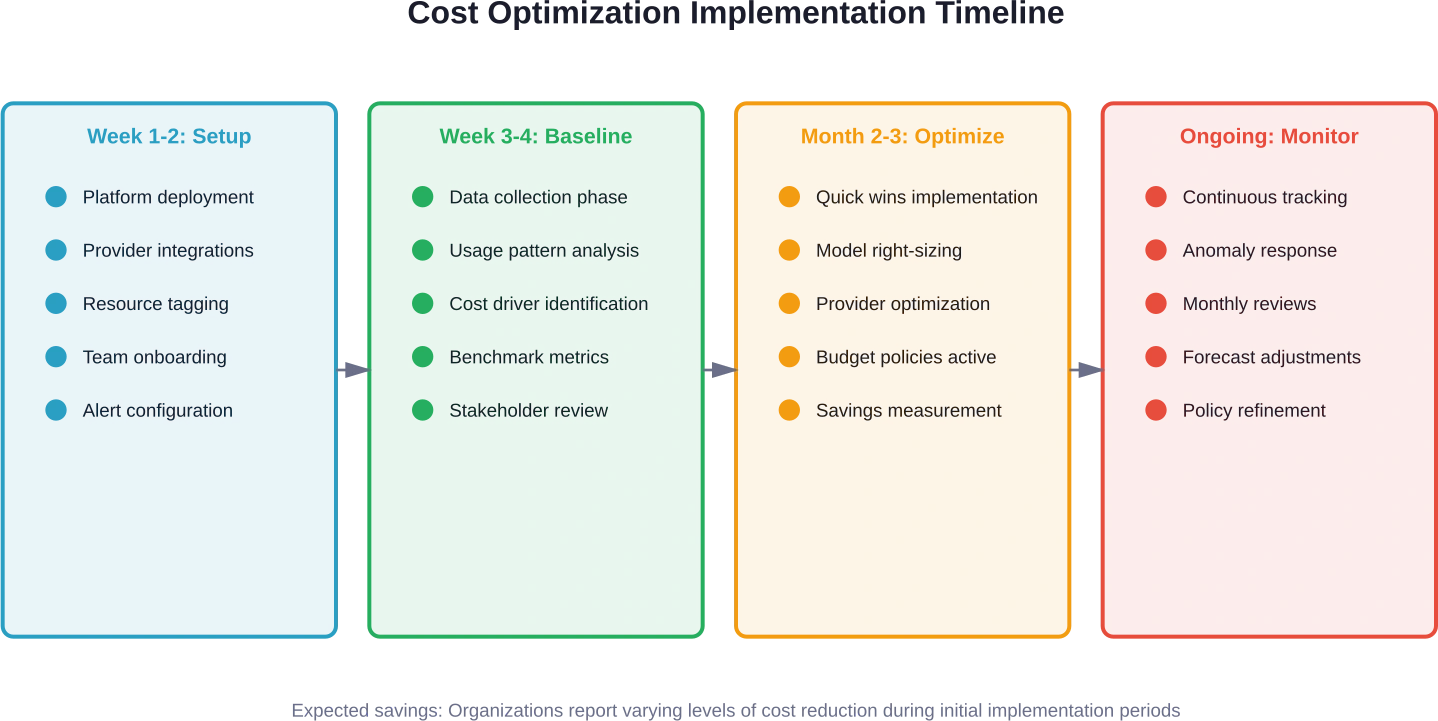

Het implementeren van een AI-platform voor kostenanalyse vereist planning. Organisaties die de implementatie overhaasten, kampen vaak met problemen met de datakwaliteit en een onvolledig inzicht.

Begin met uitgebreide instrumentatie.

Onvolledige data leidt tot onvolledige inzichten. Teams zouden alle AI-workloads vanaf het begin moeten instrumenteren in plaats van tracking stapsgewijs toe te voegen.

Dit betekent integreren met elke leverancier, alle resources op de juiste manier taggen en zorgen voor consistente metadata in alle systemen. De initiële inspanning betaalt zich terug wanneer analyses de kostenfactoren binnen de gehele AI-portfolio aan het licht brengen.

Consistente taggingschema's maken zinvolle aggregatie mogelijk. Organisaties dienen naamgevingsconventies vast te stellen voor projecten, teams, omgevingen en modellen voordat de implementatie begint.

Definieer duidelijke modellen voor kostenverdeling.

Hoe moeten gedeelde resources worden verdeeld? Een centrale AI-infrastructuur kan meerdere bedrijfsonderdelen ondersteunen; organisaties hebben transparante methoden nodig voor de verdeling van de kosten.

Gangbare benaderingen zijn onder meer proportionele toewijzing op basis van gebruik, specifieke resourcepools voor elk team, of chargebackmodellen waarbij interne klanten betalen voor het daadwerkelijke verbruik.

Welk model organisaties ook kiezen, duidelijkheid is belangrijker dan perfectie. Teams moeten begrijpen hoe hun acties de kosten beïnvloeden en hoe uitgaven aan hun budgetten worden toegewezen.

Stel basisstatistieken vast vóór optimalisatie.

Optimalisatiepogingen vereisen referentiepunten. Documenteer, voordat u wijzigingen doorvoert, de huidige uitgavenpatronen, benuttingsgraden en kosten per bedrijfsresultaat.

Deze uitgangspunten maken het mogelijk om verbeteringen te meten. Zonder deze uitgangspunten kunnen teams niet aantonen dat optimalisatie-inspanningen waarde hebben opgeleverd, noch het rendement op investeringen in kostenbeheersingsinstrumenten kwantificeren.

Basisgegevens helpen ook bij het stellen van realistische doelen. Organisaties kunnen ontdekken dat hun kosten al goed geoptimaliseerd zijn, of ze kunnen kansen ontdekken die groter zijn dan aanvankelijk verwacht.

Creëer feedbackloops tussen financiën en techniek.

Kostenoptimalisatie vereist samenwerking tussen teams met verschillende expertisegebieden. Financiële teams begrijpen budgetten en uitgavenpatronen, maar missen de technische kennis over AI-systemen. Engineeringteams weten hoe systemen werken, maar hebben vaak geen inzicht in de financiële gevolgen.

Regelmatige kostenbesprekingen brengen deze perspectieven samen. Ingenieurs leren welke werkzaamheden de kosten opdrijven. Financiële teams begrijpen de technische beperkingen die de optimalisatiemogelijkheden belemmeren.

Gedeelde dashboards en rapporten zorgen ervoor dat iedereen met dezelfde gegevens werkt. Wanneer er afwijkingen in de kosten optreden, kunnen beide teams snel onderzoek doen in plaats van te wachten tot het einde van de maand.

Opkomende trends in AI-kostenbeheer

De markt voor kostenanalyse van AI blijft zich snel ontwikkelen. Verschillende opkomende trends zullen bepalen hoe organisaties de komende jaren hun AI-uitgaven beheren.

AI-gestuurde kostenoptimalisatie

Platformen gebruiken AI steeds vaker om de kosten van AI te optimaliseren – meta-optimalisatie, zo u wilt. Machine learning-modellen analyseren historische gebruikspatronen en stellen automatisch configuratiewijzigingen voor.

Deze systemen kunnen aanbevelen om over te schakelen naar andere modellen op basis van nauwkeurigheidseisen, batchgroottes aan te passen voor trainingstaken, of werklasten tussen leveranciers te verschuiven op basis van realtime prijsinformatie.

Het doel is om van inzicht naar autonome optimalisatie te gaan. In plaats van teams alleen te laten zien waaraan geld wordt uitgegeven, zullen platforms automatisch kostenbesparende maatregelen implementeren binnen vastgestelde beleidsregels.

Gestandaardiseerde kostenindicatoren voor de hele branche

Zoals eerder vermeld, is onderzoek naar raamwerken zoals LCOAI gericht op het standaardiseren van de manier waarop organisaties de kosten van AI evalueren. De invoering van gemeenschappelijke meetmethoden in de sector zou betere benchmarking en besluitvorming mogelijk maken.

De Amerikaanse National Science Foundation investeert al sinds de jaren 60 in AI-onderzoek, en hedendaagse onderzoeksrichtingen richten zich op het economisch efficiënter en toegankelijker maken van AI-systemen. Gestandaardiseerde meetmethoden ondersteunen deze doelen door een gemeenschappelijke taal te creëren rondom de economie van AI.

Organisaties kunnen hun kosten vergelijken met branchegemiddelden, vaststellen of ze een premium- of kortingstarief betalen en op basis van data beslissingen nemen over de keuze van leveranciers.

Integratie met FinOps-praktijken

FinOps – de praktijk van het invoeren van financiële verantwoording bij clouduitgaven – breidt zich uit naar AI-workloads. Organisaties integreren AI-kostenbeheer in bredere financiële cloudprocessen.

Deze integratie zorgt voor een uniform overzicht van infrastructuur, applicaties en AI. Financiële teams krijgen een compleet beeld van de technologie-uitgaven in plaats van de AI-kosten los van andere cloudresources te beheren.

De multidisciplinaire FinOps-teams omvatten AI-specialisten die inzicht hebben in de economie van modeltraining, tokengebaseerde prijsstelling en GPU-gebruikspatronen. Deze expertise zorgt ervoor dat AI-workloads de juiste financiële controle krijgen.

Focus op CO2-kosten en duurzaamheid

AI-workloads verbruiken aanzienlijke hoeveelheden energie. Het trainen van grote modellen vereist duizenden GPU-uren, wat aanzienlijke CO2-uitstoot veroorzaakt.

Platformen voor kostenanalyse beginnen naast de financiële kosten ook de milieu-impact te volgen. Organisaties kunnen de CO2-voetafdruk van verschillende modellen en leveranciers inzien, waardoor ze weloverwogen beslissingen kunnen nemen op basis van duurzaamheid.

Deze mogelijkheid is belangrijk voor bedrijven met doelstellingen voor CO2-reductie. De keuze voor AI-opties met een lagere uitstoot of de mogelijkheid om trainingen in te plannen tijdens perioden met schonere elektriciteit uit het net, draagt bij aan het behalen van milieudoelstellingen.

Veelvoorkomende uitdagingen en hoe je ze kunt overwinnen

Organisaties die AI-platformen voor kostenanalyse implementeren, stuiten op voorspelbare obstakels. Inzicht in deze uitdagingen helpt teams zich voor te bereiden en effectief te reageren.

Onvolledige of inconsistente tagging

Kostentoewijzing is afhankelijk van een correcte labeling van resources. Wanneer teams resources niet consistent labelen, kunnen uitgaven niet nauwkeurig worden toegewezen.

De oplossing bestaat uit het vaststellen van tagbeleid vóór de implementatie en het afdwingen ervan via automatisering. Cloudgovernance-tools kunnen voorkomen dat resources worden aangemaakt zonder de vereiste tags.

Regelmatige audits identificeren resources zonder of met onjuiste tags. Geautomatiseerde herstelprocessen kunnen standaardtags toevoegen aan resources die geen correcte metadata bevatten.

Weerstand van ontwikkelteams

Ingenieurs beschouwen kostenbewaking soms als bureaucratische rompslomp die de ontwikkeling vertraagt. Ze vrezen dat budgetbeperkingen experimenten en innovatie in de weg zullen staan.

Om deze weerstand te overwinnen, is het nodig om de waarde aan te tonen in plaats van beperkingen op te leggen. Laat teams zien hoe inzicht in de kosten hen helpt hun eigen werk te optimaliseren en budget vrij te maken voor toekomstige projecten.

Betrek ingenieurs bij het vaststellen van budgetbeleid in plaats van dit van bovenaf op te leggen. Wanneer teams meebeslissen over redelijke limieten, is de kans groter dat ze het proces steunen.

Gegevenssilo's verspreid over meerdere platforms

Organisaties maken vaak gebruik van meerdere AI-aanbieders, cloudplatformen en ontwikkelomgevingen. Data bevindt zich in verschillende systemen met incompatibele formaten.

Robuuste integratiemogelijkheden bieden een oplossing voor deze uitdaging. Platformen moeten diverse gegevensbronnen ondersteunen en informatie normaliseren naar consistente formaten.

Aangepaste connectoren en API's maken integratie met eigen systemen mogelijk. Organisaties met een unieke infrastructuur hebben platforms nodig die niet-standaard gegevensbronnen ondersteunen.

Alarmmoeheid en valse positieven

Overgevoelige waarschuwingen creëren ruis die teams leren negeren. Wanneer elke kleine kostenschommeling een melding activeert, gaan belangrijke signalen verloren.

Zorgvuldige afstemming van de drempelwaarden vermindert valse positieven. Waarschuwingen moeten worden geactiveerd bij werkelijk afwijkende omstandigheden, niet bij normale gebruiksvariaties.

Contextbewuste waarschuwingen maken gebruik van machine learning om normale patronen te herkennen. In plaats van statische drempelwaarden passen intelligente waarschuwingen zich aan gebruikspatronen aan en worden ze alleen geactiveerd bij werkelijk ongebruikelijke gebeurtenissen.

Het rendement op investering (ROI) van AI-kostenanalyseplatforms

Investeringen in kostenanalyseplatforms vereisen een goede onderbouwing. Organisaties moeten inzicht hebben in het financiële rendement van deze tools.

Directe besparingen kunnen voortkomen uit minder verspilling. Organisaties melden dat ze inefficiënte werkprocessen, overmatig toegewezen resources en onnodige API-aanroepen hebben geïdentificeerd die de uitgaven kunnen verlagen.

Indirecte voordelen zijn onder meer een betere voorspelbaarheid van budgetten. Financiële teams kunnen AI-uitgaven nauwkeurig voorspellen in plaats van geconfronteerd te worden met onverwachte rekeningen. Deze voorspelbaarheid maakt een betere planning en toewijzing van middelen mogelijk.

Snellere innovatiecycli vormen een ander voordeel. Wanneer teams een helder kosteninzicht en budgettaire kaders hebben, kunnen ze vol vertrouwen experimenteren zonder bang te hoeven zijn voor financiële rampen. Dit stimuleert de verkenning van nieuwe AI-mogelijkheden.

De operationele efficiëntie verbetert wanneer geautomatiseerde systemen de kostenbewaking en -optimalisatie afhandelen. Engineeringteams besteden minder tijd aan het handmatig bijhouden van uitgaven en meer tijd aan het ontwikkelen van functionaliteiten.

Voor de meeste organisaties verdienen platformen zichzelf binnen enkele maanden terug, alleen al door de directe kostenbesparingen. De bijkomende operationele en strategische voordelen maken het rendement op de investering (ROI) zeer aantrekkelijk.

| Voordeelcategorie | Typische impact | Meetmethode | Tijd om te beseffen |

|---|---|---|---|

| Directe kostenbesparingen | 20-40% reductie in AI-uitgaven | Maandelijkse kostenvergelijking | 1-3 maanden |

| Budgetvoorspelbaarheid | ±5% voorspellingsnauwkeurigheid | Verschil tussen voorspelling en werkelijke waarde | 2-4 maanden |

| Anomaliepreventie | Vermijd kostenoverschrijdingen bij 10-50% | Gedetecteerde afwijkingen versus vermeden kosten | Lopend |

| Optimalisatie van hulpbronnen | 15-25% efficiëntiewinst | Opbrengst per bestede dollar | 2-5 maanden |

| Tijdsbesparing | 5-10 uur per week | Vermindering van handmatige kostenregistratie | 1-2 maanden |

| Snellere experimenten | 30-50% meer iteraties | Aantal experimenten binnen het budget | 3-6 maanden |

Vooruitblik: De toekomst van AI-kostenbeheer

De toepassing van AI versnelt gestaag en de mogelijkheden voor kostenbeheer moeten gelijke tred houden. Verschillende ontwikkelingen zullen de volgende generatie kostenanalyseplatformen vormgeven.

Door een diepere integratie met AI-ontwikkelingsworkflows wordt kostenbewaking onzichtbaar. In plaats van aparte platforms wordt kosteninzicht direct ingebed in ontwikkelomgevingen, testframeworks en implementatiepipelines.

Realtime feedback over de kosten tijdens de ontwikkeling helpt engineers om kostenbewuste beslissingen te nemen voordat de code in productie gaat. IDE-plugins kunnen bijvoorbeeld de verwachte kosten van een wijziging in de modelconfiguratie weergeven terwijl ontwikkelaars nog bezig zijn met het schrijven van code.

Naarmate de kosten-prestatieanalyse verfijnder wordt, zullen organisaties de optimale balans vinden. Platformen zullen specifieke configuraties aanbevelen die de kwaliteitsdoelstellingen behalen tegen minimale kosten.

Uitgebreidere ondersteuning voor opkomende AI-technologieën zorgt ervoor dat platforms relevant blijven naarmate het vakgebied zich ontwikkelt. Ondersteuning voor nieuwe modeltypen, trainingsmethoden en implementatiepatronen zal beschikbaar komen zodra deze meer worden toegepast.

De Amerikaanse National Science Foundation blijft investeren in AI-onderzoek, waaronder onderzoek naar het toegankelijker en economisch haalbaarder maken van AI. Deze onderzoeksrichtingen zullen de toekomstige mogelijkheden van platforms bepalen.

Betere ondersteuning voor gedistribueerde AI-workloads maakt edge computing en federated learning-scenario's mogelijk. Naarmate AI zich verder ontwikkelt dan gecentraliseerde cloudimplementaties, moet ook de kostenbewaking meebewegen.

Veelgestelde vragen

Wat is het verschil tussen cloudgebaseerde kostenbeheerplatforms en AI-gebaseerde kostenanalyseplatforms?

Tools voor cloudkostenbeheer houden de algemene infrastructuuruitgaven bij, zoals virtuele machines, opslag en netwerken. Platforms voor AI-kostenanalyse begrijpen specifiek de economische aspecten van AI-workloads: tokenverbruik, kosten voor modeltraining, GPU-gebruik en inferentiekosten. Ze bieden een gedetailleerd inzicht en context die generieke cloudtools niet kunnen bieden voor AI-toepassingen.

Wat zijn de gemiddelde kosten van AI-analyseplatforms?

De prijzen variëren aanzienlijk afhankelijk van de functies en de schaal. De prijzen verschillen per platform en gebruiksscenario; raadpleeg de websites van de individuele aanbieders voor actuele informatie. Veel platforms bieden prijsstelling op basis van gebruik, gekoppeld aan het bestedingsvolume aan AI of het aantal gevolgde resources. Enterprise-abonnementen met geavanceerde functies vereisen doorgaans contracten op maat.

Kunnen deze platforms werken met op maat gemaakte of zelfgehoste AI-modellen?

Ja, de meeste geavanceerde platforms ondersteunen aangepaste modellen via API's en SDK's. Organisaties die zelf gehoste modellen gebruiken, kunnen hun infrastructuur zo configureren dat kostengegevens naar analyseplatforms worden verzonden. Dit vereist meer integratiewerk dan beheerde services, maar biedt een vergelijkbaar inzicht in infrastructuurkosten, rekenkrachtgebruik en resourceverbruik.

Hoe snel kunnen organisaties een AI-platform voor kostenanalyse implementeren?

De basisimplementatie duurt doorgaans 1-2 weken voor platformimplementatie, providerintegraties en initiële configuratie. Uitgebreide instrumentatie voor alle AI-workloads kan, afhankelijk van de complexiteit van de infrastructuur, enkele weken in beslag nemen. Organisaties zien meestal binnen de eerste week al de eerste inzichten en binnen 2-4 weken na volledige dataverzameling zinvolle optimalisatiemogelijkheden.

Welke technische expertise is vereist om deze platforms te beheren?

Basisfuncties voor kostenbewaking en -rapportage vereisen minimale technische kennis; financiële teams kunnen dashboards en rapporten interpreteren zonder technische achtergrond. Geavanceerde functies zoals maatwerkintegraties, complexe budgetbeleidsregels en geautomatiseerde optimalisatie vereisen doorgaans de betrokkenheid van engineers die de onderliggende AI-infrastructuur begrijpen. De meeste organisaties maken gebruik van multidisciplinaire teams die expertise op het gebied van financiën en engineering combineren.

Bieden AI-kostenanalyseplatforms ondersteuning voor multi-cloudomgevingen?

Toonaangevende platforms bieden een uniform overzicht van meerdere cloudproviders, waaronder AWS, Azure, Google Cloud en gespecialiseerde AI-diensten zoals OpenAI en Anthropic. Ze bundelen kosten uit verschillende bronnen in één dashboard, waardoor vergelijking en optimalisatie tussen providers mogelijk is. Ondersteuning voor meerdere clouds is essentieel voor organisaties die een strategie van leveranciersdiversificatie nastreven.

Hoe gaan deze platforms om met gegevensprivacy en -beveiliging?

Platformen van enterprise-niveau implementeren uitgebreide beveiligingsmaatregelen, waaronder encryptie tijdens overdracht en opslag, op rollen gebaseerde toegangscontrole, auditregistratie en naleving van standaarden zoals SOC 2, ISO 27001 en GDPR. Ze vereisen doorgaans geen toegang tot trainingsgegevens van modellen of inferentiepayloads, alleen metadata over resourcegebruik en kosten. Organisaties dienen specifieke beveiligingsfuncties en compliance-certificeringen te verifiëren bij de betreffende leveranciers.

Actie ondernemen op het gebied van AI-kostenbeheer

De uitgaven aan AI zullen alleen maar toenemen naarmate organisaties geavanceerdere applicaties inzetten. Proactief kostenbeheer onderscheidt efficiënte bedrijfsvoering van budgettaire rampen.

Begin met het beoordelen van het huidige inzicht in de AI-kosten. Kan het financiële team uitleggen waardoor de AI-uitgaven worden gedreven? Kunnen de engineeringteams zien hoe hun beslissingen de uitgaven beïnvloeden? Als de antwoorden onduidelijk zijn, is het tijd om een degelijk systeem voor het bijhouden van de kosten te implementeren.

Evalueer AI-kostenanalyseplatforms op basis van specifieke organisatorische behoeften in plaats van algemene functielijsten. De juiste oplossing hangt af van de complexiteit van de infrastructuur, de teamgrootte, de nalevingsvereisten en de bestaande tools.

Maar wacht niet op perfecte informatie voordat u begint. Zelfs eenvoudige kostenregistratie levert direct waarde op. Organisaties kunnen beginnen met beperkte instrumenten en de dekking in de loop van de tijd uitbreiden.

De economie van AI blijft zich ontwikkelen. Onderzoek van arXiv naar frameworks zoals LCOAI en Cost-of-Pass-metrics toont aan dat de industrie steeds geavanceerder nadenkt over de kosten van AI. Organisaties die deze analytische benaderingen toepassen, behalen concurrentievoordelen.

Federale investeringen blijven innovatie op het gebied van AI stimuleren, waarbij de National Science Foundation en partnerorganisaties onderzoeksinstituten financieren die zich richten op het verbeteren van AI-mogelijkheden. Naarmate AI krachtiger en toegankelijker wordt, wordt kostenbeheer steeds belangrijker.

Organisaties die AI-kostenanalyse beheersen, besparen niet alleen geld. Ze nemen betere beslissingen over modelselectie, begrijpen de werkelijke ROI van AI en experimenteren met meer vertrouwen. Deze voordelen stapelen zich op in de loop van de tijd.

Begin met het in kaart brengen van de huidige AI-uitgaven en het identificeren van de belangrijkste kostenfactoren. Evalueer vervolgens platforms die specifieke uitdagingen aanpakken. De initiële inspanning betaalt zich snel terug door minder verspilling en een hogere efficiëntie.

AI belooft sectoren te transformeren en nieuwe mogelijkheden te creëren. Effectief kostenbeheer zorgt ervoor dat organisaties zich die belofte ook daadwerkelijk kunnen veroorloven.