Korte samenvatting: De prijzen voor LLM-chatbots in 2026 variëren van gratis versies met beperkte toegang tot bedrijfsabonnementen van meer dan $3.000 per maand. De kosten voor tokengebaseerde API's variëren enorm: OpenAI's GPT-5.2 Pro rekent $21/$168 per miljoen tokens, terwijl GPT-5.2 Standard $1,75/$14 rekent en DeepSeek V3.2-Exp $0,28 per miljoen inputtokens (cache-miss) en $0,42 per miljoen outputtokens kost. De juiste keuze hangt af van het gebruiksvolume, de benodigde functionaliteiten en of u toegang tot de chatbot via een abonnement of directe API-integratie nodig hebt.

De markt voor LLM-chatbots is explosief gegroeid, en daarmee ook een prijslandschap dat zelfs ervaren ontwikkelaars in verwarring kan brengen. Als iemand vraagt wat een AI-chatbot in 2026 kost, is het eerlijke antwoord: ergens tussen nul en zes cijfers per jaar.

Die enorme prijsverschillen bestaan omdat "LLM chatbot pricing" twee fundamenteel verschillende benaderingen omvat. Ten eerste zijn er abonnementsgebaseerde chatbotplatforms waar teams maandelijks betalen voor kant-en-klare conversationele AI. Ten tweede zijn er tokengebaseerde API-services waar ontwikkelaars oplossingen op maat bouwen en per gebruik betalen.

Om te begrijpen welk model het beste aansluit bij specifieke behoeften – en wat de werkelijke kosten zijn – is het belangrijk om door de marketingpraatjes heen te prikken en de concrete cijfers te bekijken. De prijsstructuren zijn sinds 2025 aanzienlijk veranderd, met nieuwe modellen die op de markt komen en gevestigde aanbieders die hun tarieven aanpassen.

Hoe werkt de prijsbepaling van de LLM-chatbot in de praktijk?

Voordat we ingaan op de specifieke kosten, is het nuttig om de twee dominante prijsmodellen te begrijpen die deze markt vormgeven.

Chatbotplatformen op abonnementsbasis

Deze diensten bieden complete chatbotoplossingen met ingebouwde interfaces, integraties en ondersteuning. Teams betalen een terugkerend bedrag – meestal maandelijks – en krijgen toegang tot een platform dat de technische complexiteit afhandelt.

Volgens recente marktanalyses volgt de prijsstructuur voor chatbots op abonnementsbasis doorgaans deze structuur:

| Prijsmodel | Hoe het werkt | Typisch kostenbereik |

|---|---|---|

| Abonnement (SaaS) | Vaste maandabonnementen met gebruikslimieten | $30–$1.500/maand |

| Gebruiksgebaseerd | Betaling per gesprek, oplossing of token. | $0.50–$5 per gesprek |

| Maatwerkbedrijf | Onderhandelde prijzen met toegewijde inzet van resources. | $3.000–$50.000+/maand |

| Per gebruiker/stoel | Kosten per teamlid voor toegang tot het platform | $15–$200/gebruiker/maand |

Het abonnementsmodel werkt goed voor bedrijven die voorspelbare kosten en minimale technische overhead willen. Maar er is een addertje onder het gras: deze platforms leggen vaak strenge limieten op aan het aantal maandelijkse gesprekken, actieve chatbots of de hoeveelheid trainingsdata.

API-prijsstelling op basis van tokens

Voor ontwikkelaars die maatwerkoplossingen bouwen, biedt API-toegang meer flexibiliteit, maar brengt ook variabele kosten met zich mee. Elke interactie met een LLM wordt gemeten in tokens, wat ruwweg overeenkomt met woordfragmenten.

De prijs van tokens is opgesplitst in twee componenten: inputtokens (de prompt die naar het model wordt gestuurd) en outputtokens (het gegenereerde antwoord). Outputtokens kosten bijna altijd meer, omdat het genereren van tekst meer rekenkracht vereist dan het verwerken ervan.

De wiskunde wordt al snel interessant. Een typisch klantenservicegesprek verbruikt bijvoorbeeld 500 inputtokens en genereert 300 outputtokens. Afhankelijk van de tarieven van de aanbieder kan die ene interactie tussen een fractie van een cent en enkele centen kosten.

Belangrijke prijsvergelijking van LLM API's

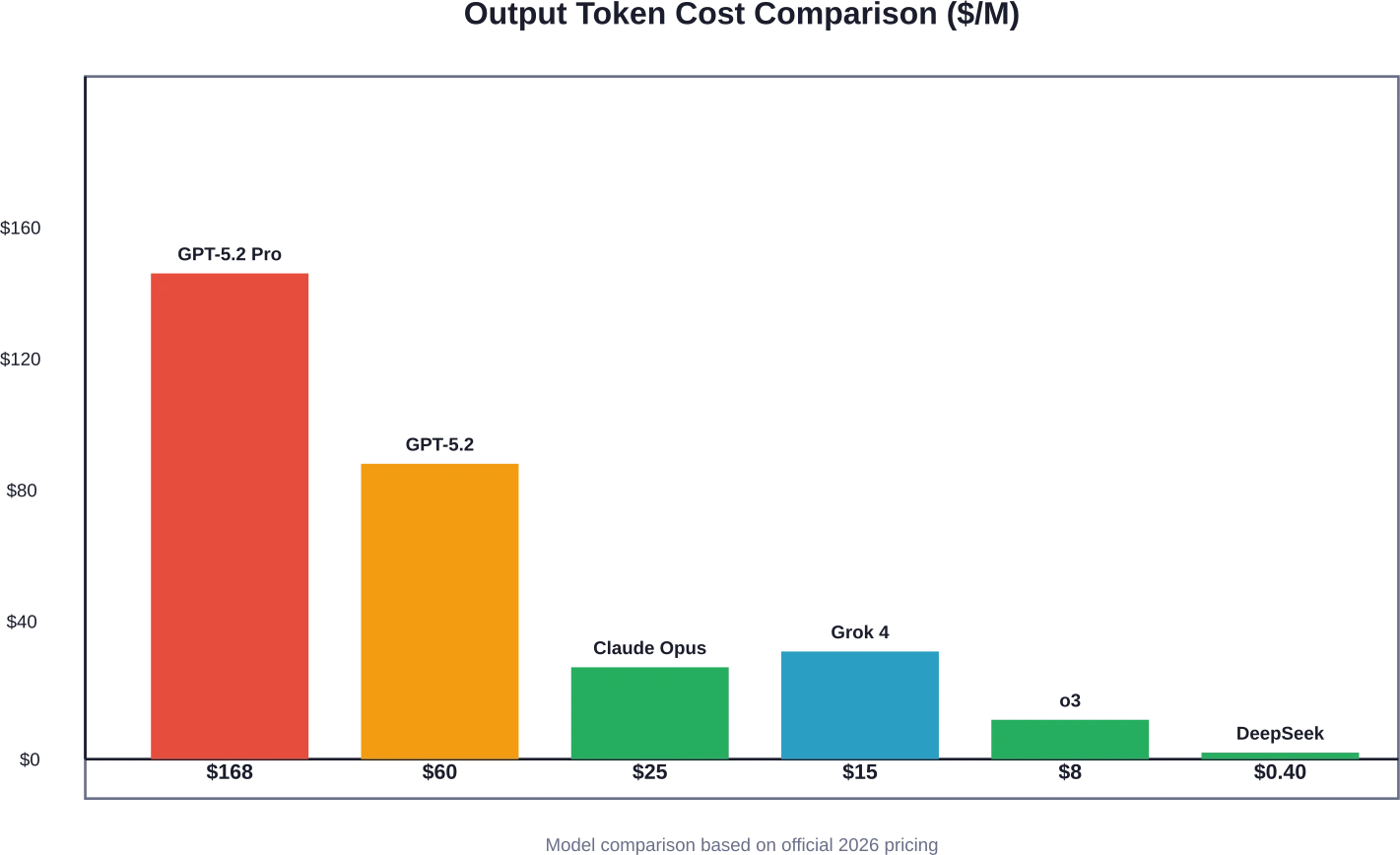

Het prijslandschap voor tokens veranderde begin 2026 drastisch. Nieuwe modellen werden gelanceerd, concurrenten boden elkaar lagere prijzen aan en verbeteringen in functionaliteit veranderden de kosten per waarde-berekening.

Prijsstructuur van OpenAI

OpenAI biedt zowel abonnementen voor ChatGPT-toegang als API-prijzen per token voor ontwikkelaars. Volgens de officiële prijslijst van OpenAI zijn de volgende abonnementsniveaus voor ChatGPT beschikbaar:

- Vrij: Beperkte toegang tot GPT-5.2 met berichtlimieten en tragere reacties.

- Gaan: Uitgebreidere toegang met meer berichten en uploads.

- Plus, Pro, Team, Enterprise: Progressieve niveaus met hogere limieten en extra functies.

Voor API-toegang laat de prijsstelling van OpenAI in februari 2026 een aanzienlijke variatie zien tussen de verschillende modelniveaus:

| Model | Invoer ($/M tokens) | Uitvoer ($/M tokens) | Gebruiksvoorbeeld |

|---|---|---|---|

| GPT-5.2 Pro | $21.00 | $168.00 | Maximale capaciteitstaken |

| GPT-5.2 | $1.75 | $14.00 | Het nieuwste topmodel |

| GPT-4.1 Mini | $0.40 | $1.60 | Kostenefficiënte taken |

| o1 (redenering) | $15.00 | $60.00 | Complexe probleemoplossing |

| o3 (redenering) | $2.00 | $8.00 | Redeneren van de volgende generatie |

Tijdens discussies binnen de community werd opgemerkt dat o1 aanzienlijk duurder is dan o3, hoewel de prijsverhouding eerder te maken heeft met verschillende computerarchitecturen dan met een hiërarchie van mogelijkheden.

OpenAI biedt ook gespecialiseerde modellen aan, zoals chatgpt-image-latest met een input van $5 en een output van $10 per miljoen tokens, ontworpen voor multimodale interacties.

Antropische Claude-prijzen

De Claude-modellen van Anthropic hebben aan populariteit gewonnen vanwege hun sterke prestaties bij codeer- en analysetaken. Volgens de aankondiging van Anthropic van 5 februari 2026 blijft de prijs van Claude Opus 4.6 $5 per miljoen inputtokens en $25 per miljoen outputtokens.

Dat maakt Claude Opus aanzienlijk goedkoper dan sommige modellen van OpenAI. Voor een ontwikkelaar die maandelijks 10 miljoen inputtokens en 5 miljoen outputtokens verwerkt met modellen van een vergelijkbaar niveau, is het kostenverschil aanzienlijk:

- GPT-5.2 Pro: (10 × $21) + (5 × $168) = $1,050

- Claude Opus 4.6: (10 × $5) + (5 × $25) = $175

Claude introduceerde in de bètaversie ook een contextvenster van 1 miljoen tokens, waardoor langere gesprekken mogelijk zijn zonder dat de context wordt afgekapt – een functie die tokenverspilling door herhaalde context vermindert.

Anthropic biedt tools voor kostenbewaking via de Claude Console, waar ontwikkelaars gebruikspatronen kunnen volgen en bestedingslimieten kunnen instellen. Voor Anthropic Claude Code kunnen ontwikkelaars de opdracht /cost gebruiken om gedetailleerde statistieken over het tokengebruik voor de huidige sessie te bekijken, wat helpt bij het identificeren van optimalisatiemogelijkheden.

Google Gemini-prijzen

De Gemini-modellen van Google bieden concurrerende prijzen, hoewel de specifieke tarieven voor 2026 variëren per modelcategorie en regio. Op basis van concurrentieanalyses positioneren Gemini-modellen zich doorgaans tussen de premium-categorieën en budgetalternatieven van OpenAI.

Het voordeel van Gemini ligt in de integratie met de infrastructuur en diensten van Google Cloud, waardoor het aantrekkelijk is voor organisaties die al in dat ecosysteem hebben geïnvesteerd.

xAI Grok-prijzen

Volgens een concurrentieanalyse heeft xAI Grok 4-modellen gelanceerd met een prijs van $3 per miljoen inputtokens en $15 per miljoen outputtokens. Dit maakt Grok 4 duurder dan Claude Opus, maar goedkoper dan GPT-5.2.

xAI biedt ook Grok 4 Fast en Grok 4.1 Fast aan tegen aanzienlijk lagere tarieven: 1 TP4T0.20 input en 1 TP4T0.50 output per miljoen tokens. Deze snelle varianten offeren wel wat functionaliteit op voor snelheid en kostenefficiëntie.

Prijsverandering bij DeepSeek

Het in China gevestigde DeepSeek heeft met zijn V3.2-Exp-modelvariant vrijwel alle concurrenten onderboden. DeepSeek V3.2-Exp kost $0,28 per miljoen inputtokens (cache-miss) en $0,42 per miljoen outputtokens.

Die prijsstelling is een factor tien lager dan die van duurdere westerse modellen. Voor toepassingen met een hoog volume kunnen de tarieven van DeepSeek een besparing van duizenden dollars per maand opleveren.

De afwegingen omvatten mogelijke vertragingen door Chinese servers, zorgen over de locatie van gegevens voor gereguleerde sectoren en vragen over de duurzaamheid van de prijsstelling op lange termijn.

Kosten van een abonnement op een chatbotplatform

Voor bedrijven die de voorkeur geven aan kant-en-klare oplossingen boven API-ontwikkeling, bieden abonnementsplatformen bundels met LLM-toegang, interfaces, analyses en integraties.

Prijzen voor kleine bedrijven

Instapabonnementen zijn doorgaans bedoeld voor solopreneurs of kleine teams die de mogelijkheden van chatbots testen. Deze startersabonnementen kosten vaak tussen de $30 en $150 per maand en omvatten:

- 1–3 actieve chatbots

- Beperkt aantal maandelijkse gesprekken (vaak 500-5000)

- Basisintegraties (website, Facebook Messenger)

- Standaard antwoordsjablonen

- E-mailondersteuning

De beperkingen zijn hier van belang. Een kleine e-commercewebsite die dagelijks 100 klantvragen afhandelt, bereikt binnen de eerste week al de limiet van 3.000 gesprekken per maand. Zodra deze limieten worden overschreden, brengen platforms ofwel extra kosten in rekening, ofwel pauzeren ze de chatbot – geen van beide opties is ideaal voor de klantervaring.

Mid-Market Solutions

Groeiende bedrijven hebben doorgaans abonnementen nodig in de categorie $300–$1.000 per maand. Op dit niveau worden de mogelijkheden aanzienlijk uitgebreid:

- 5-10 chatbots met geavanceerdere logica

- 15.000–50.000 gesprekken per maand

- CRM- en helpdeskintegraties

- Training op maat over bedrijfsspecifieke gegevens

- Analyses en inzichten uit gesprekken

- Prioriteitsondersteuning met snellere reactietijden.

Deze abonnementsvorm is geschikt voor bedrijven met een gevestigde klantenbasis, maar nog niet op enterprise-schaal. De prijs begint de waarde van automatisering te weerspiegelen: een enkele supportmedewerker kost maandelijks $3.000–$5.000 aan salaris en secundaire arbeidsvoorwaarden, dus zelfs een chatbot die 30% aan vragen afhandelt, kan de investering rechtvaardigen.

Prijzen voor chatbots voor bedrijven

Grote organisaties betalen vaak maandelijks tussen de 3.000 en 50.000 euro of meer voor chatbotplatformen van enterprise-niveau. Op dit niveau verschuift de prijsstelling doorgaans naar een offerte op maat, gebaseerd op:

- Onbeperkt of zeer hoog gespreksvolume

- Opties voor white-label branding

- Geavanceerde beveiligings- en compliancefuncties

- Toegewijd accountmanagement

- Training en fine-tuning van aangepaste modellen

- SLA-garanties voor uptime en reactiesnelheid.

- Meertalige ondersteuning

Zakelijke contracten omvatten vaak professionele diensten, zoals ondersteuning bij de implementatie, ontwikkeling van maatwerkintegraties en doorlopend advies over optimalisatie. Deze diensten kunnen tienduizenden euro's extra kosten, zowel eenmalig als terugkerend.

Verborgen kosten die de prijs van de LLM-chatbot opdrijven

De geadverteerde prijs vertelt zelden het hele verhaal. Verschillende verborgen of semi-verborgen kosten kunnen de werkelijke kosten voor het gebruik van LLM-chatbots verdubbelen.

Contextvenster en tokenverspilling

Elk gesprek met een LLM bevat niet alleen het meest recente bericht van de gebruiker, maar ook de gespreksgeschiedenis voor context. Een gesprek van tien beurten kan duizenden contextuele gegevens bevatten bij elk nieuw bericht.

Modellen met grotere contextvensters verminderen deze verspilling door meer conversatiestatus te bewaren zonder opnieuw te hoeven verzenden. Het contextvenster van 1 miljoen tokens van Claude Opus 4.6 is hier een groot voordeel: langere conversaties vereisen geen kostbare herverzending van de context.

Snelle cachekosten

Sommige aanbieders bieden prompt caching aan om de kosten te verlagen bij het herhaaldelijk verzenden van dezelfde context. OpenAI en Anthropic ondersteunen beide vormen van caching, maar de prijsmodellen verschillen.

Gecachede tokens kosten minder dan nieuwe, maar niet alle content komt in aanmerking voor caching. Begrijpen wanneer caching van toepassing is – en prompts optimaliseren om het aantal cachehits te maximaliseren – vereist technische expertise die kleinere teams mogelijk niet bezitten.

Integratie- en ontwikkeltijd

API-gebaseerde benaderingen besparen op abonnementskosten, maar brengen ontwikkelingskosten met zich mee. Het bouwen van een productiegereed chatbot vereist:

- Backend-infrastructuur voor API-aanroepen

- Gebruikersinterfaceontwikkeling

- Logica voor gespreksverloop en foutafhandeling

- Beveiligingsimplementatie voor gebruikersgegevens

- Monitoring- en logboeksystemen

- Doorlopend onderhoud naarmate API's zich ontwikkelen

Voor een middelgroot ontwikkelteam zou dit in eerste instantie 200-500 uur werk betekenen, plus 10-20 uur per maand voor onderhoud. Bij gangbare tarieven voor ontwikkelaars vertaalt dit zich naar $20.000-$50.000 aan initiële kosten en $1.500-$3.000 aan doorlopende kosten per maand.

Gegevensvoorbereiding en training

Algemene LLM's presteren over het algemeen goed zonder aanpassingen, maar domeinspecifieke prestaties vereisen vaak fijnafstemming of systemen voor het genereren van zoekresultaten die worden ondersteund door augmented reality (RAG).

Het opzetten van een RAG-systeem betekent:

- Het verzamelen en opschonen van bedrijfsdocumentatie

- Inhoud op de juiste manier opdelen

- Het genereren en opslaan van embeddings

- Het implementeren van de ophaallogica

- Het testen en verbeteren van de kwaliteit van de zoekresultaten.

Dit werk is niet gratis. Organisaties besteden vaak weken of maanden aan het gereedmaken van kennisbanken voor productiegebruik.

Monitoring en kwaliteitsborging

LLM's genereren soms onjuiste, ongepaste of afwijkende antwoorden. Implementaties binnen de organisatie vereisen:

- Gespreksmonitoringsystemen

- Menselijke beoordelingsprocessen voor gemarkeerde interacties

- A/B-testen van verschillende prompts en modellen

- Regelmatige audits voor kwaliteit en naleving van de regelgeving.

Deze operationele kosten lopen flink op. Een bedrijf heeft mogelijk 0,5 tot 2 voltijdmedewerkers nodig voor het kwaliteitsbeheer van chatbots, afhankelijk van het gespreksvolume en de risicobereidheid.

Het juiste prijsmodel kiezen

Met zo'n gevarieerd aanbod, hoe moeten organisaties dan kiezen tussen abonnementsplatformen en API-ontwikkeling, of tussen premiummodellen en budgetalternatieven?

Berekeningen van het gebruiksvolume

Begin met het inschatten van het gespreksvolume en het tokenverbruik. Voor een klantenservicechatbot:

- Schat het aantal dagelijkse gesprekken (het huidige aantal tickets dient als basislijn).

- Bereken het gemiddelde aantal tokens per gesprek (500-2000 is gebruikelijk, afhankelijk van de complexiteit).

- Voeg 30–50%-buffer toe voor groei en onverwachte pieken.

Bereken vervolgens de kosten bij verschillende aanbieders. Een bedrijf dat maandelijks 10.000 gesprekken afhandelt met elk 1.000 tokens (500 invoer, 500 uitvoer) zou het volgende verbruiken:

- 5 miljoen inputtokens per maand

- 5 miljoen output-tokens per maand

Bij verschillende aanbieders:

| Aanbieder/Model | Maandelijkse kosten | Jaarlijkse kosten |

|---|---|---|

| GPT-5.2 Pro | $945 | $11,340 |

| Claude Opus 4.6 | $150 | $1,800 |

| Grok 4 | $90 | $1,080 |

| o3 | $50 | $600 |

| DeepSeek V3.2 | $3.50 | $42 |

Die berekening laat enorme verschillen zien. Maar wacht even – prijs is niet alles.

Afweging tussen kwaliteit en kosten

Goedkopere modellen betekenen vaak resultaten van lagere kwaliteit. Voor toepassingen waar nauwkeurigheid van belang is – medisch advies, juridische informatie, financieel advies – verlaagt de investering in betere modellen het risico.

Sommige ontwikkelaars hebben gemeld dat de geheugenkosten onverwacht hoog kunnen oplopen bij het bouwen van chatbots met een lange gespreksgeschiedenis, vooral bij modellen die geen efficiënt contextbeheer ondersteunen.

Het testen van verschillende modellen aan de hand van specifieke gebruiksscenario's levert het duidelijkste antwoord op. Voer pilotprojecten uit met 100-500 echte gesprekken met behulp van meerdere modellen en meet daarbij:

- Nauwkeurigheid en relevantie van de antwoorden

- Gebruikerstevredenheidsscores

- Oplossingspercentages van gesprekken

- Escalatie naar menselijke agenten

Het model dat acceptabele kwaliteit biedt tegen de laagste prijs wint. Soms is dat een premium model; soms presteert een middenklasse optie net zo goed.

Zelf bouwen versus kopen: de beslissing

Moeten organisaties zelf chatbots bouwen met behulp van API's of abonnementsplatformen aanschaffen?

Abonnementsplatformen zijn zinvol wanneer:

- De technische middelen zijn beperkt.

- Snelheid van marktintroductie is belangrijker dan maatwerk.

- Het gespreksvolume past binnen de platformlimieten.

- Standaardintegraties dekken de benodigde gebruiksscenario's.

API-ontwikkeling is zinvol wanneer:

- Unieke workflows vereisen aangepaste logica.

- Door het grote volume worden de abonnementskosten onbetaalbaar.

- Diepgaande integratie met bestaande systemen is essentieel.

- Het technische team heeft voldoende capaciteit voor ontwikkeling.

Het omslagpunt ligt vaak rond de 25.000 tot 50.000 maandelijkse gesprekken. Onder die drempel bieden abonnementsplatformen een betere prijs-kwaliteitverhouding. Daarboven zijn op maat gemaakte API-implementaties doorgaans goedkoper, ondanks de extra ontwikkelingskosten.

Het beheren en optimaliseren van de kosten van een LLM-opleiding.

Eenmaal geïmplementeerd, helpen verschillende strategieën om de lopende kosten te beheersen.

Snelle engineering voor efficiëntie

Goed opgestelde prompts verminderen tokenverspilling en verbeteren de kwaliteit van de output. Technieken omvatten:

- Gebruik beknopte systeemberichten die context scheppen zonder overbodige woorden.

- Het implementeren van few-shot learning met 2-3 voorbeelden in plaats van 10 of meer.

- Het structureren van output met JSON of andere formaten om omslachtige uitleg te minimaliseren.

- Het is belangrijk om complexe taken waar mogelijk op te splitsen in kleinere stappen.

Een verlaging van het gemiddelde aantal tokens per gesprek met 20% vertaalt zich direct in een kostenbesparing van 20%.

Modelselectie op basis van taak

Niet elke taak vereist het meest geavanceerde model. Slimme routeplanning kan aanzienlijke kosten besparen:

- Gebruik goedkopere modellen voor eenvoudige veelgestelde vragen en routeplanning.

- Reserveer dure modellen voor complexe redeneringen of generaties.

- Gebruik een betrouwbaarheidsscore om te bepalen wanneer er moet worden overgeschakeld naar premium modellen.

Een gelaagde aanpak zou bijvoorbeeld GPT-4.1 Mini kunnen gebruiken voor 70% aan gesprekken en GPT-5.2 voor de resterende 30% die geavanceerde mogelijkheden vereisen, waardoor de gemiddelde kosten met 50–60% worden verlaagd.

Caching en contextoptimalisatie

Door gebruik te maken van promptcaching wanneer beschikbaar, worden de kosten voor herhaalde context verlaagd. Strategisch gebruik van gecachede content kan de tokenkosten aanzienlijk verlagen.

Voor Anthropic Claude Code kunnen ontwikkelaars het commando /cost gebruiken om gedetailleerde statistieken over het tokengebruik van de huidige sessie te bekijken, wat helpt bij het identificeren van optimalisatiemogelijkheden.

Gebruiksmonitoring en waarschuwingen

Zowel OpenAI als Anthropic bieden tools voor gebruiksmonitoring. Door waarschuwingen in te stellen, voorkomt u onverwachte rekeningen wanneer het gebruik plotseling toeneemt.

Belangrijke meetwaarden om in de gaten te houden:

- Dagelijkse trends in tokenverbruik

- Kosten per gesprek over tijd

- Modelselectieverdeling

- Foutpercentages die herhaalde pogingen en verspilling van tokens veroorzaken

De Claude Console van Anthropic biedt gedetailleerde kosten- en gebruiksrapportages die zichtbaar zijn voor ontwikkelaars, facturatiemanagers en beheerders, waardoor proactief kostenbeheer mogelijk wordt.

Bedrijfsoverwegingen en volumekortingen

Grote organisaties bedingen vaak betere tarieven dan de gepubliceerde API-prijzen doen vermoeden.

Maatwerk bedrijfsovereenkomsten

Bedrijven die zich committeren aan aanzienlijke volumes – vaak $50.000+ per jaar – kunnen het volgende onderhandelen:

- Volumekortingen van 10–30%

- Aangepaste tariefcategorieën op basis van reeds toegezegde uitgaven

- SLA-garanties voor uptime en latentie.

- Toegewijde ondersteuning en technisch accountbeheer.

- Opties voor privé-implementatie met betrekking tot gegevensgevoeligheid

OpenAI, Anthropic en andere grote aanbieders bieden allemaal bedrijfsabonnementen aan, hoewel de prijsdetails niet openbaar worden gemaakt.

Gegevensopslag en naleving

Gereguleerde sectoren worden geconfronteerd met extra beperkingen. Zorginstellingen moeten voldoen aan de HIPAA-regelgeving; financiële dienstverleners hebben een SOC 2-certificering nodig; Europese bedrijven moeten rekening houden met de GDPR-regels voor gegevensopslag.

Collectieve ondernemingsovereenkomsten omvatten vaak:

- Zakelijke partnerovereenkomsten (BAA's) voor de gezondheidszorg

- Gegevensverwerkingsovereenkomsten waarin de verwerking van gegevens is gespecificeerd

- Regionale implementatieopties om gegevens in specifieke rechtsgebieden te bewaren.

- Nulbeleid voor gegevensbewaring

Claude Code biedt opties voor het volledig stopzetten van gegevensbewaring voor teams die zich zorgen maken over gegevensprivacy.

Aan deze compliancefuncties zijn soms extra kosten verbonden of minimale bestedingsverplichtingen verbonden.

Opkomende modellen en toekomstige prijsontwikkelingen

Het LLM-landschap is in snelle ontwikkeling. Verschillende trends bepalen de prijsvorming voor 2026 en daarna.

Open Source-competitie

Modellen zoals GLM-5 en Qwen3.5 vertegenwoordigen steeds krachtigere open-source alternatieven. Organisaties met voldoende technische middelen kunnen deze modellen zelf hosten, waardoor de kosten per token volledig komen te vervallen.

De keerzijde is de infrastructuurkosten. Het uitvoeren van een model met 40 miljard parameters vereist aanzienlijke GPU-resources – vaak $500–$2000 per maand aan GPU-kosten in de cloud of een substantiële kapitaalinvestering voor hardware op locatie.

Bij implementaties met een zeer hoog volume (miljoenen dagelijkse gesprekken) kan zelfhosting economisch voordeliger zijn dan API-diensten, ondanks de extra infrastructuurkosten.

Gespecialiseerde modellen

Taakspecifieke modellen die geoptimaliseerd zijn voor specifieke toepassingen bieden vaak een betere prijs-kwaliteitverhouding dan algemene vlaggenschipmodellen. Het o3-redeneermodel van OpenAI is bijvoorbeeld goedkoper dan o1 en levert betere prestaties voor bepaalde analytische taken.

Naarmate leveranciers meer gespecialiseerde modellen op de markt brengen, kunnen organisaties de kosten optimaliseren door modellen af te stemmen op de specifieke gebruikseisen, in plaats van dure topmodellen voor alles te gebruiken.

Evolutie van multimodale prijsstelling

Modellen die afbeeldingen, audio en andere modaliteiten verwerken, introduceren extra complexiteit in de prijsstelling. De Realtime API van OpenAI hanteert verschillende tarieven voor tekst-, audio- en afbeeldingstokens: audiotokens in gebruikersberichten kosten 1 token per 100 ms en audiotokens van assistenten kosten 1 token per 50 ms.

Voor spraakgestuurde chatbots lopen deze snelheden snel op. Een gesprek van 5 minuten omvat 300.000 ms aan audio. Met de snelheden van OpenAI's Realtime API (1 token per 100 ms voor gebruikersaudio, 1 token per 50 ms voor audio van de assistent) kan dit, afhankelijk van de verdeling van het gesprek, neerkomen op 3.000 tot 6.000 tokens, nog voordat er tekstverwerking plaatsvindt.

Het rendement op investering berekenen

Inzicht in de kosten is slechts de helft van het verhaal. De andere helft is het kwantificeren van de waarde die chatbots bieden.

Ondersteuning van kostenverlaging

De meest eenvoudige ROI-berekening betreft het aantal bespaarde supporttickets. Als een chatbot 40% aan binnenkomende vragen afhandelt en elk ticket dat door een mens wordt afgehandeld $5 tot $15 aan arbeidskosten met zich meebrengt, lopen de besparingen snel op.

Voor een bedrijf dat maandelijks 5.000 supporttickets verwerkt met een gemiddelde kostprijs van $8:

- Totale maandelijkse ondersteuningskosten: $40,000

- Chatbot die 40% afhandelt: 2.000 tickets geautomatiseerd

- Besparingen: 2.000 × $8 = $16.000 per maand

Als de chatbot maandelijks $2.000 kost (inclusief ontwikkelingskosten en API-kosten), bedraagt de netto besparing $14.000 per maand of $168.000 per jaar.

Impact op de omzet

Bij chatbots voor verkoop en leadgeneratie verschuiven de ROI-berekeningen naar conversieverbeteringen:

- Verhoogde betrokkenheid dankzij 24/7 beschikbaarheid

- Snellere reactietijden verminderen het aantal afgebroken opdrachten.

- Betere kwalificatie van leads vóór overdracht aan een medewerker.

- Aanbevelingen voor upselling en cross-selling

Zelfs kleine verbeteringen in conversieratio's kunnen de investering in een chatbot rechtvaardigen. Een stijging van 2% in conversies bij een maandelijkse omzet van $1M is $20.000 – wat de gebruikelijke kosten van een chatbot ruimschoots overtreft.

Immateriële voordelen

De waarde van sommige chatbots is lastiger te kwantificeren:

- Verbeterde klanttevredenheid dankzij snelle reacties.

- Een consistente merkstem in alle interacties.

- Menselijke agenten komen vrij voor complexe, waardevolle zaken.

- Gegevensverzameling en inzichten uit gesprekspatronen

Deze factoren zijn van belang voor de concurrentiekracht op lange termijn, zelfs als ze niet direct in de financiële berekeningen terug te vinden zijn.

Stop met te veel betalen voor LLM-chatbots en bouw ze op de juiste manier.

De kosten van een LLM-chatbot zijn sterk afhankelijk van het ontwerp van het systeem. Modelkeuze, trainingsstrategie, tokengebruik en infrastructuur hebben allemaal invloed op de uiteindelijke prijs. Veel bedrijven ontdekken dat het gebruik van generieke modellen zonder optimalisatie de operationele kosten snel verhoogt.

AI Superieur Het bedrijf werkt samen met bedrijven die behoefte hebben aan op maat gemaakte LLM-systemen (Large Language Models) voor daadwerkelijk productiegebruik. Ze ontwikkelen en verfijnen grote taalmodellen, bereiden trainingsdata voor en optimaliseren de implementatie, zodat chatbots accuraat en kostenefficiënt blijven naarmate het gebruik toeneemt. Hun team van datawetenschappers en ingenieurs met een doctoraat richt zich op het bouwen van AI-systemen die zijn afgestemd op specifieke workflows, in plaats van te vertrouwen op standaardmodellen.

Bent u van plan een chatbot voor uw LLM-opleiding te ontwikkelen? Neem dan contact op met AI Superieur Voordat je je vastlegt op een dure architectuur, is het belangrijk om een duidelijk beeld te krijgen van de werkelijke kosten voor het bouwen en beheren van je chatbot.

Praktische kostenvoorbeelden

Om de prijsbepaling concreet te maken, kunt u een aantal realistische scenario's overwegen:

Scenario 1: Een kleine FAQ-bot voor e-commerce

- Volume: 2.000 gesprekken per maand

- Benadering: Abonnementsplatform

- Kosten: $79/maand platformkosten

- Resultaat: Behandelt 60% aan productvragen, waardoor het volume aan e-mailondersteuning met de helft wordt verminderd.

Scenario 2: Ondersteuning voor middelgrote SaaS-bedrijven

- Volume: 15.000 gesprekken per maand

- Benadering: Aangepaste API-integratie met Claude Opus

- Tokengebruik: 12 miljoen input, 8 miljoen output per maand

- API-kosten: (12 × $5) + (8 × $25) = $260/maand

- Ontwikkeling: $30.000 initiële bouwkosten, $2.000 maandelijkse onderhoudskosten

- Kosten voor het eerste jaar: $30.000 + ($260 + $2.000 × 12) = $57.120

- Doorlopende jaarlijkse kosten: $27,120

- Resultaat: Verwerkt 45% aan eerstelijns support, bespaart 2 FTE.

Scenario 3: Multichannel-assistent voor bedrijven

- Volume: 200.000 gesprekken per maand via web, mobiel en spraak

- Benadering: Hybride model dat DeepSeek gebruikt voor eenvoudige zoekopdrachten en GPT-5.2 voor complexe zoekopdrachten.

- Tokengebruik: 120M ingang (80M DeepSeek, 40M GPT), 80M uitgang (50M DeepSeek, 30M GPT)

- API-kosten: DeepSeek: (80 × $0.28) + (50 × $0.42) = $43.40; GPT: (40 × $21) + (30 × $168) = $5,880

- Totale maandelijkse API-kosten: $2,442

- Infrastructuur: $5.000 per maand (load balancing, monitoring, databases)

- Team: 2 FTE voor onderhoud en optimalisatie = $20.000 per maand

- Totale maandelijkse kosten: $27,442

- Resultaat: Verwerkt 70% aan klantinteracties en vervangt daarmee 8 fulltime supportmedewerkers.

Deze voorbeelden illustreren hoe de kosten stijgen met het volume en de complexiteit.

Veelgestelde vragen over prijzen

Zijn er gratis LLM-opleidingen beschikbaar?

Ja, verschillende aanbieders bieden gratis versies aan. Volgens de prijslijst van OpenAI biedt hun gratis abonnement beperkte toegang tot GPT-5.2 met een maximum aantal berichten en tragere reactietijden. Dit is geschikt voor experimenten, maar niet voor productieomgevingen.

Open-source modellen kunnen zelfstandig worden gehost zonder softwarelicentiekosten, maar de infrastructuurkosten blijven wel bestaan.

Hoe werken bedrijfskortingen?

Zakelijke klanten die grote volumes afnemen, kunnen aangepaste tarieven bedingen, vaak 10 tot 301 ton lager dan de gepubliceerde API-prijzen. Deze overeenkomsten vereisen doorgaans een minimale jaarlijkse besteding van 50.000 tot 100.000 dollar of meer.

Wat gebeurt er als het verbruik de limieten van het abonnement overschrijdt?

Abonnementsplatformen brengen doorgaans ofwel extra kosten in rekening voor overschrijding van het verbruik (vaak tegen hogere tarieven per eenheid) of pauzeren de dienstverlening tot de volgende factureringscyclus. API-diensten blijven wel functioneren, maar er worden kosten in rekening gebracht die verder gaan dan het overeengekomen verbruik.

Kunnen de kosten nauwkeurig worden voorspeld?

De schatting van het gebruik verbetert met de tijd, maar er blijft variabiliteit bestaan. Onverwachte virale content, seizoensgebonden pieken of veranderingen in gebruikersgedrag kunnen schommelingen in het gebruik veroorzaken van 2 tot 5 keer. Het inbouwen van een buffer van 30 tot 501 TP3T helpt verrassingen te voorkomen.

Zijn er regionale prijsverschillen?

Sommige aanbieders passen hun prijzen aan per regio, hoewel grote API-diensten zoals OpenAI en Anthropic uniforme wereldwijde tarieven hanteren. Vereisten met betrekking tot de locatie van gegevens dwingen soms tot het gebruik van regionale implementaties, wat hogere prijzen met zich meebrengt.

Veelgestelde vragen

Wat zijn de gemiddelde kosten van een AI-chatbot in 2026?

De gemiddelde kosten variëren sterk, afhankelijk van de gekozen aanpak. Abonnementsplatforms voor kleine bedrijven kosten tussen de $30 en $300 per maand. Oplossingen voor het middensegment kosten $300 tot $1.000 per maand. Implementaties voor grote ondernemingen kosten vaak meer dan $3.000 per maand. Voor API-gebaseerde implementaties zijn de kosten afhankelijk van het volume; de gebruikelijke kosten liggen tussen de $100 en $5.000 per maand voor de meeste organisaties, waarbij grootschalige implementaties voor grote ondernemingen soms meer dan $20.000 per maand kosten, alleen al aan tokenkosten.

Wat zijn de kosten van de ChatGPT API in vergelijking met Claude?

Vanaf februari 2026 kost OpenAI's GPT-5.2 Pro $21 per miljoen inputtokens en $168 per miljoen outputtokens, terwijl Anthropic's Claude Opus 4.6 $5 per miljoen inputtokens en $25 per miljoen outputtokens kost. Claude is aanzienlijk goedkoper – ongeveer 67% minder duur dan GPT-5.2 Pro. Voor 10 miljoen inputtokens en 5 miljoen outputtokens per maand kost GPT-5.2 $1.050, tegenover $175 voor Claude.

Welke factoren hebben de grootste invloed op de prijsstelling van de LLM-chatbot?

De belangrijkste kostenfactoren zijn het conversatievolume, het aantal tokens per conversatie, de modelkeuze en de implementatiemethode. Een bedrijf dat premiummodellen zoals GPT-5.2 Pro gebruikt bij een hoog conversatievolume, kan 100 tot 400 keer meer betalen dan een bedrijf dat budgetmodellen zoals DeepSeek gebruikt voor een vergelijkbaar aantal conversaties. De grootte van het contextvenster, de cachingefficiëntie en de vraag of maatwerkontwikkeling nodig is, hebben ook een aanzienlijke invloed op de totale eigendomskosten.

Is het goedkoper om een chatbot op maat te bouwen of een platform te gebruiken?

Voor volumes onder de 25.000 maandelijkse gesprekken zijn abonnementsplatformen doorgaans goedkoper als de ontwikkeltijd wordt meegerekend. Boven die drempel worden maatwerk-API-implementaties economischer, ondanks initiële ontwikkelingskosten van $20.000–$50.000. Het omslagpunt hangt af van de beschikbaarheid van het technische team en de specifieke functionaliteitsvereisten. Maatwerkoplossingen bieden meer flexibiliteit, maar vereisen doorlopend onderhoud.

Bieden aanbieders van LLM-opleidingen gratis opties aan?

Ja, de meeste grote aanbieders bieden beperkte gratis toegang. OpenAI biedt een gratis abonnement met beperkte toegang tot GPT-5.2, een maximum aantal berichten en tragere reactietijden. Deze gratis abonnementen zijn geschikt voor testen en experimenteren, maar leggen beperkingen op waardoor ze onpraktisch zijn voor productiegebruik. Zodra het aantal gesprekken honderden of duizenden per maand bedraagt, worden betaalde abonnementen noodzakelijk.

Hoe kan ik de kosten van LLM API verlagen zonder in te leveren op kwaliteit?

Verschillende strategieën verlagen de kosten met behoud van kwaliteit: gebruik gelaagde modelroutering (goedkopere modellen voor eenvoudige zoekopdrachten, premium modellen voor complexe zoekopdrachten), optimaliseer prompts om tokenverspilling te verminderen, maak gebruik van promptcaching waar mogelijk, implementeer grotere contextvensters om herhaalde contextoverdracht te voorkomen en test meerdere modellen om de beste prijs-prestatieverhouding voor specifieke gebruikssituaties te vinden. Veel organisaties realiseren door deze optimalisaties kostenbesparingen van 30–501 TP3T.

Welke verborgen kosten moet ik naast de API-kosten nog in mijn budget opnemen?

Naast de directe API- of abonnementskosten, moet u rekening houden met de volgende kosten: ontwikkeltijd ($20.000–$50.000 initiële kosten voor maatwerkoplossingen), doorlopend onderhoud ($1.500–$5.000 per maand), infrastructuur voor hosting en monitoring ($500–$5.000 per maand, afhankelijk van de schaal), datavoorbereiding en het creëren van een kennisbank (weken tot maanden werk) en kwaliteitsborging, inclusief menselijke beoordelingsprocessen. Verborgen kosten verdubbelen of verdrievoudigen vaak de ogenschijnlijke prijs van LLM-diensten.

De prijsbepaling voor uw LLM-chatbot bepalen

Het prijslandschap voor LLM-chatbots biedt in 2026 meer opties dan ooit, maar ook meer complexiteit. De kloof tussen budget- en premiumopties is groter geworden, met keuzes die nu variëren van DeepSeek's $0,28/$0,42 per miljoen tokens tot OpenAI's GPT-5.2 Pro voor $21/$168.

Er is geen pasklare oplossing voor elk gebruiksscenario. Kleine bedrijven die conversationele AI testen, profiteren van abonnementsplatformen die technologie en ondersteuning bundelen voor voorspelbare maandelijkse kosten. Groeiende bedrijven met een gemiddeld volume vinden vaak dat platforms in het middensegment of API-implementaties met kosteneffectieve modellen zoals Claude Opus of o3 de beste prijs-kwaliteitverhouding bieden. Grote ondernemingen met technische middelen kunnen de kosten optimaliseren door middel van maatwerkontwikkeling, modelrouting en volumekortingen.

De sleutel is om te beginnen met duidelijke gebruiksramingen, meerdere benaderingen te testen met echte werklasten en niet alleen de kosten, maar ook de resultaten te meten: opgeloste supporttickets, verbeterde conversieratio's, verhoogde klanttevredenheid. Die meetgegevens bepalen het werkelijke rendement op investering (ROI).

Eén ding is zeker: de prijsstelling zal blijven evolueren. Maandelijks worden er nieuwe modellen gelanceerd, bestaande aanbieders passen hun tarieven aan en open-source alternatieven worden verbeterd. Organisaties die flexibele architecturen bouwen die een gemakkelijke overstap tussen modellen mogelijk maken, positioneren zich om de kosten te optimaliseren naarmate de markt verandert.

Klaar om de LLM-chatbotopties voor uw specifieke behoeften te verkennen? Begin met het berekenen van uw verwachte maandelijkse conversatievolume en tokenverbruik. Test gratis versies van verschillende aanbieders met representatieve gebruiksscenario's. Kies vervolgens de oplossing die acceptabele kwaliteit levert tegen beheersbare kosten – niet per se de goedkoopste of de duurste optie, maar de oplossing die de beste prijs-kwaliteitverhouding biedt voor uw specifieke behoeften.