Korte samenvatting: De kosten voor LLM's (Language Learning Models) in het VK variëren aanzienlijk, afhankelijk van de aanbieder en het gebruik. Vanaf 2026 worden bedrijven geconfronteerd met kosten die variëren van een fractie van een cent per token voor kleinere modellen tot enkele ponden voor complexe query's op bedrijfssystemen. De Universiteit van Manchester heeft frameworks ontwikkeld die de benodigde resources voor controletechnieken voor LLM's met meer dan 901 TP3T verminderen, wat de operationele kosten potentieel drastisch kan verlagen. De adoptie van AI in het VK blijft groeien, waarbij natuurlijke taalverwerking en tekstgeneratie de meest voorkomende toepassingen zijn. Momenteel gebruikt 851 TP3T AI voor deze doeleinden.

Grote taalmodellen zijn in het Verenigd Koninkrijk geëvolueerd van experimentele technologie tot essentiële bedrijfsonderdelen. Maar er is een probleem: de kosten kunnen snel oplopen als organisaties de prijsstructuren niet begrijpen.

Volgens overheidsgegevens kende de Britse AI-sector tussen 2023 en 2024 een aanzienlijke groei. Deze groei roept een belangrijke vraag op: wat kost het nu eigenlijk om deze systemen te laten draaien?

Inzicht in de kosten van LLM gaat niet alleen over de kosten per token. Infrastructuur, testen, controlemechanismen en energieverbruik spelen allemaal een rol in de totale eigendomskosten. En die cijfers zijn belangrijk, of je nu een startup in Manchester runt of de bedrijfsvoering van een grote onderneming in Londen beheert.

Inzicht in LLM-prijsmodellen in het Verenigd Koninkrijk

De meeste aanbieders van LLM-cursussen berekenen hun kosten op basis van het aantal gebruikte tokens. Een token staat ongeveer gelijk aan vier tekens of driekwart van een Engels woord.

Bij de prijsopbouw worden inputtokens (de prompt die naar het model wordt gestuurd) doorgaans gescheiden van outputtokens (het gegenereerde antwoord). Outputtokens kosten over het algemeen meer omdat ze meer rekenkracht vereisen.

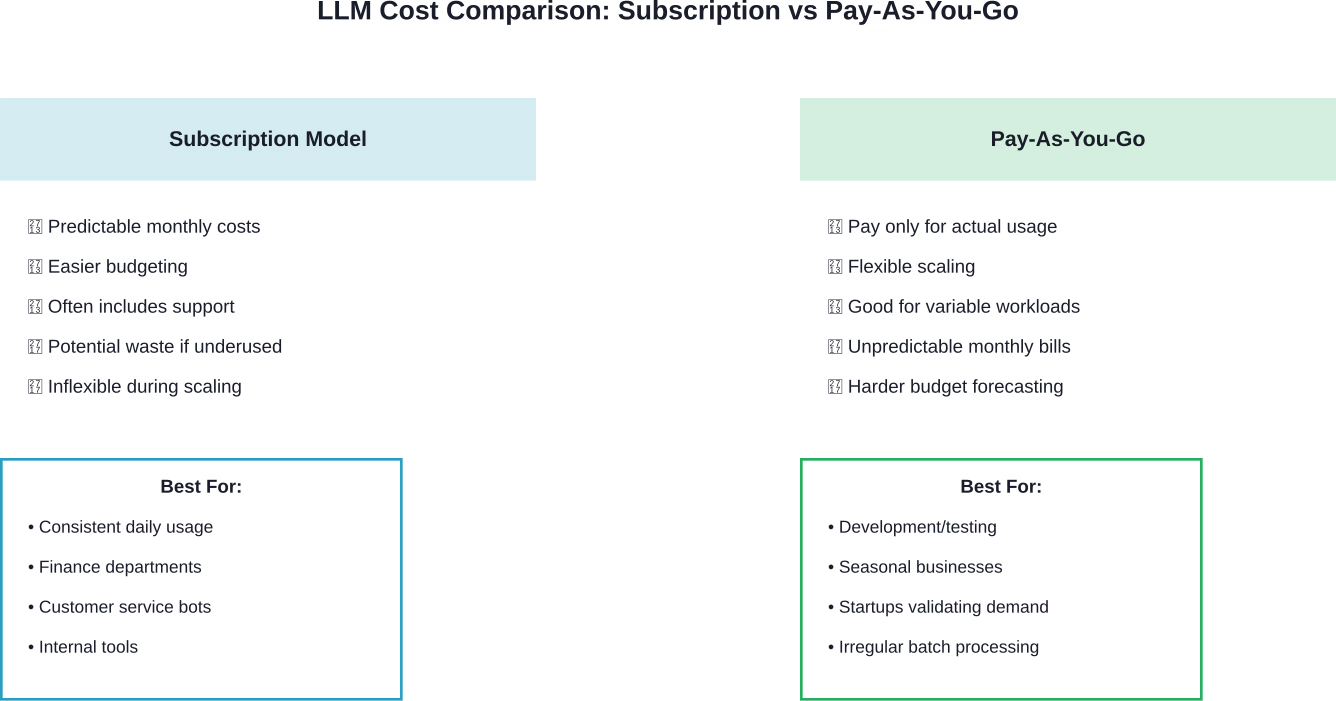

De Britse markt kent verschillende prijsstrategieën. Sommige aanbieders bieden abonnementen met verschillende niveaus en inbegrepen tegoeden. Anderen hanteren een puur pay-as-you-go-model. Zakelijke contracten bevatten vaak volumekortingen en gegarandeerde capaciteit.

Tokengebaseerde prijsstelling uitgelegd

Facturering op basis van tokens betekent dat de kosten rechtstreeks schalen met het gebruik. Een eenvoudige zoekopdracht kan in totaal 50 tot 100 tokens verbruiken. Complexe documentanalyses kunnen duizenden tokens kosten.

Eerlijk gezegd: de meeste bedrijven onderschatten hun tokenverbruik in het eerste kwartaal van de implementatie. Test- en ontwikkelomgevingen kunnen budgetten verrassend snel opgebruiken.

En nu wordt het interessant. Onderzoekers van de Universiteit van Manchester hebben nieuwe softwareframeworks ontwikkeld – LangVAE en LangSpace – die de hardware- en energiebehoefte voor het besturen en testen van LLM's met meer dan 901 TP3T verminderen. Dat is niet zomaar een kleine verbetering. Het is een revolutionaire verandering voor organisaties die zich zorgen maken over de snel stijgende operationele kosten.

Abonnement versus betalen per gebruik

Abonnementsmodellen bieden voorspelbaarheid. Vaste maandelijkse kosten zijn handig voor budgettering. Maar ze kunnen verspilling zijn als het werkelijke gebruik niet overeenkomt met het gekochte abonnement.

Betalen per gebruik biedt flexibiliteit. Organisaties betalen alleen voor wat ze verbruiken. Het nadeel? Kosten worden moeilijker te voorspellen, vooral tijdens opschalingsperioden.

Veel Britse bedrijven hanteren een hybride aanpak. Basisabonnementen dekken voorspelbare werkbelastingen. Extra capaciteit wordt gefactureerd op basis van gebruik.

Patronen en kostenimplicaties van AI-adoptie in het VK

Uit overheidsgegevens blijkt dat de adoptie van AI sterk varieert afhankelijk van de omvang en sector van de organisatie. Grote en middelgrote bedrijven lopen voorop wat betreft de adoptie, met name in de informatie- en communicatiesector, de financiële sector, de vastgoedsector en de zakelijke dienstverlening.

Natuurlijke taalverwerking en tekstgeneratie zijn de meest voorkomende toepassingen, waarbij 85% van de AI-gebruikers AI momenteel voor deze doeleinden inzet. Dat is logisch: deze toepassingen leveren direct waarde op zonder uitgebreide aanpassingen.

Maar de adoptiepatronen onthullen iets belangrijks over de kosten. Sectoren met een hogere adoptiegraad hebben geleerd de kosten te beheersen door middel van specialisatie en optimalisatie. Ze gooien niet zomaar modellen tegen problemen aan.

Sectorspecifieke gebruikspatronen

Financiële dienstverleners verwerken doorgaans grote hoeveelheden relatief gestandaardiseerde vragen. Denk aan fraudedetectie, compliance-monitoring en documentclassificatie. Voor deze werkzaamheden is dedicated capaciteit en een gunstig onderhandeld tarief essentieel.

De gezondheidszorg en de juridische sector kennen verschillende dynamieken. Hun vragen zijn doorgaans langer en complexer. Nauwkeurigheid is belangrijker dan snelheid. Gespecialiseerde modellen presteren vaak beter dan algemene alternatieven.

Onderzoek van het Regulatory Genome Project aan de Cambridge Judge Business School toont dit precies aan. Hun analyse geeft aan dat, wil een systeem met menselijke tussenkomst echt effectief zijn, de evaluatie rekening moet houden met de totale efficiëntie van begin tot eind. Gespecialiseerde modellen zijn niet alleen nauwkeuriger, ze zijn ook goedkoper als ze afzonderlijk worden ingezet.

Het onderzoek wijst uit dat de vrijwel onmiddellijke verwerkingstijd van gespecialiseerde modellen de gehele workflow sneller en responsiever maakt. Die snelheid vertaalt zich direct in kostenbesparingen bij facturering per token.

Kostenbesparingsstrategieën voor Britse organisaties

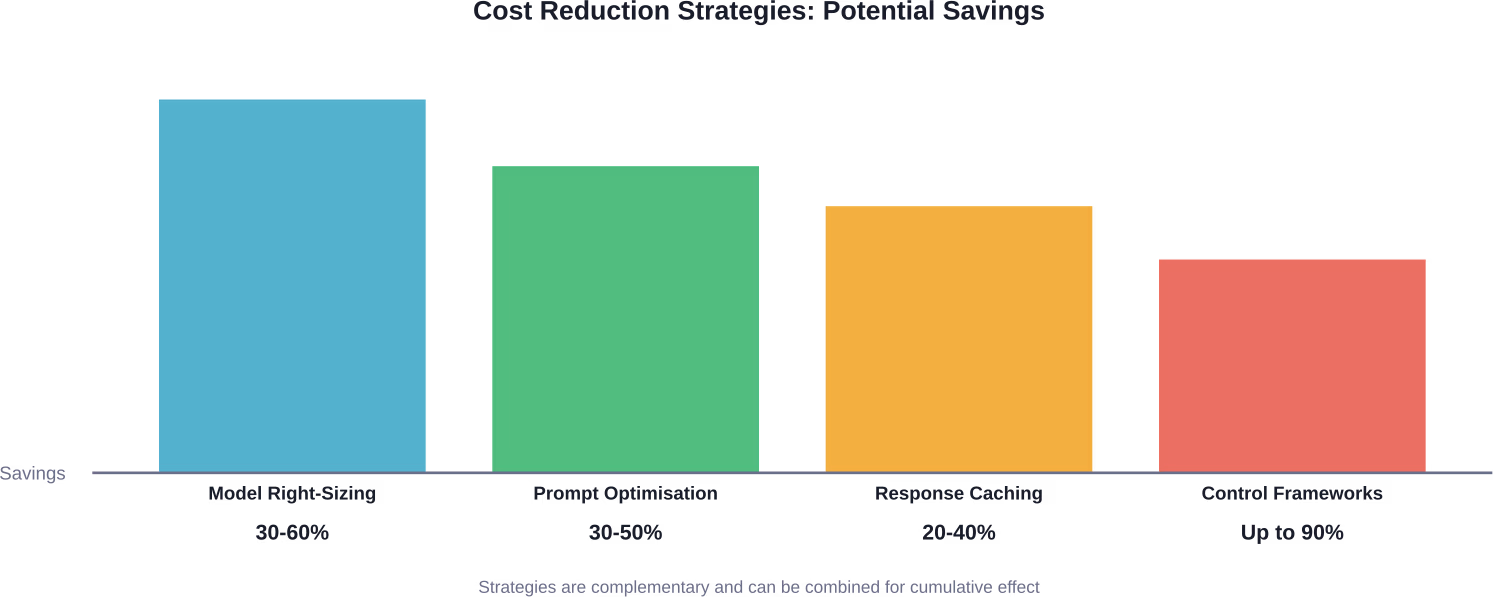

Slimme organisaties accepteren de prijzen van leveranciers niet zomaar als vaststaand. Meerdere strategieën kunnen de operationele kosten van LLM aanzienlijk verlagen.

Modelselectie en de juiste maatvoering

Niet voor elke taak is het grootste en meest geavanceerde model nodig. Kleinere modellen kunnen veel routinetaken prima uitvoeren tegen een fractie van de kosten.

Overweeg een gelaagde aanpak. Leid eenvoudige vragen door naar lichtgewicht modellen. Reserveer premium modellen voor complexe redeneertaken die echt geavanceerde mogelijkheden vereisen.

Onderzoek van Cambridge Judge Business School bevestigt dat gespecialiseerde AI-modellen aanzienlijke voordelen bieden voor precisietaken. Hoewel algemene modellen op grote schaal hun nut hebben, optimaliseert het afstemmen van de mogelijkheden van het model op de taakvereisten zowel de prestaties als de kosten.

Snelle engineering en optimalisatie

Inefficiënte prompts leiden tot verspilling van tokens. Uitgebreide instructies, onnodige voorbeelden en slecht gestructureerde zoekopdrachten verhogen allemaal de kosten.

Effectieve prompt-engineering vermindert het tokenverbruik zonder dat dit ten koste gaat van de uitvoerkwaliteit. Dat betekent kortere prompts, duidelijkere instructies en strategisch gebruik van systeemberichten.

Tests tonen aan dat goed geoptimaliseerde prompts het tokengebruik met 30-50% kunnen verminderen in vergelijking met naïeve benaderingen. Bij duizenden dagelijkse zoekopdrachten lopen deze besparingen aanzienlijk op.

Caching en hergebruik van responsen

Veel organisaties raadplegen LLM's herhaaldelijk met identieke of bijna identieke invoer. Door reacties in de cache op te slaan, worden overbodige API-aanroepen volledig geëlimineerd.

Semantische caching gaat nog een stap verder. Wanneer een nieuwe query sterk overeenkomt met een eerdere query, kan het antwoord uit de cache volstaan. Deze aanpak vereist een zorgvuldige implementatie om te voorkomen dat verouderde of ongepaste antwoorden worden gegeven, maar de kostenbesparingen kunnen aanzienlijk zijn.

Geavanceerde besturingskaders

De doorbraak van de Universiteit van Manchester verdient bijzondere aandacht. Hun LangVAE- en LangSpace-frameworks verminderen de benodigde middelen voor LLM-controle met meer dan 90%.

Deze frameworks bouwen gecomprimeerde taalrepresentaties op uit LLM's, waardoor controle- en testprocessen aanzienlijk efficiënter worden. Voor organisaties die prioriteit geven aan verklaarbaarheid en betrouwbaarheid – met name in gereguleerde sectoren zoals de gezondheidszorg en de energiesector – zou deze technologie de kostenstructuur fundamenteel kunnen veranderen.

De aanpak van het onderzoeksteam pakt een cruciaal knelpunt aan. Het onderzoeken en aanpassen van LLM-gedrag vereist traditioneel enorme rekenkracht. Door taalrepresentaties te comprimeren, maken de frameworks deze processen toegankelijk voor organisaties zonder hyperscale-infrastructuur.

Infrastructuur en verborgen kosten

De kosten voor tokens vormen slechts een deel van de totale LLM-uitgaven. Infrastructuur, integratie, monitoring en onderhoud brengen allemaal extra kosten met zich mee.

API-beheer en -monitoring

Effectief kostenbeheer vereist inzicht in gebruikspatronen. API-managementplatformen volgen het verbruik, identificeren afwijkingen en handhaven limieten voor het aantal aanvragen.

Zonder adequate monitoring ontdekken organisaties budgetoverschrijdingen vaak pas wanneer de facturen binnenkomen. Realtime monitoring maakt proactief ingrijpen mogelijk voordat de kosten uit de hand lopen.

Integratie- en ontwikkelingskosten

Het integreren van LLM-functionaliteit in bestaande systemen vereist ontwikkeltijd. Afhankelijk van de complexiteit kunnen integratieprojecten variëren van een paar dagen tot meerdere maanden.

Discussies binnen de community benadrukken deze realiteit. Ontwikkel- en testomgevingen verbruiken aanzienlijke tokenbudgetten. Organisaties zouden deze kosten apart van het productiegebruik moeten verantwoorden.

Energie- en milieuoverwegingen

LLM's verbruiken aanzienlijke hoeveelheden energie, zowel tijdens de training als bij de inferentie. Hoewel cloudproviders de infrastructuur verzorgen, worden deze kosten uiteindelijk doorberekend aan de klant.

Het onderzoek van Manchester pakt deze zorg direct aan. Het verminderen van de grondstoffenbehoefte met 90% betekent een overeenkomstige vermindering van het energieverbruik. Voor organisaties met duurzaamheidsdoelstellingen zijn deze efficiëntiewinsten van belang, niet alleen vanwege de financiële besparingen.

Gespecialiseerde versus algemene modellen: kosten-batenanalyse

Het debat tussen gespecialiseerde en algemene modellen heeft concrete gevolgen voor de kosten.

Algemene modellen bieden veelzijdigheid. Eén API, meerdere gebruiksscenario's. Vereenvoudigde architectuur. Maar ze zijn vaak te groot voor specifieke taken en verbruiken meer tokens dan nodig.

Gespecialiseerde modellen blinken uit in precisietaken. Onderzoek van de Cambridge Judge Business School toont aan dat ze niet alleen nauwkeuriger zijn, maar ook goedkoper voor specifieke toepassingen. Vrijwel onmiddellijke verwerking betekent lagere kosten per query en een efficiënter gebruik van resources.

De optimale strategie combineert doorgaans beide. Algemene modellen verwerken uiteenlopende, onvoorspelbare vragen. Gespecialiseerde modellen pakken grote hoeveelheden domeinspecifiek werk aan.

| Factor | Algemene modellen | Gespecialiseerde modellen |

|---|---|---|

| Kosten vooraf | Lager (geen training vereist) | Hoger niveau (vereist training/fijnafstemming) |

| Kosten per zoekopdracht | Hoger (groter tokenverbruik) | Lager (geoptimaliseerd voor specifieke taken) |

| Nauwkeurigheid | Goed in het uitvoeren van uiteenlopende taken | Uitstekend voor het beoogde domein. |

| Snelheid | Variabele | Vrijwel direct voor getrainde taken |

| Flexibiliteit | Hoog (kan uiteenlopende vragen verwerken) | Laag (geoptimaliseerd voor een specifiek domein) |

| Break-evenpunt | Niet van toepassing | Doorgaans meer dan 10.000 zoekopdrachten per maand. |

Adoptie van AI in de Britse publieke sector en kostenoverwegingen

De publieke sector wordt geconfronteerd met unieke beperkingen bij de inzet van AI. Budgettaire beperkingen, aanbestedingsprocedures en het vertrouwen van het publiek spelen allemaal een rol bij beslissingen over de adoptie ervan.

Onderzoek van Nesta wijst uit dat minder dan de helft (40%) van het Britse publiek erop vertrouwt dat de publieke sector AI op een verantwoorde manier gebruikt. Dit gebrek aan vertrouwen bemoeilijkt de implementatie en kan leiden tot de noodzaak van extra toezichts- en transparantiemechanismen, wat allemaal extra kosten met zich meebrengt.

De AI-incubator voor kunstmatige intelligentie, in samenwerking met Nesta's Centre for Collective Intelligence Design, heeft geëxperimenteerd met methoden om het publiek te betrekken bij de beoordeling van AI-tools voor publieke diensten. Deze participatieve methoden brengen extra administratieve lasten met zich mee, maar kunnen essentieel blijken voor het opbouwen van het vertrouwen dat nodig is voor een succesvolle implementatie.

Uitdagingen bij overheidsaanbestedingen

Bij aanbestedingen in de publieke sector staan transparantie en een goede prijs-kwaliteitverhouding voorop. Standaard commerciële prijsmodellen sluiten niet altijd aan op deze eisen.

Contracten met een vaste prijs bieden budgetzekerheid, maar zijn mogelijk niet geschikt voor de variabele aard van prijsstelling op basis van tokens. Sommige overheidsinstanties sluiten hybride overeenkomsten met gebruikslimieten en bepalingen voor overschrijding van het verbruik.

Agentische AI-systemen en workflows met meerdere stappen

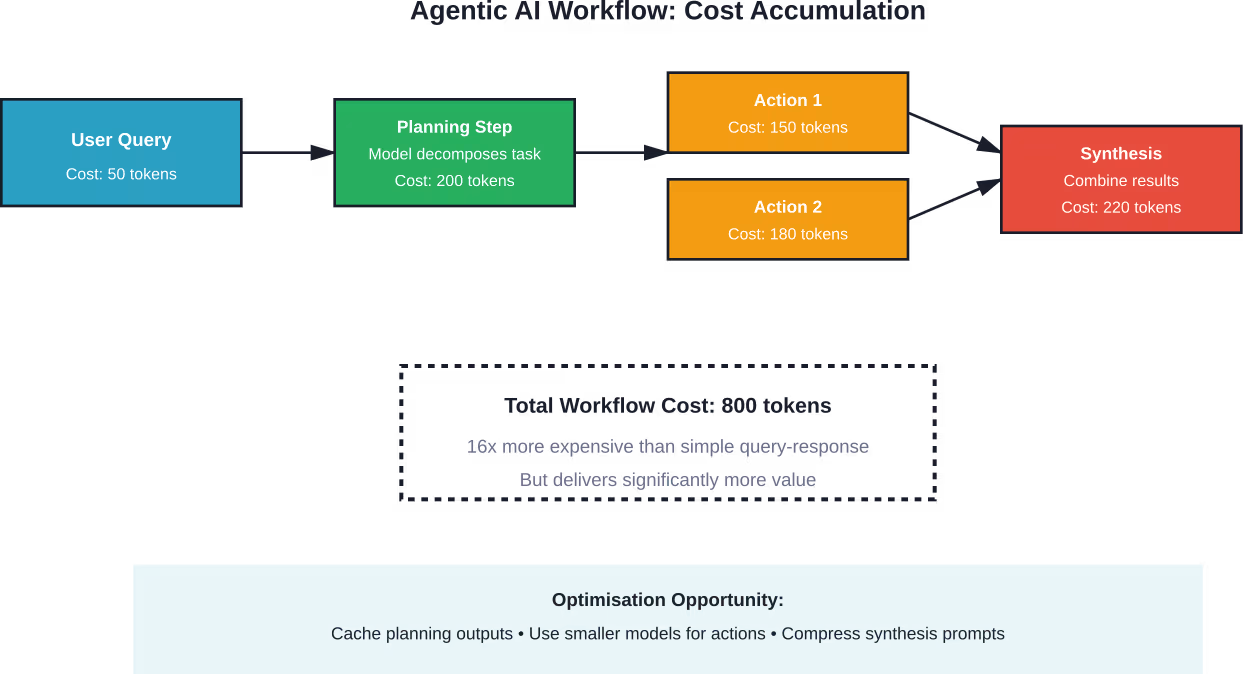

Agentische AI-systemen die taken in meerdere stappen afhandelen, vertegenwoordigen de volgende grens op het gebied van complexiteit en kostenbeheersing.

Deze systemen doen meerdere LLM-aanroepen om individuele gebruikersverzoeken af te handelen. Elke stap verbruikt tokens. Complexe workflows kunnen de kosten snel doen oplopen in vergelijking met eenvoudige vraag-antwoordpatronen.

Werkprocessen waarbij mensen actief betrokken zijn, voegen een extra dimensie toe. Hoewel ze de nauwkeurigheid verbeteren en het vertrouwen vergroten, brengen ze naast computerkosten ook extra arbeidskosten met zich mee.

Het onderzoek van het Regulatory Genome Project naar HITL-systemen benadrukt dat bij de evaluatie rekening moet worden gehouden met de totale efficiëntie van begin tot eind. Een model dat per zoekopdracht iets duurder is, kan de totale kosten verlagen als het de stappen van menselijke beoordeling elimineert.

Toekomstige kostentrends en -voorspellingen

De kosten van LLM (Leadership and Liaison Management) zijn over het algemeen gedaald als gevolg van toenemende concurrentie en verbeterde efficiëntie. Het voorspellen van toekomstige prijzen blijft echter een uitdaging.

Verschillende factoren wijzen op aanhoudende kostenverlagingen. Modelcompressietechnieken verbeteren de efficiëntie. Verbeteringen in hardware verminderen de rekenkracht die nodig is. Toenemende concurrentie zet aanbieders onder druk om de prijzen te verlagen.

De vraag naar geavanceerdere functionaliteiten zou deze besparingen echter kunnen tenietdoen. Naarmate organisaties LLM's inzetten voor steeds complexere taken, verbruiken ze mogelijk meer tokens per interactie, zelfs als de prijs per token daalt.

De open-sourcefactor

Open source LLM's zorgen voor concurrentiedruk op commerciële prijzen. Organisaties die bereid zijn hun eigen infrastructuur te beheren, kunnen de kosten aanzienlijk verlagen.

Maar zelfhosting is niet gratis. Hardware, energie, onderhoud en expertise brengen allemaal kosten met zich mee. Voor veel Britse bedrijven blijven commerciële API's voordeliger dan zelfgehoste alternatieven, vooral bij lagere gebruiksvolumes.

Onderzoek van het Generative AI Laboratory aan de Universiteit van Edinburgh benadrukt de druk die AI uitoefent op open toegankelijke bronnen. De kosten voor het gratis aanbieden van bronnen rijzen de pan uit, wat een spanning creëert tussen de idealen van openheid en economische duurzaamheid.

Best practices voor budgettering en kostenprognoses

Effectief kostenbeheer voor LLM-programma's begint met een realistische begroting. Veel organisaties vinden het echter lastig om de uitgaven nauwkeurig te voorspellen.

Het vaststellen van gebruiksbaselines

Voordat u overgaat tot implementatie in productie, is het raadzaam om uitgebreide pilots uit te voeren. Houd het daadwerkelijke tokenverbruik bij voor representatieve workloads. Gebruikspatronen wijken vaak sterk af van de initiële schattingen.

Houd rekening met seizoensschommelingen. Veel zakelijke applicaties vertonen cyclische gebruikspatronen. Budgetteer voor piekperioden, niet alleen voor het gemiddelde.

Het inbouwen van buffers en reservemogelijkheden.

Het tokenverbruik kan onverwacht sterk stijgen. Systeemfouten, veranderingen in gebruikersgedrag of een uitbreiding van het tokengebruik kunnen allemaal leiden tot hogere kosten dan verwacht.

Over het algemeen biedt het toevoegen van een reserve van 20-30% aan LLM-budgetten een redelijke bescherming tegen budgetoverschrijdingen. Een kleinere reserve is geschikt voor volwassen implementaties met vastgestelde gebruikspatronen.

Regelmatige evaluatie- en optimalisatiecycli

De kosten van LLM zijn niet eenmalig. Regelmatige evaluaties brengen optimalisatiemogelijkheden aan het licht. Zoekpatronen veranderen. Nieuwe, efficiëntere modellen komen beschikbaar. Prijsstructuren evolueren.

Driemaandelijkse kostenanalyses werken goed voor de meeste organisaties. Gebruikers met een hoog volume kunnen baat hebben bij maandelijkse analyses.

Verlaag de kosten van een LLM-opleiding voordat je je vastlegt.

De kosten van LLM-programma's in het Verenigd Koninkrijk lopen vaak op in de data- en trainingsfase, vooral wanneer modellen worden gebouwd zonder een duidelijke structuur. AI Superieur De focus ligt op het bouwen en implementeren van LLM-systemen van begin tot eind, van dataverzameling, voorbewerking en modelontwerp tot training en finetuning. In plaats van deze stappen afzonderlijk te behandelen, wordt het werk vanaf het begin op elkaar afgestemd, wat herwerk voorkomt en de budgetten voorspelbaarder houdt.

Het team werkt doorgaans met bedrijven die productiegereedde systemen nodig hebben, geen experimenten. Ze combineren AI-consultancy met volledige ontwikkeling om modellen af te stemmen op concrete zakelijke toepassingen. Als u een LLM-project plant of de kosten voor data, training en implementatie wilt beheersen, is het verstandig om vroegtijdig een tweede mening te vragen. Neem contact op met AI Superieur Je aanpak herzien voordat de kosten definitief vaststaan.

Veelgestelde vragen

Wat zijn de gemiddelde maandelijkse kosten voor een LLM-opleiding aan Britse bedrijven?

De kosten variëren enorm, afhankelijk van het gebruiksvolume en het gekozen model. Kleine bedrijven die eenvoudige chatbots gebruiken, betalen mogelijk tussen de £50 en £200 per maand. Middelgrote organisaties met meerdere applicaties zien hun maandelijkse kosten doorgaans tussen de £500 en £5.000 liggen. Grote ondernemingen met uitgebreide implementaties kunnen tienduizenden ponden per maand uitgeven. Prijsstelling op basis van tokens betekent dat de kosten direct schalen met het gebruik, waardoor generalisaties moeilijk zijn zonder de specifieke kenmerken van de werkbelasting te kennen.

Zijn abonnementsplannen of betalen per gebruik voordeliger voor Britse bedrijven?

Het hangt af van de voorspelbaarheid van het gebruik. Abonnementen werken goed voor consistente, voorspelbare workloads en bieden budgetzekerheid. Betalen per gebruik is geschikt voor variabele gebruikspatronen, testomgevingen en organisaties die de vraag willen valideren. Veel Britse bedrijven gebruiken hybride benaderingen: basisabonnementen voor voorspelbaar werk met betalen per gebruik voor piekbelastingen. Analyseer historische gebruikspatronen om te bepalen welk model het beste aansluit bij de werkelijke verbruikspatronen.

Kunnen kleinere modellen de kosten verlagen zonder dat dit ten koste gaat van de kwaliteit?

Absoluut. Onderzoek van Cambridge bevestigt dat gespecialiseerde modellen vaak beter presteren dan algemene modellen voor specifieke taken, terwijl ze ook nog eens minder kosten. Niet elke query vereist het grootste beschikbare model. Eenvoudige classificatie, routinematige klantenservice en ongecompliceerde data-extractie werken prima met kleinere modellen. Reserveer premium modellen voor complexe redeneertaken die echt geavanceerde mogelijkheden vereisen. Door verschillende modellen te testen met daadwerkelijke workloads, wordt de optimale balans tussen kosten en prestaties gevonden.

Welke verborgen kosten moeten Britse organisaties budgetteren, naast de API-kosten?

Integratie- en ontwikkeltijd vertegenwoordigen aanzienlijke initiële kosten. API-beheer- en monitoringtools brengen doorlopende kosten met zich mee. Test- en ontwikkelomgevingen verbruiken tokens los van het gebruik in de productieomgeving. De kosten voor handmatige controle van workflows met menselijke tussenkomst kunnen de computerkosten overstijgen. Het trainen van personeel om effectief met LLM's te werken, vereist een tijdsinvestering. Ten slotte moeten organisaties budgetteren voor periodieke optimalisatie om kostenstijgingen te voorkomen naarmate het gebruik toeneemt.

Hoe kan de kostenbesparing van 90% van de Universiteit van Manchester worden toegepast?

De LangVAE- en LangSpace-frameworks richten zich specifiek op de benodigde controle- en testresources. Organisaties die prioriteit geven aan verklaarbaarheid en betrouwbaarheid – met name in gereguleerde sectoren – kunnen deze frameworks gebruiken om taalrepresentaties te comprimeren. Hierdoor wordt het onderzoeken en aanpassen van LLM-gedrag aanzienlijk efficiënter. Hoewel de frameworks zich richten op specifieke aspecten van LLM-bewerkingen in plaats van algemene inferentiekosten, kunnen ze de totale eigendomskosten voor organisaties die strenge test- en controlemechanismen vereisen, aanzienlijk verlagen.

Welke kostenreferentiewaarden zouden Britse bedrijven moeten hanteren voor verschillende sectoren?

De financiële sector heeft doorgaans hogere kosten per medewerker voor LLM-systemen vanwege compliance, fraudedetectie en documentverwerking. Zorginstellingen worden geconfronteerd met complexe vragen die geavanceerde modellen vereisen, wat de kosten per interactie opdrijft, terwijl de volumes lager liggen. De detailhandel en e-commerce verwerken vaak grote volumes aan minder complexe taken met bescheiden kosten per vraag. Professionele dienstverleners zoals advocatenkantoren en consultants laten wisselende patronen zien: sommige bedrijven gebruiken LLM-systemen uitgebreid voor onderzoek en het opstellen van documenten, andere minimaal. Focus in plaats van sectorbenchmarks op gebruiksspecifieke meetwaarden die aansluiten bij de geleverde bedrijfswaarde.

Zouden Britse organisaties moeten overwegen om open source-modellen zelf te hosten?

Zelfhosting is zinvol in specifieke scenario's: zeer hoge gebruiksvolumes waarbij de kosten per token onbetaalbaar worden, strenge eisen op het gebied van datasoevereiniteit of de noodzaak tot uitgebreide modelaanpassing. Zelfhosting vereist echter investeringen in hardware, energiekosten, expertise op het gebied van onderhoud en continue modelupdates. Voor de meeste Britse bedrijven met een maandelijks gebruik van minder dan 10 miljoen tokens blijven commerciële API's economischer. Organisaties dienen de totale eigendomskosten, inclusief infrastructuur, personeel en opportuniteitskosten, te berekenen voordat ze overgaan tot zelfhosting.

Conclusie

De kosten van een LLM-opleiding in het Verenigd Koninkrijk blijven evolueren naarmate de technologie zich verder ontwikkelt en de toepassing ervan toeneemt. Inzicht in prijsmodellen, optimalisatie van het gebruik en de selectie van geschikte modellen dragen allemaal bij aan kostenbeheersing.

Het onderzoek van Manchester, dat een reductie van 90% in de benodigde controlemiddelen aantoont, laat zien dat baanbrekende efficiëntiewinsten nog steeds mogelijk zijn. Naarmate frameworks en technieken zich verder ontwikkelen, kunnen organisaties die bereid zijn te investeren in optimalisatie aanzienlijke besparingen realiseren.

Maar kosten mogen niet de enige overweging zijn. Het onderzoek van het Regulatory Genome Project naar HITL-systemen herinnert ons eraan dat de totale efficiëntie van begin tot eind belangrijker is dan de prijs per token. Een iets duurder model dat menselijke controle overbodig maakt of het foutpercentage verlaagt, kan uiteindelijk een betere prijs-kwaliteitverhouding bieden.

Voor Britse bedrijven die de implementatie van LLM overwegen, is het belangrijk om te beginnen met duidelijke gebruiksscenario's en realistische gebruiksverwachtingen. Voer pilots uit om een basislijn vast te stellen. Implementeer monitoring vanaf dag één. En onthoud: de duurste fout is niet te veel uitgeven aan tokens, maar het implementeren van systemen die geen zakelijke waarde opleveren.

Bent u klaar om uw LLM-kosten te optimaliseren? Begin met het analyseren van uw huidige gebruikspatronen, het identificeren van snelle winsten door middel van directe optimalisatie en het evalueren of gespecialiseerde modellen efficiënter kunnen zijn voor toepassingen met een hoog volume. De juiste strategie balanceert kostenefficiëntie met de waarde die deze krachtige tools kunnen leveren.