Belangrijkste punten: De kosten voor AI-data-annotatie variëren van 1 tot 12 ton per uur voor basistaken, met prijsmodellen zoals uurtarieven, kosten per eenheid en projectcontracten. De kosten variëren afhankelijk van de complexiteit van de annotatie, de vereiste expertise, de geografische locatie, de kwaliteitseisen en de omvang van het project. Uit branchegegevens blijkt dat organisaties tot wel 951 ton aan annotaties verspillen als gevolg van inefficiënte processen.

De basis van elk succesvol AI-model ligt niet in complexe algoritmen of enorme computerclusters. Het ligt in geannoteerde data. Schone, precieze, gelabelde informatie die machines leert wat ze moeten herkennen.

Maar er is een addertje onder het gras: data-annotatie is niet goedkoop. En als de prijsmodellen niet goed begrepen worden, lopen de kosten snel op.

In 2026 staan organisaties onder steeds grotere druk om kwaliteit in evenwicht te brengen met budgettaire beperkingen. Recente marktprognoses laten zien dat de wereldwijde markt voor data-annotatie blijft groeien, gedreven door de vraag naar computervisie, natuurlijke taalverwerking en autonome systemen.

De vraag is niet of annotatiekosten ertoe doen. Het gaat erom hoe we ze kunnen voorspellen, beheersen en optimaliseren zonder de kwaliteit op te offeren die de modelprestaties bepaalt.

Inzicht in prijsmodellen voor AI-data-annotatie

De prijsstelling voor annotaties is niet uniform. Verschillende projecttypen vereisen verschillende factureringsstructuren, en een verkeerde keuze kan leiden tot budgetoverschrijdingen.

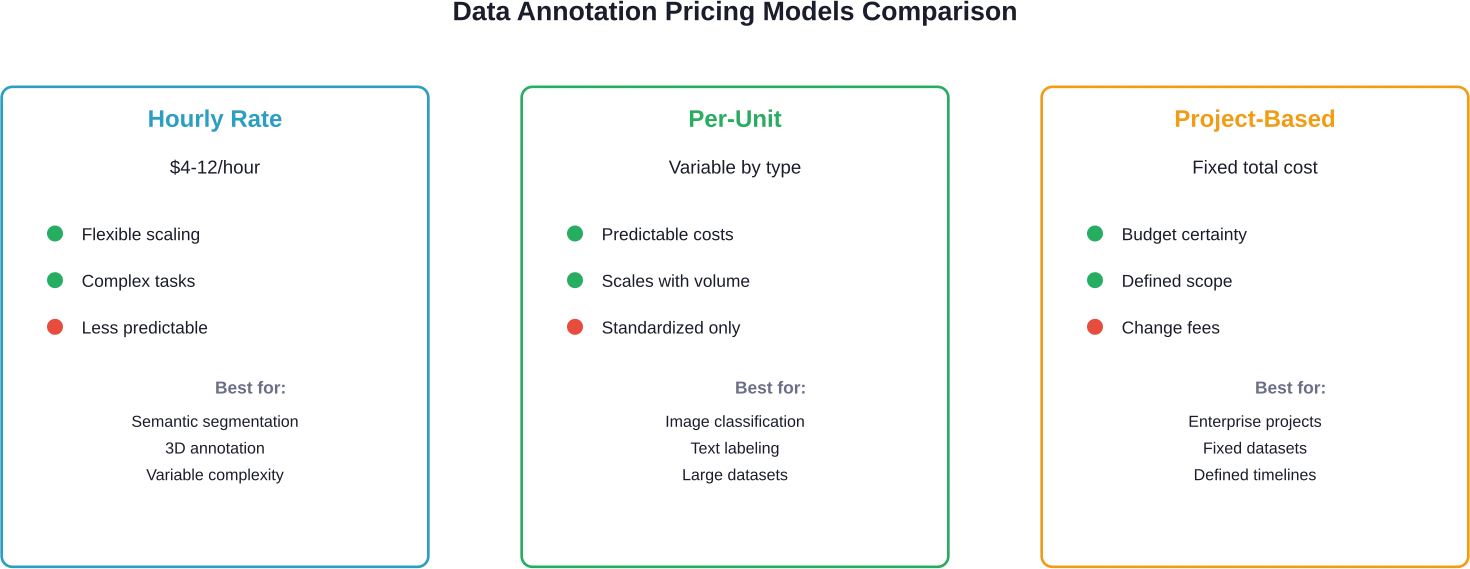

Drie hoofdmodellen domineren de markt. Elk model heeft specifieke voordelen, afhankelijk van de omvang, de planning en de complexiteit van het project.

Uurtarief

Bij dit model wordt gefactureerd op basis van de tijd die de annotator besteedt, in plaats van op basis van de hoeveelheid output. De tarieven variëren doorgaans van $4 tot $12 per uur, afhankelijk van de expertise van de annotator en de geografische locatie.

Uurtarieven werken het beste voor complexe, variabele taken waarbij de annotatietijd per eenheid sterk fluctueert – denk aan gedetailleerde semantische segmentatie of 3D-beeldannotatie. Wanneer de complexiteit van de taak het moeilijk maakt om de output te voorspellen, bieden uurtarieven flexibiliteit.

Het nadeel? Minder voorspelbare totale kosten voor grote datasets.

Prijs per eenheid

Bij modellen waarbij per annotatie betaald wordt, worden vaste tarieven gehanteerd voor elk voltooid item: per kader, per gelabelde afbeelding, per getranscribeerd audiofragment.

Deze aanpak is geschikt voor gestandaardiseerde taken met een constante complexiteit. Eenvoudige beeldclassificatie of basistekstlabeling profiteert van modellen per eenheid, omdat de kosten voorspelbaar schalen met de omvang van de dataset.

Aanbieders hanteren doorgaans getrapte tarieven per eenheid op basis van afnamevolumes.

Projectgebaseerde contracten

Vaste-prijsafspraken dekken complete annotatieprojecten van begin tot eind. Leveranciers geven vooraf een totaalprijsopgave op basis van de omvang van de dataset, het type annotatie en de kwaliteitseisen.

Prijsstelling op projectbasis vermindert de onzekerheid over de facturering, maar vereist een gedetailleerde omschrijving van de projectomvang. Wijzigingen halverwege het project leiden vaak tot extra kosten.

Grote ondernemingen met goed gedefinieerde datasets geven de voorkeur aan dit model voor budgetvoorspelbaarheid.

Belangrijkste factoren die de annotatiekosten beïnvloeden

Het begrijpen van prijsmodellen is niet voldoende. Meerdere variabelen beïnvloeden de uiteindelijke kosten, en een aantal daarvan zijn niet direct duidelijk.

Complexiteit en type van annotaties

Simpele taken kosten minder. Punt.

Basisbeeldclassificatie – het labelen van foto's als 'kat' of 'hond' – vereist minimale tijd en expertise. Annotatie met begrenzingskaders kost meer, omdat annotatoren precieze rechthoeken rond objecten tekenen.

Semantische segmentatie? Dat is een heel ander niveau. Maskers op pixelniveau vereisen nauwgezet werk, wat zowel de tijd als de kosten verhoogt. 3D-annotatie voor de training van autonome voertuigen bevindt zich in het topsegment en vereist gespecialiseerde vaardigheden en tools.

Tekstannotatie volgt vergelijkbare patronen. Eenvoudige sentimentlabeling is goedkoper dan named entity recognition, wat op zijn beurt minder kost dan complexe relatie-extractie.

Vereiste expertise en specialisatie

Algemene data-annotatie – basistaken zoals labelen, rangschikken en het uitvoeren van taken op basis van richtlijnen – valt in de categorie 'minderwaardig'. Uit discussies binnen de community blijkt dat de gemiddelde snelheid voor algemene data-annotatie voor dit werk doorgaans rond de 1 TP4 TP8-20 per uur ligt.

Vakinhoudelijke expertise maakt alles mogelijk. Voor het annoteren van medische beelden zijn radiologen of getrainde technici nodig die anatomische structuren begrijpen. Voor de classificatie van juridische documenten zijn annotatoren nodig die bekend zijn met juridische terminologie en concepten.

Gespecialiseerde kennis brengt hogere tarieven met zich mee, soms verdubbelen of verdrievoudigen de kosten in vergelijking met algemeen werk.

Geografische locatie

De locatie waar de annotatie plaatsvindt, heeft een aanzienlijke invloed op de prijs. De arbeidskosten variëren sterk per regio.

Annotatoren in Noord-Amerika en West-Europa rekenen doorgaans hogere tarieven voor complexe taken dan in andere regio's. Teams in Oost-Europa bieden een gemiddelde prijsklasse. De markten in Zuidoost-Azië en Afrika bieden kosteneffectieve opties met behoud van kwaliteit dankzij gedegen training en kwaliteitscontrole.

De toename van werken op afstand heeft de toegang tot wereldwijde talentpools vergroot, waardoor organisaties kosten en kwaliteit in verschillende geografische gebieden beter op elkaar kunnen afstemmen.

Kwaliteitseisen en validatie

Hogere nauwkeurigheidseisen brengen hogere kosten met zich mee. Wanneer modellen een annotatieprecisie van 95%+ vereisen, is meerlaagse kwaliteitsborging noodzakelijk.

Kwaliteitsborging omvat doorgaans het labelen van dezelfde gegevens door meerdere annotatoren, een deskundige beoordeling van afwijkingen en validatierondes. Elke QA-laag voegt 20-40% toe aan de basiskosten.

Onderzoek naar crowd-annotatie laat zien dat het samenvoegen van zachte labels van meerdere annotatoren zowel de voorspellende prestaties als de onzekerheidsschatting kan verbeteren, maar dat vereist wel dat meerdere mensen voor hetzelfde werk worden betaald.

Omvang van de dataset en schaal van het project

Volume creëert onderhandelingsmacht. Grote projecten leveren doorgaans volumekortingen op – soms wel 15 tot 301 ton korting op de basistarieven.

Maar schaalvergroting brengt ook complexiteit met zich mee. Het coördineren van tientallen of honderden annotatoren vereist een goede infrastructuur voor projectmanagement. De trainingskosten voor gespecialiseerde taken worden in grote projecten over meer eenheden verdeeld, waardoor de impact per eenheid afneemt.

Bij kleine pilotprojecten zijn de kosten per eenheid hoger, omdat de opstartkosten over minder onderdelen worden verdeeld.

| Kostenfactor | Impactniveau | Typisch bereik | Optimalisatiestrategie

|

|---|---|---|---|

| Annotatiecomplexiteit | Zeer hoog | 2-10x variatie | Vooraf labelen met automatisering waar mogelijk |

| Vereiste expertise | Hoog | 1,5-3x variatie | Combineer deskundige beoordelingen met algemene annotatoren. |

| Geografische locatie | Hoog | 2-4x variatie | Offshore opslag voor niet-gevoelige gegevens |

| Kwaliteitseisen | Middelhoog | +20-60% kosten | Risicogebaseerde kwaliteitsborging (steekproefvalidatie versus volledige validatie) |

| Datasetvolume | Medium | 15-30% korting op schaal | Batchverwerking om volumekorting te ontgrendelen |

Verminder verspilling bij het annoteren van AI-gegevens met deskundige begeleiding van AI Superior.

De kosten voor annotatie zijn afhankelijk van de omvang en complexiteit van de dataset, de vereisten voor kwaliteitscontrole en de expertise op het betreffende vakgebied. AI Superieur Helpt bedrijven bij het definiëren van annotatiestrategieën die een balans vinden tussen nauwkeurigheid en budget.

Zij bieden:

- Ontwerp van annotatieworkflows

- Kwaliteitsborgingskader

- Richtlijnen voor gereedschapsselectie

- Gegevensvalidatie vóór modeltraining

Voordat er grote budgetten worden toegewezen aan etikettering, Werk samen met AI Superior Om precies te bepalen welke gegevens nodig zijn en onnodige kosten voor annotaties te vermijden.

De crisis van de verborgen kosten: verspilde annotaties

Dit is iets waar de meeste organisaties niet over praten: verspilling.

Organisaties besteden aanzienlijke middelen aan het handmatig aanmaken van data-annotaties die ze nooit gebruiken. Volgens sommige schattingen gebruiken organisaties 951 TP3T van hun data-annotaties nooit, wat neerkomt op een enorme verspilling van middelen.

Naar verluidt gooit één organisatie 499 van de 500 annotaties weg. Laat dat even tot je doordringen.

Waarom gebeurt dit? Verschillende redenen spelen een rol:

Teams annoteren datasets te uitgebreid zonder duidelijke modelvereisten. Productvereisten veranderen halverwege het project, waardoor bestaande annotaties irrelevant worden. Kwaliteitsproblemen met annotaties leiden tot volledig herwerk. Modellen behalen acceptabele prestaties met veel minder data dan aanvankelijk geannoteerd.

Deze verspilling vertegenwoordigt niet alleen financieel verlies, maar ook gemiste kansen: budgetten die worden opgeslokt door onnodige annotaties kunnen niet worden gebruikt voor modelontwikkeling of infrastructuurverbeteringen.

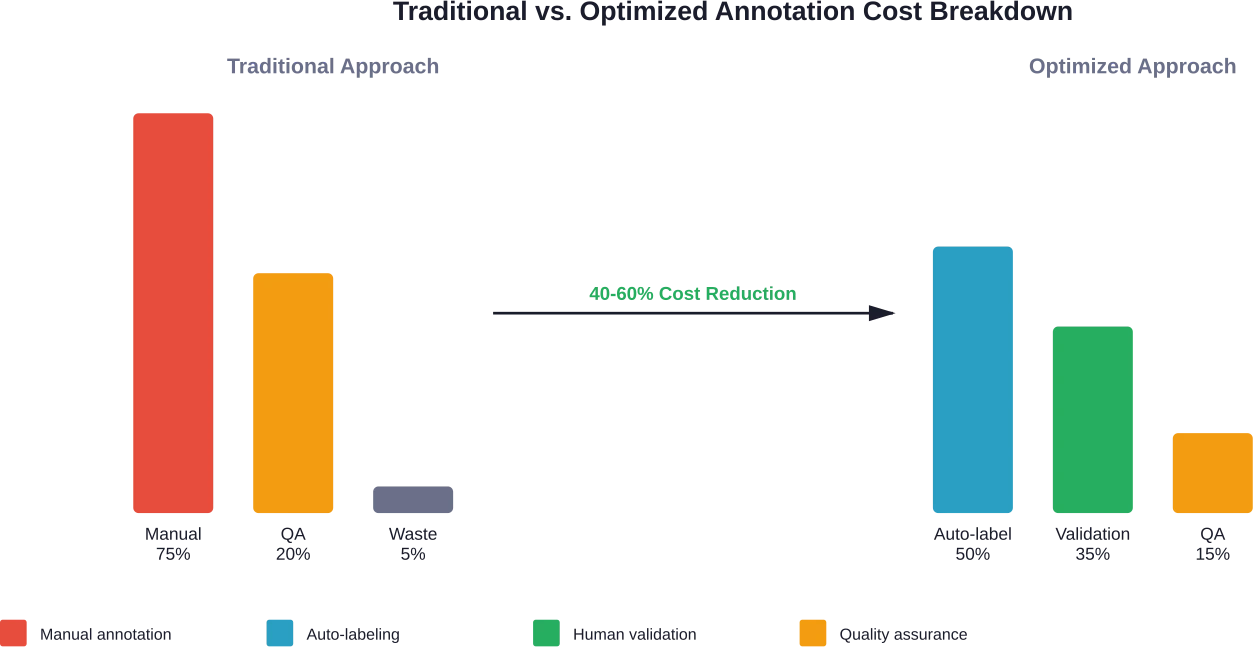

Automatische etikettering en efficiëntieverbeteringen

Technologie verandert de economie. Automatische labeling maakt gebruik van vooraf getrainde modellen om initiële annotaties te genereren, die vervolgens door mensen worden gecontroleerd en gecorrigeerd.

Deze aanpak kan de annotatietijd met 50-80% verkorten voor geschikte taken. In plaats van helemaal opnieuw te annoteren, valideren medewerkers machinaal gegenereerde labels – sneller en goedkoper.

Actieve leertechnieken identificeren welke data het meest geschikt zijn voor modeltraining, waardoor selectieve annotatie van waardevolle datapunten mogelijk is in plaats van uitputtende labeling. Onderzoek toont aan dat met minder dan 81 TP3T aan data gelabeld met behulp van actieve leertechnieken acceptabele modelprestaties haalbaar zijn.

Maar het punt is: automatisering werkt het beste voor bestaande toepassingen met vooraf getrainde modellen. Nieuwe taken of unieke domeinen vereisen nog steeds aanzienlijke handmatige inspanning.

Intern versus uitbesteden: kostenvergelijking

Het opzetten van interne annotatieteams of het uitbesteden ervan is een fundamentele budgettaire beslissing. Geen van beide opties is altijd de beste – de context is van belang.

Kosten voor interne annotatie

Interne teams zorgen voor controle en domeinintegratie. Annotatoren werken nauw samen met datawetenschappers, wat snelle feedbackcycli en een diepgaand begrip van de modelvereisten mogelijk maakt.

Maar de totale kosten omvatten meer dan alleen salarissen. Denk ook aan werving, training, managementkosten, annotatietools, werkruimte en secundaire arbeidsvoorwaarden. De totale jaarlijkse kosten per annotator voor interne teams kunnen in ontwikkelde markten aanzienlijk zijn.

Voor organisaties met een continue behoefte aan annotaties en gevoelige gegevens die niet buiten de interne systemen mogen worden opgeslagen, zijn interne teams een logische keuze. De initiële investering wordt terugverdiend over de lopende projecten.

Economie van outsourcing

Outsourcing zet vaste kosten om in variabele kosten. U betaalt alleen voor het daadwerkelijke annotatiewerk en hoeft geen vast personeel aan te houden tijdens rustige periodes.

Gespecialiseerde leveranciers bieden getrainde teams, vastgestelde werkprocessen en kwaliteitskaders. De implementatie verloopt sneller: leveranciers kunnen binnen enkele dagen tientallen annotatoren inzetten, in tegenstelling tot interne werving die maanden in beslag neemt.

Nadelen zijn onder meer minder directe controle, mogelijke communicatieproblemen en overwegingen met betrekking tot gegevensbeveiliging. Zeer vertrouwelijke datasets kunnen te maken krijgen met beperkingen op het delen met externe partijen.

Veel organisaties hanteren hybride modellen: ze behouden kleine interne teams voor gevoelig werk, terwijl ze gestandaardiseerde taken met een hoog volume uitbesteden.

Budgettering voor data-annotatieprojecten

Een nauwkeurige budgetprognose voorkomt verrassingen halverwege het project. Verschillende stappen verbeteren de nauwkeurigheid van de schatting.

Definieer de reikwijdte nauwkeurig.

Vage eisen leiden tot vage offertes. Specificeer de benodigde annotatietypen, de verwachte kwaliteitsniveaus, de omvang van de dataset en de tijdsbeperkingen.

Stel vroegtijdig richtlijnen voor annotaties op; zelfs ruwe versies helpen leveranciers de complexiteit in te schatten. Voorbeeldgegevenssets onthullen uitzonderlijke gevallen die van invloed zijn op de benodigde inspanning.

Houd rekening met verborgen kosten.

Budgetposten die verder gaan dan de basisannotatie omvatten:

Ontwikkeling en verfijning van richtlijnen. Training van annotatoren in domeinspecifieke vereisten. Kwaliteitsborging en testen van de overeenstemming tussen annotatoren. Herwerk voor mislukte validatiebatches. Projectmanagement en communicatiekosten. Licenties voor tools indien gebruik wordt gemaakt van gespecialiseerde annotatieplatformen.

Het is raadzaam om bij de eerste schattingen rekening te houden met onvoorziene omstandigheden. Annotatieprojecten brengen steevast onverwachte complexiteit aan het licht.

Proefproject vóór opschaling

Kleine proefseries van 500 tot 1000 items geven inzicht in de werkelijke annotatiesnelheid en kwaliteitsniveaus voordat er met volledige datasets wordt gewerkt. Proefseries kosten meer per eenheid, maar voorkomen kostbare fouten op grote schaal.

Gebruik de resultaten van de pilot om richtlijnen te verfijnen, kwaliteitsprocessen aan te passen en budgetramingen bij te stellen op basis van de waargenomen prestaties.

Overweeg iteratieve financiering.

In plaats van complete datasets vooraf te annoteren, kun je de annotatie faseren met de modelontwikkeling. Annoteer minimaal noodzakelijke datasets, train de eerste modellen en annoteer vervolgens aanvullende data op basis van modelprestaties en foutenanalyse.

Actief leren identificeert welke extra voorbeelden het belangrijkst zijn, waardoor verspilling van tijd aan annotaties die de nauwkeurigheid van het model niet verbeteren, wordt voorkomen.

| Annotatiebenadering | Gemiddelde kosten per 1.000 afbeeldingen | Tijdlijn | Beste toepassing

|

|---|---|---|---|

| Eenvoudige classificatie | $50-$150 | 1-2 dagen | Categorie-etikettering, contentmoderatie |

| Begrenzingskaders | $200-$600 | 3-5 dagen | Objectdetectie, winkelvoorraadbeheer |

| Semantische segmentatie | $800-$2,500 | 1-2 weken | Autonome voertuigen, medische beeldvorming |

| 3D-annotatie | $2,000-$6,000 | 2-3 weken | LIDAR, robotica, ruimtelijke kartering |

| Video-annotatie | $1,500-$4,000 | 1-3 weken | Actieherkenning, surveillance |

De juiste annotatiepartner kiezen

Voor organisaties die annotatie uitbesteden, heeft de keuze van de leverancier invloed op zowel de kosten als de kwaliteit. Naast de prijs zijn er diverse andere criteria van belang.

Kwaliteitsborgingsprocessen

Vraag hoe leveranciers de kwaliteit meten en waarborgen. Validatie op meerdere niveaus, overeenstemmingsstatistieken tussen beoordelaars en beoordelingscycli door experts duiden op vol成熟e processen.

Vraag om proefprojecten om de werkelijke kwaliteit te evalueren voordat u zich vastlegt op grote contracten. Kwaliteitsproblemen die pas laat worden ontdekt, kosten veel meer om te verhelpen dan validatie vooraf.

Domeinexpertise

Algemene annotatiebureaus voeren standaardtaken goed uit. Gespecialiseerde domeinen – medisch, juridisch, wetenschappelijk – profiteren van leveranciers met relevante ervaring en getrainde annotatoren.

Raadpleeg casestudies en referenties uit vergelijkbare sectoren. Vakinhoudelijke kennis en begrip van concepten hebben een aanzienlijke invloed op de efficiëntie.

Schaalbaarheid en flexibiliteit

Projectbehoeften veranderen. Kunnen leveranciers hun capaciteit snel op- of afschalen? Welke minimale verplichtingen zijn er in contracten vastgelegd?

Flexibele contractmodellen voorkomen dat u betaalt voor ongebruikte capaciteit of wekenlang moet wachten op een toename van het volume.

Gegevensbeveiliging en naleving van regelgeving

Voor gevoelige datasets zijn leveranciers met de juiste beveiligingscertificeringen nodig, zoals SOC 2, ISO 27001, HIPAA-conformiteit voor zorggegevens en GDPR-conformiteit voor Europese gegevens.

Begrijp waar annotatie geografisch plaatsvindt en of dat tot regelgevingsproblemen leidt. Sommige sectoren stellen beperkingen aan de locaties waar gegevens worden verwerkt.

Technologieplatform

Moderne annotatieplatformen versnellen het werk dankzij slimme tools, zoals suggesties voor het vooraf labelen, sneltoetsen en geautomatiseerde kwaliteitscontroles.

Leveranciers die verouderde interfaces gebruiken, zijn duurder omdat annotatie meer tijd in beslag neemt. Vraag tijdens de evaluatie om platformdemonstraties.

Toekomstige trends die van invloed zijn op de annotatiekosten

De komende jaren zullen verschillende opkomende trends de economie van annotaties ingrijpend veranderen.

Basismodellen en transfer learning verminderen de annotatievereisten voor veel taken. Modellen die zijn getraind op enorme datasets hebben minder taakspecifieke gelabelde data nodig om goede prestaties te leveren.

Synthetische datageneratie creëert programmatisch gelabelde trainingsdata, waardoor de afhankelijkheid van menselijke annotatie voor bepaalde computervisie-toepassingen mogelijk wordt verminderd.

Verbeterde actieve leertechnieken worden steeds slimmer in het identificeren van waardevolle voorbeelden, waardoor de modelverbetering per bestede dollar aan annotatie wordt gemaximaliseerd.

Maar wat is de keerzijde? Complexere AI-toepassingen – multimodale modellen, belichaamde AI, genuanceerd taalbegrip – vereisen rijkere, meer geavanceerde annotaties. Simpele labels volstaan niet.

De markt voor annotaties zal zich waarschijnlijk opsplitsen: standaardlabels worden steeds meer geautomatiseerd en goedkoper, terwijl gespecialiseerde, hoogwaardige annotaties voor geavanceerde toepassingen een hogere prijs zullen vragen.

Veelgestelde vragen

Wat zijn de gemiddelde kosten per uur voor data-annotatie?

De kosten voor data-annotatie variëren doorgaans van $4 tot $12 per uur voor basiswerk, afhankelijk van de geografische locatie en de complexiteit van de taak. Gespecialiseerde annotatie, waarvoor domeinexpertise vereist is, kan in ontwikkelde markten hogere tarieven opleveren. De tarieven zijn sterk afhankelijk van het type annotatie, de kwaliteitseisen en het vaardigheidsniveau van de annotator.

Wat zijn de kosten voor het annoteren van 10.000 afbeeldingen?

De kosten voor beeldannotatie zijn sterk afhankelijk van de complexiteit en variëren per aanbieder en projectspecificaties. De kosten stijgen naarmate het type annotatie complexer is, zoals bounding boxes, semantische segmentatie en 3D-annotatie.

Is annotatie intern goedkoper dan uitbesteden?

Niet per se. Hoewel de uurtarieven voor interne medewerkers lager lijken, omvatten de totale kosten van interne teams salarissen, secundaire arbeidsvoorwaarden, training, management, tools en werkruimte – en dat kan aanzienlijk zijn. Outsourcing zet deze vaste kosten om in variabele kosten en maakt snellere schaalvergroting mogelijk. Interne teams zijn zinvol voor continue behoeften en gevoelige gegevens; outsourcing werkt beter voor variabele werklasten.

Hoe kunnen organisaties de annotatiekosten verlagen zonder in te boeten aan kwaliteit?

Verschillende strategieën verlagen de kosten met behoud van kwaliteit: gebruik automatische labeling met menselijke validatie om de handmatige inspanning met 50-80% te verminderen, pas actief leren toe om alleen waardevolle monsters te annoteren, implementeer risicogebaseerde kwaliteitsborging in plaats van alles te beoordelen, begin met pilotprojecten om processen te verfijnen en profiteer van geografische arbitrage door samen te werken met offshore kwaliteitsteams.

Welk percentage van het budget voor annotaties moet worden besteed aan kwaliteitsborging?

Kwaliteitsborging voegt doorgaans 20-401 TP3T toe aan de basiskosten voor annotatie, afhankelijk van de nauwkeurigheidseisen. Bedrijfskritische applicaties die een precisie van 951 TP3T of hoger vereisen, kunnen 40-601 TP3T van het budget toewijzen aan meerlaagse validatie. Minder kritische applicaties kunnen gebruikmaken van op steekproeven gebaseerde kwaliteitsborging tegen een totale kostprijs van 15-251 TP3T. Weeg de investering in kwaliteitsborging af tegen de latere kosten van fouten in productiemodellen.

Waarom verspillen organisaties zoveel geannoteerde data?

Uit schattingen in de sector blijkt dat organisaties nooit 95% van hun annotaties gebruiken vanwege verschillende factoren: overmatige annotatie zonder duidelijke modelvereisten, veranderende productspecificaties halverwege het project, kwaliteitsproblemen die herwerk noodzakelijk maken en modellen die acceptabele prestaties leveren met minder data dan verwacht. Betere planning, iteratieve annotatie afgestemd op modelontwikkeling en actieve leerbenaderingen verminderen deze verspilling.

Moeten annotatiekosten als een eenmalige of als doorlopende uitgave worden beschouwd?

De meeste AI-toepassingen vereisen continue annotatie. Modellen moeten worden bijgewerkt naarmate concepten evolueren, uitzonderlijke gevallen zich voordoen en bedrijfsvereisten veranderen. Houd rekening met een budget van 20-401 TP3T aan initiële datasetcreatiekosten per jaar voor continue annotatie. Toepassingen in snel veranderende domeinen vereisen een hoger budget voor continue annotatie om de relevantie en nauwkeurigheid van het model te behouden.

Slimme investeringsbeslissingen nemen op het gebied van annotaties

De kosten voor data-annotatie vormen een aanzienlijk deel van de ontwikkelingskosten van AI, maar slimme aanpakken voorkomen budgetoverschrijdingen en behouden tegelijkertijd de kwaliteit.

De belangrijkste inzichten: prijsmodellen variëren enorm afhankelijk van de complexiteit van de taak, de vereiste expertise en de kwaliteitsnormen. Geografische locatie, projectomvang en leverancierskeuze hebben allemaal invloed op de uiteindelijke kosten. Organisaties verspillen enorme middelen aan onnodige annotaties door gebrekkige planning.

Succesvolle annotatiestrategieën combineren automatisering waar nodig met gerichte menselijke validatie. Pilotprojecten valideren aannames voordat er op grotere schaal wordt gewerkt. Iteratieve benaderingen, afgestemd op de modelontwikkeling, voorkomen overmatige annotatie.

Het allerbelangrijkste is dat annotatie niet zomaar een kostenpost is. Het vormt de fundamentele infrastructuur die de kwaliteit, mogelijkheden en zakelijke waarde van een model bepaalt. Bezuinigen op de kwaliteit van annotaties leidt vaak tot veel hogere kosten verderop in het proces, zoals modelfouten, herwerk en gemiste kansen.

De vraag is niet hoe de annotatiekosten te minimaliseren, maar hoe de investering in annotatie te optimaliseren voor maximale modelprestaties per bestede dollar. Organisaties die dit onderscheid begrijpen, bouwen efficiënter betere AI-systemen.

Klaar om je annotatiebudget te optimaliseren? Begin met een klein pilotproject, meet de werkelijke kosten en kwaliteit, en schaal vervolgens op basis van data in plaats van aannames. De duurste fout bij annotaties is het starten van grootschalig werk voordat je je aanpak hebt gevalideerd.