Het AI-landschap is drastisch veranderd. Drie grote spelers strijden nu om de aandacht van ontwikkelaars: Claude van Anthropic, de GPT-serie van OpenAI en de baanbrekende nieuwkomer DeepSeek.

Maar welk model levert nu echt de beste resultaten? Het antwoord is niet eenvoudig. Elk model heeft zijn eigen sterke punten, en de beste keuze hangt volledig af van wat je wilt bouwen.

Laten we eens bekijken hoe deze modellen presteren op basis van de criteria die er echt toe doen.

Modelaanbod: Waar u nu eigenlijk voor kiest

Inzicht in het huidige aanbod is de eerste stap. Deze bedrijven hebben niet slechts "één model"—ze hebben complete productfamilies ontwikkeld met verschillende prestatieniveaus.

De huidige selectie van Claude

Anthropic biedt begin 2026 drie hoofdmodellen aan. De Claude Opus 4.6 is hun meest intelligente model, speciaal ontworpen voor het bouwen van agents en complexe programmeertaken. De Claude Sonnet 4.6 combineert snelheid met intelligentie, waardoor het hun aanbevolen model is voor dagelijks gebruik. De Claude Haiku 4.5 is de snelste optie met een intelligentie die de grenzen van het mogelijke verlegt.

Claude Opus 4.6 en Claude Sonnet 4.6 (en enkele Sonnet 4.x-varianten) ondersteunen een contextvenster van 1 miljoen tokens in bètaversie via de Claude API, Amazon Bedrock, Google Cloud Vertex AI en Microsoft Foundry.

Het uitgebreide aanbod van OpenAI

Het portfolio van OpenAI is aanzienlijk gegroeid. Hun vlaggenschip GPT-5.2 richt zich op codeer- en agenttaken in diverse sectoren, met een contextvenster van 400.000 tokens en een kennisdeadline van 31 augustus 2025. Input kost 1 TP4T1,75 per miljoen tokens, output 1 TP4T14,00 per miljoen tokens. Input uit de cache daalt tot slechts 1 TP4T0,18 per miljoen tokens.

GPT-4.1 is hun slimste niet-redenerende model, met een indrukwekkend contextvenster van 1.047.576 tokens en een kennisafsluiting op 1 juni 2024. De standaardprijs bedraagt $2,00 per miljoen inputtokens en $8,00 per miljoen outputtokens.

Het assortiment wordt verder uitgebreid met de GPT-5-mini ($0.25 input, $2.00 output per miljoen tokens) en de GPT-5-nano ($0.05 input, $0.40 output per miljoen tokens) voor budgetvriendelijke toepassingen.

De Lean-aanpak van DeepSeek

DeepSeek houdt het simpel. Hun DeepSeek-V3.2 is verkrijgbaar in twee modi: deepseek-chat (niet-denkende modus) en deepseek-reasoner (denkende modus). Beide draaien op hetzelfde basismodel met een contextvenster van 128K.

Volgens de officiële DeepSeek API-documentatie heeft deepseek-chat standaard een maximale uitvoer van 4K (maximaal 8K), terwijl deepseek-reasoner een standaard uitvoer van 32K toestaat (maximaal 64K). De prijsstructuur is opvallend agressief: $0.028 per miljoen inputtokens met cachehits, $0.28 per miljoen standaard inputtokens en $0.42 per miljoen outputtokens.

DeepSeek-V3.2-Speciale tilt de redeneermogelijkheden naar een nog hoger niveau en behaalt gouden prestaties in competities zoals IMO, CMO, ICPC World Finals en IOI 2025. Het is momenteel alleen beschikbaar via de API en biedt geen ondersteuning voor gebruik in tools.

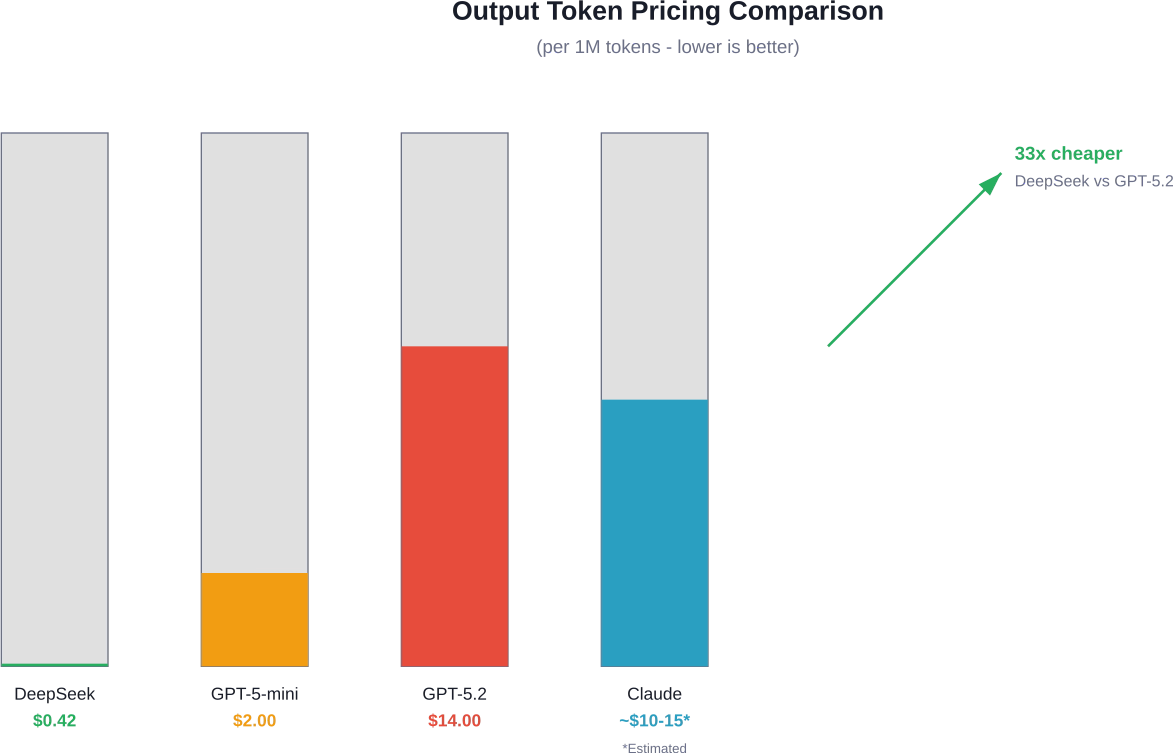

Kosten-prestatieverhouding van belangrijke AI-modellen begin 2026, waaruit het concurrentievoordeel van DeepSeek op het gebied van prijsstelling blijkt.

Codeerprestaties: waar het op aankomt

Ontwikkelaars hechten vooral waarde aan één ding: kan dit model daadwerkelijk goede code schrijven?

Volgens onderzoek van arXiv, waarin deze modellen werden vergeleken op programmeertaken, behaalde DeepSeek concurrerende prestaties tegen aanzienlijk lagere kosten, terwijl Claude over het algemeen aanzienlijk meer per token kost. Dat is een aantrekkelijke waardepropositie voor kostenbewuste teams.

Eerlijk gezegd: het verschil tussen deze modellen op het gebied van programmeertaken is aanzienlijk kleiner geworden. GPT-4.1 biedt evenwichtige programmeermogelijkheden met een sterke Azure-integratie als je al deel uitmaakt van het Microsoft-ecosysteem. Claude Opus blinkt uit in het begrijpen van complexe codebases en het geven van doordachte refactoring-suggesties.

Maar hier wordt het interessant. Volgens benchmarkgegevens behaalde DeepSeek R1 een score van 65,9 op LiveCodeBench (Pass@1-COT), OpenAI o1-1217 scoorde 63,4 en Claude-3.5-Sonnet 33,8, terwijl GPT-4o-0513 een score van 34,2 behaalde.

| Model | HumanEval Score | LiveCodeBench | Beste toepassing

|

|---|---|---|---|

| DeepSeek R1 | 85%+ | 65.9 | Budgetvriendelijke programmeertaken |

| GPT-5.2 | Hoog | ~63-65 | Agentische codeerworkflows |

| Claude Opus 4.6 | Competitief | Niet van toepassing | Complexe refactoring |

| OpenAI o1-1217 | Hoog | 63.4 | Taken die veel redeneervermogen vereisen |

En hoe zit het met programmeren in de praktijk?

Benchmarks vertellen een bepaald verhaal. De daadwerkelijke ontwikkelingswerkzaamheden vertellen een ander verhaal.

Uit discussies binnen de community blijkt dat Claude uitblinkt in het handhaven van een consistente codestijl in grote projecten. GPT-5 kan complexe architectuurkeuzes goed afhandelen, vooral wanneer je meerdere implementatiebenaderingen moet afwegen. DeepSeek verrast ontwikkelaars met zijn vermogen om context te begrijpen, ondanks de lagere prijs.

De waarheid? Voor eenvoudige CRUD-toepassingen en standaard webontwikkelingspatronen presteren ze alle drie uitstekend. De verschillen komen pas aan het licht bij het debuggen van subtiele gelijktijdigheidsproblemen of het refactoren van verouderde systemen.

Redeneervermogen: Hoe diep denken ze?

De o-serie modellen van OpenAI zijn expliciet getraind om "langer na te denken" en een gedachtegang te ontwikkelen voordat ze een antwoord geven. Dit resulteert in een sterke logische redenering bij complexe problemen.

DeepSeek V3.2 in redeneermodus (deepseek-reasoner) concurreert direct in dit segment. Het model behaalde gouden resultaten in wiskundeolympiades en programmeerwedstrijden. DeepSeek-V3.2-Speciale maximaliseert de redeneermogelijkheden om te kunnen wedijveren met geavanceerde modellen zoals Gemini-3.0-Pro, hoewel het een hoger tokenverbruik vereist.

De aanpak van Claude verschilt enigszins. In plaats van een uitgebreide gedachtegang die zichtbaar is voor gebruikers, gebruikt Claude adaptief denken: hij beslist dynamisch wanneer en hoeveel hij moet nadenken op basis van de complexiteit van de taak.

Volgens wetenschappelijk onderzoek van arXiv vertoonden deze modellen, bij vergelijking op wetenschappelijke computertaken, elk een eigen redeneerpatroon. De studie evalueerde de prestaties in verschillende domeinen en concludeerde dat de modelkeuze een significante invloed had op de resultaten, afhankelijk van het specifieke type redenering dat vereist was.

De realiteit van de prijsstelling

Kosten zijn belangrijk. Vooral als je maandelijks miljoenen tokens verwerkt.

Laten we de cijfers eens nader bekijken aan de hand van de officiële prijslijsten.

Prijsstructuur van OpenAI

De standaardverwerkingskosten voor GPT-5.2 bedragen $1,75 per miljoen invoertokens en $14,00 per miljoen uitvoertokens. Bij gecachede invoer dalen de kosten tot $0,175 per miljoen tokens. De Batch API biedt een besparing van 50%, waardoor de invoerkosten $0,875 en de uitvoerkosten $7,00 per miljoen tokens bedragen.

GPT-5-mini biedt een voordeligere optie met $0.25 input en $2.00 output per miljoen tokens (standaardtarieven). GPT-5-nano is nog goedkoper met $0.025 input en $0.20 output per miljoen tokens.

De pro-modellen kosten aanzienlijk meer. GPT-5.2-pro verwerkt $21.00 input en $168.00 output per miljoen tokens.

De prijsstelling van Claude (gebaseerd op historische patronen)

Hoewel de officiële actuele prijs voor Claude Opus 4.6 niet in de documentatie werd vermeld, bleek uit onderzoek van arXiv dat Claude over het algemeen duurder is dan andere AI-benaderingen voor vergelijkbare taken.

Actuele prijsinformatie voor de Claude API is te vinden in de officiële documentatie van Anthropic.

De agressieve prijsstelling van DeepSeek

DeepSeek is aanzienlijk goedkoper dan alle anderen. Volgens hun officiële API-documentatie bedraagt de standaardprijs $0.28 per miljoen inputtokens en $0.42 per miljoen outputtokens. Met cachehits daalt de inputprijs naar slechts $0.028 per miljoen tokens.

Dat is ongeveer 5 tot 50 keer goedkoper dan vergelijkbare modellen, afhankelijk van de configuratie.

Prijsvergelijking van outputtokens die het aanzienlijke kostenvoordeel van DeepSeek ten opzichte van concurrerende modellen aantoont.

Contextvensters en geheugen

Hoeveel informatie kunnen deze modellen tijdens een gesprek in hun 'werkgeheugen' opslaan?

- Claude biedt in de bètaversie een contextvenster van 1 miljoen tokens. Dat is genoeg voor meerdere complete romans of een volledige, omvangrijke codebase. Hierdoor is Claude bijzonder geschikt voor taken die de analyse van enorme documenten of langdurige gesprekken vereisen.

- GPT-5.2 biedt 400.000 tokens, terwijl GPT-4.1 een contextvenster van 1.047.576 tokens biedt. Dit zijn beide aanzienlijke aantallen – meer dan genoeg voor de meeste praktijktoepassingen.

- DeepSeek V3.2 biedt 128.000 tokens, wat minder is, maar nog steeds voldoende voor de meeste taken. De meeste ontwikkelaars zullen deze limiet bij normaal gebruik niet bereiken.

Het praktische gevolg? Als je tools bouwt die complete databestanden analyseren, lange juridische documenten verwerken of zeer lange gesprekken bijhouden, hebben Claude of GPT-4.1 een streepje voor. Voor standaard chatbottoepassingen of gerichte programmeertaken voldoet DeepSeek's 128K prima.

Ecosysteem en integratie

Modellen bestaan niet op zichzelf. Integratie is belangrijk.

Het ecosysteemvoordeel van OpenAI

De modellen van OpenAI integreren naadloos met Microsoft Azure, GitHub Copilot en talloze tools van derden. Het GPT-ecosysteem is volwassen, met uitgebreide documentatie, communitybronnen en kant-en-klare integraties.

Functieaanroepen, gestructureerde uitvoer, fijnafstemming, distillatie en voorspelde uitvoer worden allemaal ondersteund. Het v1/chat/completions-eindpunt is een de facto standaard geworden die door veel tools wordt ondersteund.

De groeiende aanwezigheid van Claude

Claude is via meerdere kanalen beschikbaar: de Claude API rechtstreeks van Anthropic, Amazon Bedrock, Google Cloud Vertex AI en Microsoft Foundry. Deze multi-cloudbenadering biedt flexibiliteit.

Anthropic heeft Agent Skills geïntroduceerd, modulaire mogelijkheden die de functionaliteit van Claude uitbreiden. Elke skill bevat instructies, metadata en optionele resources die Claude automatisch gebruikt wanneer dat nodig is.

DeepSeek's Compatibiliteitsstrategie

De API van DeepSeek bootst bewust het formaat van OpenAI na. Volgens hun officiële documentatie kunt u de OpenAI SDK of andere OpenAI-compatibele software met DeepSeek gebruiken door simpelweg de base_url te wijzigen in https://api.deepseek.com en een DeepSeek API-sleutel op te geven.

Deze compatibiliteit betekent dat veel bestaande tools direct met DeepSeek werken, waardoor de overstapkosten lager uitvallen.

Veiligheid, afstemming en transparantie

Niet alle modellen benaderen veiligheid op dezelfde manier.

- Claude heeft een reputatie opgebouwd voor zorgvuldige afstemming op veiligheid. De constitutionele AI-aanpak van Anthropic is erop gericht modellen behulpzaam, onschadelijk en eerlijk te maken. In de praktijk betekent dit soms dat Claude verzoeken weigert die andere modellen wel zouden proberen uit te voeren, wat sommige gebruikers overdreven voorzichtig vinden.

- OpenAI maakt uitgebreid gebruik van reinforcement learning op basis van menselijke feedback (RLHF) en veiligheidstests. Ze zijn meer bereid geweest om grenzen te verleggen, terwijl ze tegelijkertijd de nodige waarborgen handhaven.

- DeepSeek publiceerde technische documentatie waarin de mechanismen en trainingsmethoden van hun model werden uitgelegd, wat de transparantie bevorderde. Als relatief nieuwe speler op de markt moet hun reputatie op het gebied van veiligheid op de lange termijn echter nog worden opgebouwd.

Voor bedrijfsapplicaties in gereguleerde sectoren kan de conservatieve aanpak van Claude voordelig zijn. Voor onderzoek en experimenten werkt de balans tussen functionaliteit en veiligheid van GPT goed. De open aanpak van DeepSeek spreekt ontwikkelaars aan die willen begrijpen wat er onder de motorkap gebeurt.

Bedrijfsoverwegingen: Welk bedrijfsmodel is het meest geschikt?

Bij de keuze voor een AI-model voor zakelijk gebruik gelden andere criteria dan bij persoonlijke projecten.

Totale eigendomskosten

Kijk niet alleen naar de prijs per token. Houd rekening met volumekortingen, cachingvoordelen en de kosten van ontwikkeltijd. Een model dat drie keer zo duur is, maar de debugtijd met 40% verkort, is wellicht de betere investering.

De prijsstelling van DeepSeek maakt het aantrekkelijk voor applicaties met een hoog volume, waar de kosten per interactie doorslaggevend zijn. De nauwkeurigheid van Claude kan de hogere kosten rechtvaardigen voor klantgerichte applicaties waar fouten kostbaar zijn. De ecosysteemintegratie van GPT kan de ontwikkeltijd verkorten, waardoor de hogere API-kosten worden gecompenseerd.

Betrouwbaarheid en beschikbaarheid

OpenAI heeft tijdens piekuren af en toe te maken gehad met storingen. De beschikbaarheid van Claude in meerdere clouds via AWS, GCP en Azure biedt redundantieopties. DeepSeek, als nieuwere dienst, heeft nog beperkte gegevens over de prestaties.

Voor bedrijfskritische applicaties worden multi-modelstrategieën steeds gebruikelijker. Gebruik Claude als primair model met GPT als back-up, of stuur eenvoudige query's door naar DeepSeek en complexere naar duurdere modellen.

Gegevensprivacy en naleving van wet- en regelgeving

Controleer zorgvuldig het gegevensverwerkingsbeleid van elke aanbieder. Claude via Amazon Bedrock of Google Vertex AI biedt mogelijk andere compliance-certificeringen dan wanneer de directe API wordt gebruikt. De Azure-implementatie van OpenAI biedt beveiligingsfuncties van enterprise-niveau. Het gegevensbeleid van DeepSeek moet worden beoordeeld op basis van uw specifieke wettelijke vereisten.

| Factor | Het beste voor Claude | Het beste voor GPT | Het beste voor DeepSeek

|

|---|---|---|---|

| Budgetprioriteit | Laag | Medium | Hoog |

| Ecosysteemintegratie | Medium | Hoog | Medium |

| Veiligheidseisen | Hoog | Medium | Medium |

| Contextvensterbehoeften | Zeer hoog (1M) | Hoog (400K-1M) | Medium (128K) |

| Redeneertaken | Hoog | Zeer hoog | Hoog |

| Kwaliteit van de documentatie | Hoog | Zeer hoog | Goed |

Bekende beperkingen en zwakke punten

Elk model heeft blinde vlekken. Als je die kent, kun je er beter mee omgaan.

Claude's eigenaardigheden

Claude kan overdreven voorzichtig zijn en onschuldige verzoeken afwijzen vanwege veiligheidsfilters. Het geeft soms uitgebreidere uitleg dan nodig. De hogere prijs beperkt het gebruik in situaties waar de kosten per token cruciaal zijn.

De uitdagingen van GPT

GPT-modellen "hallucineren" soms informatie op een zelfverzekerde manier. De redeneermodellen kunnen trager zijn vanwege de langere denktijd. De prijs van de professionele versies maakt ze voor veel toepassingen onbetaalbaar.

De groeipijnen van DeepSeek

DeepSeek is een relatief nieuw platform met minder communitykennis en minder integraties met externe partijen. Het beperktere toepassingsbereik beperkt daardoor sommige toepassingen. De betrouwbaarheid en ondersteuning op de lange termijn blijven een aandachtspunt naarmate de dienst zich verder ontwikkelt.

Prestatiebenchmarks: de cijfers

Benchmarks bieden gestandaardiseerde vergelijkingspunten, hoewel de prestaties in de praktijk kunnen variëren.

Onderzoek van het Center for Security and Emerging Technology van Georgetown University benadrukt dat evaluaties zich "nog in een zeer vroeg stadium" bevinden en met de nodige voorzichtigheid moeten worden geïnterpreteerd. Populaire benchmarks zijn onder andere MMLU (Measuring Massive Multitask Language Understanding) met meerkeuzevragen uit professionele examens, en GPQA (Graduate-Level Google-Proof Q&A) met door experts opgestelde vragen.

Volgens diverse bronnen presteert DeepSeek V3 goed in codeerbenchmarks, terwijl de kosten aanzienlijk lager liggen. Modellen uit de GPT-5-serie blinken uit in taken die veel redeneerwerk vereisen. Claude presteert sterk bij taken met genuanceerde taal en het begrijpen van lange documenten.

De conclusie? Benchmarkscores zijn belangrijk, maar ze vertellen niet het hele verhaal. Test modellen op jouw specifieke gebruiksscenario's voordat je een definitieve keuze maakt.

Gebruikerservaring en interface

De ervaring van een ontwikkelaar is net zo belangrijk als de pure vaardigheid.

De playground en documentatie van OpenAI zijn verzorgd en uitgebreid. De API is goed gedocumenteerd met veel voorbeelden. Voor GPT-5.2 wordt de gratis versie niet ondersteund; de gebruiksversies hebben gedefinieerde TPM-limieten (bijvoorbeeld, versie 5 toont tot 40.000.000 TPM).

De documentatie van Claude is eveneens zeer uitgebreid, met duidelijke tabellen voor modelvergelijkingen en functiebeschrijvingen. De multi-cloudbenadering betekent dat u, afhankelijk van uw implementatiekeuze, mogelijk via verschillende interfaces met Claude communiceert.

De documentatie van DeepSeek is functioneel, maar niet erg uitgebreid. De compatibiliteit met OpenAI is een pluspunt, aangezien veel tutorials en voorbeelden met minimale aanpassingen werken.

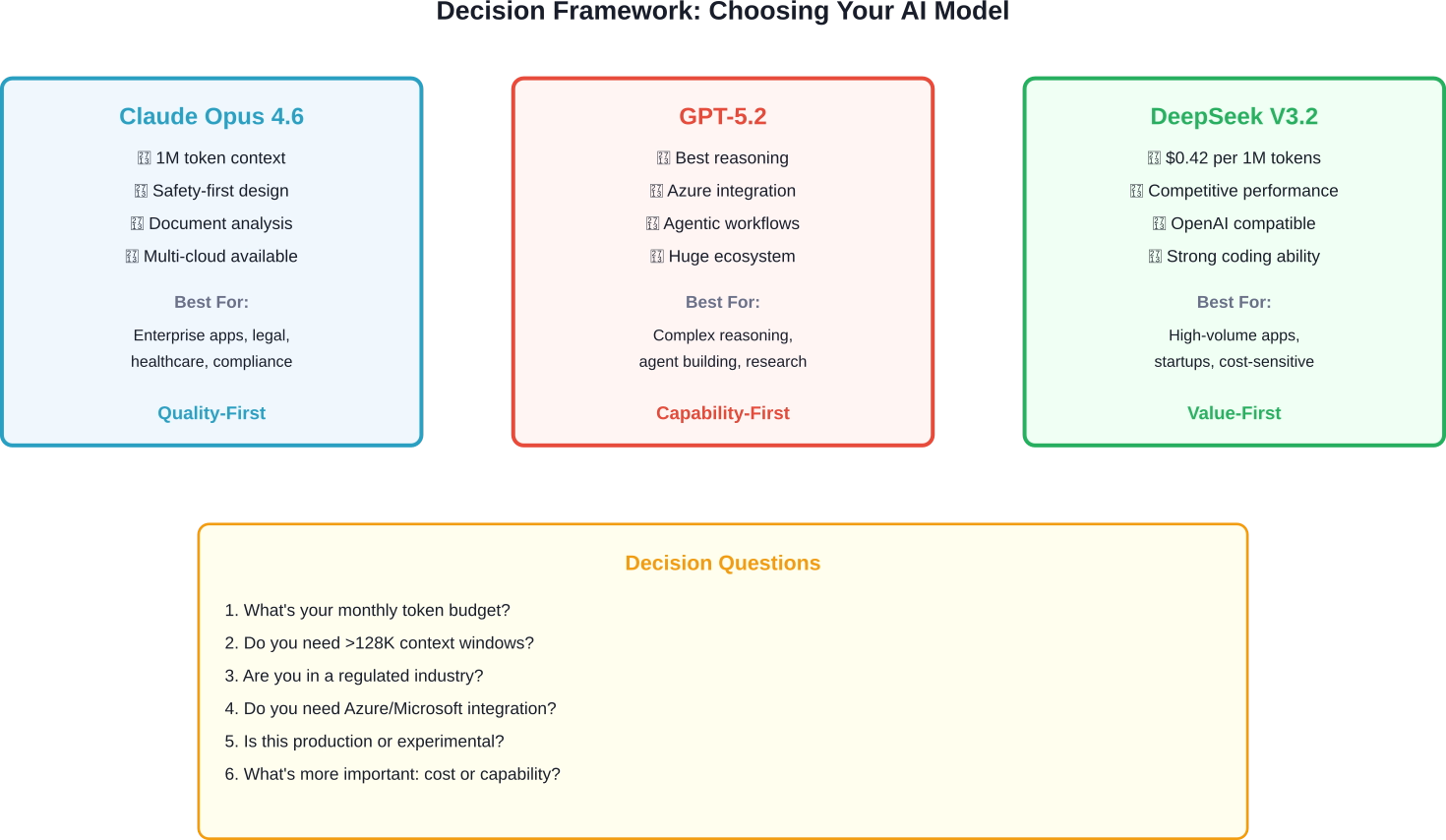

Welk model moet je nu eigenlijk kiezen?

Het zit zo: er bestaat geen universeel "beste" model. Je keuze hangt af van je specifieke behoeften.

Kies Claude als…

Je hebt een zo groot mogelijk contextvenster nodig voor het verwerken van grote documenten. Veiligheid en zorgvuldige uitvoergeneratie zijn prioriteiten. Je ontwikkelt applicaties in gevoelige domeinen waar een voorzichtige aanpak voordelig is. Het budget is minder beperkt dan de kwaliteitseisen.

Kies GPT als…

Je hebt een diepe ecosysteemintegratie nodig met tools van Microsoft, Azure of GitHub. Redeneervermogen is essentieel voor je gebruiksscenario. Je wilt de meest uitgebreide documentatie en communityondersteuning. Je bouwt agentsystemen die geavanceerde planning vereisen.

Kies DeepSeek als…

Kostenefficiëntie is een prioriteit. U verwerkt grote volumes, waardoor de kosten per token snel oplopen. U hebt concurrerende prestaties nodig zonder de hoge prijs. U bent vertrouwd met een nieuwer platform en wilt compatibiliteit met OpenAI.

Framework voor het selecteren van het juiste AI-model op basis van uw specifieke eisen en beperkingen.

Multimodelstrategieën

Veel geavanceerde toepassingen kiezen niet voor slechts één model.

Een routeringsaanpak kan zowel de kosten als de kwaliteit optimaliseren. Gebruik DeepSeek voor eenvoudige zoekopdrachten, Claude voor complexe analyses die een lange context vereisen, en GPT voor taken die diepgaande redenering vereisen. Dit vereist het ontwikkelen van routeringslogica, maar kan de kosten met 60% of meer verlagen, terwijl de kwaliteit behouden blijft.

Een andere strategie: gebruik goedkopere modellen voor het genereren van eerste concepten en vervolgens duurdere modellen voor verfijning en kwaliteitscontrole. Of voer dezelfde prompt door meerdere modellen en gebruik stem- of ensemblemethoden voor cruciale beslissingen.

De overheadkosten voor het beheren van meerdere modellen nemen af, omdat tools zoals Crazyrouter en vergelijkbare diensten het eenvoudig maken om verschillende modellen met dezelfde code te testen.

Navigeren door de AI-frontier met AI Superior

Naarmate de kloof tussen redeneervermogen en kostenefficiëntie kleiner wordt, verschuift de uitdaging voor de meeste bedrijven van het kiezen van een model naar het succesvol implementeren ervan. AI Superieur, Ons team van datawetenschappers en software-engineers met een doctoraat is gespecialiseerd in het overbruggen van deze kloof door middel van end-to-end AI-applicatieontwikkeling en strategisch advies. We helpen organisaties verder te gaan dan simpele API-aanroepen door op maat gemaakte, krachtige systemen te bouwen die deze geavanceerde modellen integreren in bestaande workflows. Zo zorgen we ervoor dat uw architectuurkeuze – of het nu gaat om de enorme contextvensters van Claude of de kostenefficiënte redenering van DeepSeek – zich vertaalt in tastbare bedrijfswaarde.

Onze systematische aanpak richt zich op het identificeren van de specifieke gebieden waar machine learning op de lange termijn efficiëntie kan opleveren, van computervisie tot voorspellende analyses. We begrijpen dat in een zo volatiel landschap als 2026 een 'one-size-fits-all'-modelstrategie zelden werkt. Daarom werkt ons team nauw met u samen via een rigoureus ontdekkings- en MVP-proces om oplossingen te schalen die robuust, betrouwbaar en afgestemd zijn op de unieke regelgeving en datavereisten van uw branche.

Toekomstperspectief: Wat staat ons te wachten?

Het landschap van AI-modellen blijft zich in hoog tempo ontwikkelen.

- OpenAI blijft stapsgewijze verbeteringen aan hun modelfamilie uitbrengen. De kloof tussen redeneermodellen en standaardmodellen lijkt kleiner te worden. Prijsdruk van concurrenten zoals DeepSeek kan aanpassingen afdwingen.

- Anthropic breidt de beschikbaarheid van Claude uit naar verschillende cloudproviders en voegt functies toe zoals Agent Skills. Het contextvenster van 1 miljoen tokens in de bètaversie suggereert dat ze de grenzen van inputverwerking verleggen.

- DeepSeek positioneert zich als een vernieuwer en bewijst dat concurrerende prestaties geen premium prijs vereisen. Hun V3.2-Speciale model behaalde gouden resultaten in programmeerwedstrijden, wat aantoont dat het hen niet alleen om de prijs gaat, maar dat ze ook de mogelijkheden naar een hoger niveau tillen.

Verwacht voortdurende verbeteringen aan de modellen, prijsconcurrentie en consolidatie van mogelijkheden bij verschillende aanbieders. De verschillen tussen deze modellen zullen waarschijnlijk kleiner worden op basis van benchmarks, terwijl ze verder uiteen zullen lopen bij specifieke gebruiksscenario's.

Conclusie: Uw keuze maken

De concurrentie tussen Claude, GPT en DeepSeek is gunstig voor iedereen. De prijzen dalen, de mogelijkheden nemen toe en het verschil tussen premium- en budgetopties wordt kleiner.

Uiteindelijk komt uw beslissing neer op prioriteiten. Als u iets bouwt waarbij intelligentie belangrijker is dan kosten – denk aan onderzoekstoepassingen, complexe redeneertaken of geavanceerde agenten – dan rechtvaardigen GPT-5.2 of Claude Opus 4.6 hun hogere prijs.

Als u grote volumes verwerkt en kostenefficiëntie nodig hebt zonder al te veel in te leveren op functionaliteit, biedt DeepSeek een opmerkelijke prijs-kwaliteitverhouding. De prijsstelling van $0,42 per miljoen outputtokens verandert de economie van AI-toepassingen.

En steeds vaker is de slimste zet niet het kiezen van één model, maar het ontwerpen van je applicatie zo dat het juiste model voor elke taak wordt gebruikt.

Wat is de beste aanpak? Test ze alle drie op jouw specifieke gebruiksscenario's. De meeste bieden gratis versies of credits voor een eerste test. Voer je daadwerkelijke prompts uit, meet de resultaten, bereken de kosten en neem je beslissing op basis van data in plaats van marketingclaims.

Klaar om te beginnen met testen? Raadpleeg de officiële documentatie voor de Claude API, het OpenAI Platform en de DeepSeek API om uw sleutels te verkrijgen en vandaag nog te beginnen met experimenteren.

Veelgestelde vragen

Is DeepSeek net zo goed als GPT-4 of Claude?

Voor veel taken wel. DeepSeek V3.2 behaalt concurrerende prestaties op codeerbenchmarks zoals HumanEval, terwijl het aanzienlijk minder kost. Onderzoeksgegevens tonen aan dat het sterke prestaties behaalde op HumanEval tegen aanzienlijk lagere kosten dan Claude. GPT en Claude kunnen echter nog steeds voordelen hebben bij taken die maximale redeneercapaciteit vereisen of zeer lange contextvensters van meer dan 128.000 tokens.

Welk AI-model is het meest geschikt voor programmeren in 2026?

Het hangt af van uw specifieke behoeften. DeepSeek R1 behaalde de hoogste score op LiveCodeBench (65,9), waardoor het uitstekend geschikt is voor codeertaken tegen lage kosten. GPT-5.2 blinkt uit in agentische workflows en complexe architectuurbeslissingen. Claude Opus 4.6 is sterk voor het begrijpen en refactoren van grote codebases. Voor de meeste ontwikkelaars biedt DeepSeek de beste prijs-kwaliteitverhouding, terwijl GPT de beste ecosysteemintegratie biedt.

Wat zijn de kosten voor het gebruik van deze AI-modellen?

De prijzen variëren aanzienlijk. Volgens de officiële prijspagina's kost DeepSeek $0.28 input en $0.42 output per miljoen tokens (standaardtarieven). GPT-5.2 kost $1.75 input en $14.00 output per miljoen tokens. GPT-5-mini kost $0.25 input en $2.00 output per miljoen tokens. De prijs van Claude varieert afhankelijk van de implementatiemethode – raadpleeg de officiële documentatie van Anthropic voor de actuele tarieven. DeepSeek is ongeveer 5 tot 50 keer goedkoper dan vergelijkbare modellen.

Kan ik DeepSeek gebruiken met mijn bestaande OpenAI-code?

Ja. Volgens de officiële API-documentatie van DeepSeek gebruikt hun API een OpenAI-compatibel formaat. Je kunt de OpenAI SDK of andere OpenAI-compatibele software met DeepSeek gebruiken door de base_url te wijzigen in https://api.deepseek.com en je DeepSeek API-sleutel op te geven. De meeste bestaande code zou met minimale aanpassingen moeten werken.

Welk model heeft het langste contextvenster?

Claude biedt momenteel in bèta een contextvenster van 1 miljoen tokens. GPT-4.1 biedt 1.047.576 tokens, iets meer dan Claude. GPT-5.2 biedt 400.000 tokens. DeepSeek V3.2 heeft 128.000 tokens, wat minder is, maar voldoende voor de meeste toepassingen. Voor taken die de analyse van extreem grote documenten of zeer lange gesprekken vereisen, hebben Claude of GPT-4.1 een voordeel.

Zijn deze modellen veilig voor gebruik binnen een bedrijf?

Alle drie zijn ingezet in bedrijfsomgevingen, maar met verschillende aandachtspunten. Claude legt de nadruk op veiligheid en is populair in gereguleerde sectoren. OpenAI biedt bedrijfsimplementaties via Azure met extra beveiligingsfuncties. DeepSeek is nieuwer en heeft een minder gevestigde reputatie. Voor bedrijfsgebruik is het belangrijk om het gegevensverwerkingsbeleid, de compliance-certificeringen en de service level agreements van elke provider te evalueren op basis van uw specifieke vereisten. Multicloud-implementaties van Claude via AWS, GCP of Azure bieden mogelijk extra compliance-opties.