ملخص سريع: لن يحلّ الذكاء الاصطناعي محلّ متخصصي الأمن السيبراني، بل سيُحدث نقلة نوعية في أدوارهم من خلال أتمتة المهام المتكررة، مثل اكتشاف التهديدات وتحليل السجلات. ووفقًا لأبحاث وكالة الأمن السيبراني وأمن البنية التحتية (CISA) والمعهد الوطني للمعايير والتكنولوجيا (NIST)، تظل الخبرة البشرية أساسية لاتخاذ القرارات الاستراتيجية، والحكم الأخلاقي، والاستجابة للحوادث، والتصدي للتهديدات الجديدة التي تعجز أنظمة الذكاء الاصطناعي عن حلّها بمفردها. ويكمن مستقبل هذا النوع من الذكاء الاصطناعي في التعاون بين الإنسان والذكاء الاصطناعي، حيث يُوجّه المتخصصون أدوات الذكاء الاصطناعي بدلًا من التنافس معها.

يتكرر السؤال في الأوساط المهنية والمنتديات الإلكترونية ومؤتمرات الأمن السيبراني: هل سيحل الذكاء الاصطناعي محل وظائف الأمن السيبراني؟ إنه قلق مشروع. ففي نهاية المطاف، يحلل الذكاء الاصطناعي بالفعل أنماط حركة مرور الشبكة، ويكشف عن الحالات الشاذة، ويستجيب لبعض التهديدات بسرعة تفوق قدرة أي فريق بشري.

لكن الأمر المهم هو أن العلاقة بين الذكاء الاصطناعي وخبراء الأمن السيبراني ليست لعبة محصلتها صفر. فالتكنولوجيا لا تلغي الأدوار البشرية، بل تعيد تشكيلها بطرق تتطلب مهارات جديدة مع الحفاظ على القيمة التي لا تُضاهى للحكم البشري.

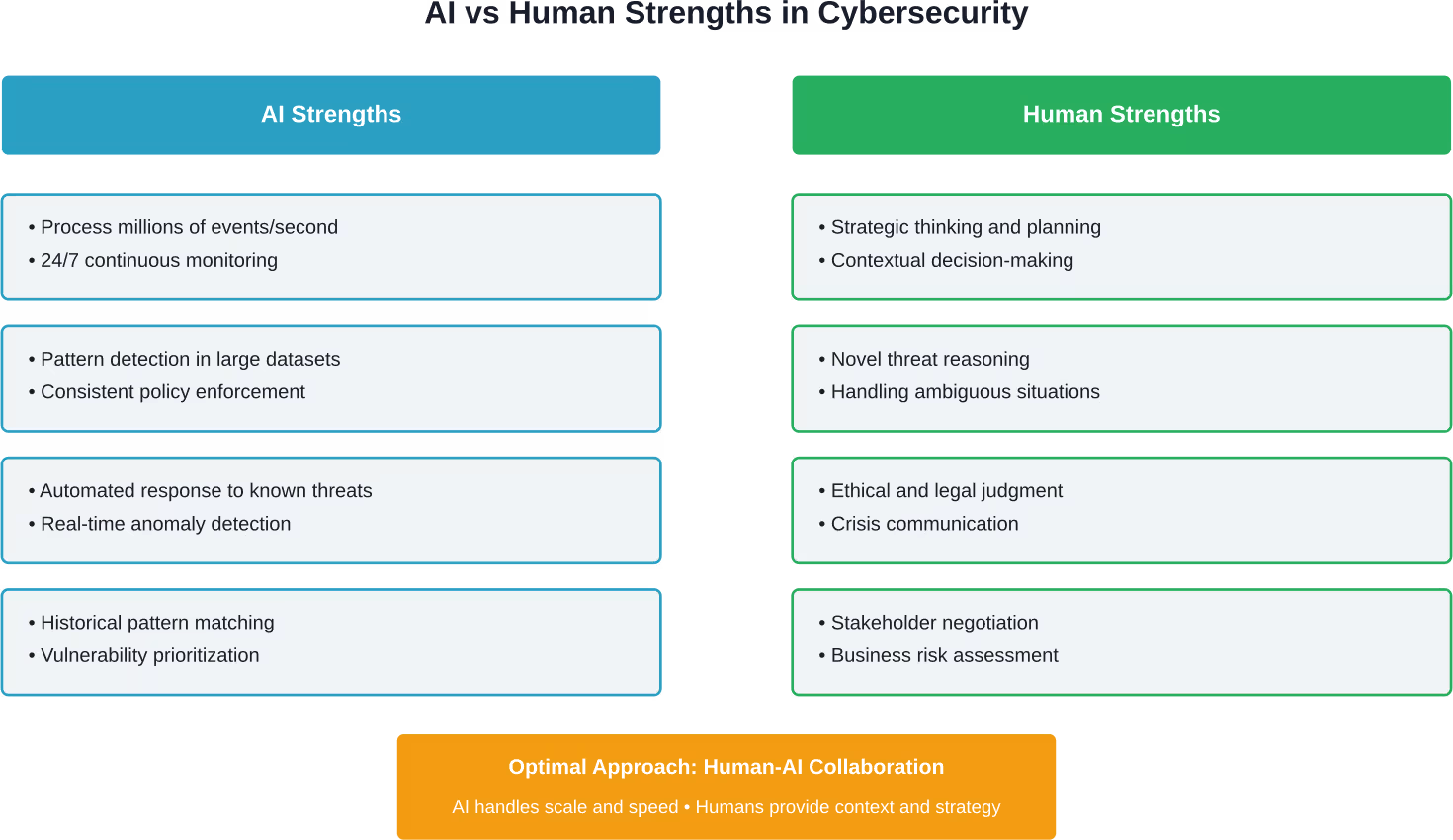

بصراحة: يتفوق الذكاء الاصطناعي في معالجة مجموعات البيانات الضخمة وتحديد الأنماط، لكنه يواجه صعوبة في فهم السياق والتفكير الاستراتيجي والفروق الأخلاقية الدقيقة التي تُحدد برامج الأمن الفعّالة. هذه الفجوة أهم مما يدركه معظم الناس.

الوضع الحالي للذكاء الاصطناعي في عمليات الأمن السيبراني

بحسب دراسات الحالة المنشورة من قبل وكالة الأمن السيبراني وأمن البنية التحتية (CISA)، أصبحت أدوات الذكاء الاصطناعي مكونات أساسية في عمليات الأمن الحديثة. فمن رصد الشذوذات في بيانات الشبكة إلى تعزيز معلومات التهديدات، تُكمّل هذه الأنظمة القدرات البشرية بدلاً من أن تحل محلها.

تركز مبادرات الأتمتة المدعومة بالذكاء الاصطناعي التابعة لوكالة الأمن السيبراني وأمن البنية التحتية (CISA) على الاستفادة من التعلم الآلي لأتمتة العمليات وتعزيز الكفاءة التشغيلية. ويُدرّب برنامج أخصائي الأتمتة المعتمد المدعوم بالذكاء الاصطناعي (CAIAS)، الذي أُنشئ عام 2024، المتخصصين على العمل جنبًا إلى جنب مع هذه الأنظمة، لا منافستها.

تشمل تطبيقات الذكاء الاصطناعي الحالية في مجال الأمن السيبراني ما يلي:

- التحليلات السلوكية: تُحدد خوارزميات التعلم الآلي أنماط سلوك المستخدم الأساسية وتُشير إلى الانحرافات التي قد تدل على اختراق بيانات الاعتماد أو التهديدات الداخلية.

- فحص الثغرات الأمنية الآلي: تقوم أنظمة الذكاء الاصطناعي بتقييم بيئات الحوسبة السحابية والبنية التحتية المحلية بشكل مستمر للكشف عن أي انحرافات في التكوين أو ثغرات أمنية.

- تجميع معلومات التهديدات: تقوم معالجة اللغة الطبيعية بتحليل النشرات الأمنية ومنتديات الإنترنت المظلم ومصادر التهديدات لتحديد أولويات المخاطر الناشئة

- تحليل السجلات على نطاق واسع: يقوم الذكاء الاصطناعي بمعالجة ملايين سجلات البيانات لتحديد الأنماط المشبوهة التي قد تستغرق أيامًا من المحللين البشريين لاكتشافها.

- أتمتة تطبيق السياسات: يضمن الذكاء الاصطناعي اتساق إعدادات الأمان عبر حسابات السحابة الموزعة، ويكشف عن أي انحراف في الإعدادات في الوقت الفعلي.

تشترك هذه التطبيقات في سمة مشتركة: فهي تعالج مهامًا متكررة وكثيفة البيانات كانت تستهلك سابقًا قدرًا هائلاً من موارد فرق الأمن. ويؤكد مقرر دراسي في كلية كوستلاين حول تطبيقات الذكاء الاصطناعي في الأمن السيبراني، والمذكور في مواد NICCS، على هذا التعاون بين تقنيات الذكاء الاصطناعي والإشراف البشري.

تصميم ونشر أنظمة الذكاء الاصطناعي باستخدام برنامج AI Superior

متفوقة الذكاء الاصطناعي يعمل على تصميم أنظمة الذكاء الاصطناعي التي تتناسب مع البيئات الحقيقية. ويشمل ذلك تحديد المشكلة، وتطوير النماذج، وضمان عمل هذه النماذج بشكل صحيح بمجرد ربطها بسير العمليات التشغيلية.

هل تحتاج إلى مساعدة في تصميم ونشر الذكاء الاصطناعي؟

يمكن أن تساعدك تقنية الذكاء الاصطناعي المتفوقة في:

- بناء نماذج الذكاء الاصطناعي لحالات الاستخدام العملي

- تحديد بنية النظام والنهج التقني

- دمج الذكاء الاصطناعي في البنية التحتية للأعمال

👉 تواصل مع شركة AI Superior لمناقشة مشروعك وبياناتك ونهج التنفيذ

مواطن قصور الذكاء الاصطناعي في مجال الأمن السيبراني

على الرغم من قدراتها المذهلة، تواجه أنظمة الذكاء الاصطناعي قيودًا جوهرية تحول دون أتمتة العمليات الأمنية بشكل كامل. وفهم هذه القيود يفسر لماذا تبقى الخبرة البشرية عنصرًا لا غنى عنه.

اتخاذ القرارات بناءً على السياق

يتفوق الذكاء الاصطناعي في التعرف على الأنماط، لكنه يواجه صعوبة في فهم السياق. قد يشير ارتفاع مفاجئ في استعلامات قاعدة البيانات إلى هجوم حقن SQL، أو قد يعكس نشاطًا تجاريًا مشروعًا خلال إطلاق منتج. يُشير الذكاء الاصطناعي إلى هذا الشذوذ، بينما يُحدد البشر ما إذا كان يُمثل تهديدًا أم لا.

غالباً ما تتطلب القرارات الأمنية فهم أهداف العمل، والمتطلبات التنظيمية، ومدى تقبّل المؤسسة للمخاطر. هذه ليست بيانات يمكن للخوارزمية معالجتها بشكل مستقل.

أساليب هجوم جديدة

تعتمد نماذج التعلم الآلي في تدريبها على البيانات التاريخية. وعندما يطور المهاجمون أساليب جديدة تمامًا، تفتقر أنظمة الذكاء الاصطناعي إلى نقاط مرجعية. وقد يغفل النموذج عن التهديدات التي لا تتطابق مع الأنماط المعروفة.

لنأخذ مثالاً على ذلك موظف الشؤون المالية في هونغ كونغ الذي حوّل مبلغ 125 مليون جنيه إسترليني بعد مؤتمر فيديو عُقد في فبراير 2024 مع من بدا أنه المدير المالي وعدد من المديرين التنفيذيين الآخرين. نجحت تقنية التزييف العميق في محاكاة أنماط الكلام والمظهر المرئي بشكل مقنع لدرجة أنها خدعت الموظف. لم تكن أنظمة الكشف بالذكاء الاصطناعي قد رصدت هذا النمط من الهجمات من قبل.

وعلى النقيض من ذلك، يستطيع متخصصو الأمن البشري التفكير في السيناريوهات غير المألوفة من خلال تطبيق مبادئ الأمن الأساسية وفهم دوافع المهاجمين.

الذكاء الاصطناعي التنافسي والتلاعب بالنماذج

تؤكد أبحاث المعهد الوطني للمعايير والتكنولوجيا (NIST) حول أمن الذكاء الاصطناعي أن أنظمة الذكاء الاصطناعي نفسها تصبح أهدافًا للهجمات. إذ يمكن لتقنيات التعلم الآلي المعادية أن تُفسد بيانات التدريب أو تُصمم مدخلات تُضلل نماذج التصنيف.

قد يُصنّف نموذج أمني مُدرّب على تحديد البرامج الضارة الشيفرة الخبيثة تصنيفًا خاطئًا إذا قام المهاجمون بتعديل خصائص الملفات بشكل دقيق. ويتطلب التصدي لهذه الهجمات باحثين أمنيين بشريين مُلِمّين بنقاط ضعف الذكاء الاصطناعي وتكتيكات المهاجمين.

تتناول دورة NIST's AI Model Validation and Test Automation for Critical Systems Essentials، التي نُشرت في مايو 2025، هذه المخاوف تحديدًا - التحقق من موثوقية الذكاء الاصطناعي في المجالات عالية الضمان حيث تحمل حالات الفشل عواقب وخيمة.

الحكم الأخلاقي والقانوني

غالباً ما تنطوي الحوادث الأمنية على اعتبارات تتعلق بالخصوصية، والامتثال القانوني، ومعضلات أخلاقية. هل ينبغي لفريق أمن الشركة الوصول إلى الأجهزة الشخصية للموظفين للتحقيق في اختراق بيانات مشتبه به؟ كيف يمكن أن يوازن الاستجابة للحوادث بين الشفافية وحماية المعلومات الحساسة؟

لا توجد إجابات خوارزمية لهذه الأسئلة. إنها تتطلب حكماً بشرياً مستنيراً بالأطر القانونية والمبادئ الأخلاقية والقيم التنظيمية.

كيف يُحدث الذكاء الاصطناعي تحولاً في أدوار الأمن السيبراني

بدلاً من إلغاء وظائف الأمن السيبراني، يُعيد الذكاء الاصطناعي تشكيل طبيعة هذه الوظائف. ويعكس هذا التحول التحولات التكنولوجية التاريخية، فالأتمتة لا تقضي على المهن بقدر ما تُعيد توجيه الجهود البشرية نحو أنشطة ذات قيمة أعلى.

من التحليل اليدوي إلى الإشراف الاستراتيجي

كان محللو الأمن يقضون ساعات طويلة في مراجعة سجلات جدار الحماية يدويًا وربط الأحداث عبر الأنظمة المختلفة. أما الآن، فيتولى الذكاء الاصطناعي هذا العمل الشاق، ويعالج البيانات بسرعات لا يمكن لأي فريق بشري أن يضاهيها.

يُتيح هذا التحول للمحللين التركيز على الأسئلة الاستراتيجية: هل تتوافق الدفاعات الحالية مع بيئات التهديدات الناشئة؟ كيف ينبغي ترتيب أولويات استثمارات الأمن بناءً على مخاطر الأعمال؟ ما هي الثغرات الموجودة في قدرات الاستجابة للحوادث؟

بحسب دراسة أجرتها مؤسسة بروكينغز ونُشرت في أكتوبر 2024، قد يتعرض أكثر من 301 مليار عامل لتأثيرات الذكاء الاصطناعي التوليدي، مع تأثيرات أكبر على الوظائف ذات الأجور المتوسطة والعالية والأدوار الكتابية. لكن الدراسة تؤكد أن التعرض لا يعني الاستبدال، بل يشير إلى تحول في المهام.

متطلبات المهارات الجديدة

تُبرز دراسة المعهد الوطني للمعايير والتكنولوجيا (NIST) حول تأثير الذكاء الاصطناعي على القوى العاملة في مجال الأمن السيبراني (نُشرت في يونيو 2025) كيف يتكيف إطار عمل NICE للقوى العاملة مع هذه التغييرات. ويحتاج متخصصو الأمن السيبراني بشكل متزايد إلى مهارات تربط بين الخبرة الأمنية والمعرفة بالذكاء الاصطناعي.

وفقًا لتوقعات المنتدى الاقتصادي العالمي المذكورة في البحوث الأكاديمية، من المتوقع أن تتغير 39% من مهارات القوى العاملة بحلول عام 2030، مما يستلزم تكيفًا كبيرًا وإعادة تأهيل لتلبية متطلبات سوق العمل المتطورة.

تشمل المهارات الناشئة الأساسية ما يلي:

- تقييم نموذج الذكاء الاصطناعي: فهم كيفية اتخاذ نماذج التعلم الآلي للقرارات وتحديد التحيزات أو نقاط الضعف المحتملة

- هندسة سريعة لأغراض الأمن: الاستعلام الفعال عن أنظمة الذكاء الاصطناعي لاستخراج معلومات التهديدات ذات الصلة ورؤى الأمن

- الدفاع ضد الذكاء الاصطناعي المعادي: حماية أنظمة الذكاء الاصطناعي من التلاعب وهجمات التسميم

- تفسير الخوارزمية: ترجمة مخرجات الذكاء الاصطناعي إلى توصيات أمنية قابلة للتنفيذ

- تصميم سير العمل بين الإنسان والذكاء الاصطناعي: هيكلة العمليات التي تُحسّن التعاون بين الأنظمة الآلية والمحللين البشريين

هذه ليست مهن جديدة تماماً. إنها تطورات لأدوار أمنية موجودة، معززة بقدرات الذكاء الاصطناعي.

الاستجابة للحوادث المتصاعدة

يُسرّع الذكاء الاصطناعي بشكلٍ كبير عملية الكشف الأولي عن التهديدات واحتوائها. تستطيع الأنظمة الآلية عزل نقاط النهاية المخترقة، وحظر عناوين IP الضارة، وتفعيل خطط الاستجابة المحددة مسبقًا في غضون أجزاء من الثانية من اكتشاف الحادث.

لكن الاختراقات المعقدة لا تزال تتطلب تنسيقًا بشريًا. تحديد نطاق الاختراق، وإدارة التواصل مع أصحاب المصلحة، والتنسيق مع جهات إنفاذ القانون، واتخاذ قرارات الإفصاح - كل هذه الأنشطة تتطلب حكمة لا تستطيع الخوارزميات محاكاتها.

تُتيح العلاقة التكافلية سرعة أكبر في متوسط وقت الاستجابة (MTTR) إلى جانب استجابة استراتيجية أكثر دقة. يوفر الذكاء الاصطناعي رؤى آنية، بينما يتخذ البشر القرارات الحاسمة.

| مهمة أمنية | مساهمة الذكاء الاصطناعي | المساهمة البشرية | نتائج التعاون |

|---|---|---|---|

| الكشف عن التهديدات | يقوم بتحليل حركة مرور الشبكة وسجلاتها لتحديد الحالات الشاذة في الوقت الفعلي | يتحقق من صحة التنبيهات، ويحدد النتائج الإيجابية الخاطئة، ويطبق سياق العمل | كشف أسرع مع عدد أقل من النتائج الإيجابية الخاطئة |

| إدارة الثغرات الأمنية | يقوم بفحص البنية التحتية، ويحدد الأولويات بناءً على قابلية الاستغلال والتعرض للخطر | يُقيّم الأثر على الأعمال، ويُجدول عمليات المعالجة، ويدير الاستثناءات. | تحديد الأولويات بناءً على المخاطر بما يتماشى مع احتياجات العمل |

| الاستجابة للحادث | يُؤتمت عملية الاحتواء، وينفذ خطط الاستجابة، ويجمع البيانات الجنائية. | يوجه استراتيجية التحقيق، ويتخذ قرارات الإفصاح، وينسق بين الفرق | احتواء أسرع من خلال اتخاذ القرارات الاستراتيجية |

| مراقبة الأمن | مراقبة مستمرة على مدار الساعة وطوال أيام الأسبوع، والتعرف على الأنماط عبر ملايين الأحداث | يضبط قواعد الكشف، ويحقق في السيناريوهات المعقدة، ويتعامل مع التصعيدات | تغطية شاملة دون إرهاق المحللين |

| صيد التهديد | يقترح فرضيات البحث بناءً على معلومات التهديدات، ويؤتمت استعلامات البيانات. | يطور سيناريوهات بحث إبداعية، ويفسر النتائج، ويتتبع الشذوذات | اكتشاف التهديدات الاستباقي على نطاق واسع |

التكامل بين الذكاء الاصطناعي والأمن السيبراني في العالم الحقيقي

تُجسّد المنظمات التي تستخدم الذكاء الاصطناعي بالفعل في العمليات الأمنية كيف يبدو هذا التعاون على أرض الواقع. هذه ليست مجرد تصورات مستقبلية نظرية، بل هي تطبيقات حالية.

معلومات التهديدات الآلية

تستخدم فرق الأمن الذكاء الاصطناعي لتجميع بيانات التهديدات من مئات المصادر، وربط مؤشرات الاختراق، وتحديد أولويات التهديدات بناءً على مدى تعرض المؤسسة لها. يقوم الذكاء الاصطناعي بمعالجة اللغة الطبيعية من النشرات الأمنية، واستخراج المؤشرات التقنية ذات الصلة، وربطها بالأصول الداخلية.

يقوم المحللون البشريون بمراجعة التهديدات ذات الأولوية، وتحديد التهديدات التي تتطلب إجراءً فوريًا، وتعديل الاستراتيجيات الدفاعية وفقًا لذلك. بدون الذكاء الاصطناعي، ستغرق الفرق في كم هائل من بيانات التهديدات الخام. وبدون العنصر البشري، لن يتمكن النظام من ترجمة المعلومات الاستخباراتية إلى إجراءات مناسبة للسياق.

إدارة وضع أمن الحوسبة السحابية

تقوم الأدوات المدعومة بالذكاء الاصطناعي بفحص بيئات الحوسبة السحابية باستمرار بحثًا عن أي خلل في الإعدادات، أو ضوابط وصول متساهلة للغاية، أو انتهاكات للسياسات. كما تقوم هذه الأدوات بمعالجة بعض أنواع المشكلات تلقائيًا، مثل إغلاق حاويات التخزين المتاحة للعامة، أو إلغاء بيانات الاعتماد غير المستخدمة.

يُحدد مهندسو الأمن السياسات التي يفرضها الذكاء الاصطناعي. فهم يُحددون مستويات المخاطر المقبولة، ويُصممون إجراءات الاستثناء، ويضمنون توافق المعالجة الآلية مع عمليات الأعمال. ويتولى الذكاء الاصطناعي تطبيق السياسات على نطاق واسع، بينما يتولى البشر وضع الاستراتيجيات والحوكمة.

تحليلات سلوك المستخدم

تُحدد تقنيات التعلم الآلي أنماطًا أساسية للمستخدمين الأفراد ومجموعات الأقران. فعندما يُظهر حساب المستخدم سلوكًا غير معتاد - كالدخول إلى الأنظمة في أوقات غير معتادة، أو تنزيل مجموعات بيانات كبيرة، أو الاتصال من مواقع غير مألوفة - يقوم الذكاء الاصطناعي بالإبلاغ عن هذا النشاط.

تقوم فرق عمليات الأمن بالتحقيق في الحسابات المُعلّمة، وتجري مقابلات مع المستخدمين عند الضرورة، وتحدد ما إذا كان السلوك غير المعتاد يعكس نشاطًا تجاريًا مشروعًا أم اختراقًا محتملاً. يحدد الذكاء الاصطناعي الحالات الشاذة، بينما يحدد البشر النوايا.

واقع سوق العمل لمتخصصي الأمن السيبراني

توفر البيانات من معهد مهندسي الكهرباء والإلكترونيات (IEEE) والأبحاث الأكاديمية منظورًا حول التأثير الفعلي للذكاء الاصطناعي على التوظيف - والذي يختلف اختلافًا كبيرًا عن سيناريوهات الاستبدال الكئيبة.

يناقش تقريرٌ نُشر في مجلة IEEE Spectrum في فبراير 2024 حججًا مفادها أن الذكاء الاصطناعي قد يُسهم في خلق فرص عمل أكثر من إحداث تغييرات جذرية، مما قد يُعيد إحياء وظائف الطبقة المتوسطة التي فُقدت بسبب موجات الأتمتة السابقة. لكن ثمة تحذيرٌ هام: يجب على المجتمع الحذر من إساءة استخدام الذكاء الاصطناعي، ولا سيما التضليل الإعلامي والتزييف العميق.

يؤكد تحليل مجلة IEEE Transmitter الصادر في أبريل 2025 هذا التقييم، مشيرًا إلى أن الذكاء الاصطناعي يحل محل مهام أكثر من الوظائف. وقد صدقت إلى حد كبير توقعات باحثي الذكاء الاصطناعي في عام 2016 بأن الأتمتة ستُحدث تحولًا جذريًا في العمل بدلًا من إلغائه، وذلك بعد مرور ما يقرب من عقد من الزمان.

في مجال الأمن السيبراني تحديداً، لا يزال الطلب يفوق العرض. ويواجه هذا المجال نقصاً مستمراً في الكفاءات رغم انتشار أدوات الذكاء الاصطناعي. لماذا؟ لأن الذكاء الاصطناعي يخلق تحديات أمنية جديدة حتى وهو يحل التحديات القائمة.

يُساهم الذكاء الاصطناعي في مجال الأمن في خلق فرص عمل

يتطلب تأمين أنظمة الذكاء الاصطناعي خبرة متخصصة. فمع قيام المؤسسات بنشر نماذج التعلم الآلي في عملياتها التجارية، فإنها تحتاج إلى متخصصين يفهمون الذكاء الاصطناعي المعادي، والتحقق من صحة النماذج، وأطر حوكمة الذكاء الاصطناعي.

تتناول مذكرة المفاهيم الصادرة عن المعهد الوطني للمعايير والتكنولوجيا (NIST) بشأن ملف تعريف إطار إدارة مخاطر الذكاء الاصطناعي (RMF) حول الذكاء الاصطناعي الجدير بالثقة في البنية التحتية الحيوية (2026-04-07) متطلبات السلامة والأمن والموثوقية للذكاء الاصطناعي المستخدم في الأنظمة الحيوية. ويتطلب تطبيق هذه الأطر خبرة بشرية، وذلك من خلال استحداث أدوار بدلاً من إلغائها.

وفقًا لتحليل مؤسسة بروكينغز، مثلت البنية التحتية للذكاء الاصطناعي والنماذج والبحوث والحوكمة أجزاءً كبيرة من إجمالي التمويل الخاص للذكاء الاصطناعي على مستوى العالم بين عامي 2014 و2025. يشير هذا الاستثمار إلى خلق فرص عمل، وليس إلى تدميرها.

ضرورة إعادة تأهيل المهارات

مع ذلك، لن تكفي المهارات الثابتة. يجب على متخصصي الأمن السيبراني التكيف باستمرار مع تطور قدرات الذكاء الاصطناعي. تميل المؤسسات التي تستثمر في تطوير كوادرها - بتدريب الفرق الحالية على دمج الذكاء الاصطناعي بدلاً من استبدالها - إلى تحقيق نتائج أمنية أفضل.

يمثل برنامج أخصائي الأتمتة المعتمد المدعوم بالذكاء الاصطناعي أحد المسارات. وتساهم مبادرات مماثلة من منظمات صناعية ومؤسسات أكاديمية ووكالات حكومية في سد الفجوة بين مهارات الأمن التقليدية والأدوار المعززة بالذكاء الاصطناعي.

المخاطر التي يُدخلها الذكاء الاصطناعي على الأمن السيبراني

ومن المفارقات أن دمج الذكاء الاصطناعي في العمليات الأمنية يخلق ثغرات جديدة. وفهم هذه المخاطر يفسر سبب بقاء الإشراف البشري أمراً بالغ الأهمية.

التعلم الآلي التنافسي

يستطيع المهاجمون التلاعب بأنظمة الذكاء الاصطناعي من خلال مدخلات مصممة بعناية. ويمكن أن تتسبب الأمثلة الخصومية - وهي مدخلات مصممة لخداع نماذج التعلم الآلي - في تصنيف البرامج الضارة بشكل خاطئ، أو تجاوز أنظمة التعرف على الوجوه، أو التهرب من أنظمة كشف التسلل.

بحسب بحث أجرته مؤسسة راند حول مخاطر الذكاء الاصطناعي على الأمن، ونُشر في ديسمبر 2017، فإن هذه الثغرات الأمنية كانت موجودة منذ المراحل الأولى لتبني الذكاء الاصطناعي، ولم تزدد إلا تعقيدًا. ويتطلب التصدي للذكاء الاصطناعي المعادي متخصصين في الأمن يفهمون آليات التعلم الآلي وأساليب المهاجمين على حد سواء.

تسميم البيانات

تعتمد نماذج الذكاء الاصطناعي في تدريبها على البيانات التاريخية. إذا تمكن المهاجمون من اختراق مجموعات بيانات التدريب - عن طريق إدخال أمثلة خبيثة أو تحريف التوزيعات - فإن النماذج الناتجة سترث هذه العيوب. قد يتجاهل نموذج كشف التهديدات المخترق بشكل منهجي بعض بصمات الهجوم أو يُنتج عددًا كبيرًا من الإنذارات الكاذبة.

بحسب تحليل أجرته مؤسسة بروكينغز في سبتمبر 2025، فإنّ عدم كفاية الاستثمار في أمن الذكاء الاصطناعي على مستوى الدولة قد يؤدي إلى ارتفاع تكاليف الجرائم الإلكترونية بشكل ملحوظ. في عام 2021، قُدّرت تكلفة الجرائم الإلكترونية على الدول الأفريقية بنحو 101 تريليون من ناتجها المحلي الإجمالي، أي ما يعادل 1 تريليون و4 تريليونات دولار أمريكي، مما يُبرز المخاطر الاقتصادية الناجمة عن قصور أمن الذكاء الاصطناعي.

الاعتماد المفرط وتراجع المهارات

تُخاطر المؤسسات التي تعتمد بشكل مفرط على الذكاء الاصطناعي بتقليص مهارات فرقها البشرية. فإذا توقف المحللون عن تطوير مهارات التحقيق اليدوي لأن الذكاء الاصطناعي يتولى التحليلات الروتينية، فإنهم يفقدون القدرة على العمل عند تعطل أنظمة الذكاء الاصطناعي أو عند مواجهة سيناريوهات جديدة.

يتطلب الحفاظ على الخبرة البشرية جنباً إلى جنب مع أتمتة الذكاء الاصطناعي تطويراً مدروساً للقوى العاملة. تحتاج الفرق إلى فرص لممارسة المهارات الأساسية حتى عندما يكون الذكاء الاصطناعي قادراً نظرياً على إنجاز المهام بشكل أسرع.

إمكانية التفسير والمساءلة

تعمل العديد من نماذج الذكاء الاصطناعي كصناديق سوداء، إذ تُنتج مخرجات دون تفسير واضح. عندما يُشير نظام الذكاء الاصطناعي إلى اختراق حساب ما، تحتاج فرق الأمن إلى فهم السبب. وبدون إمكانية التفسير، يصبح التحقق من صحة قرارات الذكاء الاصطناعي مستحيلاً.

يتفاقم هذا التحدي في القطاعات الخاضعة للتنظيم، حيث يجب أن تكون قرارات الأمن قابلة للتدقيق والدفاع. ويؤكد بحث المعهد الوطني للمعايير والتكنولوجيا (NIST) حول الذكاء الاصطناعي الجدير بالثقة أن أمن أنظمة الذكاء الاصطناعي يعتمد جزئيًا على قابلية التفسير والمساءلة، وهما سمتان تتطلبان إدارة بشرية.

أفضل الممارسات للتعاون بين الإنسان والذكاء الاصطناعي في مجال الأمن

تتبع المنظمات التي تنجح في دمج الذكاء الاصطناعي في عمليات الأمن أنماطاً محددة. تعمل هذه الممارسات على تعظيم فوائد الذكاء الاصطناعي مع الحفاظ على الخبرة البشرية.

حدد حدودًا واضحة للأتمتة

ضع قواعد واضحة بشأن المهام التي يمكن للذكاء الاصطناعي إنجازها تلقائيًا وتلك التي تتطلب موافقة بشرية. الأنشطة منخفضة المخاطر وعالية الحجم، مثل الفحص الروتيني للثغرات الأمنية، تناسب الأتمتة الكاملة. أما القرارات المصيرية، مثل الإفصاح عن الحوادث، فتتطلب إشرافًا بشريًا.

قم بتوثيق هذه الحدود في كتيبات إجراءات الأمن حتى تفهم الفرق متى تثق في مخرجات الذكاء الاصطناعي مقابل متى تتحقق منها بشكل مستقل.

تطبيق التحقق من صحة البيانات بواسطة الإنسان

فيما يخص القرارات الأمنية الحساسة، صمم مسارات عمل تتطلب موافقة بشرية قبل تنفيذ الإجراءات التي توصي بها أنظمة الذكاء الاصطناعي. قد يعني هذا مراجعة المحللين للتنبيهات عالية الخطورة قبل حظرها تلقائيًا، أو اشتراط الموافقة قبل أن تُعدّل أنظمة الذكاء الاصطناعي سياسات الأمان الخاصة بالإنتاج.

تؤدي أساليب التدخل البشري إلى إبطاء الاستجابة قليلاً ولكنها تقلل بشكل كبير من خطر النتائج الإيجابية الخاطئة التي تسبب اضطرابًا في العمل.

مراقبة النموذج المستمر

تتدهور نماذج الذكاء الاصطناعي بمرور الوقت مع تطور بيئات التهديدات وتقادم بيانات التدريب. لذا، يتعين على فرق الأمن مراقبة أداء النموذج باستمرار، وتتبع مؤشرات مثل معدلات الإنذارات الكاذبة، ودقة الكشف، وثقة التنبؤ.

عندما يتراجع الأداء، تحتاج النماذج إلى إعادة تدريب باستخدام البيانات الحديثة. تتطلب هذه الصيانة المستمرة إشرافًا بشريًا، إذ لا تستطيع أنظمة الذكاء الاصطناعي تحديد متى تصبح غير فعالة بشكل مستقل.

استثمر في تدريب معرفة الذكاء الاصطناعي

لا يحتاج متخصصو الأمن إلى أن يصبحوا علماء بيانات، لكنهم بحاجة إلى معرفة أساسية بالذكاء الاصطناعي. يجب أن يشمل التدريب كيفية عمل نماذج التعلم الآلي، وأسباب فشلها الشائعة، وكيفية تفسير مخرجات الذكاء الاصطناعي بشكل نقدي.

وفقًا لبحث تأثير القوى العاملة الذي أجراه المعهد الوطني للمعايير والتكنولوجيا (NIST) في يونيو 2025، فإن المنظمات التي تستثمر في تطوير مهارات الذكاء الاصطناعي للفرق الحالية ترى نتائج تكامل أفضل من تلك التي تحاول توظيف موظفين متخصصين في الذكاء الاصطناعي جدد تمامًا.

الحفاظ على القدرات اليدوية

حتى مع تولي الذكاء الاصطناعي للمهام الروتينية، ينبغي على الفرق التدرب دوريًا على التحقيق والتحليل اليدوي. تضمن هذه التدريبات عدم تراجع المهارات وتُهيئ الفرق لسيناريوهات فشل أنظمة الذكاء الاصطناعي أو عدم كفايتها.

تساعد التدريبات المكتبية المنتظمة التي تحاكي أعطال أنظمة الذكاء الاصطناعي الفرق على الاستعداد للعمليات المتدهورة والحفاظ على الثقة في قدراتها الأساسية.

المستقبل: تعزيز لا استبدال

تشير الأدلة باستمرار إلى مستقبل يُعزز فيه الذكاء الاصطناعي دور متخصصي الأمن السيبراني بدلاً من أن يحل محلهم. وهذا ليس مجرد أمنيات، بل يعكس القيود الأساسية للذكاء الاصطناعي والقيمة الدائمة للحكم البشري.

مع توسع قدرات الذكاء الاصطناعي، تتسع رقعة الهجمات الإلكترونية. فكل تطبيق جديد للذكاء الاصطناعي يخلق تحديات أمنية تتطلب خبرة بشرية لمواجهتها. وتُظهر حادثة التزييف العميق في هونغ كونغ كيف يُمكّن الذكاء الاصطناعي المهاجمين بقدر ما يُمكّن المدافعين.

انظر، السؤال "هل سيحل الذكاء الاصطناعي محل الأمن السيبراني؟" يطرح المسألة بشكل خاطئ. السؤال الأنسب هو: كيف سيتكيف متخصصو الأمن السيبراني للاستفادة من الذكاء الاصطناعي بفعالية مع التصدي للمخاطر الجديدة التي يخلقها؟

تحتاج المؤسسات إلى متخصصين يفهمون مبادئ الأمن التقليدية وتحديات عصر الذكاء الاصطناعي. أولئك الذين يطورون مهارات هجينة - تجمع بين أساسيات الأمن ومعرفة الذكاء الاصطناعي - سيجدون أنفسهم ذوي قيمة متزايدة.

يشبه هذا التحول التحولات التكنولوجية السابقة. فالحوسبة السحابية لم تلغِ دور مديري الأنظمة، بل غيرت طبيعة هذا الدور. كما أن تكنولوجيا الهواتف المحمولة لم تلغي دور مطوري البرامج، بل أعادت توجيه التطبيقات التي يطورونها.

يتبع الذكاء الاصطناعي النمط نفسه. فهو يلغي مهاماً محددة بينما يخلق مهاماً جديدة تتطلب حكماً بشرياً وإبداعاً وتفكيراً استراتيجياً.

الأسئلة الشائعة

هل سيحل الذكاء الاصطناعي محل محللي الأمن السيبراني بشكل كامل؟

لا، سيُؤتمت الذكاء الاصطناعي المهام المتكررة مثل تحليل السجلات والمراقبة الروتينية، لكن محللي الأمن السيبراني سيظلون أساسيين في اتخاذ القرارات الاستراتيجية، وتنسيق الاستجابة للحوادث، والتعامل مع التهديدات الجديدة. ووفقًا لبحث وكالة الأمن السيبراني وأمن البنية التحتية (CISA) حول حالات استخدام الذكاء الاصطناعي، فإن أدوات الذكاء الاصطناعي تُكمّل القدرات البشرية ولا تحل محلها. فالتحقيقات المعقدة، والحكم الأخلاقي، والتواصل مع أصحاب المصلحة تتطلب خبرة بشرية لا يستطيع الذكاء الاصطناعي محاكاتها.

ما هي وظائف الأمن السيبراني الأكثر عرضة للخطر بسبب أتمتة الذكاء الاصطناعي؟

تشهد الوظائف المبتدئة التي تركز بشكل أساسي على المراقبة الروتينية ومراجعة السجلات اليدوية تحولاً جذرياً. ومع ذلك، فإن هذه الأدوار تتطور بدلاً من أن تختفي، حيث يركز المحللون المبتدئون بشكل متزايد على التحقق من صحة مخرجات الذكاء الاصطناعي، وضبط أنظمة الكشف، والتحقيق في التنبيهات المُصعّدة. ووفقاً لبحث أجرته مؤسسة IEEE عام 2025، يحل الذكاء الاصطناعي محل مهام أكثر من الوظائف الكاملة، مما يُعيد توجيه الجهد البشري نحو أنشطة ذات قيمة أعلى.

ما هي الأدوار الجديدة في مجال الأمن السيبراني التي يخلقها الذكاء الاصطناعي؟

يُتيح الذكاء الاصطناعي أدوارًا متخصصة، تشمل متخصصي أمن الذكاء الاصطناعي الذين يحمون أنظمة التعلم الآلي من الهجمات الخبيثة، وخبراء التحقق من صحة النماذج الذين يتحققون من موثوقية أنظمة الذكاء الاصطناعي، ومحللي حوكمة الذكاء الاصطناعي الذين يضمنون نشره بشكل مسؤول، ومهندسي التوجيه الذين يُحسّنون تفاعلات الذكاء الاصطناعي التي تركز على الأمن. ويُبرز إطار عمل المعهد الوطني للمعايير والتكنولوجيا (NIST) لعام 2026 بشأن الذكاء الاصطناعي الجدير بالثقة في البنية التحتية الحيوية الطلب المتزايد على المتخصصين الذين يفهمون كلاً من الأمن وإدارة مخاطر الذكاء الاصطناعي.

هل يحتاج متخصصو الأمن السيبراني إلى تعلم البرمجة وعلوم البيانات؟

يُعدّ الإلمام الأساسي بالذكاء الاصطناعي مفيدًا، لكن الخبرة البرمجية المتعمقة ليست شرطًا أساسيًا لمعظم وظائف الأمن السيبراني. ينبغي على المتخصصين فهم كيفية عمل نماذج التعلّم الآلي من الناحية النظرية، والتعرّف على أنماط الفشل الشائعة، وتفسير مخرجات الذكاء الاصطناعي بشكل نقدي. ووفقًا لبحث أجراه المعهد الوطني للمعايير والتكنولوجيا (NIST) حول القوى العاملة عام 2025، يركز التكامل الناجح للذكاء الاصطناعي بشكل أكبر على تطوير مهارات هجينة - تجمع بين أساسيات الأمن وفهم عملي للذكاء الاصطناعي - بدلًا من تحويل متخصصي الأمن إلى علماء بيانات.

كيف يمكن لمتخصصي الأمن السيبراني الاستعداد لدمج الذكاء الاصطناعي؟

ينبغي على المتخصصين السعي للحصول على تدريب في تطبيقات الذكاء الاصطناعي لأغراض الأمن، مثل برنامج أخصائي الأتمتة المعتمد المدعوم بالذكاء الاصطناعي (CAIAS) الذي تقدمه وكالة الأمن السيبراني وأمن البنية التحتية (CISA). يجب التركيز على فهم أساسيات التعلم الآلي، وتقنيات الذكاء الاصطناعي العدائي، وسير عمل التعاون بين الإنسان والذكاء الاصطناعي. ينبغي الحفاظ على أساسيات قوية في مجالات الأمن التقليدية مع تطوير الإلمام بأدوات الذكاء الاصطناعي المستخدمة في اكتشاف التهديدات، وإدارة الثغرات الأمنية، والاستجابة للحوادث.

ما هي أكبر مخاطر استخدام الذكاء الاصطناعي في الأمن السيبراني؟

تشمل المخاطر الرئيسية هجمات التعلم الآلي المعادية التي تتلاعب بأنظمة الذكاء الاصطناعي، وتسميم البيانات الذي يُفسد تدريب النماذج، والاعتماد المفرط الذي يُضعف مهارات الفرق البشرية، وانعدام الشفافية الذي يُصعّب عملية التحقق. ووفقًا لبحث أجرته مؤسسة راند حول مخاطر أمن الذكاء الاصطناعي، يجب على المؤسسات معالجة هذه الثغرات من خلال حوكمة دقيقة للذكاء الاصطناعي، ومراقبة مستمرة، والحفاظ على إشراف بشري على القرارات الأمنية الحاسمة.

هل سيجعل الذكاء الاصطناعي وظائف الأمن السيبراني أسهل أم أكثر تعقيداً؟

كلاهما. يتولى الذكاء الاصطناعي المهام الروتينية والمتكررة التي كانت تستنزف وقت المحللين بشكل كبير، مما يقلل من الإرهاق ويحسن الكفاءة. مع ذلك، يُضيف الذكاء الاصطناعي تعقيدات جديدة، مثل تأمين أنظمة الذكاء الاصطناعي نفسها، والتحقق من صحة مخرجات النماذج، والتصدي للتهديدات التي يُتيحها الذكاء الاصطناعي، كالتزييف العميق. ووفقًا لبحث أجرته مؤسسة بروكينغز عام 2024، فإن أكثر من 301 مليار عامل يتعرضون لتأثيرات الذكاء الاصطناعي التوليدي، لكن هذا التعرض يُغير طبيعة العمل بدلًا من إلغائه، إذ يُحوّل التركيز نحو أنشطة أكثر استراتيجية.

الخلاصة: تبني مستقبل التكافل

الأدلة واضحة. لن يحل الذكاء الاصطناعي محل متخصصي الأمن السيبراني، بل سيعيد تعريف ما يفعله هؤلاء المتخصصون والمهارات التي يحتاجونها.

تحقق المؤسسات التي تتعامل مع الذكاء الاصطناعي كأداة لتعزيز القدرات البشرية بدلاً من استبدالها نتائج أمنية أفضل. فهي تستثمر في تدريب فرقها الحالية على دمج الذكاء الاصطناعي، وتحافظ على حدود واضحة بين الأنشطة الآلية والأنشطة التي يقودها البشر، وتراقب أداء أنظمة الذكاء الاصطناعي باستمرار.

يُهيئ متخصصو الأمن السيبراني الذين يتكيفون من خلال تطوير معرفتهم بالذكاء الاصطناعي مع الحفاظ على أسس أمنية متينة، أنفسهم لنجاح مهني طويل الأمد. يحتاج هذا المجال إلى خبراء قادرين على توجيه أنظمة الذكاء الاصطناعي، والتحقق من صحة مخرجاتها، ومواجهة التحديات الجديدة التي يفرضها الذكاء الاصطناعي.

هل سيحلّ الذكاء الاصطناعي محلّ الأمن السيبراني؟ السؤال بحد ذاته يغفل جوهر المسألة. فالذكاء الاصطناعي يُحدث تحولاً جذرياً في هذا المجال، ويخلق فرصاً لمن يتقبّلون التغيير مع الحفاظ على التفكير النقدي والحكم السليم اللذين لا تستطيع الخوارزميات محاكاتهما.

إن المستقبل ملك للمحترفين الذين يتقنون التعاون بين الخبرة البشرية والذكاء الاصطناعي - حيث يساهم كل منهما بنقاط قوة تكميلية للدفاع ضد مشهد التهديدات المتطور.

هل أنت مستعد لتأمين مستقبلك المهني في مجال الأمن السيبراني؟ ابدأ باستكشاف برامج تدريبية متخصصة في الذكاء الاصطناعي مثل CAIAS، واكتسب خبرة عملية في أدوات أمن الذكاء الاصطناعي، وطوّر مهاراتك في مجالات الأمن التقليدية وتحديات الذكاء الاصطناعي الناشئة. يتطلب مستقبل الأمن السيبراني المتكامل وجود متخصصين قادرين على الجمع بين هذين المجالين.