Korte samenvatting: AI zal cybersecurityprofessionals niet vervangen, maar hun rol transformeren door repetitieve taken zoals dreigingsdetectie en loganalyse te automatiseren. Volgens onderzoek van CISA en NIST blijft menselijke expertise essentieel voor strategische besluitvorming, ethisch oordeel, incidentrespons en het aanpakken van nieuwe dreigingen die AI-systemen niet zelfstandig kunnen oplossen. De toekomst draait om samenwerking tussen mens en AI, waarbij professionals AI-tools begeleiden in plaats van ermee te concurreren.

De vraag duikt steeds weer op in professionele kringen, online forums en cybersecurityconferenties: zal AI cybersecuritybanen vervangen? Het is een terechte zorg. Kunstmatige intelligentie analyseert immers al netwerkverkeerspatronen, detecteert afwijkingen en reageert sneller op bepaalde bedreigingen dan welk menselijk team dan ook.

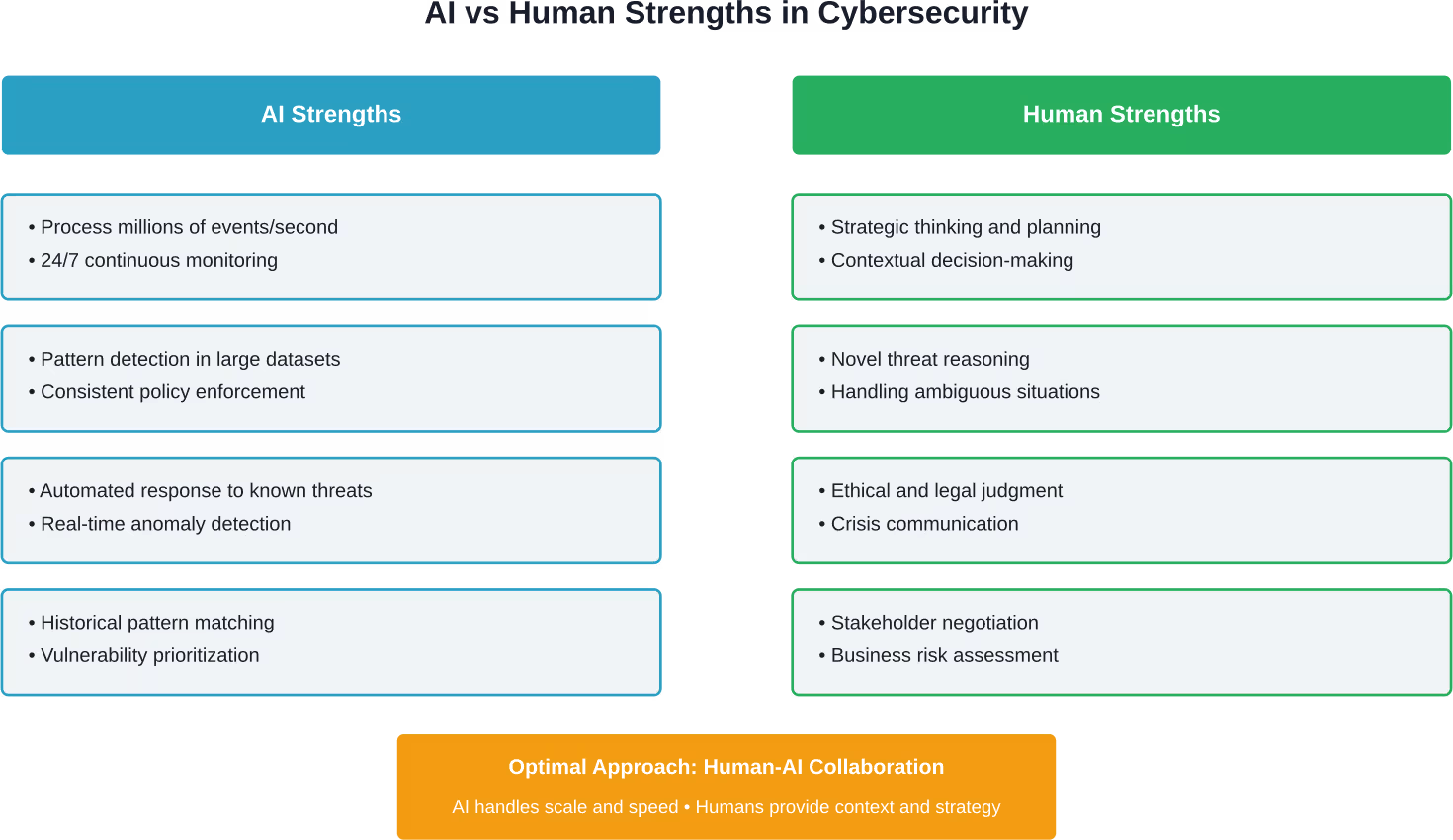

Maar het zit zo: de relatie tussen AI en cybersecurityprofessionals is geen nulsomspel. De technologie elimineert geen menselijke rollen. In plaats daarvan hervormt ze die rollen op manieren die nieuwe vaardigheden vereisen, terwijl de onvervangbare waarde van menselijk oordeel behouden blijft.

Eerlijk gezegd: AI blinkt uit in het verwerken van enorme datasets en het herkennen van patronen. Het heeft echter moeite met context, strategisch denken en de ethische nuances die effectieve beveiligingsprogramma's kenmerken. Dat hiaat is belangrijker dan de meeste mensen beseffen.

De huidige stand van AI in cybersecurityoperaties

Volgens de door CISA gepubliceerde use cases zijn AI-tools essentiële onderdelen geworden van moderne beveiligingsoperaties. Van het opsporen van afwijkingen in netwerkdata tot het verbeteren van dreigingsinformatie: deze systemen vullen de menselijke capaciteiten aan in plaats van ze te vervangen.

De AI-gestuurde automatiseringsinitiatieven van CISA richten zich op het benutten van machine learning om processen te automatiseren en de operationele efficiëntie te verbeteren. Het Certified AI-Driven Automation Specialist (CAIAS)-programma, dat in 2024 van start ging, leidt professionals op om met deze systemen samen te werken – in plaats van ertegen te concurreren.

Huidige AI-toepassingen in cyberbeveiliging zijn onder meer:

- Gedragsanalyse: Machine learning-algoritmen stellen basispatronen voor gebruikersgedrag vast en signaleren afwijkingen die kunnen wijzen op gecompromitteerde inloggegevens of bedreigingen van binnenuit.

- Geautomatiseerde kwetsbaarheidsscan: AI-systemen beoordelen continu cloudomgevingen en on-premises infrastructuur op configuratieafwijkingen en beveiligingslekken.

- Verzameling van dreigingsinformatie: Natuurlijke taalverwerking analyseert beveiligingsbulletins, darkwebforums en dreigingsfeeds om opkomende risico's te prioriteren.

- Loganalyse op grote schaal: AI verwerkt miljoenen logboekvermeldingen om verdachte patronen te identificeren die menselijke analisten dagen zouden kosten om te ontdekken.

- Automatisering van de beleidshandhaving: AI zorgt voor consistente beveiligingsconfiguraties in gedistribueerde cloudaccounts en detecteert configuratieafwijkingen in realtime.

Deze toepassingen hebben een gemeenschappelijk kenmerk: ze verwerken repetitieve, data-intensieve taken die voorheen enorme hoeveelheden tijd en capaciteit van beveiligingsteams in beslag namen. Een cursus van Coastline College over AI-toepassingen in cybersecurity, waarnaar in het NICCS-materiaal wordt verwezen, benadrukt deze samenwerking tussen AI-technologieën en menselijk toezicht.

Ontwerp en implementatie van AI-systemen met AI Superior

AI Superieur Het werk omvat het ontwerpen van AI-systemen die passen in reële omgevingen. Dit omvat het definiëren van het probleem, het ontwikkelen van modellen en het waarborgen dat die modellen correct functioneren zodra ze zijn gekoppeld aan operationele workflows.

Hulp nodig bij het ontwerpen en implementeren van AI?

AI Superior kan u helpen met:

- AI-modellen bouwen voor praktische toepassingen

- het definiëren van de systeemarchitectuur en de technische aanpak

- AI integreren in de bedrijfsinfrastructuur

👉 Neem contact op met AI Superior om uw project, gegevens en implementatieaanpak te bespreken

Waar AI tekortschiet in cyberbeveiliging

Ondanks indrukwekkende mogelijkheden kampen AI-systemen met fundamentele beperkingen die volledige automatisering van beveiligingsprocessen in de weg staan. Inzicht in deze beperkingen verklaart waarom menselijke expertise onmisbaar blijft.

Contextafhankelijke besluitvorming

AI blinkt uit in patroonherkenning, maar heeft moeite met context. Een plotselinge piek in databasequery's kan wijzen op een SQL-injectieaanval, maar het kan ook legitieme bedrijfsactiviteit tijdens een productlancering weerspiegelen. AI signaleert de anomalie. Mensen bepalen of het een bedreiging vormt.

Beveiligingsbeslissingen vereisen vaak inzicht in bedrijfsdoelstellingen, wettelijke vereisten en de risicotolerantie van de organisatie. Dit zijn geen gegevens die een algoritme zelfstandig kan verwerken.

Nieuwe aanvalsvectoren

Machine learning-modellen worden getraind op historische gegevens. Wanneer aanvallers werkelijk nieuwe technieken ontwikkelen, beschikken AI-systemen niet over referentiepunten. Het model kan bedreigingen missen die niet overeenkomen met bekende patronen.

Neem bijvoorbeeld de financiële medewerker in Hongkong die 14,25 miljoen TP4T overmaakte na een videoconferentie in februari 2024 met wat leek op de CFO en andere leidinggevenden. De deepfake-technologie imiteerde spraakpatronen en uiterlijk zo overtuigend dat de medewerker geen argwaan kreeg. AI-detectiesystemen waren dit specifieke aanvalspatroon nog niet eerder tegengekomen.

Beveiligingsprofessionals die met mensen werken, kunnen daarentegen wel redeneren over onbekende scenario's door fundamentele beveiligingsprincipes toe te passen en de motivaties van aanvallers te begrijpen.

Vijandige AI en modelmanipulatie

NIST-onderzoek naar AI-beveiliging benadrukt dat AI-systemen zelf doelwitten voor aanvallen worden. Vijandige machine learning-technieken kunnen trainingsdata vervalsen of invoergegevens creëren die classificatiemodellen misleiden.

Een beveiligingsmodel dat is getraind om malware te identificeren, kan kwaadaardige code verkeerd classificeren als aanvallers de bestandseigenschappen subtiel wijzigen. Om zich tegen deze aanvallen te verdedigen, zijn menselijke beveiligingsonderzoekers nodig die zowel de kwetsbaarheden van AI als de tactieken van aanvallers begrijpen.

De NIST-cursus "AI Model Validation and Test Automation for Critical Systems Essentials", die in mei 2025 is gepubliceerd, behandelt precies deze problemen: het verifiëren van de betrouwbaarheid van AI in domeinen met hoge betrouwbaarheidseisen waar storingen ernstige gevolgen kunnen hebben.

Ethisch en juridisch oordeel

Beveiligingsincidenten brengen vaak privacykwesties, wettelijke naleving en ethische dilemma's met zich mee. Mag het beveiligingsteam van een bedrijf toegang krijgen tot persoonlijke apparaten van werknemers om een vermoedelijk datalek te onderzoeken? Hoe moet de incidentrespons een balans vinden tussen transparantie en de bescherming van gevoelige informatie?

Deze vragen hebben geen algoritmische antwoorden. Ze vereisen menselijk oordeel, gebaseerd op wettelijke kaders, ethische principes en organisatiewaarden.

Hoe AI de rol van cybersecurityspelers transformeert

In plaats van banen in de cybersecurity te elimineren, geeft AI een nieuwe vorm aan die banen. Deze transformatie weerspiegelt historische technologische verschuivingen: automatisering vernietigt geen beroepen, maar richt de menselijke inspanning op activiteiten met een hogere toegevoegde waarde.

Van handmatige analyse naar strategisch toezicht

Beveiligingsanalisten besteedden vroeger uren aan het handmatig controleren van firewall-logboeken en het correleren van gebeurtenissen in verschillende systemen. AI neemt dat tijdrovende werk nu over en verwerkt gegevens met een snelheid die geen enkel menselijk team zou kunnen evenaren.

Deze verschuiving geeft analisten de ruimte om zich te richten op strategische vragen: Zijn de huidige verdedigingsmechanismen afgestemd op het veranderende dreigingslandschap? Hoe moeten investeringen in beveiliging worden geprioriteerd op basis van bedrijfsrisico's? Welke lacunes bestaan er in de mogelijkheden voor incidentrespons?

Volgens onderzoek van het Brookings Institution, gepubliceerd in oktober 2024, zouden meer dan 301.000 tot 3.000 werknemers blootgesteld kunnen worden aan de effecten van generatieve AI, met de grootste impact op midden- tot hoogbetaalde banen en administratieve functies. Het onderzoek benadrukt echter dat blootstelling niet gelijk staat aan vervanging, maar aan een transformatie van taken.

Nieuwe vaardigheidseisen

NIST-onderzoek naar de impact van AI op de cybersecuritysector (gepubliceerd in juni 2025) laat zien hoe het NICE Workforce Framework zich aanpast aan deze veranderingen. Cybersecurityprofessionals hebben steeds vaker vaardigheden nodig die een brug slaan tussen beveiligingsexpertise en AI-kennis.

Volgens projecties van het World Economic Forum, aangehaald in academisch onderzoek, zal naar verwachting 391 TP3T aan vaardigheden van de beroepsbevolking veranderen tegen 2030. Dit vereist aanzienlijke aanpassing en omscholing om te voldoen aan de veranderende eisen van de arbeidsmarkt.

Tot de essentiële, opkomende vaardigheden behoren:

- Evaluatie van AI-modellen: Inzicht in hoe machine learning-modellen beslissingen nemen en het identificeren van mogelijke vooroordelen of kwetsbaarheden.

- Snelle engineering voor beveiliging: Effectief AI-systemen bevragen om relevante dreigingsinformatie en beveiligingsinzichten te verkrijgen.

- Verdediging tegen vijandige AI: AI-systemen beschermen tegen manipulatie- en vergiftigingsaanvallen.

- Interpretatie van het algoritme: Het vertalen van AI-uitkomsten naar bruikbare beveiligingsaanbevelingen.

- Ontwerp van de workflow tussen mens en AI: Het structureren van processen die de samenwerking tussen geautomatiseerde systemen en menselijke analisten optimaliseren.

Dit zijn geen volledig nieuwe beroepen. Het zijn evoluties van bestaande beveiligingsrollen, versterkt door AI-mogelijkheden.

Verhoogde incidentrespons

AI versnelt de initiële detectie en beheersing van bedreigingen aanzienlijk. Geautomatiseerde systemen kunnen gecompromitteerde endpoints isoleren, kwaadwillende IP-adressen blokkeren en vooraf gedefinieerde reactieprotocollen activeren binnen milliseconden na detectie van een incident.

Maar complexe datalekken vereisen nog steeds menselijke coördinatie. Het bepalen van de omvang van het datalek, het beheren van de communicatie met belanghebbenden, het coördineren met de wetshandhaving, het nemen van beslissingen over openbaarmaking – deze activiteiten vereisen een beoordelingsvermogen dat algoritmes niet kunnen nabootsen.

De symbiotische relatie betekent een snellere gemiddelde oplostijd (MTTR) in combinatie met een doordachtere strategische aanpak. AI levert realtime inzichten. Mensen nemen de cruciale beslissingen.

| Beveiligingstaak | Bijdrage van AI | Menselijke bijdrage | Resultaat van de samenwerking |

|---|---|---|---|

| Bedreigingsdetectie | Analyseert netwerkverkeer en logbestanden om afwijkingen in realtime te identificeren. | Valideert waarschuwingen, bepaalt valse positieven en past de bedrijfscontext toe. | Snellere detectie met minder valse positieven. |

| Kwetsbaarheidsbeheer | Scant de infrastructuur en geeft prioriteit op basis van kwetsbaarheid en blootstelling. | Beoordeelt de impact op de bedrijfsvoering, plant herstelmaatregelen in en beheert uitzonderingen. | Prioritering op basis van risico's, afgestemd op de bedrijfsbehoeften. |

| Reactie op incidenten | Automatiseert de inperking, voert reactieprotocollen uit en verzamelt forensische gegevens. | Geeft leiding aan de onderzoeksstrategie, neemt beslissingen over openbaarmaking en coördineert teams. | Snellere beheersing door strategische besluitvorming. |

| Beveiligingsmonitoring | Continue 24/7-bewaking, patroonherkenning over miljoenen gebeurtenissen. | Verfijnt detectieregels, onderzoekt complexe scenario's en behandelt escalaties. | Uitgebreide berichtgeving zonder dat analisten overbelast raken. |

| Bedreigingsjacht | Stelt jachthypothesen voor op basis van dreigingsinformatie en automatiseert dataquery's. | Ontwikkelt creatieve opsporingsscenario's, interpreteert bevindingen en spoort afwijkingen op. | Proactieve dreigingsdetectie op grote schaal |

Integratie van AI en cyberbeveiliging in de praktijk

Organisaties die AI al inzetten voor beveiligingsoperaties laten zien hoe deze samenwerking er in de praktijk uitziet. Dit zijn geen theoretische toekomstscenario's, maar huidige implementaties.

Geautomatiseerde dreigingsinformatie

Beveiligingsteams gebruiken AI om dreigingsinformatie uit honderden bronnen te verzamelen, indicatoren van inbreuken te correleren en dreigingen te prioriteren op basis van de blootstelling van de organisatie. De AI verwerkt natuurlijke taal uit beveiligingsbulletins, extraheert relevante technische indicatoren en koppelt deze aan interne activa.

Menselijke analisten beoordelen de dreigingen op prioriteit, bepalen welke onmiddellijke actie vereisen en passen de verdedigingsstrategie daarop aan. Zonder AI zouden teams verdrinken in ruwe dreigingsgegevens. Zonder mensen zou het systeem de inlichtingen niet kunnen vertalen naar contextspecifieke acties.

Cloudbeveiligingspostuurbeheer

Door AI aangedreven tools scannen continu cloudomgevingen op verkeerde configuraties, te ruime toegangsrechten en beleidsschendingen. Ze verhelpen automatisch bepaalde soorten problemen, zoals het sluiten van openbaar toegankelijke opslagbuckets of het intrekken van ongebruikte inloggegevens.

Beveiligingsarchitecten definiëren het beleid dat door AI wordt gehandhaafd. Ze bepalen acceptabele risiconiveaus, ontwerpen uitzonderingsprocedures en zorgen ervoor dat geautomatiseerde herstelmaatregelen aansluiten bij de bedrijfsvoering. De AI zorgt voor de handhaving op grote schaal. Mensen houden zich bezig met strategie en governance.

Gebruikersgedragsanalyse

Machine learning stelt basispatronen vast voor individuele gebruikers en peer groups. Wanneer een gebruikersaccount ongebruikelijk gedrag vertoont – zoals toegang tot systemen op vreemde tijdstippen, het downloaden van grote datasets of verbinding maken vanaf onbekende locaties – signaleert AI deze activiteit.

Beveiligingsteams onderzoeken gemarkeerde accounts, interviewen gebruikers indien nodig en bepalen of afwijkend gedrag legitieme bedrijfsactiviteiten weerspiegelt of mogelijk een inbreuk op het netwerk inhoudt. De AI identificeert afwijkende gevallen. Mensen bepalen de intentie.

De realiteit van de arbeidsmarkt voor cybersecurityprofessionals

Gegevens van IEEE en academisch onderzoek bieden inzicht in de daadwerkelijke impact van AI op de werkgelegenheid, die aanzienlijk verschilt van dystopische vervangingsscenario's.

In een artikel in IEEE Spectrum uit februari 2024 worden argumenten besproken dat AI mogelijk meer banengroei dan -ontwrichting zal creëren, waardoor banen voor de middenklasse die verloren zijn gegaan door eerdere automatiseringsgolven, wellicht weer kunnen worden hersteld. De kanttekening? De samenleving moet zich beschermen tegen misbruik van AI, met name desinformatie en deepfakes.

De analyse van IEEE Transmitter uit april 2025 bevestigt deze inschatting en merkt op dat AI meer taken vervangt dan banen. De voorspelling van AI-onderzoekers uit 2016 dat automatisering werk zou transformeren in plaats van elimineren, is bijna tien jaar later grotendeels uitgekomen.

In de cybersecuritysector in het bijzonder blijft de vraag het aanbod overtreffen. Het vakgebied kampt met een aanhoudend tekort aan talent, zelfs nu AI-tools steeds vaker worden gebruikt. Waarom? Omdat AI nieuwe beveiligingsuitdagingen creëert, naast het oplossen van bestaande problemen.

AI-beveiliging zelf creëert banen.

Het beveiligen van AI-systemen vereist specialistische expertise. Naarmate organisaties machine learning-modellen inzetten voor hun bedrijfsvoering, hebben ze professionals nodig die verstand hebben van vijandige AI, modelvalidatie en AI-governancekaders.

Het conceptdocument van NIST over het AI RMF-profiel 'Trustworthy AI in Critical Infrastructure' (2026-04-07) behandelt de eisen ten aanzien van veiligheid, beveiliging en betrouwbaarheid van AI die in kritieke systemen wordt ingezet. De implementatie van deze raamwerken vereist menselijke expertise – het creëren van nieuwe rollen in plaats van ze te elimineren.

Volgens een analyse van het Brookings Institution vertegenwoordigden AI-infrastructuur, -modellen, -onderzoek en -governance een aanzienlijk deel van de totale wereldwijde particuliere AI-financiering tussen 2014 en 2025. Deze investeringen duiden op het creëren van banen, niet op het vernietigen ervan.

De noodzaak tot omscholing

Desondanks volstaan statische vaardigheden niet. Cybersecurityprofessionals moeten zich voortdurend aanpassen aan de evolutie van AI-mogelijkheden. Organisaties die investeren in de ontwikkeling van hun personeel – door bestaande teams te trainen in AI-integratie in plaats van ze te vervangen – behalen doorgaans betere resultaten op het gebied van beveiliging.

Het Certified AI-Driven Automation Specialist-programma is één mogelijke route. Vergelijkbare initiatieven van brancheorganisaties, onderwijsinstellingen en overheidsinstanties helpen de kloof te overbruggen tussen traditionele beveiligingsvaardigheden en functies die door AI worden ondersteund.

Risico's die AI met zich meebrengt voor cyberbeveiliging

Ironisch genoeg creëert de integratie van AI in beveiligingsprocessen nieuwe kwetsbaarheden. Inzicht in deze risico's verklaart waarom menselijk toezicht cruciaal blijft.

Vijandige machine learning

Aanvallers kunnen AI-systemen manipuleren door middel van zorgvuldig samengestelde invoer. Vijandige voorbeelden – invoer die is ontworpen om machine learning-modellen te misleiden – kunnen leiden tot verkeerde classificatie van malware, het omzeilen van gezichtsherkenningssystemen of het ontwijken van inbraakdetectie.

Volgens onderzoek van de RAND Corporation naar AI-risico's voor de beveiliging, gepubliceerd in december 2017, bestonden deze kwetsbaarheden al vroeg in de adoptie van AI en zijn ze sindsdien alleen maar geavanceerder geworden. Verdediging tegen vijandige AI vereist beveiligingsprofessionals die zowel de mechanismen van machine learning als de methoden van aanvallers begrijpen.

Gegevensvergiftiging

AI-modellen worden getraind op historische gegevens. Als aanvallers trainingsdatasets compromitteren – door bijvoorbeeld kwaadaardige voorbeelden toe te voegen of de verdeling te vertekenen – erven de resulterende modellen die gebreken. Een gemanipuleerd model voor dreigingsdetectie kan systematisch bepaalde aanvalspatronen negeren of een overmatig aantal valse positieven genereren.

Volgens een analyse van het Brookings Institution uit september 2025 kan een ontoereikende investering in AI-beveiliging op staatsniveau de kosten van cybercriminaliteit aanzienlijk verhogen. In 2021 werd geschat dat cybercriminaliteit Afrikaanse landen 101 TP3 biljoen van hun bruto binnenlands product kostte, oftewel 1 TP4 biljoen,12 miljard – wat de economische gevolgen van falende AI-beveiliging aantoont.

Overmatige afhankelijkheid en verlies van vaardigheden

Organisaties die te veel op AI vertrouwen, lopen het risico dat hun menselijke teams minder vaardig worden. Als analisten stoppen met het ontwikkelen van handmatige onderzoeksvaardigheden omdat AI de routinematige analyses afhandelt, verliezen ze het vermogen om te functioneren wanneer AI-systemen falen of met nieuwe scenario's worden geconfronteerd.

Het behouden van menselijke expertise naast AI-automatisering vereist doelbewuste personeelsontwikkeling. Teams hebben mogelijkheden nodig om fundamentele vaardigheden te oefenen, zelfs wanneer AI taken theoretisch sneller zou kunnen uitvoeren.

Verklaarbaarheid en verantwoording

Veel AI-modellen functioneren als black boxes: ze produceren resultaten zonder transparante onderbouwing. Wanneer een AI-systeem een account als gecompromitteerd markeert, moeten beveiligingsteams begrijpen waarom. Zonder uitleg is het onmogelijk om AI-beslissingen te valideren.

Deze uitdaging wordt nog groter in gereguleerde sectoren waar beveiligingsbeslissingen controleerbaar en verdedigbaar moeten zijn. Het onderzoek van NIST naar betrouwbare AI benadrukt dat de beveiliging van AI-systemen deels afhangt van verklaarbaarheid en verantwoordingsplicht – eigenschappen die menselijk toezicht vereisen.

Beste praktijken voor samenwerking tussen mens en AI op het gebied van beveiliging

Organisaties die AI succesvol integreren in hun beveiligingsprocessen volgen bepaalde patronen. Deze werkwijzen maximaliseren de voordelen van AI en behouden tegelijkertijd de menselijke expertise.

Definieer duidelijke grenzen voor automatisering.

Stel expliciete regels op over welke taken AI autonoom kan uitvoeren en welke menselijke goedkeuring vereisen. Activiteiten met een laag risico en een hoog volume, zoals routinematige kwetsbaarheidsscans, lenen zich voor volledige automatisering. Beslissingen met grote gevolgen, zoals het openbaar maken van incidenten, vereisen menselijk toezicht.

Leg deze grenzen vast in beveiligingsdraaiboeken, zodat teams begrijpen wanneer ze op AI-uitvoer kunnen vertrouwen en wanneer ze deze onafhankelijk moeten valideren.

Implementeer validatie met menselijke tussenkomst.

Voor cruciale beveiligingsbeslissingen is het belangrijk workflows te ontwerpen die menselijke bevestiging vereisen voordat door AI aanbevolen acties worden uitgevoerd. Dit kan betekenen dat analisten waarschuwingen met een hoge prioriteit beoordelen voordat geautomatiseerde blokkering plaatsvindt, of dat goedkeuring vereist is voordat AI-systemen het beveiligingsbeleid van de productieomgeving wijzigen.

Bij benaderingen waarbij een mens betrokken is, is de reactietijd iets langer, maar het risico op valse positieven die tot bedrijfsstoringen leiden, wordt aanzienlijk verkleind.

Continue modelbewaking

AI-modellen verslechteren na verloop van tijd doordat het dreigingslandschap verandert en de trainingsdata verouderd raken. Beveiligingsteams moeten de prestaties van modellen continu monitoren en statistieken bijhouden zoals het aantal valse positieven, de detectienauwkeurigheid en de voorspellingsbetrouwbaarheid.

Wanneer de prestaties afnemen, moeten modellen opnieuw getraind worden met actuele gegevens. Dit voortdurende onderhoud vereist menselijk toezicht; AI-systemen kunnen niet zelfstandig bepalen wanneer ze niet langer effectief zijn.

Investeer in AI-geletterdheidstraining.

Beveiligingsprofessionals hoeven geen datawetenschappers te worden, maar ze moeten wel basiskennis van AI hebben. Trainingen moeten ingaan op hoe machine learning-modellen werken, veelvoorkomende fouten en hoe je AI-uitvoer kritisch kunt interpreteren.

Volgens het NIST-onderzoek naar de impact op de beroepsbevolking uit juni 2025 behalen organisaties die investeren in de ontwikkeling van AI-vaardigheden voor bestaande teams betere integratieresultaten dan organisaties die volledig nieuw personeel met AI-specialisatie proberen aan te werven.

Handmatige mogelijkheden behouden

Zelfs wanneer AI routinetaken afhandelt, moeten teams periodiek handmatig onderzoek en analyse blijven uitvoeren. Deze oefeningen zorgen ervoor dat vaardigheden niet verloren gaan en bereiden teams voor op scenario's waarin AI-systemen falen of ontoereikend blijken.

Regelmatige simulaties van AI-systeemstoringen, uitgevoerd aan de hand van tafelbladsimulaties, helpen teams zich voor te bereiden op verminderde prestaties en het vertrouwen in hun fundamentele capaciteiten te behouden.

De toekomst: verbetering, geen vervanging.

Er zijn steeds meer aanwijzingen dat AI in de toekomst cybersecurityprofessionals zal ondersteunen in plaats van vervangen. Dit is geen wensdenken, maar weerspiegelt de fundamentele beperkingen van AI en de blijvende waarde van menselijk oordeel.

Naarmate de mogelijkheden van AI toenemen, nemen ook de aanvalsoppervlakken toe. Elke nieuwe AI-toepassing brengt beveiligingsuitdagingen met zich mee die menselijke expertise vereisen om aan te pakken. Het deepfake-incident in Hongkong laat zien hoe AI aanvallers net zozeer in staat stelt als verdedigers.

Kijk, de vraag "zal AI cybersecurity vervangen?" benadert het probleem verkeerd. Een betere vraag is: hoe zullen cybersecurityprofessionals zich aanpassen om AI effectief in te zetten en tegelijkertijd de nieuwe risico's die het met zich meebrengt aan te pakken?

Organisaties hebben professionals nodig die zowel traditionele beveiligingsprincipes als de uitdagingen van het AI-tijdperk begrijpen. Degenen die een hybride vaardighedenpakket ontwikkelen – een combinatie van beveiligingsfundamentals en AI-kennis – zullen steeds waardevoller blijken.

De transformatie vertoont overeenkomsten met eerdere technologische verschuivingen. Cloudcomputing heeft systeembeheerders niet overbodig gemaakt; het heeft de aard van systeembeheer veranderd. Mobiele technologie heeft softwareontwikkelaars niet overbodig gemaakt; het heeft de aard van de applicaties die ze bouwen, veranderd.

AI volgt hetzelfde patroon. Het elimineert specifieke taken en creëert nieuwe taken die menselijk oordeel, creativiteit en strategisch denken vereisen.

Veelgestelde vragen

Zal AI cybersecurity-analisten volledig vervangen?

Nee. AI zal repetitieve taken zoals loganalyse en routinematige monitoring automatiseren, maar cybersecurity-analisten blijven essentieel voor strategische besluitvorming, coördinatie van incidentrespons en het omgaan met nieuwe bedreigingen. Volgens onderzoek van CISA naar toepassingen van AI vullen AI-tools de menselijke capaciteiten aan in plaats van ze te vervangen. Complexe onderzoeken, ethische afwegingen en communicatie met belanghebbenden vereisen menselijke expertise die AI niet kan repliceren.

Welke banen in de cybersecuritysector lopen het meeste risico door AI-automatisering?

Instapfuncties die zich voornamelijk richten op routinematige monitoring en handmatige loganalyse ondergaan de grootste transformatie. Deze rollen evolueren echter in plaats van te verdwijnen: junior analisten richten zich steeds meer op het valideren van AI-output, het afstemmen van detectiesystemen en het onderzoeken van escalerende waarschuwingen. Volgens onderzoek van IEEE uit 2025 vervangt AI meer taken dan dat het banen volledig overneemt, waardoor menselijke inspanningen zich kunnen richten op activiteiten met een hogere toegevoegde waarde.

Welke nieuwe functies op het gebied van cyberbeveiliging creëert AI?

AI creëert gespecialiseerde rollen, waaronder AI-beveiligingsspecialisten die machine learning-systemen beschermen tegen aanvallen van buitenaf, experts in modelvalidatie die de betrouwbaarheid van AI-systemen verifiëren, AI-governance-analisten die zorgen voor een verantwoorde implementatie van AI, en prompt engineers die beveiligingsgerichte AI-interacties optimaliseren. Het NIST-raamwerk voor 2026 over betrouwbare AI in kritieke infrastructuur benadrukt de groeiende vraag naar professionals die zowel beveiliging als AI-risicomanagement begrijpen.

Moeten cybersecurityprofessionals programmeren en datawetenschap leren?

Basiskennis van AI is nuttig, maar diepgaande programmeerexpertise is voor de meeste cybersecurityfuncties niet vereist. Professionals moeten begrijpen hoe machine learning-modellen conceptueel werken, veelvoorkomende fouten herkennen en AI-uitvoer kritisch interpreteren. Volgens NIST-onderzoek naar de arbeidsmarkt uit 2025 richt succesvolle AI-integratie zich meer op het ontwikkelen van hybride vaardigheden – een combinatie van beveiligingsprincipes met praktische AI-kennis – dan op het omvormen van beveiligingsprofessionals tot datawetenschappers.

Hoe kunnen cybersecurityprofessionals zich voorbereiden op de integratie van AI?

Professionals zouden zich moeten verdiepen in AI-toepassingen voor beveiliging, bijvoorbeeld door het Certified AI-Driven Automation Specialist (CAIAS)-programma van CISA te volgen. Focus daarbij op het begrijpen van de basisprincipes van machine learning, AI-technieken die vijandige aanvallen simuleren en workflows voor samenwerking tussen mens en AI. Behoud een sterke basis in traditionele beveiligingsdomeinen en ontwikkel tegelijkertijd kennis van AI-tools die worden gebruikt voor dreigingsdetectie, kwetsbaarheidsbeheer en incidentrespons.

Wat zijn de grootste risico's van het gebruik van AI in cyberbeveiliging?

Belangrijke risico's zijn onder meer vijandige machine learning-aanvallen die AI-systemen manipuleren, datavergiftiging die de modeltraining verstoort, overmatige afhankelijkheid die leidt tot een afname van de vaardigheden van menselijke teams en een gebrek aan verklaarbaarheid dat validatie bemoeilijkt. Volgens onderzoek van RAND naar AI-beveiligingsrisico's moeten organisaties deze kwetsbaarheden aanpakken door middel van zorgvuldig AI-beheer, continue monitoring en menselijk toezicht op cruciale beveiligingsbeslissingen.

Zal AI cybersecuritybanen makkelijker of juist complexer maken?

Beide. AI neemt saaie, repetitieve taken over die voorheen veel tijd van analisten in beslag namen, waardoor burn-out wordt verminderd en de efficiëntie wordt verbeterd. AI introduceert echter ook nieuwe complexiteit: het beveiligen van AI-systemen zelf, het valideren van modeluitvoer en het aanpakken van door AI mogelijk gemaakte bedreigingen zoals deepfakes. Volgens onderzoek van het Brookings Institution uit 2024 worden meer dan 301.000 werknemers blootgesteld aan de effecten van generatieve AI, maar deze blootstelling transformeert het werk in plaats van het te elimineren, waardoor de focus verschuift naar meer strategische activiteiten.

Conclusie: De symbiotische toekomst omarmen

Het bewijs is duidelijk. AI zal cybersecurityprofessionals niet vervangen, maar zal herdefiniëren wat deze professionals doen en welke vaardigheden ze nodig hebben.

Organisaties die AI beschouwen als een hulpmiddel ter ondersteuning van de mens in plaats van als vervanging ervan, behalen betere resultaten op het gebied van beveiliging. Ze investeren in de training van bestaande teams op het gebied van AI-integratie, handhaven duidelijke grenzen tussen geautomatiseerde en door mensen aangestuurde activiteiten en monitoren continu de prestaties van AI-systemen.

Cybersecurityprofessionals die zich aanpassen door AI-kennis te ontwikkelen en tegelijkertijd een sterke basis in beveiliging te behouden, creëren een goede uitgangspositie voor een succesvolle carrière op de lange termijn. Het vakgebied heeft experts nodig die AI-systemen kunnen begeleiden, hun output kunnen valideren en de nieuwe uitdagingen die AI met zich meebrengt, kunnen aanpakken.

Zal AI de cybersecurity vervangen? Die vraag gaat eigenlijk voorbij aan de kern van de zaak. AI transformeert het vakgebied en creëert kansen voor diegenen die verandering omarmen en tegelijkertijd het kritisch denkvermogen en het beoordelingsvermogen behouden die algoritmes niet kunnen nabootsen.

De toekomst behoort toe aan professionals die de samenwerking tussen menselijke expertise en kunstmatige intelligentie beheersen – waarbij beide complementaire sterke punten inbrengen om zich te verdedigen tegen een steeds veranderend dreigingslandschap.

Klaar om je cybersecuritycarrière toekomstbestendig te maken? Begin met het verkennen van AI-gerichte trainingsprogramma's zoals CAIAS, doe praktijkervaring op met AI-beveiligingstools en bouw expertise op in zowel traditionele beveiligingsdomeinen als opkomende AI-uitdagingen. De symbiotische toekomst van cybersecurity vraagt om professionals die beide werelden kunnen overbruggen.