Kurzzusammenfassung: KI wird Cybersicherheitsexperten nicht ersetzen, sondern ihre Rolle durch die Automatisierung wiederkehrender Aufgaben wie Bedrohungserkennung und Protokollanalyse grundlegend verändern. Laut Studien von CISA und NIST bleibt menschliches Fachwissen unerlässlich für strategische Entscheidungen, ethische Beurteilungen, die Reaktion auf Sicherheitsvorfälle und die Bewältigung neuartiger Bedrohungen, die KI-Systeme nicht selbstständig lösen können. Die Zukunft liegt in der Zusammenarbeit von Mensch und KI, in der Experten KI-Tools steuern, anstatt mit ihnen zu konkurrieren.

Die Frage taucht immer wieder in Fachkreisen, Online-Foren und auf Cybersicherheitskonferenzen auf: Wird KI Cybersicherheitsjobs ersetzen? Das ist eine berechtigte Sorge. Schließlich analysiert künstliche Intelligenz bereits Netzwerkverkehrsmuster, erkennt Anomalien und reagiert auf bestimmte Bedrohungen schneller als jedes menschliche Team.

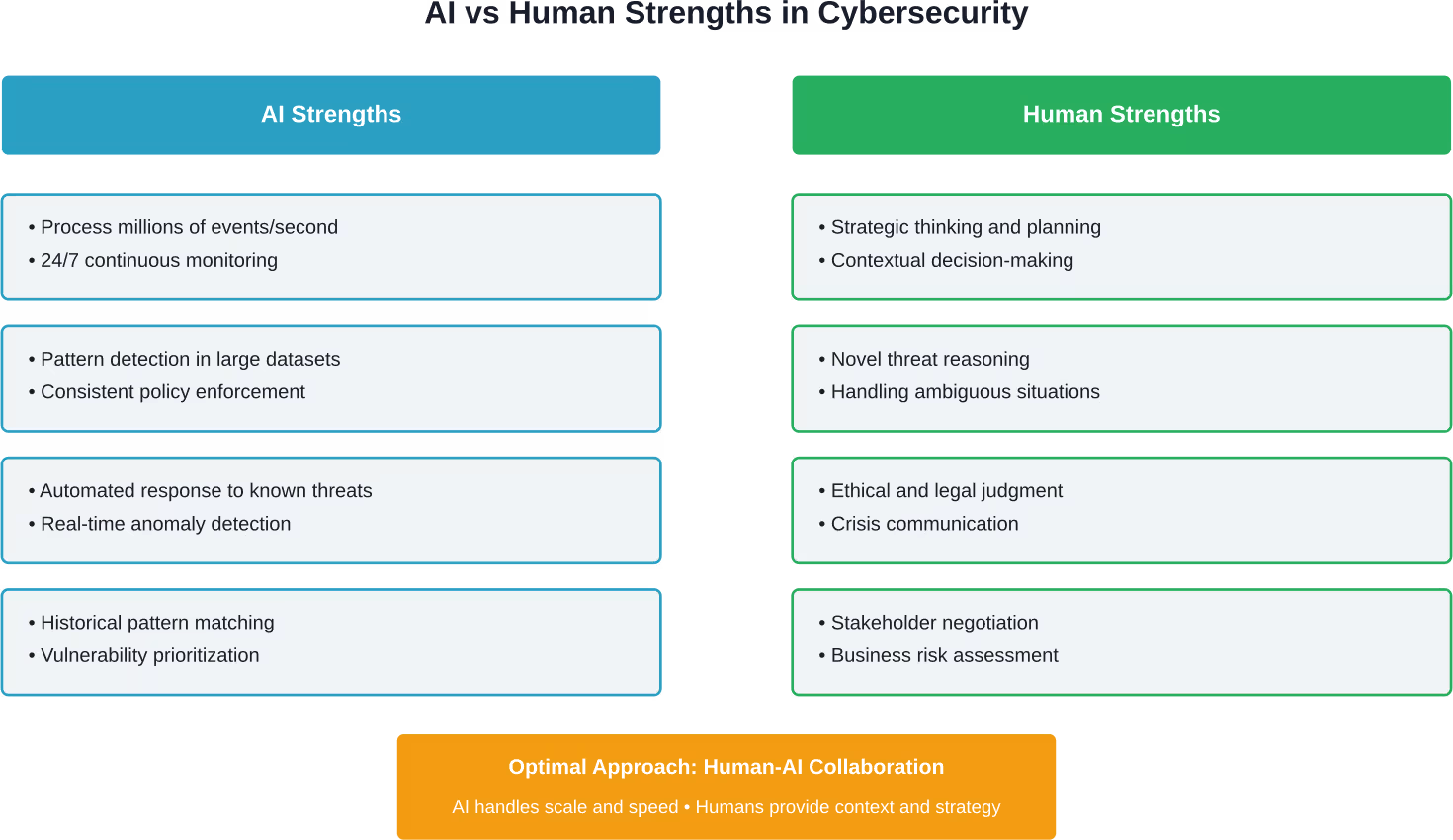

Aber der entscheidende Punkt ist: Die Beziehung zwischen KI und Cybersicherheitsexperten ist kein Nullsummenspiel. Die Technologie ersetzt nicht die menschliche Rolle. Vielmehr formt sie diese neu und erfordert neue Fähigkeiten, während gleichzeitig der unersetzliche Wert menschlichen Urteilsvermögens erhalten bleibt.

Mal ehrlich: KI ist hervorragend darin, riesige Datensätze zu verarbeiten und Muster zu erkennen. Schwierigkeiten hat sie jedoch mit Kontext, strategischem Denken und den ethischen Feinheiten, die effektive Sicherheitsprogramme ausmachen. Diese Lücke ist bedeutsamer, als den meisten bewusst ist.

Der aktuelle Stand der KI in Cybersicherheitsoperationen

Laut den von CISA veröffentlichten Anwendungsfällen sind KI-Tools zu zentralen Bestandteilen moderner Sicherheitsoperationen geworden. Von der Erkennung von Anomalien in Netzwerkdaten bis hin zur Verbesserung der Bedrohungsanalyse ergänzen diese Systeme die menschlichen Fähigkeiten, anstatt sie zu ersetzen.

Die KI-gestützten Automatisierungsinitiativen von CISA konzentrieren sich auf die Nutzung von maschinellem Lernen zur Automatisierung von Prozessen und zur Steigerung der betrieblichen Effizienz. Das 2024 ins Leben gerufene Programm „Certified AI-Driven Automation Specialist“ (CAIAS) bildet Fachkräfte aus, die mit diesen Systemen zusammenarbeiten – und nicht gegen sie konkurrieren.

Zu den aktuellen KI-Anwendungen im Bereich Cybersicherheit gehören:

- Verhaltensanalyse: Maschinelle Lernalgorithmen ermitteln grundlegende Nutzerverhaltensmuster und kennzeichnen Abweichungen, die auf kompromittierte Zugangsdaten oder Insiderbedrohungen hindeuten könnten.

- Automatisierte Schwachstellensuche: KI-Systeme bewerten kontinuierlich Cloud-Umgebungen und lokale Infrastrukturen auf Konfigurationsabweichungen und Sicherheitslücken.

- Aggregation von Bedrohungsinformationen: Die Verarbeitung natürlicher Sprache analysiert Sicherheitsbulletins, Darknet-Foren und Bedrohungsfeeds, um neu auftretende Risiken zu priorisieren.

- Logarithmusanalyse im großen Stil: KI verarbeitet Millionen von Protokolleinträgen, um verdächtige Muster zu erkennen, deren Aufdeckung menschliche Analysten Tage kosten würde.

- Automatisierung der Richtliniendurchsetzung: KI gewährleistet konsistente Sicherheitskonfigurationen über verteilte Cloud-Konten hinweg und erkennt Konfigurationsabweichungen in Echtzeit.

Diese Anwendungen weisen eine Gemeinsamkeit auf: Sie übernehmen repetitive, datenintensive Aufgaben, die zuvor enorme Ressourcen der Sicherheitsteams beanspruchten. Ein Kurs des Coastline College über KI-Anwendungen in der Cybersicherheit, auf den in den NICCS-Materialien verwiesen wird, betont diese Zusammenarbeit zwischen KI-Technologien und menschlicher Aufsicht.

KI-Systemdesign und -implementierung mit überlegener KI

AI Superior arbeitet an der Entwicklung von KI-Systemen, die sich in reale Umgebungen einfügen. Dies umfasst die Definition des Problems, die Entwicklung von Modellen und die Sicherstellung, dass diese Modelle nach der Anbindung an operative Arbeitsabläufe ordnungsgemäß funktionieren.

Benötigen Sie Hilfe bei der Entwicklung und dem Einsatz von KI?

AI Superior kann Ihnen helfen bei:

- Entwicklung von KI-Modellen für praktische Anwendungsfälle

- Definition der Systemarchitektur und des technischen Ansatzes

- Integration von KI in die Geschäftsinfrastruktur

👉 Kontaktieren Sie AI Superior um Ihr Projekt, Ihre Daten und Ihren Implementierungsansatz zu besprechen

Wo KI in der Cybersicherheit Schwächen aufweist

Trotz ihrer beeindruckenden Fähigkeiten stoßen KI-Systeme an grundlegende Grenzen, die eine vollständige Automatisierung von Sicherheitsoperationen verhindern. Das Verständnis dieser Grenzen erklärt, warum menschliches Fachwissen weiterhin unverzichtbar ist.

Kontextabhängige Entscheidungsfindung

KI ist hervorragend in der Mustererkennung, hat aber Schwierigkeiten mit dem Kontext. Ein plötzlicher Anstieg der Datenbankabfragen könnte auf einen SQL-Injection-Angriff hindeuten – oder aber legitime Geschäftsaktivitäten im Rahmen einer Produkteinführung widerspiegeln. Die KI erkennt die Anomalie. Menschen entscheiden, ob sie eine Bedrohung darstellt.

Sicherheitsentscheidungen erfordern häufig ein Verständnis der Geschäftsziele, der regulatorischen Anforderungen und der Risikotoleranz der Organisation. Dies sind keine Datenpunkte, die ein Algorithmus selbstständig verarbeiten kann.

Neue Angriffsvektoren

Maschinelle Lernmodelle werden mit historischen Daten trainiert. Wenn Angreifer jedoch wirklich neue Techniken entwickeln, fehlen KI-Systemen die Vergleichspunkte. Das Modell könnte Bedrohungen übersehen, die nicht bekannten Mustern entsprechen.

Nehmen wir den Fall eines Finanzangestellten in Hongkong, der nach einer Videokonferenz im Februar 2024 mit dem vermeintlichen Finanzvorstand und anderen Führungskräften 1,4 Billionen Pesos überwies. Die Deepfake-Technologie ahmte Sprachmuster und Aussehen so überzeugend nach, dass der Mitarbeiter keinen Verdacht schöpfte. KI-Erkennungssysteme waren zuvor noch nie auf dieses spezielle Angriffsmuster gestoßen.

Sicherheitsexperten hingegen können über unbekannte Szenarien nachdenken, indem sie grundlegende Sicherheitsprinzipien anwenden und die Motivationen der Angreifer verstehen.

Gegnerische KI und Modellmanipulation

Die Forschung des NIST zur KI-Sicherheit betont, dass KI-Systeme selbst zu Angriffszielen werden. Mithilfe von Adversarial-Machine-Learning-Techniken können Trainingsdaten verfälscht oder Eingaben erzeugt werden, die Klassifizierungsmodelle täuschen.

Ein Sicherheitsmodell, das auf die Erkennung von Schadsoftware trainiert wurde, kann bösartigen Code falsch klassifizieren, wenn Angreifer die Dateieigenschaften subtil verändern. Die Abwehr solcher Angriffe erfordert Sicherheitsexperten, die sowohl KI-Schwachstellen als auch die Taktiken von Angreifern verstehen.

Der im Mai 2025 veröffentlichte Kurs „AI Model Validation and Test Automation for Critical Systems Essentials“ des NIST befasst sich genau mit diesen Bedenken – der Überprüfung der Zuverlässigkeit von KI in Hochsicherheitsbereichen, in denen Fehler schwerwiegende Folgen haben.

Ethische und rechtliche Beurteilung

Sicherheitsvorfälle werfen häufig Fragen des Datenschutzes, der Einhaltung gesetzlicher Bestimmungen und ethischer Dilemmata auf. Sollte das Sicherheitsteam eines Unternehmens auf private Geräte von Mitarbeitern zugreifen, um einen vermuteten Datenverstoß zu untersuchen? Wie lässt sich bei der Reaktion auf Sicherheitsvorfälle Transparenz mit dem Schutz sensibler Daten in Einklang bringen?

Diese Fragen lassen sich nicht algorithmisch beantworten. Sie erfordern menschliches Urteilsvermögen, das auf rechtlichen Rahmenbedingungen, ethischen Grundsätzen und den Werten der Organisation basiert.

Wie KI die Rollen in der Cybersicherheit verändert

Anstatt Cybersicherheitsjobs zu vernichten, verändert KI deren Aufgabenbereich. Diese Transformation spiegelt historische technologische Umbrüche wider – Automatisierung zerstört Berufe nicht so sehr, sondern lenkt menschliche Anstrengungen auf höherwertige Tätigkeiten um.

Von der manuellen Analyse zur strategischen Aufsicht

Früher verbrachten Sicherheitsanalysten Stunden damit, Firewall-Protokolle manuell zu überprüfen und Ereignisse in unterschiedlichen Systemen zu korrelieren. Diese mühsame Arbeit übernimmt heute KI und verarbeitet Daten in einer Geschwindigkeit, die kein menschliches Team erreichen könnte.

Diese Verlagerung ermöglicht es Analysten, sich auf strategische Fragen zu konzentrieren: Sind die aktuellen Abwehrmaßnahmen mit den sich entwickelnden Bedrohungslandschaften im Einklang? Wie sollten Sicherheitsinvestitionen auf der Grundlage des Geschäftsrisikos priorisiert werden? Welche Lücken bestehen bei den Fähigkeiten zur Reaktion auf Sicherheitsvorfälle?

Laut einer im Oktober 2024 veröffentlichten Studie der Brookings Institution könnten über 301.000 Arbeitnehmer den Auswirkungen generativer KI ausgesetzt sein, wobei die größten Auswirkungen auf mittel- bis hochbezahlte Berufe und Büroangestellte zu erwarten wären. Die Studie betont jedoch, dass die Konfrontation mit KI nicht gleichbedeutend mit Arbeitsplatzverlust ist – sie signalisiert vielmehr eine Transformation der Arbeitsaufgaben.

Neue Qualifikationsanforderungen

Eine Studie des NIST zu den Auswirkungen von KI auf die Cybersicherheitsbranche (veröffentlicht im Juni 2025) zeigt, wie sich das NICE Workforce Framework an diese Veränderungen anpasst. Cybersicherheitsexperten benötigen zunehmend Kompetenzen, die Sicherheitsexpertise und KI-Kenntnisse verbinden.

Laut Prognosen des Weltwirtschaftsforums, die in akademischen Studien zitiert werden, werden sich bis 2030 voraussichtlich 391.030 der Qualifikationen der Arbeitskräfte verändern, was eine erhebliche Anpassung und Umschulung erforderlich macht, um den sich wandelnden Anforderungen des Arbeitsmarktes gerecht zu werden.

Zu den entscheidenden Zukunftskompetenzen gehören:

- Evaluierung von KI-Modellen: Verstehen, wie Modelle des maschinellen Lernens Entscheidungen treffen und potenzielle Verzerrungen oder Schwachstellen identifizieren

- Schnelle Sicherheitsentwicklung: Effektive Abfrage von KI-Systemen zur Gewinnung relevanter Bedrohungsinformationen und Sicherheitserkenntnisse

- Abwehr von gegnerischer KI: Schutz von KI-Systemen vor Manipulations- und Vergiftungsangriffen

- Algorithmeninterpretation: Übersetzung von KI-Ergebnissen in umsetzbare Sicherheitsempfehlungen

- Gestaltung des Mensch-KI-Workflows: Strukturierung von Prozessen zur Optimierung der Zusammenarbeit zwischen automatisierten Systemen und menschlichen Analysten

Es handelt sich hierbei nicht um gänzlich neue Berufe. Vielmehr sind es Weiterentwicklungen bestehender Sicherheitsrollen, die durch KI-Fähigkeiten erweitert wurden.

Erhöhte Reaktion auf Zwischenfälle

KI beschleunigt die erste Bedrohungserkennung und -eindämmung erheblich. Automatisierte Systeme können kompromittierte Endpunkte isolieren, schädliche IP-Adressen blockieren und vordefinierte Reaktionsabläufe innerhalb von Millisekunden nach Erkennung eines Vorfalls auslösen.

Doch auch komplexe Sicherheitsvorfälle erfordern weiterhin menschliche Koordination. Die Ermittlung des Umfangs des Vorfalls, die Steuerung der Kommunikation mit den Beteiligten, die Abstimmung mit den Strafverfolgungsbehörden, die Entscheidung über die Offenlegung – all diese Tätigkeiten erfordern Urteilsvermögen, das Algorithmen nicht ersetzen können.

Die symbiotische Beziehung ermöglicht eine schnellere Problemlösung und eine durchdachtere strategische Reaktion. KI liefert Echtzeit-Einblicke. Menschen treffen die entscheidenden Entscheidungen.

| Sicherheitsaufgabe | KI-Beitrag | Menschlicher Beitrag | Ergebnis der Zusammenarbeit |

|---|---|---|---|

| Bedrohungserkennung | Analysiert Netzwerkverkehr und Protokolle, um Anomalien in Echtzeit zu erkennen. | Validiert Warnmeldungen, ermittelt Fehlalarme und wendet den Geschäftskontext an. | Schnellere Erkennung mit weniger Fehlalarmen |

| Schwachstellenmanagement | Scannt die Infrastruktur und priorisiert Bedrohungen anhand ihrer Ausnutzbarkeit und Gefährdung. | Bewertet die Auswirkungen auf das Geschäft, plant Abhilfemaßnahmen und verwaltet Ausnahmen. | Risikobasierte Priorisierung, abgestimmt auf die Geschäftsanforderungen |

| Reaktion auf Vorfälle | Automatisiert die Eindämmung, führt Reaktionspläne aus und sammelt forensische Daten. | Leitet die Ermittlungsstrategie, trifft Entscheidungen zur Offenlegung von Beweismitteln, koordiniert Teams | Schnellere Eindämmung durch strategische Entscheidungsfindung |

| Sicherheitsüberwachung | Kontinuierliche Überwachung rund um die Uhr, Mustererkennung bei Millionen von Ereignissen | Optimiert Erkennungsregeln, untersucht komplexe Szenarien, bearbeitet Eskalationen | Umfassende Berichterstattung ohne Analysten-Burnout |

| Bedrohungssuche | Schlägt auf Basis von Bedrohungsdaten Jagdhypothesen vor und automatisiert Datenabfragen. | Entwickelt kreative Suchszenarien, interpretiert Ergebnisse und verfolgt Anomalien. | Proaktive Bedrohungserkennung in großem Umfang |

Integration von KI und Cybersicherheit in der Praxis

Organisationen, die KI bereits im Bereich der Sicherheitsoperationen einsetzen, zeigen, wie diese Zusammenarbeit in der Praxis aussieht. Es handelt sich hierbei nicht um theoretische Zukunftsszenarien, sondern um aktuelle Implementierungen.

Automatisierte Bedrohungsanalyse

Sicherheitsteams nutzen KI, um Bedrohungsdaten aus Hunderten von Quellen zu aggregieren, Indikatoren für Kompromittierungen zu korrelieren und Bedrohungen anhand der Gefährdungslage des Unternehmens zu priorisieren. Die KI verarbeitet die natürliche Sprache von Sicherheitsbulletins, extrahiert relevante technische Indikatoren und ordnet sie internen Assets zu.

Menschliche Analysten prüfen priorisierte Bedrohungen, entscheiden, welche sofortiges Handeln erfordern, und passen die Verteidigungsstrategien entsprechend an. Ohne KI würden die Teams in der Flut unstrukturierter Bedrohungsdaten ertrinken. Ohne menschliche Expertise könnte das System die gewonnenen Informationen nicht in kontextgerechte Maßnahmen umsetzen.

Cloud-Sicherheitsstatusmanagement

KI-gestützte Tools scannen Cloud-Umgebungen kontinuierlich auf Fehlkonfigurationen, zu liberale Zugriffskontrollen und Richtlinienverstöße. Sie beheben automatisch bestimmte Problemklassen – beispielsweise durch das Schließen öffentlich zugänglicher Speicherbereiche oder den Widerruf nicht verwendeter Anmeldeinformationen.

Sicherheitsarchitekten definieren die Richtlinien, die die KI durchsetzt. Sie legen akzeptable Risikostufen fest, entwerfen Ausnahmeprozesse und stellen sicher, dass die automatisierte Behebung mit den Geschäftsabläufen übereinstimmt. Die KI übernimmt die Durchsetzung im großen Maßstab. Strategie und Governance werden von Menschen verantwortet.

Nutzerverhaltensanalyse

Maschinelles Lernen ermittelt Basismuster für einzelne Nutzer und Nutzergruppen. Zeigt ein Benutzerkonto ungewöhnliches Verhalten – beispielsweise den Zugriff auf Systeme zu ungewöhnlichen Zeiten, das Herunterladen großer Datensätze oder die Verbindung von unbekannten Standorten aus –, kennzeichnet die KI diese Aktivität.

Sicherheitsteams untersuchen verdächtige Konten, befragen bei Bedarf Nutzer und prüfen, ob ungewöhnliches Verhalten auf legitime Geschäftstätigkeit oder eine mögliche Sicherheitslücke zurückzuführen ist. Die KI identifiziert Ausreißer. Menschen ermitteln die Absicht.

Die Realität des Arbeitsmarktes für Cybersicherheitsexperten

Daten von IEEE und aus der akademischen Forschung geben Aufschluss über die tatsächlichen Auswirkungen von KI auf die Beschäftigung – die sich erheblich von dystopischen Ersatzszenarien unterscheiden.

Ein Bericht von IEEE Spectrum vom Februar 2024 erörtert Argumente dafür, dass KI mehr neue Arbeitsplätze schaffen als sie verdrängen könnte und möglicherweise die durch frühere Automatisierungswellen verloren gegangenen Arbeitsplätze der Mittelschicht wiederbeleben könnte. Die Einschränkung? Die Gesellschaft muss sich vor KI-Missbrauch schützen, insbesondere vor Desinformation und Deepfakes.

Die Analyse des IEEE Transmitter vom April 2025 bestätigt diese Einschätzung und stellt fest, dass KI mehr Aufgaben als Arbeitsplätze ersetzt. Die Prognose von KI-Forschern aus dem Jahr 2016, dass die Automatisierung die Arbeit eher verändern als abschaffen würde, hat sich fast ein Jahrzehnt später weitgehend bewahrheitet.

Gerade im Bereich der Cybersicherheit übersteigt die Nachfrage weiterhin das Angebot. Trotz der zunehmenden Verbreitung von KI-Tools herrscht in diesem Bereich ein anhaltender Fachkräftemangel. Warum? Weil KI neue Sicherheitsherausforderungen schafft, während sie gleichzeitig bestehende löst.

KI-Sicherheit schafft selbst Arbeitsplätze

Die Absicherung von KI-Systemen erfordert spezialisiertes Fachwissen. Da Unternehmen Modelle des maschinellen Lernens für ihre Geschäftsprozesse einsetzen, benötigen sie Fachkräfte, die sich mit adversarieller KI, Modellvalidierung und KI-Governance-Frameworks auskennen.

Das Konzeptpapier des NIST zum KI-RMF-Profil für vertrauenswürdige KI in kritischen Infrastrukturen (07.04.2026) behandelt die Anforderungen an Sicherheit und Zuverlässigkeit von KI, die in kritischen Systemen eingesetzt wird. Die Implementierung dieser Rahmenwerke erfordert menschliches Fachwissen – es werden Rollen geschaffen, anstatt bestehende abzuschaffen.

Laut einer Analyse der Brookings Institution entfielen zwischen 2014 und 2025 weltweit erhebliche Anteile der gesamten privaten KI-Finanzierung auf KI-Infrastruktur, -Modelle, -Forschung und -Governance. Diese Investitionen deuten auf die Schaffung von Arbeitsplätzen hin, nicht auf deren Vernichtung.

Das Umschulungsgebot

Dennoch reichen statische Kompetenzen nicht aus. Cybersicherheitsexperten müssen sich kontinuierlich an die Weiterentwicklung der KI-Fähigkeiten anpassen. Unternehmen, die in die Weiterbildung ihrer Mitarbeiter investieren – indem sie bestehende Teams in der KI-Integration schulen, anstatt sie zu ersetzen – erzielen in der Regel bessere Sicherheitsergebnisse.

Das Programm zum zertifizierten Spezialisten für KI-gestützte Automatisierung stellt einen möglichen Weg dar. Ähnliche Initiativen von Branchenverbänden, akademischen Einrichtungen und Regierungsbehörden tragen dazu bei, die Lücke zwischen traditionellen Sicherheitskompetenzen und KI-gestützten Aufgaben zu schließen.

Risiken, die KI für die Cybersicherheit mit sich bringt

Ironischerweise schafft die Integration von KI in Sicherheitsprozesse neue Schwachstellen. Das Verständnis dieser Risiken erklärt, warum die menschliche Aufsicht weiterhin unerlässlich ist.

Adversarisches maschinelles Lernen

Angreifer können KI-Systeme durch gezielt präparierte Eingaben manipulieren. Solche „Adversarial Examples“ – Eingaben, die maschinelle Lernmodelle täuschen sollen – können zu Fehlklassifizierungen von Schadsoftware führen, Gesichtserkennungssysteme umgehen oder die Erkennung von Eindringlingen verhindern.

Laut einer im Dezember 2017 veröffentlichten Studie der RAND Corporation zu KI-Sicherheitsrisiken bestanden diese Schwachstellen bereits früh in der KI-Einführung und sind seither nur noch komplexer geworden. Die Abwehr von KI-Angriffen erfordert Sicherheitsexperten, die sowohl die Mechanismen des maschinellen Lernens als auch die Methoden von Angreifern verstehen.

Datenvergiftung

KI-Modelle werden mit historischen Daten trainiert. Wenn Angreifer Trainingsdatensätze kompromittieren – etwa durch das Einschleusen schädlicher Beispiele oder die Verfälschung von Verteilungen –, übernehmen die resultierenden Modelle diese Fehler. Ein manipuliertes Bedrohungserkennungsmodell könnte bestimmte Angriffssignaturen systematisch ignorieren oder übermäßig viele Fehlalarme auslösen.

Laut einer Analyse der Brookings Institution vom September 2025 könnten unzureichende Investitionen in KI-Sicherheit auf staatlicher Ebene die Kosten der Cyberkriminalität erheblich erhöhen. Im Jahr 2021 beliefen sich die Kosten der Cyberkriminalität für afrikanische Staaten schätzungsweise auf 101,3 Billionen US-Dollar ihres Bruttoinlandsprodukts (101,3 Billionen US-Dollar) – ein deutliches Zeichen für die wirtschaftlichen Folgen von Sicherheitslücken im Bereich KI.

Übermäßige Abhängigkeit und Entqualifizierung

Organisationen, die sich zu stark auf KI verlassen, riskieren, die Kompetenzen ihrer Mitarbeiter zu verkümmern. Wenn Analysten ihre manuellen Ermittlungsfähigkeiten vernachlässigen, weil KI Routineanalysen übernimmt, verlieren sie die Fähigkeit, bei Systemausfällen oder in neuen Szenarien handlungsfähig zu bleiben.

Um menschliches Fachwissen neben KI-Automatisierung zu erhalten, ist eine gezielte Personalentwicklung erforderlich. Teams benötigen Möglichkeiten, grundlegende Fähigkeiten zu trainieren, selbst wenn KI Aufgaben theoretisch schneller erledigen könnte.

Erklärbarkeit und Verantwortlichkeit

Viele KI-Modelle funktionieren wie Blackboxes – sie liefern Ergebnisse ohne nachvollziehbare Begründung. Wenn ein KI-System ein Konto als kompromittiert kennzeichnet, müssen Sicherheitsteams die Gründe dafür verstehen. Ohne diese Erklärbarkeit ist die Validierung von KI-Entscheidungen unmöglich.

Diese Herausforderung verschärft sich in regulierten Branchen, in denen Sicherheitsentscheidungen nachvollziehbar und begründbar sein müssen. Die Forschung des NIST zu vertrauenswürdiger KI unterstreicht, dass die Sicherheit von KI-Systemen teilweise von Erklärbarkeit und Verantwortlichkeit abhängt – Eigenschaften, die menschliche Steuerung erfordern.

Bewährte Verfahren für die Mensch-KI-Kollaboration im Bereich Sicherheit

Organisationen, die KI erfolgreich in ihre Sicherheitsabläufe integrieren, folgen bestimmten Mustern. Diese Praktiken maximieren den Nutzen der KI und erhalten gleichzeitig das menschliche Fachwissen.

Definiere klare Automatisierungsgrenzen

Legen Sie klare Regeln fest, welche Aufgaben die KI autonom erledigt und welche eine menschliche Genehmigung erfordern. Risikoarme, häufige Aktivitäten wie routinemäßige Schwachstellenscans eignen sich für die vollständige Automatisierung. Entscheidungen mit weitreichenden Folgen, wie die Meldung von Sicherheitsvorfällen, erfordern hingegen menschliche Aufsicht.

Dokumentieren Sie diese Grenzen in Sicherheitshandbüchern, damit die Teams verstehen, wann sie den KI-Ausgaben vertrauen können und wann sie diese unabhängig überprüfen müssen.

Implementierung der Mensch-in-den-Kreislauf-Validierung

Bei kritischen Sicherheitsentscheidungen sollten Arbeitsabläufe so gestaltet werden, dass eine menschliche Bestätigung erforderlich ist, bevor KI-empfohlene Aktionen ausgeführt werden. Dies kann bedeuten, dass Analysten Warnmeldungen mit hoher Priorität prüfen, bevor eine automatische Blockierung erfolgt, oder dass eine Genehmigung erforderlich ist, bevor KI-Systeme die Sicherheitsrichtlinien in der Produktion ändern.

Ansätze mit menschlicher Einbindung verlangsamen die Reaktionszeit zwar geringfügig, reduzieren aber das Risiko von Fehlalarmen, die zu Betriebsunterbrechungen führen könnten, drastisch.

Kontinuierliche Modellüberwachung

KI-Modelle verlieren mit der Zeit an Leistung, da sich die Bedrohungslandschaft weiterentwickelt und die Trainingsdaten veralten. Sicherheitsteams müssen die Modellleistung kontinuierlich überwachen und Kennzahlen wie Fehlalarmraten, Erkennungsgenauigkeit und Vorhersagesicherheit verfolgen.

Bei nachlassender Leistung müssen die Modelle mit aktuellen Daten neu trainiert werden. Diese kontinuierliche Wartung erfordert menschliche Aufsicht – KI-Systeme können nicht selbstständig feststellen, wann sie nicht mehr effektiv sind.

Investieren Sie in KI-Kompetenzschulungen

Sicherheitsexperten müssen keine Data Scientists werden, benötigen aber grundlegende KI-Kenntnisse. Schulungen sollten die Funktionsweise von Machine-Learning-Modellen, häufige Fehlerquellen und die kritische Interpretation von KI-Ergebnissen umfassen.

Laut einer Studie des NIST zum Einfluss auf die Arbeitskräfte vom Juni 2025 erzielen Organisationen, die in die Entwicklung von KI-Kompetenzen für bestehende Teams investieren, bessere Integrationsergebnisse als solche, die versuchen, komplett neue KI-spezialisierte Mitarbeiter einzustellen.

Manuelle Fähigkeiten beibehalten

Auch wenn KI Routineaufgaben übernimmt, sollten Teams regelmäßig manuelle Untersuchungen und Analysen durchführen. Diese Übungen verhindern, dass Fähigkeiten verkümmern, und bereiten die Teams auf Szenarien vor, in denen KI-Systeme versagen oder sich als unzureichend erweisen.

Regelmäßige Planspielübungen, die Ausfälle von KI-Systemen simulieren, helfen Teams, sich auf eingeschränkte Abläufe vorzubereiten und das Vertrauen in ihre grundlegenden Fähigkeiten aufrechtzuerhalten.

Die Zukunft: Erweiterung, nicht Ersatz

Die Beweislage deutet eindeutig auf eine Zukunft hin, in der KI Cybersicherheitsexperten unterstützt, anstatt sie zu ersetzen. Dies ist kein Wunschdenken – es spiegelt die grundlegenden Grenzen der KI und den anhaltenden Wert menschlichen Urteilsvermögens wider.

Mit zunehmenden Fähigkeiten der KI wächst auch die Angriffsfläche. Jede neue KI-Anwendung birgt Sicherheitsrisiken, deren Bewältigung menschliches Fachwissen erfordert. Der Deepfake-Vorfall in Hongkong verdeutlicht, wie KI Angreifern ebenso wie Verteidigern Macht verleiht.

Die Frage “Wird KI die Cybersicherheit ersetzen?” greift zu kurz. Die bessere Frage lautet: Wie können sich Cybersicherheitsexperten anpassen, um KI effektiv zu nutzen und gleichzeitig die damit verbundenen neuen Risiken zu bewältigen?

Unternehmen benötigen Fachkräfte, die sowohl traditionelle Sicherheitsprinzipien als auch die Herausforderungen des KI-Zeitalters verstehen. Wer über hybride Kompetenzen verfügt – eine Kombination aus Sicherheitsgrundlagen und KI-Kenntnissen –, wird zunehmend an Wert gewinnen.

Diese Transformation ähnelt früheren technologischen Umbrüchen. Cloud Computing hat Systemadministratoren nicht überflüssig gemacht; es hat lediglich deren Aufgaben verändert. Mobile Technologien haben Softwareentwickler nicht überflüssig gemacht; sie haben lediglich die Art der von ihnen entwickelten Anwendungen verändert.

KI folgt demselben Muster. Sie eliminiert bestimmte Aufgaben und schafft gleichzeitig neue, die menschliches Urteilsvermögen, Kreativität und strategisches Denken erfordern.

Häufig gestellte Fragen

Wird KI Cybersicherheitsanalysten vollständig ersetzen?

Nein. KI wird zwar wiederkehrende Aufgaben wie die Protokollanalyse und die routinemäßige Überwachung automatisieren, doch Cybersicherheitsanalysten bleiben unerlässlich für strategische Entscheidungen, die Koordination der Reaktion auf Sicherheitsvorfälle und den Umgang mit neuen Bedrohungen. Laut einer Studie der CISA zu KI-Anwendungsfällen ergänzen KI-Tools die menschlichen Fähigkeiten, anstatt sie zu ersetzen. Komplexe Untersuchungen, ethische Beurteilungen und die Kommunikation mit Stakeholdern erfordern menschliches Fachwissen, das KI nicht nachbilden kann.

Welche Cybersicherheitsjobs sind am stärksten durch KI-Automatisierung gefährdet?

Einstiegspositionen, die sich hauptsächlich auf routinemäßige Überwachung und manuelle Protokollprüfung konzentrieren, stehen vor dem größten Wandel. Diese Rollen entwickeln sich jedoch weiter, anstatt zu verschwinden – Junior-Analysten konzentrieren sich zunehmend auf die Validierung von KI-Ergebnissen, die Optimierung von Erkennungssystemen und die Untersuchung eskalierter Warnmeldungen. Laut einer IEEE-Studie aus dem Jahr 2025 wird KI mehr Aufgaben als ganze Arbeitsplätze ersetzen und so menschliche Arbeitskraft für wertschöpfendere Tätigkeiten freisetzen.

Welche neuen Rollen im Bereich Cybersicherheit entstehen durch KI?

KI schafft spezialisierte Rollen, darunter KI-Sicherheitsspezialisten, die Systeme des maschinellen Lernens vor Angriffen schützen, Experten für Modellvalidierung, die die Zuverlässigkeit von KI-Systemen überprüfen, Analysten für KI-Governance, die einen verantwortungsvollen KI-Einsatz gewährleisten, und Prompt Engineers, die sicherheitsorientierte KI-Interaktionen optimieren. Der NIST-Rahmenplan für vertrauenswürdige KI in kritischen Infrastrukturen bis 2026 unterstreicht die wachsende Nachfrage nach Fachkräften mit Kenntnissen in Sicherheits- und KI-Risikomanagement.

Müssen Cybersicherheitsexperten Programmierkenntnisse und Datenwissenschaft erlernen?

Grundlegende KI-Kenntnisse sind hilfreich, aber tiefgreifende Programmierkenntnisse sind für die meisten Positionen im Bereich Cybersicherheit nicht erforderlich. Fachkräfte sollten die Funktionsweise von Machine-Learning-Modellen konzeptionell verstehen, häufige Fehlerquellen erkennen und KI-Ergebnisse kritisch interpretieren können. Laut einer NIST-Arbeitsmarktstudie aus dem Jahr 2025 konzentriert sich eine erfolgreiche KI-Integration eher auf die Entwicklung hybrider Kompetenzen – die Kombination von Sicherheitsgrundlagen mit praktischem KI-Verständnis – als darauf, Sicherheitsexperten zu Datenwissenschaftlern auszubilden.

Wie können sich Cybersicherheitsexperten auf die KI-Integration vorbereiten?

Fachkräfte sollten sich in KI-Anwendungen für die Sicherheit weiterbilden, beispielsweise durch das von CISA angebotene Programm „Certified AI-Driven Automation Specialist“ (CAIAS). Der Fokus sollte auf dem Verständnis der Grundlagen des maschinellen Lernens, adversarieller KI-Techniken und Arbeitsabläufen in der Mensch-KI-Kollaboration liegen. Neben soliden Kenntnissen in traditionellen Sicherheitsbereichen sollten auch KI-Tools für Bedrohungserkennung, Schwachstellenmanagement und Incident Response weiterentwickelt werden.

Was sind die größten Risiken beim Einsatz von KI in der Cybersicherheit?

Zu den Hauptrisiken zählen Angriffe auf KI-Systeme durch manipulierte maschinelle Lernverfahren, Datenvergiftung, die das Modelltraining beeinträchtigt, übermäßige Abhängigkeit von KI, die zu einer Abwertung menschlicher Teams führt, und mangelnde Erklärbarkeit, die die Validierung erschwert. Laut einer Studie von RAND zu KI-Sicherheitsrisiken müssen Unternehmen diese Schwachstellen durch sorgfältige KI-Governance, kontinuierliche Überwachung und die Aufrechterhaltung der menschlichen Kontrolle kritischer Sicherheitsentscheidungen beheben.

Wird KI die Arbeit im Bereich Cybersicherheit vereinfachen oder verkomplizieren?

Beides. KI übernimmt mühsame, repetitive Aufgaben, die zuvor viel Analystenzeit in Anspruch nahmen, reduziert so Burnout und steigert die Effizienz. Gleichzeitig bringt KI aber auch neue Komplexität mit sich – die Sicherheit der KI-Systeme selbst, die Validierung von Modellergebnissen und die Bekämpfung KI-basierter Bedrohungen wie Deepfakes. Laut einer Studie der Brookings Institution aus dem Jahr 2024 sind mehr als 301.000 Billionen Arbeitnehmer den Auswirkungen generativer KI ausgesetzt. Diese Auswirkungen verändern jedoch die Arbeit, anstatt sie zu eliminieren, und verlagern den Fokus auf strategischere Tätigkeiten.

Fazit: Die symbiotische Zukunft gestalten

Die Beweislage ist eindeutig. Künstliche Intelligenz wird Cybersicherheitsexperten nicht ersetzen – sie wird deren Aufgaben und die dafür benötigten Fähigkeiten neu definieren.

Organisationen, die KI als Werkzeug zur Unterstützung des Menschen und nicht als dessen Ersatz einsetzen, erzielen bessere Sicherheitsergebnisse. Sie investieren in die Schulung ihrer bestehenden Teams im Bereich KI-Integration, achten auf klare Abgrenzungen zwischen automatisierten und von Menschen gesteuerten Aktivitäten und überwachen kontinuierlich die Leistung ihrer KI-Systeme.

Cybersicherheitsexperten, die sich durch den Ausbau ihrer KI-Kompetenzen und die Beibehaltung solider Sicherheitsgrundlagen weiterentwickeln, sichern sich langfristige Karrierechancen. Der Bereich benötigt Experten, die KI-Systeme steuern, deren Ergebnisse validieren und die neuen Herausforderungen der KI bewältigen können.

Wird KI also die Cybersicherheit ersetzen? Die Frage selbst verfehlt den Kern der Sache. KI transformiert den Beruf und schafft Chancen für diejenigen, die Veränderungen begrüßen und gleichzeitig kritisches Denken und Urteilsvermögen bewahren, die Algorithmen nicht ersetzen können.

Die Zukunft gehört den Fachleuten, die die Zusammenarbeit zwischen menschlichem Fachwissen und künstlicher Intelligenz beherrschen – wobei jede ihre komplementären Stärken einbringt, um sich gegen eine sich ständig verändernde Bedrohungslandschaft zu verteidigen.

Bereit für eine zukunftssichere Karriere im Bereich Cybersicherheit? Beginnen Sie mit der Erkundung KI-orientierter Weiterbildungsprogramme wie CAIAS, sammeln Sie praktische Erfahrung mit KI-Sicherheitstools und entwickeln Sie Expertise sowohl in traditionellen Sicherheitsbereichen als auch in den neuen Herausforderungen der KI. Die symbiotische Zukunft der Cybersicherheit erfordert Fachkräfte, die beide Welten miteinander verbinden können.