El panorama de la IA ha cambiado drásticamente. Tres grandes actores compiten ahora por la atención de los desarrolladores: Claude de Anthropic, la serie GPT de OpenAI y la innovadora DeepSeek.

Pero ¿qué modelo realmente cumple con lo prometido? La respuesta no es sencilla. Cada uno aporta diferentes ventajas, y la mejor opción depende completamente de lo que se esté construyendo.

Analicemos cómo se comparan estos modelos con las métricas que realmente importan.

Gamas de modelos: ¿entre qué estás eligiendo realmente?

Comprender la oferta actual de modelos es el primer paso. Estas empresas no solo tienen un modelo único, sino que han creado familias completas con diferentes niveles de rendimiento.

La lista actual de Claude

Anthropic ofrece tres modelos principales a principios de 2026. Claude Opus 4.6 representa su modelo más inteligente, diseñado específicamente para la creación de agentes y tareas de codificación complejas. Claude Sonnet 4.6 equilibra velocidad e inteligencia, lo que lo convierte en su modelo recomendado para uso diario. Claude Haiku 4.5 es la opción más rápida con inteligencia de vanguardia.

Claude Opus 4.6 y Claude Sonnet 4.6 (y algunas variantes de Sonnet 4.x) admiten una ventana de contexto de token de 1 millón en versión beta en la API de Claude, Amazon Bedrock, Google Cloud Vertex AI y Microsoft Foundry.

La línea ampliada de OpenAI

El portafolio de OpenAI ha crecido considerablemente. Su producto estrella, GPT-5.2, se centra en tareas de codificación y agencia en diversas industrias, con una ventana de contexto de 400.000 tokens y un límite de conocimiento del 31 de agosto de 2025. El costo de entrada es de $1,75 por millón de tokens, mientras que el de salida es de $14,00 por millón de tokens. El costo de entrada en caché se reduce a tan solo $0,18 por millón de tokens.

GPT-4.1 funciona como su modelo no racional más inteligente, con una impresionante ventana de contexto de 1.047.576 tokens y un límite de conocimiento del 1 de junio de 2024. El precio estándar es de $2,00 por millón de tokens de entrada y $8,00 por millón de tokens de salida.

La línea se extiende hacia abajo con GPT-5-mini (entrada $0.25, salida $2.00 por millón de tokens) y GPT-5-nano (entrada $0.05, salida $0.40 por millón de tokens) para aplicaciones con presupuesto limitado.

El enfoque Lean de DeepSeek

DeepSeek simplifica las cosas. Su DeepSeek-V3.2 está disponible en dos modos: deepseek-chat (modo sin pensamiento) y deepseek-reasoner (modo pensante). Ambos funcionan con el mismo modelo base y una ventana de contexto de 128K.

Según la documentación oficial de la API de DeepSeek, deepseek-chat tiene una resolución máxima de salida de 4K (8K como máximo), mientras que deepseek-reasoner permite una resolución de salida de 32K (64K como máximo). La estructura de precios es notablemente competitiva: $0.028 por millón de tokens de entrada con aciertos de caché, $0.28 por millón de tokens de entrada estándar y $0.42 por millón de tokens de salida.

DeepSeek-V3.2-Speciale lleva las capacidades de razonamiento aún más lejos, logrando un rendimiento de nivel oro en competencias como IMO, CMO, ICPC World Finals e IOI 2025. Actualmente, es solo API sin soporte para el uso de herramientas.

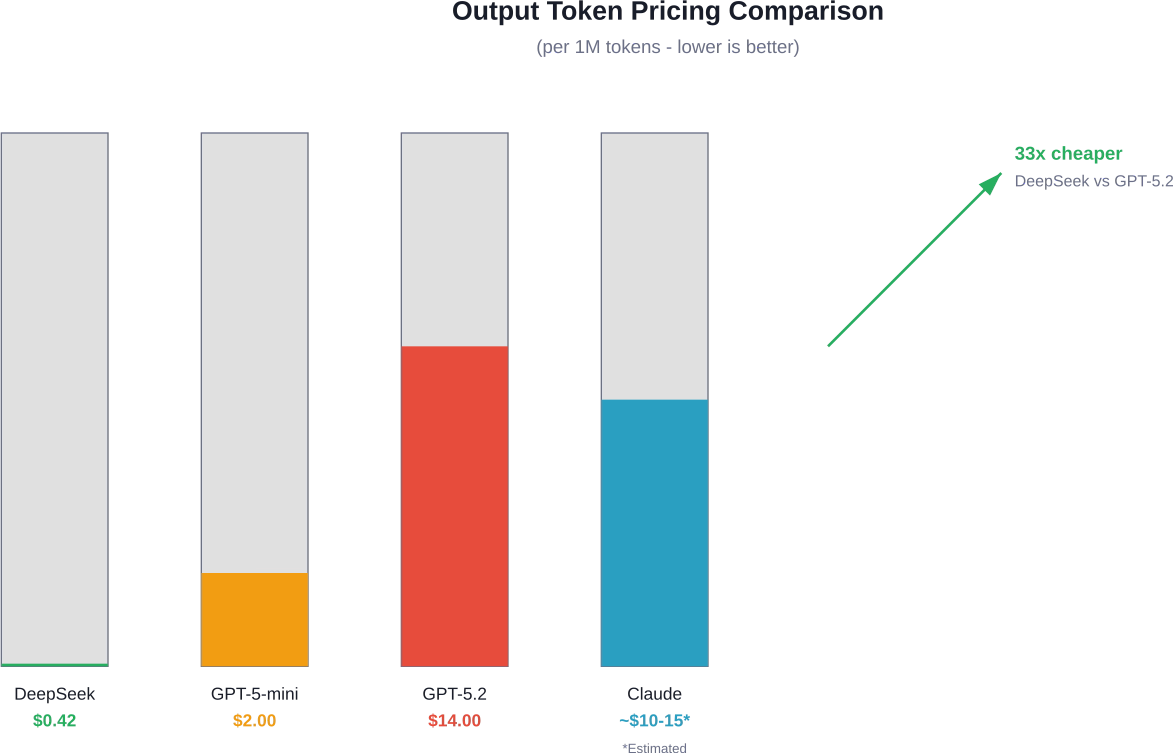

Posicionamiento de costo-rendimiento de los principales modelos de IA a principios de 2026, que muestra la ventaja de precios competitivos de DeepSeek

Rendimiento de codificación: donde la teoría se pone en práctica

A los desarrolladores les preocupa una cosa por encima de todo: ¿puede este modelo realmente escribir buen código?

Según una investigación de arXiv que compara estos modelos en tareas de codificación, DeepSeek logró un rendimiento competitivo a costos significativamente menores, mientras que Claude generalmente cuesta significativamente más por token. Esta es una propuesta de valor atractiva para equipos con presupuestos ajustados.

En serio: la brecha entre estos modelos en las tareas de codificación se ha reducido drásticamente. GPT-4.1 ofrece capacidades de codificación equilibradas con una sólida integración con Azure si ya forma parte del ecosistema de Microsoft. Claude Opus destaca por comprender bases de código complejas y ofrecer sugerencias de refactorización bien pensadas.

Pero aquí es donde la cosa se pone interesante. Según los datos de referencia, DeepSeek R1 obtuvo una puntuación de 65,9 en LiveCodeBench (Pass@1-COT), con OpenAI o1-1217 con 63,4 y Claude-3.5-Sonnet con 33,8, mientras que GPT-4o-0513 obtuvo una puntuación de 34,2.

| Modelo | Puntuación de HumanEval | Banco de código en vivo | Mejor caso de uso

|

|---|---|---|---|

| Búsqueda profunda R1 | 85%+ | 65.9 | Tareas de codificación que se ajustan al presupuesto |

| GPT-5.2 | Alto | ~63-65 | Flujos de trabajo de codificación agentic |

| Claude Opus 4.6 | Competitivo | N / A | Refactorización compleja |

| OpenAI o1-1217 | Alto | 63.4 | Tareas que requieren mucho razonamiento |

¿Qué pasa con la codificación en el mundo real?

Los puntos de referencia cuentan una historia. El trabajo de desarrollo real cuenta otra.

Las discusiones de la comunidad revelan que Claude tiende a destacar en mantener un estilo de código consistente en proyectos grandes. GPT-5 gestiona eficazmente decisiones arquitectónicas complejas, especialmente cuando es necesario analizar múltiples enfoques de implementación. DeepSeek sorprende a los desarrolladores con su capacidad para comprender el contexto a pesar de su bajo precio.

¿La verdad? Para aplicaciones CRUD sencillas y patrones de desarrollo web estándar, los tres funcionan admirablemente. Las diferencias surgen al depurar problemas sutiles de concurrencia o refactorizar sistemas heredados.

Capacidades de razonamiento: ¿Hasta qué profundidad piensan?

Los modelos de la serie o de OpenAI se entrenaron explícitamente para pensar con mayor profundidad y generar un razonamiento en cadena antes de responder. Esto genera un razonamiento lógico sólido en problemas complejos.

DeepSeek V3.2 en modo de razonamiento (deepseek-reasoner) compite directamente en este espacio. El modelo obtuvo resultados de oro en olimpiadas matemáticas y concursos de programación competitivos. DeepSeek-V3.2-Speciale maximiza las capacidades de razonamiento para competir con modelos avanzados como Gemini-3.0-Pro, aunque requiere un mayor uso de tokens.

El enfoque de Claude difiere ligeramente. En lugar de una cadena de pensamiento extensa y visible para los usuarios, Claude utiliza el pensamiento adaptativo: decide dinámicamente cuándo y cuánto pensar según la complejidad de la tarea.

Según una investigación académica de arXiv, al comparar estos modelos en tareas de computación científica, cada uno mostró patrones de razonamiento distintos. El estudio evaluó el rendimiento en múltiples dominios y descubrió que la elección del modelo influyó significativamente en los resultados según el tipo de razonamiento específico requerido.

La verificación de la realidad de los precios

El costo importa, especialmente cuando se procesan millones de tokens al mes.

Seamos específicos con los números de las páginas de precios oficiales.

Estructura de precios de OpenAI

El procesamiento estándar de GPT-5.2 cuesta $1.75 por millón de tokens de entrada y $14.00 por millón de tokens de salida. La entrada en caché se reduce a $0.175 por millón de tokens. La API por lotes ofrece un ahorro de 50%, lo que reduce la entrada a $0.875 y la salida a $7.00 por millón de tokens.

GPT-5-mini ofrece una opción más económica con una entrada de $0.25 y una salida de $2.00 por millón de tokens (tarifas estándar). GPT-5-nano ofrece un precio inferior, con una entrada de $0.025 y una salida de $0.20 por millón de tokens.

Los modelos profesionales cuestan considerablemente más. GPT-5.2-pro ejecuta $21.00 de entrada y $168.00 de salida por millón de tokens.

Precios de Claude (basados en patrones históricos)

Si bien el precio oficial actual de Claude Opus 4.6 no se especificó en la documentación proporcionada, la investigación de arXiv señaló que Claude generalmente cuesta más que otros enfoques de IA para tareas similares.

La información actual sobre los precios de la API de Claude está disponible en la documentación oficial de Anthropic.

Precios agresivos de DeepSeek

DeepSeek ofrece precios considerablemente más bajos que los demás. Según la documentación oficial de su API, el precio estándar es de $0.28 por millón de tokens de entrada y $0.42 por millón de tokens de salida. Con los aciertos de caché, el precio de entrada se reduce a tan solo $0.028 por millón de tokens.

Eso es aproximadamente entre 5 y 50 veces más barato que modelos comparables, dependiendo de la configuración.

Comparación de precios de tokens de salida que muestra la drástica ventaja de costos de DeepSeek sobre los modelos de la competencia

Contexto de Windows y memoria

¿Cuánta información pueden almacenar estos modelos en su “memoria de trabajo” durante una conversación?

- Claude lidera con una ventana de contexto de un millón de tokens en la versión beta. Esto es suficiente para albergar varias novelas completas o una base de código extensa. Esto hace que Claude sea especialmente eficaz para tareas que requieren el análisis de documentos masivos o conversaciones largas.

- GPT-5.2 ofrece 400 000 tokens, mientras que GPT-4.1 ofrece una ventana de contexto de 1 047 576 tokens. Ambas son cantidades considerables, más que suficientes para la mayoría de las aplicaciones del mundo real.

- DeepSeek V3.2 ofrece 128 000 tokens, una cantidad menor, pero suficiente para la mayoría de las tareas. La mayoría de los desarrolladores no alcanzarán este límite en un uso normal.

¿El impacto práctico? Si desarrolla herramientas que analizan repositorios completos, procesan documentos legales extensos o mantienen conversaciones muy largas, Claude o GPT-4.1 tienen la ventaja. Para aplicaciones de chatbot estándar o tareas de codificación específicas, los 128K de DeepSeek son perfectos.

Ecosistema e Integración

Los modelos no existen de forma aislada. La integración es importante.

La ventaja del ecosistema de OpenAI

Los modelos de OpenAI se integran a la perfección con Microsoft Azure, GitHub Copilot e innumerables herramientas de terceros. El ecosistema GPT es sólido y cuenta con amplia documentación, recursos comunitarios e integraciones predefinidas.

Se admiten llamadas a funciones, salidas estructuradas, ajustes, destilación y resultados predichos. El punto de conexión v1/chat/completes se ha convertido en un estándar de facto compatible con muchas herramientas.

La creciente presencia de Claude

Claude está disponible a través de múltiples canales: API de Claude directamente de Anthropic, Amazon Bedrock, Google Cloud Vertex AI y Microsoft Foundry. Este enfoque multinube ofrece flexibilidad.

Anthropic ha introducido las Habilidades de Agente, capacidades modulares que amplían la funcionalidad de Claude. Cada habilidad incluye instrucciones, metadatos y recursos opcionales que Claude utiliza automáticamente cuando es necesario.

Juego de compatibilidad de DeepSeek

La API de DeepSeek imita intencionalmente el formato de OpenAI. Según su documentación oficial, puedes usar el SDK de OpenAI o cualquier software compatible con OpenAI con DeepSeek simplemente cambiando la URL base a https://api.deepseek.com y proporcionando una clave de API de DeepSeek.

Esta compatibilidad significa que muchas herramientas existentes funcionan con DeepSeek inmediatamente, lo que reduce el costo del cambio.

Seguridad, alineación y transparencia

No todos los modelos abordan la seguridad de la misma manera.

- Claude se ha forjado una reputación de meticuloso en la alineación de seguridad. El enfoque de IA Constitucional de Anthropic busca que los modelos sean útiles, inofensivos y honestos. En la práctica, esto a veces significa que Claude rechaza solicitudes que otros modelos intentarían, lo que algunos usuarios consideran demasiado cauteloso.

- OpenAI emplea un amplio aprendizaje por refuerzo basado en la retroalimentación humana (RLHF) y pruebas de seguridad. Han estado más dispuestos a superar los límites, manteniendo las barreras.

- DeepSeek publicó documentación técnica que explica los mecanismos de sus modelos y métodos de entrenamiento, promoviendo así la transparencia. Sin embargo, al ser un participante reciente, su historial de seguridad a largo plazo aún se está consolidando.

Para aplicaciones empresariales en industrias reguladas, el enfoque conservador de Claude puede ser ventajoso. Para la investigación y la experimentación, el equilibrio entre capacidad y seguridad de GPT funciona bien. El enfoque abierto de DeepSeek resulta atractivo para los desarrolladores que desean comprender lo que ocurre en segundo plano.

Consideraciones empresariales: ¿Qué modelo de negocio?

La elección de un modelo de IA para uso empresarial implica criterios diferentes a los de los proyectos personales.

Costo total de propiedad

No te fijes solo en el precio por token. Considera los descuentos por volumen, las ventajas del almacenamiento en caché y el coste del tiempo de desarrollo. Un modelo que cuesta tres veces más, pero reduce el tiempo de depuración en 40%, podría ser la mejor inversión.

El precio de DeepSeek lo hace atractivo para aplicaciones de gran volumen donde predomina el coste por interacción. La precisión de Claude puede justificar costes más elevados para aplicaciones de cara al cliente, donde los errores son costosos. La integración del ecosistema de GPT puede reducir el tiempo de desarrollo, compensando así los mayores costes de las API.

Confiabilidad y tiempo de actividad

OpenAI ha experimentado interrupciones ocasionales durante picos de uso. La disponibilidad multinube de Claude a través de AWS, GCP y Azure ofrece opciones de redundancia. DeepSeek, al ser un servicio más reciente, cuenta con un historial de datos limitado.

Para aplicaciones críticas, las estrategias multimodelo son cada vez más comunes. Utilice Claude como modelo principal con GPT como alternativa, o enrute las consultas simples a DeepSeek y las complejas a modelos más costosos.

Privacidad de datos y cumplimiento

Revise cuidadosamente las políticas de gestión de datos de cada proveedor. Claude, a través de Amazon Bedrock o Google Vertex AI, podría ofrecer certificaciones de cumplimiento diferentes a las que ofrece la API directa. La implementación de OpenAI en Azure ofrece funciones de seguridad de nivel empresarial. Las políticas de datos de DeepSeek deben revisarse según sus requisitos regulatorios específicos.

| Factor | Lo mejor para Claude | Mejor para GPT | Ideal para DeepSeek

|

|---|---|---|---|

| Prioridad presupuestaria | Bajo | Medio | Alto |

| Integración de ecosistemas | Medio | Alto | Medio |

| Requisitos de seguridad | Alto | Medio | Medio |

| Necesidades de la ventana de contexto | Muy alto (1M) | Alto (400K-1M) | Medio (128K) |

| Tareas de razonamiento | Alto | Muy alto | Alto |

| Calidad de la documentación | Alto | Muy alto | Bien |

Limitaciones y debilidades conocidas

Todo modelo tiene puntos ciegos. Conocerlos te ayuda a sortearlos.

Las peculiaridades de Claude

Claude puede ser demasiado cauteloso y rechazar solicitudes benignas debido a los filtros de seguridad. A veces proporciona explicaciones más detalladas de lo necesario. Los precios más altos limitan los casos de uso donde el costo por token es crítico.

Los desafíos de GPT

Los modelos GPT ocasionalmente "alucinan" información con seguridad. Los modelos de razonamiento pueden ser más lentos debido al mayor tiempo de reflexión. El precio de las versiones profesionales las hace inaccesibles para muchas aplicaciones.

Los problemas de crecimiento de DeepSeek

Al ser una plataforma más reciente, DeepSeek cuenta con menos conocimiento de la comunidad y menos integraciones con terceros. La ventana de contexto más pequeña limita algunas aplicaciones. La fiabilidad y el soporte a largo plazo siguen siendo cuestionables a medida que el servicio madura.

Puntos de referencia de rendimiento: las cifras

Los puntos de referencia proporcionan puntos de comparación estandarizados, aunque el rendimiento en el mundo real varía.

Una investigación del Centro de Seguridad y Tecnología Emergente de la Universidad de Georgetown enfatiza que las evaluaciones aún se encuentran en una etapa muy temprana y deben interpretarse con cautela. Entre los puntos de referencia más populares se encuentran MMLU (Medición de la Comprensión Masiva del Lenguaje Multitarea), con preguntas de opción múltiple de exámenes profesionales, y GPQA (Preguntas y Respuestas a Prueba de Google para Graduados), con preguntas redactadas por expertos.

Según diversas fuentes, DeepSeek V3 compite eficazmente en los benchmarks de codificación, manteniendo costos significativamente más bajos. Los modelos de la serie GPT-5 son líderes en evaluaciones que requieren razonamiento intensivo. Claude se desempeña de forma excelente en tareas lingüísticas complejas y en la comprensión de documentos extensos.

¿La moraleja? Los resultados de los benchmarks son importantes, pero no lo dicen todo. Pruebe los modelos en sus casos de uso específicos antes de comprometerse.

Experiencia de usuario e interfaz

La experiencia del desarrollador es tan importante como la capacidad bruta.

El entorno de pruebas y la documentación de OpenAI son impecables y completos. La API está bien documentada con ejemplos detallados. Para GPT-5.2, el nivel gratuito no es compatible; los niveles de uso tienen límites de TPM definidos (p. ej., el nivel 5 muestra hasta 40 000 000 TPM).

La documentación de Claude es igualmente completa, con tablas de comparación de modelos claras y descripciones de funciones. El enfoque multinube permite interactuar con Claude a través de diferentes interfaces según la implementación elegida.

La documentación de DeepSeek es funcional, pero menos extensa. La compatibilidad con OpenAI facilita su uso, ya que muchos tutoriales y ejemplos funcionan con mínimas modificaciones.

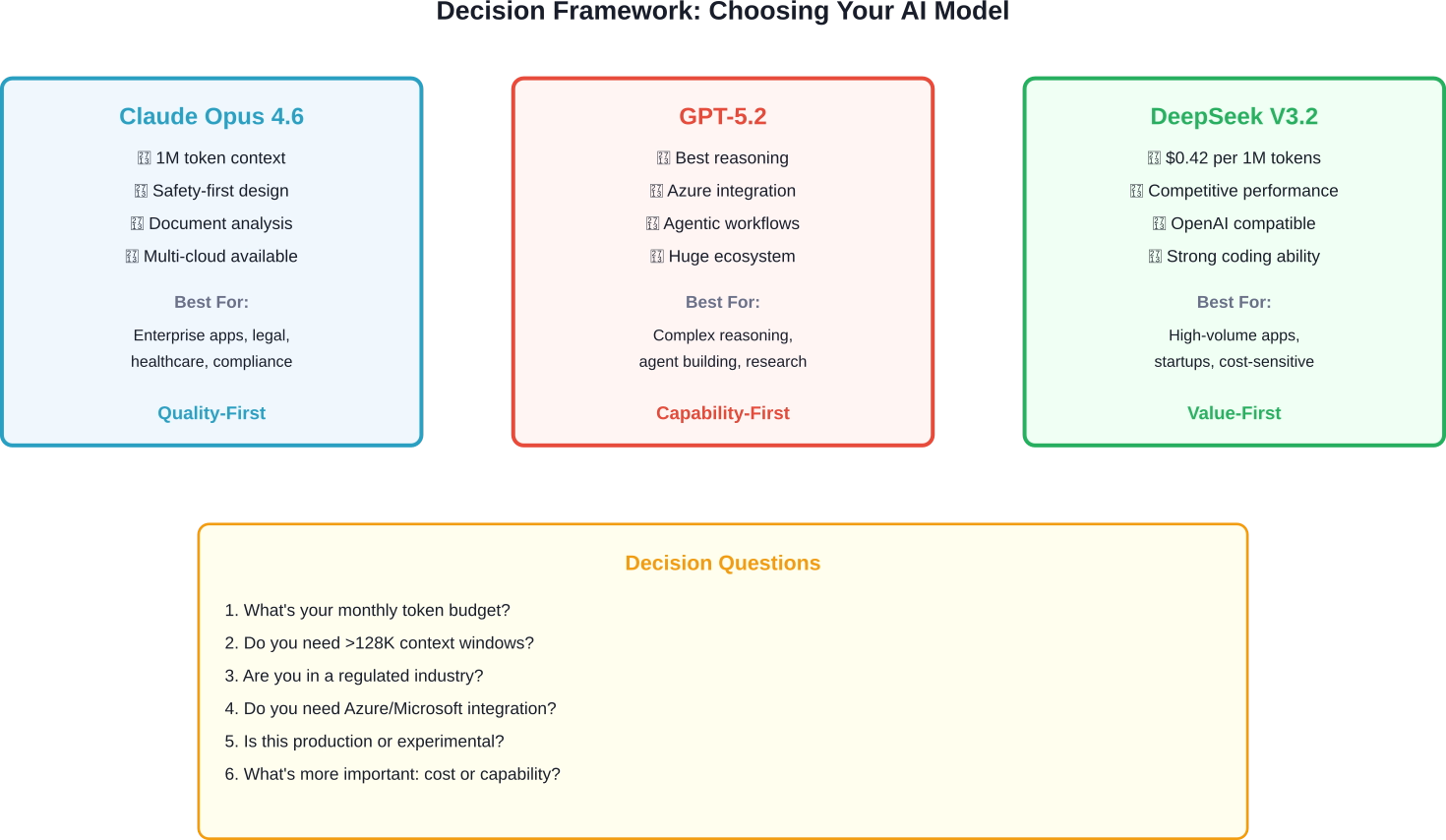

¿Qué modelo deberías realmente elegir?

La cuestión es que no existe un modelo universal "mejor". Tu elección depende de tus necesidades específicas.

Elige a Claude si…

Necesita la máxima ventana de contexto para procesar documentos grandes. La seguridad y la generación cuidadosa de resultados son prioritarias. Desarrolla aplicaciones en dominios sensibles donde el comportamiento conservador es ventajoso. El presupuesto es menos restrictivo que los requisitos de calidad.

Elija GPT si…

Necesita una integración profunda del ecosistema con herramientas de Microsoft, Azure o GitHub. Las capacidades de razonamiento son fundamentales para su caso de uso. Quiere la documentación más completa y el soporte de la comunidad. Está creando sistemas de agentes que requieren una planificación sofisticada.

Elija DeepSeek si…

La rentabilidad es una preocupación primordial. Procesas grandes volúmenes donde los costos por token se acumulan rápidamente. Necesitas un rendimiento competitivo sin precios elevados. Te sientes cómodo con una plataforma más nueva y deseas compatibilidad con OpenAI.

Marco para seleccionar el modelo de IA adecuado según sus requisitos y limitaciones específicos

Estrategias multimodelo

Muchas aplicaciones sofisticadas no eligen solo un modelo.

Un enfoque de enrutamiento puede optimizar tanto el costo como la calidad. Utilice DeepSeek para consultas sencillas, Claude para análisis complejos que requieren contexto extenso y GPT para tareas que requieren razonamiento profundo. Esto requiere desarrollar una lógica de enrutamiento, pero puede reducir los costos en 60% o más, manteniendo la calidad.

Otra estrategia: usar modelos más económicos para generar borradores iniciales y luego usar modelos premium para el refinamiento y la verificación de calidad. O bien, ejecutar la misma solicitud en varios modelos y usar métodos de votación o de conjunto para tomar decisiones cruciales.

La sobrecarga de administrar múltiples modelos está disminuyendo a medida que herramientas como Crazyrouter y servicios similares facilitan la prueba de diferentes modelos con el mismo código.

Navegando la frontera de la IA con AI Superior

A medida que se reduce la brecha entre las capacidades de razonamiento y la rentabilidad, el desafío para la mayoría de las empresas pasa de elegir un modelo a implementarlo con éxito. IA superior, Nuestro equipo de científicos de datos e ingenieros de software con doctorado se especializa en cerrar esta brecha mediante el desarrollo integral de aplicaciones de IA y la consultoría estratégica. Ayudamos a las organizaciones a ir más allá de las simples llamadas a API mediante la creación de sistemas personalizados de alto rendimiento que integran estos modelos de vanguardia en los flujos de trabajo existentes, garantizando que su elección de arquitectura, ya sea que involucre las enormes ventanas de contexto de Claude o el razonamiento rentable de DeepSeek, se traduzca en valor comercial tangible.

Nuestro enfoque sistemático se centra en identificar las áreas específicas donde el aprendizaje automático puede impulsar la eficiencia a largo plazo, desde la visión artificial hasta el análisis predictivo. Entendemos que, en un panorama tan volátil como el de 2026, una estrategia de modelo universal rara vez funciona. Por ello, nuestro equipo colabora estrechamente con usted mediante un riguroso proceso de descubrimiento y desarrollo de MVP para escalar soluciones robustas, fiables y adaptadas a los requisitos regulatorios y de datos específicos de su sector.

Perspectivas de futuro: lo que viene

El panorama de los modelos de IA continúa evolucionando rápidamente.

- OpenAI continúa lanzando mejoras incrementales a su familia de modelos. La brecha entre los modelos de razonamiento y los modelos estándar parece estar reduciéndose. La presión sobre los precios de competidores como DeepSeek podría obligar a realizar ajustes.

- Anthropic está ampliando la disponibilidad de Claude entre los proveedores de nube y añadiendo funciones como las Habilidades de Agente. La ventana de contexto de un millón de tokens en la versión beta sugiere que están ampliando los límites del manejo de entradas.

- DeepSeek se posiciona como un disruptor, demostrando que un rendimiento competitivo no requiere precios elevados. Su modelo V3.2-Speciale, con resultados de oro en competiciones de programación, demuestra que no solo priorizan el coste, sino también la capacidad.

Se prevén mejoras continuas en los modelos, competencia de precios y consolidación de capacidades entre los proveedores. Es probable que las diferencias entre estos modelos se reduzcan en los puntos de referencia y diverjan en los casos de uso especializados.

Conclusión: Cómo hacer su elección

La competencia entre Claude, GPT y DeepSeek beneficia a todos. Los precios están bajando, las capacidades están aumentando y la brecha entre las opciones premium y las económicas se está reduciendo.

En última instancia, su decisión se reduce a sus prioridades. Si está desarrollando algo donde la inteligencia es más importante que el costo (aplicaciones de investigación, tareas de razonamiento complejas, agentes sofisticados), GPT-5.2 o Claude Opus 4.6 justifican su precio elevado.

Si procesa grandes volúmenes y necesita rentabilidad sin sacrificar demasiada capacidad, DeepSeek ofrece un valor excepcional. El precio de $0.42 por millón de tokens de salida revoluciona la economía de las aplicaciones de IA.

Y cada vez más, la decisión inteligente no es elegir un modelo, sino diseñar la aplicación para utilizar el modelo correcto para cada tarea.

¿Cuál es la mejor manera de proceder? Pruebe las tres en sus casos de uso específicos. La mayoría ofrece niveles gratuitos o créditos para las pruebas iniciales. Ejecute sus indicaciones, mida los resultados, calcule los costos y tome su decisión basándose en datos, no en afirmaciones de marketing.

¿Listo para empezar a probar? Consulta la documentación oficial de la API de Claude, la Plataforma OpenAI y la API de DeepSeek para obtener tus claves y empezar a experimentar hoy mismo.

Preguntas frecuentes

¿Es DeepSeek tan bueno como GPT-4 o Claude?

Para muchas tareas, sí. DeepSeek V3.2 alcanza un rendimiento competitivo en benchmarks de codificación como HumanEval a un coste considerablemente menor. Los datos de investigación muestran que alcanzó altos niveles de rendimiento en HumanEval a un coste significativamente menor que Claude. Sin embargo, GPT y Claude aún pueden presentar ventajas en tareas que requieren la máxima capacidad de razonamiento o ventanas de contexto muy extensas, superiores a 128 000 tokens.

¿Qué modelo de IA es mejor para codificar en 2026?

Depende de sus necesidades específicas. DeepSeek R1 obtuvo la puntuación más alta en LiveCodeBench (65.9), lo que lo convierte en una solución excelente para tareas de codificación a bajo costo. GPT-5.2 destaca en flujos de trabajo de agencia y decisiones arquitectónicas complejas. Claude Opus 4.6 es eficaz para comprender y refactorizar grandes bases de código. Para la mayoría de los desarrolladores, DeepSeek ofrece la mejor relación calidad-precio, mientras que GPT proporciona la mejor integración con el ecosistema.

¿Cuánto cuesta utilizar estos modelos de IA?

Los precios varían considerablemente. Según las páginas oficiales de precios, DeepSeek cuesta $0.28 de entrada y $0.42 de salida por millón de tokens (tarifas estándar). GPT-5.2 cuesta $1.75 de entrada y $14.00 de salida por millón de tokens. GPT-5-mini cuesta $0.25 de entrada y $2.00 de salida por millón de tokens. El precio de Claude varía según el método de implementación; consulte la documentación oficial de Anthropic para conocer las tarifas actuales. DeepSeek es aproximadamente de 5 a 50 veces más económico que modelos comparables.

¿Puedo utilizar DeepSeek con mi código OpenAI existente?

Sí. Según la documentación oficial de la API de DeepSeek, su API utiliza un formato compatible con OpenAI. Puedes usar el SDK de OpenAI o cualquier software compatible con OpenAI con DeepSeek cambiando la URL base a https://api.deepseek.com y proporcionando tu clave de API de DeepSeek. La mayor parte del código existente debería funcionar con modificaciones mínimas.

¿Qué modelo tiene la ventana de contexto más larga?

Claude ofrece actualmente una ventana de contexto de 1 millón de tokens en su versión beta. GPT-4.1 proporciona 1 047 576 tokens, superando ligeramente a Claude. GPT-5.2 ofrece 400 000 tokens. DeepSeek V3.2 tiene 128 000 tokens, una cantidad menor, pero suficiente para la mayoría de las aplicaciones. Para tareas que requieren el análisis de documentos extremadamente grandes o conversaciones muy largas, Claude o GPT-4.1 tienen la ventaja.

¿Son estos modelos seguros para uso empresarial?

Los tres se han implementado en entornos empresariales, pero con diferentes consideraciones. Claude prioriza la alineación con la seguridad y es popular en sectores regulados. OpenAI ofrece implementaciones empresariales a través de Azure con funciones de seguridad adicionales. DeepSeek es más reciente y tiene una trayectoria menos consolidada. Para uso empresarial, evalúe las políticas de gestión de datos, las certificaciones de cumplimiento y los acuerdos de nivel de servicio de cada proveedor según sus requisitos específicos. Las implementaciones multinube de Claude a través de AWS, GCP o Azure pueden ofrecer opciones de cumplimiento adicionales.