Resumen rápido: Los precios de los chatbots LLM en 2026 varían desde planes gratuitos con acceso limitado hasta planes empresariales que superan los $3000 mensuales. Los costos de la API basada en tokens varían drásticamente: GPT-5.2 Pro de OpenAI cobra $21/$168 por millón de tokens, mientras que GPT-5.2 estándar cobra $1.75/$14, y DeepSeek V3.2-Exp cuesta $0.28 por millón de tokens de entrada (cache-fall) y $0.42 por millón de tokens de salida. La elección correcta depende del volumen de uso, las funciones necesarias y si se requiere acceso al chatbot mediante suscripción o integración directa de la API.

El mercado de chatbots para LLM ha experimentado un auge explosivo, y con él, un panorama de precios que puede confundir incluso a desarrolladores experimentados. Si alguien preguntara cuánto costaría un chatbot de IA en 2026, la respuesta sincera sería: desde cero dólares hasta cifras de seis dígitos anuales.

Esa enorme variedad existe porque la fijación de precios de los chatbots para LLM abarca dos enfoques fundamentalmente diferentes. En primer lugar, existen plataformas de chatbots por suscripción, donde los equipos pagan una cuota mensual por una IA conversacional lista para usar. En segundo lugar, existen servicios de API basados en tokens, donde los desarrolladores crean soluciones personalizadas y pagan por uso.

Para comprender qué modelo se ajusta mejor a las necesidades específicas —y cuáles son los costos reales— es necesario ir más allá de la publicidad engañosa y analizar las cifras reales. Las estructuras de precios han evolucionado significativamente desde 2025, con la entrada de nuevos modelos al mercado y el ajuste de las tarifas por parte de los proveedores ya establecidos.

Cómo funciona realmente la fijación de precios de los chatbots de LLM

Antes de adentrarnos en los costes específicos, conviene comprender los dos marcos de precios predominantes que dan forma a este mercado.

Plataformas de chatbot basadas en suscripción

Estos servicios ofrecen soluciones completas de chatbot con interfaces, integraciones y soporte integrados. Los equipos pagan una cuota recurrente, generalmente mensual, y obtienen acceso a una plataforma que gestiona la complejidad técnica.

Según análisis de mercado recientes, la estructura de precios de los chatbots por suscripción suele seguir esta línea:

| Modelo de precios | Cómo funciona | Rango de costos típico |

|---|---|---|

| Suscripción (SaaS) | Planes mensuales fijos con límites de uso. | $30–$1.500/mes |

| Basado en el uso | Pago por conversación, resolución o token | $0,50–$5 por conversación |

| Empresa personalizada | Precios negociados con recursos especializados | $3.000–$50.000+/mes |

| Por usuario/puesto | Coste por miembro del equipo que accede a la plataforma | $15–$200/usuario/mes |

El modelo de suscripción funciona bien para las empresas que buscan costes predecibles y una mínima complejidad técnica. Pero aquí está el inconveniente: estas plataformas suelen imponer límites estrictos en cuanto a conversaciones mensuales, chatbots activos o volumen de datos de entrenamiento.

Precios de API basados en tokens

Para los desarrolladores que crean soluciones personalizadas, el acceso a la API ofrece mayor flexibilidad, pero introduce costes variables. Cada interacción con un LLM se mide en tokens, que equivalen aproximadamente a fragmentos de palabras.

El precio de los tokens se divide en dos componentes: tokens de entrada (la solicitud enviada al modelo) y tokens de salida (la respuesta generada). Los tokens de salida casi siempre cuestan más porque generar texto requiere más recursos computacionales que procesarlo.

Las matemáticas se vuelven interesantes rápidamente. Una conversación típica de atención al cliente puede consumir 500 tokens de entrada y generar 300 tokens de salida. Con diferentes tarifas de proveedor, esa única interacción podría costar desde fracciones de centavo hasta varios centavos.

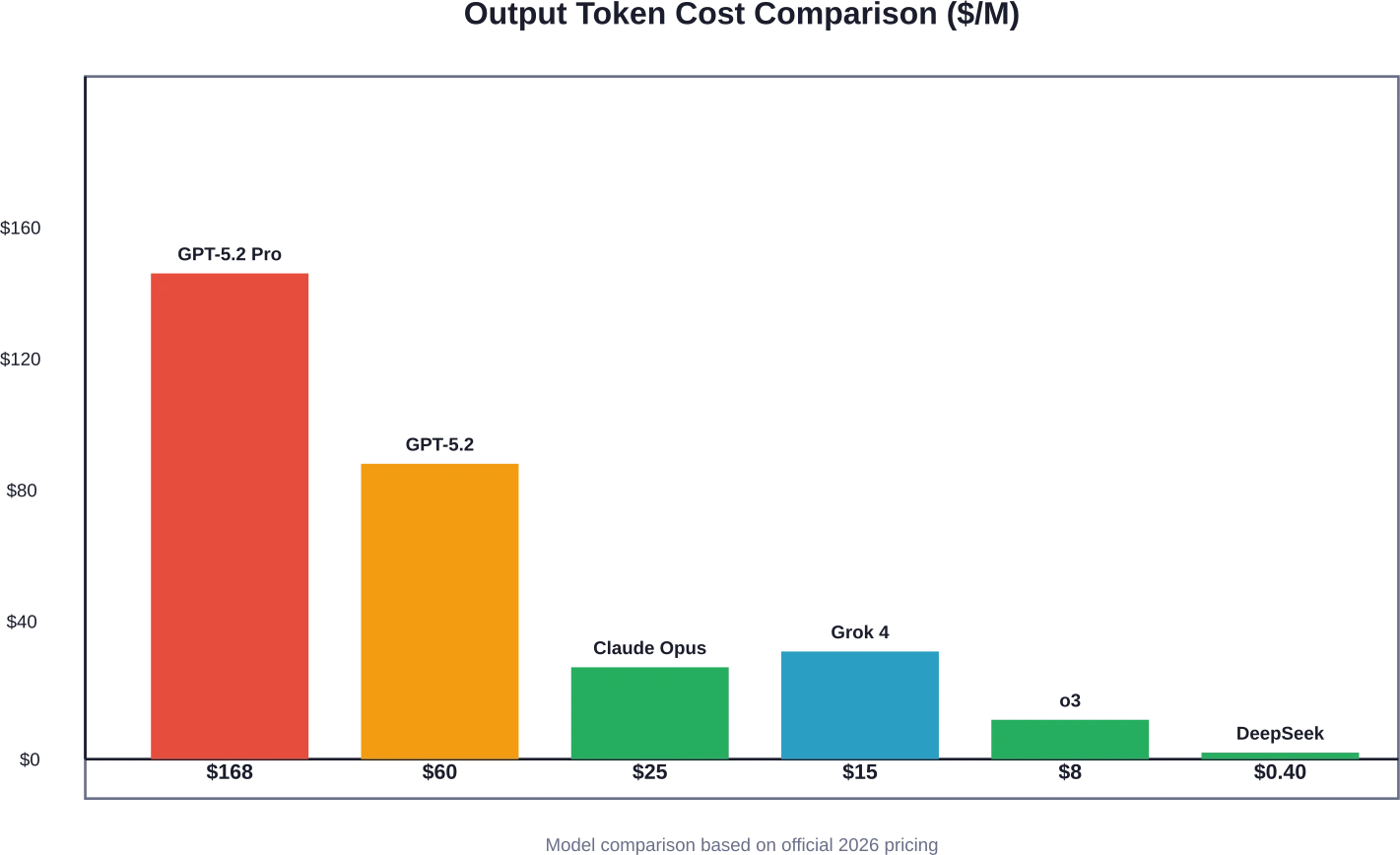

Comparación de precios de las principales API de LLM

El panorama de precios basado en tokens cambió drásticamente a principios de 2026. Se lanzaron nuevos modelos, los competidores se rebajaron los precios entre sí y las mejoras en las capacidades modificaron los cálculos de coste por valor.

Estructura de precios de OpenAI

OpenAI ofrece planes de suscripción para el acceso a ChatGPT y precios de API por token para desarrolladores. Según la página oficial de precios de OpenAI, sus niveles de suscripción para ChatGPT incluyen:

- Gratis: Acceso limitado a GPT-5.2 con límites de mensajes y respuestas más lentas.

- Ir: Acceso ampliado con más mensajes y cargas.

- Plus, Pro, Equipo, Empresa: Niveles progresivos con límites más altos y funciones adicionales

En cuanto al acceso a la API, los precios de OpenAI de febrero de 2026 muestran una variación significativa entre los distintos niveles de modelos:

| Modelo | Entrada (tokens $/M) | Salida (tokens $/M) | Caso de uso |

|---|---|---|---|

| GPT-5.2 Pro | $21.00 | $168.00 | Tareas de máxima capacidad |

| GPT-5.2 | $1.75 | $14.00 | Último modelo insignia |

| GPT-4.1 Mini | $0.40 | $1.60 | Tareas rentables |

| o1 (razonamiento) | $15.00 | $60.00 | Resolución de problemas complejos |

| o3 (razonamiento) | $2.00 | $8.00 | Razonamiento de próxima generación |

En los debates de la comunidad se observó que o1 cuesta significativamente más que o3, aunque la relación de precios refleja diferentes arquitecturas computacionales más que una jerarquía de capacidades.

OpenAI también ofrece modelos especializados como chatgpt-image-latest con una entrada de $5 y una salida de $10 por millón de tokens, diseñados para interacciones multimodales.

Precios de Claude Antropológico

Los modelos Claude de Anthropic han ganado popularidad gracias a su excelente rendimiento en tareas de codificación y análisis. Según el anuncio de Anthropic del 5 de febrero de 2026, el precio de Claude Opus 4.6 se mantiene en $5 por millón de tokens de entrada y $25 por millón de tokens de salida.

Esto hace que Claude Opus sea sustancialmente más económico que algunos modelos de OpenAI. Para un desarrollador que procesa 10 millones de tokens de entrada y 5 millones de tokens de salida al mes utilizando modelos de nivel equivalente, la diferencia de costo es significativa:

- GPT-5.2 Pro: (10 × $21) + (5 × $168) = $1,050

- Claude Opus 4.6: (10 × $5) + (5 × $25) = $175

Claude también introdujo en versión beta una ventana de contexto de 1 millón de tokens, lo que permite conversaciones más largas sin truncamiento del contexto, una característica que reduce el desperdicio de tokens debido a la repetición del contexto.

Anthropic proporciona herramientas de monitorización de costes a través de la consola Claude, donde los desarrolladores pueden realizar un seguimiento de los patrones de uso y establecer límites de gasto. En Anthropic Claude Code, los desarrolladores pueden usar el comando /cost para ver estadísticas detalladas del uso de tokens en las sesiones actuales, lo que ayuda a identificar oportunidades de optimización.

Precios de Google Gemini

Los modelos Gemini de Google ofrecen precios competitivos, aunque las tarifas específicas para 2026 varían según el nivel del modelo y la región. Según el análisis de la competencia, los modelos Gemini suelen posicionarse entre los niveles premium de OpenAI y las alternativas económicas.

La ventaja de Gemini reside en su integración con la infraestructura y los servicios de Google Cloud, lo que la hace atractiva para las organizaciones que ya han invertido en ese ecosistema.

Precios de xAI Grok

Según el análisis de la competencia, xAI lanzó los modelos Grok 4 con un precio de $3 por millón de tokens de entrada y $15 por millón de tokens de salida. Esto posiciona a Grok 4 como más caro que Claude Opus, pero más barato que GPT-5.2.

xAI también ofrece Grok 4 Fast y Grok 4.1 Fast a precios considerablemente más bajos: $0.20 de entrada y $0.50 de salida por millón de tokens. Estas variantes rápidas sacrifican algunas capacidades en aras de la velocidad y la eficiencia en costos.

La disrupción en los precios de DeepSeek

La empresa china DeepSeek ha superado a casi todos sus competidores con su variante de modelo V3.2-Exp. DeepSeek V3.2-Exp cuesta $0.28 por millón de tokens de entrada (cache-fall) y $0.42 por millón de tokens de salida.

Este precio representa una reducción de un orden de magnitud en comparación con los modelos occidentales de gama alta. Para aplicaciones de alto volumen, las tarifas de DeepSeek podrían traducirse en miles de dólares de ahorro mensual.

Entre las desventajas se incluyen la posible latencia derivada de los servidores chinos, las preocupaciones sobre la residencia de los datos para las industrias reguladas y las dudas sobre la sostenibilidad de los precios a largo plazo.

Costos de la plataforma de chatbot por suscripción

Para las empresas que prefieren soluciones llave en mano en lugar del desarrollo de API, las plataformas de suscripción combinan el acceso a LLM con interfaces, análisis e integraciones.

Precios para pequeñas empresas

Los planes básicos suelen estar dirigidos a emprendedores individuales o pequeños equipos que prueban las capacidades de los chatbots. Estos planes iniciales suelen costar entre $30 y $150 mensuales e incluyen:

- 1–3 chatbots activos

- Conversaciones mensuales limitadas (a menudo entre 500 y 5000).

- Integraciones básicas (sitio web, Facebook Messenger)

- Plantillas de respuesta estándar

- Soporte por correo electrónico

En este caso, las limitaciones son importantes. Un pequeño sitio de comercio electrónico que gestiona 100 consultas de clientes al día alcanzaría el límite mensual de 3000 conversaciones en la primera semana. Una vez superados los límites, las plataformas cobran recargos o pausan el chatbot; ninguna de las dos opciones es ideal para la experiencia del cliente.

Soluciones para el mercado medio

Las empresas en crecimiento suelen necesitar planes en el rango mensual de $300–$1,000. En este nivel, las capacidades se amplían sustancialmente:

- 5-10 chatbots con lógica más sofisticada

- Entre 15.000 y 50.000 conversaciones mensuales

- Integraciones de CRM y mesa de ayuda

- Formación personalizada sobre datos específicos de la empresa.

- Análisis y perspectivas de las conversaciones

- Soporte prioritario con tiempos de respuesta más rápidos.

Este nivel es adecuado para empresas con una base de clientes consolidada, pero que aún no operan a escala empresarial. El precio comienza a reflejar el valor de la automatización: un solo representante de soporte cuesta entre 3000 y 5000 dólares mensuales en salario y beneficios, por lo que incluso un chatbot que gestione 301 millones de consultas puede justificar la inversión.

Precios de chatbots empresariales

Las grandes organizaciones suelen pagar entre 3.000 y más de 50.000 dólares mensuales por plataformas de chatbot de nivel empresarial. A este nivel, los precios suelen pasar a ser presupuestos personalizados basados en:

- Volúmenes de conversación ilimitados o muy elevados

- Opciones de marca blanca

- Funciones avanzadas de seguridad y cumplimiento

- Gestión de cuentas dedicada

- Entrenamiento y ajuste de modelos personalizados

- El SLA garantiza tiempo de actividad y velocidad de respuesta.

- Soporte multilingüe

Los contratos empresariales suelen incluir servicios profesionales: soporte para la implementación, desarrollo de integraciones personalizadas y consultoría continua para la optimización. Estos servicios pueden suponer un coste adicional de decenas de miles de dólares, ya sea por única vez o de forma recurrente.

Costes ocultos que inflan el precio de los chatbots de LLM

El precio anunciado rara vez refleja la realidad. Varios costos ocultos o semi-ocultos pueden duplicar el gasto real de operar los chatbots de LLM.

Ventana de contexto y desperdicio de tokens

Cada conversación con un LLM incluye no solo el último mensaje del usuario, sino también el historial de la conversación para contextualizarla. Una conversación de 10 turnos podría enviar miles de tokens de contexto con cada nuevo mensaje.

Los modelos con ventanas de contexto más amplias reducen este desperdicio al mantener un mayor estado de la conversación sin necesidad de reenviarla. La ventana de contexto de 1 millón de tokens de Claude Opus 4.6 representa una gran ventaja en este sentido: las conversaciones más largas no requieren una costosa retransmisión del contexto.

Costos de almacenamiento en caché inmediato

Algunos proveedores ofrecen almacenamiento en caché instantáneo para reducir costos al enviar repetidamente el mismo contexto. Tanto OpenAI como Anthropic admiten formas de almacenamiento en caché, pero sus modelos de precios difieren.

Los tokens almacenados en caché cuestan menos que los nuevos, pero no todo el contenido es apto para el almacenamiento en caché. Comprender cuándo se aplica el almacenamiento en caché —y optimizar las solicitudes para maximizar los aciertos— requiere conocimientos técnicos que los equipos más pequeños quizás no posean.

Tiempo de integración y desarrollo

Los enfoques basados en API ahorran en tarifas de suscripción, pero introducen costos de desarrollo. Para crear un chatbot listo para producción se requiere:

- Infraestructura de backend para llamadas a la API

- Desarrollo de interfaz de usuario

- Lógica del flujo de la conversación y manejo de errores

- Implementación de seguridad para datos de usuario

- Sistemas de monitoreo y registro

- Mantenimiento continuo a medida que evolucionan las API.

Para un equipo de desarrollo de tamaño mediano, esto podría representar entre 200 y 500 horas de trabajo inicialmente, más entre 10 y 20 horas mensuales para mantenimiento. Con las tarifas típicas de los desarrolladores, esto se traduce en un costo inicial de entre 20.000 y 50.000 TPM y un costo mensual continuo de entre 1.500 y 3.000 TPM.

Preparación de datos y capacitación

Los modelos de lenguaje natural de propósito general funcionan bien desde el primer momento, pero el rendimiento específico de un dominio a menudo requiere ajustes finos o sistemas de generación aumentada por recuperación (RAG).

Construir un sistema RAG significa:

- Recopilación y limpieza de la documentación de la empresa

- Segmentación adecuada del contenido

- Generación y almacenamiento de incrustaciones

- Implementación de la lógica de recuperación

- Pruebas e iteraciones sobre la calidad de recuperación

Este trabajo no es gratuito. Las organizaciones suelen invertir semanas o meses en preparar las bases de conocimiento para su uso en producción.

Seguimiento y garantía de calidad

En ocasiones, los sistemas LLM generan respuestas incorrectas, inapropiadas o que no se ajustan a la imagen de marca. Las implementaciones empresariales requieren:

- Sistemas de monitorización de conversaciones

- Procesos de revisión humana para interacciones señaladas

- Pruebas A/B con diferentes indicaciones y modelos.

- Auditorías periódicas de calidad y cumplimiento

Estos costes operativos se acumulan. Una empresa podría necesitar entre 0,5 y 2 empleados a tiempo completo dedicados a la gestión de la calidad de los chatbots, dependiendo del volumen de conversaciones y la tolerancia al riesgo.

Elegir el modelo de precios adecuado

Ante tal variedad de opciones, ¿cómo deberían las organizaciones decidir entre plataformas de suscripción y desarrollo de API, o entre modelos premium y alternativas económicas?

Cálculos de volumen de uso

Comience por estimar el volumen de conversaciones y el consumo de tokens. Para un chatbot de atención al cliente:

- Estimar las conversaciones diarias (el volumen de tickets existente proporciona una base de referencia).

- Calcula el promedio de tokens por conversación (entre 500 y 2000 es lo habitual, dependiendo de la complejidad).

- Agregue el tampón 30–50% para el crecimiento y los picos inesperados.

Luego, calcula los costos entre diferentes proveedores. Una empresa que gestiona 10 000 conversaciones mensuales a 1 000 tokens cada una (500 de entrada, 500 de salida) consumiría:

- 5 millones de tokens de entrada mensuales

- 5 millones de tokens de salida mensuales

A diferentes tarifas de proveedores:

| Proveedor/Modelo | Costo mensual | Costo anual |

|---|---|---|

| GPT-5.2 Pro | $945 | $11,340 |

| Claude Opus 4.6 | $150 | $1,800 |

| Comprender 4 | $90 | $1,080 |

| o3 | $50 | $600 |

| DeepSeek V3.2 | $3.50 | $42 |

Ese cálculo revela diferencias enormes. Pero un momento, el precio no lo es todo.

Compromisos entre calidad y coste

Los modelos más económicos suelen ofrecer resultados de menor calidad. En casos donde la precisión es crucial —como el asesoramiento médico, la información legal o la orientación financiera—, invertir en mejores modelos reduce el riesgo.

Algunos desarrolladores han informado de que los costes de memoria pueden dispararse inesperadamente al crear chatbots con historiales de conversación extensos, especialmente con modelos que no admiten una gestión de contexto eficiente.

Probar diferentes modelos con casos de uso específicos proporciona la respuesta más clara. Ejecute proyectos piloto con entre 100 y 500 conversaciones reales en varios modelos, midiendo:

- Precisión y relevancia de la respuesta

- puntuaciones de satisfacción del usuario

- Tasas de resolución de conversaciones

- Escalada a agentes humanos

El modelo que ofrece una calidad aceptable al menor coste es el que gana. A veces se trata de un modelo de gama alta; otras veces, una opción de gama media funciona igual de bien.

Decisión entre construir o comprar

¿Deberían las organizaciones crear chatbots personalizados utilizando API o comprar plataformas de suscripción?

Las plataformas de suscripción tienen sentido cuando:

- Los recursos técnicos son limitados.

- La rapidez en la comercialización importa más que la personalización.

- El volumen de la conversación se ajusta a los límites de la plataforma.

- Las integraciones estándar cubren los casos de uso necesarios.

El desarrollo de API tiene sentido cuando:

- Los flujos de trabajo únicos requieren lógica personalizada.

- El alto volumen hace que los costos de suscripción sean prohibitivos.

- La integración profunda con los sistemas existentes es esencial.

- El equipo técnico tiene capacidad para el desarrollo.

El punto de inflexión suele producirse entre las 25 000 y las 50 000 conversaciones mensuales. Por debajo de ese umbral, las plataformas de suscripción ofrecen una mejor relación calidad-precio. Por encima, las implementaciones de API personalizadas suelen ser más económicas, a pesar de los costes de desarrollo.

Gestión y optimización de los costes de los másteres en Derecho (LLM)

Una vez implementadas, varias estrategias ayudan a controlar los gastos corrientes.

Ingeniería rápida para la eficiencia

Las indicaciones bien elaboradas reducen el desperdicio de fichas y mejoran la calidad de la salida. Las técnicas incluyen:

- Utilizar mensajes del sistema concisos que establezcan el contexto sin palabras excesivas

- Implementar el aprendizaje con pocos ejemplos utilizando 2-3 ejemplos en lugar de 10 o más.

- Estructurar las salidas con JSON u otros formatos para minimizar las explicaciones extensas.

- Dividir las tareas complejas en pasos más pequeños siempre que sea posible.

Una reducción de 20% en el promedio de tokens por conversación se traduce directamente en un ahorro de costos de 20%.

Selección de modelos por tarea

No todas las tareas requieren el modelo más potente. El enrutamiento inteligente puede ahorrar costes sustanciales:

- Utilice modelos más económicos para preguntas frecuentes sencillas y decisiones de enrutamiento.

- Reserve los modelos costosos para razonamientos o generación complejos.

- Implementar un sistema de puntuación de confianza para determinar cuándo pasar a los modelos premium.

Un enfoque escalonado podría utilizar GPT-4.1 Mini para 70% de conversaciones y GPT-5.2 para los 30% restantes que necesitan capacidades avanzadas, reduciendo el coste medio en 50–60%.

Almacenamiento en caché y optimización del contexto

Aprovechar el almacenamiento en caché instantáneo cuando esté disponible reduce los costos de contexto repetido. El uso estratégico del contenido en caché puede reducir significativamente los gastos de tokens.

En Anthropic Claude Code, los desarrolladores pueden usar el comando /cost para ver estadísticas detalladas del uso de tokens para las sesiones actuales, lo que ayuda a identificar oportunidades de optimización.

Monitorización del uso y alertas

Tanto OpenAI como Anthropic ofrecen herramientas de monitorización del uso. Configurar alertas evita facturas inesperadas cuando el consumo aumenta bruscamente.

Indicadores clave a monitorizar:

- Tendencias diarias de consumo de tokens

- Coste por conversación a lo largo del tiempo

- Distribución de selección de modelos

- Tasas de error que provocan reintentos y desperdicio de tokens

La consola Claude de Anthropic proporciona informes detallados de costes y uso visibles para desarrolladores, gestores de facturación y administradores, lo que permite una gestión proactiva de los costes.

Consideraciones para empresas y descuentos por volumen

Las grandes organizaciones suelen negociar mejores tarifas que las que sugieren los precios de API publicados.

Acuerdos empresariales personalizados

Las empresas que se comprometen a un volumen significativo —a menudo más de 50.000 unidades anuales— pueden negociar:

- Descuentos por volumen de 10–30%

- Niveles de tarifas personalizadas según el gasto comprometido

- Garantías de SLA para tiempo de actividad y latencia

- Soporte especializado y gestión técnica de cuentas

- Opciones de implementación privada para la confidencialidad de los datos

OpenAI, Anthropic y otros proveedores importantes ofrecen planes empresariales, aunque los detalles de los precios no se divulgan públicamente.

Residencia de datos y cumplimiento normativo

Los sectores regulados se enfrentan a restricciones adicionales. Las organizaciones sanitarias deben cumplir con la HIPAA; los servicios financieros requieren la certificación SOC 2; las empresas europeas deben tener en cuenta las normas de residencia de datos del RGPD.

Los convenios colectivos suelen incluir:

- Acuerdos de asociación comercial (BAA) para el sector sanitario

- Acuerdos de procesamiento de datos que especifican el tratamiento de los datos

- Opciones de despliegue regional para mantener los datos en jurisdicciones específicas.

- Políticas de retención de datos cero

Claude Code ofrece opciones de retención de datos cero para equipos preocupados por la privacidad de los datos.

Estas funciones de cumplimiento normativo a veces conllevan precios elevados o compromisos de gasto mínimo.

Modelos emergentes y tendencias futuras de precios

El panorama de los másteres en Derecho (LLM) evoluciona rápidamente. Varias tendencias están influyendo en los precios para 2026 y años posteriores.

Competencia de código abierto

Modelos como GLM-5 y Qwen3.5 representan alternativas de código abierto cada vez más capaces. Las organizaciones con recursos técnicos pueden alojar estos modelos por sí mismas, eliminando por completo los costos por token.

La desventaja radica en el costo de la infraestructura. Ejecutar un modelo de 40 mil millones de parámetros requiere importantes recursos de GPU, a menudo entre 1.500 y 1.2000 dólares mensuales en costos de GPU en la nube, o una inversión de capital sustancial para hardware local.

Para implementaciones de muy alto volumen (millones de conversaciones diarias), el autoalojamiento puede lograr una mejor rentabilidad que los servicios API, a pesar de los costos de infraestructura.

Modelos especializados

Los modelos específicos para tareas, optimizados para casos de uso concretos, suelen ofrecer una mejor relación calidad-precio que los modelos insignia de propósito general. El modelo de razonamiento o3 de OpenAI cuesta menos que o1 y, al mismo tiempo, ofrece un rendimiento superior para determinadas tareas analíticas.

A medida que los proveedores lanzan modelos más especializados, las organizaciones pueden optimizar los costos adaptando los modelos a los requisitos específicos de cada caso de uso, en lugar de utilizar modelos insignia costosos para todo.

Evolución de la fijación de precios multimodal

Los modelos que procesan imágenes, audio y otras modalidades introducen una complejidad adicional en la tarificación. La API en tiempo real de OpenAI cobra de forma diferente por los tokens de texto, audio e imagen: los tokens de audio en los mensajes de usuario cuestan 1 token cada 100 ms y los tokens de audio del asistente, 1 token cada 50 ms.

Para los chatbots de voz, estas tasas se acumulan rápidamente. Una conversación de 5 minutos implica 300 000 ms de audio. Con las tasas de la API en tiempo real de OpenAI (1 token por cada 100 ms para el audio del usuario, 1 token por cada 50 ms para el audio del asistente), esto podría traducirse en 3000 a 6000 tokens, dependiendo de la división de la conversación, antes de cualquier procesamiento de texto.

Cálculo del retorno de la inversión

Comprender los costos es solo la mitad de la ecuación. La otra mitad consiste en cuantificar el valor que aportan los chatbots.

Apoyo a la reducción de costos

El cálculo más sencillo del retorno de la inversión (ROI) implica la reducción de los tickets de soporte. Si un chatbot gestiona 40% de consultas entrantes y cada ticket atendido por un humano cuesta entre $5 y $15 en mano de obra, el ahorro se acumula rápidamente.

Para una empresa que procesa 5.000 tickets de soporte mensuales con un coste medio de $8:

- Coste total mensual de soporte: $40,000

- El chatbot gestiona el error 40%: 2.000 entradas automatizadas

- Ahorros: 2000 × $8 = $16 000 mensuales

Si el chatbot cuesta $2.000 al mes (incluidos los gastos de desarrollo y API), el ahorro neto es de $14.000 al mes o $168.000 al año.

Impacto en los ingresos

En el caso de los chatbots de ventas y generación de clientes potenciales, los cálculos del retorno de la inversión se centran en la mejora de las conversiones:

- Mayor participación gracias a la disponibilidad las 24 horas del día, los 7 días de la semana.

- Tiempos de respuesta más rápidos que reducen el abandono.

- Mejor cualificación de los clientes potenciales antes de la transferencia humana.

- Recomendaciones de venta adicional y venta cruzada

Incluso pequeñas mejoras en las tasas de conversión pueden justificar la inversión en chatbots. Un aumento de 2% en la conversión sobre unos ingresos mensuales de $1M supone $20.000, superando con creces los costes típicos de un chatbot.

Beneficios intangibles

Algunos aspectos del valor de los chatbots son más difíciles de cuantificar:

- Mayor satisfacción del cliente gracias a respuestas instantáneas.

- Un tono de marca coherente en todas las interacciones.

- Agentes humanos liberados para casos complejos de alto valor.

- Recopilación de datos y análisis de patrones de conversación

Estos factores son importantes para la competitividad a largo plazo, aunque no se reflejen directamente en los cálculos financieros.

Deja de pagar de más por los chatbots de LLM y créalos correctamente.

El coste de un chatbot LLM depende en gran medida del diseño del sistema. La elección del modelo, la estrategia de entrenamiento, el uso de tokens y la infraestructura influyen en el precio final. Muchas empresas descubren que el uso de modelos genéricos sin optimización incrementa rápidamente los costes operativos.

IA superior Colabora con empresas que necesitan sistemas LLM personalizados para su uso en entornos de producción reales. La compañía desarrolla y optimiza modelos lingüísticos complejos, prepara datos de entrenamiento y optimiza la implementación para que los chatbots sigan siendo precisos y rentables a medida que aumenta su uso. Su equipo de científicos de datos e ingenieros con doctorado se centra en la creación de sistemas de IA adaptados a flujos de trabajo específicos, en lugar de utilizar modelos genéricos.

¿Estás planeando un chatbot para LLM? Habla con IA superior Antes de comprometerte con una arquitectura costosa, obtén una visión clara de cuánto debería costar realmente construir y operar tu chatbot.

Ejemplos de costos reales

Para concretar los precios, considere algunos escenarios realistas:

Escenario 1: Bot de preguntas frecuentes para comercio electrónico pequeño

- Volumen: 2000 conversaciones mensuales

- Acercarse: Plataforma de suscripción

- Costo: Tarifa de plataforma de $79/mes

- Resultado: Gestiona 60% de preguntas sobre productos, reduciendo el volumen de soporte por correo electrónico a la mitad.

Escenario 2: Soporte SaaS de tamaño mediano

- Volumen: 15.000 conversaciones mensuales

- Acercarse: Integración de API personalizada con Claude Opus

- Uso del token: Entrada de 12 millones, salida de 8 millones mensuales

- Coste de la API: (12 × $5) + (8 × $25) = $260/mes

- Desarrollo: $30.000 de construcción inicial, $2.000 de mantenimiento mensual

- Costo del primer año: $30.000 + ($260 + $2.000 × 12) = $57.120

- Coste anual recurrente: $27,120

- Resultado: Gestiona 45% de soporte de nivel 1, ahorrando 2 FTE.

Escenario 3: Asistente multicanal empresarial

- Volumen: 200.000 conversaciones mensuales a través de web, móvil y voz.

- Acercarse: Modelo híbrido que utiliza DeepSeek para consultas simples y GPT-5.2 para consultas complejas.

- Uso del token: Entrada de 120M (80M DeepSeek, 40M GPT), salida de 80M (50M DeepSeek, 30M GPT)

- Coste de la API: DeepSeek: (80 × $0.28) + (50 × $0.42) = $43.40; GPT: (40 × $21) + (30 × $168) = $5,880

- Coste total mensual de la API: $2,442

- Infraestructura: $5,000 mensuales (balanceo de carga, monitoreo, bases de datos)

- Equipo: 2 FTE para mantenimiento y optimización = $20.000 mensuales

- Coste mensual total: $27,442

- Resultado: Gestiona 70% de interacciones con clientes, desplazando a 8 empleados de soporte a tiempo completo.

Estos ejemplos ilustran cómo los costes aumentan con el volumen y la complejidad.

Preguntas frecuentes sobre precios

¿Existen opciones de máster en Derecho (LLM) gratuitas?

Sí, varios proveedores ofrecen planes gratuitos. Según la página de precios de OpenAI, su plan gratuito ofrece acceso limitado a GPT-5.2 con límites de mensajes y tiempos de respuesta más lentos. Esto es útil para experimentación, pero no para implementaciones en producción.

Los modelos de código abierto pueden alojarse en servidores propios sin coste alguno de licencia de software, pero los gastos de infraestructura persisten.

¿Cómo funcionan los descuentos para empresas?

Los clientes empresariales que se comprometen a un alto volumen pueden negociar tarifas personalizadas, a menudo entre 10 y 30 TP3T por debajo de los precios de API publicados. Estos acuerdos generalmente requieren un compromiso de gasto anual mínimo de $50 000 a $100 000 o más.

¿Qué sucede si el uso supera los límites del plan?

Las plataformas de suscripción suelen cobrar recargos por exceso de consumo (a menudo con tarifas unitarias más altas) o pausar el servicio hasta el siguiente ciclo de facturación. Los servicios API siguen funcionando, pero acumulan cargos que superan el gasto contratado.

¿Se pueden predecir los costes con precisión?

La estimación del uso mejora con el tiempo, pero la variabilidad persiste. El contenido viral inesperado, los picos estacionales o los cambios en el comportamiento del usuario pueden provocar fluctuaciones de uso de 2 a 5 veces. Incorporar un margen de seguridad de 30 a 50% ayuda a evitar sorpresas.

¿Existen diferencias de precios regionales?

Algunos proveedores ajustan los precios por región, aunque los principales servicios de API, como OpenAI y Anthropic, utilizan tarifas globales unificadas. Los requisitos de residencia de datos a veces obligan a utilizar implementaciones regionales que conllevan precios más elevados.

Preguntas frecuentes

¿Cuál es el coste medio de un chatbot de IA en 2026?

El costo promedio varía drásticamente según el enfoque. Las plataformas de suscripción para pequeñas empresas oscilan entre $30 y $300 mensuales. Las soluciones para medianas empresas cuestan entre $300 y $1000 mensuales. Las implementaciones empresariales a menudo superan los $3000 mensuales. Para las implementaciones basadas en API, los costos dependen del volumen: los rangos típicos son de $100 a $5000 mensuales para la mayoría de las organizaciones, y las implementaciones empresariales de alto volumen a veces alcanzan más de $20 000 mensuales solo en costos de tokens.

¿Cuánto cuesta la API de ChatGPT en comparación con Claude?

A febrero de 2026, GPT-5.2 Pro de OpenAI cuesta $21 por millón de tokens de entrada y $168 por millón de tokens de salida, mientras que Claude Opus 4.6 de Anthropic cuesta $5 por millón de tokens de entrada y $25 por millón de tokens de salida. Claude es considerablemente más económico, aproximadamente 67% menos costoso que GPT-5.2 Pro. Para 10 millones de tokens de entrada y 5 millones de tokens de salida mensuales, GPT-5.2 cuesta $1050 frente a Claude, que cuesta $175.

¿Qué factores influyen más en el precio de los chatbots de LLM?

Los principales factores que influyen en el costo son el volumen de conversaciones, los tokens por conversación, la selección del modelo y el enfoque de implementación. Una empresa que utiliza modelos premium como GPT-5.2 Pro con un alto volumen de conversaciones puede pagar entre 100 y 400 veces más que una que utiliza modelos económicos como DeepSeek para un número similar de conversaciones. El tamaño de la ventana de contexto, la eficiencia del almacenamiento en caché y la necesidad de desarrollo personalizado también impactan significativamente el costo total de propiedad.

¿Es más económico crear un chatbot personalizado o utilizar una plataforma?

Para volúmenes inferiores a 25 000 conversaciones mensuales, las plataformas de suscripción suelen ser más económicas si se tiene en cuenta el tiempo de desarrollo. Por encima de ese umbral, las implementaciones de API personalizadas resultan más económicas, a pesar de que los costes iniciales de desarrollo oscilan entre $20 000 y $50 000. El punto de inflexión depende de la disponibilidad del equipo técnico y de los requisitos específicos de las funcionalidades. Las soluciones personalizadas ofrecen mayor flexibilidad, pero requieren un mantenimiento continuo.

¿Ofrecen los proveedores de programas de LLM planes gratuitos?

Sí, la mayoría de los proveedores principales ofrecen acceso gratuito limitado. OpenAI ofrece un plan gratuito con acceso restringido a GPT-5.2, límites de mensajes y respuestas más lentas. Estos planes gratuitos son útiles para pruebas y experimentación, pero imponen limitaciones que los hacen poco prácticos para su uso en producción. Una vez que el volumen de conversaciones alcanza cientos o miles al mes, los planes de pago se vuelven necesarios.

¿Cómo puedo reducir los costes de la API de LLM sin sacrificar la calidad?

Varias estrategias reducen los costos manteniendo la calidad: usar enrutamiento de modelos por niveles (modelos más económicos para consultas simples, modelos premium para consultas complejas), optimizar las solicitudes para reducir el desperdicio de tokens, aprovechar el almacenamiento en caché de solicitudes cuando esté disponible, implementar ventanas de contexto más amplias para evitar la transmisión repetida de contexto y probar múltiples modelos para encontrar la mejor relación valor-rendimiento para casos de uso específicos. Muchas organizaciones logran reducciones de costos de entre 30 y 501 TP3T mediante estas optimizaciones.

¿Qué costes ocultos debo presupuestar además del precio de la API?

Más allá de los costos directos de la API o la suscripción, el presupuesto incluye tiempo de desarrollo (entre 20 000 y 50 000 £ iniciales para soluciones personalizadas), mantenimiento continuo (entre 1500 y 5000 £ mensuales), infraestructura para alojamiento y monitoreo (entre 500 y 5000 £ mensuales, según la escala), preparación de datos y creación de bases de conocimiento (de semanas a meses de trabajo), y garantía de calidad, incluidos los procesos de revisión humana. Los costos ocultos suelen duplicar o triplicar el precio aparente de los servicios de LLM.

Tomar decisiones sobre el precio del chatbot para su programa LLM

El panorama de precios de los chatbots LLM en 2026 ofrece más opciones que nunca, y también mayor complejidad. La diferencia entre las opciones económicas y las premium se ha ampliado, con alternativas que van desde DeepSeek ($0.28/$0.42 por millón de tokens) hasta GPT-5.2 Pro de OpenAI ($21/$168).

No existe una única solución para todos los casos. Las pequeñas empresas que prueban la IA conversacional se benefician de plataformas de suscripción que combinan tecnología y soporte por cuotas mensuales predecibles. Las empresas en crecimiento con un volumen moderado suelen encontrar que las plataformas de nivel medio o las implementaciones de API con modelos rentables como Claude Opus u o3 ofrecen la mejor relación calidad-precio. Las grandes empresas con recursos técnicos pueden optimizar los costes mediante el desarrollo a medida, el enrutamiento de modelos y la negociación de volúmenes.

La clave está en partir de estimaciones de uso claras, probar diferentes enfoques con cargas de trabajo reales y medir no solo los costos, sino también los resultados: incidencias de soporte resueltas, tasas de conversión mejoradas, mayor satisfacción del cliente. Estas métricas determinan el verdadero retorno de la inversión.

Una cosa es segura: los precios seguirán evolucionando. Mensualmente se lanzan nuevos modelos, los proveedores actuales ajustan sus tarifas y las alternativas de código abierto mejoran. Las organizaciones que desarrollan arquitecturas flexibles que permiten cambiar de modelo fácilmente se posicionan para optimizar los costos a medida que el mercado cambia.

¿Listo para explorar las opciones de chatbots LLM que se ajusten a tus necesidades específicas? Comienza calculando el volumen mensual de conversaciones y el consumo de tokens que esperas. Prueba las versiones gratuitas de varios proveedores con casos de uso representativos. Luego, elige la solución que ofrezca una calidad aceptable a un costo manejable; no necesariamente la opción más barata ni la más cara, sino la que te brinde el mejor valor para tus requisitos particulares.