Résumé rapide : Les services d'évaluation de LLM privés coûtent généralement entre $249 et plus de $10 par mois pour les plateformes, tandis que les projets d'évaluation personnalisés varient de $125K à $820K par an selon leur envergure. Les coûts dépendent de la taille du modèle, des exigences en matière d'infrastructure, de l'expertise de l'équipe et de la complexité du déploiement. Des outils d'évaluation open source existent, mais les frais d'exploitation liés à l'hébergement, aux ressources humaines et à la maintenance dépassent souvent les frais d'abonnement aux plateformes.

La course au déploiement de grands modèles de langage privés a mis en lumière une réalité amère pour de nombreuses organisations : la construction du modèle n’est que le point de départ. Évaluer son efficacité ? C’est là que les coûts s’envolent.

Contrairement aux modèles publics basés sur une API, où l'évaluation peut se faire par simple analyse comparative, les modèles LLM privés exigent des tests rigoureux et continus qui tiennent compte des données propriétaires, des cas d'utilisation personnalisés et des exigences de sécurité de l'entreprise. L'infrastructure d'évaluation à elle seule peut égaler, voire dépasser, les coûts d'hébergement des modèles eux-mêmes.

Voici la vérité qui dérange : les entreprises sous-estiment systématiquement les coûts d’évaluation de 40 à 60 000 dollars. Elles prévoient un budget pour le matériel et les ingénieurs, mais oublient l’infrastructure de tests continus, les spécialistes en équipes rouges et les frais généraux d’exploitation liés à la maintenance des pipelines d’évaluation exécutés des milliers de fois par mois.

Cette analyse détaillée couvre la tarification de la plateforme, les dépenses d'infrastructure, les coûts liés aux talents et les pertes opérationnelles cachées qui transforment l'évaluation open source “ abordable ” en un engagement annuel à six chiffres.

Comprendre l'évaluation privée des LLM : ce que vous payez réellement

L'évaluation privée des LLM ne se limite pas à soumettre un modèle à une série de tests de performance et à considérer le travail comme terminé. Il s'agit d'un processus continu qui englobe de multiples dimensions.

Le processus d'évaluation comprend des tests de précision, l'analyse des vulnérabilités de sécurité, l'optimisation des performances, la détection des biais et la validation de la conformité réglementaire. Chaque dimension requiert des outils, des ensembles de données et une expertise spécifiques. Certaines organisations tentent d'assembler des solutions open source. D'autres acquièrent des plateformes. La plupart optent finalement pour une solution hybride, plus coûteuse que chacune des approches prises individuellement.

Les principaux éléments qui génèrent des coûts

L'infrastructure d'évaluation se décompose en plusieurs centres de coûts. Les abonnements aux plateformes ou les frais de licence constituent la base visible. Les coûts d'infrastructure nécessaires pour exécuter des évaluations à grande échelle ajoutent une couche supplémentaire. Viennent ensuite les dépenses liées aux talents : ingénieurs en apprentissage automatique, spécialistes de l'évaluation et experts du domaine qui conçoivent les tests et interprètent les résultats.

N’oubliez pas le coût des données. Les jeux de données d’évaluation personnalisés, qu’ils soient acquis auprès de fournisseurs ou créés en interne, représentent un investissement conséquent. Selon le Centre pour les normes et l’innovation en IA (CAISI) du NIST, la conception de systèmes d’IA de référence exige des méthodes de mesure de l’IA de référence, et celles-ci ont un coût.

Le dernier élément à prendre en compte ? Les coûts d’intégration et de maintenance. Les pipelines d’évaluation doivent se connecter aux flux de travail MLOps, aux systèmes de contrôle de version et aux plateformes de surveillance existants. Ce travail d’intégration est rarement inclus dans les estimations de coûts initiales, mais il absorbe systématiquement entre 20 et 300 000 taxe sur les budgets d’évaluation.

Services d'évaluation basés sur une plateforme : points de référence en matière de prix

Les plateformes d'évaluation gérées offrent la voie la plus rapide vers des tests complets. Cependant, les prix varient considérablement en fonction des fonctionnalités, de l'échelle et du positionnement du fournisseur.

D’après les données disponibles pour 2025-2026, voici à quoi ressemble le marché :

| Niveau de la plateforme | Coût mensuel | Caractéristiques principales | Idéal pour |

|---|---|---|---|

| Entrée (ex. : Braintrust Pro) | $249 | Traces illimitées, 5 Go de données traitées, 50 000 scores | Petites équipes, produits en phase de démarrage |

| Niveau intermédiaire | $1,500-$3,500 | Analyses avancées, indicateurs de performance personnalisés, collaboration d'équipe | Produits en croissance avec un trafic modéré |

| Entreprise | $5,000-$10,000+ | Déploiement sur site, assistance dédiée, évolutivité illimitée | Grandes organisations, industries réglementées |

| Personnalisation/Marque blanche | $15,000+ | Personnalisation complète, infrastructure dédiée, garanties SLA | Fortune 500, agences gouvernementales |

Les données relatives à la structure tarifaire de Braintrust montrent que, selon l'entreprise, les clients constatent systématiquement des gains de précision de 30% ou plus quelques semaines seulement après l'adoption. Ce type d'amélioration des performances justifie le coût de la plateforme, surtout si l'alternative consiste à déployer des fonctionnalités d'IA défaillantes en production.

Giskard propose des solutions open source et pour entreprises. La bibliothèque open source est gratuite, mais nécessite un hébergement sur place et des compétences techniques. Leur plateforme pour entreprises assure des tests d'intrusion continus en IA et une évaluation RAG (Real Aggregation, Agility, and Assessment) avec une infrastructure gérée ; toutefois, les tarifs précis ne sont pas communiqués publiquement.

Que couvrent réellement les frais de plateforme ?

Les abonnements à la plateforme incluent généralement le cadre d'évaluation lui-même, des suites de tests de référence préconfigurées, l'hébergement pour l'exécution des tests, des tableaux de bord d'analyse des résultats et un certain niveau de support.

Qu'est-ce qui n'est pas inclus ? Les coûts de calcul liés à l'exécution de vos modèles lors de l'évaluation. La création de jeux de données personnalisés. Le temps d'ingénierie nécessaire à l'intégration de la plateforme dans votre flux de travail. La formation de votre équipe à son utilisation efficace.

De nombreuses plateformes facturent en fonction du volume de données traitées ou du nombre d'exécutions d'évaluation. L'offre d'entrée de gamme à $249/mois semble raisonnable jusqu'à ce que vous traitiez 100 Go de données d'évaluation par mois et que vous ayez soudainement besoin de l'offre entreprise.

Coûts d'infrastructure pour une évaluation auto-hébergée

Certaines équipes choisissent de construire leur infrastructure d'évaluation à l'aide d'outils open source comme Lighteval ou les bibliothèques d'évaluation de Hugging Face. Le logiciel est gratuit. Tout le reste est payant.

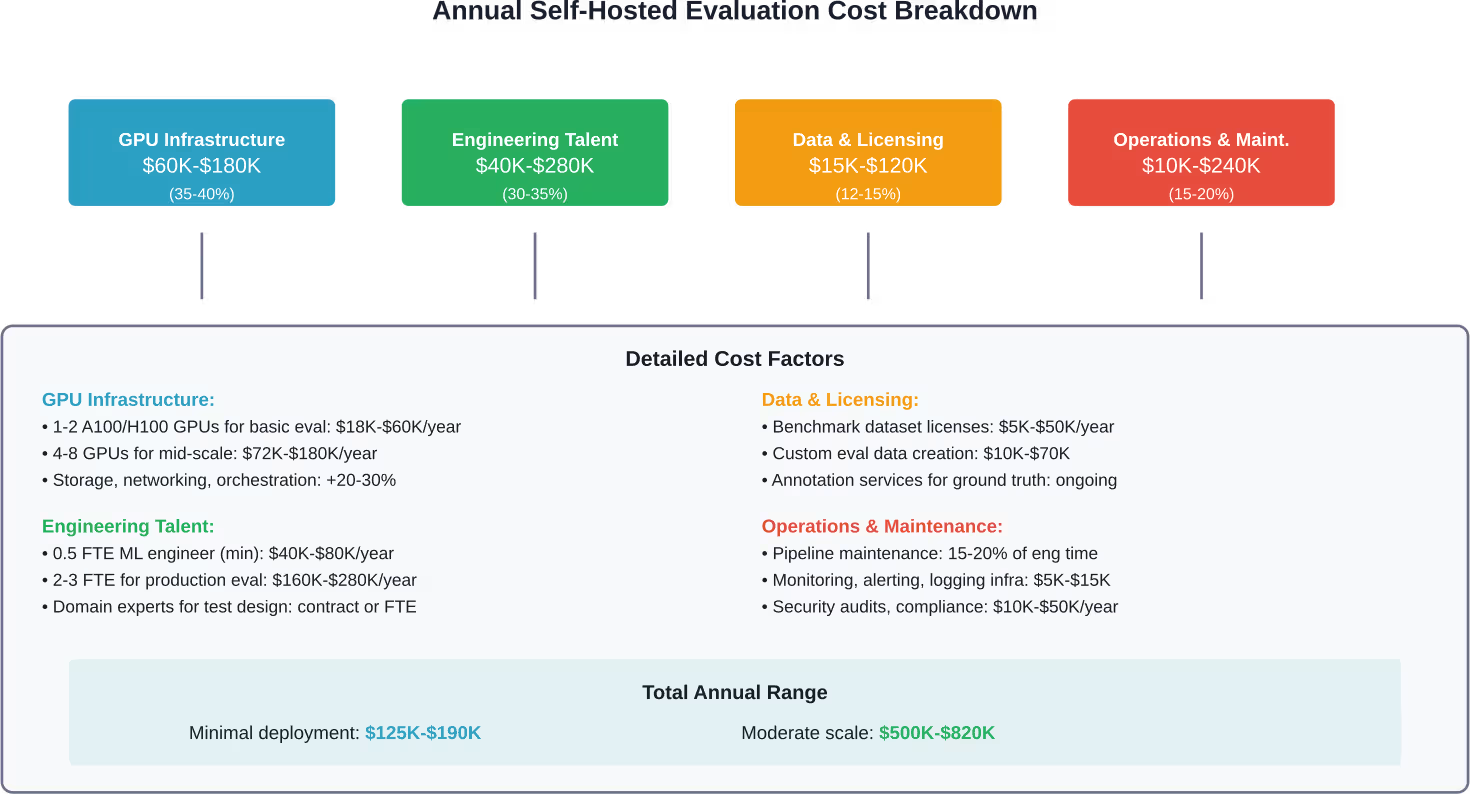

Même un déploiement interne minimal peut coûter entre $125K et $190K par an. Ce tarif concerne une configuration à petite échelle dédiée à des cas d'utilisation internes. Pour des fonctionnalités d'évaluation destinées aux clients à une échelle plus modérée, prévoyez un budget annuel de $500K à $820K, au minimum.

Voici ce qui explique ces chiffres :

Configuration requise pour le GPU et le calcul

L'exécution des évaluations consiste à tester les modèles de manière répétée sur des jeux de données de test. Pour un modèle comportant entre 7 et 13 milliards de paramètres, un seul GPU A100 ou H100 suffit pour les charges de travail d'évaluation de base. Le coût mensuel d'un GPU cloud pour ce niveau de service se situe entre 1 040 000 et 5 000 000 £.

Passer à des modèles de 30 à 70 milliards de roupies ? Le besoin passe alors à 4 à 8 GPU, et les coûts mensuels d'exploitation atteignent 1 TP4 T6 000 à 1 TP4 T15 000. L'infrastructure d'évaluation peut aisément couvrir les coûts d'hébergement en production.

D'après les données concurrentielles de 2025, les déploiements d'entrée de gamme avec des modèles de 7 à 13 milliards de dollars sur un seul GPU coûtent environ 1 400 000 à 5 000 000 TP4 000 par mois. Les déploiements de milieu de gamme avec des modèles plus importants sur 4 à 8 GPU coûtent entre 6 400 000 et 15 400 000 TP4 000 par mois. Les déploiements d'entreprise avec les modèles les plus volumineux peuvent dépasser 30 000 000 TP4 000 par mois rien que pour le calcul.

Mais voilà le hic : l’évaluation ne s’exécute pas en continu comme la production. Elle s’effectue par à-coups. Cela engendre des inefficacités. Les équipes surdimensionnent les GPU et gaspillent de l’argent avec des ressources inutilisées, ou les sous-dimensionnent et créent des goulots d’étranglement qui ralentissent les cycles de développement.

La taxe sur les talents dont personne ne parle

Les outils open source ne se configurent pas d'eux-mêmes. Ils nécessitent des ingénieurs qualifiés qui maîtrisent à la fois les cadres d'évaluation et le domaine spécifique testé.

Même les modèles pré-entraînés nécessitent l'intervention d'experts. Il faut concevoir les protocoles d'évaluation, sélectionner les benchmarks appropriés, interpréter les résultats et traduire les conclusions en améliorations concrètes. Cela requiert une expertise en apprentissage automatique combinée à une connaissance approfondie du domaine — une combinaison qui justifie un salaire annuel de 150 000 à 250 000 roubles pour les praticiens expérimentés.

Les petites équipes peuvent initialement allouer 0,5 ETP (équivalent temps plein) aux travaux d'évaluation. Cela représente un coût total de 1 400 000 à 1 400 000 £ (salaire, avantages sociaux et frais généraux inclus). Les déploiements à plus grande échelle nécessitent 2 à 3 ingénieurs dédiés, ce qui porte les coûts liés aux talents à 1 400 000 à 1 400 000 £ par an.

Les discussions au sein de la communauté mettent régulièrement en lumière cette lacune. Les équipes partent du principe qu'elles peuvent simplement “ utiliser la bibliothèque d'évaluation open source ” sans prévoir de budget pour l'expertise nécessaire à son utilisation efficace. Six mois plus tard, elles embauchent des spécialistes ou abandonnent complètement leurs efforts d'évaluation.

Impact de la taille et de la complexité du modèle sur les coûts d'évaluation

La relation entre la taille du modèle et le coût de l'évaluation n'est pas linéaire. Elle est exponentielle dans le pire des cas.

Les petits modèles (1 à 3 milliards de paramètres) sont rapidement évalués. Un test complet peut prendre de quelques minutes à quelques heures. Les grands modèles (30 à 70 milliards de paramètres) peuvent nécessiter plusieurs jours pour atteindre le même niveau d'évaluation. Les architectures de type « mixte d'experts » (MoE) ajoutent une couche de complexité supplémentaire.

D'après les recherches sur les systèmes MoE, ces modèles possèdent un grand nombre de paramètres (certains atteignant 1,571 milliard), mais n'en activent que 1 à 25% lors du traitement des jetons. Cette activation limitée complexifie l'évaluation. Les benchmarks standard peuvent ne pas permettre de tester adéquatement tous les chemins d'analyse, ce qui nécessite des protocoles d'évaluation personnalisés.

Nombre de paramètres vs. complexité de l'évaluation

Voici comment la taille du modèle se traduit en frais généraux d'évaluation :

| Taille du modèle | Paramètres typiques | VRAM (4 bits) | Temps d'évaluation par test | Coût de l'évaluation mensuelle |

|---|---|---|---|---|

| Petit | 1-3B | ~2 Go | Minutes | $200-$800 |

| Moyen | 7-13B | 6-8 Go | Heures | $800-$2,500 |

| Grand | 30-70B | 20-40 Go | Quelques heures à quelques jours | $3,000-$8,000 |

| Très grand | 100 milliards+ | Plus de 60 Go | Jours | $10,000+ |

Ces estimations supposent un rythme d'évaluation régulier (tests complets hebdomadaires et tests de non-régression quotidiens). Les équipes pratiquant une évaluation continue à chaque modification du code verront leurs coûts augmenter considérablement.

Les architectures spécialisées exigent des tests spécialisés.

Les modèles de transformateurs standard disposent de protocoles d'évaluation bien établis. Les architectures plus récentes, comme les modèles MoE, les modèles d'espace d'état ou les systèmes hybrides, nécessitent des approches de test spécifiques.

Cette personnalisation a un coût. Les équipes peuvent soit concevoir elles-mêmes l'infrastructure de test (ce qui représente du temps d'ingénierie), soit faire appel à des services d'évaluation spécialisés. Dans les deux cas, le surcoût lié à cette architecture spécifique s'ajoute de 30 à 501 TP3T aux coûts d'évaluation de base.

Coûts cachés : données, intégration et frais généraux opérationnels

Les dépenses ne se limitent pas aux plateformes et à l'infrastructure. Plusieurs catégories de coûts restent invisibles jusqu'à la réception des factures.

Coûts de l'ensemble de données d'évaluation

Les benchmarks publics comme HumanEval (164 problèmes de codage) ou MBPP permettent d'évaluer les compétences générales. En revanche, les LLM privés couvrent généralement des domaines spécifiques : analyse juridique, diagnostic médical, modélisation financière, service client.

Les benchmarks génériques ne suffisent pas. Les organisations ont besoin d'ensembles de données d'évaluation personnalisés qui reflètent leurs cas d'utilisation réels, la distribution de leurs données et leurs cas particuliers. La création de ces ensembles de données nécessite un effort interne ou le recours à des services externes.

Les coûts de création de jeux de données internes comprennent le temps des experts (souvent de 150 000 à 300 000 TP4T/heure pour les domaines spécialisés), le travail d'annotation, l'assurance qualité et la maintenance des jeux de données au fur et à mesure de l'évolution des produits. Un jeu de données d'évaluation personnalisé de taille modeste (5 000 à 10 000 exemples) coûte généralement entre 20 000 et 50 000 TP4T à créer et entre 5 000 et 15 000 TP4T à maintenir par an.

L'acquisition de licences pour les jeux de données de référence commerciaux représente un coût supplémentaire. Les jeux de données spécialisés (juridiques, médicaux, financiers) peuvent coûter entre 100 000 et plus de 100 000 € selon leur taille, leur qualité et les conditions de licence.

Frais d'intégration et d'orchestration

L'évaluation ne peut exister de manière isolée. Elle doit s'intégrer aux systèmes de contrôle de version, aux pipelines CI/CD, aux registres de modèles, aux plateformes de suivi des expériences et à la surveillance de la production.

La mise en place de ces intégrations exige un temps d'ingénierie considérable. Une intégration de base entre une plateforme d'évaluation et une infrastructure MLOps existante nécessite généralement entre 80 et 200 heures de développement et de tests. À un tarif horaire de 1 400 000 à 250 000 £ pour un ingénieur en apprentissage automatique, cela représente entre 1 400 000 et 50 000 £ par intégration.

Multipliez ce coût par le nombre d'outils de la pile. Ajoutez ensuite la maintenance continue liée aux modifications des API et à l'évolution des besoins. Les frais d'intégration peuvent facilement atteindre 15 à 251 000 trous du coût total d'évaluation.

Audit de conformité et de sécurité

Les cabinets d'avocats privés traitent souvent des données sensibles. Les établissements de santé gèrent les données de santé protégées. Les institutions financières traitent les données personnelles et transactionnelles. Les agences gouvernementales gèrent les informations classifiées.

L'infrastructure d'évaluation doit respecter les mêmes normes de sécurité et de conformité que les systèmes de production. Cela implique des audits de sécurité, des tests d'intrusion, une documentation de conformité et, potentiellement, une infrastructure dédiée déployée en mode isolé du réseau.

Les audits de sécurité des systèmes d'IA coûtent entre $25K pour les évaluations de base et plus de $200K pour les évaluations complètes des déploiements complexes. Le suivi continu de la conformité représente un coût supplémentaire de $10 à $50K par an, selon les exigences réglementaires.

Comparaison du coût total de possession : Plateforme vs. Hébergement autogéré

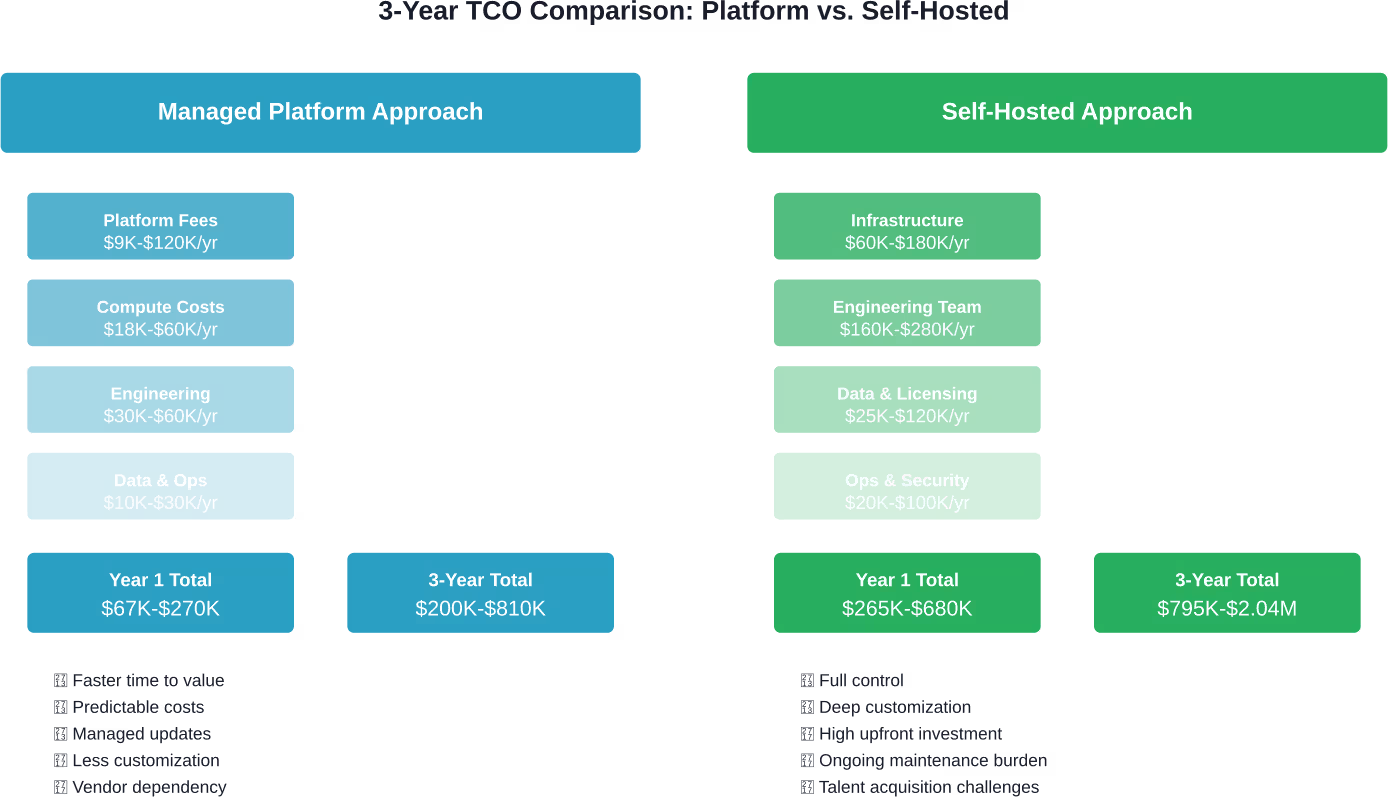

La décision de construire ou d'acheter une infrastructure d'évaluation implique plus que la simple comparaison des frais d'abonnement à une plateforme et des coûts d'infrastructure.

Le coût total de possession (CTP) comprend les coûts directs (plateformes, calcul, licences), les coûts liés aux talents (ingénierie, opérations, expertise spécialisée), les coûts d'opportunité (délai de rentabilisation, vitesse de mise en œuvre des fonctionnalités) et les coûts liés aux risques (lacunes d'évaluation entraînant des échecs de production).

L'approche par plateforme gérée présente des coûts de première année inférieurs ($67K-$270K contre $265K-$680K) et un coût total de possession (TCO) sur trois ans nettement inférieur ($200K-$810K contre $795K-$2,04M). L'approche auto-hébergée nécessite un investissement 3 à 4 fois supérieur pour des fonctionnalités comparables.

Mais ces chiffres ne révèlent qu'une partie de la réalité. Les plateformes permettent un retour sur investissement plus rapide, souvent en quelques semaines au lieu de plusieurs mois. Les solutions auto-hébergées offrent une personnalisation plus poussée aux organisations ayant des besoins spécifiques que les plateformes ne peuvent pas prendre en charge.

Quand les abonnements à une plateforme sont judicieux

Les plateformes gérées conviennent mieux aux équipes qui ont besoin rapidement de capacités d'évaluation complètes, qui disposent d'une expertise limitée en infrastructure ML en interne, qui souhaitent des coûts opérationnels prévisibles ou qui opèrent à une échelle petite à moyenne où les limites de la plateforme ne sont pas contraignantes.

Le cadre économique d'évaluation des modèles de langage suggère de se concentrer sur les indicateurs de coût de validation, c'est-à-dire le coût nécessaire pour obtenir un résultat correct. Les plateformes présentent un avantage certain pour la plupart des organisations, car elles réduisent les coûts d'ingénierie requis pour obtenir des résultats d'évaluation fiables.

Quand l'auto-hébergement devient nécessaire

Une infrastructure auto-hébergée est judicieuse lorsque les exigences d'évaluation dépassent les capacités de la plateforme, que la sensibilité des données empêche l'utilisation de services externes, que le volume d'évaluation rendrait les frais de plateforme prohibitifs, ou qu'une personnalisation poussée est nécessaire pour les architectures propriétaires ou les protocoles d'évaluation.

Les organisations des secteurs réglementés (santé, finance, administration publique) n'ont souvent pas le choix. Les exigences en matière de gouvernance des données imposent un déploiement sur site ou dans un cloud privé, avec un contrôle total sur les flux de données et les modalités d'accès.

Stratégies d'optimisation des coûts pour l'évaluation des LLM

Quel que soit le choix entre une plateforme et une solution auto-hébergée, plusieurs stratégies permettent de réduire les coûts d'évaluation sans sacrifier la qualité.

Approches d'évaluation par paliers

Chaque modification de code ne nécessite pas une évaluation complète. Mettez en œuvre une stratégie de tests à plusieurs niveaux : des tests rapides sur chaque commit (minutes, coût minimal), une évaluation moyenne sur les pull requests (heures, coût modéré) et une évaluation complète sur les versions candidates (jours, coût total).

Cette approche réduit les coûts de calcul de 60 à 70% par rapport à l'exécution d'une évaluation complète sur chaque modification, tout en détectant la plupart des problèmes tôt, lorsqu'ils sont moins coûteux à corriger.

Sélection efficace des points de référence

Une étude sur les benchmarks de modèles de langage à grande échelle (LLM) recense 283 benchmarks représentatifs, témoignant de l'approche exhaustive adoptée dans ce domaine. Plutôt que d'exécuter tous les benchmarks disponibles, il est conseillé d'en sélectionner 8 à 10 qui sont les plus pertinents pour des cas d'utilisation spécifiques. Il est également recommandé de valider cette sélection trimestriellement afin de garantir une couverture adéquate malgré l'évolution des modèles.

Stratégies d'évaluation hybrides

Combinez les services de la plateforme pour les tests de fonctionnalités standard avec une évaluation personnalisée auto-hébergée pour les exigences spécifiques au domaine. Les plateformes gèrent efficacement la charge de travail d'évaluation courante. L'infrastructure interne prend en charge les tests spécifiques 20% que les plateformes ne peuvent pas couvrir.

Cette approche hybride coûte généralement 30 à 40% de moins que l'auto-hébergement pur tout en conservant la personnalisation nécessaire.

Optimisation des ressources de calcul

Les charges de travail d'évaluation connaissent des pics et des creux. Les instances Spot et les machines virtuelles préemptibles peuvent réduire les coûts des GPU cloud de 60 à 801 TP3T pour les charges de travail d'évaluation tolérant les interruptions et les redémarrages.

Pour les équipes effectuant régulièrement des évaluations, les instances réservées offrent des réductions de 40 à 50% par rapport à la tarification à la demande. Le risque lié à l'engagement diminue à mesure que l'évaluation s'intègre durablement aux processus de développement plutôt que de rester une activité ponctuelle.

Faites en sorte que l'évaluation du LLM justifie son coût, et non qu'elle représente une dépense supplémentaire.

L'évaluation privée des LLM peut rapidement devenir coûteuse, surtout lorsque les tests sont déconnectés de la manière dont le modèle est réellement construit et utilisé. IA supérieure L'évaluation est envisagée comme une partie intégrante du cycle de vie complet du modèle, et non comme une couche de service distincte. Leur travail comprend la création et l'optimisation des modèles, la mise en place de pipelines de validation et l'alignement de l'évaluation sur des cas d'utilisation réels. Cela permet d'éviter les tests excessifs, de réduire les benchmarks redondants et de garantir que l'évaluation reste liée aux performances réellement importantes en production.

La plupart des coûts d'évaluation augmentent lorsque les tests sont répétés sans amélioration du système lui-même. En intégrant l'évaluation au développement et au déploiement, vous réduisez le nombre de cycles et obtenez des résultats plus clairs. Si vous souhaitez que l'évaluation contribue réellement à l'amélioration de votre modèle au lieu de simplement le mesurer, contactez-nous. IA supérieure et examinez de plus près la structure de votre installation actuelle.

Exemples concrets de tarification et études de cas

Les fourchettes de coûts abstraites deviennent plus claires grâce à des scénarios concrets.

Petite équipe : Chatbot interne

Une start-up de 15 personnes développe un chatbot de base de connaissances interne à l'aide d'un modèle à 7 milliards de paramètres finement paramétré. L'évaluation doit inclure des tests de précision sur des requêtes spécifiques à l'entreprise, des contrôles de sécurité et un suivi des performances.

Approche : Plateforme Braintrust Pro ($249/mois, prix confirmé) plus création d'un ensemble de données d'évaluation personnalisé (estimation unique de $15K) plus 0,25 ETP de temps d'ingénierie (estimation de $40K/an).

Coût total de la première année : $58K. Coût annuel récurrent : $43K.

Entreprise de taille moyenne : IA de service client

Une entreprise SaaS de 200 personnes déploie un modèle à 13 milliards de paramètres pour l'automatisation du service client. Les critères d'évaluation comprennent la précision, la pertinence du ton, la détection des hallucinations et les tests A/B par rapport à des modèles de référence.

Approche : Plateforme de niveau intermédiaire ($2 500/mois) plus ressources GPU modérées pour les tests spécialisés auto-hébergés ($4K/mois) plus ensemble de données de domaine personnalisé ($35K) plus 1,5 spécialistes ETP ($180K/an).

Coût total de la première année : $293K. Coût annuel récurrent : $258K.

Entreprise : Déploiement dans un secteur réglementé

Une société de services financiers de 5 000 employés développe un modèle à 30 milliards de paramètres pour l’aide à la recherche en investissement. Les exigences réglementaires imposent un déploiement sur site, des pistes d’audit complètes et une validation par un tiers.

Approche : Infrastructure auto-hébergée sur matériel dédié ($180K/an de coûts GPU) plus une équipe de 3 ETP ($450K/an) plus des ensembles de données et des licences commerciales ($80K/an) plus des audits de sécurité ($50K/an) plus des services de validation externes ($40K/an).

Coût total de la première année : $800K. Coût annuel récurrent : $800K (plus mises à niveau majeures de l’infrastructure tous les 3 ans).

Ces scénarios illustrent comment les coûts évoluent en fonction de la taille de l'organisation, de la complexité du modèle et des exigences réglementaires. L'exemple de l'entreprise coûte 14 fois plus cher que celui de la petite équipe, mais dessert 333 fois plus d'utilisateurs dans un environnement fortement réglementé.

L'économie cachée de l'évaluation des logiciels libres “ gratuits ”

Les outils d'évaluation LLM open source font une promesse séduisante : aucun coût de licence logicielle. La réalité est bien plus coûteuse.

Le problème ne réside pas dans les outils eux-mêmes. Lighteval, les bibliothèques d'évaluation de Hugging Face et les frameworks similaires fonctionnent bien. Le véritable défi est tout ce qui les entoure : l'infrastructure nécessaire à leur fonctionnement, l'expertise requise pour les utiliser efficacement, la maintenance pour les maintenir à jour et l'intégration pour les rendre utiles.

Les discussions au sein de la communauté mettent régulièrement en lumière ce problème. Les équipes partent du principe que logiciel libre rime avec gratuité. Elles déchantent souvent après six mois de projet, un investissement de 150 000 $ en temps d'ingénierie et des difficultés persistantes à obtenir des résultats d'évaluation fiables.

Voici le schéma : télécharger un framework d’évaluation open source (gratuit), passer 2 semaines à élaborer la documentation (coût d’ingénierie), passer 1 mois à construire l’infrastructure (coût d’ingénierie + coût du cloud), passer 2 mois à déboguer les problèmes d’intégration (coût d’ingénierie) et consacrer des efforts continus à la maintenance à mesure que les frameworks évoluent (coût d’ingénierie permanent).

Ce framework “ gratuit ” a coûté entre $80K et $120K la première année. Pour de nombreuses organisations, investir entre $3K et $10K dans une plateforme gérée aurait permis d'obtenir de meilleurs résultats plus rapidement et à moindre coût.

Quand l'open source permet réellement de faire des économies

Les outils d'évaluation open source présentent un intérêt économique dans certains cas précis : lorsque les équipes possèdent déjà une expertise en infrastructure ML en interne, lorsque les exigences d'évaluation sont très spécialisées et que les plateformes ne peuvent pas les prendre en charge, lorsque le volume d'évaluation rendrait les frais de plateforme extrêmement élevés, ou lorsque les organisations ont des engagements idéologiques ou stratégiques envers les piles technologiques open source.

Mais même dans ces cas-là, la rentabilité opérationnelle reste essentielle. La structure des coûts se déplace des frais de plateforme vers les talents et l'infrastructure, mais les dépenses totales diminuent rarement autant que le laissaient présager les analyses initiales.

Tendances tarifaires et prévisions des coûts futurs

Le marché de l'évaluation des LLM demeure immature et les prix y sont volatils. Plusieurs tendances influencent l'évolution future des coûts.

La concurrence accrue fait baisser les prix des plateformes

De plus en plus de fournisseurs font leur entrée sur le marché des plateformes d'évaluation chaque mois. La concurrence entraîne généralement une baisse des prix et une augmentation des fonctionnalités. L'offre d'entrée de gamme à $249/mois en 2025 pourrait passer à $149/mois d'ici 2027, tout en incluant des fonctionnalités auparavant réservées aux abonnements Entreprise.

Les recherches sur les indicateurs de coût de passage montrent que ce coût a diminué au fil du temps avec les nouvelles versions de modèles, et des analyses économiques précises révèlent que les modèles légers sont les plus rentables pour les tâches de base. Les services d'évaluation suivront probablement une dynamique de tarification similaire.

Les coûts d'infrastructure restent rigides

Malgré des années de prévisions, le coût des GPU n'a pas baissé de manière significative. Les fournisseurs de cloud maintiennent des marges élevées sur les instances GPU. L'oligopole des hyperscalers empêche une concurrence agressive sur les prix.

Il ne faut pas s'attendre à une réduction significative des coûts d'infrastructure pour l'évaluation auto-hébergée à court terme. Les gains d'efficacité grâce à de meilleurs logiciels pourraient compenser 10 à 151 Tbit/s des coûts de calcul, mais la rentabilité du matériel reste un défi.

La spécialisation crée des niveaux de prix premium

Les plateformes d'évaluation génériques se banaliseront et leurs prix deviendront compétitifs. Les services spécialisés pour les secteurs réglementés, l'évaluation par domaine spécifique ou les fonctionnalités avancées comme les tests adverses conserveront des tarifs élevés.

Attendez-vous à une segmentation du marché : plateformes de base à $200-$500/mois, plateformes professionnelles à $2K-$5K/mois et services spécialisés à $10K+/mois ou tarification personnalisée pour les projets.

Questions fréquemment posées

Quel est le coût moyen des services d'évaluation privés de LLM ?

Les services d'évaluation sur plateforme coûtent généralement entre $249/mois pour les formules d'entrée de gamme et plus de $10/mois pour les déploiements en entreprise. Une infrastructure d'évaluation auto-hébergée coûte entre $125K et $190K par an pour les déploiements minimaux et entre $500K et $820K par an pour les systèmes de production de taille moyenne. Le coût total dépend de la taille du modèle, de la fréquence des évaluations, de l'expertise de l'équipe et des choix d'infrastructure.

Les outils d'évaluation LLM open source sont-ils vraiment gratuits ?

Le logiciel est gratuit, mais ses coûts d'exploitation sont considérables. Même un déploiement minimal auto-hébergé utilisant des outils open source coûte plus de 1 000 000 $ par an, en tenant compte de l'infrastructure, des compétences en ingénierie, des licences de données et de la maintenance. Les entreprises doivent prévoir un budget pour les ressources GPU, l'expertise en ingénierie du ML, la création de jeux de données et les frais généraux d'exploitation. Le coût total de possession d'un logiciel “ gratuit ” est souvent supérieur à celui des plateformes payantes.

Combien coûte l'évaluation d'un modèle paramétrique 70B ?

L'évaluation de grands modèles à 70 milliards de paramètres nécessite généralement 4 à 8 GPU haut de gamme et coûte entre 3 000 et 8 000 £ par mois rien que pour les ressources de calcul. À cela s'ajoutent les frais de plateforme (entre 2 500 et 5 000 £ par mois) ou le coût d'une infrastructure hébergée en interne (2 à 3 ETP, soit entre 300 000 et 450 000 £ par an), ainsi que les jeux de données personnalisés (entre 35 000 et 70 000 £) et la maintenance. Le coût total de la première année pour une évaluation complète d'un modèle de 70 milliards de paramètres varie entre 150 000 et 400 000 £, selon la profondeur et la fréquence de l'évaluation.

Quels sont les facteurs qui influencent le plus les coûts d'évaluation des LLM ?

La taille et l'architecture du modèle sont les principaux facteurs de variation des coûts. Les modèles plus volumineux nécessitent davantage de GPU et des temps d'évaluation plus longs. La fréquence et la profondeur de l'évaluation ont également une incidence considérable : une évaluation continue coûte 5 à 10 fois plus cher qu'une évaluation hebdomadaire. L'expertise de l'équipe influe sur les coûts, car les évaluateurs expérimentés travaillent plus efficacement et choisissent les outils les plus adaptés. Les choix d'infrastructure (plateforme ou hébergement sur site) peuvent engendrer des différences de coût de 3 à 4 fois supérieures pour des fonctionnalités comparables.

Est-il moins coûteux d'utiliser des plateformes d'évaluation ou de construire une infrastructure personnalisée ?

Pour la plupart des organisations, les plateformes sont plus économiques. Le coût total de possession (TCO) sur trois ans d'une plateforme varie de 200 000 à 810 000 £, contre 795 000 à 2,04 millions de £ pour une infrastructure auto-hébergée aux capacités comparables. Les plateformes permettent un retour sur investissement plus rapide et requièrent moins d'expertise spécialisée. L'infrastructure auto-hébergée n'est économiquement viable que lorsque le volume d'évaluation dépasse les limites de la plateforme, que la gouvernance des données empêche le recours à des services externes ou que des exigences d'évaluation très spécifiques ne peuvent être satisfaites par les plateformes.

Comment les organisations peuvent-elles réduire les coûts d'évaluation des LLM sans sacrifier la qualité ?

Mettez en œuvre des stratégies d'évaluation par paliers, avec des tests rapides à chaque modification et des tests complets uniquement lors des mises en production, afin de réduire les coûts de calcul de 60 à 701 TP3T. Privilégiez les sous-ensembles de benchmarks efficaces plutôt que l'exécution de suites de tests exhaustives. Utilisez des approches hybrides combinant les services de la plateforme pour les tests standard et une évaluation ciblée et auto-hébergée pour les besoins spécifiques. Optimisez les ressources de calcul grâce aux instances spot (économies de 60 à 801 TP3T) ou aux instances réservées (économies de 40 à 501 TP3T) pour les charges de travail constantes. Concentrez vos efforts d'ingénierie sur l'évaluation personnalisée à forte valeur ajoutée plutôt que sur la reconstruction de fonctionnalités standard.

Les coûts d'évaluation sont-ils proportionnels à la taille du modèle ?

Non, les coûts d'évaluation augmentent de façon superlinéaire. L'évaluation d'un modèle de 70 milliards de paramètres ne coûte pas deux fois plus cher que celle d'un modèle de 35 milliards ; elle coûte généralement 3 à 5 fois plus cher en raison des exigences accrues en matière de GPU, des temps d'évaluation plus longs et de la complexité de l'infrastructure. Les très grands modèles (plus de 100 milliards de paramètres) nécessitent une infrastructure et des techniques spécialisées qui engendrent des coûts supplémentaires. La relation entre le nombre de paramètres et le coût est donc de type accéléré, et non linéaire.

Prendre la décision économique

Le coût des services d'évaluation de masters en droit (LLM) privés varie considérablement selon l'approche, l'envergure et les exigences. Les petites équipes peuvent opter pour des solutions de plateforme à moins de 100 000 £ par an. Les grandes entreprises aux besoins spécifiques peuvent dépenser plus de 100 000 £ par an pour une infrastructure d'évaluation complète.

La décision économique repose sur trois facteurs : la profondeur et la fréquence requises de l’évaluation, l’expertise interne disponible et l’importance stratégique des capacités d’évaluation.

Pour la plupart des organisations, les plateformes gérées offrent la meilleure solution économique. Un investissement initial moindre, un retour sur investissement plus rapide et des coûts prévisibles compensent largement les avantages de flexibilité d'une infrastructure auto-hébergée. L'exception ? Les organisations ayant des besoins véritablement spécifiques, un volume d'évaluations très important ou des contraintes réglementaires qui excluent le recours à des services externes.

Mais voici le véritable enseignement : les coûts d’évaluation doivent être comparés aux coûts d’un échec. Le déploiement en production d’une fonctionnalité d’IA défectueuse peut anéantir la confiance des clients, exposer les autorités réglementaires à des problèmes et nuire à la réputation de la marque. Ces coûts sont bien supérieurs aux dépenses d’évaluation.

La question n'est pas de savoir s'il faut investir dans l'évaluation, mais plutôt quel montant est adéquat au regard du profil de risque. Un chatbot de service client pourrait justifier un budget annuel de $50K pour son évaluation. Un assistant de diagnostic médical pourrait nécessiter $500K. Un système de décision pour véhicule autonome pourrait exiger plus de $5M.

Adaptez l'investissement dans l'évaluation à la gravité des conséquences. Négliger l'évaluation pour faire des économies aujourd'hui engendre souvent des dépenses exponentiellement plus importantes demain en cas de défaillances de production.

Prêt à mettre en œuvre une évaluation rigoureuse des modules d'apprentissage ? Commencez par évaluer la maturité actuelle de l'évaluation, identifier les écarts entre les capacités actuelles et requises, et calculer le coût réel des échecs d'évaluation dans des cas d'utilisation spécifiques. Cette analyse permet de trancher entre plateforme et solution auto-hébergée et justifie l'investissement nécessaire auprès des parties prenantes.