Korte samenvatting: Particuliere LLM-evaluatiediensten kosten doorgaans tussen de $249 en $10.000+ per maand voor platformen, terwijl maatwerkevaluatieprojecten variëren van $125.000 tot $820.000 per jaar, afhankelijk van de schaal. De kosten worden bepaald door de omvang van het model, de infrastructuurvereisten, de expertise van het team en de complexiteit van de implementatie. Er bestaan open-source evaluatietools, maar de operationele kosten voor hosting, personeel en onderhoud overstijgen vaak de abonnementskosten van het platform.

De haast om grote, private taalmodellen te implementeren heeft bij veel organisaties tot een pijnlijke conclusie geleid: het bouwen van het model is slechts het begin. Evalueren of het daadwerkelijk werkt? Dát is waar de kosten oplopen.

In tegenstelling tot openbare API-gebaseerde modellen, waarbij evaluatie kan plaatsvinden door middel van eenvoudige benchmarking, vereisen private LLM's rigoureuze, continue tests die rekening houden met bedrijfseigen data, specifieke gebruiksscenario's en beveiligingsvereisten van de onderneming. De evaluatie-infrastructuur alleen al kan de hostingkosten van de modellen zelf evenaren of zelfs overtreffen.

Dit is de ongemakkelijke waarheid: bedrijven onderschatten de evaluatiekosten steevast met 40 tot 60 biljoen dollar. Ze budgetteren voor hardware en engineers, maar vergeten de infrastructuur voor continue testen, red teaming-specialisten en de operationele overhead van het onderhouden van evaluatiepipelines die duizenden keren per maand draaien.

Deze specificatie omvat platformprijzen, infrastructuurkosten, personeelskosten en de verborgen operationele kosten die van een "betaalbare" open-source evaluatie een jaarlijkse verplichting van zes cijfers maken.

Inzicht in de evaluatie van particuliere LLM-programma's: waar u nu eigenlijk voor betaalt

De evaluatie van private LLM-programma's is meer dan alleen een model door een benchmarksuite halen en het daarbij laten. Het is een continu proces dat meerdere dimensies omvat.

Het evaluatieproces omvat nauwkeurigheidstesten, het scannen op beveiligingslekken, prestatieoptimalisatie, het opsporen van vooringenomenheid en validatie van de naleving van regelgeving. Elke dimensie vereist verschillende tools, datasets en expertise. Sommige organisaties proberen open-source oplossingen samen te stellen. Anderen kopen platforms. De meeste kiezen uiteindelijk voor een hybride oplossing die duurder is dan elk van beide benaderingen afzonderlijk.

De belangrijkste kostenfactoren

De infrastructuur voor evaluaties bestaat uit verschillende kostenposten. Platformabonnementen of licentiekosten vormen de zichtbare basis. De infrastructuurkosten voor het uitvoeren van evaluaties op grote schaal voegen daar nog een laag aan toe. Daarnaast zijn er de personeelskosten: ML-engineers, evaluatiespecialisten en domeinexperts die tests ontwerpen en resultaten interpreteren.

Vergeet de datakosten niet. Aangepaste evaluatiedatasets, of deze nu van leveranciers zijn gelicentieerd of intern zijn ontwikkeld, vertegenwoordigen een aanzienlijke investering. Volgens het Center for AI Standards and Innovation (CAISI) van NIST vereist de ontwikkeling van hoogwaardige AI-systemen een hoogwaardige AI-meetwetenschap – en die is niet goedkoop.

Het laatste onderdeel? Integratie- en onderhoudskosten. Evaluatiepipelines moeten worden gekoppeld aan bestaande MLOps-workflows, versiebeheersystemen en monitoringplatforms. Deze integratiewerkzaamheden worden zelden meegenomen in de initiële kostenramingen, maar slokken steevast 20 tot 30 biljoen dollar aan evaluatiebudget op.

Platformgebaseerde evaluatiediensten: prijsbenchmarks

Beheerde evaluatieplatformen bieden de snelste weg naar uitgebreide tests. De prijzen variëren echter sterk, afhankelijk van de functies, de schaal en de positionering van de aanbieder.

Op basis van de beschikbare gegevens voor 2025-2026 ziet de markt er als volgt uit:

| Platformniveau | Maandelijkse kosten | Belangrijkste kenmerken | Het beste voor |

|---|---|---|---|

| Toegang (bijv. Braintrust Pro) | $249 | Onbeperkt aantal traceringen, 5 GB aan verwerkte data, 50.000 scores | Kleine teams, producten in een vroeg stadium. |

| Middenklasse | $1,500-$3,500 | Geavanceerde analyses, aangepaste benchmarks, samenwerking in teamverband | Groeiende producten met een gemiddeld verkeersvolume |

| Onderneming | $5,000-$10,000+ | On-premise implementatie, toegewijde ondersteuning, onbeperkte schaalbaarheid | Grote organisaties, gereguleerde sectoren |

| Maatwerk/White-Label | $15,000+ | Volledige aanpassing, toegewijde infrastructuur, SLA-garanties | Fortune 500-bedrijven, overheidsinstanties |

De gegevens over de prijsstructuur van Braintrust laten zien dat klanten volgens Braintrust consequent nauwkeurigheidsverbeteringen van 30% of meer rapporteren binnen slechts enkele weken na implementatie. Een dergelijke prestatiewinst rechtvaardigt de platformkosten – als het alternatief is om defecte AI-functionaliteiten in productie te nemen.

Giskard biedt zowel open-source als enterprise-opties. De open-source bibliotheek is gratis, maar vereist zelfhosting en technische expertise. Hun enterprise-platform biedt continue AI-red teaming en RAG-evaluatie met beheerde infrastructuur, hoewel de specifieke prijzen niet openbaar zijn gemaakt.

Wat platformkosten daadwerkelijk dekken

Platformabonnementen omvatten doorgaans het evaluatiekader zelf, vooraf samengestelde benchmarksuites, hosting voor testuitvoering, dashboards voor resultaatanalyse en een zekere mate van ondersteuning.

Wat is er niet inbegrepen? De rekenkosten voor het daadwerkelijk uitvoeren van je modellen tijdens de evaluatie. Het creëren van aangepaste datasets. De ontwikkeltijd die nodig is om het platform in je workflow te integreren. Het trainen van je team om het effectief te gebruiken.

Veel platformen berekenen de kosten op basis van het verwerkte datavolume of het aantal testruns. Dat instapabonnement van $249/maand klinkt redelijk, totdat je maandelijks 100 GB aan testdata verwerkt en ineens het enterprise-abonnement nodig hebt.

Infrastructuurkosten voor zelfgehoste evaluatie

Sommige teams kiezen ervoor om een evaluatie-infrastructuur op te bouwen met behulp van open-source tools zoals Lighteval of de evaluatiebibliotheken van Hugging Face. De software is gratis. Al het andere kost geld.

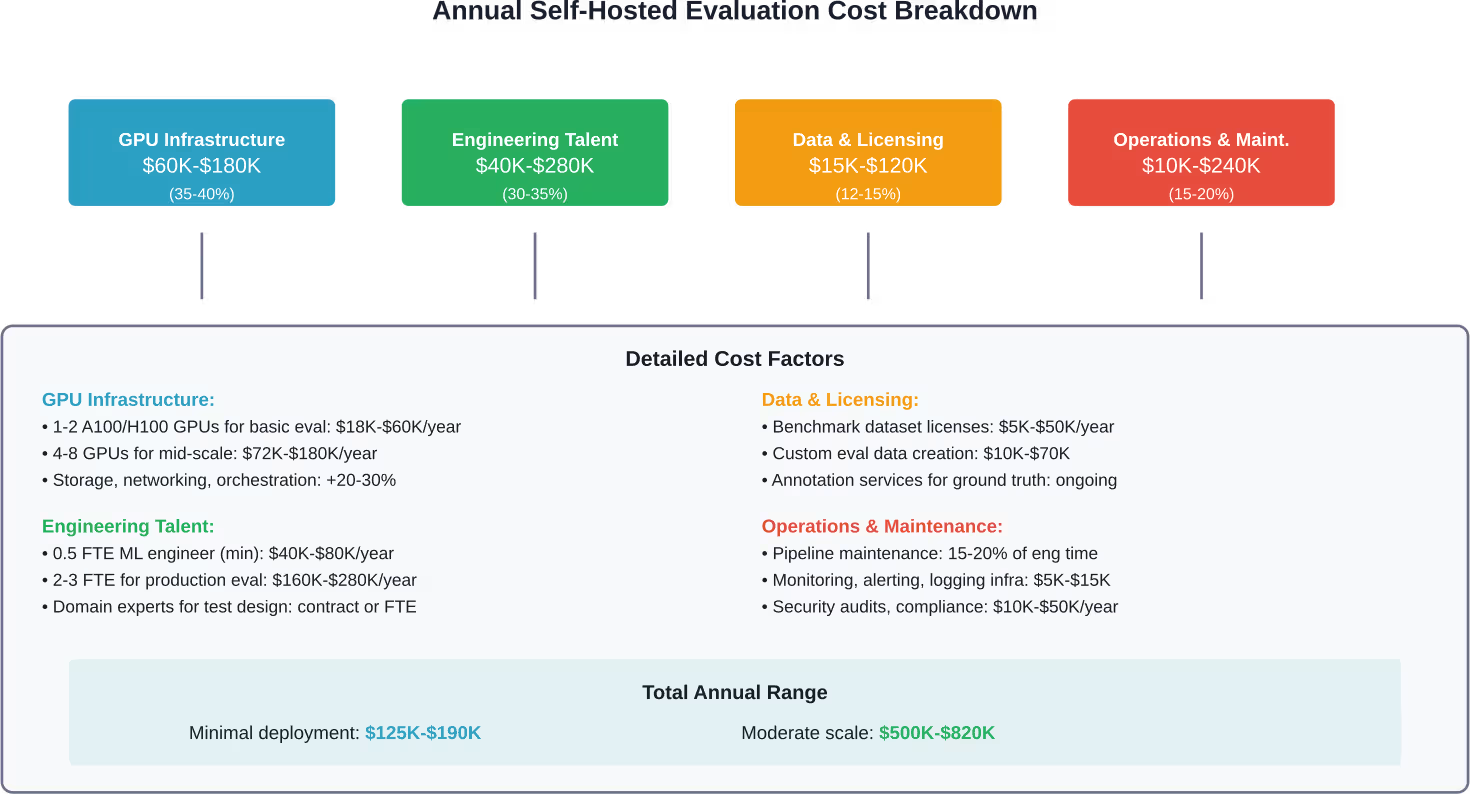

Zelfs een minimale interne implementatie kan jaarlijks tussen de 125.000 en 190.000 dollar kosten. Dat is voor een kleinschalige opstelling voor intern gebruik. Middelgrote, klantgerichte evaluatiefuncties? Reken dan, conservatief geschat, op 500.000 tot 820.000 dollar per jaar.

Dit is wat deze cijfers verklaart:

GPU- en rekenvereisten

Evaluaties uitvoeren betekent dat modellen herhaaldelijk worden getest met testdatasets. Voor een model met 7 tot 13 miljard parameters kan één A100 of H100 GPU de basisevaluatietaken aan. De maandelijkse kosten voor een cloud-GPU in die categorie bedragen ongeveer 1.500 tot 1.500.

Opschalen naar modellen van 30 tot 70 miljard? Dan zijn er 4 tot 8 GPU's nodig en lopen de maandelijkse actieve kosten op tot $6.000 tot $15.000. De kosten voor de evaluatie-infrastructuur kunnen dan gemakkelijk oplopen tot dezelfde kosten als de hosting voor de productieomgeving.

Op basis van concurrentiegegevens uit 2025 kosten instapimplementaties met 7B-13B-modellen op één GPU ongeveer $1.5K-$5K per maand. Implementaties in het middensegment met grotere modellen op 4-8 GPU's variëren van TP4T6K-$15K per maand. Enterprise-implementaties met de grootste modellen kunnen meer dan TP4T30K per maand kosten, alleen al voor rekenkracht.

Maar hier zit de crux: evaluatie draait niet continu zoals de productieomgeving. Het draait in bursts. Dat zorgt voor inefficiëntie. Teams overdimensioneren ofwel te veel GPU's en verspillen geld aan ongebruikte GPU's, ofwel onderdimensioneren ze en creëren knelpunten die de ontwikkelcycli vertragen.

De talentenbelasting waar niemand het over heeft

Open-source tools configureren zichzelf niet. Ze vereisen bekwame engineers die zowel de evaluatiekaders als het specifieke te testen domein begrijpen.

Zelfs voorgeprogrammeerde modellen hebben deskundige gebruikers nodig. Iemand moet evaluatieprotocollen ontwerpen, geschikte benchmarks selecteren, resultaten interpreteren en bevindingen vertalen naar concrete verbeteringen. Dat vereist expertise in machine learning in combinatie met domeinkennis – een combinatie die ervaren professionals een jaarsalaris van 1.400.000 tot 1.400.000 euro oplevert.

Kleine teams kunnen in eerste instantie 0,5 FTE (fulltime equivalent) toewijzen aan evaluatiewerk. Dat komt neer op $75K-$125K aan totale kosten (salaris plus secundaire arbeidsvoorwaarden en overhead). Middelgrote implementaties vereisen 2-3 toegewijde engineers, waardoor de personeelskosten oplopen tot $300K-$750K per jaar.

Discussies binnen de community brengen deze kloof herhaaldelijk aan het licht. Teams gaan ervan uit dat ze simpelweg "de open-source evaluatiebibliotheek kunnen gebruiken" zonder te budgetteren voor de expertise die nodig is om deze effectief te gebruiken. Zes maanden later moeten ze ofwel specialisten inhuren, ofwel hun evaluatie-inspanningen volledig staken.

Invloed van modelgrootte en complexiteit op evaluatiekosten

De relatie tussen modelgrootte en evaluatiekosten is niet lineair. In het ergste geval is deze exponentieel.

Kleine modellen (1-3 miljard parameters) doorlopen evaluatiesuites snel. Een uitgebreide test kan minuten tot uren duren. Grote modellen (30-70 miljard parameters) kunnen dagen in beslag nemen voor dezelfde evaluatiediepte. Mixture-of-Experts (MoE)-architecturen voegen nog een extra complexiteitslaag toe.

Volgens onderzoek naar MoE-systemen beschikken deze modellen over een groot aantal parameters – sommige tot wel 1,571 miljard – maar activeren ze slechts 1-25% tijdens de tokenverwerking. Deze spaarzame activering zorgt voor uitdagingen bij de evaluatie. Standaard benchmarks testen mogelijk niet alle expertpaden adequaat, waardoor aangepaste evaluatieprotocollen nodig zijn.

Aantal parameters versus evaluatiecomplexiteit

Hieronder leggen we uit hoe de schaal van een model zich vertaalt naar de overheadkosten voor de evaluatie:

| Modelmaat | Typische parameters | VRAM (4-bit) | Evaluatietijd per test | Maandelijkse evaluatiekosten |

|---|---|---|---|---|

| Klein | 1-3B | ~2 GB | Notulen | $200-$800 |

| Medium | 7-13B | 6-8 GB | Uren | $800-$2,500 |

| Groot | 30-70B | 20-40 GB | Uren tot dagen | $3,000-$8,000 |

| Extra groot | 100 miljard+ | 60+ GB | Dagen | $10,000+ |

Deze schattingen gaan uit van een regelmatige evaluatiecyclus (wekelijkse uitgebreide tests plus dagelijkse rooktests). Teams die bij elke codewijziging een continue evaluatie uitvoeren, zullen merken dat de kosten aanzienlijk hoger uitvallen.

Gespecialiseerde architecturen vereisen gespecialiseerde tests.

Standaard transformermodellen hebben goed ingeburgerde evaluatieprotocollen. Nieuwere architecturen zoals MoE-modellen, toestandsruimtemodellen of hybride systemen vereisen aangepaste testmethoden.

Die aanpassing kost geld. Teams bouwen de testinfrastructuur zelf (engineeringtijd) of kopen gespecialiseerde evaluatiediensten in. In beide gevallen voegt de meerprijs voor een exotische architectuur 30 tot 501 ton toe aan de basiskosten voor evaluatie.

Verborgen kosten: data, integratie en operationele overhead

De kosten beperken zich niet tot platformen en infrastructuur. Verschillende kostenposten blijven verborgen totdat de facturen binnenkomen.

Evaluatiegegevenssetkosten

Openbare benchmarks zoals HumanEval (164 programmeerproblemen) of MBPP zijn geschikt voor het testen van algemene vaardigheden. Maar private LLM's (Learning Learning Modules) zijn doorgaans gericht op specifieke domeinen, zoals juridische analyse, medische diagnose, financiële modellering en klantenservice.

Generieke benchmarks volstaan niet. Organisaties hebben aangepaste evaluatiegegevenssets nodig die hun daadwerkelijke gebruiksscenario's, gegevensverdeling en uitzonderlijke gevallen weerspiegelen. Het creëren van dergelijke gegevenssets vereist interne inspanning of de inzet van externe diensten.

De kosten voor het intern creëren van datasets omvatten de tijd van vakdeskundigen (vaak $150-$300 per uur voor gespecialiseerde domeinen), annotatiewerk, kwaliteitscontrole en het onderhoud van de dataset naarmate producten evolueren. Een bescheiden, op maat gemaakte evaluatiedataset (5.000-10.000 voorbeelden) kost doorgaans $20K-$50K om te creëren en $5K-$15K per jaar om te onderhouden.

Het verkrijgen van licenties voor commerciële benchmarkdatasets brengt extra kosten met zich mee. Datasets voor specifieke domeinen (juridisch, medisch, financieel) kunnen 1.400.000 tot 1.400.000 dollar of meer kosten, afhankelijk van de omvang, kwaliteit en licentievoorwaarden.

Integratie- en orkestratiekosten

Evaluatie vindt niet op zichzelf plaats. Het moet geïntegreerd worden met versiebeheersystemen, CI/CD-pipelines, modelregisters, platforms voor het bijhouden van experimenten en productiemonitoring.

Het bouwen van dergelijke integraties vergt aanzienlijke engineeringtijd. Een basisintegratie tussen een evaluatieplatform en de bestaande MLOps-infrastructuur vereist doorgaans 80 tot 200 uur aan ontwikkeling en testen. Met een uurtarief van $150 tot $250 voor ML-engineers, komt dat neer op $12.000 tot $50.000 per integratie.

Vermenigvuldig dat met meerdere tools in de stack. Voeg daar vervolgens het doorlopende onderhoud aan toe, naarmate API's veranderen en de vereisten evolueren. De overhead voor integratie kan gemakkelijk oplopen tot 15-251 TP3T aan totale evaluatiekosten.

Audits op het gebied van naleving en beveiliging

Particuliere LLM-opleidingen verwerken vaak gevoelige gegevens. Zorgverleners behandelen medische gegevens. Financiële instellingen verwerken persoonsgegevens en transactiegegevens. Overheidsinstanties beheren vertrouwelijke informatie.

Evaluatie-infrastructuur moet voldoen aan dezelfde beveiligings- en compliance-normen als productiesystemen. Dat betekent beveiligingsaudits, penetratietesten, compliance-documentatie en mogelijk een dedicated infrastructuur met air-gapped deployment.

Beveiligingsaudits voor AI-systemen variëren van $25K voor basisbeoordelingen tot $200K+ voor uitgebreide evaluaties van complexe implementaties. Continue nalevingsmonitoring voegt daar jaarlijks $10K-$50K aan toe, afhankelijk van de wettelijke vereisten.

Platform versus zelfhosting: vergelijking van de totale eigendomskosten

De beslissing om een evaluatie-infrastructuur zelf te bouwen of aan te schaffen, omvat meer dan alleen het vergelijken van platformabonnementskosten met infrastructuurkosten.

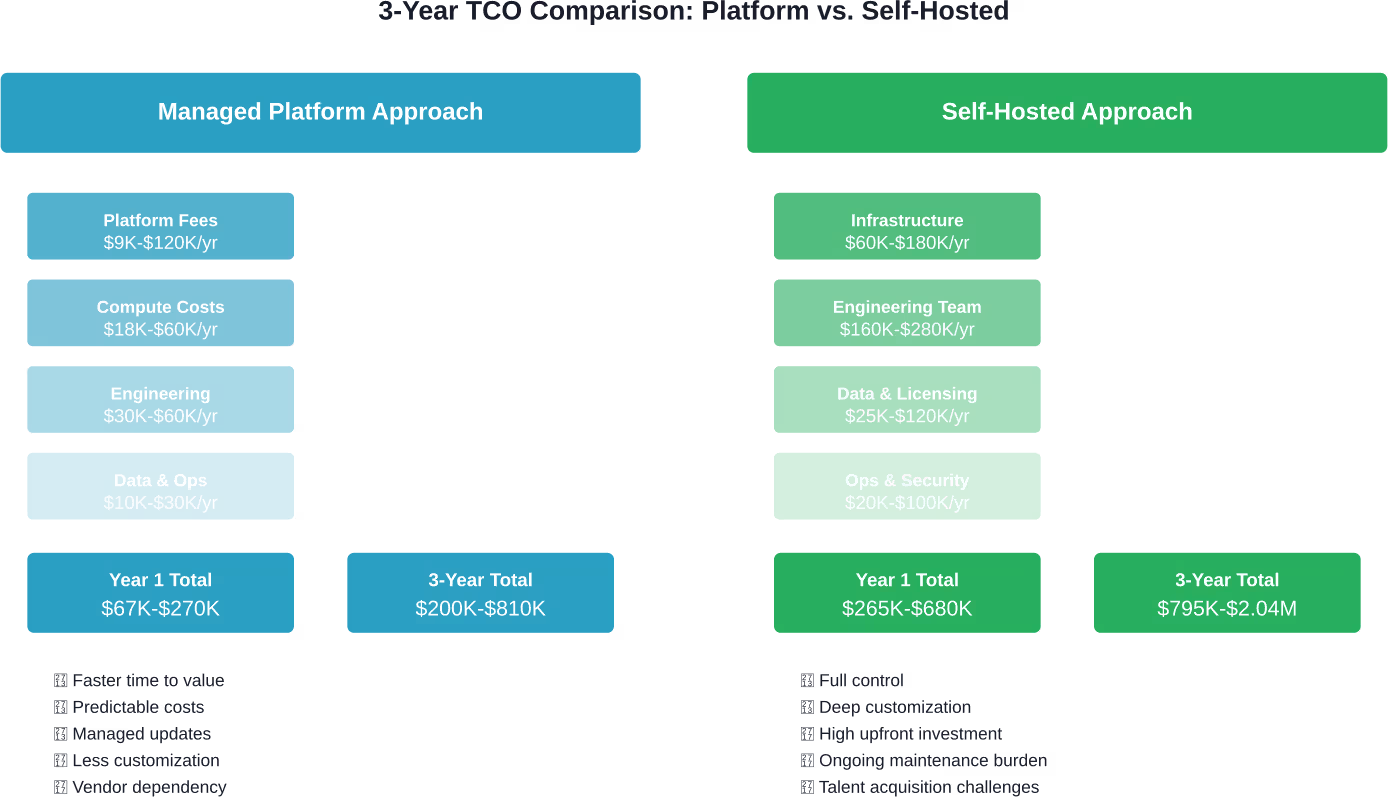

De totale eigendomskosten (TCO) omvatten directe kosten (platformen, rekenkracht, licenties), personeelskosten (engineering, operations, specialistische expertise), opportuniteitskosten (tijd tot waardecreatie, snelheid van feature-ontwikkeling) en risicokosten (evaluatiefouten die leiden tot productiefouten).

De beheerde platformaanpak resulteert in lagere kosten in het eerste jaar ($67K-$270K versus $265K-$680K) en aanzienlijk lagere totale eigendomskosten over drie jaar ($200K-$810K versus $795K-$2.04M). De zelfgehoste aanpak vereist een investering die 3 tot 4 keer zo hoog is voor vergelijkbare functionaliteit.

Maar die cijfers vertellen slechts een deel van het verhaal. Platformbenaderingen leveren sneller resultaten op – vaak binnen weken in plaats van maanden. Zelfgehoste oplossingen bieden meer mogelijkheden voor maatwerk voor organisaties met unieke behoeften waaraan platformen niet kunnen voldoen.

Wanneer platformabonnementen zinvol zijn

Beheerde platforms zijn het meest geschikt voor teams die snel uitgebreide evaluatiemogelijkheden nodig hebben, beperkte expertise op het gebied van machine learning-infrastructuur in huis hebben, voorspelbare operationele kosten willen of op kleine tot middelgrote schaal opereren waar platformbeperkingen geen belemmering vormen.

Het economische kader voor de evaluatie van taalmodellen suggereert dat de focus moet liggen op de kosten per geslaagd resultaat – hoeveel het kost om een correct resultaat te behalen. Platformen blinken hierin uit voor de meeste organisaties, omdat ze de benodigde technische overhead voor betrouwbare evaluatieresultaten verlagen.

Wanneer zelfhosting noodzakelijk wordt

Een zelfgehoste infrastructuur is zinvol wanneer de evaluatievereisten de mogelijkheden van het platform overstijgen, de gevoeligheid van de gegevens het gebruik van externe diensten verhindert, het evaluatievolume de platformkosten onbetaalbaar zou maken, of diepgaande aanpassingen nodig zijn voor eigen architecturen of evaluatieprotocollen.

Organisaties in gereguleerde sectoren (gezondheidszorg, financiën, overheid) hebben vaak geen andere keuze. Vereisten op het gebied van databeheer schrijven implementatie op locatie of in een private cloud voor, met volledige controle over datastromen en toegangspatronen.

Strategieën voor kostenoptimalisatie bij de evaluatie van LLM-programma's

Ongeacht de keuze tussen een platform of een zelfgehoste omgeving, zijn er verschillende strategieën die de evaluatiekosten verlagen zonder dat dit ten koste gaat van de kwaliteit.

Gefaseerde evaluatiemethoden

Niet elke codewijziging hoeft volledig geëvalueerd te worden. Implementeer een gelaagde teststrategie: snelle rooktests bij elke commit (minuten, minimale kosten), evaluatie van gemiddelde diepte bij pull requests (uren, gemiddelde kosten) en uitgebreide evaluatie bij releasekandidaten (dagen, volledige kosten).

Deze aanpak verlaagt de rekenkosten met 60-70% in vergelijking met het uitvoeren van een uitgebreide evaluatie bij elke wijziging, terwijl de meeste problemen vroegtijdig worden opgespoord wanneer ze goedkoper te verhelpen zijn.

Efficiënte benchmarkselectie

Een onderzoek naar benchmarks voor grote taalmodellen identificeert 283 representatieve benchmarks, wat de alomvattende aanpak van het vakgebied voor de evaluatie van LLM's aantoont. In plaats van alle beschikbare benchmarks uit te voeren, selecteer je de 8-10 die het meest relevant zijn voor specifieke gebruikssituaties. Valideer de selectie van deze subset elk kwartaal om ervoor te zorgen dat de dekking toereikend blijft naarmate de modellen zich ontwikkelen.

Hybride evaluatiestrategieën

Combineer platformservices voor het testen van standaardfunctionaliteiten met aangepaste, zelfgehoste evaluatie voor domeinspecifieke vereisten. Platforms verwerken de standaard evaluatiewerkzaamheden efficiënt. De interne infrastructuur biedt oplossingen voor de gespecialiseerde 20%-vereisten die platforms niet kunnen afdekken.

Deze hybride aanpak kost doorgaans 30-40% minder dan pure zelfhosting, terwijl de noodzakelijke aanpassingsmogelijkheden behouden blijven.

Optimalisatie van computerbronnen

Evaluatieworkloads kennen pieken en dalen. Spot-instances en preemptible VM's kunnen de GPU-kosten in de cloud met 60-80% verlagen voor evaluatieworkloads die onderbrekingen en herstarts tolereren.

Voor teams met een constant evaluatievolume bieden gereserveerde instanties 40-50%-kortingen ten opzichte van de prijsstelling op aanvraag. Het risico van het niet nakomen van verplichtingen neemt af, omdat evaluatie een vast onderdeel wordt van de ontwikkelingsworkflows in plaats van een incidentele activiteit.

Zorg ervoor dat de LLM-evaluatie de kosten waard is, en niet zomaar een extra kostenpost.

Particuliere evaluaties van LLM-modellen kunnen snel duur worden, vooral wanneer de toetsing losstaat van de manier waarop het model daadwerkelijk is opgebouwd en gebruikt. AI Superieur Ze beschouwen evaluatie als onderdeel van de volledige levenscyclus van het model – niet als een aparte servicelaag. Hun werk omvat het bouwen en verfijnen van modellen, het opzetten van validatiepipelines en het afstemmen van evaluatie op reële gebruiksscenario's. Dit helpt overmatig testen te voorkomen, vermindert overbodige benchmarks en zorgt ervoor dat evaluatie gekoppeld blijft aan prestaties die er in productie daadwerkelijk toe doen.

De meeste evaluatiekosten lopen op wanneer testen herhaaldelijk worden uitgevoerd zonder dat het systeem zelf verbetert. Wanneer evaluatie is geïntegreerd in de ontwikkelings- en implementatiefase, resulteert dit in minder testcycli en duidelijkere resultaten. Wilt u van evaluatie iets maken dat uw model daadwerkelijk verbetert in plaats van het alleen maar te meten? Neem dan contact met ons op. AI Superieur en bekijk eens goed hoe je huidige configuratie is opgebouwd.

Praktische prijsvoorbeelden en casestudies

Abstracte kostenbereiken worden duidelijker met concrete scenario's.

Klein team: interne chatbot

Een startup met 15 medewerkers bouwt een interne kennisbank-chatbot met behulp van een verfijnd 7B-parametermodel. Evaluatie is nodig op basis van nauwkeurigheidstesten met bedrijfsspecifieke vragen, veiligheidscontroles en prestatiebewaking.

Aanpak: Braintrust Pro-platform ($249/maand, bevestigde prijs) plus het creëren van een aangepaste evaluatiedataset (eenmalige schatting van $15K) plus 0,25 FTE engineeringtijd (geschatte $40K/jaar).

Totale kosten eerste jaar: $58K. Doorlopende jaarlijkse kosten: $43K.

Middelgroot bedrijf: AI voor klantenservice

Een SaaS-bedrijf met 200 medewerkers implementeert een model met 13 miljard parameters voor de automatisering van de klantenservice. Evaluatievereisten omvatten nauwkeurigheid, gepastheid van de toon, detectie van hallucinaties en A/B-testen ten opzichte van basismodellen.

Aanpak: Middelgroot platform ($2.500/maand) plus gemiddelde GPU-resources voor zelfgehoste gespecialiseerde tests ($4K/maand) plus aangepaste domeindataset ($35K) plus 1,5 FTE specialisten ($180K/jaar).

Totale kosten eerste jaar: $293K. Doorlopende jaarlijkse kosten: $258K.

Bedrijfsvoering: Implementatie in gereguleerde sectoren

Een financiële dienstverlener met 5.000 werknemers bouwt een 30B-parametermodel voor ondersteuning bij beleggingsonderzoek. Wettelijke voorschriften vereisen implementatie op locatie, uitgebreide auditsporen en validatie door derden.

Aanpak: Eigen infrastructuur op dedicated hardware ($180K/jaar GPU-kosten) plus 3 FTE-team ($450K/jaar) plus commerciële datasets en licenties ($80K/jaar) plus beveiligingsaudits ($50K/jaar) plus externe validatiediensten ($40K/jaar).

Totale kosten in het eerste jaar: $800K. Doorlopende jaarlijkse kosten: $800K (plus grote infrastructuurupgrades om de 3 jaar).

Deze scenario's illustreren hoe de kosten schalen met de omvang van de organisatie, de complexiteit van het model en de wettelijke vereisten. Het voorbeeld van de grote onderneming kost 14 keer meer dan het kleine team, maar bedient 333 keer meer gebruikers in een sterk gereguleerde omgeving.

De verborgen economie van 'gratis' open-source evaluatie

Open-source evaluatietools voor LLM-programma's beloven veel: geen softwarelicentiekosten. De realiteit is echter duurder.

De uitdaging zit hem niet in de tools zelf. Lighteval, de evaluatiebibliotheken van Hugging Face en vergelijkbare frameworks werken prima. De uitdaging zit hem in alles eromheen: de infrastructuur om ze te draaien, de expertise om ze effectief te gebruiken, het onderhoud om ze actueel te houden en de integratie om ze bruikbaar te maken.

Discussies binnen de community benadrukken dit verschil steeds weer. Teams gaan ervan uit dat open source ook gratis betekent. Ze komen er pas achter dat dit niet het geval is wanneer ze zes maanden bezig zijn met een project waarin 14.150.000 dollar aan ontwikkeltijd is geïnvesteerd en ze nog steeds moeite hebben om betrouwbare evaluatieresultaten te verkrijgen.

Het patroon is als volgt: download een open-source evaluatieframework (gratis), besteed 2 weken aan het uitzoeken van de documentatie (ontwikkelingskosten), besteed 1 maand aan het bouwen van de infrastructuur (ontwikkelings- en cloudkosten), besteed 2 maanden aan het oplossen van integratieproblemen (ontwikkelingskosten) en besteed voortdurende tijd aan het onderhouden van de frameworks naarmate ze evolueren (permanente ontwikkelingskosten).

Dat 'gratis' framework kostte in het eerste jaar tussen de $80K en $120K. Voor veel organisaties zou het betalen van $3K tot $10K voor een beheerd platform betere resultaten sneller en tegen lagere totale kosten hebben opgeleverd.

Wanneer open source daadwerkelijk geld bespaart

Open-source evaluatietools zijn in specifieke scenario's economisch zinvol: wanneer teams al interne expertise hebben op het gebied van machine learning-infrastructuur, de evaluatievereisten zeer specialistisch zijn en platforms daar niet aan kunnen voldoen, het evaluatievolume de platformkosten extreem hoog zou maken, of organisaties ideologische of strategische verplichtingen hebben ten aanzien van open-source technologieën.

Maar zelfs in die scenario's spelen de operationele kosten een belangrijke rol. De kostenstructuur verschuift van platformkosten naar personeel en infrastructuur, maar de totale uitgaven dalen zelden zo sterk als de eerste analyses doen vermoeden.

Prijsontwikkelingen en toekomstige kostenvoorspellingen

De markt voor LLM-evaluaties is nog in de kinderschoenen en de prijzen zijn volatiel. Verschillende trends bepalen de toekomstige kostenontwikkeling.

Toenemende concurrentie zorgt voor lagere platformprijzen.

Er komen maandelijks meer aanbieders bij op de markt voor evaluatieplatformen. Concurrentie zorgt er doorgaans voor dat de prijzen dalen en de functionaliteit toeneemt. Het instapabonnement van $249/maand uit 2025 zou in 2027 kunnen dalen naar $149/maand, terwijl er tegelijkertijd functionaliteiten worden toegevoegd die voorheen alleen beschikbaar waren in bedrijfsabonnementen.

Onderzoek naar kostenberekeningen laat zien dat de kosten voor het behalen van een bepaalde certificeringsgrens in de loop der tijd zijn gedaald met de introductie van nieuwe modellen. Duidelijke economische inzichten tonen aan dat lichtgewicht modellen het meest kosteneffectief zijn voor basistaken. Evaluatiediensten zullen naar verwachting een vergelijkbare prijsontwikkeling doormaken.

Infrastructuurkosten blijven hardnekkig hoog.

De kosten van GPU's zijn, ondanks jarenlange voorspellingen, niet significant gedaald. Cloudproviders behouden hoge marges op GPU-instanties. Het oligopolie van hyperscalers verhindert agressieve prijsconcurrentie.

Verwacht op korte termijn geen significante verlaging van de infrastructuurkosten voor zelfgehoste evaluatieomgevingen. Efficiëntiewinsten door betere software zouden de rekenkosten van 10-151 TP3T kunnen compenseren, maar de economische haalbaarheid van hardware blijft een uitdaging.

Specialisatie leidt tot hogere prijsniveaus.

Generieke evaluatieplatforms zullen een standaardproduct worden en concurrerende prijzen hanteren. Gespecialiseerde diensten voor gereguleerde sectoren, domeinspecifieke evaluaties of geavanceerde mogelijkheden zoals vijandige testen zullen hun premium prijsniveau behouden.

Verwacht marktsegmentatie: standaardplatformen voor $200-$500/maand, professionele platformen voor $2K-$5K/maand en gespecialiseerde diensten voor $10K+/maand of prijsstelling op maat voor projecten.

Veelgestelde vragen

Wat zijn de gemiddelde kosten van particuliere evaluatiediensten voor LLM-titels?

Evaluatiediensten op platformbasis kosten doorgaans tussen de $249 per maand voor instapabonnementen en meer dan $10.000 per maand voor grootschalige implementaties. De kosten voor een zelfgehoste evaluatie-infrastructuur liggen tussen de $125.000 en $190.000 per jaar voor minimale implementaties en tussen de $500.000 en $820.000 per jaar voor middelgrote productiesystemen. De totale kosten zijn afhankelijk van de omvang van het model, de evaluatiefrequentie, de expertise van het team en de gekozen infrastructuur.

Zijn open-source LLM-evaluatietools echt gratis?

De software zelf is gratis, maar de operationele kosten zijn aanzienlijk. Zelfs minimale, zelfgehoste implementaties met open-source tools kosten jaarlijks meer dan 1.400.000 euro, inclusief infrastructuur, engineeringtalent, datalicenties en onderhoud. Organisaties moeten budgetteren voor GPU-resources, expertise op het gebied van machine learning, het creëren van datasets en de doorlopende operationele overhead. De "gratis" software is in totaal vaak duurder dan betaalde platforms.

Wat zijn de kosten voor het evalueren van een model met 70B-parameters?

Voor het evalueren van grote modellen met 70 miljard parameters zijn doorgaans 4 tot 8 krachtige GPU's nodig, met maandelijkse kosten van $3.000 tot $8.000 alleen al voor rekenkracht. Daar komen nog platformkosten ($2.500 tot $5.000 per maand) of de benodigde technische expertise voor een zelfgehoste infrastructuur (2-3 FTE à $300.000 tot $450.000 per jaar) bij, evenals aangepaste datasets ($35.000 tot $70.000) en doorlopend onderhoud. De totale kosten voor het eerste jaar voor een uitgebreide evaluatie van een model met 70 miljard parameters variëren van $150.000 tot $400.000, afhankelijk van de diepte en frequentie van de evaluatie.

Welke factoren hebben de grootste invloed op de evaluatiekosten van een LLM-examen?

De grootte en architectuur van het model zijn de belangrijkste factoren die van invloed zijn op de kosten. Grotere modellen vereisen meer GPU's en langere evaluatietijden. Ook de frequentie en diepte van de evaluatie spelen een belangrijke rol: continue evaluatie kost 5 tot 10 keer meer dan wekelijkse tests. De expertise van het team is van invloed op de kosten, omdat ervaren evaluatoren efficiënter werken en betere tools kiezen. Beslissingen over de infrastructuur (platform versus zelfhosting) leiden tot kostenverschillen van 3 tot 4 keer voor vergelijkbare functionaliteiten.

Is het goedkoper om evaluatieplatforms te gebruiken of om een eigen infrastructuur te bouwen?

Platformen zijn voor de meeste organisaties goedkoper. De totale eigendomskosten (TCO) van een platform over een periode van drie jaar variëren van $200K tot $810K, vergeleken met $795K tot $2,04M voor zelfgehoste infrastructuur met vergelijkbare mogelijkheden. Platformen bieden een snellere time-to-value en vereisen minder specialistische expertise. Zelfgehoste infrastructuur is alleen economisch zinvol wanneer het evaluatievolume de platformlimieten overschrijdt, databeheer externe diensten verhindert of er zeer specifieke evaluatievereisten bestaan waaraan platforms niet kunnen voldoen.

Hoe kunnen organisaties de evaluatiekosten voor LLM-programma's verlagen zonder in te boeten aan kwaliteit?

Implementeer gelaagde evaluatiestrategieën met snelle rooktests bij elke wijziging en uitgebreide tests alleen bij releases, waardoor de rekenkosten met 60-701 TP3T worden verlaagd. Selecteer efficiënte benchmarksubsets in plaats van uitputtende testsuites uit te voeren. Gebruik hybride benaderingen die platformservices combineren voor standaardtests met gerichte, zelfgehoste evaluatie voor specifieke behoeften. Optimaliseer rekenresources door middel van spot-instances (besparing van 60-801 TP3T) of gereserveerde instances (besparing van 40-501 TP3T) voor consistente workloads. Richt de engineeringinspanning op waardevolle, op maat gemaakte evaluaties in plaats van het opnieuw opbouwen van standaardfunctionaliteiten.

Schalen de evaluatiekosten lineair met de modelgrootte?

Nee, de evaluatiekosten schalen niet lineair. Een model met 70 miljard parameters kost niet twee keer zoveel om te evalueren als een model met 35 miljard parameters; het kost doorgaans 3 tot 5 keer meer vanwege de hogere GPU-vereisten, langere evaluatietijden en de complexiteit van de infrastructuur. Zeer grote modellen (100 miljard of meer parameters) vereisen gespecialiseerde infrastructuur en technieken, wat extra kosten met zich meebrengt. De relatie tussen parameters en kosten versnelt in plaats van lineair te verlopen.

De economische beslissing nemen

De kosten van particuliere LLM-evaluatiediensten variëren met een factor twee, afhankelijk van de aanpak, de schaal en de vereisten. Kleine teams kunnen beginnen met platformoplossingen voor minder dan 1 tot 4 tot 5 duizend dollar per jaar. Grote ondernemingen met specialistische behoeften kunnen jaarlijks 1 tot 4 tot 1 miljoen dollar of meer uitgeven aan een uitgebreide evaluatie-infrastructuur.

De economische beslissing hangt af van drie factoren: de vereiste diepte en frequentie van de evaluatie, de beschikbare interne expertise en het strategische belang van de evaluatiemogelijkheden.

Voor de meeste organisaties bieden beheerde platforms de beste economische voordelen. Lagere investeringskosten vooraf, een snellere return on investment en voorspelbare kosten wegen op tegen de flexibiliteitsvoordelen van zelfgehoste infrastructuur. De uitzondering? Organisaties met werkelijk unieke eisen, een enorm evaluatievolume of wettelijke beperkingen die externe diensten uitsluiten.

Maar hier komt het echte inzicht: evaluatiekosten moeten worden afgewogen tegen de kosten van een mislukking. Het in productie nemen van een defecte AI-functie kan het klantvertrouwen schaden, problemen met de regelgeving opleveren of de merkreputatie beschadigen. Die kosten vallen in het niet bij de evaluatiekosten.

De vraag is niet óf er in evaluatie geïnvesteerd moet worden, maar hoeveel er nodig is voor het risicoprofiel. Een chatbot voor klantenservice zou bijvoorbeeld $50K per jaar aan evaluatie kunnen rechtvaardigen. Een medisch diagnosesysteem zou $500K nodig kunnen hebben. Een beslissingssysteem voor autonome voertuigen zou $5M+ kunnen vereisen.

Stem de investering in evaluatie af op de ernst van de gevolgen. Bezuinigen op evaluatie om vandaag geld te besparen, leidt vaak tot exponentieel hogere kosten morgen wanneer er productiestoringen optreden.

Bent u klaar om een rigoureuze LLM-evaluatie te implementeren? Begin dan met het beoordelen van de huidige volwassenheid van de evaluatie, het identificeren van de lacunes tussen de huidige en de vereiste mogelijkheden, en het berekenen van de werkelijke kosten van mislukte evaluaties in specifieke gebruiksscenario's. Deze analyse maakt de keuze tussen een platform en een zelfgehoste oplossing duidelijk en rechtvaardigt de noodzakelijke investering voor belanghebbenden.