Résumé rapide : Datadog LLM Observability offre une surveillance complète des applications d'IA avec des indicateurs sur l'utilisation des jetons, la latence et les taux d'erreur. Cependant, sa tarification est complexe et basée sur le volume de données ingérées. Les équipes peuvent s'attendre à ce que les coûts évoluent en fonction du volume de requêtes et des besoins de conservation des données. Il est donc essentiel de surveiller l'utilisation grâce aux fonctionnalités de gestion des coûts de Datadog et de configurer des alertes pour éviter les dépassements.

Le déploiement de modèles de langage à grande échelle a explosé ces deux dernières années. Cette explosion s'accompagne d'un nouveau défi opérationnel : comment les équipes peuvent-elles superviser ces charges de travail d'IA sans se ruiner ?

Datadog s'est lancé dans l'observabilité des modèles de vie pour répondre précisément à ce problème. Sa plateforme promet une visibilité complète sur les performances des modèles, l'utilisation des jetons et la qualité des applications. Mais voilà : comprendre le coût réel de cette fonctionnalité nécessite de se familiariser avec le modèle de tarification complexe de Datadog.

Ce guide détaille la structure des coûts de Datadog LLM Observability, explique les principaux facteurs de tarification et propose des stratégies pratiques pour maîtriser les dépenses tout en maintenant la visibilité exigée par les applications d'IA modernes.

Comprendre la structure tarifaire de Datadog LLM Observability

Datadog ne publie pas de prix distinct pour LLM Observability sur sa page de tarification publique. Le modèle de coût est en effet directement lié à son infrastructure APM (Application Performance Monitoring), dont la facturation est basée sur les segments ingérés.

D'après la documentation officielle de Datadog, LLM Observability génère des métriques calculées à partir de 1 001 000 bits/s de trafic applicatif. Ces métriques enregistrent le nombre de spans, le nombre d'erreurs, l'utilisation des jetons et les mesures de latence. La métrique ml_obs.span suit le nombre total de spans avec des étiquettes relatives à l'environnement, au nom du modèle, au fournisseur du modèle, au service et au type de span.

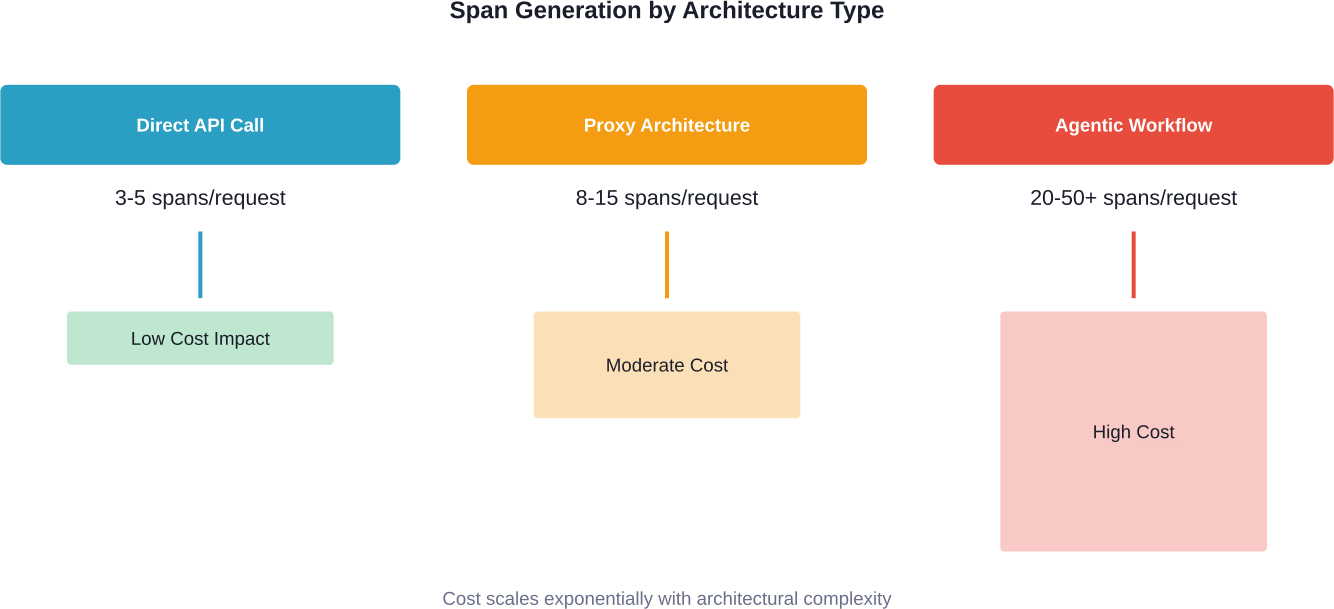

Chaque requête LLM génère généralement plusieurs spans : un pour la requête globale, et des spans supplémentaires pour le prétraitement, l’invocation du modèle, le post-traitement et les appels d’outils. Le volume de spans influe directement sur les coûts, car la tarification APM de Datadog est proportionnelle au volume de données ingérées et indexées.

Composantes de base de la tarification

Les équipes déployant LLM Observability sont confrontées à plusieurs facteurs de coûts :

- Volume d'ingestion de spans basé sur le débit des requêtes

- Durées de conservation des données (conservation standard vs. conservation étendue)

- Métriques personnalisées dérivées des données de traçage

- Surveillance de l'infrastructure des ressources de calcul sous-jacentes

- Ingestion des journaux en cas de capture des charges utiles de requêtes/réponses LLM

Le problème ? Dans les environnements conteneurisés ou de microservices, les coûts peuvent augmenter plus rapidement que prévu. Comme le souligne une analyse, le modèle de tarification de Datadog, basé sur l’hôte, “ peut paraître obsolète et pénalisant ” dans les environnements cloud dynamiques où le nombre de conteneurs fluctue.

Quels sont les facteurs qui déterminent les coûts d'observabilité des LLM ?

Comprendre les facteurs de coûts permet aux équipes d'établir des budgets précis et d'identifier les opportunités d'optimisation. Voici ce qui influe réellement sur les dépenses de suivi LLM.

Génération du volume et de la durée des requêtes

Chaque appel à l'API LLM génère des traces. Une simple requête de complétion peut créer 3 à 5 traces. Les flux de travail complexes impliquant des agents, avec des appels d'outils, des étapes de récupération et des chaînes de raisonnement, peuvent facilement générer 20 à 50 traces par requête.

Prenons l'exemple d'une équipe traitant 1 million de requêtes LLM par jour. En considérant 5 spans par requête, cela représente 5 millions de spans quotidiennement, soit 150 millions par mois. À cette échelle, les coûts d'ingestion des spans s'accumulent rapidement.

Les architectures basées sur des proxys ajoutent une couche supplémentaire. Lorsque les équipes acheminent le trafic LLM via des passerelles comme LiteLLM ou des solutions de proxy personnalisées, chaque décision d'acheminement, chaque nouvelle tentative et chaque solution de repli génère des segments supplémentaires. Selon les recommandations de Datadog concernant la surveillance des proxys d'IA, les équipes doivent instrumenter les requêtes de proxy afin de suivre “ la sélection du modèle, la latence, les taux d'erreur et l'utilisation des jetons ”.”

Frais généraux liés au suivi de l'utilisation des jetons

Datadog enregistre le nombre de jetons sous forme de métadonnées de span. Pour les équipes traitant des milliards de jetons par mois, le stockage de ces données de télémétrie représente un volume considérable. La plateforme suit les jetons d'entrée et de sortie, ainsi que les métadonnées relatives au modèle, au fournisseur et aux paramètres de la requête.

Les données de jetons prennent toute leur importance pour l'optimisation des coûts. Les équipes peuvent ainsi identifier les requêtes coûteuses, détecter les invites inefficaces ou repérer les schémas d'utilisation inattendus. Cependant, cette visibilité a pour inconvénient de nécessiter le stockage de données à forte cardinalité, potentiellement réparties sur des millions de requêtes.

Métriques et tableaux de bord personnalisés

Au-delà des indicateurs standard, les équipes créent souvent des tableaux de bord personnalisés regroupant les données de performance LLM. Chaque requête d'indicateur personnalisé, en particulier celles comportant des balises à forte cardinalité, engendre des coûts mensuels supplémentaires.

Les indicateurs personnalisés courants incluent le coût par session utilisateur, le nombre moyen de jetons par type de requête, les taux d'erreur par version de modèle et les percentiles de latence par région géographique. Ils fournissent des informations cruciales pour l'entreprise, mais nécessitent une gestion rigoureuse afin d'éviter une explosion des coûts.

Gestion des coûts Datadog pour les charges de travail LLM

Datadog propose des outils spécialement conçus pour aider les équipes à suivre et à maîtriser leurs dépenses en matière d'observabilité. Pour les charges de travail LLM, ces fonctionnalités deviennent essentielles.

La fonctionnalité Datadog Costs de Cloud Cost Management offre une visibilité sur les dépenses liées à l'observabilité. D'après la documentation officielle, les équipes doivent disposer des autorisations billing_read et usage_read pour accéder au détail des coûts. Seul Cloud Cost Management affiche les coûts réels basés sur l'utilisation, tandis que la page Plan et Utilisation présente des estimations mensuelles au prorata.

Configuration des alertes d'utilisation des jetons

Une stratégie pratique de maîtrise des coûts consiste à configurer des alertes d'utilisation des jetons. Comme l'explique le guide de surveillance des proxys de Datadog, les équipes peuvent “ définir un quota "souple" qui déclenche une notification lorsque la limite est atteinte, et un quota "strict" pour éviter tout dépassement ‘.’

Ce système d'alerte à deux niveaux évite les factures surprises. L'alerte préliminaire donne aux équipes le temps d'analyser les pics de consommation, tandis que la limite maximale empêche les coûts de s'envoler.

Stratégies d'échantillonnage de traces

Toutes les traces ne nécessitent pas d'être conservées. Les équipes peuvent mettre en œuvre un échantillonnage intelligent pour réduire les coûts tout en maintenant la signification statistique pour l'analyse des performances.

L'échantillonnage basé sur le début prend des décisions dès l'initialisation du traçage : par exemple, échantillonner 10% de toutes les requêtes. L'échantillonnage basé sur la fin est plus intelligent : il conserve toutes les traces d'erreurs et les requêtes lentes, mais n'échantillonne qu'un pourcentage des requêtes rapides réussies. Cette approche préserve les données de débogage les plus précieuses tout en réduisant les coûts de stockage.

Datadog prend en charge les deux approches grâce à des contrôles d'ingestion et des filtres de rétention. L'essentiel est de configurer des règles adaptées aux besoins de débogage de l'équipe sans payer pour la conservation exhaustive des requêtes courantes et réussies.

| Stratégie d'échantillonnage | Données conservées | Impact sur les coûts | Idéal pour |

|---|---|---|---|

| Rétention 100% | Toutes traces | coût le plus élevé | Applications de production critiques, exigences de conformité |

| Échantillonnage de tête (10%) | sous-ensemble aléatoire | Réduction 90% | Applications stables à volume élevé |

| Échantillonnage de la queue | Erreurs + requêtes lentes + exemple de comportement normal | Réduction 60-80% | La plupart des applications LLM de production |

| Erreur uniquement | Requêtes ayant échoué uniquement | Réduction 95% | Environnements de développement/préproduction sensibles aux coûts |

Comparaison des coûts d'observabilité de Datadog LLM avec les solutions alternatives

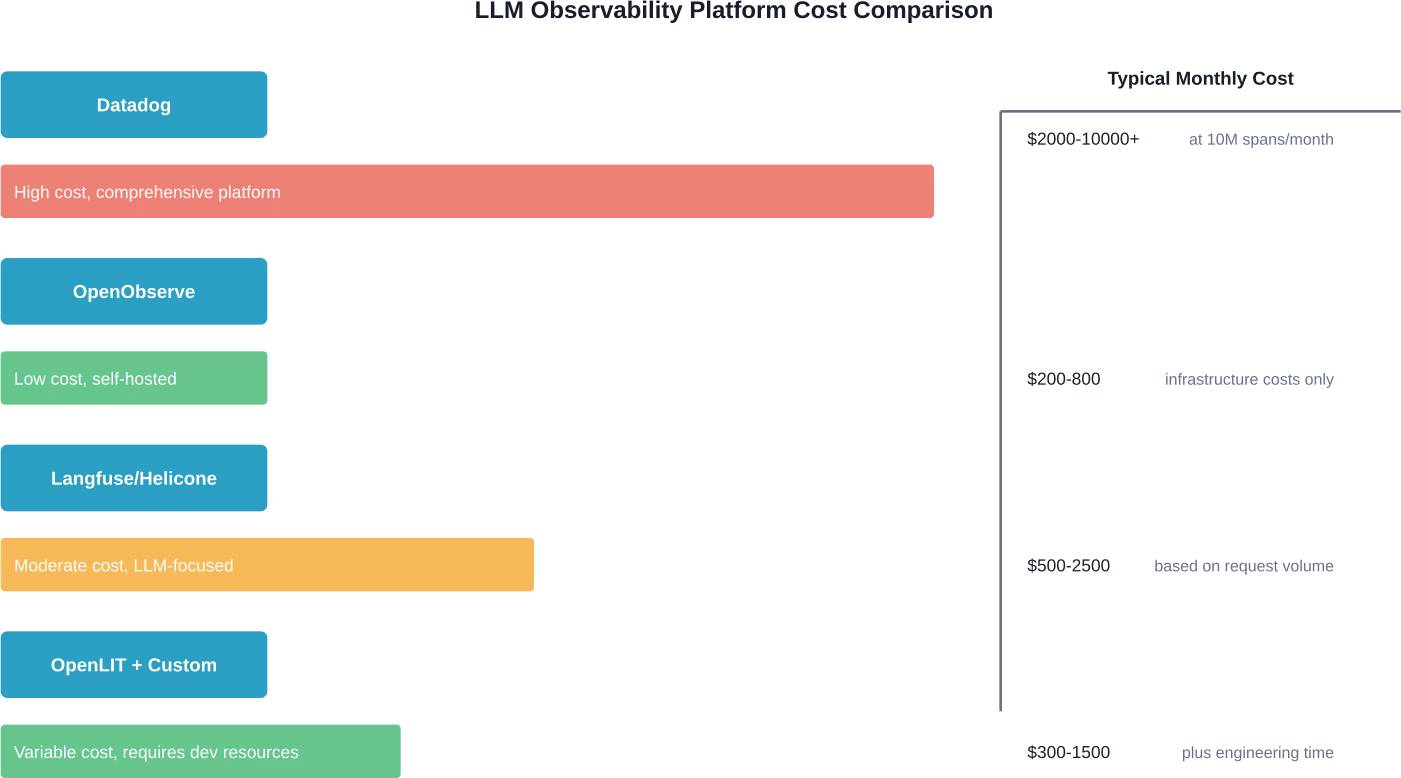

Datadog n'est pas le seul acteur du marché de l'observabilité LLM. Comprendre le contexte concurrentiel permet aux équipes d'évaluer si la tarification de Datadog est adaptée à leurs besoins.

Alternatives open source

OpenObserve est décrit comme “ une alternative économique à Datadog, Splunk et Elasticsearch, avec des coûts de stockage 140 fois inférieurs ”. La plateforme utilise un stockage S3 avec une architecture sans état, réduisant considérablement les coûts d'infrastructure par rapport au modèle de service géré de Datadog.

Parmi les autres solutions open source, on trouve OpenLIT, qui propose une surveillance basée sur OpenTelemetry, spécialement conçue pour les charges de travail LLM. Pour les équipes disposant de ressources d'ingénierie pour gérer l'infrastructure, ces alternatives peuvent générer des économies substantielles, mais au prix de frais d'exploitation plus importants.

Plateformes LLM spécialisées

Des plateformes comme Langfuse, Helicone et Arize offrent une observabilité spécifique aux architectures LLM avec des modèles de tarification plus simples. Nombre d'entre elles facturent en fonction des requêtes suivies plutôt que des métriques de l'infrastructure sous-jacente.

Le compromis ? Ces plateformes excellent dans la surveillance des cycles de vie des produits (LLM), mais ne proposent pas l’observabilité complète de l’infrastructure offerte par Datadog. Les équipes utilisant déjà Datadog pour la gestion des performances applicatives (APM) traditionnelle trouvent souvent un intérêt à consolider la surveillance des cycles de vie des produits au sein de la même plateforme, malgré des coûts potentiellement plus élevés.

Solutions intermédiaires et proxy

Des projets comme claude_telemetry illustrent une approche hybride : des wrappers OpenTelemetry légers qui enregistrent les appels d'outils, l'utilisation des jetons et les coûts vers différents systèmes de stockage, dont Datadog. La documentation du projet claude_telemetry indique que les données de télémétrie peuvent être envoyées à différents systèmes de stockage, dont Datadog.

Cette architecture dissocie l'instrumentation du backend, offrant ainsi aux équipes la possibilité de changer de fournisseur si les coûts de Datadog deviennent prohibitifs. Le coût de l'instrumentation est minime (uniquement la surcharge liée à l'interface), tandis que les coûts du backend évoluent en fonction du modèle tarifaire du fournisseur choisi.

Stratégies pratiques d'optimisation des coûts

La gestion des coûts de Datadog LLM Observability exige une attention constante et des choix de configuration judicieux. Voici des stratégies qui ont fait leurs preuves en environnement de production.

Optimiser les règles de routage des proxys

Lorsqu'on utilise des proxys LLM, les décisions de routage ont un impact direct sur les coûts. Une requête routée vers GPT-4 coûte nettement plus cher qu'une requête traitée par GPT-3.5 ou un modèle ouvert plus petit.

Les recommandations de Datadog concernant la surveillance des proxys préconisent de suivre les performances de la sélection des modèles. Si une règle de routage achemine le trafic vers un modèle coûteux sans amélioration des indicateurs de qualité, il est conseillé de “ rétablir la règle de routage vers un modèle plus rapide et moins onéreux ”. Cette visibilité au niveau des traces s'avère rentable en évitant l'utilisation inutile de modèles haut de gamme.

Mettre en œuvre la limitation du nombre de requêtes

Les boucles de requêtes incontrôlées ou une logique de nouvelle tentative inefficace peuvent faire exploser les coûts des fournisseurs LLM et les coûts d'observabilité. Les traces Datadog révèlent ces schémas grâce à l'analyse des étendues.

Les équipes doivent configurer la limitation du nombre de requêtes au niveau du proxy, avec des limites généreuses pour le trafic légitime et des plafonds stricts pour empêcher les abus ou les bogues de générer des millions de requêtes inutiles. Les données d'observabilité permettent de calibrer ces limites en fonction des habitudes d'utilisation réelles.

Discipline de gestion des balises

Les balises à cardinalité élevée augmentent considérablement les coûts de stockage des métriques. Des balises comme user_id, session_id ou request_id sur chaque span génèrent des volumes de données massifs.

Bonne pratique : utilisez des identifiants à forte cardinalité pour les traces (recherchables dans les données d’étendue), mais pas pour les étiquettes de métriques. Réservez les étiquettes de métriques aux attributs délimités tels que model_name, environment, service et error_type. Cela permet de conserver les capacités de débogage tout en maîtrisant la prolifération des métriques.

Capture sélective de la charge utile

La capture de l'intégralité des données de requête et de réponse LLM offre des possibilités de débogage considérables, mais consomme une quantité importante d'espace de stockage. Une seule conversation peut générer des centaines de kilo-octets de données enregistrées.

Approche stratégique : capturer automatiquement les données relatives aux erreurs et aux requêtes à latence élevée, mais échantillonner les requêtes réussies à un taux de 1 à 5%. Les équipes peuvent augmenter temporairement l’échantillonnage lors de l’investigation de problèmes spécifiques.

Réduisez les coûts d'observabilité avant qu'ils ne deviennent incontrôlables.

Les outils d'observabilité LLM comme Datadog sont utiles, mais ils ne corrigent pas les inefficacités sous-jacentes. La plupart des coûts proviennent de la manière dont le modèle est construit, paramétré et déployé, et non seulement de la manière dont il est surveillé. IA supérieure Ils interviennent en amont : sélection du modèle, préparation des données, optimisation et conception du déploiement, afin d’éviter de surcharger inutilement les pipelines d’observabilité ultérieurement. Leurs interventions couvrent généralement l’intégralité du cycle de vie, de la gestion des données à l’optimisation et à la mise en production.

Si vous vous préoccupez déjà des coûts d'observabilité, c'est le moment idéal pour prendre du recul et revoir l'architecture sous-jacente. Discutez-en avec IA supérieure, définissez ce qui doit réellement être suivi et construisez un système qui reste prévisible au lieu de devenir plus coûteux à chaque requête.

Scénarios de coûts réels

Combien les équipes dépensent-elles réellement pour Datadog LLM Observability ? Bien que les chiffres précis varient considérablement en fonction de l’échelle et de la configuration, certaines tendances se dégagent.

Application de production à petite échelle

Une startup traitant 500 000 requêtes LLM par mois, d'une complexité moyenne (7 spans par requête), génère environ 3,5 millions de spans. Avec une tarification APM standard, l'ingestion et la conservation des spans pourraient coûter entre $300 et $600 par mois.

Ajoutez la surveillance de l'infrastructure pour 10 à 20 conteneurs exécutant le service LLM, et la facture mensuelle atteint $800-1200. Ceci suppose une rétention standard et une utilisation modérée des métriques personnalisées.

Plateforme d'IA d'entreprise

Une grande organisation traitant 50 millions de requêtes LLM par mois avec des flux de travail complexes (en moyenne 25 segments par requête) génère 1,25 milliard de segments. Ce volume justifie le passage à l'offre Entreprise de Datadog.

Avec des tarifs négociés et un échantillonnage optimisé (conservation de 201 030 trous de traces), les coûts mensuels pourraient varier de 8 000 à 15 000 £ pour la seule observabilité LLM. Les dépenses totales de Datadog, incluant la surveillance de l'infrastructure, pourraient dépasser 30 000 £ par mois.

Développement et mise en scène

Les équipes ont souvent tendance à sur-instrumenter les environnements hors production. Un environnement de développement générant 5 millions de requêtes par mois avec une observabilité complète pourrait coûter entre $400 et 1TP800 — un investissement plus judicieux dans la visibilité en production.

Approche recommandée : utiliser un échantillonnage agressif (rétention de 5 à 101 TP3T) en environnement de développement/préproduction, en privilégiant la capture des erreurs plutôt qu’un traçage exhaustif. Cela permet de réduire les coûts de 80 à 901 TP3T tout en conservant les capacités de débogage.

| Type d'environnement | Demandes mensuelles | Stratégie d'échantillonnage | Coût mensuel estimé |

|---|---|---|---|

| Développement/Test | 5M | 10% + erreurs | $100-200 |

| Mise en scène | 10M | 20% + erreurs | $300-500 |

| Production (petite) | 500K-2M | 50-100% | $800-1500 |

| Production (moyenne) | 10M-25M | 30-50% | $3000-6000 |

| Production (entreprise) | Plus de 50 millions | 20-30% optimisé | $8000-15000+ |

Quand Datadog se justifie malgré des coûts plus élevés

Le prix élevé de Datadog n'est pas toujours un obstacle. Plusieurs situations justifient cet investissement.

Les organisations qui utilisent déjà Datadog pour la supervision de leur infrastructure et de leurs performances applicatives (APM) tirent un avantage considérable de l'ajout de l'observabilité LLM. Cette plateforme unifiée élimine les changements de contexte et met en corrélation les performances LLM avec les indicateurs d'infrastructure sous-jacents. En cas de ralentissement de la réponse d'un modèle, les équipes peuvent immédiatement vérifier l'utilisation du GPU, la latence réseau et les performances de la base de données, le tout depuis une interface unique.

Les entreprises soumises à des exigences de conformité complexes tirent profit des fonctionnalités d'audit, de contrôle d'accès et de conservation des données de Datadog. Les solutions open source alternatives ne proposent souvent pas les outils de gouvernance nécessaires aux secteurs réglementés.

Les équipes ne disposant pas de ressources dédiées à l'ingénierie de plateforme apprécient le service géré de Datadog. L'alternative, à savoir le déploiement et la maintenance d'une infrastructure d'observabilité open source, exige un investissement continu en ingénierie qui peut dépasser le coût d'un abonnement Datadog.

Questions fréquemment posées

Combien coûte réellement l'abonnement mensuel à Datadog LLM Observability ?

Datadog ne publie pas de tarification pour son service d'observabilité LLM autonome. Les coûts dépendent du volume d'ingestion des spans, qui varie selon le débit des requêtes et la complexité de l'application. Les petites applications peuvent consommer entre $ et $ par mois, tandis que les déploiements en entreprise dépassent généralement entre $ et 15 000. La tarification est adaptée aux taux d'ingestion des spans APM et aux besoins de surveillance de l'infrastructure.

Puis-je utiliser Datadog LLM Observability sans payer pour la version complète d'APM ?

Non. LLM Observability s'appuie sur l'infrastructure APM de Datadog et nécessite un abonnement APM actif. Le modèle de tarification au volume d'événements (span) signifie que les traces LLM sont comptabilisées dans le volume total d'événements APM ingérés. Les équipes ont besoin à la fois d'APM et des composants de surveillance de l'infrastructure qui prennent en charge l'application.

Quel est le moyen le plus économique de contrôler les coûts LLM en production ?

Pour un suivi basique des coûts, des solutions légères comme les compteurs de jetons dans le code applicatif ou la simple journalisation des requêtes vers S3 sont quasiment gratuites. Pour une observabilité complète, les plateformes open source telles qu'OpenLIT ou OpenObserve offrent les coûts d'infrastructure les plus bas, mais nécessitent un investissement en temps d'ingénierie pour leur déploiement et leur maintenance. Les alternatives gérées comme Langfuse proposent un tarif intermédiaire, adapté spécifiquement aux charges de travail LLM.

Datadog facture-t-il séparément les données d'utilisation des jetons ?

Le nombre de jetons est stocké en tant que métadonnées de span et n'entraîne pas de frais supplémentaires au-delà des coûts d'ingestion de span sous-jacents. Cependant, la création de métriques personnalisées basées sur l'utilisation des jetons (comme le nombre total de jetons par utilisateur ou type de requête) génère des coûts supplémentaires. Les équipes doivent surveiller l'utilisation des métriques personnalisées afin d'éviter des frais imprévus.

Comment puis-je estimer les coûts de Datadog LLM Observability avant le déploiement ?

Calculez le volume mensuel de requêtes prévu, estimez le nombre de requêtes par appel (3 à 5 pour les appels simples, 20 à 50 pour les agents complexes) et multipliez ces valeurs pour obtenir le nombre total de requêtes. Comparez ce résultat aux niveaux de tarification APM de Datadog. Ajoutez les coûts de surveillance de l'infrastructure pour les ressources de calcul exécutant l'application LLM. Prévoyez une marge de 20 à 301 TP3T pour la croissance et les variations d'utilisation imprévues.

Existe-t-il des différences de coûts entre les différents fournisseurs de services de suivi LLM ?

Les tarifs de Datadog sont fixes et ne dépendent pas du fournisseur LLM surveillé (OpenAI, Anthropic, etc.). Le coût est uniquement lié au volume de données d'observabilité : étendues, métriques et journaux générés par l'infrastructure de surveillance. Toutefois, les caractéristiques de réponse des différents fournisseurs peuvent varier, ce qui influe sur la complexité des traces et les besoins de stockage.

Que se passe-t-il si je dépasse mon budget Datadog en milieu de mois ?

Datadog ne coupe généralement pas le service en cours de mois, mais facture les dépassements. Les équipes doivent configurer des alertes d'utilisation via les fonctionnalités de gestion des coûts et définir des alertes de quota de jetons pour éviter les dépenses excessives. Le modèle de quota souple/strict recommandé par Datadog permet d'être averti avant d'atteindre les limites et peut bloquer les requêtes qui dépasseraient les budgets.

Faire le bon choix pour votre équipe

Datadog LLM Observability offre une visibilité optimale sur les performances des applications d'IA, l'économie des tokens et les indicateurs de qualité. Pour les équipes déjà présentes dans l'écosystème Datadog, l'ajout de la surveillance LLM permet de mettre en place une stratégie d'observabilité unifiée.

Cependant, ce modèle de coûts exige une gestion rigoureuse. Les volumes de données augmentent rapidement avec le débit des requêtes et la complexité de l'architecture. Sans stratégies d'échantillonnage disciplinées, une gestion efficace des balises et un suivi de l'utilisation, la facture peut grimper plus vite que la valeur ajoutée.

La décision repose en définitive sur trois facteurs : l’investissement existant chez Datadog, les ressources d’ingénierie disponibles pour les solutions alternatives et l’importance cruciale d’une observabilité unifiée à travers l’infrastructure et les charges de travail d’IA.

Pour les grandes entreprises aux déploiements complexes, l'offre premium de Datadog se justifie souvent. Pour les équipes plus petites ou celles qui possèdent de solides compétences en ingénierie de plateforme, les alternatives open source offrent une visibilité comparable à un coût bien moindre.

Quel que soit le chemin le plus judicieux, l'essentiel est de considérer les coûts d'observabilité comme une préoccupation de premier ordre : les surveiller, les optimiser et les justifier par les informations opérationnelles qu'ils permettent.

Prêt à démarrer la surveillance LLM ? Consultez la documentation officielle de Datadog pour connaître les fonctionnalités disponibles et contactez leur équipe commerciale pour obtenir un devis adapté à l’envergure et aux exigences de votre déploiement.