Kurzzusammenfassung: Datadog LLM Observability bietet umfassendes Monitoring für KI-Anwendungen mit Metriken zu Token-Nutzung, Latenz und Fehlerraten. Die Preisgestaltung ist jedoch komplex und basiert auf der Span-Erfassung. Teams müssen damit rechnen, dass die Kosten mit dem Anfragevolumen und dem Datenaufbewahrungsbedarf skalieren. Daher ist es entscheidend, die Nutzung mithilfe der Kostenmanagement-Funktionen von Datadog zu überwachen und Benachrichtigungen einzurichten, um Kostenüberschreitungen zu vermeiden.

Der Einsatz großer Sprachmodelle hat in den letzten zwei Jahren explosionsartig zugenommen. Mit dieser Explosion geht eine neue operative Herausforderung einher: Wie können Teams diese KI-Workloads überwachen, ohne dabei ihr Budget zu sprengen?

Datadog betrat den Markt für LLM-Observability, um genau dieses Problem zu lösen. Ihre Plattform verspricht umfassende Transparenz hinsichtlich Modellperformance, Token-Nutzung und Anwendungsqualität. Doch der Haken an der Sache ist: Um die tatsächlichen Kosten dieser Funktionalität zu verstehen, muss man sich durch Datadogs komplexes Preismodell kämpfen.

Dieser Leitfaden erläutert die Kostenstruktur von Datadog LLM Observability, erklärt die wichtigsten Preistreiber und bietet praktische Strategien zur Kostenkontrolle bei gleichzeitiger Aufrechterhaltung der Transparenz, die moderne KI-Anwendungen erfordern.

Datadog LLM Observability-Preisstruktur verstehen

Datadog veröffentlicht auf seiner öffentlichen Preisseite keinen separaten Preis für LLM Observability. Stattdessen ist das Kostenmodell direkt an seine APM-Infrastruktur (Application Performance Monitoring) gekoppelt, die auf Basis der erfassten Spans abrechnet.

Laut der offiziellen Datadog-Dokumentation generiert LLM Observability Metriken, die aus 100% Anwendungsdatenverkehr berechnet werden. Diese Metriken erfassen Span-Anzahlen, Fehleranzahlen, Token-Nutzung und Latenzzeiten. Die Metrik ml_obs.span verfolgt die Gesamtzahl der Spans mit Tags für Umgebung, Modellname, Modellanbieter, Dienst und Span-Typ.

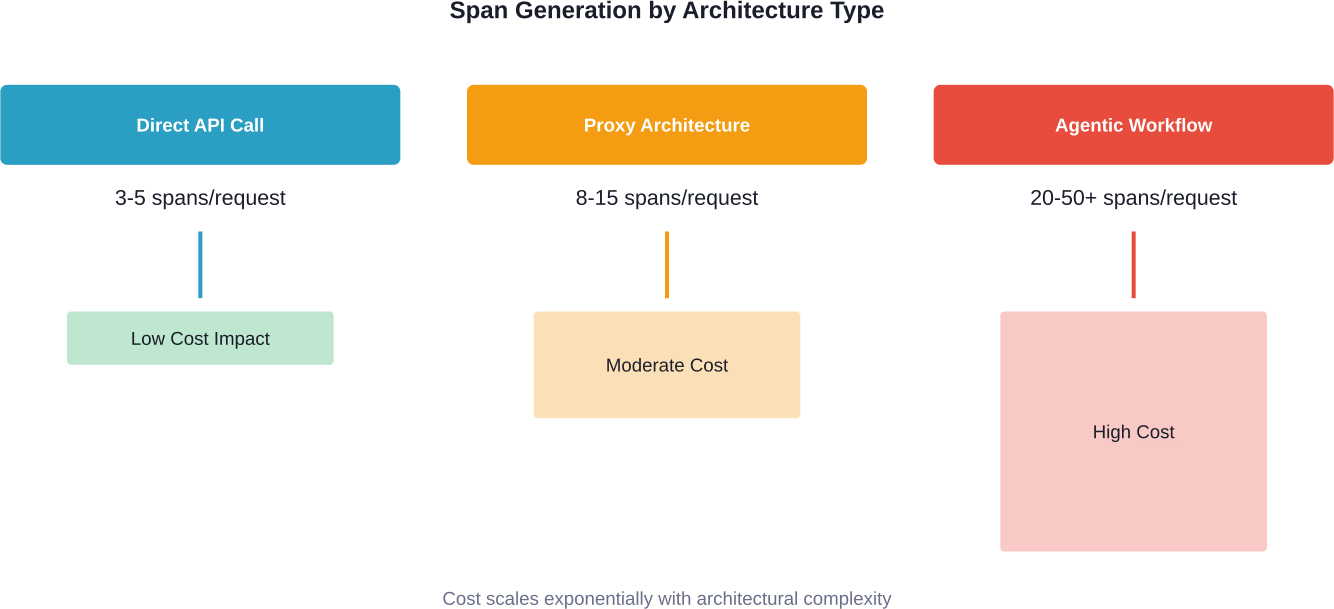

Jede LLM-Anfrage erzeugt typischerweise mehrere Spans – einen für die Gesamtanfrage, zusätzliche Spans für Vorverarbeitung, Modellaufruf, Nachbearbeitung und etwaige Tool-Aufrufe. Das Span-Volumen wirkt sich direkt auf die Kosten aus, da die APM-Preisgestaltung von Datadog mit der Menge der erfassten und indizierten Span-Daten skaliert.

Kernkomponenten der Preisgestaltung

Teams, die LLM Observability einsetzen, sehen sich mit mehreren Kostenfaktoren konfrontiert:

- Span-Aufnahmevolumen basierend auf dem Anfragedurchsatz

- Datenaufbewahrungsfristen (Standard- vs. verlängerte Aufbewahrung)

- Benutzerdefinierte Metriken, abgeleitet aus Tracedaten

- Infrastrukturüberwachung der zugrunde liegenden Rechenressourcen

- Protokollerfassung bei der Erfassung von LLM-Anfrage-/Antwortnutzdaten

Die Herausforderung? In containerisierten Umgebungen oder Microservices können die Kosten schneller steigen als erwartet. Wie eine Analyse feststellte, kann sich Datadogs hostbasiertes Preismodell in dynamischen Cloud-Umgebungen mit schwankenden Containeranzahlen “veraltet und zu teuer anfühlen”.

Was treibt die Kosten für die Beobachtbarkeit von LLM-Systemen an?

Das Verständnis der Kostentreiber hilft Teams, präzise zu budgetieren und Optimierungspotenziale zu erkennen. Hier erfahren Sie, was die Ausgaben für LLM-Monitoring tatsächlich beeinflusst.

Anforderungsvolumen und Spanngenerierung

Jeder LLM-API-Aufruf erzeugt Traces. Eine einfache Completion-Anfrage kann 3–5 Spans erzeugen. Komplexe agentenbasierte Workflows mit Tool-Aufrufen, Abrufschritten und Reasoning Chains hingegen können leicht 20–50 Spans pro Anfrage generieren.

Stellen Sie sich ein Team vor, das täglich 1 Million LLM-Anfragen verarbeitet. Bei konservativer Schätzung von 5 Spans pro Anfrage entspricht das 5 Millionen Spans täglich bzw. 150 Millionen monatlich. Die Kosten für die Span-Erfassung summieren sich bei diesem Umfang schnell.

Proxybasierte Architekturen fügen eine weitere Ebene hinzu. Wenn Teams den LLM-Datenverkehr über Gateways wie LiteLLM oder benutzerdefinierte Proxy-Lösungen leiten, erzeugt jede Routing-Entscheidung, jeder Wiederholungsversuch und jeder Fallback zusätzliche Spans. Laut Datadogs Leitfaden zur Überwachung von KI-Proxys sollten Teams Proxy-Anfragen instrumentieren, um “Modellauswahl, Latenz, Fehlerraten und Token-Nutzung” zu verfolgen.”

Overhead für die Token-Nutzungsverfolgung

Datadog erfasst Token-Zähler als Span-Metadaten. Für Teams, die monatlich Milliarden von Token verarbeiten, summiert sich die Speicherung dieser Telemetriedaten. Die Plattform verfolgt sowohl Eingabe- als auch Ausgabetoken sowie Metadaten zum Modell, Provider und den Anfrageparametern.

Token-Daten sind besonders wertvoll bei der Kostenoptimierung. Teams können teure Abfragen identifizieren, ineffiziente Eingabeaufforderungen erkennen oder unerwartete Nutzungsmuster aufspüren. Diese Transparenz hat jedoch den Nachteil, dass Daten mit hoher Kardinalität über potenziell Millionen von Anfragen gespeichert werden müssen.

Benutzerdefinierte Kennzahlen und Dashboards

Über die Standardkennzahlen hinaus erstellen Teams häufig benutzerdefinierte Dashboards, die LLM-Leistungsdaten aggregieren. Jede benutzerdefinierte Kennzahlenabfrage, insbesondere solche mit Tags hoher Kardinalität, erhöht die monatlichen Kosten.

Gängige benutzerdefinierte Metriken umfassen die Kosten pro Benutzersitzung, die durchschnittliche Anzahl an Tokens pro Abfragetyp, Fehlerraten nach Modellversion und Latenz-Perzentile nach geografischer Region. Diese liefern geschäftskritische Erkenntnisse, erfordern jedoch ein sorgfältiges Management, um unkontrollierte Kostensteigerungen zu vermeiden.

Datadog Kostenmanagement für LLM-Workloads

Datadog bietet Tools, die speziell dafür entwickelt wurden, Teams bei der Überwachung und Kontrolle ihrer Ausgaben für Observability zu unterstützen. Für LLM-Workloads sind diese Funktionen unerlässlich.

Die Datadog-Kostenfunktion in Cloud Cost Management bietet Einblick in die Ausgaben für Observability. Laut offizieller Dokumentation benötigen Teams die Berechtigungen billing_read und usage_read, um auf die Kostenaufschlüsselungen zugreifen zu können. Nur Cloud Cost Management zeigt die tatsächlichen nutzungsbasierten Kosten an, während die Seite „Plan & Nutzung“ anteilige monatliche Schätzungen anzeigt.

Token-Nutzungswarnungen einrichten

Eine praktische Strategie zur Kostenkontrolle besteht in der Konfiguration von Warnmeldungen zur Token-Nutzung. Wie die Anleitung von Datadog zur Proxy-Überwachung erläutert, können Teams “ein ‘weiches’ Kontingent festlegen, das bei Erreichen des Limits eine Benachrichtigung auslöst, und ein ‘hartes’ Kontingent, um eine Überschreitung zu verhindern.”

Dieses zweistufige Warnsystem verhindert unerwartete Rechnungen. Die sanfte Warnung gibt den Teams Zeit, Nutzungsspitzen zu untersuchen, während das feste Limit eingreift, bevor die Kosten explodieren.

Strategien zur Spurenprobenahme

Nicht jede Datenspur muss aufbewahrt werden. Teams können intelligente Stichprobenverfahren einsetzen, um Kosten zu senken und gleichzeitig die statistische Signifikanz für die Leistungsanalyse zu erhalten.

Head-basiertes Sampling trifft Entscheidungen beim Start der Trace-Erfassung – beispielsweise werden 10% aller Anfragen erfasst. Tail-basiertes Sampling ist intelligenter: Es speichert alle Fehlertraces und langsamen Anfragen, erfasst aber nur einen Prozentsatz der erfolgreichen schnellen Anfragen. Dieser Ansatz bewahrt die wichtigsten Debugging-Daten und reduziert gleichzeitig die Speicherkosten.

Datadog unterstützt beide Ansätze durch Erfassungssteuerung und Aufbewahrungsfilter. Der Schlüssel liegt darin, Regeln zu konfigurieren, die den Debugging-Anforderungen des Teams entsprechen, ohne für die umfassende Aufbewahrung routinemäßiger, erfolgreicher Anfragen bezahlen zu müssen.

| Stichprobenstrategie | Aufbewahrte Daten | Kostenauswirkungen | Am besten geeignet für |

|---|---|---|---|

| 100% Retention | Alle Spuren | Höchste Kosten | Kritische Produktionsanwendungen, Compliance-Anforderungen |

| Kopfprobenahme (10%) | Zufällige Teilmenge | 90%-Reduzierung | Anwendungen mit hohem Volumen und stabiler Stabilität |

| Tail Sampling | Fehler + langsame Anfragen + Beispiel für normale | 60-80% Reduzierung | Die meisten LLM-Produktionsanwendungen |

| Nur Fehler | Nur fehlgeschlagene Anfragen | 95%-Reduzierung | Kostensensible Entwicklungs-/Staging-Umgebungen |

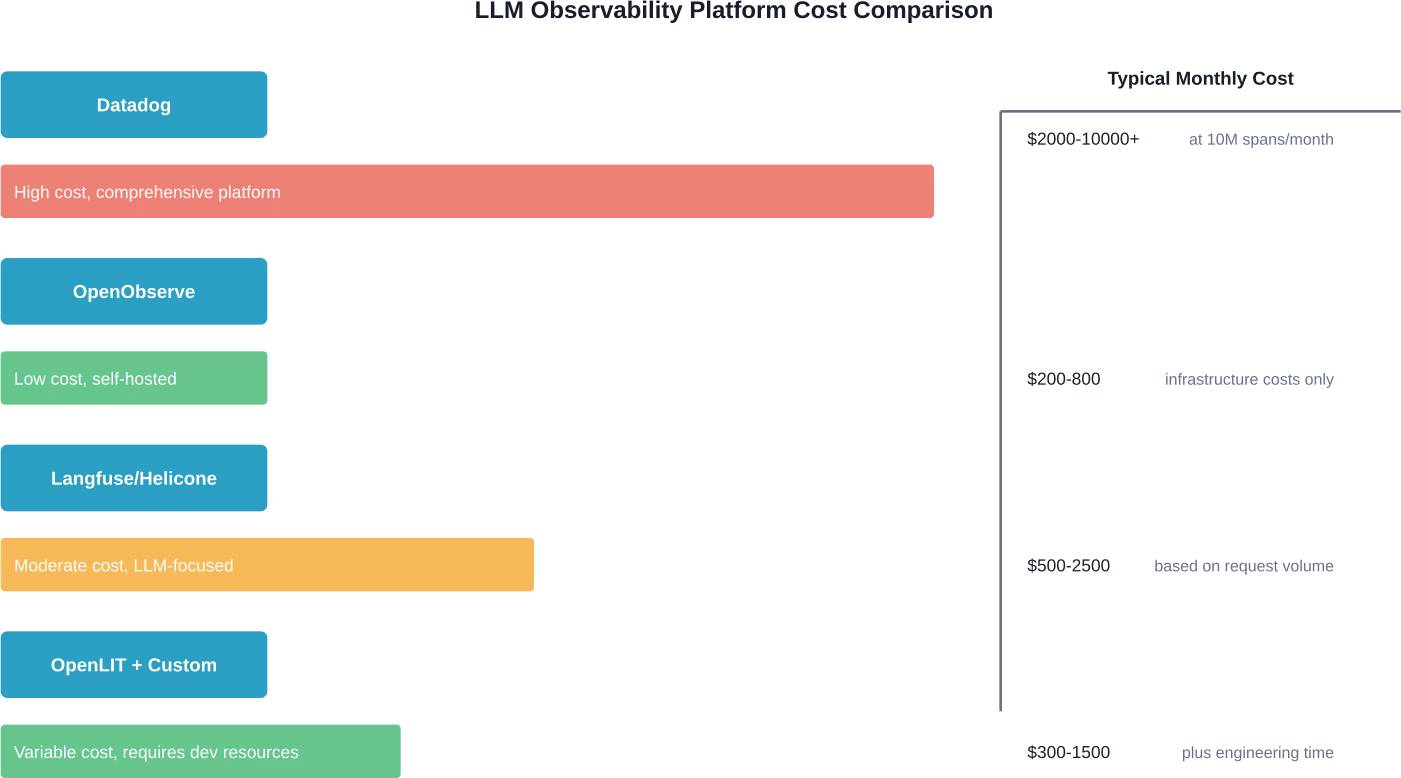

Vergleich der Observability-Kosten von Datadog LLM mit Alternativen

Datadog ist nicht der einzige Anbieter im Bereich der LLM-Observability. Das Verständnis des Wettbewerbsumfelds hilft Teams bei der Beurteilung, ob die Preisgestaltung von Datadog für ihren Anwendungsfall sinnvoll ist.

Open-Source-Alternativen

OpenObserve wird als “kosteneffiziente Alternative zu Datadog, Splunk und Elasticsearch mit 140-mal geringeren Speicherkosten” beschrieben. Die Plattform nutzt S3-basierten Speicher mit zustandsloser Architektur, wodurch die Infrastrukturkosten im Vergleich zum Managed-Service-Modell von Datadog drastisch reduziert werden.

Zu den weiteren Open-Source-Optionen gehört OpenLIT, das eine auf OpenTelemetry basierende Überwachung speziell für LLM-Workloads bietet. Für Teams mit den entsprechenden technischen Ressourcen zur Infrastrukturverwaltung können diese Alternativen erhebliche Einsparungen ermöglichen – allerdings auf Kosten des Betriebsaufwands.

Spezialisierte LLM-Plattformen

Plattformen wie Langfuse, Helicone und Arize bieten LLM-spezifische Observability mit einfacheren Preismodellen. Viele berechnen die Kosten anhand der erfassten Anfragen anstatt anhand der zugrunde liegenden Infrastrukturmetriken.

Der Nachteil? Diese Plattformen eignen sich hervorragend für die Überwachung von LLM-Systemen, bieten aber nicht die umfassende Infrastruktur-Überwachung von Datadog. Teams, die Datadog bereits für traditionelles APM einsetzen, sehen oft einen Vorteil darin, die LLM-Überwachung auf derselben Plattform zu konsolidieren, trotz potenziell höherer Kosten.

Middleware- und Proxy-Lösungen

Projekte wie claude_telemetry demonstrieren einen hybriden Ansatz: schlanke OpenTelemetry-Wrapper protokollieren Tool-Aufrufe, Token-Nutzung und Kosten an verschiedene Backends, darunter Datadog. Die Projektdokumentation von claude_telemetry gibt an, dass Telemetriedaten an verschiedene Backends, einschließlich Datadog, gesendet werden können.

Diese Architektur entkoppelt die Instrumentierung vom Backend und ermöglicht Teams so einen flexiblen Anbieterwechsel, falls die Kosten für Datadog zu hoch werden. Die Kosten für die Instrumentierung sind minimal – lediglich der Overhead der Wrapper-Software –, während die Backend-Kosten mit dem Preismodell des gewählten Anbieters skalieren.

Praktische Kostenoptimierungsstrategien

Die Verwaltung der Kosten für Datadog LLM Observability erfordert kontinuierliche Aufmerksamkeit und kluge Konfigurationsentscheidungen. Hier sind Strategien, die sich in Produktionsumgebungen bewährt haben.

Proxy-Routingregeln optimieren

Bei der Verwendung von LLM-Proxys wirken sich Routing-Entscheidungen direkt auf die Kosten aus. Eine an GPT-4 weitergeleitete Anfrage ist deutlich teurer als eine, die von GPT-3.5 oder einem kleineren offenen Modell bearbeitet wird.

Datadogs Leitfaden zur Proxy-Überwachung empfiehlt, die Performance der Modellauswahl zu verfolgen. Wenn eine Routing-Regel den Datenverkehr an ein teures Modell weiterleitet, sich die Qualitätsmetriken aber nicht verbessern, sollte man die Routing-Regel auf ein schnelleres und kostengünstigeres Modell zurücksetzen. Diese detaillierte Transparenz zahlt sich aus, da sie die unnötige Nutzung von Premium-Modellen verhindert.

Anforderungsdrosselung implementieren

Unkontrollierte Anfrageschleifen oder ineffiziente Wiederholungslogik können sowohl die Kosten des LLM-Anbieters als auch die Kosten für die Überwachung in die Höhe treiben. Datadog-Traces decken diese Muster durch Spannenanalyse auf.

Teams sollten die Anfragedrosselung auf Proxy-Ebene konfigurieren, mit großzügigen Grenzwerten für legitimen Datenverkehr, aber strengen Obergrenzen, um Missbrauch oder Fehler zu verhindern, die Millionen unnötiger Anfragen generieren. Die Beobachtungsdaten helfen dabei, diese Grenzwerte anhand der tatsächlichen Nutzungsmuster zu kalibrieren.

Disziplin der Tag-Verwaltung

Tags mit hoher Kardinalität erhöhen die Speicherkosten für Metriken drastisch. Tags wie user_id, session_id oder request_id erzeugen auf jedem Span massive Datenmengen.

Bewährte Vorgehensweise: Verwenden Sie für Traces (suchbar in Span-Daten) hochgradig aussagekräftige Kennungen, jedoch nicht als Metrik-Tags. Reservieren Sie Metrik-Tags für begrenzte Attribute wie Modellname, Umgebung, Dienst und Fehlertyp. Dadurch bleibt die Debugging-Funktionalität erhalten, während gleichzeitig die Metrikexplosion kontrolliert wird.

Selektive Nutzlasterfassung

Das Erfassen vollständiger LLM-Anfrage- und Antwortdaten bietet einen enormen Nutzen für die Fehlersuche, beansprucht aber erheblichen Speicherplatz. Ein einzelner Gesprächsverlauf kann Hunderte von Kilobyte an Protokolldaten erzeugen.

Strategischer Ansatz: Nutzdaten für Fehler und Anfragen mit hoher Latenz werden automatisch erfasst, erfolgreiche Anfragen hingegen mit einer Stichprobe von 1-5%. Teams können die Stichprobenanzahl bei der Untersuchung spezifischer Probleme jederzeit vorübergehend erhöhen.

Reduzieren Sie die Kosten der Beobachtbarkeit, bevor sie außer Kontrolle geraten.

LLM-Observability-Tools wie Datadog sind zwar nützlich, beheben aber nicht die zugrundeliegenden Ineffizienzen. Die meisten Kosten entstehen durch die Art und Weise, wie das Modell erstellt, optimiert und bereitgestellt wird, nicht nur durch dessen Überwachung. AI Superior Sie arbeiten auf der vorherigen Ebene: Modellauswahl, Datenaufbereitung, Feinabstimmung und Bereitstellungsdesign, damit später keine unnötige Last in die Observability-Pipelines gelangt. Ihre Arbeit deckt typischerweise den gesamten Lebenszyklus ab, von der Datenverarbeitung über die Optimierung bis hin zur Produktionseinrichtung.

Wenn Sie sich bereits Gedanken über die Kosten der Observability machen, ist es an der Zeit, einen Schritt zurückzutreten und die zugrundeliegende Architektur zu überarbeiten. Sprechen Sie mit AI Superior, definieren Sie, was tatsächlich verfolgt werden muss, und bauen Sie ein System auf, das vorhersehbar bleibt, anstatt mit jeder Abfrage teurer zu werden.

Reale Kostenszenarien

Wie viel geben Teams tatsächlich für Datadog LLM Observability aus? Die konkreten Zahlen variieren zwar je nach Umfang und Konfiguration stark, aber es lassen sich einige Muster erkennen.

Anwendung für die Kleinserienproduktion

Ein Startup, das monatlich 500.000 LLM-Anfragen mit durchschnittlicher Komplexität (7 Spans pro Anfrage) verarbeitet, generiert etwa 3,5 Millionen Spans. Bei üblichen APM-Preisen könnten die Kosten für die Span-Erfassung und -Aufbewahrung monatlich zwischen 1.400.300 und 6.000 liegen.

Fügt man die Infrastrukturüberwachung für 10-20 Container hinzu, auf denen der LLM-Dienst läuft, belaufen sich die monatlichen Kosten auf $800-1200. Dies setzt eine standardmäßige Aufbewahrungsdauer und eine moderate Nutzung benutzerdefinierter Metriken voraus.

KI-Plattform für Unternehmen

Eine große Organisation, die monatlich 50 Millionen LLM-Anfragen mit komplexen Agenten-Workflows verarbeitet (durchschnittlich 25 Spans pro Anfrage), generiert 1,25 Milliarden Spans. Dieses Volumen führt zu einem Preis im Enterprise-Tarif von Datadog.

Bei ausgehandelten Tarifen und optimierter Stichprobenentnahme (Aufbewahrung von 20% Spuren) könnten die Kosten allein für die LLM-Beobachtbarkeit monatlich zwischen $8.000 und 15.000 liegen. Die Gesamtausgaben für Datadog einschließlich Infrastrukturüberwachung könnten monatlich $30.000 übersteigen.

Entwicklung und Staging

Teams übertreiben es oft mit der Instrumentierung von Nicht-Produktionsumgebungen. Eine Entwicklungsumgebung, die monatlich 5 Millionen Anfragen generiert und vollständig überwacht werden kann, kostet möglicherweise $400-800 – Geld, das besser in die Transparenz der Produktionsumgebung investiert wäre.

Empfohlene Vorgehensweise: Nutzen Sie aggressives Sampling (5–101 TP3T Aufbewahrungsdauer) in der Entwicklungs-/Staging-Umgebung und konzentrieren Sie sich dabei auf die Fehlererfassung anstatt auf umfassendes Tracing. Dadurch werden die Kosten um 80–901 TP3T gesenkt, während die Debugging-Funktionalität erhalten bleibt.

| Umgebungstyp | Monatliche Anfragen | Stichprobenstrategie | Geschätzte monatliche Kosten |

|---|---|---|---|

| Entwicklung/Test | 5M | 10% + Fehler | $100-200 |

| Inszenierung | 10 Millionen | 20% + Fehler | $300-500 |

| Produktion (klein) | 500.000-2 Mio. | 50-100% | $800-1500 |

| Produktion (mittel) | 10–25 m | 30-50% | $3000-6000 |

| Produktion (Unternehmen) | 50 Millionen+ | 20-30% optimiert | $8000-15000+ |

Wann Datadog trotz höherer Kosten sinnvoll ist

Die höheren Preise von Datadog sind nicht immer ein Ausschlusskriterium. In einigen Fällen ist die Investition gerechtfertigt.

Unternehmen, die Datadog bereits für die Infrastruktur- und APM-Überwachung standardisiert einsetzen, profitieren erheblich von der Integration von LLM Observability. Die einheitliche Plattform eliminiert Kontextwechsel und korreliert die LLM-Performance mit den zugrunde liegenden Infrastrukturmetriken. Bei einer verlangsamten Modellreaktion können Teams sofort GPU-Auslastung, Netzwerklatenz und Datenbankleistung überprüfen – alles über eine einzige Benutzeroberfläche.

Unternehmen mit komplexen Compliance-Anforderungen profitieren von den Prüffunktionen, Zugriffskontrollen und Datenaufbewahrungsfunktionen von Datadog. Open-Source-Alternativen mangelt es oft an den in regulierten Branchen erforderlichen Governance-Tools.

Teams ohne dedizierte Ressourcen für die Plattformentwicklung profitieren vom Managed Service von Datadog. Die Alternative – die Bereitstellung und Wartung einer Open-Source-Observability-Infrastruktur – erfordert fortlaufende Investitionen in die Entwicklung, die die Abonnementkosten von Datadog übersteigen können.

Häufig gestellte Fragen

Wie viel kostet Datadog LLM Observability tatsächlich pro Monat?

Datadog veröffentlicht keine Preise für die eigenständige LLM-Observability-Lösung. Die Kosten hängen vom Span-Ingestionsvolumen ab, welches wiederum vom Durchsatz der Anfragen und der Komplexität der Anwendung abhängt. Kleinere Anwendungen geben monatlich etwa 1.300–800 TP4T aus, während Enterprise-Implementierungen üblicherweise 8.000–15.000 TP4T überschreiten. Die Preise skalieren mit den APM-Span-Ingestionsraten und den Anforderungen an die Infrastrukturüberwachung.

Kann ich Datadog LLM Observability nutzen, ohne für das vollständige APM-Abonnement zu bezahlen?

Nein. LLM Observability baut auf der APM-Infrastruktur von Datadog auf und erfordert ein aktives APM-Abonnement. Das spanbasierte Preismodell bedeutet, dass LLM-Traces auf die gesamte APM-Span-Erfassung angerechnet werden. Teams benötigen sowohl APM als auch die Infrastrukturüberwachungskomponenten, die die Anwendung unterstützen.

Wie lassen sich die LLM-Kosten in der Produktion am kostengünstigsten überwachen?

Für die grundlegende Kostenverfolgung sind schlanke Lösungen wie Token-Zähler im Anwendungscode oder einfaches Request-Logging in S3 nahezu kostenlos. Für umfassende Observability bieten Open-Source-Plattformen wie OpenLIT oder OpenObserve die niedrigsten Infrastrukturkosten, erfordern jedoch Entwicklungsaufwand für Bereitstellung und Wartung. Managed-Lösungen wie Langfuse bieten ein mittleres Preissegment, das speziell auf LLM-Workloads ausgerichtet ist.

Berechnet Datadog die Token-Nutzungsdaten separat?

Tokenanzahlen werden als Span-Metadaten gespeichert und verursachen keine separaten Gebühren über die Kosten der Span-Erfassung hinaus. Die Erstellung benutzerdefinierter Metriken basierend auf der Tokennutzung (z. B. aggregierte Tokenanzahlen nach Benutzer oder Abfragetyp) generiert jedoch zusätzliche Kosten. Teams sollten die Nutzung benutzerdefinierter Metriken überwachen, um unerwartete Kosten zu vermeiden.

Wie kann ich die Kosten für Datadog LLM Observability vor der Bereitstellung abschätzen?

Berechnen Sie das erwartete monatliche Anfragevolumen, schätzen Sie die Anzahl der Anfragen pro Anfrage (3–5 für einfache Anrufe, 20–50 für komplexe Agenten) und multiplizieren Sie diese Werte, um die Gesamtanzahl der Anfragen zu erhalten. Vergleichen Sie dies mit den APM-Preisstufen von Datadog. Addieren Sie die Kosten für die Infrastrukturüberwachung der Rechenressourcen, auf denen die LLM-Anwendung ausgeführt wird. Planen Sie einen Puffer von 20–301 TP3T für Wachstum und unerwartete Nutzungsmuster ein.

Gibt es Kostenunterschiede bei der Überwachung verschiedener LLM-Anbieter?

Die Preise von Datadog variieren nicht je nach dem überwachten LLM-Anbieter (OpenAI, Anthropic usw.). Die Kosten hängen ausschließlich vom Umfang der Observability-Daten ab – Spans, Metriken und Logs, die von der Monitoring-Infrastruktur generiert werden. Unterschiedliche Anbieter können jedoch unterschiedliche Antwortcharakteristika aufweisen, was die Komplexität der Traces und den Speicherbedarf beeinflusst.

Was passiert, wenn ich mein Datadog-Budget Mitte des Monats überschreite?

Datadog schaltet den Service in der Regel nicht mitten im Monat ab, stellt aber Kosten für Überschreitungen in Rechnung. Teams sollten Nutzungswarnungen über die Kostenmanagement-Funktionen konfigurieren und Token-Kontingentwarnungen festlegen, um unkontrollierte Ausgaben zu vermeiden. Das von Datadog empfohlene Soft/Hard-Quota-Modell warnt vor Erreichen von Limits und kann Anfragen blockieren, die das Budget überschreiten würden.

Die richtige Wahl für Ihr Team treffen

Datadog LLM Observability bietet umfassende Einblicke in die Performance von KI-Anwendungen, die Token-Ökonomie und Qualitätsmetriken. Für Teams, die bereits im Datadog-Ökosystem tätig sind, schafft die Integration von LLM-Monitoring eine einheitliche Observability-Strategie.

Das Kostenmodell erfordert jedoch ein sorgfältiges Management. Die Span-Volumina skalieren schnell mit dem Anfragedurchsatz und der architektonischen Komplexität. Ohne disziplinierte Sampling-Strategien, Tag-Management und Nutzungsüberwachung können die Kosten schneller steigen als der Nutzen.

Die Entscheidung hängt letztlich von drei Faktoren ab: den bestehenden Investitionen von Datadog, den für Alternativen verfügbaren Entwicklungsressourcen und der Bedeutung einer einheitlichen Beobachtbarkeit der Infrastruktur und der KI-Workloads.

Für Enterprise-Teams mit komplexen Implementierungen lohnt sich der Premium-Preis von Datadog oft. Kleinere Teams oder solche mit ausgeprägten Kompetenzen im Plattform-Engineering bieten mit Open-Source-Alternativen vergleichbare Transparenz zu einem Bruchteil der Kosten.

Welcher Weg auch immer sinnvoll ist, entscheidend ist, dass die Kosten der Beobachtbarkeit als vorrangiges Anliegen behandelt werden – überwacht, optimiert und durch die operativen Erkenntnisse, die sie ermöglichen, gerechtfertigt werden.

Sie möchten mit LLM-Monitoring beginnen? In der offiziellen Datadog-Dokumentation finden Sie Informationen zur aktuellen Funktionsverfügbarkeit. Kontaktieren Sie das Vertriebsteam, um ein Angebot zu erhalten, das Ihrem spezifischen Implementierungsumfang und Ihren Anforderungen entspricht.