Korte samenvatting: Het LangChain-framework zelf is gratis en open-source, maar de ontwikkeling van LLM-applicaties brengt kosten met zich mee voor LLM API-aanroepen (doorgaans $0,25-$75 per miljoen tokens), het LangSmith-observatieplatform ($0-$39+ per gebruiker per maand), infrastructuurhosting en ontwikkeltijd. De totale ontwikkelingskosten variëren van bijna nul voor prototypes tot meer dan $10.000 per maand voor productie-implementaties, afhankelijk van de schaal, de modelkeuze en de complexiteit van de functionaliteit.

Het bouwen van applicaties met grote taalmodellen is in 2026 gemeengoed geworden, en LangChain blijft een van de meest gebruikte frameworks voor het orkestreren van LLM-workflows. Maar teams worden vaak verrast door het volgende: hoewel het framework gratis is, omvatten de totale ontwikkelings- en implementatiekosten meerdere lagen die niet altijd direct duidelijk zijn.

De prijsstructuur is niet eenvoudig. LangChain is open-source, dus er zijn geen licentiekosten. Teams krijgen echter al snel te maken met kosten voor API-aanroepen naar modellen, tools voor observatie, vectordatabases, hostinginfrastructuur en de ontwikkeltijd die nodig is om productieklare applicaties te bouwen.

Deze handleiding geeft een gedetailleerd overzicht van alle kostencomponenten voor de ontwikkeling van LLM-applicaties op basis van LangChain in 2026, van de eerste prototypefase tot de opschaling naar productie.

LangChain Framework Prijsstelling: De Kerncomponenten

LangChain zelf is volledig gratis. Het framework is open-source en beschikbaar zonder licentiekosten. Dit geldt voor zowel de Python- als de JavaScript-implementatie, die ontwikkelaars via pip of npm kunnen installeren en direct kunnen gebruiken.

Het framework biedt modulaire componenten voor het bouwen van LLM-applicaties: ketens voor het sequentiëren van bewerkingen, agenten voor autonome besluitvorming, retrievers voor het zoeken in documenten en geheugensystemen voor de context van gesprekken. Voor geen van deze kernfunctionaliteiten is een betaling aan LangChain vereist.

Het LangChain-ecosysteem reikt echter verder dan het kernframework. LangGraph, een bibliotheek voor het bouwen van stateful multi-agent workflows, is ook open-source en gratis. LangServe, dat ketens omzet in implementeerbare API's, volgt hetzelfde model: gratis te gebruiken, hoewel het implementeren van die API's cloudinfrastructuur vereist, wat hostingkosten met zich meebrengt.

LangSmith Observability Platform: Waar abonnementskosten beginnen

LangSmith is waar teams voor het eerst directe kosten ondervinden van het LangChain-ecosysteem. Dit platform biedt mogelijkheden voor tracering, debugging, evaluatie en monitoring die essentieel worden bij de overgang van prototype naar productie.

Volgens de officiële LangChain-prijslijst biedt LangSmith vanaf 2026 drie abonnementsniveaus aan:

| Plan | Prijs per stoel | Basissporen inbegrepen | Sporenbewaring | Het beste voor |

|---|---|---|---|---|

| Ontwikkelaar | $0/maand | 5.000/maand | 14 dagen (basis) | Solo-ontwikkelaars, prototyping |

| Plus | $39/maand | 10.000/maand | 14 dagen (basis), 400 dagen (verlengd) | Kleine teams, productie-apps |

| Onderneming | Aangepaste prijzen | Aangepaste toewijzing | Aangepaste retentie | Grote organisaties, nalevingsvereisten |

Het ontwikkelaarsabonnement biedt één gratis licentie, waardoor het aantrekkelijk is voor individuele ontwikkelaars die net beginnen. Het omvat tot 5.000 basistraceringen per maand, met een pay-as-you-go-tarief voor elke tracering daarboven. Basistraceringen kosten $2,50 per 1.000 traceringen en hebben een bewaartermijn van 14 dagen.

Uitgebreide traceringen, die gegevens 400 dagen bewaren, kosten $5,00 per 1.000 traceringen (het dubbele van het basistarief). Voor toepassingen die langdurige observeerbaarheid en compliance-auditsporen vereisen, kunnen deze kosten aanzienlijk oplopen.

Het Plus-abonnement van $39 per gebruiker per maand is waar de meeste productieteams voor kiezen. Het omvat 10.000 basistraceringen per maand, een onbeperkt aantal Fleet-agents voor autonome operaties en e-mailondersteuning. Teams kunnen onbeperkt extra gebruikers toevoegen tegen hetzelfde tarief per gebruiker.

Extra functies van LangSmith zijn onder andere annotatiewachtrijen voor menselijke feedback, promptbeheer via de Prompt Hub en Playground, en monitoring met waarschuwingsmogelijkheden. Deze tools brengen geen aparte kosten met zich mee; ze zijn inbegrepen in de abonnementen.

LLM API-kosten: de grootste variabele in productiebudgetten

De belangrijkste terugkerende kostenpost voor LangChain-applicaties zijn de kosten voor het aanroepen van LLM API's. Deze kosten overtreffen ruimschoots de kosten voor het framework en de tools voor elke applicatie die op grote schaal draait.

LangChain ondersteunt integratie met tientallen modelaanbieders via de gestandaardiseerde interface. Elke aanbieder hanteert verschillende prijsstructuren op basis van tokenverbruik, modelmogelijkheden en extra functies zoals caching of batchverwerking.

Prijslandschap voor modellen in 2026

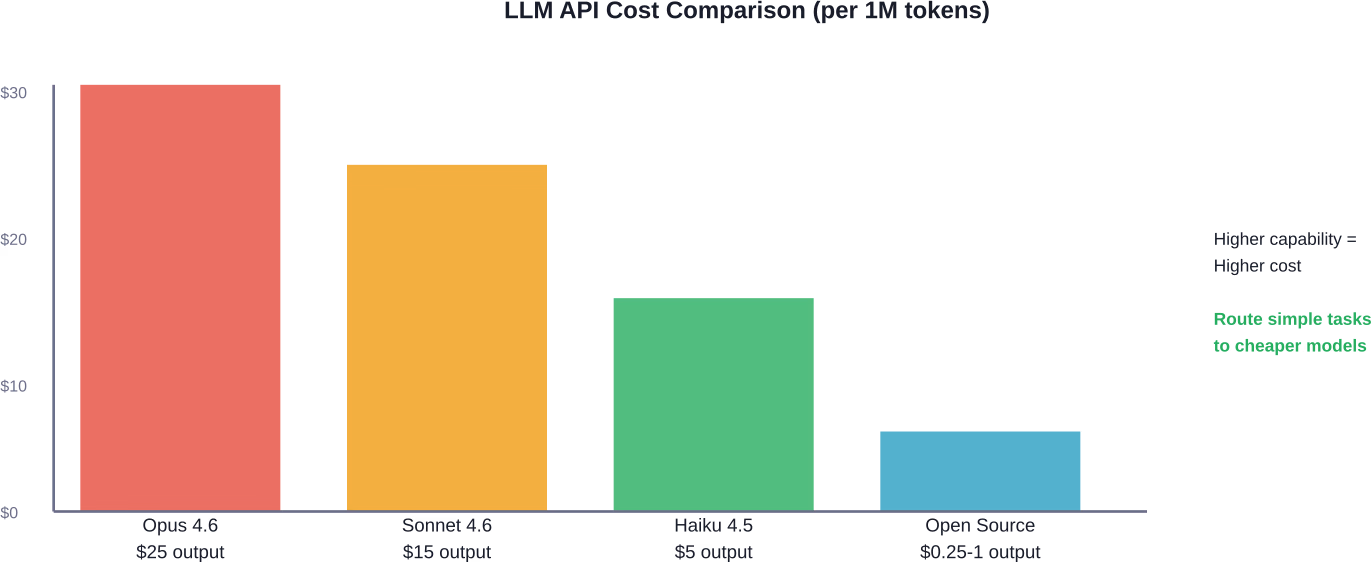

De Claude-modellen van Anthropic zijn een veelgebruikte keuze voor LangChain-applicaties. Volgens recente prijsdocumentatie bieden de Claude-modellen de volgende representatieve tarieven per miljoen tokens (prijzen kunnen wijzigen):

- Claude Opus 4.6: $5 ingang / $25 uitgang

- Claude Sonnet 4.6: $3 ingang / $15 uitgang

- Claude Haiku 4.5: $0.25-$1 ingang / $1.25-$5 uitgang

Oudere modellen uit de Claude 4.1-serie vertonen hogere prijzen, met Opus 4.1 op $15 input / $75 output per miljoen tokens. De prijsontwikkeling laat zien hoe nieuwere generaties vaak betere prestaties leveren tegen lagere kosten.

OpenAI-modellen hanteren een vergelijkbare prijsstelling op basis van tokens, hoewel de specifieke tarieven voor 2026 variëren afhankelijk van de modelgeneratie. GPT-4-klassemodellen kosten doorgaans tussen de $2.50 en $30 per miljoen invoertokens, afhankelijk van het capaciteitsniveau en de grootte van het contextvenster.

Kleinere open-source modellen, toegankelijk via providers zoals Groq of gehost op infrastructuur zoals AWS Bedrock, kunnen de kosten per token aanzienlijk verlagen – soms met 80-951 TP3T vergeleken met geavanceerde modellen – hoewel dit wel ten koste gaat van de functionaliteit.

Kostenoptimalisatiestrategieën

Het cachen van prompts kan de kosten voor herhaalde context met wel 90% verlagen. Wanneer applicaties vergelijkbare documenten verwerken of consistente systeemprompts gebruiken bij verschillende verzoeken, elimineert het cachen van de gecodeerde representaties de kosten voor overbodige verwerking.

Batchverwerking van API's biedt, indien beschikbaar, doorgaans 50%-kortingen ten opzichte van realtime-inferentie. Applicaties die vertraagde reacties kunnen tolereren – zoals documentverwerkingspipelines of nachtelijke analysetaken – profiteren aanzienlijk van batchtarieven.

Door deze strategieën te combineren, worden de besparingen vergroot. Volgens onderzoek naar kostenoptimalisatie kunnen teams die zowel prompt caching als batch-API's gebruiken, de totale inferentiekosten aanzienlijk verlagen in vergelijking met standaard realtime verwerking zonder caching.

Modelroutering vertegenwoordigt een andere optimalisatiemethode. Hiërarchische architecturen in de financiële documentverwerking behaalden een reflexieve architectuurnauwkeurigheid van 97,71 TP3T tegen 60,91 TP3T aan kosten, gebaseerd op benchmarkgegevens voor gespecialiseerde workflows. LangChain-applicaties kunnen een vergelijkbare logica implementeren om eenvoudige query's naar goedkopere modellen te routeren, terwijl dure grensmodellen worden gereserveerd voor complexe redeneertaken.

Infrastructuur- en ondersteunende servicekosten

Naast de LLM API's en de LangSmith-observabiliteit vereisen LangChain-applicaties ondersteunende infrastructuur, wat het totale budget verhoogt.

Kosten van vectordatabases

Applicaties die gebruikmaken van retrieval-augmented generation vereisen vectordatabases om document-embeddings op te slaan en te doorzoeken. Populaire opties zijn onder andere Pinecone, Weaviate, Qdrant en Chroma, elk met verschillende prijsmodellen.

Beheerde vectordatabaseservices berekenen de kosten doorgaans op basis van datavolume, queryvolume en prestatieniveau. Kleine applicaties kunnen binnen de gratis niveaus met 1 GB opslagruimte en een beperkt aantal query's blijven. Productieomgevingen die miljoenen vectoren verwerken, kunnen maandelijks tussen de $50 en $500 of meer kosten, afhankelijk van de schaal en de replicatievereisten.

Zelf gehoste vectordatabases elimineren abonnementskosten, maar vereisen infrastructuurbeheer. Het draaien van Qdrant of Chroma op cloud-computing-instanties verschuift de kosten naar serverhuur en operationele overhead.

Inbeddingsmodelkosten

Het genereren van embeddings voor vectoropslag brengt eigen API-kosten met zich mee, hoewel deze doorgaans veel lager liggen dan die van LLM-inferentie. OpenAI's text-embedding-3-large kost ongeveer $0,13 per miljoen tokens, terwijl kleinere embeddingmodellen zelfs nog minder kosten.

Voor applicaties die grote documentverzamelingen verwerken, kunnen de kosten voor het inbedden flink oplopen. Het verwerken van 10 miljoen documenttokens zou met standaard inbeddings-API's ongeveer $1,30 kosten – verwaarloosbaar in vergelijking met de kosten van LLM, maar wel de moeite waard om bij te houden voor een nauwkeurige begroting.

Applicatiehosting

Het implementeren van LangChain-applicaties vereist rekenkracht. Eenvoudige chatbots kunnen draaien op serverloze platforms zoals Vercel of AWS Lambda met minimale kosten van minder dan 1 TP4T20 per maand. Complexere agentsystemen met continue werking en statusbeheer vereisen permanente servers.

De kosten voor cloudcomputing variëren sterk, afhankelijk van de vereisten. Een basisimplementatie in containers op services zoals Render of Railway kost ongeveer $7-$25 per maand voor kleine instanties. Productiesystemen met automatische schaling, load balancing en hoge beschikbaarheid kunnen oplopen tot $200-$2.000+ per maand, afhankelijk van het verkeer en de complexiteit.

Investering in het ontwikkelingsteam: de verborgen kostencomponent

De tijd die ontwikkelaars besteden aan een project vertegenwoordigt een aanzienlijk deel van de totale projectkosten, hoewel dit vaak over het hoofd wordt gezien wanneer de focus ligt op infrastructuur- en API-kosten.

Het bouwen van een eenvoudige LangChain-applicatie – een simpele RAG-chatbot of een vraag-en-antwoordsysteem voor documenten – vereist doorgaans 40 tot 80 uur voor een ontwikkelaar die bekend is met Python en LLM-concepten. Bij standaard contracttarieven van $75 tot $150 per uur, komt dit neer op een investering van $3.000 tot $12.000 aan ontwikkelingskosten.

Complexe multi-agentsystemen met aangepaste tools, geavanceerd geheugenbeheer en foutafhandeling van productieniveau kunnen 200 tot meer dan 500 ontwikkeluren vergen. Voor teams die eigen agentworkflows bouwen, kunnen de ontwikkelingskosten gemakkelijk oplopen tot $20.000 tot $75.000 voordat de applicatie ook maar één productieverzoek verwerkt.

Doorlopend onderhoud draagt bij aan dit totaal. LLM API's ontwikkelen zich snel, waarbij modellen regelmatig worden uitgefaseerd en nieuwe versies worden uitgebracht. Het up-to-date houden van applicaties, het monitoren van prestatievermindering en het optimaliseren van prompts naarmate het gedrag van modellen verandert, vereist continue aandacht van ontwikkelaars.

Praktische budgetvoorbeelden: van prototype tot productie

Inzicht in abstracte kostencomponenten is nuttig, maar concrete budgetscenario's bieden een duidelijker leidraad voor de planning.

Scenario 1: Prototype voor solo-ontwikkelaar

Een enkele ontwikkelaar die een proof-of-concept tool voor documentanalyse bouwt:

- LangChain-framework: $0

- Plan van de LangSmith-ontwikkelaar: $0 (5.000 traceringen/maand)

- Gebruik van de Claude Haiku API (50.000 query's, gemiddeld 2000 tokens als output): ~$500/maand

- Vectordatabase (Chroma zelf gehost): $0

- Hosting (niveau voor spoorweghobbyisten): $0-$5/maand

- Ontwikkelingstijd (60 uur, zelf gefinancierd): Niet gefactureerd

Totale maandelijkse terugkerende kosten: ~$505. Initiële ontwikkelingsinvestering: 60 uur ontwikkeltijd.

Scenario 2: Klantenservicebot voor een klein team

Een startup die met een team van 3 leden een interne klantenservice-assistent ontwikkelt:

- LangChain-framework: $0

- LangSmith Plus-abonnement (3 stoelen): $117/maand

- API-gebruik van Claude Sonnet (200.000 query's, gemiddeld 1500 tokens als output): ~$4.500/maand

- Vectordatabase voor dennenappels (startplan): $70/maand

- AWS-hosting (implementatie in containers): $150/maand

- Ontwikkelingstijd (eerste 200 uur verdeeld over het team tegen $75-$150/uur): $15.000-$30.000 eenmalig

- Continue optimalisatie (10 uur/maand): $750-$1.500/maand

Totale maandelijkse terugkerende kosten: ~$5.587-$6.337. Initiële ontwikkelingsinvestering: $15.000-$30.000.

Scenario 3: Documentverwerkingspipeline voor bedrijven

Een grote organisatie die dagelijks duizenden financiële documenten verwerkt:

- LangChain-framework: $0

- LangSmith Enterprise-abonnement (25 zitplaatsen): ~$3.000+/maand (prijs op maat)

- Multimodelroutering (Opus voor complexe, Haiku voor eenvoudige, batchverwerking): ~$15.000/maand

- Vectordatabase (beheerd, hoge beschikbaarheid): $800/maand

- Cloudinfrastructuur (automatische schaling, redundantie): $2.500/maand

- Ontwikkelteam (eerste versie, 500 uur): $50.000-$100.000 eenmalig

- Doorlopende ontwikkeling en optimalisatie (40 uur/maand): $3.000-$6.000/maand

Totale maandelijkse terugkerende kosten: ~$24.300-$27.300. Initiële ontwikkelingsinvestering: $50.000-$100.000.

Kostenbewaking en budgetbeheer

Om de kosten van LLM-applicaties te beheren, is inzicht in het tokenverbruik essentieel. LangSmith biedt ingebouwde mogelijkheden voor kostenbewaking die geïntegreerd kunnen worden met LangChain-applicaties.

Volgens de officiële documentatie over kostenregistratie berekent LangSmith de kosten op basis van metadata over tokengebruik en configureerbare prijsmodellen. Teams kunnen voor elk model in- en uitgaande prijzen per miljoen tokens instellen, met ondersteuning voor gedetailleerde uitsplitsingen naar tokentype.

Voor applicaties die OpenAI, Anthropic of modellen gebruiken die compatibel zijn met OpenAI-formaten, vindt kostenregistratie automatisch plaats bij gebruik van LangChain-integraties of LangSmith-wrappers. Het platform leest het aantal tokens uit API-reacties en past prijsregels toe om de uitvoeringskosten te berekenen.

Aangepaste kostenstructuren, zoals niet-lineaire prijsstelling of providerspecifieke kortingen, vereisen handmatige kostenannotatie. Teams kunnen programmatisch kostenmetadata aan traceringen koppelen wanneer de automatische berekening niet overeenkomt met de werkelijke facturering.

De kostenberekening werkt op een gierige manier, van meest naar minst specifieke tokensoorten. Als de prijs $2 per miljoen inputtokens is met een gedetailleerd tarief van $1 per miljoen cache-gelezen tokens, en een run 20 inputtokens gebruikt, waarvan 5 uit de cache, dan berekent het systeem $1 per miljoen voor de 5 gecachede tokens en $2 per miljoen voor de resterende 15 standaardinputs.

LangChain vergelijken met alternatieve frameworks

Kostenoverwegingen spelen ook een rol bij de keuze van het framework. LangChain concurreert met alternatieven zoals de Vercel AI SDK en het rechtstreeks gebruik van de OpenAI SDK, die elk hun eigen kostenimplicaties hebben.

De Vercel AI SDK is gericht op streaming en edge-implementatie en is geoptimaliseerd voor Next.js-applicaties. Het framework zelf is gratis, net als LangChain. Het biedt echter geen ingebouwde observability zoals LangSmith, waardoor aparte monitoringoplossingen nodig zijn die mogelijk kosten met zich meebrengen.

De OpenAI SDK biedt directe toegang tot OpenAI-modellen met minimale abstractie. Dit elimineert de overhead van frameworks, maar vereist een eigen implementatie van functies die LangChain standaard biedt, zoals ketencompositie, geheugenbeheer en toolintegratie. De tijdsbesparing bij het gebruik van LangChain weegt vaak op tegen eventuele marginale prestatieverbeteringen bij direct gebruik van de SDK.

Semantic Kernel van Microsoft biedt vergelijkbare orchestratiemogelijkheden met een nauwe integratie met Azure. Teams die al in het Azure-ecosysteem hebben geïnvesteerd, kunnen overwegen om gebundelde services via de Azure-integratie van Semantic Kernel te gebruiken, hoewel het framework zelf, net als LangChain, open-source en gratis is.

| Kader | Kernlicentie | Observeerbaarheid | Het beste voor | Kostenprofiel |

|---|---|---|---|---|

| LangChain | Gratis/Open | LangSmith ($0-$39+/zitplaats) | Complexe agenten, RAG | LLM API's + optionele tools |

| Vercel AI SDK | Gratis/Open | Derde partij vereist | Edge streaming, Next.js | LLM API's + monitoring SaaS |

| OpenAI SDK | Gratis/Open | Maatwerkimplementatie | Eenvoudige apps die alleen OpenAI gebruiken | LLM API's + ontwikkeltijd |

| Semantische kern | Gratis/Open | Azure Application Insights | Azure-native implementaties | LLM API's + Azure-services |

Technische schuld en kostenoverwegingen op lange termijn

Door te kiezen voor een veelgebruikt framework zoals LangChain kunnen bepaalde risico's die gepaard gaan met verouderde frameworks worden verminderd.

De snelle evolutie van frameworks brengt echter uitdagingen met zich mee op het gebied van versiebeheer. LangChain brengt periodiek ingrijpende wijzigingen uit naarmate het LLM-landschap verandert. Teams moeten budgetteren voor periodieke upgrades wanneer LangChain ingrijpende wijzigingen en nieuwe functionaliteiten introduceert.

Onderzoek wijst uit dat zelfverklaarde technische schuld voorkomt in 2,41 TP3T tot 311 TP3T aan codebases van open-sourceprojecten, vaak geïntroduceerd door ervaren ontwikkelaars. Specifiek voor LLM-toepassingen hoopt schuld zich op rond promptbeheer, evaluatiemethoden en het vastzetten van modelversies – allemaal gebieden waar tools zoals LangSmith waarde bieden, maar wel tegen abonnementskosten.

Het rendement op investering (ROI) berekenen

Of de ontwikkelingskosten van LangChain financieel verantwoord zijn, hangt af van de gegenereerde zakelijke waarde. Een klantenservicebot die dagelijks 1.000 vragen afhandelt en het aantal supporttickets met 301 TP3T vermindert, kan maandelijkse operationele kosten van 1 TP4T5.000 rechtvaardigen als er 1 TP4T20.000 aan salarissen voor supportmedewerkers wordt bespaard.

Documentverwerkingsprocessen vereisen een vergelijkbare analyse. Als een bedrijf maandelijks 10.000 financiële documenten verwerkt en LLM-automatisering de beoordelingstijd per document verkort van 15 minuten naar 3 minuten, dan bedraagt de arbeidsbesparing – 2.000 uur per maand bij een tarief van $50/uur – $100.000. Zelfs het gebruik van het dure model bij een tarief van $20.000 per maand laat een duidelijke ROI zien.

Prototypes en MVP's vereisen verschillende berekeningen. Het is logisch om 1 tot 4 tot 5.000 dollar te besteden aan ontwikkeling om de product-marktfit te valideren voordat er overgegaan wordt tot volledige implementatie. Het is echter niet verstandig om 1 tot 4 tot 50.000 dollar te besteden aan een prototype zonder gebruikersvalidatie.

De belangrijkste conclusie: de kosten van LangChain en LangSmith zijn optimalisatieproblemen, geen vaste uitgaven. Teams bepalen zelf de modelselectie, cachingstrategieën, het gebruik van batchverwerking en de infrastructuurkeuzes. Het framework biedt de flexibiliteit om goedkoop te beginnen en strategisch op te schalen naarmate de bedrijfswaarde zich bewijst.

Zorg ervoor dat LangChain-projecten vanaf dag één efficiënt blijven.

LangChain lijkt in eerste instantie vaak eenvoudig, maar de kosten lopen doorgaans op zodra het aantal chains, prompts en modelaanroepen in de praktijk toeneemt. AI Superieur Het project werkt aan de volledige LLM-applicatielaag achter frameworks zoals LangChain – modelselectie, finetuning, retrieval-configuratie en implementatie. De focus ligt niet op het framework zelf, maar op het bouwen van systemen waarbij modelaanroepen, dataflows en infrastructuur zijn afgestemd op de daadwerkelijke use case. Dit houdt het tokengebruik onder controle en voorkomt pipelines die onnodige belasting genereren.

De meeste kostenproblemen bij LangChain-configuraties komen voort uit de manier waarop het systeem is ontworpen, niet uit de gekozen tool. Als u overgecompliceerde ketens en stijgende inferentiekosten wilt vermijden, neem dan contact op met AI Superieur en controleer de instellingen van je LLM-aanvraag voordat deze wordt opgeschaald.

Veelgestelde vragen

Is LangChain volledig gratis te gebruiken?

Ja, het LangChain-framework zelf is open-source en gratis. Er zijn geen licentiekosten, gebruiksvergoedingen of abonnementsvereisten voor het kernframework, LangGraph of LangServe. Het bouwen van applicaties brengt echter wel kosten met zich mee voor LLM API-aanroepen, het optionele LangSmith-observabilityplatform en de hosting van de infrastructuur.

Wat zijn de kosten van LangSmith voor productietoepassingen?

LangSmith biedt een gratis ontwikkelaarsabonnement met 5.000 traces per maand, geschikt voor individuele ontwikkelaars en prototypes. Het Plus-abonnement kost $39 per gebruiker per maand en omvat 10.000 traces per maand, waardoor het geschikt is voor kleine teams en productieomgevingen. De prijs voor Enterprise-abonnementen wordt op maat gemaakt, afhankelijk van de schaal en de vereisten. Extra traces boven de abonnementslimieten kosten $2,50 tot $5,00 per 1.000 traces, afhankelijk van de bewaartermijn.

Wat zijn de gebruikelijke kosten voor de LLM API voor een LangChain-applicatie?

De kosten van LLM API's variëren sterk, afhankelijk van het gekozen model en het gebruiksvolume. Claude Haiku kost $0,25-$5 per miljoen tokens, Sonnet kost $3-$15 per miljoen en Opus kost $5-$25 per miljoen. Een kleine chatbot die maandelijks 50.000 vragen verwerkt met gemiddeld 2.000 outputtokens kan $500-$2.500 per maand kosten, afhankelijk van het model. Zakelijke applicaties kunnen op grote schaal oplopen tot $10.000-$50.000+ per maand.

Kan ik de kosten van een LLM-opleiding verlagen zonder dat dit ten koste gaat van de kwaliteit?

Ja, door middel van verschillende optimalisatiestrategieën. Prompt caching kan de kosten met wel 901 TP3T verlagen voor herhaalde context. Batchverwerking van API's biedt een korting van 501 TP3T voor niet-realtime workloads. Model routing – waarbij goedkopere modellen worden gebruikt voor eenvoudige taken en duurdere modellen alleen voor complexe redeneringen – kan de kosten met 40-601 TP3T verlagen, terwijl een nauwkeurigheid van 951 TP3T of hoger behouden blijft. Door deze technieken te combineren, kan een aanzienlijke kostenbesparing worden gerealiseerd in vergelijking met niet-geoptimaliseerde implementaties.

Heb ik LangSmith nodig om LangChain in een productieomgeving te kunnen gebruiken?

Nee, LangSmith is optioneel. LangChain-applicaties werken prima zonder LangSmith-abonnementen. LangSmith biedt echter essentiële mogelijkheden voor observatie, debugging en evaluatie die waardevol worden voor productieomgevingen. Teams kunnen zonder LangSmith beginnen en het later toevoegen wanneer de complexiteit of schaal van de applicatie debugging en monitoring bemoeilijkt. Het gratis Developer-abonnement biedt beperkte traceermogelijkheden om deze functionaliteiten te testen.

Hoeveel budget moet ik reserveren voor de ontwikkeling van LangChain?

De ontwikkelingskosten zijn afhankelijk van de complexiteit van de applicatie. Eenvoudige chatbots of vraag-en-antwoordsystemen voor documenten vereisen doorgaans 40-80 uur ontwikkeling ($3.000-$12.000 tegen standaardtarieven). Complexe multi-agentsystemen met aangepaste tools en geavanceerde workflows kunnen 200-500+ uur in beslag nemen ($15.000-$75.000+). Doorlopend onderhoud komt daar maandelijks 5-40 uur bij, afhankelijk van de schaal. De maandelijkse operationele kosten variëren van $500 voor prototypes tot $25.000+ voor implementaties op bedrijfsniveau, waarbij het gebruik van de LLM API 55-99% aan terugkerende kosten vertegenwoordigt.

Zijn er verborgen kosten waar ik rekening mee moet houden?

De meest over het hoofd geziene kosten omvatten abonnementen op vectordatabases voor RAG-toepassingen ($0-$500+ per maand), kosten voor het integreren van API's voor documentverwerking ($0,10-$0,30 per miljoen tokens), infrastructuurhosting buiten de gratis serverloze tiers ($20-$2.000+ per maand) en ontwikkeltijd voor continue promptoptimalisatie en modelupdates (10-40 uur per maand). Teams onderschatten soms ook het tokenverbruik tijdens ontwikkeling en testen, wat 20-50% aan de initiële budgetramingen kan toevoegen.

Uw budget voor LangChain-ontwikkeling plannen

Het bouwen van LLM-applicaties met LangChain in 2026 vereist inzicht in meerdere kostenlagen. Het framework zelf elimineert licentiekosten, maar de totale eigendomskosten omvatten het gebruik van de LLM API, optionele tools voor observatie, ondersteunende infrastructuur en investeringen van ontwikkelaars.

Begin met de gratis versie. Het open-source framework van LangChain en het ontwikkelaarsabonnement van LangSmith stellen teams in staat om concepten te prototypen en te valideren zonder voorafgaande kosten. Deze risicovrije verkenningsfase helpt bepalen of de applicatie voldoende waarde genereert om een investering in productie te rechtvaardigen.

Budgetteer geleidelijk voor schaalvergroting. Begin met goedkopere modellen zoals Claude Haiku of kleinere alternatieven. Implementeer direct caching en batchverwerking. Upgrade alleen naar krachtigere modellen voor specifieke toepassingen waarbij de kwaliteitsverbetering de kostenverhoging rechtvaardigt.

Houd alles bij. Schakel de kostenregistratie van LangSmith vroegtijdig in om inzicht te krijgen in verbruikspatronen voordat ze tot dure verrassingen leiden. Controleer het tokengebruik wekelijks tijdens de ontwikkeling en dagelijks in productie. Stel budgetwaarschuwingen in voordat de kosten de acceptabele drempelwaarden overschrijden.

Het allerbelangrijkste is om de zakelijke waarde af te wegen tegen de technische kosten. LLM-applicaties moeten problemen oplossen die meer waard zijn dan hun operationele kosten. Als de rekensom niet klopt – als de API-kosten de gegenereerde waarde overstijgen – zal geen enkele optimalisatie het project duurzaam maken. Maar wanneer de waarde de kosten overstijgt, biedt LangChain de tools om efficiënt te bouwen, te implementeren en te schalen.

Klaar om te beginnen met bouwen? Het LangChain-framework is nu volledig gratis beschikbaar. Test de mogelijkheden met het LangSmith Developer-abonnement, kies een kosteneffectief model voor de eerste experimenten en schaal je investering op naarmate je applicatie zijn waarde bewijst. Het framework maakt het mogelijk om vandaag nog te beginnen voor bijna geen kosten en in je eigen tempo naar een productieomgeving te groeien.