Korte samenvatting: De kosten voor LLM-servers variëren enorm: cloud-API's zoals OpenAI rekenen $0,03 tot $6 per miljoen tokens, afhankelijk van het model, terwijl zelfhosting jaarlijks $50.000 tot $287.000 kost voor een geschikte infrastructuur. Het break-evenpunt ligt doorgaans bij meer dan 500 miljoen tokens per maand voor implementaties op bedrijfsniveau. Kostenoptimalisatie hangt af van het gebruiksvolume, de behoeften op het gebied van gegevensprivacy en of u prioriteit geeft aan een minimale investering vooraf of aan besparingen op de lange termijn.

De economische aspecten van het beheren van grote taalmodellen zijn een cruciale zakelijke beslissing geworden. Volgens concurrerende gegevens zijn de bedrijfsuitgaven aan LLM API's in 2025 verdubbeld tot $8,4 miljard, maar veel organisaties vragen zich af of cloudproviders of zelfgehoste infrastructuur financieel gezien wel zinvol zijn.

Volgens concurrerende publicaties, die verwijzen naar het Enterprise AI-rapport van Kong uit 2025, noemen 44% organisaties gegevensprivacy en -beveiliging als de grootste belemmering voor de implementatie van LLM. Elke prompt die naar externe API's wordt verzonden, maakt verbinding met servers buiten de controle van de organisatie. Deze privacyzorgen drijven veel teams ertoe om zelf te hosten, maar de infrastructuurkosten brengen hun eigen financiële uitdagingen met zich mee.

De berekening is niet eenvoudig. Cloud-API's bieden geen opstartkosten, maar de kosten lopen op naarmate het gebruik toeneemt. Zelfhosting vereist een aanzienlijke kapitaalinvestering, maar belooft besparingen op de lange termijn. Het omslagpunt hangt af van het gebruiksvolume, de omvang van het model en de operationele vereisten.

Inzicht in LLM-prijsmodellen

Cloudproviders hanteren een tokengebaseerde prijsstelling als standaard. OpenAI rekent $0.03 per 1.000 inputtokens en $0.06 per 1.000 outputtokens voor GPT-4. GPT-3.5 Turbo is aanzienlijk goedkoper met $0.0015 per 1.000 inputtokens.

Maar wat betekent dat concreet voor de praktijk? Een enkel klantenservicegesprek kan 2.000 tot 5.000 tokens verbruiken. Schaal dat op naar duizenden gesprekken per dag en de kosten lopen snel op.

De kosten voor tokens variëren enorm tussen aanbieders en modellen. Volgens de documentatie van OpenAI kosten audiotokens in de Realtime API 1 token per 100 milliseconden voor gebruikersberichten, terwijl audio-uitvoer van spraakassistenten 1 token per 50 milliseconden kost. Deze verschillen tussen de modaliteiten zorgen voor een complexe prijsstelling die gemakkelijk onderschat kan worden.

Prijsstructuren van de belangrijkste cloudproviders

Amazon Bedrock hanteert een vergelijkbare prijsstructuur op basis van tokens, hoewel de tarieven afhankelijk zijn van het gekozen basismodel. De prijzen variëren per modaliteit, provider en modelniveau. Google Cloud's Vertex AI hanteert vergelijkbare prijsstructuren en biedt standaard PayGo-verbruiksopties die de doorvoercapaciteit aanpassen op basis van de uitgaven van de organisatie over periodes van 30 dagen.

Het zit echter wel zo: cloudprijzen gaan niet alleen over tarieven per token. Aanbieders hanteren gebruikstarieven, kortingen voor batchverwerking en regionale verschillen die directe vergelijkingen bemoeilijken.

Volgens de documentatie van OpenAI over kostenoptimalisatie bieden de Batch API en flexibele verwerking extra mechanismen voor kostenreductie bovenop de standaardprijzen. Batchverwerking kan de kosten verlagen voor workloads die niet tijdgevoelig zijn en waarbij de latentievereisten flexibel zijn.

| Aanbieder | Voorbeeldmodel | Invoerkosten (per 1 miljoen tokens) | Outputkosten (per 1 miljoen tokens) | Opvallende kenmerken |

|---|---|---|---|---|

| Open AI | GPT-4 | $30 | $60 | Realtime API, batchverwerking |

| Open AI | GPT-3.5 Turbo | $1.50 | $2.00 | Lagere kosten, snellere inferentie |

| Amazone-ondergrond | Diverse aanbieders | Verschilt per model. | Verschilt per model. | Toegang tot meerdere aanbieders |

| Google Vertex AI | Gemini-modellen | Verschilt per categorie | Verschilt per categorie | Op gebruik gebaseerde niveau-upgrades |

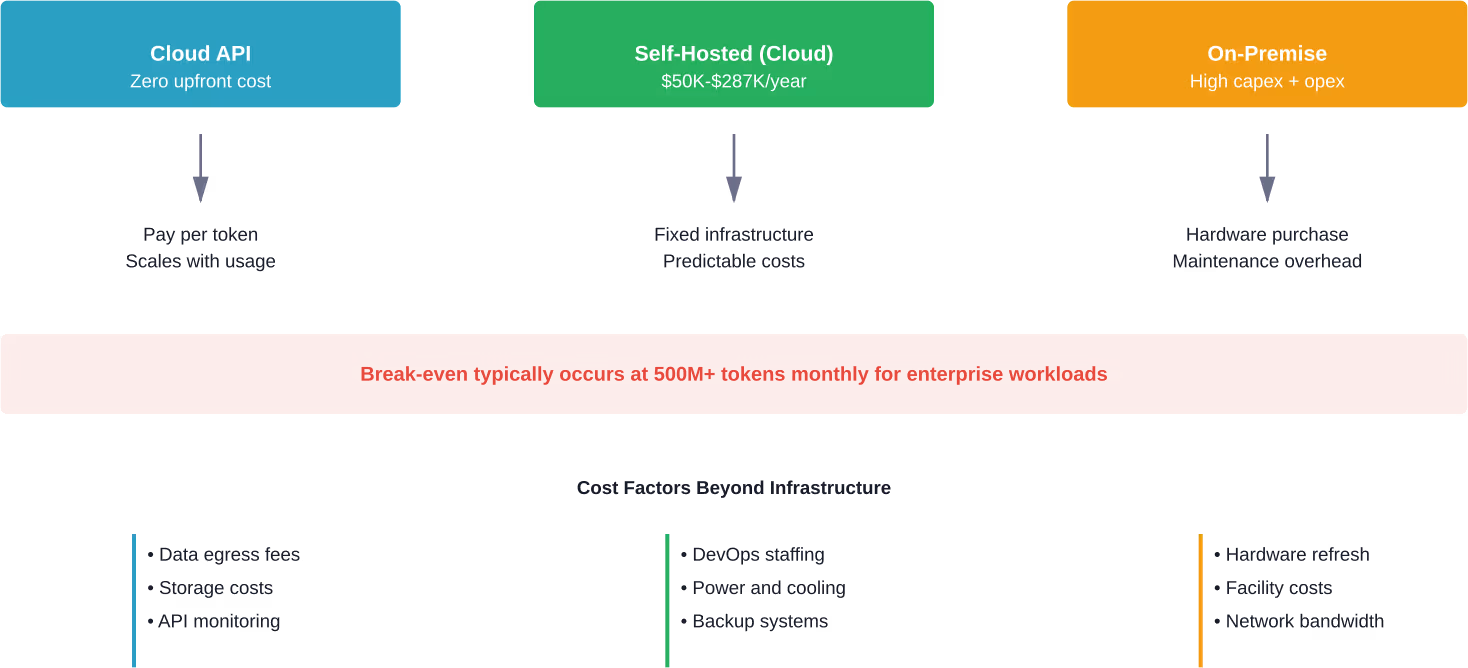

Verborgen kosten bij LLM-diensten in de cloud

De prijsstelling van tokens geeft slechts een deel van het financiële plaatje weer. Cloudimplementaties brengen kosten met zich mee die niet op de initiële prijspagina's worden weergegeven.

Bij het overdragen van grote hoeveelheden reacties lopen de kosten voor data-uitvoer op. Opslagkosten zijn van toepassing op gesprekslogboeken en trainingsdata. Monitoring- en observatietools brengen extra overhead met zich mee. Voor productiesystemen die een gegarandeerde doorvoer vereisen, vervangen prijsmodellen met gereserveerde capaciteit de pay-per-token-economie door vaste afspraken.

Discussies op platforms zoals LocalLLaMA laten frustratie zien over de onvoorspelbare kosten van de cloud. Gebruikspatronen die tijdens het testen redelijk lijken, kunnen in een productieomgeving volledig uit de hand lopen naarmate het aantal gelijktijdige gebruikers toeneemt.

Kosten voor zelfhosting van de infrastructuur

De belofte van zelfgehoste LLM's draait om kostenbesparingen op de lange termijn en controle over de gegevens. Maar de initiële investering is aanzienlijk en de operationele kosten blijven onbeperkt bestaan.

Uit discussies binnen de community blijkt dat het draaien van Qwen-2.5 32B of QwQ 32B op AWS g5.12xlarge-instances (4x A10G GPU's) jaarlijks ongeveer $50.000 kost bij continu gebruik. Llama-3 70B op p4d.24xlarge-instances (8x A100 GPU's) kost naar verluidt ongeveer $287.000 per jaar bij continu gebruik.

Die cijfers gaan uit van een cloudinfrastructuur. Hardware op locatie verandert de economische situatie volledig.

Hardwarevereisten en investeringskosten

De bandbreedte van moderne consumenten-CPU's – dual-channel DDR5-6400 met ongeveer 100 GB/s – blijft dramatisch achter bij de doorvoersnelheid van GPU's van meer dan 1,7 TB/s. Apple Silicon vormt een uitzondering met Unified Memory Architecture, dat een hogere bandbreedte biedt, maar het opschalen van Apple-hardware voor productieworkloads stuit op praktische beperkingen.

De vuistregel is ongeveer 0,5 GB VRAM per miljard parameters bij gebruik van 4-bits kwantisatie. Volledige precisie FP16 verdubbelt die vereiste. Een model met 70 miljard parameters in 4-bits kwantisatie heeft minimaal ongeveer 35 GB VRAM nodig. Het model moet in het VRAM passen voor een redelijke inferentiesnelheid; anders valt het systeem terug op CPU-verwerking, wat 10 tot 100 keer trager is.

Uit discussies binnen de community blijkt dat de minimale interne implementatiekosten variëren tussen 125.000 en 190.000 dollar per jaar, terwijl klantgerichte functionaliteiten van gemiddelde omvang 500.000 tot 820.000 dollar per jaar kosten. Kernproductengines op bedrijfsniveau gaan aanzienlijk verder dan deze bedragen.

Operationele kosten die verder gaan dan hardware

Infrastructuur is slechts het begin. Zelfhosting vereist bekwaam DevOps-personeel, doorlopend onderhoud, stroomvoorziening en koeling, back-upsystemen en netwerkinfrastructuur.

Het stroomverbruik van GPU-servers is aanzienlijk. Een systeem met 8 A100-processors kan onder belasting 3-5 kW verbruiken, wat neerkomt op $2.000-$4.000 aan jaarlijkse elektriciteitskosten, afhankelijk van de lokale tarieven. Koeling voegt daar nog eens 30-50% aan toe.

Maar wacht even. Hardware veroudert. GPU's verliezen snel hun restwaarde naarmate er nieuwere architecturen verschijnen. Een afschrijvingscyclus van drie jaar betekent dat de investeringskosten jaarlijks worden afgeschreven, plus eventuele vervangingskosten.

Uitsplitsing van de totale eigendomskosten

Om de kosten van cloudcomputing en zelfhosting te vergelijken, is het nodig de totale eigendomskosten over een realistische periode te berekenen. De analyse verandert aanzienlijk afhankelijk van het gebruiksvolume.

Voor applicaties met een laag volume die minder dan 10 miljoen tokens per maand verwerken, blijven cloud-API's economisch onverslaanbaar. Bij GPT-3.5 Turbo-tarieven van $1,50 per miljoen inputtokens blijven de maandelijkse kosten onder de $20. Geen enkele investering in infrastructuur is op deze schaal financieel rendabel.

De berekening verandert bij gemiddeld gebruik. Het maandelijks verwerken van 100 miljoen tokens op GPT-3.5 Turbo kost ongeveer $150-200. Over drie jaar is dat $5.400-7.200 – nog steeds ruim onder de minimale kosten voor een zelfgehoste infrastructuur.

Het break-evenpunt

Uit analyses blijkt dat het break-evenpunt voor bedrijfsimplementaties doorgaans ligt tussen de 500 miljoen en 1 miljard tokens per maand. Bij dit volume lopen de cloudkosten op tot 15.000-60.000 tokens per maand, afhankelijk van het gebruikte model. Op jaarbasis is dat 180.000-720.000 tokens per maand.

Zelf gehoste infrastructuur met jaarlijkse kosten van 125.000 tot 190.000 euro voor minimale implementatie begint economisch aantrekkelijk te worden. Over een periode van drie jaar kunnen on-premise oplossingen een besparing van 30 tot 50 biljoen euro opleveren ten opzichte van clouddiensten voor workloads met een hoog volume.

Klinkt dit bekend? Dit komt overeen met patronen die zijn gerapporteerd in analyses van de community waarin cloud- en on-premise-implementaties op grote schaal met elkaar werden vergeleken.

| Maandelijks tokenvolume | Kosten cloud-API (GPT-3,5) | Kosten van de cloud-API (GPT-4) | Schatting voor zelfhosting | Aanbevolen aanpak |

|---|---|---|---|---|

| 10 miljoen tokens | $15-20 | $300-600 | Niet van toepassing | Cloud API |

| 100 miljoen tokens | $150-200 | $3,000-6,000 | Niet van toepassing | Cloud API |

| 500 miljoen tokens | $750-1,000 | $15,000-30,000 | $10.400/maand | Overweeg zelfhosting. |

| 1 miljard+ tokens | $1,500-2,000 | $30,000-60,000 | $10.400-15.800/maand | Zelf hosten is waarschijnlijk goedkoper. |

Verborgen variabelen in TCO-berekeningen

Standaard break-evenanalyses negeren cruciale factoren. Vereisten op het gebied van gegevensbescherming kunnen zelfhosting afdwingen, ongeacht de kostenefficiëntie. Wettelijke naleving in de sectoren gezondheidszorg, financiën of overheid vereist vaak een infrastructuur op locatie.

Latentievereisten veranderen de situatie. API-aanroepen in de cloud introduceren netwerkvertraging. Voor realtime-applicaties die responstijden van minder dan 100 ms vereisen, wordt lokale inferentie noodzakelijk, ongeacht de kostenoverwegingen.

Modelaanpassing voegt een extra dimensie toe. Cloudproviders bieden beperkte mogelijkheden voor fijnafstelling. Organisaties die uitgebreide modelaanpassingen nodig hebben, vereisen een infrastructuur die aangepaste trainingspipelines ondersteunt, wat de complexiteit en kosten aanzienlijk verhoogt.

Kostenoptimalisatiestrategieën

Ongeacht de gekozen implementatiemethode kunnen kostenoptimalisatietechnieken de LLM-kosten aanzienlijk verlagen. Volgens de documentatie over kostenoptimalisatie van OpenAI leveren verschillende strategieën consequent besparingen op.

Het tokenverbruik verminderen

Elke token kost geld. Het minimaliseren van tokengebruik verlaagt direct de kosten. Kortere prompts leveren dezelfde resultaten op tegen lagere kosten. Het verwijderen van onnodige context, voorbeelden en langdradige instructies vermindert het aantal tokens zonder dat de kwaliteit van de output daaronder lijdt.

Prompt engineering wordt een economische optimalisatieoefening. Het testen van verschillende promptformuleringen om identieke resultaten te bereiken met minder tokens genereert direct rendement op de investering (ROI). Een reductie van 20% in de gemiddelde promptlengte vertaalt zich direct in een kostenbesparing van 20%.

Het cachen van veelgebruikte context vermindert overbodige tokenverwerking. Veel providers ondersteunen nu prompt caching, waarbij herhaalde contextgedeelten niet meetellen voor de tokenlimieten bij volgende verzoeken.

Batchverwerking en asynchrone workloads

De Batch API van OpenAI biedt aanzienlijk lagere prijzen voor workloads die niet tijdsgevoelig zijn. Door verzoeken asynchroon te verwerken wanneer de latentievereisten flexibel zijn, worden substantiële kortingen ontsloten.

De Batch API accepteert bulkverzoeken die binnen 24 uur worden verwerkt. Voor taken zoals contentanalyse, dataverrijking of batchsamenvatting verlaagt deze aanpak de kosten met behoud van doorvoer.

Vergelijkbare mogelijkheden voor batchverwerking zijn beschikbaar bij verschillende aanbieders. Amazon SageMaker ondersteunt batchtransformaties. Google Vertex AI biedt batchvoorspellings-endpoints aan tegen lagere prijzen dan online inferentie.

Modelselectie en kwantisering

Kleinere modellen kosten minder per token en werken sneller. GPT-3.5 Turbo kost ongeveer 51 TP3T aan GPT-4-tarieven. Voor taken die binnen de mogelijkheden van kleinere modellen vallen, lopen de kostenbesparingen enorm op naarmate de schaal groter wordt.

Bij zelfgehoste implementaties verlaagt kwantisering de hardwarevereisten aanzienlijk. 4-bits kwantisering halveert de geheugenbehoefte in vergelijking met 8-bits, waardoor grotere modellen op gelijkwaardige hardware mogelijk zijn. Volgens technische discussies blijft de nauwkeurigheidsvermindering door kwantisering voor de meeste toepassingen minimaal.

Onderzoek gepubliceerd op arXiv onderzoekt LLM-begeleidingstechnieken waarbij kleine taalmodellen de meeste verzoeken afhandelen, terwijl grotere modellen alleen hints geven wanneer dat nodig is. Zelfs kleine hints (10-30% aan volledige LLM-reacties) leiden tot aanzienlijke nauwkeurigheidsverbeteringen. Deze hybride aanpak kan drastische kostenbesparingen opleveren met behoud van de kwaliteit van de output.

Optimaliseer de voor- en nadelen van cloud- versus zelfhosting voordat de kosten vastlopen.

De keuze tussen een cloudgebaseerde en een zelfgehoste LLM-infrastructuur is zelden alleen een prijsbeslissing. De kosten hangen af van hoe modellen worden getraind, geïmplementeerd en in de loop der tijd worden gebruikt, inclusief datapijplijnen, schaalstrategie en systeemefficiëntie. AI Superieur Het bedrijf ondersteunt de volledige levenscyclus, van gegevensvoorbereiding en modelselectie tot implementatie en optimalisatie, en helpt teams bij het ontwerpen van configuraties die aansluiten op het werkelijke gebruik in plaats van de theoretische capaciteit.

In de praktijk betekent dit vaak dat je moet bepalen waar de cloud zinvol is, waar zelfhosting gerechtvaardigd is en hoe je kunt voorkomen dat je in beide gevallen te veel betaalt. De focus ligt op het bouwen van systemen die betrouwbaar draaien in een productieomgeving, niet alleen op het vergelijken van infrastructuurkosten. Als je de cloud versus zelfhosting evalueert of de kosten al ziet stijgen, is het de moeite waard om je architectuur vroegtijdig te herzien. Neem contact op met AI Superieur om uw situatie te beoordelen voordat de kosten verder oplopen.

Optimalisatie van de infrastructuurprestaties

Bij zelfgehoste implementaties heeft het hardwaregebruik een directe invloed op de kostenefficiëntie. Volgens aankondigingen van AWS biedt Amazon SageMaker Large Model Inference Container v15, aangedreven door vLLM 0.8.4 met ondersteuning voor de vLLM V1-engine, de V1-engine, die een hogere doorvoer levert dan de vorige V0-engine.

De V1-engine bevat een asynchrone modus die direct integreert met vLLM's AsyncLLMEngine. Dit creëert een efficiëntere achtergrondloop die continu inkomende verzoeken verwerkt, wat resulteert in een hogere doorvoer dan de vorige Rolling-Batch-implementatie. Deze infrastructurele verbeteringen vertalen zich direct in kostenbesparingen doordat er meer inferentiecapaciteit uit gelijkwaardige hardware wordt gehaald.

Keuzes in hardwarearchitectuur

AWS Graviton-processors bieden kostenefficiënte alternatieven voor kleinere modellen. Analyse door AWS toont aan dat het uitvoeren van kleine taalmodellen op Graviton3-gebaseerde instanties (ml.c7g-serie) met llama.cpp voor Graviton-geoptimaliseerde inferentie en vooraf gekwantiseerde GGUF-formaatmodellen aanzienlijke kostenbesparingen oplevert voor geschikte workloads.

De A4 VM's van Google Cloud, gebaseerd op de NVIDIA Blackwell-architectuur, vertegenwoordigen de nieuwste optie voor hoge prestaties. Volgens casestudy's behaalde Baseten een kosten-prestatieverhouding die ruim 2251 TP3T beter was door populaire modellen zoals DeepSeek V3, DeepSeek R1 en Llama 4 Maverick op de A4-infrastructuur te draaien, vergeleken met hardware van de vorige generatie.

De hardwarekeuze hangt af van de modelgrootte en de doorvoereisen. Kleinere modellen met minder dan 13 miljard parameters draaien effectief op CPU-gebaseerde instanties. Middelgrote modellen (13 tot 70 miljard parameters) profiteren van configuraties met één of meerdere GPU's. Grote modellen met meer dan 70 miljard parameters vereisen configuraties met meerdere GPU's of strategieën voor modelparallellisatie.

Dynamische werkbelastingplanning

De Dynamic Workload Scheduler van Google Cloud optimaliseert het gebruik van resources bij wisselende verkeerspatronen. In plaats van continu te reserveren voor piekcapaciteit, schaalt dynamische planning resources op basis van de werkelijke vraag.

Deze mogelijkheid is vooral belangrijk voor workloads met aanzienlijke verkeersvariatie. Applicaties met dagelijkse of wekelijkse gebruikspatronen verspillen resources tijdens perioden met weinig verkeer bij statische provisioning. Dynamische scheduling kan de infrastructuurkosten met 40-60% verlagen voor workloads met een uitgesproken variabiliteit.

Praktische kostenvoorbeelden

Theoretische analyses schieten tekort. Werkelijke implementatiekosten bieden concrete referentiepunten.

In discussies binnen de community wordt gesproken over minimale productie-implementaties met jaarlijkse kosten van 125.000 tot 190.000 dollar. Dit is doorgaans bedoeld voor interne tools en een gematigd aanvraagvolume – duizenden aanvragen per dag in plaats van miljoenen.

Volgens dezelfde analyses verwerken klantgerichte functionaliteiten van gemiddelde omvang jaarlijks 1 TP4 TP500.000 tot 820.000 applicaties. Deze schaal kan aanzienlijk productieverkeer aan met acceptabele latentie en beschikbaarheidsgaranties.

Implementaties op bedrijfsniveau

Grote organisaties die LLM's als kernproductinfrastructuur gebruiken, melden kosten die deze bedragen ruimschoots overstijgen. Jaarlijkse investeringen van miljoenen dollars zijn gebruikelijk voor grote volumes, lage latentie en verspreide geografische regio's.

Onderzoek van arXiv naar de economische aspecten van inferentie levert basisberekeningen op. Neem bijvoorbeeld de A800 80GB: onder gangbare aannames bedragen de basiskosten per kaart ongeveer $0,79/uur, meestal tussen de $0,51 en 0,99/uur. Grote cloudplatforms rekenen doorgaans een veelvoud van dit basistarief om de operationele overhead en marge te dekken.

Deze kosten per kaart lopen op naarmate er meer GPU's nodig zijn voor grotere modellen. Een implementatie met 8 GPU's verbruikt ongeveer 1 TP4T6,32 per uur bij een basistarief, wat neerkomt op 1 TP4T55.366 per jaar bij continu gebruik – nog voordat de kosten voor stroom, koeling, netwerk of personeel worden meegerekend.

Een vergelijking tussen cloud en on-premise op grote schaal.

Uit een analyse die de economische aspecten van cloud versus on-premise vergelijkt, blijkt dat on-premise systemen die een vergelijkbare capaciteit leveren als grootschalige cloudimplementaties, ongeveer $833.806 aan initiële kapitaalkosten vereisen voor op H100 gebaseerde infrastructuur.

Over een periode van drie jaar wordt deze kapitaalinvestering afgeschreven tot ongeveer $277.935 per jaar. Tel daar de operationele kosten bij op – energie, koeling, onderhoud, personeel – en de totale jaarlijkse kosten lopen op tot $350.000-450.000 voor een bedrijfsbrede implementatie op locatie.

Vergelijk dat eens met de kosten van cloud-API's bij vergelijkbare volumes. Het verwerken van 5 miljard tokens per maand op GPT-4 kost ongeveer 150.000-300.000 tokens per maand, of 1,8-3,6 miljoen tokens per jaar. Het break-evenpunt voor een on-premise oplossing wordt bij deze schaal duidelijk.

| Implementatiescenario | Jaarlijkse kosten voor cloud-API | Jaarlijkse kosten voor zelfgehoste cloud | Jaarlijkse kosten voor gebruik op locatie |

|---|---|---|---|

| Klein (100 miljoen tokens/maand) | $2,400 | Niet economisch | Niet economisch |

| Gemiddeld (500 miljoen tokens/maand) | $12,000-360,000 | $125,000-190,000 | $350,000-450,000 |

| Groot (2 miljard tokens per maand) | $48,000-1.4M | $287,000-400,000 | $350,000-450,000 |

| Enterprise (5 miljard+ tokens/maand) | $1.8M-3.6M | $400,000-600,000 | $400,000-550,000 |

Kosten voor gegevensprivacy en naleving

Financiële analyse alleen geeft geen volledig beeld van het besluitvormingsproces. Gegevensbescherming en wettelijke voorschriften stellen eisen die prevaleren boven pure kostenoptimalisatie.

Zorginstellingen die onder de HIPAA-regelgeving vallen, worden geconfronteerd met strenge eisen voor de verwerking van gegevens. Het verzenden van patiëntinformatie naar externe API's brengt compliance-uitdagingen met zich mee die buitengewoon complex of kostbaar kunnen zijn om op te lossen. Zelfhosting wordt dan verplicht, ongeacht de kosteninefficiëntie bij lagere volumes.

De financiële sector ondervindt vergelijkbare beperkingen door regelgeving zoals de AVG, PCI-DSS en sectorspecifieke eisen. De kosten van nalevingsschendingen – zowel financiële boetes als reputatieschade – overtreffen de infrastructuurkosten ruimschoots.

De waarde van privacy kwantificeren

Hoeveel is gegevensprivacy financieel waard? Deze berekening hangt af van de zakelijke context. Voor consumententoepassingen die niet-gevoelige gegevens verwerken, zijn de privacyvoordelen mogelijk minimaal. Voor bedrijven die bedrijfseigen informatie, intellectueel eigendom of gereguleerde gegevens beheren, wordt de privacywaarde aanzienlijk.

Sommige organisaties accepteren 2-3 keer hogere kosten voor zelfgehoste infrastructuur puur vanwege data-soevereiniteit. Andere organisaties vereisen volledig geïsoleerde implementaties zonder externe connectiviteit, ongeacht de bijbehorende kosten.

Het feit dat 44% van de organisaties gegevensprivacy als een van de grootste belemmeringen voor de invoering van LLM noemt, weerspiegelt deze afweging. Kostenefficiëntie is belangrijk, maar niet ten koste van essentiële beveiligings- en compliance-vereisten.

Langetermijnkostentrends

De economie van LLM blijft zich snel ontwikkelen. De inferentiekosten zijn aanzienlijk gedaald dankzij verbeterde algoritmische efficiëntie en geavanceerdere hardware.

Onderzoek van MIT naar de efficiëntie van algoritmen en de dalende inferentiekosten van AI heeft aangetoond dat trends in gesloten gewichtsmodellen iets sneller verlopen dan trends in open gewichtsmodellen. Dit is met name het geval bij gesloten gewichtsmodellen in de groep 40%-60%, waar plotselinge prijsdalingen voorkomen die niet terug te vinden zijn in open gewichtsmodellen, wat wijst op niet-technische concurrentie-effecten.

De wet van Moore en AI-versnelling

De hardwareprestaties blijven verbeteren. NVIDIA's Blackwell-architectuur levert aanzienlijke prestatieverbeteringen ten opzichte van eerdere generaties. Google's TPU-ontwikkelingen en gespecialiseerde AI-acceleratoren van startups zorgen voor voortdurende prestatieverbeteringen.

Deze hardwareverbeteringen verlagen de kosten op twee manieren. Ten eerste levert nieuwere hardware een hogere inferentiedoorvoer per geïnvesteerde dollar. Ten tweede zorgt de concurrentie tussen cloudproviders voor prijsdruk, wat gunstig is voor de klanten.

Maar wacht even. Hardwareverbeteringen maken ook grotere, krachtigere modellen mogelijk. De overstap van GPT-3 naar GPT-4 bracht aanzienlijke capaciteitsvergrotingen met zich mee, maar ook hogere inferentiekosten. De trend naar grotere modellen kan de efficiëntiewinsten van de infrastructuur tenietdoen.

Open Source Model Ecosystem

Open-weight modellen van Meta, Mistral, Alibaba en anderen zorgen voor concurrentiedruk op de prijzen van propriëtaire modellen. Organisaties kunnen open modellen zoals Llama 4, DeepSeek of Qwen inzetten zonder API-kosten per token.

Deze dynamiek versnelt de kostenreductie voor organisaties die in staat zijn tot zelfhosting. Het verschil tussen de kosten van eigen API's en de kosten van zelfgehoste open modellen wordt groter naarmate de kwaliteit van het open model verbetert.

Uit de analyse blijkt dat de opvatting dat "open source LLM's" gratis zijn, een misvatting is. De modellen zelf hebben geen licentiekosten, maar de operationele kosten blijven aanzienlijk. De werkelijke besparingen komen voort uit het elimineren van kosten per token op voldoende schaal – niet uit een volledig kosteloze werking.

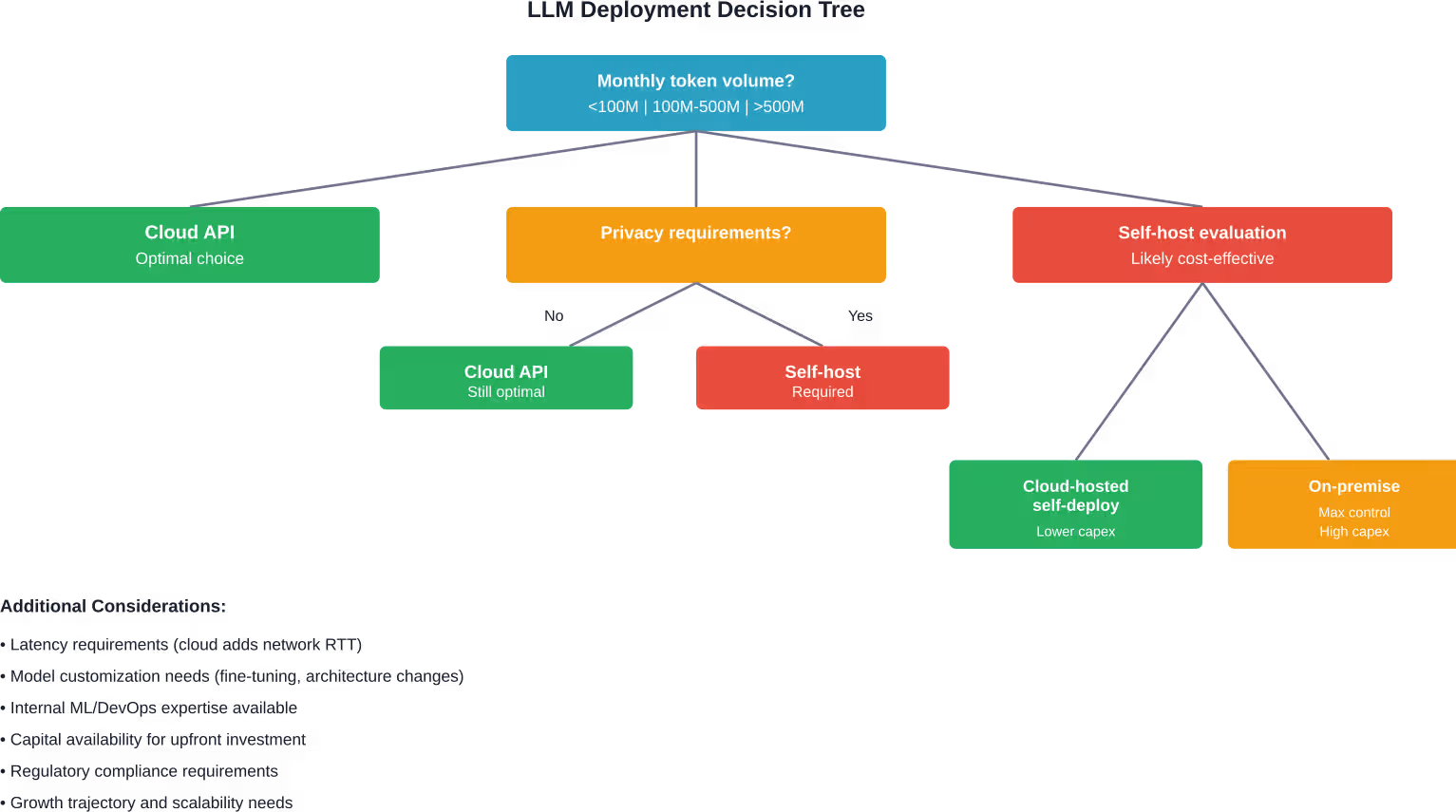

De keuze maken tussen zelf bouwen of kopen

Het korte antwoord? Dat hangt af van het volume, de mogelijkheden en de beperkingen.

Cloud-API's zijn uitermate geschikt voor onderzoek, prototyping en productie op kleine tot gemiddelde schaal. Geen investering vooraf, geen operationele complexiteit en directe toegang tot de nieuwste modellen bieden een ongeëvenaarde waarde voor de meeste toepassingen.

Zelf hosten wordt economisch haalbaar wanneer het maandelijkse tokenvolume consistent tussen de 500 miljoen en 1 miljard tokens ligt. Op deze schaal worden de infrastructuurkosten effectief afgeschreven en is de totale eigendomskost lager als je kiest voor eigen infrastructuur in plaats van API-kosten.

Besluitvormingskader

Houd systematisch rekening met de volgende factoren:

- Omvang en schaal: Bereken het huidige en verwachte tokenverbruik over een periode van 12 tot 36 maanden. Een break-evenanalyse vereist een tijdshorizon van meerdere jaren om de kapitaalinvesteringen correct af te schrijven.

- Gevoeligheid van de gegevens: Bepaal of privacyoverwegingen, wettelijke voorschriften of intellectuele-eigendomsrechten zelfhosting vereisen, ongeacht de kosten.

- Latentievereisten: Applicaties die responstijden van minder dan 100 ms vereisen, hebben mogelijk behoefte aan lokale inferentie, ongeacht de kostenefficiëntie.

- Behoeften aan modelaanpassing: Uitgebreide verfijning, voortdurende training of aanpassingen aan de modelarchitectuur vereisen een zelfgehoste infrastructuur met volledige toegang tot het model.

- Technische mogelijkheden: Zelfhosting vereist expertise op het gebied van machine learning, DevOps en infrastructuur. Organisaties die deze capaciteiten niet bezitten, worden geconfronteerd met aanzienlijke kosten voor het inhuren van personeel of consultancy, wat van invloed is op de totale eigendomskosten (TCO).

- Beschikbaar kapitaal: Infrastructuur op locatie vereist een aanzienlijke investering vooraf. Zelfimplementatie in de cloud verlaagt de kapitaalbehoefte en behoudt tegelijkertijd enkele kostenvoordelen ten opzichte van API's op grote schaal.

Veelgestelde vragen

Wat zijn de kosten voor het draaien van een LLM-server?

De kosten voor cloud-API's variëren van $0,0015 tot $6 per miljoen tokens, afhankelijk van het model. Zelfhosting vereist jaarlijks $50.000-$287.000 voor cloudinfrastructuur of $350.000-$550.000 voor implementatie op locatie, inclusief hardware, energie en operationele kosten. De kosten schalen mee met de omvang van het model, de doorvoervereisten en het gebruiksvolume.

Wanneer wordt het zelf hosten van LLM's goedkoper dan cloud-API's?

Het break-evenpunt ligt doorgaans rond de 500 miljoen tot 1 miljard tokens per maand voor bedrijfsimplementaties. Onder deze drempel blijven cloud-API's kosteneffectiever vanwege de afwezigheid van opstartkosten en de operationele eenvoud. Boven dit volume levert zelfgehoste infrastructuur een besparing op van 30 tot 501 tokens over een periode van drie jaar.

Wat zijn de verborgen kosten van het zelf organiseren van LLM-programma's?

Naast de kosten voor hardware en cloudinfrastructuur brengt zelfhosting ook kosten met zich mee voor DevOps-personeel, energieverbruik ($2.000-$4.000 per jaar voor grote GPU-systemen), koeling die 30-50% aan energiekosten toevoegt, back-upsystemen, netwerkbandbreedte, monitoringtools en afschrijving van hardware met vervangingscycli van 3-5 jaar.

Kan ik LLM-cursussen kosteneffectief vanuit huis volgen?

Kleinere modellen met parameters onder de 13B draaien op consumentenhardware tegen bescheiden kosten – voornamelijk elektriciteit, zo'n 50-200 euro per maand, afhankelijk van het verbruik en de lokale tarieven. Grotere modellen vereisen professionele GPU-configuraties die 3.000-15.000 euro aan hardware kosten, plus de doorlopende energiekosten. Voor persoonlijk gebruik en experimenten kan dit kosteneffectief zijn, maar voor productieomgevingen is een bedrijfsmatige infrastructuur vereist.

Hoe vergelijken de verschillende aanbieders van LLM-programma's zich qua prijs?

OpenAI rekent $30-60 per miljoen tokens voor GPT-4 en $1,50-2,00 voor GPT-3.5 Turbo. Amazon Bedrock en Google Vertex AI bieden vergelijkbare prijzen, met variaties afhankelijk van specifieke modellen en verbruiksniveaus. API's voor batchverwerking bieden kortingen van 30-50% voor niet-tijdgevoelige workloads bij de meeste aanbieders.

Welke factoren hebben de grootste invloed op de inferentiekosten van LLM?

Het tokenvolume is de belangrijkste kostenfactor voor cloud-API's. Bij zelfgehoste implementaties bepaalt de modelgrootte de hardwarevereisten, terwijl de doorvoerbehoeften de schaal van de infrastructuur bepalen. Kwantisering (4-bits versus 8-bits versus volledige precisie) heeft invloed op de geheugenvereisten en de hardwarekosten. Snelle engineering en cachingstrategieën kunnen het tokenverbruik met 15-40% verminderen.

Is het de moeite waard om open-source LLM's zelf te hosten?

Open source-modellen elimineren API-kosten per token, maar vereisen nog steeds investeringen in infrastructuur. Bij volumes onder de 100 miljoen tokens per maand blijven cloud-API's goedkoper. Boven de 500 miljoen tokens per maand leveren zelfgehoste open modellen aanzienlijke besparingen op, ondanks de operationele complexiteit. Vereisten op het gebied van gegevensprivacy kunnen zelfhosting rechtvaardigen, ongeacht het break-evenpunt qua kosten.

Conclusie

De kosten van LLM-servers vormen een genuanceerd besluitvormingskader, waarbij geen eenduidig antwoord geschikt is voor alle scenario's. Cloud-API's bieden ongeëvenaard gemak en kostenefficiëntie voor kleine tot middelgrote volumes. Zelfhosting vereist een aanzienlijke investering vooraf, maar levert op de lange termijn aanzienlijke besparingen op bij schaalvergroting.

Het break-evenpunt ligt doorgaans rond de 500 miljoen tokens per maand, hoewel privacyvereisten, latency-eisen en de behoefte aan modelaanpassingen de pure financiële optimalisatie kunnen overschaduwen. Organisaties moeten de totale eigendomskosten over meerdere jaren berekenen en daarbij rekening houden met verborgen operationele kosten die verder gaan dan de eenvoudige infrastructuurkosten.

Kostenoptimalisatiestrategieën – zoals prompt engineering, batchverwerking, modelselectie, kwantisering en caching – zijn van toepassing ongeacht de gekozen implementatiemethode en kunnen de kosten verlagen wanneer ze systematisch worden toegepast.

Vooruitkijkend zullen de inferentiekosten blijven dalen naarmate de hardware verbetert en de algoritmes efficiënter worden. Open-sourcemodellen creëren concurrentiedruk die organisaties ten goede komt die in staat zijn om op grote schaal zelf te hosten. Het besluitvormingskader blijft consistent: begin met cloud-API's, monitor de groei van het tokenverbruik en evalueer zelfhosting wanneer de volumes een investering in infrastructuur rechtvaardigen.

Bent u klaar om de kosten van LLM te optimaliseren voor uw specifieke gebruikssituatie? Bereken de verwachte tokenvolumes, beoordeel de vereisten voor gegevensprivacy en modelleer de totale eigendomskosten voor verschillende implementatieopties. De juiste keuze hangt af van uw unieke beperkingen, maar met realistische kosteninformatie wordt die beslissing een stuk duidelijker.