Resumen rápido: El framework LangChain es gratuito y de código abierto, pero el desarrollo de aplicaciones LLM implica costes por llamadas a la API de LLM (normalmente entre 0,25 y 75 TPP por millón de tokens), la plataforma de observabilidad LangSmith (entre 0 y 39 TPP mensuales por usuario), el alojamiento de la infraestructura y el tiempo de los desarrolladores. Los costes totales de desarrollo varían desde prácticamente cero para prototipos hasta más de 10 000 TPP mensuales para implementaciones en producción, dependiendo de la escala, el modelo elegido y la complejidad de las funcionalidades.

En 2026, la creación de aplicaciones con modelos de lenguaje complejos se generalizó, y LangChain sigue siendo uno de los frameworks más utilizados para orquestar flujos de trabajo LLM. Sin embargo, hay un aspecto que suele sorprender a los equipos: si bien el framework es gratuito, el costo total de desarrollo e implementación implica múltiples capas que no siempre son evidentes de antemano.

La estructura de precios no es sencilla. LangChain es de código abierto, por lo que no hay que pagar ninguna licencia. Sin embargo, los equipos pronto se topan con costes derivados de las llamadas a la API del modelo, las herramientas de observabilidad, las bases de datos vectoriales, la infraestructura de alojamiento y las horas de desarrollo necesarias para crear aplicaciones listas para producción.

Esta guía desglosa cada componente de costo para el desarrollo de aplicaciones LLM basadas en LangChain en 2026, desde la creación de prototipos iniciales hasta la ampliación a escala de producción.

Precios del framework LangChain: Los componentes principales

LangChain es completamente gratuito. El framework es de código abierto y está disponible sin costes de licencia. Esto se aplica tanto a las implementaciones en Python como en JavaScript, que los desarrolladores pueden instalar mediante pip o npm y usar de inmediato.

El marco proporciona componentes modulares para la creación de aplicaciones LLM: cadenas para la secuenciación de operaciones, agentes para la toma de decisiones autónoma, recuperadores para la búsqueda de documentos y sistemas de memoria para el contexto de las conversaciones. Ninguna de estas funcionalidades principales requiere pago a LangChain.

Sin embargo, el ecosistema de LangChain va más allá del marco principal. LangGraph, una biblioteca para crear flujos de trabajo multiagente con estado, también es de código abierto y gratuita. LangServe, que convierte cadenas en API desplegables, sigue el mismo modelo: su uso es gratuito, aunque la implementación de estas API requiere infraestructura en la nube con los consiguientes costes de alojamiento.

Plataforma de observabilidad de LangSmith: dónde comienzan los costos de suscripción

LangSmith es donde los equipos se topan con el primer coste directo del ecosistema LangChain. Esta plataforma proporciona capacidades de rastreo, depuración, evaluación y monitorización que resultan esenciales al pasar del prototipo a la producción.

Según la página oficial de precios de LangChain, LangSmith ofrece tres niveles a partir de 2026:

| Plan | Precio por asiento | Trazas de base incluidas | Retención de trazas | Mejor para |

|---|---|---|---|---|

| Revelador | $0/mes | 5.000 al mes | 14 días (base) | Desarrolladores independientes, creación de prototipos |

| Más | $39/mes | 10.000 al mes | 14 días (base), 400 días (prorrogado) | Equipos pequeños, aplicaciones de producción |

| Empresa | Precios personalizados | Asignación personalizada | retención personalizada | Grandes organizaciones, necesidades de cumplimiento |

El plan Desarrollador ofrece una licencia gratuita, lo que lo hace ideal para desarrolladores individuales que se inician en el sector. Incluye hasta 5000 trazas base mensuales, con precios de pago por uso para las trazas adicionales. Cada 1000 trazas base cuestan $2.50 y tienen un período de retención de 14 días.

Los registros extendidos, que conservan los datos durante 400 días, cuestan $5,00 por cada 1000 registros (el doble de la tarifa base). Para las aplicaciones que requieren observabilidad a largo plazo y registros de auditoría de cumplimiento, este coste puede acumularse considerablemente.

El plan Plus, con un precio de $39 por usuario al mes, es el más elegido por los equipos de producción. Incluye 10 000 registros base mensuales, agentes Fleet ilimitados para operaciones autónomas y soporte por correo electrónico. Los equipos pueden añadir usuarios ilimitados al mismo precio por usuario.

Entre las funciones adicionales de LangSmith se incluyen colas de anotación para recibir comentarios humanos, gestión de indicaciones a través de Prompt Hub y Playground, y monitorización con alertas. Estas herramientas no tienen costes adicionales, ya que están incluidas en los planes.

Costes de la API de LLM: La variable más importante en los presupuestos de producción

El gasto recurrente más significativo para las aplicaciones de LangChain es el costo de las llamadas a las API de LLM. Este costo supera con creces los costos de la infraestructura y las herramientas para cualquier aplicación que se ejecute a gran escala.

LangChain admite la integración con decenas de proveedores de modelos a través de su interfaz estandarizada. Cada proveedor tiene estructuras de precios diferentes según el consumo de tokens, la capacidad del modelo y funciones adicionales como el almacenamiento en caché o el procesamiento por lotes.

Panorama de precios de los modelos 2026

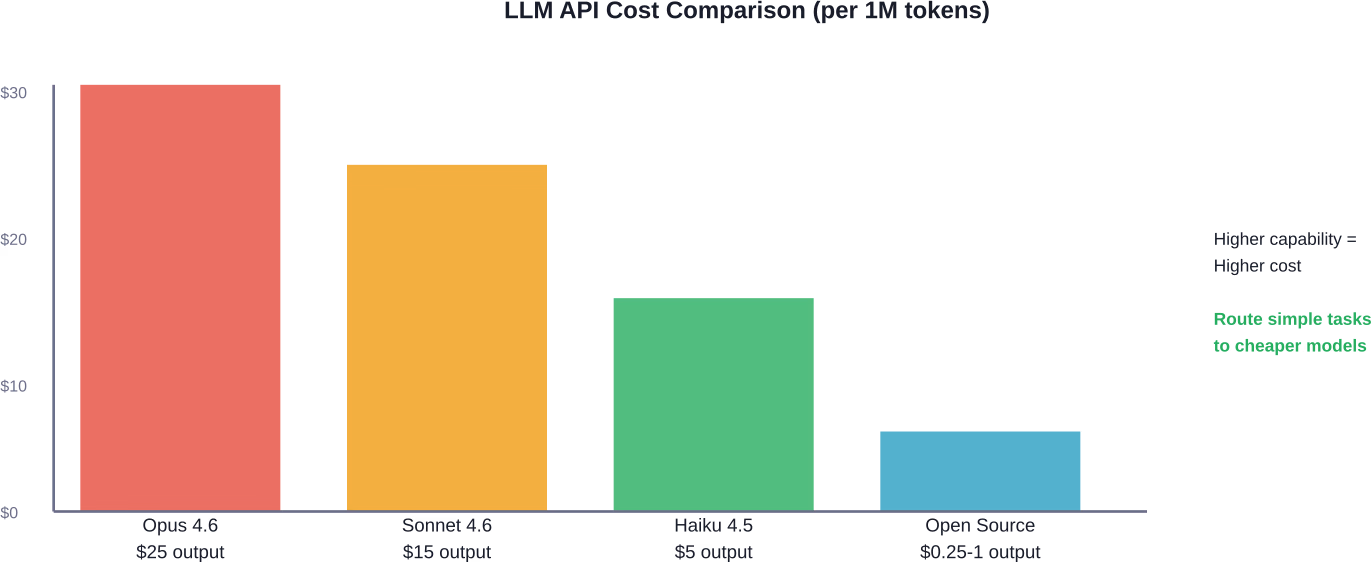

Los modelos Claude de Anthropic representan una opción común para las aplicaciones de LangChain. Según la documentación de precios reciente, los modelos Claude ofrecen estas tarifas representativas por millón de tokens (precios sujetos a cambios):

- Claude Opus 4.6: Entrada $5 / Salida $25

- Soneto 4.6 de Claude: Entrada $3 / Salida $15

- Claude Haiku 4.5: Entrada $0.25-$1 / Salida $1.25-$5

Los modelos heredados de la serie Claude 4.1 presentan precios más elevados, con Opus 4.1 a $15 de entrada / $75 de salida por millón de tokens. La evolución de los precios demuestra cómo las generaciones más recientes suelen ofrecer un mejor rendimiento a menor coste.

Los modelos de OpenAI siguen un sistema de precios similar basado en tokens, aunque las tarifas específicas para 2026 varían según la generación del modelo. Los modelos de la clase GPT-4 suelen costar entre $2.50 y $30 por millón de tokens de entrada, dependiendo del nivel de capacidad y el tamaño de la ventana de contexto.

Los modelos de código abierto más pequeños, a los que se accede a través de proveedores como Groq o que se alojan en infraestructuras como AWS Bedrock, pueden reducir sustancialmente los costes por token (a veces entre 80 y 951 TP3T en comparación con los modelos de vanguardia), aunque con las correspondientes limitaciones en cuanto a capacidades.

Estrategias de optimización de costos

El almacenamiento en caché de mensajes puede reducir los costos hasta en 90% para contextos repetidos. Cuando las aplicaciones procesan documentos similares o mantienen mensajes del sistema consistentes entre solicitudes, el almacenamiento en caché de las representaciones codificadas elimina los costos de procesamiento redundantes.

El procesamiento de API por lotes, cuando está disponible, suele ofrecer descuentos 50% en comparación con la inferencia en tiempo real. Las aplicaciones que pueden tolerar retrasos en las respuestas, como los procesos de procesamiento de documentos o los análisis nocturnos, se benefician significativamente de los precios por lotes.

La combinación de estas estrategias multiplica los ahorros. Según estudios sobre optimización de costes, los equipos que utilizan conjuntamente el almacenamiento en caché instantáneo y las API por lotes pueden reducir significativamente los costes totales de inferencia en comparación con el procesamiento estándar en tiempo real sin almacenamiento en caché.

El enrutamiento de modelos representa otro enfoque de optimización. Las arquitecturas jerárquicas en el procesamiento de documentos financieros lograron una precisión de arquitectura reflexiva del 97,71 TP3T con un costo del 60,91 TP3T, según datos de evaluación comparativa para flujos de trabajo especializados. Las aplicaciones LangChain pueden implementar una lógica similar para enrutar consultas simples a modelos más económicos, reservando los costosos modelos de vanguardia para tareas de razonamiento complejas.

Costos de infraestructura y servicios de apoyo

Más allá de las API de LLM y la capacidad de observación de LangSmith, las aplicaciones de LangChain requieren una infraestructura de soporte que incrementa el presupuesto total.

Costos de la base de datos vectorial

Las aplicaciones que utilizan la generación aumentada por recuperación requieren bases de datos vectoriales para almacenar y buscar incrustaciones de documentos. Algunas opciones populares son Pinecone, Weaviate, Qdrant y Chroma, cada una con diferentes modelos de precios.

Los servicios de bases de datos vectoriales gestionadas suelen cobrar en función del volumen de datos, el volumen de consultas y el nivel de rendimiento. Las aplicaciones pequeñas pueden mantenerse dentro de los niveles gratuitos que ofrecen 1 GB de almacenamiento y consultas limitadas. Las implementaciones en producción que manejan millones de vectores pueden generar costos mensuales de entre $50 y $500+, dependiendo de la escala y los requisitos de replicación.

Las bases de datos vectoriales autogestionadas eliminan los costos de suscripción, pero requieren la gestión de la infraestructura. Ejecutar Qdrant o Chroma en instancias de computación en la nube traslada el costo al alquiler del servidor y a los gastos operativos.

Costos del modelo de integración

La generación de incrustaciones para el almacenamiento vectorial conlleva sus propios costes de API, aunque suelen ser mucho menores que los de la inferencia LLM. El modelo text-embedding-3-large de OpenAI cuesta aproximadamente $0.13 por millón de tokens, mientras que los modelos de incrustación más pequeños cuestan aún menos.

Para aplicaciones que procesan grandes colecciones de documentos, los costos de incrustación pueden acumularse. Procesar 10 millones de tokens de documentación costaría aproximadamente $1.30 con las API de incrustación estándar, una cantidad insignificante en comparación con los costos de LLM, pero que vale la pena monitorear para lograr precisión presupuestaria.

Alojamiento de aplicaciones

El despliegue de aplicaciones LangChain requiere recursos informáticos. Los chatbots sencillos pueden ejecutarse en plataformas sin servidor como Vercel o AWS Lambda con costes mínimos inferiores a $20 mensuales. Los sistemas de agentes más complejos, con funcionamiento continuo y gestión de estado, necesitan servidores persistentes.

Los costos de computación en la nube varían considerablemente según los requisitos. Un despliegue básico en contenedores en servicios como Render o Railway comienza en torno a $7-$25 mensuales para instancias pequeñas. Los sistemas de producción con escalado automático, balanceo de carga y alta disponibilidad pueden alcanzar entre $200 y más de $2000 mensuales, dependiendo del tráfico y la complejidad.

Inversión del equipo de desarrollo: El componente de costo oculto

El tiempo que dedican los desarrolladores representa una parte importante del coste total del proyecto, aunque a menudo se pasa por alto al centrarse en los gastos de infraestructura y API.

Crear una aplicación básica de LangChain (un chatbot RAG sencillo o un sistema de preguntas y respuestas sobre documentos) suele requerir entre 40 y 80 horas de trabajo para un desarrollador familiarizado con Python y los conceptos de LLM. Con tarifas contractuales estándar de $75-$150 por hora, esto se traduce en una inversión en desarrollo de entre $3.000 y $12.000.

Los sistemas multiagente complejos con herramientas personalizadas, gestión de memoria sofisticada y manejo de errores de nivel de producción pueden requerir entre 200 y 500 horas o más de desarrollo. Para los equipos que crean flujos de trabajo agentes propios, la inversión en desarrollo puede alcanzar fácilmente entre $20 000 y $75 000 antes de que la aplicación procese una sola solicitud de producción.

El mantenimiento continuo incrementa este total. Las API de LLM evolucionan rápidamente: algunos modelos se vuelven obsoletos y se lanzan nuevas versiones con frecuencia. Mantener las aplicaciones actualizadas, supervisar la degradación del rendimiento y optimizar las indicaciones a medida que cambia el comportamiento del modelo requiere una atención constante por parte de los desarrolladores.

Ejemplos de presupuestos reales: del prototipo a la producción.

Comprender los componentes abstractos de los costos es útil, pero los escenarios presupuestarios reales proporcionan una guía de planificación más clara.

Escenario 1: Prototipo de desarrollador individual

Un único desarrollador está creando una herramienta de análisis de documentos como prueba de concepto:

- Marco de trabajo LangChain: $0

- Plan del desarrollador LangSmith: $0 (5.000 trazas/mes)

- Uso de la API de Claude Haiku (50.000 consultas, salida promedio de 2k tokens): ~$500/mes

- Base de datos de vectores (Chroma autoalojada): $0

- Alojamiento (nivel de aficionado al ferrocarril): $0-$5/mes

- Tiempo de desarrollo (60 horas autofinanciadas): No facturado

Coste mensual recurrente total: ~$505. Inversión inicial en desarrollo: 60 horas de tiempo de desarrollador.

Escenario 2: Bot de soporte al cliente para equipos pequeños

Una startup que está desarrollando un asistente interno de atención al cliente con 3 miembros en su equipo:

- Marco de trabajo LangChain: $0

- Plan LangSmith Plus (3 plazas): $117/mes

- Uso de la API de Claude Sonnet (200.000 consultas, salida promedio de 1.500 tokens): ~$4.500/mes

- Base de datos de vectores Pinecone (plan inicial): $70/mes

- Alojamiento en AWS (despliegue en contenedores): $150/mes

- Tiempo de desarrollo (200 horas iniciales en todo el equipo a razón de $75-$150/hora): $15.000-$30.000 por única vez

- Optimización continua (10 horas/mes): $750-$1.500/mes

Costo mensual recurrente total: ~$5,587-$6,337. Inversión inicial en desarrollo: $15,000-$30,000.

Escenario 3: Canalización de procesamiento de documentos empresariales

Una gran organización que procesa miles de documentos financieros diariamente:

- Marco de trabajo LangChain: $0

- Plan LangSmith Enterprise (25 puestos): ~$3.000+/mes (precios personalizados)

- Enrutamiento multimodo (Opus para procesamiento complejo, Haiku para procesamiento simple, procesamiento por lotes): ~$15.000/mes

- Base de datos de vectores (gestionada, de alta disponibilidad): $800/mes

- Infraestructura en la nube (autoescalado, redundancia): $2.500/mes

- Equipo de desarrollo (versión inicial, 500 horas): $50.000-$100.000 por única vez

- Desarrollo y optimización continuos (40 horas/mes): $3.000-$6.000/mes

Costo mensual recurrente total: ~$24,300-$27,300. Inversión inicial de desarrollo: $50,000-$100,000.

Seguimiento de costes y gestión presupuestaria

Gestionar los costes de las aplicaciones LLM requiere visibilidad sobre los patrones de consumo de tokens. LangSmith ofrece funcionalidades integradas de seguimiento de costes que se integran con las aplicaciones de LangChain.

Según la documentación oficial de seguimiento de costes, LangSmith calcula los costes basándose en los metadatos de uso de los tokens y en modelos de precios configurables. Los equipos pueden establecer precios de entrada y salida por millón de tokens para cada modelo, con soporte para desgloses detallados por tipo de token.

Para las aplicaciones que utilizan OpenAI, Anthropic o modelos compatibles con OpenAI, el seguimiento de costes se realiza automáticamente al usar integraciones de LangChain o adaptadores de LangSmith. La plataforma lee el número de tokens de las respuestas de la API y aplica reglas de precios para calcular los costes de ejecución.

Las estructuras de costos personalizadas, como los precios no lineales o los descuentos específicos del proveedor, requieren la anotación manual de los costos. Los equipos pueden adjuntar metadatos de costos a los registros mediante programación cuando el cálculo automático no coincide con la facturación real.

El cálculo de costos funciona de forma voraz, desde los tipos de tokens más específicos hasta los menos específicos. Si el precio define $2 por millón de tokens de entrada con una tasa detallada de $1 por millón de tokens leídos en caché, y una ejecución utiliza 20 tokens de entrada, 5 de ellos de la caché, el sistema cobra $1 por millón por los 5 tokens almacenados en caché y $2 por millón por los 15 tokens de entrada estándar restantes.

Comparación de LangChain con marcos de trabajo alternativos

Las consideraciones de costos se extienden a la selección del marco de trabajo. LangChain compite con alternativas como el SDK de IA de Vercel y el uso directo del SDK de OpenAI, cada una con diferentes implicaciones de costos.

El SDK de IA de Vercel se centra en la transmisión de datos y el despliegue en el borde de la red, optimizado para aplicaciones Next.js. El framework es gratuito, al igual que LangChain. Sin embargo, no incluye observabilidad integrada como LangSmith, por lo que requiere soluciones de monitorización independientes que pueden tener sus propios costes.

El SDK de OpenAI proporciona acceso directo a los modelos de OpenAI con una abstracción mínima. Esto elimina la sobrecarga del framework, pero requiere la implementación personalizada de las funcionalidades que LangChain ofrece de forma predeterminada: composición de cadenas, gestión de memoria e integración de herramientas. El ahorro de tiempo de desarrollo que supone usar LangChain suele compensar cualquier mejora marginal en el rendimiento derivada del uso directo del SDK.

Semantic Kernel de Microsoft ofrece capacidades de orquestación similares con una estrecha integración con Azure. Los equipos que ya utilizan el ecosistema de Azure pueden considerar los servicios integrados mediante la integración de Semantic Kernel con Azure, aunque el framework en sí también es de código abierto y gratuito, al igual que LangChain.

| Estructura | Licencia básica | Observabilidad | Mejor para | Perfil de costos |

|---|---|---|---|---|

| LangChain | Gratuito/Abierto | LangSmith ($0-$39+/asiento) | Agentes complejos, RAG | API de LLM + herramientas opcionales |

| SDK de IA de Vercel | Gratuito/Abierto | Se requiere la participación de terceros. | Edge streaming, Next.js | API de LLM + SaaS de monitorización |

| SDK de OpenAI | Gratuito/Abierto | Implementación personalizada | Aplicaciones sencillas que solo utilizan OpenAI | API de LLM + tiempo de desarrollo |

| Núcleo semántico | Gratuito/Abierto | Azure Application Insights | Implementaciones nativas de Azure | API de LLM + servicios de Azure |

Deuda técnica y consideraciones sobre costos a largo plazo

Elegir un framework bien adoptado como LangChain puede reducir ciertos riesgos asociados con los frameworks abandonados.

Sin embargo, la rápida evolución del framework plantea desafíos en la gestión de versiones. LangChain lanza periódicamente cambios incompatibles con versiones anteriores a medida que cambia el panorama de LLM. Los equipos deben presupuestar el trabajo de actualización periódica, ya que LangChain lanza cambios incompatibles con versiones anteriores y nuevas funcionalidades.

Las investigaciones indican que la deuda técnica autodeclarada aparece en entre 2,41 y 311 millones de copias de código fuente de proyectos de código abierto, a menudo introducida por desarrolladores experimentados. En el caso específico de las aplicaciones LLM, la deuda se acumula en torno a la gestión oportuna, las metodologías de evaluación y la fijación de versiones del modelo; áreas en las que herramientas como LangSmith aportan valor, pero a un coste de suscripción.

Cómo realizar el cálculo del retorno de la inversión (ROI)

Que los costes de desarrollo de LangChain sean financieramente viables depende del valor comercial que generen. Un bot de atención al cliente que gestiona 1000 consultas diarias y reduce el volumen de tickets de soporte en 30% podría justificar $5000 mensuales en costes operativos si ahorra $20 000 en salarios de agentes de soporte.

Los flujos de procesamiento de documentos requieren un análisis similar. Si una empresa procesa 10 000 documentos financieros al mes y la automatización LLM reduce el tiempo de revisión de 15 minutos a 3 minutos por documento, el ahorro laboral —2000 horas mensuales a una tarifa de $50/hora— ascendería a $100 000. Incluso el uso de modelos costosos, a una tarifa mensual de $20 000, muestra un claro retorno de la inversión.

Los prototipos y los MVP requieren cálculos diferentes. Invertir $5000 en desarrollo para validar la adecuación del producto al mercado antes de comprometerse con el despliegue a gran escala tiene sentido. Invertir $50 000 en un prototipo sin validación por parte de los usuarios no lo tiene.

La clave reside en que los costes de LangChain y LangSmith son problemas de optimización, no gastos fijos. Los equipos controlan la selección del modelo, las estrategias de almacenamiento en caché, el uso del procesamiento por lotes y las opciones de infraestructura. El marco ofrece flexibilidad para empezar con un presupuesto ajustado y escalar estratégicamente a medida que se demuestra su valor para el negocio.

Mantén la eficiencia de tus proyectos LangChain desde el primer día.

LangChain suele parecer sencillo al principio, pero los costes tienden a aumentar una vez que las cadenas, las indicaciones y las llamadas al modelo se utilizan a gran escala en un uso real. IA superior Trabaja en la capa de aplicación LLM completa que respalda marcos como LangChain: selección de modelos, ajuste fino, configuración de recuperación e implementación. El enfoque no está en el marco en sí, sino en la creación de sistemas donde las llamadas a modelos, los flujos de datos y la infraestructura se alinean con el caso de uso real. Esto mantiene el uso de tokens bajo control y evita canalizaciones que generan carga innecesaria.

La mayoría de los problemas de costos en las configuraciones de LangChain provienen de cómo está diseñado el sistema, no de la herramienta que elija. Si desea evitar cadenas sobredimensionadas y costos de inferencia crecientes, contáctenos. IA superior y revise la configuración de su aplicación LLM antes de que se implemente a gran escala.

Preguntas frecuentes

¿Es LangChain completamente gratuito?

Sí, el framework LangChain es de código abierto y gratuito. No hay costos de licencia, tarifas de uso ni requisitos de suscripción para el framework principal, LangGraph o LangServe. Sin embargo, el desarrollo de aplicaciones implica costos por llamadas a la API de LLM, la plataforma de observabilidad LangSmith (opcional) y el alojamiento de la infraestructura.

¿Cuánto cuesta LangSmith para aplicaciones de producción?

LangSmith ofrece un plan gratuito para desarrolladores con 5000 trazas al mes, ideal para desarrolladores individuales y prototipos. El plan Plus cuesta $39 por usuario al mes e incluye 10 000 trazas mensuales, lo que lo hace adecuado para equipos pequeños e implementaciones en producción. Los precios para empresas se personalizan según la escala y los requisitos. Las trazas adicionales que superen los límites del plan cuestan entre $2,50 y $5,00 por cada 1000 trazas, dependiendo del período de retención.

¿Cuáles son los costes típicos de la API LLM para una aplicación LangChain?

Los costos de la API de LLM varían drásticamente según el modelo elegido y el volumen de uso. Claude Haiku cuesta entre $0.25 y $5 por millón de tokens, Sonnet entre $3 y $15 por millón, y Opus entre $5 y $25 por millón. Un pequeño chatbot que procesa 50 000 consultas mensuales con un promedio de 2000 tokens de salida podría costar entre $500 y $2500 mensuales, dependiendo del nivel del modelo. Las aplicaciones empresariales pueden alcanzar entre $10 000 y más de $50 000 mensuales a gran escala.

¿Puedo reducir los costes del máster en Derecho sin sacrificar la calidad?

Sí, mediante diversas estrategias de optimización. El almacenamiento en caché de mensajes instantáneos puede reducir los costos hasta en 90% para contextos repetidos. El procesamiento de API por lotes ofrece descuentos de 50% para cargas de trabajo que no son en tiempo real. El enrutamiento de modelos —que utiliza modelos más económicos para tareas sencillas y modelos costosos solo para razonamientos complejos— puede reducir los costos entre 40 y 60% manteniendo una precisión superior a 95%. La combinación de estas técnicas permite lograr una reducción significativa de costos en comparación con las implementaciones no optimizadas.

¿Necesito LangSmith para usar LangChain en producción?

No, LangSmith es opcional. Las aplicaciones de LangChain funcionan perfectamente sin suscripciones a LangSmith. Sin embargo, LangSmith proporciona capacidades críticas de observabilidad, depuración y evaluación que resultan valiosas para las implementaciones en producción. Los equipos pueden comenzar sin él y agregar LangSmith cuando la complejidad o la escala de la aplicación dificulten la depuración y la monitorización. El plan gratuito para desarrolladores ofrece un seguimiento limitado para probar estas capacidades.

¿Cuánto debería presupuestar para el desarrollo de LangChain?

Los costos de desarrollo dependen de la complejidad de la aplicación. Los chatbots simples o los sistemas de preguntas y respuestas sobre documentos generalmente requieren de 40 a 80 horas de desarrollo ($3,000-$12,000 a tarifas estándar). Los sistemas multiagente complejos con herramientas personalizadas y flujos de trabajo sofisticados pueden requerir de 200 a 500+ horas ($15,000-$75,000+). El mantenimiento continuo agrega de 5 a 40 horas mensuales según la escala. Los costos operativos mensuales oscilan entre $500 para prototipos y $25,000+ para implementaciones empresariales, con el uso de la API LLM representando de 55 a 99% de gastos recurrentes.

¿Hay costes ocultos que deba tener en cuenta?

Los costos que suelen pasarse por alto incluyen las suscripciones a bases de datos vectoriales para aplicaciones RAG ($0-$500+ mensuales), los costos de integración de API para el procesamiento de documentos ($0.10-$0.30 por millón de tokens), el alojamiento de infraestructura más allá de los niveles gratuitos sin servidor ($20-$2,000+ mensuales) y el tiempo de los desarrolladores para la optimización continua de avisos y actualizaciones de modelos (10-40 horas mensuales). Los equipos también suelen subestimar el consumo de tokens durante el desarrollo y las pruebas, lo que puede añadir 20-50% a las estimaciones presupuestarias iniciales.

Planificando tu presupuesto de desarrollo de LangChain

Para desarrollar aplicaciones LLM con LangChain en 2026, es necesario comprender las diversas capas de costos. Si bien el marco de trabajo en sí elimina los gastos de licencia, el costo total de propiedad incluye el consumo de la API de LLM, las herramientas de observabilidad opcionales, la infraestructura de soporte y la inversión de los desarrolladores.

Comienza con la versión gratuita. El framework de código abierto de LangChain y el plan para desarrolladores de LangSmith permiten a los equipos crear prototipos y validar conceptos sin costes iniciales. Esta fase de exploración sin riesgos ayuda a determinar si la aplicación genera suficiente valor como para justificar la inversión en producción.

Planifique el presupuesto para la escalabilidad gradualmente. Comience con modelos más económicos como Claude Haiku o alternativas más pequeñas. Implemente el almacenamiento en caché de mensajes instantáneos y el procesamiento por lotes desde el principio. Actualice a modelos más potentes solo para casos de uso específicos donde la mejora de la calidad justifique el aumento de costos.

Controla todo. Activa el seguimiento de costes de LangSmith cuanto antes para comprender los patrones de consumo antes de que se conviertan en sorpresas costosas. Revisa el uso de tokens semanalmente durante el desarrollo y diariamente en producción. Configura alertas de presupuesto antes de que los costes superen los umbrales aceptables.

Lo más importante es medir el valor comercial en relación con los costos técnicos. Las aplicaciones LLM deben resolver problemas cuyo valor supere sus gastos operativos. Si los números no cuadran —si los costos de la API superan el valor generado— ninguna optimización garantizará la sostenibilidad del proyecto. Pero cuando el valor supera el costo, LangChain proporciona las herramientas para construir, implementar y escalar de manera eficiente.

¿Listo para empezar a desarrollar? El framework LangChain ya está disponible, completamente gratis. Prueba sus posibilidades con el plan LangSmith Developer, elige un modelo económico para tus experimentos iniciales y aumenta tu inversión a medida que tu aplicación demuestre su valía. El framework te permite empezar hoy mismo con un coste casi nulo y llegar a producción a tu propio ritmo.