Resumen rápido: Los costos de los servidores LLM varían drásticamente: las API en la nube como OpenAI cobran entre $0.03 y $6 por millón de tokens, según el modelo, mientras que el autoalojamiento requiere entre $50,000 y $287,000 anuales para una infraestructura capaz. El punto de equilibrio generalmente se alcanza con más de 500 millones de tokens mensuales para implementaciones empresariales. La optimización de costos depende del volumen de uso, las necesidades de privacidad de datos y si se prioriza una inversión inicial mínima o el ahorro a largo plazo.

La viabilidad económica de gestionar grandes modelos de lenguaje se ha convertido en una decisión empresarial crucial. Según datos de la competencia, el gasto empresarial en API para modelos de lenguaje se duplicó hasta alcanzar los 8.400 millones de dólares en 2025; sin embargo, muchas organizaciones se preguntan si los proveedores de servicios en la nube o la infraestructura autogestionada resultan financieramente viables.

Según el contenido de la competencia, que cita el informe de IA empresarial de Kong de 2025, el 441 % de las organizaciones citan la privacidad y la seguridad de los datos como la principal barrera para la adopción de LLM. Cada solicitud enviada a las API externas pasa por servidores que están fuera del control de la organización. Esta preocupación por la privacidad impulsa a muchos equipos a optar por el autoalojamiento, pero los costos de infraestructura generan sus propios desafíos financieros.

Las matemáticas no son sencillas. Las API en la nube no ofrecen costos iniciales, pero generan gastos crecientes a gran escala. El autoalojamiento requiere una inversión de capital sustancial, pero promete ahorros a largo plazo. El punto de equilibrio depende del volumen de uso, el tamaño del modelo y los requisitos operativos.

Comprensión de los modelos de precios de los programas de maestría en derecho (LLM)

Los proveedores de servicios en la nube han estandarizado los precios en torno a tokens. OpenAI cobra $0.03 por cada 1000 tokens de entrada y $0.06 por cada 1000 tokens de salida para GPT-4. GPT-3.5 Turbo es significativamente más económico, con un coste de $0.0015 por cada 1000 tokens de entrada.

Pero, ¿qué significa esto en la práctica para cargas de trabajo reales? Una sola conversación de atención al cliente puede consumir entre 2000 y 5000 tokens. Si esto se traduce en miles de conversaciones diarias, los costos se acumulan rápidamente.

Los costos de los tokens varían drásticamente entre proveedores y modelos. Según la documentación de OpenAI, los tokens de audio en la API en tiempo real tienen un precio de 1 token por cada 100 milisegundos para los mensajes de usuario, mientras que las salidas de audio del asistente contabilizan 1 token por cada 50 milisegundos. Estas diferencias entre modalidades generan una complejidad de precios que es fácil subestimar.

Estructuras de precios de los principales proveedores de servicios en la nube

Amazon Bedrock utiliza un modelo de precios similar basado en tokens, aunque las tarifas dependen del modelo base seleccionado. Los precios varían según la modalidad, el proveedor y el nivel del modelo. Vertex AI de Google Cloud mantiene estructuras de precios comparables y ofrece opciones de consumo de pago por uso estándar que ajustan la capacidad de transferencia de datos según el gasto de la organización durante períodos de 30 días.

Sin embargo, hay un detalle importante: los precios en la nube no se basan únicamente en las tarifas por token. Los proveedores implementan niveles de uso, descuentos por procesamiento por lotes y variaciones regionales que complican las comparaciones directas.

Según la documentación de OpenAI sobre optimización de costes, la API de procesamiento por lotes y el procesamiento flexible ofrecen mecanismos adicionales de reducción de costes que van más allá de los precios estándar. El procesamiento por lotes puede reducir los gastos en cargas de trabajo que no requieren una respuesta inmediata, donde los requisitos de latencia son flexibles.

| Proveedor | Ejemplo de modelo | Costo de entrada (por 1 millón de tokens) | Coste de producción (por cada millón de tokens) | Características destacadas |

|---|---|---|---|---|

| Abierto AI | GPT-4 | $30 | $60 | API en tiempo real, procesamiento por lotes |

| Abierto AI | GPT-3.5 Turbo | $1.50 | $2.00 | Menor coste, inferencia más rápida |

| Roca madre del Amazonas | Varios proveedores | Varía según el modelo | Varía según el modelo | Acceso a múltiples proveedores |

| Google Vertex AI | Modelos Géminis | Varía según el nivel | Varía según el nivel | Actualizaciones de nivel basadas en el uso |

Costes ocultos en los servicios de LLM en la nube

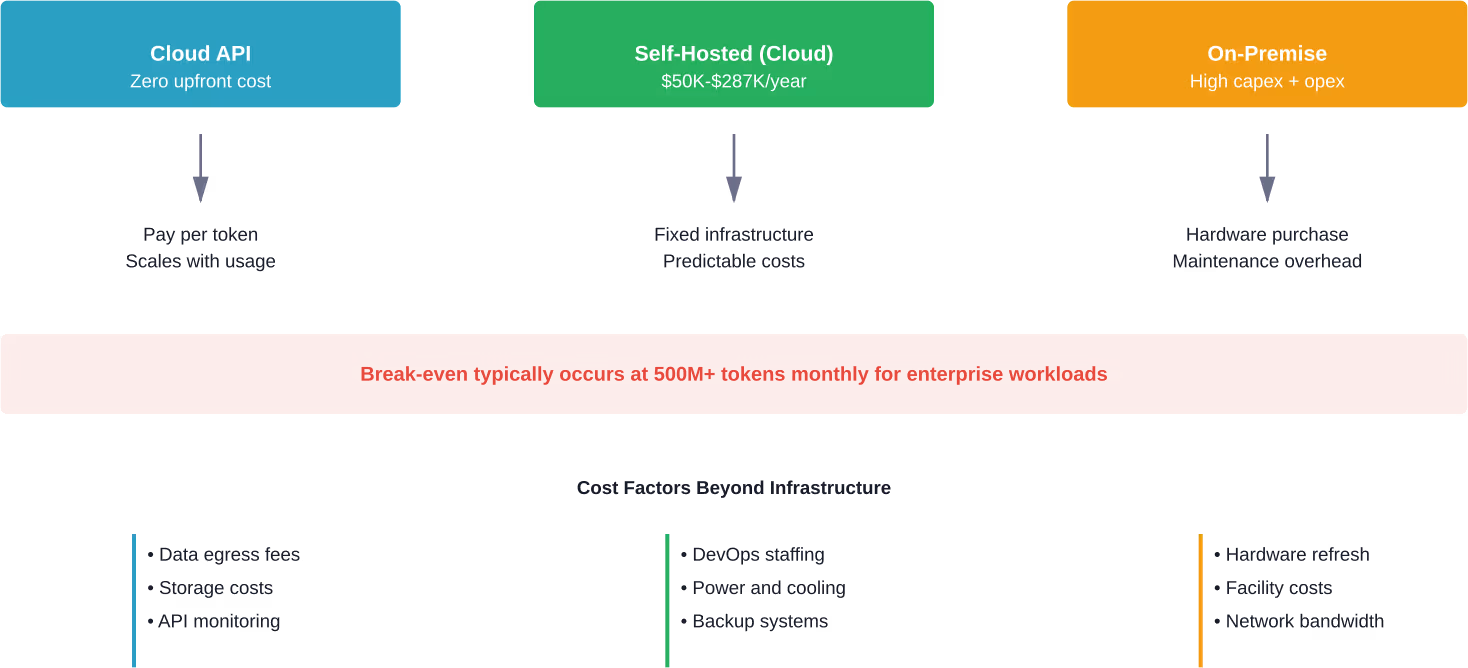

El precio de los tokens representa solo una parte del panorama financiero. Las implementaciones en la nube generan costos que no aparecen en las páginas de precios iniciales.

Las tarifas de salida de datos se acumulan al transferir grandes volúmenes de respuestas. Los costos de almacenamiento se aplican a los registros de conversaciones y los datos de entrenamiento. Las herramientas de monitoreo y observabilidad generan costos adicionales. Para sistemas de producción que requieren un rendimiento garantizado, los modelos de precios de capacidad reservada reemplazan la economía de pago por token con compromisos fijos.

Los debates en plataformas como LocalLLaMA revelan la frustración que generan los costes impredecibles de la nube. Los patrones de uso que parecen razonables durante las pruebas pueden dispararse en producción a medida que aumenta la concurrencia.

Costos de infraestructura de autoalojamiento

La promesa de los másteres en derecho autogestionados se centra en el ahorro de costes a largo plazo y el control de los datos. Sin embargo, la inversión inicial es considerable y los gastos operativos se mantienen indefinidamente.

Según informes de la comunidad, ejecutar Qwen-2.5 32B o QwQ 32B en instancias AWS g5.12xlarge (4 GPU A10G) cuesta aproximadamente $50,000 al año en operación continua. Llama-3 70B en instancias p4d.24xlarge (8 GPU A100) cuesta alrededor de $287,000 al año en operación continua.

Esas cifras se basan en la suposición de que la infraestructura está en la nube. El hardware local cambia por completo la situación económica.

Requisitos de hardware y costos de capital

El ancho de banda de las CPU modernas para consumidores (DDR5-6400 de doble canal ofrece alrededor de 100 GB/s) se queda muy corto en comparación con el rendimiento de las GPU, que supera los 1,7 TB/s. Apple Silicon representa una excepción con su arquitectura de memoria unificada, que proporciona un mayor ancho de banda, pero escalar el hardware de Apple para cargas de trabajo de producción presenta limitaciones prácticas.

Como regla general, se requieren aproximadamente 0,5 GB de VRAM por cada mil millones de parámetros al usar cuantización de 4 bits. La precisión completa FP16 duplica este requisito. Un modelo de 70 mil millones de parámetros con cuantización de 4 bits necesita un mínimo de aproximadamente 35 GB de VRAM. El modelo debe caber en la VRAM para una velocidad de inferencia razonable; de lo contrario, el sistema recurre al procesamiento por CPU, que es entre 10 y 100 veces más lento.

Según los informes de la comunidad, los costos mínimos de implementación interna oscilan entre 125.000 y 190.000 TW anuales, mientras que las funcionalidades orientadas al cliente de escala moderada cuestan entre 500.000 y 820.000 TW anuales. Los motores de productos principales a escala empresarial superan considerablemente estas cifras.

Gastos operativos más allá del hardware

La infraestructura es solo el comienzo. El autoalojamiento requiere personal DevOps cualificado, mantenimiento continuo, suministro eléctrico y refrigeración, sistemas de respaldo e infraestructura de red.

El consumo energético de los servidores GPU es considerable. Un sistema 8x A100 puede consumir entre 3 y 5 kW bajo carga, lo que se traduce en un coste anual de electricidad de entre 2000 y 4000 THB, dependiendo de las tarifas locales. Los requisitos de refrigeración añaden otros 30-50 THB al consumo energético.

Pero un momento. El hardware envejece. Las GPU pierden valor de reventa rápidamente a medida que surgen arquitecturas más nuevas. Un ciclo de depreciación de tres años implica que los costos de capital se amortizan anualmente, además de los gastos de reemplazo eventuales.

Desglose del costo total de propiedad

Comparar los costos de la nube y los de los servidores propios requiere calcular el costo total de propiedad en horizontes temporales realistas. El análisis varía drásticamente según el volumen de uso.

Para aplicaciones de bajo volumen que procesan menos de 10 millones de tokens al mes, las API en la nube siguen siendo económicamente imbatibles. Con tasas de GPT-3.5 Turbo de $1.50 por millón de tokens de entrada, los costos mensuales se mantienen por debajo de $20. Ninguna inversión en infraestructura resulta rentable a esta escala.

El cálculo cambia para un uso moderado. Procesar 100 millones de tokens al mes en GPT-3.5 Turbo cuesta aproximadamente $150-200. En tres años, eso equivale a $5400-7200, todavía muy por debajo de una infraestructura mínima de autoalojamiento.

El punto de equilibrio

Los análisis sugieren que el punto de equilibrio suele alcanzarse entre 500 millones y 1.000 millones de tokens mensuales para implementaciones empresariales. Con este volumen, los costos de la nube ascienden a entre 15.000 y 60.000 tokens mensuales, según el modelo utilizado. Anualmente, esto representa entre 180.000 y 720.000 tokens.

La infraestructura autogestionada, con un coste anual de entre 125.000 y 190.000 dólares para un despliegue mínimo, empieza a ser económicamente viable. En tres años, las soluciones locales pueden generar ahorros de entre 30 y 50 dólares en comparación con los servicios en la nube para cargas de trabajo de alto volumen.

¿Te suena familiar? Esto coincide con los patrones observados en análisis de la comunidad que comparan implementaciones en la nube con implementaciones locales a gran escala.

| Volumen mensual de tokens | Costo de la API en la nube (GPT-3.5) | Costo de la API en la nube (GPT-4) | Estimación de autoalojamiento | Enfoque recomendado |

|---|---|---|---|---|

| 10 millones de tokens | $15-20 | $300-600 | N / A | API en la nube |

| 100 millones de tokens | $150-200 | $3,000-6,000 | N / A | API en la nube |

| 500 millones de tokens | $750-1,000 | $15,000-30,000 | $10.400/mes | Considere la opción de autoalojamiento. |

| Más de mil millones de tokens | $1,500-2,000 | $30,000-60,000 | $10.400-15.800/mes | El autoalojamiento probablemente sea más barato. |

Variables ocultas en los cálculos del costo total de propiedad

El análisis estándar del punto de equilibrio pasa por alto factores críticos. Los requisitos de privacidad de datos pueden obligar al autoalojamiento, independientemente de la rentabilidad. El cumplimiento normativo en los sectores sanitario, financiero o gubernamental suele exigir infraestructura local.

Los requisitos de latencia cambian las reglas del juego. Las llamadas a la API en la nube introducen un tiempo de ida y vuelta en la red. Para aplicaciones en tiempo real que requieren tiempos de respuesta inferiores a 100 ms, la inferencia local se vuelve necesaria independientemente de las consideraciones de costo.

La personalización del modelo añade otra dimensión. Los proveedores de servicios en la nube ofrecen opciones de ajuste fino limitadas. Las organizaciones que necesitan una adaptación exhaustiva del modelo requieren una infraestructura que admita procesos de entrenamiento personalizados, lo que aumenta drásticamente la complejidad y el coste.

Estrategias de optimización de costos

Independientemente de la opción de implementación elegida, las técnicas de optimización de costos pueden reducir sustancialmente los gastos de LLM. Según la documentación de optimización de costos de OpenAI, varias estrategias generan ahorros de forma consistente.

Reducción del consumo de tokens

Cada token tiene un coste. Minimizar el uso de tokens reduce directamente los gastos. Las indicaciones más breves ofrecen los mismos resultados a menor coste. Eliminar el contexto, los ejemplos y las instrucciones innecesarias reduce la cantidad de tokens sin sacrificar la calidad del resultado.

La ingeniería de indicaciones se convierte en un ejercicio de optimización económica. Probar diferentes formulaciones de indicaciones para lograr resultados idénticos con menos tokens genera un retorno de la inversión inmediato. Una reducción de 20% en la longitud promedio de las indicaciones se traduce directamente en un ahorro de costos de 20%.

El almacenamiento en caché del contexto de uso frecuente reduce el procesamiento redundante de tokens. Muchos proveedores ahora admiten el almacenamiento en caché de avisos, donde las porciones de contexto repetidas no se contabilizan para los límites de tokens en solicitudes posteriores.

Procesamiento por lotes y cargas de trabajo asíncronas

La API Batch de OpenAI ofrece precios significativamente reducidos para cargas de trabajo que no requieren una respuesta inmediata. El procesamiento asíncrono de las solicitudes, cuando los requisitos de latencia son flexibles, permite obtener descuentos sustanciales.

La API de procesamiento por lotes acepta solicitudes masivas que se procesan en ventanas de 24 horas. Para tareas como el análisis de contenido, el enriquecimiento de datos o la generación de resúmenes por lotes, este enfoque reduce los costos sin comprometer el rendimiento.

Existen capacidades de procesamiento por lotes similares en distintos proveedores. Amazon SageMaker admite trabajos de transformación por lotes. Google Vertex AI ofrece puntos de acceso para predicciones por lotes con precios reducidos en comparación con la inferencia en línea.

Selección de modelos y cuantificación

Los modelos más pequeños cuestan menos por token y se ejecutan más rápido. GPT-3.5 Turbo cuesta aproximadamente 5% del precio de GPT-4. Para tareas dentro de las capacidades de los modelos más pequeños, el ahorro de costos se multiplica enormemente a gran escala.

Para implementaciones autoalojadas, la cuantización reduce drásticamente los requisitos de hardware. La cuantización de 4 bits reduce a la mitad las necesidades de memoria en comparación con la de 8 bits, lo que permite utilizar modelos más grandes en hardware equivalente. Según las discusiones técnicas, la degradación de la precisión derivada de la cuantización sigue siendo mínima para la mayoría de las aplicaciones.

Una investigación publicada en arXiv explora técnicas de gestión de modelos de lenguaje (LLM) en las que los modelos de lenguaje pequeños procesan la mayoría de las solicitudes, mientras que los modelos más grandes proporcionan sugerencias solo cuando es necesario. Incluso sugerencias pequeñas (de 10 a 30% de respuestas completas de LLM) generan mejoras sustanciales en la precisión. Este enfoque híbrido puede lograr reducciones de costos drásticas manteniendo la calidad de la salida.

Optimiza la nube frente al autoalojamiento antes de que los costos se estabilicen.

Elegir entre una infraestructura LLM en la nube o autogestionada rara vez se reduce a una simple decisión de precio. Los costos dependen de cómo se entrenan, implementan y utilizan los modelos a lo largo del tiempo, incluyendo los flujos de datos, la estrategia de escalado y la eficiencia del sistema. IA superior Funciona a lo largo de todo el ciclo de vida, desde la preparación de datos y la selección de modelos hasta la implementación y la optimización, ayudando a los equipos a diseñar configuraciones que se ajusten al uso real en lugar de a la capacidad teórica.

En la práctica, esto suele significar decidir dónde tiene sentido la nube, dónde se justifica el autoalojamiento y cómo evitar pagar de más en cualquier caso. El objetivo es construir sistemas que funcionen de forma fiable en producción, no solo comparar los costes de infraestructura. Si está evaluando la nube frente al autoalojamiento o ya está viendo que los costes aumentan, conviene revisar su arquitectura cuanto antes. Póngase en contacto con nosotros. IA superior para evaluar su configuración antes de que los costos aumenten aún más.

Optimización del rendimiento de la infraestructura

En las implementaciones autogestionadas, la utilización del hardware influye directamente en la rentabilidad. Según los anuncios de AWS, el contenedor Amazon SageMaker Large Model Inference v15, impulsado por vLLM 0.8.4 con soporte para el motor vLLM V1, ofrece un mayor rendimiento que el motor V0 anterior.

El motor V1 incluye un modo asíncrono que se integra directamente con AsyncLLMEngine de vLLM, creando un bucle en segundo plano más eficiente que procesa continuamente las solicitudes entrantes para lograr un mayor rendimiento que la implementación anterior de Rolling-Batch. Estas mejoras de infraestructura se traducen directamente en ahorros de costos al extraer mayor capacidad de inferencia de un hardware equivalente.

Opciones de arquitectura de hardware

Los procesadores AWS Graviton ofrecen alternativas rentables para modelos pequeños. Un análisis de AWS demuestra que ejecutar modelos de lenguaje pequeños en instancias basadas en Graviton3 (serie ml.c7g) con llama.cpp para inferencia optimizada por Graviton y modelos en formato GGUF pre-cuantificados genera ahorros sustanciales para cargas de trabajo adecuadas.

Las máquinas virtuales A4 de Google Cloud, basadas en la arquitectura NVIDIA Blackwell, representan la opción de alto rendimiento más reciente. Según estudios de caso, Baseten logró una relación costo-rendimiento superior a 225% al ofrecer modelos populares como DeepSeek V3, DeepSeek R1 y Llama 4 Maverick en la infraestructura A4, en comparación con el hardware de la generación anterior.

La selección del hardware depende del tamaño del modelo y de los requisitos de rendimiento. Los modelos más pequeños, con menos de 13 mil millones de parámetros, se ejecutan eficazmente en instancias basadas en CPU. Los modelos de tamaño medio (de 13 a 70 mil millones de parámetros) se benefician de configuraciones con una o varias GPU. Los modelos grandes, con más de 70 mil millones de parámetros, requieren configuraciones con varias GPU o estrategias de paralelismo de modelos.

Programación dinámica de cargas de trabajo

El programador de carga de trabajo dinámico de Google Cloud optimiza la utilización de recursos en función de los diferentes patrones de tráfico. En lugar de aprovisionar recursos para la capacidad máxima de forma continua, la programación dinámica los ajusta según la demanda real.

Esta capacidad es fundamental para cargas de trabajo con variaciones de tráfico significativas. Las aplicaciones con patrones de uso diarios o semanales desperdician recursos durante los períodos de bajo tráfico con el aprovisionamiento estático. La programación dinámica puede reducir los costos de infraestructura entre 40 y 60 TP3T para cargas de trabajo con una variabilidad pronunciada.

Ejemplos de costos reales

El análisis teórico tiene sus límites. Los costes reales de implementación proporcionan puntos de referencia concretos.

En los debates de la comunidad se describen despliegues de producción mínimos con un coste anual de entre 125.000 y 190.000 dólares. Esto suele dar soporte a herramientas internas y volúmenes de solicitudes moderados: miles de solicitudes diarias en lugar de millones.

Según los mismos análisis, las funcionalidades de cara al cliente de escala moderada se ejecutan entre $500.000 y 820.000 veces al año. Esta escala permite gestionar un tráfico de producción significativo con una latencia y una disponibilidad aceptables.

Implementaciones a escala empresarial

Las grandes organizaciones que utilizan sistemas de gestión de la vida (LLM) como infraestructura principal de sus productos reportan costos que superan con creces estos rangos. Las inversiones anuales multimillonarias se vuelven habituales para requisitos de alto volumen y baja latencia en regiones geográficas distribuidas.

Un estudio de arXiv que analiza la economía de la inferencia proporciona cálculos de referencia. Tomando como ejemplo la tarjeta A800 de 80 GB bajo supuestos comunes, el costo horario base por tarjeta se aproxima a $0,79/hora, generalmente dentro del rango de $0,51-0,99/hora. Las principales plataformas en la nube suelen cobrar múltiplos de este valor base para cubrir los gastos operativos y el margen de beneficio.

Estos costos por tarjeta se multiplican según la cantidad de GPU necesarias para los modelos más grandes. Una implementación de 8 GPU consume aproximadamente $6,32 por hora a tasas base, lo que se traduce en $55.366 al año para un funcionamiento continuo, antes de considerar los costos de energía, refrigeración, redes o personal.

Comparación de soluciones en la nube y en las instalaciones a gran escala

Un análisis que examina la economía de la nube frente a la de las soluciones locales revela que los sistemas locales que ofrecen una capacidad equivalente a las implementaciones en la nube de alto volumen requieren aproximadamente $833,806 en costos de capital iniciales para la infraestructura basada en H100.

En un plazo de tres años, esta inversión de capital se amortiza a aproximadamente 1.044.277.935 anuales. Si se suman los gastos operativos (electricidad, refrigeración, mantenimiento, personal), los costes anuales totales alcanzan entre 1.444.350.000 y 1.444.450.000 para una implementación local de nivel empresarial.

Compárelo con los costos de las API en la nube para volúmenes equivalentes. Procesar 5 mil millones de tokens al mes en GPT-4 cuesta aproximadamente entre 150 000 y 300 000 tokens mensuales, o entre 1,8 y 3,6 millones al año. El punto de equilibrio de las soluciones locales se hace evidente a esta escala.

| Escenario de despliegue | Costo anual de la API en la nube | Costo anual de la nube autogestionada | Costo anual en las instalaciones |

|---|---|---|---|

| Pequeño (100 millones de tokens/mes) | $2,400 | No es económico | No es económico |

| Medio (500 millones de tokens/mes) | $12,000-360,000 | $125,000-190,000 | $350,000-450,000 |

| Grande (2 mil millones de tokens/mes) | $48.000-1,4M | $287,000-400,000 | $350,000-450,000 |

| Empresa (más de 5 mil millones de tokens al mes) | $1.8M-3.6M | $400,000-600,000 | $400,000-550,000 |

Costos de privacidad de datos y cumplimiento normativo

El análisis financiero por sí solo no abarca el marco completo de toma de decisiones. La privacidad de los datos y el cumplimiento normativo imponen requisitos que prevalecen sobre la mera optimización de costes.

Las organizaciones sanitarias sujetas a la normativa HIPAA se enfrentan a estrictos requisitos de gestión de datos. El envío de información de pacientes a API externas plantea desafíos de cumplimiento que pueden resultar prohibitivamente complejos o costosos de abordar. El autoalojamiento se vuelve obligatorio, independientemente de la ineficiencia en costes a volúmenes reducidos.

Los servicios financieros se enfrentan a limitaciones similares en virtud de normativas como el RGPD, la PCI-DSS y los requisitos específicos del sector. El coste de las infracciones de cumplimiento —tanto las sanciones económicas como el daño a la reputación— supera con creces los gastos de infraestructura.

Cuantificación del valor de la privacidad

¿Cuánto vale económicamente la privacidad de los datos? Este cálculo depende del contexto empresarial. Para las aplicaciones de consumo que manejan datos no sensibles, las primas por privacidad pueden ser mínimas. Para las empresas que gestionan información confidencial, propiedad intelectual o datos regulados, el valor de la privacidad se vuelve sustancial.

Algunas organizaciones aceptan costos dos o tres veces mayores para infraestructura autogestionada, simplemente por la soberanía de los datos. Otras requieren implementaciones aisladas, sin conectividad externa, independientemente de los costos adicionales.

El hecho de que 44% de las organizaciones citen la privacidad de los datos como una de las principales barreras para la adopción de LLM refleja este análisis. La eficiencia en costos es importante, pero no a expensas de los requisitos fundamentales de seguridad y cumplimiento normativo.

Tendencias de costos a largo plazo

La economía de los modelos de aprendizaje automático (LLM) sigue evolucionando rápidamente. Los costes de inferencia han disminuido sustancialmente a medida que mejora la eficiencia algorítmica y avanza el hardware.

Una investigación del MIT que examinó la eficiencia algorítmica y la disminución de los costos de inferencia de la IA reveló que las tendencias de los modelos de ponderación cerrada son ligeramente más rápidas que las de los modelos de ponderación abierta. Esto se observa particularmente en los modelos de ponderación cerrada del grupo 40%-60%, donde se producen caídas repentinas de precios que no se reflejan en los modelos de ponderación abierta, lo que sugiere efectos competitivos no técnicos.

La Ley de Moore y la aceleración de la IA

El rendimiento del hardware sigue mejorando. La arquitectura Blackwell de NVIDIA ofrece mejoras de rendimiento significativas con respecto a las generaciones anteriores. Los avances de Google en TPU y los aceleradores de IA especializados de las empresas emergentes generan mejoras de rendimiento constantes.

Estos avances en hardware reducen los costos de dos maneras. Primero, el hardware más reciente ofrece un mayor rendimiento de inferencia por cada dólar invertido. Segundo, la competencia entre los proveedores de servicios en la nube genera presión sobre los precios, lo que beneficia a los clientes.

Pero un momento. Las mejoras en el hardware también permiten crear modelos más grandes y potentes. El paso de GPT-3 a GPT-4 trajo consigo un aumento sustancial de las capacidades, junto con mayores costes de inferencia. La tendencia hacia modelos más grandes puede contrarrestar las mejoras en la eficiencia de la infraestructura.

Ecosistema de modelos de código abierto

Los modelos de ponderación abierta de Meta, Mistral, Alibaba y otros generan presión competitiva sobre los precios de los modelos propietarios. Las organizaciones pueden implementar modelos abiertos como Llama 4, DeepSeek o Qwen sin cargos por API por token.

Esta dinámica acelera la reducción de costos para las organizaciones con capacidad de autoalojamiento. La diferencia entre los costos de las API propietarias y los costos de los modelos abiertos autoalojados se amplía a medida que mejora la calidad de estos últimos.

Los análisis destacan que considerar los modelos de aprendizaje automático de código abierto como gratuitos es un error. Si bien estos modelos no tienen tarifas de licencia, los costos operativos siguen siendo considerables. El verdadero ahorro proviene de eliminar los cargos por token a una escala suficiente, no de una operación sin costo alguno.

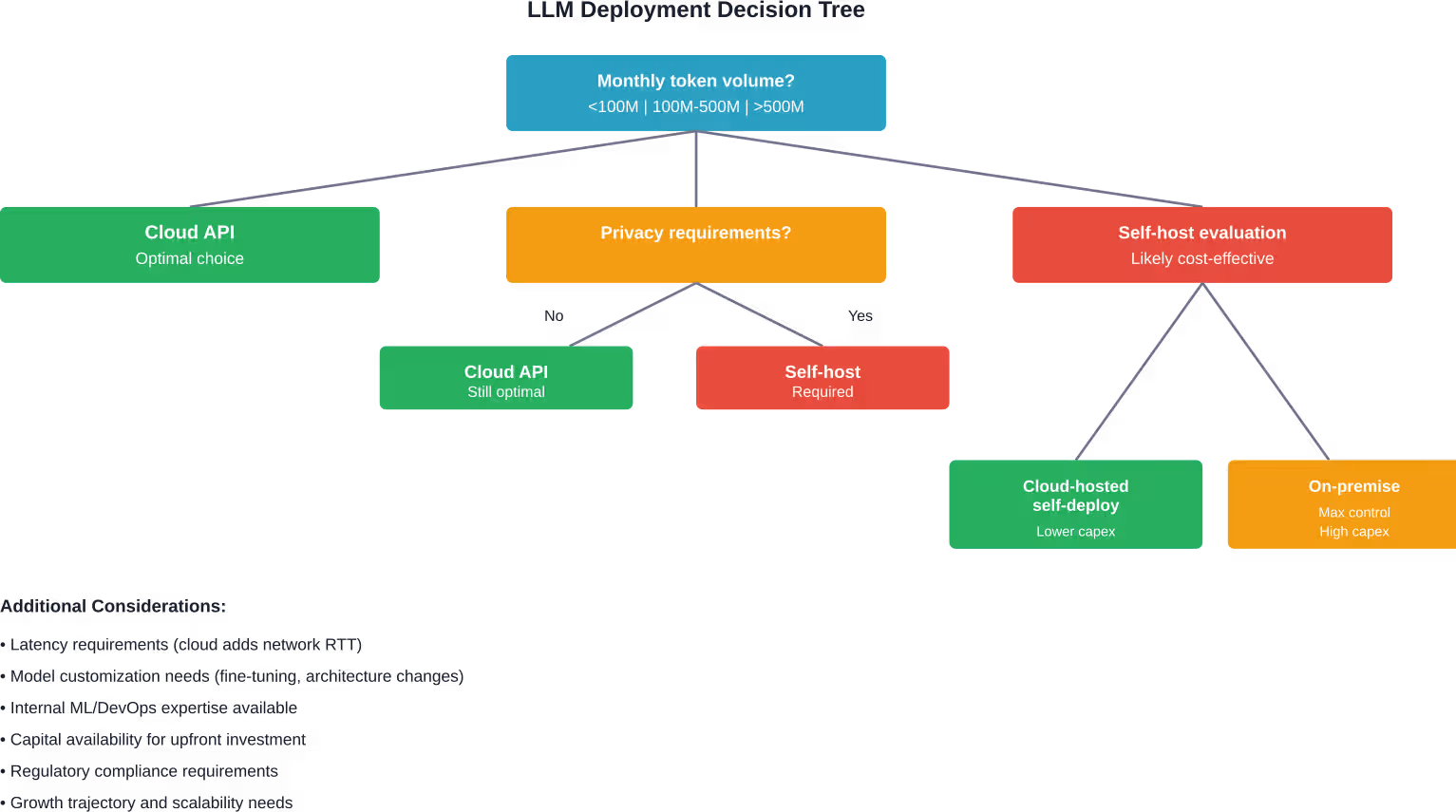

Tomar la decisión de construir o comprar

¿La respuesta corta? Depende del volumen, las capacidades y las limitaciones.

Las API en la nube son sumamente útiles para la exploración, la creación de prototipos y volúmenes de producción bajos a moderados. La ausencia de inversión inicial, la falta de complejidad operativa y el acceso instantáneo a modelos de vanguardia ofrecen un valor inigualable para la mayoría de los casos de uso.

El autoalojamiento se vuelve económicamente viable cuando el volumen mensual de tokens supera consistentemente los 500 millones a 1.000 millones. A esta escala, los costos de infraestructura se amortizan eficazmente y el costo total de propiedad favorece a la infraestructura propia frente a los cargos por API.

Marco de decisión

Considere sistemáticamente estos factores:

- Volumen y escala: Calcule el consumo actual y proyectado de tokens durante un período de 12 a 36 meses. El análisis del punto de equilibrio requiere horizontes temporales de varios años para amortizar adecuadamente las inversiones de capital.

- Sensibilidad de los datos: Determinar si la privacidad de los datos, el cumplimiento normativo o las preocupaciones sobre la propiedad intelectual exigen el autoalojamiento, independientemente de las consideraciones de coste.

- Requisitos de latencia: Las aplicaciones que requieren tiempos de respuesta inferiores a 100 ms pueden necesitar inferencia local independientemente de la eficiencia en costos.

- Necesidades de personalización del modelo: Para un ajuste preciso, una formación continua o modificaciones en la arquitectura del modelo, se requiere una infraestructura autogestionada con acceso completo al modelo.

- Capacidades técnicas: El autoalojamiento exige conocimientos de ingeniería de aprendizaje automático, DevOps y experiencia en infraestructura. Las organizaciones que carecen de estas capacidades se enfrentan a costes sustanciales de contratación o consultoría que repercuten en el cálculo del coste total de propiedad.

- Disponibilidad de capital: La infraestructura local requiere una inversión inicial considerable. El despliegue propio en la nube reduce los requisitos de capital, al tiempo que mantiene algunas ventajas de costes respecto a las API a gran escala.

Preguntas frecuentes

¿Cuánto cuesta mantener un servidor LLM en funcionamiento?

Los costos de la API en la nube varían entre 0,0015 y 6 tokens por millón, según el modelo. El autoalojamiento requiere entre 50 000 y 287 000 tokens anuales para infraestructura en la nube, o entre 350 000 y 550 000 tokens para implementación local, incluyendo hardware, energía y gastos operativos. Los costos aumentan según el tamaño del modelo, los requisitos de rendimiento y el volumen de uso.

¿Cuándo resultarán más económicas las plataformas LLM autogestionadas que las API en la nube?

El punto de equilibrio suele alcanzarse entre 500 millones y 1.000 millones de tokens mensuales en implementaciones empresariales. Por debajo de este umbral, las API en la nube siguen siendo más rentables debido a la ausencia de costes iniciales y a su simplicidad operativa. Por encima de este volumen, la infraestructura autogestionada ofrece ahorros de entre 30 y 501 millones de tokens en un periodo de tres años.

¿Cuáles son los costes ocultos de los másteres en Derecho (LLM) autogestionados?

Más allá de los costos de hardware e infraestructura en la nube, el autoalojamiento conlleva gastos de personal de DevOps, consumo de energía (entre 2000 y 4000 kWh anuales para sistemas GPU grandes), requisitos de refrigeración que añaden entre 30 y 50 kWh a los costos de energía, sistemas de respaldo, ancho de banda de red, herramientas de monitoreo y depreciación del hardware con ciclos de reemplazo cada 3 a 5 años.

¿Puedo cursar un máster en Derecho (LLM) de forma rentable desde casa?

Los modelos más pequeños, con parámetros inferiores a 13B, funcionan con hardware de consumo y tienen un coste moderado, principalmente de electricidad, que oscila entre 50 y 200 £ mensuales según el uso y las tarifas locales. Los modelos más grandes requieren configuraciones de GPU profesionales, con un coste de entre 3000 y 15 000 £ en hardware, además de los gastos de alimentación. Para uso personal y experimentación, esto puede resultar rentable, pero las implementaciones en producción requieren infraestructura empresarial.

¿Cómo se comparan los precios de los diferentes proveedores de LLM?

OpenAI cobra entre 30 y 60 TP4T por millón de tokens para GPT-4 y entre 1,50 y 2,00 TP4T para GPT-3.5 Turbo. Amazon Bedrock y Google Vertex AI ofrecen precios similares, con variaciones según el modelo y el nivel de consumo. La mayoría de los proveedores ofrecen descuentos de entre 30 y 50 TP3T para cargas de trabajo no urgentes.

¿Qué factores influyen más en los costes de inferencia de los modelos lineales generalistas (LLM)?

El volumen de tokens representa el principal factor de costo para las API en la nube. Para implementaciones autoalojadas, el tamaño del modelo determina los requisitos de hardware, mientras que las necesidades de rendimiento dictan la escala de la infraestructura. La cuantización (4 bits, 8 bits o precisión completa) afecta los requisitos de memoria y los costos de hardware. Las estrategias de ingeniería y almacenamiento en caché rápidas pueden reducir el consumo de tokens 15-40%.

¿Merece la pena alojar en servidores propios los másteres en derecho de código abierto?

Los modelos de código abierto eliminan los cargos por token de API, pero aún requieren inversiones en infraestructura. Para volúmenes inferiores a 100 millones de tokens mensuales, las API en la nube siguen siendo más económicas. Por encima de 500 millones de tokens mensuales, los modelos abiertos autogestionados ofrecen ahorros sustanciales a pesar de la complejidad operativa. Los requisitos de privacidad de datos pueden justificar la autogestión independientemente del punto de equilibrio de costos.

Conclusión

Los costos de los servidores LLM plantean un marco de decisión complejo donde no existe una solución única para todos los casos. Las API en la nube ofrecen una comodidad y rentabilidad inigualables para volúmenes bajos a moderados. El autoalojamiento requiere una inversión inicial considerable, pero genera ahorros a largo plazo a gran escala.

El punto de equilibrio suele alcanzarse en torno a los 500 millones de tokens mensuales, si bien los requisitos de privacidad, las necesidades de latencia y las exigencias de personalización del modelo pueden prevalecer sobre la optimización puramente financiera. Las organizaciones deben calcular el coste total de propiedad a largo plazo, teniendo en cuenta los gastos operativos ocultos que van más allá de los simples costes de infraestructura.

Las estrategias de optimización de costos (ingeniería rápida, procesamiento por lotes, selección de modelos, cuantificación y almacenamiento en caché) se aplican independientemente de la opción de implementación y pueden reducir los gastos 30-70% cuando se implementan sistemáticamente.

De cara al futuro, los costes de inferencia seguirán disminuyendo gracias a las mejoras en el hardware y al avance de la eficiencia algorítmica. Los modelos de código abierto generan una presión competitiva que beneficia a las organizaciones capaces de autoalojarse a gran escala. El marco de decisión se mantiene constante: comenzar con las API en la nube, monitorizar el crecimiento del consumo de tokens y evaluar el autoalojamiento cuando el volumen justifique la inversión en infraestructura.

¿Listo para optimizar los costos de LLM para su caso de uso específico? Calcule los volúmenes de tokens proyectados, evalúe los requisitos de privacidad de datos y modele el costo total de propiedad en las diferentes opciones de implementación. La elección correcta depende de sus limitaciones particulares, pero con datos de costos realistas, la decisión se vuelve mucho más clara.