Resumen rápido: Las tendencias en análisis predictivo para 2026 se centran en la previsión en tiempo real, la automatización impulsada por IA, el aprendizaje automático causal para cadenas de suministro y experiencias personalizadas para el cliente. El mercado crece a un ritmo de entre 22 y 281 millones de transacciones anuales, y las organizaciones aprovechan las arquitecturas basadas en eventos y el aprendizaje automático avanzado para transformar datos históricos en información útil para el futuro en los sectores de salud, comercio minorista, finanzas y manufactura.

El mercado de análisis predictivo continúa su trayectoria de crecimiento explosivo. Se prevé que alcance entre 1.041.700 millones y 1.042.200 millones de dólares en 2025, manteniendo una tasa de crecimiento anual de entre 221.300 y 281.300 millones de dólares durante los próximos cinco años. Esto no es solo un progreso gradual, sino un cambio fundamental en la forma en que las organizaciones toman decisiones.

Pero lo cierto es que el análisis predictivo ya no es lo que era hace tan solo dos años. Las técnicas, las herramientas y las aplicaciones han evolucionado drásticamente. El procesamiento de datos en tiempo real, el aprendizaje automático causal y la automatización impulsada por IA están redefiniendo el panorama.

¿Qué tendencias están marcando realmente el rumbo del sector en 2026? Analicemos los acontecimientos más relevantes.

Qué es realmente el análisis predictivo en 2026

El análisis predictivo utiliza datos históricos, métodos estadísticos y modelos de aprendizaje automático para pronosticar resultados o tendencias futuras. Según Stanford HAI, estas técnicas analizan patrones en datos históricos para estimar la probabilidad de eventos como el comportamiento del cliente, fallas en los equipos o cambios en el mercado.

Esta práctica se sitúa en la intersección de las matemáticas, la estadística y la informática. Es fundamentalmente diferente del análisis descriptivo (¿qué sucedió?) o del análisis diagnóstico (¿por qué sucedió?). El análisis predictivo responde a la pregunta: ¿qué sucederá?

| Tipo de análisis | Pregunta respondida | Uso principal |

|---|---|---|

| Descriptivo | ¿Qué pasó? | Informes históricos |

| Diagnóstico | ¿Por qué sucedió? | Análisis de la causa raíz |

| Profético | ¿Qué sucederá? | Pronóstico y probabilidad |

| Preceptivo | ¿Qué debemos hacer? | Optimización de decisiones |

La principal diferencia entre el análisis predictivo y el aprendizaje automático radica en su alcance y aplicación. El análisis predictivo se centra en pronosticar resultados específicos para la toma de decisiones empresariales. El aprendizaje automático permite que los sistemas aprendan de los datos y mejoren su rendimiento sin necesidad de programación explícita.

Dicho esto, la línea divisoria se está difuminando. Las implementaciones modernas de análisis predictivo hacen un uso intensivo de las técnicas de aprendizaje automático, en particular del aprendizaje profundo y las redes neuronales.

El aprendizaje automático causal transforma la gestión de la cadena de suministro.

Una de las tendencias más significativas es el cambio de los modelos basados en correlación a los enfoques causales. Según una investigación del NIST publicada en enero de 2026, el aprendizaje automático causal representa un avance empírico en la gestión de la cadena de suministro.

Los modelos predictivos tradicionales identifican patrones: “Cuando ocurre X, suele ocurrir Y”. Los modelos causales van más allá: “X causa Y a través del mecanismo Z”. Esta distinción es de suma importancia a la hora de tomar decisiones de intervención.

En lo que respecta específicamente a las cadenas de suministro, el aprendizaje automático causal ayuda a responder preguntas como:

- ¿Cambiar de proveedor A realmente reducirá los retrasos, o la correlación es espuria?

- ¿Cuál es el verdadero impacto de los cambios en la política de inventario en la satisfacción del cliente?

- ¿Qué perturbaciones se propagan realmente en cascada por toda la red y cuáles son aisladas?

El marco del NIST demuestra cómo se pueden aplicar las técnicas de inferencia causal a datos reales de la cadena de suministro, yendo más allá de la simple predicción para comprender los mecanismos subyacentes que impulsan los resultados.

Y esto no es teórico. Los fabricantes ya están implementando modelos causales para optimizar las compras, reducir el desperdicio y aumentar la resiliencia ante las interrupciones.

Las arquitecturas de datos en tiempo real impulsan la previsión inmediata.

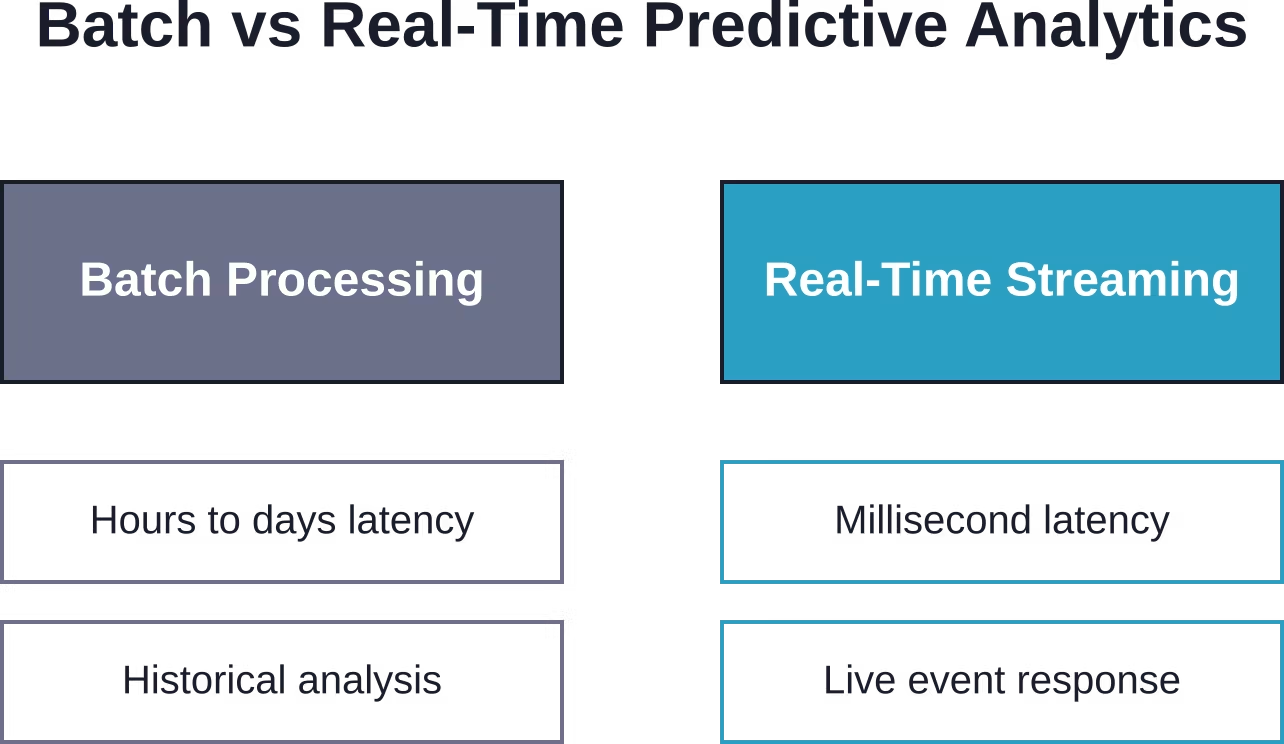

El procesamiento por lotes está perdiendo terreno frente al análisis en tiempo real. Las arquitecturas basadas en eventos (EDA) y las plataformas de datos en movimiento se están convirtiendo en la base de los sistemas predictivos que necesitan responder de inmediato.

He aquí por qué esto es importante: los modelos predictivos tradicionales suelen trabajar con datos de hace horas o días. Para casos de uso como la detección de fraudes, la monitorización de equipos o la fijación dinámica de precios, ese retraso es inaceptable.

Las tecnologías de datos en tiempo real permiten:

- Detección inmediata de anomalías en flujos de transacciones.

- Predicción de fallos en equipos en tiempo real basada en datos de sensores

- Personalización dinámica de la experiencia del cliente durante las sesiones activas

- Alertas instantáneas sobre riesgos en la cadena de suministro a medida que se desarrollan los acontecimientos.

Este cambio requiere una infraestructura técnica diferente: marcos de procesamiento de flujos de datos, intermediarios de eventos y modelos optimizados para la puntuación con baja latencia. Pero la recompensa es sustancial: predicciones que se pueden aplicar en el momento preciso en que se necesitan.

La personalización impulsada por IA alcanza un nuevo nivel de sofisticación.

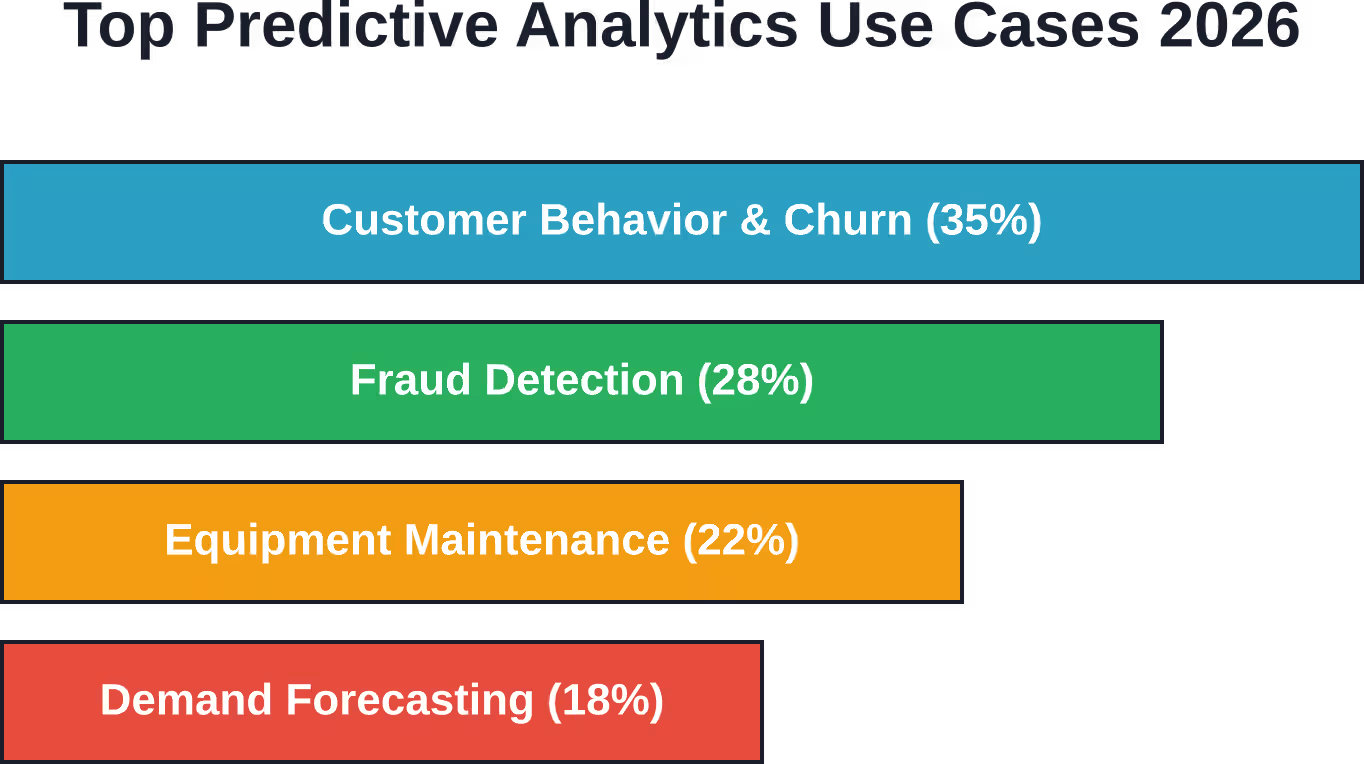

El análisis de clientes siempre ha sido un caso de uso fundamental del análisis predictivo. Pero el nivel de personalización posible en 2026 es extraordinario.

Las organizaciones que utilizan técnicas avanzadas de análisis predictivo de clientes y personalización reportan mejoras en sus ingresos. Esto se corrobora en diversos análisis del sector y refleja la madurez de los motores de recomendación, los sistemas de contenido dinámico y los modelos de predicción del comportamiento.

Las principales empresas de comercio electrónico reportan mejoras significativas en la retención de clientes gracias al análisis predictivo. Si bien la magnitud de Amazon es única, las técnicas subyacentes —filtrado colaborativo, minería de patrones secuenciales, modelado de propensión— son cada vez más accesibles para organizaciones más pequeñas.

Las plataformas modernas de análisis de clientes combinan:

- Análisis de secuencias de comportamiento para predecir las próximas acciones.

- Análisis de sentimientos a partir de interacciones de texto y voz.

- Modelado del valor de vida del cliente para la priorización de la retención.

- Predicción de la deserción de clientes con recomendaciones de intervención

La transición de la predicción segmentada a la predicción a nivel individual está prácticamente completa. Los modelos de aprendizaje automático ahora pueden generar pronósticos personalizados para millones de clientes simultáneamente, algo que no era computacionalmente factible ni siquiera hace cinco años.

Los fabricantes más pequeños acceden a la IA a través de herramientas prácticas.

El análisis predictivo ya no es una capacidad exclusiva de las grandes empresas. Según una investigación del NIST sobre fabricantes más pequeños, la inteligencia artificial se ha convertido en un aspecto crucial de la adopción de la Industria 4.0, incluso para instalaciones de producción medianas y pequeñas.

¿Qué cambió? Principalmente la accesibilidad y el costo de las herramientas. Las plataformas de análisis basadas en la nube, los modelos preentrenados y las interfaces de bajo código/sin código han reducido drásticamente las barreras de entrada.

Los fabricantes más pequeños están aprovechando el análisis predictivo para:

- Programación del mantenimiento de equipos basada en datos de sensores

- Predicción de la calidad para reducir defectos y desperdicios.

- Previsión de la demanda para la optimización del inventario

- Predicción del consumo energético para la gestión de costes

Los centros MEP (Manufacturing Extension Partnership) han desempeñado un papel importante en la difusión de estas capacidades, ayudando a los fabricantes a identificar casos de uso e implementar soluciones sin una inversión de capital masiva.

En realidad, el análisis predictivo para la fabricación ya no requiere un equipo de ciencia de datos. Muchas plataformas ofrecen plantillas específicas para el sector y entrenamiento automatizado de modelos que los gerentes de producción pueden configurar ellos mismos.

Se amplían los servicios de diagnóstico y previsión de recursos sanitarios.

El sector sanitario sigue siendo uno de los ámbitos con mayor impacto en la analítica predictiva. Sus aplicaciones abarcan desde el apoyo al diagnóstico a nivel individual del paciente hasta la planificación de recursos a nivel de todo el sistema.

Entre los principales casos de uso en el sector sanitario en 2026 se incluyen:

- Predicción de fallos de equipos para dispositivos médicos críticos

- Modelización del riesgo de reingreso hospitalario del paciente

- Pronóstico de la progresión de enfermedades crónicas

- Predicción de la capacidad hospitalaria y la demanda de personal

- Probabilidad del resultado del tratamiento para la atención personalizada

La precisión de estos modelos sigue mejorando a medida que los sistemas de registros electrónicos de salud (EHR) maduran y aumenta la calidad de los datos. Las técnicas de aprendizaje automático, como las redes de memoria a largo y corto plazo (LSTM), destacan en el análisis de datos de salud temporales, permitiendo realizar un seguimiento de la evolución de las condiciones de los pacientes a lo largo del tiempo.

Pero existe un desafío: los modelos predictivos en el ámbito de la salud deben ser explicables. Las redes neuronales opacas que no pueden justificar sus predicciones se enfrentan a barreras regulatorias y éticas. Esto ha impulsado una importante innovación en técnicas de aprendizaje automático interpretable e inferencia causal.

La previsión financiera se vuelve más detallada.

Los servicios financieros llevan décadas utilizando análisis predictivos; la calificación crediticia es, fundamentalmente, un modelo predictivo. Lo novedoso reside en la precisión y la amplitud de sus aplicaciones.

La previsión financiera moderna aprovecha el análisis predictivo para:

- Detección de fraude en tiempo real en todos los flujos de transacciones.

- Predicción del movimiento del mercado para el trading algorítmico.

- Evaluación del riesgo crediticio con fuentes de datos alternativas

- Previsión de flujos de efectivo para la gestión de tesorería

- Modelado del valor de vida del cliente para la optimización de la adquisición.

Una tendencia destacable es la incorporación de datos no estructurados, como el análisis del sentimiento en las noticias, las señales de las redes sociales y las imágenes satelitales, en los modelos financieros. Estas fuentes de datos alternativas proporcionan señales predictivas que los datos estructurados tradicionales no detectan.

WHOOP, por ejemplo, mejoró la previsión financiera mediante IA y aprendizaje automático, a la vez que optimizó la experiencia de sus miembros centralizando el acceso a los datos con plataformas modernas. Esta combinación —mejores previsiones y una mejor experiencia del cliente— refleja cómo el análisis predictivo se ha integrado en todas las funciones empresariales, en lugar de permanecer aislado en el departamento financiero.

Modelos y técnicas clave de análisis predictivo

Los fundamentos técnicos del análisis predictivo siguen evolucionando. Si bien los métodos estadísticos clásicos siguen siendo relevantes, el aprendizaje automático predomina en las implementaciones modernas.

Modelos de regresión

La regresión lineal, la regresión logística y la regresión polinómica manejan predicciones continuas y categóricas. Son interpretables, rápidas de entrenar y efectivas cuando las relaciones son relativamente lineales. La previsión financiera y la evaluación de riesgos simples suelen basarse en la regresión.

Árboles de decisión y métodos de conjunto

Los bosques aleatorios, las máquinas de potenciación de gradiente (como XGBoost y LightGBM) y las técnicas de conjunto combinan múltiples modelos para lograr una precisión superior. Manejan con eficacia las relaciones no lineales, las interacciones entre características y los datos faltantes. La predicción de la deserción de clientes y la calificación crediticia suelen utilizar métodos de conjunto.

Redes neuronales y aprendizaje profundo

El aprendizaje profundo destaca en el reconocimiento de patrones complejos, especialmente en datos no estructurados como imágenes, texto y series temporales. Las redes LSTM, las redes neuronales convolucionales (CNN) y las arquitecturas Transformer impulsan aplicaciones avanzadas de predicción. El diagnóstico médico y el procesamiento del lenguaje natural dependen en gran medida del aprendizaje profundo.

Pronóstico de series temporales

ARIMA, Prophet y arquitecturas neuronales especializadas manejan datos temporales con estacionalidad y tendencias. La previsión de la demanda, la predicción de ventas y la planificación de recursos dependen de técnicas robustas de series temporales.

Agrupación y clasificación

Los algoritmos K-means, la agrupación jerárquica, las máquinas de vectores de soporte y los clasificadores bayesianos segmentan los datos y asignan predicciones de categoría. La segmentación de clientes y la detección de fraudes se basan en estos enfoques.

La elección de la técnica depende de las características de los datos, los requisitos de interpretabilidad, los recursos computacionales y la tarea de predicción específica. Muchos sistemas de producción utilizan enfoques de conjunto, combinando varios tipos de modelos para aprovechar sus fortalezas complementarias.

Optimización de la producción de alimentos mediante redes LSTM

El desperdicio de alimentos sigue siendo uno de los desafíos persistentes que enfrenta la industria. Una predicción errónea de la demanda conlleva sobreproducción, deterioro y una mala asignación de recursos.

Investigaciones recientes sobre análisis predictivo para la producción de alimentos demostraron un enfoque de aprendizaje automático que utiliza redes de memoria a corto y largo plazo (LSTM). El sistema pronostica las cantidades de alimentos y las transacciones utilizando datos históricos de ventas combinados con características como el día, el mes y atributos específicos del producto.

¿Los resultados? Una precisión del 89,681% en la predicción de la demanda. Este nivel de precisión permite una reducción significativa del desperdicio, una gestión de inventario optimizada y una mejor asignación de recursos, lo que se traduce en beneficios económicos y ambientales para una producción alimentaria sostenible.

Las redes LSTM son especialmente adecuadas para esta aplicación porque capturan dependencias a largo plazo en datos secuenciales. La demanda de alimentos presenta patrones complejos —ciclos semanales, tendencias mensuales, variaciones estacionales, efectos de los días festivos— que los modelos más simples tienen dificultades para representar.

Este enfoque demuestra cómo las arquitecturas neuronales especializadas pueden resolver desafíos de pronóstico específicos de la industria que antes eran intratables.

Herramientas y plataformas que permiten el análisis predictivo

El ecosistema de análisis predictivo incluye una gama de herramientas que abarcan diferentes casos de uso y niveles de habilidad técnica.

Las plataformas en la nube como Snowflake ofrecen capacidades integradas de almacenamiento y análisis de datos. Centralizan el acceso a los datos, reducen la complejidad de la infraestructura y permiten a los equipos crear modelos predictivos sin necesidad de gestionar servidores.

Las plataformas especializadas de aprendizaje automático ofrecen entrenamiento automatizado de modelos, ajuste de hiperparámetros y procesos de implementación. Esto reduce el tiempo desde la obtención de datos hasta la puesta en producción del modelo, de meses a días.

Los frameworks de código abierto —scikit-learn, TensorFlow, PyTorch, XGBoost— brindan a los científicos de datos un control y una personalización precisos. Son la base para el desarrollo de modelos personalizados cuando las soluciones estándar no se ajustan a las necesidades.

Las herramientas de inteligencia empresarial incorporan cada vez más capacidades predictivas de forma directa. Los usuarios sin conocimientos técnicos pueden generar pronósticos a través de interfaces guiadas sin necesidad de escribir código.

La tendencia apunta a la democratización: hacer que el análisis predictivo sea accesible a más profesionales, no solo a científicos de datos especializados. Pero esto no significa simplificarlo en exceso, sino mejorar las abstracciones y las interfaces sobre técnicas sofisticadas.

Desafíos y consideraciones

El análisis predictivo no es la solución definitiva. Persisten varios desafíos:

Calidad y disponibilidad de los datos

La calidad de los modelos depende de la calidad de sus datos de entrenamiento. Los datos incompletos, sesgados o desactualizados generan predicciones poco fiables. La gobernanza de datos y la calidad del flujo de trabajo son tan importantes como la elección del algoritmo.

Interpretabilidad del modelo

Los modelos complejos, como las redes neuronales profundas, suelen funcionar como cajas negras. En industrias reguladas o en decisiones de gran trascendencia, la explicabilidad es fundamental. Esto impulsa la investigación continua en aprendizaje automático interpretable.

Sobreajuste y generalización

Los modelos pueden memorizar datos de entrenamiento en lugar de aprender patrones generalizables. La validación rigurosa, la regularización y las pruebas con datos de reserva son esenciales para garantizar que los modelos funcionen bien con nuevas entradas.

Preocupaciones éticas y de sesgo

Los modelos predictivos pueden perpetuar o amplificar los sesgos presentes en los datos históricos. Las solicitudes de préstamos justos, contratación y atención médica requieren una auditoría cuidadosa de los sesgos y estrategias de mitigación.

Integración y operacionalización

Una cosa es crear un modelo; otra muy distinta es implementarlo en sistemas de producción donde genere valor para el negocio. Las prácticas de MLOps (control de versiones, monitorización y reentrenamiento) son fundamentales para un análisis predictivo sostenible.

Las organizaciones que tienen éxito con el análisis predictivo se toman estos desafíos en serio, en lugar de considerarlos asuntos secundarios.

Introducción al análisis predictivo

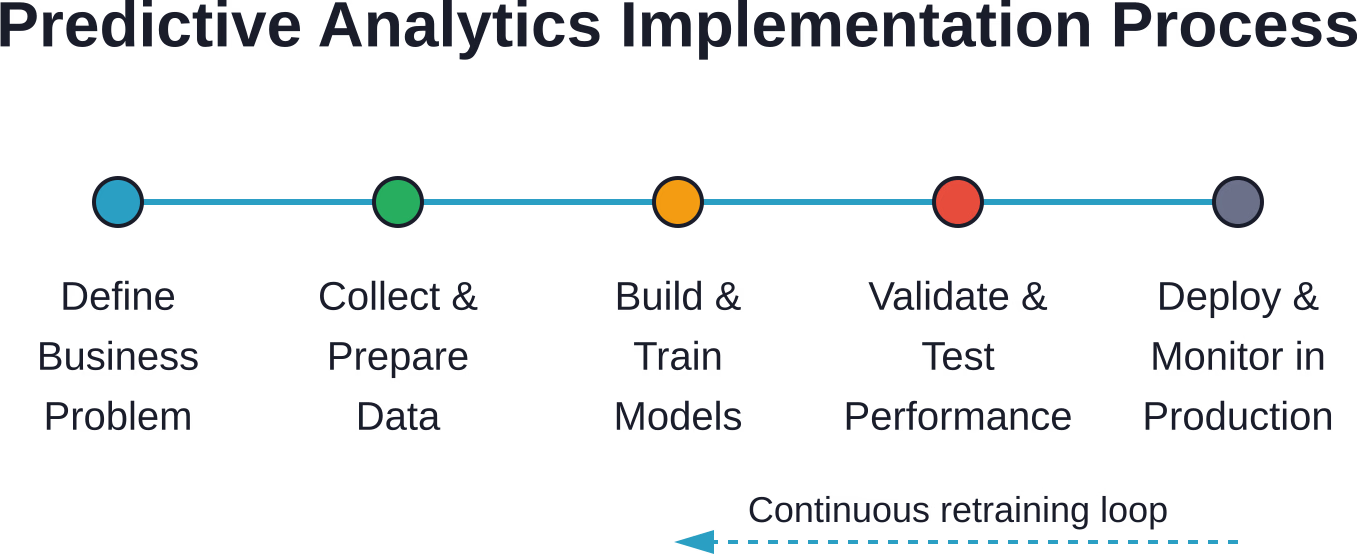

Las organizaciones que se inician en el análisis predictivo deben adoptar un enfoque pragmático:

- Comience con un problema empresarial claro: No cree modelos en busca de aplicaciones. Identifique una decisión específica que mejoraría con una mejor previsión: la rotación de clientes, los niveles de inventario, las fallas de los equipos.

- Evaluar la preparación de los datos: ¿Dispone de datos históricos suficientes? ¿Están limpios y accesibles? La preparación de datos suele consumir entre 60 y 80 TP3T del tiempo del proyecto. Subestimar este tiempo es un error común.

- Comience con líneas de base simples: La regresión lineal o los árboles de decisión suelen ofrecer un valor sorprendente antes de pasar al aprendizaje profundo complejo. Los modelos simples son más rápidos de implementar, más fáciles de interpretar y sirven como puntos de referencia de rendimiento.

- Invertir en infraestructura: El análisis predictivo requiere flujos de datos, entornos de entrenamiento de modelos y plataformas de implementación. Las soluciones basadas en la nube reducen los costos de capital iniciales.

- Crear equipos multifuncionales: El análisis predictivo eficaz combina conocimientos especializados, ingeniería de datos y modelado estadístico. Ninguna persona posee todas estas habilidades.

- Mida el impacto en el negocio, no solo la precisión del modelo: Un modelo con una precisión del 951% que no modifica las decisiones no sirve para nada. Es importante analizar cómo las predicciones influyen en las acciones y los resultados.

Las barreras de entrada nunca han sido tan bajas. Pero el éxito aún requiere una ejecución disciplinada y expectativas realistas.

Crea modelos predictivos que realmente funcionen con tus datos.

La mayoría de los proyectos de análisis predictivo fracasan porque los modelos no se ajustan a los datos reales ni a los procesos de toma de decisiones. IA superior Desarrolla modelos personalizados de aprendizaje automático que utilizan datos históricos y actuales para respaldar la previsión, la detección de patrones y la toma de decisiones más precisas.

Convierta el análisis predictivo en modelos funcionales.

AI Superior se centra en la implementación práctica, no en la teoría:

- Desarrollo de modelos basados en sus datos

- Identificación de patrones y señales en grandes conjuntos de datos.

- Apoyo a los procesos de toma de decisiones basados en datos.

- Integración en sistemas existentes

- Validación mediante implementaciones pequeñas y comprobables.

Habla con un superior en IA y vea cómo sus datos pueden convertirse en modelos predictivos funcionales.

Preguntas frecuentes

¿Qué es el análisis predictivo y cómo funciona?

El análisis predictivo utiliza datos históricos, algoritmos estadísticos y aprendizaje automático para pronosticar resultados futuros. Funciona identificando patrones en datos pasados —como compras de clientes, lecturas de sensores de equipos o tendencias del mercado— y aplicando esos patrones para realizar predicciones basadas en probabilidades sobre lo que sucederá a continuación. El proceso incluye la recopilación de datos, el entrenamiento del modelo con ejemplos históricos, la validación para garantizar la precisión y la implementación para generar pronósticos con datos nuevos.

¿Qué sectores se benefician más del análisis predictivo?

Los sectores de la salud, las finanzas, el comercio minorista, la manufactura y las telecomunicaciones obtienen un gran valor de la analítica predictiva. El sector salud la utiliza para el diagnóstico de pacientes y la planificación de recursos. Los servicios financieros la aplican a la detección de fraudes y el riesgo crediticio. Los minoristas aprovechan la predicción del comportamiento del cliente y la previsión de la demanda. Los fabricantes predicen fallos en los equipos y optimizan la producción. Cualquier industria con datos históricos sustanciales y cuyas decisiones se vean influenciadas por la incertidumbre futura puede beneficiarse.

¿En qué se diferencia el análisis predictivo del aprendizaje automático?

El análisis predictivo es una aplicación centrada en la previsión de resultados empresariales específicos mediante datos. El aprendizaje automático es un conjunto de técnicas que permiten a los sistemas aprender patrones a partir de datos sin programación explícita. El análisis predictivo suele utilizar métodos de aprendizaje automático como herramientas, pero no todo el aprendizaje automático es predictivo (algunos son descriptivos o prescriptivos). La distinción clave radica en que el análisis predictivo describe lo que se pretende lograr (prever el futuro), mientras que el aprendizaje automático describe cómo lograrlo (aprendizaje algorítmico de patrones).

¿Qué tamaño de organización necesita capacidades de análisis predictivo?

Organizaciones de todos los tamaños pueden beneficiarse, aunque las aplicaciones varían. Las grandes empresas utilizan el análisis predictivo para realizar pronósticos complejos con múltiples variables en sus operaciones globales. Las empresas medianas lo aplican a casos de uso específicos, como la reducción de la rotación de clientes o la optimización del inventario. Incluso los pequeños fabricantes ahora acceden al mantenimiento predictivo a través de plataformas en la nube asequibles y herramientas específicas del sector. La cuestión no radica en el tamaño de la organización, sino en si una mejor previsión mejoraría las decisiones específicas lo suficiente como para justificar la inversión.

¿Cuáles son los mayores desafíos en la implementación de análisis predictivos?

La calidad y disponibilidad de los datos son prioritarias: los modelos requieren una cantidad sustancial de datos históricos limpios. La integración con los procesos de negocio existentes es compleja; las predicciones deben incorporarse a los flujos de trabajo de toma de decisiones para generar valor. Persisten las carencias de habilidades; muchas organizaciones carecen de experiencia en ciencia de datos. La interpretabilidad de los modelos es fundamental para las industrias reguladas que necesitan explicar las predicciones. Por último, gestionar las expectativas es crucial: el análisis predictivo mejora la toma de decisiones probabilísticamente, pero no elimina la incertidumbre.

¿Qué tan precisos son los modelos de análisis predictivo?

La precisión varía drásticamente según el dominio, la calidad de los datos y el horizonte de predicción. Las predicciones a corto plazo con patrones estables (como la demanda de productos consolidados para la próxima semana) pueden superar una precisión de 90%. Las predicciones a largo plazo en dominios volátiles (como las fluctuaciones del mercado bursátil) son mucho menos fiables. La predicción de la producción de alimentos ha alcanzado una precisión cercana a 90% utilizando redes LSTM. Los modelos de abandono de clientes suelen tener una precisión de entre 70 y 85%. La clave reside en comparar el rendimiento del modelo con métodos de referencia (como la predicción ingenua o el juicio humano) en lugar de esperar la perfección.

¿Cuál es la diferencia entre el análisis predictivo y el análisis prescriptivo?

El análisis predictivo pronostica lo que sucederá: estima probabilidades y resultados probables. El análisis prescriptivo va más allá y recomienda qué acciones deben tomarse en respuesta a esos pronósticos. Por ejemplo, la predicción podría indicar que "este cliente tiene una probabilidad de abandono de 75%". El análisis prescriptivo añadiría: "ofrezca un descuento de 15% para maximizar el valor de retención". El análisis prescriptivo generalmente combina modelos predictivos con algoritmos de optimización y reglas de negocio para generar recomendaciones prácticas, no solo pronósticos.

El futuro de la analítica predictiva

De cara al futuro, varias tendencias darán forma al análisis predictivo más allá de 2026.

El aprendizaje automático automatizado (AutoML) seguirá reduciendo la barrera técnica, permitiendo a los analistas de negocio crear modelos sofisticados sin necesidad de programar. Sin embargo, la experiencia humana seguirá siendo fundamental para definir los problemas, interpretar los datos y detectar sesgos.

Las técnicas de inferencia causal complementarán cada vez más la predicción basada en correlaciones, ayudando a las organizaciones a comprender no solo qué sucederá, sino también por qué, y qué intervenciones realmente cambiarán los resultados.

La computación perimetral acercará los modelos predictivos a las fuentes de datos. Los sensores de fabricación, los dispositivos IoT y las aplicaciones móviles ejecutarán modelos de predicción locales en lugar de enviar todos los datos a sistemas centralizados en la nube.

La IA ética y la previsión responsable cobrarán mayor protagonismo. A medida que los modelos predictivos influyan en decisiones de mayor trascendencia, los marcos de equidad, transparencia y rendición de cuentas se convertirán en práctica habitual en lugar de aspectos secundarios.

La integración de datos no estructurados (texto, imágenes, vídeo, audio) en los modelos de predicción se profundizará. Los modelos multimodales que combinan datos estructurados tradicionales con lenguaje natural y entradas visuales permitirán nuevas capacidades de predicción.

La predicción en tiempo real se convertirá en un requisito indispensable. La previsión por lotes no desaparecerá, pero las aplicaciones que exigen respuestas inmediatas impulsarán la innovación arquitectónica en el análisis de datos en tiempo real y la entrega de modelos de baja latencia.

Las organizaciones que triunfen con el análisis predictivo serán aquellas que lo consideren no como un proyecto tecnológico, sino como una capacidad de toma de decisiones, la cual requiere una inversión continua en infraestructura de datos, talento e integración de procesos.

¿Listo para implementar análisis predictivos en su organización? Comience por identificar una decisión clave que se beneficiaría de una mejor previsión. Evalúe la preparación de sus datos. Forme un equipo multidisciplinario. Y elija las herramientas que se ajusten a sus capacidades técnicas y necesidades comerciales. La tecnología nunca ha sido tan accesible; la clave está en una ejecución rigurosa.