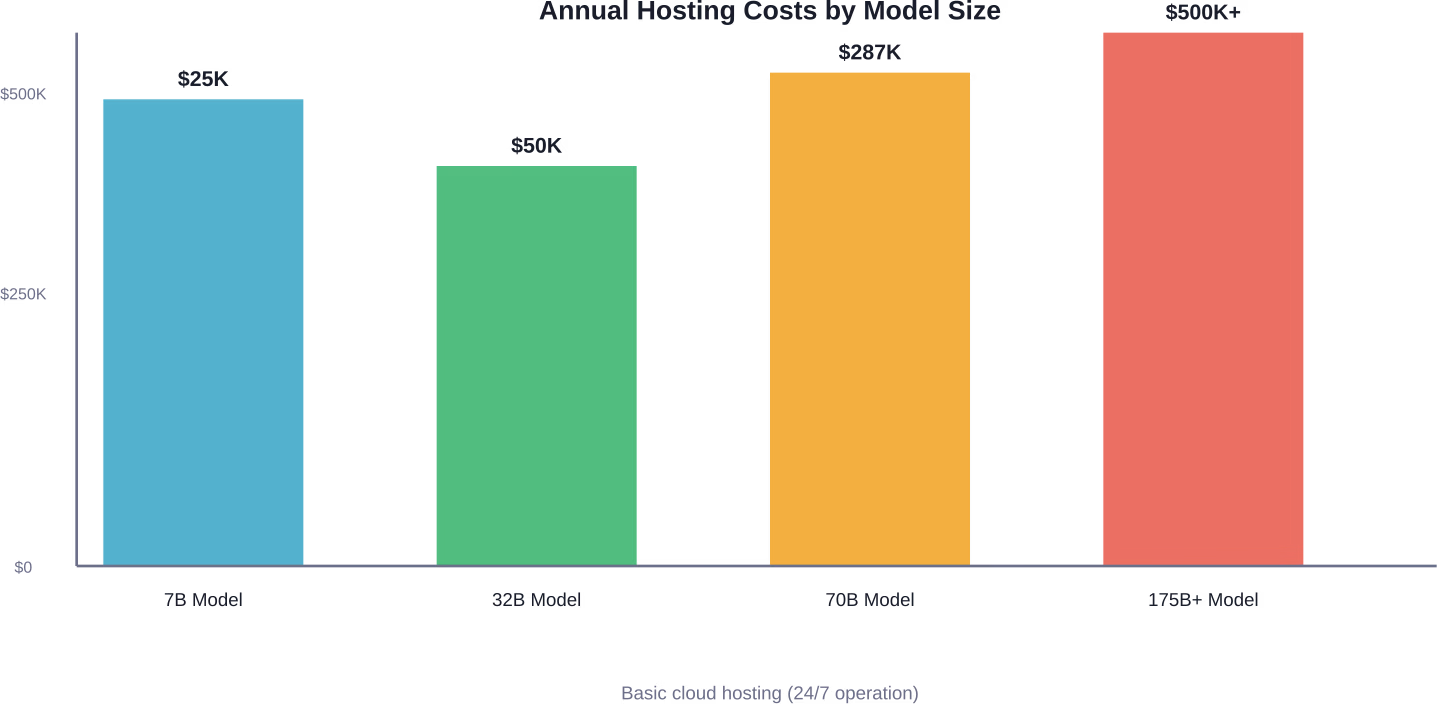

Résumé rapide : La création d'un modèle linéaire en nombres entiers (LLM) personnalisé coûte entre 125 000 et 12 000 000 $ par an, selon la taille du modèle, l'infrastructure choisie et l'échelle du déploiement. Les modèles plus petits (32 milliards de paramètres) sur des instances cloud coûtent environ 50 000 $ par an, tandis que les déploiements en entreprise de modèles de plus de 70 milliards de paramètres peuvent dépasser 287 000 $ par an rien que pour l'hébergement. L'entraînement à partir de zéro ajoute des millions de dollars en coûts de GPU, de préparation des données et de ressources d'ingénierie, ce qui rend souvent les services API plus économiques pour la plupart des cas d'utilisation.

L'affirmation selon laquelle “ les LLM open source sont gratuits ” figure parmi les idées reçues les plus dangereuses du secteur technologique actuel. Gratuits au téléchargement ? Certes. Gratuits à utiliser ? Loin de là.

Les organisations qui évaluent des modèles de langage personnalisés sont confrontées à une structure de coûts complexe qui va bien au-delà des simples frais de licence. Ces dépenses se traduisent par des coûts d'infrastructure, de temps d'ingénierie, de maintenance et des coûts d'opportunité stratégiques qui ne sont pas immédiatement visibles.

Cette analyse examine les coûts de déploiement réels en fonction des besoins concrets en infrastructure, des données de tarification du cloud et des implémentations en entreprise. Les chiffres proviennent de déploiements en production, et non de calculs théoriques.

La réalité de l'infrastructure : le coût réel de l'hébergement

Le matériel représente le poste de dépense le plus visible lors du déploiement de modèles linéaires personnalisés. Les coûts augmentent considérablement avec la taille du modèle, et les calculs deviennent vite complexes.

D'après les discussions de la communauté analysant des scénarios de déploiement réels, un modèle Qwen-2.5 32B ou QwQ 32B nécessite une instance AWS g5.12xlarge équipée de 4 GPU A10G. Le fonctionnement de cette configuration 24 h/24 et 7 j/7 coûte environ 1 TP4T50 000 $ par an. Ce tarif correspond à un modèle de taille moyenne gérant des charges de travail de production classiques.

Passez à Llama-3 70B : l’infrastructure requise passe à une instance p4d.24xlarge avec 8 GPU A100. Le coût annuel ? Environ $287 000 pour un fonctionnement continu.

Mais attention : ces chiffres supposent une utilisation optimale. En conditions réelles, les déploiements nécessitent redondance, répartition de charge et capacité de basculement. Un déploiement en production, avec une redondance et une surveillance adéquates, consomme généralement quatre à cinq fois le coût de l'instance de base. Cette estimation mensuelle de $15 000 explose avant même tout réglage fin ou mise à l'échelle.

Analyse économique des GPU

Une étude publiée sur arXiv, analysant les aspects économiques du déploiement de solutions LLM sur site, révèle les coûts de base des GPU qui servent de base à ces calculs. Une carte A800 80G, selon des hypothèses courantes, a un coût horaire de base d'environ $0,79. Ce coût se situe généralement entre $0,51 et $0,99 par heure, en fonction des spécificités d'approvisionnement et d'infrastructure.

Les plateformes cloud appliquent une majoration aux coûts de calcul bruts. La commodité de ne pas avoir à gérer de matériel physique a un coût supplémentaire qui s'accroît avec le temps.

Exigences en matière de mémoire et de stockage

Les modèles linéaires à longue portée (LLM) nécessitent une quantité importante de mémoire, au-delà de la VRAM du GPU. Un modèle de 70 milliards de paramètres requiert généralement environ 140 Go rien que pour charger les poids en précision FP16. Si l'on ajoute le cache KV pour les fenêtres de contexte, la mémoire d'activation pendant l'inférence et la surcharge du framework de service, ce besoin théorique grimpe soudainement à plus de 200 Go de mémoire système.

Les coûts de stockage s'accumulent insidieusement. Les points de contrôle des modèles, les données d'entraînement, les journaux et les artefacts de versionnage s'accumulent. Une simulation d'entraînement complète peut générer des téraoctets d'artefacts qu'il convient de conserver pour garantir la reproductibilité et la conformité.

Coûts de formation : la question à un million de dollars

Héberger un modèle pré-entraîné coûte cher. En entraîner un à partir de zéro ? C’est là que les coûts entrent dans une toute autre dimension.

Une étude publiée sur arXiv, portant sur le pré-entraînement de modèles linéaires à faible coût, a utilisé deux nœuds de cluster, chacun doté de ressources GPU importantes, pour ses expériences d'entraînement. Même ces approches “ économiques ” nécessitaient des configurations multi-GPU coordonnées que la plupart des organisations ne peuvent pas mettre en place facilement.

L'intensité de calcul du pré-entraînement engendre une structure de coûts dominée par les heures de GPU. Un entraînement complet pour un modèle compétitif peut consommer des milliers d'heures de GPU sur des accélérateurs haut de gamme.

En quoi consiste réellement la préformation ?

Le pré-entraînement d'un modèle linguistique à partir de zéro implique le traitement de corpus textuels massifs, souvent composés de centaines de milliards, voire de billions de tokens. Le modèle apprend les structures linguistiques, les associations factuelles et les capacités de raisonnement grâce à une exposition répétée à ces données.

Ce processus nécessite :

- Acquisition et nettoyage des données (dont la complexité est souvent sous-estimée)

- Infrastructure de formation distribuée avec interconnexions à haut débit

- Optimisation des hyperparamètres sur plusieurs essais

- Surveillance continue et intervention en cas de déstabilisation de l'entraînement

- pipelines de gestion et d'évaluation des points de contrôle

Chacun de ces composants engendre des coûts directs et nécessite du temps d'ingénierie.

L'économie du calcul

D'après une étude d'arXiv sur l'économie de l'inférence, la structure des coûts marginaux des opérations LLM suit un modèle de production axé sur le calcul. L'inférence fonctionne comme une “ activité de production intelligente ” où les ressources de calcul se traduisent directement en capacité de production.

L'entraînement amplifie cette relation. Alors que les coûts d'inférence augmentent avec l'utilisation, les coûts d'entraînement sont concentrés au début et restent en grande partie fixes. Que le modèle réussisse ou échoue, les heures de calcul GPU sont consommées.

Les fournisseurs de services cloud proposent diverses options de GPU aux caractéristiques de prix et de performances variées. De manière générale, les accélérateurs de dernière génération offrent un meilleur rapport performances/prix, mais les problèmes de disponibilité et les prix élevés peuvent annuler les avantages théoriques.

Les coûts cachés dont personne ne vous avertit

L'infrastructure et la formation constituent des postes de dépenses évidents. Les coûts qui prennent les organisations par surprise sont souvent plus indirects, mais tout aussi importants.

Dépenses d'ingénierie et de recrutement

Le déploiement et la maintenance de modèles de langage personnalisés (LLM) requièrent une expertise pointue. Les ingénieurs en apprentissage automatique possédant une expérience des LLM bénéficient de salaires très élevés, souvent de 150 000 à plus de 300 000 dollars par an pour les profils les plus expérimentés.

Un déploiement interne minimal nécessite généralement :

- Au moins un ingénieur en apprentissage automatique pour les opérations sur les modèles et leur mise au point.

- Support DevOps pour l'infrastructure et la surveillance

- Ingénieurs backend pour les travaux d'intégration

- Des experts produits/domaines pour l'évaluation et le conseil

D'après une analyse publiée sur LinkedIn portant sur les coûts des solutions open source LLM, même les déploiements internes minimaux coûtent entre 125 000 et 190 000 $ par an, ressources d'ingénierie comprises. Les fonctionnalités destinées aux clients, d'envergure moyenne, peuvent coûter entre 500 000 et 820 000 $ par an. Les moteurs de produits principaux à l'échelle de l'entreprise peuvent dépasser plusieurs millions de dollars.

Ces chiffres partent du principe que l'équipe possède déjà l'expertise requise. Développer cette compétence à partir de zéro engendre des coûts supplémentaires liés au recrutement, à l'intégration et à la formation.

Maintenance et exploitation

Les modèles ne se maintiennent pas d'eux-mêmes. Les déploiements en production nécessitent :

- Surveillance de la dégradation et de la dérive des performances

- Mises à jour de sécurité et de dépendances

- Intervention en cas d'incident survenant à 3 h du matin

- Planification des capacités et ajustements d'échelle

- Optimisation des coûts en fonction de l'évolution des habitudes d'utilisation

Ces exigences opérationnelles persistent indéfiniment. La facture mensuelle du cloud pourrait se stabiliser, mais l'attention humaine requise, elle, ne se stabilise pas.

Préparation et qualité des données

Les données d'entraînement de qualité ne se créent pas spontanément. Les organisations ont généralement besoin de :

- Licence ou acquisition des ensembles de données appropriés

- Nettoyer et filtrer le contenu pour en vérifier la qualité et la pertinence.

- Gérer les exigences en matière de confidentialité et de conformité des données

- Créer des ensembles de données d'évaluation pour mesurer les performances

- Mettez à jour les données en continu à mesure que les domaines évoluent.

Le traitement des données est une activité exigeante en main-d'œuvre et requiert souvent une expertise du domaine. Les coûts sont proportionnels au volume de données et aux exigences de qualité.

L'échelle du déploiement détermine les coûts totaux.

La différence entre l'exécution d'un modèle pour des outils internes et son utilisation pour alimenter des fonctionnalités destinées aux clients engendre des variations de coûts considérables.

Cas d'utilisation internes

Le déploiement d'un LLM pour améliorer la productivité interne (analyse de documents, assistance au développement, recherche interne) représente la partie la moins coûteuse de l'échelle des coûts. Ces charges de travail consistent généralement en :

- Servir un nombre limité d'utilisateurs simultanés (10-100)

- Tolérer une latence plus élevée

- Accepter des interruptions ou des dégradations occasionnelles

- Besoin d'un suivi et d'un soutien moins rigoureux

Même dans ce cas, les coûts s'élèvent à $125K–$190K par an en tenant compte des frais généraux d'infrastructure, d'ingénierie et de maintenance.

Fonctionnalités destinées aux clients

Dès lors qu'un LLM alimente des fonctionnalités avec lesquelles les clients interagissent directement, les exigences se durcissent considérablement :

- Les temps de réponse attendus sont désormais inférieurs à la seconde.

- La disponibilité doit être proche de 99,9% ou supérieure.

- La charge varie de manière imprévisible, nécessitant une marge de manœuvre et une capacité d'adaptation.

- Les échecs ont un impact direct sur les revenus et la réputation.

Ces contraintes font grimper les coûts vers une fourchette de prix allant de $500K à $820K pour les déploiements modérés. Les applications à fort trafic dépassent facilement le million de dollars.

Moteurs de produits principaux

Lorsqu'un LLM personnalisé devient le principal facteur de différenciation d'un produit, les organisations s'engagent de fait à maintenir une infrastructure d'IA comme compétence fondamentale. Cela signifie :

- Équipes dédiées à l'apprentissage automatique et à l'intelligence artificielle

- Amélioration et réentraînement continus du modèle

- Cadres sophistiqués de surveillance et d'expérimentation

- Déploiements multirégionaux pour des performances et une fiabilité accrues

- Une attention et un investissement stratégique significatifs de la part des dirigeants

D'après une analyse de LinkedIn, ces implémentations coûtent entre $6M et $12M par an à l'échelle de l'entreprise. Et ce, sans compter le coût d'opportunité lié aux ressources d'ingénierie non affectées à d'autres priorités.

| Niveau de déploiement | Cas d'utilisation typique | Gamme de coûts annuels | Contraintes clés |

|---|---|---|---|

| Outils internes | Recherche de documents, assistance au codage, analyse | $125K–$190K | Nombre limité d'utilisateurs, latence flexible |

| Face à la clientèle | Chatbots, recommandations, génération de contenu | $500K–$820K | Haute disponibilité, faible latence |

| Produit de base | Différenciation primaire du produit | $6M–$12M | Amélioration continue, multirégionale |

Réglage fin : un juste milieu plus accessible

La plupart des organisations n'ont pas besoin de pré-entraîner des modèles à partir de zéro. L'optimisation de modèles open source existants offre une alternative pragmatique qui réduit considérablement les coûts tout en permettant la personnalisation.

Quels sont les coûts du réglage fin ?

Des recherches sur les stratégies d'amélioration efficaces des modèles linéaires à faible rang (LLM), publiées sur arXiv, documentent des expériences de réglage fin utilisant des techniques comme LoRA (Low-Rank Adaptation) sur du matériel modeste. L'entraînement du modèle de base, quantifié à 8 bits avec LoRA, a nécessité environ 7 heures sur un seul GPU NVIDIA T4 doté de 16 Go de VRAM. Ce traitement a été effectué sur Google Colab avec 12 Go de RAM.

L'utilisation d'un GPU T4 chez les fournisseurs de cloud coûte généralement entre $0,35 et $0,50 par heure. Une phase d'ajustement fin de 7 heures coûte donc environ $2,50 à $3,50 en calcul. Même en tenant compte de plusieurs cycles d'entraînement, de la recherche d'hyperparamètres et de l'évaluation, les coûts d'ajustement fin restent généralement inférieurs à $500–$1000 pour les modèles de petite taille.

Le temps consacré à l'ingénierie représente l'investissement le plus important. La mise en place des chaînes d'entraînement, la préparation des jeux de données et l'évaluation des résultats nécessitent une expertise, mais pour un effort bien moindre que celui requis pour le pré-entraînement.

Quand un réglage fin est judicieux

Le réglage fin fonctionne bien lorsque :

- La terminologie ou le style propres au domaine importent plus que les capacités générales

- Les données propriétaires peuvent améliorer les performances sur des tâches spécifiques

- La personnalisation offre un avantage concurrentiel

- Des modèles plus petits, avec un réglage fin, peuvent égaler des modèles généraux plus grands.

D'après un article du blog Hugging Face (publié le 20 mars 2026) sur la création de modèles d'embeddings spécifiques à un domaine, les organisations utilisant des jeux de données d'entraînement synthétiques et des méthodes éprouvées ont constaté une amélioration de plus de 101 % (TP3T) de leurs performances en matière de rappel et de classement. Ces gains sont le fruit d'un réglage fin ciblé, et non d'investissements massifs dans l'entraînement préalable.

Techniques à faible consommation de paramètres

Les approches modernes de réglage fin, telles que LoRA, QLoRA et les méthodes d'adaptation, réduisent les besoins en ressources en ne mettant à jour qu'une petite partie des paramètres du modèle. Cela signifie :

- Moins de mémoire nécessaire pendant l'entraînement

- Cycles d'itération plus rapides

- Capacité à maintenir de multiples adaptations spécifiques à la tâche

- Coûts de stockage réduits pour les variantes du modèle

Ces techniques rendent la personnalisation accessible aux organisations ne disposant pas de budgets massifs en matière d'apprentissage automatique.

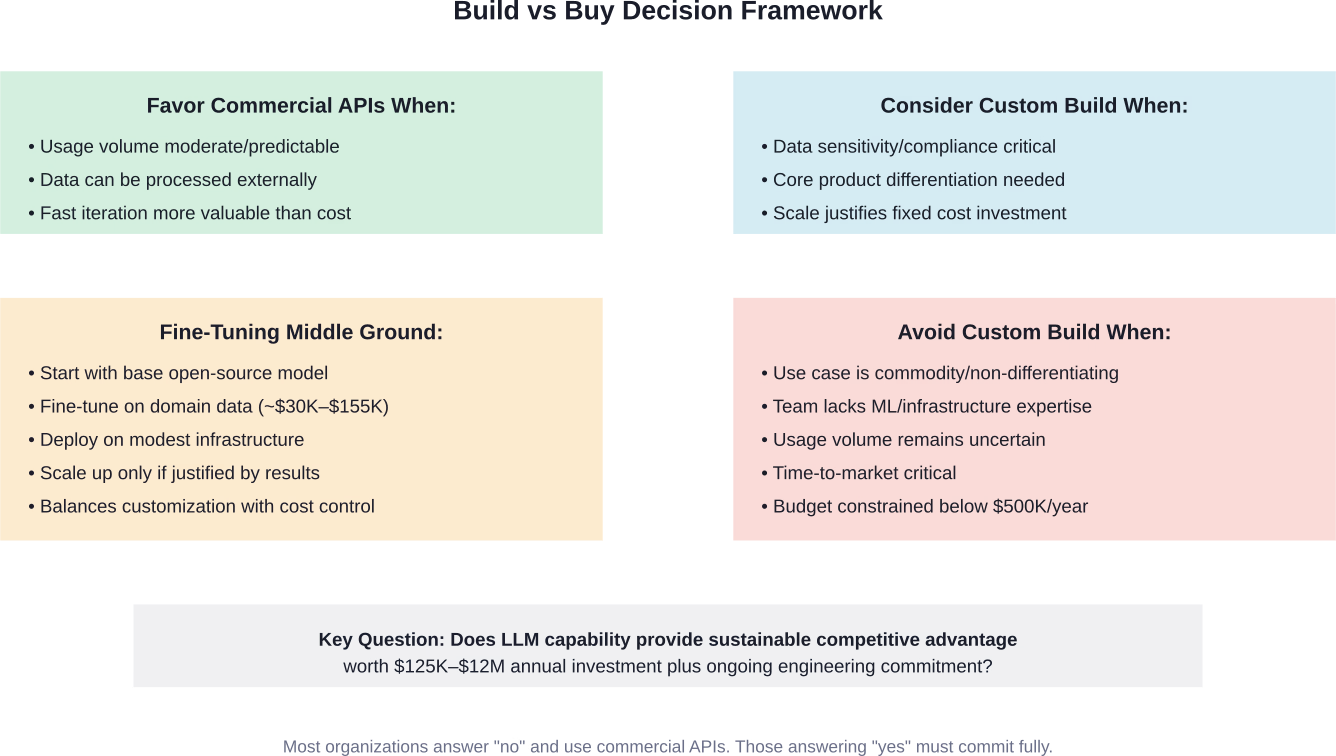

Services API commerciaux : l’alternative

Avant d'opter pour une infrastructure personnalisée, les organisations devraient sérieusement évaluer les services d'API commerciaux. Le coût est souvent plus avantageux pour les API, sauf dans les cas d'utilisation les plus spécifiques.

Fonctionnement de la tarification des API

Les fournisseurs de services LLM commerciaux facturent généralement par jeton traité. Les tarifs varient selon les capacités du modèle :

- Des modèles plus petits et plus rapides : $0,10–$0,50 par million de jetons

- Modèles de milieu de gamme : $1–$5 par million de jetons

- Modèles de raisonnement avancés : $10–$60 par million de jetons

Les jetons de contexte et de sortie peuvent être tarifés différemment, la génération de la sortie coûtant généralement plus cher que le traitement de l'entrée.

Quand les API prennent tout leur sens

Les API commerciales sont généralement plus avantageuses en termes de coût lorsque :

- L'utilisation est modérée et prévisible.

- Les exigences de latence permettent les appels réseau

- La sensibilité des données autorise le traitement externe

- L'itération rapide et l'expérimentation sont importantes

- Les ressources en ingénierie sont limitées.

Une étude publiée sur arXiv, portant sur l'analyse coûts-avantages du déploiement de solutions LLM sur site, examine le choix entre développement interne et acquisition auquel les entreprises sont confrontées. Les services cloud offrent un avantage pratique et évitent les investissements initiaux, mais les coûts d'abonnement récurrents s'accumulent avec le temps.

Le seuil de rentabilité dépend du volume d'utilisation et des priorités de l'organisation. Pour de nombreuses entreprises, les API restent plus économiques, même à grande échelle.

Approches hybrides

Certaines organisations déploient des architectures hybrides :

- Utilisez les API pour gérer les pics de trafic et la capacité de débordement.

- Exécutez des modèles personnalisés pour les opérations à volume élevé et sensibles à la latence

- Conservez les données sensibles sur site tout en utilisant les API pour les tâches générales.

- Créez un prototype avec des API avant de vous engager dans une infrastructure personnalisée.

Cette approche permet d'équilibrer les coûts, la flexibilité et les capacités tout en offrant des solutions de repli.

Études de cas réels et coûts rapportés

Comprendre les coûts théoriques est utile, mais ce sont les expériences de déploiement réelles qui révèlent où les estimations se heurtent à la réalité.

Déploiement à échelle modérée

D'après les discussions au sein de la communauté, l'expérience d'une équipe ayant déployé des LLM privés a montré que les coûts initiaux semblaient gérables, mais qu'ils ont rapidement augmenté une fois les exigences de production entrées en jeu.

L'équipe a constaté que son déploiement en production nécessitait redondance, mise en cache, répartition de charge et surveillance complète. Ce qui avait commencé par quelques milliers de dollars par mois a rapidement atteint près de 1 000 000 dollars, et ce avant même tout réglage fin ou mise à l'échelle significative.

Mise en œuvre en entreprise

D'après le rapport d'OpenAI du 17 décembre 2025 sur l'adoption de l'IA en entreprise, les organisations déployant l'IA à grande échelle ont constaté une augmentation spectaculaire de son utilisation. Selon ce même rapport, le volume de messages ChatGPT a été multiplié par 8 en un an, tandis que la consommation de jetons de raisonnement API par organisation a été multipliée par 320.

Ces modes d'utilisation révèlent des coûts récurrents importants, qu'il s'agisse d'infrastructures personnalisées ou de services commerciaux. Les organisations ayant constaté une “ productivité et un impact commercial mesurables ” ont manifestement jugé l'investissement rentable, mais le coût demeure considérable.

Contexte académique et de recherche

Les institutions de recherche sont confrontées à des pressions similaires sur les coûts, assorties de contraintes supplémentaires. Une équipe de Carnegie Mellon a publié en 2026 une analyse coûts-avantages portant sur la rentabilité du déploiement sur site. Leurs conclusions ont souligné que l'obtention de performances équivalentes à celles des modèles commerciaux exige une sélection rigoureuse de ces derniers, visant généralement des scores de référence parmi les meilleures offres commerciales.

Ce seuil de performance reflète la pratique des entreprises où des écarts de performance modestes sont acceptables si d'autres facteurs (confidentialité des données, prévisibilité des coûts, personnalisation) offrent des avantages compensatoires.

Stratégies d'optimisation pour maîtriser les coûts

Les organisations qui optent pour un déploiement LLM personnalisé peuvent employer plusieurs stratégies pour gérer leurs dépenses.

Sélection du modèle adapté

Le modèle le plus imposant n'est pas toujours nécessaire. Une analyse approfondie des exigences de la tâche révèle souvent que des modèles plus petits, une fois finement paramétrés, égalent ou surpassent les modèles généraux plus volumineux pour des charges de travail spécifiques.

Tester plusieurs modèles de tailles différentes face à des cas d'utilisation réels permet d'identifier le modèle minimal efficace. Cela a un impact direct sur les besoins en infrastructure et les coûts récurrents.

Quantification et compression

La quantification des modèles réduit la précision des nombres à virgule flottante 16 ou 32 bits à des entiers 8 ou même 4 bits. Cela diminue considérablement les besoins en mémoire et augmente le débit d'inférence avec une perte de précision minimale pour de nombreuses tâches.

Des recherches documentées sur arXiv ont montré que l'entraînement LoRA appliqué à des modèles pré-quantifiés à 4 bits permettait d'obtenir des résultats comparables à une précision plus élevée avec des besoins en ressources considérablement moindres.

Gestion efficace des infrastructures

D'après une étude arXiv sur l'efficacité de l'entraînement des modèles linéaires à longue portée (LLM), le choix de l'optimiseur et le réglage des hyperparamètres ont un impact significatif sur les temps de pré-entraînement et les performances finales du modèle. Des études comparant AdamW, Lion et d'autres optimiseurs ont mis en évidence des différences notables en termes de vitesse de convergence et d'efficacité de calcul.

De même, veiller à ce que les GPU restent activement utilisés plutôt que de rester inactifs permet d'éviter de payer pour une capacité inutilisée. Le traitement par lots des requêtes, la mise en place d'une file d'attente des requêtes et l'adaptation automatique de l'infrastructure en fonction de la demande contribuent tous à améliorer l'efficacité des coûts.

Mise en cache et optimisation des requêtes

De nombreuses requêtes LLM se répètent ou se chevauchent considérablement. La mise en œuvre d'un cache sémantique permet de traiter les requêtes identiques ou similaires à partir du cache plutôt que de recalculer les réponses. Cela réduit les coûts d'inférence proportionnellement au taux d'accès au cache.

Le traitement par lots des requêtes améliore également l'utilisation du GPU en traitant plusieurs requêtes simultanément, amortissant ainsi la surcharge entre les membres du lot.

Créez un LLM sur mesure sans laisser les coûts s'envoler.

Les projets LLM personnalisés deviennent rarement onéreux du jour au lendemain – les coûts s'accumulent au fil des décisions concernant la portée des données, l'approche de formation et la façon dont le modèle est censé fonctionner en situation réelle. IA supérieure Nous prenons en charge le développement de modèles linéaires sur mesure, de la préparation des données au déploiement, en passant par l'entraînement et l'optimisation. Plutôt que d'opter par défaut pour des modèles volumineux ou des cycles d'entraînement longs, nous privilégions une configuration adaptée à la tâche et pérenne. Cela implique souvent de restreindre le périmètre, de structurer les données avec plus de rigueur et de choisir des méthodes d'entraînement peu gourmandes en ressources de calcul.

Les projets ont tendance à dépasser le budget lorsque le modèle est construit sans limites claires ou lorsque les exigences évoluent constamment au cours du développement. Aligner le système sur les cas d'utilisation réels rend sa construction et son exploitation future plus prévisibles. Si vous souhaitez un LLM personnalisé, facile à construire et à exploiter, contactez-nous. IA supérieure et aligner le projet avant que les coûts n'augmentent.

Le calcul stratégique : quand la personnalisation a du sens

Compte tenu de ces coûts, quand la construction d'une infrastructure LLM personnalisée est-elle réellement stratégiquement judicieuse ?

Sensibilité et conformité des données

Les organisations qui traitent des données sensibles (santé, finance, gouvernement) peuvent être soumises à des exigences réglementaires ou à un niveau de tolérance au risque qui interdisent l'utilisation d'API externes. Le déploiement sur site devient alors obligatoire.

Une étude publiée sur arXiv propose un cadre décisionnel spécifiquement conçu pour l'adoption des logiciels LLM par les administrations publiques. Ce cadre souligne que la valeur stratégique et économique d'une solution repose sur un volume d'utilisation suffisant. Selon le rapport « Menlo Ventures 2025 State of Generative AI » cité dans l'étude, les leaders du marché, Anthropic, OpenAI et Google, ont collectivement enregistré une adoption massive ; toutefois, cela ne signifie pas que chaque organisation ait besoin d'une infrastructure personnalisée.

Différenciation et avantage concurrentiel

Si les capacités LLM constituent un facteur de différenciation clé du produit, les modèles personnalisés peuvent justifier l'investissement. Cela s'applique lorsque :

- Les données exclusives créent un corpus d'entraînement sans égal.

- Les connaissances spécialisées du domaine ne sont pas disponibles dans les modèles généraux.

- Le comportement du modèle et le style de sortie définissent l'identité de la marque

- La pression concurrentielle exige des capacités que d'autres ne peuvent pas facilement reproduire.

Les cas d'utilisation standardisés justifient rarement un déploiement personnalisé. La différenciation est essentielle.

Échelle et modèles d'utilisation

Des volumes d'utilisation extrêmement élevés peuvent rendre une infrastructure personnalisée plus avantageuse économiquement, malgré des coûts fixes importants. Le calcul repose sur la comparaison des coûts cumulés des API avec le coût total de possession.

Mais il faut être réaliste quant aux prévisions d'utilisation. Surestimer l'adoption et sous-estimer l'efficacité des API conduit à une infrastructure coûteuse sous-utilisée.

Investissement stratégique à long terme

Développer des compétences en LLM représente un investissement stratégique à long terme dans l'IA en tant que compétence fondamentale. Cela va au-delà des simples calculs de coûts et soulève des questions de capacités organisationnelles et de positionnement stratégique.

Les organisations qui choisissent cette voie s'engagent à investir continuellement dans les talents, les infrastructures et l'amélioration. Les coûts sont permanents, mais la liberté de choix stratégiques l'est tout autant.

Tendances émergentes en matière de coûts et perspectives d'avenir

L'économie des programmes de maîtrise en droit sur mesure continue d'évoluer rapidement. Plusieurs tendances influencent les calculs de coûts futurs.

Améliorations de l'efficacité matérielle

Les nouvelles architectures GPU améliorent constamment le rapport performance/prix. Selon une analyse du marché RISC-V publiée en 2025, le marché mondial des processeurs d'IA était évalué à 1 040 000 milliards de dollars en 2025 et devrait croître à un TCAC de 8,11 000 milliards de dollars pour atteindre 1 040 000 milliards de dollars d'ici 2030.

Cette croissance engendre concurrence et innovation architecturale. L'émergence de RISC-V comme architecture native de l'IA pourrait bouleverser la domination actuelle des GPU, et potentiellement faire baisser les coûts grâce à une concurrence accrue et à une spécialisation plus poussée.

Avancées en matière d'algorithmes et d'architecture

La recherche se poursuit afin de développer des architectures de modèles et des techniques d'entraînement plus efficaces. Les améliorations apportées aux mécanismes d'attention, aux approches de type « mélange d'experts » et aux modèles parcimonieux permettent de réduire les besoins en calcul pour des performances équivalentes.

Ces avancées permettent de réduire les coûts de formation et d'inférence, même si leur mise en œuvre efficace requiert une expertise.

Pressions réglementaires et de conformité

L'attention accrue des autorités de réglementation envers l'IA — notamment en matière de confidentialité des données, de biais et de transparence — pourrait favoriser les déploiements sur site pour les secteurs réglementés. Les coûts de mise en conformité pourraient rendre les infrastructures personnalisées relativement plus intéressantes malgré des coûts absolus plus élevés.

Consolidation du marché

D'après le rapport d'OpenAI sur l'IA en entreprise de décembre 2025, le volume de messages ChatGPT a été multiplié par huit en un an, tandis que l'utilisation de l'API a été multipliée par 320 par organisation. Cette concentration laisse présager une possible consolidation du marché autour de quelques fournisseurs.

La dépendance à l'égard de fournisseurs consolidés crée un risque stratégique qui pourrait justifier une infrastructure personnalisée comme protection contre la dépendance vis-à-vis d'un fournisseur unique ou la pression sur les prix.

Questions fréquemment posées

Combien coûte la formation d'un LLM à partir de zéro ?

L'entraînement d'un modèle linéaire généralisé (LLM) à partir de zéro coûte généralement entre 1 400 000 et plusieurs millions de dollars, selon la taille du modèle et les performances souhaitées. Ce coût inclut le calcul sur GPU (1 400 000 à 1 400 000 $ et plus), les ressources d'ingénierie (1 400 000 à 1 400 000 $ et plus) et la préparation des données (1 400 000 à 1 400 000 $). Il est possible d'entraîner des modèles de recherche plus petits à moindre coût grâce à des techniques d'optimisation budgétaire, mais l'obtention de performances compétitives à grande échelle exige un investissement conséquent. L'ajustement fin des modèles existants permet de réduire ce coût à 1 400 000 à 155 000 $ pour la plupart des cas d'utilisation.

Qu'est-ce qui est le moins cher : héberger un LLM personnalisé ou utiliser des services API ?

Les services API sont généralement plus économiques pour la plupart des organisations, sauf en cas de volume d'utilisation extrêmement élevé et constant. Un modèle à 32 milliards de paramètres hébergé 24 h/24 et 7 j/7 coûte environ 1 400 000 £ par an rien que pour l'infrastructure, tandis qu'un modèle à 70 milliards de paramètres coûte environ 1 400 000 £ par an (287 000 £). Avec une tarification API de 1 400 000 à 1 400 000 £ par million de jetons, atteindre le seuil de rentabilité nécessite le traitement de milliards de jetons par mois. De plus, un déploiement personnalisé requiert des ressources d'ingénierie (125 000 à 190 000 £ minimum), ressources que les services API permettent d'éviter.

Les petites entreprises peuvent-elles se permettre de créer des LLM sur mesure ?

Les petites entreprises peuvent optimiser des modèles open source existants pour un volume de données allant de 30 000 à 155 000 TPE/4T, ce qui est envisageable pour les startups bien financées. Cependant, le pré-entraînement à partir de zéro ou le déploiement à grande échelle en production (de 500 000 à 12 millions de TPE/4T par an) dépassent généralement les budgets des petites entreprises. La plupart des petites organisations obtiennent un meilleur retour sur investissement en utilisant des API commerciales ou des modèles plus petits et optimisés, déployés sur une infrastructure modeste. L'expertise technique requise représente également un défi pour les petites équipes.

Quels sont les coûts cachés liés à la gestion d'un LLM privé ?

Les coûts cachés comprennent les salaires des ingénieurs (de 150 000 à plus de 300 000 $ par poste spécialisé), les frais généraux de maintenance et d'exploitation, l'infrastructure de surveillance, la préparation et le nettoyage des données, les travaux de sécurité et de conformité, ainsi que le coût d'opportunité lié aux ressources non affectées aux problématiques métiers essentielles. Les déploiements en production nécessitent également une redondance et un équilibrage de charge qui multiplient les coûts d'infrastructure de base par 4 ou 5. Ces coûts indirects dépassent souvent le montant des factures cloud visibles.

Combien coûte la mise au point d'un modèle existant ?

Le réglage fin coûte entre $500 et $5 000 unités de calcul pour la plupart des projets, auxquels s'ajoutent entre $20K et $100K unités de calcul d'ingénierie, selon la complexité. Des études montrent qu'un réglage fin de 7 heures sur un seul GPU T4 coûte environ entre $2,50 et $3,50 unités de calcul dans le cloud. Des techniques d'optimisation des paramètres comme LoRa réduisent encore davantage les besoins. Le coût total d'un projet, préparation des données incluse, se situe généralement entre $30K et $155K, ce qui représente une réduction des coûts d'environ 95% par rapport à un pré-entraînement à partir de zéro.

Quand la création d'un LLM sur mesure est-elle judicieuse d'un point de vue commercial ?

La création de modules logiques personnalisés (LLM) se justifie lorsque la sensibilité des données exige un déploiement sur site, lorsque les fonctionnalités LLM constituent un avantage concurrentiel majeur qu'il convient de préserver, lorsque le volume d'utilisation dépasse le seuil de rentabilité des API, ou encore dans le cadre du développement de l'IA comme compétence stratégique à long terme. Les organisations qui traitent des données sensibles et réglementées, qui gèrent des milliards de jetons par mois ou qui développent des produits axés sur les LLM sont les candidates les plus probables. Les cas d'utilisation classiques justifient rarement un tel investissement.

Quelle taille de modèle les organisations doivent-elles choisir pour un déploiement personnalisé ?

Après optimisation, les organisations doivent choisir le modèle le plus petit répondant aux exigences de performance. En règle générale, les modèles de 7 à 13 milliards de paramètres gèrent efficacement de nombreuses charges de travail de production avec une infrastructure modeste. Les modèles à 32 milliards de paramètres offrent des capacités supérieures, mais nécessitent d'importantes ressources GPU. Les modèles à plus de 70 milliards de paramètres requièrent une infrastructure de niveau entreprise et ne doivent être déployés que lorsque les modèles plus petits s'avèrent manifestement incapables de répondre aux exigences. Tester différentes tailles de modèles avec des cas d'utilisation réels permet d'identifier le juste équilibre entre performances et coût.

La prise de décision : un cadre pratique

Le choix entre la création d'une infrastructure LLM sur mesure et le recours à des services commerciaux dépend en fin de compte des spécificités de chaque organisation. Voici comment aborder cette décision de manière systématique.

Commencez par évaluer honnêtement le volume d'utilisation. Calculez le débit de jetons attendu pour tous les cas d'utilisation. Comparez les coûts cumulés de l'API au coût total d'une infrastructure personnalisée, incluant l'ingénierie, la maintenance et les coûts d'opportunité. Soyez prudent dans vos projections d'utilisation : une surestimation conduit à une infrastructure sous-utilisée et coûteuse.

Évaluez les exigences en matière de sensibilité des données. Si la conformité réglementaire ou les risques commerciaux empêchent réellement le traitement externe, une infrastructure personnalisée devient nécessaire, indépendamment des comparaisons de coûts. Assurez-vous toutefois que cette contrainte est réelle et non présumée.

Envisagez une différenciation stratégique. La maîtrise du LLM offre-t-elle un avantage concurrentiel durable ou s'agit-il d'une fonctionnalité standard ? Les cas d'utilisation standardisés privilégient les API. Une véritable différenciation peut justifier un investissement sur mesure.

Évaluez les capacités de l'organisation de manière réaliste. La mise en place et l'exploitation d'une infrastructure LLM requièrent une expertise pointue. Les organisations dépourvues de talents en apprentissage automatique et en intelligence artificielle sont confrontées à une courbe d'apprentissage abrupte et à des coûts plus élevés.

Commencez modestement, quelle que soit la direction choisie. Utilisez des API commerciales ou des modèles optimisés sur une infrastructure modeste avant de vous engager dans un déploiement personnalisé à grande échelle. Démontrez la valeur ajoutée et les cas d'utilisation avec un investissement minimal, puis passez à l'échelle supérieure lorsque cela se justifie.

La plupart des organisations constatent que les API commerciales ou des modèles plus petits et optimisés répondent à leurs besoins à moindre coût et avec moins de risques que les déploiements sur mesure à grande échelle. Les cas exceptionnels – secteurs fortement réglementés, déploiements à très grande échelle, différenciation stratégique – justifient une infrastructure sur mesure, mais ils restent minoritaires.

Les coûts sont réels et substantiels. Les organisations qui s'engagent dans une infrastructure LLM personnalisée doivent l'envisager comme un investissement stratégique à long terme nécessitant une attention et des ressources constantes. Les demi-mesures mènent à des échecs coûteux.

Prêt à explorer le déploiement de LLM pour des cas d'usage spécifiques ? Évaluez les options de manière systématique, validez les hypothèses par des tests à petite échelle et ajustez les investissements à mesure que l'utilisation et la valeur ajoutée se précisent. Cette technologie est puissante, mais sa réussite repose sur l'adéquation des approches de déploiement aux besoins et aux capacités réels de l'organisation.