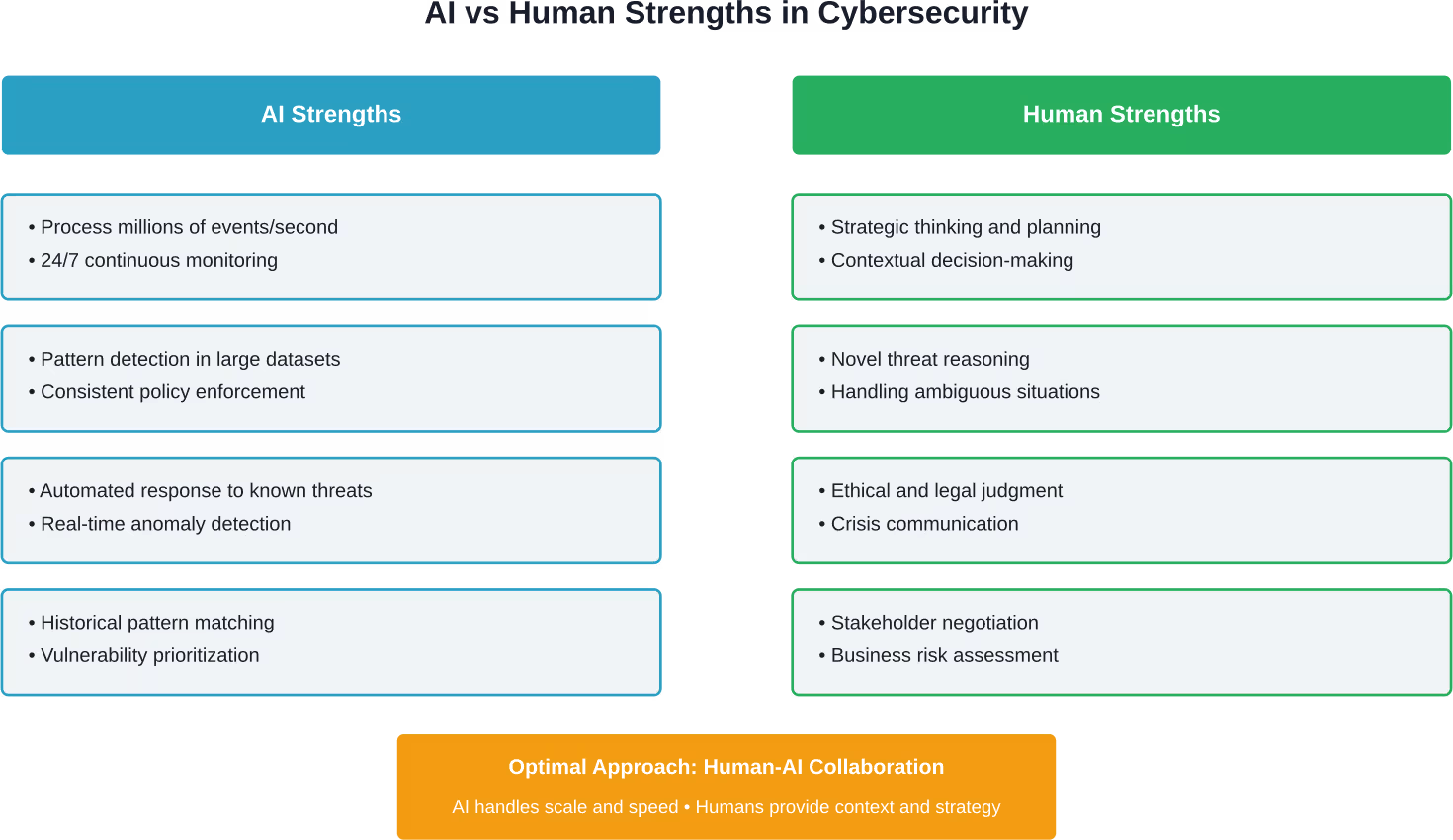

Résumé rapide : L'IA ne remplacera pas les professionnels de la cybersécurité, mais transformera leurs rôles en automatisant les tâches répétitives telles que la détection des menaces et l'analyse des journaux. Selon une étude de la CISA et du NIST, l'expertise humaine demeure essentielle pour la prise de décisions stratégiques, le jugement éthique, la gestion des incidents et la résolution des nouvelles menaces que les systèmes d'IA ne peuvent pas traiter seuls. L'avenir réside dans la collaboration entre l'humain et l'IA, où les professionnels guideront les outils d'IA plutôt que de les concurrencer.

La question revient sans cesse dans les milieux professionnels, les forums en ligne et les conférences sur la cybersécurité : l’IA va-t-elle remplacer les emplois en cybersécurité ? C’est une préoccupation légitime. Après tout, l’intelligence artificielle analyse déjà les schémas de trafic réseau, détecte les anomalies et réagit à certaines menaces plus rapidement que n’importe quelle équipe humaine.

Mais voilà le point essentiel : la relation entre l’IA et les professionnels de la cybersécurité n’est pas un jeu à somme nulle. Cette technologie ne supprime pas le rôle de l’humain. Au contraire, elle le redéfinit en exigeant de nouvelles compétences tout en préservant la valeur irremplaçable du jugement humain.

Soyons francs : l’IA excelle dans le traitement de vastes ensembles de données et l’identification de tendances. Elle peine en revanche à appréhender le contexte, la réflexion stratégique et les subtilités éthiques qui caractérisent les programmes de sécurité efficaces. Cet écart est plus important qu’on ne le croit.

État actuel de l'IA dans les opérations de cybersécurité

D'après les cas d'usage publiés par la CISA, les outils d'IA sont devenus des composantes essentielles des opérations de sécurité modernes. De la détection d'anomalies dans les données réseau à l'amélioration du renseignement sur les menaces, ces systèmes complètent les capacités humaines sans les remplacer.

Les initiatives d'automatisation pilotée par l'IA de la CISA visent à tirer parti de l'apprentissage automatique pour automatiser les processus et améliorer l'efficacité opérationnelle. Le programme de spécialiste certifié en automatisation pilotée par l'IA (CAIAS), créé en 2024, forme des professionnels à collaborer avec ces systèmes, et non à les concurrencer.

Les applications actuelles de l'IA en cybersécurité comprennent :

- Analyse comportementale : Les algorithmes d'apprentissage automatique établissent des modèles de comportement de base pour les utilisateurs et signalent les écarts pouvant indiquer des identifiants compromis ou des menaces internes.

- Analyse automatisée des vulnérabilités : Les systèmes d'IA évaluent en permanence les environnements cloud et l'infrastructure sur site afin de détecter les dérives de configuration et les failles de sécurité.

- Agrégation des renseignements sur les menaces : Le traitement automatique du langage naturel analyse les bulletins de sécurité, les forums du dark web et les flux d'informations sur les menaces afin de prioriser les risques émergents.

- Analyse des logigrammes à grande échelle : L'IA traite des millions d'entrées de journal pour identifier des schémas suspects qu'il faudrait des jours à des analystes humains pour déceler.

- Automatisation de l'application des politiques : L'IA garantit des configurations de sécurité cohérentes sur l'ensemble des comptes cloud distribués et détecte les dérives de configuration en temps réel.

Ces applications ont un point commun : elles prennent en charge les tâches répétitives et gourmandes en données qui, auparavant, mobilisaient une part considérable des ressources des équipes de sécurité. Un cours du Coastline College sur les applications de l’IA en cybersécurité, cité dans les documents du NICCS, met l’accent sur cette collaboration entre les technologies d’IA et la supervision humaine.

Conception et déploiement de systèmes d'IA avec AI Superior

IA supérieure Ce travail consiste à concevoir des systèmes d'IA adaptés aux environnements réels. Cela inclut la définition du problème, le développement de modèles et la vérification de leur bon fonctionnement une fois intégrés aux flux de travail opérationnels.

Besoin d'aide pour concevoir et déployer une IA ?

AI Superior peut vous aider avec :

- construction de modèles d'IA pour des cas d'utilisation pratiques

- définition de l'architecture système et de l'approche technique

- intégrer l'IA dans l'infrastructure d'entreprise

👉 Contactez l'IA supérieure pour discuter de votre projet, de vos données et de votre approche de mise en œuvre

Les limites de l'IA en matière de cybersécurité

Malgré des capacités impressionnantes, les systèmes d'IA présentent des limitations fondamentales qui empêchent l'automatisation complète des opérations de sécurité. La compréhension de ces contraintes explique pourquoi l'expertise humaine demeure indispensable.

Prise de décision contextuelle

L'IA excelle dans la reconnaissance de formes, mais peine à appréhender le contexte. Une augmentation soudaine du nombre de requêtes de base de données peut indiquer une attaque par injection SQL, ou refléter une activité commerciale légitime lors du lancement d'un produit. L'IA signale l'anomalie ; c'est à l'humain qu'il revient de déterminer s'il s'agit d'une menace.

Les décisions en matière de sécurité nécessitent souvent de comprendre les objectifs commerciaux, les exigences réglementaires et la tolérance au risque de l'organisation. Ce ne sont pas des données qu'un algorithme peut traiter indépendamment.

Nouveaux vecteurs d'attaque

Les modèles d'apprentissage automatique sont entraînés sur des données historiques. Lorsque des attaquants développent des techniques véritablement inédites, les systèmes d'IA manquent de points de repère. Le modèle risque alors de ne pas détecter les menaces qui ne correspondent pas aux schémas connus.

Prenons l'exemple de cet employé du secteur financier à Hong Kong qui a transféré 1 425 000 000 TP4 000 après une visioconférence en février 2024 avec ce qui semblait être le directeur financier et d'autres cadres supérieurs. La technologie deepfake a imité les intonations et l'apparence de manière suffisamment convaincante pour tromper la vigilance de l'employé. Les systèmes de détection par intelligence artificielle n'avaient jamais rencontré ce type d'attaque auparavant.

Les professionnels de la sécurité humaine, en revanche, peuvent raisonner sur des scénarios inconnus en appliquant les principes fondamentaux de la sécurité et en comprenant les motivations des attaquants.

IA adverse et manipulation de modèles

Les recherches du NIST sur la sécurité de l'IA soulignent que les systèmes d'IA eux-mêmes deviennent des cibles d'attaque. Les techniques d'apprentissage automatique adverses peuvent corrompre les données d'entraînement ou concevoir des entrées qui trompent les modèles de classification.

Un modèle de sécurité entraîné à identifier les logiciels malveillants peut mal classer un code malveillant si les attaquants modifient subtilement les caractéristiques des fichiers. Se défendre contre ces attaques exige des chercheurs en sécurité qui comprennent à la fois les vulnérabilités de l'IA et les tactiques des attaquants.

Le cours essentiel du NIST sur la validation des modèles d'IA et l'automatisation des tests pour les systèmes critiques, publié en mai 2025, répond précisément à ces préoccupations : vérifier la fiabilité de l'IA dans des domaines à haute assurance où les défaillances ont de graves conséquences.

Jugement éthique et juridique

Les incidents de sécurité soulèvent souvent des questions de confidentialité, de conformité légale et des dilemmes éthiques. L'équipe de sécurité d'une entreprise doit-elle accéder aux appareils personnels des employés pour enquêter sur une suspicion de fuite de données ? Comment concilier transparence et protection des informations sensibles lors d'un incident ?

Ces questions n'ont pas de réponses algorithmiques. Elles requièrent un jugement humain éclairé par les cadres juridiques, les principes éthiques et les valeurs organisationnelles.

Comment l'IA transforme les rôles en cybersécurité

Loin de supprimer les emplois en cybersécurité, l'IA en redéfinit la nature. Cette transformation reflète les mutations technologiques historiques : l'automatisation ne détruit pas les professions, elle réoriente plutôt l'effort humain vers des activités à plus forte valeur ajoutée.

De l'analyse manuelle à la supervision stratégique

Les analystes de sécurité passaient autrefois des heures à examiner manuellement les journaux de pare-feu et à corréler les événements entre différents systèmes. L'IA prend désormais en charge ce travail fastidieux, traitant les données à une vitesse qu'aucune équipe humaine ne pourrait égaler.

Ce changement permet aux analystes de se concentrer sur des questions stratégiques : les défenses actuelles sont-elles adaptées aux nouvelles menaces ? Comment prioriser les investissements en sécurité en fonction des risques opérationnels ? Quelles sont les lacunes des capacités de réponse aux incidents ?

D'après une étude de la Brookings Institution publiée en octobre 2024, plus de 301 millions de travailleurs pourraient être exposés aux effets de l'IA générative, les impacts les plus importants concernant les emplois moyennement et très bien rémunérés ainsi que les postes administratifs. Cependant, l'étude souligne que cette exposition ne signifie pas un remplacement, mais plutôt une transformation des tâches.

Nouvelles exigences en matière de compétences

Une étude du NIST sur l'impact de l'IA sur les effectifs en cybersécurité (publiée en juin 2025) souligne comment le cadre de référence NICE s'adapte à ces changements. Les professionnels de la cybersécurité ont de plus en plus besoin de compétences alliant expertise en sécurité et maîtrise de l'IA.

Selon les projections du Forum économique mondial citées dans la recherche universitaire, 391 000 milliards de dollars de compétences de la main-d'œuvre devraient changer d'ici 2030, ce qui nécessitera une adaptation et une requalification importantes pour répondre aux exigences changeantes du marché du travail.

Les compétences émergentes essentielles comprennent :

- Évaluation des modèles d'IA : Comprendre comment les modèles d'apprentissage automatique prennent des décisions et identifier les biais ou vulnérabilités potentiels

- Ingénierie rapide pour la sécurité : Interroger efficacement les systèmes d'IA pour extraire des renseignements pertinents sur les menaces et des informations de sécurité

- Défense contre l'IA adverse : Protection des systèmes d'IA contre les attaques de manipulation et d'empoisonnement

- Interprétation de l'algorithme : Traduire les résultats de l'IA en recommandations de sécurité exploitables

- Conception du flux de travail humain-IA : Structuration des processus pour optimiser la collaboration entre les systèmes automatisés et les analystes humains

Il ne s'agit pas de professions entièrement nouvelles. Ce sont des évolutions de rôles existants dans le domaine de la sécurité, améliorées par les capacités de l'IA.

Intervention renforcée en cas d'incident

L'IA accélère considérablement la détection et le confinement initiaux des menaces. Les systèmes automatisés peuvent isoler les terminaux compromis, bloquer les adresses IP malveillantes et déclencher des scénarios de réponse prédéfinis en quelques millisecondes après la détection d'un incident.

Mais les violations complexes nécessitent toujours une coordination humaine. Déterminer l'étendue de la violation, gérer la communication avec les parties prenantes, se coordonner avec les forces de l'ordre, prendre des décisions concernant la divulgation : ces activités requièrent un jugement que les algorithmes ne peuvent pas reproduire.

Cette relation symbiotique permet de réduire le délai moyen de résolution (MTTR) et d'apporter une réponse stratégique plus réfléchie. L'IA fournit des informations en temps réel. Les décisions cruciales restent du ressort des humains.

| Tâche de sécurité | Contribution de l'IA | Contribution humaine | Résultat de la collaboration |

|---|---|---|---|

| Détection des menaces | Analyse le trafic réseau et les journaux pour identifier les anomalies en temps réel | Valide les alertes, détermine les faux positifs, applique le contexte métier | Détection plus rapide avec moins de faux positifs |

| Gestion des vulnérabilités | Analyse l'infrastructure et priorise les vulnérabilités en fonction de leur exploitabilité et de leur exposition. | Évalue l'impact sur l'activité, planifie les mesures correctives, gère les exceptions | Priorisation basée sur les risques et alignée sur les besoins de l'entreprise |

| Réponse aux incidents | Automatise le confinement, exécute les scénarios d'intervention, collecte les données médico-légales | Dirige la stratégie d'enquête, prend les décisions relatives à la divulgation, coordonne les équipes | Un confinement plus rapide grâce à une prise de décision stratégique |

| Surveillance de la sécurité | Surveillance continue 24h/24 et 7j/7, reconnaissance de schémas parmi des millions d'événements | Ajuste les règles de détection, analyse les scénarios complexes et gère les escalades. | Couverture complète sans épuisement des analystes |

| Chasse aux menaces | Propose des hypothèses de chasse basées sur le renseignement sur les menaces, automatise les requêtes de données | Élabore des scénarios de chasse créatifs, interprète les résultats, recherche les anomalies | Découverte proactive des menaces à grande échelle |

Intégration concrète de l'IA et de la cybersécurité

Les organisations qui déploient déjà l'IA dans leurs opérations de sécurité illustrent concrètement ce que signifie cette collaboration. Il ne s'agit pas de futurs théoriques, mais de mises en œuvre actuelles.

Renseignement automatisé sur les menaces

Les équipes de sécurité utilisent l'IA pour agréger les flux de menaces provenant de centaines de sources, corréler les indicateurs de compromission et hiérarchiser les menaces en fonction de l'exposition de l'organisation. L'IA traite le langage naturel des bulletins de sécurité, extrait les indicateurs techniques pertinents et les associe aux ressources internes.

Des analystes humains examinent les menaces prioritaires, déterminent celles qui requièrent une action immédiate et adaptent les stratégies de défense en conséquence. Sans IA, les équipes seraient submergées par un flot de données brutes sur les menaces. Sans intervention humaine, le système serait incapable de traduire les renseignements en actions pertinentes.

Gestion de la posture de sécurité du cloud

Les outils basés sur l'IA analysent en continu les environnements cloud afin de détecter les erreurs de configuration, les contrôles d'accès trop permissifs et les violations de politiques. Ils corrigent automatiquement certains types de problèmes, par exemple en fermant les compartiments de stockage accessibles publiquement ou en révoquant les identifiants inutilisés.

Les architectes de sécurité définissent les politiques appliquées par l'IA. Ils déterminent les niveaux de risque acceptables, conçoivent les procédures de gestion des exceptions et veillent à ce que la remédiation automatisée soit cohérente avec les opérations métiers. L'IA assure l'application à grande échelle. Les humains, quant à eux, gèrent la stratégie et la gouvernance.

Analyse du comportement des utilisateurs

L'apprentissage automatique établit des modèles de référence pour les utilisateurs individuels et les groupes d'utilisateurs. Lorsqu'un compte utilisateur présente un comportement inhabituel (accès aux systèmes à des heures inhabituelles, téléchargement de gros volumes de données ou connexion depuis des lieux inhabituels), l'IA signale cette activité.

Les équipes de sécurité enquêtent sur les comptes signalés, interrogeant les utilisateurs si nécessaire et déterminant si un comportement anormal correspond à une activité commerciale légitime ou à une potentielle compromission. L'IA identifie les anomalies. L'intention est déterminée par les humains.

La réalité du marché du travail pour les professionnels de la cybersécurité

Les données issues de l'IEEE et de la recherche universitaire permettent de mieux comprendre l'impact réel de l'IA sur l'emploi, qui diffère sensiblement des scénarios dystopiques de remplacement.

Un article d'IEEE Spectrum de février 2024 examine l'idée que l'IA pourrait créer davantage d'emplois que de perturbations, et potentiellement relancer les emplois de la classe moyenne perdus lors des précédentes vagues d'automatisation. Cependant, la société doit se prémunir contre les mésusages de l'IA, notamment la désinformation et les deepfakes.

L'analyse d'IEEE Transmitter d'avril 2025 confirme cette évaluation, soulignant que l'IA remplace davantage de tâches que d'emplois. La prédiction de 2016 des chercheurs en IA, selon laquelle l'automatisation transformerait le travail plutôt que de l'éliminer, s'est largement avérée exacte près de dix ans plus tard.

En matière de cybersécurité, la demande reste supérieure à l'offre. Le secteur est confronté à une pénurie persistante de talents, malgré la prolifération des outils d'IA. Pourquoi ? Parce que l'IA crée de nouveaux défis en matière de sécurité, même si elle résout ceux qui existent déjà.

La sécurité basée sur l'IA crée elle-même des emplois.

La sécurisation des systèmes d'IA exige une expertise pointue. À mesure que les organisations déploient des modèles d'apprentissage automatique pour leurs opérations commerciales, elles ont besoin de professionnels maîtrisant l'IA adverse, la validation des modèles et les cadres de gouvernance de l'IA.

La note conceptuelle du NIST sur le profil RMF relatif à l'IA et à l'IA de confiance dans les infrastructures critiques (07/04/2026) aborde les exigences de sûreté, de sécurité et de fiabilité de l'IA déployée dans les systèmes critiques. La mise en œuvre de ces cadres requiert une expertise humaine ; il s'agit donc de créer des rôles plutôt que d'en supprimer.

Selon une analyse de la Brookings Institution, l'infrastructure, les modèles, la recherche et la gouvernance de l'IA ont représenté une part importante du financement privé total de l'IA à l'échelle mondiale entre 2014 et 2025. Cet investissement est un signe de création d'emplois, et non de destruction.

L'impératif de requalification

Cela dit, des compétences statiques ne suffisent plus. Les professionnels de la cybersécurité doivent s'adapter en permanence à l'évolution des capacités de l'IA. Les organisations qui investissent dans le développement de leurs effectifs – en formant leurs équipes existantes à l'intégration de l'IA plutôt qu'en les remplaçant – obtiennent généralement de meilleurs résultats en matière de sécurité.

Le programme de spécialiste certifié en automatisation pilotée par l'IA représente une voie possible. Des initiatives similaires, menées par des organisations industrielles, des établissements d'enseignement et des agences gouvernementales, contribuent à combler le fossé entre les compétences traditionnelles en sécurité et les rôles où l'IA est omniprésente.

Risques liés à l'IA en matière de cybersécurité

Paradoxalement, l'intégration de l'IA dans les opérations de sécurité crée de nouvelles vulnérabilités. La compréhension de ces risques explique pourquoi la supervision humaine demeure essentielle.

Apprentissage automatique adverse

Les attaquants peuvent manipuler les systèmes d'IA grâce à des entrées soigneusement conçues. Les exemples adverses — des entrées destinées à tromper les modèles d'apprentissage automatique — peuvent entraîner une mauvaise classification des logiciels malveillants, contourner les systèmes de reconnaissance faciale ou échapper à la détection d'intrusion.

D'après une étude de la RAND Corporation sur les risques liés à l'IA pour la sécurité, publiée en décembre 2017, ces vulnérabilités existaient dès les débuts de l'adoption de l'IA et n'ont fait que se perfectionner depuis. Se défendre contre les IA adverses exige des professionnels de la sécurité qui maîtrisent à la fois les mécanismes d'apprentissage automatique et les méthodes des attaquants.

Empoisonnement des données

Les modèles d'IA sont entraînés sur des données historiques. Si des attaquants compromettent les ensembles de données d'entraînement (en y injectant des exemples malveillants ou en faussant les distributions), les modèles résultants héritent de ces failles. Un modèle de détection de menaces corrompu pourrait ignorer systématiquement certaines signatures d'attaque ou générer un nombre excessif de faux positifs.

D'après une analyse de la Brookings Institution datant de septembre 2025, un investissement insuffisant dans la sécurité de l'IA au niveau étatique pourrait considérablement alourdir le coût de la cybercriminalité. En 2021, on estimait que la cybercriminalité avait coûté aux pays africains 101 030 milliards de dollars de leur produit intérieur brut, soit 1 400 milliards de dollars, illustrant ainsi les enjeux économiques des défaillances en matière de sécurité de l'IA.

Dépendance excessive et déqualification

Les organisations qui s'appuient trop sur l'IA risquent de déqualifier leurs équipes humaines. Si les analystes cessent de développer leurs compétences d'investigation manuelle parce que l'IA prend en charge les analyses de routine, ils perdent la capacité d'intervenir efficacement lorsque les systèmes d'IA tombent en panne ou sont confrontés à des situations inédites.

Pour préserver l'expertise humaine face à l'automatisation par l'IA, il est indispensable de développer les compétences des équipes. Celles-ci doivent avoir la possibilité de mettre en pratique leurs compétences fondamentales, même si l'IA pourrait théoriquement effectuer les tâches plus rapidement.

Explicabilité et responsabilité

De nombreux modèles d'IA fonctionnent comme des boîtes noires, produisant des résultats sans explication transparente. Lorsqu'un système d'IA signale un compte comme compromis, les équipes de sécurité doivent comprendre pourquoi. Sans explication, la validation des décisions de l'IA devient impossible.

Ce défi s'accentue dans les secteurs réglementés où les décisions en matière de sécurité doivent être vérifiables et justifiables. Les recherches du NIST sur l'IA de confiance soulignent que la sécurité des systèmes d'IA repose en partie sur l'explicabilité et la responsabilité, des attributs qui requièrent une gouvernance humaine.

Meilleures pratiques pour la collaboration homme-IA en matière de sécurité

Les organisations qui intègrent avec succès l'IA dans leurs opérations de sécurité suivent certaines pratiques. Ces pratiques permettent de maximiser les avantages de l'IA tout en préservant l'expertise humaine.

Définir des limites d'automatisation claires

Établissez des règles claires concernant les tâches que l'IA peut gérer de manière autonome et celles qui nécessitent une intervention humaine. Les activités à faible risque et à volume élevé, comme les analyses de vulnérabilité de routine, se prêtent à une automatisation complète. Les décisions à fort enjeu, telles que la divulgation d'incidents, exigent une supervision humaine.

Consignez ces limites dans les plans de sécurité afin que les équipes comprennent quand faire confiance aux résultats de l'IA et quand les valider indépendamment.

Mettre en œuvre la validation avec intervention humaine

Pour les décisions de sécurité critiques, concevez des processus exigeant une confirmation humaine avant l'exécution des actions recommandées par l'IA. Cela peut impliquer que des analystes examinent les alertes critiques avant tout blocage automatisé, ou qu'une approbation soit requise avant que les systèmes d'IA ne modifient les politiques de sécurité en production.

Les approches avec intervention humaine ralentissent légèrement la réponse, mais réduisent considérablement le risque de faux positifs pouvant perturber l'activité.

Surveillance continue des modèles

Les modèles d'IA se dégradent avec le temps, à mesure que les menaces évoluent et que les données d'entraînement deviennent obsolètes. Les équipes de sécurité doivent donc surveiller en permanence les performances des modèles, en suivant des indicateurs tels que les taux de faux positifs, la précision de la détection et la fiabilité des prédictions.

Lorsque les performances se dégradent, les modèles doivent être réentraînés avec les données les plus récentes. Cette maintenance continue exige une supervision humaine : les systèmes d’IA ne peuvent pas déterminer de manière autonome quand ils deviennent inefficaces.

Investissez dans la formation à la culture de l'IA

Les professionnels de la sécurité n'ont pas besoin de devenir des data scientists, mais ils doivent posséder des connaissances de base en IA. La formation devrait aborder le fonctionnement des modèles d'apprentissage automatique, les modes de défaillance courants et l'interprétation critique des résultats de l'IA.

Selon une étude du NIST sur l'impact sur la main-d'œuvre datant de juin 2025, les organisations qui investissent dans le développement des compétences en IA pour leurs équipes existantes obtiennent de meilleurs résultats d'intégration que celles qui tentent d'embaucher du personnel entièrement nouveau et spécialisé en IA.

Maintenir les capacités manuelles

Même si l'IA prend en charge les tâches routinières, les équipes doivent régulièrement pratiquer l'investigation et l'analyse manuelles. Ces exercices permettent de maintenir et d'entretenir les compétences, et préparent les équipes aux situations où les systèmes d'IA échouent ou se révèlent inadéquats.

Des exercices réguliers sur table simulant des défaillances de systèmes d'IA aident les équipes à se préparer à des opérations dégradées et à maintenir leur confiance dans leurs capacités fondamentales.

L'avenir : l'augmentation, pas le remplacement

De plus en plus d'éléments convergent vers un avenir où l'IA viendra compléter le travail des professionnels de la cybersécurité plutôt que de les remplacer. Il ne s'agit pas d'un vœu pieux : cela reflète les limites fondamentales de l'IA et la valeur intrinsèque du jugement humain.

À mesure que les capacités de l'IA se développent, les surfaces d'attaque s'étendent également. Chaque nouvelle application d'IA engendre des défis de sécurité qui requièrent l'expertise humaine. L'incident des deepfakes à Hong Kong illustre comment l'IA renforce autant les attaquants que les défenseurs.

La question “ l’IA va-t-elle remplacer la cybersécurité ? ” pose un problème mal posé. La question pertinente est : comment les professionnels de la cybersécurité vont-ils s’adapter pour tirer pleinement parti de l’IA tout en gérant les nouveaux risques qu’elle engendre ?

Les organisations ont besoin de professionnels maîtrisant à la fois les principes de sécurité traditionnels et les enjeux de l'ère de l'IA. Ceux qui développent des compétences hybrides, alliant connaissances fondamentales en sécurité et en IA, deviendront de plus en plus précieux.

Cette transformation rappelle de précédentes mutations technologiques. Le cloud computing n'a pas fait disparaître les administrateurs système ; il a modifié la nature même de leur fonction. De même, la technologie mobile n'a pas éliminé les développeurs de logiciels ; elle a réorienté les applications qu'ils conçoivent.

L'IA suit le même schéma. Elle élimine certaines tâches tout en en créant de nouvelles qui requièrent le jugement, la créativité et la réflexion stratégique humains.

Questions fréquemment posées

L'IA remplacera-t-elle complètement les analystes en cybersécurité ?

Non. L'IA automatisera les tâches répétitives comme l'analyse des journaux et la surveillance de routine, mais les analystes en cybersécurité demeurent indispensables à la prise de décisions stratégiques, à la coordination des interventions en cas d'incident et à la gestion des nouvelles menaces. Selon une étude de la CISA sur les cas d'usage de l'IA, les outils d'IA complètent les capacités humaines sans les remplacer. Les enquêtes complexes, le jugement éthique et la communication avec les parties prenantes requièrent une expertise humaine que l'IA ne peut reproduire.

Quels sont les emplois en cybersécurité les plus menacés par l'automatisation par l'IA ?

Les postes de début de carrière, principalement axés sur la surveillance de routine et l'analyse manuelle des journaux, sont ceux qui subissent la plus grande transformation. Toutefois, ces rôles évoluent plutôt que de disparaître : les analystes juniors se concentrent de plus en plus sur la validation des résultats de l'IA, l'optimisation des systèmes de détection et l'investigation des alertes critiques. Selon une étude de l'IEEE datant de 2025, l'IA remplace davantage de tâches qu'elle ne supprime d'emplois, réorientant ainsi les efforts humains vers des activités à plus forte valeur ajoutée.

Quels nouveaux rôles l'IA crée-t-elle dans la cybersécurité ?

L'IA crée des rôles spécialisés, notamment des spécialistes de la sécurité de l'IA qui protègent les systèmes d'apprentissage automatique contre les attaques adverses, des experts en validation de modèles qui vérifient la fiabilité des systèmes d'IA, des analystes de la gouvernance de l'IA qui garantissent un déploiement responsable de l'IA et des ingénieurs en sécurité qui optimisent les interactions de l'IA axées sur la sécurité. Le cadre 2026 du NIST sur l'IA de confiance dans les infrastructures critiques souligne la demande croissante de professionnels maîtrisant à la fois la sécurité et la gestion des risques liés à l'IA.

Les professionnels de la cybersécurité doivent-ils apprendre la programmation et la science des données ?

Une culture générale en IA est utile, mais une expertise pointue en programmation n'est pas indispensable pour la plupart des postes en cybersécurité. Les professionnels doivent comprendre le fonctionnement conceptuel des modèles d'apprentissage automatique, identifier les défaillances courantes et interpréter les résultats de l'IA de manière critique. Selon une étude du NIST sur les effectifs de 2025, une intégration réussie de l'IA repose davantage sur le développement de compétences hybrides – alliant les fondamentaux de la sécurité à une compréhension pratique de l'IA – que sur la transformation des professionnels de la sécurité en data scientists.

Comment les professionnels de la cybersécurité peuvent-ils se préparer à l'intégration de l'IA ?

Les professionnels devraient se former aux applications d'IA en sécurité, notamment au programme de spécialiste certifié en automatisation pilotée par l'IA (CAIAS) proposé par la CISA. Il est important de se concentrer sur la compréhension des principes fondamentaux de l'apprentissage automatique, des techniques d'IA adverses et des processus de collaboration homme-IA. Il convient de maintenir de solides compétences dans les domaines traditionnels de la sécurité tout en se familiarisant avec les outils d'IA utilisés pour la détection des menaces, la gestion des vulnérabilités et la réponse aux incidents.

Quels sont les principaux risques liés à l'utilisation de l'IA en cybersécurité ?

Les principaux risques comprennent les attaques adverses en apprentissage automatique qui manipulent les systèmes d'IA, la corruption des données qui altère l'entraînement des modèles, la dépendance excessive à l'égard de l'IA qui entraîne une déqualification des équipes humaines et le manque d'explicabilité qui complique la validation. Selon une étude de RAND sur les risques liés à la sécurité de l'IA, les organisations doivent remédier à ces vulnérabilités par une gouvernance rigoureuse de l'IA, une surveillance continue et le maintien d'un contrôle humain sur les décisions critiques en matière de sécurité.

L'IA va-t-elle rendre les emplois en cybersécurité plus faciles ou plus complexes ?

Les deux. L'IA prend en charge les tâches fastidieuses et répétitives qui accaparaient auparavant une part importante du temps des analystes, réduisant ainsi l'épuisement professionnel et améliorant l'efficacité. Cependant, l'IA introduit également une nouvelle complexité : sécuriser les systèmes d'IA eux-mêmes, valider les résultats des modèles et lutter contre les menaces permises par l'IA, telles que les deepfakes. Selon une étude de la Brookings Institution datant de 2024, plus de 301 000 millions de travailleurs sont exposés aux effets de l'IA générative, mais cette exposition transforme le travail plutôt que de le supprimer, en recentrant l'attention sur des activités plus stratégiques.

Conclusion : Embrasser l'avenir symbiotique

Les preuves sont claires : l’IA ne remplacera pas les professionnels de la cybersécurité, mais redéfinira leur rôle et les compétences dont ils ont besoin.

Les organisations qui considèrent l'IA comme un outil d'assistance humaine plutôt que de remplacement humain obtiennent de meilleurs résultats en matière de sécurité. Elles investissent dans la formation de leurs équipes à l'intégration de l'IA, maintiennent une séparation claire entre les activités automatisées et les activités réalisées par l'humain, et surveillent en permanence les performances de leurs systèmes d'IA.

Les professionnels de la cybersécurité qui développent leurs compétences en IA tout en conservant de solides fondamentaux en sécurité se positionnent pour une réussite professionnelle à long terme. Le secteur a besoin d'experts capables de piloter les systèmes d'IA, de valider leurs résultats et de relever les nouveaux défis posés par l'IA.

L'IA va-t-elle remplacer la cybersécurité ? La question est mal posée. L'IA transforme la profession, créant des opportunités pour celles et ceux qui embrassent le changement tout en conservant l'esprit critique et le jugement que les algorithmes ne peuvent reproduire.

L'avenir appartient aux professionnels qui maîtrisent la collaboration entre l'expertise humaine et l'intelligence artificielle, chacune apportant des forces complémentaires pour se défendre contre un paysage de menaces en constante évolution.

Prêt à pérenniser votre carrière en cybersécurité ? Commencez par explorer les programmes de formation axés sur l’IA comme CAIAS, acquérez une expérience pratique des outils de sécurité basés sur l’IA et développez une expertise à la fois dans les domaines de sécurité traditionnels et face aux nouveaux défis posés par l’IA. L’avenir symbiotique de la cybersécurité exige des professionnels capables de faire le lien entre ces deux mondes.