Résumé rapide : Les coûts de l'API Google LLM varient considérablement selon les modèles Vertex AI. En mars 2026, Gemini 3.1 Flash-Lite était proposé à partir de $0,25 par million de jetons d'entrée (pour ≤ 200 000 jetons) et à $0,25 par million de jetons pour > 200 000 jetons, tandis que Gemini 3.1 Pro coûtait entre $2 et $12 par million de jetons en fonction de la taille du contexte. La tarification dépendait du type de modèle, du volume de jetons, de la mise en cache et des fonctionnalités d'ancrage, le traitement par lots offrant une réduction de 50%.

La tarification des API LLM de Google est devenue un facteur crucial pour les développeurs et les entreprises qui créent des applications d'IA. Avec l'extension de la gamme de modèles Gemini de Vertex AI jusqu'à début 2026, la compréhension de la structure des coûts n'est plus une option.

Le problème ? Le modèle de tarification de Google repose sur de multiples variables : le nombre de jetons, la taille de la fenêtre de contexte, l’état du cache et le mode de traitement des requêtes (par lots ou en temps réel). Le coût d’un seul appel d’API peut varier de quelques centimes à plusieurs dollars selon la configuration.

Voici à quoi ressemblent les coûts réels actuellement.

Comprendre la structure tarifaire de l'API Google LLM

Google facture l'utilisation de l'API LLM via Vertex AI au jeton. Mais la simplicité s'arrête là.

D'après la page de tarification officielle de Vertex AI, les coûts sont divisés en jetons d'entrée (ce que les développeurs envoient au modèle) et en jetons de sortie (ce que le modèle génère). Cette double tarification implique qu'une consigne de 1 000 mots avec une réponse de 500 mots est facturée deux fois : une fois pour la lecture, une fois pour la rédaction.

Un jeton est un fragment de texte, généralement de 3 à 4 caractères en anglais. L'expression “ intelligence artificielle ” se divise en environ 4 jetons. Ainsi, un document commercial classique de 500 mots se traduit par environ 650 à 750 jetons.

Soyons francs : la plupart des développeurs sous-estiment la consommation de jetons de 30 à 401 TP3T lors de l’établissement de leur budget. Cet écart se creuse considérablement lorsqu’il s’agit d’entrées multimodales comme des images ou des vidéos.

Qu'est-ce qui constitue une demande facturable ?

Google facture tous les jetons traités lors des requêtes réussies (200 OK). Cependant, certaines erreurs 4xx (comme l'erreur 429 « Trop de requêtes ») sont gratuites, tandis que d'autres, liées au filtrage du contenu lors de la génération, peuvent entraîner des frais pour les jetons d'entrée.

C'est plus important qu'il n'y paraît. Lors des phases de test où les taux d'erreur peuvent atteindre 15-20%, cette protection représente des économies considérables.

Répartition des prix du modèle Gemini 3.1

La gamme Gemini 3.1 comprend plusieurs modèles aux prix très variés. Voici sa structure actuelle (mars 2026).

| Modèle | Saisie ≤ 200 000 jetons | Sortie ≤ 200 000 jetons | Saisie > 200 000 jetons | Générer plus de 200 000 jetons |

|---|---|---|---|---|

| Aperçu de Gemini 3.1 Pro | $2 par 1M | $12 par 1M | $4 par 1M | $18 par 1M |

| Aperçu de l'image Flash de Gemini 3.1 | 1 entrée TP4T0.50, 1 sortie TP4T3 par mètre | Image : $60 par M | N / A | N / A |

| Gemini 3 Standard | $3 par 1M | $15 par 1M | Des taux plus élevés s'appliquent | Des taux plus élevés s'appliquent |

Le tarif augmente lorsque le contexte d'entrée dépasse 200 000 jetons. À ce seuil, Google facture tous les jetons (entrée et sortie) au tarif pour contexte long. Pour Gemini 3.1 Pro, cela représente une augmentation du coût d'entrée de 1 001 TP3T (de 1 TP4T2 à 1 TP4T4) et une augmentation du coût de sortie de 501 TP3T (de 1 TP4T12 à 1 TP4T18).

Les modèles Flash sont conçus pour les applications économiques. À moitié prix des modèles Pro, ils privilégient la vitesse et l'économie au détriment de la profondeur de raisonnement. Pour les tâches simples de classification, de synthèse ou d'extraction, Flash offre 90% de la qualité des modèles Pro pour 25% du prix.

Avantage de tarification des entrées mises en cache

La mise en cache est un moyen pour les développeurs avisés de réduire considérablement les coûts. Lorsqu'un même contenu apparaît dans plusieurs requêtes (par exemple, un catalogue de produits, une documentation ou une base de connaissances), la mise en cache de ce contenu réduit les coûts de saisie répétée de 90%.

Pour Gemini 3.1 Pro, les jetons d'entrée mis en cache coûtent $0,20 par million au lieu de $2 (pour ≤200K jetons) ou $0,40 par million (pour >200K jetons).

Le calcul est rapide. Si une base de connaissances de 50 000 jetons est interrogée 100 fois par jour, la mise en cache permet d'économiser environ $9 par jour par rapport à l'envoi du contexte complet à chaque requête. Cela représente une économie de $270 par mois grâce à cette seule optimisation.

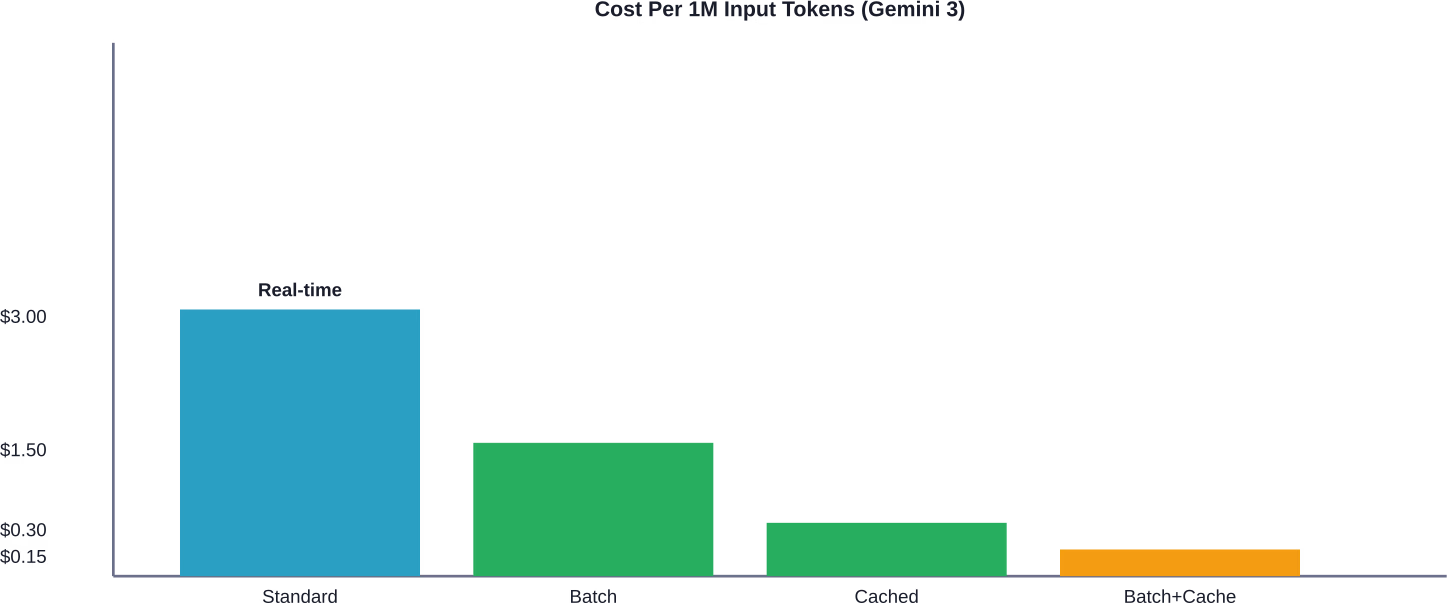

Coûts du traitement par lots par rapport aux coûts en temps réel

Le traitement par lots permet de réduire les coûts de moitié. Selon la documentation officielle de Vertex AI, le traitement par lots pour Gemini 3 Standard coûte 1,50 TP4T par million de jetons, contre 3 TP4T pour le traitement en temps réel (hors traitement par lots). Le traitement par lots coûte 7,50 TP4T par million de jetons, contre 15 TP4T pour le traitement en temps réel.

Le compromis ? La latence. Les tâches par lots s'exécutent de manière asynchrone, avec des temps d'exécution allant de quelques minutes à plusieurs heures. Pour le traitement de données nocturne, l'analyse de documents ou la génération de contenu en masse, ce délai est négligeable. En revanche, pour les chatbots ou les outils interactifs, il est rédhibitoire.

Les opérations de cache par lots bénéficient de remises similaires. Les écritures en cache sont facturées $1,875 par million de jetons, et les accès au cache $0,15. Pour les charges de travail importantes ne nécessitant pas de réponses immédiates, le traitement par lots avec mise en cache représente la solution la plus économique.

Mise à la terre et tarification des outils

Gemini 2.5 Pro inclut 10 000 requêtes de mise à la terre par jour sans frais supplémentaires. Au-delà de cette limite, Google facture 1 TP4T35 par tranche de 1 000 requêtes de mise à la terre.

Une requête géoréférencée signifie que le modèle interroge Google Search lors de sa génération. Pour garantir l'exactitude des faits dans les résumés d'actualités, l'aide à la recherche ou la consultation de données en temps réel, cette géoréférencement s'avère indispensable. Mais son coût est élevé.

Avec un coût de $35 pour 1 000 requêtes au sol, les scénarios d'utilisation intensive peuvent rapidement engendrer des frais importants. Une application effectuant 50 000 requêtes au sol par mois paie $1 750 rien que pour le traitement des requêtes, avant même le coût des jetons. L'allocation quotidienne gratuite couvre 300 000 requêtes mensuelles pour les comptes éligibles, ce qui suffit pour la plupart des déploiements de petite et moyenne taille.

L'analyse Web pour entreprises est facturée plus cher : 1 TP4T45 pour 1 000 requêtes ancrées. Ce niveau premium offre des fonctionnalités de recherche avancées et des sources de données d'entreprise. Les organisations qui souhaitent bénéficier de cette fonctionnalité sont invitées à contacter l'équipe commerciale de Google Cloud pour connaître les éventuelles remises sur volume.

Comparaison des coûts du LLM de Google avec ceux de ses concurrents

Comment les tarifs de Google se comparent-ils à ceux d'OpenAI et d'Anthropic ?

En mars 2026, le modèle GPT-5.2 Pro d'OpenAI coûtait $21 par million de jetons d'entrée et $168 par million de jetons de sortie, soit environ 10 fois plus que Gemini 3.1 Pro de Google. Claude Sonnet 4.5 d'Anthropic, quant à lui, consommait $3 par million de jetons d'entrée et $15 par million de jetons de sortie, un coût quasiment identique à celui de Gemini 3 Standard.

Mais c'est là que ça devient intéressant. La version 3.2 de DeepSeek est imbattable : à $0,28 par million de jetons d'entrée, elle est plus compétitive que toutes les autres solutions. Pour les applications à budget limité, les fournisseurs chinois ont instauré un nouveau seuil de prix que les fournisseurs occidentaux peinent à égaler.

| Fournisseur | Modèle | Entrée (par million de jetons) | Sortie (pour 1 million de jetons) |

|---|---|---|---|

| Gemini 3.1 Pro | $2.00 | $12.00 | |

| Gemini 3.1 Flash-Lite | $0.25 | Tarifs standard | |

| OpenAI | GPT-5.2 Pro | $21.00 | $168.00 |

| Anthropique | Claude Sonnet 4.5 | $3.00 | $15.00 |

| DeepSeek | V3.2-Exp | $0.28 | $0.40 |

Les performances sont aussi importantes que le prix. Selon certaines discussions au sein de la communauté, le prix très bas de DeepSeek pourrait impliquer des compromis en termes de qualité pour certaines tâches de raisonnement complexes. Les modèles Gemini 3.1 Pro de Google et Claude d'Anthropic offrent des performances supérieures sur des benchmarks tels que MMLU et HellaSwag.

Le calcul de la valeur dépend entièrement du cas d'utilisation. Pour l'analyse de documents juridiques à forts enjeux, payer dix fois plus cher pour la précision de GPT-5.2 Pro se justifie. Pour la classification des tickets d'assistance client, Gemini Flash ou DeepSeek offrent une qualité suffisante à un coût bien moindre.

Coûts cachés et frais d'infrastructure

Le prix des jetons ne révèle qu'une partie de la réalité. L'infrastructure d'IA de Vertex engendre des coûts supplémentaires que de nombreux développeurs négligent lors de la planification initiale.

Le stockage des données pour les applications RAG utilisant Vertex AI RAG Engine est facturé séparément. La tarification de Vertex AI Search repose sur un modèle configurable avec des abonnements mensuels pour la capacité de requêtes (QPM) et le stockage. Pour les sites web, le stockage est calculé à raison de 500 kilo-octets multipliés par le nombre de pages ; un site web de 1 000 pages coûte $2,38 par mois pour l’indexation des données uniquement.

Les bases de données vectorielles, qu'elles utilisent les offres gérées de Vertex AI ou des solutions tierces comme Pinecot ou Weaviate, engendrent des coûts de stockage et de requêtes par Go. Un déploiement RAG d'entreprise classique avec 50 Go d'embeddings peut entraîner des frais mensuels de stockage vectoriel de $50 à 150 £, indépendamment des coûts LLM.

Frais de transfert et de sortie de données

L'accès au stockage cloud, à Google Drive et aux autres sources de données accessibles depuis Vertex AI est gratuit, mais des frais de sortie de données s'appliquent. Le transfert de données hors des régions Google Cloud engendre des frais de bande passante allant de $0,08 à $0,23 par Go, selon la destination.

Pour les applications traitant des fichiers multimédias volumineux ou d'importantes collections de documents, le trafic de sortie peut alourdir les coûts totaux de 10 à 201 TP3T. Un pipeline de traitement vidéo gérant 1 To par mois engendre un coût de 1 TP4T80 à 230 TP4T rien que pour la bande passante.

Stratégies d'optimisation des coûts qui fonctionnent

L'écart entre une mise en œuvre basique et un déploiement optimisé peut atteindre 701 000 milliards de dollars de dépenses totales. Voici ce qui fait réellement la différence.

Mettre en œuvre une mise en cache contextuelle agressive

Au-delà de la simple mise en cache, l'implémentation d'une stratégie de cache multiniveau permet de réduire davantage les coûts. Stockez les contextes fréquemment consultés dans le cache natif de Vertex AI. Pour les contextes moins fréquents mais néanmoins récurrents, utilisez une couche Redis ou Memcached qui reconstruit les invites à partir de modèles.

Un exemple de réduction des coûts montre que la mise en œuvre d'un système de cache à deux niveaux pour un bot de service client référençant un catalogue de produits de 30 000 jetons peut réduire les coûts d'environ $2 400 à $720 par mois.

Compressez les invites sans sacrifier la qualité

L'optimisation des invites ne se limite pas à la qualité ; elle concerne aussi l'efficacité. Supprimer les mots superflus, utiliser des abréviations lorsque le contexte le permet et restructurer les invites peuvent réduire le nombre de jetons de 15 à 25% sans perte de qualité.

Au lieu de “ Veuillez analyser les commentaires clients suivants et fournir un résumé détaillé des principaux thèmes, du sentiment et des recommandations concrètes ”, utilisez “ Analysez ces commentaires. Liste : principaux thèmes, sentiment, recommandations concrètes ”. Même consigne, erreur 40% en moins.

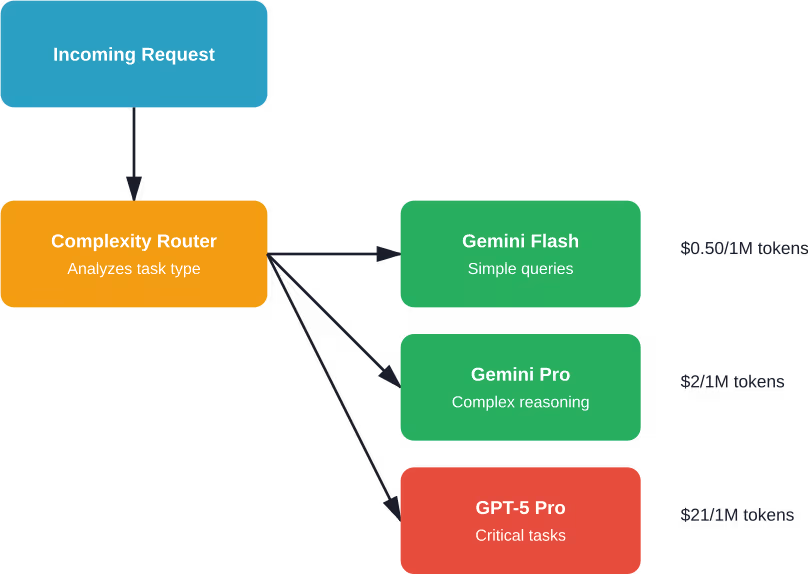

Acheminer les requêtes vers les modèles appropriés

Toutes les requêtes ne nécessitent pas Gemini Pro. La mise en place d'une couche de routage qui dirige les requêtes simples vers Flash et les raisonnements complexes vers Pro optimise le rapport coût/qualité.

Les tâches de classification, les questions-réponses de base et le remplissage de modèles fonctionnent correctement sur Flash. Le raisonnement en plusieurs étapes, l'analyse nuancée et la génération créative tirent parti des fonctionnalités supplémentaires de la version Pro. Le routage intelligent peut réduire les coûts moyens par requête de 40 à 501 TP3T sur des charges de travail mixtes.

Tout regrouper possible

L'importance du temps réel est souvent surestimée. La modération de contenu, la synthèse de documents, l'enrichissement des données et de nombreux autres flux de travail tolèrent des délais de 5 à 30 minutes sans impact pour l'utilisateur.

La migration de ces charges de travail vers le traitement par lots permet de réduire immédiatement les coûts (50%). Pour les organisations traitant des millions de requêtes par mois, cela représente des économies à cinq chiffres avec un minimum d'efforts d'ingénierie.

Surveiller et configurer les alertes budgétaires

Les coûts peuvent s'emballer. Une boucle de nouvelle tentative mal configurée, un pic de trafic inattendu ou une attaque par injection de requêtes peuvent épuiser un budget en quelques heures.

Les alertes de facturation de Google Cloud envoient des notifications lorsque les dépenses dépassent certains seuils. Configurer des alertes à 501 TP3 T, 751 TP3 T et 901 TP3 T de budget mensuel permet d'être prévenu à temps. Associer ces alertes à des limites de quota automatiques évite les dépassements catastrophiques.

Évitez de surpayer les API LLM, validez d'abord votre configuration.

L'utilisation des API Google LLM semble simple au premier abord, mais les coûts augmentent rapidement à mesure que l'utilisation se généralise, en particulier lorsque les invites, le flux de données et le comportement du modèle ne sont pas optimisés. IA supérieure Elle fonctionne sur l'ensemble du cycle de vie, de la préparation des données et de la sélection du modèle au réglage fin et au déploiement, ce qui contribue à réduire l'utilisation inutile des API et à éviter les configurations inefficaces.

Au lieu de se fier uniquement aux API externes, cette approche consiste souvent à évaluer quand des modèles personnalisés, un paramétrage précis ou des configurations hybrides sont plus avantageux financièrement. Ceci est particulièrement pertinent pour les entreprises qui passent de la phase de test à la production, où les coûts des API peuvent s'accumuler au fil du temps. Si vous prévoyez d'utiliser des API LLM ou si vous constatez déjà une augmentation des coûts, il est judicieux de revoir votre architecture au plus tôt. Contactez-nous. IA supérieure pour évaluer votre configuration avant que les coûts n'augmentent davantage.

Exemples de coûts concrets

La théorie importe moins que la pratique. Quel est le coût réel des déploiements ?

Chatbot d'assistance client

Une entreprise de commerce électronique de taille moyenne utilise un chatbot de support qui gère 50 000 conversations par mois. Chaque conversation comprend en moyenne 8 messages, chacun contenant 200 jetons d'entrée et 150 jetons de sortie.

Volume mensuel total : 50 000 conversations × 8 messages × (200 entrées + 150 sorties) = 140 millions de jetons (80M entrées, 60M sorties).

Utilisation de Gemini 3.1 Flash (entrée $0.50 pour texte/image, sortie $3 pour texte) : environ $40 entrée + $30 sortie = $70 par mois.

Utilisation de Gemini 3.1 Pro (entrée $2, sortie $12) : entrée $160 + sortie $720 = $880 par mois.

Flash gère efficacement ce cas d'utilisation, permettant une réduction des coûts de $810 par mois—97%.

Pipeline de traitement des documents

Une startup spécialisée dans les technologies juridiques traite 10 000 contrats par mois, chacun contenant en moyenne 5 000 jetons. L’extraction et l’analyse génèrent 1 000 jetons de sortie par document.

Volume total : 10 000 documents × (5 000 entrées + 1 000 sorties) = 60 millions de jetons (50M en entrée, 10M en sortie).

Pour le traitement par lots avec Gemini 3 Standard : 50M × $1.50/1M (entrée par lots) + 10M × $7.50/1M (sortie par lots) = $75 + $75 = $150 par mois.

Traitement en temps réel : 50M × $3/1M + 10M × $15/1M = $150 + $150 = $300 par mois.

Le traitement par lots permet de réduire les coûts de moitié sans impact sur la qualité des flux de travail de traitement nocturnes.

Quand choisir Google plutôt que ses concurrents

Les API LLM de Google excellent dans des scénarios spécifiques, mais ne sont pas optimales dans tous les cas.

Choisissez Google Vertex AI lorsque :

- Déjà opérationnel au sein de l'infrastructure Google Cloud : Les coûts de transfert et d'intégration des données diminuent considérablement.

- Nécessitant des capacités multimodales : Gemini gère le texte, les images, l'audio et la vidéo dans des invites unifiées.

- Création d'applications RAG : Les outils intégrés de recherche vectorielle et d'ancrage de Vertex AI réduisent la complexité architecturale

- Besoin de fenêtres de contexte ultra-longues : Gemini 1.5 Pro prend en charge jusqu'à 2 millions de jetons, surpassant largement la plupart de ses concurrents.

- Prioriser la rentabilité des tâches de complexité modérée : Les modèles Flash offrent une valeur ajoutée importante

Cherchez ailleurs lorsque :

La capacité de raisonnement maximale prime sur le coût : GPT-5.2 Pro surpasse Gemini dans les tâches logiques complexes. Dans des domaines spécialisés comme les mathématiques avancées ou la programmation compétitive, les modèles d’OpenAI dominent actuellement ces benchmarks. Exigences de conformité strictes : certains secteurs imposent des certifications spécifiques qui favorisent les fournisseurs établis.

Questions fréquemment posées

Quel est le prix de l'API LLM la moins chère de Google ?

Gemini 3.1 Flash-Lite coûte $0,25 par million de jetons d'entrée (pour un contexte ≤ 200 000) en mars 2026, ce qui en fait l'une des options les plus économiques de Google. Grâce au traitement par lots et à la mise en cache, le coût effectif peut descendre à $0,15 par million de jetons pour les accès au cache par lots, même si les premières écritures dans le cache par lots coûtent $1,875 par million.

Quelle est la différence de prix entre Gemini Pro et Flash ?

Gemini 3.1 Pro coûte $2 par million de jetons d'entrée, contre $0,50 pour Flash, soit un écart de 4 fois. On observe un écart similaire pour les jetons de sortie : Pro facture $12 par million, tandis que Flash utilise des tarifs standard nettement inférieurs. Pro offre un raisonnement plus précis et nuancé ; Flash privilégie la vitesse et le coût pour les tâches plus simples.

Google facture-t-il les requêtes API qui échouent ?

Google facture tous les jetons traités lors des requêtes réussies (200 OK). Cependant, certaines erreurs 4xx (comme l'erreur 429 « Trop de requêtes ») sont gratuites, tandis que d'autres, liées au filtrage du contenu lors de la génération, peuvent entraîner des frais pour les jetons d'entrée.

Comment la mise en cache du contexte réduit-elle les coûts LLM de Google ?

La mise en cache du contexte répété réduit le coût des jetons d'environ 90%. Pour Gemini 3.1 Pro, les jetons d'entrée mis en cache coûtent $0,20 par million contre $2 pour les jetons non mis en cache.

Quels sont les coûts de mise à la terre pour les modèles Gemini ?

Gemini 2.5 Pro inclut 10 000 requêtes de mise à la terre gratuites par jour. Au-delà, la mise à la terre standard coûte $35 par tranche de 1 000 requêtes. La mise à la terre web pour entreprises coûte $45 par tranche de 1 000 requêtes. Ces frais s'ajoutent aux coûts standard des jetons d'entrée et de sortie.

Puis-je utiliser gratuitement les API Google LLM ?

Contrairement à certains concurrents, Google ne propose pas d'offre gratuite permanente pour Vertex AI LLM. Cependant, les nouveaux comptes Google Cloud bénéficient de crédits (généralement $300) pour les tests initiaux. La tarification est à l'usage, sans minimum requis, ce qui permet de réaliser des tests à petite échelle à moindre coût.

Comment fonctionne la tarification du traitement par lots ?

Le traitement par lots réduit les coûts de jetons de 50% sur l'ensemble des modèles Gemini de Google. Par exemple, pour Gemini 3 Standard, le coût passe de $3 à $1,50 par million de jetons d'entrée et de $15 à $7,50 par million de jetons de sortie. Les requêtes par lots sont traitées de manière asynchrone et leur durée d'exécution varie de quelques minutes à plusieurs heures selon la profondeur de la file d'attente.

Prendre la décision en matière de coûts

La tarification de l'API LLM de Google positionne Vertex AI de manière compétitive sur le marché de 2026, notamment pour les applications fonctionnant déjà au sein de l'écosystème Google Cloud.

La structure des coûts favorise l'optimisation. Les développeurs qui mettent en œuvre la mise en cache, le traitement par lots et le routage intelligent des modèles peuvent réaliser des coûts effectifs de 70 à 801 TP3T inférieurs aux prix catalogue. Ceux qui déploient des modèles de manière naïve paieront beaucoup trop cher.

La tarification par jetons reste le modèle dominant chez tous les principaux fournisseurs, mais le coût effectif par réponse générée par l'IA varie considérablement selon les choix d'implémentation. Un déploiement bien conçu sur Gemini Flash peut offrir des capacités d'IA à un dixième du coût d'un déploiement GPT-5 Pro non optimisé.

La question essentielle n'est pas de savoir quel fournisseur propose le prix catalogue le plus bas, mais quelle combinaison de fonctionnalités du modèle, de structure tarifaire et d'intégration d'infrastructure offre le meilleur rapport qualité-prix pour des caractéristiques de charge de travail spécifiques.

Commencez par une analyse comparative claire. Testez des charges de travail représentatives sur les modèles Google, OpenAI et Anthropic. Mesurez non seulement la qualité, mais aussi la consommation réelle de jetons, la latence et les taux d'erreur. Calculez le coût total de possession, incluant l'infrastructure, le transfert de données et le temps d'ingénierie.

Ensuite, optimisez sans relâche. Chaque réduction de 10% du nombre moyen de jetons par requête, chaque point de pourcentage d'amélioration du taux d'accès au cache, chaque charge de travail migrée vers le traitement par lots se traduit directement par des économies substantielles.

Le paysage des coûts des technologies de modélisation juridique (LLM) évolue rapidement. Les prix compétitifs d'aujourd'hui pourraient devenir obsolètes d'ici quelques mois, les fournisseurs se livrant une concurrence féroce pour gagner des parts de marché. La flexibilité budgétaire et l'adaptabilité architecturale sont tout aussi importantes que les prix actuels pour la construction d'une infrastructure d'IA à long terme.