Kurzzusammenfassung: Die Kosten der Google LLM API variieren je nach Vertex AI-Modell erheblich. Stand März 2026 beginnen die Kosten für Gemini 3.1 Flash-Lite bei $0,25 pro 1 Million Eingabe-Token (für ≤ 200.000 Token) und ebenfalls bei $0,25 pro 1 Million Token (für > 200.000 Token). Gemini 3.1 Pro hingegen kostet je nach Kontextgröße zwischen $2 und $12 pro 1 Million Token. Die Preisgestaltung richtet sich nach Modelltyp, Token-Volumen, Caching- und Grounding-Funktionen. Batch-Verarbeitung bietet einen Rabatt von 50%.

Die Preisgestaltung für Googles LLM-APIs ist für Entwickler und Unternehmen, die KI-Anwendungen entwickeln, zu einem entscheidenden Faktor geworden. Angesichts der Erweiterung der Gemini-Modellfamilie von Vertex AI bis Anfang 2026 ist das Verständnis der Kostenstruktur unerlässlich.

Die Herausforderung? Googles Preismodell basiert auf mehreren Variablen – Tokenanzahl, Kontextfenstergröße, Caching-Status und ob Anfragen im Batch- oder Echtzeitverfahren verarbeitet werden. Ein einzelner API-Aufruf kann je nach Konfiguration zwischen Bruchteilen eines Cents und mehreren Dollar kosten.

So sehen die tatsächlichen Kosten aktuell aus.

Die Preisstruktur der Google LLM API verstehen

Google berechnet die Nutzung der LLM-API über Vertex AI tokenbasiert. Doch damit endet die Einfachheit.

Laut der offiziellen Preisseite von Vertex AI werden die Kosten in Eingabe-Tokens (die Entwickler an das Modell senden) und Ausgabe-Tokens (die das Modell generiert) aufgeteilt. Dieses zweistufige Preismodell bedeutet, dass eine 1.000 Wörter umfassende Anfrage mit einer 500 Wörter umfassenden Antwort zweimal abgerechnet wird – einmal für das Lesen und einmal für das Schreiben.

Ein Token ist ein Textfragment, typischerweise 3–4 Zeichen im Englischen. Der Ausdruck “künstliche Intelligenz” lässt sich in etwa 4 Tokens unterteilen. Ein typisches 500 Wörter langes Geschäftsdokument ergibt somit ungefähr 650–750 Tokens.

Mal ehrlich: Die meisten Entwickler unterschätzen den Tokenverbrauch bei der Budgetplanung um 30 bis 401 Tsd. Token. Diese Diskrepanz vergrößert sich dramatisch bei multimodalen Eingaben wie Bildern oder Videos.

Was gilt als abrechnungsfähige Anfrage?

Google berechnet Gebühren für alle verarbeiteten Tokens bei erfolgreichen Anfragen (200 OK). Einige 4xx-Fehler (wie z. B. 429 Too Many Requests) sind jedoch kostenlos, während andere, die mit der Inhaltsfilterung während der Generierung zusammenhängen, weiterhin Gebühren für eingegebene Tokens verursachen können.

Das ist wichtiger, als es zunächst klingt. In Testphasen, in denen Fehlerraten von 15–20% auftreten können, bedeutet dieser Schutz erhebliche Einsparungen.

Preisübersicht des Modells Gemini 3.1

Die Gemini 3.1-Familie umfasst mehrere Modelle mit deutlich unterschiedlichen Preisen. Hier die aktuelle Struktur (Stand: März 2026).

| Modell | Eingabe ≤200K Token | Ausgabe ≤200K Token | Eingabe >200.000 Token | Ausgabe >200.000 Token |

|---|---|---|---|---|

| Gemini 3.1 Pro Vorschau | $2 pro 1M | $12 pro 1M | $4 pro 1M | $18 pro 1M |

| Gemini 3.1 Blitzbildvorschau | $0,50 Eingang, $3 Ausgang pro 1M | Bild: $60 pro 1M | N / A | N / A |

| Gemini 3 Standard | $3 pro 1M | $15 pro 1M | Es gelten höhere Tarife. | Es gelten höhere Tarife. |

Die Preisstufe ändert sich, sobald der Eingabekontext 200.000 Token übersteigt. Ab diesem Schwellenwert berechnet Google alle Token – sowohl Eingabe- als auch Ausgabetoken – zum Tarif für längere Kontexte. Für Gemini 3.1 Pro bedeutet dies eine Erhöhung der Eingabekosten um 100% (von $2 auf $4) und der Ausgabekosten um 50% (von $12 auf $18).

Die Flash-Modelle richten sich an kostenbewusste Anwender. Sie kosten nur die Hälfte der Pro-Modelle und bieten dafür weniger Rechenleistung, dafür aber höhere Geschwindigkeit und Wirtschaftlichkeit. Für einfache Klassifizierungs-, Zusammenfassungs- oder Extraktionsaufgaben liefern die Flash-Modelle die gleiche Qualität wie die Pro-Modelle (90%) zum Bruchteil des Preises (25%).

Preisvorteile bei zwischengespeicherten Eingaben

Durch Caching können clevere Entwickler die Kosten drastisch senken. Wenn derselbe Kontext bei mehreren Anfragen auftaucht – beispielsweise bei einem Produktkatalog, einer Dokumentation oder einer Wissensdatenbank – reduziert das Caching dieser Inhalte die Kosten für wiederholte Eingaben um 901T³T.

Bei Gemini 3.1 Pro kosten zwischengespeicherte Eingabe-Token $0,20 pro Million anstatt $2 (für ≤200K Token) oder $0,40 pro Million (für >200K Token).

Die Rechnung geht schnell auf. Wenn eine Wissensdatenbank mit 50.000 Tokens 100 Mal täglich abgefragt wird, spart Caching im Vergleich zum Senden des vollständigen Kontexts bei jeder Abfrage etwa $9 pro Tag. Das sind $270 pro Monat durch eine einzige Optimierung.

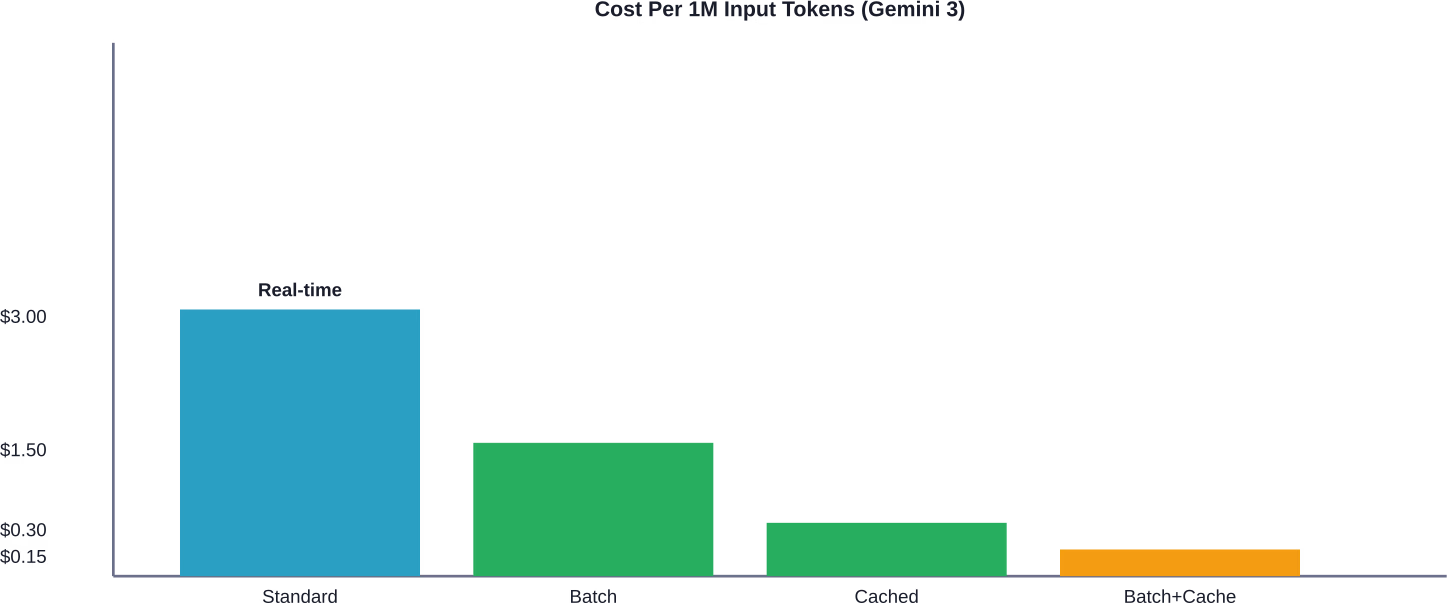

Stapelverarbeitung vs. Echtzeitverarbeitung – Kosten

Durch Batch-Anfragen halbieren sich die Kosten. Laut offizieller Dokumentation von Vertex AI kostet die Batch-Eingabe für Gemini 3 Standard 1,50 TP4T pro Million Token, im Vergleich zu 3 TP4T für Echtzeitverarbeitung (ohne Batch). Die Batch-Ausgabe kostet 7,50 TP4T pro Million Token, im Vergleich zu 15 TP4T für Echtzeitverarbeitung.

Der Nachteil? Latenz. Batch-Jobs werden asynchron verarbeitet, die Bearbeitungszeiten können von Minuten bis Stunden reichen. Für die Datenverarbeitung über Nacht, die Dokumentenanalyse oder die Massengenerierung von Inhalten ist diese Verzögerung irrelevant. Für Chatbots oder interaktive Tools ist sie jedoch ein Ausschlusskriterium.

Batch-Cache-Operationen bieten ähnliche Preisnachlässe. Cache-Schreibvorgänge sinken auf 1,875 TP4T pro Million Token und Cache-Treffer auf 0,15 TP4T. Für Workloads mit hohem Datenvolumen, bei denen keine sofortigen Antworten erforderlich sind, stellt die Batch-Verarbeitung mit Caching die mit Abstand kostengünstigste Lösung dar.

Erdung und Werkzeugpreise

Gemini 2.5 Pro beinhaltet 10.000 Erdungshinweise pro Tag ohne zusätzliche Kosten. Für jeden weiteren Erdungshinweis berechnet Google $35.

Eine datenbasierte Abfrage bedeutet, dass das Modell während der Generierung Google Search abfragt. Für die faktische Richtigkeit von Nachrichtenzusammenfassungen, Rechercheunterstützung oder Echtzeit-Datenabfragen ist diese Datenbasis von unschätzbarem Wert. Doch die Kosten summieren sich.

Bei $35 pro 1.000 abgeschlossenen Anfragen können die Kosten bei intensiver Nutzung schnell in die Höhe schnellen. Eine Anwendung, die monatlich 50.000 abgeschlossene Anfragen stellt, zahlt allein für die Abwicklung 1.750 $ – zuzüglich Token-Kosten. Das kostenlose Tageskontingent deckt 300.000 monatliche Anfragen für berechtigte Konten ab und ist damit für die meisten kleinen bis mittleren Implementierungen ausreichend.

Web Grounding für Unternehmen ist teurer: $45 pro 1.000 geerdete Abfragen. Diese Premium-Stufe bietet erweiterte Suchfunktionen und Zugriff auf Unternehmensdatenquellen. Organisationen, die diese Funktion benötigen, sollten sich bezüglich möglicher Mengenrabatte an das Google Cloud-Account-Team wenden.

Vergleich der LLM-Kosten von Google mit denen der Konkurrenz

Wie schneiden die Preise von Google im Vergleich zu OpenAI und Anthropic ab?

Stand März 2026 kostet OpenAIs GPT-5.2 Pro $21 pro Million Eingabe-Token und $168 pro Million Ausgabe-Token – etwa das Zehnfache von Googles Gemini 3.1 Pro. Anthropics Claude Sonnet 4.5 kostet $3 pro Million Eingabe-Token und $15 pro Million Ausgabe-Token, nahezu identisch mit Gemini 3 Standard.

Doch jetzt wird es interessant. DeepSeek V3.2 unterbietet die Konkurrenz mit $0,28 pro Million Input-Token. Für kostenbewusste Anwendungen haben chinesische Anbieter damit eine neue Preisuntergrenze geschaffen, die westliche Anbieter nur schwer erreichen können.

| Anbieter | Modell | Eingabe (pro 1 Mio. Token) | Ausgabe (pro 1 Million Token) |

|---|---|---|---|

| Gemini 3.1 Pro | $2.00 | $12.00 | |

| Gemini 3.1 Blitzleuchte | $0.25 | Standardtarife | |

| OpenAI | GPT-5.2 Pro | $21.00 | $168.00 |

| Anthropisch | Claude Sonett 4.5 | $3.00 | $15.00 |

| DeepSeek | V3.2-Exp | $0.28 | $0.40 |

Leistung ist genauso wichtig wie der Preis. Diskussionen in der Community deuten darauf hin, dass der extrem niedrige Preis von DeepSeek bei bestimmten komplexen Berechnungsaufgaben mit Qualitätseinbußen einhergehen könnte. Googles Gemini 3.1 Pro und Anthropics Claude-Modelle liefern in Benchmarks wie MMLU und HellaSwag deutlich bessere Ergebnisse.

Die Wertberechnung hängt vollständig vom Anwendungsfall ab. Für die Analyse hochsensibler juristischer Dokumente ist es sinnvoll, für die Genauigkeit von GPT-5.2 Pro das Zehnfache zu bezahlen. Für die Klassifizierung von Kundensupport-Tickets bieten Gemini Flash oder DeepSeek hingegen ausreichende Qualität zu einem Bruchteil der Kosten.

Versteckte Kosten und Infrastrukturgebühren

Die Token-Preisgestaltung ist nur ein Teil der Wahrheit. Die Vertex AI-Infrastruktur verursacht zusätzliche Kosten, die viele Entwickler bei der ersten Planung übersehen.

Die Datenspeicherung für RAG-Anwendungen mit der Vertex AI RAG Engine ist kostenpflichtig. Die Preisgestaltung von Vertex AI Search basiert auf einem konfigurierbaren Modell mit monatlichen Abonnements für Abfragekapazität (QPM) und Speicherplatz. Bei Websites berechnet sich der Speicherplatz mit 500 Kilobyte multipliziert mit der Seitenzahl – eine Website mit 1.000 Seiten kostet monatlich $2,38 allein für die Datenindizierung.

Vektordatenbanken, ob mit den Managed-Lösungen von Vertex AI oder Drittanbieterlösungen wie Pinecot oder Weaviate, verursachen zusätzliche Speicher- und Abfragekosten pro GB. Eine typische RAG-Implementierung in einem Unternehmen mit 50 GB eingebetteten Daten kann monatlich $50-150 an Vektorspeicherkosten verursachen, unabhängig von den LLM-Kosten.

Gebühren für Datenübertragung und ausgehenden Datenverkehr

Der Zugriff auf Cloud-Speicher, Google Drive und andere Datenquellen von Vertex AI ist kostenlos, es fallen jedoch Kosten für den Datentransfer an. Für die Übertragung von Daten aus Google Cloud-Regionen fallen Bandbreitengebühren zwischen $0,08 und $0,23 pro GB an, abhängig vom Zielort.

Bei Anwendungen, die große Multimediadateien oder umfangreiche Dokumentensammlungen verarbeiten, können die Kosten für ausgehenden Datenverkehr 10–201 TP3T betragen. Eine Videoverarbeitungspipeline, die monatlich 1 TB verarbeitet, zahlt allein für die Bandbreite 1 TP4T80–230.

Kostenoptimierungsstrategien, die funktionieren

Die Differenz zwischen einer unüberlegten Implementierung und einer optimierten Bereitstellung kann sich auf bis zu 701.300 Billionen US-Dollar belaufen. Hier erfahren Sie, was den entscheidenden Unterschied macht.

Aggressives Kontext-Caching implementieren

Über das einfache Caching hinaus senkt eine mehrstufige Cache-Strategie die Kosten weiter. Häufig aufgerufene Kontexte werden im nativen Cache von Vertex AI gespeichert. Für weniger häufige, aber dennoch wiederkehrende Kontexte wird eine Redis- oder Memcached-Schicht verwendet, die Eingabeaufforderungen anhand von Vorlagen rekonstruiert.

Ein Beispiel zur Kostenreduzierung zeigt, dass die Implementierung eines zweistufigen Caching-Systems für einen Kundenservice-Bot, der auf einen 30.000 Token umfassenden Produktkatalog zugreift, die Kosten von etwa $2.400 auf $720 monatlich senken kann.

Eingabeaufforderungen komprimieren, ohne die Qualität zu beeinträchtigen

Bei der Optimierung von Eingabeaufforderungen geht es nicht nur um Qualität, sondern auch um Effizienz. Durch das Entfernen von Füllwörtern, die Verwendung von Abkürzungen, wo es der Kontext erlaubt, und die Umstrukturierung von Eingabeaufforderungen lässt sich die Anzahl der Token um 15 bis 251T reduzieren – ohne Qualitätsverlust.

Statt “Bitte analysieren Sie das folgende Kundenfeedback und fassen Sie die wichtigsten Themen, die Stimmung und die daraus resultierenden Handlungsempfehlungen detailliert zusammen” verwenden Sie “Analysieren Sie dieses Feedback. Listen Sie auf: Hauptthemen, Stimmung, Handlungsempfehlungen.” Gleiche Anweisung, 40% weniger Tokens.

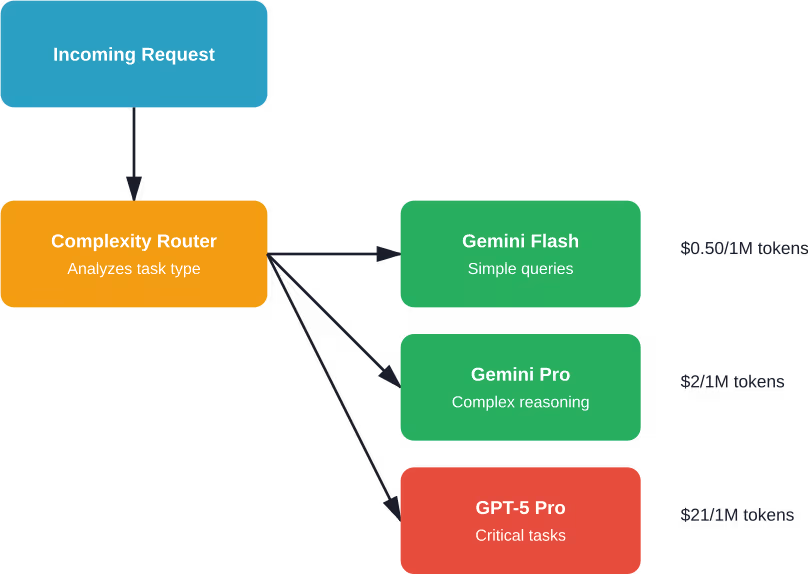

Anfragen an geeignete Modelle weiterleiten

Nicht jede Anfrage benötigt Gemini Pro. Die Implementierung einer Routing-Schicht, die einfache Abfragen an Flash und komplexe Schlussfolgerungen an Pro weiterleitet, optimiert das Kosten-Nutzen-Verhältnis.

Klassifizierungsaufgaben, einfache Frage-Antwort-Runden und das Ausfüllen von Vorlagen funktionieren einwandfrei mit Flash. Mehrstufige Schlussfolgerungen, differenzierte Analysen und die Generierung kreativer Inhalte profitieren von den zusätzlichen Funktionen von Pro. Intelligentes Routing kann die durchschnittlichen Kosten pro Anfrage bei gemischten Arbeitslasten um 40–501 TP3T senken.

Alles in einem Batch-Verfahren möglich

Die Anforderungen an Echtzeit werden oft überbewertet. Inhaltsmoderation, Dokumentenzusammenfassung, Datenanreicherung und viele andere Arbeitsabläufe tolerieren Verzögerungen von 5 bis 30 Minuten ohne Auswirkungen auf die Nutzer.

Die Migration dieser Arbeitslasten auf Stapelverarbeitung senkt die Kosten sofort um 50%. Für Organisationen, die monatlich Millionen von Anfragen verarbeiten, bedeutet das fünfstellige Einsparungen bei minimalem Entwicklungsaufwand.

Budget überwachen und Warnungen einrichten

Es kann zu unkontrollierten Kosten kommen. Eine falsch konfigurierte Wiederholungsschleife, ein unerwarteter Anstieg des Datenverkehrs oder ein Prompt-Injection-Angriff können Budgets innerhalb weniger Stunden aufzehren.

Die Abrechnungsbenachrichtigungen von Google Cloud lösen automatisch Warnungen aus, sobald Ausgaben bestimmte Schwellenwerte überschreiten. Durch die Einrichtung von Benachrichtigungen bei monatlichen Budgetgrenzen von 501 TP3T, 751 TP3T und 901 TP3T werden Sie frühzeitig gewarnt. Die Kombination von Benachrichtigungen mit automatischen Kontingentbegrenzungen verhindert gravierende Kostenüberschreitungen.

Vermeiden Sie überhöhte Preise für LLM-APIs, überprüfen Sie zuerst Ihre Konfiguration.

Die Verwendung der Google LLM APIs erscheint auf den ersten Blick unkompliziert, doch die Kosten steigen schnell an, sobald die Nutzung zunimmt – insbesondere dann, wenn Eingabeaufforderungen, Datenfluss und Modellverhalten nicht optimiert sind. AI Superior Funktioniert über den gesamten Lebenszyklus hinweg, von der Datenaufbereitung und Modellauswahl bis hin zur Feinabstimmung und Bereitstellung, was dazu beiträgt, unnötige API-Nutzung zu reduzieren und ineffiziente Setups zu vermeiden.

Anstatt sich ausschließlich auf externe APIs zu verlassen, beinhaltet dieser Ansatz häufig die Prüfung, wann benutzerdefinierte Modelle, Feinabstimmungen oder hybride Setups finanziell sinnvoller sind. Dies ist besonders relevant für Unternehmen, die von der Test- zur Produktionsumgebung wechseln, da sich die API-Kosten im Laufe der Zeit summieren können. Wenn Sie planen, auf LLM-APIs zu setzen oder bereits steigende Kosten feststellen, lohnt es sich, Ihre Architektur frühzeitig zu überprüfen. Kontaktieren Sie uns. AI Superior um Ihre aktuelle Situation zu bewerten, bevor die Kosten weiter steigen.

Kostenbeispiele aus der Praxis

Die Theorie ist weniger wichtig als die Praxis. Was kosten tatsächliche Einsätze?

Kundensupport-Chatbot

Ein mittelständisches E-Commerce-Unternehmen betreibt einen Support-Bot, der monatlich 50.000 Konversationen bearbeitet. Jede Konversation umfasst durchschnittlich 8 Nachrichten mit jeweils 200 Eingabe- und 150 Ausgabetoken.

Monatliches Gesamtvolumen: 50.000 Konversationen × 8 Nachrichten × (200 Eingaben + 150 Ausgaben) = 140 Millionen Token (80 Millionen Eingaben, 60 Millionen Ausgaben).

Bei Verwendung von Gemini 3.1 Flash ($0.50 Eingang für Text/Bild, $3 Ausgang für Text): ungefähr $40 Eingang + $30 Ausgang = $70 monatlich.

Bei Verwendung von Gemini 3.1 Pro ($2 Eingang, $12 Ausgang): $160 Eingang + $720 Ausgang = $880 monatlich.

Flash bewältigt diesen Anwendungsfall effektiv und spart monatlich $810 – eine Kostenreduzierung von 97%.

Dokumentenverarbeitungspipeline

Ein Legal-Tech-Startup verarbeitet monatlich 10.000 Verträge mit durchschnittlich 5.000 Token pro Vertrag. Extraktion und Analyse generieren 1.000 Output-Token pro Dokument.

Gesamtvolumen: 10.000 Dokumente × (5.000 Eingabe + 1.000 Ausgabe) = 60 Millionen Token (50 Millionen Eingabe, 10 Millionen Ausgabe).

Für die Stapelverarbeitung mit Gemini 3 Standard: 50M × $1.50/1M (Stapeleingang) + 10M × $7.50/1M (Stapelausgang) = $75 + $75 = $150 monatlich.

Echtzeitverarbeitung: 50M × $3/1M + 10M × $15/1M = $150 + $150 = $300 monatlich.

Durch die Stapelverarbeitung werden die Kosten halbiert, ohne dass die Qualität bei nächtlichen Verarbeitungsabläufen beeinträchtigt wird.

Wann man Google gegenüber Mitbewerbern wählen sollte

Die LLM-APIs von Google sind in bestimmten Szenarien hervorragend, aber nicht universell optimal.

Wählen Sie Google Vertex AI, wenn:

- Befindet sich bereits in der Google Cloud-Infrastruktur: Die Kosten für Datentransfer und -integration sinken deutlich.

- Erfordert multimodale Fähigkeiten: Gemini verarbeitet Text, Bilder, Audio und Video in einheitlichen Eingabeaufforderungen.

- Erstellung von RAG-Anwendungen: Die integrierten Vektorsuch- und Grounding-Tools von Vertex AI reduzieren die architektonische Komplexität

- extrem lange Kontextfenster erforderlich: Gemini 1.5 Pro unterstützt bis zu 2 Millionen Token und übertrifft damit die meisten Konkurrenten deutlich.

- Priorisierung der Kosteneffizienz bei Aufgaben mittlerer Komplexität: Flash-Modelle bieten ein hohes Preis-Leistungs-Verhältnis

Suchen Sie woanders, wenn:

Maximale Denkfähigkeit ist wichtiger als die Kosten – GPT-5.2 Pro übertrifft Gemini bei komplexen logischen Aufgaben. Spezialisierte Bereiche wie höhere Mathematik oder Wettbewerbsprogrammierung – die Modelle von OpenAI führen derzeit diese Benchmarks an. Null-Toleranz-Konformitätsanforderungen – einige Branchen schreiben spezifische Zertifizierungen vor, die etablierte Anbieter bevorzugen.

Häufig gestellte Fragen

Wie viel kostet Googles günstigste LLM-API?

Gemini 3.1 Flash-Lite kostet ab März 2026 $0,25 pro Million Eingabe-Token (bei ≤200.000 Kontexten) und ist damit eine der kostengünstigsten Optionen von Google. Durch Stapelverarbeitung und Caching können die effektiven Kosten für Stapel-Cache-Treffer auf $0,15 pro Million Token sinken, wobei die ersten Stapel-Cache-Schreibvorgänge $1,875 pro Million kosten.

Worin besteht der Preisunterschied zwischen Gemini Pro und Flash?

Gemini 3.1 Pro kostet $2 pro Million Eingabe-Token, im Vergleich zu Flashs $0,50 – ein vierfacher Unterschied. Bei den Ausgabe-Token ist der Unterschied ähnlich: Pro berechnet $12 pro Million, während Flash deutlich niedrigere Standardtarife verwendet. Pro bietet überlegene Logik und differenzierte Analysen; Flash optimiert Geschwindigkeit und Kosten bei einfacheren Aufgaben.

Erhebt Google Gebühren für fehlgeschlagene API-Anfragen?

Google berechnet Gebühren für alle verarbeiteten Tokens bei erfolgreichen Anfragen (200 OK). Einige 4xx-Fehler (wie z. B. 429 Too Many Requests) sind jedoch kostenlos, während andere, die mit der Inhaltsfilterung während der Generierung zusammenhängen, weiterhin Gebühren für eingegebene Tokens verursachen können.

Wie senkt Kontext-Caching die Kosten von Google LLM?

Durch das Zwischenspeichern wiederholter Kontexte werden die Tokenkosten um etwa 90% reduziert. Bei Gemini 3.1 Pro kosten zwischengespeicherte Eingabetoken $0,20 pro Million, im Vergleich zu $2 für nicht zwischengespeicherte.

Welche Kosten entstehen für die Erdung von Gemini-Modellen?

Gemini 2.5 Pro beinhaltet 10.000 kostenlose Erdungsaufforderungen pro Tag. Darüber hinaus kostet die Standarderdung $35 pro 1.000 Erdungsaufforderungen. Die Enterprise-Weberdung kostet $45 pro 1.000 Erdungsaufforderungen. Diese Gebühren fallen zusätzlich zu den Standardkosten für Eingabe- und Ausgabetoken an.

Kann ich die Google LLM APIs kostenlos nutzen?

Google bietet im Gegensatz zu einigen Mitbewerbern kein dauerhaft kostenloses Kontingent für die Nutzung von Vertex AI LLM an. Neue Google Cloud-Konten erhalten jedoch Guthaben (in der Regel $300) für erste Tests. Die Abrechnung erfolgt nutzungsbasiert ohne Mindestnutzungsanforderungen, sodass auch Tests im kleinen Rahmen kostengünstig durchgeführt werden können.

Wie funktioniert die Preisgestaltung bei der Stapelverarbeitung?

Durch die Stapelverarbeitung werden die Tokenkosten bei Googles Gemini-Modellen um 50% gesenkt. Beispielsweise sinken die Kosten beim Gemini 3 Standard von $3 auf $1,50 pro Million Eingabe-Token und von $15 auf $7,50 pro Million Ausgabe-Token. Stapelanfragen werden asynchron verarbeitet, wobei die Bearbeitungszeiten je nach Länge der Warteschlange zwischen Minuten und Stunden variieren.

Die Kostenentscheidung treffen

Die Preisgestaltung der LLM-API von Google positioniert Vertex AI wettbewerbsfähig auf dem Markt im Jahr 2026, insbesondere für Anwendungen, die bereits innerhalb des Google Cloud-Ökosystems betrieben werden.

Die Kostenstruktur belohnt Optimierung. Entwickler, die Caching, Stapelverarbeitung und intelligentes Modellrouting implementieren, können effektive Kosten erzielen, die 70–801 TP3T unter den Listenpreisen liegen. Wer Modelle hingegen unreflektiert einsetzt, zahlt deutlich zu viel.

Tokenbasierte Preisgestaltung ist nach wie vor das dominierende Modell bei allen großen Anbietern, doch die effektiven Kosten pro KI-generierter Antwort variieren stark je nach Implementierungsentscheidungen. Eine gut konzipierte Bereitstellung auf Gemini Flash kann KI-Funktionen zu einem Zehntel der Kosten einer nicht optimierten GPT-5 Pro-Bereitstellung bereitstellen.

Die entscheidende Frage ist nicht, welcher Anbieter den niedrigsten Listenpreis hat, sondern welche Kombination aus Modellfunktionalität, Preisstruktur und Infrastrukturintegration den besten Wert für spezifische Workload-Charakteristika bietet.

Beginnen Sie mit aussagekräftigen Benchmarks. Testen Sie repräsentative Workloads mit Modellen von Google, OpenAI und Anthropic. Messen Sie dabei nicht nur die Qualität, sondern auch den tatsächlichen Tokenverbrauch, die Latenz und die Fehlerraten. Berechnen Sie die Gesamtbetriebskosten inklusive Infrastruktur, Datentransfer und Entwicklungsaufwand.

Optimieren Sie dann rigoros. Jede Reduzierung der durchschnittlichen Token pro Anfrage um 10%, jede Verbesserung der Cache-Trefferrate um einen Prozentpunkt, jede Migration von Arbeitslasten zur Stapelverarbeitung führt direkt zu Kosteneinsparungen.

Die Kostenlandschaft für LLM entwickelt sich weiterhin rasant. Preise, die heute wettbewerbsfähig sind, können innerhalb weniger Monate überholt sein, da die Anbieter um Marktanteile ringen. Budgetflexibilität und architektonische Anpassungsfähigkeit sind beim Aufbau langfristiger KI-Infrastrukturen ebenso wichtig wie die aktuellen Preise.