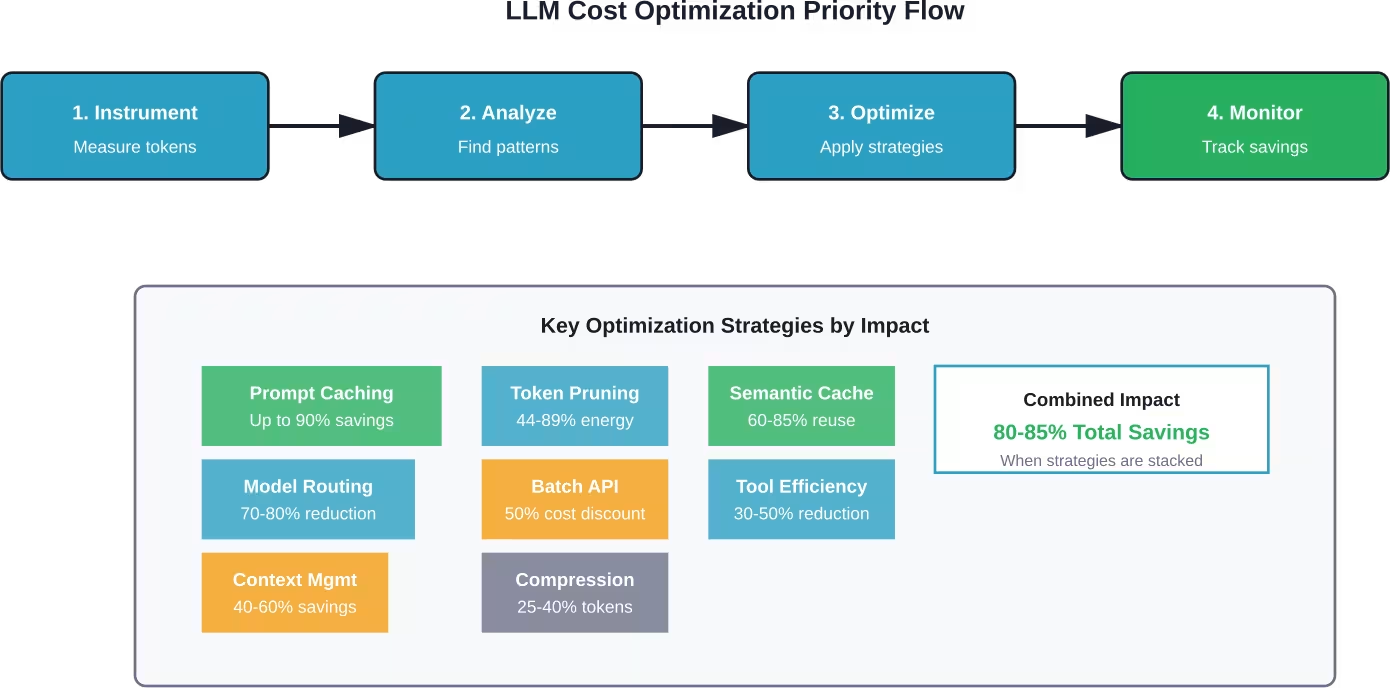

Kurzzusammenfassung: Die Kostenoptimierung von LLM im Jahr 2026 konzentriert sich auf intelligente Orchestrierungsstrategien: Prompt-Caching reduziert die Wiederholungskosten um bis zu 901 TP3T, hybrides SLM+LLM-Routing senkt die Kosten um 70–801 TP3T, und tokeneffiziente Techniken wie Kontextkomprimierung ermöglichen Einsparungen von 44–891 TP3T. Der Schlüssel liegt darin, zunächst die Nutzung zu messen und anschließend gezielte Optimierungen wie semantisches Caching, Batch-Verarbeitung und Modellauswahl basierend auf der Aufgabenkomplexität anzuwenden, anstatt standardmäßig auf teure Spitzenmodelle zurückzugreifen.

Produktive LLM-Implementierungen bergen ein unschönes Geheimnis: Viele Organisationen verbrauchen unnötigerweise erhebliche Mengen an Token. Die Ursache liegt nicht allein in der Modellauswahl, sondern im Fehlen einer systematischen Optimierung entlang der gesamten Inferenzpipeline.

Betrachten wir folgendes konkrete Szenario aus der Praxis: Ein Support-Chatbot, der monatlich 500.000 Anfragen mit je 1.500 Token bearbeitet, verbraucht monatlich etwa 18.000 Token. Das entspricht 216.000 Token jährlich für eine einzige Funktion. Doch jetzt wird es interessant: Dieselbe Arbeitslast, optimiert durch Caching, Routing und Kontextmanagement, reduziert den Verbrauch auf 27.000 bis 50.000 Token pro Jahr.

Der Unterschied? Ein strategisches Kostenmanagement, das den Tokenverbrauch als vorrangiges technisches Anliegen behandelt und nicht als Nebensache.

Die Kostenrealität des LLM-Studiums im Jahr 2026

Die Kosten für LLM-Inferenz skalieren nicht wie herkömmliche Rechenprozesse. Ein einzelner Modellaufruf mag zwar Bruchteile eines Cents kosten, aber multipliziert man dies mit Millionen von Anfragen, verändern sich die Kosten dramatisch.

Bei tokenbasierter Preisgestaltung zählt jedes Wort. Eingabe-Token (Ihre Eingabeaufforderungen) und Ausgabe-Token (Modellantworten) haben jeweils unterschiedliche Kosten. Auf Amazon Nova Micro kosten Eingabe-Token $0,000035 pro Tausend, während Ausgabe-Token $0,00014 pro Tausend kosten – ein Unterschied von etwa dem Vierfachen. Bei größeren Modellen wie GPT-4 vergrößert sich diese Differenz noch weiter.

Mal ehrlich: Die meisten Kostenüberschreitungen entstehen, weil Teams ihre Systeme nicht richtig instrumentieren. Ohne Einblick in die Token-Verbrauchsmuster wird Optimierung zum Ratespiel. Untersuchungen zum Energieverbrauch bei LLM-Inferenz zeigen, dass die Dekodierung (Ausgabegenerierung) den größten Kostenfaktor darstellt. Durch die Unterdrückung von Babbling lassen sich Energieeinsparungen von 441 TP3T bis 891 TP3T erzielen, ohne die Generierungsgenauigkeit zu beeinträchtigen.

Wo sich die Kosten für den LLM verstecken

Die reine Zählung der Token offenbart nur einen Teil des Bildes. Versteckte Kosten summieren sich in verschiedenen Dimensionen:

- Redundante Verarbeitung: Identische oder ähnliche Anfragen werden ohne Zwischenspeicherung erneut verarbeitet.

- Übergroße Kontexte: Senden vollständiger Konversationsverläufe, wenn Zusammenfassungen ausreichen

- Falsche Modellauswahl: Frontier-Modelle für Aufgaben verwenden, die kleinere Modelle gut bewältigen

- Ineffiziente Werkzeugnutzung: Ausführliche Funktionsschemata und redundante Tool-Aufrufe

- Schlechte Chargenbildung: Anfragen einzeln statt gebündelt verarbeiten, wenn die Latenz dies zulässt

Jede Ineffizienz verstärkt sich. Ein System, das das falsche Modell wählt, keine Zwischenspeicherung durchführt UND aufgeblähte Kontexte sendet, kann leicht 5- bis 10-mal mehr Token verbrauchen als optimierte Alternativen.

Messen vor Managen: Instrumentierung zuerst

Die effektivste Kostenoptimierungsstrategie beginnt mit der Messung. Teams, die ihre LLM-Prozesse vor der Optimierung instrumentieren, erzielen durchweg bessere Ergebnisse als jene, die Optimierungen blindlings anwenden.

Eine geeignete Instrumentierung erfasst mehrere Dimensionen pro Anfrage:

| Metrisch | Warum es wichtig ist | Optimierungssignal |

|---|---|---|

| Anzahl der Eingabetoken | Direkter Kostentreiber | Kontextüberfrachtung, ineffiziente Eingabeaufforderungen |

| Anzahl der Ausgabetoken | Typischerweise 2-4 Mal teurer | wortreiche Antworten, Gebrabbel |

| Verwendetes Modell | Unterschiedliche Preisstufen | Möglichkeiten zur Überversorgung |

| Latenz | Auswirkungen auf die Nutzererfahrung | Caching-Kandidaten |

| Cache-Trefferrate | Tatsächliche Kosten vermieden | Caching-Effektivität |

| Metadaten zur Quellenangabe | Kostenverteilung | Nutzer/Funktionen mit hohen Kosten |

Die Zuordnung von Kosten ist wichtiger, als den meisten Teams bewusst ist. Durch die Kennzeichnung von Anfragen mit Projekt-ID, Team-ID, Umgebung und Feature-Flags lässt sich eine detaillierte Kostenanalyse durchführen. Nehmen wir zum Beispiel den Chatbot mit 18.000 monatlichen Nutzern: Mithilfe von Instrumentierungsmaßnahmen könnte sich herausstellen, dass 701,3 Billionen Kosten auf 151,3 Billionen Nutzer zurückzuführen sind – und damit gezielte Optimierungsmöglichkeiten eröffnen.

Aufbau eines Kostenverfolgungssystems

Die Infrastruktur für das Kostenmanagement muss nicht komplex sein. Ein minimales, funktionsfähiges System erfasst Folgendes:

- Zeitstempel und Anforderungs-ID zur Korrelation

- Modellkennung und Anbieter

- Tokenanzahl (Eingabe, Ausgabe, zwischengespeichert)

- Berechnete Kosten in einheitlicher Währung

- Attributions-Tags (Benutzer, Funktion, Umgebung)

- Kennzahlen zur Antwortqualität, sofern verfügbar

Speichern Sie diese Daten in einer Zeitreihendatenbank oder einem Data Warehouse, das Aggregationsabfragen unterstützt. Tägliche Kostenübersichten sollten Trends nach Modell, Funktion und Nutzersegment aufzeigen. Wöchentliche Überprüfungen decken Optimierungspotenziale auf, bevor diese zu Budgetengpässen führen.

Schnelles Caching: Der wirkungsvollste Schnellgewinn

Prompt-Caching bietet die größte Kostenreduzierung für die meisten Produktions-Workloads. Der Mechanismus ist einfach: Anbieter wie Anthropic und OpenAI speichern die Schlüssel-Wert-Matrizen aus den Aufmerksamkeitsberechnungen für Prompt-Präfixe im Cache. Wenn nachfolgende Anfragen dasselbe Präfix verwenden, sind die Kosten für die zwischengespeicherten Teile um 90% geringer.

Auf Amazon Bedrock reduziert das Prompt-Caching die Latenz der Inferenzantwort um bis zu 85% und die Kosten für Eingabetoken um bis zu 90%. Die Rechnung ist überzeugend: Eine Prompt-Anfrage mit 10.000 Token, die $0,30 kostet, reduziert sich durch das Caching auf $0,03 – eine Einsparung von $0,27 pro Zugriff.

Die Effektivität des Caching hängt jedoch vollständig von den Anfragemustern ab. Hohe Cache-Trefferraten erfordern stabile Prompt-Strukturen, in denen variable Inhalte an vorhersehbaren Positionen eingefügt werden.

Gestaltung cachefreundlicher Eingabeaufforderungen

Die Cache-Optimierung beginnt mit einer Prompt-Architektur. Statische Inhalte – Systemanweisungen, kurze Beispiele, Dokumentationsverweise – gehören an den Anfang. Variable Inhalte wie Benutzerabfragen und sitzungsspezifische Daten folgen am Ende.

Mangelhafte Struktur:

Benutzerabfrage: [VARIABLE]

Systemanweisungen: [STATIC 5000 Tokens]

Beispiele: [STATIC 3000 tokens]

Optimierte Struktur:

Systemanweisungen: [STATIC 5000 Tokens]

Beispiele: [STATIC 3000 tokens]

Benutzerabfrage: [VARIABLE]

Der zweite Ansatz speichert 8.000 Token pro Anfrage im Cache. Bei üblichen Preisen reduziert eine Arbeitslast mit einer Cache-Trefferrate von 80% die Kosten um 72% im Vergleich zu keiner Zwischenspeicherung.

Die Richtlinien zur Cache-Löschung variieren je nach Anbieter. Der Cache von Anthropic läuft nach 5 Minuten Inaktivität ab. Bei anhaltender Arbeitslast kann es sich lohnen, “warme” Caches mit regelmäßigen Anfragen zu betreiben, sofern das Anfragevolumen dies rechtfertigt.

Wann sich Caching auszahlt

Nicht jede Arbeitslast profitiert gleichermaßen von Caching. Berechnen Sie die zu erwartenden Einsparungen:

Break-Even-Cache-Trefferrate = Cache-Schreibkosten / (Kosten für nicht zwischengespeicherte Daten – Kosten für zwischengespeicherte Daten)

Bei Eingabeaufforderungen unter 1.000 Tokens übersteigt der Cache-Overhead oft die Einsparungen, es sei denn, die Trefferrate liegt über 85–90%. Optimale Werte ergeben sich bei:

- Große statische Kontexte (Dokumentation, Wissensdatenbanken)

- Wiederholte Systemanweisungen über Anfragen hinweg

- Wenige Beispiele in jeder Aufgabenstellung

- Konversationsverläufe mit angehängten neuen Nachrichten

Ein Dokumentations-Chatbot mit 15.000 Token Kontext und 500-Wort-Abfragen profitiert enorm. Ein Assistent für kreatives Schreiben, der jedes Mal einzigartige Geschichten generiert? Wohl eher nicht.

Semantisches Caching: Mehr als nur exakte Übereinstimmungen

Herkömmliches Caching erfordert identische Eingaben. Semantisches Caching erkennt, dass Fragen wie “Wie setze ich mein Passwort zurück?” und “Wie kann ich mein Passwort wiederherstellen?” dieselbe Antwort im Cache speichern sollten.

Die Implementierung verwendet Vektoreinbettungen, um die Ähnlichkeit von Anfragen zu messen. Jede Anfrage generiert eine Einbettung (typischerweise 100–300 Dimensionen), die mithilfe der Kosinusähnlichkeit oder anderer Distanzmetriken mit zwischengespeicherten Einbettungen verglichen wird. Überschreitet die Ähnlichkeit einen Schwellenwert (üblicherweise 0,85–0,95), wird die zwischengespeicherte Antwort zurückgegeben, anstatt das LLM aufzurufen.

Semantisches Caching arbeitet auf einer anderen Ebene als das Prompt-Caching des Anbieters. Prompt-Caching reduziert zwar die Kosten für Eingabetoken bei Cache-Treffern, ruft aber dennoch das Modell auf. Semantisches Caching vermeidet den Modellaufruf vollständig und eliminiert so sowohl Eingabe- als auch Ausgabekosten sowie Latenz.

Aufbau einer semantischen Cache-Schicht

Effektives semantisches Caching erfordert mehrere Komponenten:

- Einbettungsmodell: Leicht und schnell (Sentence-BERT, MiniLM)

- Vektordatenbank: Redis, Pinecone, Qdrant oder ähnliche Dienste für die Ähnlichkeitssuche

- Generierung von Cache-Schlüsseln: Kombination aus Einbettungsähnlichkeits- und Metadatenfiltern

- Anpassung des Ähnlichkeitsschwellenwerts: Ausgewogenheit zwischen Cache-Trefferrate und Antwortrelevanz

- TTL-Richtlinien: Ablaufdatum für zeitkritische Inhalte

Der Ähnlichkeitsschwellenwert ist von entscheidender Bedeutung. Ist er zu hoch (0,98+), sinkt die Trefferrate des Caches unnötig. Ist er zu niedrig (0,80-), verschlechtert sich die Qualität durch irrelevante Cache-Antworten. Beginnen Sie mit 0,90 und optimieren Sie den Wert anhand manueller Überprüfung von Grenzfällen.

Metadatenfilterung verhindert unzulässige Cache-Treffer. Eine Anfrage zu “Preisen von Produkt A” sollte keine zwischengespeicherten Antworten zu “Preisen von Produkt B” liefern, selbst bei hoher semantischer Ähnlichkeit. Zwischengespeicherte Einträge werden mit relevanten Attributen (Produkt, Nutzersegment, Datumsbereich) versehen und neben der semantischen Ähnlichkeit auch Metadatenübereinstimmungen gefordert.

Hybrides SLM + LLM-Routing: Modelle den Aufgaben zuordnen

Der Irrglaube, größere Modelle seien immer besser, geht fälschlicherweise davon aus, dass sie stets besser abschneiden. Die Realität ist jedoch differenzierter. Kleine Sprachmodelle (SLMs) mit 7–9 Milliarden Parametern bewältigen viele Produktionsaufgaben zu 10–50-mal geringeren Kosten als Alternativen mit über 70 Milliarden Parametern.

Untersuchungen zur Steuerung von LLMs zeigen, dass bereits Hinweise, die 10–30% der vollständigen LLM-Antwort umfassen, die Genauigkeit von SLMs signifikant verbessern, wobei der Nutzen ab 60% abnimmt. Dieser Ansatz kann in Hybridarchitekturen eingesetzt werden, in denen SLMs den Großteil der Arbeit übernehmen und LLMs bei Bedarf gezielte Unterstützung leisten.

Die hybride Orchestrierung ermöglicht das Routing von Anfragen basierend auf deren Komplexität. Einfache Aufgaben können an SLMs weitergeleitet werden, während komplexe Schlussfolgerungen an größere Modelle eskaliert werden.

Implementierung intelligenter Routen

Effektives Routing erfordert eine Klassifizierungsschicht, die die Aufgabenkomplexität vorhersagt, bevor Modelle aufgerufen werden. Mehrere Ansätze sind geeignet:

| Routing-Strategie | Komplexität | Genauigkeit | Kostenauswirkungen |

|---|---|---|---|

| Regelbasiert | Niedrig | Mäßig | 60-70% Reduzierung |

| Übereinstimmung mit Schlüsselwörtern | Niedrig | Mäßig | 50-65% Reduzierung |

| Klassifikatormodell | Medium | Hoch | 70-80% Reduzierung |

| Konfidenzbewertung | Hoch | Sehr hoch | 75-85% Reduzierung |

| Kaskadierung mit Fallback | Medium | Sehr hoch | 65-80% Reduzierung |

Regelbasiertes Routing erweist sich als am einfachsten: “Fragen mit weniger als 20 Token gehen an SLM, solche mit mehr als 100 Token an LLM.” Dies funktioniert bei klaren Unterscheidungen, lässt aber Nuancen außer Acht.

Klassifikationsmodelle werden anhand historischer Daten trainiert, die mit der tatsächlichen Komplexität gekennzeichnet sind. Zu den Merkmalen gehören die Abfragelänge, die Vielfalt des Vokabulars, das Vorhandensein bestimmter Schlüsselwörter und die bisherige Leistung des Modells bei ähnlichen Abfragen. Ressourcenschonende Klassifikatoren (100–300 Millionen Parameter) verursachen nur minimale Latenz und verbessern gleichzeitig die Routing-Genauigkeit.

Die Konfidenzbewertung verfolgt einen anderen Ansatz: Zuerst wird immer der SLM (Single Link Manager) kontaktiert, die Konfidenzwerte in der Antwort werden geprüft und erst dann auf den LLM (Local Link Manager) umgeschaltet, wenn die Konfidenz unter einen bestimmten Schwellenwert fällt. Dieses “optimistische Routing” minimiert unnötige LLM-Aufrufe bei gleichbleibender Qualität.

Das Kaskadenmuster

Die Kaskadierung kombiniert Routing mit Validierung. Jede Anfrage beginnt beim kleinsten fähigen Modell. Erfüllt die Antwort dieses Modells die Qualitätskriterien, wird sie zurückgegeben. Andernfalls wird das nächstgrößere Modell aufgerufen.

Zu den Qualitätsstandards könnten gehören:

- Konfidenzwerte des Modells selbst

- Formatvalidierung (korrekt strukturiertes JSON, vollständige Sätze)

- Längenanforderungen (Mindestwortzahl)

- Semantische Kohärenzprüfungen

Untersuchungen zu Pyramid MoA-Frameworks zeigen, dass Kaskadensysteme die Oracle-Basisgenauigkeit von 68,11 TP3T erreichen und gleichzeitig bis zu 18,41 TP3T Rechenleistung einsparen. Der Router überträgt Zero-Shot-Daten auf unbekannte Benchmarks und gewährleistet so Robustheit über verschiedene Aufgabentypen hinweg.

Der Nachteil? Latenz. Kaskadierung erhöht den Zeitaufwand für fehlgeschlagene Versuche. Bei latenzempfindlichen Anwendungen ist vorgelagertes Routing mit einem Klassifizierungsmodell besser geeignet als Kaskadierung mit Validierung.

Kontextmanagement und Komprimierung

Kontextfenster werden immer größer – 128.000, 200.000, sogar 1 Million Token –, aber größer ist nicht immer besser. Jeder Token in Ihrem Kontext verursacht Inputkosten und beeinflusst die Outputkosten. Aufgeblähte Kontexte verbrauchen Budgets, ohne die Ergebnisse zu verbessern.

Effektives Kontextmanagement schafft ein Gleichgewicht zwischen Informationsvollständigkeit und Token-Ökonomie. Das Ziel: ausreichend Kontext für präzise Antworten bereitstellen und gleichzeitig redundante oder irrelevante Informationen ausschließen.

Kontextkomprimierungstechniken

Untersuchungen zur satzverankerten Gist-Komprimierung zeigen, dass vortrainierte LLMs feinabgestimmt werden können, um Kontexte um Faktoren von 2x bis 8x zu komprimieren, ohne dass es zu signifikanten Leistungseinbußen kommt.

Zu den praktischen Kompressionsstrategien gehören:

- Zusammenfassung: Lange Dokumente oder Gesprächsverläufe in Zusammenfassungen fassen

- Extraktion: Relevante Auszüge extrahieren, anstatt vollständige Dokumente einzufügen.

- Beschneidung: Redundante Informationen aus wiederholten Kontexten entfernen

- Hierarchischer Kontext: Wir stellen Ihnen gerne eine allgemeine Zusammenfassung zur Verfügung; detaillierte Informationen erhalten Sie auf Anfrage.

Der Gesprächsverlauf eignet sich gut zur Komprimierung. Anstatt 50 Nachrichtenpaare (insgesamt 100 Nachrichten) zu senden, werden ältere Konversationen zusammengefasst und nur die neuesten Nachrichten wortgetreu eingefügt. Dadurch wird der Kontext typischerweise um 60–801 TTP3T reduziert, bei minimalem Informationsverlust.

Dokumentenabruf-Workflows profitieren von der Extraktion gegenüber der Einbindung. Anstatt zehn vollständige Dokumentationsseiten (15.000 Tokens) in den Kontext einzufügen, werden relevante Abschnitte mit insgesamt 2.000–3.000 Tokens extrahiert. Architekturen mit erweitertem Abruf (RAG) eignen sich hierfür hervorragend, da sie Vektorähnlichkeit nutzen, um relevante Passagen zu identifizieren.

Kontexte für gleitende Fenster

Bei laufenden Gesprächen oder Überwachungsaufgaben behalten gleitende Fenster eine feste Größe des Kontextes bei, indem sie alte Informationen verwerfen, sobald neue eintreffen. Die Fenstergröße optimiert das Verhältnis zwischen Kontexterhalt und Kosten.

Die Implementierung verfolgt die Tokenanzahl über alle Kontextelemente hinweg:

- Systemanweisungen: Feste Zuteilung (z. B. 1.000 Token)

- Neueste Nachrichten: Variable Allokation (z. B. letzte 10 Transaktionen, ca. 3.000 Token)

- Zusammenfassung des älteren Kontextes: Feste Zuteilung (z. B. 500 Token)

- Aktuelle Anfrage: Variable (Benutzereingabe)

Wenn der Gesamtkontext die zulässigen Grenzwerte überschreitet, wird die Zusammenfassung neu generiert, um ältere, kürzlich veröffentlichte Nachrichten einzubeziehen. Anschließend werden diese Nachrichten verworfen. Dadurch wird die Kontextkontinuität gewahrt und gleichzeitig der Tokenverbrauch begrenzt.

Token-effiziente Werkzeugnutzung und Funktionsaufrufe

Der Funktionsaufruf von LLM ermöglicht strukturierte Interaktionen mit externen Systemen, jedoch benötigen Werkzeugdefinitionen erheblichen Kontext. Eine komplexe API mit 20 verfügbaren Funktionen kann allein für deren Beschreibung 5.000 bis 8.000 Tokens erfordern – noch bevor die eigentliche Arbeit beginnt.

Die tokeneffiziente Werkzeugnutzung optimiert sowohl Werkzeugdefinitionen als auch Aufrufmuster, um den Aufwand zu minimieren und gleichzeitig die Funktionalität zu erhalten.

Optimierung von Werkzeugschemata

Funktionsdefinitionen folgen dem JSON-Schema-Format, das recht umfangreich sein kann. Betrachten Sie dieses aufgeblähte Beispiel:

{

“name”: “get_user_information”,

“Beschreibung”: “Diese Funktion ruft umfassende Benutzerinformationen aus der Datenbank ab, einschließlich persönlicher Daten, Kontostatus, Präferenzen und Verlauf.”,

“Parameter”: {

“type”: “object”,

“"Eigenschaften": {

“user_identifier”: {

“type”: “string”,

“Beschreibung”: “Die eindeutige Kennung des Benutzers, die entweder sein Benutzername oder seine E-Mail-Adresse sein kann.”

}

}

}

}

Komprimierte Version:

{

“name”: “get_user”,

“description”: “Benutzerdetails anhand des Benutzernamens oder der E-Mail-Adresse abrufen”,

“Parameter”: {

“type”: “object”,

“"Eigenschaften": {

“id”: {“type”: “string”, “description”: “Benutzername/E-Mail”}

}

}

}

Die komprimierte Version reduziert die Anzahl der Token um 60%, wobei die Funktionalität erhalten bleibt. Beachten Sie folgende Prinzipien:

- Kürzere Funktionsnamen, wenn eindeutig

- Kurze Beschreibungen (maximal 10-15 Wörter)

- Abgekürzte Parameternamen

- Minimale Parameterbeschreibungen

- Entfernen Sie selten verwendete optionale Parameter.

Dynamische Werkzeugbereitstellung

Anstatt bei jeder Anfrage alle verfügbaren Tools bereitzustellen, sollten die Tools basierend auf der Abfrageanalyse bereitgestellt werden. Eine Anfrage zu “Benutzerkonten” lädt beispielsweise Benutzerverwaltungstools; eine Anfrage zu “Produktbestand” lädt Bestandsverwaltungstools.

Dies erfordert eine Werkzeugauswahlebene vor dem eigentlichen LLM-Aufruf:

- Analysiere die Anfrage mit einem leichtgewichtigen Klassifikator.

- Ordnen Sie Abfragekategorien den entsprechenden Werkzeugsätzen zu.

- Beziehen Sie nur die jeweils anwendbaren Werkzeuge in den Kontext ein.

- Prozess mit Haupt-LLM

Bei Anwendungen mit mehr als 50 verfügbaren Tools reduziert die dynamische Bereitstellung den Aufwand für die Tool-Definition von 15.000 Token auf 2.000-4.000 Token – eine Reduzierung des toolbezogenen Kontextverbrauchs um 80%.

Stapelverarbeitung für nicht dringende Arbeitslasten

Die Batch-API von OpenAI und ähnliche Angebote anderer Anbieter ermöglichen Kostenersparnisse gemäß 50% für die asynchrone Verarbeitung. Der Nachteil ist die Latenz: Batch-Anfragen werden innerhalb von 24 Stunden statt Sekunden abgeschlossen.

Stapelverarbeitung ist sinnvoll für:

- Offline-Analyse und Berichterstattung

- Masseninhaltsgenerierung

- Datenkennzeichnung und -annotation

- Nächtliche Zusammenfassungsjobs

- Modellevaluierung und -prüfung

Es funktioniert nicht für:

- Benutzerorientierte Chat-Schnittstellen

- Echtzeit-Entscheidungssysteme

- Zeitkritische Benachrichtigungen

- Interaktive Anwendungen

Die Klassifizierung der Arbeitslast bestimmt die Eignung für Batch-Verarbeitung. Eine Content-Empfehlungs-Engine kann Empfehlungen über Nacht in Batches generieren und diese dann tagsüber aus dem Cache bereitstellen. Dieser hybride Ansatz nutzt Batch-Rabatte, ohne die Benutzerfreundlichkeit zu beeinträchtigen.

Implementierung von Batch-Workflows

Eine effektive Stapelverarbeitung erfordert Workflow-Orchestrierung:

- Sammelphase: Sammeln Sie Anfragen, deren Bearbeitung verzögert werden kann.

- Stapelverarbeitung: Paketanfragen und Übermittlung an die Batch-API

- Statusüberwachung: Verfolgen Sie den Fortschritt der Chargen und behandeln Sie Fehler

- Ergebnisverarbeitung: Abgeschlossene Ergebnisse abrufen und Systeme aktualisieren

- Cache-Bestand: Ergebnisse für schnellen Abruf speichern

Die Optimierung der Batchgröße ist entscheidend. Größere Batches amortisieren zwar den fixen Aufwand, erhöhen aber das Fehlerrisiko und die Kosten für Wiederholungsversuche. Kleinere Batches werden schneller verarbeitet, vervielfachen jedoch die API-Aufrufe. Optimale Werte liegen typischerweise zwischen 100 und 1.000 Anfragen pro Batch, abhängig von der Komplexität der einzelnen Anfragen.

Strategie zur Modellauswahl: Intelligenz zur richtigen Dimensionierung

Die Modellauswahl ist einer der wichtigsten Kostenfaktoren. Die Preise variieren je nach Modellkategorie erheblich, dennoch verwenden viele Anwendungen standardmäßig Premiummodelle für alle Aufgaben.

| Modellklasse | Parameter | Typische Kosten/1 Mio. Token | Am besten geeignet für |

|---|---|---|---|

| Mikromodelle | 1-3B | $50-100 | Klassifizierung, Extraktion, Weiterleitung |

| Kleine Modelle | 7-9B | $100-300 | Einfache Fragen und Antworten, Vorlagengenerierung |

| Mittlere Modelle | 30-40B | $500-1,000 | Komplexes Denken, technische Aufgaben |

| Große Modelle | 70 Milliarden+ | $2,000-5,000 | Fortgeschrittenes logisches Denken, kreatives Arbeiten |

| Frontier-Modelle | 400 Milliarden+ | $10,000-30,000 | Forschung, die schwierigsten Aufgaben |

Amazon Nova Micro veranschaulicht dieses Preisspektrum: $0,035 pro Million Input-Tokens, also etwa 100-mal günstiger als vergleichbare Alternativen. Für Aufgaben innerhalb seines Leistungsbereichs bietet Nova Micro enorme Kostenvorteile.

Die Strategie: Die Leistungsfähigkeit des Modells sollte der Aufgabenkomplexität angepasst werden. Klassifizierungsaufgaben benötigen keine hochleistungsfähigen Modelle. Einfache Frage-Antwort-Systeme mit strukturierten Daten funktionieren mit kleineren Modellen einwandfrei. Leistungsstarke Modelle sollten für wirklich schwierige Probleme reserviert werden.

Progressive Modellprüfung

Bei der Implementierung neuer Funktionen sollten Sie schrittweise von den kleinsten zu den größten Modellen testen:

- Beginnen Sie mit dem kleinsten Modell, das funktionieren könnte.

- Qualitätskennzahlen anhand der Anforderungen messen

- Bei unzureichender Qualität eine Stufe höher wechseln.

- Wiederholen Sie den Vorgang, bis die Qualitätsanforderungen erfüllt sind.

- Verwenden Sie diese Modellstufe in der Produktion

Dies verhindert eine Überdimensionierung. Teams gehen oft davon aus, dass komplexe Aufgaben Spitzenmodelle erfordern, und stellen dann fest, dass Modelle mit 30 Milliarden Parametern ausreichend sind. Diese Annahme ist 10- bis 20-mal teurer, als Tests aufzeigen würden.

Überwachung, Warnmeldungen und Kostensteuerung

Kostenoptimierung ist kein einmaliges Projekt – sie erfordert kontinuierliche Überwachung und Steuerung. Produktionssysteme verändern sich im Laufe der Zeit, da sich Nutzungsmuster weiterentwickeln und neue Funktionen eingeführt werden.

Wesentliche Kostenkennzahlen

Verfolgen Sie diese Kennzahlen täglich oder wöchentlich:

- Gesamtkosten: Gesamtausgaben aller LLM-Operationen

- Kosten pro Anfrage: Durchschnittliche Kosten für einzelne Operationen

- Kosten je nach Modell: Ausgabenaufschlüsselung nach Modellstufen

- Kosten pro Funktion: Zuordnung zu Produktfähigkeiten

- Token-Effizienzverhältnis: Ausgabetoken / Eingabetoken

- Cache-Trefferrate: Prozentsatz der aus dem Cache bedienten Anfragen

- Modell-Routing-Verteilung: Prozentsatz der Anfragen nach Modellebene

Alarme für Anomalien einrichten:

- Die täglichen Ausgaben übersteigen den gleitenden 7-Tage-Durchschnitt von 1501 TP3T.

- Die Kosten pro Anfrage steigen von Woche zu Woche um mehr als 50%.

- Die Cache-Trefferrate sinkt unter den historischen Basiswert

- Ein einzelner Benutzer/eine einzelne Funktion verbraucht über 20% des täglichen Budgets

Warnmeldungen ermöglichen eine schnelle Reaktion auf Kostenspitzen, bevor diese sich zu Budgetkrisen ausweiten.

Kostenverteilung und Rückbelastungen

Für Organisationen, in denen mehrere Teams oder Produkte die LLM-Infrastruktur gemeinsam nutzen, schafft die Kostenverteilung Verantwortlichkeit. Jede Anfrage sollte mit Metadaten zur Zuordnung versehen werden:

- Team oder Geschäftseinheit

- Produkt oder Funktion

- Umgebung (Produktion, Inszenierung, Entwicklung)

- Nutzersegment (kostenlos, Premium, Unternehmen)

Erstellen Sie wöchentliche Kostenberichte, die die Ausgaben nach Dimensionen aufschlüsseln. Teams, die ihre Verbrauchsmuster kennen, treffen fundiertere Optimierungsentscheidungen als solche, denen diese Transparenz fehlt.

Die Kostenverrechnung – also die direkte Abrechnung der LLM-Nutzung mit internen Teams – schafft stärkere Anreize für Effizienz. Wenn die Kosten als Einzelposten im Teambudget und nicht als geteilter Gemeinkostenbeitrag erscheinen, wird die Optimierung zur Priorität.

Erweiterte Optimierung: Quantisierung und Feinabstimmung

Neben der Optimierung des Betriebs bieten Techniken auf Modellebene eine zusätzliche Kostenreduzierung für selbstgehostete Bereitstellungen.

Quantisierung

Die Quantisierung reduziert die Modellgenauigkeit von 16-Bit- oder 32-Bit-Gleitkommazahlen auf 8-Bit- oder 4-Bit-Ganzzahlen. Dadurch werden der Speicherbedarf gesenkt und die Inferenz beschleunigt, während bei sorgfältiger Durchführung nur minimale Qualitätseinbußen entstehen.

Laut Hugging Face kann das Pruning die Modellgröße bei sorgfältiger Durchführung deutlich reduzieren (oft auf 80–90%) und dabei die Leistung nur minimal beeinträchtigen. Bei einer Sparsity von 50% erhält WiSparse 97% der Leistung des dichten Modells von Llama3.1.

Bei selbstgehosteten Installationen kann die Quantisierung den Speicherbedarf deutlich reduzieren. Der modellspezifische Speicherbedarf hängt von der Parameteranzahl und dem Genauigkeitsgrad ab – dies ermöglicht den Einsatz auf kostengünstigerer Hardware oder die Bearbeitung von mehr Anfragen pro GPU.

Kompromisse sind wichtig. Aggressive Quantisierung (2 Bit, 1 Bit) verschlechtert die Qualität merklich. Konservative Quantisierung (8 Bit) erhält die Qualität, reduziert aber die Einsparungen. Die meisten Produktionsumgebungen streben 4 Bit als optimalen Kompromiss an.

Feinabstimmung für maximale Effizienz

Feinabgestimmte Modelle können kleiner und kostengünstiger sein und gleichzeitig die Leistungsfähigkeit für spezifische Anwendungsbereiche beibehalten. Ein universelles 70B-Parameter-Modell könnte für spezielle Anwendungen durch ein feinabgestimmtes 7B-Modell ersetzt werden.

Für die Feinabstimmung ist Folgendes erforderlich:

- Hochwertige Trainingsdaten (Hunderte bis Tausende von Beispielen)

- Rechenressourcen für das Training (GPUs, Stunden bis Tage)

- Evaluierungsinfrastruktur zur Validierung der Qualität

- Kontinuierliche Wartung im Zuge der sich ändernden Anforderungen

Ökonomische Gründe sprechen für eine Feinabstimmung, wenn:

- Das Anfragevolumen ist sehr hoch (Millionen pro Monat).

- Die Aufgabenanforderungen sind stabil

- Die Leistungsqualität kann streng gemessen werden

- Die Infrastruktur für das Hosting von Modellen ist vorhanden.

Bei API-basierten Workflows übersteigen die Kosten für die Feinabstimmung die Einsparungen erst dann, wenn das monatliche Anfragevolumen Hunderttausende oder Millionen von Aufrufen erreicht.

Der Kostenoptimierungs-Stack 2026

Effektives LLM-Kostenmanagement im Jahr 2026 kombiniert verschiedene Strategien zu einer kohärenten Architektur. Keine einzelne Technik löst alle Probleme – die besten Ergebnisse erzielt man durch die Kombination komplementärer Ansätze.

Ein produktionsreifer Optimierungsstack umfasst:

- Fundamentschicht: Die Strategie zur Modellauswahl stellt sicher, dass für die Aufgaben standardmäßig Modelle in der passenden Größe verwendet werden.

- Caching-Schicht: Sowohl Prompt-Caching als auch semantisches Caching verhindern redundante Arbeitsschritte, bevor diese die Modelle erreichen.

- Routing-Schicht: Intelligente Orchestrierung leitet Anfragen an das kosteneffektivste Modell weiter, das in der Lage ist, diese zu bearbeiten.

- Optimierungsschicht: Kontextkomprimierung, Token-Effizienz und Ausgabemanagement minimieren den Aufwand bei Anfragen an die Modelle.

- Arbeitslastschicht: Stapelverarbeitung und asynchrone Muster ermöglichen Rabatte für nicht dringende Arbeiten.

- Governance-Ebene: Überwachung, Zuordnung und Warnmeldungen erhalten die Optimierungen im Laufe der Zeit aufrecht und verhindern Kostenabweichungen.

Jede Schicht trägt unabhängig bei, doch die kombinierte Wirkung verstärkt sich. Ein System, das alle sechs Schichten nutzt, erzielt eine Kostenreduktion von 80–851 TP3T im Vergleich zu einfachen Implementierungen – die jährlichen Ausgaben sinken von 1 TP4T216.000 auf 1 TP4T30.000–1 TP4T40.000, während die Qualität erhalten oder sogar verbessert wird.

LLM-Kosten frühzeitig reduzieren – Setup vor der Skalierung optimieren

Die meisten Kostenprobleme in LLM-Projekten entstehen durch die Systemkonfiguration, nicht nur durch die Systemnutzung. Ineffiziente Datenpipelines, überdimensionierte Modelle und unoptimierte Abfragen können die Kosten lange vor der eigentlichen Skalierung unbemerkt in die Höhe treiben. AI Superior Wirkt über den gesamten Lebenszyklus hinweg – von der Datenaufbereitung und dem Modelldesign bis hin zum Training, der Feinabstimmung und der Bereitstellung – und hilft Teams dabei, diese Ineffizienzen frühzeitig zu beseitigen, anstatt später reagieren zu müssen.

Der Fokus liegt darauf, Modelle ohne unnötigen Aufwand produktionstauglich zu machen. Dies kann die Anpassung der Modellgröße, die Optimierung von Arbeitsabläufen oder die Überprüfung der Nutzung externer APIs im Vergleich zu individuellen Lösungen umfassen. Dies wird besonders wichtig, wenn die Nutzung zunimmt, da sich kleine Ineffizienzen schnell in erhebliche Kosten verwandeln. Wenn Sie die LLM-Kosten auf praktische Weise senken möchten, sollten Sie Ihre bestehende Konfiguration überprüfen, bevor Sie weiter skalieren. Kontaktieren Sie uns. AI Superior um herauszufinden, wo die Kosten tatsächlich gesenkt werden können.

Häufige Fallstricke, die es zu vermeiden gilt

Versuche zur Kostenoptimierung scheitern oft an vorhersehbaren Fehlern. Deren Vermeidung beschleunigt den Erfolg.

Optimieren ohne Messen

Der häufigste Fehler: Optimierungen werden implementiert, ohne deren Auswirkungen zu messen. Teams implementieren Caching, gehen davon aus, dass es funktioniert, und übersehen dabei, dass die Cache-Trefferraten eher bei 201 TP3T als bei den erwarteten 801 TP3T liegen.

Die Messung muss der Optimierung vorausgehen. Andernfalls konzentrieren sich die Bemühungen auf Bereiche mit minimalen Auswirkungen, während kostenintensive Faktoren unberücksichtigt bleiben.

Überoptimierung der Latenz

Latenz und Kosten stehen im Konflikt. Aggressives Caching senkt die Kosten, erhöht aber die Latenz beim Cache-Zugriff. Kaskadiertes Routing spart Geld, verlängert aber die Wartezeiten bei fehlgeschlagenen Zugriffen. Stapelverarbeitung ermöglicht massive Kosteneinsparungen, verhindert aber Echtzeit-Reaktionen.

Nicht jede Millisekunde ist gleich wichtig. Eine kundenorientierte Chat-Oberfläche benötigt Reaktionszeiten im Subsekundenbereich. Ein Berichtsgenerator, der über Nacht arbeitet, kann hingegen Minuten tolerieren. Optimieren Sie Ihre Strategien daher an den tatsächlichen Latenzanforderungen, anstatt alles auf Geschwindigkeit zu optimieren.

Vernachlässigung der Qualitätsüberwachung

Kostenoptimierung sollte die Ausgabequalität nicht beeinträchtigen, aggressive Verfahren tun dies jedoch mitunter. Zu aggressive Komprimierung führt zu Kontextverlust. Semantisches Caching mit zu niedrigen Ähnlichkeitsschwellenwerten kann Antworten liefern, die nicht genau der Abfrageabsicht entsprechen. Das Routing zu kleineren Modellen reduziert die Leistungsfähigkeit.

Die Qualitätsüberwachung muss parallel zur Kostenüberwachung erfolgen. Erfassen Sie Kennzahlen wie:

- Nutzerzufriedenheitswerte

- Aufgabenabschlussquoten

- Fehlerraten und Wiederholungsversuche

- Manuelle Überprüfung der Beispielausgaben

Wenn die Kostenoptimierung die Qualität beeinträchtigt, scheitert die Optimierung unabhängig von den erzielten Einsparungen.

Ignorieren versteckter Kosten

Die Tokenkosten stellen die offensichtlichen Ausgaben dar, aber es kommen noch versteckte Kosten hinzu:

- Zeitaufwand für den Aufbau und die Wartung der Optimierungsinfrastruktur.

- Infrastrukturkosten für Caching-Schichten und Überwachungssysteme

- Erhöhte Komplexität und schwierigere Fehlersuche

- Opportunitätskosten, wenn sich das Team auf die Kosten anstatt auf die Funktionen konzentriert.

Berechnen Sie den tatsächlichen ROI unter Berücksichtigung dieser Faktoren. Ein Caching-System, das monatlich 1.400.500 einspart, aber 1.400.300 an Infrastrukturkosten und 20 Ingenieurstunden für die Wartung benötigt, bietet einen fraglichen Nutzen.

Häufig gestellte Fragen

Welche einzelne LLM-Kostenoptimierungsmaßnahme hat den größten Einfluss auf die meisten Anwendungsfälle?

Prompt-Caching erzielt in der Regel die größten unmittelbaren Auswirkungen bei Anwendungen mit stabilen Prompt-Strukturen. Sofern anwendbar, kann Caching die Kosten für Eingabetoken um 90% und die Latenz um 85% reduzieren. Die Implementierung ist unkompliziert – die Prompts werden so umstrukturiert, dass statische Inhalte zuerst angezeigt werden – und erfordert keine komplexe Infrastruktur. Die meisten Produktionsanwendungen mit Dokumentation, Beispielen oder wiederholten Anweisungen in den Prompts profitieren deutlich davon.

Woran erkenne ich, ob meine Cache-Trefferrate gut genug ist?

Cache-Trefferraten über 60% ermöglichen durch Prompt-Caching signifikante Kosteneinsparungen. Semantisches Caching erfordert höhere Trefferraten – typischerweise 70–80% –, da die Implementierung aufwändiger ist. Die erwarteten Einsparungen berechnen sich wie folgt: (Trefferrate × Cache-Einsparungen) – Cache-Kosten. Übersteigt die Netto-Reduzierung 40–50%, lohnt sich Caching. Die Trefferraten sollten wöchentlich überwacht werden; Rückgänge deuten auf Änderungen in der Prompt-Struktur oder im Abfragemuster hin, die behoben werden müssen.

Sollte ich für Klassifizierungsaufgaben SLMs oder LLMs verwenden?

Klassifizierungsaufgaben profitieren fast immer von kleineren Modellen. Studien zeigen, dass Modelle mit 7–9 Milliarden Parametern bei der Klassifizierung eine Genauigkeit von 85–951 TP3T erreichen, die mit der großer Modelle vergleichbar ist, und dabei 10–50-mal weniger kosten. Testen Sie Ihre spezifische Klassifizierungsaufgabe: Sammeln Sie 100–200 annotierte Beispiele, evaluieren Sie sowohl kleine als auch große Modelle und vergleichen Sie deren Genauigkeit. Sofern der Genauigkeitsunterschied nicht mehr als 5–10 Prozentpunkte beträgt, wählen Sie das kleinere Modell.

Wann lohnt sich die Feinabstimmung von Modellen im Vergleich zur Verwendung größerer Modelle?

Die Feinabstimmung wird wirtschaftlich, wenn das monatliche Anfragevolumen mehrere hunderttausend Aufrufe übersteigt und die Aufgabenanforderungen stabil bleiben. Die Trainingskosten liegen je nach Modellgröße und Datenvolumen zwischen 1.400.500 und 5.000. Wenn ein feinabgestimmtes 7-B-Modell eine 70-B-API bei 30-fach geringeren Inferenzkosten ersetzt, amortisiert sich die Optimierung bei etwa 300.000 bis 500.000 Anfragen. Bei geringerem Volumen bieten Optimierungstechniken wie Caching und Routing einen besseren ROI.

Wie viel Kontextkomprimierung ist unbedenklich, ohne dass die Qualität leidet?

Sichere Komprimierungsraten hängen stark vom Inhaltstyp ab. Konversationsverläufe lassen sich mit Zusammenfassung auf 60–801 TP3T komprimieren, wobei der Dialog erhalten bleibt. Technische Dokumentationen werden typischerweise durch Extraktion ohne Informationsverlust auf 40–601 TP3T komprimiert. Kreative oder differenzierte Inhalte benötigen weniger Komprimierung – etwa 30–401 TP3T. Führen Sie stets A/B-Tests durch: Verarbeiten Sie identische Anfragen mit vollständigem und komprimiertem Kontext, vergleichen Sie die Ergebnisse und messen Sie die Qualitätsunterschiede, bevor Sie die Komprimierung implementieren.

Was ist die minimal erforderliche Instrumentierung zur Kostenverfolgung im LLM-Bereich?

Protokollieren Sie mindestens diese sechs Felder pro Anfrage: Zeitstempel, Modellname, Eingabe-Tokens, Ausgabe-Tokens, berechnete Kosten und ein Attributfeld (Benutzer-ID oder Feature-Name). Speichern Sie die Daten in einer Datenbank, die Aggregationsabfragen unterstützt – selbst eine einfache PostgreSQL-Tabelle genügt. Dies ermöglicht die tägliche Kostenüberwachung und die Identifizierung von Kostenschwerpunkten. Fügen Sie bei Bedarf weitere Felder hinzu (Latenz, Cache-Treffer, Qualitätsbewertung), beginnen Sie aber mit diesen Grundlagen.

Wie kann ich die Führungsebene davon überzeugen, in die Kostenoptimierung des LLM-Studiums zu investieren?

Stellen Sie Kostenprognosen mit und ohne Optimierung dar. Zeigen Sie die aktuellen monatlichen Ausgaben, multiplizieren Sie diese mit 12, um die jährlichen Kosten zu erhalten, und berechnen Sie anschließend die optimierten jährlichen Kosten anhand konservativer Einsparungsschätzungen (50–601 TP³T statt 801 TP³T). Die Differenz – oft über 1 TP´T100.000 für Produktionsanwendungen – rechtfertigt die Investition in die Entwicklung. Fügen Sie eine ROI-Berechnung hinzu: (Jährliche Einsparungen – Implementierungskosten) / Implementierungskosten. Ein ROI über 3001 TP³T ist ein überzeugendes Argument.

Fazit: Vom Kostenzentrum zum Wettbewerbsvorteil

Die Kosten für LLM müssen nicht außer Kontrolle geraten. Die hier beschriebenen Strategien – schnelles Caching, intelligentes Routing, Kontextoptimierung und systematische Instrumentierung – senken die Produktionskosten konstant um 70–851 TP3T und erhalten oder verbessern gleichzeitig die Qualität.

Doch es geht hier nicht nur um Kosteneinsparungen. Organisationen, die kosteneffiziente LLM-Prozesse beherrschen, erzielen strategische Vorteile. Geringere Stückkosten ermöglichen es, mehr Nutzer zu bedienen, mit neuen Funktionen zu experimentieren und KI-Funktionen bereitzustellen, die für Wettbewerber wirtschaftlich nicht rentabel sind.

Die wichtigste Erkenntnis: Behandeln Sie den Tokenverbrauch von Anfang an als zentrales technisches Problem. Implementieren Sie frühzeitig, optimieren Sie systematisch und überwachen Sie kontinuierlich. Die Techniken, die 2026 funktionieren – Caching, Routing, Komprimierung – werden sich weiterentwickeln, aber die Disziplin des kostenbewussten LLM-Engineerings bleibt unerlässlich.

Beginnen Sie mit der Messung. Wählen Sie eine stark frequentierte Funktion, erfassen Sie deren Token-Verbrauch und analysieren Sie die Muster. Diese Transparenz eröffnet Optimierungsmöglichkeiten, die das 10- bis 100-fache des Messaufwands wert sind. Wenden Sie anschließend gezielte Strategien dort an, wo die Daten den größten Nutzen versprechen.

Die Organisationen, die im Jahr 2026 mit der LLM-Technologie erfolgreich sein werden, sind nicht nur diejenigen mit den besten Modellen – es sind diejenigen, die die Wirtschaftlichkeit der effizienten Produktion von Modellen beherrschen.