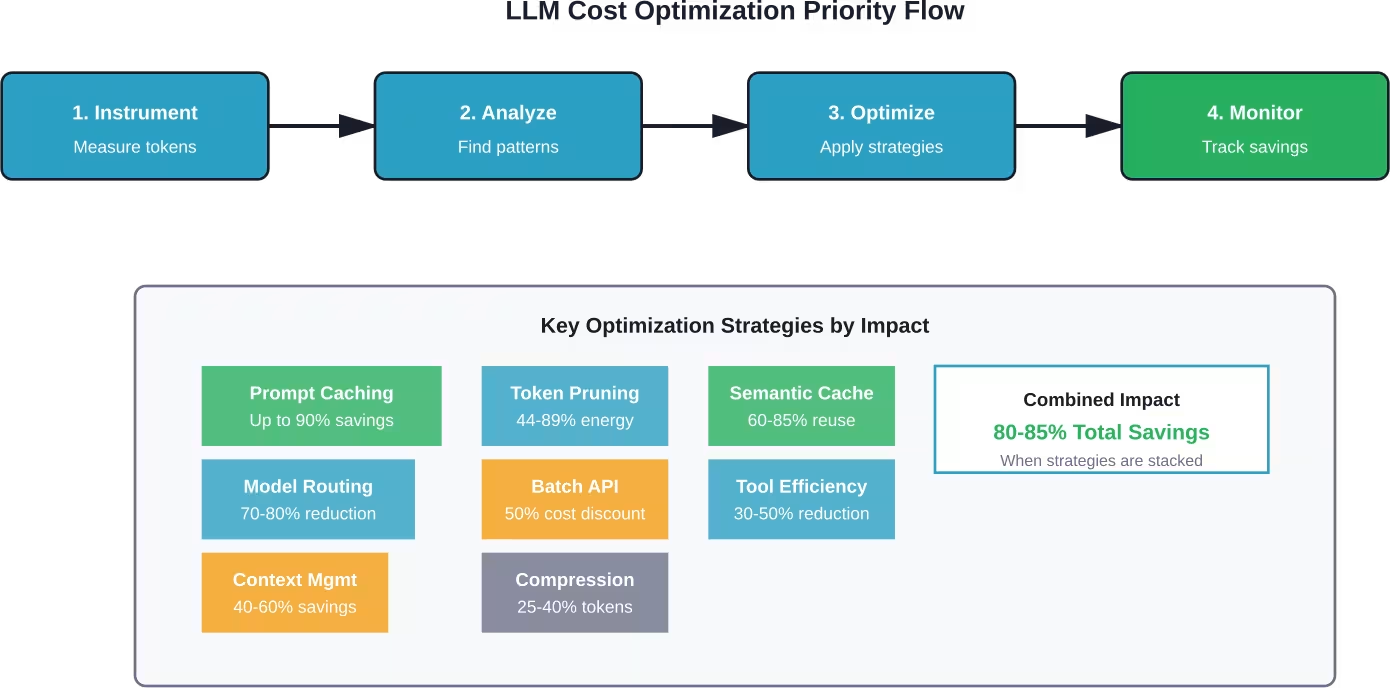

Résumé rapide : L'optimisation des coûts LLM en 2026 repose sur des stratégies d'orchestration intelligentes : la mise en cache rapide réduit les coûts récurrents jusqu'à 901 TP3T, le routage hybride SLM+LLM diminue les dépenses de 70 à 801 TP3T, et des techniques économes en jetons comme la compression de contexte permettent des économies de 44 à 891 TP3T. La clé réside dans la mesure de l'utilisation en premier lieu, puis dans l'application d'optimisations ciblées telles que la mise en cache sémantique, le traitement par lots et la sélection du modèle en fonction de la complexité de la tâche, plutôt que d'opter par défaut pour des modèles de pointe coûteux.

Les déploiements LLM en production cachent un secret bien gardé : de nombreuses organisations gaspillent inutilement d’importantes quantités de jetons. Le problème ne réside pas uniquement dans la sélection du modèle, mais aussi dans l’absence d’optimisation systématique tout au long du pipeline d’inférence.

Prenons un exemple concret tiré de données réelles : un chatbot d’assistance traitant 500 000 requêtes par mois à raison de 1 500 jetons par requête consomme environ $18 000 par mois. Cela représente $216 000 par an pour une seule fonctionnalité. Mais voici le plus intéressant : la même charge de travail, optimisée grâce à la mise en cache, au routage et à la gestion du contexte, voit sa consommation chuter à $27 000-$50 000 par an.

La différence ? Une gestion stratégique des coûts qui considère la consommation de jetons comme une préoccupation technique de premier plan, et non comme une simple réflexion après coup.

La réalité des coûts des opérations LLM en 2026

Les coûts d'inférence des modèles linéaires à longue portée (LLM) ne suivent pas la même progression que les calculs traditionnels. Un seul appel de modèle peut coûter quelques fractions de centime, mais multipliez ce coût par des millions de requêtes et le rapport coût-efficacité change radicalement.

La tarification par jetons signifie que chaque mot compte. Les jetons d'entrée (vos requêtes) et les jetons de sortie (les réponses du modèle) ont chacun un coût distinct. Sur Amazon Nova Micro, les jetons d'entrée coûtent $0,000035 par millier, tandis que les jetons de sortie coûtent $0,00014 par millier, soit une différence d'environ quatre fois. Pour les modèles plus complexes comme GPT-4, cet écart est encore plus important.

Soyons francs : la plupart des dépassements de coûts sont dus à une instrumentation insuffisante des systèmes. Sans visibilité sur les profils de consommation des jetons, l’optimisation relève de la conjecture. Les recherches sur la consommation énergétique dans l’inférence LLM montrent que le décodage (génération de la sortie) représente la part la plus importante des coûts, la suppression du bruit parasite permettant des économies d’énergie de 441 TP3T à 891 TP3T sans incidence sur la précision de la génération.

Où se cachent les coûts du LLM

Le comptage des jetons ne révèle qu'une partie du tableau. Des coûts cachés s'accumulent selon plusieurs dimensions :

- Traitement redondant : Les requêtes identiques ou similaires sont retraitées sans mise en cache.

- Contextes surdimensionnés : Envoyer l'historique complet des conversations alors que les résumés suffisent.

- Sélection de modèle incorrecte : L'utilisation de modèles de frontière pour des tâches que des modèles plus petits gèrent bien

- Utilisation inefficace des outils : Schémas de fonctions verbeux et appels d'outils redondants

- Mauvaise préparation des lots : Traiter les requêtes individuellement plutôt que par lots lorsque la latence le permet.

Chaque inefficacité s'accumule. Un système qui choisit un mauvais modèle, qui ne parvient pas à mettre en cache et qui envoie des contextes surchargés peut facilement consommer 5 à 10 fois plus de jetons que des alternatives optimisées.

Mesurer avant de gérer : l'instrumentation d'abord

La stratégie d'optimisation des coûts la plus efficace commence par la mesure. Les équipes qui instrumentent leurs opérations LLM avant de les optimiser obtiennent systématiquement de meilleurs résultats que celles qui appliquent les optimisations à l'aveugle.

Une instrumentation appropriée permet de capturer plusieurs dimensions par requête :

| Métrique | Pourquoi c'est important | Signal d'optimisation |

|---|---|---|

| Nombre de jetons d'entrée | facteur de coût direct | Surcharge du contexte, invites inefficaces |

| Nombre de jetons de sortie | Généralement 2 à 4 fois plus cher | Réponses verbeuses, bavardages |

| Modèle utilisé | Différents niveaux de prix | opportunités de surprovisionnement |

| Latence | Impact de l'expérience utilisateur | Candidats en cache |

| Taux de réussite du cache | Coût réel évité | Efficacité de la mise en cache |

| Métadonnées d'attribution | Répartition des coûts | Utilisateurs/fonctionnalités à coût élevé |

L'attribution est plus importante que la plupart des équipes ne le pensent. L'étiquetage des requêtes avec les identifiants de projet, d'équipe, d'environnement et de fonctionnalité permet une analyse fine des coûts. Ce chatbot à 18 000 THB par mois ? L'instrumentation pourrait révéler que 701 000 THB de coûts proviennent de 151 000 THB d'utilisateurs, ouvrant ainsi la voie à des optimisations ciblées.

Création d'un système de suivi des coûts

L'infrastructure de gestion des coûts n'a pas besoin d'être complexe. Un système minimal viable permet de prendre en compte :

- Horodatage et identifiant de requête pour la corrélation

- Identifiant et fournisseur du modèle

- Nombre de jetons (entrée, sortie, en cache)

- Coût calculé dans une devise cohérente

- Balises d'attribution (utilisateur, fonctionnalité, environnement)

- Indicateurs de qualité de réponse, lorsqu'ils sont disponibles

Stockez ces données dans une base de données de séries temporelles ou un entrepôt de données prenant en charge les requêtes d'agrégation. Les tableaux de bord de coûts quotidiens doivent afficher les tendances par modèle, fonctionnalité et segment d'utilisateurs. Des analyses hebdomadaires permettent d'identifier les opportunités d'optimisation avant qu'elles ne se transforment en crises budgétaires.

Mise en cache rapide : la solution à fort impact et à gain rapide

La mise en cache des requêtes immédiates permet de réaliser les économies les plus importantes pour la plupart des charges de travail en production. Le mécanisme est simple : des fournisseurs comme Anthropic et OpenAI mettent en cache les matrices clé-valeur issues des calculs d’attention pour les préfixes des requêtes immédiates. Lorsque les requêtes suivantes partagent ce préfixe, les portions mises en cache coûtent 901 TP3T de moins.

Sur Amazon Bedrock, la mise en cache des requêtes réduit la latence de réponse des inférences jusqu'à 851 TP3T et le coût des jetons d'entrée jusqu'à 901 TP3T. Le calcul est convaincant : une requête nécessitant 10 000 jetons, dont le coût est de 1 TP4T0,30 par requête, passe à 1 TP4T0,03 une fois mise en cache, soit une économie de 1 TP4T0,27 par requête.

Mais l'efficacité de la mise en cache dépend entièrement des modèles de requêtes. Des taux d'accès au cache élevés nécessitent des structures d'invite stables avec un contenu variable inséré à des positions prévisibles.

Concevoir des invites optimisées pour le cache

L'optimisation du cache commence par l'architecture des invites. Placez le contenu statique (instructions système, exemples succincts, références de documentation) au début. Le contenu variable, comme les requêtes utilisateur et les données spécifiques à la session, est placé à la fin.

Mauvaise structure :

Requête de l'utilisateur : [VARIABLE]

Instructions système : [STATIQUE 5000 jetons]

Exemples : [STATIC 3000 tokens]

Structure optimisée :

Instructions système : [STATIQUE 5000 jetons]

Exemples : [STATIC 3000 tokens]

Requête de l'utilisateur : [VARIABLE]

La seconde approche met en cache 8 000 jetons par requête. Avec une tarification standard, une charge de travail avec un taux d'accès au cache de 801 TP3T permet de réduire les coûts de 721 TP3T par rapport à une absence de mise en cache.

Les politiques d'éviction du cache varient selon les fournisseurs. Le cache d'Anthropic expire après 5 minutes d'inactivité. Pour les charges de travail soutenues, il peut être judicieux de maintenir un cache “ chaud ” avec des requêtes périodiques si le volume de requêtes le justifie.

Quand la mise en cache est rentable

Toutes les charges de travail ne bénéficient pas de la même manière de la mise en cache. Calculez les économies attendues :

Taux d'accès au cache à seuil de rentabilité = Coût d'écriture dans le cache / (Coût sans cache – Coût avec cache)

Pour les requêtes de moins de 1 000 jetons, la surcharge du cache dépasse souvent les économies réalisées, sauf si le taux d'accès dépasse 85 à 90 TP3T. Les valeurs optimales sont :

- Grands contextes statiques (documentation, bases de connaissances)

- Instructions système répétées dans les requêtes

- Des exemples concis dans chaque invite

- Historique des conversations avec ajout de nouveaux messages

Un chatbot de documentation doté d'un contexte de 15 000 jetons et de requêtes de 500 mots en tire un avantage considérable. Un assistant de rédaction créative générant des histoires uniques à chaque fois ? Probablement pas.

Mise en cache sémantique : au-delà des correspondances exactes

La mise en cache traditionnelle exige des entrées identiques. La mise en cache sémantique reconnaît que les questions “ Comment réinitialiser mon mot de passe ? ” et “ Quelle est la procédure de récupération de mot de passe ? ” méritent la même réponse mise en cache.

L'implémentation utilise des plongements vectoriels pour mesurer la similarité des requêtes. Chaque requête génère un plongement (généralement de 100 à 300 dimensions), qui est comparé aux plongements mis en cache à l'aide de la similarité cosinus ou d'autres métriques de distance. Lorsque la similarité dépasse un seuil (généralement entre 0,85 et 0,95), la réponse mise en cache est renvoyée au lieu d'appeler le LLM.

La mise en cache sémantique fonctionne à un niveau différent de la mise en cache des invites du fournisseur. La mise en cache des invites réduit le coût des jetons d'entrée pour les accès au cache, mais invoque tout de même le modèle. La mise en cache sémantique évite complètement l'appel au modèle, éliminant ainsi les coûts d'entrée et de sortie, ainsi que la latence.

Création d'une couche de cache sémantique

La mise en cache sémantique efficace nécessite plusieurs composantes :

- Modèle d'intégration : Léger et rapide (Sentence-BERT, MiniLM)

- Base de données vectorielles : Redis, Pinecone, Qdrant ou un outil similaire pour la recherche de similarités

- Génération de la clé de cache : Combinaison de filtres de similarité d'intégration et de métadonnées

- Réglage du seuil de similarité : Équilibre entre le taux d'accès au cache et la pertinence de la réponse

- Politiques TTL : Expiration pour le contenu sensible au temps

Le seuil de similarité est crucial. Un seuil trop élevé (0,98 et plus) entraîne une baisse inutile du taux d'accès au cache. Un seuil trop bas (0,80 et moins) dégrade la qualité des réponses mises en cache de manière non pertinente. Commencez à 0,90 et ajustez-le en fonction de l'examen manuel des cas limites.

Le filtrage des métadonnées empêche les accès inappropriés au cache. Une question sur le “ prix du produit A ” ne devrait pas renvoyer de réponses mises en cache concernant le “ prix du produit B ”, même en cas de forte similarité sémantique. Il est donc important d'associer aux entrées mises en cache des attributs pertinents (produit, segment d'utilisateurs, période) et d'exiger une correspondance des métadonnées en plus de la similarité sémantique.

Routage hybride SLM + LLM : faire correspondre les modèles aux tâches

L'illusion du modèle de frontière suppose que les modèles plus grands sont toujours plus performants. La réalité est plus nuancée. Les petits modèles de langage (SLM) avec 7 à 9 milliards de paramètres gèrent de nombreuses tâches de production à un coût 10 à 50 fois inférieur à celui des alternatives comportant plus de 70 milliards de paramètres.

Les recherches sur l'accompagnement des LLM montrent que même des indications représentant 10 à 30% de la réponse complète du LLM améliorent significativement la précision du SLM, avec des gains décroissants au-delà de 60%. Cette approche peut être utilisée dans des architectures hybrides où les SLM prennent en charge la majeure partie du travail et les LLM fournissent une assistance ciblée en cas de besoin.

L'orchestration hybride peut acheminer les requêtes en fonction de leur complexité, les tâches simples étant potentiellement dirigées vers les SLM et les raisonnements complexes vers des modèles plus importants.

Mise en œuvre du routage intelligent

Un routage efficace nécessite une couche de classification qui prédit la complexité des tâches avant d'appeler les modèles. Plusieurs approches fonctionnent :

| Stratégie de routage | Complexité | Précision | Impact sur les coûts |

|---|---|---|---|

| Basé sur des règles | Faible | Modéré | Réduction 60-70% |

| Correspondance des mots clés | Faible | Modéré | Réduction de 50 à 65% |

| Modèle de classification | Moyen | Haut | Réduction 70-80% |

| Score de confiance | Haut | Très haut | Réduction 75-85% |

| Cascade avec repli | Moyen | Très haut | Réduction 65-80% |

Le routage basé sur des règles s'avère le plus simple : “ Les questions de moins de 20 jetons sont envoyées au SLM, celles de plus de 100 jetons au LLM. ” Cela fonctionne pour des distinctions nettes, mais manque de nuances.

Les modèles de classification sont entraînés sur des données historiques annotées avec la complexité réelle. Les caractéristiques comprennent la longueur de la requête, la diversité du vocabulaire, la présence de mots-clés spécifiques et les performances passées du modèle sur des requêtes similaires. Les classificateurs légers (100 à 300 millions de paramètres) induisent une latence minimale tout en améliorant la précision du routage.

L'évaluation de la confiance adopte une approche différente : privilégier systématiquement le SLM, vérifier les scores de confiance de la réponse et ne recourir au LLM que lorsque la confiance descend en dessous du seuil requis. Ce “ routage optimiste ” minimise les appels inutiles au LLM tout en préservant la qualité.

Le modèle en cascade

Le routage en cascade combine le routage et la validation. Chaque requête commence par le modèle le plus simple capable de fournir des informations. Si la réponse de ce modèle satisfait aux critères de qualité, elle est renvoyée. Sinon, la requête est transmise au modèle supérieur.

Les seuils de qualité peuvent inclure :

- Scores de confiance du modèle lui-même

- Validation du format (JSON correctement structuré, phrases complètes)

- Exigences de longueur (nombre minimum de mots)

- Contrôles de cohérence sémantique

Les recherches sur les frameworks Pyramid MoA démontrent que les systèmes en cascade atteignent la précision de référence d'Oracle (68,11 TP3T) tout en permettant des économies de calcul allant jusqu'à 18,41 TP3T. Le routeur transfère les données d'entraînement initiales vers des benchmarks inédits, garantissant ainsi la robustesse pour différents types de tâches.

Le compromis ? La latence. La mise en cascade engendre un coût temporel supplémentaire lié aux tentatives infructueuses. Pour les applications sensibles à la latence, un routage initial avec un modèle de classification est plus performant qu'une mise en cascade avec validation.

Gestion et compression du contexte

Les fenêtres de contexte ne cessent de s'étendre (128 000, 200 000, voire 1 million de jetons), mais plus grand n'est pas toujours synonyme de meilleur. Chaque jeton dans votre contexte engendre des coûts d'entrée et influe sur les coûts de génération des sorties. Des contextes trop volumineux gaspillent des ressources sans améliorer les résultats.

Une gestion efficace du contexte permet de trouver un équilibre entre l'exhaustivité de l'information et la concision. L'objectif : fournir un contexte suffisant pour des réponses précises tout en excluant les informations redondantes ou non pertinentes.

Techniques de compression du contexte

Les recherches sur la compression de l'essence ancrée dans la phrase montrent que les LLM pré-entraînés peuvent être affinés pour compresser les contextes par des facteurs de 2x à 8x sans dégradation significative des performances.

Les stratégies de compression pratiques comprennent :

- Récapitulation: Condenser de longs documents ou des historiques de conversations en résumés

- Extraction: Extrayez les passages pertinents plutôt que d'inclure des documents complets.

- Taille: Supprimer les informations redondantes des contextes répétés

- Contexte hiérarchique : Fournir des résumés généraux, les détails étant disponibles sur demande.

L'historique des conversations constitue une cible de compression courante. Au lieu d'envoyer 50 paires de messages (100 messages au total), résumez les échanges les plus anciens et ne conservez que les messages récents tels quels. Cela permet généralement de réduire le contexte de 60 à 801 octets avec une perte d'information minimale.

Les flux de travail de recherche documentaire tirent profit de l'extraction par rapport à l'inclusion. Plutôt que d'intégrer dix pages de documentation complètes (15 000 éléments), il est préférable d'extraire les sections pertinentes, soit 2 000 à 3 000 éléments. Les architectures de génération augmentée pour la recherche (RAG) excellent dans ce domaine, en utilisant la similarité vectorielle pour identifier les passages pertinents.

Contextes de fenêtre coulissante

Pour les conversations en cours ou les tâches de surveillance, les fenêtres glissantes maintiennent des contextes de taille fixe en supprimant les informations obsolètes au fur et à mesure que de nouvelles informations arrivent. La taille de la fenêtre permet d'optimiser le compromis entre la préservation du contexte et le coût.

L'implémentation permet de suivre le nombre de jetons dans les éléments de contexte :

- Instructions système : Allocation fixe (par exemple, 1 000 jetons)

- Messages récents : Allocation variable (par exemple, les 10 derniers échanges, environ 3 000 jetons)

- Résumé du contexte antérieur : Allocation fixe (ex. : 500 jetons)

- Requête actuelle : Variable (saisie utilisateur)

Lorsque le contexte total dépasse les limites, le résumé est régénéré pour intégrer les messages récents les plus anciens, puis ces derniers sont supprimés. Cela assure la continuité du contexte tout en limitant la consommation de jetons.

Utilisation efficace des outils et appels de fonctions

L'appel de fonctions LLM permet des interactions structurées avec des systèmes externes, mais la définition des outils consomme une quantité importante de données contextuelles. Une API complexe comportant 20 fonctions disponibles peut nécessiter entre 5 000 et 8 000 jetons rien que pour décrire ces fonctions, avant même que le moindre traitement ne soit effectué.

L'utilisation efficace des outils à faible coût optimise à la fois les définitions des outils et les modèles d'appel afin de minimiser la surcharge tout en maintenant les fonctionnalités.

Schémas d'outils d'optimisation

Les définitions de fonctions suivent le format JSON Schema, qui peut être verbeux. Prenons cet exemple complexe :

{

“ nom ” : “ obtenir_informations_utilisateur ”,

“ description ” : “ Cette fonction récupère des informations complètes sur l'utilisateur à partir de la base de données, notamment ses données personnelles, l'état de son compte, ses préférences et son historique. ”,

“ paramètres ” : {

“ type ” : “ objet ”,

“"propriétés": {

“ identifiant_utilisateur ” : {

“ type ” : “ chaîne de caractères ”,

“ description ” : “ L’identifiant unique de l’utilisateur, qui peut être soit son nom d’utilisateur, soit son adresse électronique. ”

}

}

}

}

Version compressée :

{

“ nom ” : “ obtenir_utilisateur ”,

“ description ” : “ Obtenir les détails de l'utilisateur par nom d'utilisateur ou adresse e-mail ”,

“ paramètres ” : {

“ type ” : “ objet ”,

“"propriétés": {

“ id ” : {“ type ” : “ chaîne ”, “ description ” : “ Nom d’utilisateur/email ”}

}

}

}

La version compressée réduit le nombre de jetons de 60% tout en préservant les fonctionnalités. Appliquez les principes suivants :

- Noms de fonctions plus courts lorsqu'ils ne sont pas ambigus

- Descriptions concises (10 à 15 mots maximum)

- Noms abrégés des paramètres

- Descriptions minimales des paramètres

- Supprimer les paramètres optionnels rarement utilisés

Provisionnement dynamique des outils

Au lieu de fournir tous les outils disponibles à chaque requête, proposez-en en fonction de l'analyse de la requête. Une question sur les “ comptes utilisateurs ” chargera les outils de gestion des utilisateurs ; une question sur l'“ inventaire des produits ” chargera les outils d'inventaire.

Cela nécessite une couche de sélection d'outils avant l'appel LLM principal :

- Analysez la requête avec un classificateur léger

- Associer les catégories de requêtes aux ensembles d'outils pertinents

- Inclure uniquement les outils applicables dans le contexte

- Processus avec le LLM principal

Pour les applications disposant de plus de 50 outils disponibles, le provisionnement dynamique réduit la surcharge de définition des outils de 15 000 jetons à 2 000-4 000 jetons, soit une réduction de 80% de la consommation de contexte liée aux outils.

Traitement par lots pour les charges de travail non urgentes

L'API Batch d'OpenAI et les offres similaires d'autres fournisseurs permettent de réaliser des économies de 50% sur le traitement asynchrone. En contrepartie, la latence est plus élevée : les requêtes par lots s'exécutent en 24 heures au lieu de quelques secondes.

Le traitement par lots est judicieux pour :

- Analyse et reporting hors ligne

- génération de contenu en masse

- Étiquetage et annotation des données

- emplois de résumé nocturne

- Évaluation et test du modèle

Cela ne fonctionne pas pour :

- Interfaces de chat destinées aux utilisateurs

- Systèmes de décision en temps réel

- Alertes urgentes

- Applications interactives

La classification de la charge de travail détermine la pertinence du traitement par lots. Un moteur de recommandation de contenu peut générer des recommandations par lots pendant la nuit, puis les diffuser depuis le cache durant la journée. Cette approche hybride permet de bénéficier de remises sur les lots sans dégrader l'expérience utilisateur.

Mise en œuvre des flux de travail par lots

Le traitement par lots efficace nécessite une orchestration des flux de travail :

- Phase de collecte : Regroupez les requêtes pouvant tolérer un traitement différé.

- Soumission par lots : Requêtes de paquet et soumission à l'API par lots

- Surveillance de l'état : Suivre l'avancement des lots et gérer les échecs

- Traitement des résultats : Récupérer les résultats complets et mettre à jour les systèmes

- Population du cache : Enregistrer les résultats pour un accès rapide

L'optimisation de la taille des lots est essentielle. Des lots plus importants permettent d'amortir les coûts fixes, mais augmentent le risque d'échec et le coût des nouvelles tentatives. Des lots plus petits s'exécutent plus rapidement, mais multiplient les appels API. La taille optimale se situe généralement entre 100 et 1 000 requêtes par lot, selon la complexité de chaque requête.

Stratégie de sélection des modèles : dimensionnement optimal de l’intelligence

Le choix du modèle représente l'un des leviers de coût les plus importants. Les prix varient considérablement d'un niveau de modèle à l'autre, pourtant de nombreuses applications optent par défaut pour les modèles haut de gamme pour toutes les tâches.

| Classe de modèle | Paramètres | Coût typique pour 1 million de jetons | Idéal pour |

|---|---|---|---|

| Micromodèles | 1-3B | $50-100 | Classification, extraction, routage |

| Petits modèles | 7-9B | $100-300 | Questions-réponses simples, génération de modèles |

| Modèles moyens | 30-40B | $500-1,000 | Raisonnement complexe, tâches techniques |

| Grands modèles | 70B+ | $2,000-5,000 | Raisonnement avancé, travail créatif |

| Modèles Frontier | 400B+ | $10,000-30,000 | Recherche, tâches les plus difficiles |

Amazon Nova Micro illustre cette gamme de prix : $0,035 par million de jetons d'entrée, soit environ 100 fois moins cher que les solutions concurrentes de pointe. Pour les tâches relevant de ses capacités, Nova Micro offre des avantages considérables en termes de coûts.

La stratégie : adapter les capacités du modèle à la difficulté de la tâche. Les tâches de classification ne nécessitent pas de modèles surpuissants. Un simple système de questions-réponses sur des données structurées convient parfaitement aux modèles plus petits. Réserver les modèles coûteux aux problèmes véritablement complexes.

Tests de modèles progressifs

Lors de la mise en œuvre de nouvelles fonctionnalités, effectuez des tests progressifs, des modèles les plus petits aux plus grands :

- Commencez par le plus petit modèle susceptible de fonctionner.

- Mesurer les indicateurs de qualité par rapport aux exigences

- Si la qualité est insuffisante, passez au niveau supérieur.

- Répéter jusqu'à ce que les exigences de qualité soient satisfaites.

- Utilisez ce niveau de modèle en production

Cela évite le surdimensionnement. Les équipes supposent souvent, à tort, que les tâches complexes nécessitent des modèles de pointe, pour ensuite constater que des modèles à 30 milliards de paramètres suffisent. Cette supposition coûte 10 à 20 fois plus cher que ce que les tests permettraient de déceler.

Surveillance, alertes et gouvernance des coûts

L'optimisation des coûts n'est pas un projet ponctuel ; elle exige une surveillance et une gouvernance continues. Les systèmes de production évoluent avec le temps, au gré des changements des habitudes d'utilisation et du lancement de nouvelles fonctionnalités.

Indicateurs de coûts essentiels

Suivez ces indicateurs quotidiennement ou hebdomadairement :

- Coût total : Dépenses totales pour l'ensemble des opérations LLM

- Coût par demande : Coût moyen des opérations individuelles

- Coût par modèle : Répartition des dépenses par niveau de modèle

- Coût par fonctionnalité : Attribution aux capacités du produit

- Ratio d'efficacité du jeton : Jetons de sortie / jetons d'entrée

- Taux d'accès au cache : Pourcentage de requêtes traitées depuis le cache

- Distribution du modèle de routage : Pourcentage de requêtes par niveau de modèle

Configurer des alertes pour les anomalies :

- Les dépenses quotidiennes dépassent 150% de moyenne mobile sur 7 jours

- Le coût par requête augmente de plus de 50% d'une semaine à l'autre

- Le taux de réussite des caches chute en dessous du niveau de référence historique.

- Un seul utilisateur/fonctionnalité consomme plus de 201 TP3 TP du budget quotidien

Les alertes permettent de réagir rapidement aux pics de coûts avant qu'ils ne se transforment en crises budgétaires.

Répartition des coûts et refacturations

Pour les organisations disposant de plusieurs équipes ou produits partageant une infrastructure LLM, la répartition des coûts permet de responsabiliser les équipes. Il est important d'associer des métadonnées d'attribution à chaque requête.

- Équipe ou unité commerciale

- Produit ou fonctionnalité

- Environnement (production, mise en scène, développement)

- Segmentation des utilisateurs (gratuit, premium, entreprise)

Générez des rapports de coûts hebdomadaires détaillant les dépenses par dimension. Les équipes qui visualisent leurs habitudes de consommation prennent des décisions d'optimisation plus éclairées que celles qui n'ont aucune visibilité.

La refacturation – c’est-à-dire la facturation effective aux équipes internes de leur utilisation de LLM – incite davantage à l’efficacité. Lorsque le coût apparaît comme un poste budgétaire distinct plutôt que comme une charge partagée, l’optimisation devient une priorité.

Optimisation avancée : quantification et réglage fin

Au-delà des optimisations opérationnelles, les techniques au niveau du modèle offrent une réduction de coûts supplémentaire pour les déploiements auto-hébergés.

Quantification

La quantification réduit la précision du modèle, passant de nombres à virgule flottante 16 ou 32 bits à des entiers 8 ou 4 bits. Cela diminue les besoins en mémoire et accélère l'inférence, tout en n'entraînant qu'une dégradation minimale de la qualité si elle est effectuée avec soin.

D'après Hugging Face, l'élagage peut réduire considérablement la taille du modèle (souvent de 80 à 90%) avec une dégradation minimale des performances lorsqu'il est effectué avec soin. Avec un niveau de sparsité de 50%, WiSparse préserve 97% des performances du modèle dense de Llama3.1.

Pour les déploiements auto-hébergés, la quantification peut réduire considérablement les besoins en mémoire. Ces besoins dépendent du nombre de paramètres et du niveau de précision, ce qui permet un déploiement sur du matériel moins coûteux ou le traitement d'un plus grand nombre de requêtes par GPU.

Il est important de faire des compromis. Une quantification agressive (2 bits, 1 bit) dégrade sensiblement la qualité. Une quantification conservatrice (8 bits) préserve la qualité, mais réduit les économies. La plupart des déploiements en production privilégient 4 bits, considéré comme le compromis idéal.

Réglage fin pour une efficacité accrue

Les modèles optimisés peuvent être plus petits et moins coûteux tout en conservant leurs performances pour des domaines spécifiques. Un modèle générique à 70 milliards de paramètres peut être remplacé par un modèle optimisé à 7 milliards de paramètres pour des applications ciblées.

Le réglage fin nécessite :

- Données d'entraînement de haute qualité (des centaines à des milliers d'exemples)

- Ressources de calcul pour l'entraînement (GPU, de quelques heures à plusieurs jours)

- Infrastructure d'évaluation pour valider la qualité

- Maintenance continue en fonction de l'évolution des besoins

Les facteurs économiques favorisent un réglage fin lorsque :

- Le volume des requêtes est très élevé (millions par mois).

- Les exigences de la tâche sont stables

- La qualité des performances peut être rigoureusement mesurée

- L'infrastructure nécessaire à l'hébergement des modèles existe.

Pour les flux de travail basés sur les API, les coûts de réglage fin dépassent les économies réalisées jusqu'à ce que les volumes de requêtes mensuels atteignent des centaines de milliers, voire des millions d'appels.

La pile d'optimisation des coûts 2026

Une gestion efficace des coûts des masters en droit (LLM) en 2026 repose sur l'intégration de plusieurs stratégies au sein d'une architecture cohérente. Aucune technique ne résout à elle seule tous les problèmes ; les meilleurs résultats sont obtenus en combinant des approches complémentaires.

Une pile d'optimisation de niveau production comprend :

- Couche de base : La stratégie de sélection des modèles garantit que les tâches utilisent par défaut des modèles de taille appropriée.

- Couche de mise en cache : La mise en cache rapide et la mise en cache sémantique interceptent toutes deux le travail redondant avant qu'il n'atteigne les modèles.

- Couche de routage : L'orchestration intelligente dirige les requêtes vers le modèle le plus rentable capable de les traiter.

- Couche d'optimisation : La compression du contexte, l'efficacité des jetons et la gestion des sorties minimisent le gaspillage dans les requêtes qui atteignent les modèles.

- Couche de charge de travail : Le traitement par lots et les modèles asynchrones permettent de bénéficier de réductions sur les travaux non urgents.

- Couche de gouvernance : La surveillance, l'attribution et les alertes permettent de maintenir les optimisations dans le temps et d'éviter les dérives de coûts.

Chaque couche contribue indépendamment, mais leurs effets combinés se multiplient. Un système utilisant les six couches permet une réduction des coûts de 80 à 85 000 £ par rapport aux implémentations simples, transformant ainsi des dépenses annuelles de 216 000 £ en 30 000 à 40 000 £ tout en maintenant, voire en améliorant, la qualité.

Réduisez les coûts de votre LLM dès le début – optimisez votre configuration avant de passer à l'échelle.

Dans les projets LLM, la plupart des problèmes de coûts proviennent de la configuration des systèmes, et non seulement de leur utilisation. Des flux de données inefficaces, des modèles surdimensionnés et des invites non optimisées peuvent faire grimper les coûts insidieusement, bien avant le début de la mise à l'échelle. IA supérieure Elle intervient sur l'ensemble du cycle de vie – de la préparation des données et de la conception du modèle à l'entraînement, au réglage fin et au déploiement – aidant ainsi les équipes à éliminer ces inefficacités au plus tôt plutôt que de réagir plus tard.

L'objectif est de rendre les modèles utilisables en production sans surcharge inutile, que ce soit en ajustant leur taille, en optimisant les flux de travail ou en repensant le choix entre API externes et configurations personnalisées. Ceci devient crucial lorsque l'utilisation augmente, car de petites inefficacités se transforment alors en dépenses importantes. Si vous cherchez à réduire concrètement les coûts de vos modèles de modélisation juridique (LLM), il est judicieux de revoir votre configuration avant de passer à l'échelle supérieure. Contactez-nous. IA supérieure identifier les domaines où les coûts peuvent réellement être réduits.

Pièges courants à éviter

Les tentatives d'optimisation des coûts échouent souvent en raison d'erreurs prévisibles. Les éviter accélère la réussite.

Optimiser sans mesurer

Le mode d'échec le plus fréquent : la mise en œuvre d'optimisations sans en mesurer l'impact. Les équipes déploient la mise en cache, supposent qu'elle fonctionne et ne constatent pas que le taux d'accès au cache oscille autour de 201 TP3T au lieu des 801 TP3T attendus.

L'évaluation doit précéder l'optimisation. Autrement, les efforts se concentrent sur des domaines à faible impact tandis que les facteurs de coûts élevés restent sans réponse.

Latence sur-optimisée

Il existe un compromis entre latence et coût. La mise en cache agressive réduit les coûts, mais augmente la latence d'accès au cache. Le routage en cascade permet de réaliser des économies, mais accroît les délais en cas d'échec. Le traitement par lots offre des réductions importantes, mais empêche la réponse en temps réel.

Chaque milliseconde n'a pas la même importance. Une interface de chat destinée aux clients exige des temps de réponse inférieurs à la seconde. Un générateur de rapports nocturne peut tolérer quelques minutes. Il est donc essentiel d'adapter les stratégies d'optimisation aux exigences réelles de latence plutôt que d'optimiser systématiquement la vitesse.

Négliger le contrôle de la qualité

L'optimisation des coûts ne devrait pas dégrader la qualité des résultats, mais certaines techniques agressives peuvent y parvenir. Une compression excessive entraîne une perte d'informations cruciales. Un cache sémantique avec des seuils de similarité trop permissifs peut renvoyer des réponses qui ne correspondent pas précisément à l'intention de la requête. Le routage vers des modèles plus petits réduit les capacités.

Le contrôle qualité doit être mené en parallèle du contrôle des coûts. Suivez des indicateurs tels que :

- Scores de satisfaction des utilisateurs

- taux d'achèvement des tâches

- Taux d'erreur et tentatives de réessai

- Examen manuel des exemples de résultats

Lorsque l'optimisation des coûts nuit à la qualité, l'optimisation échoue quelles que soient les économies réalisées.

Ignorer les coûts cachés

Les coûts symboliques représentent la dépense évidente, mais les coûts cachés s'accumulent :

- Temps d'ingénierie consacré à la construction et à la maintenance de l'infrastructure d'optimisation

- Coûts d'infrastructure pour les couches de mise en cache et les systèmes de surveillance

- Complexité accrue et difficulté de débogage

- Coût d'opportunité lié à l'attention portée par l'équipe aux coûts plutôt qu'aux fonctionnalités

Calculez le véritable retour sur investissement en tenant compte de ces facteurs. Un système de cache qui permet d'économiser $500 par mois, mais qui nécessite $300 en infrastructure et 20 heures d'ingénierie pour sa maintenance, présente une valeur discutable.

Questions fréquemment posées

Quelle est l'optimisation des coûts LLM ayant le plus fort impact dans la plupart des applications ?

La mise en cache des invites offre généralement l'impact le plus immédiat pour les applications dont la structure des invites est stable. Lorsqu'elle est applicable, elle peut réduire le coût des jetons d'entrée de 90% et la latence de 85%. Sa mise en œuvre est simple : il suffit de restructurer les invites pour placer le contenu statique en premier. Elle ne nécessite pas d'infrastructure complexe. La plupart des applications en production comportant de la documentation, des exemples ou des instructions répétées dans les invites en tirent un avantage considérable.

Comment savoir si mon taux de réussite dans le cache est suffisamment bon ?

Un taux d'accès au cache supérieur à 600 TP3T permet de réaliser des économies substantielles grâce à la mise en cache des requêtes immédiates. La mise en cache sémantique requiert des taux plus élevés (généralement entre 70 et 800 TP3T) en raison de son coût de mise en œuvre plus important. Calculez les économies attendues : (taux_accès_au_cache × économies_cache) – coûts_cache. Si ce résultat dépasse une réduction nette de 40 à 500 TP3T, la mise en cache est rentable. Surveillez les taux d'accès chaque semaine ; une baisse indique des modifications de la structure des requêtes immédiates ou des changements dans les modèles de requêtes qui nécessitent une intervention.

Dois-je utiliser des SLM ou des LLM pour les tâches de classification ?

Les tâches de classification bénéficient presque toujours de modèles plus petits. Des études montrent que les modèles à 7-9 milliards de paramètres atteignent une précision équivalente à celle des grands modèles (85 à 95 TP3T) pour la classification, tout en coûtant 10 à 50 fois moins cher. Testez votre tâche de classification : collectez 100 à 200 exemples étiquetés, évaluez les modèles plus petits et plus grands, et comparez leur précision. À moins que l’écart de précision ne dépasse 5 à 10 points de pourcentage, choisissez le modèle plus petit.

Dans quels cas le réglage fin d'un modèle est-il plus avantageux que l'utilisation de modèles plus grands ?

L'optimisation fine devient rentable lorsque le volume mensuel de requêtes dépasse plusieurs centaines de milliers d'appels et que les exigences des tâches restent stables. Les coûts d'entraînement varient de 1 000 à 5 000 € selon la taille du modèle et le volume de données. Si un modèle de 7 milliards d'enregistrements optimisé remplace une API de 70 milliards d'enregistrements pour un coût d'inférence 30 fois inférieur, le seuil de rentabilité est atteint autour de 300 000 à 500 000 requêtes. En dessous de ce volume, des techniques d'optimisation comme la mise en cache et le routage offrent un meilleur retour sur investissement.

Quel niveau de compression du contexte est acceptable sans perte de qualité ?

Les taux de compression sûrs dépendent fortement du type de contenu. L'historique des conversations se compresse de 60 à 801 TP3T grâce à la synthèse, tout en préservant la cohérence du dialogue. La documentation technique se compresse généralement de 40 à 601 TP3T par extraction sans perte d'information. Les contenus créatifs ou nuancés se compressent moins, de 30 à 401 TP3T environ. Il est toujours recommandé de réaliser des tests A/B : traiter des requêtes identiques avec des contextes complets et compressés, comparer les résultats et mesurer les différences de qualité avant de déployer la compression.

Quels sont les instruments minimaux viables pour le suivi des coûts des programmes LLM ?

Au minimum, enregistrez ces six champs par requête : horodatage, nom_du_modèle, jetons_d'entrée, jetons_de_sortie, coût_calculé et un champ d'attribution (identifiant_utilisateur ou nom_de_la_fonctionnalité). Stockez ces données dans une base de données prenant en charge les requêtes d'agrégation ; même une simple table PostgreSQL convient. Cela permet un suivi quotidien des coûts et l'identification des postes de dépenses importants. Ajoutez d'autres champs (latence, accès_au_cache, score_de_qualité) selon les besoins, mais commencez par ces éléments de base.

Comment convaincre la direction d'investir dans l'optimisation des coûts du LLM ?

Présentez les projections de coûts avec et sans optimisation. Indiquez les dépenses mensuelles actuelles, multipliez-les par 12 pour obtenir le coût annuel, puis calculez le coût annuel optimisé en utilisant des estimations d'économies prudentes (50 à 600 000 £ au lieu de 800 000 £). L'écart, souvent supérieur à 100 000 £ pour les applications de production, justifie l'investissement en ingénierie. Incluez le calcul du retour sur investissement (RSI) : (Économies_Annuelles – Coût_de_Mise_En_Œuvre) / Coût_de_Mise_En_Œuvre. Un RSI supérieur à 3 000 £ rend l'investissement particulièrement convaincant.

Conclusion : Du centre de coûts à l'avantage concurrentiel

Les coûts de la fabrication de logiciels légers ne doivent pas nécessairement s'envoler. Les stratégies décrites ici (mise en cache rapide, routage intelligent, optimisation du contexte et instrumentation systématique) permettent de réduire systématiquement les coûts de production de 70 à 851 TP3T tout en maintenant, voire en améliorant, la qualité.

Mais il ne s'agit pas seulement de faire des économies. Les organisations qui maîtrisent les opérations LLM rentables acquièrent des avantages stratégiques. Des coûts unitaires plus bas permettent de servir davantage d'utilisateurs, d'expérimenter de nouvelles fonctionnalités et de proposer des capacités d'IA que les concurrents jugent économiquement non viables.

L'idée clé : considérer la consommation de jetons comme une priorité d'ingénierie dès le départ. Instrumenter rapidement, optimiser systématiquement et surveiller en continu. Les techniques performantes en 2026 (mise en cache, routage, compression) évolueront, mais une ingénierie LLM axée sur la maîtrise des coûts restera essentielle.

Commencez par la mesure. Choisissez une fonctionnalité à fort trafic, instrumentez sa consommation de jetons et analysez les tendances. Cette visibilité révèle des opportunités d'optimisation dont le rendement est 10 à 100 fois supérieur à l'effort d'instrumentation. Appliquez ensuite des stratégies ciblées là où les données indiquent qu'elles auront le plus d'impact.

Les organisations qui tireront leur épingle du jeu grâce à la technologie LLM en 2026 ne seront pas seulement celles qui possèdent les meilleurs modèles, mais celles qui auront maîtrisé les aspects économiques de la mise en production efficace de ces modèles.