Résumé rapide : Les tarifs des modèles LLM varient considérablement d'un fournisseur à l'autre, avec des jetons d'entrée allant de $0,10 à $5 par million et des jetons de sortie allant de $0,40 à $25 par million (données de mars 2026). Les modèles GPT d'OpenAI, Claude d'Anthropic et Gemini de Google dominent le marché avec différents niveaux de performance et de prix. Comprendre la tarification par jetons, les fenêtres de contexte et les modèles d'utilisation est essentiel pour optimiser les coûts tout en maintenant la qualité.

La multiplication des API de modèles de langage de grande envergure a engendré un paysage tarifaire complexe. Les organisations sont confrontées à des décisions cruciales quant aux modèles les plus adaptés à leurs cas d'usage spécifiques.

Mais attention : le choix d’un modèle ne se résume pas à trouver l’option la moins chère. L’économie de l’inférence LLM dépend de multiples facteurs : le prix des jetons, les limites de la fenêtre de contexte, les exigences de latence et les coûts cachés qui peuvent multiplier votre facture par 2 ou 3.

Cette étude comparative analyse les prix pratiqués par les principaux fournisseurs, notamment OpenAI, Anthropic, Google et les alternatives émergentes. Les données reflètent les prix en vigueur en mars 2026, même si les fournisseurs ajustent régulièrement leurs tarifs.

Comprendre les modèles de tarification basés sur les jetons

Les fournisseurs de LLM facturent en fonction des jetons traités. Un jeton représente environ 4 caractères de texte, soit environ 0,75 mot en anglais. Par exemple, la chaîne “ ChatGPT is great! ” est encodée en six jetons : [“ Chat ”, “ G ”, “ PT ”, ” is ”, ” great ”, “ ! ”].

La plupart des fournisseurs divisent leur tarification en deux parties : les jetons d’entrée (que les développeurs envoient au modèle) et les jetons de sortie (que le modèle génère). Les jetons de sortie coûtent généralement 3 à 5 fois plus cher que les jetons d’entrée, car leur génération nécessite davantage de ressources de calcul.

Le nombre total de jetons dans un appel API influe sur trois facteurs critiques : le coût de l’appel, sa durée d’exécution et sa compatibilité avec les limites de la fenêtre de contexte du modèle.

Fenêtres de contexte et mise en cache

Les fenêtres de contexte définissent le nombre maximal de jetons qu'un modèle peut traiter en une seule requête. Début 2026, leur capacité a considérablement augmenté. Claude Opus 4.6 d'Anthropic propose une fenêtre de contexte d'un million de jetons en version bêta, tandis que la plupart des modèles en production offrent des fenêtres de 128 000 à 200 000 jetons.

Des fenêtres de contexte plus larges permettent des applications plus sophistiquées, mais augmentent les coûts proportionnellement. Une entrée de 100 000 jetons à 1 TP4T3 par million de jetons coûte 1 TP4T0,30 par requête ; multipliez cela par des milliers de requêtes quotidiennes et les coûts grimpent rapidement.

La mise en cache rapide permet de réaliser des économies considérables. OpenAI propose un tarif pour les données d'entrée mises en cache équivalent à 501 TP3 T du coût des données d'entrée standard. Selon la documentation tarifaire d'OpenAI, GPT-4.1 facture 1 TP4 T2,00 par million de jetons d'entrée, mais seulement 1 TP4 T0,50 par million de jetons d'entrée mis en cache.

Ventilation des prix des principaux fournisseurs

Le paysage concurrentiel comprend trois acteurs dominants et plusieurs alternatives émergentes. Chaque fournisseur propose plusieurs niveaux de modèles optimisés pour différents cas d'utilisation.

Structure tarifaire d'OpenAI

Les modèles GPT d'OpenAI couvrent plusieurs niveaux d'intelligence et de coût. Comme indiqué dans les discussions communautaires de janvier 2026, la tarification continue d'évoluer au fur et à mesure du lancement de nouveaux modèles.

| Modèle | Entrée (par million de jetons) | Entrée mise en cache (par Mo) | Sortie (pour 1 million de jetons) | Fenêtre contextuelle |

|---|---|---|---|---|

| GPT-4.1 | $2.00 | $0.50 | $8.00 | 128K |

| GPT-4o | $2.50 | $1.25 | $10.00 | 128K |

| GPT-4-32k (obsolète) | $60.00 | N / A | $120.00 | 32K |

OpenAI a déprécié les modèles GPT-4-32k, leur arrêt étant prévu pour le 6 juin 2025. Selon la documentation d'OpenAI relative à cette dépréciation, les utilisateurs existants disposaient d'un temps limité pour migrer vers des modèles plus récents comme GPT-40.

La famille de modèles GPT-5.4 représente la dernière avancée d'OpenAI. Lancée en mars 2026, la version GPT-5.4 mini est accessible aux utilisateurs des versions Free et Go via la fonctionnalité “ Thinking ” de ChatGPT. Pour les utilisateurs payants, GPT-5.4 mini sert de solution de repli en cas de limitation de débit pour GPT-5.4 Thinking.

Prix de Claude l'anthropomorphe

Les modèles Claude d'Anthropic se sont imposés comme de sérieux concurrents à OpenAI, notamment pour les tâches de codage et d'automatisation. L'entreprise a lancé Claude Opus 4.6 en février 2026 et Claude Sonnet 4.6 peu après.

Claude Opus 4.6 conserve ses tarifs de $5 par million de jetons d'entrée et de $25 par million de jetons de sortie, malgré des améliorations significatives de ses fonctionnalités. D'après l'annonce d'Anthropic, ces tarifs restent inchangés par rapport à la version précédente, Opus 4.5.

Claude Sonnet 4.6 propose une tarification plus accessible à $3 par million de jetons d'entrée et $15 par million de jetons de sortie, soit le même tarif que Sonnet 4.5. Anthropic décrit Sonnet 4.6 comme approchant l'intelligence de niveau Opus à un prix plus pratique pour les tâches quotidiennes.

| Modèle | Entrée (par million de jetons) | Sortie (pour 1 million de jetons) | Fenêtre contextuelle | Idéal pour |

|---|---|---|---|---|

| Claude Opus 4.6 | $5.00 | $25.00 | 1M (bêta) | Raisonnement complexe, codage, agents |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 1M (bêta) | Performance et coût équilibrés |

| Claude Opus 4.5 | $5.00 | $25.00 | 200K | Applications héritées |

La fenêtre de contexte de 1 million de jetons de Claude Opus 4.6 constitue une première pour les modèles de classe Opus d'Anthropic. Cette extension permet de traiter des bases de code entières ou des documents volumineux en une seule requête.

Tarification de Google Gemini

Les modèles Gemini de Google sont très compétitifs en termes de prix, notamment pour les applications à fort volume. La gamme Gemini comprend plusieurs niveaux optimisés pour différents besoins de performance.

Les tarifs des modèles Gemini varient considérablement selon le niveau et le volume d'utilisation. Google positionne Gemini comme une alternative économique pour les applications exigeant de hautes performances sans surcoût.

Coûts cachés et mécanismes de tarification

Le prix affiché par jeton ne révèle qu'une partie de la réalité. Plusieurs facteurs cachés peuvent faire grimper considérablement les coûts réels.

Multiplicateurs de jetons de sortie

Chez tous les fournisseurs, le coût des jetons de sortie est systématiquement 3 à 5 fois supérieur à celui des jetons d'entrée. Une application générant des réponses longues subira des coûts disproportionnés par rapport à une application traitant des entrées volumineuses mais produisant des sorties concises.

Définir le nombre maximal de jetons de sortie (paramètre max_tokens) permet de maîtriser les coûts. Si cette valeur est trop faible, les réponses sont tronquées. Si elle est trop élevée, le modèle risque de générer du contenu superflu, notamment à des températures élevées favorisant la créativité.

Limites de débit et coûts de repli

La plupart des fournisseurs mettent en place des limites de débit basées sur le nombre de requêtes par minute, le nombre de jetons par minute, ou les deux. Lorsque les applications atteignent ces limites, elles tombent en panne ou basculent vers des modèles alternatifs.

L'implémentation GPT-5.4 d'OpenAI illustre ce principe. D'après les notes de version du modèle d'OpenAI de mars 2026, les utilisateurs payants bénéficient de GPT-5.4 mini en cas d'atteinte des limites de requêtes de GPT-5.4 Thinking. Ceci garantit la continuité du service, mais potentiellement avec une structure de coûts différente.

Économie de la fenêtre contextuelle

Des fenêtres de contexte plus larges permettent des applications plus sophistiquées, mais augmentent les coûts de manière linéaire. Avec une longueur de contexte de 128 000 jetons, le cache KV de LLama2-7B en demi-précision atteint 64 Go, calculé comme suit : num_layers × num_kv_head × head_dim × seqlen × sizeof(fp16) × 2.

Les recherches sur l'efficacité du décodage LLM indiquent que la taille du cache KV augmente linéairement avec la longueur de la séquence, créant des goulots d'étranglement de mémoire lors du décodage qui se traduisent par des coûts opérationnels plus élevés.

Considérations relatives à la tarification des entreprises

Les déploiements en entreprise sont soumis à des contraintes économiques différentes de celles des développeurs individuels ou des petites équipes. Les remises sur volume, les tarifs personnalisés et les options de déploiement ont un impact significatif sur le coût total de possession.

API cloud vs. déploiement auto-hébergé

Les organisations peuvent souscrire à des services LLM commerciaux ou déployer des modèles sur leur propre infrastructure. Une étude publiée sur arXiv, analysant le déploiement de LLM sur site, a révélé que pour atteindre le seuil de rentabilité avec les services commerciaux, une analyse approfondie des habitudes d'utilisation et des coûts d'infrastructure est indispensable.

L'étude a défini quatre critères de sélection du modèle : performances équivalentes à celles des meilleurs modèles commerciaux (dans le cadre de l'étude 20%), compatibilité opérationnelle, exigences de sécurité et rentabilité à grande échelle. Pour les applications à fort volume, l'auto-hébergement peut réduire les coûts, mais l'investissement initial dans l'infrastructure reste conséquent.

Optimisation des coûts de l'architecture hiérarchique

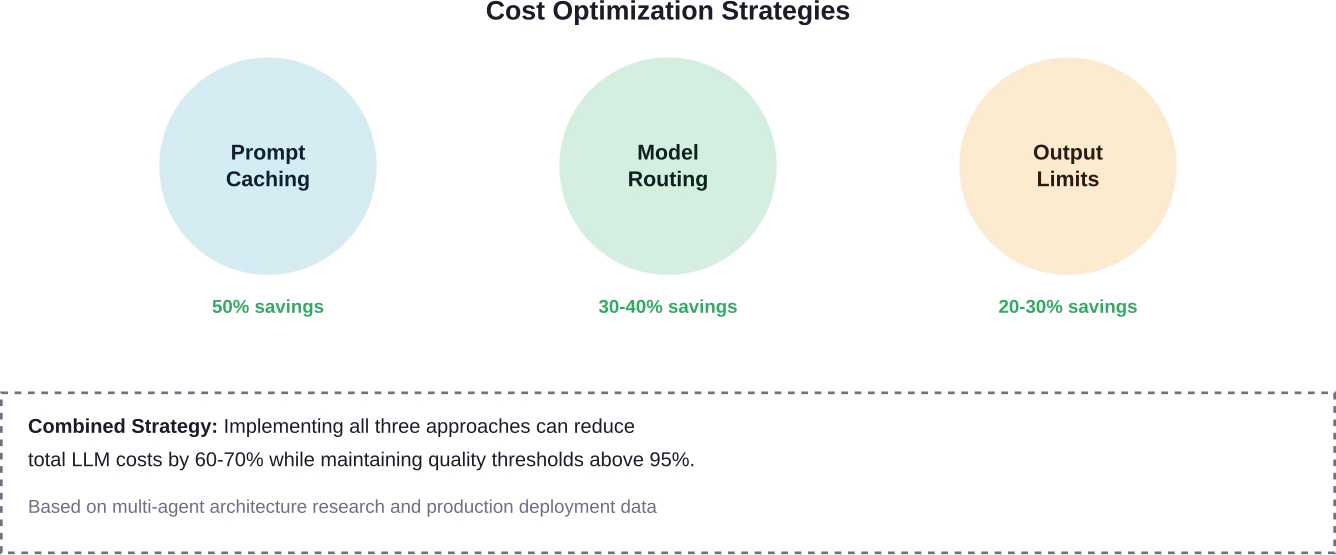

Des recherches comparatives récentes sur les architectures LLM multi-agents pour le traitement de documents financiers ont révélé que les architectures hiérarchiques offrent le meilleur compromis coût-précision. Ces systèmes ont atteint une précision de 97,71 TP3T pour une architecture réflexive, pour un coût de 60,91 TP3T.

La recherche a démontré que la mise en cache sémantique, le routage par modèle et le traitement adaptatif peuvent réduire considérablement les coûts opérationnels sans compromettre la qualité. Ces techniques deviennent de plus en plus importantes à mesure que les applications traitent des millions de requêtes quotidiennes.

Solutions alternatives émergentes et tarification régionale

Au-delà des trois principaux fournisseurs, plusieurs alternatives proposent des prix compétitifs pour des cas d'utilisation spécifiques.

DeepSeek et les modèles open source

DeepSeek s'est fait remarquer grâce à ses prix compétitifs sur des modèles performants. L'entreprise se positionne comme une alternative économique pour les applications ne nécessitant pas des performances de pointe absolues.

Les modèles open source déployés via des fournisseurs de GPU cloud comme RunPod offrent une autre solution. Ces services facturent à l'heure GPU plutôt qu'au jeton, ce qui rend les coûts plus prévisibles pour les applications à fort volume de données.

Fournisseurs de modèles spécialisés

Les modèles Mistral, Meta Llama et NVIDIA s'adressent chacun à des besoins spécifiques. Selon une analyse comparative publiée en août 2025, le choix d'un modèle doit prendre en compte sa finalité, ses spécifications techniques et ses cas d'utilisation optimaux, et pas seulement son prix.

L'analyse souligne que différents modèles excellent dans différentes tâches. Choisir uniquement en fonction du coût le plus bas conduit souvent à de mauvais résultats et à un retraitement coûteux.

Cadre pratique de calcul des coûts

L'estimation des coûts réels nécessite la compréhension des modèles d'utilisation spécifiques à l'application. Les quatre paramètres critiques sont : le nombre moyen de jetons d'entrée par requête, le nombre moyen de jetons de sortie par requête, le nombre de requêtes quotidiennes prévues et le niveau de modèle choisi.

Un calcul simple : (Jetons d'entrée × Prix d'entrée + Jetons de sortie × Prix de sortie) × Requêtes quotidiennes × 30 jours = Coût mensuel.

Par exemple, une application traitant 10 000 jetons d'entrée et générant 2 000 jetons de sortie par requête, exécutant 1 000 requêtes par jour sur Claude Sonnet 4.6 : (10 000 × $0,000003 + 2 000 × $0,000015) × 1 000 × 30 = $1 800 par mois.

Soyons francs : la plupart des applications sous-estiment l’utilisation réelle des jetons d’un facteur 2 à 3 lors des phases de planification. Prévoyez des marges de sécurité en conséquence.

Considérations relatives à la performance et au prix

Le modèle le moins cher est rarement le plus performant. Selon une étude analysant l'économie de l'inférence en IA, le “ coût marginal ” de l'inférence LLM varie considérablement en fonction de l'efficacité de calcul et de l'architecture du modèle.

Des études analysant l'approximation des requêtes à l'aide de modèles proxy légers ont démontré qu'une sélection stratégique du modèle permet de réduire les coûts et la latence d'un facteur 100. Ces recherches ont montré que les modèles proxy atteignent une précision supérieure à 90% tout en réduisant considérablement les coûts pour certains types de requêtes.

Le déploiement local sur du matériel grand public offre une autre possibilité. Des recherches sur l'efficacité des modèles de langage locaux ont montré que ces modèles peuvent répondre avec précision à 88,71 TPE/3 T de requêtes conversationnelles et de raisonnement en un seul tour, malgré des pertes de latence importantes par rapport aux déploiements en centre de données.

Compromis entre latence et coût

Les modèles plus rapides coûtent généralement plus cher ou nécessitent des abonnements premium. Les applications avec des exigences de latence strictes peuvent devoir accepter des coûts par jeton plus élevés pour respecter les SLA de performance.

Les attentes en matière de latence varient selon le modèle et le déploiement : les modèles phares fournissent généralement 20 à 40 jetons/seconde, les modèles de milieu de gamme atteignent 40 à 80 jetons/seconde et les modèles optimisés peuvent dépasser 100 jetons/seconde sur une infrastructure dédiée.

Comparez attentivement les modèles et choisissez celui qui vous convient.

Comparer plus de 15 LLM uniquement sur la base du prix ne donne que rarement une image complète. Le coût réel dépend de la mise en œuvre des modèles : la qualité des données, la stratégie d’optimisation et les choix d’infrastructure influent tous sur le coût final. IA supérieure Elle intervient sur l'ensemble du cycle de vie, de la préparation des données et de la sélection du modèle à l'entraînement, à l'optimisation et au déploiement, aidant ainsi les équipes à choisir et à configurer des modèles en fonction de cas d'utilisation réels plutôt que d'une simple tarification superficielle.

En pratique, cela signifie souvent éviter les modèles surdimensionnés lorsqu'ils ne sont pas nécessaires, ou combiner des approches comme le réglage fin et les configurations hybrides au lieu de s'appuyer sur un seul modèle ou une seule API. L'objectif est de construire des systèmes performants en production, et non de simplement comparer des performances. Si vous évaluez plusieurs LLM et cherchez à comprendre leur coût réel d'utilisation, il est judicieux de revoir votre configuration dès le début. Contactez-nous. IA supérieure pour que le choix du modèle corresponde au coût réel, et non pas seulement au prix affiché.

Tendances futures en matière de prix

La tarification des LLM continue d'évoluer rapidement. Plusieurs tendances claires se sont dégagées entre 2025 et 2026.

Les fenêtres de contexte ont connu une expansion considérable tandis que le prix par jeton a diminué. Claude Opus 4.6 et Sonnet 4.6 proposent tous deux des fenêtres de contexte d'un million de jetons au même prix que les modèles précédents à 200 000 fenêtres. Cela représente une augmentation significative de la capacité des fenêtres de contexte sans augmentation proportionnelle des coûts.

L'obsolescence des modèles s'accélère. La mise hors service par OpenAI des variantes de GPT-4-32k dans les 12 à 18 mois suivant leur publication témoigne d'une accélération des cycles d'itération. Les organisations doivent prévoir des migrations régulières de modèles et les coûts de développement associés.

L'écart entre les modèles haut de gamme et de milieu de gamme s'est réduit. Selon les annonces d'Anthropic, Claude Sonnet 4.6 offre des capacités quasi équivalentes à celles d'Opus pour un prix 60%. Cette réduction des fonctionnalités à différents niveaux de prix est avantageuse pour les déploiements à coût maîtrisé.

FAQ

Quel est le LLM le moins cher pour une utilisation en production en 2026 ?

DeepSeek et Google Gemini proposent les coûts par jeton les plus bas parmi les principaux fournisseurs, mais “ le moins cher ” n'est pas toujours synonyme de meilleur rapport qualité-prix. Le coût total dépend des exigences de précision, des besoins de retraitement et des exigences relatives à la fenêtre de contexte. Pour de nombreuses applications, les modèles de milieu de gamme comme Claude Sonnet 4.6 à $3/$15 par million de jetons offrent une rentabilité globale supérieure à celle des solutions à prix plancher offrant une qualité de sortie moindre.

Combien la mise en cache des invites permet-elle réellement d'économiser ?

La tarification des entrées mises en cache d'OpenAI permet de réaliser des économies de 50% sur les segments d'invites répétitifs. Pour les applications utilisant des invites système ou des documents de référence cohérents, cela se traduit par une réduction du coût total de 30 à 50%. Les économies sont particulièrement importantes pour les applications effectuant des milliers de requêtes similaires avec un contexte partagé.

Les entreprises doivent-elles héberger elles-mêmes leurs plateformes LLM ou utiliser des API ?

Les études économiques sur le déploiement sur site indiquent que le seuil de rentabilité exige une utilisation intensive et constante ainsi qu'une infrastructure technique adaptée. Les applications traitant moins de 100 millions de jetons par mois trouvent généralement la tarification des API plus avantageuse. Au-delà de ce seuil, l'auto-hébergement devient envisageable, mais il faut alors prendre en compte les coûts liés au DevOps, aux mises à jour des modèles et à la gestion de l'infrastructure, en plus des dépenses de calcul brutes.

Pourquoi les jetons de sortie coûtent-ils plus cher que les jetons d'entrée ?

La génération exige beaucoup plus de ressources de calcul que le traitement. Les jetons d'entrée sont encodés une seule fois, tandis que chaque jeton de sortie nécessite un traitement complet pour prédire le jeton suivant. Il en résulte une différence de calcul de 3 à 5 fois, qui se répercute sur les tarifs proposés par tous les fournisseurs.

Comment estimer l'utilisation des jetons pour mon application ?

Utilisez les outils de tokenisation fournis par chaque fournisseur de modèle pour mesurer les requêtes typiques. OpenAI, Anthropic et Google proposent tous des API ou des outils web de tokenisation. Testez avec des données d'exemple représentatives, multipliez par les volumes de requêtes attendus et ajoutez une marge de 50% pour les variations. La plupart des estimations de planification sous-estiment l'utilisation réelle d'un facteur 2 à 3.

Que se passe-t-il lorsque j'atteins les limites de débit ?

La réponse dépend du fournisseur et du niveau de service. Certaines implémentations mettent les requêtes en file d'attente, d'autres renvoient des erreurs de limitation de débit nécessitant une nouvelle tentative, et les niveaux premium peuvent utiliser des modèles alternatifs. OpenAI utilise GPT-5.4 mini pour les utilisateurs payants lorsque les limites de débit sont atteintes. Consultez la documentation spécifique du fournisseur pour connaître la gestion des limites de débit propre à chaque niveau.

Existe-t-il des remises sur volume pour les API LLM ?

La plupart des fournisseurs proposent des tarifs entreprises avec des remises sur volume, mais les conditions ne sont pas publiques. Les organisations traitant plus d'un milliard de jetons par mois sont invitées à contacter directement les équipes commerciales. Les remises varient généralement de 10 à 301 000 téléchargements par million (TP3T) en fonction du niveau d'engagement et des volumes d'utilisation. Anthropic, OpenAI et Google proposent tous des programmes commerciaux pour entreprises avec des tarifs personnalisés.

Conclusion

Le paysage tarifaire des LLM demeure complexe et en constante évolution. En mars 2026, le coût par jeton variait de moins de $1 par million à $25 par million, selon le niveau du modèle et le type de jeton.

Les considérations économiques privilégient la sélection stratégique du modèle plutôt que le simple choix de l'option la moins chère. Claude Sonnet 4.6, à $3/$15 par million de jetons, offre des performances quasi optimales pour les tâches courantes. GPT-4.1 d'OpenAI, à $2/$8, propose un raisonnement général performant à des tarifs compétitifs. Claude Opus 4.6, à un prix plus élevé ($5/$25), est en tête pour la programmation complexe et les tâches d'automatisation.

Les coûts cachés sont aussi importants que les prix affichés. La mise en cache rapide permet d'économiser 50% sur les saisies répétées. La gestion des jetons de sortie évite les explosions de coûts dues aux réponses verbeuses. Les architectures hiérarchiques réduisent les coûts totaux de 60% tout en maintenant la qualité.

Les organisations doivent calculer le coût total de possession, incluant la gestion des limites de débit, les cycles de dépréciation des modèles et les besoins de retraitement liés à la qualité. Le prix par jeton le plus bas engendre souvent le coût total le plus élevé.

Commencez par évaluer les charges de travail représentatives des différents modèles candidats. Mesurez non seulement la précision, mais aussi le nombre total de jetons consommés par tâche réussie. Tenez compte des habitudes d'utilisation spécifiques, des exigences de latence et des besoins en matière de fenêtre de contexte. Vous pourrez ainsi prendre une décision éclairée, basée sur la valeur réelle et non uniquement sur le prix affiché.