Resumen rápido: Los precios de LLM varían considerablemente entre los proveedores, con tokens de entrada que oscilan entre $0.10 y $5 por millón, y tokens de salida entre $0.40 y $25 por millón (datos de marzo de 2026). Los modelos GPT de OpenAI, Claude de Anthropic y Gemini de Google dominan el mercado con diferentes niveles de relación precio-rendimiento. Comprender los precios basados en tokens, las ventanas de contexto y los patrones de uso es fundamental para optimizar los costos sin comprometer la calidad.

La proliferación de API de modelos de lenguaje de gran tamaño ha creado un panorama de precios complejo. Las organizaciones se enfrentan a decisiones cruciales sobre qué modelos ofrecen el mejor valor para sus casos de uso específicos.

Pero aquí está la clave: la elección del modelo no se trata solo de encontrar la opción más barata. La economía de la inferencia LLM implica múltiples factores: precios de tokens, límites de la ventana de contexto, requisitos de latencia y costos ocultos que pueden multiplicar su factura por 2 o 3.

Esta comparativa analiza los precios de los principales proveedores, como OpenAI, Anthropic, Google y otras alternativas emergentes. Los datos reflejan los precios vigentes a marzo de 2026, si bien los proveedores ajustan sus tarifas periódicamente.

Comprensión de los modelos de precios basados en tokens

Los proveedores de LLM cobran en función de los tokens procesados. Un token representa aproximadamente 4 caracteres de texto o alrededor de 0,75 palabras en inglés. Por ejemplo, la cadena “ChatGPT is great!” se codifica en seis tokens: [“Chat”, “G”, “PT”, ” is”, ” great”, “!”].

La mayoría de los proveedores dividen el precio en dos componentes: tokens de entrada (lo que los desarrolladores envían al modelo) y tokens de salida (lo que genera el modelo). Los tokens de salida suelen costar entre 3 y 5 veces más que los tokens de entrada, ya que su generación requiere más recursos computacionales.

El número total de tokens en una llamada a la API afecta a tres factores críticos: cuánto cuesta la llamada, cuánto tiempo tarda en completarse y si se ajusta a los límites de la ventana de contexto del modelo.

Ventanas de contexto y almacenamiento en caché

Las ventanas de contexto definen el número máximo de tokens que un modelo puede procesar en una sola solicitud. A principios de 2026, las ventanas de contexto se han expandido drásticamente. Claude Opus 4.6 de Anthropic cuenta con una ventana de contexto de 1 millón de tokens en versión beta, mientras que la mayoría de los modelos en producción ofrecen ventanas de entre 128 000 y 200 000 tokens.

Las ventanas de contexto más grandes permiten aplicaciones más sofisticadas, pero aumentan los costos proporcionalmente. Una entrada de 100 000 tokens a 1 TP4T3 por millón de tokens cuesta 1 TP4T0,30 por solicitud; si multiplicamos eso por miles de consultas diarias, los costos se disparan rápidamente.

El almacenamiento en caché de avisos proporciona ahorros significativos. OpenAI ofrece precios para entradas almacenadas en caché de 50% de los costos de entrada estándar. Según la documentación de precios de OpenAI, GPT-4.1 cobra $2.00 por millón de tokens de entrada, pero solo $0.50 por millón de tokens de entrada almacenados en caché.

Desglose de precios de los principales proveedores

El panorama competitivo incluye tres actores dominantes y varias alternativas emergentes. Cada proveedor ofrece múltiples niveles de modelos optimizados para diferentes casos de uso.

Estructura de precios de OpenAI

Los modelos GPT de OpenAI abarcan múltiples niveles de inteligencia y coste. Tal como se detalló en los debates de la comunidad en enero de 2026, los precios siguen evolucionando a medida que se lanzan nuevos modelos.

| Modelo | Entrada (por cada millón de tokens) | Entrada en caché (por 1M) | Salida (por cada millón de tokens) | Ventana de contexto |

|---|---|---|---|---|

| GPT-4.1 | $2.00 | $0.50 | $8.00 | 128K |

| GPT-4o | $2.50 | $1.25 | $10.00 | 128K |

| GPT-4-32k (obsoleto) | $60.00 | N / A | $120.00 | 32K |

OpenAI ha declarado obsoletos los modelos GPT-4-32k, con fecha de cierre prevista para el 6 de junio de 2025. Según la documentación de OpenAI sobre la obsolescencia, los usuarios existentes disponían de poco tiempo para migrar a modelos más recientes como GPT-4o.

La familia de modelos GPT-5.4 representa el último avance de OpenAI. Lanzado en marzo de 2026, GPT-5.4 mini estuvo disponible para los usuarios de Free and Go a través de la función "Thinking" de ChatGPT. Para los usuarios de pago, GPT-5.4 mini funciona como alternativa para GPT-5.4 Thinking en caso de límite de solicitudes.

Precios de Claude Antropológico

Los modelos Claude de Anthropic se han consolidado como fuertes competidores de OpenAI, especialmente en tareas de codificación y de inteligencia artificial. La compañía lanzó Claude Opus 4.6 en febrero de 2026 y Claude Sonnet 4.6 poco después.

Claude Opus 4.6 mantiene el precio de $5 por millón de tokens de entrada y $25 por millón de tokens de salida, a pesar de las importantes mejoras en sus capacidades. Según el anuncio de Anthropic, este precio permanece sin cambios con respecto a la versión anterior, Opus 4.5.

Claude Sonnet 4.6 ofrece precios más accesibles: $3 por millón de tokens de entrada y $15 por millón de tokens de salida, la misma tarifa que Sonnet 4.5. Anthropic describe Sonnet 4.6 como una solución que se acerca a la inteligencia de nivel Opus a un precio más práctico para las tareas cotidianas.

| Modelo | Entrada (por cada millón de tokens) | Salida (por cada millón de tokens) | Ventana de contexto | Mejor para |

|---|---|---|---|---|

| Claude Opus 4.6 | $5.00 | $25.00 | 1M (beta) | Razonamiento complejo, codificación, agentes |

| Soneto de Claude 4.6 | $3.00 | $15.00 | 1M (beta) | Rendimiento y coste equilibrados |

| Claude Opus 4.5 | $5.00 | $25.00 | 200 mil | Aplicaciones heredadas |

La ventana de contexto de 1 millón de tokens en Claude Opus 4.6 representa una novedad para los modelos de la clase Opus de Anthropic. Esta expansión permite gestionar bases de código completas o documentos extensos en una sola solicitud.

Precios de Google Gemini

Los modelos Gemini de Google compiten agresivamente en precio, especialmente para casos de uso de alto volumen. La familia Gemini incluye varios niveles optimizados para diferentes requisitos de rendimiento.

Las estructuras de precios de los modelos Gemini varían significativamente según el nivel y el volumen de uso. Google posiciona a Gemini como una alternativa rentable para aplicaciones que requieren un alto rendimiento sin pagar precios elevados.

Costos ocultos y mecanismos de fijación de precios

El precio anunciado por token solo cuenta una parte de la historia. Varios factores ocultos pueden aumentar drásticamente los costos reales.

Multiplicadores de tokens de salida

Los tokens de salida cuestan sistemáticamente entre 3 y 5 veces más que los tokens de entrada en todos los proveedores. Una aplicación que genera respuestas largas tendrá costes desproporcionadamente mayores que una que procesa entradas extensas pero genera salidas concisas.

Configurar el número máximo de tokens de salida (parámetro max_tokens) ayuda a controlar los costos. Si se establece en un valor demasiado bajo, las respuestas se interrumpen antes de completarse. Si se establece en un valor demasiado alto, el modelo puede generar contenido innecesario, especialmente en configuraciones de temperatura elevadas que fomentan la creatividad.

Límites de velocidad y costos de reserva

La mayoría de los proveedores implementan límites de velocidad basados en solicitudes por minuto, tokens por minuto o ambos. Cuando las aplicaciones alcanzan estos límites, fallan o recurren a modelos alternativos.

La implementación de GPT-5.4 de OpenAI ilustra este patrón. Según las notas de la versión del modelo de OpenAI de marzo de 2026, los usuarios de pago experimentan GPT-5.4 mini como alternativa cuando se alcanzan los límites de velocidad de GPT-5.4 Thinking. Esto mantiene la continuidad del servicio, pero potencialmente con estructuras de costos diferentes.

Ventana de contexto Economía

Las ventanas de contexto más grandes permiten aplicaciones más sofisticadas, pero aumentan los costos linealmente. Con una longitud de contexto de 128K tokens, la caché KV de LLama2-7B con precisión media alcanza los 64 GB, calculados como: num_layers × num_kv_head × head_dim × seqlen × sizeof(fp16) × 2.

Las investigaciones sobre la eficiencia de decodificación LLM indican que el tamaño de la caché KV crece linealmente con la longitud de la secuencia, lo que crea cuellos de botella de memoria durante la decodificación que se traducen en mayores costes operativos.

Consideraciones sobre precios empresariales

Las implementaciones empresariales se enfrentan a una situación económica diferente a la de los desarrolladores individuales o los equipos pequeños. Los descuentos por volumen, los precios personalizados y las opciones de implementación influyen significativamente en el coste total de propiedad.

API en la nube frente a implementación autohospedada

Las organizaciones pueden suscribirse a servicios comerciales de gestión del aprendizaje automático (LLM) o implementar modelos en su propia infraestructura. Un estudio publicado en arXiv que analiza la implementación local de LLM reveló que para alcanzar el punto de equilibrio con los servicios comerciales se requiere un análisis minucioso de los patrones de uso y los costos de la infraestructura.

El estudio definió cuatro criterios para la selección de modelos: paridad de rendimiento dentro del 20% con los principales modelos comerciales, compatibilidad operativa, requisitos de seguridad y rentabilidad a gran escala. Para aplicaciones de alto volumen, el autoalojamiento puede reducir los costos, pero la inversión inicial en infraestructura sigue siendo considerable.

Optimización de costos de arquitectura jerárquica

Investigaciones recientes de evaluación comparativa sobre arquitecturas LLM multiagente para el procesamiento de documentos financieros revelaron que las arquitecturas jerárquicas ofrecen la mejor relación costo-precisión. Estos sistemas lograron una precisión de arquitectura reflexiva del 97,71 TP3T con un costo del 60,91 TP3T.

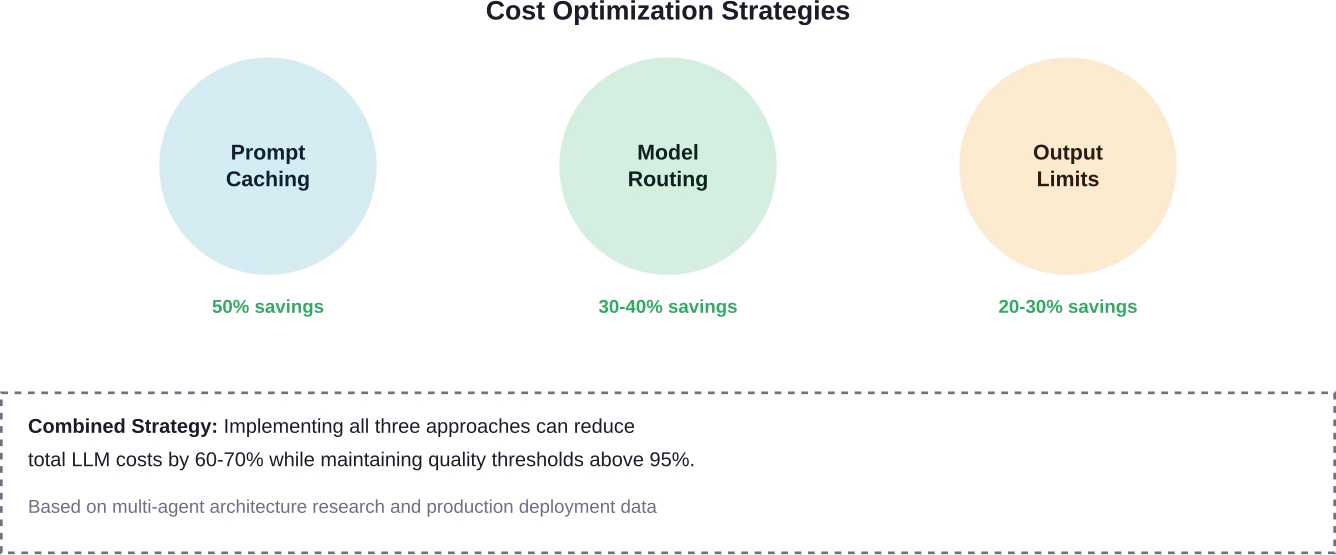

La investigación demostró que el almacenamiento en caché semántico, el enrutamiento basado en modelos y el procesamiento adaptativo pueden reducir significativamente los costos operativos sin sacrificar la calidad. Estas técnicas cobran cada vez más importancia a medida que las aplicaciones escalan a millones de solicitudes diarias.

Alternativas emergentes y precios regionales

Además de los tres principales proveedores, existen varias alternativas que ofrecen precios competitivos para casos de uso específicos.

DeepSeek y modelos de código abierto

DeepSeek ha llamado la atención por sus precios competitivos en modelos de alto rendimiento. La compañía se posiciona como una alternativa rentable para aplicaciones que no requieren un rendimiento de vanguardia.

Los modelos de código abierto implementados a través de proveedores de GPU en la nube como RunPod ofrecen otra alternativa. Estos servicios cobran por hora de GPU en lugar de por token, lo que hace que los costos sean más predecibles para aplicaciones de alto volumen.

Proveedores de modelos especializados

Mistral, la familia Llama de Meta y los modelos de NVIDIA se dirigen a nichos específicos. Según un análisis comparativo de modelos publicado en agosto de 2025, la selección del modelo debe tener en cuenta el propósito del diseño, las especificaciones técnicas y los casos de uso óptimos, más allá del precio.

El análisis subraya que los distintos modelos destacan en diferentes tareas. Elegir basándose únicamente en el menor coste suele dar lugar a malos resultados y a un reprocesamiento costoso.

Marco práctico para el cálculo de costes

Para estimar los costos reales, es necesario comprender los patrones de uso específicos de la aplicación. Los cuatro parámetros críticos son: promedio de tokens de entrada por solicitud, promedio de tokens de salida por solicitud, solicitudes esperadas por día y nivel de modelo seleccionado.

Un cálculo sencillo: (Tokens de entrada × Precio de entrada + Tokens de salida × Precio de salida) × Solicitudes diarias × 30 días = Coste mensual.

Por ejemplo, una aplicación que procesa 10.000 tokens de entrada y genera 2.000 tokens de salida por solicitud, ejecutando 1.000 solicitudes diarias en Claude Sonnet 4.6: (10.000 × $0,000003 + 2.000 × $0,000015) × 1.000 × 30 = $1.800 por mes.

En serio: la mayoría de las aplicaciones subestiman el uso real de tokens entre dos y tres veces durante las fases de planificación. Ajuste las estimaciones en consecuencia.

Consideraciones sobre el rendimiento y el precio

El modelo más económico rara vez ofrece la mejor relación calidad-precio. Según estudios que analizan la economía de la inferencia de IA, el "coste marginal" de la inferencia LLM varía significativamente en función de la eficiencia computacional y la arquitectura del modelo.

Estudios que analizaron la aproximación de consultas mediante modelos proxy ligeros demostraron que la selección estratégica de modelos puede lograr una reducción de costos y latencia de hasta 100 veces. La investigación mostró que los modelos proxy obtuvieron una precisión superior al 901% (TP3T) al tiempo que redujeron drásticamente los costos para tipos de consulta específicos.

La implementación local en hardware de consumo presenta otra opción. Un estudio que examinó la eficiencia de los modelos de lenguaje locales descubrió que estos pueden responder con precisión al 88,71% de las consultas de chat y razonamiento de un solo turno, aunque con importantes desventajas en cuanto a la latencia en comparación con las implementaciones en centros de datos.

Compromisos entre latencia y coste

Los modelos más rápidos suelen tener un coste mayor o requieren planes premium. Las aplicaciones con requisitos estrictos de latencia pueden necesitar aceptar costes por token más elevados para cumplir con los acuerdos de nivel de servicio (SLA) de rendimiento.

Las expectativas de latencia varían según el modelo y la implementación: los modelos insignia suelen ofrecer entre 20 y 40 tokens por segundo, los modelos de nivel medio alcanzan entre 40 y 80 tokens por segundo, y los modelos optimizados pueden superar los 100 tokens por segundo en infraestructura dedicada.

Compara los modelos cuidadosamente y construye en torno al más adecuado.

Comparar más de 15 modelos de aprendizaje automático (LLM) basándose únicamente en el precio rara vez ofrece una visión completa. El coste real reside en cómo se implementan los modelos: la calidad de los datos, la estrategia de ajuste fino y las decisiones sobre la infraestructura influyen en el coste final a largo plazo. IA superior Funciona a lo largo de todo el ciclo de vida, desde la preparación de datos y la selección de modelos hasta el entrenamiento, la optimización y la implementación, ayudando a los equipos a elegir y configurar modelos en función de casos de uso reales en lugar de basarse en precios superficiales.

En la práctica, esto suele significar evitar modelos excesivamente potentes donde no son necesarios, o combinar enfoques como el ajuste fino y las configuraciones híbridas en lugar de depender de un único modelo o API. El objetivo es construir sistemas que funcionen de manera eficiente en producción, no solo comparar puntos de referencia. Si está evaluando varios LLM y tratando de comprender cuánto costarán realmente en su uso, tiene sentido revisar su configuración con anticipación. Póngase en contacto con nosotros. IA superior para que la elección del modelo se ajuste al coste real, no solo al precio de lista.

Tendencias futuras en precios

Los precios de los másteres en Derecho (LLM) siguen evolucionando rápidamente. Varias tendencias claras surgieron a lo largo de 2025 y hasta 2026.

Las ventanas de contexto se expandieron drásticamente, mientras que los precios por token disminuyeron. Tanto Claude Opus 4.6 como Sonnet 4.6 ofrecen ventanas de contexto de 1 millón de tokens al mismo precio que los modelos anteriores de 200 000 tokens. Esto representa un aumento significativo en la capacidad de las ventanas de contexto sin un incremento proporcional en los costos.

Los ciclos de obsolescencia de los modelos se han acelerado. La obsolescencia de las variantes de GPT-4-32k por parte de OpenAI en un plazo de 12 a 18 meses tras su lanzamiento indica ciclos de iteración más rápidos. Las organizaciones deben planificar migraciones periódicas de modelos y los costes de desarrollo asociados.

La diferencia entre los modelos insignia y los de gama media se ha reducido. Según los anuncios de Anthropic, Claude Sonnet 4.6 ofrece una inteligencia similar a la de Opus a un precio 60% inferior. Esta optimización de capacidades en todos los rangos de precios beneficia a las implementaciones que buscan optimizar costos.

Preguntas frecuentes

¿Cuál es el máster en Derecho (LLM) más económico para uso en producción en 2026?

DeepSeek y Google Gemini ofrecen los costos por token más bajos entre los principales proveedores, pero lo más barato no siempre significa la mejor relación calidad-precio. El costo total depende de los requisitos de precisión, las necesidades de reprocesamiento y las demandas de la ventana de contexto. Para muchas aplicaciones, los modelos de nivel medio, como Claude Sonnet 4.6 a $3/$15 por millón de tokens, ofrecen una mejor rentabilidad general que los precios extremadamente bajos con resultados de menor calidad.

¿Cuánto ahorra realmente el almacenamiento en caché de indicaciones?

El modelo de precios de entrada en caché de OpenAI ofrece un ahorro de 50% en segmentos de solicitud repetidos. Para aplicaciones con solicitudes del sistema o documentos de referencia consistentes, esto se traduce en una reducción del costo total de 30 a 50%. El ahorro se multiplica de forma más significativa en aplicaciones que realizan miles de solicitudes similares con contexto compartido.

¿Deberían las empresas alojar sus propios sistemas LLM o utilizar API?

Los estudios sobre la rentabilidad de las implementaciones locales sugieren que para alcanzar el punto de equilibrio se requiere un uso constante de alto volumen y una infraestructura técnica adecuada. Las aplicaciones que procesan menos de 100 millones de tokens al mes suelen encontrar más económico el precio de las API. Por encima de ese umbral, el autoalojamiento se vuelve viable, pero hay que tener en cuenta los gastos generales de DevOps, las actualizaciones de modelos y los costes de gestión de la infraestructura, además de los gastos de computación.

¿Por qué los tokens de salida cuestan más que los tokens de entrada?

La generación requiere muchos más recursos computacionales que el procesamiento. Los tokens de entrada pasan por el modelo una sola vez para su codificación, mientras que cada token de salida requiere un recorrido completo hacia adelante para predecir el siguiente. Esto genera una diferencia computacional de 3 a 5 veces, lo cual se refleja en las estructuras de precios de todos los proveedores.

¿Cómo puedo estimar el uso de tokens para mi aplicación?

Utilice las herramientas de tokenización que ofrece cada proveedor de modelos para medir las solicitudes típicas. OpenAI, Anthropic y Google ofrecen API o herramientas web de tokenización. Realice pruebas con datos de muestra representativos, multiplique por el volumen de solicitudes previsto y añada un margen de seguridad de 50% para posibles variaciones. La mayoría de las estimaciones de planificación subestiman el uso real entre dos y tres veces.

¿Qué sucede cuando alcanzo los límites de uso?

La respuesta depende del proveedor y del nivel de suscripción. Algunas implementaciones ponen las solicitudes en cola, otras devuelven errores de límite de solicitudes que requieren reintentos, y los niveles premium pueden recurrir a modelos alternativos. El GPT-5.4 de OpenAI recurre al GPT-5.4 mini para usuarios de pago cuando se alcanzan los límites de solicitudes. Consulte la documentación específica del proveedor para obtener información sobre cómo gestionar los límites de solicitudes según su nivel de suscripción.

¿Existen descuentos por volumen para las API de LLM?

La mayoría de los proveedores ofrecen precios para empresas con descuentos por volumen, aunque las condiciones no se publican. Las organizaciones que procesan más de mil millones de tokens al mes deben contactar directamente con sus equipos de ventas. Los descuentos suelen oscilar entre 10 y 301 TP3T, según el nivel de compromiso y el volumen de uso. Anthropic, OpenAI y Google cuentan con programas de ventas para empresas con precios personalizados.

Conclusión

El panorama de precios de LLM sigue siendo complejo y evoluciona rápidamente. A marzo de 2026, los costos por token oscilan entre menos de $1 por millón y $25 por millón, dependiendo del nivel del modelo y el tipo de token.

La economía favorece la selección estratégica de modelos frente a la simple elección de la opción más barata. Claude Sonnet 4.6, a $3/$15 por millón de tokens, ofrece un rendimiento casi de gama alta para tareas cotidianas. GPT-4.1 de OpenAI, a $2/$8, proporciona un razonamiento general sólido a precios competitivos. Claude Opus 4.6 tiene un precio premium de $5/$25, pero es líder en tareas de codificación compleja y de agentes.

Los costos ocultos son tan importantes como el precio anunciado. El almacenamiento en caché de mensajes ahorra 50% en entradas repetidas. La gestión de tokens de salida evita el aumento desmesurado de costos por respuestas demasiado extensas. Las arquitecturas jerárquicas reducen los costos totales en 60% manteniendo la calidad.

Las organizaciones deben calcular el costo total de propiedad, incluyendo la gestión de límites de uso, los ciclos de obsolescencia del modelo y las necesidades de reprocesamiento relacionadas con la calidad. El precio por token más bajo suele generar el costo total más alto.

Comience por comparar cargas de trabajo representativas entre los modelos candidatos. Mida no solo la precisión, sino también el total de tokens consumidos por cada tarea completada con éxito. Considere los patrones de uso específicos, los requisitos de latencia y las necesidades de la ventana de contexto. Luego, tome una decisión informada basada en el valor real, no solo en el precio.