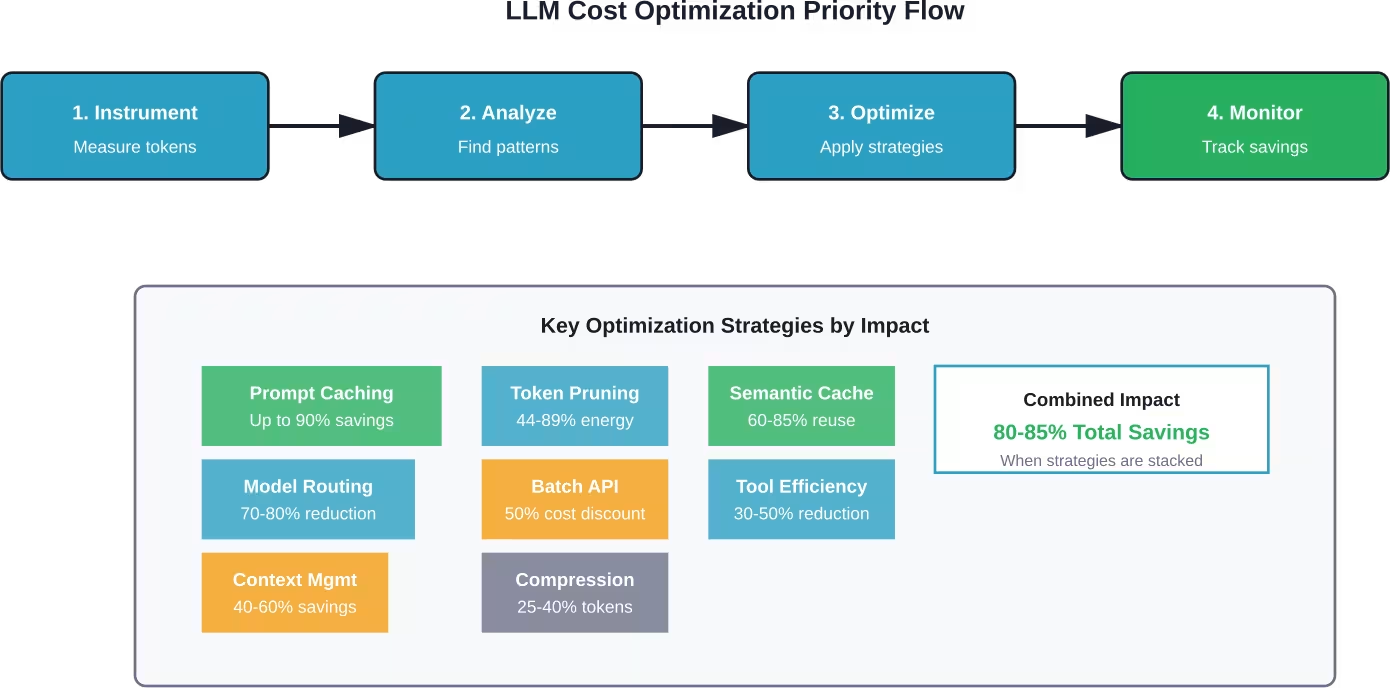

Resumen rápido: La optimización de costos de LLM en 2026 se centra en estrategias de orquestación inteligentes: el almacenamiento en caché instantáneo reduce los costos de repetición hasta en 90%, el enrutamiento híbrido SLM+LLM reduce los gastos entre 70 y 80%, y las técnicas eficientes en tokens, como la compresión de contexto, generan ahorros de entre 44 y 89%. La clave reside en medir primero el uso y luego aplicar optimizaciones específicas, como el almacenamiento en caché semántico, el procesamiento por lotes y la selección de modelos según la complejidad de la tarea, en lugar de recurrir por defecto a los costosos modelos de vanguardia.

Las implementaciones de LLM en producción ocultan un secreto inconfesable: muchas organizaciones consumen innecesariamente una cantidad considerable de tokens. El problema no reside únicamente en la selección del modelo, sino en la ausencia de una optimización sistemática a lo largo del proceso de inferencia.

Consideremos este escenario concreto basado en datos reales: un chatbot de soporte que gestiona 500 000 solicitudes mensuales a razón de 1500 tokens por solicitud consume aproximadamente 18 000 tokens al mes. Esto equivale a 216 000 tokens anuales para una sola función. Pero aquí es donde reside la clave: la misma carga de trabajo, optimizada con almacenamiento en caché, enrutamiento y gestión de contexto, se reduce a entre 27 000 y 50 000 tokens anuales.

¿La diferencia? Una gestión estratégica de costes que considera el consumo de tokens como una cuestión de ingeniería de primer orden, no como algo secundario.

La realidad de los costes operativos de los programas de máster en derecho (LLM) en 2026

Los costos de inferencia de LLM no escalan como los de la computación tradicional. Una sola llamada al modelo puede costar fracciones de centavo, pero si se multiplica por millones de solicitudes, la situación económica cambia drásticamente.

El sistema de precios basado en tokens implica que cada palabra cuenta. Los tokens de entrada (tus indicaciones) y los tokens de salida (las respuestas del modelo) tienen costos distintos. En Amazon Nova Micro, los tokens de entrada cuestan $0.000035 por cada mil, mientras que los de salida cuestan $0.00014 por cada mil, lo que representa una diferencia de aproximadamente cuatro veces. Para modelos más grandes como GPT-4, esta diferencia se amplía aún más.

En serio: la mayoría de los sobrecostos se deben a que los equipos no instrumentan sus sistemas correctamente. Sin visibilidad de los patrones de consumo de tokens, la optimización se convierte en una mera conjetura. Las investigaciones sobre el consumo de energía en la inferencia LLM demuestran que la decodificación (generación de salida) es el factor que más influye en los costos, y que la supresión de ruido genera ahorros de energía que van desde 44% hasta 89% sin afectar la precisión de la generación.

Dónde se ocultan los costes de un máster en derecho (LLM)

El recuento de fichas solo revela una parte del panorama. Los costos ocultos se acumulan en varias dimensiones:

- Procesamiento redundante: Las consultas idénticas o similares se reprocesan sin almacenamiento en caché.

- Contextos de gran tamaño: Enviar historiales de conversación completos cuando bastan los resúmenes.

- Selección de modelo incorrecta: Utilizar modelos frontera para tareas que los modelos más pequeños manejan bien

- Uso ineficiente de las herramientas: Esquemas de funciones detallados y llamadas a herramientas redundantes

- Mala preparación de lotes: Procesar las solicitudes individualmente en lugar de agruparlas cuando la latencia lo permita.

Cada ineficiencia se acumula. Un sistema que elige un modelo incorrecto, no almacena en caché y envía contextos sobredimensionados puede consumir fácilmente entre 5 y 10 veces más tokens que las alternativas optimizadas.

Medir antes de gestionar: Primero la instrumentación.

La estrategia de optimización de costes más eficaz comienza con la medición. Los equipos que instrumentan sus operaciones de gestión de riesgos antes de optimizar superan sistemáticamente a aquellos que aplican optimizaciones a ciegas.

La instrumentación adecuada captura múltiples dimensiones por solicitud:

| Métrico | Por qué es importante | Señal de optimización |

|---|---|---|

| Número de tokens de entrada | Factor de costo directo | Exceso de contexto, indicaciones ineficientes |

| Recuento de tokens de salida | Suele ser entre 2 y 4 veces más caro. | Respuestas verbosas, balbuceos |

| Modelo utilizado | Diferentes niveles de precios | Oportunidades de sobreaprovisionamiento |

| Estado latente | Impacto en la experiencia del usuario | Candidatos de almacenamiento en caché |

| Tasa de aciertos de caché | Coste real evitado | eficacia del almacenamiento en caché |

| metadatos de atribución | Asignación de costos | Usuarios/funciones de alto costo |

La atribución es más importante de lo que la mayoría de los equipos creen. Etiquetar las solicitudes con project_id, team_id, environment y feature flags permite un análisis de costos detallado. ¿Ese chatbot de $18 000 al mes? La instrumentación podría revelar que 70% de costos provienen de 15% de usuarios, lo que abre oportunidades de optimización específicas.

Creación de un sistema de seguimiento de costes

La infraestructura de gestión de costes no tiene por qué ser compleja. Un sistema mínimo viable incluye:

- Marca de tiempo e ID de solicitud para correlación

- Identificador del modelo y proveedor

- Recuento de tokens (entrada, salida, en caché)

- Coste calculado en moneda consistente

- Etiquetas de atribución (usuario, característica, entorno)

- Métricas de calidad de respuesta cuando estén disponibles

Almacene estos datos en una base de datos de series temporales o un almacén de datos que admita consultas de agregación. Los paneles de costos diarios deben mostrar las tendencias por modelo, función y segmento de usuario. Las revisiones semanales permiten identificar oportunidades de optimización antes de que se conviertan en crisis presupuestarias.

Almacenamiento en caché de mensajes: la solución más eficaz para obtener resultados rápidos.

El almacenamiento en caché de indicaciones proporciona la mayor reducción de costos para la mayoría de las cargas de trabajo de producción. El mecanismo es sencillo: proveedores como Anthropic y OpenAI almacenan en caché las matrices clave-valor de los cálculos de atención para los prefijos de las indicaciones. Cuando las solicitudes posteriores comparten ese prefijo, las partes almacenadas en caché cuestan 90% menos.

En Amazon Bedrock, el almacenamiento en caché de solicitudes reduce la latencia de respuesta de inferencia hasta en 85% y los costos de tokens de entrada hasta en 90%. Los cálculos son convincentes: una solicitud de 10 000 tokens que cuesta $0,30 por solicitud se reduce a $0,03 cuando se almacena en caché, lo que supone un ahorro de $0,27 por acceso.

Pero la eficacia del almacenamiento en caché depende totalmente de los patrones de solicitud. Una alta tasa de aciertos en la caché requiere estructuras de solicitud estables con contenido variable insertado en posiciones predecibles.

Diseño de mensajes de aviso optimizados para caché

La optimización de la caché comienza con una arquitectura de solicitudes. El contenido estático (instrucciones del sistema, ejemplos sencillos, referencias a la documentación) se coloca al principio. El contenido variable, como las consultas de los usuarios y los datos específicos de la sesión, se coloca al final.

Estructura deficiente:

Consulta del usuario: [VARIABLE]

Instrucciones del sistema: [STATIC 5000 tokens]

Ejemplos: [STATIC 3000 tokens]

Estructura optimizada:

Instrucciones del sistema: [STATIC 5000 tokens]

Ejemplos: [STATIC 3000 tokens]

Consulta del usuario: [VARIABLE]

El segundo método almacena en caché 8000 tokens por solicitud. Con precios típicos, una carga de trabajo con una tasa de aciertos de caché de 80% reduce los costos en 72% en comparación con la ausencia de almacenamiento en caché.

Las políticas de eliminación de caché varían según el proveedor. La caché de Anthropic caduca tras 5 minutos de inactividad. Para cargas de trabajo sostenidas, mantener cachés activas con solicitudes periódicas puede resultar beneficioso si el volumen de solicitudes lo justifica.

Cuando el almacenamiento en caché da sus frutos

No todas las cargas de trabajo se benefician por igual del almacenamiento en caché. Calcule el ahorro previsto:

Tasa de aciertos de caché de equilibrio = Coste de escritura en caché / (Coste sin caché – Coste con caché)

Para solicitudes de menos de 1000 tokens, la sobrecarga de la caché suele superar el ahorro, a menos que las tasas de aciertos superen el 85-90%. Los puntos óptimos se presentan con:

- Grandes contextos estáticos (documentación, bases de conocimiento)

- Instrucciones del sistema repetidas en diferentes solicitudes

- Ejemplos de pocas tomas en cada consigna

- Historiales de conversación con mensajes nuevos añadidos

Un chatbot de documentación con un contexto de 15 000 tokens y consultas de 500 palabras se beneficia enormemente. ¿Un asistente de escritura creativa que genere historias únicas cada vez? Probablemente no.

Almacenamiento en caché semántico: Más allá de las coincidencias exactas

El almacenamiento en caché tradicional requiere entradas idénticas. El almacenamiento en caché semántico reconoce que las preguntas "¿Cómo restablezco mi contraseña?" y "¿Cuál es el proceso para recuperar la contraseña?" merecen la misma respuesta almacenada en caché.

La implementación utiliza incrustaciones vectoriales para medir la similitud de las consultas. Cada solicitud genera una incrustación (normalmente de 100 a 300 dimensiones), que se compara con las incrustaciones almacenadas en caché mediante la similitud del coseno u otras métricas de distancia. Cuando la similitud supera un umbral (generalmente de 0,85 a 0,95), se devuelve la respuesta almacenada en caché en lugar de invocar el LLM.

El almacenamiento en caché semántico opera en una capa diferente a la del almacenamiento en caché de solicitudes del proveedor. El almacenamiento en caché de solicitudes reduce los costos de los tokens de entrada para los aciertos de caché, pero aún así invoca al modelo. El almacenamiento en caché semántico evita por completo la llamada al modelo, eliminando tanto los costos de entrada como de salida, además de la latencia.

Creación de una capa de caché semántica

El almacenamiento en caché semántico eficaz requiere varios componentes:

- Modelo de incrustación: Ligero y rápido (Sentence-BERT, MiniLM)

- Base de datos de vectores: Redis, Pinecone, Qdrant o similares para búsqueda de similitud

- Generación de claves de caché: Combinación de filtros de similitud de incrustación y metadatos

- Ajuste del umbral de similitud: Equilibrio entre la tasa de aciertos de la caché y la relevancia de la respuesta.

- Políticas TTL: Caducidad para contenido con fecha de caducidad

El umbral de similitud es crucial. Si es demasiado alto (0,98 o superior), la tasa de aciertos de la caché disminuye innecesariamente. Si es demasiado bajo (0,80 o inferior), las respuestas irrelevantes almacenadas en caché degradan la calidad. Comience con 0,90 y ajústelo según la revisión manual de los casos límite.

El filtrado de metadatos evita coincidencias de caché inapropiadas. Una pregunta sobre el precio del producto A no debería devolver respuestas almacenadas en caché sobre el precio del producto B, incluso con una alta similitud semántica. Etiquete las entradas almacenadas en caché con atributos relevantes (producto, segmento de usuario, rango de fechas) y exija coincidencias de metadatos además de la similitud semántica.

Enrutamiento híbrido SLM + LLM: Adaptación de modelos a tareas

La falacia del modelo frontera presupone que los modelos más grandes siempre rinden mejor. La realidad es más compleja. Los modelos de lenguaje pequeños (SLM, por sus siglas en inglés) con entre 7 y 9 mil millones de parámetros gestionan muchas tareas de producción a un coste entre 10 y 50 veces menor que las alternativas con más de 70 mil millones de parámetros.

Las investigaciones sobre la gestión de LLM demuestran que incluso las sugerencias que comprenden entre 10 y 30% de la respuesta completa de LLM mejoran significativamente la precisión de SLM, con rendimientos decrecientes a partir de 60%. Este enfoque puede utilizarse en arquitecturas híbridas donde los SLM gestionan la mayor parte del trabajo y los LLM proporcionan asistencia específica cuando es necesario.

La orquestación híbrida puede enrutar las solicitudes en función de su complejidad, de modo que las tareas sencillas pueden dirigirse a los SLM (modelos de lógica de negocio) y el razonamiento complejo puede escalarse a modelos más grandes.

Implementación de enrutamiento inteligente

El enrutamiento eficaz requiere una capa de clasificación que prediga la complejidad de la tarea antes de invocar los modelos. Existen varios enfoques que funcionan:

| Estrategia de enrutamiento | Complejidad | Exactitud | Impacto en los costos |

|---|---|---|---|

| Basado en reglas | Bajo | Moderado | Reducción de 60-70% |

| Coincidencia de palabras clave | Bajo | Moderado | Reducción de 50-65% |

| Modelo clasificador | Medio | Alto | Reducción de 70-80% |

| Puntuación de confianza | Alto | Muy alto | Reducción de 75-85% |

| Cascada con respaldo | Medio | Muy alto | Reducción de 65-80% |

El enrutamiento basado en reglas resulta ser el más sencillo: "Las preguntas con menos de 20 tokens van a SLM, las de más de 100 tokens a LLM". Esto funciona para distinciones claras, pero no capta los matices.

Los modelos de clasificación se entrenan con datos históricos etiquetados con la complejidad real. Las características incluyen la longitud de la consulta, la diversidad del vocabulario, la presencia de palabras clave específicas y el rendimiento anterior del modelo en consultas similares. Los clasificadores ligeros (100-300 millones de parámetros) añaden una latencia mínima a la vez que mejoran la precisión del enrutamiento.

La puntuación de confianza adopta un enfoque diferente: siempre se intenta primero con el SLM, se verifican los niveles de confianza en la respuesta y solo se recurre al LLM cuando la confianza cae por debajo del umbral. Este enrutamiento optimista minimiza las llamadas innecesarias al LLM sin comprometer la calidad.

El patrón en cascada

El enrutamiento en cascada combina la validación. Cada solicitud comienza en el modelo más pequeño y capaz. Si la respuesta de ese modelo cumple con los umbrales de calidad, se devuelve. De lo contrario, se pasa al siguiente modelo más grande.

Los umbrales de calidad podrían incluir:

- Puntuaciones de confianza del propio modelo

- Validación de formato (JSON correctamente estructurado, oraciones completas)

- Requisitos de extensión (número mínimo de palabras)

- Comprobaciones de coherencia semántica

Las investigaciones sobre los marcos de trabajo Pyramid MoA demuestran que los sistemas en cascada igualan la precisión de referencia de Oracle de 68,1%, al tiempo que permiten un ahorro computacional de hasta 18,4%. El enrutador transfiere datos de prueba sin errores a puntos de referencia desconocidos, manteniendo la robustez en diferentes tipos de tareas.

¿La desventaja? La latencia. El enrutamiento en cascada añade el coste de tiempo de los intentos fallidos. Para aplicaciones sensibles a la latencia, el enrutamiento inicial con un modelo clasificador ofrece un mejor rendimiento que el enrutamiento en cascada con validación.

Gestión del contexto y compresión

Las ventanas de contexto se expanden constantemente (128 000, 200 000, incluso 1 millón de tokens), pero más grande no siempre es mejor. Cada token en tu contexto tiene un costo de entrada e influye en los costos de generación de salida. Los contextos sobrecargados consumen presupuestos sin mejorar los resultados.

Una gestión eficaz del contexto equilibra la exhaustividad de la información con la economía de tokens. El objetivo: incluir suficiente contexto para obtener respuestas precisas, excluyendo al mismo tiempo la información redundante o irrelevante.

Técnicas de compresión de contexto

Las investigaciones sobre la compresión de la esencia de las frases anclada a oraciones demuestran que los modelos LLM preentrenados se pueden ajustar para comprimir contextos entre 2 y 8 veces sin una degradación significativa del rendimiento.

Las estrategias prácticas de compresión incluyen:

- Resumen: Condensar documentos extensos o historiales de conversaciones en resúmenes.

- Extracción: Extraer fragmentos relevantes en lugar de incluir documentos completos.

- Poda: Eliminar información redundante de contextos repetidos

- Contexto jerárquico: Proporcionar resúmenes de alto nivel; los detalles estarán disponibles bajo petición.

El historial de conversaciones es un objetivo común de compresión. En lugar de enviar 50 pares de mensajes (100 mensajes en total), se resumen los intercambios más antiguos y se incluyen solo los mensajes recientes tal cual. Esto suele reducir el contexto entre 60 y 801 TP3T con una pérdida mínima de información.

Los flujos de trabajo de recuperación de documentos se benefician de la extracción en lugar de la inclusión. En vez de insertar 10 páginas completas de documentación (15 000 tokens), se extraen secciones relevantes que suman entre 2000 y 3000 tokens. Las arquitecturas de generación aumentada para la recuperación (RAG) son ideales en este caso, ya que utilizan la similitud vectorial para identificar pasajes pertinentes.

Contextos de ventana deslizante

Para conversaciones continuas o tareas de monitorización, las ventanas deslizantes mantienen contextos de tamaño fijo descartando la información antigua a medida que llega información nueva. El tamaño de la ventana equilibra la preservación del contexto con el coste.

La implementación realiza un seguimiento del recuento de tokens en todos los elementos de contexto:

- Instrucciones del sistema: Asignación fija (por ejemplo, 1000 tokens)

- Mensajes recientes: Asignación variable (por ejemplo, últimos 10 intercambios, ~3000 tokens)

- Resumen del contexto anterior: Asignación fija (por ejemplo, 500 tokens)

- Consulta actual: Variable (entrada del usuario)

Cuando el contexto total supera los límites, se regenera el resumen para incorporar los mensajes recientes más antiguos y, a continuación, se descartan dichos mensajes. Esto mantiene la continuidad del contexto a la vez que limita el consumo de tokens.

Uso eficiente de herramientas y llamadas a funciones mediante tokens

La llamada a funciones LLM permite interacciones estructuradas con sistemas externos, pero las definiciones de herramientas consumen un contexto significativo. Una API compleja con 20 funciones disponibles podría requerir entre 5000 y 8000 tokens solo para describir dichas funciones, antes incluso de que se realice cualquier trabajo real.

El uso eficiente de herramientas mediante tokens optimiza tanto las definiciones de las herramientas como los patrones de llamada para minimizar la sobrecarga manteniendo la funcionalidad.

Esquemas de herramientas de optimización

Las definiciones de funciones siguen el formato JSON Schema, que puede resultar muy extenso. Considere este ejemplo recargado:

{

“nombre”: “obtener_información_del_usuario”,

“descripción”: “Esta función recupera información completa del usuario de la base de datos, incluyendo datos personales, estado de la cuenta, preferencias e historial.”,

“parámetros”: {

“tipo”: “objeto”,

“"propiedades": {

“identificador_de_usuario”: {

“tipo”: “cadena”,

“descripción”: “El identificador único del usuario, que puede ser su nombre de usuario o su dirección de correo electrónico”.”

}

}

}

}

Versión comprimida:

{

“nombre”: “obtener_usuario”,

“descripción”: “Obtener detalles del usuario por nombre de usuario o correo electrónico”,

“parámetros”: {

“tipo”: “objeto”,

“"propiedades": {

“id”: {“type”: “string”, “description”: “Nombre de usuario/correo electrónico”}

}

}

}

La versión comprimida reduce los tokens en 60% manteniendo la funcionalidad. Aplique estos principios:

- Nombres de funciones más cortos cuando no haya ambigüedad

- Descripciones concisas (máximo 10-15 palabras)

- Nombres de parámetros abreviados

- Descripciones mínimas de parámetros

- Eliminar parámetros opcionales poco utilizados

Aprovisionamiento dinámico de herramientas

En lugar de proporcionar todas las herramientas disponibles en cada solicitud, se asignan herramientas en función del análisis de la consulta. Una pregunta sobre "cuentas de usuario" carga las herramientas de gestión de usuarios; una pregunta sobre "inventario de productos" carga las herramientas de inventario.

Esto requiere una capa de selección de herramientas antes de la llamada principal a LLM:

- Analizar la consulta con un clasificador ligero

- Asignar categorías de consulta a conjuntos de herramientas relevantes

- Incluya únicamente las herramientas aplicables en contexto.

- Proceso con el LLM principal

Para aplicaciones con más de 50 herramientas disponibles, el aprovisionamiento dinámico reduce la sobrecarga de definición de herramientas de 15.000 tokens a entre 2.000 y 4.000 tokens, lo que supone una reducción de 80% en el consumo de contexto relacionado con las herramientas.

Procesamiento por lotes para cargas de trabajo no urgentes

La API Batch de OpenAI y ofertas similares de otros proveedores ofrecen descuentos de costos 50% para el procesamiento asíncrono. La desventaja es la latencia: las solicitudes por lotes se completan en 24 horas en lugar de segundos.

El procesamiento por lotes tiene sentido para:

- Análisis y elaboración de informes fuera de línea

- Generación de contenido masivo

- Etiquetado y anotación de datos

- Trabajos de resumen nocturno

- Evaluación y prueba del modelo

No funciona para:

- Interfaces de chat orientadas al usuario

- Sistemas de decisión en tiempo real

- Alertas urgentes

- Aplicaciones interactivas

La clasificación de la carga de trabajo determina la idoneidad del procesamiento por lotes. Un motor de recomendación de contenido podría generar recomendaciones en lotes durante la noche y luego servirlas desde la caché durante el día. Este enfoque híbrido aprovecha los descuentos por procesamiento por lotes sin sacrificar la experiencia del usuario.

Implementación de flujos de trabajo por lotes

El procesamiento por lotes eficaz requiere la orquestación del flujo de trabajo:

- Fase de recolección: Acumule solicitudes que puedan tolerar un procesamiento demorado.

- Envío por lotes: Empaquetar las solicitudes y enviarlas a la API por lotes.

- Monitoreo de estado: Realizar un seguimiento del progreso de los lotes y gestionar los fallos.

- Procesamiento de resultados: Recuperar los resultados completados y actualizar los sistemas.

- Población de la caché: Almacenar resultados para una recuperación rápida.

La optimización del tamaño de los lotes es importante. Los lotes más grandes amortizan los costos fijos, pero aumentan el riesgo de fallos y los costos de reintento. Los lotes más pequeños se completan más rápido, pero multiplican las llamadas a la API. El rango óptimo suele estar entre 100 y 1000 solicitudes por lote, dependiendo de la complejidad de cada solicitud.

Estrategia de selección de modelos: dimensionamiento adecuado de la inteligencia

La selección del modelo representa uno de los factores de coste más influyentes. Los precios varían drásticamente entre los distintos niveles de modelos, pero muchas aplicaciones utilizan por defecto los modelos premium para todas las tareas.

| Clase modelo | Parámetros | Coste típico por millón de tokens | Mejor para |

|---|---|---|---|

| Micromodelos | 1-3B | $50-100 | Clasificación, extracción, enrutamiento |

| Modelos pequeños | 7-9B | $100-300 | Preguntas y respuestas sencillas, generación de plantillas |

| Modelos medianos | 30-40B | $500-1,000 | Razonamiento complejo, tareas técnicas |

| Modelos grandes | 70B+ | $2,000-5,000 | Razonamiento avanzado, trabajo creativo |

| Modelos de frontera | 400B+ | $10,000-30,000 | Investigación, las tareas más difíciles |

Amazon Nova Micro ilustra este espectro de precios: $0.035 por millón de tokens de entrada, aproximadamente 100 veces más barato que las alternativas de vanguardia. Para las tareas dentro de su rango de capacidad, Nova Micro ofrece enormes ventajas en cuanto a costos.

La estrategia consiste en adaptar la capacidad del modelo a la dificultad de la tarea. Las tareas de clasificación no requieren modelos con una gran capacidad de razonamiento. Las consultas y respuestas sencillas sobre datos estructurados funcionan bien con modelos pequeños. Reserve los modelos más complejos para problemas realmente difíciles.

Pruebas de modelos progresivos

Al implementar nuevas funciones, realice pruebas progresivamente desde los modelos más pequeños hasta los más grandes:

- Comience con el modelo más pequeño que pueda funcionar.

- Medir las métricas de calidad en función de los requisitos

- Si la calidad es insuficiente, suba un nivel.

- Repita el proceso hasta que se cumplan los requisitos de calidad.

- Utilice ese nivel de modelo en producción.

Esto evita el sobredimensionamiento. Los equipos suelen asumir que las tareas complejas requieren modelos de vanguardia, para luego descubrir que los modelos con 30 mil millones de parámetros funcionan adecuadamente. Esta suposición cuesta entre 10 y 20 veces más de lo que revelarían las pruebas.

Monitoreo, alertas y control de costos

La optimización de costes no es un proyecto puntual; requiere supervisión y gobernanza continuas. Los sistemas de producción se desfasan con el tiempo a medida que evolucionan los patrones de uso y se lanzan nuevas funcionalidades.

Métricas de costos esenciales

Realice un seguimiento diario o semanal de estas métricas:

- Coste total: Gasto total en todas las operaciones de LLM

- Coste por solicitud: Costo promedio para operaciones individuales

- Coste por modelo: Desglose del gasto por niveles de modelo

- Coste por característica: Atribución a las capacidades del producto

- Índice de eficiencia del token: Tokens de salida / tokens de entrada

- Tasa de aciertos de caché: Porcentaje de solicitudes atendidas desde la caché

- Distribución del enrutamiento del modelo: Porcentaje de solicitudes por nivel de modelo

Configura alertas para anomalías:

- El gasto diario supera los 150% del promedio móvil de 7 días.

- El costo por solicitud aumenta más de 50% semana tras semana.

- La tasa de aciertos de la caché cae por debajo del nivel de referencia histórico.

- Un solo usuario/función consume más de 20% del presupuesto diario.

Las alertas permiten una respuesta rápida ante los aumentos repentinos de costes antes de que se conviertan en crisis presupuestarias.

Asignación de costos y contracargos

Para organizaciones con varios equipos o productos que comparten infraestructura LLM, la asignación de costos genera responsabilidad. Etiquete cada solicitud con metadatos de atribución:

- Equipo o unidad de negocio

- Producto o característica

- Entorno (producción, puesta en escena, desarrollo)

- Segmento de usuarios (gratuitos, premium, empresariales)

Genera informes de costos semanales que muestren el gasto por dimensión. Los equipos que pueden visualizar sus patrones de consumo toman decisiones de optimización más acertadas que aquellos que operan sin esa visibilidad.

Los reembolsos —que consisten en facturar a los equipos internos por el uso que hacen del LLM— generan mayores incentivos para la eficiencia. Cuando el costo aparece como una partida específica en los presupuestos de los equipos, en lugar de un gasto general compartido, la optimización se convierte en una prioridad.

Optimización avanzada: cuantización y ajuste fino

Más allá de las optimizaciones operativas, las técnicas a nivel de modelo ofrecen una reducción de costes adicional para las implementaciones autogestionadas.

Cuantización

La cuantización reduce la precisión del modelo de punto flotante de 16 o 32 bits a enteros de 8 o 4 bits. Esto reduce los requisitos de memoria y acelera la inferencia, introduciendo una degradación mínima de la calidad si se realiza con cuidado.

Según fuentes de Hugging Face, la poda puede reducir significativamente el tamaño del modelo (a menudo entre 80 y 90%) con una mínima degradación del rendimiento si se realiza con cuidado. Con una dispersión de 50%, WiSparse conserva 97% del rendimiento del modelo denso de Llama3.1.

Para implementaciones autogestionadas, la cuantización puede reducir significativamente los requisitos de memoria. Los requisitos de memoria específicos del modelo dependen del número de parámetros y del nivel de precisión, lo que permite la implementación en hardware más económico o el procesamiento de más solicitudes por GPU.

Es importante considerar las ventajas y desventajas. La cuantización agresiva (2 bits, 1 bit) degrada la calidad notablemente. La cuantización conservadora (8 bits) conserva la calidad, pero reduce el ahorro. La mayoría de las implementaciones en producción buscan los 4 bits como el punto óptimo.

Optimización para lograr la máxima eficiencia

Los modelos optimizados pueden ser más pequeños y económicos, manteniendo el mismo rendimiento para dominios específicos. Un modelo de 70 mil millones de parámetros de propósito general podría reemplazarse por un modelo optimizado de 7 mil millones para aplicaciones específicas.

El ajuste fino requiere:

- Datos de entrenamiento de alta calidad (cientos o miles de ejemplos)

- Recursos informáticos para el entrenamiento (GPU, de horas a días)

- Infraestructura de evaluación para validar la calidad

- Mantenimiento continuo a medida que evolucionan los requisitos.

La economía favorece el ajuste fino cuando:

- El volumen de solicitudes es muy alto (millones al mes).

- Los requisitos de la tarea son estables.

- La calidad del rendimiento se puede medir rigurosamente.

- Existe infraestructura para el alojamiento de modelos.

En el caso de los flujos de trabajo basados en API, los costes de optimización superan los ahorros hasta que el volumen mensual de solicitudes alcanza los cientos de miles o millones de llamadas.

El conjunto de herramientas de optimización de costos para 2026

La gestión eficaz de costes de los másteres en Derecho (LLM) en 2026 combina múltiples estrategias en una arquitectura coherente. Ninguna técnica por sí sola resuelve todos los problemas; los mejores resultados se obtienen al combinar enfoques complementarios.

Un conjunto de herramientas de optimización de nivel de producción incluye:

- Capa base: La estrategia de selección de modelos garantiza que las tareas utilicen modelos del tamaño adecuado por defecto.

- Capa de almacenamiento en caché: Tanto el almacenamiento en caché de mensajes instantáneos como el almacenamiento en caché semántico interceptan el trabajo redundante antes de que llegue a los modelos.

- Capa de enrutamiento: La orquestación inteligente dirige las solicitudes al modelo más rentable capaz de gestionarlas.

- Capa de optimización: La compresión del contexto, la eficiencia de los tokens y la gestión de la salida minimizan el desperdicio en las solicitudes que llegan a los modelos.

- Capa de carga de trabajo: El procesamiento por lotes y los patrones asíncronos permiten obtener descuentos por trabajos no urgentes.

- Capa de gobernanza: El monitoreo, la atribución y las alertas mantienen las optimizaciones a lo largo del tiempo y evitan la variación de costos.

Cada capa contribuye de forma independiente, pero los efectos combinados se multiplican. Un sistema que utiliza las seis capas logra una reducción de costos de entre 80 y 85 TP3T en comparación con implementaciones simples, transformando un gasto anual de 1 TP4T216 000 en 1 TP4T30 000-1 TP4T40 000 manteniendo o mejorando la calidad.

Reduzca los costos de LLM desde el principio: configure correctamente antes de escalar.

La mayoría de los problemas de costes en los proyectos LLM provienen de la configuración de los sistemas, no solo de su uso. Los flujos de datos ineficientes, los modelos sobredimensionados y las indicaciones no optimizadas pueden aumentar los costes silenciosamente mucho antes de que comience la escalabilidad. IA superior Trabaja a lo largo de todo el ciclo de vida, desde la preparación de datos y el diseño del modelo hasta el entrenamiento, el ajuste fino y la implementación, lo que ayuda a los equipos a eliminar estas ineficiencias cuanto antes, en lugar de reaccionar más tarde.

El objetivo es lograr que los modelos sean utilizables en producción sin costos adicionales innecesarios, ya sea ajustando el tamaño del modelo, refinando los flujos de trabajo o replanteando cuándo depender de API externas en lugar de configuraciones personalizadas. Esto se vuelve fundamental una vez que aumenta el uso, donde las pequeñas ineficiencias se convierten en gastos reales. Si está intentando reducir los costos de LLM de manera práctica, vale la pena revisar su configuración antes de escalar aún más. Póngase en contacto con nosotros. IA superior para identificar dónde se pueden reducir realmente los costes.

Errores comunes que se deben evitar

Los intentos de optimización de costes suelen fracasar debido a errores previsibles. Evitarlos acelera el éxito.

Optimización sin medición

El modo de fallo más común: implementar optimizaciones sin medir su impacto. Los equipos implementan el almacenamiento en caché, dan por sentado que funciona y no se dan cuenta de que las tasas de aciertos de caché rondan los 20% en lugar de los 80% esperados.

La medición debe preceder a la optimización. De lo contrario, los esfuerzos se centrarán en áreas con un impacto mínimo, mientras que los factores que generan altos costos quedarán sin abordar.

Optimización excesiva de la latencia

Existe un compromiso entre latencia y costo. El almacenamiento en caché agresivo reduce los costos, pero aumenta la latencia de búsqueda en caché. El enrutamiento en cascada ahorra dinero, pero incrementa los retrasos por intentos fallidos. El procesamiento por lotes ofrece grandes descuentos, pero elimina la respuesta en tiempo real.

No todos los milisegundos importan por igual. Una interfaz de chat para clientes requiere tiempos de respuesta inferiores a un segundo. Un generador de informes nocturno puede tolerar minutos. Adapta las estrategias de optimización a los requisitos reales de latencia en lugar de optimizarlo todo para la velocidad.

Descuidar el control de calidad

La optimización de costos no debería degradar la calidad de la salida, pero las técnicas agresivas a veces sí lo hacen. Una compresión excesivamente agresiva provoca la pérdida de contexto crítico. El almacenamiento en caché semántico con umbrales de similitud demasiado laxos puede devolver respuestas que no se ajustan a la intención de la consulta. El enrutamiento a modelos más pequeños reduce la capacidad.

El control de calidad debe ir de la mano del control de costes. Realice un seguimiento de métricas como:

- puntuaciones de satisfacción del usuario

- Tasas de finalización de tareas

- Tasas de error y reintentos

- Revisión manual de los resultados de muestra

Cuando la optimización de costes perjudica la calidad, la optimización fracasa independientemente de los ahorros conseguidos.

Ignorar los costos ocultos

Los costes de los tokens representan el gasto obvio, pero los costes ocultos se acumulan:

- Infraestructura de optimización del tiempo de ingeniería para la construcción y el mantenimiento

- Costes de infraestructura para capas de almacenamiento en caché y sistemas de monitorización

- Mayor complejidad y dificultad para la depuración

- Costo de oportunidad de la atención del equipo en el costo en lugar de en las características

Calcule el ROI real incluyendo estos factores. Un sistema de almacenamiento en caché que ahorra $500 al mes, pero que requiere $300 en infraestructura y 20 horas de ingeniería para su mantenimiento, ofrece un valor cuestionable.

Preguntas frecuentes

¿Cuál es la optimización de costes de LLM con mayor impacto para la mayoría de las aplicaciones?

El almacenamiento en caché de las indicaciones suele tener el mayor impacto inmediato en aplicaciones con estructuras de indicaciones estables. Cuando es aplicable, el almacenamiento en caché puede reducir los costos de los tokens de entrada en 90% y la latencia en 85%. Su implementación es sencilla: basta con reestructurar las indicaciones para priorizar el contenido estático, y no requiere una infraestructura compleja. La mayoría de las aplicaciones de producción con documentación, ejemplos o instrucciones repetidas en las indicaciones se benefician significativamente.

¿Cómo puedo saber si mi tasa de aciertos de caché es lo suficientemente buena?

Las tasas de aciertos de caché superiores a 60% pueden generar ahorros significativos con el almacenamiento en caché de avisos. El almacenamiento en caché semántico requiere tasas más altas (normalmente entre 70 y 80%) debido a que su implementación es más costosa. Calcule el ahorro esperado: (tasa de aciertos × ahorro de caché) – costos de caché. Si esta cifra supera una reducción neta de 40-50%, el almacenamiento en caché resulta rentable. Supervise las tasas de aciertos semanalmente; las caídas indican cambios en la estructura de los avisos o en los patrones de consulta que requieren atención.

¿Debo usar SLM o LLM para tareas de clasificación?

Las tareas de clasificación casi siempre se benefician de modelos más pequeños. Los estudios demuestran que los modelos de 7 a 9 mil millones de parámetros alcanzan una precisión de entre el 85 % y el 95 % de los modelos grandes en la clasificación, con un coste entre 10 y 50 veces menor. Pruebe su tarea de clasificación específica: recopile entre 100 y 200 ejemplos etiquetados, evalúe modelos pequeños y grandes, y compare su precisión. A menos que la diferencia de precisión supere los 5-10 puntos porcentuales, elija el modelo más pequeño.

¿Cuándo resulta más rentable ajustar un modelo con precisión que utilizar modelos más grandes?

El ajuste fino resulta económico cuando el volumen mensual de solicitudes supera los cientos de miles de llamadas y los requisitos de las tareas se mantienen estables. Los costos de entrenamiento oscilan entre $500 y 5000, dependiendo del tamaño del modelo y el volumen de datos. Si un modelo 7B ajustado reemplaza una API 70B con un costo de inferencia 30 veces menor, el punto de equilibrio se alcanza alrededor de las 300 000 a 500 000 solicitudes. Por debajo de ese volumen, las técnicas de optimización como el almacenamiento en caché y el enrutamiento ofrecen un mejor retorno de la inversión.

¿Cuánta compresión de contexto es segura sin perder calidad?

Los índices de compresión seguros dependen en gran medida del tipo de contenido. El historial de conversaciones se comprime entre 60 y 801 TP3T con resumen, manteniendo la coherencia del diálogo. La documentación técnica suele comprimirse entre 40 y 601 TP3T mediante extracción sin pérdida de información. El contenido creativo o con matices se comprime menos, quizás entre 30 y 401 TP3T. Siempre realice pruebas A/B: procese consultas idénticas con contextos completos y comprimidos, compare los resultados y mida las diferencias de calidad antes de implementar la compresión.

¿Cuál es la instrumentación mínima viable para el seguimiento de costes de LLM?

Como mínimo, registre estos seis campos por solicitud: marca de tiempo, nombre del modelo, tokens de entrada, tokens de salida, costo calculado y un campo de atribución (ID de usuario o nombre de la función). Almacene la información en cualquier base de datos que admita consultas de agregación; incluso una tabla simple de PostgreSQL funciona. Esto permite el monitoreo diario de costos e identifica las áreas de mayor gasto. Agregue más campos (latencia, acierto de caché, puntuación de calidad) según sea necesario, pero comience con estos básicos.

¿Cómo puedo convencer a la dirección de que invierta en la optimización de costes del programa LLM?

Presentar proyecciones de costos con y sin optimización. Mostrar el gasto mensual actual, multiplicarlo por 12 para obtener el costo anual y luego calcular el costo anual optimizado utilizando estimaciones de ahorro conservadoras (50-60% en lugar de 80%). La diferencia —a menudo $100,000+ para aplicaciones de producción— justifica la inversión en ingeniería. Incluir el cálculo del ROI: (Ahorro_Anual – Costo_de_Implementación) / Costo_de_Implementación. Un ROI superior a 300% hace que el caso sea convincente.

Conclusión: Del centro de costes a la ventaja competitiva

Los costos de LLM no tienen por qué descontrolarse. Las estrategias aquí descritas (almacenamiento en caché rápido, enrutamiento inteligente, optimización del contexto e instrumentación sistemática) reducen de forma consistente los costos de producción entre 70 y 851 TP3T, manteniendo o mejorando la calidad.

Pero no se trata solo de ahorrar dinero. Las organizaciones que dominan las operaciones de gestión de vida legal (LLM) rentables obtienen ventajas estratégicas. Unos costes unitarios más bajos permiten atender a más usuarios, experimentar con nuevas funciones y ofrecer capacidades de IA que la competencia considera económicamente inviables.

La clave reside en tratar el consumo de tokens como una prioridad de ingeniería desde el primer día. Instrumentar desde el principio, optimizar sistemáticamente y monitorizar continuamente. Las técnicas que funcionarán en 2026 (almacenamiento en caché, enrutamiento, compresión) evolucionarán, pero la disciplina de la ingeniería LLM con conciencia de costes seguirá siendo fundamental.

Empieza por la medición. Selecciona una función con mucho tráfico, registra su consumo de tokens y analiza los patrones. Esta visibilidad te permitirá optimizar el proceso de optimización, cuyo valor es entre 10 y 100 veces mayor que el de la instrumentación. Luego, aplica estrategias específicas donde los datos indiquen que tendrán mayor impacto.

Las organizaciones que triunfen con la tecnología LLM en 2026 no serán solo aquellas que tengan los mejores modelos, sino también aquellas que hayan dominado la economía de poner esos modelos en producción de manera eficiente.