Resumen rápido: Los costos de la API de Google LLM varían significativamente entre los modelos de Vertex AI. A partir de marzo de 2026, Gemini 3.1 Flash-Lite comienza en $0.25 por millón de tokens de entrada (para ≤200K tokens) y $0.25 por millón para >200K tokens, mientras que Gemini 3.1 Pro varía de $2 a $12 por millón de tokens según el tamaño del contexto. El precio depende del tipo de modelo, el volumen de tokens, el almacenamiento en caché y las funciones de conexión a tierra, con el procesamiento por lotes ofreciendo descuentos de 50%.

El precio de las API LLM de Google se ha convertido en un factor crucial para desarrolladores y empresas que crean aplicaciones de IA. Con la expansión de la familia de modelos Gemini de Vertex AI hasta principios de 2026, comprender la estructura de costos ya no es opcional.

¿El desafío? El modelo de precios de Google se basa en múltiples variables: cantidad de tokens, tamaño de la ventana de contexto, estado de la caché y si las solicitudes utilizan procesamiento por lotes o en tiempo real. Una sola llamada a la API puede costar desde fracciones de centavo hasta varios dólares, según la configuración.

Así son los costes reales en este momento.

Comprender la estructura de precios de la API de Google LLM

Google cobra por el uso de la API LLM a través de Vertex AI por token. Pero ahí termina la simplicidad.

Según la página oficial de precios de Vertex AI, los costos se dividen en tokens de entrada (lo que los desarrolladores envían al modelo) y tokens de salida (lo que el modelo genera). Este sistema de doble tarificación implica que una solicitud de 1000 palabras con una respuesta de 500 palabras se factura dos veces: una por la lectura y otra por la escritura.

El token en sí es un fragmento de texto, generalmente de 3 a 4 caracteres en inglés. La frase "inteligencia artificial" se divide en aproximadamente 4 tokens. Por lo tanto, un documento comercial típico de 500 palabras se convierte en aproximadamente 650 a 750 tokens.

En serio: la mayoría de los desarrolladores subestiman el consumo de tokens entre 30 y 401 TP3T al planificar sus presupuestos. Esta diferencia se amplía drásticamente al trabajar con entradas multimodales como imágenes o vídeo.

¿Qué se considera una solicitud facturable?

Google cobra por todos los tokens procesados en las solicitudes exitosas (200 OK). Sin embargo, algunos errores 4xx (como el 429 "Demasiadas solicitudes") no generan costos, mientras que otros relacionados con el filtrado de contenido durante la generación pueden generar cargos por los tokens de entrada.

Esto es más importante de lo que parece. Durante las fases de prueba, cuando las tasas de error pueden alcanzar el 15-20%, esa protección representa un ahorro significativo.

Desglose de precios del modelo Gemini 3.1

La familia Gemini 3.1 abarca varios modelos con precios muy diferentes. Esta es la estructura actual a marzo de 2026.

| Modelo | Ingrese ≤200K tokens | Salida ≤200K tokens | Introduzca >200.000 tokens | Salida >200.000 tokens |

|---|---|---|---|---|

| Vista previa de Gemini 3.1 Pro | $2 por 1M | $12 por 1M | $4 por 1M | $18 por 1M |

| Vista previa de la imagen Flash de Gemini 3.1 | Entrada $0.50, salida $3 por 1M | Imagen: $60 por 1M | N / A | N / A |

| Géminis 3 Estándar | $3 por 1M | $15 por 1M | Se aplican tarifas más altas | Se aplican tarifas más altas |

El nivel de precios aumenta cuando el contexto de entrada supera los 200 000 tokens. Al alcanzar ese umbral, Google cobra a todos los tokens, tanto de entrada como de salida, la tarifa de contexto largo. Para Gemini 3.1 Pro, esto supone un aumento del coste de entrada de 100% (de $2 a $4) y un aumento de salida de 50% (de $12 a $18).

Los modelos Flash están dirigidos a aplicaciones donde el costo es un factor importante. Con un precio que es la mitad del de los modelos Pro, sacrifican algo de profundidad de razonamiento en aras de la velocidad y la economía. Para tareas sencillas de clasificación, resumen o extracción, Flash ofrece la misma calidad que los modelos Pro a un precio mucho menor.

Ventaja de precios de entrada almacenados en caché

El almacenamiento en caché es donde los desarrolladores inteligentes reducen drásticamente los costos. Cuando el mismo contenido aparece en múltiples solicitudes (por ejemplo, un catálogo de productos, un conjunto de documentación o una base de conocimientos), almacenar ese contenido en caché reduce los costos de entrada repetida en 90%.

Para Gemini 3.1 Pro, los tokens de entrada en caché cuestan $0.20 por millón en lugar de $2 (para ≤200K tokens) o $0.40 por millón (para >200K tokens).

Los cálculos son rápidos. Si una base de conocimiento de 50 000 tokens se consulta 100 veces al día, el almacenamiento en caché ahorra aproximadamente $9 por día en comparación con el envío del contexto completo cada vez. Eso supone un ahorro mensual de $270 gracias a una sola optimización.

Costos del procesamiento por lotes frente a los costos en tiempo real

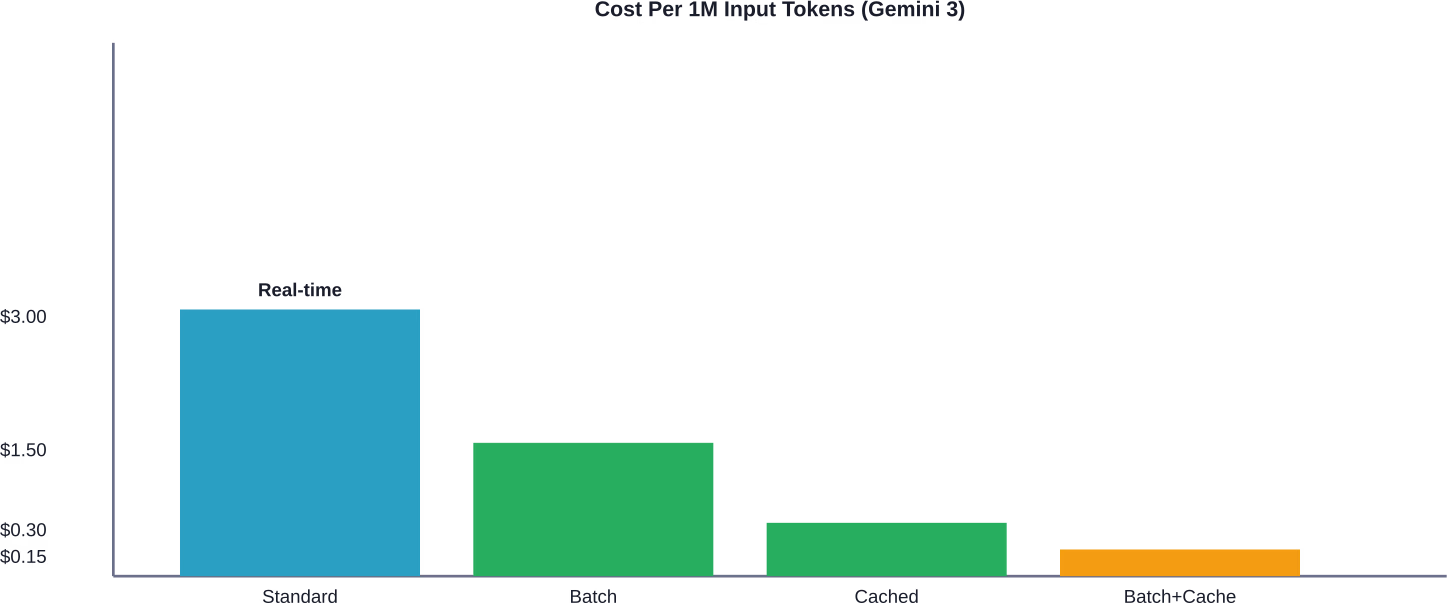

Las solicitudes por lotes reducen los costos a la mitad. Según la documentación oficial de Vertex AI, la entrada por lotes para Gemini 3 Standard cuesta 1,50 TP4T por millón de tokens, frente a 1,3 TP4T para el procesamiento en tiempo real (sin lotes). La salida por lotes cuesta 7,50 TP4T por millón, frente a 15 TP4T para el procesamiento en tiempo real.

¿La desventaja? La latencia. Los procesos por lotes se ejecutan de forma asíncrona, con tiempos de finalización que van desde minutos hasta horas. Para el procesamiento de datos nocturno, el análisis de documentos o la generación masiva de contenido, este retraso es irrelevante. Sin embargo, para los chatbots o las herramientas interactivas, es un factor determinante.

Las operaciones de caché por lotes ofrecen descuentos similares. Las escrituras en caché se reducen a $1,875 por millón de tokens, y los aciertos de caché a $0,15. Para cargas de trabajo de alto volumen donde no se requieren respuestas inmediatas, el procesamiento por lotes con almacenamiento en caché representa la estructura de costos más baja disponible.

Puesta a tierra y precios de las herramientas

Gemini 2.5 Pro incluye 10 000 avisos de castigo al día sin coste adicional. Si se supera ese límite, Google cobra $35 por cada 1000 avisos de castigo.

Una solicitud basada en datos implica que el modelo consulta la Búsqueda de Google durante su generación. Para obtener información precisa en resúmenes de noticias, asistencia en investigaciones o búsqueda de datos en tiempo real, esta función resulta invaluable. Sin embargo, el costo es considerable.

Con un coste de $35 por cada 1000 solicitudes bloqueadas, los escenarios de uso intensivo generan cargos rápidamente. Una aplicación que realiza 50 000 solicitudes bloqueadas al mes paga $1750 solo por el bloqueo, antes de los costes de los tokens. La asignación diaria gratuita cubre 300 000 solicitudes mensuales para las cuentas que cumplen los requisitos, lo que es suficiente para la mayoría de las implementaciones de tamaño pequeño a mediano.

El servicio Web Grounding para empresas tiene una tarifa más alta: $45 por cada 1000 solicitudes de acceso. Este nivel premium ofrece capacidades de búsqueda mejoradas y fuentes de datos empresariales. Las organizaciones que necesiten esta función deben ponerse en contacto con el equipo de cuentas de Google Cloud para obtener posibles descuentos por volumen.

Comparación de los costes del máster en Derecho (LLM) de Google con los de la competencia.

¿Cómo se comparan las tarifas de Google con las de OpenAI y Anthropic?

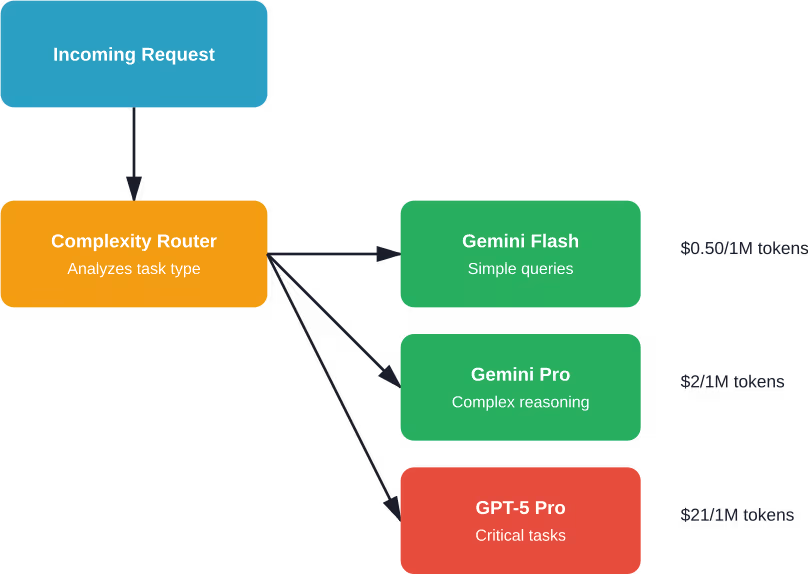

A marzo de 2026, el GPT-5.2 Pro de OpenAI cuesta $21 por millón de tokens de entrada y $168 por millón de tokens de salida, aproximadamente 10 veces más que el Gemini 3.1 Pro de Google. El Claude Sonnet 4.5 de Anthropic consume $3 por millón de entradas y $15 por millón de salidas, prácticamente idéntico al Gemini 3 Standard.

Pero aquí es donde la cosa se pone interesante. La versión 3.2 de DeepSeek ofrece un precio inferior al de la competencia, con $0.28 por millón de tokens de entrada. Para aplicaciones con presupuestos ajustados, los proveedores chinos han establecido un nuevo precio mínimo que los proveedores occidentales tienen dificultades para igualar.

| Proveedor | Modelo | Entrada (por cada millón de tokens) | Salida (por cada millón de tokens) |

|---|---|---|---|

| Gemini 3.1 Pro | $2.00 | $12.00 | |

| Gemini 3.1 Flash-Lite | $0.25 | Tarifas estándar | |

| Abierto AI | GPT-5.2 Pro | $21.00 | $168.00 |

| Antrópico | Soneto 4.5 de Claude | $3.00 | $15.00 |

| Búsqueda profunda | V3.2-Exp | $0.28 | $0.40 |

El rendimiento es tan importante como el precio. Algunos debates en la comunidad indican que el precio ultrabajo de DeepSeek podría implicar ciertas limitaciones en la calidad para tareas de razonamiento complejas. Los modelos Gemini 3.1 Pro de Google y Claude de Anthropic ofrecen un rendimiento superior en pruebas comparativas como MMLU y HellaSwag.

El cálculo del valor depende totalmente del caso de uso. Para el análisis de documentos legales de alto riesgo, pagar diez veces más por la precisión de GPT-5.2 Pro tiene sentido. Para la clasificación de tickets de atención al cliente, Gemini Flash o DeepSeek ofrecen una calidad suficiente a una fracción del costo.

Costes ocultos y gastos de infraestructura

El precio de los tokens solo cuenta una parte de la historia. La infraestructura de IA de Vertex añade costes adicionales que muchos desarrolladores pasan por alto durante la planificación inicial.

El almacenamiento de datos para aplicaciones RAG que utilizan Vertex AI RAG Engine conlleva cargos adicionales. El precio de Vertex AI Search se basa en un modelo configurable con suscripciones mensuales para la capacidad de consulta (QPM) y el almacenamiento. Para sitios web, el almacenamiento se calcula multiplicando 500 kilobytes por el número de páginas; un sitio web de 1000 páginas cuesta $2.38 al mes solo por la indexación de datos.

Las bases de datos vectoriales, ya sea que utilicen las soluciones gestionadas de Vertex AI o soluciones de terceros como Pinecot o Weaviate, generan costos adicionales por GB de almacenamiento y consulta. Una implementación típica de RAG empresarial con 50 GB de incrustaciones podría generar entre $50 y 150 mensuales en cargos por almacenamiento vectorial, independientemente de los costos de LLM.

Tarifas de transferencia y salida de datos

El acceso a Cloud Storage, Google Drive y otras fuentes de datos desde Vertex AI es gratuito, pero se aplican costos de transferencia de datos. Mover datos fuera de las regiones de Google Cloud genera cargos por ancho de banda que oscilan entre $0.08 y $0.23 por GB, según el destino.

Para aplicaciones que procesan archivos multimedia grandes o colecciones extensas de documentos, el tráfico de salida puede añadir entre 10 y 201 TP3T a los costes totales. Un sistema de procesamiento de vídeo que gestiona 1 TB al mes paga entre 1 TP4T80 y 230 solo por el ancho de banda.

Estrategias de optimización de costos que funcionan

La diferencia entre una implementación básica y una implementación optimizada puede alcanzar los 701 TP3T en gastos totales. Aquí te mostramos qué es lo que realmente marca la diferencia.

Implementar almacenamiento en caché de contexto agresivo

Más allá del almacenamiento en caché básico, implementar una estrategia de caché de múltiples niveles reduce aún más los costos. Almacene los contextos de acceso frecuente en la caché nativa de Vertex AI. Para los contextos menos comunes, pero que se repiten, mantenga una capa de Redis o Memcached que reconstruya las indicaciones a partir de plantillas.

Un ejemplo de reducción de costos muestra que la implementación de un sistema de almacenamiento en caché de dos niveles para un bot de servicio al cliente que hace referencia a un catálogo de productos de 30,000 tokens puede reducir los costos de aproximadamente $2,400 a $720 mensuales.

Comprime las indicaciones sin sacrificar la calidad.

La optimización de las indicaciones no se trata solo de calidad, sino también de eficiencia. Eliminar palabras de relleno, usar abreviaturas cuando el contexto lo permita y reestructurar las indicaciones puede reducir el número de tokens entre 15 y 25% sin pérdida de calidad.

En lugar de “Analice los siguientes comentarios de los clientes y proporcione un resumen detallado de los temas principales, el sentimiento y las conclusiones prácticas”, utilice “Analice estos comentarios. Enumere: temas principales, sentimiento y conclusiones prácticas”. Misma instrucción, 40% menos tokens.

Dirigir las solicitudes a los modelos apropiados.

No todas las solicitudes necesitan Gemini Pro. Implementar una capa de enrutamiento que dirija las consultas simples a Flash y el razonamiento complejo a Pro optimiza la relación costo-calidad.

Las tareas de clasificación, las preguntas y respuestas básicas y el llenado de plantillas funcionan correctamente en Flash. El razonamiento multietapa, el análisis detallado y la generación creativa se benefician de las capacidades adicionales de Pro. El enrutamiento inteligente puede reducir los costos promedio por solicitud entre 40 y 50 TP3T en cargas de trabajo mixtas.

Agrupar todo lo posible

Los requisitos de tiempo real suelen exagerarse. La moderación de contenido, el resumen de documentos, el enriquecimiento de datos y muchos otros flujos de trabajo toleran retrasos de 5 a 30 minutos sin afectar al usuario.

Migrar estas cargas de trabajo al procesamiento por lotes reduce inmediatamente los costos (50%). Para las organizaciones que procesan millones de solicitudes al mes, esto representa un ahorro de cinco cifras con un mínimo esfuerzo de ingeniería.

Supervise y configure alertas presupuestarias.

Los costes descontrolados son inevitables. Un bucle de reintentos mal configurado, un pico de tráfico inesperado o un ataque de inyección rápida pueden agotar los presupuestos en cuestión de horas.

Las alertas de facturación de Google Cloud activan notificaciones cuando el gasto supera ciertos umbrales. Configurar alertas en 50%, 75% y 90% de presupuestos mensuales proporciona una advertencia temprana. Combinar las alertas con límites de cuota automáticos evita sobrecostos catastróficos.

Evite pagar de más por las API de LLM; primero valide su configuración.

El uso de las API de Google LLM parece sencillo al principio, pero los costes aumentan rápidamente una vez que se incrementa el uso, especialmente cuando no se optimizan las indicaciones, el flujo de datos y el comportamiento del modelo. IA superior Funciona a lo largo de todo el ciclo de vida, desde la preparación de datos y la selección del modelo hasta el ajuste fino y la implementación, lo que ayuda a reducir el uso innecesario de la API y a evitar configuraciones ineficientes.

En lugar de depender únicamente de las API externas, este enfoque suele incluir la evaluación de cuándo los modelos personalizados, el ajuste fino o las configuraciones híbridas resultan más rentables. Esto es especialmente relevante para las empresas que pasan de la fase de pruebas a la de producción, donde los costes de las API pueden acumularse con el tiempo. Si planea utilizar las API de LLM o ya está viendo un aumento en los costes, conviene revisar su arquitectura cuanto antes. Póngase en contacto con nosotros. IA superior para evaluar su configuración antes de que los costos aumenten aún más.

Ejemplos de costos reales

La teoría importa menos que la práctica. ¿Cuánto cuestan las implementaciones reales?

Chatbot de atención al cliente

Una empresa de comercio electrónico de tamaño mediano utiliza un bot de soporte que gestiona 50.000 conversaciones al mes. Cada conversación consta de un promedio de 8 mensajes, con 200 tokens de entrada y 150 tokens de salida por mensaje.

Volumen mensual total: 50.000 conversaciones × 8 mensajes × (200 de entrada + 150 de salida) = 140 millones de tokens (80 millones de entrada, 60 millones de salida).

Utilizando Gemini 3.1 Flash ($0.50 de entrada para texto/imagen, $3 de salida para texto): aproximadamente $40 de entrada + $30 de salida = $70 mensuales.

Utilizando Gemini 3.1 Pro ($2 de entrada, $12 de salida): $160 de entrada + $720 de salida = $880 mensuales.

Flash gestiona este caso de uso de forma eficaz, ahorrando $810 al mes, lo que supone una reducción de costes de 97%.

Proceso de procesamiento de documentos

Una startup de tecnología legal procesa 10.000 contratos al mes, cada uno con un promedio de 5.000 tokens. La extracción y el análisis generan 1.000 tokens de salida por documento.

Volumen total: 10.000 documentos × (5.000 entradas + 1.000 salidas) = 60 millones de tokens (50 millones de entradas, 10 millones de salidas).

Para el procesamiento por lotes con Gemini 3 Standard: 50M × $1.50/1M (entrada por lotes) + 10M × $7.50/1M (salida por lotes) = $75 + $75 = $150 mensuales.

Procesamiento en tiempo real: 50M × $3/1M + 10M × $15/1M = $150 + $150 = $300 mensuales.

El procesamiento por lotes reduce los costos a la mitad sin afectar la calidad en los flujos de trabajo de procesamiento nocturno.

¿Cuándo elegir Google en lugar de la competencia?

Las API LLM de Google destacan en escenarios específicos, pero no son óptimas en todos los casos.

Elige Google Vertex AI cuando:

- Ya operando dentro de la infraestructura de Google Cloud: Los costes de transferencia e integración de datos se reducen significativamente.

- Requerir capacidades multimodales: Gemini gestiona texto, imágenes, audio y vídeo en indicaciones unificadas.

- Creación de aplicaciones RAG: Las herramientas integradas de búsqueda vectorial y de puesta en tierra de Vertex AI reducen la complejidad arquitectónica.

- Necesidad de ventanas de contexto ultralargas: Gemini 1.5 Pro admite hasta 2 millones de tokens, superando con creces a la mayoría de sus competidores.

- Priorizar la eficiencia de costos para tareas de complejidad moderada: Los modelos Flash ofrecen un gran valor.

Busque en otro lugar cuando:

La máxima capacidad de razonamiento es más importante que el costo: GPT-5.2 Pro supera a Gemini en tareas lógicas complejas. En ámbitos especializados como las matemáticas avanzadas o la programación competitiva, los modelos de OpenAI lideran actualmente las comparativas. Requisitos de cumplimiento de tolerancia cero: algunas industrias exigen certificaciones específicas que favorecen a los proveedores establecidos.

Preguntas frecuentes

¿Cuánto cuesta la API LLM más barata de Google?

Gemini 3.1 Flash-Lite cuesta $0.25 por millón de tokens de entrada (para contextos de ≤200K) a partir de marzo de 2026, lo que lo convierte en una de las opciones más económicas de Google. Con el procesamiento por lotes y el almacenamiento en caché, los costos efectivos pueden reducirse a $0.15 por millón de tokens para los aciertos de caché por lotes, aunque las escrituras iniciales en la caché por lotes cuestan $1.875 por millón.

¿Cuál es la diferencia de precios entre Gemini Pro y Flash?

Gemini 3.1 Pro cuesta $2 por millón de tokens de entrada, en comparación con los $0.50 de Flash, una diferencia de cuatro veces. Los tokens de salida muestran una diferencia similar: Pro cobra $12 por millón, mientras que Flash utiliza tarifas estándar significativamente más bajas. Pro ofrece un razonamiento y un análisis más precisos; Flash se centra en la velocidad y el coste en tareas más sencillas.

¿Google cobra por las solicitudes de API fallidas?

Google cobra por todos los tokens procesados en las solicitudes exitosas (200 OK). Sin embargo, algunos errores 4xx (como el 429 "Demasiadas solicitudes") no generan costos, mientras que otros relacionados con el filtrado de contenido durante la generación pueden generar cargos por los tokens de entrada.

¿Cómo reduce el almacenamiento en caché de contexto los costes de Google LLM?

El almacenamiento en caché del contexto repetido reduce los costos de los tokens en aproximadamente 90%. Para Gemini 3.1 Pro, los tokens de entrada almacenados en caché cuestan $0.20 por millón en comparación con $2 para los no almacenados en caché.

¿Cuáles son los costos de puesta a tierra para los modelos Gemini?

Gemini 2.5 Pro incluye 10 000 solicitudes de acceso gratuito al día. Si se supera este límite, el acceso estándar cuesta $35 por cada 1000 solicitudes. El acceso web empresarial cuesta $45 por cada 1000 solicitudes. Estos cargos se suman a los costes estándar de los tokens de entrada y salida.

¿Puedo usar las API de Google LLM de forma gratuita?

Google no ofrece un plan gratuito permanente para el uso de Vertex AI LLM, a diferencia de algunos competidores. Sin embargo, las nuevas cuentas de Google Cloud reciben créditos (normalmente $300) para las pruebas iniciales. El precio es de pago por uso, sin requisitos mínimos de uso, lo que permite realizar pruebas a pequeña escala con un coste mínimo.

¿Cómo funciona la tarificación por procesamiento por lotes?

El procesamiento por lotes reduce los costos de los tokens en 50% en todos los modelos Gemini de Google. Por ejemplo, Gemini 3 Standard pasa de $3 a $1,50 por millón de tokens de entrada y de $15 a $7,50 por millón de tokens de salida. Las solicitudes por lotes se procesan de forma asíncrona, con tiempos de finalización que varían de minutos a horas, según la profundidad de la cola.

Tomar la decisión sobre el costo

La política de precios de la API LLM de Google posiciona a Vertex AI de forma competitiva en el mercado de 2026, especialmente para las aplicaciones que ya operan dentro del ecosistema de Google Cloud.

La estructura de costos premia la optimización. Los desarrolladores que implementan almacenamiento en caché, procesamiento por lotes y enrutamiento inteligente de modelos pueden lograr costos efectivos entre un 70 % y un 80 % inferiores a los precios de lista. Quienes implementan modelos de forma ingenua pagarán de más considerablemente.

El modelo de precios basado en tokens sigue siendo el predominante entre los principales proveedores, pero el coste efectivo por respuesta generada por IA varía enormemente según las opciones de implementación. Una implementación bien diseñada en Gemini Flash puede ofrecer capacidades de IA a una décima parte del coste de una implementación de GPT-5 Pro no optimizada.

La cuestión clave no es qué proveedor tiene el precio de lista más bajo, sino qué combinación de capacidad del modelo, estructura de precios e integración de infraestructura ofrece el mejor valor para características específicas de la carga de trabajo.

Comience con una evaluación comparativa clara. Pruebe cargas de trabajo representativas en los modelos de Google, OpenAI y Anthropic. Mida no solo la calidad, sino también el consumo real de tokens, la latencia y las tasas de error. Calcule el costo total de propiedad, incluyendo la infraestructura, la transferencia de datos y el tiempo de ingeniería.

Luego, optimice sin piedad. Cada reducción de 10% en el promedio de tokens por solicitud, cada mejora de un punto porcentual en las tasas de aciertos de caché, cada carga de trabajo migrada al procesamiento por lotes se traduce directamente en ahorros finales.

El panorama de costes de los sistemas de gestión del aprendizaje automático (LLM) sigue evolucionando rápidamente. Los precios competitivos de hoy pueden quedar obsoletos en cuestión de meses, a medida que los proveedores compiten por la cuota de mercado. La flexibilidad presupuestaria y la adaptabilidad arquitectónica son tan importantes como los precios actuales a la hora de construir una infraestructura de IA a largo plazo.