Korte samenvatting: Kostenoptimalisatie van LLM bij de implementatie van AI vereist een gelaagde aanpak die slimme modelselectie, infrastructuuroptimalisatie en tokenbeheer combineert. Organisaties kunnen de kosten met 60-851 TP3T verlagen door technieken zoals modelroutering, semantische caching en KV-cacheoptimalisatie, zonder in te leveren op nauwkeurigheid. De sleutel is om LLM-kosten te behandelen als productiekosten in plaats van traditionele softwarekosten.

Een chatbot voor klantenservice die 500.000 verzoeken per maand verwerkt tegen 1.500 tokens per verzoek, kost ongeveer 1.500 tokens per maand – en dat alleen al voor één enkele functie. Schaal dat op naar 10.000 dagelijkse gesprekken en de kosten lopen op tot meer dan 1.500 tokens per dag, alleen al voor de input-tokens.

Dit is geen traditioneel kostenbeheer in de cloud. LLM-native producten erven eigenschappen van zowel fysieke goederen als software: ze schalen direct, net als code, maar brengen aanzienlijke variabele kosten per gebruik met zich mee. Naarmate organisaties steeds vaker grootschalige modellen implementeren, is kostenbeheer een concurrentievoordeel geworden in plaats van slechts een operationele kwestie.

Het prijsverschil tussen aanbieders is aanzienlijk. GPT-5.4 rekent $2,50 per miljoen inputtokens, terwijl Claude 4.5 Sonnet $3 per miljoen inputtokens rekent. Maar de keuze van de aanbieder is slechts het begin: kostenoptimalisatie vereist een doordachte aanpak op infrastructuurniveau.

Waarom de kosten van een LLM-opleiding zich anders gedragen

Traditionele software werkt volgens een eenvoudig economisch model: hoge ontwikkelingskosten vooraf, waarna de marginale kosten voor elke extra gebruiker bijna nul worden. De applicatie wordt één keer gehost en miljoenen gebruikers kunnen er gebruik van maken.

AI-native applicaties doorbreken dit model volledig.

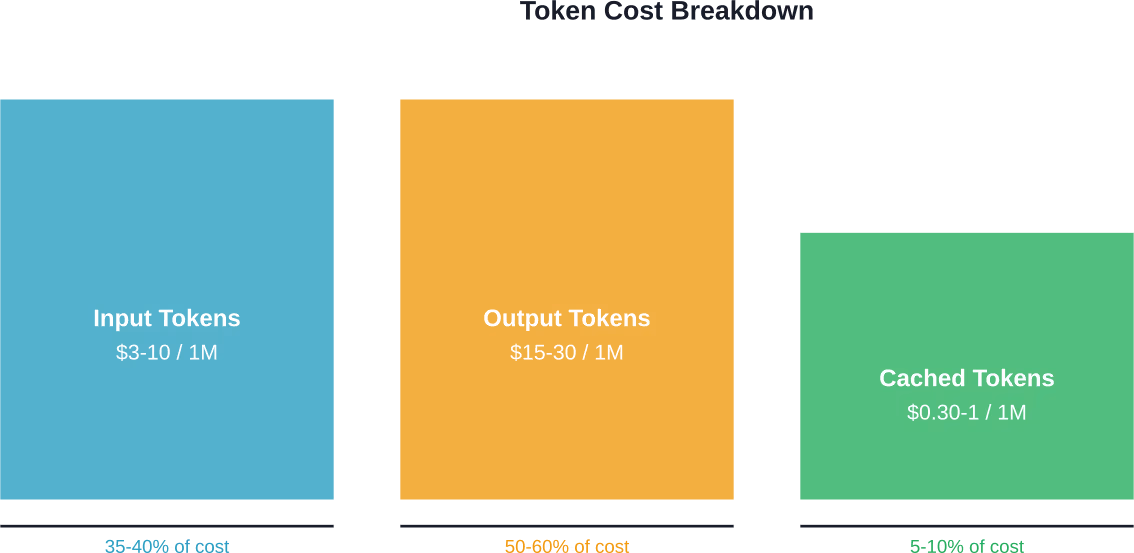

Elke inferentie brengt daadwerkelijke rekenkosten met zich mee. Invoertokens, uitvoertokens en gecachede tokens hebben elk een andere prijsstructuur. De prijs is afhankelijk van verschillende onderling samenhangende variabelen die dynamisch veranderen op basis van de kenmerken van de werklast.

De lengte van de context is belangrijker dan de meeste teams verwachten. Een model met een contextlengte van 2048 tokens kan tot 2048 tokens tegelijk verwerken. Maar het verwerken van langere contexten verhoogt de geheugenvereisten exponentieel, niet lineair. De sleutel-waardecache, die overbodige herberekening van eerdere tokenrepresentaties tijdens autoregressieve generatie elimineert, groeit evenredig met de sequentielengte.

Productiesystemen ondervinden knelpunten die tijdens de ontwikkelingsfase niet bestaan. De geheugenbandbreedte wordt de belangrijkste beperking tijdens de decodeerfase. Het multi-head attention-mechanisme voert meerdere attention-berekeningen parallel uit, maar hardwarebeperkingen bepalen de daadwerkelijke doorvoer.

Het eenheidseconomieprobleem

AI-startups staan voor unieke uitdagingen op drie gebieden: kosten per inferentie (unit economics), capaciteitsplanning (aanbod aan GPU's) en opbrengstoptimalisatie (kwaliteit van de modeloutput per token).

In tegenstelling tot traditionele software, waarbij de marginale kosten van een nieuwe gebruiker in feite nul zijn, hebben LLM-native producten aanzienlijke variabele kostencomponenten. Dit dwingt teams om te denken als fabrikanten: het bewaken van de productie-efficiëntie, het optimaliseren van de doorvoer en het beheren van leveringsbeperkingen.

Eerlijk gezegd: de meeste teams kunnen hun LLM-kosten niet nauwkeurig verklaren. De complexiteit van AI-kostenstructuren, inclusief rekenkracht, geheugenbandbreedte, opslag en netwerken, zorgt voor een gebrek aan verantwoording. Engineeringteams hebben geen inzicht in welke use cases de kosten opdrijven of welke optimalisaties het hoogste rendement opleveren.

Modelselectie en routeringsstrategieën

Recente ontwikkelingen in taalmodellen hebben een groeiend ecosysteem gecreëerd. Organisaties kunnen nu kiezen uit tientallen open-source en commerciële opties, elk met verschillende afwegingen tussen prestaties en kosten.

Maar elke vraag als even complex behandelen is geldverspilling.

| Strategie | Hoe het werkt | Typische besparingen |

|---|---|---|

| Statische routering | Routeer query's naar vooraf bepaalde modellen op basis van het gebruiksscenario. | 30-40% |

| Dynamische routering | Analyseer de complexiteit van query's in realtime en selecteer het optimale model. | 45-60% |

| Cascaderend | Probeer eerst de goedkopere modellen en ga pas over op een duurder model als dat nodig is. | 50-70% |

| LLM Herderschap | Gebruik dure modellen voor hints, goedkopere modellen voor de uitvoering. | 60-75% |

Onderzoek van arXiv toont aan dat Small Language Models (SLM's) met gerichte hints van Large Language Models (LLM's) nauwkeurigheidswinst behalen met minimaal LLM-resourcegebruik. De data laten zien dat de nauwkeurigheid van SLM (Llama-3.2-3B-Instruct) als functie van de hintgrootte van LLM (Llama-3.3-70B-Versatile) aanzienlijk verbetert, waarbij kleine hints slechts 10-30% van het volledige LLM-antwoord vertegenwoordigen, met afnemende meerwaarde boven de 60%.

Dit motiveert een begeleidende aanpak: er wordt gevraagd om hints in plaats van volledige antwoorden. De strategie behandelt het dure model als een adviseur in plaats van een uitvoerder – betaal voor begeleiding, niet voor complete antwoorden.

Optimalisatietechnieken op infrastructuurniveau

Modelselectie is slechts één aspect. Infrastructuuroptimalisatie pakt de door de hardware veroorzaakte knelpunten aan die de prestaties beperken en de kosten opdrijven.

KV Cache Management

De key-value cache is een fundamentele optimalisatie in Transformer-gebaseerde modellen. Maar het verbruikt ook veel geheugen.

Tijdens de autoregressieve generatie berekent het model bij elke stap de aandacht over alle voorgaande tokens. Zonder caching vereist dit dat de representaties voor de hele reeks herhaaldelijk opnieuw worden berekend. De KV-cache slaat deze berekeningen op, waardoor geheugen wordt ingeruild voor snelheid.

Het probleem is als volgt: de cachegrootte groeit lineair met de sequentielengte en de batchgrootte. Bij toepassingen met een lange context kan het cachegeheugen de modelgewichten zelf overschrijden. Strategieën om dit te beheersen zijn onder andere:

- Het kwantiseren van opgeslagen waarden naar een lagere precisie (8-bits of 4-bits).

- Het implementeren van verwijderingsbeleid dat minder relevante tokens verwijdert.

- Het gebruik van sliding window attention voor begrensde geheugengroei

- Cache-items comprimeren met behulp van geleerde compressietokens.

Onderzoek naar zinsgebaseerde compressie van de essentie laat zien dat voorgegetrainde LLM's kunnen worden verfijnd om context te comprimeren met behulp van geleerde tokens, waardoor de geheugen- en rekenkrachtvereisten voor lange sequenties worden verminderd. Parameter-efficiënte verfijningsmethoden stellen compacte modellen in staat om redeneertaken uit te voeren zonder volledige uitbreiding van de KV-cache.

Batch- en doorvoeroptimalisatie

Inferentiesystemen moeten een balans vinden tussen latentie en doorvoer. Grotere batchgroottes verbeteren het hardwaregebruik, maar verlengen de wachttijden voor individuele verzoeken.

De rekenfase tijdens het voorvullen (het verwerken van invoertokens) profiteert enorm van batchverwerking: het GPU-gebruik neemt lineair toe met de batchgrootte tot aan de hardwarelimieten. De decodeerfase is echter bandbreedtebeperkt. Het toevoegen van meer verzoeken aan een batch leidt niet tot een evenredige toename van de doorvoer, omdat de geheugenbandbreedte dan de bottleneck vormt.

Effectieve strategieën scheiden het voorvullen en decoderen in verschillende batches, waardoor onafhankelijke optimalisatie van elke fase mogelijk is. Continue batchverwerkingstechnieken voegen dynamisch nieuwe verzoeken toe aan lopende batches in plaats van te wachten tot de hele batch is voltooid.

Modelkwantisatie

Kwantisatie verlaagt de precisie van modellen van 32-bits of 16-bits drijvende-kommagetallen naar 8-bits of 4-bits gehele getallen. Dit vermindert de geheugenbehoefte en het bandbreedteverbruik evenredig.

GPTQ-kwantisatie is wiskundig equivalent aan Babai's nearest plane-algoritme, volgens onderzoek van IST Austria. Deze geometrische interpretatie biedt foutgrenzen voor kwantisatie van grote taalmodellen, waardoor 4-bits precisie mogelijk is met zorgvuldig gekalibreerde parameters om nauwkeurigheidsverlies te minimaliseren.

DistilBERT demonstreert de kracht van modeldistillatie in combinatie met kwantisering. Ontwikkeld door het Hugging Face-team, is het 40% kleiner en sneller dan BERT base — ongeveer 66 miljoen parameters versus 110 miljoen — terwijl het 97% van de prestaties op downstream-taken behoudt.

| Techniek | Geheugenreductie | Snelheidsverbetering | Impact van nauwkeurigheid |

|---|---|---|---|

| 8-bits kwantisering | 50% | 1,5-2x | <1%-verlies |

| 4-bits kwantisering | 75% | 2-3x | 1-3% verlies |

| Modeldestillatie | 40-60% | 2-3x | 2-5% verlies |

| KV-cachekwantisatie | 30-50% (alleen cache) | 1,3-1,8x | <1%-verlies |

Semantische caching voor kostenbesparing

Caching lijkt vanzelfsprekend: resultaten opslaan en hergebruiken. Maar LLM-toepassingen brengen unieke uitdagingen met zich mee.

Exacte tekenreeksvergelijking werkt niet omdat gebruikers identieke vragen anders formuleren. "Wat is de hoofdstad van Frankrijk?" en "Vertel me de hoofdstad van Frankrijk" zouden dezelfde cache-ingang moeten oproepen.

Semantische caching lost dit op door zoekopdrachten in een vectorruimte in te bedden en te matchen op basis van gelijkenis in plaats van exacte tekenreeksen. Wanneer een nieuwe zoekopdracht binnenkomt, berekent het systeem de bijbehorende inbedding en zoekt het naar nabijgelegen gecachede items. Als er een overeenkomst is boven een bepaalde drempelwaarde, wordt het gecachede antwoord geretourneerd. Anders wordt het model aangeroepen en het resultaat gecached.

Voor toepassingen met een hoog volume behaalt semantische caching doorgaans een hitrate van 40-60% na de eerste week van gebruik. Bij GPT-5-tarieven betekent dat een aanzienlijke maandelijkse besparing voor één enkele functionaliteit.

De implementatie vereist een zorgvuldige afstemming van de gelijkenisdrempel. Stel deze te hoog in en het aantal cachehits daalt drastisch. Stel deze te laag in en het systeem geeft verouderde of irrelevante antwoorden terug, wat de gebruikerservaring negatief beïnvloedt.

Snelle engineering en tokenbeheer

Invoertokens kosten geld. Uitvoertokens kosten meer – vaak 3 tot 5 keer zoveel als de invoertokens.

Promptoptimalisatie is gericht op het behalen van dezelfde resultaten met minder tokens. Technieken omvatten:

- Het verwijderen van overbodige context of voorbeelden.

- Het gebruik van beknoptere instructieformuleringen

- Het efficiënt benutten van systeemberichten

- Het implementeren van few-shot learning met minimale voorbeelden.

- De lengte van de uitvoer beperken door middel van instructies

De uitdaging is het vinden van een balans tussen beknoptheid en duidelijkheid. Te korte prompts leiden vaak tot resultaten van lagere kwaliteit, waardoor herhalingen nodig zijn die meer kosten dan de oorspronkelijke besparing.

Tests tonen aan dat systematische promptcompressie – het verwijderen van overbodige tokens met behoud van semantische betekenis – de invoerkosten met 20-40% kan verlagen zonder verlies aan nauwkeurigheid. Dit vereist echter een evaluatie-infrastructuur om te valideren dat gecomprimeerde prompts de uitvoerkwaliteit behouden.

Het opzetten van een kostenbewakingssysteem

Je kunt iets niet optimaliseren als het niet gemeten wordt.

Productie-LLM-systemen vereisen instrumentatie die kosten op meerdere detailniveaus bijhoudt: per gebruiker, per functionaliteit, per model en per aanvraagtype. Deze transparantie maakt datagestuurde optimalisatiebeslissingen mogelijk.

De meeste teams beginnen met de geaggregeerde maandelijkse facturen van leveranciers. Dat is onvoldoende. De meetinstrumenten moeten het volgende vastleggen:

- Aantal tokens (invoer, uitvoer, cache) per verzoek

- Gebruikt model en routeringsbeslissingen

- Latentie- en doorvoermetingen

- Cache-hitpercentages en effectiviteit

- Foutpercentages en kosten voor herhaalpogingen

- Kostentoewijzing aan functies of gebruikers

Hiërarchische budgetbeheerfuncties stellen teams in staat om bestedingslimieten in te stellen op verschillende niveaus: organisatiebreed, per team, per functie of per gebruiker. Wanneer een budgetdrempel wordt bereikt, kan het systeem automatisch overschakelen naar goedkopere modellen of een tariefbeperking toepassen.

Volgens onderzoek van MIT naar schaalwetten voor AI is het cruciaal om vooraf een rekenbudget en een streefnauwkeurigheid voor het model vast te stellen. Het onderzoek wees uit dat een gemiddelde relatieve fout (ARE) van 4% ongeveer de best haalbare nauwkeurigheid is vanwege willekeurige zaadruis, maar dat een ARE tot 20% nog steeds nuttig is voor besluitvorming.

Het probleem van de aanbiederseconomie

Beheerde LLM-services zoals Azure OpenAI brengen uitdagingen met zich mee op het gebied van kostenbeheer die fundamenteel verschillen van traditionele cloudmodellen. De prijsstructuur is afhankelijk van inputtokens, outputtokens, gecachede tokens, geprovisioneerde doorvoereenheden (PTU's) en implementatieconfiguraties.

Azure OpenAI verhult door zijn architectuur de werkelijke kostenfactoren. Organisaties reserveren capaciteit in PTU's zonder duidelijk inzicht in het daadwerkelijke tokenverbruik of het gebruik van modellen. Dit creëert lacunes in de verantwoording: engineeringteams kunnen niet vaststellen welke functies de kosten verhogen of of optimalisaties daadwerkelijk werken.

Cloudkostenbeheerplatformen die zijn gebouwd voor traditionele infrastructuren, kunnen AI-workloads niet effectief aan. Ze registreren wel VM-uren en opslagbytes, maar missen de gedetailleerde informatie op tokenniveau die nodig is voor LLM-optimalisatie.

FinOps voor AI vereist inzicht in de economische aspecten van de use case. Teams moeten de kosten per eenheid bijhouden – kosten per gesprek, per samengevat document, per voltooide code – in plaats van alleen de totale uitgaven. Dit verschuift de focus van kostenbeheer voor de infrastructuur naar efficiëntie in de productie.

Implementatiekader voor de praktijk

Optimalisatie is geen eenmalig project. Het is een doorlopend proces dat evolueert met gebruikspatronen en de beschikbaarheid van modellen.

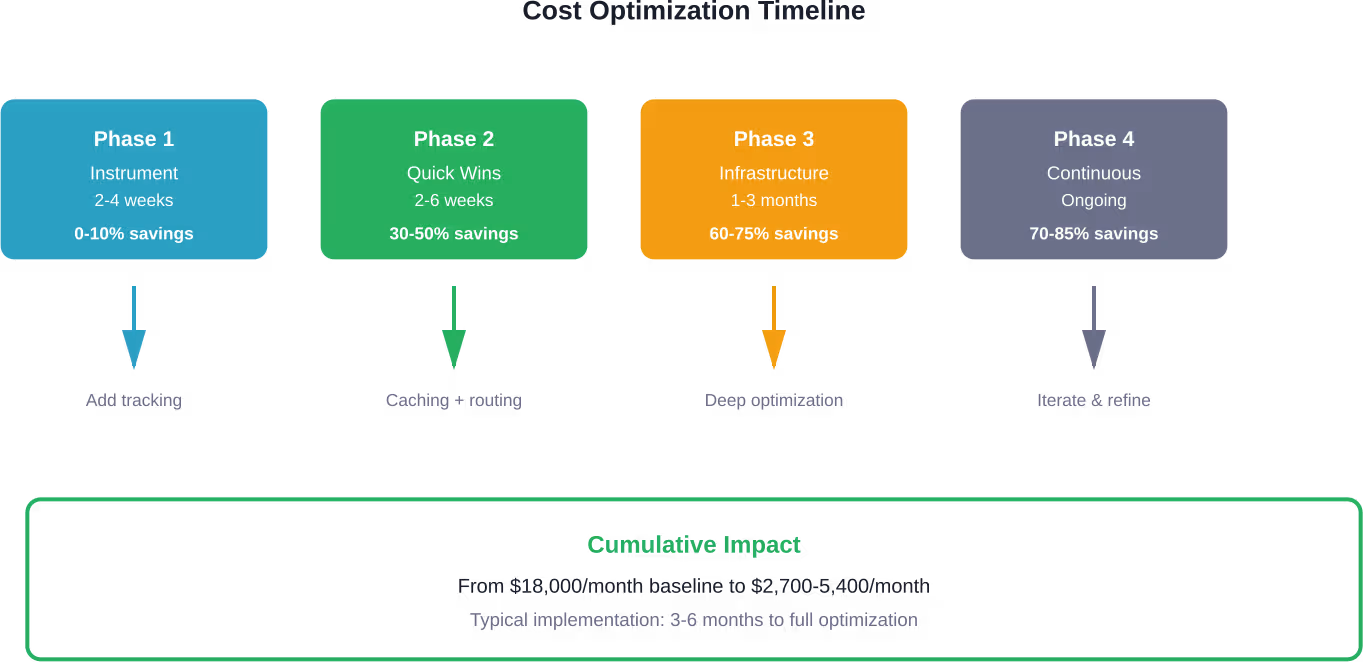

Fase 1: Basislijn en instrumentarium

Begin met uitgebreide instrumentatie. Implementeer tracking die het tokengebruik, de modelselectie, de latentie en de kosten op aanvraagniveau vastlegt. Stel basisstatistieken vast: huidige kosten, verdeling over gebruiksscenario's en prestatiebenchmarks.

Deze fase duurt doorgaans 2-4 weken en vereist minimale codeaanpassingen, voornamelijk het toevoegen van logboekregistratie en het verzamelen van statistieken.

Fase 2: Snelle successen

Voer eenvoudig te voltooien optimalisaties door:

- Implementeer semantische caching voor veelgebruikte zoekopdrachten.

- Leid eenvoudige query's door naar goedkopere modellen.

- Verkort prompts door overbodige context te verwijderen.

- Stel maximale uitvoerlimieten in voor tokens.

Deze wijzigingen leiden vaak binnen enkele weken tot een kostenbesparing van 30-50% zonder verlies aan nauwkeurigheid.

Fase 3: Infrastructuuroptimalisatie

Laten we nu dieper ingaan op optimalisaties:

- Implementeer dynamische routering met complexiteitsanalyse.

- Gebruik gekwantiseerde modellen voor workloads die tolerant zijn voor latentie.

- Optimaliseer het KV-cachebeheer.

- Implementeer continue batchverwerking voor een hogere doorvoer.

Deze fase vergt meer technische inspanning – doorgaans 1-3 maanden – maar levert een extra kostenbesparing op van 20-40%.

Fase 4: Continue verbetering

Stel feedbackloops in. Monitor welke query's waarheen worden gerouteerd, welke cache-items vaak worden gebruikt en waar latentie- of kwaliteitsproblemen optreden. Gebruik deze gegevens om de routeringslogica te verfijnen, cachebeleid bij te werken en kwantiseringsparameters opnieuw af te stemmen.

Het testen van nieuwe modellen wordt routine. Wanneer leveranciers verbeterde opties introduceren, maakt de instrumentatie snelle A/B-tests mogelijk om de afweging tussen kosten en kwaliteit te valideren vóór de volledige uitrol.

Veelvoorkomende valkuilen die je moet vermijden

Kostenoptimalisatie kan averechts werken wanneer teams de verkeerde meetwaarden optimaliseren of cruciale mogelijkheden opofferen:

- Verslechtering van de latentie: Agressief cachen of routeren naar tragere modellen kan de responstijden tot een onacceptabel niveau voor de gebruiker verhogen. Voor interactieve applicaties is latentie net zo belangrijk als de kosten. Gebruikers haken af bij vertragingen van 3-5 seconden, ongeacht de nauwkeurigheid.

- Kwaliteitsvermindering: Te agressief routeren naar kleine modellen vermindert de uitvoerkwaliteit. Tests tonen mogelijk een acceptabele nauwkeurigheid op benchmarks, maar extreme productiesituaties leggen zwakke punten bloot. Implementeer kwaliteitsbewaking in combinatie met kostenbewaking.

- Over-engineering van caching: Semantische caching voegt complexiteit toe aan de infrastructuur. Voor functionaliteiten met weinig verkeer overstijgen de engineeringkosten voor het implementeren en onderhouden van caching de besparingen. Richt uw cachinginspanningen daarom eerst op endpoints met een hoog verkeersvolume.

- De kosten voor een koude start worden buiten beschouwing gelaten: Het laden en initialiseren van modellen kan de prestaties en kostenefficiëntie beïnvloeden. Schaalbeleid gericht op nul vereist een zorgvuldige afweging van opstartlatentie ten opzichte van de kosten in ruststand. Breng de kosten in ruststand in balans met de opstartlatentie.

- Vendor lock-in: Door diepgaande optimalisatie voor de specifieke API's of prijsstructuur van één aanbieder kunnen migratiebelemmeringen ontstaan. Waar mogelijk, abstraheert u aanbiederspecifieke details achter interfaces die overstappen mogelijk maken.

Verlaag de implementatiekosten van LLM waar ze daadwerkelijk beginnen.

De meeste implementatiekosten van LLM worden niet alleen bepaald door het model zelf, maar ook door de manier waarop het systeem is ontworpen, geïntegreerd en opgeschaald. AI Superieur Ze werken aan de volledige implementatiecyclus, van modelselectie en finetuning tot infrastructuurconfiguratie en -optimalisatie. Hun aanpak is gericht op het bouwen van AI-systemen die aansluiten op de daadwerkelijke werklast, of dat nu betekent dat ze aangepaste modellen gebruiken, bestaande modellen optimaliseren of API-gebruik in balans brengen met interne implementatie. Dit vermindert onnodige inferentie, voorkomt overgedimensioneerde infrastructuur en zorgt ervoor dat de prestaties voorspelbaar blijven naarmate het gebruik toeneemt.

Kostenproblemen bij de implementatie komen meestal voort uit beslissingen die vóór de lancering worden genomen – modelgrootte, datapijplijnen en hoe vaak systemen worden aangeroepen. Het aanpassen hiervan heeft een grotere impact dan later overstappen op andere tools. Wilt u dat uw LLM-implementatie efficiënt blijft naarmate deze schaalbaar is? Neem dan contact met ons op. AI Superieur en stem je configuratie af op hoe deze daadwerkelijk in productie gebruikt zal worden.

Vooruitblik: Kostenontwikkeling

Sommigen geloven dat de kosten van LLM (Living Life Model) tot nul zullen dalen, waardoor optimalisatie overbodig wordt. De geschiedenis wijst echter anders uit.

De rekenkosten zijn al decennialang gestaag gedaald, maar de vraag groeit sneller. Krachtigere modellen maken nieuwe toepassingen mogelijk die extra rekenkracht vereisen. Contextvensters breiden zich uit van 2.048 naar meer dan 128.000 tokens, waardoor de geheugenbehoefte exponentieel toeneemt. Multimodale modellen verwerken afbeeldingen en video naast tekst.

Organisaties die LLM-kosten als strategisch beschouwen – en vroegtijdig optimalisatiemogelijkheden ontwikkelen – creëren concurrentievoordelen die zich in de loop der tijd opstapelen. Kostenefficiëntie maakt duurzame schaalvergroting mogelijk, waardoor bredere implementatie en experimenten mogelijk zijn zonder dat budgetbeperkingen de productontwikkeling belemmeren.

Infrastructuuroptimalisatie, modelselectie en tokenbeheer zijn geen eenmalige projecten. Het zijn kerncompetenties voor AI-native bedrijven. De teams die deze mogelijkheden nu ontwikkelen, zullen opereren met structurele kostenvoordelen die concurrenten moeilijk kunnen evenaren.

Veelgestelde vragen

Wat is de snelste manier om de kosten van LLM met 30% of meer te verlagen?

Implementeer semantische caching voor veelgebruikte query's en routeer eenvoudige verzoeken naar goedkopere modellen. Deze twee wijzigingen leveren doorgaans een kostenbesparing van 30-501 TP3T op binnen 4-6 weken met minimale technische inspanning. Begin met het in kaart brengen van de eindpunten om te bepalen welke eindpunten een hoog aanvraagvolume en een lage querydiversiteit hebben – dit zijn ideale kandidaten voor caching.

Moet ik GPT-4 of Claude gebruiken voor kostenoptimalisatie?

Geen van beide is exclusief. GPT-5.4 rekent $2,50 per miljoen inputtokens, terwijl Claude 4.5 Sonnet $3 per miljoen inputtokens rekent. Maar de kosten per token zijn niet de enige factor; de uitvoerkwaliteit, latentie en vereisten voor de contextlengte spelen ook een rol. Implementeer routing die elk model gebruikt voor workloads waar het de beste afweging tussen kosten, kwaliteit en latentie biedt. Het testen van verschillende modellen op productiedata is de enige manier om de optimale toewijzing te bepalen.

Heeft kwantisering een significant negatief effect op de nauwkeurigheid van het model?

Niet als het correct wordt uitgevoerd. Onderzoek toont aan dat 8-bits kwantisering doorgaans minder dan 11 TP3T aan nauwkeurigheidsverlies veroorzaakt, terwijl de geheugenbehoefte met 501 TP3T wordt verminderd. Zelfs 4-bits kwantisering met zorgvuldige kalibratie (zoals GPTQ) verliest slechts 1-31 TP3T aan nauwkeurigheid en vermindert het geheugen met 751 TP3T. De sleutel is het testen van gekwantiseerde modellen op representatieve evaluatiegegevenssets vóór de implementatie in productie om te valideren dat de prestaties acceptabel zijn.

Hoeveel kan caching in een productieomgeving daadwerkelijk besparen?

Semantische caching haalt doorgaans een hitrate van 40-60% na de eerste week van gebruik voor de meeste applicaties. Voor een supportchatbot die 500.000 maandelijkse verzoeken verwerkt tegen GPT-4-tarieven, vertaalt zich dat in een maandelijkse besparing van $ 7.200-10.800. De effectiviteit varieert echter per gebruikssituatie: FAQ-achtige applicaties behalen hogere hitrates, terwijl creatieve of sterk gepersonaliseerde applicaties minder baat hebben bij caching.

Wat is het rendement op de investering (ROI) van het bouwen van een op maat gemaakte optimalisatie-infrastructuur?

Voor applicaties die maandelijks meer dan 1.400.500 aan LLM-kosten uitgeven, verdient een op maat gemaakte optimalisatie-infrastructuur zichzelf doorgaans binnen 3-6 maanden terug. De investering in engineering bedraagt 2-4 ontwikkelaarsmaanden voor een complete implementatie, inclusief instrumentatie, caching en routing. Organisaties die minder uitgeven, kunnen zich beter richten op eenvoudigere optimalisaties zoals promptcompressie en providerselectie voordat ze een eigen infrastructuur bouwen.

Hoe vind ik de juiste balans tussen kostenoptimalisatie en responstijd?

Meet beide aspecten samen en bepaal de acceptabele afwegingen. Sommige optimalisaties, zoals caching, verlagen zowel de kosten als de latentie. Andere, zoals routering naar kleinere modellen, kunnen de latentie iets verhogen, terwijl de kosten dalen. Definieer SLA's voor latentie voor elk gebruiksscenario: interactieve chat vereist mogelijk reacties binnen een seconde, terwijl batchverwerking van documenten minuten kan tolereren. Optimaliseer binnen de gegeven beperkingen in plaats van kosten of latentie afzonderlijk te behandelen.

Kan ik LLM's lokaal uitvoeren om kosten te besparen?

Misschien. Implementatie op locatie elimineert API-kosten, maar vereist GPU-infrastructuur, technische expertise voor serviceoptimalisatie en operationele overhead. Dit wordt kosteneffectief bij schaalvergroting – ongeveer 500.000+ dagelijkse aanvragen – waarbij de vaste infrastructuurkosten worden afgeschreven over het hoge volume. Onder die drempel zijn beheerde API's doorgaans goedkoper als rekening wordt gehouden met de totale eigendomskosten, inclusief de ontwikkeltijd.

Conclusie

Kostenoptimalisatie voor LLM is niet optioneel voor AI-native producten. De economische aspecten zijn fundamenteel anders dan bij traditionele software: variabele kosten schalen mee met het gebruik, waardoor er een productie-achtige eenheidseconomie ontstaat die continue aandacht vereist.

Maar de mogelijkheden zijn aanzienlijk. Organisaties die een alomvattende optimalisatie doorvoeren – waarbij slimme modelselectie, infrastructuurafstemming, semantische caching en tokenbeheer worden gecombineerd – realiseren kostenbesparingen van 60-851 TP3T zonder in te leveren op kwaliteit of gebruikerservaring.

Begin met instrumentatie. Teams kunnen niet optimaliseren wat ze niet meten. Zorg voor inzicht in tokengebruik, modelselectie en kostenverdeling op aanvraagniveau.

Implementeer vervolgens snel resultaat: cache veelgebruikte query's en routeer eenvoudige verzoeken naar efficiënte modellen. Deze maatregelen leveren direct impact op en bouwen tegelijkertijd aan de capaciteit van de organisatie voor verdere optimalisatie.

Het concurrentievoordeel ligt bij teams die kostenoptimalisatie als een doorlopende discipline beschouwen in plaats van als een eenmalig project. Bouw de infrastructuur op, implementeer de werkwijzen en blijf continu innoveren naarmate gebruikspatronen veranderen en nieuwe modellen ontstaan.

De toekomst van AI-implementatie ligt bij organisaties die zowel de technische als de economische uitdagingen aangaan. Begin vandaag nog met optimaliseren.