Korte samenvatting: AI zal therapeuten niet volledig vervangen, maar zal dienen als een aanvullend hulpmiddel in de geestelijke gezondheidszorg. Onderzoek toont aan dat AI-chatbots in 201% van de gevallen ongepast reageren en de essentiële menselijke connectie en therapeutische relatie die nodig is voor betekenisvolle psychologische verandering niet kunnen nabootsen.

De geestelijke gezondheidszorg bevindt zich op een kruispunt. Door AI aangedreven therapiechatbots nemen in aantal toe en beloven 24/7 toegang tot geestelijke gezondheidszorg zonder wachtlijsten of hoge kosten. Voor therapeuten die deze ontwikkelingen gadeslaan, is de vraag niet alleen academisch, maar ook persoonlijk.

Zullen machines het werk vervangen dat jarenlange training en emotionele intelligentie vereist om onder de knie te krijgen?

Het punt is echter dat het antwoord niet zo simpel is als ja of nee. Recent onderzoek van toonaangevende instellingen schetst een genuanceerder beeld, waarin AI zowel verrassende mogelijkheden als cruciale beperkingen laat zien die niet genegeerd kunnen worden.

Wat onderzoek daadwerkelijk aantoont over AI-therapietools

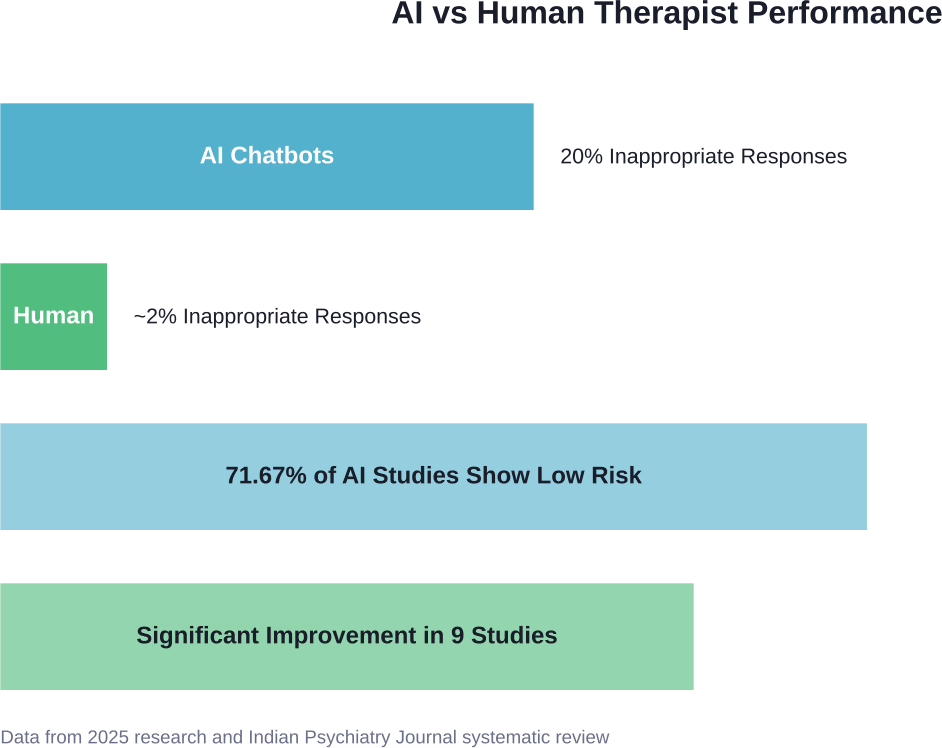

Onderzoek heeft aangetoond dat AI-chatbots die ontworpen zijn voor mentale gezondheidszorg, bij tests in 201% van de gevallen – één op de vijf reacties – ongepast reageerden. Menselijke therapeuten daarentegen gaven in dezelfde situaties zelden ongepaste reacties.

Maar wacht even. Dat is niet het hele verhaal.

Een systematische review, gepubliceerd in het Indian Psychiatry Journal in 2025, onderzocht AI-gestuurde psychologische interventies voor depressie en angst. De resultaten? De meeste studies lieten een laag risico zien (71,671 TP3T), wat duidt op betrouwbaarheid voor specifieke, afgebakende taken. Negen studies met 1082 deelnemende studenten toonden statistisch significante verbeteringen in angst- en depressiescores bij gebruik van AI-chatbots.

Wat is het nu: nuttig of schadelijk?

Het antwoord hangt volledig af van hoe deze tools worden ingezet. AI-therapietools werken goed voor specifieke toepassingen: het bijhouden van symptomen, cognitieve gedragstherapie, ondersteuning via sms-berichten in crisissituaties en psycho-educatie. Ze hebben echter moeite – soms zelfs op gevaarlijke wijze – met complexe situaties die klinisch oordeel, veiligheidsbeoordelingen en ingewikkelde traumaverwerking vereisen.

De cijfers liegen niet.

Volgens een onderzoek gepubliceerd in BMC Psychiatry (en beschikbaar via PubMed) bedroeg het percentage verkeerde diagnoses van ernstige psychiatrische stoornissen in Ethiopië 39,161 TP3T, met hogere percentages onder niet-specialisten. Dit onderstreept een cruciaal punt: zelfs menselijke behandelaars hebben moeite met het stellen van accurate diagnoses zonder de juiste training.

AI-systemen staan voor vergelijkbare uitdagingen, maar missen het vermogen om bij te sturen door middel van empathie en klinische intuïtie.

Waar AI daadwerkelijk bijdraagt aan de geestelijke gezondheidszorg

Ondanks de beperkingen zijn AI-tools niet nutteloos. Integendeel.

Onderzoek gepubliceerd in JMIR Mental Health in 2025 onderzocht op cognitieve gedragstherapie gebaseerde chatbots voor depressie en angst. De bevindingen brachten verschillende gebieden aan het licht waar AI-tools daadwerkelijke waarde bieden:

- Toegankelijkheid en schaalbaarheid: AI-chatbots bieden directe toegang tot geestelijke gezondheidszorg zonder afspraak, geografische beperkingen of belemmeringen door de zorgverzekering. Voor achtergestelde bevolkingsgroepen die te maken hebben met stigma of een beperkt aanbod aan zorgverleners, is dit van enorm belang.

- Constante beschikbaarheid: Psychische crisissen houden geen rekening met kantooruren. AI-tools bieden 24/7 ondersteuning wanneer menselijke therapeuten simpelweg niet beschikbaar zijn.

- Lagere kostendrempels: Hoewel de prijzen per platform verschillen, kosten AI-therapietools doorgaans veel minder dan traditionele therapiesessies, waardoor geestelijke gezondheidszorg toegankelijk wordt voor mensen die de standaardtarieven niet kunnen betalen.

- Verminderde administratieve lasten: Generatieve AI biedt veelbelasting voor het afhandelen van administratie, het maken van aantekeningen en het documenteren van behandelplannen, waardoor artsen zich kunnen concentreren op de directe patiëntenzorg.

Praktische toepassingen die werken

Op CBT gebaseerde chatbots lijken bijzonder effectief voor gestructureerde interventies. Deze systemen begeleiden individuen door middel van op bewijs gebaseerde oefeningen: gedachtenregistratie, gedragsactivering, blootstellingshiërarchieën en ontspanningstechnieken.

Voor studenten – een groep die steeds vaker te maken heeft met psychische problemen – lieten AI-chatbots die zich richten op aandoeningen zoals gedefinieerd in de DSM-5 meetbare verbeteringen zien. Studies documenteerden een afname van de GAD-7-angstscores en depressieve symptomen.

Desondanks vormen de variabiliteit in onderzoeksopzet en de heterogeniteit in de rapportage van uitkomsten een uitdaging voor brede generaliseerbaarheid. De bewijsbasis blijft veelbelovend, maar is nog onvolledig.

Ontdek waar AI een rol speelt in de therapie voordat je grote veranderingen verwacht.

AI wordt soms gezien als een vervanging voor therapeuten, maar in werkelijkheid speelt het een ondersteunende rol. Het kan helpen bij het structureren van informatie, het blootleggen van patronen in data of het assisteren bij routinetaken, terwijl de kern van therapie – vertrouwen, context en menselijke verbinding – onveranderd blijft.

AI Superieur Ze richten zich op het bruikbaar maken van AI binnen bestaande werkprocessen. Ze werken samen met organisaties om duidelijke use cases te definiëren en ontwikkelen en integreren vervolgens maatwerkoplossingen die aansluiten op de manier waarop diensten al worden geleverd, in plaats van een volledig nieuwe opzet te forceren.

Als u overweegt AI in te zetten in therapie of geestelijke gezondheidszorg, is het verstandiger om klein te beginnen en het in de praktijk te testen. Neem contact op. AI Superieur Om te onderzoeken wat er verbeterd kan worden zonder de huidige manier van werken van je team te verstoren.

De onvervangbare menselijke elementen

Nu wordt het interessant.

Therapie gaat niet alleen over het verstrekken van correcte informatie of het volgen van behandelprotocollen. De therapeutische relatie zelf – de band tussen therapeut en cliënt – is een belangrijke drijvende kracht achter het genezingsproces.

Onderzoek toont consequent aan dat de therapeutische alliantie een betrouwbaardere voorspeller is van behandelresultaten dan specifieke interventietechnieken. Cliënten die zich echt begrepen, erkend en gesteund voelen, boeken betere vooruitgang, ongeacht de gebruikte therapievorm.

Kan AI dat nabootsen?

Nog niet. Waarschijnlijk nooit, in de meest volledige zin van het woord.

Volgens onderzoek gepubliceerd in Frontiers in Psychology blijft de noodzaak van menselijke interactie in de geestelijke gezondheidszorg van het grootste belang. AI-systemen missen echter een aantal cruciale eigenschappen:

| Menselijke therapeutische capaciteit | Huidige status van AI | Waarom het belangrijk is |

|---|---|---|

| Echte empathie en emotionele afstemming | Alleen gesimuleerde reacties | Klanten herkennen authenticiteit; vertrouwen hangt ervan af. |

| Complexe veiligheidsbeoordelingen | Beperkt door trainingsgegevens | Een beoordeling van het zelfmoordrisico vereist een genuanceerd oordeel. |

| Culturele competentie en context | Ontbreekt vaak aan culturele specificiteit. | Effectieve therapie moet rekening houden met culturele achtergronden. |

| Ethische besluitvorming in grijze gebieden | Heeft moeite met ambigue situaties. | Geestelijke gezondheid kent zelden eenduidige scenario's. |

| Adaptieve flexibiliteit | Beperkt door programmering | Mensen passen zich aan op basis van feedback van moment tot moment. |

Eerlijk gezegd: therapie is moeilijk. Dat is ook de bedoeling. Groei vindt plaats in ongemakkelijke situaties, en bekwame therapeuten weten hoe ze cliënten op een productieve manier kunnen stimuleren, zonder hun veiligheid in gevaar te brengen.

AI-chatbots kunnen niet aanvoelen wanneer iemands lichaamstaal in tegenspraak is met wat hij of zij zegt. Ze kunnen de veelbetekenende stilte voor een antwoord niet opmerken. Ze voelen de zwaarte van iemands pijn niet en vieren het doorbraakmoment niet wanneer het inzicht plotseling doordringt.

Wat deskundigen op het gebied van geestelijke gezondheid daadwerkelijk zeggen

De American Psychological Association heeft ethische richtlijnen gepubliceerd voor het gebruik van AI in de beroepspraktijk. In hun standpunt erkennen ze zowel de potentiële voordelen als de ernstige zorgen over ongereguleerde AI-tools voor de geestelijke gezondheidszorg.

Vakdeskundigen benadrukken steevast een cruciaal onderscheid: AI als aanvulling versus AI als vervanging.

Augmentatie betekent het gebruik van AI om het klinische werk van mensen te verbeteren – geautomatiseerde screeningsinstrumenten, transcriptie van sessienotities, het bijhouden van symptomen tussen afspraken en het aanbieden van psycho-educatieve inhoud. Deze aanpak benut de sterke punten van technologie met behoud van menselijk toezicht.

Vervanging betekent dat menselijke therapeuten volledig door AI worden vervangen. De meeste experts beschouwen dit als ongeschikt voor een alomvattende geestelijke gezondheidszorg, met name voor mensen met ernstige psychische aandoeningen, complexe trauma's of acute veiligheidsrisico's.

Beoefenaars van de geneeskunde hebben uiteenlopende meningen over AI-tools, variërend van voorzichtig optimisme tot grote bezorgdheid. Veel beoefenaars zien AI-tools als potentiële hulpmiddelen om de toegang tot zorg te vergroten, maar maken zich zorgen over kwaliteitscontrole, aansprakelijkheidskwesties en de devaluatie van klinische expertise.

Het stigma-probleem

Het onderzoek van Stanford bracht het volgende aan het licht: ongereguleerde AI-chatbots kunnen bijdragen aan het stigma rond geestelijke gezondheid en gevaarlijk advies geven.

Zonder adequaat toezicht kunnen AI-systemen schadelijke stereotypen versterken, te simpele oplossingen bieden voor complexe problemen, of niet herkennen wanneer professionele interventie dringend nodig is.

Een van de reacties van een chatbot die in het onderzoek werd geanalyseerd, vertelde iemand die veel leed er in feite op neer te komen dat iedereen zich wel eens zo voelt – een reactie die echt leed bagatelliseert en mensen ervan kan weerhouden hulp te zoeken.

De crisis van sociale verbondenheid

Kijk, er is een bredere context die het waard is om te onderzoeken.

Sociale isolatie in de Verenigde Staten heeft alarmerende proporties aangenomen. Volgens Brookings heeft slechts 131% van de volwassenen nu tien of meer goede vrienden – een daling ten opzichte van 331% in 1990. Jongeren ervaren met name ernstige isolatie, ondanks dat ze in een tijdperk leven met de meeste technologische verbindingen in de geschiedenis.

Wat gebeurt er als AI-chatbots het echte menselijke contact in therapeutische contexten vervangen?

Sommige onderzoekers vrezen dat dit sociale isolatie eerder zal verergeren dan oplossen. Als mensen zich steeds vaker tot AI wenden voor emotionele steun in plaats van menselijke relaties op te bouwen – therapeutisch of anderszins – kunnen de gevolgen voor de geestelijke gezondheid op de lange termijn aanzienlijk zijn.

Mensen hebben een aangeboren behoefte aan verbinding. Therapie werkt mede doordat het een corrigerende emotionele ervaring biedt: je echt gezien en geaccepteerd voelen door een ander. Een AI-systeem, hoe geavanceerd ook, kan die fundamentele menselijke behoefte niet vervullen.

Regelgeving en toezichtskwesties

Hier wordt het ingewikkeld.

De AI-sector voor geestelijke gezondheidszorg is grotendeels ongereguleerd. Bedrijven kunnen therapiechatbots lanceren zonder klinisch toezicht, op bewijs gebaseerde protocollen of veiligheidstests die vergelijkbaar zijn met de tests waaraan farmaceutische bedrijven of fabrikanten van medische hulpmiddelen moeten voldoen.

Dit brengt ernstige risico's met zich mee. AI-systemen die getraind zijn op bevooroordeelde data kunnen verschillende zorgkwaliteit leveren aan verschillende bevolkingsgroepen. Chatbots zonder de juiste beveiligingsmaatregelen kunnen waarschuwingssignalen van ernstige aandoeningen missen of advies geven dat de symptomen verergert.

De American Psychological Association en andere beroepsorganisaties hebben opgeroepen tot ethische richtlijnen en regelgevende kaders, maar de implementatie ervan loopt ver achter op de technologische ontwikkeling.

Zowel hulpverleners als patiënten hebben behoefte aan bescherming: duidelijke normen voor wat AI-tools voor geestelijke gezondheidszorg wel en niet mogen doen, transparantie over beperkingen en verantwoording wanneer systemen schade veroorzaken.

De economische realiteit

Onderzoek van Brookings naar de verschuiving van banen door AI onthult zorgwekkende trends. Meer dan 301.000 ton van alle werknemers zou minstens 501.000 ton van hun taken kunnen verliezen door generatieve AI-technologie. Administratieve functies en midden- tot hoogbetaalde beroepen lopen een bijzonder groot risico.

Maar geldt dit ook voor therapeuten?

Gedeeltelijk. Functies op instapniveau in de therapeutische ondersteuning – zoals vrijwilligers bij crisislijnen, ervaringsdeskundigen en intakecoördinatoren – zouden kunnen worden verdrongen door AI-tools. Zeer gespecialiseerd klinisch werk waarvoor een geavanceerde opleiding vereist is, lijkt veiliger, althans voorlopig.

Het bredere arbeidsmarktpatroon laat zien dat omscholingsprogramma's vaak moeite hebben om ontslagen werknemers succesvol te begeleiden bij de overgang naar een nieuwe baan. De deelname aan omscholingsprogramma's varieert aanzienlijk per staat, van 141 tot 961 voor klassikale training.

Voor professionals in de geestelijke gezondheidszorg betekent relevant blijven waarschijnlijk dat ze AI als hulpmiddel moeten omarmen en tegelijkertijd unieke menselijke competenties moeten verdiepen: het conceptualiseren van complexe casussen, culturele bescheidenheid, ethisch redeneren en het opbouwen van relaties.

Hoe de toekomst er daadwerkelijk uitziet

Waar staan we nu?

Het meest realistische scenario is niet volledige vervanging, maar transformatie. AI-tools zullen steeds vaker routinetaken overnemen: symptoomscreening, afspraakplanning, sessienotities, huiswerkopdrachten, psycho-educatiemodules en ondersteuning tussen sessies.

Menselijke therapeuten zullen zich richten op wat machines niet kunnen: het opbouwen van therapeutische relaties, het omgaan met complexe klinische problematiek, het aanpakken van trauma's en hechtingsproblemen, het nemen van genuanceerde veiligheidsbeslissingen en het bieden van de authentieke menselijke aanwezigheid die genezing bevordert.

Dit hybride model zou de toegang tot geestelijke gezondheidszorg juist kunnen vergroten. AI-tools fungeren als eerste ondersteuningslijn en verwijzen door naar menselijke behandelaars wanneer de complexiteit of het risico toeneemt. Zo krijgen meer mensen een vorm van ondersteuning; degenen die menselijke tussenkomst nodig hebben, ontvangen die nog steeds.

Onderzoek naar generatieve, door AI ondersteunde therapiehulpmiddelen laat veelbelovende resultaten zien wanneer AI een aanvulling vormt op door mensen geleide groepstherapie. Deze combinatie verbetert zowel de effectiviteit als de therapietrouw in de geestelijke gezondheidszorg.

Dat is de ideale situatie: AI die doet waar ze goed in is, en mensen die leveren wat alleen mensen kunnen bieden.

Veelgestelde vragen

Kunnen AI-chatbots voor therapie echt helpen bij depressie en angst?

Onderzoek toont aan dat AI-chatbots meetbare verbeteringen kunnen opleveren bij milde tot matige depressie en angst, met name wanneer ze gestructureerde cognitieve gedragstherapie-oefeningen aanbieden. Negen studies met 1082 deelnemende studenten lieten statistisch significante verbeteringen zien in angst- en depressiescores. Deze tools werken echter het beste als aanvulling op professionele zorg, niet als vervanging ervan, vooral niet bij ernstige aandoeningen.

Zijn AI-therapie-apps veilig in gebruik?

De veiligheid verschilt enorm. Onderzoek heeft aangetoond dat AI-chatbots in 201% van de gevallen ongepast reageren en dat ongereguleerde systemen kunnen bijdragen aan stigmatisering of gevaarlijk advies kunnen geven. Voor basispsycho-educatie en het bijhouden van symptomen zijn veel AI-tools redelijk veilig. Voor crisisinterventie, complexe psychische aandoeningen of traumaverwerking blijft professionele menselijke ondersteuning essentieel. Controleer altijd of een app onder klinisch toezicht staat.

Zullen therapeuten hun baan verliezen aan AI?

Volledige vervanging is onwaarschijnlijk. AI zal therapeutisch werk waarschijnlijk eerder transformeren dan elimineren. Ondersteunende functies op instapniveau lopen een groter risico op verdringing, terwijl gespecialiseerde klinische functies die complex oordeelsvermogen, culturele competentie en vaardigheden op het gebied van relatieopbouw vereisen, moeilijk door AI te repliceren zijn. Therapeuten die AI-tools integreren en tegelijkertijd hun unieke menselijke competenties verder ontwikkelen, zullen waarschijnlijk succesvol zijn.

Wat kan AI beter dan menselijke therapeuten?

AI blinkt uit in 24/7 beschikbaarheid, directe toegang zonder wachttijden voor afspraken, lagere kosten, consistente levering van gestructureerde interventies, het bijhouden van symptomen in de loop van de tijd, automatisering van administratieve taken en schaalbaarheid naar achtergestelde bevolkingsgroepen. Deze sterke punten maken AI waardevol voor het verbeteren van de toegang tot geestelijke gezondheidszorg, met name voor initiële ondersteuning en het blijven oefenen van vaardigheden tussen therapiesessies.

Wat kan AI niet vervangen in de therapie?

AI kan geen echte empathie, authentieke menselijke verbinding, complexe veiligheidsbeoordelingen voor zelfmoord- of schaderisico's, genuanceerde culturele competentie, ethische besluitvorming in ambigue situaties, traumaverwerking die afstemming vereist, of de therapeutische relatie zelf bieden – waarvan onderzoek aantoont dat die de behandelresultaten beter voorspelt dan specifieke technieken. Het menselijk vermogen om onuitgesproken emoties aan te voelen en zich flexibel aan te passen, ligt nog steeds buiten het bereik van de huidige AI-mogelijkheden.

Hoe accuraat zijn AI-diagnoses op het gebied van geestelijke gezondheid?

De diagnostische nauwkeurigheid van AI varieert sterk, afhankelijk van de aandoening en de kwaliteit van de trainingsdata. Onderzoek toont aan dat zelfs menselijke artsen vaak verkeerde diagnoses stellen (39,161 TP3T voor ernstige psychiatrische stoornissen in één onderzoek), met name onder niet-specialisten. AI-systemen staan voor vergelijkbare uitdagingen, omdat ze niet in staat zijn om hun diagnose bij te sturen op basis van klinische intuïtie. AI-diagnostische tools moeten een uitgebreide professionele evaluatie ondersteunen, niet vervangen.

Zou ik een AI-chatbot moeten gebruiken in plaats van naar een therapeut te gaan?

Voor directe ondersteuning, psycho-educatie of het oefenen van copingvaardigheden wanneer professionele hulp niet beschikbaar is, kunnen AI-chatbots waardevol zijn. Ze mogen echter geen vervanging zijn voor professionele therapie bij matige tot ernstige psychische aandoeningen, trauma's, acute veiligheidsproblemen of situaties die een diagnostische beoordeling vereisen. Beschouw AI-tools als aanvullende ondersteuning en niet als vervanging voor integrale zorg.

De kern van de zaak

Zal AI therapeuten vervangen? Nee, maar het zal wel de manier waarop therapie werkt veranderen.

De bewijzen wijzen op een toekomst van samenwerking waarin technologie de toegang vergroot, terwijl menselijke expertise centraal blijft staan voor effectieve geestelijke gezondheidszorg. AI neemt routinetaken over en biedt directe ondersteuning; mensen navigeren door complexe situaties en bouwen helende relaties op.

Het gaat hier niet om de keuze tussen menselijke therapeuten en AI-tools. Het gaat erom beide op een doordachte manier te integreren om meer mensen effectiever te kunnen helpen.

Voor therapeuten die zich zorgen maken over achterhaaldheid: verdiep uw relatievaardigheden, culturele competentie en het vermogen om complexe casussen te behandelen. Deze unieke menselijke capaciteiten worden steeds waardevoller naarmate AI routinewerk overneemt.

Voor mensen die hulp zoeken bij hun geestelijke gezondheid: gebruik AI-tools als opstapje of aanvulling, maar vermijd menselijk contact niet wanneer je voor ernstige problemen staat. De therapeutische relatie zelf heeft een helende kracht die algoritmes niet kunnen nabootsen.

De geestelijke gezondheidszorg bevindt zich inderdaad op een kruispunt, maar de weg vooruit loopt waarschijnlijk via samenwerking in plaats van vervanging. Technologie en menselijkheid die samenwerken, kunnen er uiteindelijk voor zorgen dat kwalitatief goede geestelijke gezondheidszorg toegankelijk wordt voor iedereen die het nodig heeft.